Låsning af nøjagtige og indsigtsfulde svar fra enorme mængder tekst er en spændende mulighed, der er muliggjort af store sprogmodeller (LLM'er). Når man bygger LLM-applikationer, er det ofte nødvendigt at forbinde og forespørge eksterne datakilder for at give relevant kontekst til modellen. En populær tilgang er at bruge Retrieval Augmented Generation (RAG) til at skabe Q&A-systemer, der forstår kompleks information og giver naturlige svar på forespørgsler. RAG giver modeller mulighed for at udnytte enorme vidensbaser og levere menneskelignende dialog til applikationer som chatbots og virksomhedssøgeassistenter.

I dette indlæg undersøger vi, hvordan du kan udnytte kraften i Lamaindeks, Lama 2-70B-Chatog Langkæde at bygge kraftfulde Q&A-applikationer. Med disse avancerede teknologier kan du indtage tekstkorpus, indeksere kritisk viden og generere tekst, der besvarer brugernes spørgsmål præcist og klart.

Lama 2-70B-Chat

Llama 2-70B-Chat er en kraftfuld LLM, der konkurrerer med førende modeller. Det er fortrænet på to billioner tekst-tokens og beregnet af Meta til at blive brugt til chat-assistance til brugere. Før-træningsdata er hentet fra offentligt tilgængelige data og afsluttes fra september 2022, og finjusteringsdata slutter juli 2023. For flere detaljer om modellens træningsproces, sikkerhedsovervejelser, læring og tilsigtede anvendelser henvises til papiret Llama 2: Open Foundation og finjusterede chatmodeller. Llama 2 modeller er tilgængelige på Amazon SageMaker JumpStart for en hurtig og ligetil implementering.

Lamaindeks

Lamaindeks er en dataramme, der gør det muligt at bygge LLM-applikationer. Det giver værktøjer, der tilbyder dataforbindelser til at indlæse dine eksisterende data med forskellige kilder og formater (PDF'er, dokumenter, API'er, SQL og mere). Uanset om du har data gemt i databaser eller i PDF'er, gør LlamaIndex det ligetil at tage disse data i brug til LLM'er. Som vi demonstrerer i dette indlæg, gør LlamaIndex API'er dataadgang ubesværet og giver dig mulighed for at skabe kraftfulde brugerdefinerede LLM-applikationer og arbejdsgange.

Hvis du eksperimenterer og bygger med LLM'er, er du sandsynligvis bekendt med LangChain, som tilbyder en robust ramme, der forenkler udviklingen og implementeringen af LLM-drevne applikationer. I lighed med LangChain tilbyder LlamaIndex en række værktøjer, herunder dataforbindelser, dataindekser, motorer og dataagenter, samt applikationsintegrationer såsom værktøjer og observerbarhed, sporing og evaluering. LlamaIndex fokuserer på at bygge bro mellem dataene og kraftfulde LLM'er og strømline dataopgaver med brugervenlige funktioner. LlamaIndex er specifikt designet og optimeret til at bygge søge- og genfindingsapplikationer, såsom RAG, fordi det giver en enkel grænseflade til at forespørge LLM'er og hente relevante dokumenter.

Løsningsoversigt

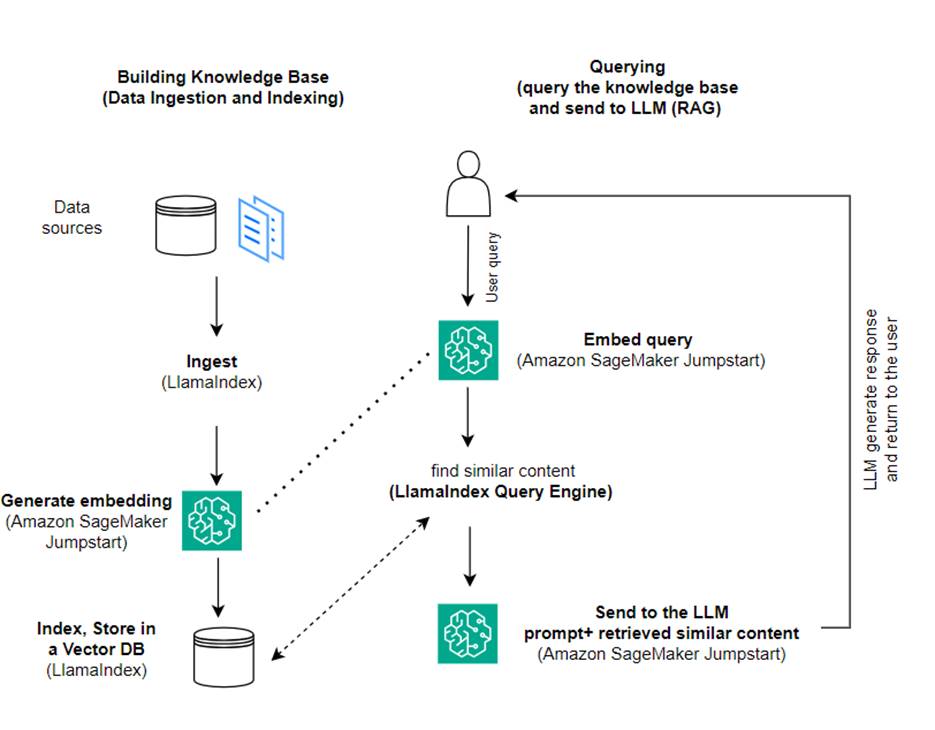

I dette indlæg demonstrerer vi, hvordan man opretter en RAG-baseret applikation ved hjælp af LlamaIndex og en LLM. Følgende diagram viser trin-for-trin-arkitekturen for denne løsning skitseret i de følgende afsnit.

RAG kombinerer informationssøgning med naturlig sproggenerering for at producere mere indsigtsfulde svar. Når du bliver bedt om det, søger RAG først tekstkorpus for at hente de mest relevante eksempler til input. Under responsgenerering betragter modellen disse eksempler for at øge dens muligheder. Ved at inkorporere relevante hentede passager har RAG-svar en tendens til at være mere faktuelle, sammenhængende og konsistente med kontekst sammenlignet med grundlæggende generative modeller. Denne hentningsgenererede ramme udnytter styrkerne ved både hentning og generering, og hjælper med at løse problemer som gentagelse og mangel på kontekst, der kan opstå fra rene autoregressive samtalemodeller. RAG introducerer en effektiv tilgang til opbygning af samtaleagenter og AI-assistenter med kontekstualiserede svar af høj kvalitet.

Opbygning af løsningen består af følgende trin:

- Opsætning Amazon SageMaker Studio som udviklingsmiljø og installere de nødvendige afhængigheder.

- Implementer en indlejringsmodel fra Amazon SageMaker JumpStart-hubben.

- Download pressemeddelelser til brug som vores eksterne vidensbase.

- Byg et indeks ud af pressemeddelelserne for at kunne forespørge og tilføje som yderligere kontekst til prompten.

- Spørg vidensbasen.

- Byg en Q&A-applikation ved hjælp af LlamaIndex og LangChain-agenter.

Al koden i dette indlæg er tilgængelig i GitHub repo.

Forudsætninger

Til dette eksempel har du brug for en AWS-konto med et SageMaker-domæne og passende AWS identitets- og adgangsstyring (IAM) tilladelser. For instruktioner om kontoopsætning, se Opret en AWS-konto. Hvis du ikke allerede har et SageMaker-domæne, henvises til Amazon SageMaker domæne overblik for at oprette en. I dette indlæg bruger vi AmazonSageMakerFullAccess rolle. Det anbefales ikke, at du bruger denne legitimation i et produktionsmiljø. I stedet bør du oprette og bruge en rolle med mindste privilegerede tilladelser. Du kan også undersøge, hvordan du kan bruge Amazon SageMaker Rolle Manager at bygge og administrere personbaserede IAM-roller til almindelige maskinlæringsbehov direkte gennem SageMaker-konsollen.

Derudover skal du have adgang til et minimum af følgende instansstørrelser:

- ml.g5.2xlarge til slutpunktsbrug ved implementering af Krammer ansigt GPT-J tekstindlejringsmodel

- ml.g5.48xlarge til brug af slutpunkt ved implementering af Llama 2-Chat-modellens slutpunkt

For at øge din kvote, se Anmodning om kontingentforhøjelse.

Implementer en GPT-J-indlejringsmodel ved hjælp af SageMaker JumpStart

Dette afsnit giver dig to muligheder, når du implementerer SageMaker JumpStart-modeller. Du kan bruge en kodebaseret implementering ved at bruge den medfølgende kode eller bruge SageMaker JumpStart-brugergrænsefladen (UI).

Implementer med SageMaker Python SDK

Du kan bruge SageMaker Python SDK til at implementere LLM'erne, som vist i kode tilgængelig i depotet. Udfør følgende trin:

- Indstil den instansstørrelse, der skal bruges til implementering af indlejringsmodellen ved hjælp af

instance_type = "ml.g5.2xlarge" - Find det ID, som modellen skal bruge til indlejringer. I SageMaker JumpStart er det identificeret som

model_id = "huggingface-textembedding-gpt-j-6b-fp16" - Hent den præ-trænede modelbeholder og implementer den til slutninger.

SageMaker returnerer navnet på modellens slutpunkt og følgende meddelelse, når indlejringsmodellen er blevet implementeret med succes:

Implementer med SageMaker JumpStart i SageMaker Studio

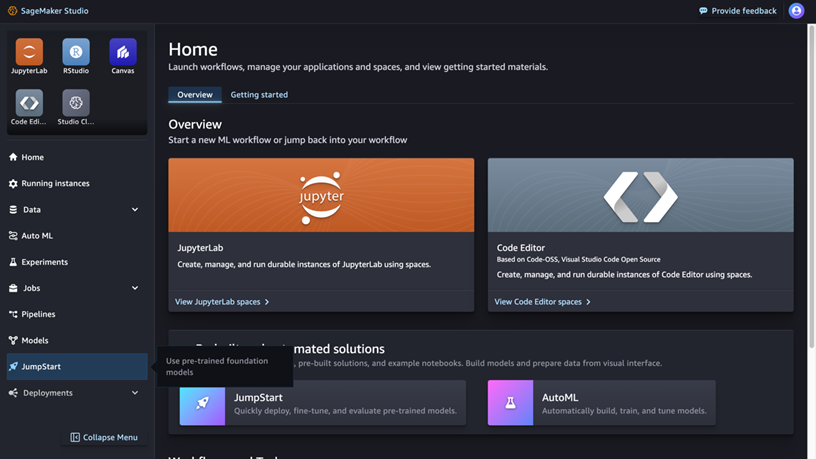

Udfør følgende trin for at implementere modellen ved hjælp af SageMaker JumpStart i Studio:

- På SageMaker Studio-konsollen skal du vælge JumpStart i navigationsruden.

- Søg efter og vælg GPT-J 6B Embedding FP16-modellen.

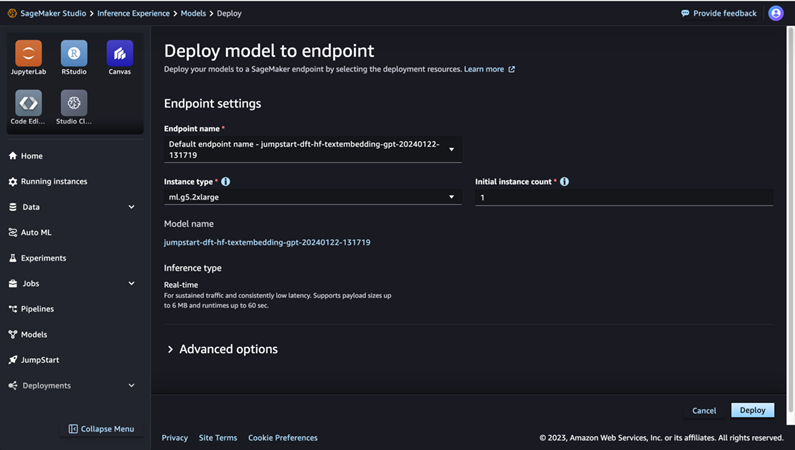

- Vælg Implementer og tilpas implementeringskonfigurationen.

- Til dette eksempel har vi brug for en ml.g5.2xlarge-instans, som er standardinstansen foreslået af SageMaker JumpStart.

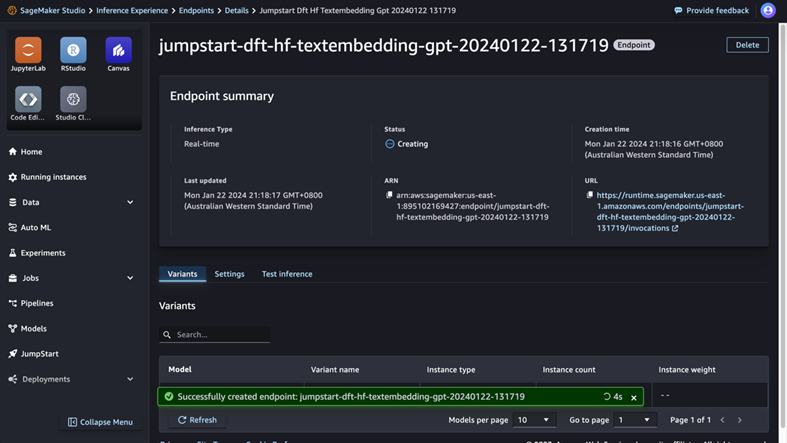

- Vælg Implementer igen for at oprette slutpunktet.

Slutpunktet vil tage cirka 5-10 minutter at være i drift.

Efter du har implementeret indlejringsmodellen, for at bruge LangChain-integrationen med SageMaker API'er, skal du oprette en funktion til at håndtere input (råtekst) og transformere dem til indlejringer ved hjælp af modellen. Det gør du ved at oprette en klasse kaldet ContentHandler, som tager en JSON af inputdata og returnerer en JSON af tekstindlejringer: class ContentHandler(EmbeddingsContentHandler).

Send modellens slutpunkts navn til ContentHandler funktion til at konvertere teksten og returnere indlejringer:

Du kan finde slutpunktets navn i enten output fra SDK eller i installationsdetaljerne i SageMaker JumpStart UI.

Du kan teste, at ContentHandler funktion og slutpunkt fungerer som forventet ved at indtaste noget rå tekst og køre embeddings.embed_query(text) fungere. Du kan bruge det viste eksempel text = "Hi! It's time for the beach" eller prøv din egen tekst.

Implementer og test Llama 2-Chat ved hjælp af SageMaker JumpStart

Nu kan du implementere modellen, der er i stand til at føre interaktive samtaler med dine brugere. I dette tilfælde vælger vi en af Llama 2-chat-modellerne, der identificeres via

Modellen skal implementeres til et slutpunkt i realtid ved hjælp af predictor = my_model.deploy(). SageMaker returnerer modellens slutpunktsnavn, som du kan bruge til endpoint_name variabel til senere reference.

Du definerer en print_dialogue funktion til at sende input til chatmodellen og modtage dens outputsvar. Nyttelasten inkluderer hyperparametre for modellen, herunder følgende:

- max_new_tokens – Refererer til det maksimale antal tokens, som modellen kan generere i sine output.

- top_s – Refererer til den kumulative sandsynlighed for de tokens, der kan beholdes af modellen, når den genererer dens output

- temperatur – Henviser til tilfældigheden af de output, der genereres af modellen. En temperatur større end 0 eller lig med 1 øger niveauet af tilfældighed, hvorimod en temperatur på 0 vil generere de mest sandsynlige tokens.

Du bør vælge dine hyperparametre baseret på din use case og teste dem korrekt. Modeller som f.eks. Llama-familien kræver, at du medtager en ekstra parameter, der angiver, at du har læst og accepteret slutbrugerlicensaftalen (EULA):

For at teste modellen skal du udskifte indholdssektionen af input-nyttelasten: "content": "what is the recipe of mayonnaise?". Du kan bruge dine egne tekstværdier og opdatere hyperparametrene for at forstå dem bedre.

I lighed med implementeringen af indlejringsmodellen kan du implementere Llama-70B-Chat ved hjælp af SageMaker JumpStart UI:

- Vælg på SageMaker Studio-konsollen Forspring i navigationsruden

- Søg efter og vælg

Llama-2-70b-Chat model - Accepter EULA og vælg Implementer, ved at bruge standardforekomsten igen

I lighed med indlejringsmodellen kan du bruge LangChain-integration ved at oprette en indholdshåndteringsskabelon til input og output fra din chatmodel. I dette tilfælde definerer du inputs som dem, der kommer fra en bruger, og angiver, at de er styret af system prompt. Det system prompt informerer modellen om dens rolle i at hjælpe brugeren til en bestemt brugssag.

Denne indholdshandler videregives derefter, når modellen kaldes, ud over de førnævnte hyperparametre og brugerdefinerede attributter (EULA-accept). Du analyserer alle disse attributter ved hjælp af følgende kode:

Når slutpunktet er tilgængeligt, kan du teste, at det fungerer som forventet. Du kan opdatere llm("what is amazon sagemaker?") med din egen tekst. Du skal også definere det specifikke ContentHandler at påberåbe LLM ved hjælp af LangChain, som vist i kode og følgende kodestykke:

Brug LlamaIndex til at bygge RAG'en

For at fortsætte skal du installere LlamaIndex for at oprette RAG-applikationen. Du kan installere LlamaIndex ved hjælp af pip: pip install llama_index

Du skal først indlæse dine data (vidensbase) til LlamaIndex til indeksering. Dette involverer et par trin:

- Vælg en dataindlæser:

LlamaIndex giver en række dataforbindelser tilgængelige på LamaHub til almindelige datatyper som JSON, CSV og tekstfiler samt andre datakilder, så du kan indtage en række datasæt. I dette indlæg bruger vi SimpleDirectoryReader at indtage et par PDF-filer som vist i koden. Vores dataeksempel er to Amazon-pressemeddelelser i PDF-version i pressemeddelelser mappe i vores kodelager. Når du har indlæst PDF'erne, kan du se, at de er blevet konverteret til en liste med 11 elementer.

I stedet for at indlæse dokumenterne direkte, kan du også skjule Document objekt ind Node objekter, før de sendes til indekset. Valget mellem at sende det hele Document gøre indsigelse mod indekset eller konvertere dokumentet til Node objekter før indeksering afhænger af din specifikke use case og strukturen af dine data. Nodetilgangen er generelt et godt valg til lange dokumenter, hvor du ønsker at bryde og hente specifikke dele af et dokument frem for hele dokumentet. For mere information, se Dokumenter / Noder.

- Instantér loaderen og indlæs dokumenterne:

Dette trin initialiserer loader-klassen og enhver nødvendig konfiguration, såsom om skjulte filer skal ignoreres. For flere detaljer, se SimpleDirectoryReader.

- Ring til læsseren

load_datametode til at analysere dine kildefiler og data og konvertere dem til LlamaIndex Document-objekter, klar til indeksering og forespørgsel. Du kan bruge følgende kode til at fuldføre dataindtagelsen og forberedelsen til fuldtekstsøgning ved hjælp af LlamaIndex's indekserings- og genfindingsfunktioner:

- Byg indekset:

Nøgletræk ved LlamaIndex er dets evne til at konstruere organiserede indekser over data, som er repræsenteret som dokumenter eller noder. Indekseringen letter effektiv forespørgsel over dataene. Vi opretter vores indeks med standard-in-memory vektorlageret og med vores definerede indstillingskonfiguration. Lamaindekset Indstillinger er et konfigurationsobjekt, der giver almindeligt anvendte ressourcer og indstillinger til indekserings- og forespørgselsoperationer i et LlamaIndex-program. Det fungerer som et singleton-objekt, så det giver dig mulighed for at indstille globale konfigurationer, samtidig med at det giver dig mulighed for at tilsidesætte specifikke komponenter lokalt ved at overføre dem direkte til de grænseflader (såsom LLM'er, indlejringsmodeller), der bruger dem. Når en bestemt komponent ikke eksplicit er angivet, falder LlamaIndex-rammen tilbage til de indstillinger, der er defineret i Settings objekt som en global standard. At bruge vores indlejrings- og LLM-modeller med LangChain og konfigurere Settings vi skal installere llama_index.embeddings.langchain , llama_index.llms.langchain. Vi kan konfigurere Settings objekt som i følgende kode:

Som standard VectorStoreIndex bruger en in-memory SimpleVectorStore der er initialiseret som en del af standardlagringskonteksten. I virkelige use cases skal du ofte oprette forbindelse til eksterne vektorbutikker som f.eks Amazon OpenSearch Service. For flere detaljer, se Vector Engine til Amazon OpenSearch Serverless.

Nu kan du køre Q&A over dine dokumenter ved at bruge query_engine fra LlamaIndex. For at gøre det skal du sende det indeks, du oprettede tidligere for forespørgsler, og stille dit spørgsmål. Forespørgselsmotoren er en generisk grænseflade til at forespørge data. Det tager en naturlig sprogforespørgsel som input og returnerer et rigt svar. Forespørgselsmotoren er typisk bygget oven på en eller flere indekser ved brug af retrievere.

Du kan se, at RAG-løsningen er i stand til at hente det rigtige svar fra de medfølgende dokumenter:

Brug LangChain værktøjer og agenter

Loader klasse. Indlæseren er designet til at indlæse data i LlamaIndex eller efterfølgende som et værktøj i en LangChain agent. Dette giver dig mere kraft og fleksibilitet til at bruge dette som en del af din applikation. Du starter med at definere din værktøj fra LangChain-agentklassen. Den funktion, du videregiver til dit værktøj, forespørger på det indeks, du har bygget over dine dokumenter ved hjælp af LlamaIndex.

Derefter vælger du den rigtige type agent, som du gerne vil bruge til din RAG-implementering. I dette tilfælde bruger du chat-zero-shot-react-description agent. Med denne agent vil LLM bruge det tilgængelige værktøj (i dette scenarie, RAG'en over videnbasen) til at give svaret. Du initialiserer derefter agenten ved at videregive dit værktøj, LLM og agenttype:

Du kan se agenten gå igennem thoughts, actionsog observation , brug værktøjet (i dette scenarie, forespørgsel efter dine indekserede dokumenter); og returner et resultat:

Du kan finde ende-til-ende implementeringskoden i den medfølgende GitHub repo.

Ryd op

For at undgå unødvendige omkostninger kan du rydde op i dine ressourcer, enten via følgende kodestykker eller Amazon JumpStart UI.

For at bruge Boto3 SDK skal du bruge følgende kode til at slette tekstindlejringsmodellens slutpunkt og tekstgenereringsmodellens slutpunkt samt slutpunktskonfigurationerne:

For at bruge SageMaker-konsollen skal du udføre følgende trin:

- På SageMaker-konsollen, under Inference i navigationsruden, skal du vælge Endpoints

- Søg efter slutpunkterne for indlejring og tekstgenerering.

- På siden med slutpunktsdetaljer skal du vælge Slet.

- Vælg Slet igen for at bekræfte.

Konklusion

Til brugssager med fokus på søgning og genfinding giver LlamaIndex fleksible muligheder. Det udmærker sig ved indeksering og genfinding for LLM'er, hvilket gør det til et kraftfuldt værktøj til dyb udforskning af data. LlamaIndex giver dig mulighed for at oprette organiserede dataindekser, bruge forskellige LLM'er, udvide data for bedre LLM-ydeevne og forespørge data med naturligt sprog.

Dette indlæg demonstrerede nogle vigtige LlamaIndex-koncepter og -funktioner. Vi brugte GPT-J til indlejring og Llama 2-Chat som LLM til at bygge en RAG-applikation, men du kunne bruge enhver passende model i stedet. Du kan udforske det omfattende udvalg af modeller, der er tilgængelige på SageMaker JumpStart.

Vi viste også, hvordan LlamaIndex kan levere kraftfulde, fleksible værktøjer til at forbinde, indeksere, hente og integrere data med andre rammer som LangChain. Med LlamaIndex-integrationer og LangChain kan du bygge mere kraftfulde, alsidige og indsigtsfulde LLM-applikationer.

Om forfatterne

Dr. Romina Sharifpour er Senior Machine Learning og Artificial Intelligence Solutions Architect hos Amazon Web Services (AWS). Hun har brugt over 10 år på at lede design og implementering af innovative end-to-end-løsninger muliggjort af fremskridt inden for ML og AI. Rominas interesseområder er naturlig sprogbehandling, store sprogmodeller og MLOps.

Dr. Romina Sharifpour er Senior Machine Learning og Artificial Intelligence Solutions Architect hos Amazon Web Services (AWS). Hun har brugt over 10 år på at lede design og implementering af innovative end-to-end-løsninger muliggjort af fremskridt inden for ML og AI. Rominas interesseområder er naturlig sprogbehandling, store sprogmodeller og MLOps.

Nicole Pinto er en AI/ML Specialist Solutions Architect baseret i Sydney, Australien. Hendes baggrund inden for sundhedspleje og finansielle tjenesteydelser giver hende et unikt perspektiv i løsning af kundeproblemer. Hun brænder for at gøre det muligt for kunderne gennem machine learning og styrke den næste generation af kvinder i STEM.

Nicole Pinto er en AI/ML Specialist Solutions Architect baseret i Sydney, Australien. Hendes baggrund inden for sundhedspleje og finansielle tjenesteydelser giver hende et unikt perspektiv i løsning af kundeproblemer. Hun brænder for at gøre det muligt for kunderne gennem machine learning og styrke den næste generation af kvinder i STEM.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/build-knowledge-powered-conversational-applications-using-llamaindex-and-llama-2-chat/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 10

- 100

- 11

- 13

- 14

- 15 %

- 16

- 2022

- 2023

- 22

- 500

- 7

- 8

- 9

- a

- evne

- I stand

- Om

- accept

- accepteret

- accepterer

- adgang

- Ifølge

- Konto

- præcis

- handlinger

- tilføje

- Desuden

- Yderligere

- adresse

- fremskridt

- Fordel

- Efter

- igen

- Agent

- midler

- Aftale

- AI

- ai forskning

- AI / ML

- Alle

- tillade

- tillader

- allerede

- også

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- Amazon Web Services (AWS)

- beløb

- an

- ,

- besvare

- besvarelse

- svar

- enhver

- API'er

- Anvendelse

- applikationer

- tilgang

- passende

- passende

- cirka

- arkitektur

- ER

- områder

- opstå

- kunstig

- kunstig intelligens

- AS

- spørg

- Assistance

- assistenter

- bistår

- At

- attributter

- forøge

- augmented

- Australien

- til rådighed

- undgå

- AWS

- tilbage

- baggrund

- bund

- baseret

- grundlæggende

- BE

- Beach

- fordi

- været

- før

- Bedre

- mellem

- både

- Pause

- brodannelse

- bringe

- bygge

- Bygning

- bygget

- men

- by

- kaldet

- CAN

- kapaciteter

- kapacitet

- tilfælde

- tilfælde

- chatte

- chatbots

- valg

- Vælg

- klasse

- ren

- tydeligt

- kunde

- kode

- SAMMENHÆNGENDE

- kombinerer

- kommer

- Fælles

- almindeligt

- selskab

- sammenlignet

- konkurrerer

- fuldføre

- komplekse

- komponent

- komponenter

- forstå

- omfattende

- begreber

- konkluderer

- Konfiguration

- konfigurering

- Bekræfte

- Tilslut

- stik

- overvejelser

- anser

- konsekvent

- består

- Konsol

- konstruere

- Container

- indhold

- sammenhæng

- fortsæt

- konversation

- samtaler

- konvertere

- konverteret

- konvertering af

- korrigere

- Koste

- omkostningsbesparelser

- Omkostninger

- kunne

- skabe

- oprettet

- Oprettelse af

- KREDENTIAL

- kritisk

- skik

- kunde

- Kunder

- tilpasse

- Klip

- data

- dataadgang

- databaser

- datasæt

- dyb

- Standard

- definere

- definerede

- definere

- levere

- demonstrere

- demonstreret

- afhængigheder

- afhænger

- indsætte

- indsat

- implementering

- implementering

- Design

- konstrueret

- detaljer

- Udvikling

- diagram

- Dialog

- DICT

- direkte

- forskelligartede

- do

- docs

- dokumentet

- dokumenter

- domæne

- Dont

- drevet

- i løbet af

- tidligere

- Effektiv

- effektiv

- nemt

- enten

- elementer

- indlejring

- bemyndigelse

- aktiveret

- muliggør

- muliggør

- ende

- ende til ende

- Endpoint

- Engine (Motor)

- Motorer

- Enterprise

- Hele

- Miljø

- lige

- evaluering

- eksempel

- eksempler

- spændende

- eksisterende

- forventet

- eksperimentere

- udtrykkeligt

- udforskning

- udforske

- ekstern

- Ansigtet

- letter

- Falls

- bekendt

- familie

- Feature

- Funktionalitet

- få

- Filer

- finansielle

- finansielle tjenesteydelser

- Finde

- Fornavn

- Fleksibilitet

- fleksibel

- fokuserede

- fokuserer

- efter

- Til

- Foundation

- Framework

- rammer

- fra

- funktion

- kløft

- generelt

- generere

- genereret

- generere

- generation

- generative

- giver

- Global

- gå

- godt

- reguleret

- større

- håndtere

- seletøj

- Have

- sundhedspleje

- hjælpe

- hende

- Skjult

- høj kvalitet

- Hvordan

- How To

- Men

- HTML

- HTTPS

- Hub

- ID

- identificeret

- Identity

- if

- ignorere

- implementering

- forbedringer

- in

- omfatter

- omfatter

- Herunder

- inkorporering

- Forøg

- Stigninger

- indeks

- indekseret

- indekser

- angiver

- angiver

- oplysninger

- oplyser

- Infrastruktur

- Innovation

- innovativ

- indgang

- indgange

- indtastning

- indsigtsfuld

- installere

- instans

- i stedet

- anvisninger

- integrere

- integration

- integrationer

- Intelligens

- beregnet

- interaktiv

- interesse

- grænseflade

- grænseflader

- ind

- Introducerer

- involverer

- spørgsmål

- IT

- ITS

- jpg

- json

- juli

- Nøgle

- viden

- Mangel

- Sprog

- stor

- senere

- førende

- læring

- Niveau

- Licens

- ligesom

- Sandsynlig

- Liste

- Llama

- LLM

- belastning

- loader

- lastning

- lokalt

- Lang

- maskine

- machine learning

- lave

- maerker

- Making

- administrere

- maksimal

- Kan..

- nævnte

- besked

- Meta

- metode

- migrere

- migration

- minimum

- minutter

- ML

- MLOps

- model

- modeller

- mere

- mest

- meget

- navn

- Natural

- Natural Language Processing

- Navigation

- nødvendig

- Behov

- behov

- behov

- næste

- noder

- nummer

- objekt

- objekter

- of

- tilbyde

- Tilbud

- tit

- on

- ONE

- kun

- på

- åbent

- operationelle

- Produktion

- optimeret

- Indstillinger

- or

- ordrer

- Organiseret

- Andet

- vores

- ud

- skitseret

- output

- udgange

- i løbet af

- overstyring

- oversigt

- egen

- side

- brød

- Papir

- parameter

- parametre

- del

- særlig

- dele

- passerer

- passager

- Bestået

- Passing

- lidenskabelige

- ydeevne

- Tilladelser

- perspektiv

- plato

- Platon Data Intelligence

- PlatoData

- Populær

- Indlæg

- magt

- vigtigste

- præcist

- Predictor

- forberedelse

- trykke

- Pressemeddelelse

- Pressemeddelelser

- problemer

- behandle

- forarbejdning

- producere

- produktion

- give

- forudsat

- giver

- offentligt

- ren

- Python

- Spørgsmål og svar

- forespørgsler

- query

- spørgsmål

- Spørgsmål

- Hurtig

- klud

- tilfældighed

- rækkevidde

- hellere

- Raw

- Læs

- klar

- realtid

- modtage

- opskrift

- anbefales

- Reduceret

- henvise

- henvisningen

- refererer

- geninvestere

- frigive

- Udgivelser

- relevant

- erstatte

- Repository

- repræsenteret

- kræver

- påkrævet

- forskning

- forskning og udvikling

- Ressourcer

- svar

- reaktioner

- resultere

- hentning

- afkast

- afkast

- Rich

- højre

- robust

- roller

- roller

- Kør

- kører

- s

- Sikkerhed

- sagemaker

- prøve

- Besparelser

- scenarie

- SDK

- Søg

- søgninger

- Sektion

- sektioner

- se

- Vælg

- SELV

- send

- afsendelse

- senior

- september

- tjeneste

- Tjenester

- sæt

- indstilling

- indstillinger

- setup

- hun

- bør

- viste

- vist

- Shows

- lignende

- Simpelt

- forenkle

- siden

- Størrelse

- størrelser

- uddrag

- So

- løsninger

- Løsninger

- Løsning

- nogle

- Kilde

- indkøbt

- Kilder

- specialist

- specifikke

- specifikt

- brugt

- starte

- state-of-the-art

- Stater

- Stem

- Trin

- Steps

- opbevaring

- butik

- opbevaret

- forhandler

- ligetil

- strømlining

- styrker

- struktur

- Studio

- Efterfølgende

- Succesfuld

- sådan

- egnede

- sydney

- systemet

- Systemer

- Tag

- tager

- Tryk på

- opgaver

- Teknologier

- skabelon

- tendens

- prøve

- tekst

- end

- at

- Them

- derefter

- Disse

- de

- denne

- dem

- Gennem

- tid

- til

- Tokens

- værktøj

- værktøjer

- top

- Sporing

- Kurser

- Transform

- trillion

- prøv

- to

- typen

- typer

- typisk

- ui

- under

- forstå

- enestående

- unødvendig

- Opdatering

- Brug

- brug

- brug tilfælde

- anvendte

- nyttigt

- Bruger

- Brugergrænseflade

- brugervenlig

- brugere

- bruger

- ved brug af

- Værdier

- variabel

- række

- forskellige

- Vast

- alsidige

- udgave

- via

- ønsker

- we

- web

- webservices

- GODT

- Hvad

- Hvad er

- hvornår

- ud fra følgende betragtninger

- hvorvidt

- som

- mens

- vilje

- med

- Dame

- arbejdsgange

- arbejder

- ville

- år

- Du

- Din

- zephyrnet