Generative AI-løsninger har potentialet til at transformere virksomheder ved at øge produktiviteten og forbedre kundeoplevelsen, og det er blevet mere og mere populært at bruge store sprogmodeller (LLM'er) med disse løsninger. At bygge proofs of concept er relativt ligetil, fordi banebrydende fundament modeller er tilgængelige fra specialiserede udbydere gennem et simpelt API-kald. Derfor er organisationer af forskellige størrelser og på tværs af forskellige industrier begyndt at genskabe deres produkter og processer ved hjælp af generativ AI.

På trods af deres rigdom af generel viden har avancerede LLM'er kun adgang til den information, de er blevet trænet i. Dette kan føre til faktuelle unøjagtigheder (hallucinationer), når LLM bliver bedt om at generere tekst baseret på information, de ikke så under deres træning. Derfor er det afgørende at bygge bro mellem LLM's generelle viden og dine proprietære data for at hjælpe modellen med at generere mere nøjagtige og kontekstuelle svar og samtidig reducere risikoen for hallucinationer. Den traditionelle metode til finjustering, selvom den er effektiv, kan være computerkrævende, dyr og kræver teknisk ekspertise. En anden mulighed at overveje kaldes Retrieval Augmented Generation (RAG), som giver LLM'er yderligere information fra en ekstern videnkilde, som nemt kan opdateres.

Derudover skal virksomheder sikre datasikkerhed, når de håndterer proprietære og følsomme data, såsom personlige data eller intellektuel ejendom. Dette er især vigtigt for organisationer, der opererer i stærkt regulerede industrier, såsom finansielle tjenesteydelser og sundhedspleje og biovidenskab. Derfor er det vigtigt at forstå og kontrollere strømmen af dine data gennem den generative AI-applikation: Hvor er modellen placeret? Hvor behandles dataene? Hvem har adgang til dataene? Vil dataene blive brugt til at træne modeller og i sidste ende risikere læk af følsomme data til offentlige LLM'er?

Dette indlæg diskuterer, hvordan virksomheder kan bygge nøjagtige, gennemsigtige og sikre generative AI-applikationer, mens de bevarer fuld kontrol over proprietære data. Den foreslåede løsning er en RAG-pipeline, der bruger en AI-native teknologistack, hvis komponenter er designet fra bunden med AI i deres kerne, snarere end at have AI-kapaciteter tilføjet som en eftertanke. Vi demonstrerer, hvordan man bygger en end-to-end RAG-applikation ved hjælp af Coheres sprogmodeller ved Amazonas grundfjeld og en Weaviate vektordatabase på AWS Marketplace. Den medfølgende kildekode er tilgængelig i relateret GitHub-depot vært hos Weaviate. Selvom AWS ikke vil være ansvarlig for at vedligeholde eller opdatere koden i partnerens lager, opfordrer vi kunder til at oprette forbindelse til Weaviate direkte vedrørende eventuelle ønskede opdateringer.

Løsningsoversigt

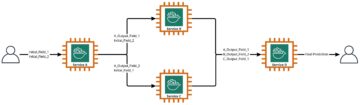

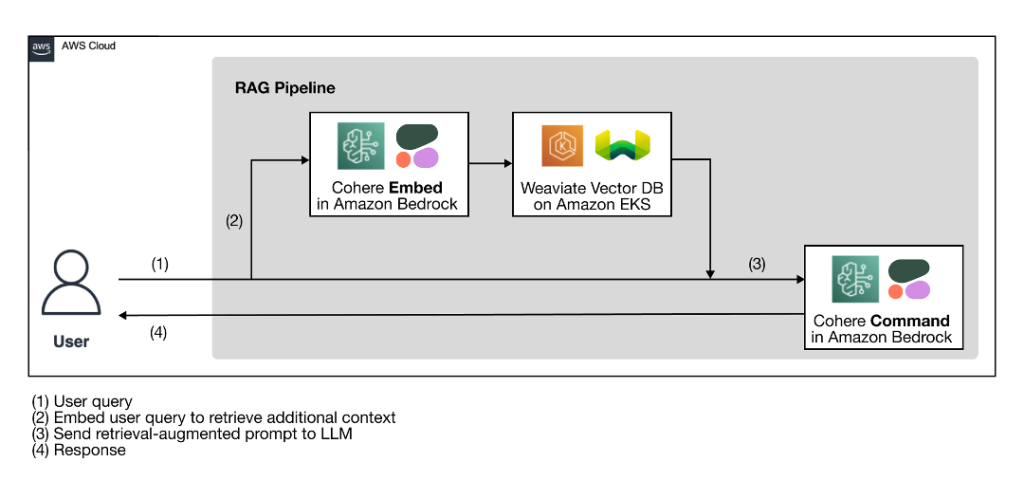

Følgende arkitekturdiagram på højt niveau illustrerer den foreslåede RAG-pipeline med en AI-native teknologistack til at bygge nøjagtige, gennemsigtige og sikre generative AI-løsninger.

Figur 1: RAG workflow ved hjælp af Coheres sprogmodeller gennem Amazon Bedrock og en Weaviate vektordatabase på AWS Marketplace

Som et forberedelsestrin til RAG-workflowet indtages en vektordatabase, der fungerer som den eksterne videnkilde, med den ekstra kontekst fra de proprietære data. Den faktiske RAG-arbejdsgang følger de fire trin, der er illustreret i diagrammet:

- Brugeren indtaster deres forespørgsel.

- Brugerforespørgslen bruges til at hente relevant yderligere kontekst fra vektordatabasen. Dette gøres ved at generere vektorindlejringerne af brugerforespørgslen med en indlejringsmodel for at udføre en vektorsøgning for at hente den mest relevante kontekst fra databasen.

- Den hentede kontekst og brugerforespørgslen bruges til at udvide en promptskabelon. Den genfindingsforstærkede prompt hjælper LLM med at generere en mere relevant og nøjagtig afslutning, hvilket minimerer hallucinationer.

- Brugeren modtager et mere præcist svar baseret på deres forespørgsel.

Den AI-native teknologistak, der er illustreret i arkitekturdiagrammet, har to nøglekomponenter: Cohere-sprogmodeller og en Weaviate-vektordatabase.

Sammenhænge sprogmodeller i Amazon Bedrock

Sammenhængende platform bringer sprogmodeller med state-of-the-art ydeevne til virksomheder og udviklere gennem et simpelt API-kald. Der er to nøgletyper af sprogbehandlingsfunktioner, som Cohere-platformen leverer – generativ og indlejring – og hver er betjent af en anden type model:

- Tekstgenerering med Kommando – Udviklere kan få adgang til endepunkter, der driver genererende AI-kapaciteter, hvilket muliggør applikationer såsom samtale, besvarelse af spørgsmål, tekstforfatning, opsummering, informationsudtrækning og mere.

- Tekstgengivelse med Integrer – Udviklere kan få adgang til endepunkter, der fanger den semantiske betydning af tekst, hvilket muliggør applikationer som vektorsøgemaskiner, tekstklassificering og klyngedannelse og mere. Cohere Embed kommer i to former, en engelsksproget model og en flersproget model, som begge er nu tilgængelig på Amazon Bedrock.

Cohere-platformen giver virksomheder mulighed for at tilpasse deres generative AI-løsning privat og sikkert gennem Amazon Bedrock-implementeringen. Amazon Bedrock er en fuldt administreret cloud-tjeneste, der gør det muligt for udviklingsteams at bygge og skalere generative AI-applikationer hurtigt samtidig med at du hjælper med at holde dine data og applikationer sikre og private. Dine data bruges ikke til serviceforbedringer, deles aldrig med tredjepartsmodeludbydere og forbliver i Område hvor API-kaldet behandles. Dataene er altid krypteret under transport og hvile, og du kan kryptere dataene ved hjælp af dine egne nøgler. Amazon Bedrock understøtter sikkerhedskrav, herunder US Health Insurance Portability and Accountability Act (HIPAA) berettigelse og overholdelse af General Data Protection Regulation (GDPR). Derudover kan du sikkert integrere og nemt implementere dine generative AI-applikationer ved hjælp af de AWS-værktøjer, du allerede er bekendt med.

Weaviate vektordatabase på AWS Marketplace

Væv er en AI-indfødt vektor database det gør det nemt for udviklingsteams at bygge sikre og gennemsigtige generative AI-applikationer. Weaviate bruges til at gemme og søge i både vektordata og kildeobjekter, hvilket forenkler udviklingen ved at eliminere behovet for at hoste og integrere separate databaser. Weaviate leverer semantisk søgeydelse i sekundet og kan skaleres til at håndtere milliarder af vektorer og millioner af lejere. Med en unik udvidelsesbar arkitektur integrerer Weaviate indbygget med Cohere-fundamentmodeller implementeret i Amazon Bedrock for at lette den praktiske vektorisering af data og bruge dens generative muligheder fra databasen.

Weaviate AI-native vektordatabase giver kunderne fleksibiliteten til at implementere den som en bring-your-own-cloud (BYOC)-løsning eller som en administreret service. Dette udstillingsvindue bruger Weaviate Kubernetes Cluster på AWS Marketplace, en del af Weaviates BYOC-tilbud, som tillader containerbaseret skalerbar implementering i din AWS-lejer og VPC med blot et par klik ved hjælp af en AWS CloudFormation skabelon. Denne tilgang sikrer, at din vektordatabase implementeres i din specifikke region tæt på fundamentmodellerne og proprietære data for at minimere latens, understøtte datalokalitet og beskytte følsomme data, mens potentielle regulatoriske krav, såsom GDPR, adresseres.

Brug case oversigt

I de følgende afsnit demonstrerer vi, hvordan man bygger en RAG-løsning ved hjælp af den AI-native teknologistack med Cohere, AWS og Weaviate, som illustreret i løsningsoversigten.

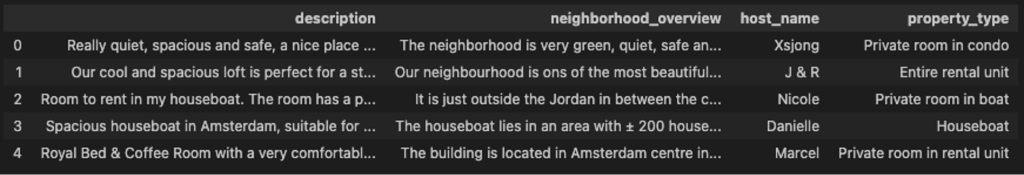

Eksemplet på use case genererer målrettede annoncer for ferieophold baseret på en målgruppe. Målet er at bruge brugerforespørgslen til målgruppen (f.eks. "familie med små børn") til at hente den mest relevante ferieopholdsfortegnelse (f.eks. en liste med legepladser tæt på) og derefter generere en annonce for hentet fortegnelse skræddersyet til målgruppen.

Figur 2: De første par rækker af ferieophold tilgængelige fra Inside Airbnb.

Datasættet er tilgængeligt fra Inde på Airbnb og er licenseret under a Creative Commons Attribution 4.0 International licens. Du kan finde den medfølgende kode i GitHub repository.

Forudsætninger

For at følge med og bruge nogen AWS-tjenester i følgende vejledning, skal du sørge for at have en AWS-konto.

Aktiver komponenter i den AI-native teknologistack

Først skal du aktivere de relevante komponenter, der er beskrevet i løsningsoversigten på din AWS-konto. Udfør følgende trin:

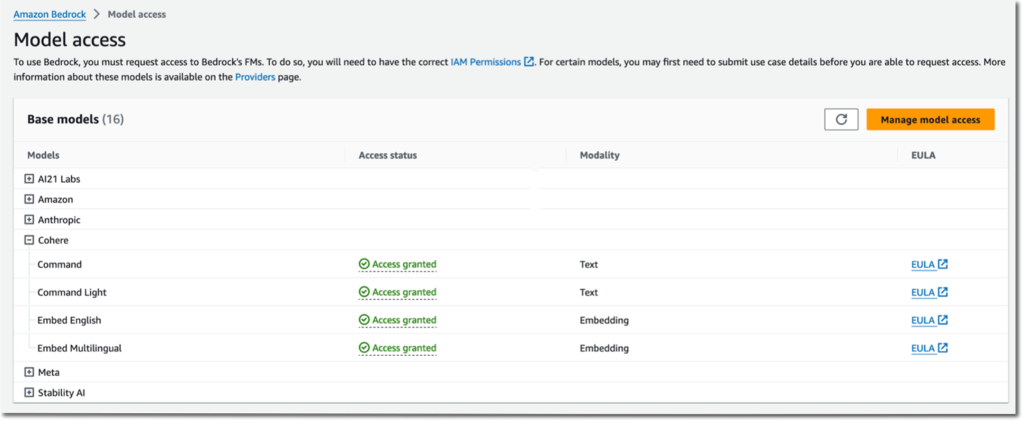

- I venstre side Amazon Bedrock-konsol, vælg Modeladgang i navigationsruden.

- Vælg Administrer modeladgang øverst til højre.

- Vælg de funderingsmodeller du ønsker, og anmod om adgang.

Figur 3: Administrer modeladgang i Amazon Bedrock-konsollen.

Dernæst opsætter du en Weaviate-klynge.

- Abonner på Weaviate Kubernetes Cluster på AWS Marketplace.

- Start softwaren ved hjælp af en CloudFormation-skabelon i henhold til din foretrukne tilgængelighedszone.

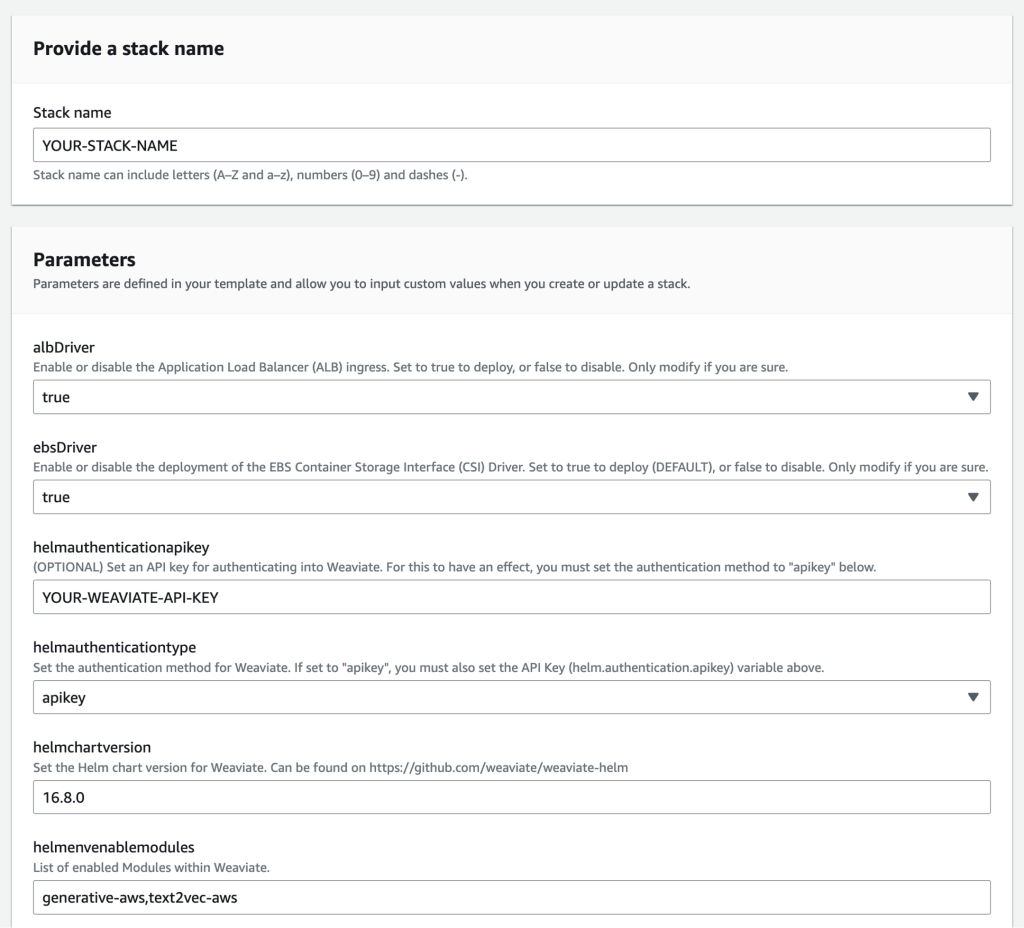

CloudFormation-skabelonen er forududfyldt med standardværdier.

- Til Staknavn, indtast et staknavn.

- Til helmauthentication type, anbefales det at aktivere godkendelse ved at indstille

helmauthenticationtypetilapikeyog definere en helmauthenticationapikey. - Til helmauthenticationapikey, skal du indtaste din Weaviate API-nøgle.

- Til helmchartversion, indtast dit versionsnummer. Det skal mindst være v.16.8.0. Der henvises til GitHub repo til den nyeste version.

- Til helmenabled modules, sørge for at

tex2vec-aws,generative-awsfindes på listen over aktiverede moduler i Weaviate.

Figur 4: CloudFormation skabelon.

Denne skabelon tager omkring 30 minutter at færdiggøre.

Opret forbindelse til Weaviate

Udfør følgende trin for at oprette forbindelse til Weaviate:

- I Amazon SageMaker konsol, navigere til Notebook-forekomster i navigationsruden via Notesbog > Notebook-forekomster til venstre.

- Opret en ny notesbogsforekomst.

- Installer Weaviate-klientpakken med de nødvendige afhængigheder:

- Opret forbindelse til din Weaviate-instans med følgende kode:

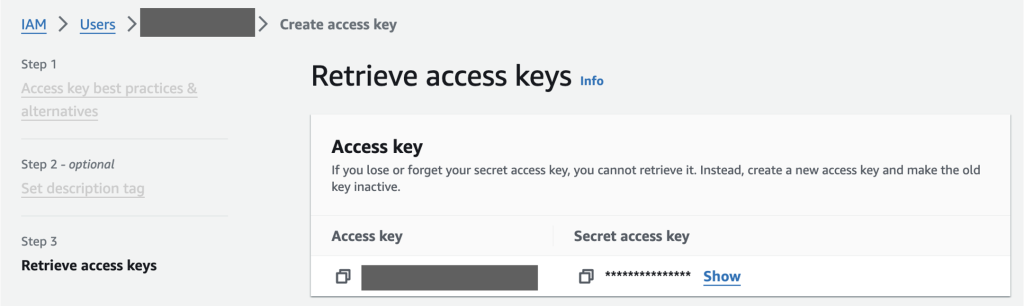

- Weaviate URL – Få adgang til Weaviate via load balancer-URL'en. I den Amazon Elastic Compute Cloud (Amazon EC2) konsol, vælg Indlæs balancere i navigationsruden og find belastningsbalanceren. Se efter kolonnen DNS-navn, og tilføj

http://foran den. - Weaviate API nøgle – Dette er nøglen, du har angivet tidligere i CloudFormation-skabelonen (

helmauthenticationapikey). - AWS adgangsnøgle og hemmelig adgangsnøgle – Du kan hente adgangsnøglen og den hemmelige adgangsnøgle til din bruger i AWS identitets- og adgangsstyring (IAM) konsol.

Figur 5: AWS Identity and Access Management (IAM)-konsol til at hente AWS-adgangsnøgle og hemmelig adgangsnøgle.

Konfigurer Amazon Bedrock-modulet for at aktivere Cohere-modeller

Dernæst definerer du en dataindsamling (class) hedder Listings at gemme fortegnelsernes dataobjekter, hvilket er analogt med at oprette en tabel i en relationsdatabase. I dette trin konfigurerer du de relevante moduler til at muliggøre brugen af Cohere-sprogmodeller, der hostes på Amazon Bedrock indbygget fra Weaviates vektordatabase. Vektorizeren ("text2vec-aws") og generativt modul ("generative-aws“) er specificeret i dataindsamlingsdefinitionen. Begge disse moduler tager tre parametre:

- "service" - Brug "

bedrock" til Amazon Bedrock (brug alternativt "sagemaker" til Amazon SageMaker JumpStart) - "Område" – Indtast den region, hvor din model er installeret

- "model" – Angiv fundamentmodellens navn

Se følgende kode:

Indtag data i Weaviates vektordatabase

I dette trin definerer du strukturen for dataindsamlingen ved at konfigurere dens egenskaber. Udover ejendommens navn og datatype kan du også konfigurere, om kun dataobjektet skal gemmes, eller om det vil blive gemt sammen med dets vektorindlejringer. I dette eksempel, host_name , property_type er ikke vektoriseret:

Kør følgende kode for at oprette samlingen i din Weaviate-instans:

Du kan nu tilføje objekter til Weaviate. Du bruger en batchimportproces for maksimal effektivitet. Kør følgende kode for at importere data. Under importen vil Weaviate bruge den definerede vektorisering til at skabe en vektorindlejring for hvert objekt. Følgende kode indlæser objekter, initialiserer en batchproces og tilføjer objekter til målsamlingen én efter én:

Retrieval Augmented Generation

Du kan bygge en RAG-pipeline ved at implementere en generativ søgeforespørgsel på din Weaviate-instans. Til dette skal du først definere en promptskabelon i form af en f-streng, der kan tage brugerforespørgslen ({target_audience}) direkte og den yderligere kontekst ({{host_name}}, {{property_type}}, {{description}}og {{neighborhood_overview}}) fra vektordatabasen ved kørsel:

Dernæst kører du en generativ søgeforespørgsel. Dette beder den definerede generative model med en prompt, der består af brugerforespørgslen såvel som de hentede data. Følgende forespørgsel henter ét listeobjekt (.with_limit(1)) Fra Listings samling, der ligner mest brugerforespørgslen (.with_near_text({"concepts": target_audience})). Derefter brugerforespørgslen (target_audience) og de hentede fortegnelsers egenskaber (["description", "neighborhood", "host_name", "property_type"]) føres ind i promptskabelonen. Se følgende kode:

I det følgende eksempel kan du se, at det foregående stykke kode for target_audience = “Family with small children” henter en liste fra værten Marre. Spørgsmålsskabelonen er udvidet med Marres listedetaljer og målgruppen:

Baseret på den genfindingsforstærkede prompt genererer Cohere's Command-model følgende målrettede annonce:

Alternative tilpasninger

Du kan foretage alternative tilpasninger til forskellige komponenter i den foreslåede løsning, såsom følgende:

- Coheres sprogmodeller er også tilgængelige via Amazon SageMaker JumpStart, som giver adgang til banebrydende fundamentmodeller og gør det muligt for udviklere at implementere LLM'er til Amazon SageMaker, en fuldt administreret tjeneste, der samler et bredt sæt værktøjer for at muliggøre højtydende, billig maskinlæring til enhver brug. Weaviate er også integreret med SageMaker.

- En kraftfuld tilføjelse til denne løsning er Kohere Rerank endpoint, tilgængelig gennem SageMaker JumpStart. Genrangering kan forbedre relevansen af søgeresultater fra leksikalsk eller semantisk søgning. Genrangering fungerer ved at beregne semantiske relevansscores for dokumenter, der hentes af et søgesystem, og rangordne dokumenterne baseret på disse scores. Tilføjelse af Rerank til en applikation kræver kun en enkelt kodeændring.

- For at imødekomme forskellige implementeringskrav i forskellige produktionsmiljøer kan Weaviate implementeres på flere forskellige måder. For eksempel er den tilgængelig som en direkte download fra Weaviate hjemmeside, der kører videre Amazon Elastic Kubernetes Service (Amazon EKS) eller lokalt via Docker or Kubernetes. Den fås også som en administreret service der kan køre sikkert i en VPC eller som en offentlig cloud-tjeneste hostet på AWS med en 14-dages gratis prøveperiode.

- Du kan betjene din løsning i en VPC vha Amazon Virtual Private Cloud (Amazon VPC), som gør det muligt for organisationer at lancere AWS-tjenester i et logisk isoleret virtuelt netværk, der ligner et traditionelt netværk, men med fordelene ved AWS's skalerbare infrastruktur. Afhængigt af det klassificerede niveau af følsomhed for dataene, kan organisationer også deaktivere internetadgang i disse VPC'er.

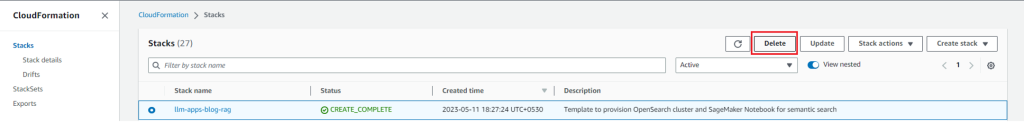

Ryd op

For at forhindre uventede opkrævninger skal du slette alle de ressourcer, du har implementeret som en del af dette indlæg. Hvis du har startet CloudFormation-stakken, kan du slette den via AWS CloudFormation-konsollen. Bemærk, at der kan være nogle AWS-ressourcer, som f.eks Amazon Elastic Block Store (Amazon EBS) volumener og AWS Key Management Service (AWS KMS) nøgler, som muligvis ikke slettes automatisk, når CloudFormation-stakken slettes.

Figur 6: Slet alle ressourcer via AWS CloudFormation-konsollen.

Konklusion

Dette indlæg diskuterede, hvordan virksomheder kan bygge nøjagtige, gennemsigtige og sikre generative AI-applikationer, mens de stadig har fuld kontrol over deres data. Den foreslåede løsning er en RAG-pipeline, der bruger en AI-native teknologistack som en kombination af Cohere-fundamentmodeller i Amazon Bedrock og en Weaviate-vektordatabase på AWS Marketplace. RAG-tilgangen gør det muligt for virksomheder at bygge bro mellem LLM's generelle viden og de proprietære data og samtidig minimere hallucinationer. En AI-native teknologistack muliggør hurtig udvikling og skalerbar ydeevne.

Du kan begynde at eksperimentere med RAG proofs of concept til dine virksomhedsklare generative AI-applikationer ved at bruge de trin, der er beskrevet i dette indlæg. Den medfølgende kildekode er tilgængelig i relateret GitHub-depot. Tak fordi du læste. Kom gerne med kommentarer eller feedback i kommentarfeltet.

Om forfatterne

James Yi er senior AI/ML Partner Solutions Architect i Technology Partners COE Tech-teamet hos Amazon Web Services. Han brænder for at arbejde med virksomhedskunder og partnere for at designe, implementere og skalere AI/ML-applikationer for at opnå forretningsværdi. Uden for arbejdet nyder han at spille fodbold, rejse og tilbringe tid med sin familie.

James Yi er senior AI/ML Partner Solutions Architect i Technology Partners COE Tech-teamet hos Amazon Web Services. Han brænder for at arbejde med virksomhedskunder og partnere for at designe, implementere og skalere AI/ML-applikationer for at opnå forretningsværdi. Uden for arbejdet nyder han at spille fodbold, rejse og tilbringe tid med sin familie.

Leonie Monigatti er udvikleradvokat hos Weaviate. Hendes fokusområde er AI/ML, og hun hjælper udviklere med at lære om generativ AI. Uden for arbejdet deler hun også sine erfaringer inden for datavidenskab og ML på sin blog og på Kaggle.

Leonie Monigatti er udvikleradvokat hos Weaviate. Hendes fokusområde er AI/ML, og hun hjælper udviklere med at lære om generativ AI. Uden for arbejdet deler hun også sine erfaringer inden for datavidenskab og ML på sin blog og på Kaggle.

Meor Amer er udvikleradvokat hos Cohere, en udbyder af banebrydende NLP-teknologi (natural language processing). Han hjælper udviklere med at bygge banebrydende applikationer med Cohere's Large Language Models (LLM'er).

Meor Amer er udvikleradvokat hos Cohere, en udbyder af banebrydende NLP-teknologi (natural language processing). Han hjælper udviklere med at bygge banebrydende applikationer med Cohere's Large Language Models (LLM'er).

Skynd Mao er senior AI/ML Partner Solutions Architect i Emerging Technologies-teamet hos Amazon Web Services. Han brænder for at arbejde med virksomhedskunder og partnere for at designe, implementere og skalere AI/ML-applikationer for at udlede deres forretningsværdier. Uden for arbejdet nyder han at fiske, rejse og spille bordtennis.

Skynd Mao er senior AI/ML Partner Solutions Architect i Emerging Technologies-teamet hos Amazon Web Services. Han brænder for at arbejde med virksomhedskunder og partnere for at designe, implementere og skalere AI/ML-applikationer for at udlede deres forretningsværdier. Uden for arbejdet nyder han at fiske, rejse og spille bordtennis.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/build-enterprise-ready-generative-ai-solutions-with-cohere-foundation-models-in-amazon-bedrock-and-weaviate-vector-database-on-aws-marketplace/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 10

- 100

- 11

- 12

- 13

- 16

- 17

- 19

- 23

- 30

- 32

- 33

- 7

- 8

- 9

- a

- Om

- adgang

- Ifølge

- Konto

- ansvarlighed

- præcis

- tværs

- Lov

- faktiske

- tilføje

- tilføjet

- tilføje

- Desuden

- Yderligere

- yderligere information

- Derudover

- adressering

- Tilføjer

- voksne

- reklame

- fortaler

- AI

- AI / ML

- Airbnb

- Alle

- tillader

- sammen

- allerede

- også

- alternativ

- Skønt

- altid

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- amsterdam

- an

- ,

- En anden

- besvarelse

- enhver

- api

- Anvendelse

- applikationer

- tilgang

- arkitektur

- ER

- OMRÅDE

- områder

- AS

- side

- At

- attraktioner

- publikum

- forøge

- augmented

- Godkendelse

- automatisk

- tilgængelighed

- til rådighed

- væk

- AWS

- AWS CloudFormation

- AWS Identity and Access Management (IAM)

- AWS Marketplace

- swing

- barer

- baseret

- BE

- fordi

- bliver

- begyndt

- fordele

- BEDSTE

- mellem

- milliarder

- Bloker

- Blog

- fremme

- både

- BRIDGE

- Bringer

- bred

- bygge

- Bygning

- virksomhed

- virksomheder

- men

- by

- caféer

- ringe

- kaldet

- CAN

- kapaciteter

- fange

- tilfælde

- imødekomme

- central

- center

- lave om

- afgifter

- Børn

- valg

- Vælg

- By

- klasse

- klassificering

- klassificeret

- kunde

- Luk

- Cloud

- Cluster

- klyngedannelse

- kode

- samling

- Kolonne

- kombination

- Kom

- kommer

- kommentarer

- Commons

- fuldføre

- færdiggørelse

- Compliance

- komponenter

- Indeholder

- Compute

- computing

- Konceptet

- begreber

- konfigurering

- Tilslut

- Overvej

- Konsol

- sammenhæng

- kontekstuelle

- kontrol

- Praktisk

- bekvemt

- konversation

- tekstforfatning

- Core

- skabe

- Oprettelse af

- afgørende

- kunde

- Kunder

- tilpasse

- banebrydende

- data

- databeskyttelse

- datalogi

- datasikkerhed

- Database

- databaser

- Standard

- definere

- definerede

- definere

- definition

- leverer

- demonstrere

- afhængigheder

- Afhængigt

- indsætte

- indsat

- implementering

- udlede

- beskrivelse

- Design

- konstrueret

- ønskes

- detaljer

- Udvikler

- udviklere

- Udvikling

- udviklingsteams

- forskellige

- spisestue

- direkte

- direkte

- drøftet

- dns

- dokumenter

- færdig

- downloade

- i løbet af

- hver

- tidligere

- nemt

- Effektiv

- effektivitet

- forhøjet

- berettigelse

- eliminere

- Integrer

- indlejring

- smergel

- nye teknologier

- bemyndiger

- muliggøre

- aktiveret

- muliggør

- muliggør

- tilskynde

- krypteret

- ende til ende

- Motorer

- Engelsk

- sikre

- sikrer

- Indtast

- Enterprise

- virksomheder

- Går ind i

- Hele

- miljøer

- til sidst

- eksempel

- dyrt

- erfaring

- Oplevelser

- ekspertise

- ekstern

- udvinding

- lette

- bekendt

- familie

- FAST

- Funktionalitet

- Med

- Fed

- tilbagemeldinger

- føler sig

- få

- File (Felt)

- finansielle

- finansielle tjenesteydelser

- Finde

- Fornavn

- Fiskeri

- Fleksibilitet

- Gulvlampe

- flow

- Fokus

- følger

- efter

- følger

- Til

- formular

- formularer

- Foundation

- fire

- Gratis

- gratis prøveversion

- fra

- forsiden

- fuld

- fuldt ud

- yderligere

- kløft

- GDPR

- Generelt

- generelle data

- Generel databeskyttelsesforordning

- generere

- genererer

- generere

- generation

- generative

- Generativ AI

- GitHub

- giver

- mål

- Ground

- gruppe

- Halvdelen

- håndtere

- Håndtering

- Have

- have

- he

- Overskrift

- Helse

- sygesikring

- sundhedspleje

- Hjerte

- stærkt

- hjælpe

- hjælpe

- hjælper

- hende

- højt niveau

- Høj ydeevne

- hans

- Home

- host

- hostede

- Hvordan

- How To

- http

- HTTPS

- Identity

- if

- illustrerer

- gennemføre

- importere

- vigtigt

- Forbedre

- forbedringer

- forbedring

- in

- Herunder

- stigende

- industrier

- oplysninger

- informationsudtræk

- Infrastruktur

- indvendig

- installere

- instans

- forsikring

- integrere

- integreret

- Integrerer

- intellektuel

- intellektuel ejendomsret

- internationalt

- Internet

- Internetadgang

- ind

- isolerede

- IT

- ITS

- jpg

- lige

- Holde

- holde

- Nøgle

- nøgler

- børn

- viden

- Sprog

- stor

- Latency

- seneste

- lancere

- lanceret

- føre

- Leads

- lække

- LÆR

- læring

- mindst

- til venstre

- Niveau

- Licenseret

- Livet

- Life Sciences

- Line (linje)

- Liste

- notering

- Listings

- levende

- LLM

- belastning

- belastninger

- lokale

- lokalt

- placeret

- placering

- logisk

- Se

- leder

- lave omkostninger

- maskine

- machine learning

- Vedligeholdelse

- lave

- maerker

- administrere

- lykkedes

- ledelse

- markedsplads

- Master

- maksimal

- Kan..

- betyder

- midler

- Memories

- metode

- millioner

- minimering

- minutter

- ML

- model

- modeller

- Moduler

- Moduler

- mere

- mest

- skal

- navn

- indbygget

- Natural

- Natural Language Processing

- Naviger

- Navigation

- Behov

- netværk

- aldrig

- Ny

- NLP

- ingen

- Bemærk

- notesbog

- nu

- nummer

- objekt

- objekter

- of

- tilbyde

- tilbyde

- on

- ONE

- kun

- drift

- Option

- or

- organisationer

- Andet

- vores

- skitseret

- uden for

- i løbet af

- oversigt

- egen

- pakke

- betalt

- pandaer

- brød

- parametre

- parkering

- del

- især

- partner

- partnere

- lidenskabelige

- perfekt

- Udfør

- ydeevne

- personale

- Personlig data

- stykke

- pipeline

- Place

- perron

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- Populær

- bærbarhed

- Indlæg

- potentiale

- magt

- vigtigste

- forud

- foretrækkes

- forberedelse

- præsentere

- forhindre

- private

- behandle

- Behandlet

- Processer

- forarbejdning

- produktion

- produktivitet

- Produkter

- prompter

- beviser

- egenskaber

- ejendom

- foreslog

- proprietære

- beskytte

- beskyttelse

- give

- udbyder

- udbydere

- giver

- offentlige

- Offentlig sky

- spørgsmål

- hurtigt

- klud

- Ranking

- hellere

- RE

- Læs

- Læsning

- modtager

- anbefales

- reducere

- henvise

- om

- region

- reguleret

- regulerede brancher

- Regulering

- lovgivningsmæssige

- relativt

- relevans

- relevant

- resterne

- Repository

- anmode

- påkrævet

- Krav

- Kræver

- ligner i

- Ressourcer

- svar

- reaktioner

- ansvarlige

- REST

- Restauranter

- resultere

- Resultater

- højre

- Risiko

- risikere

- Værelse

- RÆKKE

- Kør

- løber

- runtime

- s

- sagemaker

- skalerbar

- Scale

- Videnskab

- VIDENSKABER

- Søg

- Søgemaskiner

- Secret

- Sektion

- sektioner

- sikker

- sikkert

- sikkerhed

- se

- semantiske

- senior

- følsom

- Følsomhed

- adskille

- tjener

- serveret

- tjener

- tjeneste

- Tjenester

- sæt

- indstilling

- delt

- Aktier

- hun

- Kort

- udstillingsvindue

- lignende

- Simpelt

- forenkler

- enkelt

- størrelser

- lille

- Fodbold

- Software

- løsninger

- Løsninger

- nogle

- Kilde

- kildekode

- Space

- specialiserede

- specifikke

- specificeret

- udgifterne

- stable

- starte

- state-of-the-art

- forblive

- Trin

- Steps

- Stadig

- butik

- opbevaret

- ligetil

- struktur

- stilfuld

- sådan

- egnede

- support

- Understøtter

- sikker

- systemet

- bord

- skræddersyet

- Tag

- tager

- mål

- målrettet

- hold

- hold

- tech

- Teknisk

- Teknologier

- Teknologier

- skabelon

- lejer

- tekst

- Tekstklassificering

- end

- takke

- at

- oplysninger

- deres

- derefter

- Der.

- derfor

- Disse

- de

- tredjepart

- denne

- tre

- Gennem

- tid

- til

- sammen

- værktøjer

- top

- traditionelle

- Tog

- uddannet

- Kurser

- Transform

- transit

- gennemsigtig

- Traveling

- retssag

- tutorial

- to

- typen

- typer

- os

- under

- forstå

- Uventet

- uforglemmelig

- entydigt

- opdateret

- opdateringer

- opdatering

- ovenpå

- URL

- Brug

- brug

- brug tilfælde

- anvendte

- Bruger

- bruger

- ved brug af

- ferie

- værdi

- Værdier

- forskellige

- Ve

- udgave

- via

- Virtual

- mængder

- gå

- Vej..

- måder

- we

- Rigdom

- web

- webservices

- velkommen

- GODT

- var

- hvornår

- som

- mens

- WHO

- hvis

- vilje

- med

- inden for

- Arbejde

- workflow

- arbejder

- virker

- skriver

- Du

- Din

- zephyrnet