Svindel på internettet kan blive meget farligere nu, takket være svindlere, der har uhindret adgang til ChatGPT, Techradar rapporter.

Den meget populære AI-drevne chatbot, ChatGPT, skaber konstant overskrifter. Med sin evne til at skrive alt fra debugging iframe-kode til kompleks computerprogrammeringskode, har ChatGPT etableret AI som årets teknologiske buzzword.

På trods af sin enorme popularitet og engagement har ChatGPT givet anledning til bekymringer om etik og regulering.

Læs også: ChatGPT-brugere 'Jailbreak' AI, Slip Dan Alter Ego løs

En nylig indberette udgivet af cybersikkerhedsforskere ved Norton Labs opstillede tre vigtige måder, hvorpå trusselsaktører kunne misbruge ChatGPT. Rapporten indikerede, at ChatGPT kunne blive misbrugt til at gøre internetsvindel på en mere effektiv måde: gennem generering af dybt falsk indhold, oprettelse af phishing og skabelse af malware.

"Norton Labs forventer, at svindlere også ser på mulighederne i store sprogmodeller og tester måder at forbedre deres cyberkriminalitet på for at gøre dem mere realistiske og troværdige," hedder det i rapporten.

Værktøjets kapacitet til at producere "misinformation af høj kvalitet eller desinformation i stor skala" kunne hjælpe botfarme med at intensivere uenighed mere effektivt. Dette kunne gøre det muligt for ondsindede aktører ubesværet at "indgyde tvivl og manipulere fortællinger på flere sprog," ifølge Norton.

Meget overbevisende 'misinformation'

At skrive forretningsplaner, strategier og virksomhedsbeskrivelser på en overbevisende måde er en børneleg for ChatGPT. Dette potentiale øger dog også risikoen for misinformation, som kan blive til en fidus.

"Ikke kun er indholdet genereret af ChatGPT nogle gange utilsigtet forkert, men en dårlig skuespiller kan også bruge disse værktøjer til med vilje at skabe indhold, der bruges til at skade folk på en eller anden måde," hedder det i rapporten.

Dets evne til at generere "misinformation af høj kvalitet eller desinformation i stor skala kan føre til mistillid og forme fortællinger på forskellige sprog."

At skrive anmeldelser af produkter er blevet stadig nemmere med ChatGPT, som ikke kan spores, fordi det genererer individuelle svar med den samme angivne information hver gang. På trods af sin evne udgør det udfordringen med at "spotte falske anmeldelser og sjuskede produkter."

Bekymrende nok kan værktøjet også bruges til mobning.

"At bruge disse værktøjer i chikanekampagner på sociale medier for at bringe folk til tavshed eller mobbe folk er også et muligt resultat, der ville have en afkølende effekt på tale," bemærker rapporten.

ChatGPT i phishing-kampagner

ChatGPT er særlig god til at generere menneskelignende tekst på forskellige sprog, hvor læserne ikke er klogere på, om teksten er produceret af AI eller menneskelig. Selv OpenAI, udvikleren af ChatGPT, er ikke i stand til at identificere, om en tekst er skrevet af AI, og siger, at "det er umuligt pålideligt at detektere al AI-skrevet tekst."

Udsigten til, at ChatGPT bliver brugt i phishing-kampagner, er reel.

"Ondsindede aktører kan bruge ChatGPT til at lave phishing-e-mails eller opslag på sociale medier, der ser ud til at være fra legitime kilder, hvilket gør det sværere at opdage og forsvare sig mod disse typer trusler," hedder det i rapporten.

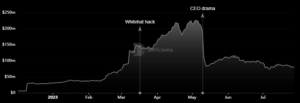

Efterhånden som dens popularitet stiger, er en sandsynlig konsekvens en stigning i antallet af "phishing-kampagner og deres sofistikerede."

Rapporten foreslog, at "ondsindede aktører kan fodre ChatGPT med eksempler fra det virkelige liv på ikke-ondsindede beskeder fra de virksomheder, de ønsker at efterligne, og beordre AI til at skabe nye baseret på samme stil med ondsindede hensigter."

Sådanne kampagner kan vise sig at være yderst vellykkede med hensyn til at bedrage enkeltpersoner til at afsløre personlige oplysninger eller sende penge til kriminelle enheder. Norton Labs rådede forbrugerne til at være forsigtige, når de "klikker på links eller giver personlige oplysninger."

ChatGPT kan skabe malware

Generering af kode og tilpasning af forskellige programmeringssprog er simpelthen en del af ChatGPTs tjenester. Så det er ikke så mærkeligt, at svindlere bruger det til at generere malware.

"Med den rigtige prompt kan nybegyndere malware-forfattere beskrive, hvad de vil gøre og få fungerende kodestykker," ifølge rapporten. Dette udgør en alvorlig trussel om malware-angreb, der er tilstrækkeligt avancerede til at skabe kaos.

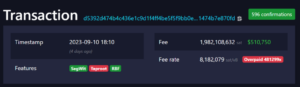

"Et eksempel er at generere kode for at registrere, når en bitcoin-wallet-adresse kopieres til udklipsholderen, så den kan erstattes med en ondsindet adresse, der kontrolleres af malware-forfatteren," forklarede rapporten.

Som et resultat vil tilgængeligheden af en sådan chatbot forårsage en stigning i sofistikeringen af malware.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- Platoblokkæde. Web3 Metaverse Intelligence. Viden forstærket. Adgang her.

- Kilde: https://metanews.com/chatgpt-is-being-used-to-make-quality-scams/

- :er

- 7

- 8

- a

- evne

- I stand

- Om

- misbrug

- adgang

- Ifølge

- aktører

- adresse

- fremskreden

- mod

- AI

- AI-drevne

- Støtte

- Alle

- ,

- foregribe

- vises

- ER

- AS

- At

- Angreb

- forfatter

- forfattere

- tilgængelighed

- Bad

- baseret

- BE

- fordi

- bliver

- være

- Bitcoin

- Bitcoin Wallet

- Bot

- mobning

- virksomhed

- by

- Kampagner

- CAN

- kan ikke

- kapaciteter

- Kapacitet

- Årsag

- forsigtig

- udfordre

- chatbot

- ChatGPT

- kode

- Virksomheder

- selskab

- komplekse

- computer

- Bekymringer

- Forbrugere

- indhold

- Indholdsgenerering

- kontinuerligt

- kontrolleret

- kunne

- håndværk

- skabe

- skabelse

- Criminal

- Cybersecurity

- Dangerous

- beskrive

- Udvikler

- forskellige

- svært

- Offentliggørelse

- disharmoni

- misinformation

- tvivler

- hver

- effekt

- Effektiv

- effektivt

- emails

- muliggøre

- engagement

- enheder

- etableret

- etik

- Endog

- at alt

- eksempel

- eksempler

- forklarede

- falsk

- Gårde

- Til

- svindlere

- fra

- generere

- genereret

- genererer

- generere

- generation

- få

- godt

- Have

- have

- Overskrifter

- stærkt

- Men

- HTTPS

- kæmpe

- menneskelig

- identificere

- umuligt

- in

- Forøg

- Stigninger

- stigende

- angivet

- individuel

- enkeltpersoner

- oplysninger

- hensigt

- med vilje

- Internet

- IT

- ITS

- Nøgle

- Labs

- Sprog

- Sprog

- stor

- føre

- Livet

- links

- lidt

- Lot

- lave

- Making

- malware

- max-bredde

- Medier

- beskeder

- måske

- misinformation

- mistro

- modeller

- penge

- mere

- flere

- fortællinger

- Ny

- Noter

- novice

- nummer

- of

- on

- ONE

- OpenAI

- ordrer

- Resultat

- del

- især

- Mennesker

- personale

- Phishing

- planer

- plato

- Platon Data Intelligence

- PlatoData

- Leg

- Lege for

- Populær

- popularitet

- udgør

- mulig

- Indlæg

- potentiale

- producere

- produceret

- Produkter

- Programmering

- programmeringssprog

- udsigten

- Bevise

- forudsat

- leverer

- offentliggjort

- Læs

- læsere

- ægte

- I virkeligheden

- realistisk

- nylige

- Regulering

- udskiftes

- indberette

- forskere

- resultere

- Anmeldelser

- risici

- samme

- Scale

- Fup

- Snydere

- svindel

- afsendelse

- alvorlig

- Tjenester

- Shape

- Silence

- ganske enkelt

- So

- Social

- sociale medier

- Indlæg på sociale medier

- nogle

- Kilder

- tale

- Trods

- erklærede

- strategier

- stil

- vellykket

- sådan

- tech

- Test

- Tak

- at

- deres

- Them

- Disse

- trussel

- trusselsaktører

- trusler

- tre

- Gennem

- tid

- til

- værktøj

- værktøjer

- TUR

- typer

- frigøre

- brug

- brugere

- tegnebog

- Vej..

- måder

- Hvad

- hvorvidt

- som

- bredt

- vilje

- med

- arbejder

- ville

- skriver

- skriftlig

- zephyrnet