Introduktion

Hvornår Alexei Efros flyttede med sin familie fra Rusland til Californien som teenager i 1980'erne, medbragte han sin sovjetbyggede personlige computer, en Elektronika BK-0010. Maskinen havde ingen ekstern lagring og blev overophedet med få timers mellemrum, så for at spille videospil skulle han skrive kode, fejlfinde og spille hurtigt - før maskinen lukkede ned. Den cyklus, som gentages de fleste dage, fremskyndede hans indlæring.

"Jeg var meget heldig, at denne sovjetiske computer ikke var særlig god!" sagde Efros, der ler let og taler med en mild russisk accent. Han spiller ikke så mange spil i dag, men viljen til at udforske og få mest muligt ud af hans værktøjer består.

På kandidatskolen ved University of California, Berkeley, begyndte Efros at vandre og udforske Bay Areas naturlige skønhed. Det varede ikke længe, før han begyndte at kombinere sin passion for computere med sin nydelse af disse seværdigheder. Han udviklede en måde til problemfrit at lappe huller i fotografier - for eksempel ved at erstatte en vildfaren skraldespand på et billede af en redwood-skov med naturligt udseende træer. Adobe Photoshop adopterede senere en version af teknikken til sit "indholdsbevidste udfyldningsværktøj".

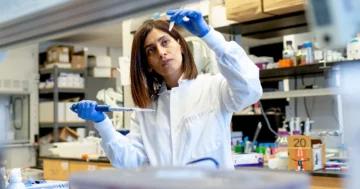

Nu er en datalog ved Berkeley Artificial Intelligence Research Lab, Efros kombinerer massive onlinedatasæt med maskinlæringsalgoritmer for at forstå, modellere og genskabe den visuelle verden. I 2016 tildelte Foreningen for Datamaskiner ham sin Præmie i computing for hans arbejde med at skabe realistiske syntetiske billeder og kalder ham en "billedalkymist".

Introduktion

Efros siger, at på trods af forskernes bedste indsats ser maskiner stadig fundamentalt anderledes, end vi gør. "Pletter af farver og lysstyrke kræver, at vi forbinder det, vi ser nu, til vores hukommelse om, hvor vi har set disse ting før," sagde Efros. "Denne forbindelse giver mening til det, vi ser." Alt for ofte ser maskiner, hvad der er der i øjeblikket uden at forbinde det med det, de har set før.

Men forskel kan have fordele. Inden for computersyn værdsætter Efros umiddelbarheden af at vide, om en algoritme designet til at genkende objekter og scener virker på et billede. Nogle af hans computervisionsspørgsmål - såsom "Hvad får Paris til at ligne Paris?” — have en filosofisk tilbøjelighed. Andre, såsom hvordan man adresserer vedvarende bias i datasæt, er praktiske og presserende.

"Der er mange mennesker, der laver kunstig intelligens med sprog lige nu," sagde Efros. "Jeg vil se på de helt visuelle mønstre, der er efterladt." Ved at forbedre computersynet håber han ikke kun på bedre praktiske applikationer, såsom selvkørende biler; han ønsker også at udvinde disse indsigter for bedre at forstå, hvad han kalder "menneskelig visuel intelligens" - hvordan folk forstår, hvad de ser.

Quanta Magazine mødtes med Efros på hans kontor i Berkeley for at tale om videnskabelige superkræfter, vanskeligheden ved at beskrive det visuelle, og hvor farlig kunstig intelligens egentlig er. Interviewet er blevet komprimeret og redigeret for klarhedens skyld.

Introduktion

Hvordan er computersynet blevet bedre, siden du var studerende?

Da jeg startede min ph.d., var der næsten ikke noget brugbart. Nogle robotter skruede nogle skruer ved hjælp af computersyn, men det var begrænset til denne form for meget kontrollerede industrielle omgivelser. Så pludselig opdagede mit kamera ansigter og gjorde dem skarpere.

Nu er computersyn i et stort antal applikationer, såsom selvkørende biler. Det tager længere tid, end nogle mennesker først troede, men der er stadig fremskridt. For nogen, der ikke kører bil, er dette ekstremt spændende.

Vent, du kører ikke?

Nej, jeg ser ikke godt nok til at køre! [Griner.] For mig ville dette være sådan en game changer - at have en bil, der kunne køre mig til steder.

Jeg var ikke klar over, at dit syn forhindrede dig i at køre bil. Kan du se de billeder, du arbejder med, på en computerskærm?

Hvis jeg laver dem store nok. Du kan se, at mine skrifttyper er ret store. Jeg er født med at se dårligt. Jeg tror, at alle andre er sære, fordi de har et sindssygt godt syn.

Påvirkede din status som ikke-weirdo din forskningsretning?

Hvem ved? Der var bestemt ingen følelse af "Åh, jeg kan ikke se godt, så jeg vil lave computere, der ser bedre." Nej, det har jeg aldrig haft som motivation.

For at være en god videnskabsmand har du brug for en hemmelig supermagt. Du skal gøre noget bedre end alle andre. Det fantastiske ved videnskaben er, at vi ikke alle har den samme superkraft. Måske har min superkraft været, at jeg, fordi jeg ikke ser så godt, måske har mere indsigt i synsproblemet.

Introduktion

Jeg forstod tidligt vigtigheden af tidligere data, når man så på verden. Jeg kunne ikke se så godt selv, men min hukommelse om tidligere oplevelser fyldte hullerne nok til, at jeg stort set kunne fungere lige så godt som et normalt menneske. De fleste ved ikke, at jeg ikke ser godt. Det gav mig – tror jeg – denne unikke intuition om, at det måske handler mindre om pixels og mere om hukommelsen.

Computere ser kun, hvad der er der nu, hvorimod vi ser øjeblikket forbundet med tapetet af alt, hvad vi har set før.

Er det overhovedet muligt med ord at udtrykke de subtile visuelle mønstre, der for eksempel får Paris til at ligne Paris?

Når du er i en bestemt by, ved du nogle gange bare, hvilken by du er i - der er dette du ne sais quoi, selvom du aldrig har været på netop det gadehjørne. Det er ekstremt svært at beskrive med ord, men det er lige der i pixels.

[For Paris] kunne man tale om, hvordan det normalt er seks-etagers bygninger, og som regel er der balkoner på den fjerde etage. Man kunne sætte ord på noget af dette, men meget er ikke sprogligt. For mig er det spændende.

Dit seneste arbejde involverer at lære computere at indtage visuelle data på måder, der efterligner menneskesyn. Hvordan virker det?

Lige nu har computere et enormt datasæt: milliarder af tilfældige billeder skrabet af internettet. De tager tilfældige billeder, behandler et billede, tager så et andet tilfældigt billede, behandler det osv. Du træner dit [computers visuelle] system ved at gå igen og igen dette datasæt.

Den måde, vi - biologiske agenser - indtager data på, er meget forskellig. Når vi står over for en ny situation, er det den eneste gang, disse data vil være der for os. Vi har aldrig været i denne præcise situation, i dette rum, med denne belysning, klædt på denne måde. For det første bruger vi disse data til at gøre det, vi skal gøre, for at forstå verden. Derefter bruger vi disse data til at lære af dem, [for at forudsige] fremtiden.

Introduktion

Desuden er de data, vi ser, ikke tilfældige. Det, du ser nu, er meget korreleret med det, du så for få sekunder siden. Du kan tænke på det som video. Alle videoens frames er korreleret til hinanden, hvilket er meget forskelligt fra hvordan computere behandler dataene.

Jeg er interesseret i at få vores læringstilgang til at være en, hvor computere ser dataene, når de kommer ind, behandler dem og lærer af dem, mens de går.

Jeg forestiller mig, at det ikke er så enkelt som at få computere til at se videoer i stedet for stillbilleder.

Nej, du skal stadig bruge [computere] til at tilpasse sig. Jeg er interesseret i at lære tilgange, der ser dataene, som de kommer ind og derefter behandler og lærer af dem, mens de går. En tilgang vi har er kendt som test-time træning. Ideen er, at når du ser på en sekvens af billeder som en video, kan tingene ændre sig. Så du ønsker ikke, at din model bliver fikset. Ligesom et biologisk middel altid tilpasser sig sine omgivelser, ønsker vi, at computeren løbende tilpasser sig.

Standardparadigmet er, at du først træner på et stort datasæt, og derefter implementerer du. Dall·E og ChatGPT blev trænet på internettet omkring 2021, og derefter frøs [deres viden]. Så spyr den ud, hvad den allerede ved. En mere naturlig måde er [test-time-træning], at prøve at få det til at absorbere data og lære på jobbet, ikke at have separate trænings- og implementeringsfaser.

Der er helt sikkert et problem med computere, kaldet domæneskift eller datasæt bias - denne idé om, at hvis dine træningsdata er meget forskellige fra de data, du bruger, når du implementerer systemet, vil tingene ikke fungere meget godt. Vi gør nogle fremskridt, men vi er ikke helt der endnu.

Introduktion

Er problemet det samme som, hvordan banker advarer investorer om, at tidligere resultater muligvis ikke forudsiger fremtidig indtjening?

Det er netop problemet. I den virkelige verden ændrer tingene sig. For eksempel, hvis en markmus ender i et hus, vil den klare sig fint. Du slipper aldrig af med den mus! [griner.] Den blev født på en mark, har aldrig været i et hus før, og alligevel vil den finde og spise alle dine forsyninger. Den tilpasser sig meget hurtigt, lærer og tilpasser sig de nye omgivelser.

Den evne er der ikke i de nuværende [computer vision]-systemer. Med selvkørende, hvis du træner en bil i Californien og derefter tester den i Minnesota — boom! - der er sne. Den har aldrig set sne. Det bliver forvirret.

Nu adresserer folk dette ved at få så meget data, at [systemet] stort set har set alt. Så behøver den ikke tilpasse sig. Men det går stadig glip af sjældne begivenheder.

Det lyder som om AI-systemer er vejen frem. Hvor efterlader det mennesker?

Det arbejde, der kommer ud af OpenAI både på tekstfronten (ChatGPT) og på billedfronten (Dall·E) har været utrolig spændende og overraskende. Det bekræfter denne idé om, at når du har nok data, kan rimeligt simple metoder give overraskende gode resultater.

Introduktion

Men ChatGPT fik mig til at indse, at mennesker ikke er så kreative og exceptionelle, som vi kan lide at se os selv. Det meste af tiden kunne mønstergenkenderne i os tage over. Vi taler i sætninger lavet ud fra sætninger eller sætninger, vi har hørt før. Selvfølgelig har vi lyst og kreativitet. Vi er i stand til at gøre ting, som computere ikke kan - i det mindste for nu. Men det meste af tiden kunne vi blive erstattet af ChatGPT, og de fleste ville ikke bemærke det.

Det er ydmygende. Men det er også en motivator til at bryde ud af disse mønstre, for at prøve at få flere lyster, for ikke at blive hængende i klichéer og pasticher.

Nogle videnskabsmænd har udtrykt bekymring over de risici, kunstig intelligens udgør for menneskeheden. Er du bekymret?

Mange forskere, som jeg har stor respekt for, har advaret om kunstig intelligens. Jeg ønsker ikke at formindske de ord. Mange af disse er gyldige pointer. Men man er nødt til at sætte tingene i perspektiv.

Lige nu kommer den største fare for civilisationen ikke fra computere, men fra mennesker. Nuklear Armageddon og klimaændringer er meget mere presserende bekymringer. Den Russiske Føderation har angrebet sin fuldstændig uskyldige nabo. Jeg er født i Rusland, og det er særligt rædselsfuldt, at mine tidligere landsmænd kunne gøre dette. Jeg gør alt, hvad jeg kan for at sikre, at dette forbliver emne nummer et.

Vi tror måske, at AI-revolutionen er den vigtigste begivenhed i vores liv. Men AI-revolutionen bliver ingenting, hvis vi ikke redder den frie verden.

Så du bekymrer dig slet ikke om AI?

Nej. Du ved, jeg elsker at bekymre mig. Jeg er en stor bekymrer! Men hvis Putin, der ødelægger verden, er her [løfter hånden til hovedet] og klimaforandringerne er her [sænker hånden til sine skuldre], så er AI hernede [sænker hånden op på fødderne]. Det er brøkdele af en procent af min bekymring sammenlignet med Putin og klimaforandringerne.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://www.quantamagazine.org/the-computing-pioneer-helping-ai-see-20231024/

- :har

- :er

- :ikke

- :hvor

- ][s

- $OP

- 2016

- 2021

- a

- evne

- I stand

- Om

- accelereret

- ACM

- tilpasse

- tilpasser

- adresse

- Adobe

- vedtaget

- fordele

- Agent

- midler

- siden

- AI

- AI-systemer

- algoritme

- algoritmer

- Alle

- næsten

- allerede

- også

- altid

- am

- an

- ,

- En anden

- applikationer

- tilgang

- tilgange

- ER

- kunstig

- kunstig intelligens

- AS

- Association

- At

- uddelt

- Banker

- I bund og grund

- Bugt

- BE

- Skønhed

- fordi

- været

- før

- begyndte

- bag

- Berkeley

- BEDSTE

- Bedre

- skævhed

- Big

- Big data

- Største

- milliarder

- født

- både

- Pause

- bryde ud

- bragte

- men

- by

- california

- kaldet

- ringer

- Opkald

- værelse

- CAN

- kan ikke

- bil

- biler

- lave om

- Changer

- skiftende

- ChatGPT

- cirka

- By

- Civilization

- klarhed

- Klima

- Klima forandring

- kode

- farve

- kombinerer

- kombinerer

- kommer

- kommer

- sammenlignet

- fuldstændig

- computer

- Computer Vision

- computere

- computing

- Bekymring

- forvirret

- Tilslut

- tilsluttet

- Tilslutning

- tilslutning

- kontinuerligt

- kontrolleret

- Corner

- kunne

- Kursus

- skøre

- Oprettelse af

- Kreativ

- kreativitet

- Nuværende

- cyklus

- FARE

- Dangerous

- data

- datasæt

- datasæt

- Dage

- definitivt

- indsætte

- implementering

- implementering

- beskrive

- konstrueret

- Trods

- opdaget

- udviklet

- forskel

- forskellige

- Vanskelighed

- retning

- do

- gør

- Er ikke

- gør

- domæne

- Dont

- ned

- køre

- kørsel

- Dumpster

- hver

- Tidligt

- Indtjening

- nemt

- spiser

- indsats

- andet

- ender

- nok

- Miljø

- etc.

- Endog

- begivenhed

- begivenheder

- Hver

- alle

- at alt

- præcist nok

- eksempel

- enestående

- spændende

- Oplevelser

- udforske

- Udforskning

- Express

- udtrykt

- ekstern

- ekstremt

- konfronteret

- ansigter

- familie

- FAST

- Føderation

- Feet

- få

- felt

- fyldt

- Finde

- ende

- Fornavn

- fast

- Fly

- skrifttyper

- Til

- skov

- Tidligere

- Videresend

- Fjerde

- Gratis

- fra

- forsiden

- funktion

- fundamentalt

- fremtiden

- spil

- game-changer

- Spil

- gav

- få

- få

- GitHub

- giver

- Go

- gå

- godt

- eksamen

- stor

- havde

- hånd

- Hård Ost

- Have

- have

- he

- hoved

- hørt

- hjælpe

- link.

- ham

- hans

- Huller

- håber

- gruopvækkende

- HOURS

- hus

- Hvordan

- How To

- HTML

- http

- HTTPS

- kæmpe

- menneskelig

- Menneskelighed

- Mennesker

- i

- idé

- if

- billede

- billeder

- billede

- betydning

- vigtigt

- forbedret

- forbedring

- in

- utroligt

- industrielle

- indflydelse

- i første omgang

- uskyldig

- indsigt

- indsigt

- i stedet

- Intelligens

- interesseret

- Internet

- Interview

- ind

- Investorer

- spørgsmål

- IT

- ITS

- Job

- lige

- Venlig

- Kend

- Kendskab til

- viden

- kendt

- kender

- lab

- Sprog

- senere

- LÆR

- læring

- mindst

- Forlade

- til venstre

- mindre

- levetid

- Belysning

- ligesom

- Limited

- Lang

- længere

- Se

- ligner

- leder

- Lot

- kærlighed

- maskine

- machine learning

- maskiner

- Maskiner

- lavet

- magasin

- lave

- maerker

- Making

- mange

- massive

- Kan..

- kan være

- me

- betyder

- Hukommelse

- mødte

- metoder

- måske

- misses

- MIT

- model

- øjeblik

- Overvåg

- mere

- mest

- Motivation

- flyttet

- meget

- my

- mig selv

- Natural

- ne

- Behov

- behov

- aldrig

- Ny

- ingen

- normal

- intet

- Varsel..

- roman

- nu

- nukleare

- nummer

- objekter

- of

- off

- Office

- tit

- on

- engang

- ONE

- online

- kun

- OpenAI

- or

- ordrer

- Andet

- Andre

- vores

- os selv

- ud

- i løbet af

- paradigme

- Paris

- særlig

- især

- lidenskab

- forbi

- patch

- Mønster

- mønstre

- Mennesker

- procent

- ydeevne

- person,

- personale

- perspektiv

- foto

- fotografier

- sætninger

- pioner

- Steder

- plato

- Platon Data Intelligence

- PlatoData

- Leg

- punkter

- udgør

- mulig

- Praktisk

- forudsige

- trykke

- Forud

- Problem

- behandle

- producere

- Progress

- sætte

- Putin

- Spørgsmål

- hurtigt

- helt

- rejser

- tilfældig

- SJÆLDEN

- bekræfter igen

- ægte

- virkelige verden

- realistisk

- indse

- virkelig

- nylige

- genkende

- resterne

- gentaget

- udskiftes

- kræver

- forskning

- forskere

- respekt

- Resultater

- revolution

- Rid

- højre

- risici

- robotter

- Værelse

- Rusland

- Russisk

- Den Russiske Føderation

- Said

- samme

- Gem

- så

- siger

- scener

- Skole

- Videnskab

- videnskabelig

- Videnskabsmand

- forskere

- problemfrit

- sekunder

- Secret

- se

- se

- set

- selvkørende

- forstand

- adskille

- Sequence

- sæt

- sæt

- indstilling

- skifte

- skuldre

- Luk ned

- Syn

- Seværdigheder

- lignende

- Simpelt

- siden

- Situationen

- sne

- So

- nogle

- noget

- sommetider

- tale

- Taler

- standard

- påbegyndt

- Status

- Stadig

- opbevaring

- Story

- gade

- studerende

- sådan

- supermagt

- forsyninger

- sikker

- overraskende

- syntetisk

- systemet

- Systemer

- Tag

- tager

- Tal

- Undervisning

- teknik

- teenager

- prøve

- tekst

- end

- at

- Fremtiden

- verdenen

- deres

- Them

- derefter

- Der.

- Disse

- de

- ting

- ting

- tror

- denne

- dem

- selvom?

- tænkte

- tid

- til

- også

- værktøj

- værktøjer

- emne

- Tog

- uddannet

- Kurser

- Træer

- prøv

- forstå

- forstået

- enestående

- universitet

- University of California

- us

- brug

- ved brug af

- sædvanligvis

- gyldig

- udgave

- meget

- video

- videospil

- Videoer

- vision

- visuals

- ønsker

- ønsker

- advarsel

- var

- Vej..

- måder

- we

- WebP

- GODT

- var

- Hvad

- Hvad er

- hvornår

- ud fra følgende betragtninger

- hvorvidt

- som

- WHO

- helt

- vilje

- villighed

- med

- uden

- ord

- Arbejde

- virker

- world

- bekymret

- bekymre sig

- ville

- skriver

- skriv kode

- endnu

- Du

- Din

- zephyrnet