I dag er vi glade for at kunne meddele, at Gemma model er nu tilgængelig for kunder, der bruger Amazon SageMaker JumpStart. Gemma er en familie af sprogmodeller baseret på Googles Gemini-modeller, trænet på op til 6 billioner tokens tekst. Gemma-familien består af to størrelser: en 7 milliarder parametermodel og en 2 milliarder parametermodel. Nu kan du bruge Gemma 2B og Gemma 7B fortrænede og instruktionstunede modeller inden for SageMaker JumpStart. JumpStart er maskinlæringscentret (ML) i SageMaker, der giver adgang til fundamentmodeller ud over indbyggede algoritmer og end-to-end løsningsskabeloner, der hjælper dig hurtigt med at komme i gang med ML.

I dette indlæg gennemgår vi, hvordan du implementerer Gemma-modellen og finjusterer den til dine brugstilfælde i SageMaker JumpStart. Den komplette notesbog er tilgængelig på GitHub.

Gemma model

Gemma er en familie af letvægts, state-of-the-art modeller bygget ud fra den samme forskning og teknologi, der blev brugt til at skabe Gemini modeller. Gemma er udviklet af Google DeepMind og andre teams på tværs af Google og er inspireret af Gemini. Gemma udviser stærke generalistiske evner inden for tekstdomæner og state-of-the-art forståelse og ræsonnement færdigheder i skala. Det opnår bedre ydeevne sammenlignet med andre offentligt tilgængelige modeller af lignende eller større skalaer på tværs af forskellige domæner, herunder besvarelse af spørgsmål, fornuftig ræsonnement, matematik og naturvidenskab og kodning. Gemma frigav modelvægtene for at understøtte udviklerinnovation ved hjælp af Gemma-modeller. Gemma blev lanceret med en ny Ansvarlig Generative AI Toolkit der giver vejledning og væsentlige værktøjer til at skabe sikrere AI-applikationer med Gemma.

Fundamentmodeller i SageMaker

JumpStart giver adgang til en række modeller fra populære modelhubs, herunder Hugging Face, PyTorch Hub og TensorFlow Hub, som du kan bruge i dit ML-udviklingsworkflow i SageMaker. De seneste fremskridt inden for ML har givet anledning til en ny klasse af modeller kendt som fundament modeller, som typisk trænes på milliarder af parametre og kan tilpasses til en bred kategori af use cases, såsom tekstresumé, generering af digital kunst og sprogoversættelse. Fordi disse modeller er dyre at træne, ønsker kunder at bruge eksisterende præ-trænede foundation-modeller og finjustere dem efter behov, i stedet for at træne disse modeller selv. SageMaker giver en udvalgt liste over modeller, som du kan vælge imellem på SageMaker-konsollen.

Du kan nu finde fundamentmodeller fra forskellige modeludbydere i JumpStart, så du hurtigt kan komme i gang med fundamentmodeller. Du kan finde funderingsmodeller baseret på forskellige opgaver eller modeludbydere og gennemgå modellens karakteristika og brugsbegreber. Du kan også prøve disse modeller ved hjælp af en test-UI-widget. Når du vil bruge en fundamentmodel i stor skala, kan du gøre det uden at forlade SageMaker ved at bruge forudbyggede notesbøger fra modeludbydere. Fordi modellerne hostes og implementeres på AWS, deles dine data, uanset om de bruges til at evaluere modellen eller bruge den i stor skala, aldrig med tredjeparter.

Lad os undersøge, hvordan du kan bruge Llama Guard-modellen i JumpStart.

Udforsk Gemma-modellen i Jumpstart

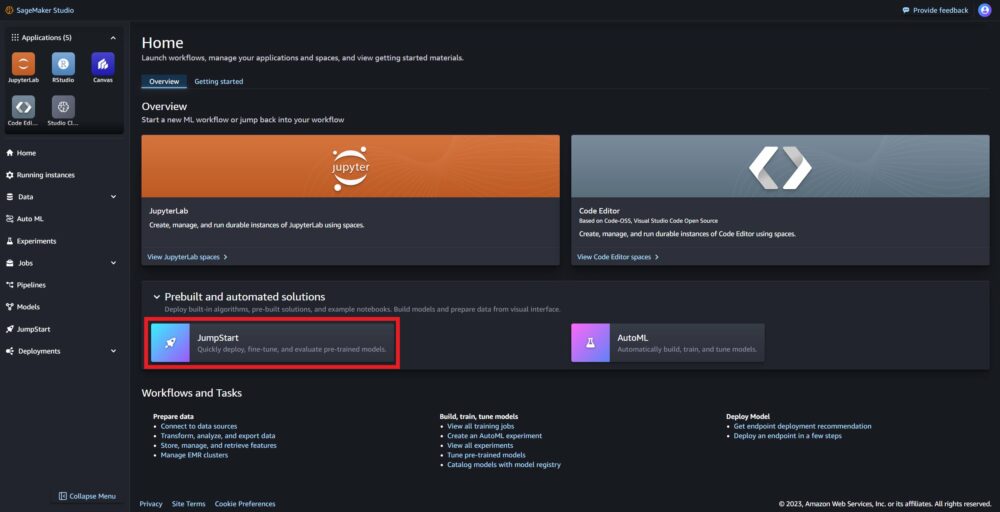

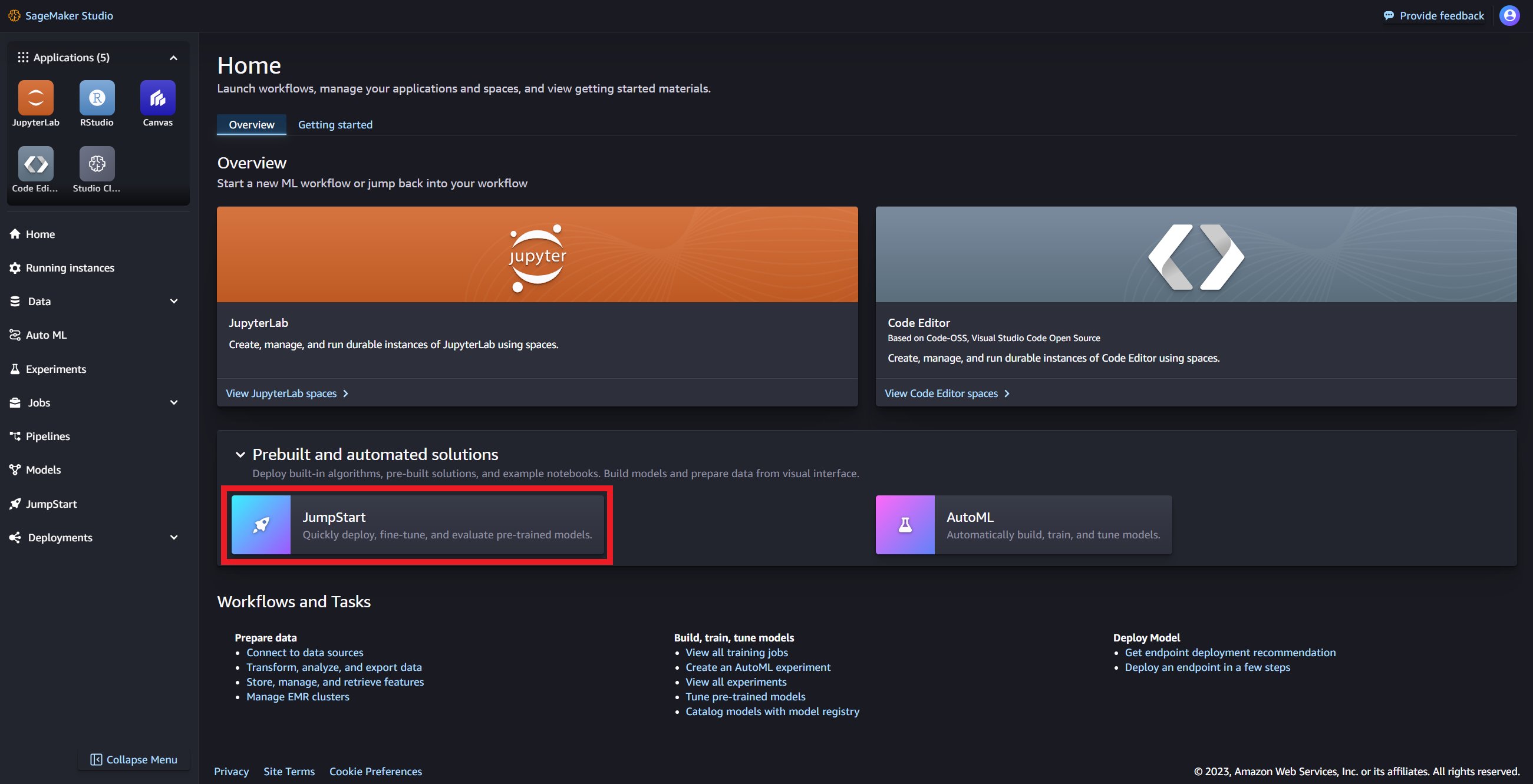

Du kan få adgang til Gemma-fundamentmodeller gennem SageMaker JumpStart i SageMaker Studio UI og SageMaker Python SDK. I dette afsnit gennemgår vi, hvordan du opdager modellerne i SageMaker Studio.

SageMaker Studio er et integreret udviklingsmiljø (IDE), der giver en enkelt webbaseret visuel grænseflade, hvor du kan få adgang til specialbyggede værktøjer til at udføre alle ML-udviklingstrin, fra forberedelse af data til opbygning, træning og implementering af dine ML-modeller. For flere detaljer om, hvordan du kommer i gang og konfigurerer SageMaker Studio, se Amazon SageMaker Studio.

I AWS Management Console til SageMaker Studio skal du gå til SageMaker JumpStart under Præbyggede og automatiserede løsninger. Jumpstart indeholder præ-trænede modeller, notebooks og præbyggede løsninger.

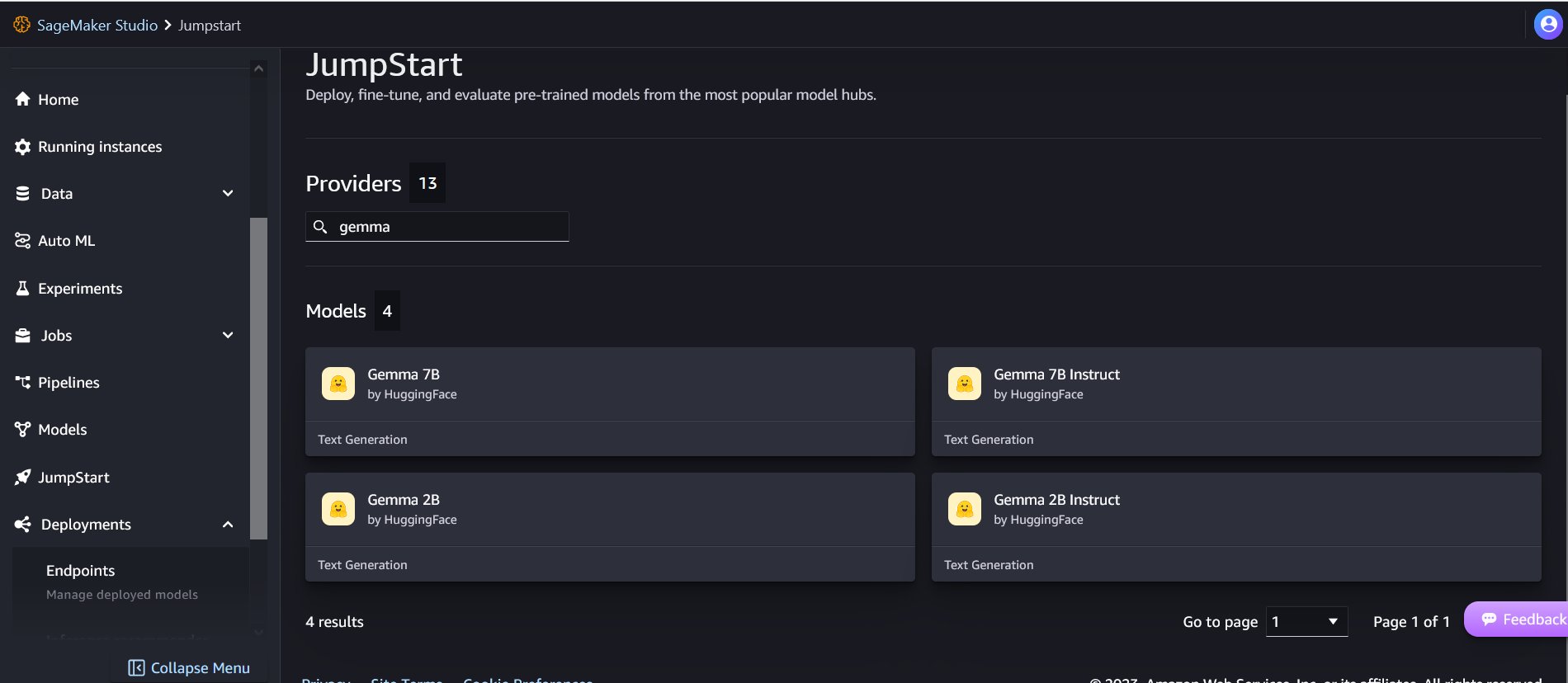

På SageMaker JumpStart-landingssiden kan du finde Gemma-modellen ved at søge efter Gemma.

Du kan derefter vælge mellem en række Gemma-modelvarianter, herunder Gemma 2B, Gemma 7B, Gemma 2B instruct og Gemma 7B instruct.

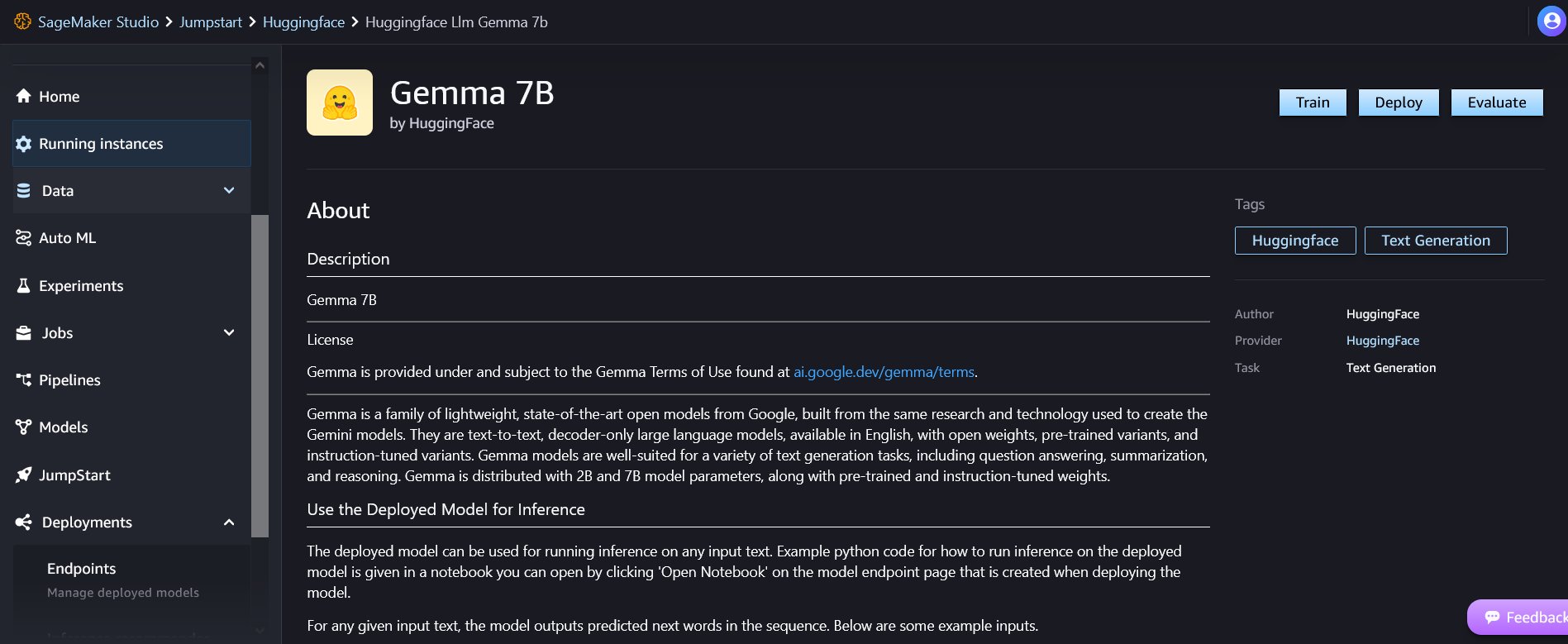

Vælg modelkortet for at se detaljer om modellen, såsom licensen, data brugt til at træne, og hvordan du bruger modellen. Du finder også en Implementer knap, som fører dig til en landingsside, hvor du kan teste slutninger med et eksempel på nyttelast.

Implementer Gemma med SageMaker Python SDK

Du kan finde koden, der viser implementeringen af Gemma på JumpStart og et eksempel på, hvordan du bruger den installerede model i denne GitHub notesbog.

Start med at vælge SageMaker Model Hub-model-id og modelversion, der skal bruges, når Gemma implementeres.

Vælg et model-id fra følgende tabel, som beskriver standardkonfigurationsmulighederne for JumpStart-implementeringen. På grund af den store ordforrådsstørrelse på 256 tokens kan Gemma 7B kun passe på en enkelt A10G GPU, når den understøtter en kontekstlængde på 1. Af denne grund bruger JumpStart en større standardinstans til Gemma 7B.

| Model ID | Standardinferensforekomst | Tensor parallel grad | Understøttet kontekst Længde |

| huggingface-llm-gemma-2b | ml.g5.xlarge | 1 | 8k |

| huggingface-llm-gemma-2b-instruct | ml.g5.xlarge | 1 | 8k |

| huggingface-llm-gemma-7b | ml.g5.12xlarge | 4 | 8k |

| huggingface-llm-gemma-7b-instruct | ml.g5.12xlarge | 4 | 8k |

Du kan nu implementere modellen ved hjælp af SageMaker JumpStart. Følgende kode bruger standardforekomsten ml.g5.12xlarge for slutningsendepunktet Du kan implementere modellen på andre instanstyper ved at videregive instance_type i JumpStartModel klasse. Implementeringen kan tage 5-10 minutter.

For en vellykket implementering skal du manuelt ændre accept_eula argument i modellens implementeringsmetode til True. Denne model er implementeret ved hjælp af tekst-generation-inferens (TGI) deep learning container.

Kald slutpunkt

Du kan programmatisk hente eksempler på nyttelast fra JumpStartModel objekt. Dette vil hjælpe dig med at komme i gang ved at observere forudformaterede instruktionsprompter, som Gemma kan indtage.

Før vi ser på specifikke prompter, lad os overveje chatskabelonen for Gemma Instruct-modeller.

Her placerer du din prompt i [USER_PROMPT] Beliggenhed. Der er ingen understøttelse af en systeminstruktion; i stedet kan du sætte den ønskede instruktion foran brugerprompten. Derudover, hvis du har en samtale med flere drejninger, kan modelprompten skifte mellem bruger og assistent efter behov.

Overvej nu et par instruktionseksempler. Her beder du Gemma om at skrive et Hello World-program.

Følgende er det forventede output:

Dernæst påkalder du Gemma den kreative opgave at skrive et digt.

Følgende er output:

Det her ser ret godt ud!

Lad os nu se på benchmarking af latency og gennemløbsydelse for modelvisning med standard JumpStart-implementeringskonfigurationen. Her viser vi, hvordan modelydeevnen kan variere for din typiske endpoint-arbejdsbelastning. I de følgende tabeller kan du observere, at små forespørgsler (256 inputord og 256 output-tokens) er ret effektive under et stort antal samtidige brugere, og når token-gennemstrømning i størrelsesordenen et tusind til to tusinde tokens pr. sekund. Men efterhånden som antallet af inputord nærmer sig Gemmas maksimale understøttede kontekstlængde på otte tusinde tokens, mætter endepunktet dets batchkapacitet – antallet af samtidige anmodninger, der må behandles samtidigt – på grund af instanshukommelsesbundne begrænsninger.

For mere information om, hvordan du overvejer disse oplysninger og justerer implementeringskonfigurationer til din specifikke brugssag, se Benchmark og optimer implementering af slutpunkter i Amazon SageMaker JumpStart.

| . | Gennemløb (tokens/s) | ||||||||||

| Samtidige brugere | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| model | Forekomsttype | Indtastningsord | Output tokens | . | . | . | . | . | . | . | . |

| gemma-2b-instruktion | ml.g5.xlarge | 256 | 256 | 73 | 137 | 262 | 486 | 829 | 1330 | 1849 | 1834 |

| 2048 | 256 | 69 | 126 | 227 | 373 | 537 | 704 | 764 | — | ||

| 7936 | 256 | 60 | 100 | 147 | 195 | 226 | 230 | — | — | ||

| gemma-7b-instruktion | ml.g5.12xlarge | 256 | 256 | 62 | 119 | 227 | 413 | 601 | 811 | 937 | 962 |

| 2048 | 256 | 56 | 100 | 172 | 245 | 267 | 273 | — | — | ||

| 7936 | 256 | 44 | 67 | 77 | 77 | 78 | — | — | — | ||

| . | P50 latens (ms/token) | ||||||||||

| Samtidige brugere | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| model | Forekomsttype | Indtastningsord | Output tokens | . | . | . | . | . | . | . | . |

| gemma-2b-instruktion | ml.g5.xlarge | 256 | 256 | 13 | 14 | 15 | 16 | 19 | 23 | 33 | 49 |

| 2048 | 256 | 14 | 15 | 17 | 20 | 28 | 43 | 79 | — | ||

| 7936 | 256 | 16 | 19 | 26 | 39 | 68 | 136 | — | — | ||

| Gemma-7b-instruktion | ml.g5.12xlarge | 256 | 256 | 16 | 16 | 17 | 19 | 26 | 38 | 57 | 110 |

| 2048 | 256 | 17 | 19 | 23 | 32 | 52 | 119 | — | — | ||

| 7936 | 256 | 22 | 29 | 45 | 105 | 197 | — | — | — | ||

Finjuster Gemma ved hjælp af SageMaker Python SDK

Dernæst viser vi dig, hvordan du finjusterer Gemma 7B-instruktionsmodellen på et samtaleformateret datasæt ved hjælp af QLoRA teknik. Som tidligere nævnt, på grund af den store ordforrådsstørrelse på 256 tusind og 8 tusind kontekstlængde, tilbyder JumpStart følgende standardkonfigurationer til QLoRA-finjustering.

| Model ID | Standard træningsforekomst | Maksimal længde på inputsekvens | Per enhed træningsbatchstørrelse | Gradientakkumuleringstrin |

| huggingface-llm-gemma-2b | ml.g5.2xlarge | 1024 | 1 | 4 |

| huggingface-llm-gemma-2b-instruct | ml.g5.2xlarge | 1024 | 1 | 4 |

| huggingface-llm-gemma-7b | ml.g5.12xlarge | 2048 | 1 | 4 |

| huggingface-llm-gemma-7b-instruct | ml.g5.12xlarge | 2048 | 1 | 4 |

Lad os indlæse og behandle datasættet i samtaleformat. Eksempeldatasættet til denne demonstration er OpenAssistants TOP-1 samtaletråde.

Træningsdataene skal formuleres i JSON-linjer (.jsonl) format, hvor hver linje er en ordbog, der repræsenterer et sæt samtaler. Et eksempel i JSON-linjefilen er vist nedenfor. For detaljer om, hvordan datasættet behandles, se notesbogen i GitHub.

Underliggende træningsscripts bruger JumpStart HuggingFace SFTræner med QLoRA , FlashAttention. Flash Attention muliggør skaleringseffektivitet, hvilket fører til hurtigere træning og inferens. Udover chat-baseret finjustering, understøtter JumpStart også instruktion og domænetilpasning finjustering med QLoRA. For detaljer, se notesbogen i GitHub.

Efter finjusteringen kan du implementere den finjusterede model til et SageMaker-slutpunkt.

Du kan vælge at implementere modellen finjusteret på samtaledata i SageMaker-slutpunktet med HuggingFace messages API-funktion som en alternativ tilgang. Fordelen ved at bruge Message API-funktionen er, at den giver brugerne mulighed for at videregive forespørgselseksemplerne i råformat som vist i følgende tabel, og chat_template i slutpunktet vil konvertere forespørgselseksemplerne til det korrekte format, før de sendes til modellen. For detaljer, se installationsafsnittet efter finjustering i notesbog.

Efter at have implementeret den finjusterede model i et slutpunkt, kan du sammenligne output-svar fra forudtrænede og finjusterede Gemma-modeller. Eksemplerne er indsamlet fra testdata, som er et hold-out-sæt fra træningsdataene. Inferensparametrene er max_tokens som 512, top_p som 0.9, temperature som 0.4, og top_k som 50.

Som du kan se med finjusteringsresultaterne, er agentsvarene mere nøjagtige.

For yderligere at evaluere dine finjusterede modeller, kan du udforske FM-evaluering med Amazon SageMaker Clarify for at se, hvordan din finjusterede model klarer sig i forhold til basismodellen.

| Indgange | Grund sandhed | Svar fra bund model | Svar fra finjusteret model | |

| 1 |

Bruger: Jeg vil arbejde med mit ordforråd, kan du give mig nogle enkle måder, hvorpå jeg kan finde nye ord at bruge til at øge mangfoldigheden af mine sætninger? Assistent: Helt sikkert! At forbedre dit ordforråd er en løbende proces, men her er nogle enkle måder at finde nye ord og øge mangfoldigheden af dine sætninger: 1. Læs meget: At læse bøger, artikler og blogs fra forskellige genrer og emner udsætter dig for nye ord og sætninger. Noter alle ukendte ord, du støder på, og slå deres betydning op. 2. Brug en synonymordbog: Når du skriver eller læser, så brug en synonymordbog til at finde synonymer til almindeligt anvendte ord. Dette hjælper dig ikke kun med at lære nye ord, men forbedrer også din forståelse af deres subtile betydningsforskelle. 3. Ord-en-dag-kalendere eller apps: Abonner på en ord-en-dag-e-mail eller download en app til opbygning af ordforråd. Disse værktøjer introducerer dig til et nyt ord hver dag sammen med dets betydning, udtale og brugseksempler. 4. Deltag i en bogklub eller diskussionsgruppe: At deltage i samtaler og diskussioner om bøger, artikler eller et hvilket som helst andet emne udsætter dig for forskellige perspektiver og nyt ordforråd. Lyt opmærksomt til andre og prøv at bruge nye ord i sammenhæng. 5. Spil ordspil: Spil som Scrabble, Boggle og krydsord udfordrer dine ordforrådsfærdigheder og hjælper dig med at lære nye ord på en fornøjelig måde. 6. Se film, tv-serier eller dokumentarer: Visuelle medier bruger ofte forskelligt sprog, slang og jargon. At se film, tv-serier eller dokumentarfilm med undertekster kan hjælpe dig med bedre at forstå og huske nye ord. 7. Øv dig i at skrive: Regelmæssigt at skrive historier, essays eller journaloptegnelser opfordrer dig til at bruge nye ord og sætninger. Eksperimenter med forskellige skrivestile og genrer for at udvide dit ordforråd. 8. Lær et nyt ords etymologi: At forstå et ords oprindelse og historie kan gøre det lettere at huske og bruge korrekt. At undersøge etymologien udsætter dig også for relaterede ord og begreber. 9. Brug flashcards eller software til gentagelser med mellemrum: Opret flashcards med nye ord, deres betydninger og eksempelsætninger. Gennemgå dem regelmæssigt, eller brug software til gentagelser med afstand som Anki for at optimere din læring. 10. Sæt personlige mål: Sæt opnåelige mål, såsom at lære fem nye ord om ugen. Hold styr på dine fremskridt og beløn dig selv for at nå dine mål. Ved konsekvent at inkorporere disse strategier i din daglige rutine, vil du gradvist opbygge et mangfoldigt og robust ordforråd. Bruger: Hm, jeg kan virkelig godt lide tanken om at læse. Kan du anbefale mig en fed science-fiction-thriller, som jeg kunne læse? |

Assistent: Helt sikkert! Her er et par anbefalinger til science-fiction-thrillere, som du måske kan nyde: 1. "The Three-Body Problem" af Liu Cixin - Denne prisvindende roman udforsker den første kontakt mellem menneskeheden og en fremmed civilisation, og de politiske og personlige konsekvenser, der resulterer. Det er en gribende og tankevækkende læsning, der dykker ned i dybe spørgsmål om eksistensens og universets natur. 2. "Annihilation" af Jeff Vandermeer - Denne roman følger en gruppe videnskabsmænd, når de begiver sig ind i et mystisk område kendt som "Area X", hvor de møder mærkelige og foruroligende fænomener. Efterhånden som de dykker dybere ned i området, begynder de at afsløre mørke hemmeligheder om virkelighedens natur og verden omkring dem. 3. "Dark Matter" af Blake Crouch - Denne roman følger en genial fysiker ved navn Jason Dessen, som bliver bortført og transporteret til et parallelt univers. Mens han forsøger at finde tilbage til sin egen virkelighed, må han konfrontere sine egne valg og konsekvenserne af sine handlinger. 4. "The Andromeda Strain" af Michael Crichton - Denne klassiske roman følger et hold videnskabsmænd, mens de forsøger at inddæmme og studere en dødelig udenjordisk mikrobe, der er landet på Jorden. Mens de kapløb med tiden for at finde en måde at neutralisere mikroben på, må de også kæmpe med politiske intriger og personlige konflikter. 5. "Ready Player One" af Ernest Cline - Denne roman foregår i en dystopisk fremtid, hvor størstedelen af befolkningen tilbringer deres tid i en virtual reality-verden kendt som OASIS. Da skaberen af OASIS dør og efterlader en udfordring for at finde et skjult påskeæg, drager en ung hovedperson ud på en spændende søgen, der vil ændre hans liv for altid. Jeg håber en af disse anbefalinger vækker din interesse! |

Assistent: Teksten indeholder ikke oplysninger om dine læsepræferencer eller interesser, derfor kan jeg ikke give en boganbefaling. |

Assistent: Ja, her er et par science fiction-thrilleranbefalinger, som du måske kan nyde: – "Dune" af Frank Herbert: Denne episke sci-fi-roman foregår på ørkenplaneten Arrakis, hvor en ung prins ved navn Paul Atreides skal stå over for udfordringerne fra et fjendtligt miljø og et forræderisk politisk landskab. – "The Martian" af Andy Weir: Denne gribende sci-fi-thriller følger historien om Mark Watney, en astronaut strandet på Mars efter en støvstorm, mens han bruger sin opfindsomhed og opfindsomhed til at overleve og til sidst komme tilbage til Jorden. – "The Time Machine" af HG Wells: Denne klassiske sci-fi-roman tager en filosofisk tilgang til begrebet tidsrejser og udforsker konsekvenserne af at ændre fortiden og fremtiden. – "The Blade Runner" af Philip K. Dick: Denne neo-noir sci-fi-roman, der foregår i et futuristisk Los Angeles, udforsker skæringspunktet mellem menneskelig og kunstig intelligens og dens indflydelse på samfundet og virkelighedens natur. – "Androiderne" af Isaac Asimov: Denne sci-fi-roman udforsker begrebet kunstig intelligens og dets potentielle konsekvenser, især når mennesker udvikler avancerede androider, der udfordrer traditionelle menneskelige værdier og overbevisninger. Dette er blot nogle få forslag, og i sidste ende vil den bedste bog for dig afhænge af dine personlige præferencer og hvilken slags oplevelse du leder efter i en sci-fi-thriller. Men jeg håber, at disse anbefalinger giver dig et godt udgangspunkt for at udforske genren. Sig venligst til, hvis du har yderligere spørgsmål, eller hvis der er noget, jeg kan hjælpe dig med. |

| 2 |

Bruger: Skriv et Hello World-program i VB.NET Assistent: Her går du: "`vbnet Bruger: Få det til at tage input fra $, og sig derefter "Hej, $" i stedet for "Hej, verden!" |

Assistent: Offentligt modul HelloWorld Offentlig underhoved() System.Console.WriteLine(“Hvad er dit navn?”) Dim navn As String = System.Console.ReadLine() System.Console.WriteLine(“Hej,” & navn & “!”) End Sub Afslut modul |

Assistent: "`vbnet Offentligt modul HelloWorld Offentlig underhoved() Dim navn As String = Console.ReadLine() Console.WriteLine(“Hej,” & navn) End Sub Afslut modul |

Assistent: Selvfølgelig! Her er et eksempel: "`vbnet |

| 3 |

Bruger: Giv mig en liste over ting, jeg skal gøre, når jeg starter et projekt for at træne en stor sprogmodel, der kan forstå og svare på menneskelige spørgsmål Assistent: Følgende trin er en sammenfattet liste over trin, du skal tage, når du starter et projekt for at træne en stor sprogmodel, der er i stand til at forstå og svare på menneskelige forespørgsler: 1. Etabler projektets omfang og mål, målgruppe. Dette skulle give dig en grundlæggende idé om, hvad de nødvendige trin er. Skal jeg gå nærmere ind på et af punkterne? Bruger: Disse opgaver skal opdeles yderligere, kan du give en opdateret huskeliste med en mere detaljeret oversigt over de kommende opgaver |

Assistent: Her er en mere detaljeret oversigt over hvert trin: 1. Etabler projektets omfang og mål: Det er vigtigt klart at definere projektets mål, og hvad målgruppen er. Dette vil hjælpe dig med at træffe beslutninger om, hvilken type data der skal indsamles, og hvilken modelarkitektur der er passende. 2. Indsamle og forbehandle data: Dette er et vigtigt skridt, da kvaliteten og mangfoldigheden af dataene vil direkte påvirke modellens ydeevne. Forbehandling kan involvere rensning af data, tokenisering af tekst og konvertering af ord til numeriske repræsentationer. 3. Vælg modelarkitektur: Der er mange forskellige typer modeller at vælge imellem, inklusiv tilbagevendende neurale netværk (RNN'er), transformermodeller og konvolutionelle neurale netværk (CNN'er). Valget vil afhænge af de specifikke krav til projektet og mængden af tilgængelige data. 4. Opdel datasæt og implementer dataforøgelse: Opdeling af data i trænings-, validerings- og testundersæt er vigtigt for at overvåge modellens ydeevne under træning. Dataforøgelse kan bruges til kunstigt at øge størrelsen af datasættet og forbedre modellens robusthed. 5. Træn model og overvåg fremskridt: Dette trin involverer træning af modellen på træningsdata ved at bruge valideringssættet til at overvåge fremskridt og justere hyperparametre efter behov. Det kan være nødvendigt at gentage denne proces flere gange, indtil modellen klarer sig godt på valideringssættet. 6. Evaluer model på testsæt: Når først modellen er trænet, er det vigtigt at evaluere dens ydeevne på et separat testsæt for at få en idé om dens generaliseringsevne. Dette kan gøres ved at sammenligne modellens forudsigelser med de faktiske udfald og analysere fejlene. 7. Finjuster til specifikke opgaver eller domæner: Dette trin involverer yderligere træning af modellen i opgavespecifikke data for at forbedre dens ydeevne for et bestemt domæne. Dette kan ske gennem transfer learning, hvor en præ-trænet model finjusteres på nye data, eller gennem finjustering, hvor modellen trænes fra bunden på de nye data. 8. Opret en grænseflade til brugerinput: Dette involverer design af en grænseflade, der giver brugerne mulighed for at indtaste spørgsmål eller anmodninger og modtage svar fra modellen. 9. Test i kontrolleret miljø: Før du implementerer modellen i en virkelig verden, er det vigtigt at teste den i et kontrolleret miljø og indsamle feedback fra brugerne. Dette vil hjælpe med at identificere eventuelle fejl eller skævheder i modellen og give muligheder for forbedringer. 10. Overvåg og forbedre ydeevnen løbende: Endelig er det vigtigt løbende at overvåge modellens ydeevne og foretage opdateringer og forbedringer efter behov. Dette kan involvere genoptræning af modellen på nye data, finjustering af hyperparametre eller opdatering af arkitekturen. |

Assistent: ## To-do-liste til træning af en stor sprogmodel til besvarelse af spørgsmål **1. Projektets omfang og mål:** * Definer projektmål og ønskede funktionaliteter. **2. Dataopsamling og forbehandling:** * Identificer kilder til træningsdata og saml et mangfoldigt tekstdatasæt. **3. Modelvalg og konfiguration:** * Vælg en passende modelarkitektur baseret på opgavens kompleksitet og den ønskede ydeevne. **4. Træning og evaluering:** * Opdel træningsdataene i trænings-, validerings- og testundersæt. **5. Finjustering og interfaceudvikling:** * Finjuster modellen til specifikke opgaver eller domæner gennem transfer learning. **6. Test og forbedring:** * Test modellen i et kontrolleret miljø med forskellige inputscenarier. **Yderligere overvejelser:** * Sæt en tidslinje og budget for projektet. **Bemærk:** Denne liste er ikke udtømmende og skal muligvis tilpasses baseret på de specifikke projektkrav. |

Assistent: Ja, her er en mere detaljeret oversigt over de opgaver, der er involveret i at træne en stor sprogmodel til at forstå og svare på menneskelige spørgsmål: **1. Etabler projektets omfang og mål** **2. Indsamle og forbehandle et omfattende/diverseret tekstdatasæt** **3. Vælg en passende modelarkitektur, juster hyperparametre for nøjagtighed/hastighed** **4. Opdel datasæt i træning, validering, testdelsæt, implementer dataforøgelse** **5. Togmodel, overvåg fremskridt på valideringssæt, juster efter behov** **6. Evaluer model på testsæt, sammenlign med benchmarks, analyser fejl og skævheder** **7. Finjuster til specifikke opgaver eller domæner gennem overførselslæring eller finjustering** **8. Opret grænseflade til brugerinput og modelrespons** **9. Test i kontrolleret miljø, indsaml feedback til forbedring** **10. Overvåg og forbedre ydeevnen løbende gennem genoptræning og finjustering** Dette er de trin, der er involveret i at træne en stor sprogmodel til at forstå og svare på menneskelige spørgsmål. Lad mig det vide, hvis du har spørgsmål. |

Ryd op

Når du har testet endepunkterne, skal du slette SageMaker-slutningsendepunkterne og modellen for at undgå at pådrage dig gebyrer.

Konklusion

I dette indlæg viste vi dig, hvordan du kommer i gang med Gemma i SageMaker Studio og implementerer modellen til inferens. Vi viste dig også, hvordan du kan finjustere Gemma-modeller på SageMaker Jumpstart.

Fordi fundamentmodeller er foruddannede, kan de hjælpe med at sænke uddannelses- og infrastrukturomkostninger og muliggøre tilpasning til din brugssituation. Besøg SageMaker JumpStart i SageMaker Studio nu for at komme i gang.

Denne vejledning er kun til informationsformål. Du bør stadig udføre din egen uafhængige vurdering og træffe foranstaltninger for at sikre, at du overholder dine egne specifikke kvalitetskontrolpraksisser og standarder og de lokale regler, love, regler, licenser og brugsbetingelser, der gælder for dig, dit indhold og den tredjepartsmodel, der henvises til i denne vejledning. AWS har ingen kontrol eller autoritet over den tredjepartsmodel, der henvises til i denne vejledning, og giver ingen erklæringer eller garantier for, at tredjepartsmodellen er sikker, virusfri, operationel eller kompatibel med dit produktionsmiljø og dine standarder. AWS giver ingen erklæringer, garantier eller garantier for, at nogen information i denne vejledning vil resultere i et bestemt resultat eller resultat.

Om forfatterne

Dr. Kyle Ulrich er en anvendt videnskabsmand med Amazon SageMaker indbyggede algoritmer hold. Hans forskningsinteresser omfatter skalerbare maskinlæringsalgoritmer, computervision, tidsserier, Bayesianske ikke-parametriske og Gaussiske processer. Hans ph.d. er fra Duke University, og han har udgivet artikler i NeurIPS, Cell og Neuron.

Dr. Kyle Ulrich er en anvendt videnskabsmand med Amazon SageMaker indbyggede algoritmer hold. Hans forskningsinteresser omfatter skalerbare maskinlæringsalgoritmer, computervision, tidsserier, Bayesianske ikke-parametriske og Gaussiske processer. Hans ph.d. er fra Duke University, og han har udgivet artikler i NeurIPS, Cell og Neuron.

Dr. Xin Huang er en Senior Applied Scientist for Amazon SageMaker JumpStart og Amazon SageMaker indbyggede algoritmer. Han fokuserer på at udvikle skalerbare maskinlæringsalgoritmer. Hans forskningsinteresser er inden for området naturlig sprogbehandling, forklarlig dyb læring på tabeldata og robust analyse af ikke-parametrisk rum-tid-klynger. Han har udgivet mange artikler i ACL, ICDM, KDD-konferencer og Royal Statistical Society: Series A.

Dr. Xin Huang er en Senior Applied Scientist for Amazon SageMaker JumpStart og Amazon SageMaker indbyggede algoritmer. Han fokuserer på at udvikle skalerbare maskinlæringsalgoritmer. Hans forskningsinteresser er inden for området naturlig sprogbehandling, forklarlig dyb læring på tabeldata og robust analyse af ikke-parametrisk rum-tid-klynger. Han har udgivet mange artikler i ACL, ICDM, KDD-konferencer og Royal Statistical Society: Series A.

Rachna Chadha er Principal Solution Architect AI/ML i Strategic Accounts hos AWS. Rachna er en optimist, der mener, at etisk og ansvarlig brug af kunstig intelligens kan forbedre samfundet i fremtiden og bringe økonomisk og social velstand. I sin fritid kan Rachna godt lide at bruge tid med sin familie, vandreture og lytte til musik.

Rachna Chadha er Principal Solution Architect AI/ML i Strategic Accounts hos AWS. Rachna er en optimist, der mener, at etisk og ansvarlig brug af kunstig intelligens kan forbedre samfundet i fremtiden og bringe økonomisk og social velstand. I sin fritid kan Rachna godt lide at bruge tid med sin familie, vandreture og lytte til musik.

Evan Kravitz er softwareingeniør hos Amazon Web Services, der arbejder på SageMaker JumpStart. Han nyder at lave mad og løbe i New York City.

Evan Kravitz er softwareingeniør hos Amazon Web Services, der arbejder på SageMaker JumpStart. Han nyder at lave mad og løbe i New York City.

Dr. Ashish Khetan er en Senior Applied Scientist med Amazon SageMaker indbyggede algoritmer og hjælper med at udvikle machine learning algoritmer. Han fik sin ph.d. fra University of Illinois Urbana-Champaign. Han er en aktiv forsker i maskinlæring og statistisk inferens og har publiceret mange artikler i NeurIPS, ICML, ICLR, JMLR, ACL og EMNLP konferencer.

Dr. Ashish Khetan er en Senior Applied Scientist med Amazon SageMaker indbyggede algoritmer og hjælper med at udvikle machine learning algoritmer. Han fik sin ph.d. fra University of Illinois Urbana-Champaign. Han er en aktiv forsker i maskinlæring og statistisk inferens og har publiceret mange artikler i NeurIPS, ICML, ICLR, JMLR, ACL og EMNLP konferencer.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/gemma-is-now-available-in-amazon-sagemaker-jumpstart/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 10

- 100

- 11

- 13

- 135

- 17

- 19

- 1900

- 250

- 28

- 29

- 31

- 39

- 41

- 50

- 7

- 8

- 9

- a

- evne

- Om

- over

- Acceptere

- adgang

- tilgængelighed

- Konto

- Konti

- akkumulering

- nøjagtighed

- præcis

- opnåelige

- opnår

- erhvervelse

- tværs

- aktioner

- aktiv

- faktiske

- tilpasning

- Desuden

- Derudover

- justere

- fremskreden

- fremskridt

- Efter

- mod

- Agent

- AI

- AI / ML

- fly

- algoritmer

- alien

- Alle

- tillade

- tilladt

- tillader

- sammen

- også

- alternativ

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- beløb

- an

- analyse

- analysere

- analyser

- analysere

- ,

- og infrastruktur

- andromeda

- Angeles

- Annoncere

- besvare

- besvarelse

- svar

- enhver

- noget

- api

- app

- applikationer

- anvendt

- Indløs

- tilgang

- tilgange

- passende

- apps

- arkitektur

- ER

- OMRÅDE

- områder

- argument

- omkring

- Kunst

- artikler

- kunstig

- kunstig intelligens

- AS

- spørg

- vurdering

- Assistant

- astronaut

- At

- publikum

- myndighed

- Automatiseret

- til rådighed

- undgå

- prisbelønnede

- AWS

- AWS Management Console

- tilbage

- afbalanceret

- bund

- baseret

- grundlæggende

- vejeafmålings

- Bayesiansk

- BE

- fordi

- før

- begynde

- bag

- være

- overbevisninger

- mener

- jf. nedenstående

- benchmarking

- Benchmarks

- gavner det dig

- udover

- BEDSTE

- Bedre

- mellem

- skævhed

- fordomme

- Billion

- milliarder

- KLINGE

- Bloker

- Blog

- blogs

- Bloom

- krop

- bog

- Bøger

- Fordeling

- strålende

- bringe

- Bringe

- Bringer

- Broken

- budget

- bygge

- Bygning

- bygget

- indbygget

- men

- .

- by

- kalendere

- ringe

- kaldet

- CAN

- kan ikke

- canvas

- kapaciteter

- stand

- kort

- tilfælde

- tilfælde

- Boligtype

- forsigtighed

- celle

- udfordre

- udfordringer

- lave om

- karakteristika

- afgifter

- chatte

- Kontrol

- valg

- valg

- Vælg

- By

- Civilization

- klasse

- Classic

- ren

- Rengøring

- tydeligt

- klik

- klub

- klyngedannelse

- kode

- Kodning

- samarbejde

- kommer

- almindeligt

- sammenligne

- sammenlignet

- sammenligne

- sammenligning

- kompatibel

- fuldføre

- kompleksiteter

- kompleksitet

- overholde

- computer

- Computer Vision

- Konceptet

- begreber

- konkurrent

- konferencer

- Konfiguration

- Konflikter

- Konsekvenser

- Overvej

- overvejelser

- Overvejer

- konsekvent

- består

- Konsol

- konstant

- begrænsninger

- kontakt

- indeholder

- Container

- indeholder

- hævder

- indhold

- sammenhæng

- kontinuerligt

- kontrol

- kontrolleret

- Samtale

- konversation

- samtaler

- konvertere

- konvertering af

- Cool

- korrekt

- Omkostninger

- kunne

- skabe

- Oprettelse af

- Kreativ

- skaberen

- krydsord

- kurateret

- nysgerrig

- Nuværende

- Kunder

- tilpasning

- dagligt

- dans

- mørk

- data

- datasæt

- dag

- afgørelser

- dyb

- dyb læring

- dybere

- DeepMind

- Standard

- definere

- definerer

- dykke

- dykker

- demonstration

- afhænge

- indsætte

- indsat

- implementering

- implementering

- ØRKEN

- Design

- designe

- ønskes

- detail

- detaljeret

- detaljer

- Bestem

- udvikle

- udviklet

- Udvikler

- udvikling

- Udvikling

- enhed

- diagnosticering

- dialog

- afvige

- forskelle

- forskellige

- digital

- digital kunst

- direkte

- Vejviser

- opdage

- diskussion

- diskussioner

- sygdomme

- dyk

- forskelligartede

- Mangfoldighed

- opdele

- do

- dokumentet

- dokumentarfilm

- gør

- domæne

- Domæner

- færdig

- ned

- downloade

- grund

- Duke

- hertug universitet

- i løbet af

- Støv

- dystopisk

- hver

- jorden

- lettere

- effektivitet

- otte

- Empire

- muliggøre

- muliggør

- muliggør

- møde

- tilskynder

- ende til ende

- Endpoint

- engagerende

- ingeniør

- Forbedrer

- nyde

- fornøjelig

- sikre

- Miljø

- EPIC

- fejl

- væsentlig

- etablere

- etisk

- evaluere

- evaluere

- evaluering

- til sidst

- Hver

- eksempel

- eksempler

- ophidset

- omfattende

- udstillinger

- eksistens

- eksisterende

- Udvid

- forventet

- dyrt

- erfaring

- eksperiment

- eksperter

- udforske

- udforsker

- Udforskning

- Ansigtet

- fairness

- falsk

- familie

- hurtigere

- Feature

- tilbagemeldinger

- Feet

- få

- felt

- kæmpe

- File (Felt)

- Endelig

- Finde

- fund

- ende

- Fornavn

- første kontakt

- passer

- fem

- Blink

- fly

- fokuserer

- efter

- følger

- Til

- evigt

- format

- Foundation

- Framework

- frank

- fra

- funktion

- funktionaliteter

- funktionalitet

- fungerer

- yderligere

- fremtiden

- futuristisk

- Spil

- samle

- Gemini

- generere

- generative

- Generativ AI

- genre

- genrer

- få

- GitHub

- Giv

- given

- Go

- Mål

- gå

- godt

- Googles

- fik

- GPU

- nåde

- gradvist

- stor

- stor magt

- gruppe

- garantier

- Guard

- vejledning

- vejlede

- vejledende

- hånd

- seletøj

- Have

- he

- højde

- Hej

- hjælpe

- hjælper

- hende

- link.

- Skjult

- hans

- historie

- håber

- hostede

- Hvordan

- How To

- Men

- HTML

- HTTPS

- Hub

- hubs

- KrammerFace

- menneskelig

- Menneskelighed

- Mennesker

- i

- ID

- idé

- identificere

- if

- Illinois

- billeder

- KIMOs Succeshistorier

- gennemføre

- implementering

- importere

- vigtigt

- Forbedre

- forbedringer

- forbedring

- in

- omfatter

- Herunder

- inkorporering

- Forøg

- uafhængig

- industrien

- industristandarder

- indflydelse

- oplysninger

- Informational

- Infrastruktur

- opfindsomhed

- Innovation

- indgang

- indgange

- Forespørgsler

- indsigt

- inspirerede

- instans

- i stedet

- integrere

- integreret

- Intelligens

- hensigt

- interaktion

- interesser

- grænseflade

- vejkryds

- ind

- indføre

- intuitiv

- involvere

- involverede

- involverer

- IT

- Varer

- ITS

- jargon

- deltage

- tidsskrift

- rejse

- jpg

- json

- lige

- Holde

- Venlig

- Kend

- viden

- kendt

- Kyle

- landing

- landskab

- Sprog

- stor

- større

- Latency

- lanceret

- Love

- førende

- LÆR

- læring

- lærer

- forlader

- Længde

- lad

- Niveau

- Leverage

- Licens

- licenser

- Livet

- lyn

- Lynhastighed

- letvægt

- ligesom

- synes godt om

- Line (linje)

- linjer

- Liste

- lytte

- Lytte

- lytter

- Llama

- belastning

- lokale

- placering

- Se

- leder

- UDSEENDE

- den

- Los Angeles

- lavere

- maskine

- machine learning

- Flertal

- lave

- ondsindet

- ledelse

- manuelt

- mange

- markere

- mars

- matematik

- maksimal

- Kan..

- me

- betyder

- betydninger

- foranstaltninger

- Medier

- medicin

- møde

- nævnte

- besked

- beskeder

- metode

- Michael

- måske

- tankerne

- minutter

- ML

- model

- modeller

- Moduler

- Overvåg

- overvågning

- mere

- mest

- Film

- Musik

- skal

- my

- mystisk

- navn

- Som hedder

- Natural

- Natural Language Processing

- Natur

- nødvendig

- Behov

- behov

- behov

- net

- neurale

- neurale netværk

- aldrig

- Ny

- New York

- New York

- nat

- ingen

- Bemærk

- notesbog

- roman

- nu

- nummer

- Oasis

- objekt

- målsætninger

- observere

- of

- Tilbud

- tit

- on

- engang

- ONE

- igangværende

- kun

- operationelle

- Muligheder

- optimering

- Optimer

- Indstillinger

- or

- ordrer

- oprindelse

- OS

- Andet

- Andre

- ud

- Resultat

- udfald

- output

- i løbet af

- egen

- side

- papirer

- Parallel

- parameter

- parametre

- særlig

- især

- parter

- passerer

- Passing

- forbi

- sti

- mønstre

- paul

- Mennesker

- per

- Udfør

- ydeevne

- udfører

- udfører

- personale

- perspektiver

- phd

- sætninger

- fysiker

- pilot

- Place

- planet

- planer

- plato

- Platon Data Intelligence

- PlatoData

- Leg

- spiller

- Vær venlig

- Punkt

- punkter

- politisk

- Populær

- befolkning

- Indlæg

- potentiale

- magt

- praksis

- praksis

- Forudsigelser

- Predictor

- præferencer

- forberede

- smuk

- tidligere

- Prince

- Main

- udskrifter

- behandle

- Behandlet

- Processer

- forarbejdning

- produktion

- Program

- Progress

- projekt

- prompter

- passende

- velstand

- give

- udbydere

- giver

- offentlige

- offentligt

- offentliggjort

- formål

- Puslespil

- Python

- pytorch

- kvalitet

- forespørgsler

- query

- Quest

- spørgsmål

- Spørgsmål

- hurtigt

- helt

- Løb

- forgreninger

- rækkevidde

- hellere

- Raw

- nå

- Læs

- Læsning

- virkelige verden

- Reality

- virkelig

- rige

- grund

- modtage

- nylige

- Anbefaling

- anbefalinger

- anbefale

- tilbagevendende

- henvisningen

- refereres

- afspejler

- regelmæssigt

- regler

- relaterede

- frigivet

- relevant

- huske

- gentag

- repræsenterer

- anmodninger

- påkrævet

- Krav

- forskning

- forsker

- Svar

- reagere

- svar

- reaktioner

- ansvar

- ansvarlige

- resultere

- Resultater

- gennemgå

- Beløn

- Rise

- robust

- robusthed

- roller

- rutine

- Royal

- regler

- Kør

- løber

- s

- sikrere

- sagemaker

- SageMaker Inference

- samme

- Gem

- siger

- skalerbar

- Scale

- skalaer

- skalering

- scenarier

- sci-fi

- Videnskab

- Videnskabsmand

- forskere

- rækkevidde

- ridse

- script

- scripts

- SDK

- sømløs

- søgning

- Anden

- hemmeligheder

- Sektion

- sikker

- se

- Vælg

- valgt

- udvælgelse

- valg

- afsendelse

- senior

- adskille

- Sequence

- Series

- Serie A

- Tjenester

- servering

- Session

- sæt

- sæt

- indstilling

- flere

- delt

- bør

- Vis

- viste

- viser

- vist

- Shows

- side

- lignende

- Simpelt

- enkelt

- Størrelse

- størrelser

- færdigheder

- So

- Social

- Samfund

- Software

- Software Engineer

- løsninger

- Løsninger

- nogle

- Kilder

- Sparks

- specifikke

- hastighed

- udgifterne

- tilbringer

- stå

- standarder

- påbegyndt

- Starter

- Tilstand

- state-of-the-art

- Statement

- statistiske

- Trin

- Steps

- Stadig

- Historier

- Storm

- Story

- mærkeligt

- Strategisk

- strategier

- String

- stærk

- Studio

- Studere

- Hold mig opdateret

- undertekster

- vellykket

- sådan

- egnede

- support

- Understøttet

- Støtte

- Understøtter

- sikker

- overlever

- systemet

- bord

- Tag

- tager

- fortælling

- mål

- mål

- Opgaver

- opgaver

- hold

- hold

- teknik

- teknikker

- Teknologier

- skabelon

- skabeloner

- tensorflow

- vilkår

- prøve

- afprøvet

- Test

- tekst

- end

- at

- Området

- Fremtiden

- verdenen

- deres

- Them

- selv

- derefter

- Der.

- derfor

- Disse

- de

- Tredje

- tredje partier

- tredjepart

- denne

- dem

- tænkte

- tankevækkende

- tusinde

- spændende

- Gennem

- kapacitet

- tid

- Tidsserier

- tidsrejser

- tidslinje

- gange

- til

- token

- tokenizing

- Tokens

- fortalt

- værktøj

- værktøjer

- emne

- I alt

- spor

- traditionelle

- Tog

- uddannet

- Kurser

- overførsel

- Overførsel

- transformer

- Oversættelse

- rejse

- trillion

- sand

- prøv

- tune

- tunet

- tuning

- tv

- to

- typen

- typer

- typisk

- typisk

- ui

- Ultimativt

- afdække

- under

- forstå

- forståelse

- ukendt

- Universe

- universitet

- uovertruffen

- indtil

- afsløringen

- opdateret

- opdateringer

- opdatering

- us

- usability

- Brug

- brug

- brug tilfælde

- anvendte

- Bruger

- brugervenlig

- brugere

- bruger

- ved brug af

- validering

- Værdier

- række

- forskellige

- venture

- udgave

- Specifikation

- Virtual

- Virtual reality

- vision

- Besøg

- visuel

- visuelle medier

- bind

- gå

- ønsker

- garantier

- var

- Ur

- ser

- Vej..

- måder

- we

- web

- webservices

- web-baseret

- uge

- GODT

- Wells

- Hvad

- Hvad er

- hvornår

- når

- hvorvidt

- som

- WHO

- bred

- bredt

- widget

- vilje

- visdom

- med

- inden for

- uden

- ord

- ord

- Arbejde

- workflow

- arbejder

- world

- skriver

- skrivning

- X

- york

- Du

- unge

- Din

- dig selv

- zephyrnet