Dette indlæg blev skrevet sammen med Greg Benson, Chief Scientist; Aaron Kesler, senior produktchef; og Rich Dill, Enterprise Solutions Architect fra SnapLogic.

Mange kunder bygger generative AI-apps på Amazonas grundfjeld , Amazon Code Whisperer at skabe kodeartefakter baseret på naturligt sprog. Denne use case fremhæver, hvordan store sprogmodeller (LLM'er) er i stand til at blive en oversætter mellem menneskelige sprog (engelsk, spansk, arabisk og mere) og maskinfortolkelige sprog (Python, Java, Scala, SQL og så videre) sammen med sofistikerede indre ræsonnement. Denne nye evne i LLM'er har tvunget softwareudviklere til at bruge LLM'er som et automatiserings- og UX-forbedringsværktøj, der transformerer naturligt sprog til et domænespecifikt sprog (DSL): systeminstruktioner, API-anmodninger, kodeartefakter og mere. I dette indlæg viser vi dig hvordan SnapLogic, en AWS-kunde, brugte Amazon Bedrock til at drive deres SnapGPT produkt gennem automatiseret oprettelse af disse komplekse DSL-artefakter fra menneskeligt sprog.

Når kunder opretter DSL-objekter fra LLM'er, er den resulterende DSL enten en nøjagtig replika eller en afledt af eksisterende grænsefladedata og -skemaer, der danner kontrakten mellem brugergrænsefladen og forretningslogikken i backing-tjenesten. Dette mønster er særligt populært hos uafhængige softwareleverandører (ISV'er) og software as a service (SaaS) ISV'er på grund af deres unikke måde at repræsentere konfigurationer på gennem kode og ønsket om at forenkle brugeroplevelsen for deres kunder. Eksempler på brug omfatter:

Den mest ligetil måde at bygge og skalere tekst-til-pipeline-applikationer med LLM'er på AWS er at bruge Amazon Bedrock. Amazon Bedrock er den nemmeste måde at bygge og skalere generative AI-applikationer med fundamentmodeller (FM'er). Det er en fuldt administreret tjeneste, der giver adgang til et udvalg af højtydende fundament FM'er fra førende AI via en enkelt API, sammen med et bredt sæt af muligheder, du har brug for til at bygge generative AI-applikationer med privatliv og sikkerhed. Anthropic, et AI-sikkerheds- og forskningslaboratorium, der bygger pålidelige, fortolkbare og styrbare AI-systemer, er en af de førende AI-virksomheder, der tilbyder adgang til deres avancerede LLM, Claude, på Amazon Bedrock. Claude er en LLM, der udmærker sig til en bred vifte af opgaver, lige fra tankevækkende dialog, skabelse af indhold, kompleks ræsonnement, kreativitet og kodning. Anthropic tilbyder både Claude og Claude Instant modeller, som alle er tilgængelige gennem Amazon Bedrock. Claude har hurtigt vundet popularitet i disse tekst-til-pipeline-applikationer på grund af dens forbedrede ræsonnementevne, som gør det muligt for den at udmærke sig i tvetydig teknisk problemløsning. Claude 2 på Amazon Bedrock understøtter et kontekstvindue på 100,000 tokener, hvilket svarer til omkring 200 sider engelsk tekst. Dette er en særlig vigtig funktion, som du kan stole på, når du bygger tekst-til-pipeline-applikationer, der kræver komplekse ræsonnementer, detaljerede instruktioner og omfattende eksempler.

SnapLogic baggrund

SnapLogic er en AWS-kunde på en mission om at bringe virksomhedsautomatisering til verden. SnapLogic Intelligent Integration Platform (IIP) gør det muligt for organisationer at realisere virksomhedsomspændende automatisering ved at forbinde hele deres økosystem af applikationer, databaser, big data, maskiner og enheder, API'er og mere med forudbyggede, intelligente forbindelser kaldet Snaps. SnapLogic udgav for nylig en funktion kaldet SnapGPT, som giver en tekstgrænseflade, hvor du kan skrive den ønskede integrationspipeline, du vil oprette, på et enkelt menneskeligt sprog. SnapGPT bruger Anthropics Claude-model gennem Amazon Bedrock til at automatisere oprettelsen af disse integrationspipelines som kode, som derefter bruges gennem SnapLogics flagskibsintegrationsløsning. SnapLogics rejse til SnapGPT har dog været en kulmination på mange år, der har arbejdet i AI-rummet.

SnapLogics AI-rejse

Inden for integrationsplatforme har SnapLogic konsekvent været på forkant og udnyttet den transformative kraft af kunstig intelligens. Gennem årene er virksomhedens forpligtelse til at innovere med AI blevet tydelig, især når vi sporer rejsen fra iris til Auto Link.

Den ydmyge begyndelse med Iris

I 2017 afslørede SnapLogic Iris, en branchens første AI-drevet integrationsassistent. Iris blev designet til at bruge maskinlæringsalgoritmer (ML) til at forudsige de næste trin i opbygningen af en datapipeline. Ved at analysere millioner af metadataelementer og datastrømme kunne Iris komme med intelligente forslag til brugerne, demokratisere dataintegration og give selv dem uden en dyb teknisk baggrund mulighed for at skabe komplekse arbejdsgange.

AutoLink: Opbygning af momentum

Med udgangspunkt i succesen og erfaringerne fra Iris introducerede SnapLogic AutoLink, en funktion, der sigter mod yderligere at forenkle datakortlægningsprocessen. Den kedelige opgave med manuelt at kortlægge felter mellem kilde- og målsystemer blev en leg med AutoLink. Ved hjælp af AI identificerede og foreslog AutoLink automatisk potentielle matches. Integrationer, der engang tog timer, kunne køres på få minutter.

Det generative spring med SnapGPT

SnapLogics seneste indtog i AI bringer os SnapGPT, som har til formål at revolutionere integrationen yderligere. Med SnapGPT introducerer SnapLogic verdens første generative integrationsløsning. Dette handler ikke kun om at forenkle eksisterende processer, men om helt at genforestille, hvordan integrationer er designet. Kraften i generativ AI kan skabe hele integrationspipelines fra bunden, og optimere arbejdsgangen baseret på det ønskede resultat og datakarakteristika.

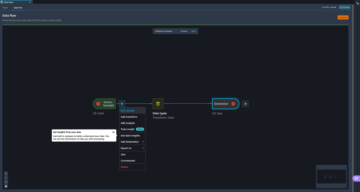

SnapGPT er ekstremt virkningsfuldt for SnapLogics kunder, fordi de er i stand til drastisk at reducere mængden af tid, der kræves for at generere deres første SnapLogic pipeline. Traditionelt ville SnapLogic-kunder skulle bruge dage eller uger på at konfigurere integrationspipelines fra bunden. Nu er disse kunder i stand til blot at bede SnapGPT om for eksempel at "oprette en pipeline, som vil flytte alle mine aktive SFDC-kunder til WorkDay." Et fungerende første udkast til en pipeline oprettes automatisk for denne kunde, hvilket drastisk reducerer den udviklingstid, der kræves for at skabe grundlaget for deres integrationspipeline. Dette giver slutkunden mulighed for at bruge mere tid på at fokusere på, hvad der har ægte forretningspåvirkning for dem i stedet for at arbejde på konfigurationer af en integrationspipeline. Følgende eksempel viser, hvordan en SnapLogic-kunde kan indtaste en beskrivelse i SnapGPT-funktionen for hurtigt at generere en pipeline ved hjælp af naturligt sprog.

AWS og SnapLogic har samarbejdet tæt gennem hele denne produktopbygning og har lært meget undervejs. Resten af dette indlæg vil fokusere på den tekniske læring AWS og SnapLogic har haft omkring brugen af LLM'er til tekst-til-pipeline-applikationer.

Løsningsoversigt

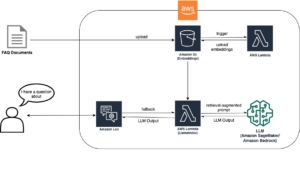

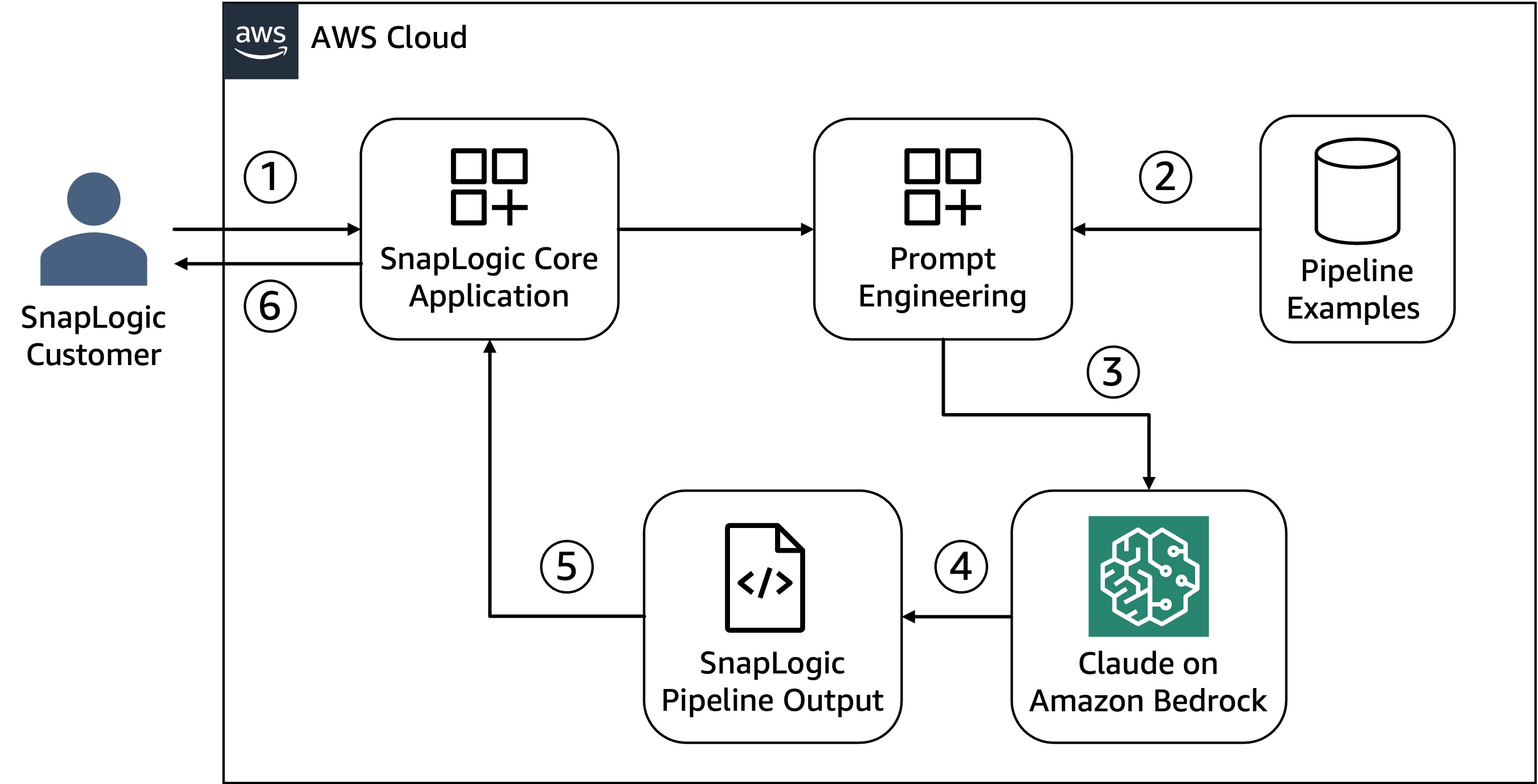

For at løse dette tekst-til-pipeline-problem har AWS og SnapLogic designet en omfattende løsning vist i følgende arkitektur.

En anmodning til SnapGPT går gennem følgende arbejdsgang:

- En bruger sender en beskrivelse til ansøgningen.

- SnapLogic bruger en Retrieval Augmented Generation (RAG) tilgang til at hente relevante eksempler på SnapLogic pipelines, der ligner brugerens anmodning.

- Disse udtrukne relevante eksempler kombineres med brugerens input og gennemgår en vis tekstforbehandling, før de sendes til Claude på Amazon Bedrock.

- Claude producerer en JSON-artefakt, der repræsenterer en SnapLogic-pipeline.

- JSON-artefakten er direkte integreret med SnapLogic-kerneintegrationsplatformen.

- SnapLogic-pipelinen gengives til brugeren på en visuel venlig måde.

Gennem forskellige eksperimenter mellem AWS og SnapLogic har vi fundet ud af, at det hurtige ingeniørtrin i løsningsdiagrammet er ekstremt vigtigt for at generere højkvalitetsoutput for disse tekst-til-pipeline-output. Det næste afsnit går yderligere ind på nogle specifikke teknikker, der bruges med Claude i dette rum.

Hurtig eksperimentering

I hele udviklingsfasen af SnapGPT fandt AWS og SnapLogic ud af, at hurtig iteration af prompter, der blev sendt til Claude, var en kritisk udviklingsopgave for at forbedre nøjagtigheden og relevansen af tekst-til-pipeline-output i SnapLogics output. Ved hjælp af Amazon SageMaker Studio interaktive notebooks, AWS- og SnapLogic-teamet var i stand til hurtigt at gennemarbejde forskellige versioner af prompter ved at bruge Boto3 SDK-forbindelse til Amazon Bedrock. Notebook-baseret udvikling gjorde det muligt for teamene hurtigt at skabe klientsideforbindelser til Amazon Bedrock, inkludere tekstbaserede beskrivelser sammen med Python-kode til at sende prompter til Amazon Bedrock og afholde fælles prompt-ingeniørsessioner, hvor gentagelser blev foretaget hurtigt mellem flere personas.

Antropiske Claude prompte ingeniørmetoder

I dette afsnit beskriver vi nogle af de iterative teknikker, vi brugte til at skabe en højtydende prompt baseret på en illustrativ brugeranmodning: "Lav en pipeline, som bruger EksempelCompany-databasen, som henter alle aktive kunder." Bemærk, at dette eksempel ikke er det skema, som SnapGPT er drevet af, og det bruges kun til at illustrere en tekst-til-pipeline-applikation.

For at baseline vores prompt-teknik bruger vi følgende originale prompt:

Lav en pipeline som bruger EksempelCompany databasen som henter alle aktive kunder

Det forventede output er som følger:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

Forbedring #1: Brug af annoteringerne Human og Assistant

Claudes træningsprocedure lærer FM at forstå dialogen mellem et menneske og en assistent i dens hurtige struktur. Claude-brugere kan drage fordel af denne struktur ved at afslutte deres prompt i Assistant:, hvilket vil udløse Claude til at begynde at generere svaret på en forespørgsel baseret på, hvad mennesket har sagt. Bemærk, at fordi Claude vil fortsætte med at generere tekst, indtil den får besked på at stoppe, skal du sørge for at bruge en stopsekvens af nnHuman: i API-anmodningen til Amazon Bedrock, når du bruger Claude. Dette vil sikre, at du kun modtager svaret fra assistenten og ikke det forudsagte næste svar fra mennesket i dialogkæden. Disse nnHuman- og nnAssistant-indikatorer hjælper ikke kun med at begrænse Claudes reaktion på relevant information, men hjælper også med at give en klar afgrænsning mellem primære menneskelige input og assistent-svar fra andre interaktioner. Dette hjælper især i en få-shot promptindstilling, hvor du kan have flere forespørgsler og svar med forespørgsler tagget med nnHuman og tidligere svar tagget med nnAssistant. Lad os se på den forbedrede prompt og tilhørende illustrative API-kald til Amazon Bedrock via Boto3 SDK.

Vi bruger følgende prompt:

Human: Lav en pipeline som bruger EksempelCompany databasen som henter alle aktive kunder

Assistent:

Udgangen er som følger:

Her er en MongoDB-pipeline til at hente alle aktive kunder fra EksempelCompany-databasen:

pipeline = [ { '$match': { 'database': 'ExampleCompany', 'status': 'active' } } ] db.customers.aggregate(pipeline)De vigtigste trin er:

– `$match` for at filtrere dokumenterne til kun dem i EksempelCompany-databasen og med status lig med "aktiv".

– `db.customers.aggregate()` kører pipelinen på kundens samling og returnerer de filtrerede resultater.

Så dette vil returnere alle kundedokumenter fra EksempelCompany-databasen, hvor statusfeltet er sat til "aktiv".

Læg mærke til, hvordan Claude i outputtet finder på et svar på vores spørgsmål uden nogen sammenhæng. Svaret er potentielt nyttigt, men det er ikke specifikt for det problem, vi forsøger at løse, fordi det ikke er forsynet med tilstrækkelig kontekst. Det er også vigtigt at bemærke, at Anthropic kræver dette menneskelige og assistent-format, når man bruger Claude-modellerne; hvis du ikke inkluderer dette trin, returnerer Amazon Bedrock en fejl.

Forbedring #2: Inkluder hyperspecifik kontekst for Claude, før den bliver fortalt, hvad den skal gøre

Claude klarer sig bedst, når den får en god kontekst om, hvad den skal udrette, samt hvordan den skal udføre denne opgave. Her er et par eksempler på ting, der skal inkluderes som kontekst for Claude, før du fortæller den opgaven:

- Beskriv den jobfunktion, du ønsker, at Claude skal udføre. Ved at gøre dette får du Claude til at tænke i rollen som en, der arbejder i det job, eller mere som en, der bare bliver ansat i den specifikke jobrolle. Dette vil hjælpe Claude med at formulere svaret fra den specifikke jobrolles perspektiv, hvilket reducerer hallucinationer og tilfældigheder i svaret.

- Inkluder tekniske detaljer vedrørende outputformatet. Grundmodeller er generelt gode til at følge handlinger, så at bede Claude om at generere outputtet i et bestemt format eller skema med et eller nogle få eksempler, vil hjælpe Claude med at give svaret i det rigtige format, hvilket reducerer behovet for filtrering og efterbehandling af outputtet. Eksemplet i den følgende prompt viser et fiktivt skema, der matcher det forventede output.

Lad os kombinere disse forslag for at forbedre vores oprindelige prompt:

Menneske: Din opgave er at fungere som ekspert på ETL-rørledninger. Specifikt er din opgave at skabe en JSON-repræsentation af en ETL-pipeline, som vil løse den brugeranmodning, du har fået.

JSON-outputtet skal følge følgende format:

Her er din opgave: lav en pipeline som bruger EksempelCompany databasen som henter alle aktive kunder

Assistent:

Udgangen er som følger:

Her er en JSON-repræsentation af en ETL-pipeline til at hente alle aktive kunder fra EksempelCompany-databasen:

Denne pipeline bruger EksempelCompany-databasen og en SQL-forespørgsel til at vælge alle poster fra kundetabellen, hvor status er 'aktiv'.

Med tilføjelsen af kontekst er modellen nu i stand til at komme det meste af vejen til vores svar. Den ved nu, hvordan den skal strukturere outputtet, og den forstår, at den skal skrive en SQL-sætning for at løse opgaven. Du vil dog bemærke, at modellen ikke korrekt bruger den ec_prod.customers-nomenklatur, vi forventer. Plads til forbedring! Bemærk også, at du i praksis bliver nødt til at inkludere væsentlig mere kontekst end det, vi gav i dette eksempel, for at opnå resultater af høj kvalitet i tekst-til-pipeline-brugssager.

Forbedring #3: Vedlagt eksempler i XML-tags

Few-shot learning er en populær måde at øge nøjagtigheden med FM'er, hvor du har relevante eksempler til at guide FM'eren i deres opgave. Dette er især vigtigt, når du arbejder i tekst-til-pipeline-applikationer, fordi disse hyperspecifikke pipeline-output normalt ikke er inkluderet i noget offentligt datasæt, fordi de er specifikke for en individuel kundes datarepræsentation. Når du bruger Claude, kan du drage fordel af dens medfødte viden om vilkårlige XML-tags for at give disse eksempler i et få-shot-format. I den følgende forbedrede prompt skal du bemærke tilføjelsen af eksempler, der er indeholdt i XML tags. Du kan også bruge forkortelser for menneske og assistent med H og A for at give kontekst til Claude uden at få det til at tro, at det var specifikke dele af dialogen, der allerede har fundet sted.

Vi bruger følgende prompt:

Menneske: Din opgave er at fungere som ekspert på ETL-rørledninger. Specifikt er din opgave at skabe en JSON-repræsentation af en ETL-pipeline, som vil løse den brugeranmodning, du har fået.

JSON-outputtet skal følge følgende format:

Her er nogle eksempler på brugeranmodninger og tilhørende output JSON-artefakter, som korrekt løser opgaven. Sørg for at bruge den samme nomenklatur, som er angivet i eksemplerne, hvis du bruger de samme databaser.

H: Forespørg i Eksempelvirksomhedens database for aktive ordrer for kunde #1234

A:

Begrundelsen for denne forespørgsel er, at kunde #1234 er filtreret, og vi søger i "ordrer"-tabellen efter eventuelle eksisterende poster efter det "aktive" filter.

H: Fjern alle kunder i EksempelCompany-databasen, som ikke har været aktive i den sidste måned

A:

Begrundelsen for denne forespørgsel er, at tabellen "ec_prod.customers" er den eneste tabel i EksempelCompany-databasen, som indeholder kunderegistreringer.

Her er din opgave: lav en pipeline som bruger EksempelCompany databasen som henter alle aktive kunder.

Assistent:

Udgangen er som følger:

Her er JSON-repræsentationen for en ETL-pipeline til at hente alle aktive kunder fra EksempelCompany-databasen:

Begrundelsen er:

EksempelCompany-databasen er angivet som den database, der skal bruges

Tabellen ec_prod.customers indeholder kundedata

Statusfeltet angiver, om en kunde er aktiv, så forespørgslen filtrerer kun efter aktive kunder

Dette skulle hente alle aktive kunderegistreringer fra EksempelCompany-databasen. Fortæl mig, hvis du har brug for nogen afklaring eller har yderligere krav til ETL-pipelinen!

JSON-outputtet har nu den korrekte databasenomenklatur, som Claude var i stand til at bruge på grund af de eksempler, vi gav. Kobling af menneskelige og assistent-indikatorer med XML-tags gør det lettere for Claude at forstå, hvad opgaven er, og hvad der var svaret i lignende eksempler med meget klar adskillelse mellem flere få-skuds eksempler. Jo nemmere det er for Claude at forstå, jo bedre og mere relevant vil svaret være, hvilket yderligere reducerer chancen for, at modellen hallucinerer og giver tilfældige irrelevante svar.

Forbedring #4: Trigger Claude til at begynde JSON-generering med XML-tags

En lille udfordring med tekst-til-pipeline-applikationer, der bruger FM'er, er behovet for nøjagtigt at parse et output fra resulterende tekst, så det kan fortolkes som kode i en downstream-applikation. En måde at løse dette på med Claude er at drage fordel af dets XML-tag-forståelse og kombinere dette med en brugerdefineret stopsekvens. I den følgende prompt har vi bedt Claude om at vedlægge outputtet i XML tags. Så har vi tilføjet tag til slutningen af prompten. Dette sikrer, at den første tekst, der kommer ud af Claude, vil være starten på JSON-outputtet. Hvis du ikke gør dette, svarer Claude ofte med en samtaletekst, så det sande kodesvar. Ved at instruere Claude om straks at begynde at generere output, kan du nemt stoppe genereringen, når du ser lukningen tag. Dette vises i det opdaterede Boto3 API-kald. Fordelene ved denne teknik er dobbelte. For det første er du i stand til nøjagtigt at analysere kodesvaret fra Claude. For det andet er du i stand til at reducere omkostningerne, fordi Claude kun genererer kodeoutput og ingen ekstra tekst. Dette reducerer omkostningerne på Amazon Bedrock, fordi du bliver opkrævet for hver token, der produceres som output fra alle FM'er.

Vi bruger følgende prompt:

Menneske: Din opgave er at fungere som ekspert på ETL-rørledninger. Specifikt er din opgave at skabe en JSON-repræsentation af en ETL-pipeline, som vil løse den brugeranmodning, du har fået.

JSON-outputtet skal følge følgende format:

Her er nogle eksempler på brugeranmodninger og tilhørende output JSON-artefakter, som korrekt løser opgaven. Sørg for at bruge den samme nomenklatur, som er angivet i eksemplerne, hvis du bruger de samme databaser.

H: Forespørg i Eksempelvirksomhedens database for aktive ordrer for kunde #1234

A:

Begrundelsen for denne forespørgsel er, at kunde #1234 er filtreret, og vi søger i "ordrer"-tabellen efter eventuelle eksisterende poster efter det "aktive" filter.

H: Fjern alle kunder i EksempelCompany-databasen, som ikke har været aktive i den sidste måned

A:

Begrundelsen for denne forespørgsel er, at tabellen "ec_prod.customers" er den eneste tabel i EksempelCompany-databasen, som indeholder kunderegistreringer.

Husk altid at vedlægge dine JSON-udgange tags.

Her er din opgave: lav en pipeline som bruger EksempelCompany databasen som henter alle aktive kunder.

Assistent:

Vi bruger følgende kode:

body = json.dumps({"prompt": prompt, "stop_sequences": ['nnHuman:', '</json>']})

response = bedrock.invoke_model( body=body, modelId='anthropic.claude-v2'

)Udgangen er som følger:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

Nu er vi nået frem til det forventede output med kun JSON-objektet returneret! Ved at bruge denne metode er vi i stand til at generere en umiddelbart anvendelig teknisk artefakt samt reducere omkostningerne ved at reducere output-tokens.

Konklusion

For at komme i gang i dag med SnapGPT, anmod om en gratis prøveversion af SnapLogic or anmod om en demo af produktet. Hvis du gerne vil bruge disse koncepter til byggeapplikationer i dag, anbefaler vi eksperimentere praktisk med den hurtige ingeniørsektion i dette indlæg, ved at bruge det samme flow på en anden DSL-generationsbrugscase, der passer til din virksomhed, og dykke dybere ned i RAG-funktioner, der er tilgængelige via Amazon Bedrock.

SnapLogic og AWS har været i stand til at samarbejde effektivt om at bygge en avanceret oversætter mellem menneskeligt sprog og det komplekse skema af SnapLogic-integrationspipelines drevet af Amazon Bedrock. Igennem denne rejse har vi set, hvordan output genereret med Claude kan forbedres i tekst-til-pipeline-applikationer ved hjælp af specifikke prompt-ingeniørteknikker. AWS og SnapLogic er begejstrede for at fortsætte dette partnerskab i Generative AI og ser frem til fremtidigt samarbejde og innovation i dette hurtigt bevægende rum.

Om forfatterne

Greg Benson er professor i datalogi ved University of San Francisco og Chief Scientist hos SnapLogic. Han kom til USF Department of Computer Science i 1998 og har undervist i bachelor- og kandidatkurser, herunder operativsystemer, computerarkitektur, programmeringssprog, distribuerede systemer og introduktionsprogrammering. Greg har offentliggjort forskning inden for områderne operativsystemer, parallel computing og distribuerede systemer. Siden han kom til SnapLogic i 2010, har Greg hjulpet med at designe og implementere flere nøgleplatformsfunktioner, herunder klyngebehandling, big data-behandling, cloud-arkitekturen og maskinlæring. Han arbejder i øjeblikket på Generativ AI til dataintegration.

Greg Benson er professor i datalogi ved University of San Francisco og Chief Scientist hos SnapLogic. Han kom til USF Department of Computer Science i 1998 og har undervist i bachelor- og kandidatkurser, herunder operativsystemer, computerarkitektur, programmeringssprog, distribuerede systemer og introduktionsprogrammering. Greg har offentliggjort forskning inden for områderne operativsystemer, parallel computing og distribuerede systemer. Siden han kom til SnapLogic i 2010, har Greg hjulpet med at designe og implementere flere nøgleplatformsfunktioner, herunder klyngebehandling, big data-behandling, cloud-arkitekturen og maskinlæring. Han arbejder i øjeblikket på Generativ AI til dataintegration.

Aaron Kesler er Senior Product Manager for AI-produkter og -tjenester hos SnapLogic, Aaron anvender over ti års produktstyringsekspertise for at være pionerer inden for AI/ML-produktudvikling og evangelisere tjenester på tværs af organisationen. Han er forfatter til den kommende bog "Hvad er dit problem?" rettet mod at guide nye produktchefer gennem produktledelseskarrieren. Hans iværksætterrejse begyndte med hans college-startup, STAK, som senere blev erhvervet af Carvertise, hvor Aaron bidrog væsentligt til deres anerkendelse som Tech Startup of the Year 2015 i Delaware. Ud over sine professionelle sysler finder Aaron glæde ved at spille golf med sin far, udforske nye kulturer og fødevarer på sine rejser og øve ukulele.

Aaron Kesler er Senior Product Manager for AI-produkter og -tjenester hos SnapLogic, Aaron anvender over ti års produktstyringsekspertise for at være pionerer inden for AI/ML-produktudvikling og evangelisere tjenester på tværs af organisationen. Han er forfatter til den kommende bog "Hvad er dit problem?" rettet mod at guide nye produktchefer gennem produktledelseskarrieren. Hans iværksætterrejse begyndte med hans college-startup, STAK, som senere blev erhvervet af Carvertise, hvor Aaron bidrog væsentligt til deres anerkendelse som Tech Startup of the Year 2015 i Delaware. Ud over sine professionelle sysler finder Aaron glæde ved at spille golf med sin far, udforske nye kulturer og fødevarer på sine rejser og øve ukulele.

Rig Dild er en Principal Solutions Architect med erfaring, der spænder bredt på tværs af flere specialiseringsområder. En track record af succes, der spænder over multi-platform enterprise software og SaaS. Velkendt for at omdanne kundeadvocacy (fungerer som kundens stemme) til indtægtsgenererende nye funktioner og produkter. Dokumenteret evne til at drive banebrydende produkter til markedet og projekter til færdiggørelse efter tidsplan og under budget i hurtige onshore- og offshore-miljøer. En enkel måde at beskrive mig på: en videnskabsmands sind, en opdagelsesrejsendes hjerte og en kunstners sjæl.

Rig Dild er en Principal Solutions Architect med erfaring, der spænder bredt på tværs af flere specialiseringsområder. En track record af succes, der spænder over multi-platform enterprise software og SaaS. Velkendt for at omdanne kundeadvocacy (fungerer som kundens stemme) til indtægtsgenererende nye funktioner og produkter. Dokumenteret evne til at drive banebrydende produkter til markedet og projekter til færdiggørelse efter tidsplan og under budget i hurtige onshore- og offshore-miljøer. En enkel måde at beskrive mig på: en videnskabsmands sind, en opdagelsesrejsendes hjerte og en kunstners sjæl.

Clay Elmore er AI/ML Specialist Solutions Architect hos AWS. Efter at have tilbragt mange timer i et materialeforskningslaboratorium, blev hans baggrund i kemiteknik hurtigt efterladt for at forfølge sin interesse for maskinlæring. Han har arbejdet med ML-applikationer i mange forskellige brancher lige fra energihandel til hotelmarkedsføring. Clays nuværende arbejde hos AWS er centreret omkring at hjælpe kunder med at bringe softwareudviklingspraksis til ML og generative AI-arbejdsbelastninger, hvilket giver kunderne mulighed for at bygge repeterbare, skalerbare løsninger i disse komplekse miljøer. I sin fritid nyder Clay at stå på ski, løse Rubiks kuber, læse og lave mad.

Clay Elmore er AI/ML Specialist Solutions Architect hos AWS. Efter at have tilbragt mange timer i et materialeforskningslaboratorium, blev hans baggrund i kemiteknik hurtigt efterladt for at forfølge sin interesse for maskinlæring. Han har arbejdet med ML-applikationer i mange forskellige brancher lige fra energihandel til hotelmarkedsføring. Clays nuværende arbejde hos AWS er centreret omkring at hjælpe kunder med at bringe softwareudviklingspraksis til ML og generative AI-arbejdsbelastninger, hvilket giver kunderne mulighed for at bygge repeterbare, skalerbare løsninger i disse komplekse miljøer. I sin fritid nyder Clay at stå på ski, løse Rubiks kuber, læse og lave mad.

Sina Sojoodi er teknologichef, systemingeniør, produktleder, tidligere grundlægger og startup-rådgiver. Han kom til AWS i marts 2021 som Principal Solutions Architect. Sina er i øjeblikket den US-West ISV-områdeledende løsningsarkitekt. Han arbejder med SaaS- og B2B-softwarevirksomheder for at opbygge og vokse deres virksomheder på AWS. Før sin rolle hos Amazon var Sina teknologichef hos VMware og Pivotal Software (IPO i 2018, VMware M&A i 2020) og tjente flere lederroller, herunder stiftende ingeniør hos Xtreme Labs (Pivotal overtagelse i 2013). Sina har dedikeret de sidste 15 år af sin arbejdserfaring til at bygge softwareplatforme og praksisser for virksomheder, softwarevirksomheder og den offentlige sektor. Han er en brancheleder med en passion for innovation. Sina har en BA fra University of Waterloo, hvor han studerede elektroteknik og psykologi.

Sina Sojoodi er teknologichef, systemingeniør, produktleder, tidligere grundlægger og startup-rådgiver. Han kom til AWS i marts 2021 som Principal Solutions Architect. Sina er i øjeblikket den US-West ISV-områdeledende løsningsarkitekt. Han arbejder med SaaS- og B2B-softwarevirksomheder for at opbygge og vokse deres virksomheder på AWS. Før sin rolle hos Amazon var Sina teknologichef hos VMware og Pivotal Software (IPO i 2018, VMware M&A i 2020) og tjente flere lederroller, herunder stiftende ingeniør hos Xtreme Labs (Pivotal overtagelse i 2013). Sina har dedikeret de sidste 15 år af sin arbejdserfaring til at bygge softwareplatforme og praksisser for virksomheder, softwarevirksomheder og den offentlige sektor. Han er en brancheleder med en passion for innovation. Sina har en BA fra University of Waterloo, hvor han studerede elektroteknik og psykologi.

Sandeep Rohilla er Senior Solutions Architect hos AWS, der støtter ISV-kunder i den vestlige region i USA. Han fokuserer på at hjælpe kunder med at arkitekte løsninger, der udnytter containere og generativ AI på AWS-skyen. Sandeep brænder for at forstå kundernes forretningsproblemer og hjælpe dem med at nå deres mål gennem teknologi. Han kom til AWS efter at have arbejdet i mere end et årti som løsningsarkitekt, og han har medført sine 17 års erfaring. Sandeep er uddannet cand.merc. i Software Engineering fra University of the West of England i Bristol, UK.

Sandeep Rohilla er Senior Solutions Architect hos AWS, der støtter ISV-kunder i den vestlige region i USA. Han fokuserer på at hjælpe kunder med at arkitekte løsninger, der udnytter containere og generativ AI på AWS-skyen. Sandeep brænder for at forstå kundernes forretningsproblemer og hjælpe dem med at nå deres mål gennem teknologi. Han kom til AWS efter at have arbejdet i mere end et årti som løsningsarkitekt, og han har medført sine 17 års erfaring. Sandeep er uddannet cand.merc. i Software Engineering fra University of the West of England i Bristol, UK.

Dr. Farooq Sabir er senior specialist i kunstig intelligens og maskinlæringsløsninger hos AWS. Han har ph.d.- og MS-grader i elektroteknik fra University of Texas i Austin og en MS i datalogi fra Georgia Institute of Technology. Han har over 15 års erhvervserfaring og kan også lide at undervise og vejlede universitetsstuderende. Hos AWS hjælper han kunder med at formulere og løse deres forretningsproblemer inden for datavidenskab, maskinlæring, computersyn, kunstig intelligens, numerisk optimering og relaterede domæner. Baseret i Dallas, Texas, elsker han og hans familie at rejse og tage på lange roadtrips.

Dr. Farooq Sabir er senior specialist i kunstig intelligens og maskinlæringsløsninger hos AWS. Han har ph.d.- og MS-grader i elektroteknik fra University of Texas i Austin og en MS i datalogi fra Georgia Institute of Technology. Han har over 15 års erhvervserfaring og kan også lide at undervise og vejlede universitetsstuderende. Hos AWS hjælper han kunder med at formulere og løse deres forretningsproblemer inden for datavidenskab, maskinlæring, computersyn, kunstig intelligens, numerisk optimering og relaterede domæner. Baseret i Dallas, Texas, elsker han og hans familie at rejse og tage på lange roadtrips.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/how-snaplogic-built-a-text-to-pipeline-application-with-amazon-bedrock-to-translate-business-intent-into-action/

- :har

- :er

- :ikke

- :hvor

- $OP

- 10

- 100

- 121

- 14

- 15 år

- 15 %

- 150

- 17

- 1998

- 200

- 2013

- 2015

- 2017

- 2018

- 2020

- 2021

- 31

- 33

- 7

- 8

- 9

- a

- Aaron

- evne

- I stand

- Om

- adgang

- udrette

- nøjagtighed

- opnå

- erhvervede

- erhvervelse

- tværs

- Lov

- Handling

- aktioner

- aktiv

- tilføjet

- Desuden

- Yderligere

- fremskreden

- Fordel

- rådgiver

- advocacy

- Efter

- AI

- AI-systemer

- AI-drevne

- AI / ML

- Rettet

- målsætninger

- algoritmer

- Alle

- tilladt

- tillade

- tillader

- sammen

- langs med

- allerede

- også

- Amazon

- Amazon Web Services

- beløb

- an

- analysere

- ,

- besvare

- svar

- Antropisk

- enhver

- api

- API'er

- Anvendelse

- applikationer

- gælder

- tilgang

- apps

- arabisk

- arkitektur

- ER

- OMRÅDE

- områder

- omkring

- ankom

- Kunst

- kunstig

- kunstig intelligens

- Kunstig intelligens og maskinlæring

- kunstner

- AS

- spørg

- spørge

- Assistant

- forbundet

- At

- augmented

- austin

- forfatter

- automatisere

- Automatiseret

- automatisk

- Automation

- til rådighed

- AWS

- AWS kunde

- B2B

- baggrund

- opbakning

- bund

- baseret

- Baseline

- BE

- Husk

- blev

- fordi

- bliver

- været

- før

- begyndte

- begynde

- bag

- være

- fordele

- BEDSTE

- Bedre

- mellem

- Beyond

- Big

- Big data

- bog

- både

- brise

- bringe

- Bringe

- Bringer

- bristol

- bred

- bredt

- budget

- bygge

- Bygning

- bygger

- bygget

- virksomhed

- virksomheder

- men

- by

- ringe

- kaldet

- CAN

- kapaciteter

- Karriere

- tilfælde

- tilfælde

- Centers

- kæde

- udfordre

- chance

- karakteristika

- opladet

- kemikalie

- chef

- valg

- klar

- nøje

- lukning

- Cloud

- Cluster

- kode

- Kodning

- samarbejdet

- samarbejde

- samling

- Kollegium

- kombinerer

- kombineret

- kommer

- engagement

- Virksomheder

- Selskabs

- tvunget

- færdiggørelse

- komplekse

- omfattende

- computer

- Datalogi

- Computer Vision

- computing

- begreber

- konfigurering

- Tilslutning

- tilslutning

- Tilslutninger

- konsekvent

- Beholdere

- indeholder

- indhold

- indholdsskabelse

- sammenhæng

- fortsæt

- kontrakt

- bidrager

- konversation

- Core

- korrigere

- korrekt

- Koste

- kunne

- kurser

- skabe

- oprettet

- skabelse

- kreativitet

- kritisk

- Nuværende

- For øjeblikket

- skik

- kunde

- Kunder

- skære

- banebrydende

- Dallas

- data

- databehandling

- datalogi

- Database

- databaser

- Dage

- årti

- falde

- dedikeret

- dyb

- dybere

- Delaware

- demo

- demokratisering

- Afdeling

- afledte

- beskrive

- beskrivelse

- Design

- konstrueret

- ønske

- ønskes

- detaljeret

- detaljer

- udviklere

- Udvikling

- Enheder

- Dialog

- forskellige

- direkte

- distribueret

- distribuerede systemer

- dykning

- do

- dokumenter

- Er ikke

- gør

- Domæner

- Dont

- ned

- udkast

- drastisk

- køre

- grund

- hver

- lettere

- nemmeste

- nemt

- økosystem

- effektivt

- enten

- elementer

- muliggør

- ende

- slutter

- energi

- ingeniør

- Engineering

- England

- Engelsk

- nok

- sikre

- sikrer

- Indtast

- Enterprise

- virksomhedssoftware

- virksomheder

- Hele

- helt

- iværksætter

- miljøer

- lige

- Ækvivalent

- fejl

- især

- Endog

- indlysende

- præcist nok

- eksempel

- eksempler

- Excel

- ophidset

- udøvende

- eksisterende

- forventet

- forventer

- erfaring

- ekspert

- ekspertise

- opdagelsesrejsende

- Udforskning

- ekstra

- ekstremt

- familie

- hurtigt bevægende

- hurtig

- Feature

- Funktionalitet

- få

- felt

- Fields

- filtrere

- filtrering

- Filtre

- fund

- Fornavn

- flagskib

- flow

- strømme

- Fokus

- fokuserer

- fokusering

- følger

- efter

- følger

- fødevarer

- Til

- strejftog

- forkant

- format

- formularer

- Videresend

- fundet

- Foundation

- stiftende

- Francisco

- venlige

- fra

- Opfylde

- fuldt ud

- funktion

- yderligere

- fremtiden

- vundet

- generelt

- generere

- genereret

- genererer

- generere

- generation

- generative

- Generativ AI

- Georgien

- få

- gif

- given

- Go

- Mål

- Goes

- godt

- eksamen

- Grow

- vejlede

- havde

- hånd

- udnyttelse

- Have

- he

- Hjerte

- hjælpe

- hjulpet

- hjælpsom

- hjælpe

- hjælper

- link.

- højtydende

- høj kvalitet

- højdepunkter

- hans

- hold

- besidder

- gæstfrihed

- HOURS

- Hvordan

- How To

- Men

- HTML

- HTTPS

- menneskelig

- ydmyg

- identificeret

- if

- illustrere

- straks

- KIMOs Succeshistorier

- effektfuld

- gennemføre

- vigtigt

- Forbedre

- forbedret

- forbedring

- in

- omfatter

- medtaget

- Herunder

- Forøg

- uafhængig

- angiver

- Indikatorer

- individuel

- industrier

- industrien

- oplysninger

- medfødte

- fornyelse

- Innovation

- indgang

- indgange

- øjeblikkelig

- i stedet

- Institut

- anvisninger

- integreret

- integration

- integrationer

- Intelligens

- Intelligent

- hensigt

- interaktioner

- interaktiv

- interesse

- grænseflade

- interne

- ind

- introduceret

- Introducerer

- indledende

- IPO

- ISV

- IT

- iteration

- iterationer

- ITS

- Java

- Job

- sluttede

- sammenføjning

- fælles

- rejse

- glæde

- jpg

- json

- lige

- Nøgle

- Kend

- viden

- kendt

- kender

- lab

- Labs

- Sprog

- Sprog

- stor

- Efternavn

- senere

- seneste

- føre

- leder

- Leadership" (virkelig menneskelig ledelse)

- førende

- Leap

- lærte

- læring

- til venstre

- lad

- løftestang

- ligesom

- synes godt om

- begrænsende

- LLM

- logik

- Lang

- Se

- Lot

- kærlighed

- SPØGELSE

- maskine

- machine learning

- Maskiner

- lavet

- lave

- maerker

- Making

- lykkedes

- ledelse

- leder

- Ledere

- måde

- manuelt

- mange

- kortlægning

- Marts

- Marked

- Marketing

- tændstikker

- materialer

- me

- mentor

- blotte

- Metadata

- metode

- millioner

- tankerne

- minutter

- Mission

- ML

- model

- modeller

- MongoDB

- mere

- mest

- bevæge sig

- MS

- Multi-platform

- flere

- my

- navn

- Natural

- Behov

- behov

- Ny

- Nye funktioner

- nyt produkt

- næste

- ingen

- Bemærk

- Varsel..

- nu

- objekt

- objekter

- forekom

- of

- Tilbud

- tit

- on

- engang

- ONE

- kun

- drift

- operativsystemer

- optimering

- optimering

- or

- ordrer

- ordrer

- organisation

- organisationer

- original

- Andet

- vores

- ud

- Resultat

- output

- udgange

- i løbet af

- sider

- Parallel

- især

- partner

- Partnerskab

- lidenskab

- lidenskabelige

- forbi

- Mønster

- udfører

- perspektiv

- fase

- phd

- stykker

- pioner

- pipeline

- afgørende

- Place

- perron

- Platforme

- plato

- Platon Data Intelligence

- PlatoData

- Populær

- popularitet

- Indlæg

- potentiale

- potentielt

- magt

- strøm

- praksis

- praksis

- forudsige

- forudsagde

- tidligere

- primære

- Main

- Beskyttelse af personlige oplysninger

- Privatliv og sikkerhed

- Problem

- problemer

- procedure

- behandle

- Processer

- forarbejdning

- produceret

- producerer

- Produkt

- produktudvikling

- produktstyring

- produktchef

- Produkter

- professionel

- Professor

- Programmering

- programmeringssprog

- projekter

- prompter

- gennemprøvet

- give

- forudsat

- giver

- leverer

- Psykologi

- offentlige

- offentliggjort

- forfølge

- Python

- forespørgsler

- spørgsmål

- hurtigt

- tilfældig

- tilfældighed

- rækkevidde

- spænder

- hurtige

- Læsning

- indse

- rige

- modtage

- for nylig

- anerkendelse

- anbefaler

- optage

- optegnelser

- reducere

- reducerer

- reducere

- om

- region

- forestille sig igen

- relaterede

- frigivet

- relevant

- pålidelig

- stole

- huske

- Fjern

- afsmeltet

- gentagelig

- svar

- repræsentation

- repræsenterer

- repræsenterer

- anmode

- anmodninger

- kræver

- påkrævet

- Krav

- Kræver

- forskning

- svar

- reaktioner

- REST

- resulterer

- Resultater

- afkast

- afkast

- revolutionere

- Rich

- højre

- vej

- roller

- roller

- Værelse

- Kør

- løber

- SaaS

- Sikkerhed

- sagemaker

- Said

- samme

- San

- San Francisco

- skalerbar

- Scale

- planlægge

- Videnskab

- Videnskabsmand

- ridse

- SDK

- søgning

- Anden

- Sektion

- sektor

- sikkerhed

- se

- set

- Vælg

- afsendelse

- senior

- sendt

- Sequence

- serveret

- tjeneste

- Tjenester

- servering

- sessioner

- sæt

- indstilling

- flere

- bør

- Vis

- vist

- Shows

- betydeligt

- lignende

- Simpelt

- forenkle

- forenkle

- ganske enkelt

- siden

- enkelt

- lille

- So

- Software

- software som en tjeneste

- Softwareudviklere

- softwareudvikling

- software Engineering

- løsninger

- Løsninger

- SOLVE

- Løsning

- nogle

- Nogen

- sofistikeret

- Kilde

- Space

- Spansk

- spænding

- specialist

- specifikke

- specifikt

- specificeret

- tilbringe

- udgifterne

- starte

- påbegyndt

- opstart

- Statement

- Status

- Trin

- Steps

- Stands

- ligetil

- struktur

- Studerende

- studeret

- succes

- Støtte

- Understøtter

- formodes

- sikker

- systemet

- Systemer

- bord

- TAG

- Tag

- mål

- Opgaver

- opgaver

- undervist

- hold

- hold

- tech

- tech opstart

- Teknisk

- teknik

- teknikker

- Teknologier

- fortælle

- ti

- Texas

- tekst

- end

- at

- Vesten

- verdenen

- deres

- Them

- derefter

- Disse

- de

- ting

- tror

- denne

- dem

- Gennem

- hele

- tid

- til

- i dag

- token

- Tokens

- fortalt

- tog

- værktøj

- Trace

- spor

- historik

- Trading

- traditionelt

- Kurser

- transformative

- transformationer

- Oversætte

- rejse

- rejser

- trend

- retssag

- udløse

- udløsning

- sand

- Ægte kode

- forsøger

- Drejning

- typen

- ui

- Uk

- under

- forstå

- forståelse

- forstår

- enestående

- universitet

- indtil

- afsløret

- kommende

- opdateret

- på

- us

- brugbar

- brug

- brug tilfælde

- anvendte

- Bruger

- Brugererfaring

- brugere

- bruger

- ved brug af

- sædvanligvis

- ux

- forskellige

- leverandører

- versioner

- meget

- via

- vision

- visuel

- vmware

- Voice

- ønsker

- var

- Vej..

- we

- web

- webservices

- uger

- GODT

- var

- Vest

- Hvad

- Hvad er

- hvornår

- som

- bred

- Bred rækkevidde

- vilje

- vindue

- med

- uden

- Arbejde

- arbejdsdagen

- arbejdede

- workflow

- arbejdsgange

- arbejder

- virker

- world

- Verdens

- ville

- skriver

- XML

- år

- år

- Du

- Din

- youtube

- zephyrnet