Verden af kunstig intelligens (AI) og maskinlæring (ML) har været vidne til et paradigmeskifte med fremkomsten af generative AI-modeller, der kan skabe menneskelignende tekst, billeder, kode og lyd. Sammenlignet med klassiske ML-modeller er generative AI-modeller betydeligt større og mere komplekse. Men deres stigende kompleksitet kommer også med høje omkostninger til slutninger og et voksende behov for kraftfulde computerressourcer. De høje omkostninger ved slutninger for generative AI-modeller kan være en barriere for adgang for virksomheder og forskere med begrænsede ressourcer, hvilket nødvendiggør behovet for mere effektive og omkostningseffektive løsninger. Desuden involverer størstedelen af generative AI-brugssager menneskelig interaktion eller scenarier i den virkelige verden, hvilket nødvendiggør hardware, der kan levere ydeevne med lav latency. AWS har fornyet sig med specialbyggede chips for at imødekomme det voksende behov for kraftfuld, effektiv og omkostningseffektiv computerhardware.

I dag er vi glade for at kunne meddele det Amazon SageMaker understøtninger AWS Inferentia2 (ml.inf2) og AWS Trainium (ml.trn1)-baserede SageMaker-instanser til at være vært for generative AI-modeller til realtid og asynkron inferens. ml.inf2-instanser er tilgængelige til modelimplementering på SageMaker i US East (Ohio) og ml.trn1-instanser i US East (N. Virginia).

Du kan bruge disse instanser på SageMaker til at opnå høj ydeevne til en lav pris for generative AI-modeller, herunder store sprogmodeller (LLM'er), stabil diffusion og vision-transformere. Derudover kan du bruge Amazon SageMaker Inference Recommender for at hjælpe dig med at køre belastningstest og evaluere fordelene ved at implementere din model på disse forekomster.

Du kan bruge ml.inf2- og ml.trn1-forekomster til at køre dine ML-applikationer på SageMaker til tekstresumé, kodegenerering, video- og billedgenerering, talegenkendelse, personalisering, registrering af svindel og mere. Du kan nemt komme i gang ved at angive ml.trn1- eller ml.inf2-forekomster, når du konfigurerer dit SageMaker-slutpunkt. Du kan bruge ml.trn1 og ml.inf2-kompatible AWS Deep Learning Containers (DLC'er) til PyTorch, TensorFlow, Hugging Face og large model inference (LMI) for nemt at komme i gang. For den fulde liste med versioner, se Tilgængelige Deep Learning Containers-billeder.

I dette indlæg viser vi processen med at implementere en stor sprogmodel på AWS Inferentia2 ved hjælp af SageMaker, uden at kræve nogen ekstra kodning, ved at udnytte LMI-beholderen. Vi bruger GPT4ALL-J, en finjusteret GPT-J 7B-model, der giver en chatbot-stil interaktion.

Oversigt over ml.trn1- og ml.inf2-forekomster

ml.trn1-forekomster drives af Trainium-acceleratoren, som er specialbygget primært til højtydende dyb læringstræning af generative AI-modeller, inklusive LLM'er. Disse instanser understøtter dog også inferensarbejdsbelastninger for modeller, der er endnu større end hvad der passer ind i Inf2. Den største instansstørrelse, trn1.32xlarge instanser, har 16 Trainium acceleratorer med 512 GB acceleratorhukommelse i en enkelt instans, der leverer op til 3.4 petaflops FP16/BF16-computerkraft. 16 Trainium acceleratorer er forbundet med ultra-højhastigheds NeuronLinkv2 for strømlinet kollektiv kommunikation.

ml.Inf2-forekomster drives af AWS Inferentia2 accelerator, en specialbygget accelerator til slutninger. Den leverer tre gange højere computerydeevne, op til fire gange højere gennemstrømning og op til 10 gange lavere latenstid sammenlignet med førstegenerations AWS Inferentia. Den største instansstørrelse, Inf2.48xlarge, har 12 AWS Inferentia2-acceleratorer med 384 GB acceleratorhukommelse i en enkelt instans for en kombineret regnekraft på 2.3 petaflops til BF16/FP16. Det giver dig mulighed for at implementere op til en model på 175 milliarder parametre i et enkelt tilfælde. Inf2 er den eneste slutningsoptimerede instans, der tilbyder denne sammenkobling, en funktion, der kun er tilgængelig i dyrere træningstilfælde. For ultra-store modeller, der ikke passer ind i en enkelt accelerator, flyder data direkte mellem acceleratorer med NeuronLink, og omgår CPU'en fuldstændigt. Med NeuronLink understøtter Inf2 hurtigere distribueret inferens og forbedrer gennemløb og latens.

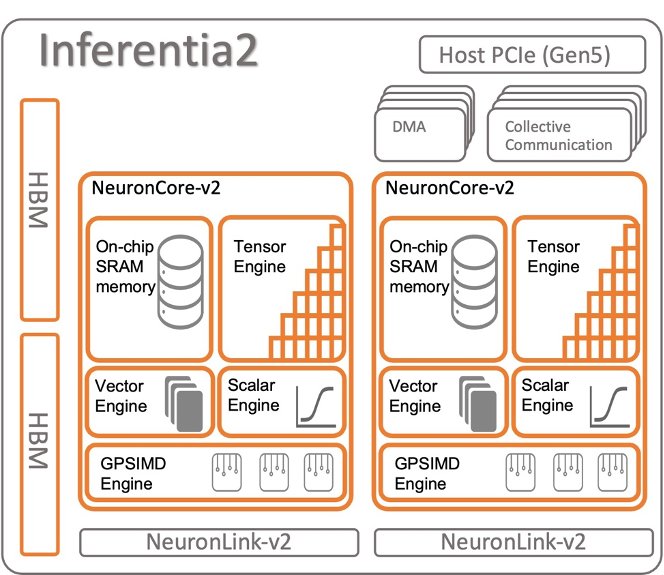

Både AWS Inferentia2 og Trainium acceleratorer har to NeuronCores-v2, 32 GB HBM-hukommelsesstakke og dedikerede collective-compute-motorer, som automatisk optimerer runtime ved at overlappe beregninger og kommunikation, når der foretages multi-accelerator-inferens. For flere detaljer om arkitekturen, se Trainium og Inferentia enheder.

Følgende diagram viser et eksempel på arkitektur ved hjælp af AWS Inferentia2.

AWS Neuron SDK

AWS Neuron er SDK'et, der bruges til at køre deep learning-arbejdsbelastninger på AWS Inferentia- og Trainium-baserede instanser. AWS Neuron inkluderer en deep learning-kompiler, runtime og værktøjer, der er integreret i TensorFlow og PyTorch. Med Neuron kan du udvikle, profilere og implementere højtydende ML-arbejdsbelastninger på ml.trn1 og ml.inf2.

Neuron compiler accepterer ML-modeller i forskellige formater (TensorFlow, PyTorch, XLA HLO) og optimerer dem til at køre på Neuron-enheder. Neuron-compilatoren påkaldes inden for ML-frameworket, hvor ML-modeller sendes til compileren af Neuron framework-plugin'et. Den resulterende kompileringsartefakt kaldes en NEFF-fil (Neuron Executable File Format), som igen indlæses af Neuron-runtimen til Neuron-enheden.

Neuron køretid består af kernedriver og C/C++ biblioteker, som giver API'er til at få adgang til AWS Inferentia og Trainium Neuron enheder. Neuron ML frameworks plugins til TensorFlow og PyTorch bruger Neuron runtime til at indlæse og køre modeller på NeuronCores. Neuron runtime indlæser kompilerede deep learning-modeller (NEFF) til Neuron-enhederne og er optimeret til høj gennemløb og lav latenstid.

Vær vært for NLP-modeller ved hjælp af SageMaker ml.inf2-instanser

Inden vi dykker dybt ned i at servere LLM'er med transformatorer-neuronx, som er et open source-bibliotek til at sønderdele modellens store vægtmatricer på flere NeuronCores, lad os kort gennemgå det typiske implementeringsflow for en model, der kan passe ind på den enkelte NeuronCore.

Tjek liste over understøttede modeller for at sikre, at modellen er understøttet på AWS Inferentia2. Dernæst skal modellen prækompileres af Neuron Compiler. Du kan bruge en SageMaker notesbog eller en Amazon Elastic Compute Cloud (Amazon EC2) instans til at kompilere modellen. Du kan bruge SageMaker Python SDK til at implementere modeller ved hjælp af populære deep learning-rammer såsom PyTorch, som vist i følgende kode. Du kan implementere din model til SageMaker-hostingtjenester og få et slutpunkt, der kan bruges til slutninger. Disse endepunkter er fuldt administrerede og understøtter automatisk skalering.

Der henvises til Udviklerflows for flere detaljer om typiske udviklingsstrømme af Inf2 på SageMaker med eksempelscripts.

Vær vært for LLM'er ved hjælp af SageMaker ml.inf2-instanser

Store sprogmodeller med milliarder af parametre er ofte for store til at passe på en enkelt accelerator. Dette nødvendiggør brugen af modelparallelle teknikker til hosting af LLM'er på tværs af flere acceleratorer. Et andet afgørende krav til hosting af LLM'er er implementeringen af en højtydende modelserveringsløsning. Denne løsning bør effektivt indlæse modellen, administrere partitionering og problemfrit betjene anmodninger via HTTP-slutpunkter.

SageMaker inkluderer specialiserede deep learning-containere (DLC'er), biblioteker og værktøj til modelparallelisme og stor modelslutning. For ressourcer til at komme i gang med LMI på SageMaker, se Modelparallelisme og stor modelslutning. SageMaker vedligeholder DLC'er med populære open source-biblioteker til hosting af store modeller såsom GPT, T5, OPT, BLOOM og Stable Diffusion på AWS-infrastruktur. Disse specialiserede DLC'er omtales som SageMaker LMI-containere.

SageMaker LMI containere brug DJLServing, en modelserver, der er integreret med transformers-neuronx-biblioteket for at understøtte tensorparallelisme på tværs af NeuronCores. For at lære mere om, hvordan DJLServing virker, se Implementer store modeller på Amazon SageMaker ved hjælp af DJLServing og DeepSpeed model parallel inferens. DJL-modelserveren og transformers-neuronx-biblioteket fungerer som kernekomponenter i containeren, som også inkluderer Neuron SDK. Denne opsætning letter indlæsningen af modeller på AWS Inferentia2-acceleratorer, paralleliserer modellen på tværs af flere NeuronCores og muliggør servering via HTTP-endepunkter.

LMI containeren understøtter indlæsning af modeller fra en Amazon Simple Storage Service (Amazon S3) spand eller Hugging Face Hub. Standard handlerscriptet indlæser modellen, kompilerer og konverterer den til et Neuron-optimeret format og indlæser den. For at bruge LMI-beholderen til at være vært for LLM'er har vi to muligheder:

- En ingen kode (foretrukket) – Dette er den nemmeste måde at implementere en LLM ved hjælp af en LMI-beholder. I denne metode kan du bruge den medfølgende standardhandler og send blot modelnavnet og de nødvendige parametre ind

serving.propertiesfil for at indlæse og hoste modellen. For at bruge standardhandleren leverer vientryPointparameter somdjl_python.transformers-neuronx. - Medbring dit eget manuskript – I denne tilgang har du mulighed for at oprette din egen model.py-fil, som indeholder den nødvendige kode til at indlæse og betjene modellen. Denne fil fungerer som mellemled mellem

DJLServingAPI'er ogtransformers-neuronxAPI'er. For at tilpasse modelindlæsningsprocessen kan du levereserving.propertiesmed konfigurerbare parametre. For en omfattende liste over tilgængelige konfigurerbare parametre henvises til Alle DJL-konfigurationsmuligheder. Her er et eksempel på en model.py fil.

Runtime arkitektur

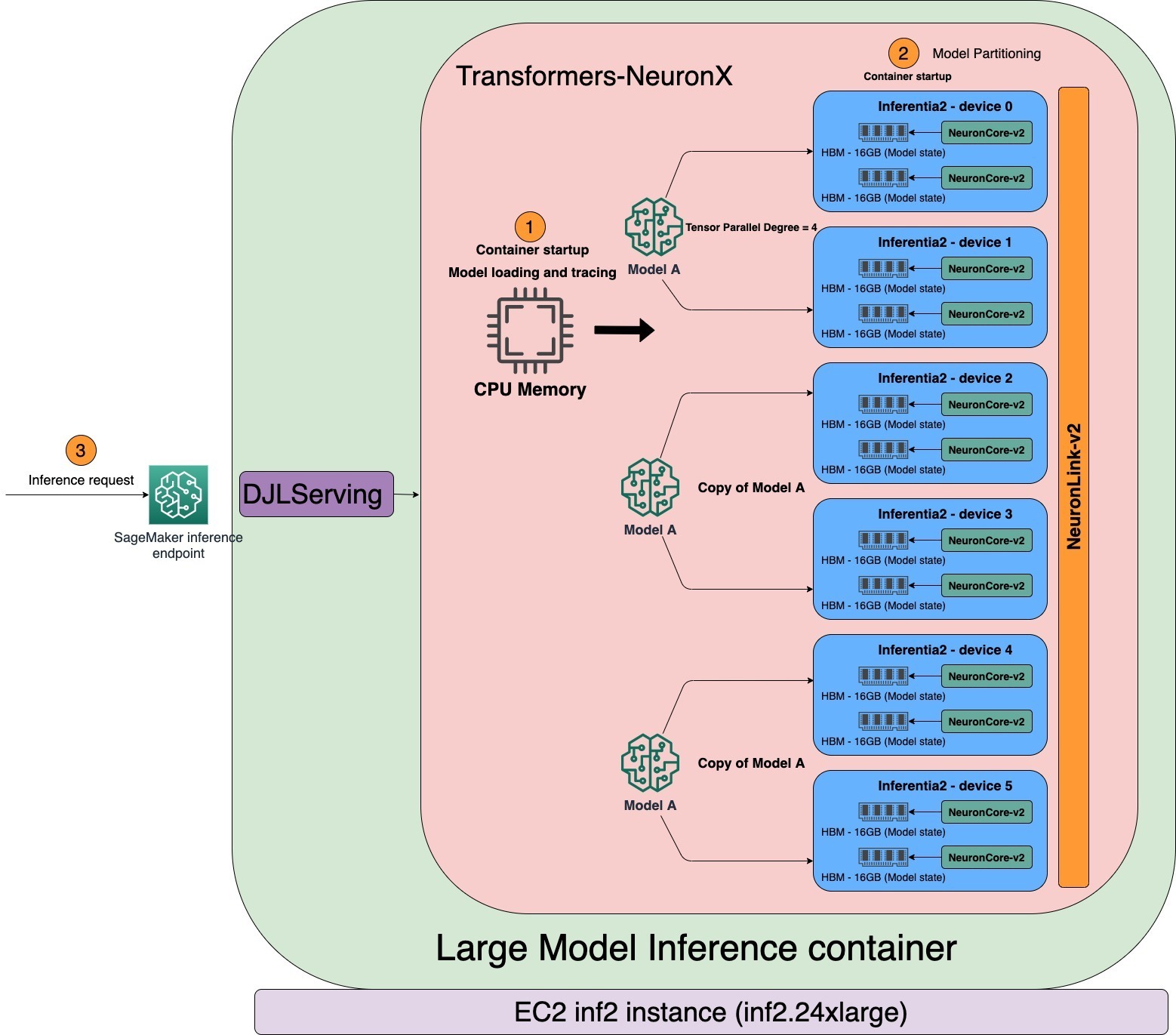

tensor_parallel_degree egenskabsværdi bestemmer fordelingen af tensor parallelle moduler på tværs af flere NeuronCores. For eksempel har inf2.24xlarge seks AWS Inferentia2 acceleratorer. Hver AWS Inferentia2 accelerator har to NeuronCores. Hver NeuronCore har en dedikeret hukommelse med høj båndbredde (HBM) på 16 GB til lagring af parallelle tensormoduler. Med en tensor parallel grad på 4 vil LMI tildele tre modelkopier af samme model, der hver bruger fire NeuronCores. Som vist i det følgende diagram, når LMI-beholderen starter, vil modellen blive indlæst og sporet først i den CPU-adresserbare hukommelse. Når sporingen er afsluttet, er modellen opdelt på tværs af NeuronCores baseret på tensor parallelgraden.

LMI bruger DJLServing som sin modelserveringsstack. Efter containerens sundhedstjek er bestået i SageMaker, er containeren klar til at betjene slutningsanmodningen. DJLServing lancerer flere Python-processer svarende til TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. Hver Python-proces indeholder tråde i C++ svarende til TENSOR_PARALLEL_DEGREE. Hver C++-tråd holder et skår af modellen på en NeuronCore.

Mange praktikere (Python-processen) har en tendens til at køre inferens sekventielt, når serveren påkaldes med flere uafhængige anmodninger. Selvom det er nemmere at sætte op, er det normalt ikke den bedste praksis at udnytte acceleratorens regnekraft. For at løse dette tilbyder DJLServing de indbyggede optimeringer af dynamisk batching for at kombinere disse uafhængige inferensanmodninger på serversiden for at danne en større batch dynamisk for at øge gennemløbet. Alle anmodninger når først den dynamiske batcher, før de går ind i de faktiske jobkøer for at vente på slutninger. Du kan indstille dine foretrukne batchstørrelser til dynamisk batching ved hjælp af batch_size indstillinger i serving.properties. Du kan også konfigurere max_batch_delay for at angive den maksimale forsinkelsestid i batcheren for at vente på andre anmodninger om at slutte sig til batchen baseret på dine latenskrav. Gennemløbet afhænger også af antallet af modelkopier og de Python-procesgrupper, der er lanceret i containeren. Som vist i det følgende diagram, med tensor-parallelgraden sat til 4, starter LMI-beholderen tre Python-procesgrupper, der hver indeholder den fulde kopi af modellen. Dette giver dig mulighed for at øge batchstørrelsen og få højere gennemløb.

SageMaker notesbog til implementering af LLM'er

I dette afsnit giver vi en trin-for-trin gennemgang af implementering af GPT4All-J, en model med 6 milliarder parametre, der er 24 GB i FP32. GPT4All-J er en populær chatbot, der er blevet trænet i en lang række interaktionsindhold som ordproblemer, dialogbokse, kode, digte, sange og historier. GPT4all-J er en finjusteret GPT-J-model, der genererer svar, der ligner menneskelige interaktioner.

Den komplette notesbog til dette eksempel findes på GitHub. Vi kan bruge SageMaker Python SDK til at implementere modellen til en Inf2-instans. Vi bruger det medfølgende standardhandler for at indlæse modellen. Med dette skal vi blot give en portioner.ejendomme fil. Denne fil har de nødvendige konfigurationer til, at DJL-modelserveren kan downloade og hoste modellen. Vi kan angive navnet på Hugging Face-modellen ved hjælp af model_id parameter for at downloade modellen direkte fra Hugging Face-repoen. Alternativt kan du downloade modellen fra Amazon S3 ved at levere s3url parameter. Det entryPoint parameter er konfigureret til at pege på biblioteket for at indlæse modellen. For flere detaljer vedr djl_python.fastertransformer, henvises til GitHub kode.

tensor_parallel_degree egenskabsværdi bestemmer fordelingen af tensorparallelle moduler på tværs af flere enheder. For eksempel, med 12 NeuronCores og en tensor parallel grad på 4, vil LMI tildele tre modelkopier, der hver bruger fire NeuronCores. Du kan også definere præcisionstypen ved hjælp af egenskaben dtype. n_position parameter definerer summen af maks. input- og outputsekvenslængde for modellen. Se følgende kode:

Konstruer tarball Indeholder serving.properties og upload det til en S3-bøtte. Selvom standardhandleren bruges i dette eksempel, kan du udvikle en model.py fil til tilpasning af indlæsnings- og serveringsprocessen. Hvis der er nogen pakker, der skal installeres, skal du inkludere dem i requirements.txt fil. Se følgende kode:

Hent DJL-beholderbilledet og opret SageMaker-modellen:

Dernæst opretter vi SageMaker-slutpunktet med den tidligere definerede modelkonfiguration. Containeren downloader modellen til /tmp plads, fordi SageMaker kortlægger /tmp til Amazon Elastic Block Store (Amazon EBS). Vi skal tilføje en volume_size parameter for at sikre /tmp bibliotek har plads nok til at downloade og kompilere modellen. Vi sætter container_startup_health_check_timeout til 3,600 sekunder for at sikre, at sundhedstjekket starter, efter at modellen er klar. Vi bruger instansen ml.inf2.8xlarge. Se følgende kode:

Efter at SageMaker-endepunktet er blevet oprettet, kan vi lave forudsigelser i realtid mod SageMaker-endepunkter ved hjælp af Predictor objekt:

Ryd op

Slet slutpunkterne for at spare omkostninger, når du er færdig med dine tests:

Konklusion

I dette indlæg fremviste vi den nyligt lancerede kapacitet i SageMaker, som nu understøtter ml.inf2 og ml.trn1-instanser til hosting af generative AI-modeller. Vi demonstrerede, hvordan man implementerer GPT4ALL-J, en generativ AI-model, på AWS Inferentia2 ved hjælp af SageMaker og LMI-beholderen uden at skrive nogen kode. Vi viste også, hvordan du kan bruge DJLServing og transformers-neuronx for at indlæse en model, opdele den og tjene.

Inf2-instanser giver den mest omkostningseffektive måde at køre generative AI-modeller på AWS. For detaljer om ydeevne, se Inf2 ydeevne.

Tjek den GitHub repo for en eksempel notesbog. Prøv det og lad os vide, hvis du har spørgsmål!

Om forfatterne

Vivek Gangasani er Senior Machine Learning Solutions Architect hos Amazon Web Services. Han arbejder med Machine Learning Startups for at bygge og implementere AI/ML-applikationer på AWS. Han er i øjeblikket fokuseret på at levere løsninger til MLOps, ML Inference og low-code ML. Han har arbejdet på projekter inden for forskellige domæner, herunder Natural Language Processing og Computer Vision.

Vivek Gangasani er Senior Machine Learning Solutions Architect hos Amazon Web Services. Han arbejder med Machine Learning Startups for at bygge og implementere AI/ML-applikationer på AWS. Han er i øjeblikket fokuseret på at levere løsninger til MLOps, ML Inference og low-code ML. Han har arbejdet på projekter inden for forskellige domæner, herunder Natural Language Processing og Computer Vision.

Hiroshi Tokoyo er Solutions Architect hos AWS Annapurna Labs. Baseret i Japan sluttede han sig til Annapurna Labs allerede før opkøbet af AWS og har konsekvent hjulpet kunder med Annapurna Labs-teknologi. Hans seneste fokus er på Machine Learning-løsninger baseret på specialbygget silicium, AWS Inferentia og Trainium.

Hiroshi Tokoyo er Solutions Architect hos AWS Annapurna Labs. Baseret i Japan sluttede han sig til Annapurna Labs allerede før opkøbet af AWS og har konsekvent hjulpet kunder med Annapurna Labs-teknologi. Hans seneste fokus er på Machine Learning-løsninger baseret på specialbygget silicium, AWS Inferentia og Trainium.

Dhawal Patel er Principal Machine Learning Architect hos AWS. Han har arbejdet med organisationer lige fra store virksomheder til mellemstore startups om problemer relateret til distribueret computing og kunstig intelligens. Han fokuserer på Deep learning, herunder NLP og Computer Vision domæner. Han hjælper kunder med at opnå højtydende modelslutning på SageMaker.

Dhawal Patel er Principal Machine Learning Architect hos AWS. Han har arbejdet med organisationer lige fra store virksomheder til mellemstore startups om problemer relateret til distribueret computing og kunstig intelligens. Han fokuserer på Deep learning, herunder NLP og Computer Vision domæner. Han hjælper kunder med at opnå højtydende modelslutning på SageMaker.

Qing Lan er softwareudviklingsingeniør i AWS. Han har arbejdet på adskillige udfordrende produkter i Amazon, herunder højtydende ML-inferensløsninger og højtydende logningssystem. Qings team lancerede med succes den første Billion-parameter model i Amazon Advertising med meget lav forsinkelse påkrævet. Qing har indgående viden om infrastrukturoptimering og Deep Learning acceleration.

Qing Lan er softwareudviklingsingeniør i AWS. Han har arbejdet på adskillige udfordrende produkter i Amazon, herunder højtydende ML-inferensløsninger og højtydende logningssystem. Qings team lancerede med succes den første Billion-parameter model i Amazon Advertising med meget lav forsinkelse påkrævet. Qing har indgående viden om infrastrukturoptimering og Deep Learning acceleration.

Qingwei Li er Machine Learning Specialist hos Amazon Web Services. Han fik sin ph.d. i Operations Research, efter at han brød sin rådgivers forskningsbevillingskonto og undlod at levere den nobelpris, han lovede. I øjeblikket hjælper han kunder i finans- og forsikringsbranchen med at bygge maskinlæringsløsninger på AWS. I sin fritid kan han godt lide at læse og undervise.

Qingwei Li er Machine Learning Specialist hos Amazon Web Services. Han fik sin ph.d. i Operations Research, efter at han brød sin rådgivers forskningsbevillingskonto og undlod at levere den nobelpris, han lovede. I øjeblikket hjælper han kunder i finans- og forsikringsbranchen med at bygge maskinlæringsløsninger på AWS. I sin fritid kan han godt lide at læse og undervise.

Alan Tan er en Senior Product Manager med SageMaker, der leder indsatsen på store modelslutninger. Han brænder for at anvende Machine Learning til området Analytics. Uden for arbejdet nyder han udendørslivet.

Alan Tan er en Senior Product Manager med SageMaker, der leder indsatsen på store modelslutninger. Han brænder for at anvende Machine Learning til området Analytics. Uden for arbejdet nyder han udendørslivet.

Varun Syal er en softwareudviklingsingeniør med AWS Sagemaker, der arbejder på kritiske kundevendte funktioner til ML Inference-platformen. Han brænder for at arbejde i Distributed Systems og AI-området. I sin fritid holder han af at læse og have havearbejde.

Varun Syal er en softwareudviklingsingeniør med AWS Sagemaker, der arbejder på kritiske kundevendte funktioner til ML Inference-platformen. Han brænder for at arbejde i Distributed Systems og AI-området. I sin fritid holder han af at læse og have havearbejde.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoAiStream. Web3 Data Intelligence. Viden forstærket. Adgang her.

- Udmøntning af fremtiden med Adryenn Ashley. Adgang her.

- Køb og sælg aktier i PRE-IPO-virksomheder med PREIPO®. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- :har

- :er

- :ikke

- :hvor

- $OP

- 10

- 100

- 12

- 13

- 14

- 15 %

- 22

- 24

- 7

- 8

- 9

- a

- Om

- accelerator

- acceleratorer

- accepterer

- adgang

- Konto

- opnå

- erhvervelse

- tværs

- handlinger

- tilføje

- Desuden

- adresse

- adresserbare

- Fordel

- Reklame

- Efter

- mod

- AI

- ai use cases

- AI / ML

- Alle

- tillader

- også

- Skønt

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- an

- analytics

- ,

- Annoncere

- En anden

- enhver

- API'er

- applikationer

- Anvendelse

- tilgang

- arkitektur

- ER

- OMRÅDE

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- AS

- At

- lyd

- auto

- automatisk

- til rådighed

- AWS

- AWS-inferens

- bold

- båndbredde

- barriere

- baseret

- BE

- fordi

- været

- før

- fordele

- BEDSTE

- mellem

- Big

- større

- milliarder

- Bloker

- Blog

- Bloom

- kortvarigt

- Broke

- bygge

- bygget

- indbygget

- virksomheder

- by

- C + +

- kaldet

- CAN

- tilfælde

- udfordrende

- chatbot

- kontrollere

- Chips

- kode

- Kodning

- kollektive

- kombinerer

- kombineret

- kommer

- Kommunikation

- Kommunikation

- sammenlignet

- kompatibel

- fuldføre

- fuldstændig

- komplekse

- kompleksitet

- komponenter

- omfattende

- beregning

- Compute

- computer

- Computer Vision

- computing

- Konfiguration

- tilsluttet

- Container

- Beholdere

- indeholder

- indhold

- Core

- Koste

- omkostningseffektiv

- Omkostninger

- skabe

- oprettet

- kritisk

- afgørende

- For øjeblikket

- kunde

- Kunder

- tilpasse

- data

- dedikeret

- dyb

- dyb læring

- Standard

- definerede

- definerer

- Degree

- forsinkelse

- levere

- leverer

- leverer

- demonstreret

- afhænger

- indsætte

- implementering

- implementering

- detaljer

- Detektion

- bestemmer

- udvikle

- Udvikling

- enhed

- Enheder

- forskellige

- Broadcasting

- direkte

- distribueret

- distribueret computing

- distribuerede systemer

- fordeling

- gør

- Domæner

- Dont

- downloade

- downloads

- driver

- dynamisk

- dynamisk

- hver

- tidligere

- lettere

- nemmeste

- nemt

- Øst

- effektiv

- effektivt

- indsats

- muliggør

- ende

- Endpoint

- ingeniør

- Motorer

- nok

- sikre

- indtastning

- virksomheder

- indrejse

- Ækvivalent

- evaluere

- Endog

- eksempel

- ophidset

- dyrt

- ekstra

- Ansigtet

- letter

- vender

- mislykkedes

- hurtigere

- Feature

- Funktionalitet

- File (Felt)

- finansielle

- finansiel service

- slut

- Fornavn

- passer

- flow

- strømme

- Fokus

- fokuserede

- fokuserer

- efter

- Til

- formular

- format

- fire

- Framework

- rammer

- bedrageri

- bedrageri afsløring

- fra

- fuld

- fuldt ud

- Endvidere

- genererer

- generation

- generative

- Generativ AI

- få

- Go

- indrømme

- Gruppens

- Dyrkning

- Hardware

- Have

- he

- Helse

- hjælpe

- hjulpet

- hjælper

- link.

- Høj

- Høj ydeevne

- højere

- hans

- bedrift

- besidder

- host

- Hosting

- hosting-tjenester

- hus

- Hvordan

- How To

- Men

- HTML

- http

- HTTPS

- Hub

- menneskelig

- if

- billede

- billeder

- implementering

- importere

- in

- dybdegående

- omfatter

- omfatter

- Herunder

- Forøg

- stigende

- uafhængig

- industrien

- Infrastruktur

- fornyelse

- indgang

- indgange

- installation

- instans

- forsikring

- integreret

- Intelligens

- interaktion

- interaktioner

- mellemmand

- ind

- påberåbes

- involvere

- IT

- ITS

- Japan

- Job

- deltage

- sluttede

- jpg

- json

- lige

- Kend

- viden

- Labs

- Sprog

- stor

- Store virksomheder

- større

- største

- Latency

- lanceret

- lanceringer

- førende

- LÆR

- læring

- Længde

- lad

- biblioteker

- Bibliotek

- ligesom

- synes godt om

- Limited

- Liste

- LLM

- belastning

- lastning

- belastninger

- logning

- Lav

- lavere

- laveste

- maskine

- machine learning

- hovedsageligt

- fastholder

- Flertal

- lave

- administrere

- lykkedes

- leder

- Maps

- max

- maksimal

- Hukommelse

- metode

- ML

- MLOps

- model

- modeller

- Moduler

- mere

- mere effektiv

- mest

- flere

- navn

- Natural

- Natural Language Processing

- nødvendig

- Behov

- behov

- Ny

- New York

- næste

- NLP

- Nobel pris

- notesbog

- nu

- nummer

- objekt

- of

- tilbyde

- Tilbud

- tit

- Ohio

- on

- ONE

- kun

- open source

- Produktion

- optimering

- Optimer

- optimeret

- Optimerer

- Option

- Indstillinger

- or

- organisationer

- Andet

- vores

- ud

- udendørs

- output

- uden for

- egen

- pakker

- paradigme

- Parallel

- parameter

- parametre

- passerer

- gennemløb

- lidenskabelige

- ydeevne

- Personalisering

- perron

- plato

- Platon Data Intelligence

- PlatoData

- plugin

- Plugins

- Punkt

- Populær

- Indlæg

- magt

- strøm

- vigtigste

- praksis

- Precision

- Forudsigelser

- Predictor

- foretrækkes

- Main

- præmie

- problemer

- behandle

- Processer

- forarbejdning

- Produkt

- produktchef

- Produkter

- Profil

- projekter

- lovede

- egenskaber

- ejendom

- give

- forudsat

- giver

- leverer

- formål

- Python

- pytorch

- spænder

- nå

- Læsning

- klar

- virkelige verden

- realtid

- modtaget

- nylige

- anerkendelse

- benævnt

- relaterede

- anmode

- anmodninger

- påkrævet

- krav

- Krav

- forskning

- forskere

- Ressourcer

- reaktioner

- resulterer

- Rise

- Kør

- sagemaker

- SageMaker Inference

- samme

- Gem

- skalering

- scenarier

- scripts

- SDK

- problemfrit

- sekunder

- Sektion

- se

- senior

- Sequence

- tjener

- tjeneste

- Tjenester

- servering

- sæt

- indstillinger

- setup

- flere

- skifte

- bør

- Vis

- fremvist

- vist

- Shows

- side

- betydeligt

- Silicon

- lignende

- Simpelt

- enkelt

- SIX

- Størrelse

- størrelser

- So

- Software

- softwareudvikling

- løsninger

- Løsninger

- Space

- specialist

- specialiserede

- tale

- Talegenkendelse

- stabil

- stable

- Stakke

- starte

- påbegyndt

- starter

- Nystartede

- opbevaring

- Historier

- lagring

- strømlinet

- stil

- Succesfuld

- sådan

- support

- Understøttet

- Understøtter

- systemet

- Systemer

- tager

- Undervisning

- hold

- teknikker

- Teknologier

- tensorflow

- tests

- end

- at

- Området

- deres

- Them

- Der.

- Disse

- denne

- tre

- Gennem

- kapacitet

- tid

- gange

- til

- også

- værktøjer

- Sporing

- uddannet

- Kurser

- transformers

- TUR

- to

- typen

- typisk

- uploadet

- us

- brug

- anvendte

- ved brug af

- sædvanligvis

- udnytte

- Ved hjælp af

- værdi

- række

- forskellige

- Vast

- meget

- via

- video

- Virginia

- vision

- vente

- går igennem

- Vej..

- we

- web

- webservices

- vægt

- Hvad

- hvornår

- som

- vilje

- med

- inden for

- uden

- vidne

- ord

- Arbejde

- arbejdede

- arbejder

- virker

- world

- skriver

- skrivning

- york

- Du

- Din

- zephyrnet