Vi mener, at generativ kunstig intelligens over tid har potentialet til at transformere stort set enhver kundeoplevelse, vi kender. Antallet af virksomheder, der lancerer generative AI-applikationer på AWS, er betydeligt og opbygges hurtigt, herunder adidas, Booking.com, Bridgewater Associates, Clariant, Cox Automotive, GoDaddy og LexisNexis Legal & Professional, for blot at nævne nogle få. Innovative startups som Perplexity AI går all in på AWS til generativ AI. Førende AI-virksomheder som Anthropic har valgt AWS som deres primære cloud-udbyder til missionskritiske arbejdsbelastninger og stedet for at træne deres fremtidige modeller. Og globale service- og løsningsudbydere som Accenture høster fordelene ved skræddersyede generative AI-applikationer, når de giver deres interne udviklere mulighed for at Amazon Code Whisperer.

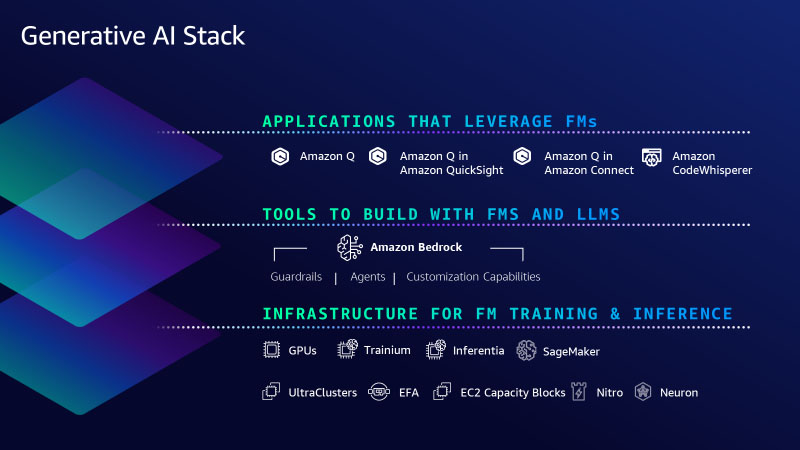

Disse kunder vælger AWS, fordi vi er fokuseret på at gøre, hvad vi altid har gjort – at tage kompleks og dyr teknologi, der kan transformere kundeoplevelser og virksomheder, og demokratisere det for kunder af alle størrelser og tekniske evner. For at gøre dette investerer og innoverer vi hurtigt for at levere det mest omfattende sæt af muligheder på tværs af de tre lag af den generative AI-stak. Det nederste lag er infrastrukturen til at træne store sprogmodeller (LLM'er) og andre grundmodeller (FM'er) og producere slutninger eller forudsigelser. Mellemlaget er nem adgang til alle de modeller og værktøjer, kunder har brug for for at bygge og skalere generative AI-applikationer med den samme sikkerhed, adgangskontrol og andre funktioner, som kunderne forventer af en AWS-tjeneste. Og på det øverste lag har vi investeret i spilskiftende applikationer på nøgleområder som generativ AI-baseret kodning. Ud over at tilbyde dem valgmuligheder og – som de forventer af os – bredde og dybde af kapaciteter på tværs af alle lag, fortæller kunderne os også, at de værdsætter vores data-først tilgang og stoler på, at vi har bygget alt fra bunden sammen med virksomheden- grad sikkerhed og privatliv.

I denne uge tog vi et stort skridt fremad og annoncerede mange væsentlige nye muligheder på tværs af alle tre lag af stakken for at gøre det nemt og praktisk for vores kunder at bruge generativ AI udbredt i deres virksomheder.

Nederste lag af stakken: AWS Trainium2 er den seneste tilføjelse til at levere den mest avancerede cloud-infrastruktur til generativ AI

Det nederste lag af stakken er den infrastruktur - computer, netværk, rammer, tjenester - der kræves for at træne og drive LLM'er og andre FM'er. AWS innoverer for at tilbyde den mest avancerede infrastruktur til ML. Gennem vores mangeårige samarbejde med NVIDIA var AWS den første til at bringe GPU'er til skyen for mere end 12 år siden, og senest var vi den første store cloud-udbyder, der gjorde NVIDIA H100 GPU'er tilgængelige med vores P5-instanser. Vi fortsætter med at investere i unikke innovationer, der gør AWS til den bedste sky til at køre GPU'er, inklusive pris-ydelsesfordelene ved det mest avancerede virtualiseringssystem (AWS Nitro), kraftfuld petabit-skala netværk med Elastic Fabric Adapter (EFA) og hyper- skala clustering med Amazon EC2 UltraClusters (tusindvis af accelererede forekomster, der er placeret sammen i en tilgængelighedszone og forbundet i et ikke-blokerende netværk, der kan levere op til 3,200 Gbps til massiv ML-træning). Vi gør det også nemmere for enhver kunde at få adgang til meget efterspurgt GPU-beregningskapacitet til generativ AI med Amazon EC2 Capacity Blocks for ML – den første og eneste forbrugsmodel i branchen, der lader kunder reservere GPU'er til fremtidig brug (op til 500 implementeret i EC2 UltraClusters) til kortvarige ML-arbejdsbelastninger.

For adskillige år siden indså vi, at for at blive ved med at presse rammen om prispræstationer, ville vi være nødt til at innovere helt ned til silicium, og vi begyndte at investere i vores egne chips. For ML specifikt startede vi med AWS Inferentia, vores specialbyggede inferenschip. I dag er vi på vores anden generation af AWS Inferentia med Amazon EC2 Inf2-instanser, der er optimeret specifikt til generative AI-applikationer i stor skala med modeller, der indeholder hundredvis af milliarder af parametre. Inf2-forekomster tilbyder de laveste omkostninger for inferens i skyen, mens de også leverer op til fire gange højere gennemløb og op til ti gange lavere latenstid sammenlignet med Inf1-forekomster. Drevet af op til 12 Inferentia2-chips er Inf2 de eneste slutningsoptimerede EC2-instanser, der har højhastighedsforbindelse mellem acceleratorer, så kunder kan køre inferens hurtigere og mere effektivt (til lavere omkostninger) uden at ofre ydeevne eller latenstid ved at distribuere ultrastore modeller på tværs af flere acceleratorer. Kunder som Adobe, Deutsche Telekom og Leonardo.ai har set gode tidlige resultater og er begejstrede for at implementere deres modeller i stor skala på Inf2.

På træningssiden er Trn1-instanser - drevet af AWS's specialbyggede ML-træningschip, AWS Trainium - optimeret til at distribuere træning på tværs af flere servere forbundet med EFA-netværk. Kunder som Ricoh har trænet en japansk LLM med milliarder af parametre på få dage. Databricks får op til 40 % bedre pris-ydeevne med Trainium-baserede instanser til at træne storstilede deep learning-modeller. Men med nye, mere dygtige modeller, der udkommer næsten hver uge, fortsætter vi med at skubbe grænserne for ydeevne og skala, og vi er glade for at kunne annoncere AWS Trainium2, designet til at levere endnu bedre prisydeevne for træningsmodeller med hundreder af milliarder til billioner af parametre. Trainium2 skulle levere op til fire gange hurtigere træningspræstation end førstegenerations Trainium, og når det bruges i EC2 UltraClusters skal det levere op til 65 eksaflops af aggregeret beregning. Det betyder, at kunderne vil være i stand til at træne en 300 milliarder parameter LLM på uger versus måneder. Trainium2s ydeevne, skala og energieffektivitet er nogle af grundene til, at Anthropic har valgt at træne sine modeller på AWS, og vil bruge Trainium2 til sine fremtidige modeller. Og vi samarbejder med Anthropic om fortsat innovation med både Trainium og Inferentia. Vi forventer, at vores første Trainium2-instanser er tilgængelige for kunderne i 2024.

Vi har også fordoblet softwareværktøjskæden for vores ML-silicium, specifikt ved at fremme AWS Neuron, softwareudviklingssættet (SDK), der hjælper kunder med at få den maksimale ydeevne fra Trainium og Inferentia. Siden vi introducerede Neuron i 2019 har vi foretaget betydelige investeringer i compiler- og rammeteknologier, og i dag understøtter Neuron mange af de mest populære offentligt tilgængelige modeller, herunder Llama 2 fra Meta, MPT fra Databricks og Stable Diffusion fra Stability AI, samt 93 af de 100 bedste modeller på det populære modellager Hugging Face. Neuron tilsluttes populære ML-frameworks som PyTorch og TensorFlow, og support til JAX kommer tidligt næste år. Kunder fortæller os, at Neuron har gjort det nemt for dem at skifte deres eksisterende modeltrænings- og inferenspipelines til Trainium og Inferentia med blot nogle få linjer kode.

Ingen andre tilbyder den samme kombination af valg af de bedste ML-chips, superhurtige netværk, virtualisering og hyperskala-klynger. Og så er det ikke overraskende, at nogle af de mest kendte generative AI-startups som AI21 Labs, Anthropic, Hugging Face, Perplexity AI, Runway og Stability AI kører på AWS. Men du har stadig brug for de rigtige værktøjer til effektivt at udnytte denne beregning til at bygge, træne og køre LLM'er og andre FM'er effektivt og omkostningseffektivt. Og for mange af disse startups, Amazon SageMaker er svaret. Uanset om man bygger og træner en ny, proprietær model fra bunden eller starter med en af de mange populære offentligt tilgængelige modeller, er træning en kompleks og dyr opgave. Det er heller ikke nemt at køre disse modeller omkostningseffektivt. Kunderne skal anskaffe store mængder data og forberede dem. Dette involverer typisk en masse manuelt arbejde med at rense data, fjerne dubletter, berige og transformere dem. Derefter skal de oprette og vedligeholde store klynger af GPU'er/acceleratorer, skrive kode for effektivt at fordele modeltræning på tværs af klynger, hyppigt checkpointe, pause, inspicere og optimere modellen og manuelt gribe ind og afhjælpe hardwareproblemer i klyngen. Mange af disse udfordringer er ikke nye, de er nogle af grundene til, at vi lancerede SageMaker for seks år siden – for at nedbryde de mange barrierer, der er involveret i modeltræning og -implementering og give udviklere en meget nemmere måde. Titusindvis af kunder bruger Amazon SageMaker, og et stigende antal af dem som LG AI Research, Perplexity AI, AI21, Hugging Face og Stability AI træner LLM'er og andre FM'er på SageMaker. For nylig har Technology Innovation Institute (skaberne af de populære Falcon LLM'er) trænet den største offentligt tilgængelige model - Falcon 180B - på SageMaker. Efterhånden som modelstørrelser og kompleksitet er vokset, er SageMakers omfang også vokset.

I årenes løb har vi tilføjet mere end 380 spilskiftende funktioner og muligheder til Amazon SageMaker såsom automatisk modeljustering, distribueret træning, fleksible modelimplementeringsmuligheder, værktøjer til ML OP'er, værktøjer til dataforberedelse, feature stores, notebooks, problemfri integration med human-in-the-loop-evalueringer på tværs af ML-livscyklussen og indbyggede funktioner til ansvarlig AI. Vi bliver ved med at innovere hurtigt for at sikre, at SageMaker-kunder er i stand til at blive ved med at bygge, træne og køre konklusioner for alle modeller – inklusive LLM'er og andre FM'er. Og vi gør det endnu nemmere og mere omkostningseffektivt for kunderne at træne og implementere store modeller med to nye muligheder. For det første for at forenkle træningen indføre Amazon SageMaker HyperPod som automatiserer flere af de processer, der kræves til højskala fejltolerant distribueret træning (f.eks. konfiguration af distribuerede træningsbiblioteker, skalering af træningsarbejdsbelastninger på tværs af tusindvis af acceleratorer, detektering og reparation af defekte instanser), fremskynde træningen med så meget som 40 %. Som et resultat bruger kunder som Perplexity AI, Hugging Face, Stability, Hippocratic, Alkaid og andre SageMaker HyperPod til at bygge, træne eller udvikle modeller. Anden, vi introducerer nye muligheder for at gøre inferens mere omkostningseffektiv og samtidig reducere latens. SageMaker hjælper nu kunder med at implementere flere modeller til den samme instans, så de kan dele computerressourcer – hvilket reducerer slutningsomkostningerne med 50 % (i gennemsnit). SageMaker overvåger også aktivt instanser, der behandler slutningsanmodninger, og dirigerer anmodninger intelligent baseret på hvilke instanser der er tilgængelige – og opnår 20 % lavere slutningsforsinkelse (i gennemsnit). Conjecture, Salesforce og Slack bruger allerede SageMaker til hosting af modeller på grund af disse slutningsoptimeringer.

Mellemlag af stakken: Amazon Bedrock tilføjer nye modeller, og en bølge af nye muligheder gør det endnu nemmere for kunderne sikkert at bygge og skalere generative AI-applikationer

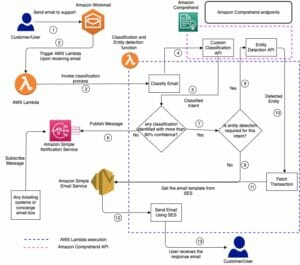

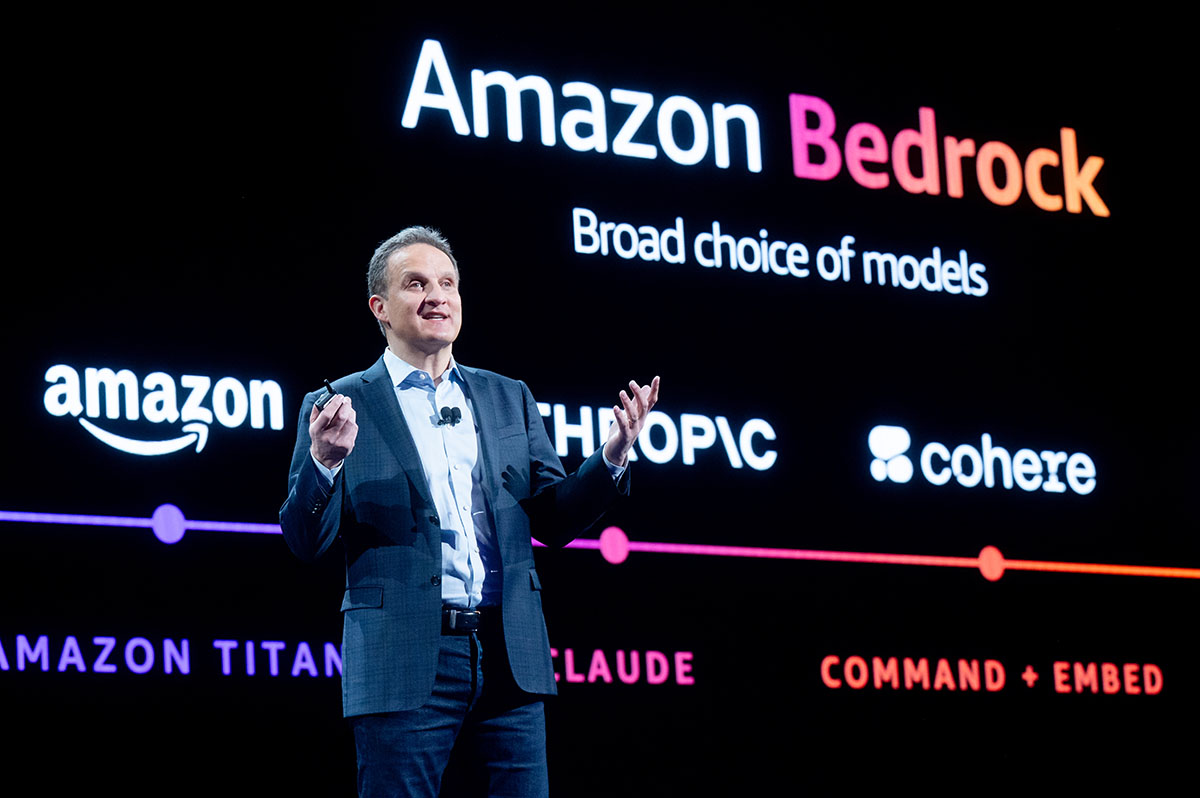

Mens en række kunder vil bygge deres egne LLM'er og andre FM'er eller udvikle et hvilket som helst antal af de offentligt tilgængelige muligheder, vil mange ikke ønske at bruge ressourcerne og tiden til at gøre dette. For dem tilbyder det mellemste lag af stakken disse modeller som en service. Vores løsning her, Amazonas grundfjeld, giver kunderne mulighed for at vælge mellem brancheførende modeller fra Anthropic, Stability AI, Meta, Cohere, AI21 og Amazon, tilpasse dem med deres egne data og udnytte alle de samme førende sikkerhed, adgangskontroller og funktioner, som de er vant til i AWS – alt sammen gennem en administreret tjeneste. Vi gjorde Amazon Bedrock generelt tilgængelig i slutningen af september, og kundernes respons har været overvældende positiv. Kunder fra hele verden og på tværs af stort set alle brancher er begejstrede for at bruge Amazon Bedrock. adidas gør det muligt for udviklere at få hurtige svar på alt fra "kom godt i gang"-information til dybere tekniske spørgsmål. Booking.com har til hensigt at bruge generativ kunstig intelligens til at skrive skræddersyede rejseanbefalinger til hver kunde. Bridgewater Associates udvikler en LLM-drevet investeringsanalytikerassistent til at hjælpe med at generere diagrammer, beregne finansielle indikatorer og opsummere resultater. Carrier gør mere præcise energianalyser og indsigter tilgængelige for kunderne, så de reducerer energiforbruget og reducerer kulstofemissionerne. Clariant styrker sine teammedlemmer med en intern generativ AI-chatbot til at accelerere R&D-processer, støtte salgsteams med mødeforberedelse og automatisere kunde-e-mails. GoDaddy hjælper kunder med nemt at oprette deres forretninger online ved at bruge generativ kunstig intelligens til at bygge deres websteder, finde leverandører, oprette forbindelse til kunder og meget mere. Lexis Nexis Legal & Professional transformerer juridisk arbejde for advokater og øger deres produktivitet med Lexis+ AI-samtalesøgning, opsummering og dokumentudformning og -analyse. Nasdaq hjælper med at automatisere efterforskningsarbejdsgange om mistænkelige transaktioner og styrke deres anti-finansiel kriminalitet og overvågningskapacitet. Alle disse – og mange flere – forskellige generative AI-applikationer kører på AWS.

Vi er spændte på momentum for Amazon Bedrock, men det er stadig tidlige dage. Det, vi har set, mens vi har arbejdet med kunder, er, at alle bevæger sig hurtigt, men udviklingen af generativ AI fortsætter i et hurtigt tempo med nye muligheder og innovationer, der sker praktisk talt dagligt. Kunder finder ud af, at der er forskellige modeller, der fungerer bedre til forskellige anvendelsestilfælde eller på forskellige datasæt. Nogle modeller er gode til at opsummere, andre er gode til ræsonnement og integration, og atter andre har virkelig fantastisk sprogunderstøttelse. Og så er der billedgenerering, søgeanvendelse og mere – alt sammen fra både proprietære modeller og fra modeller, der er offentligt tilgængelige for alle. Og i tider, hvor der er så meget, der er uvidende, er evnen til at tilpasse sig uden tvivl det mest værdifulde værktøj af alle. Der vil ikke være én model til at styre dem alle. Og bestemt ikke kun én teknologivirksomhed, der leverer de modeller, som alle bruger. Kunder skal prøve forskellige modeller. De skal kunne skifte mellem dem eller kombinere dem inden for samme use case. Det betyder, at de har brug for et reelt valg af modeludbydere (hvilket begivenhederne i de seneste 10 dage har gjort endnu mere tydelige). Det er grunden til, at vi opfandt Amazon Bedrock, hvorfor det giver så dyb genklang hos kunderne, og hvorfor vi fortsætter med at innovere og gentage hurtigt for at gøre bygning med (og flytte mellem) en række modeller lige så let som et API-kald, med de nyeste teknikker til modeltilpasning i hænderne på alle udviklere, og hold kunderne sikre og deres data private. Vi er glade for at introducere flere nye funktioner, der vil gøre det endnu nemmere for kunderne at bygge og skalere generative AI-applikationer:

- Udvider modelvalget med Anthropic Claude 2.1, Meta Llama 2 70B og tilføjelser til Amazon Titan-familien. I disse tidlige dage lærer og eksperimenterer kunderne stadig med forskellige modeller for at bestemme, hvilke de vil bruge til forskellige formål. De ønsker nemt at kunne prøve de nyeste modeller og også teste for at se, hvilke egenskaber og funktioner der vil give dem de bedste resultater og omkostningsegenskaber for deres anvendelsestilfælde. Med Amazon Bedrock er kunderne kun et API-kald væk fra en ny model. Nogle af de mest imponerende resultater, kunder har oplevet de sidste par måneder, er fra LLM'er som Anthropics Claude-model, som udmærker sig til en bred vifte af opgaver fra sofistikeret dialog og indholdsgenerering til komplekse ræsonnementer og samtidig opretholde en høj grad af pålidelighed og forudsigelighed. Kunder rapporterer, at Claude er meget mindre tilbøjelig til at producere skadelige output, lettere at tale med og mere styrbar sammenlignet med andre FM'er, så udviklere kan få deres ønskede output med mindre indsats. Anthropics avancerede model, Claude 2, scorer over 90. percentilen på GRE læse- og skriveeksamener og tilsvarende på kvantitativt ræsonnement. Og nu er den nyligt udgivne Claude 2.1-model tilgængelig i Amazon Bedrock. Claude 2.1 leverer nøglefunktioner til virksomheder, såsom et brancheførende 200 token-kontekstvindue (2x konteksten af Claude 2.0), reducerede hallucinationsfrekvenser og betydelige forbedringer i nøjagtigheden, selv ved meget lange kontekstlængder. Claude 2.1 indeholder også forbedrede systemprompter – som er modelinstruktioner, der giver en bedre oplevelse for slutbrugere – samtidig med at omkostningerne ved prompter og fuldførelser reduceres med 25 %.

For et stigende antal kunder, der ønsker at bruge en administreret version af Metas offentligt tilgængelige Llama 2-model, tilbyder Amazon Bedrock Llama 2 13B og vi tilføjer Llama 2 70B. Llama 2 70B er velegnet til store opgaver som sprogmodellering, tekstgenerering og dialogsystemer. De offentligt tilgængelige Llama-modeller er blevet downloadet mere end 30 millioner gange, og kunderne elsker, at Amazon Bedrock tilbyder dem som en del af en administreret service, hvor de ikke behøver at bekymre sig om infrastruktur eller have dyb ML-ekspertise på deres teams. Til billedgenerering tilbyder Stability AI desuden en række populære tekst-til-billede-modeller. Stable Diffusion XL 1.0 (SDXL 1.0) er den mest avancerede af disse, og den er nu generelt tilgængelig i Amazon Bedrock. Den seneste udgave af denne populære billedmodel har øget nøjagtighed, bedre fotorealisme og højere opløsning.

Kunderne bruger også Amazon Titan modeller, som er skabt og fortrænet af AWS til at tilbyde kraftfulde egenskaber med stor økonomi til en række forskellige anvendelsestilfælde. Amazon har en 25-årig track record inden for ML og AI – teknologi, vi bruger på tværs af vores virksomheder – og vi har lært meget om at bygge og implementere modeller. Vi har nøje valgt, hvordan vi træner vores modeller og de data, vi bruger til at gøre det. Vi holder kunder skadesløs mod påstande om, at vores modeller eller deres output krænker nogens ophavsret. Vi introducerede vores første Titan-modeller i april i år. Titan Text Lite- nu generelt tilgængelig-er en kortfattet, omkostningseffektiv model til brugssager som chatbots, tekstresumé eller copywriting, og den er også overbevisende at finjustere. Titan Text Express – også nu generelt tilgængelig— er mere ekspansiv og kan bruges til en bredere vifte af tekstbaserede opgaver, såsom åben tekstgenerering og samtalechat. Vi tilbyder disse tekstmodelmuligheder for at give kunderne mulighed for at optimere for nøjagtighed, ydeevne og omkostninger afhængigt af deres anvendelsessituation og forretningskrav. Kunder som Nexxiot, PGA Tour og Ryanair bruger vores to Titan Text-modeller. Vi har også en indlejringsmodel, Titan Text Embeddings, til søgninger og personalisering. Kunder som Nasdaq ser fantastiske resultater ved at bruge Titan Text Embeddings til at forbedre mulighederne for Nasdaq IR Insight til at generere indsigt fra 9,000+ globale virksomheders dokumenter til bæredygtigheds-, juridiske og regnskabshold. Og vi vil fortsætte med at tilføje flere modeller til Titan-familien med tiden. Vi introducerer en ny indlejringsmodel, Titan Multimodal Embeddings, for at drive multimodale søge- og anbefalingsoplevelser for brugere, der bruger billeder og tekst (eller en kombination af begge) som input. Og det er vi introducerer en ny tekst-til-billede-model, Amazon Titan Image Generator. Med Titan Image Generator kan kunder på tværs af brancher som annoncering, e-handel og medier og underholdning bruge et tekstinput til at generere realistiske billeder i studiekvalitet i store mængder og til lave omkostninger. Vi er spændte på, hvordan kunderne reagerer på Titan Models, og du kan forvente, at vi vil fortsætte med at innovere her.

- Nye muligheder for at tilpasse din generative AI-applikation sikkert med dine proprietære data: En af de vigtigste egenskaber ved Amazon Bedrock er, hvor nemt det er at tilpasse en model. Dette bliver virkelig spændende for kunderne, fordi det er her, generativ AI møder deres kerne differentiator – deres data. Det er dog rigtig vigtigt, at deres data forbliver sikre, at de har kontrol over det undervejs, og at modelforbedringer er private for dem. Der er et par måder, du kan gøre dette på, og Amazon Bedrock tilbyder det bredeste udvalg af tilpasningsmuligheder på tværs af flere modeller). Den første er finjustering. Det er nemt at finjustere en model i Amazon Bedrock. Du vælger blot modellen og Amazon Bedrock laver en kopi af den. Derefter peger du på et par mærkede eksempler (f.eks. en række gode spørgsmål-svar-par), som du gemmer i Amazon Simple Storage Service (Amazon S3), og Amazon Bedrock "træner trinvist" (forøger den kopierede model med de nye oplysninger) på disse eksempler, og resultatet er en privat, mere præcis finjusteret model, der leverer mere relevante, tilpassede svar. Vi er glade for at kunne meddele, at finjustering generelt er tilgængelig for Cohere Command, Meta Llama 2, Amazon Titan Text (Lite og Express), Amazon Titan Multimodal Embeddings og i preview til Amazon Titan Image Generator. Og gennem vores samarbejde med Anthropic vil vi snart give AWS-kunder tidlig adgang til unikke funktioner til modeltilpasning og finjustering af dens avancerede model Claude.

En anden teknik til at tilpasse LLM'er og andre FM'er til din virksomhed er retrieval augmented generation (RAG), som giver dig mulighed for at tilpasse en models svar ved at udvide dine prompter med data fra flere kilder, herunder dokumentlagre, databaser og API'er. I september introducerede vi en RAG-funktion, Knowledge Bases for Amazon Bedrock, der sikkert forbinder modeller til dine proprietære datakilder for at supplere dine prompter med flere oplysninger, så dine applikationer leverer mere relevante, kontekstuelle og præcise svar. Vidensbaser er nu generelt tilgængelig med en API, der udfører hele RAG-workflowet fra at hente tekst, der er nødvendig for at forstærke en prompt, til at sende prompten til modellen, til at returnere svaret. Knowledge Bases understøtter databaser med vektorfunktioner, der gemmer numeriske repræsentationer af dine data (indlejringer), som modeller bruger til at få adgang til disse data for RAG, inklusive Amazon OpenSearch Service og andre populære databaser som Pinecone og Redis Enterprise Cloud (Amazon Aurora og MongoDB vektorunderstøttelse kommer snart).

Den tredje måde, du kan tilpasse modeller i Amazon Bedrock, er med fortsat fortræning. Med denne metode bygger modellen på sin oprindelige fortræning til generel sprogforståelse for at lære domænespecifikt sprog og terminologi. Denne tilgang er for kunder, der har store mængder af umærkede, domænespecifikke oplysninger og ønsker at gøre deres LLM'er i stand til at forstå sproget, sætninger, forkortelser, begreber, definitioner og jargon, der er unikke for deres verden (og forretning). I modsætning til finjustering, som kræver en ret lille mængde data, udføres fortsat fortræning på store datasæt (f.eks. tusindvis af tekstdokumenter). Nu er præ-træningsfunktioner tilgængelige i Amazon Bedrock til Titan Text Lite og Titan Text Express.

- Generel tilgængelighed af Agenter for Amazon Bedrock at hjælpe med at udføre flertrinsopgaver ved hjælp af systemer, datakilder og virksomhedsviden. LLM'er er gode til at føre samtaler og generere indhold, men kunderne ønsker, at deres applikationer skal kunne do endnu mere – som at tage handlinger, løse problemer og interagere med en række systemer for at fuldføre opgaver i flere trin som at bestille rejser, indgive forsikringskrav eller bestille reservedele. Og Amazon Bedrock kan hjælpe med denne udfordring. Med agenter vælger udviklere en model, skriver nogle få grundlæggende instruktioner som "du er en glad kundeserviceagent" og "tjek produkttilgængelighed i lagersystemet", peg den valgte model til de rigtige datakilder og virksomhedssystemer (f.eks. CRM eller ERP-applikationer), og skriv et par AWS Lambda-funktioner for at udføre API'erne (f.eks. kontrollere tilgængeligheden af en vare i ERP-beholdningen). Amazon Bedrock analyserer automatisk anmodningen og opdeler den i en logisk sekvens ved hjælp af den valgte models ræsonnementevner til at bestemme, hvilke oplysninger der er nødvendige, hvilke API'er der skal kaldes, og hvornår de skal kaldes for at fuldføre et trin eller løse en opgave. Nu generelt tilgængelig, kan agenter planlægge og udføre de fleste forretningsopgaver – fra besvarelse af kundespørgsmål om dit produkttilgængelighed til at modtage deres ordrer – og udviklere behøver ikke at være fortrolige med maskinlæring, ingeniørprompter, træne modeller eller manuelt forbinde systemer. Og Bedrock gør alt dette sikkert og privat, og kunder som Druva og Athene bruger dem allerede til at forbedre nøjagtigheden og hastigheden af udviklingen af deres generative AI-applikationer.

- OPDAGE Autoværn til Amazon Bedrock så du kan anvende sikkerhedsforanstaltninger baseret på dine use case-krav og ansvarlige AI-politikker. Kunder vil være sikre på, at interaktioner med deres AI-applikationer er sikre, undgå giftigt eller stødende sprog, forblive relevant for deres virksomhed og tilpasse sig deres ansvarlige AI-politikker. Med autoværn kan kunderne specificere emner, der skal undgås, og Amazon Bedrock vil kun give brugerne godkendte svar på spørgsmål, der falder ind under disse begrænsede kategorier. For eksempel kan en netbankapplikation oprettes for at undgå at yde investeringsrådgivning og fjerne upassende indhold (såsom hadefulde ytringer og vold). I begyndelsen af 2024 vil kunder også være i stand til at redigere personlig identificerbar information (PII) i modelsvar. For eksempel, efter at en kunde interagerer med en callcenteragent, opsummeres kundeservicesamtalen ofte til registrering, og autoværn kan fjerne PII fra disse resuméer. Guardrails kan bruges på tværs af modeller i Amazon Bedrock (inklusive finjusterede modeller) og med Agents for Amazon Bedrock, så kunderne kan bringe et ensartet niveau af beskyttelse til alle deres generative AI-applikationer.

Det øverste lag af stakken: Fortsat innovation gør generativ kunstig intelligens tilgængelig for flere brugere

På det øverste lag af stakken er applikationer, der udnytter LLM'er og andre FM'er, så du kan drage fordel af generativ AI på arbejdet. Et område, hvor generativ AI allerede ændrer spillet, er kodning. Sidste år introducerede vi Amazon CodeWhisperer, som hjælper dig med at bygge applikationer hurtigere og mere sikkert ved at generere kodeforslag og anbefalinger i næsten realtid. Kunder som Accenture, Boeing, Bundesliga, The Cigna Group, Kone og Warner Music Group bruger CodeWhisperer til at øge udviklerproduktiviteten – og Accenture gør det muligt for op til 50,000 af deres softwareudviklere og it-professionelle med Amazon CodeWhisperer. Vi ønsker, at så mange udviklere som muligt skal kunne få produktivitetsfordelene ved generativ AI, hvorfor CodeWhisperer tilbyder anbefalinger gratis til alle enkeltpersoner.

Men mens AI-kodningsværktøjer gør meget for at gøre udvikleres liv lettere, er deres produktivitetsfordele begrænset af deres manglende viden om interne kodebaser, interne API'er, biblioteker, pakker og klasser. En måde at tænke over dette på er, at hvis du ansætter en ny udvikler, selvom de er i verdensklasse, vil de ikke være så produktive i din virksomhed, før de forstår din bedste praksis og kode. Nutidens AI-drevne kodningsværktøjer er som den nye udvikler. For at hjælpe med dette har vi for nylig forhåndsvist en ny tilpasningsevne i Amazon CodeWhisperer, der sikkert udnytter en kundes interne kodebase til at give mere relevante og nyttige kodeanbefalinger. Med denne evne er CodeWhisperer ekspert i din kode og giver anbefalinger, der er mere relevante for at spare endnu mere tid. I en undersøgelse, vi lavede med Persistent, en global digital ingeniør- og virksomhedsmoderniseringsvirksomhed, fandt vi ud af, at tilpasninger hjælper udviklere med at udføre opgaver op til 28 % hurtigere end med CodeWhisperers generelle muligheder. Nu kan en udvikler hos en sundhedsteknologivirksomhed bede CodeWhisperer om at "importere MRI-billeder forbundet med kunde-id'et og køre dem gennem billedklassificeringen" for at opdage uregelmæssigheder. Fordi CodeWhisperer har adgang til kodebasen, kan den give meget mere relevante forslag, der inkluderer importplaceringer af MRI-billeder og kunde-id'er. CodeWhisperer holder tilpasninger helt private, og den underliggende FM bruger dem ikke til træning, hvilket beskytter kundernes værdifulde intellektuelle ejendom. AWS er den eneste store cloud-udbyder, der tilbyder en funktion som denne til alle.

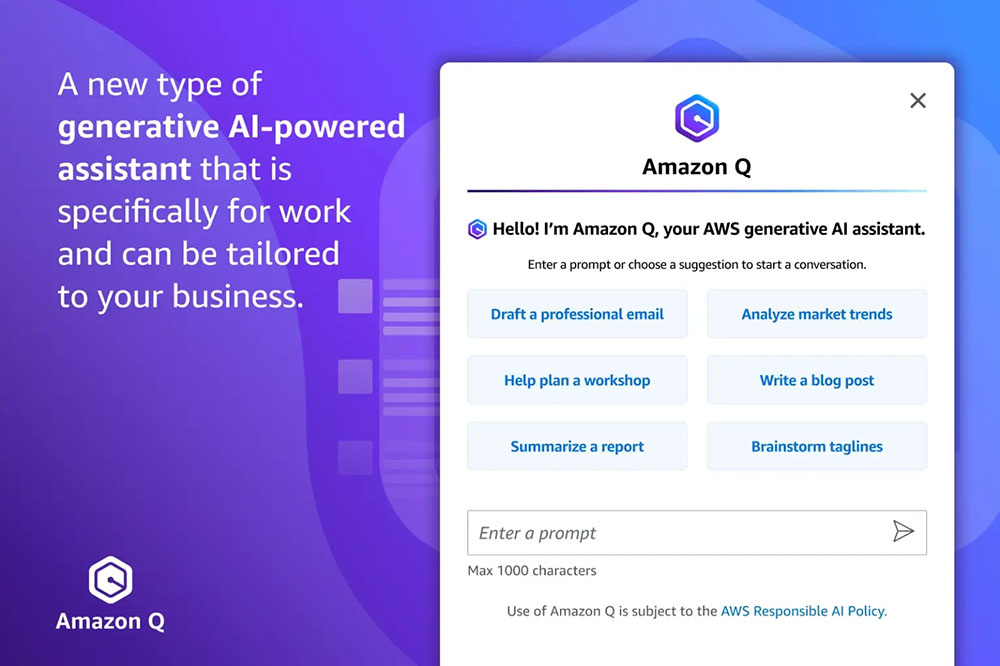

OPDAGE Amazon Q, den generative AI-drevne assistent, der er skræddersyet til arbejdet

Udviklere er bestemt ikke de eneste, der kommer i gang med generativ AI - millioner af mennesker bruger generative AI-chatapplikationer. Det, som tidlige udbydere har gjort på dette område, er spændende og super nyttigt for forbrugerne, men på mange måder "fungerer" de ikke helt på arbejdet. Deres generelle viden og kapacitet er stor, men de kender ikke din virksomhed, dine data, dine kunder, din drift eller din virksomhed. Det begrænser, hvor meget de kan hjælpe dig. De ved heller ikke meget om din rolle – hvilket arbejde du udfører, hvem du arbejder med, hvilke oplysninger du bruger, og hvad du har adgang til. Disse begrænsninger er forståelige, fordi disse assistenter ikke har adgang til din virksomheds private oplysninger, og de er ikke designet til at opfylde de databeskyttelses- og sikkerhedskrav, som virksomheder har brug for for at give dem denne adgang. Det er svært at sikre sikkerheden bagefter og forvente, at det fungerer godt. Vi tror, vi har en bedre måde, som vil give enhver person i enhver organisation mulighed for at bruge generativ AI sikkert i deres daglige arbejde.

We er glade for at introducere Amazon Q, en ny type generativ AI-drevet assistent, der er specifikt til arbejde og kan skræddersyes til din virksomhed. Q kan hjælpe dig med at få hurtige, relevante svar på presserende spørgsmål, løse problemer, generere indhold og foretage handlinger ved hjælp af de data og ekspertise, der findes i din virksomheds informationslagre, kode og virksomhedssystemer. Når du chatter med Amazon Q, giver det øjeblikkelig, relevant information og rådgivning for at hjælpe med at strømline opgaver, fremskynde beslutningstagning og hjælpe med at sætte gang i kreativitet og innovation på arbejdspladsen. Vi har bygget Amazon Q til at være sikker og privat, og den kan forstå og respektere dine eksisterende identiteter, roller og tilladelser og bruge disse oplysninger til at tilpasse sine interaktioner. Hvis en bruger ikke har tilladelse til at få adgang til bestemte data uden Q, kan de heller ikke få adgang til dem ved hjælp af Q. Vi har designet Amazon Q til at opfylde strenge virksomhedskunders krav fra dag ét – intet af deres indhold bruges til at forbedre de underliggende modeller.

Amazon Q er din ekspertassistent for at bygge på AWS: Vi har trænet Amazon Q i 17 års AWS-viden og erfaring, så det kan transformere den måde, du bygger, implementerer og betjener applikationer og arbejdsbelastninger på AWS. Amazon Q har en chatgrænseflade i AWS Management Console og dokumentation, din IDE (via CodeWhisperer) og dine teamchatrum på Slack eller andre chat-apps. Amazon Q kan hjælpe dig med at udforske nye AWS-funktioner, komme hurtigere i gang, lære ukendte teknologier, arkitektløsninger, fejlfinde, opgradere og meget mere – det er en ekspert i AWS veldesignede mønstre, bedste praksis, dokumentation og løsningsimplementeringer. Her er nogle eksempler på, hvad du kan gøre med din nye AWS-ekspertassistent:

- Få skarpe svar og vejledning om AWS-kapaciteter, tjenester og løsninger: Bed Amazon Q om at "fortælle mig om agenter for Amazon Bedrock", og Q vil give dig en beskrivelse af funktionen plus links til relevant materiale. Du kan også stille Amazon Q stort set alle spørgsmål om, hvordan en AWS-tjeneste fungerer (f.eks. "Hvad er skaleringsgrænserne på en DynamoDB-tabel?" "Hvad er Redshift Managed Storage?"), eller hvordan man bedst arkitekterer en række løsninger ( "Hvad er den bedste praksis for at bygge begivenhedsdrevne arkitekturer?"). Og Amazon Q vil samle kortfattede svar og altid citere (og linke til) dets kilder.

- Vælg den bedste AWS-tjeneste til din brugssag, og kom hurtigt i gang: Spørg Amazon Q "Hvad er måderne til at bygge en webapp på AWS? ” og det vil give en liste over potentielle tjenester som AWS Amplify, AWS Lambdaog Amazon EC2 med fordelene ved hver. Derfra kan du indsnævre mulighederne ved at hjælpe Q med at forstå dine krav, præferencer og begrænsninger (f.eks. "Hvilken af disse ville være bedst, hvis jeg vil bruge containere?" eller "Skal jeg bruge en relationel eller ikke-relationel database? ”). Afslut med "Hvordan kommer jeg i gang?" og Amazon Q vil skitsere nogle grundlæggende trin og pege dig mod yderligere ressourcer.

- Optimer dine computerressourcer: Amazon Q kan hjælpe dig med at vælge Amazon EC2-instanser. Hvis du beder den om at "Hjælp mig med at finde den rigtige EC2-instans til at implementere en videokodningsarbejdsbelastning til min gaming-app med den højeste ydeevne", vil Q give dig en liste over instansfamilier med årsager til hvert forslag. Og du kan stille et vilkårligt antal opfølgende spørgsmål for at hjælpe med at finde det bedste valg til din arbejdsbyrde.

- Få hjælp til at fejlfinde, teste og optimere din kode: Hvis du støder på en fejl under kodning i din IDE, kan du bede Amazon Q om at hjælpe ved at sige: "Min kode har en IO-fejl, kan du give en rettelse?" og Q genererer koden for dig. Hvis du kan lide forslaget, kan du bede Amazon Q om at tilføje rettelsen til din applikation. Da Amazon Q er i din IDE, forstår den den kode, du arbejder på, og ved, hvor den skal indsætte rettelsen. Amazon Q kan også oprette enhedstests ("Skriv enhedstests for den valgte funktion"), som den kan indsætte i din kode, og du kan køre. Endelig kan Amazon Q fortælle dig, hvordan du kan optimere din kode til højere ydeevne. Bed Q om at "optimere min valgte DynamoDB-forespørgsel", og den vil bruge sin forståelse af din kode til at give et naturligt sprogforslag til, hvad der skal rettes sammen med den medfølgende kode, du kan implementere med et enkelt klik.

- Diagnosticer og fejlfind problemer: Hvis du støder på problemer i AWS Management Console, såsom EC2-tilladelsesfejl eller Amazon S3-konfigurationsfejl, kan du blot trykke på knappen "Fejlfinding med Amazon Q", og den vil bruge sin forståelse af fejltypen og tjenesten, hvor fejlen er placeret for at give dig forslag til en løsning. Du kan endda bede Amazon Q om at fejlfinde dit netværk (f.eks. "Hvorfor kan jeg ikke oprette forbindelse til min EC2-instans ved hjælp af SSH?"), og Q vil analysere din ende-til-ende-konfiguration og stille en diagnose (f.eks. "Denne instans) ser ud til at være i et privat undernet, så offentlig tilgængelighed skal muligvis etableres").

- Ram op på en ny kodebase på ingen tid: Når du chatter med Amazon Q i din IDE, kombinerer den sin ekspertise i at bygge software med en forståelse af din kode – en kraftfuld parring! Tidligere, hvis du overtog et projekt fra en anden, eller du var ny på holdet, skulle du muligvis bruge timer på manuelt at gennemgå koden og dokumentationen for at forstå, hvordan det fungerer, og hvad det gør. Nu, da Amazon Q forstår koden i din IDE, kan du blot bede Amazon Q om at forklare koden ("Giv mig en beskrivelse af, hvad denne applikation gør, og hvordan den virker"), og Q vil give dig detaljer såsom hvilke tjenester kodebrug, og hvad forskellige funktioner gør (f.eks. kan Q svare med noget som "Denne applikation bygger et grundlæggende supportbilletsystem ved hjælp af Python Flask og AWS Lambda" og fortsætter med at beskrive hver af dens kerneegenskaber, hvordan de implementeres, og meget mere).

- Ryd dit funktionsefterslæb hurtigere: Du kan endda bede Amazon Q om at guide dig gennem og automatisere meget af ende-til-ende-processen med at tilføje en funktion til din applikation i Amazon CodeCatalyst, vores samlede softwareudviklingstjeneste for teams. For at gøre dette tildeler du bare Q en backlog-opgave fra din problemliste – ligesom du ville gøre en holdkammerat – og Q genererer en trin-for-trin plan for, hvordan den vil bygge og implementere funktionen. Når du har godkendt planen, vil Q skrive koden og præsentere de foreslåede ændringer for dig som en kodegennemgang. Du kan anmode om omarbejdelse (om nødvendigt), godkende og/eller implementere!

- Opgrader din kode på en brøkdel af tiden: De fleste udviklere bruger faktisk kun en brøkdel af deres tid på at skrive ny kode og bygge nye applikationer. De bruger meget mere af deres cyklusser på smertefulde, trælle områder som vedligeholdelse og opgraderinger. Tag sprogversionsopgraderinger. Et stort antal kunder fortsætter med at bruge ældre versioner af Java, fordi det vil tage måneder – endda år – og tusindvis af timers udviklertid at opgradere. At udskyde dette har reelle omkostninger og risici – du går glip af præstationsforbedringer og er sårbar over for sikkerhedsproblemer. Vi tror, at Amazon Q kan være en game changer her, og vi er begejstrede for Amazon Q-kode transformation, en funktion, som kan fjerne meget af dette tunge løft og reducere den tid, det tager at opgradere applikationer fra dage til minutter. Du åbner bare den kode, du vil opdatere i din IDE, og beder Amazon Q om at "/transformere" din kode. Amazon Q vil analysere hele kildekoden for applikationen, generere koden på målsproget og -versionen og udføre tests, der hjælper dig med at realisere sikkerheds- og ydeevneforbedringer af de seneste sprogversioner. For nylig brugte et meget lille team af Amazon-udviklere Amazon Q Code Transformation til at opgradere 1,000 produktionsapplikationer fra Java 8 til Java 17 på kun to dage. Den gennemsnitlige tid pr. påføring var mindre end 10 minutter. I dag udfører Amazon Q Code Transformation Java-sprogopgraderinger fra Java 8 eller Java 11 til Java 17. Det næste (og snart) er muligheden for at transformere .NET Framework til cross-platform .NET (med endnu flere transformationer at følge i fremtiden) .

Amazon Q er din virksomhedsekspert: Du kan forbinde Amazon Q til dine virksomhedsdata, informationer og systemer, så det kan syntetisere alt og give skræddersyet assistance til at hjælpe folk med at løse problemer, generere indhold og foretage handlinger, der er relevante for din virksomhed. Det er nemt at bringe Amazon Q til din virksomhed. Den har 40+ indbyggede stik til populære virksomhedssystemer som Amazon S3, Microsoft 365, Salesforce, ServiceNow, Slack, Atlassian, Gmail, Google Drive og Zendesk. Den kan også oprette forbindelse til dit interne intranet, wikier og kørebøger, og med Amazon Q SDK kan du oprette forbindelse til den interne applikation, du ønsker. Ret Amazon Q mod disse lagre, og det vil "rampe op" på din virksomhed, fange og forstå den semantiske information, der gør din virksomhed unik. Så får du din egen venlige og enkle Amazon Q-webapplikation, så medarbejdere på tværs af din virksomhed kan interagere med samtalegrænsefladen. Amazon Q opretter også forbindelse til din identitetsudbyder for at forstå en bruger, deres rolle og hvilke systemer de har tilladelse til at få adgang til, så brugerne kan stille detaljerede, nuancerede spørgsmål og få skræddersyede resultater, der kun omfatter information, som de har tilladelse til at se. Amazon Q genererer svar og indsigt, der er nøjagtige og trofaste i forhold til det materiale og den viden, du giver det, og du kan begrænse følsomme emner, blokere nøgleord eller bortfiltrere upassende spørgsmål og svar. Her er et par eksempler på, hvad du kan gøre med din virksomheds nye ekspertassistent:

- Få skarpe, superrelevante svar baseret på dine virksomhedsdata og oplysninger: Medarbejdere kan spørge Amazon Q om alt, hvad de tidligere måtte have søgt rundt efter på tværs af alle slags kilder. Spørg "Hvad er de seneste retningslinjer for logobrug?", eller "Hvordan ansøger jeg om et firmakreditkort?", og Amazon Q vil syntetisere alt det relevante indhold, den finder, og vende tilbage med hurtige svar plus links til det relevante kilder (f.eks. brandportaler og logoopbevaring, virksomhedens T&E-politikker og kortapplikationer).

- Strømlin den daglige kommunikation: Bare spørg, og Amazon Q kan generere indhold ("Opret et blogindlæg og tre overskrifter på sociale medier, der annoncerer produktet beskrevet i denne dokumentation"), oprette resuméer ("Skriv et resumé af vores mødeudskrift med en punktliste over handlingspunkter" ), give e-mail-opdateringer ("Udarbejdelse af en e-mail, der fremhæver vores Q3-træningsprogrammer for kunder i Indien") og hjælp til at strukturere møder ("Opret en mødedagsorden for at tale om den seneste kundetilfredshedsrapport").

- Udfør opgaver: Amazon Q kan hjælpe med at fuldføre visse opgaver, hvilket reducerer den tid, medarbejderne bruger på gentagne arbejde som at indgive billetter. Bed Amazon Q om at "Opsummere kundefeedback om det nye pristilbud i Slack", og anmod derefter Q om at tage disse oplysninger og åbne en billet i Jira for at opdatere marketingteamet. Du kan bede Q om at "Opsummere denne opkaldsudskrift" og derefter "Åbn en ny sag for kunde A i Salesforce." Amazon Q understøtter andre populære arbejdsautomatiseringsværktøjer som Zendesk og Service Now.

Amazon Q er i Amazon QuickSight: Med Amazon Q i QuickSight, AWS's business intelligence-tjeneste, kan brugere stille spørgsmål til deres dashboards som "Hvorfor steg antallet af ordrer i sidste måned?" og få visualiseringer og forklaringer på de faktorer, der har påvirket stigningen. Og analytikere kan bruge Amazon Q til at reducere den tid, det tager dem at bygge dashboards fra dage til minutter med en simpel prompt som "Vis mig salg efter region for måned som et stablet søjlediagram." Q kommer lige tilbage med det diagram, og du kan nemt tilføje det til et dashboard eller chatte yderligere med Q for at forfine visualiseringen (f.eks. "Skift søjlediagrammet til et Sankey-diagram" eller "Vis lande i stedet for regioner"). Amazon Q i QuickSight gør det også nemmere at bruge eksisterende dashboards til at informere forretningsinteressenter, destillere nøgleindsigter og forenkle beslutningstagning ved hjælp af datahistorier. For eksempel kan brugere bede Amazon Q om at "byg en historie om, hvordan virksomheden har ændret sig i løbet af den sidste måned til en virksomhedsgennemgang med ledende ledelse", og på få sekunder leverer Amazon Q en datadrevet historie, der er visuelt overbevisende og er helt tilpasselig. Disse historier kan deles sikkert i hele organisationen for at hjælpe med at tilpasse interessenter og føre bedre beslutninger.

Amazon Q er i Amazon Connect: I Amazon Connect, vores kontaktcentertjeneste, hjælper Amazon Q dine kundeservicemedarbejdere med at give bedre kundeservice. Amazon Q udnytter de videnslagre, dine agenter typisk bruger til at få information til kunderne, og derefter kan agenter chatte med Amazon Q direkte i Connect for at få svar, der hjælper dem med at reagere hurtigere på kundeforespørgsler uden selv at skulle søge i dokumentationen. Og selvom det er fantastisk at chatte med Amazon Q for at få superhurtige svar, er der ikke noget, der hedder for hurtigt i kundeservice. Derfor Amazon Q i forbindelse forvandler en live kundesamtale med en agent til en prompt og giver automatisk agenten mulige svar, foreslåede handlinger og links til ressourcer. Amazon Q kan f.eks. registrere, at en kunde kontakter et biludlejningsfirma for at ændre deres reservation, generere et svar til agenten for hurtigt at kommunikere, hvordan virksomhedens ændringsgebyrpolitikker gælder, og guide agenten gennem de trin, de skal bruge for at opdatere reservation.

Amazon Q er i AWS Supply Chain (kommer snart): I AWS Supply Chain, vores forsyningskædeindsigtstjeneste, hjælper Amazon Q udbuds- og efterspørgselsplanlæggere, lagerforvaltere og handelspartnere med at optimere deres forsyningskæde ved at opsummere og fremhæve potentielle lager- eller overlagerrisici og visualisere scenarier for at løse problemet. Brugere kan stille Amazon Q "hvad", "hvorfor" og "hvad nu hvis"-spørgsmål om deres forsyningskædedata og chatte gennem komplekse scenarier og afvejningen mellem forskellige forsyningskædebeslutninger. For eksempel kan en kunde spørge: "Hvad forårsager forsinkelsen i mine forsendelser, og hvordan kan jeg fremskynde tingene?" hvortil Amazon Q kan svare, "90 % af dine ordrer er på østkysten, og en stor storm i sydøst forårsager en 24-timers forsinkelse. Hvis du sender til havnen i New York i stedet for Miami, vil du fremskynde leveringer og reducere omkostningerne med 50 %."

Vores kunder adopterer generativ AI hurtigt – de træner banebrydende modeller på AWS, de udvikler generative AI-applikationer med rekordhastighed ved hjælp af Amazon Bedrock, og de implementerer spilskiftende applikationer på tværs af deres organisationer som Amazon Q. Med vores seneste meddelelser, AWS bringer kunderne endnu mere ydeevne, valgmuligheder og innovation til hvert lag af stakken. Den kombinerede effekt af alle de funktioner, vi leverer hos re:Invent, markerer en stor milepæl i retning af at nå et spændende og meningsfuldt mål: Vi gør generativ AI tilgængelig for kunder af alle størrelser og tekniske evner, så de kan genopfinde og transformere det er muligt.

Ressourcer

Om forfatteren

Swami Sivasubramanian er Vice President for Data and Machine Learning hos AWS. I denne rolle overvåger Swami alle AWS-databaser, analyse- og AI- og maskinlæringstjenester. Hans teams mission er at hjælpe organisationer med at få deres data til at fungere med en komplet, end-to-end dataløsning til at gemme, få adgang til, analysere og visualisere og forudsige.

Swami Sivasubramanian er Vice President for Data and Machine Learning hos AWS. I denne rolle overvåger Swami alle AWS-databaser, analyse- og AI- og maskinlæringstjenester. Hans teams mission er at hjælpe organisationer med at få deres data til at fungere med en komplet, end-to-end dataløsning til at gemme, få adgang til, analysere og visualisere og forudsige.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/welcome-to-a-new-era-of-building-in-the-cloud-with-generative-ai-on-aws/

- :har

- :er

- :ikke

- :hvor

- $OP

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 35 %

- 40

- 50

- 500

- 7

- 8

- 9

- a

- evner

- evne

- I stand

- Om

- over

- fremskynde

- accelereret

- acceleratorer

- Accenture

- adgang

- tilgængelighed

- tilgængelig

- Bogføring og administration

- nøjagtighed

- præcis

- erhverve

- tværs

- Handling

- aktioner

- aktivt

- faktisk

- tilpasse

- tilføje

- tilføjet

- tilføje

- Desuden

- Yderligere

- Derudover

- tilføjelser

- Tilføjer

- Adidas

- Adobe

- Vedtagelsen

- fremskreden

- fremrykkende

- Fordel

- fordele

- Reklame

- rådgivning

- Efter

- mod

- dagsorden

- Agent

- midler

- aggregat

- siden

- AI

- AI og maskinindlæring

- AI chatbot

- ai forskning

- AI-drevne

- tilpasse

- Alle

- tillade

- tillader

- sammen

- allerede

- også

- altid

- Amazon

- Amazon Code Whisperer

- Amazon EC2

- Amazon OpenSearch Service

- Amazon QuickSight

- Amazon SageMaker

- Amazon Web Services

- beløb

- beløb

- an

- analyse

- analytiker

- Analytikere

- analytics

- analysere

- analyser

- ,

- Annoncere

- Meddelelser

- Annoncerer

- abnormaliteter

- besvare

- svar

- Antropisk

- enhver

- nogen

- noget

- api

- API'er

- app

- kommer til syne

- Anvendelse

- applikationer

- Indløs

- værdsætter

- tilgang

- Godkend

- godkendt

- apps

- april

- ER

- OMRÅDE

- områder

- velsagtens

- omkring

- AS

- spørg

- Assistance

- Assistant

- assistenter

- forbundet

- associerede

- At

- forøge

- augmented

- tilføjelserne

- Aurora

- autoriseret

- automatisere

- automater

- Automatisk Ur

- automatisk

- Automation

- automotive

- tilgængelighed

- til rådighed

- gennemsnit

- undgå

- væk

- AWS

- AWS-inferens

- AWS Lambda

- AWS Management Console

- tilbage

- Bank

- Bar

- barrierer

- bund

- baseret

- grundlæggende

- BE

- fordi

- bliver

- været

- begyndte

- Tro

- fordele

- BEDSTE

- bedste praksis

- Bedre

- mellem

- Big

- Billion

- milliarder

- Bloker

- Blocks

- Blog

- Boeing

- Bolt

- booking

- Booking.com

- Bøger

- både

- Bund

- grænser

- brand

- Pause

- pauser

- bringe

- Bringe

- bygge

- Bygning

- bygger

- bygget

- indbygget

- virksomhed

- business intelligence

- virksomheder

- men

- .

- by

- ringe

- call center

- CAN

- Kan få

- kapaciteter

- kapacitet

- stand

- Kapacitet

- Optagelse

- bil

- kulstof

- kulstofemissioner

- kort

- omhyggeligt

- tilfælde

- tilfælde

- kategorier

- forårsager

- center

- vis

- sikkert

- kæde

- udfordre

- udfordringer

- lave om

- ændret

- Changer

- Ændringer

- skiftende

- karakteristika

- Chart

- Diagrammer

- chatrum

- chatbot

- chatbots

- chatter

- kontrollere

- chip

- Chips

- valg

- Vælg

- vælge

- valgt

- fordringer

- klasser

- Rengøring

- klar

- klik

- Cloud

- sky infrastruktur

- Cluster

- klyngedannelse

- Coast

- kode

- kodebase

- Kode anmeldelse

- Kodning

- samarbejde

- samarbejde

- KOM

- kombination

- kombinerer

- kombineret

- kombinerer

- Kom

- kommer

- kommer

- Coming Soon

- kommunikere

- Kommunikation

- Virksomheder

- selskab

- Selskabs

- sammenlignet

- overbevisende

- fuldføre

- fuldstændig

- komplekse

- kompleksitet

- omfattende

- Compute

- begreber

- Konfiguration

- konfigurering

- formodning

- Tilslut

- tilsluttet

- tilslutning

- Connectivity

- forbinder

- konsekvent

- Konsol

- begrænsninger

- Forbrugere

- forbrug

- kontakt

- kontaktcenter

- Beholdere

- indhold

- Indholdsgenerering

- sammenhæng

- kontekstuelle

- fortsæt

- fortsatte

- fortsætter

- fortsættende

- kontrol

- kontrol

- Samtale

- konversation

- samtaler

- ophavsret

- tekstforfatning

- Core

- Koste

- omkostningseffektiv

- Omkostninger

- lande

- Cox

- skabe

- oprettet

- kreativitet

- skabere

- kredit

- kreditkort

- Kriminalitet

- CRM

- kunde

- Kundeoplevelse

- Kundetilfredshed

- Kundeservice

- Kunder

- tilpasses

- tilpasning

- tilpasse

- tilpassede

- Klip

- cykler

- dagligt

- instrumentbræt

- dashboards

- data

- Dataforberedelse

- databeskyttelse

- Databeskyttelse og sikkerhed

- datasæt

- datastyret

- Database

- databaser

- dag

- dag til dag

- Dage

- Beslutningstagning

- afgørelser

- dyb

- dyb læring

- dybere

- definitioner

- Degree

- forsinkelse

- levere

- Leverancer

- leverer

- leverer

- Efterspørgsel

- demokratisering

- Afhængigt

- indsætte

- indsat

- implementering

- implementering

- dybde

- beskrive

- beskrevet

- beskrivelse

- konstrueret

- ønskes

- detaljeret

- detaljer

- opdage

- Bestem

- DEUTSCHE TELECOM

- Udvikler

- udviklere

- udvikling

- Udvikling

- diagnose

- dialog

- Dialog

- DID

- forskellige

- Broadcasting

- digital

- direkte

- distribuere

- distribueret

- distribueret træning

- distribution

- do

- dokumentet

- dokumentation

- dokumenter

- gør

- Er ikke

- gør

- færdig

- Dont

- fordobling

- ned

- køre

- grund

- dubletter

- varighed

- e

- e-handel

- hver

- Tidligt

- lettere

- nemt

- Øst

- let

- Økonomi

- udgave

- effektivt

- effektivitet

- effektivt

- indsats

- enten

- andet

- emails

- Emissioner

- medarbejdere

- bemyndige

- bemyndigelse

- muliggøre

- muliggør

- kodning

- ende

- ende til ende

- energi

- Energiforbrug

- ingeniør

- Engineering

- forbedre

- forbedringer

- berigende

- Enterprise

- enterprise-grade

- virksomheder

- Underholdning

- Hele

- kuvert

- Era

- ERP

- fejl

- fejl

- evalueringer

- Endog

- begivenheder

- NOGENSINDE

- Hver

- alle

- at alt

- evolution

- udvikle sig

- eksempel

- eksempler

- ophidset

- spændende

- udføre

- udøvende

- eksisterende

- ekspansiv

- forvente

- fremskynde

- dyrt

- erfaring

- erfarne

- Oplevelser

- ekspert

- ekspertise

- Forklar

- udforske

- Express

- stof

- Ansigtet

- Faktisk

- faktorer

- retfærdigt

- trofaste

- Fall

- bekendt

- familier

- familie

- FAST

- hurtigere

- defekt

- Feature

- Funktionalitet

- gebyr

- tilbagemeldinger

- få

- Arkivering

- filtrere

- Endelig

- finansielle

- Finde

- finde

- fund

- ende

- slut

- Fornavn

- Fix

- fleksibel

- fokuserede

- følger

- Til

- For forbrugere

- Videresend

- fundet

- Foundation

- fire

- fraktion

- Framework

- rammer

- Gratis

- hyppigt

- venlige

- fra

- funktioner

- yderligere

- fremtiden

- spil

- game-changer

- spil

- Generelt

- generelt

- generere

- genererer

- generere

- generation

- generative

- Generativ AI

- generator

- få

- få

- Giv

- Global

- global digital

- Go

- mål

- gå

- godt

- GPU

- GPU'er

- stor

- Ground

- banebrydende

- gruppe

- Dyrkning

- voksen

- vejledning

- vejlede

- retningslinjer

- havde

- hænder

- Happening

- Hård Ost

- Hardware

- skadelig

- hader

- Have

- have

- Overskrifter

- sundhedspleje

- tunge

- tunge løft

- hjælpe

- hjælpe

- hjælper

- link.

- Høj

- højere

- højeste

- fremhæve

- stærkt

- leje

- hans

- Hosting

- HOURS

- Hvordan

- How To

- Men

- HTTPS

- Hundreder

- i

- ID

- identiteter

- Identity

- id'er

- if

- billede

- billeder

- umiddelbar

- KIMOs Succeshistorier

- gennemføre

- implementeringer

- implementeret

- importere

- vigtigt

- imponerende

- Forbedre

- forbedret

- forbedringer

- in

- omfatter

- omfatter

- Herunder

- Forøg

- øget

- stigende

- Indikatorer

- enkeltpersoner

- industrier

- industrien

- brancheførende

- påvirket

- info

- informere

- oplysninger

- Infrastruktur

- innovere

- fornyelse

- Innovation

- innovationer

- innovativ

- indgang

- indgange

- indsigt

- indsigt

- instans

- i stedet

- Institut

- anvisninger

- forsikring

- integration

- intellektuel

- intellektuel ejendomsret

- Intelligens

- hensigt

- interagere

- interaktioner

- interagerer

- sammenkoblet

- grænseflade

- interne

- intervenere

- ind

- indføre

- introduceret

- indføre

- Opfundet

- opgørelse

- Invest

- undersøgende

- investere

- investering

- Investeringer

- involverede

- spørgsmål

- IT

- ITS

- japansk

- jargon

- Java

- jpg

- lige

- bare en

- Holde

- holde

- holder

- Nøgle

- Nøgleområder

- søgeord

- Kit (SDK)

- Kend

- viden

- kender

- Labs

- Mangel

- Sprog

- stor

- storstilet

- største

- Efternavn

- Sidste år

- Sent

- Latency

- seneste

- lanceret

- lancering

- Advokater

- lag

- lag

- Leadership" (virkelig menneskelig ledelse)

- førende

- LÆR

- lærte

- læring

- Politikker

- mindre

- Lets

- Niveau

- Leverage

- Udnytter

- LexisNexis

- LG

- biblioteker

- livscyklus

- løft

- ligesom

- Sandsynlig

- begrænsninger

- Limited

- grænser

- linjer

- LINK

- links

- Liste

- leve

- Lives

- Llama

- LLM

- placeret

- placeringer

- logisk

- logo

- Lang

- mangeårige

- Lot

- kærlighed

- Lav

- lavere

- laveste

- maskine

- machine learning

- lavet

- vedligeholde

- Vedligeholdelse

- vedligeholdelse

- større

- lave

- maerker

- Making

- lykkedes

- ledelse

- Ledere

- manuel

- manuelt arbejde

- manuelt

- mange

- Marketing

- materiale

- materialer

- maksimal

- Kan..

- me

- meningsfuld

- midler

- Medier

- Mød

- møde

- møder

- opfylder

- Medlemmer

- blotte

- Meta

- metode

- Miami

- microsoft

- Mellemøsten

- måske

- milepæl

- minutter

- glip af

- Mission

- ML

- model

- modellering

- modeller

- momentum

- MongoDB

- skærme

- Måned

- måned

- mere

- mest

- Mest Populære

- flytning

- MRI

- meget

- flere

- Musik

- skal

- my

- navn

- smal

- Nasdaq

- Natural

- I nærheden af

- nødvendig

- Behov

- behov

- behøve

- netto

- netværk

- netværk

- Ny

- New York

- nyligt

- næste

- Nitro

- ingen

- nu

- nummer

- Nvidia

- of

- off

- offensiv

- tilbyde

- tilbyde

- Tilbud

- tit

- ældre

- on

- engang

- ONE

- dem

- online

- netbank

- kun

- åbent

- betjene

- Produktion

- Optimer

- optimeret

- optimering

- Indstillinger

- or

- ordrer

- organisation

- organisationer

- original

- Andet

- Andre

- vores

- ud

- skitse

- output

- udgange

- i løbet af

- Overstock

- overvældende

- egen

- Tempo

- pakker

- smertefulde

- par

- parameter

- parametre

- del

- partnere

- dele

- forbi

- mønstre

- pause

- Mennesker

- per

- Udfør

- ydeevne

- udføres

- udfører

- tilladelse

- Tilladelser

- person,

- Personalisering

- Tilpas

- Personligt

- PGA Tour

- sætninger

- Place

- fly

- plato

- Platon Data Intelligence

- PlatoData

- plus

- Punkt

- politikker

- Populær

- positiv

- mulig

- Indlæg

- potentiale

- magt

- strøm

- vigtigste

- Praktisk

- praktisk

- praksis

- brug

- forudsige

- Forudsigelser

- præferencer

- forberedelse

- Forbered

- præsentere

- præsident

- trykke

- trykke

- Eksempel

- tidligere

- pris

- prissætning

- primære

- Beskyttelse af personlige oplysninger

- Privatliv og sikkerhed

- private

- privat information

- Problem

- problemer

- behandle

- Processer

- forarbejdning

- producere

- Produkt

- produktion

- produktiv

- produktivitet

- professionel

- professionelle partnere

- Programmer

- projekt

- prompter

- ejendom

- proprietære

- beskyttelse

- beskyttelse

- give

- udbyder

- udbydere

- giver

- leverer

- offentlige

- offentligt

- formål

- Skub ud

- Pushing

- sætte

- Sætte

- Python

- pytorch

- Q3

- kvantitativ

- spørgsmål

- Spørgsmål

- Hurtig

- hurtigt

- helt

- F & U

- rækkevidde

- hurtige

- hurtigt

- priser

- RE

- Læsning

- ægte

- realtid

- realistisk

- indse

- gik op for

- virkelig

- høste

- årsager

- for nylig

- Anbefaling

- anbefalinger

- optage

- reducere

- Reduceret

- reducere

- raffinere

- region

- frigivet

- relevant

- pålidelighed

- resterne

- Fjern

- fjernelse

- reparation

- repetitiv

- udskiftning

- svar

- indberette

- Repository

- anmode

- anmodninger

- påkrævet

- Krav

- forskning

- Booking

- Reserve

- Løsning

- resonans

- Ressourcer

- respekt

- Svar

- reagere

- svar

- reaktioner

- ansvarlige

- begrænse

- begrænset

- resultere

- Resultater

- vender tilbage

- gennemgå

- gennemgå

- højre

- risici

- roller

- roller

- Rum

- veje

- Herske

- Kør

- kører

- landingsbane

- at ofre

- sikker

- sikkerhedsforanstaltninger

- sikkert

- sagemaker

- salg

- salgsstyrke

- samme

- tilfredshed

- Gem

- siger

- Scale

- skalering

- scenarier

- rækkevidde

- ridse

- SDK

- sømløs

- Søg

- Anden

- Anden generation

- sekunder

- sikker

- sikkert

- sikkerhed

- se

- se

- set

- Vælg

- valgt

- valg

- afsendelse

- senior

- ledende ledelse

- følsom

- september

- Sequence

- Series

- Servere

- tjeneste

- Tjenester

- sæt

- sæt

- flere

- Del

- delt

- SKIB

- Kort

- bør

- side

- signifikant

- Silicon

- Tilsvarende

- Simpelt

- forenkle

- ganske enkelt

- siden

- SIX

- størrelser

- slæk

- lille

- So

- Social

- sociale medier

- Software

- Softwareudviklere

- softwareudvikling

- softwareudviklingssæt

- løsninger

- Løsninger

- SOLVE

- nogle

- Nogen

- noget

- snart

- sofistikeret

- Kilde

- kildekode

- Kilder

- sydøst

- Space

- Spark

- specifikt

- tale

- hastighed

- tilbringe

- Stabilitet

- stabil

- stable

- stablet

- interessenter

- påbegyndt

- Starter

- Nystartede

- state-of-the-art

- forblive

- Trin

- Steps

- Stadig

- opbevaring

- butik

- forhandler

- Historier

- Storm

- Story

- strømline

- Styrke

- stringent

- struktur

- Studere

- subnet

- væsentlig

- sådan

- egnede

- suite

- opsummere

- RESUMÉ

- Super

- supplere

- leverandører

- forsyne

- Udbud og efterspørgsel

- forsyningskæde

- support

- Understøtter

- sikker

- overraskende

- overvågning

- mistænksom

- Bæredygtighed

- Kontakt

- syntetisere

- systemet

- Systemer

- bord

- skræddersyet

- Tag

- tager

- tager

- Tal

- mål

- Opgaver

- opgaver

- hold

- Holdkammerater

- hold

- Teknisk

- teknik

- teknikker

- Teknologier

- Teknologier

- Teknologiinnovation

- fortælle

- fortæller

- ti

- tiere

- tensorflow

- terminologi

- prøve

- Test

- tests

- tekst

- end

- at

- Fremtiden

- verdenen

- deres

- Them

- selv

- derefter

- Der.

- Disse

- de

- ting

- ting

- tror

- Tredje

- denne

- i år

- dem

- tusinder

- tre

- Gennem

- hele

- kapacitet

- billet

- billetter

- tid

- gange

- titan

- til

- i dag

- nutidens

- sammen

- token

- også

- tog

- værktøj

- værktøjer

- top

- Emner

- Tour

- mod

- mod

- spor

- historik

- Trading

- Tog

- uddannet

- Kurser

- Transaktioner

- Transcript

- Transform

- Transformation

- transformationer

- omdanne

- rejse

- billioner

- tur

- virkelig

- Stol

- prøv

- forsøger

- tuning

- vender

- to

- typen

- typisk

- underliggende

- forstå

- forståelig

- forståelse

- forstår

- ukendt

- forenet

- enestående

- enhed

- I modsætning til

- indtil

- Opdatering

- opdateringer

- opgradering

- opgraderinger

- us

- Brug

- brug

- brug tilfælde

- anvendte

- Bruger

- brugere

- bruger

- ved brug af

- Værdifuld

- række

- forskellige

- udgave

- versioner

- versus

- meget

- via

- vice

- Vice President

- video

- Vold

- næsten

- visualisering

- Visualiser

- visuelt

- mængder

- Sårbar

- ønsker

- Warner

- warner musikgruppe

- var

- Wave

- Vej..

- måder

- we

- web

- Webapplikation

- webservices

- websites

- uge

- uger

- velkommen

- GODT

- Kendt

- var

- Hvad

- Hvad er

- hvornår

- hvorvidt

- som

- mens

- WHO

- hvorfor

- bred

- Bred rækkevidde

- bredere

- vilje

- vindue

- med

- inden for

- uden

- Arbejde

- arbejdede

- arbejdsgange

- arbejder

- virker

- world

- verdens klasse

- bekymre sig

- værd

- ville

- skriver

- skriv kode

- skrivning

- år

- år

- york

- Du

- Din

- Zendesk

- zephyrnet