Store sprogmodeller (LLM'er) kan med deres brede viden generere menneskelignende tekst om næsten ethvert emne. Men deres træning i massive datasæt begrænser også deres anvendelighed til specialiserede opgaver. Uden fortsat læring forbliver disse modeller uvidende om nye data og tendenser, der dukker op efter deres indledende træning. Desuden kan omkostningerne ved at træne nye LLM'er vise sig at være uoverkommelige for mange virksomhedsindstillinger. Det er dog muligt at krydshenvise et modelsvar med det originale specialiserede indhold, og derved undgå behovet for at træne en ny LLM-model ved hjælp af Retrieval-Augmented Generation (RAG).

RAG styrker LLM'er ved at give dem mulighed for at hente og inkorporere ekstern viden. I stedet for udelukkende at stole på deres forudtrænede viden, tillader RAG modeller at trække data fra dokumenter, databaser og mere. Modellen integrerer derefter dygtigt denne eksterne information i dens genererede tekst. Ved at hente kontekstrelevante data kan modellen give informerede, opdaterede svar skræddersyet til din use case. Videnforøgelsen reducerer også sandsynligheden for hallucinationer og unøjagtig eller meningsløs tekst. Med RAG bliver fundamentmodeller tilpasningsdygtige eksperter, der udvikler sig i takt med, at din videnbase vokser.

I dag er vi glade for at kunne afsløre tre generative AI-demoer, licenseret under MIT-0 licens:

- Amazon Kendra med grundlæggende LLM – Udnytter de dybe søgefunktioner fra Amazon Kendra kombineret med den omfattende viden om LLM'er. Denne integration giver præcise og kontekstbevidste svar på komplekse forespørgsler ved at trække fra en bred vifte af kilder.

- Indlejringsmodel med grundlæggende LLM – Forener styrken af indlejringer – en teknik til at fange semantiske betydninger af ord og sætninger – med den store videnbase af LLM'er. Denne synergi muliggør mere nøjagtig emnemodellering, indholdsanbefaling og semantiske søgefunktioner.

- Foundation Models Pharma Ad Generator – En specialiseret applikation skræddersyet til den farmaceutiske industri. Ved at udnytte grundmodellernes generative egenskaber skaber dette værktøj overbevisende og kompatible farmaceutiske reklamer, hvilket sikrer, at indholdet overholder industristandarder og regler.

Disse demoer kan problemfrit implementeres på din AWS-konto og giver grundlæggende indsigt og vejledning i at bruge AWS-tjenester til at skabe en avanceret LLM-generativ AI-spørgsmål og -svar-bot og generering af indhold.

I dette indlæg undersøger vi, hvordan RAG kombineret med Amazon Kendra eller brugerdefinerede indlejringer kan overvinde disse udfordringer og give raffinerede svar på naturlige sprogforespørgsler.

Løsningsoversigt

Ved at bruge denne løsning kan du opnå følgende fordele:

- Forbedret informationsadgang – RAG giver modeller mulighed for at hente information fra store eksterne kilder, hvilket kan være særligt nyttigt, når den præ-trænede models viden er forældet eller ufuldstændig.

- Skalerbarhed – I stedet for at træne en model på alle tilgængelige data, giver RAG modeller mulighed for at hente relevant information på farten. Det betyder, at efterhånden som nye data bliver tilgængelige, kan de tilføjes til genfindingsdatabasen uden at skulle genoptræne hele modellen.

- Hukommelseseffektivitet – LLM'er kræver betydelig hukommelse til at gemme parametre. Med RAG kan modellen være mindre, fordi den ikke behøver at huske alle detaljer; den kan hente dem, når det er nødvendigt.

- Dynamisk videnopdatering – I modsætning til konventionelle modeller med et fastsat videnslutpunkt, kan RAG's eksterne database gennemgå regelmæssige opdateringer, hvilket giver modellen adgang til opdateret information. Hentefunktionen kan finjusteres til forskellige opgaver. For eksempel kan en medicinsk diagnostisk opgave hente data fra medicinske tidsskrifter, hvilket sikrer, at modellen får ekspert og relevant indsigt.

- Bias afbødning – Evnen til at trække fra en velkurateret database giver mulighed for at minimere skævheder ved at sikre afbalancerede og upartiske eksterne kilder.

Før du dykker ned i integrationen af Amazon Kendra med grundlæggende LLM'er, er det afgørende at udstyre dig selv med de nødvendige værktøjer og systemkrav. At have den rigtige opsætning på plads er det første skridt mod en problemfri implementering af demoerne.

Forudsætninger

Du skal have følgende forudsætninger:

Selvom det er muligt at konfigurere og implementere infrastrukturen beskrevet i denne vejledning fra din lokale computer, AWS Cloud9 tilbyder et praktisk alternativ. Forududstyret med værktøjer som AWS CLI, AWS CDK og Docker kan AWS Cloud9 fungere som din implementeringsarbejdsstation. For at bruge denne tjeneste, skal du blot sætte miljøet op via AWS Cloud9 konsol.

Med forudsætningerne af vejen, lad os dykke ned i funktionerne og mulighederne i Amazon Kendra med grundlæggende LLM'er.

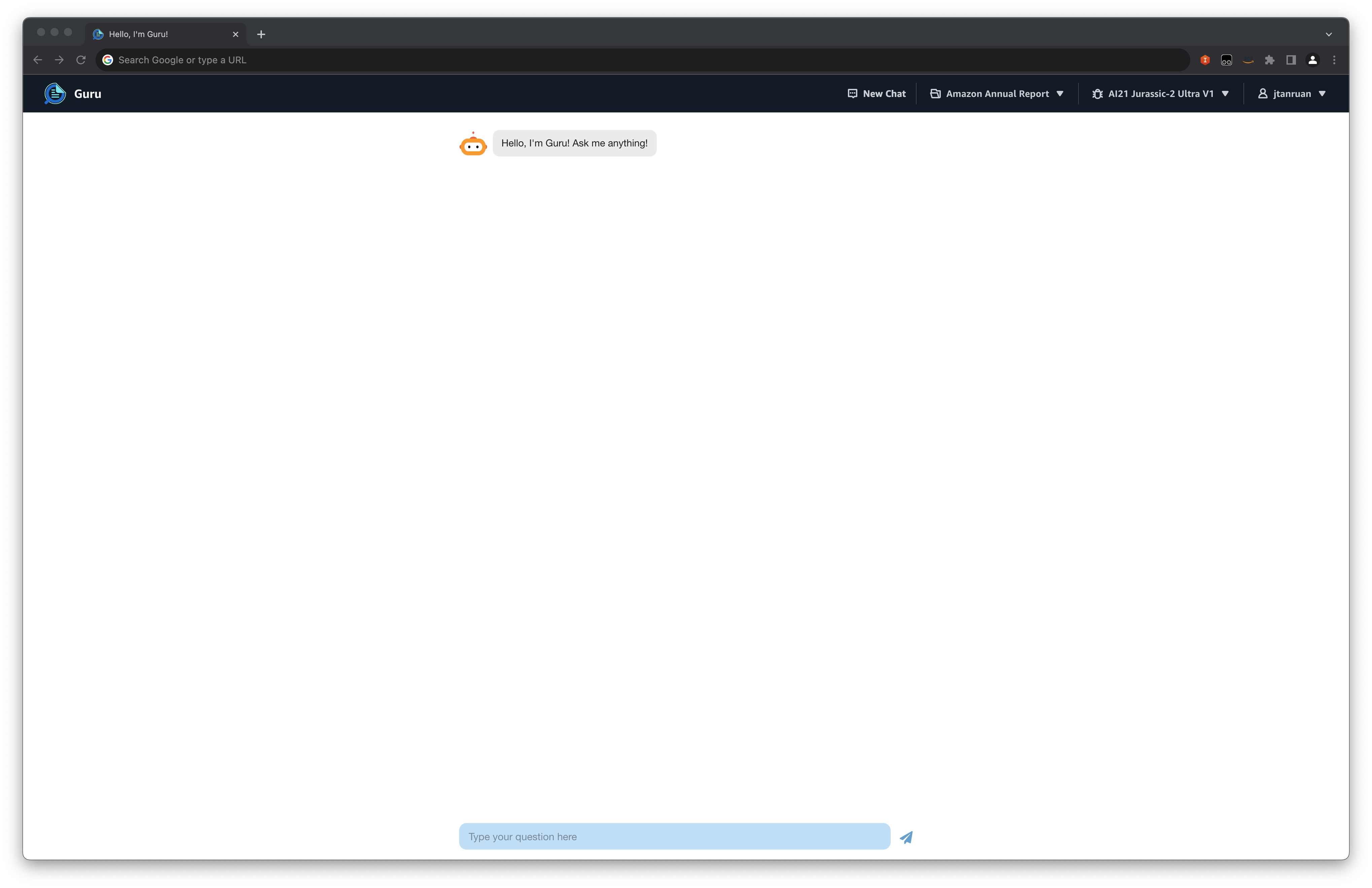

Amazon Kendra med grundlæggende LLM

Amazon Kendra er en avanceret virksomhedssøgningstjeneste, der er forbedret med maskinlæring (ML), der giver semantiske søgefunktioner, der er klar til brug. Ved at bruge naturlig sprogbehandling (NLP) forstår Amazon Kendra både indholdet af dokumenter og den underliggende hensigt med brugerforespørgsler og placerer det som et indholdsgenfindingsværktøj til RAG-baserede løsninger. Ved at bruge det højnøjagtige søgeindhold fra Kendra som en RAG-nyttelast, kan du få bedre LLM-svar. Brugen af Amazon Kendra i denne løsning muliggør også personlig søgning ved at filtrere svar i henhold til slutbrugernes adgangstilladelser til indhold.

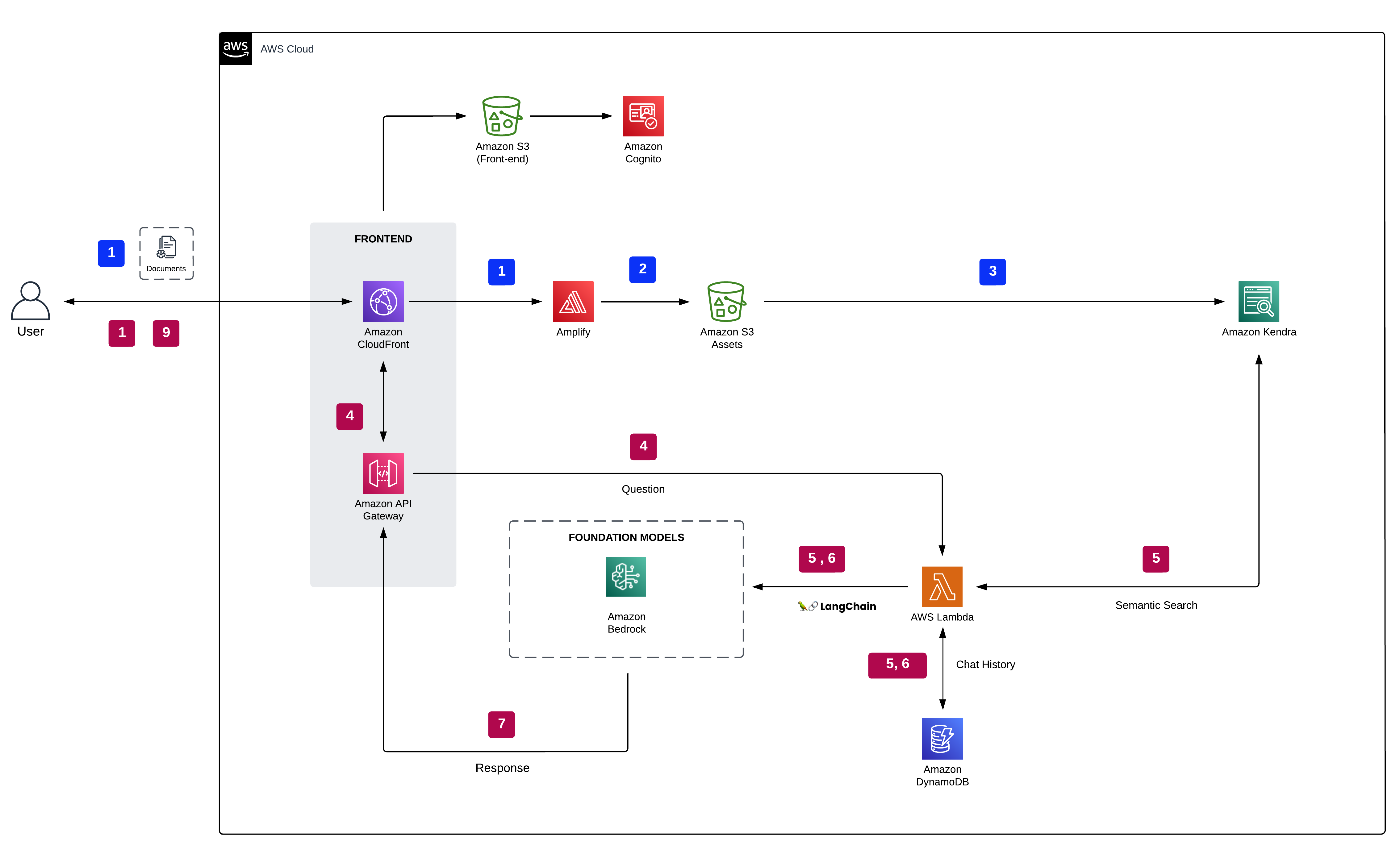

Følgende diagram viser arkitekturen af en generativ AI-applikation, der bruger RAG-tilgangen.

Dokumenter behandles og indekseres af Amazon Kendra gennem Amazon Simple Storage Service (Amazon S3) stik. Kundeanmodninger og kontekstuelle data fra Amazon Kendra er rettet til en Amazonas grundfjeld fundament model. Demoen lader dig vælge mellem Amazons Titan, AI21s Jurassic og Anthropics Claude-modeller understøttet af Amazon Bedrock. Samtalehistorikken gemmes i Amazon DynamoDB, der tilbyder ekstra kontekst for LLM til at generere svar.

Vi har leveret denne demo i GitHub repo. Se installationsinstruktionerne i readme-filen for at implementere den på din AWS-konto.

De følgende trin skitserer processen, når en bruger interagerer med den generative AI-app:

- Brugeren logger ind på webappen, der er godkendt af Amazon Cognito.

- Brugeren uploader et eller flere dokumenter til Amazon S3.

- Brugeren kører et Amazon Kendra-synkroniseringsjob for at indlæse S3-dokumenter i Amazon Kendra-indekset.

- Brugerens spørgsmål sendes gennem en sikker WebSocket API hostet på Amazon API Gateway bakket op af en AWS Lambda funktion.

- Lambda-funktionen, bemyndiget af Langkæde framework – et alsidigt værktøj designet til at skabe applikationer drevet af AI-sprogmodeller – forbindes til Amazon Bedrock-slutpunktet for at omformulere brugerens spørgsmål baseret på chathistorik. Efter omformulering videresendes spørgsmålet til Amazon Kendra ved hjælp af Retrieve API. Som svar viser Amazon Kendra-indekset søgeresultater og giver uddrag fra relevante dokumenter hentet fra virksomhedens indtagne data.

- Brugerens spørgsmål sammen med de data, der hentes fra indekset, sendes som en kontekst i LLM-prompten. Svaret fra LLM gemmes som chathistorik i DynamoDB.

- Til sidst sendes svaret fra LLM tilbage til brugeren.

Dokumentindekseringsarbejdsgang

Følgende er proceduren for behandling og indeksering af dokumenter:

- Brugere indsender dokumenter via brugergrænsefladen (UI).

- Dokumenter overføres til en S3-spand ved hjælp af AWS Amplify API.

- Amazon Kendra indekserer nye dokumenter i S3-bøtten gennem Amazon Kendra S3-stikket.

Fordele

Følgende liste fremhæver fordelene ved denne løsning:

- Hentning på virksomhedsniveau – Amazon Kendra er designet til virksomhedssøgning, hvilket gør det velegnet til organisationer med enorme mængder af strukturerede og ustrukturerede data.

- Semantisk forståelse – ML-kapaciteterne i Amazon Kendra sikrer, at hentning er baseret på dyb semantisk forståelse og ikke kun søgeordsmatches.

- Skalerbarhed – Amazon Kendra kan håndtere store datakilder og giver hurtige og relevante søgeresultater.

- Fleksibilitet – Grundmodellen kan generere svar baseret på en bred vifte af sammenhænge, hvilket sikrer, at systemet forbliver alsidigt.

- Integrationsmuligheder – Amazon Kendra kan integreres med forskellige AWS-tjenester og datakilder, hvilket gør det tilpasset til forskellige organisatoriske behov.

Indlejringsmodel med grundlæggende LLM

An indlejring er en numerisk vektor, der repræsenterer kerneessensen af forskellige datatyper, herunder tekst, billeder, lyd og dokumenter. Denne repræsentation fanger ikke kun dataens iboende betydning, men tilpasser den også til en lang række praktiske anvendelser. Indlejring af modeller, en gren af ML, transformerer komplekse data, såsom ord eller sætninger, til kontinuerlige vektorrum. Disse vektorer forstår i sagens natur de semantiske forbindelser mellem data, hvilket muliggør dybere og mere indsigtsfulde sammenligninger.

RAG kombinerer problemfrit styrkerne ved grundlæggende modeller, såsom transformere, med præcisionen af indlejringer for at gennemsøge enorme databaser for relevant information. Ved modtagelse af en forespørgsel bruger systemet indlejringer til at identificere og udtrække relevante sektioner fra en omfattende mængde data. Grundmodellen formulerer derefter et kontekstuelt præcist svar baseret på denne udtrukne information. Denne perfekte synergi mellem datahentning og responsgenerering gør det muligt for systemet at give grundige svar, der trækker på den store viden, der er lagret i ekspansive databaser.

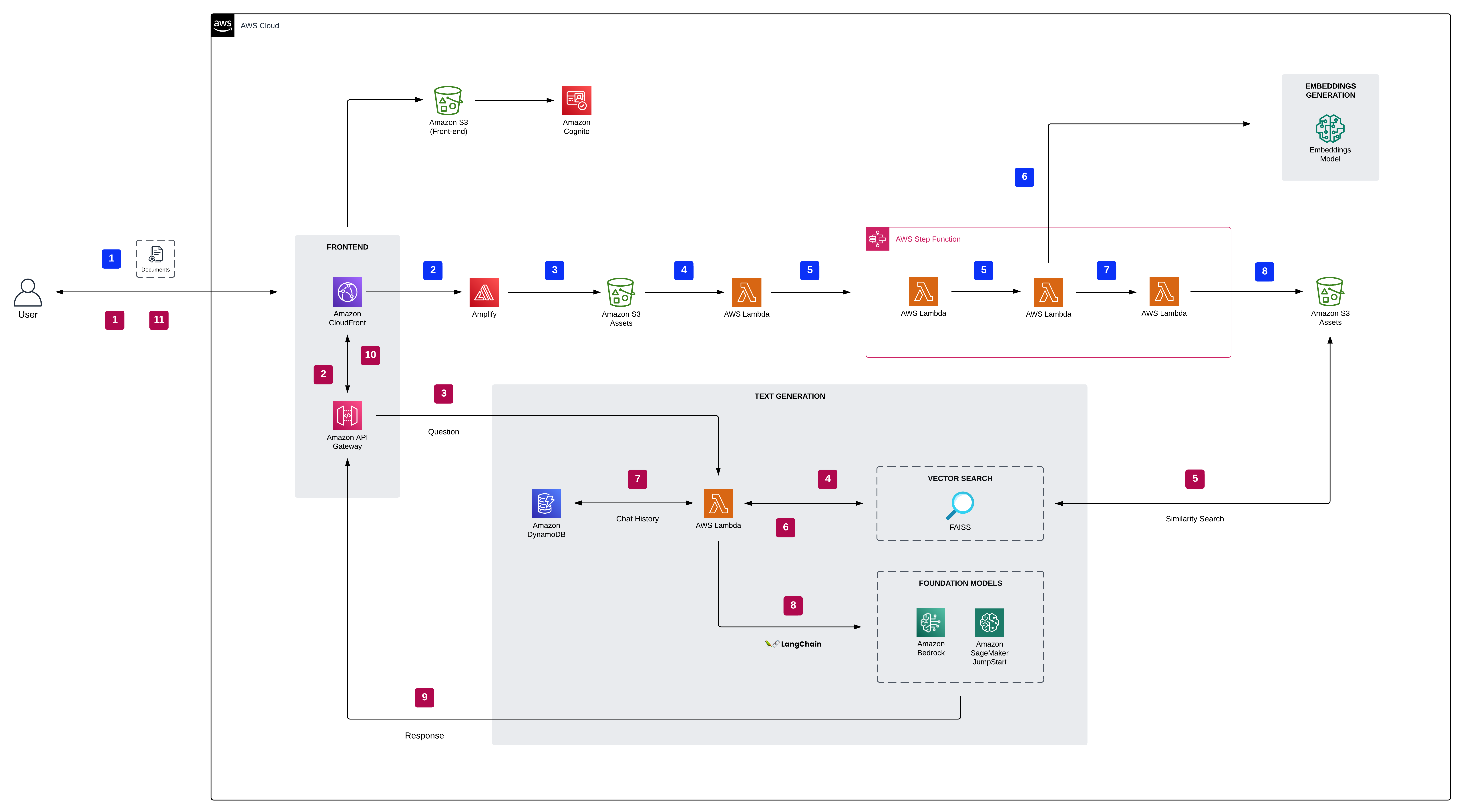

I det arkitektoniske layout, baseret på deres UI-valg, guides brugerne til enten Amazonas grundfjeld eller Amazon SageMaker JumpStart fundament modeller. Dokumenter gennemgår behandling, og vektorindlejringer produceres af indlejringsmodellen. Disse indlejringer indekseres derefter vha FAISS for at muliggøre effektiv semantisk søgning. Samtalehistorier er bevaret i DynamoDB, hvilket beriger konteksten for LLM'en til at lave svar.

Følgende diagram illustrerer løsningsarkitekturen og arbejdsgangen.

Vi har leveret denne demo i GitHub repo. Se installationsinstruktionerne i readme-filen for at implementere den på din AWS-konto.

Indstøbningsmodel

Ansvaret for indlejringsmodellen er som følger:

- Denne model er ansvarlig for at konvertere tekst (som dokumenter eller passager) til tætte vektorrepræsentationer, almindeligvis kendt som indlejringer.

- Disse indlejringer fanger tekstens semantiske betydning, hvilket giver mulighed for effektive og semantisk meningsfulde sammenligninger mellem forskellige tekststykker.

- Indlejringsmodellen kan trænes på det samme store korpus som den grundlæggende model eller kan specialiseres til specifikke domæner.

Q&A arbejdsgang

Følgende trin beskriver arbejdsgangen for spørgsmålsbesvarelsen over dokumenter:

- Brugeren logger ind på webappen, der er godkendt af Amazon Cognito.

- Brugeren uploader et eller flere dokumenter til Amazon S3.

- Ved dokumentoverførsel udløser en S3-hændelsesmeddelelse en Lambda-funktion, som derefter kalder SageMaker-indlejringsmodellens slutpunkt for at generere indlejringer til det nye dokument. Indlejringsmodellen konverterer spørgsmålet til en tæt vektorrepræsentation (indlejring). Den resulterende vektorfil opbevares sikkert i S3-bøtten.

- FAISS retriever sammenligner denne spørgsmålsindlejring med indlejring af alle dokumenter eller passager i databasen for at finde de mest relevante passager.

- Passagerne, sammen med brugerens spørgsmål, er givet som kontekst til den grundlæggende model. Lambda-funktionen bruger LangChain-biblioteket og forbinder til Amazon Bedrock eller SageMaker JumpStart-slutpunktet med en kontekstfyldt forespørgsel.

- Svaret fra LLM gemmes i DynamoDB sammen med brugerens forespørgsel, tidsstemplet, en unik identifikator og andre vilkårlige identifikatorer for elementet, såsom spørgsmålskategori. Ved at gemme spørgsmålet og svaret som diskrete elementer kan Lambda-funktionen nemt genskabe en brugers samtalehistorik baseret på det tidspunkt, hvor spørgsmålene blev stillet.

- Til sidst sendes svaret tilbage til brugeren via en HTTPs-anmodning gennem API Gateway WebSocket API-integrationssvaret.

Fordele

Følgende liste beskriver fordelene ved denne løsning:

- Semantisk forståelse – Indlejringsmodellen sikrer, at retrieveren vælger passager baseret på dyb semantisk forståelse, ikke kun søgeordsmatches.

- Skalerbarhed – Indlejringer giver mulighed for effektive lighedssammenligninger, hvilket gør det muligt hurtigt at søge gennem store databaser med dokumenter.

- Fleksibilitet – Grundmodellen kan generere svar baseret på en bred vifte af sammenhænge, hvilket sikrer, at systemet forbliver alsidigt.

- Domænetilpasning – Indlejringsmodellen kan trænes eller finjusteres til specifikke domæner, så systemet kan tilpasses til forskellige applikationer.

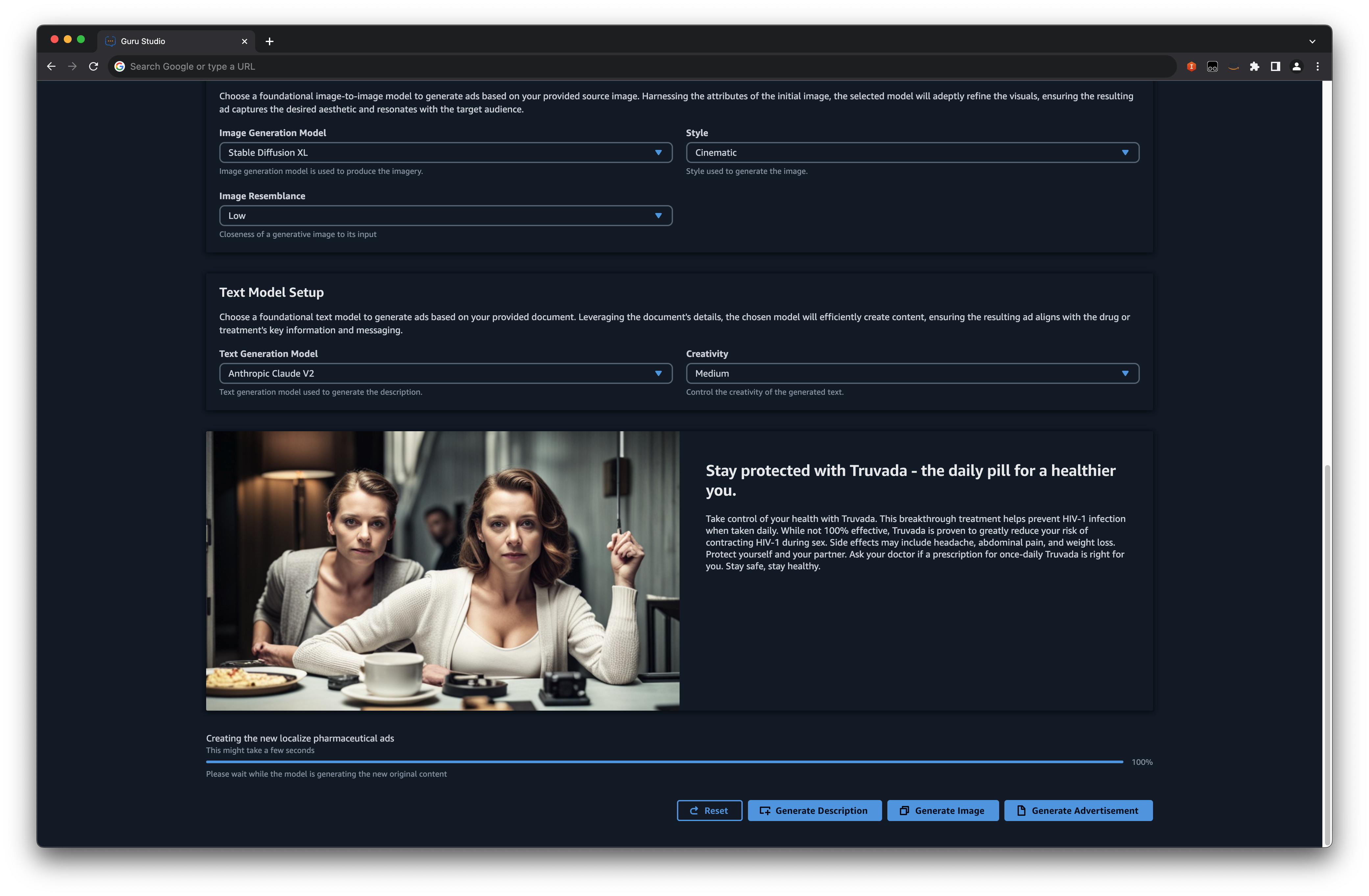

Foundation Models Pharma Ad Generator

I nutidens hurtige farmaceutiske industri er effektiv og lokaliseret annoncering mere afgørende end nogensinde. Det er her, en innovativ løsning kommer i spil, der bruger kraften fra generativ AI til at lave lokaliserede lægemiddelannoncer fra kildebilleder og PDF'er. Ud over blot at fremskynde annoncegenereringsprocessen, strømliner denne tilgang processen med medicinsk juridisk gennemgang (MLR). MLR er en streng gennemgangsmekanisme, hvor medicinske, juridiske og regulatoriske teams omhyggeligt evaluerer reklamemateriale for at garantere deres nøjagtighed, videnskabelige opbakning og overholdelse af lovgivningen. Traditionelle metoder til oprettelse af indhold kan være besværlige og kræver ofte manuelle justeringer og omfattende gennemgange for at sikre overensstemmelse med regional overholdelse og relevans. Men med fremkomsten af generativ AI kan vi nu automatisere udformningen af annoncer, der virkelig giver genlyd hos det lokale publikum, alt imens vi opretholder strenge standarder og retningslinjer.

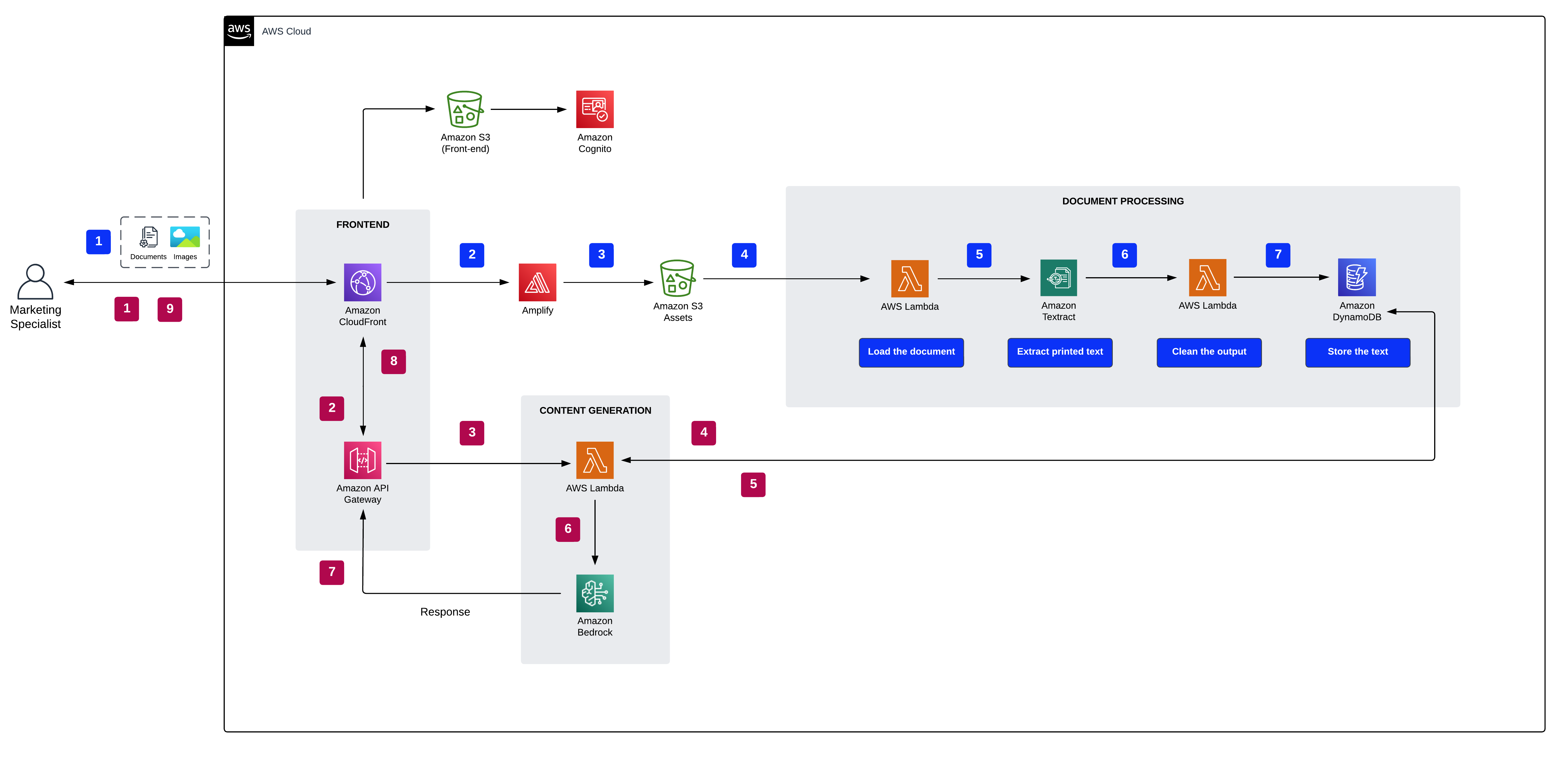

Følgende diagram illustrerer løsningsarkitekturen.

I det arkitektoniske layout, baseret på deres valgte model og annoncepræferencer, guides brugerne problemfrit til Amazon Bedrock-fundamentmodellerne. Denne strømlinede tilgang sikrer, at nye annoncer genereres præcist i overensstemmelse med den ønskede konfiguration. Som en del af processen håndteres dokumenter effektivt af amazontekst, med den resulterende tekst sikkert gemt i DynamoDB. En iøjnefaldende funktion er det modulære design til billed- og tekstgenerering, der giver dig fleksibiliteten til selvstændigt at regenerere enhver komponent efter behov.

Vi har leveret denne demo i GitHub repo. Se installationsinstruktionerne i readme-filen for at implementere den på din AWS-konto.

Indholdsgenerering arbejdsgang

Følgende trin skitserer processen for indholdsgenerering:

- Brugeren vælger sit dokument, kildebillede, annonceplacering, sprog og billedstil.

- Sikker adgang til webapplikationen er sikret gennem Amazon Cognito-godkendelse.

- Webapplikationens frontend hostes via Amplify.

- En WebSocket API, der administreres af API Gateway, letter brugeranmodninger. Disse anmodninger er autentificeret igennem AWS identitets- og adgangsstyring (JEG ER).

- Integration med Amazon Bedrock inkluderer følgende trin:

- En Lambda-funktion anvender LangChain-biblioteket til at oprette forbindelse til Amazon Bedrock-slutpunktet ved hjælp af en kontekstrig forespørgsel.

- Grundmodellen tekst-til-tekst laver en kontekstuelt passende annonce baseret på den givne kontekst og indstillinger.

- Grundmodellen tekst-til-billede skaber et skræddersyet billede, påvirket af kildebilledet, valgt stil og placering.

- Brugeren modtager svaret via en HTTPS-anmodning via den integrerede API Gateway WebSocket API.

Dokument- og billedbehandlingsarbejdsgang

Følgende er proceduren for behandling af dokumenter og billeder:

- Brugeren uploader aktiver via den angivne brugergrænseflade.

- Amplify API overfører dokumenterne til en S3-bøtte.

- Efter at aktivet er overført til Amazon S3, finder en af følgende handlinger sted:

- Hvis det er et dokument, bruger en Lambda-funktion Amazon Textract til at behandle og udtrække tekst til annoncegenerering.

- Hvis det er et billede, konverterer Lambda-funktionen det til base64-format, velegnet til stabil diffusionsmodellen for at skabe et nyt billede fra kilden.

- Den udpakkede tekst eller base64 billedstreng er sikkert gemt i DynamoDB.

Fordele

Følgende liste beskriver fordelene ved denne løsning:

- Effektivitet – Brugen af generativ AI fremskynder annoncegenereringsprocessen betydeligt, hvilket eliminerer behovet for manuelle justeringer.

- Overholdelse af overholdelse – Løsningen sikrer, at genererede annoncer overholder specifikke vejledninger og regler, såsom FDA's retningslinjer for markedsføring.

- Omkostningseffektivt – Ved at automatisere oprettelsen af skræddersyede annoncer kan virksomheder reducere omkostningerne forbundet med annonceproduktion og revisioner markant.

- Strømlinet MLR-proces – Løsningen forenkler MLR-processen, reducerer friktionspunkter og sikrer jævnere anmeldelser.

- Lokaliseret resonans – Generativ kunstig intelligens producerer annoncer, der vækker genklang hos det lokale publikum, hvilket sikrer relevans og effekt i forskellige regioner.

- Standardisering – Løsningen opretholder nødvendige standarder og retningslinjer, hvilket sikrer konsistens på tværs af alle genererede annoncer.

- Skalerbarhed – Den AI-drevne tilgang kan håndtere enorme databaser med kildebilleder og PDF'er, hvilket gør det muligt for generering af annoncer i stor skala.

- Reduceret manuel indgriben – Automatiseringen reducerer behovet for menneskelig indgriben, minimerer fejl og sikrer sammenhæng.

Du kan implementere infrastrukturen i dette selvstudie fra din lokale computer, eller du kan bruge AWS Cloud9 som din implementeringsarbejdsstation. AWS Cloud9 kommer forudindlæst med AWS CLI, AWS CDK og Docker. Hvis du vælger AWS Cloud9, skabe miljøet fra AWS Cloud9 konsol.

Ryd op

For at undgå unødvendige omkostninger skal du rydde op i al den infrastruktur, der er oprettet via AWS CloudFormation-konsollen eller ved at køre følgende kommando på din arbejdsstation:

Derudover skal du huske at stoppe eventuelle SageMaker-slutpunkter, du har startet via SageMaker-konsollen. Husk, at sletning af et Amazon Kendra-indeks fjerner ikke de originale dokumenter fra dit lager.

Konklusion

Generativ AI, indbegrebet af LLM'er, varsler et paradigmeskifte i, hvordan vi får adgang til og genererer information. Selvom disse modeller er kraftfulde, er de ofte begrænset af deres træningsdata. RAG løser denne udfordring og sikrer, at den store viden inden for disse modeller konsekvent tilføres relevant, aktuel indsigt.

Vores RAG-baserede demoer giver et håndgribeligt bevis på dette. De fremviser den sømløse synergi mellem Amazon Kendra, vektorindlejringer og LLM'er, hvilket skaber et system, hvor information ikke kun er omfattende, men også præcis og rettidig. Når du dykker ned i disse demoer, vil du på første hånd udforske transformationspotentialet ved at fusionere fortrænet viden med RAG's dynamiske muligheder, hvilket resulterer i output, der både er troværdigt og skræddersyet til virksomhedens indhold.

Selvom generativ AI drevet af LLM'er åbner op for en ny måde at opnå informationsindsigt på, skal denne indsigt være troværdig og begrænset til virksomhedsindhold ved hjælp af RAG-tilgangen. Disse RAG-baserede demoer giver dig mulighed for at blive udstyret med indsigt, der er præcis og opdateret. Kvaliteten af disse indsigter afhænger af semantisk relevans, som aktiveres ved at bruge Amazon Kendra og vektorindlejringer.

Hvis du er klar til yderligere at udforske og udnytte kraften i generativ AI, her er dine næste trin:

- Deltag i vores demoer – Den praktiske erfaring er uvurderlig. Udforsk funktionaliteterne, forstå integrationerne, og gør dig bekendt med grænsefladen.

- Uddyb din viden – Udnyt de tilgængelige ressourcer. AWS tilbyder dybdegående dokumentation, tutorials og fællesskabsstøtte for at hjælpe på din AI-rejse.

- Igangsætte et pilotprojekt – Overvej at starte med en småskalaimplementering af generativ AI i din virksomhed. Dette vil give indsigt i systemets praktiske og tilpasningsevne inden for din specifikke kontekst.

For mere information om generative AI-applikationer på AWS, se følgende:

Husk, at AI-landskabet er i konstant udvikling. Hold dig opdateret, forbliv nysgerrig, og vær altid klar til at tilpasse og innovere.

Om forfatterne

Jin Tan Ruan er en Prototyping-udvikler inden for AWS Industries Prototyping and Customer Engineering (PACE) team, med speciale i NLP og generativ AI. Med en baggrund inden for softwareudvikling og ni AWS-certificeringer bringer Jin et væld af erfaring med til at hjælpe AWS-kunder med at materialisere deres AI/ML og generative AI-visioner ved hjælp af AWS-platformen. Han har en mastergrad i Computer Science & Software Engineering fra University of Syracuse. Uden for arbejdet nyder Jin at spille videospil og fordybe sig i den spændende verden af gyserfilm.

Jin Tan Ruan er en Prototyping-udvikler inden for AWS Industries Prototyping and Customer Engineering (PACE) team, med speciale i NLP og generativ AI. Med en baggrund inden for softwareudvikling og ni AWS-certificeringer bringer Jin et væld af erfaring med til at hjælpe AWS-kunder med at materialisere deres AI/ML og generative AI-visioner ved hjælp af AWS-platformen. Han har en mastergrad i Computer Science & Software Engineering fra University of Syracuse. Uden for arbejdet nyder Jin at spille videospil og fordybe sig i den spændende verden af gyserfilm.

Aravind Kodandaramaiah er en Senior Prototyping full stack løsningsbygger inden for AWS Industries Prototyping and Customer Engineering (PACE) team. Han fokuserer på at hjælpe AWS-kunder med at omsætte innovative ideer til løsninger med målbare og dejlige resultater. Han brænder for en række emner, herunder cloud-sikkerhed, DevOps og AI/ML, og kan normalt findes ved at pille ved disse teknologier.

Aravind Kodandaramaiah er en Senior Prototyping full stack løsningsbygger inden for AWS Industries Prototyping and Customer Engineering (PACE) team. Han fokuserer på at hjælpe AWS-kunder med at omsætte innovative ideer til løsninger med målbare og dejlige resultater. Han brænder for en række emner, herunder cloud-sikkerhed, DevOps og AI/ML, og kan normalt findes ved at pille ved disse teknologier.

Arjun Shakdher er en udvikler på AWS Industries Prototyping-teamet (PACE), der brænder for at blande teknologi ind i livets stof. Med en mastergrad fra Purdue University, kredser Arjuns nuværende rolle om arkitektur og bygning af banebrydende prototyper, der spænder over en række domæner, som i øjeblikket fremtrædende byder på AI/ML og IoT. Når du ikke er fordybet i kode og digitale landskaber, vil du opleve, at Arjun hengiver sig til kaffens verden, udforsker urets indviklede mekanik eller svælger i bilernes kunst.

Arjun Shakdher er en udvikler på AWS Industries Prototyping-teamet (PACE), der brænder for at blande teknologi ind i livets stof. Med en mastergrad fra Purdue University, kredser Arjuns nuværende rolle om arkitektur og bygning af banebrydende prototyper, der spænder over en række domæner, som i øjeblikket fremtrædende byder på AI/ML og IoT. Når du ikke er fordybet i kode og digitale landskaber, vil du opleve, at Arjun hengiver sig til kaffens verden, udforsker urets indviklede mekanik eller svælger i bilernes kunst.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/harnessing-the-power-of-enterprise-data-with-generative-ai-insights-from-amazon-kendra-langchain-and-large-language-models/

- :er

- :ikke

- :hvor

- $OP

- 100

- 150

- 7

- a

- evne

- Om

- accelererer

- adgang

- Ifølge

- Konto

- nøjagtighed

- præcis

- tværs

- aktioner

- Ad

- tilpasse

- tilpasser

- tilføjet

- adresser

- klæbe

- justeringer

- Vedtagelsen

- annoncer

- fremskreden

- Fordel

- fordele

- advent

- Reklame

- Efter

- AI

- AI / ML

- Støtte

- tilpasning

- Alle

- tillade

- tillade

- tillader

- næsten

- sammen

- også

- alternativ

- altid

- Amazon

- Amazon Cognito

- Amazon Kendra

- amazontekst

- Amazon Web Services

- beløb

- forstærke

- an

- ,

- besvare

- svar

- enhver

- api

- app

- Anvendelse

- applikationer

- tilgang

- passende

- arkitektonisk

- arkitektur

- ER

- omkring

- Array

- kunstfærdighed

- AS

- aktiv

- Aktiver

- hjælpe

- forbundet

- høringer

- lyd

- autentificeret

- Godkendelse

- automatisere

- Automatisering

- Automation

- til rådighed

- undgå

- undgå

- AWS

- AWS Cloud9

- AWS CloudFormation

- tilbage

- Backed

- baggrund

- opbakning

- bund

- baseret

- BE

- fordi

- bliver

- bliver

- fordele

- Bedre

- mellem

- Beyond

- fordomme

- blanding

- krop

- Bot

- både

- Branch

- Bringer

- bred

- Builder

- Bygning

- men

- by

- Opkald

- CAN

- Kan få

- kapaciteter

- fange

- fanger

- tilfælde

- Boligtype

- certificeringer

- udfordre

- udfordringer

- Vælg

- valgt

- ren

- Cloud

- Cloud Security

- Cloud9

- kode

- Kaffe

- kombineret

- kombinerer

- kommer

- almindeligt

- samfund

- Virksomheder

- sammenligninger

- komplekse

- Compliance

- kompatibel

- komponent

- fatter

- computer

- Datalogi

- Konfiguration

- Tilslut

- Tilslutninger

- forbinder

- Overvej

- konsekvent

- Konsol

- konstant

- indhold

- Indholdsgenerering

- indholdsskabelse

- sammenhæng

- sammenhænge

- kontekstuelle

- fortsatte

- kontinuerlig

- Praktisk

- konventionelle

- Samtale

- konvertering af

- Core

- Koste

- Omkostninger

- håndværk

- skabe

- oprettet

- skaber

- Oprettelse af

- skabelse

- afgørende

- besværlig

- nysgerrig

- Nuværende

- skik

- kunde

- Kunder

- banebrydende

- data

- Database

- databaser

- datasæt

- Dato

- dyb

- dybere

- Degree

- dejlige

- demo

- Demoer

- afhængig

- indsætte

- indsat

- implementering

- implementering

- beskrive

- Design

- konstrueret

- ønskes

- ødelægge

- detaljeret

- detaljer

- Udvikler

- Udvikling

- diagnostisk

- forskellige

- Broadcasting

- digital

- rettet

- displays

- distinkt

- dyk

- forskelligartede

- dykning

- Docker

- dokumentet

- dokumentation

- dokumenter

- Er ikke

- Domæner

- tegne

- tegning

- drevet

- dynamisk

- nemt

- effektivitet

- effektiv

- effektivt

- enten

- eliminere

- indlejring

- emerge

- beskæftiger

- bemyndiget

- bemyndiger

- muliggøre

- aktiveret

- muliggør

- muliggør

- ende

- Endpoint

- Engineering

- forbedret

- berigende

- sikre

- sikret

- sikrer

- sikring

- Enterprise

- Hele

- udstyret

- fejl

- især

- Essensen

- evaluere

- begivenhed

- NOGENSINDE

- udvikle sig

- udviklende

- eksempel

- ophidset

- ekspansiv

- erfaring

- ekspert

- eksperter

- udforske

- Udforskning

- omfattende

- ekstern

- ekstrakt

- stof

- letter

- fortrolig

- hurtig

- FB

- gennemførlig

- Feature

- Funktionalitet

- Med

- File (Felt)

- filtrering

- Finde

- Fornavn

- Fleksibilitet

- fokuserer

- efter

- følger

- Til

- format

- fundet

- Foundation

- friktion

- fra

- forsiden

- forreste ende

- fuld

- Fuld stak

- funktion

- funktionaliteter

- yderligere

- Endvidere

- Gevinst

- vinder

- Spil

- gateway

- generere

- genereret

- generation

- generative

- Generativ AI

- generator

- få

- given

- Give

- tildeling

- forståelse

- Vokser

- garanti

- vejledning

- guidet

- retningslinjer

- håndtere

- hands-on

- seletøj

- udnyttelse

- Have

- have

- he

- hjælpe

- herolder

- link.

- højdepunkter

- selv

- historier

- historie

- bedrift

- besidder

- horror

- hostede

- Hvordan

- Men

- HTML

- http

- HTTPS

- menneskelig

- ideer

- identifikator

- identifikatorer

- identificere

- Identity

- if

- illustrerer

- billede

- billeder

- nedsænket

- KIMOs Succeshistorier

- implementering

- in

- dybdegående

- forkert

- omfatter

- Herunder

- indarbejde

- uafhængigt

- indeks

- indekseret

- indekser

- industrier

- industrien

- industristandarder

- påvirket

- oplysninger

- informeret

- Infrastruktur

- sagens natur

- initial

- indledt

- innovere

- innovativ

- indsigtsfuld

- indsigt

- i stedet

- anvisninger

- integreret

- Integrerer

- integration

- integrationer

- hensigt

- interagerer

- grænseflade

- indgriben

- ind

- iboende

- uvurderlig

- tingenes internet

- IT

- Varer

- ITS

- Job

- rejse

- jpg

- lige

- viden

- kendt

- landskab

- Sprog

- stor

- storstilet

- Layout

- læring

- Politikker

- Lets

- Bibliotek

- Licenseret

- Livet

- ligesom

- sandsynlighed

- Limited

- grænser

- Liste

- LLM

- lokale

- placering

- maskine

- machine learning

- fastholder

- Making

- lykkedes

- manuel

- mange

- Marketing

- massive

- herres

- tændstikker

- materialer

- betyder

- meningsfuld

- betydninger

- midler

- mekanik

- mekanisme

- medicinsk

- Hukommelse

- blot

- fletninger

- sammenlægning

- metoder

- omhyggeligt

- minimering

- afbødning

- ML

- model

- modellering

- modeller

- modulær

- mere

- mest

- Film

- skal

- Natural

- Natural Language Processing

- nødvendig

- Behov

- behov

- behøve

- behov

- Ny

- næste

- ni

- NLP

- underretning

- nu

- of

- tilbyde

- Tilbud

- tit

- on

- ONE

- kun

- åbner

- or

- organisatorisk

- organisationer

- original

- Andet

- vores

- ud

- udfald

- skitse

- udgange

- uden for

- i løbet af

- Overvind

- Tempo

- paradigme

- parametre

- del

- lidenskabelige

- perfekt

- Tilladelser

- Personlig

- Pharma

- Pharmaceutical

- sætninger

- stykker

- pilot

- pilot projekt

- Place

- placering

- perron

- plato

- Platon Data Intelligence

- PlatoData

- Leg

- spiller

- punkter

- positionering

- mulig

- Indlæg

- potentiale

- magt

- strøm

- vigtigste

- Praktisk

- brug

- præcist

- Precision

- præferencer

- forudsætninger

- i øjeblikket

- procedure

- behandle

- Behandlet

- forarbejdning

- produceret

- producerer

- produktion

- projekt

- salgsfremmende

- prototyper

- prototyping

- Bevise

- give

- forudsat

- giver

- leverer

- kvalitet

- forespørgsler

- spørgsmål

- Spørgsmål

- Hurtig

- hurtigt

- rækkevidde

- klar

- riger

- modtager

- modtagende

- Anbefaling

- reducere

- reducerer

- reducere

- henvise

- raffinerede

- regional

- regioner

- fast

- regler

- lovgivningsmæssige

- Regulatory Compliance

- relevans

- relevant

- stole

- forblive

- resterne

- huske

- Fjern

- omformulering

- repræsentation

- repræsenterer

- anmode

- anmodninger

- kræver

- påkrævet

- Krav

- Resonator

- Ressourcer

- svar

- reaktioner

- ansvar

- ansvarlige

- resulterende

- resulterer

- Resultater

- gennemgå

- Anmeldelser

- revisioner

- roterer

- højre

- stringent

- roller

- kører

- løber

- sagemaker

- samme

- gemt

- Videnskab

- videnskabelig

- sømløs

- problemfrit

- Søg

- sektioner

- sikker

- sikkert

- sikkerhed

- valgt

- valg

- senior

- sendt

- tjeneste

- Tjenester

- sæt

- indstillinger

- setup

- skifte

- udstillingsvindue

- Shows

- Si

- signifikant

- betydeligt

- Simpelt

- ganske enkelt

- mindre

- glattere

- Software

- softwareudvikling

- software Engineering

- Alene

- løsninger

- Løsninger

- Kilde

- indkøbt

- Kilder

- Sourcing

- rum

- span

- specialiserede

- speciale

- specifikke

- specificeret

- stabil

- stable

- standarder

- Starter

- state-of-the-art

- forblive

- Trin

- Steps

- Stands

- opbevaring

- butik

- opbevaret

- lagring

- strømlinet

- styrker

- String

- stringent

- struktureret

- stil

- indsende

- sådan

- egnede

- support

- Understøttet

- synergi

- systemet

- skræddersyet

- Tag

- tager

- materielle

- Opgaver

- opgaver

- hold

- hold

- teknik

- Teknologier

- Teknologier

- testamente

- tekst

- end

- at

- Landskabet

- The Source

- verdenen

- deres

- Them

- derefter

- derved

- Disse

- de

- denne

- tre

- spændende

- Gennem

- tid

- rettidig

- tidsstempel

- titan

- til

- nutidens

- værktøj

- værktøjer

- emne

- Emner

- mod

- traditionelle

- Tog

- uddannet

- Kurser

- overførsel

- overført

- overførsler

- Transform

- transformerende

- transformers

- Tendenser

- virkelig

- troværdig

- TUR

- tutorial

- tutorials

- typer

- ui

- gennemgå

- underliggende

- forstå

- forståelse

- enestående

- universitet

- I modsætning til

- unødvendig

- afsløre

- up-to-date

- Opdatering

- opdateret

- opdateringer

- opretholdelsen

- på

- brug

- brug tilfælde

- Bruger

- Brugergrænseflade

- brugere

- bruger

- ved brug af

- sædvanligvis

- udnytter

- Ved hjælp af

- forskellige

- Vast

- alsidige

- via

- video

- videospil

- visioner

- Vej..

- we

- Rigdom

- web

- Webapplikation

- webservices

- websockets

- var

- hvornår

- som

- mens

- WHO

- bred

- Bred rækkevidde

- vilje

- med

- inden for

- uden

- ord

- Arbejde

- workflow

- arbejdsstation

- world

- Du

- Din

- dig selv

- zephyrnet