Kunder står over for stigende sikkerhedstrusler og sårbarheder på tværs af infrastruktur og applikationsressourcer, efterhånden som deres digitale fodaftryk er blevet udvidet, og forretningsvirkningen af disse digitale aktiver er vokset. En fælles cybersikkerhedsudfordring har været todelt:

- Forbrug af logfiler fra digitale ressourcer, der kommer i forskellige formater og skemaer, og automatisering af analysen af trusselsfund baseret på disse logfiler.

- Uanset om logfiler kommer fra Amazon Web Services (AWS), andre cloud-udbydere, on-premises eller edge-enheder, skal kunderne centralisere og standardisere sikkerhedsdata.

Desuden skal analyserne til at identificere sikkerhedstrusler være i stand til at skalere og udvikle sig for at møde et skiftende landskab af trusselsaktører, sikkerhedsvektorer og digitale aktiver.

En ny tilgang til at løse dette komplekse sikkerhedsanalysescenario kombinerer indtagelse og lagring af sikkerhedsdata ved hjælp af Amazon Security Lake og analysere sikkerhedsdataene med maskinlæring (ML) ved hjælp af Amazon SageMaker. Amazon Security Lake er en specialbygget tjeneste, der automatisk centraliserer en organisations sikkerhedsdata fra cloud- og lokale kilder til en specialbygget datasø, der er gemt på din AWS-konto. Amazon Security Lake automatiserer den centrale styring af sikkerhedsdata, normaliserer logfiler fra integrerede AWS-tjenester og tredjepartstjenester og administrerer datas livscyklus med tilpasselig opbevaring og automatiserer også lagerniveauer. Amazon Security Lake indtager logfiler i Open Cybersecurity Schema Framework (OCSF)-format med understøttelse af partnere som Cisco Security, CrowdStrike, Palo Alto Networks og OCSF-logfiler fra ressourcer uden for dit AWS-miljø. Dette forenede skema strømliner downstream-forbrug og analyser, fordi dataene følger et standardiseret skema, og nye kilder kan tilføjes med minimale ændringer i datapipeline. Efter sikkerhedslogdataene er gemt i Amazon Security Lake, bliver spørgsmålet, hvordan man analyserer dem. En effektiv tilgang til analyse af sikkerhedslogdata er at bruge ML; specifikt anomalidetektion, som undersøger aktivitets- og trafikdata og sammenligner dem med en baseline. Basislinjen definerer, hvilken aktivitet der er statistisk normal for det pågældende miljø. Anomalidetektion skalerer ud over en individuel hændelsessignatur, og den kan udvikle sig med periodisk genoptræning; Trafik, der er klassificeret som unormal eller unormal, kan derefter reageres med prioriteret fokus og uopsættelighed. Amazon SageMaker er en fuldt administreret tjeneste, der gør det muligt for kunder at forberede data og bygge, træne og implementere ML-modeller til enhver brugssituation med fuldt administreret infrastruktur, værktøjer og arbejdsgange, inklusive tilbud uden kode til forretningsanalytikere. SageMaker understøtter to indbyggede anomalidetektionsalgoritmer: IP-indsigt , Random Cut Skov. Du kan også bruge SageMaker til at oprette din egen brugerdefinerede model for afvigende detektering ved hjælp af algoritmer hentet fra flere ML-frameworks.

I dette indlæg lærer du, hvordan du forbereder data hentet fra Amazon Security Lake og derefter træner og implementerer en ML-model ved hjælp af en IP Insights-algoritme i SageMaker. Denne model identificerer unormal netværkstrafik eller adfærd, som derefter kan sammensættes som en del af en større end-to-end sikkerhedsløsning. En sådan løsning kunne påberåbe sig en multi-factor authentication (MFA) kontrol, hvis en bruger logger ind fra en usædvanlig server eller på et usædvanligt tidspunkt, underrette personalet, hvis der er en mistænkelig netværksscanning, der kommer fra nye IP-adresser, advare administratorer, hvis usædvanligt netværk protokoller eller porte bruges, eller beriger IP-indsigts klassificeringsresultatet med andre datakilder som f.eks. Amazon Guard Duty og IP-omdømmescore for at rangere trusselsfund.

Løsningsoversigt

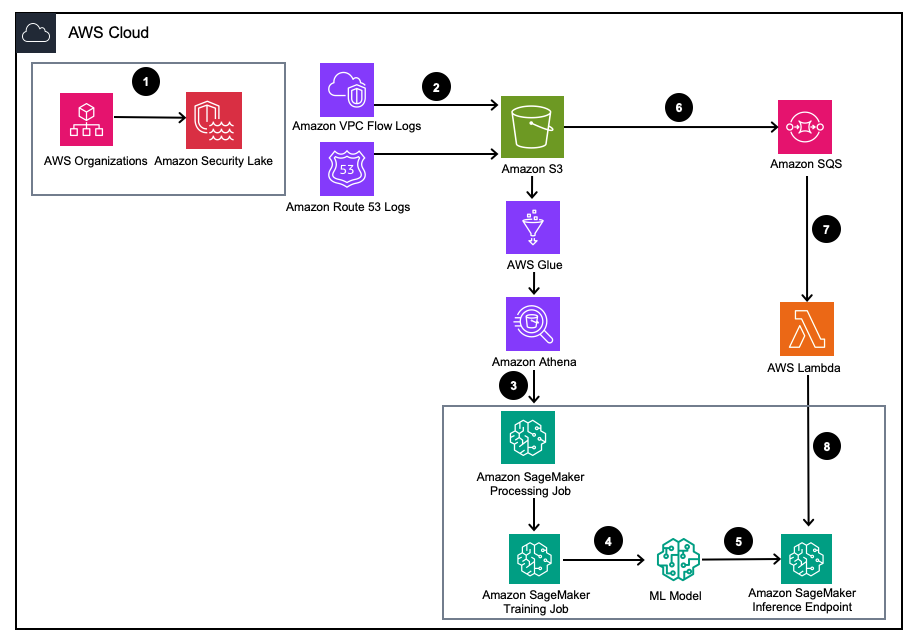

Figur 1 – Løsningsarkitektur

- Aktiver Amazon Security Lake med AWS-organisationer for AWS-konti, AWS-regioner og eksterne it-miljøer.

- Konfigurer Security Lake-kilder fra Amazon Virtual Private Cloud (Amazon VPC) Flow logs og Amazon Route53 DNS-logfiler til Amazon Security Lake S3-bøtten.

- Behandl Amazon Security Lake-logdata ved hjælp af et SageMaker Processing-job for at udvikle funktioner. Brug Amazonas Athena at forespørge strukturerede OCSF-logdata fra Amazon Simple Storage Service (Amazon S3) ved AWS Lim tabeller administreret af AWS LakeFormation.

- Træn en SageMaker ML-model ved hjælp af et SageMaker Training-job, der bruger de behandlede Amazon Security Lake-logfiler.

- Implementer den trænede ML-model til et SageMaker-slutpunkt.

- Gem nye sikkerhedslogfiler i en S3-bøtte, og kør hændelser ind Amazon Simple Queue Service (Amazon SQS).

- Abonner på en AWS Lambda funktion til SQS-køen.

- Kald SageMaker-slutningsendepunktet ved hjælp af en Lambda-funktion til at klassificere sikkerhedslogfiler som anomalier i realtid.

Forudsætninger

For at implementere løsningen skal du først opfylde følgende forudsætninger:

- Aktiver Amazon Security Lake inden for din organisation eller en enkelt konto med både VPC Flow Logs og Route 53 resolver logs aktiveret.

- Sørg for, at AWS Identity and Access Management (IAM) rolle, der bruges af SageMaker, der behandler job og notesbøger, har fået en IAM-politik, herunder Adgangstilladelse til Amazon Security Lake-abonnentforespørgsel til den administrerede Amazon Security-sødatabase og tabeller, der administreres af AWS Lake Formation. Dette behandlingsjob bør køres fra en analyse- eller sikkerhedsværktøjskonto for at forblive kompatibel AWS Security Reference Architecture (AWS SRA).

- Sørg for, at IAM-rollen, der bruges af Lambda-funktionen, har fået tildelt en IAM-politik, herunder Tilladelse til dataadgang for Amazon Security Lake-abonnenter.

Implementer løsningen

For at konfigurere miljøet skal du udføre følgende trin:

- Start en SageMaker Studio eller SageMaker Jupyter notesbog med en

ml.m5.largeinstans. Bemærk: Forekomststørrelsen afhænger af de datasæt, du bruger. - Klon GitHub Repository.

- Åbn notesbogen

01_ipinsights/01-01.amazon-securitylake-sagemaker-ipinsights.ipy. - Gennemfør forudsat IAM-politik , tilsvarende IAM-tillidspolitik for din SageMaker Studio Notebook-instans for at få adgang til alle de nødvendige data i S3, Lake Formation og Athena.

Denne blog gennemgår den relevante del af koden i notesbogen, efter den er implementeret i dit miljø.

Installer afhængighederne og importer det nødvendige bibliotek

Brug følgende kode til at installere afhængigheder, importere de nødvendige biblioteker og oprette den SageMaker S3-bøtte, der er nødvendig til databehandling og modeltræning. Et af de nødvendige biblioteker, awswrangler, er en AWS SDK til pandas dataramme der bruges til at forespørge de relevante tabeller i AWS Glue Data Catalog og gemme resultaterne lokalt i en dataramme.

Forespørg i Amazon Security Lake VPC-flowlogtabellen

Denne del af koden bruger AWS SDK til pandaer til at forespørge i AWS Glue-tabellen relateret til VPC Flow Logs. Som nævnt i forudsætningerne administreres Amazon Security Lake-tabeller af AWS søformation, så alle korrekte tilladelser skal gives til den rolle, der bruges af SageMaker-notesbogen. Denne forespørgsel vil trække flere dages VPC-flowlogtrafik. Datasættet, der blev brugt under udviklingen af denne blog, var lille. Afhængigt af omfanget af din use case, bør du være opmærksom på grænserne for AWS SDK for pandaer. Når du overvejer terabyte-skala, bør du overveje AWS SDK til panda-understøttelse Modin.

Når du ser datarammen, vil du se et output fra en enkelt kolonne med fælles felter, der kan findes i Netværksaktivitet (4001) klasse af OCSF.

Normaliser Amazon Security Lake VPC-flowlogdataene til det krævede træningsformat til IP Insights.

IP Insights-algoritmen kræver, at træningsdataene er i CSV-format og indeholder to kolonner. Den første kolonne skal være en uigennemsigtig streng, der svarer til en enheds unikke identifikator. Den anden kolonne skal være IPv4-adressen for enhedens adgangsbegivenhed i decimalpunktsnotation. I eksempeldatasættet for denne blog er den unikke identifikator instans-id'erne for EC2-instanser, der er knyttet til instance_id værdi inden for dataframe. IPv4-adressen vil blive afledt af src_endpoint. Baseret på den måde, Amazon Athena-forespørgslen blev oprettet, er de importerede data allerede i det korrekte format til træning af en IP Insights-model, så der kræves ingen yderligere funktionsudvikling. Hvis du ændrer forespørgslen på en anden måde, skal du muligvis inkorporere yderligere funktionsteknik.

Forespørg og normaliser Amazon Security Lake Route 53-resolver-logtabellen

Ligesom du gjorde ovenfor, kører næste trin i notebooken en lignende forespørgsel mod Amazon Security Lake Route 53-resolvertabellen. Da du vil bruge alle OCSF-kompatible data i denne notesbog, forbliver alle funktionstekniske opgaver de samme for Route 53-resolverlogs, som de var for VPC Flow Logs. Du kombinerer derefter de to datarammer til en enkelt dataramme, der bruges til træning. Da Amazon Athena-forespørgslen indlæser dataene lokalt i det korrekte format, er der ikke behov for yderligere funktionsudvikling.

Få IP Insights træningsbillede og træne modellen med OCSF-dataene

I denne næste del af notesbogen træner du en ML-model baseret på IP Insights-algoritmen og bruger den konsoliderede dataframe af OCSF fra forskellige typer logs. En liste over IP Insights hyperparmetre kan findes link.. I eksemplet nedenfor valgte vi hyperparametre, der udsendte den bedst ydende model, for eksempel 5 for epoke og 128 for vector_dim. Da træningsdatasættet for vores prøve var relativt lille, brugte vi en ml.m5.large eksempel. Hyperparametre og dine træningskonfigurationer såsom antal forekomster og forekomsttype bør vælges baseret på dine objektive metrics og din træningsdatastørrelse. En funktion, som du kan bruge i Amazon SageMaker til at finde den bedste version af din model, er Amazon SageMaker automatisk model tuning der søger efter den bedste model på tværs af en række hyperparameterværdier.

Implementer den trænede model og test med gyldig og unormal trafik

Efter at modellen er blevet trænet, implementerer du modellen til et SageMaker-slutpunkt og sender en række unikke identifikator- og IPv4-adressekombinationer for at teste din model. Denne del af koden antager, at du har testdata gemt i din S3-bøtte. Testdataene er en .csv-fil, hvor den første kolonne er instans-id'er og den anden kolonne er IP'er. Det anbefales at teste gyldige og ugyldige data for at se resultaterne af modellen. Følgende kode implementerer dit slutpunkt.

Nu hvor dit slutpunkt er implementeret, kan du nu indsende inferensanmodninger for at identificere, om trafikken er potentielt unormal. Nedenfor er et eksempel på, hvordan dine formaterede data skal se ud. I dette tilfælde er den første kolonne-id et instans-id, og den anden kolonne er en tilknyttet IP-adresse som vist i følgende:

Når du har dine data i CSV-format, kan du indsende dataene til slutning ved hjælp af koden ved at læse din .csv-fil fra en S3-bøtte.:

Outputtet for en IP Insights-model giver et mål for, hvor statistisk forventet en IP-adresse og onlineressource er. Området for denne adresse og ressource er dog ubegrænset, så der er overvejelser om, hvordan du vil afgøre, om en kombination af instans-id og IP-adresse skal betragtes som unormal.

I det foregående eksempel blev fire forskellige identifikator- og IP-kombinationer indsendt til modellen. De første to kombinationer var gyldige instans-id- og IP-adressekombinationer, som forventes baseret på træningssættet. Den tredje kombination har den korrekte unikke identifikator, men en anden IP-adresse inden for det samme undernet. Modellen skal afgøre, at der er en beskeden anomali, da indlejringen er lidt anderledes end træningsdataene. Den fjerde kombination har en gyldig unik identifikator, men en IP-adresse på et ikke-eksisterende undernet inden for nogen VPC i miljøet.

Bemærk: Normale og unormale trafikdata vil ændre sig baseret på din specifikke brugssituation, for eksempel: Hvis du ønsker at overvåge ekstern og intern trafik, skal du have en unik identifikator tilpasset hver IP-adresse og et skema til at generere de eksterne identifikatorer.

For at bestemme, hvad din tærskel skal være, for at afgøre, om trafikken er unormal, kan du udføre ved hjælp af kendt normal og unormal trafik. De trin, der er beskrevet i denne eksempel notesbog er som følger:

- Konstruer et testsæt til at repræsentere normal trafik.

- Tilføj unormal trafik til datasættet.

- Plot fordelingen af

dot_productscorer for modellen for normal trafik og den unormale trafik. - Vælg en tærskelværdi, der adskiller den normale delmængde fra den unormale delmængde. Denne værdi er baseret på din falsk-positive tolerance

Opsæt løbende overvågning af ny VPC-flowlogtrafik.

For at demonstrere, hvordan denne nye ML-model kan bruges med Amazon Security Lake på en proaktiv måde, vil vi konfigurere en Lambda-funktion, der skal aktiveres på hver PutObject hændelse inden for Amazon Security Lakes administrerede bucket, specifikt VPC-flowlogdataene. Inden for Amazon Security Lake er der konceptet med en abonnent, der bruger logfiler og hændelser fra Amazon Security Lake. Lambdafunktionen, der reagerer på nye hændelser, skal have et dataadgangsabonnement. Abonnenter med dataadgang får besked om nye Amazon S3-objekter for en kilde, da objekterne skrives til Security Lake-bøtten. Abonnenter kan få direkte adgang til S3-objekterne og modtage meddelelser om nye objekter gennem et abonnementsslutpunkt eller ved at polle en Amazon SQS-kø.

- Åbne Security Lake konsol.

- Vælg i navigationsruden Abonnenter.

- På siden Abonnenter skal du vælge Opret abonnent.

- Indtast for abonnentoplysninger

inferencelambdaforum Abonnent navn og en valgfri Beskrivelse. - Område indstilles automatisk som din aktuelt valgte AWS-region og kan ikke ændres.

- Til Log- og hændelseskilder, vælg Specifikke log- og hændelseskilder Og vælg VPC Flow Logs og Route 53 logs

- Til Dataadgangsmetode, vælg S3.

- Til Abonnent legitimationsoplysninger, angiv dit AWS-konto-id for den konto, hvor Lambda-funktionen vil være, og en brugerspecificeret eksternt ID.

Bemærk: Hvis du gør dette lokalt på en konto, behøver du ikke at have et eksternt ID. - Vælg Opret.

Opret Lambda-funktionen

For at oprette og implementere Lambda-funktionen kan du enten udføre følgende trin eller implementere den forudbyggede SAM-skabelon 01_ipinsights/01.02-ipcheck.yaml i GitHub-repoen. SAM-skabelonen kræver, at du angiver SQS ARN og SageMaker-slutpunktets navn.

- Vælg på Lambda-konsollen Opret funktion.

- Vælg Forfatter fra bunden.

- Til Funktionsnavn, gå ind

ipcheck. - Til Runtime, vælg Python 3.10.

- Til arkitektur, Vælg x86_64.

- Til Udførelsesrolle, Vælg Opret en ny rolle med Lambda-tilladelser.

- Når du har oprettet funktionen, skal du indtaste indholdet af ipcheck.py fil fra GitHub-repoen.

- Vælg i navigationsruden Miljøvariabler.

- Vælg Redigere.

- Vælg Tilføj miljøvariabel.

- Indtast for den nye miljøvariabel

ENDPOINT_NAMEog for værdi skal du indtaste det endepunkts ARN, der blev udsendt under implementeringen af SageMaker-endepunktet. - Type Gem.

- Vælg Implementer.

- Vælg i navigationsruden Konfiguration.

- Type Udløser.

- Type Tilføj trigger.

- Under Vælg en kilde, vælg SQS.

- Under SQS-kø, indtast ARN for den primære SQS-kø oprettet af Security Lake.

- Marker afkrydsningsfeltet for Aktiver trigger.

- Type Tilføj.

Valider Lambda-resultater

- Åbne Amazon CloudWatch-konsol.

- Vælg i venstre siderude Log grupper.

- Indtast ipcheck i søgefeltet, og vælg derefter loggruppen med navnet

/aws/lambda/ipcheck. - Vælg den seneste logstrøm under Log streams.

- I logfilerne bør du se resultater, der ser ud som følgende for hver ny Amazon Security Lake-log:

{'predictions': [{'dot_product': 0.018832731992006302}, {'dot_product': 0.018832731992006302}]}

Denne Lambda-funktion analyserer løbende netværkstrafikken, der indtages af Amazon Security Lake. Dette giver dig mulighed for at bygge mekanismer til at underrette dine sikkerhedsteams, når en specificeret tærskel er overtrådt, hvilket ville indikere en unormal trafik i dit miljø.

Ryd op

Når du er færdig med at eksperimentere med denne løsning og for at undgå gebyrer på din konto, skal du rydde op i dine ressourcer ved at slette S3-bøtten, SageMaker-slutpunktet, lukke computeren, der er knyttet til SageMaker Jupyter-notebooken, slette Lambda-funktionen og deaktivere Amazon Security Lake på din konto.

Konklusion

I dette indlæg lærte du, hvordan du forbereder netværkstrafikdata hentet fra Amazon Security Lake til maskinlæring, og derefter trænede og implementerede du en ML-model ved hjælp af IP Insights-algoritmen i Amazon SageMaker. Alle de trin, der er skitseret i Jupyter-notesbogen, kan replikeres i en ende-til-ende ML-pipeline. Du implementerede også en AWS Lambda-funktion, der forbrugte nye Amazon Security Lake-logfiler og indsendte konklusioner baseret på den trænede anomalidetektionsmodel. ML-modellens svar modtaget af AWS Lambda kunne proaktivt underrette sikkerhedsteams om unormal trafik, når visse tærskler er opfyldt. Kontinuerlig forbedring af modellen kan aktiveres ved at inkludere dit sikkerhedsteam i loop-gennemgangene for at markere, om trafik identificeret som unormalt var en falsk positiv eller ej. Dette kan derefter tilføjes til dit træningssæt og også tilføjes til dit normal trafikdatasæt ved bestemmelse af en empirisk tærskel. Denne model kan identificere potentielt unormal netværkstrafik eller adfærd, hvorved den kan inkluderes som en del af en større sikkerhedsløsning for at starte et MFA-tjek, hvis en bruger logger på fra en usædvanlig server eller på et usædvanligt tidspunkt, advare personalet, hvis der er en mistænkelig netværksscanning, der kommer fra nye IP-adresser, eller kombiner IP-indsigtsresultatet med andre kilder såsom Amazon Guard Duty for at rangere trusselsfund. Denne model kan inkludere brugerdefinerede logkilder såsom Azure Flow-logfiler eller logfiler på stedet ved at tilføje tilpassede kilder til din Amazon Security Lake-implementering.

I del 2 af denne blogindlægsserie lærer du, hvordan du opbygger en anomalidetektionsmodel ved hjælp af Random Cut Skov algoritme trænet med yderligere Amazon Security Lake-kilder, der integrerer netværks- og værtssikkerhedslogdata og anvender sikkerhedsanomaliklassificeringen som en del af en automatiseret, omfattende sikkerhedsovervågningsløsning.

Om forfatterne

Joe Morotti er Solutions Architect hos Amazon Web Services (AWS), der hjælper Enterprise-kunder i hele Midtvesten i USA. Han har haft en bred vifte af tekniske roller og nyder at vise kundens kunst af det mulige. I sin fritid nyder han at bruge kvalitetstid sammen med sin familie på at udforske nye steder og overanalysere sit sportsholds præstationer

Joe Morotti er Solutions Architect hos Amazon Web Services (AWS), der hjælper Enterprise-kunder i hele Midtvesten i USA. Han har haft en bred vifte af tekniske roller og nyder at vise kundens kunst af det mulige. I sin fritid nyder han at bruge kvalitetstid sammen med sin familie på at udforske nye steder og overanalysere sit sportsholds præstationer

Bishr Tabbaa er løsningsarkitekt hos Amazon Web Services. Bishr har specialiseret sig i at hjælpe kunder med applikationer til maskinlæring, sikkerhed og observerbarhed. Uden for arbejdet nyder han at spille tennis, lave mad og tilbringe tid med familien.

Bishr Tabbaa er løsningsarkitekt hos Amazon Web Services. Bishr har specialiseret sig i at hjælpe kunder med applikationer til maskinlæring, sikkerhed og observerbarhed. Uden for arbejdet nyder han at spille tennis, lave mad og tilbringe tid med familien.

Sriharsh Adari er Senior Solutions Architect hos Amazon Web Services (AWS), hvor han hjælper kunder med at arbejde baglæns fra forretningsresultater for at udvikle innovative løsninger på AWS. I årenes løb har han hjulpet adskillige kunder med transformationer af dataplatforme på tværs af brancher. Hans kerneområde omfatter teknologistrategi, dataanalyse og datavidenskab. I sin fritid kan han lide at spille tennis, se tv-serier og spille Tabla.

Sriharsh Adari er Senior Solutions Architect hos Amazon Web Services (AWS), hvor han hjælper kunder med at arbejde baglæns fra forretningsresultater for at udvikle innovative løsninger på AWS. I årenes løb har han hjulpet adskillige kunder med transformationer af dataplatforme på tværs af brancher. Hans kerneområde omfatter teknologistrategi, dataanalyse og datavidenskab. I sin fritid kan han lide at spille tennis, se tv-serier og spille Tabla.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/identify-cybersecurity-anomalies-in-your-amazon-security-lake-data-using-amazon-sagemaker/

- :har

- :er

- :ikke

- :hvor

- $OP

- 01

- 1

- 10

- 100

- 12

- 125

- 15 %

- 17

- 20000

- 25

- 32

- 7

- 9

- a

- over

- adgang

- Konto

- Konti

- tværs

- aktivitet

- aktører

- tilføjet

- tilføje

- Yderligere

- adresse

- adresser

- administratorer

- Efter

- mod

- Alert

- algoritme

- algoritmer

- justeret

- Alle

- tillader

- allerede

- også

- Amazon

- Amazonas Athena

- Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- analyse

- Analytikere

- analytics

- analysere

- analyser

- analysere

- ,

- abnormaliteter

- afsløring af anomalier

- En anden

- enhver

- Anvendelse

- applikationer

- Indløs

- tilgang

- arkitektur

- ER

- OMRÅDE

- Kunst

- AS

- Aktiver

- forbundet

- antager

- At

- Godkendelse

- Automatiseret

- automater

- automatisk

- Automatisering

- undgå

- opmærksom på

- AWS

- AWS Lim

- AWS søformation

- AWS Lambda

- Azure

- Bar

- baseret

- Baseline

- BE

- fordi

- bliver

- været

- adfærd

- være

- jf. nedenstående

- BEDSTE

- Beyond

- Blog

- både

- bygge

- indbygget

- virksomhed

- men

- by

- CAN

- kapacitet

- stand

- tilfælde

- katalog

- central

- centralisere

- vis

- udfordre

- lave om

- Ændringer

- skiftende

- afgifter

- kontrollere

- Vælg

- valgt

- Cisco

- klasse

- klassificering

- klassificeret

- Klassificere

- ren

- Cloud

- kode

- Kolonne

- Kolonner

- kombination

- kombinationer

- kombinerer

- kombinerer

- Kom

- kommer

- Fælles

- fuldføre

- komplekse

- kompatibel

- sammensat

- omfattende

- Compute

- Konceptet

- Overvej

- overvejelser

- betragtes

- Overvejer

- Konsol

- forbruges

- forbrug

- indeholder

- indhold

- løbende

- kontinuerlig

- Core

- korrigere

- svarer

- kunne

- skabe

- oprettet

- For øjeblikket

- skik

- Kunder

- tilpasses

- Klip

- Cybersecurity

- data

- dataadgang

- Dataanalyse

- Data Lake

- Dataplatform

- databehandling

- datalogi

- Database

- datasæt

- Dage

- definerer

- demonstrere

- afhængigheder

- afhængig

- Afhængigt

- indsætte

- indsat

- implementering

- udruller

- Afledt

- detaljer

- Detektion

- Bestem

- bestemmelse

- udvikle

- Udvikling

- Enheder

- DID

- forskellige

- digital

- Digitale aktiver

- direkte

- fordeling

- dns

- gør ikke

- gør

- Don

- færdig

- Dont

- ned

- i løbet af

- e

- hver

- Edge

- Effektiv

- enten

- andet

- indlejring

- aktiveret

- muliggør

- ende til ende

- Endpoint

- ingeniør

- Engineering

- nyde

- berige

- Indtast

- Enterprise

- Miljø

- miljøer

- epoke

- fejl

- begivenhed

- begivenheder

- udvikle sig

- udviklende

- undersøger

- eksempel

- Undtagen

- eksisterer

- udvidet

- forventet

- ekspertise

- Udforskning

- ekstern

- konfronteret

- falsk

- familie

- Feature

- Funktionalitet

- Fields

- File (Felt)

- Filer

- Finde

- fund

- Fornavn

- flow

- Fokus

- efter

- følger

- Fodspor

- Til

- format

- formation

- fundet

- fire

- Fjerde

- FRAME

- rammer

- Gratis

- fra

- fuldt ud

- funktion

- yderligere

- generere

- GitHub

- bevilget

- gruppe

- voksen

- Guard

- Have

- he

- Held

- hjulpet

- hjælpe

- hjælper

- hans

- host

- Hvordan

- How To

- Men

- HTML

- HTTPS

- ID

- identificeret

- identifikator

- identifikatorer

- identificerer

- identificere

- identificere

- Identity

- id'er

- if

- billede

- KIMOs Succeshistorier

- implementeret

- importere

- in

- omfatter

- medtaget

- Herunder

- indarbejde

- stigende

- angiver

- individuel

- industrien

- Infrastruktur

- indlede

- innovativ

- indsigt

- installere

- instans

- integrere

- integreret

- interne

- ind

- påberåbes

- IP

- IP-adresse

- IP-adresser

- IT

- Job

- Karriere

- jpg

- json

- kendt

- etiket

- sø

- landskab

- stor

- større

- LÆR

- lærte

- læring

- til venstre

- biblioteker

- livscyklus

- ligesom

- grænser

- Liste

- belastninger

- lokalt

- log

- Se

- ligner

- maskine

- machine learning

- Main

- lykkedes

- ledelse

- administrerer

- måde

- Kan..

- måle

- mekanismer

- Mød

- nævnte

- mødte

- Metrics

- MFA

- Midtvesten

- mindste

- mangler

- ML

- model

- modeller

- beskedne

- modificeret

- ændre

- Overvåg

- overvågning

- mest

- flere

- skal

- navn

- Navigation

- nødvendig

- Behov

- behov

- netværk

- netværkstrafik

- net

- Ny

- næste

- ingen

- ikke-eksisterende

- normal

- notesbog

- meddelelser

- roman

- nu

- objektiv

- objekter

- of

- tilbud

- on

- ONE

- online

- uigennemsigtig

- or

- organisation

- OS

- Andet

- vores

- udfald

- outlier

- skitseret

- output

- uden for

- i løbet af

- egen

- side

- Palo Alto

- pandaer

- brød

- del

- partnere

- udfører

- periodisk

- tilladelse

- Tilladelser

- pipeline

- Steder

- perron

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- politik

- del

- porte

- positiv

- mulig

- Indlæg

- potentielt

- forud

- Forudsigelser

- Predictor

- Forbered

- forudsætninger

- prioriteret

- private

- Proaktiv

- Behandlet

- forarbejdning

- passende

- protokoller

- give

- udbydere

- giver

- kvalitet

- spørgsmål

- rejse

- rækkevidde

- rangerer

- Læsning

- ægte

- realtid

- modtage

- modtaget

- nylige

- anbefales

- henvisningen

- region

- regioner

- relaterede

- relativt

- relevant

- forblive

- replikeres

- repræsentere

- omdømme

- anmodninger

- påkrævet

- Kræver

- ressource

- Ressourcer

- svar

- reaktioner

- resultere

- Resultater

- tilbageholdelse

- Anmeldelser

- roller

- roller

- R

- Kør

- løber

- sagemaker

- SageMaker Inference

- Sam

- samme

- Eksempeldatasæt

- gemt

- Scale

- skalaer

- skalering

- scanne

- scenarie

- Ordningen

- Videnskab

- score

- SDK

- Søg

- søgninger

- Anden

- sikkerhed

- Sikkerhedsrisici

- se

- Vælg

- valgt

- send

- senior

- Series

- server

- tjeneste

- Tjenester

- Session

- sæt

- bør

- vist

- Shows

- lukker ned

- side

- signatur

- signering

- lignende

- Simpelt

- siden

- enkelt

- Størrelse

- lidt anderledes

- lille

- So

- løsninger

- Løsninger

- SOLVE

- Kilde

- indkøbt

- Kilder

- specialiseret

- specifikke

- specifikt

- specificeret

- udgifterne

- Sport

- Personale

- Trin

- Steps

- opbevaring

- butik

- opbevaret

- Strategi

- strøm

- strømliner

- String

- struktureret

- Studio

- indsende

- indsendt

- subnet

- abonnent

- abonnenter

- abonnement

- sådan

- support

- Understøtter

- mistænksom

- bord

- opgaver

- hold

- hold

- Teknisk

- Teknologier

- Teknologistrategi

- skabelon

- tennis

- prøve

- at

- deres

- derefter

- Der.

- de

- Tredje

- tredjepart

- denne

- dem

- trussel

- trusselsaktører

- trusler

- tærskel

- Gennem

- tid

- til

- værktøjer

- Trafik

- Tog

- uddannet

- Kurser

- transformationer

- Stol

- prøv

- tv

- to

- to gange

- typen

- typer

- under

- forenet

- enestående

- på

- haster

- us

- brug

- brug tilfælde

- anvendte

- Bruger

- bruger

- ved brug af

- udnytte

- udnyttet

- gyldig

- værdi

- Værdier

- variabel

- udgave

- vertikaler

- Specifikation

- krænket

- Virtual

- Sårbarheder

- gåture

- ønsker

- var

- Vej..

- we

- web

- webservices

- var

- Hvad

- hvornår

- hvorvidt

- som

- bred

- Bred rækkevidde

- vilje

- med

- inden for

- Arbejde

- arbejdsgange

- ville

- skriftlig

- år

- Du

- Din

- zephyrnet