Amazon SageMaker-JumpStart ist der Hub für maschinelles Lernen (ML) von SageMaker, der vortrainierte, öffentlich verfügbare Modelle für eine Vielzahl von Problemtypen bereitstellt, um Ihnen den Einstieg in maschinelles Lernen zu erleichtern.

Das Verständnis des Kundenverhaltens ist heute für jedes Unternehmen von höchster Bedeutung. Erkenntnisse darüber zu gewinnen, warum und wie Kunden kaufen, kann zur Umsatzsteigerung beitragen. Kundenabwanderung ist ein Problem, mit dem viele Unternehmen konfrontiert sind, von der Telekommunikation bis zum Bankwesen, wo Kunden normalerweise an Wettbewerber verloren gehen. Es ist im besten Interesse eines Unternehmens, bestehende Kunden zu halten, anstatt neue Kunden zu gewinnen, da die Gewinnung neuer Kunden in der Regel erheblich mehr kostet. Bei dem Versuch, Kunden zu halten, konzentrieren sich Unternehmen oft auf Kunden, die eher abwandern. Benutzerverhalten und Chatprotokolle des Kundensupports können wertvolle Indikatoren für die Wahrscheinlichkeit enthalten, dass ein Kunde den Dienst beendet. In dieser Lösung trainieren und implementieren wir ein Abwanderungsvorhersagemodell, das ein hochmodernes NLP-Modell (Natural Language Processing) verwendet, um nützliche Signale im Text zu finden. Zusätzlich zu Texteingaben verwendet dieses Modell traditionelle strukturierte Dateneingaben wie numerische und kategoriale Felder.

Multimodalität ist ein multidisziplinäres Forschungsgebiet, das einige der ursprünglichen Ziele der künstlichen Intelligenz angeht, indem es mehrere Modalitäten integriert und modelliert. Dieser Beitrag zielt darauf ab, ein Modell zu erstellen, das Informationen aus mehreren Modalitäten wie Tabellen- und Textfunktionen verarbeiten und in Beziehung setzen kann.

Wir zeigen Ihnen, wie Sie ein Abwanderungsvorhersagemodell trainieren, bereitstellen und verwenden, das numerische, kategoriale und textuelle Merkmale verarbeitet hat, um seine Vorhersage zu treffen. Obwohl wir in diesem Beitrag tief in einen Anwendungsfall für die Abwanderungsvorhersage eintauchen, können Sie diese Lösung als Vorlage verwenden, um die Feinabstimmung vortrainierter Modelle mit Ihrem eigenen Datensatz zu verallgemeinern und anschließend die Hyperparameter-Optimierung (HPO) auszuführen, um die Genauigkeit zu verbessern. Sie können den Beispieldatensatz sogar durch Ihren eigenen ersetzen und ihn durchgehend ausführen, um Ihre eigenen Anwendungsfälle zu lösen. Die im Beitrag beschriebene Lösung ist verfügbar unter GitHub.

JumpStart-Lösungsvorlagen

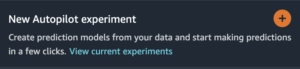

Amazon SageMaker-JumpStart bietet One-Click-End-to-End-Lösungen für viele gängige ML-Anwendungsfälle. Sehen Sie sich die folgenden Anwendungsfälle an, um weitere Informationen zu verfügbaren Lösungsvorlagen zu erhalten:

Die JumpStart-Lösungsvorlagen decken eine Vielzahl von Anwendungsfällen ab, unter denen jeweils mehrere verschiedene Lösungsvorlagen angeboten werden (diese Document Understanding-Lösung befindet sich unter dem Anwendungsfall „Daten aus Dokumenten extrahieren und analysieren“).

Wählen Sie auf der Landingpage von JumpStart die Lösungsvorlage aus, die am besten zu Ihrem Anwendungsfall passt. Weitere Informationen zu spezifischen Lösungen für jeden Anwendungsfall und zum Starten einer JumpStart-Lösung finden Sie unter Lösungsvorlagen.

Lösungsüberblick

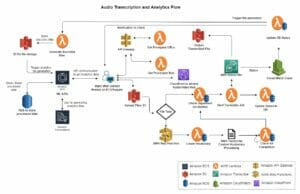

Die folgende Abbildung zeigt, wie Sie diese Lösung mit verwenden können Amazon Sage Maker Komponenten. Die SageMaker-Trainingsjobs werden verwendet, um die verschiedenen NLP-Modelle zu trainieren, und SageMaker-Endpunkte werden verwendet, um die Modelle in jeder Phase bereitzustellen. Wir gebrauchen Amazon Simple Storage-Service (Amazon S3) neben SageMaker zum Speichern der Trainingsdaten und Modellartefakte und Amazon CloudWatch zum Protokollieren von Trainings- und Endpunktausgaben.

Wir nähern uns der Lösung des Churn-Prognose-Problems mit den folgenden Schritten:

- Datenexploration, um die Daten für ML vorzubereiten.

- Trainieren Sie ein multimodales Modell mit a Hugging Face-Satztransformator und Scikit-learn-Random-Forest-Klassifikator.

- Verbessern Sie die Modellleistung mit HPO weiter Automatische Modellabstimmung von SageMaker.

- Trainiere zwei Multimodale AutoGluon-Modelle: ein multimodales gewichtetes/gestapeltes AutoGluon-Ensemble-Modell und ein multimodales AutoGluon-Fusionsmodell.

- Bewerten und vergleichen Sie die Modellleistungen anhand der Holdout-Testdaten.

Voraussetzungen:

Um das auszuprobieren Lösung Stellen Sie in Ihrem eigenen Konto sicher, dass Sie Folgendes eingerichtet haben:

- Ein AWS-Konto. Wenn Sie kein Konto haben, können Sie dies tun melde dich für einen an.

- Die im Beitrag beschriebene Lösung ist Teil von SageMaker JumpStart. Um diese JumpStart-Lösung auszuführen und die Infrastruktur auf Ihrem AWS-Konto bereitzustellen, müssen Sie eine aktive Amazon SageMaker-Studio Instanz (siehe Onboard zu Amazon SageMaker Studio). Wenn Ihre Studio-Instanz bereit ist, verwenden Sie die Anweisungen in JumpStart, um die Lösung zu starten.

- Beim Ausführen dieser Notizbuch auf Studio sollte man sich vergewissern das Python 3 (PyTorch 1.10 Python 3.8 CPU-optimiert) Bild/Kernel wird verwendet.

Sie können die erforderlichen Pakete wie in der Lösung beschrieben installieren, um dieses Notebook auszuführen:

Öffnen Sie den Anwendungsfall für die Abwanderungsvorhersage

Wählen Sie in der Studio-Konsole aus Lösungen, Modelle, Beispielnotebooks für Schnellstart-Lösungen im Navigationsbereich. Navigieren Sie zu Abwanderungsvorhersage mit Text Lösung in JumpStart.

Jetzt können wir uns einige der Assets, die in dieser Lösung enthalten sind, genauer ansehen.

Datenexploration

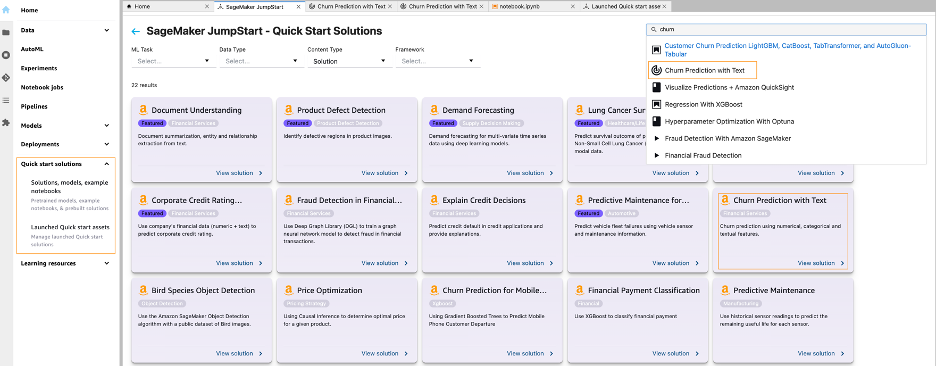

Lassen Sie uns zuerst das Test-, Validierungs- und Trainings-Dataset aus dem S3-Quell-Bucket herunterladen und in unseren S3-Bucket hochladen. Der folgende Screenshot zeigt uns 10 Beobachtungen der Trainingsdaten.

Beginnen wir mit der Untersuchung des Zug- und Validierungsdatensatzes.

Wie Sie sehen können, haben wir verschiedene Funktionen wie z CustServ Calls, Day Charge und Day Calls die wir verwenden, um die Zielspalte vorherzusagen y (ob der Kunde den Service verlassen hat).

y als die bekannte Zielattribut: das Attribut, das das ML-Modell vorhersagen soll. Da das Zielattribut binär ist, führt unser Modell eine binäre Vorhersage durch, auch bekannt als binäre Klassifikation.

Es gibt 21 Merkmale, einschließlich der Zielvariablen. Die Anzahl der Beispiele für Trainings- und Validierungsdaten beträgt 43,000 bzw. 5,000.

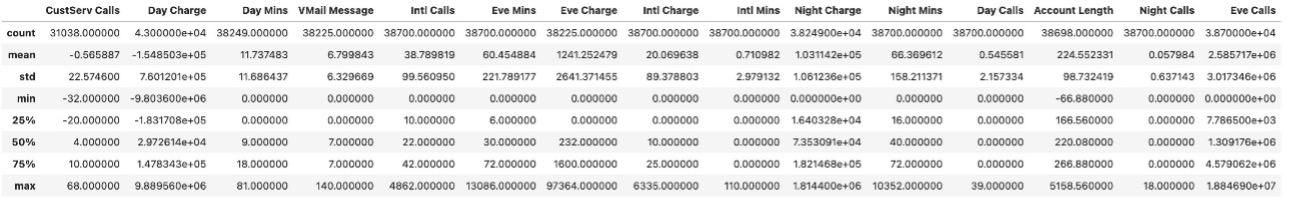

Der folgende Screenshot zeigt die zusammenfassende Statistik des Trainingsdatensatzes.

Wir haben den Datensatz untersucht und ihn in Trainings-, Validierungs- und Testsätze aufgeteilt. Das Trainings- und Validierungsset wird für Training und HPO verwendet. Der Testsatz wird als Holdout-Satz für die Bewertung der Modellleistung verwendet. Wir führen nun Feature-Engineering-Schritte durch und passen dann das Modell an.

Passen Sie ein multimodales Modell mit einem Hugging Face-Satztransformator und einem Scikit-learn-Random-Forest-Klassifikator an

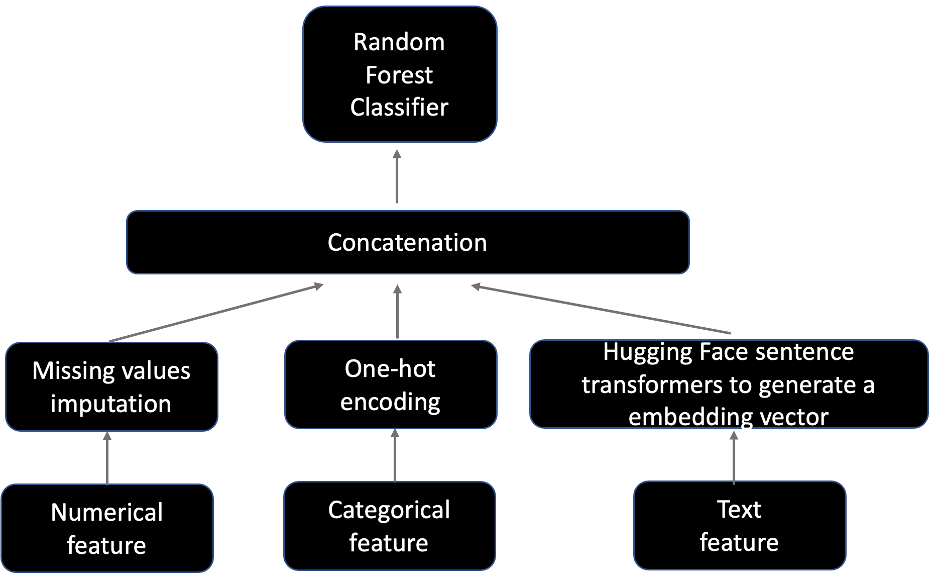

Das Modelltraining besteht aus zwei Komponenten: einem Feature-Engineering-Schritt, der numerische, kategoriale und Text-Features verarbeitet, und einem Modellanpassungsschritt, der die transformierten Features in a einpasst Scikit-learn-Random-Forest-Klassifikator.

Für das Feature Engineering führen wir folgende Schritte durch:

- Tragen Sie die fehlenden Werte für numerische Merkmale ein.

- Codieren Sie kategoriale Merkmale in One-Hot-Werte, wobei die fehlenden Werte als eine der Kategorien für jedes Merkmal gezählt werden.

- Verwenden Hugging Face-Satztransformator um das Textmerkmal zu codieren, um einen X-dimensionalen dichten Vektor zu erzeugen, wobei der Wert von X von einem bestimmten Satztransformator abhängt.

Wir wählen die drei am häufigsten heruntergeladenen Satztransformatormodelle aus und verwenden sie in der folgenden Modellanpassung und HPO. Insbesondere verwenden wir All-MiniLM-L6-v2, multi-qa-mpnet-base-dot-v1 und Paraphrase-MiniLM-L6-v2. Informationen zu Hyperparametern des Random-Forest-Klassifikators finden Sie in der GitHub Repo.

Die folgende Abbildung zeigt das Diagramm der Modellarchitektur.

Es gibt viele Hyperparameter, die Sie optimieren können, z. B. n-Schätzer, maximale Tiefe und Bootstrap. Weitere Einzelheiten finden Sie unter GitHub Repo.

Zu Demonstrationszwecken verwenden wir nur numerische Merkmale CustServ Calls und Account Length, kategoriale Merkmale plan und limit, und Textfunktion text zum Modell passen. Mehrere Features sollten durch , getrennt werden.

Wir stellen das Modell nach Abschluss des Trainings bereit:

Beim Aufruf unseres neuen Endpunkts vom Notebook aus verwenden wir ein SageMaker-SDK Predictor. Eine Predictor wird verwendet, um Daten an einen Endpunkt (als Teil einer Anfrage) zu senden und die Antwort zu interpretieren. JSON wird als Format sowohl für Eingabedaten als auch für Ausgabeantworten verwendet, da es sich um ein standardmäßiges Endpunktformat handelt und die Endpunktantwort verschachtelte Datenstrukturen enthalten kann.

Nachdem unser Modell erfolgreich bereitgestellt und unser Prädiktor konfiguriert wurde, können wir das Abwanderungsvorhersagemodell an einer Beispieleingabe ausprobieren:

Der folgende Code zeigt die Antwort (Abwanderungswahrscheinlichkeit) auf die Abfrage des Endpunkts:

Beachten Sie, dass die von diesem Modell zurückgegebene Wahrscheinlichkeit nicht kalibriert wurde. Wenn das Modell beispielsweise eine Abwanderungswahrscheinlichkeit von 20 % angibt, bedeutet dies nicht zwangsläufig, dass 20 % der Kunden mit einer Abwanderungswahrscheinlichkeit von 20 % zu einer Abwanderung geführt haben. Die Kalibrierung ist unter bestimmten Umständen eine nützliche Eigenschaft, ist jedoch nicht erforderlich, wenn eine Unterscheidung zwischen Fällen von Abwanderung und Nicht-Abwanderung ausreichend ist. Kalibrierter KlassifikatorCV für Scikit-lernen kann verwendet werden, um ein Modell zu kalibrieren.

Jetzt fragen wir den Endpunkt mit den Hold-out-Testdaten ab, die aus 1,939 Beispielen bestehen. Die folgende Tabelle fasst die Bewertungsergebnisse für unser multimodales Modell mit einem Hugging-Face-Satztransformator und einem Scikit-learn-Random-Forest-Klassifikator zusammen.

| Metrisch | BERT + Zufälliger Wald |

| Genauigkeit | 0.77463 |

| ROC-AUC | 0.75905 |

Die Modellleistung hängt von Hyperparameterkonfigurationen ab. Das Trainieren eines Modells mit einem Satz von Hyperparameterkonfigurationen garantiert kein optimales Modell. Daher führen wir im folgenden Abschnitt den HPO-Prozess aus, um die Modellleistung weiter zu verbessern.

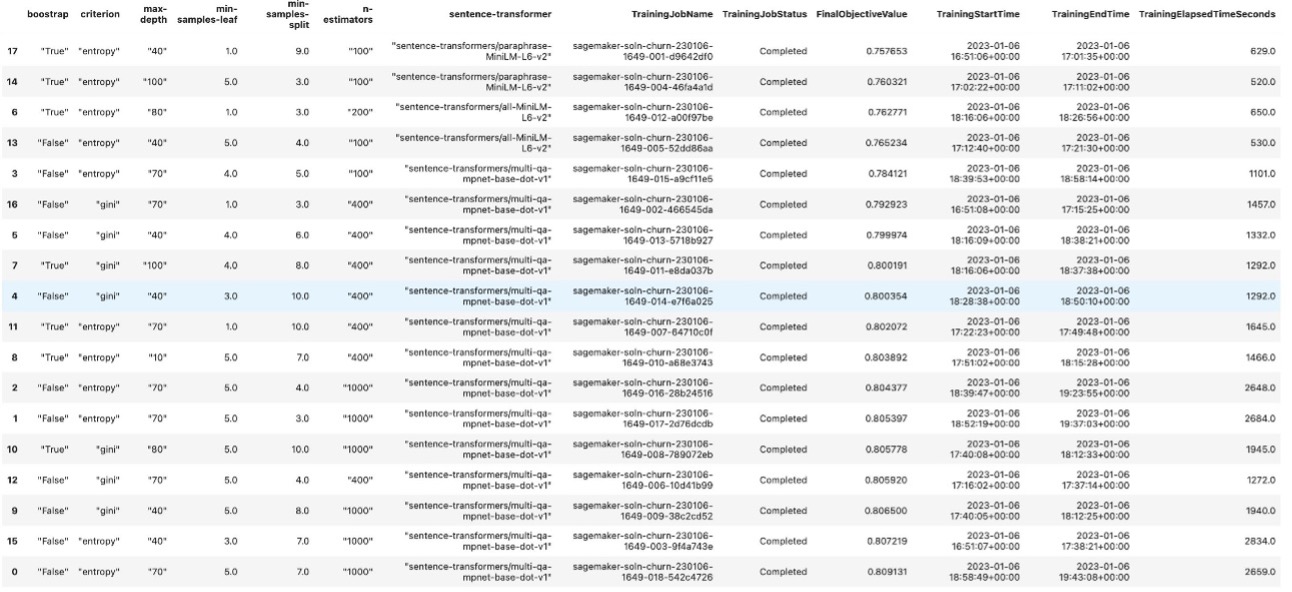

Passen Sie ein multimodales Modell mit HPO an

In diesem Abschnitt verbessern wir die Modellleistung weiter, indem wir HPO-Tuning mit hinzufügen Automatische Modellabstimmung von SageMaker. Die automatische Modelloptimierung von SageMaker, auch bekannt als Hyperparameter-Optimierung, findet die beste Version eines Modells, indem viele Trainingsjobs auf Ihrem Datensatz ausgeführt werden, wobei der Algorithmus und die Bereiche von Hyperparametern verwendet werden, die Sie angeben. Anschließend werden die Hyperparameterwerte ausgewählt, die zu einem Modell führen, das die beste Leistung liefert, gemessen an einer von Ihnen ausgewählten Metrik. Das beste Modell und seine entsprechenden Hyperparameter werden anhand der Validierungsdaten ausgewählt. Als Nächstes wird das beste Modell anhand der Holdout-Testdaten bewertet, bei denen es sich um dieselben Testdaten handelt, die wir im vorherigen Abschnitt erstellt haben. Abschließend zeigen wir, dass die Leistung des mit HPO trainierten Modells deutlich besser ist als die des ohne HPO trainierten.

Das Folgende sind statische Hyperparameter, die wir nicht optimieren, und dynamische Hyperparameter, die wir optimieren möchten, und ihre Suchbereiche:

Wir definieren den Zielmetriknamen, die Metrikdefinition (mit Regex-Muster) und den Zieltyp für den Tuning-Job.

Zuerst legen wir das Ziel als Genauigkeitswert für die Validierungsdaten fest (roc auc score on validation data) und definierte Metriken für den Optimierungsjob, indem Sie den Namen der Zielmetrik und einen regulären Ausdruck (regex) angeben. Der reguläre Ausdruck wird verwendet, um die Protokollausgabe des Algorithmus abzugleichen und die numerischen Werte von Metriken zu erfassen.

Als Nächstes geben wir Hyperparameterbereiche an, aus denen die besten Hyperparameterwerte ausgewählt werden. Wir setzen die Gesamtzahl der Tuning-Jobs auf 10 und verteilen diese Jobs auf fünf verschiedene Amazon Elastic Compute-Cloud (Amazon EC2)-Instances zum Ausführen paralleler Tuning-Jobs.

Schließlich übergeben wir diese Werte, um ein SageMaker Estimator-Objekt zu instanziieren, ähnlich wie im vorherigen Trainingsschritt. Anstatt die Anpassungsfunktion des Estimator-Objekts aufzurufen, übergeben wir das Estimator-Objekt als Parameter an die HyperparameterTuner Konstruktor und rufen Sie die Fit-Funktion davon auf, um Tuning-Jobs zu starten:

Wenn der Tuning-Job abgeschlossen ist, können wir die Übersichtstabelle aller Tuning-Jobs erstellen.

Nachdem die Optimierungsjobs abgeschlossen sind, stellen wir das Modell bereit, das die beste Bewertungsmetrik für das Validierungsdataset liefert, führen eine Inferenz für dasselbe Hold-out-Testdataset durch, das wir im vorherigen Abschnitt durchgeführt haben, und berechnen Bewertungsmetriken.

| Metrisch | BERT + Zufälliger Wald | BERT + Random Forest mit HPO |

| Genauigkeit | 0.77463 | 0.9278 |

| ROC-AUC | 0.75905 | 0.79861 |

Wir können sehen, dass das Ausführen von HPO mit der automatischen Modelloptimierung von SageMaker die Modellleistung erheblich verbessert.

Neben HPO ist die Modellleistung auch vom Algorithmus abhängig. Es ist wichtig, mehrere hochmoderne Algorithmen zu trainieren, ihre Leistung mit denselben Hold-out-Testdaten zu vergleichen und den optimalen auszuwählen. Daher trainieren wir in den folgenden Abschnitten zwei weitere multimodale AutoGluon-Modelle.

Passen Sie ein multimodales gewichtetes/gestapeltes AutoGluon-Ensemble-Modell an

Es gibt zwei Arten von AutoGluon-Multimodalität:

- Trainieren Sie mehrere tabellarische Modelle sowie die

TextPredictorModell (unter Verwendung derTextPredictorModell innerhalb vonTabularPredictor) und kombinieren Sie sie dann entweder über ein gewichtetes Ensemble oder ein gestapeltes Ensemble, wie in erläutert AutoGluon-Tabular: Robustes und genaues AutoML für strukturierte Daten - Verschmelzen Sie mehrere neuronale Netzwerkmodelle direkt und verarbeiten Sie Rohtext (die auch zusätzliche numerische und kategoriale Spalten verarbeiten können).

In diesem Abschnitt trainieren wir zuerst ein multimodales gewichtetes oder gestapeltes Ensemblemodell und im nächsten Abschnitt ein neuronales Fusionsnetzwerkmodell.

Zuerst rufen wir das AutoGluon-Trainingsbild ab:

Als nächstes übergeben wir Hyperparameter. Im Gegensatz zu bestehenden AutoML-Frameworks, die sich hauptsächlich auf die Modell- oder Hyperparameterauswahl konzentrieren, gelingt es AutoGluonTabular, mehrere Modelle zu vereinen und sie in mehreren Schichten zu stapeln. Daher ist HPO normalerweise nicht für AutoGluon-Ensemble-Modelle erforderlich.

Zum Schluss erstellen wir eine SageMaker-Schätzer und Ruf an estimator.fit() um einen Ausbildungsberuf zu beginnen:

Nach Abschluss des Trainings rufen wir das AutoGluon-Inferenzbild ab und stellen das Modell bereit:

Nachdem wir die Endpunkte bereitgestellt haben, fragen wir den Endpunkt mit demselben Testsatz ab und berechnen Bewertungsmetriken. In der folgenden Tabelle sehen wir, dass das multimodale AutoGluon-Ensemble die ROC-AUC im Vergleich zum BERT-Satztransformator und Random Forest mit HPO um etwa 3 % verbessert.

| Metrisch | BERT + Zufälliger Wald | BERT + Random Forest mit HPO | AutoGluon Multimodales Ensemble |

| Genauigkeit | 0.77463 | 0.9278 | 0.92625 |

| ROC-AUC | 0.75905 | 0.79861 | 0.82918 |

Passen Sie ein multimodales AutoGluon-Fusionsmodell an

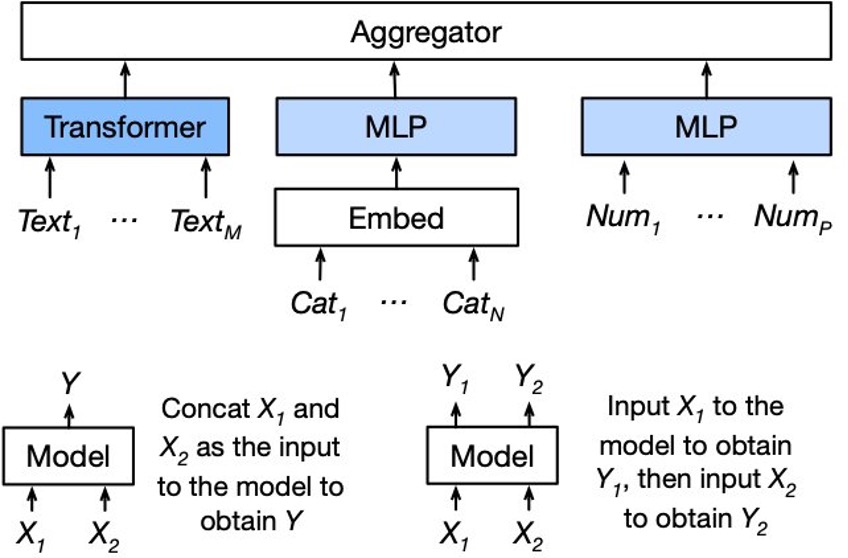

Das folgende Diagramm veranschaulicht die Architektur des Modells. Einzelheiten finden Sie unter AutoMM für Text + Tabellen – Schnellstart.

Intern verwenden wir verschiedene Netzwerke, um die Textspalten, kategorialen Spalten und numerischen Spalten zu codieren. Die von einzelnen Netzwerken generierten Features werden von einem Late-Fusion-Aggregator aggregiert. Der Aggregator kann sowohl die Logits als auch Score-Vorhersagen ausgeben.

Hier verwenden wir das vortrainierte NLP-Backbone, um die Textmerkmale zu extrahieren, und verwenden dann zwei weitere Türme, um das Merkmal aus der kategorialen Spalte und der numerischen Spalte zu extrahieren.

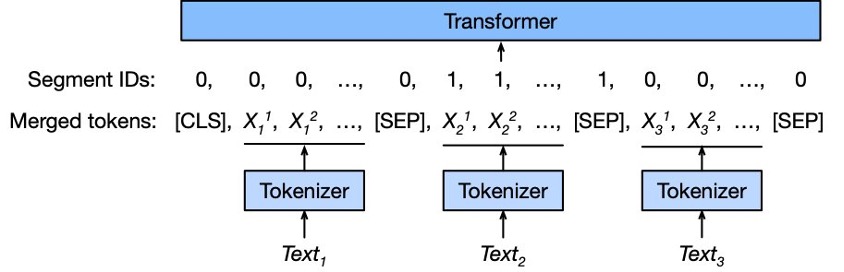

Um mit mehreren Textfeldern umzugehen, trennen wir diese Felder außerdem mit dem [SEP]-Token und abwechselnden Nullen und Einsen als Segment-IDs, wie im folgenden Diagramm gezeigt.

In ähnlicher Weise befolgen wir die Anweisungen im vorherigen Abschnitt, um das multimodale AutoGluon-Fusionsmodell zu trainieren und bereitzustellen:

Die folgende Tabelle fasst die Bewertungsergebnisse für das multimodale AutoGluon-Fusionsmodell zusammen mit denen von drei Modellen zusammen, die wir in den vorherigen Abschnitten bewertet haben. Wir können sehen, dass das multimodale Ensemble AutoGluon und multimodale Fusionsmodelle die beste Leistung erzielen.

| Metrik | BERT + Zufälliger Wald | BERT + Random Forest mit HPO | AutoGluon Multimodales Ensemble | Multimodale AutoGluon-Fusion |

| Genauigkeit | 0.77463 | 0.9278 | 0.92625 | 0.9247 |

| ROC-AUC | 0.75905 | 0.79861 | 0.82918 | 0.81115 |

Beachten Sie, dass die Ergebnisse und die relative Leistung zwischen diesen Modellen von dem Dataset abhängen, das Sie für das Training verwenden. Diese Ergebnisse sind repräsentativ, und obwohl die Tendenz, dass bestimmte Algorithmen besser abschneiden, auf relevanten Faktoren basiert, kann sich das Leistungsgleichgewicht bei einer anderen Datenverteilung ändern. Sie können das Beispiel-Dataset durch Ihre eigenen Daten ersetzen, um zu bestimmen, welches Modell für Sie am besten geeignet ist.

Demo-Notizbuch

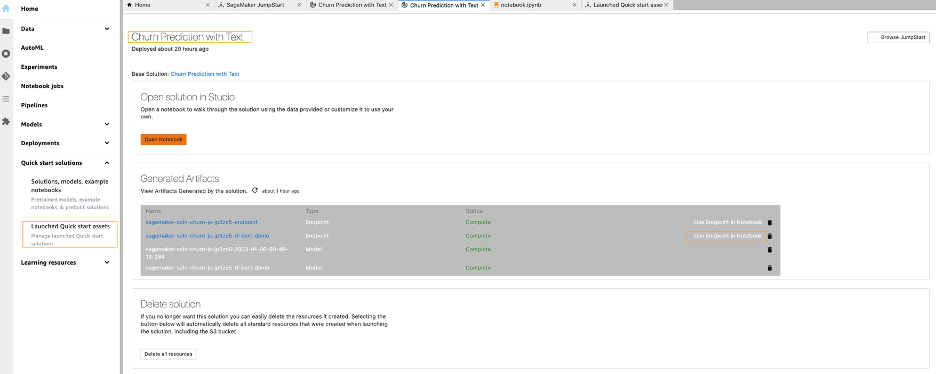

Sie können das Demo-Notebook verwenden, um Beispieldaten an bereits bereitgestellte Modellendpunkte zu senden. Mit dem Demo-Notebook können Sie schnell praktische Erfahrungen sammeln, indem Sie die Beispieldaten abfragen. Nachdem Sie die Lösung Churn Prediction with Text gestartet haben, öffnen Sie das Demo-Notizbuch, indem Sie auswählen Verwenden Sie Endpunkt in Notebook.

Aufräumen

Wenn Sie mit dieser Lösung fertig sind, stellen Sie sicher, dass Sie alle unerwünschten AWS-Ressourcen löschen, indem Sie auswählen Löschen Sie alle Ressourcen.

Beachten Sie, dass Sie alle zusätzlichen Ressourcen, die Sie möglicherweise in diesem Notizbuch erstellt haben, manuell löschen müssen.

Zusammenfassung

In diesem Beitrag haben wir gezeigt, wie Sie mit Sagemaker JumpStart die Abwanderung mithilfe der Multimodalität von Text- und Tabellenfunktionen vorhersagen können.

Wenn Sie mehr über Kundenabwanderungsmodelle erfahren möchten, lesen Sie die folgenden Beiträge:

Über die Autoren

Xin Huang ist ein angewandter Wissenschaftler für Amazon SageMaker JumpStart und die integrierten Algorithmen von Amazon SageMaker. Er konzentriert sich auf die Entwicklung skalierbarer Algorithmen für maschinelles Lernen. Seine Forschungsinteressen liegen im Bereich der Verarbeitung natürlicher Sprache, erklärbares Deep Learning auf tabellarischen Daten und robuste Analyse von nichtparametrischem Raum-Zeit-Clustering. Er hat viele Artikel in ACL-, ICDM-, KDD-Konferenzen und in der Zeitschrift Royal Statistical Society: Series A veröffentlicht.

Xin Huang ist ein angewandter Wissenschaftler für Amazon SageMaker JumpStart und die integrierten Algorithmen von Amazon SageMaker. Er konzentriert sich auf die Entwicklung skalierbarer Algorithmen für maschinelles Lernen. Seine Forschungsinteressen liegen im Bereich der Verarbeitung natürlicher Sprache, erklärbares Deep Learning auf tabellarischen Daten und robuste Analyse von nichtparametrischem Raum-Zeit-Clustering. Er hat viele Artikel in ACL-, ICDM-, KDD-Konferenzen und in der Zeitschrift Royal Statistical Society: Series A veröffentlicht.

Rajakumar Sampathkumar ist Principal Technical Account Manager bei AWS, berät Kunden bei der Ausrichtung von Unternehmen und Technologien und unterstützt die Neuerfindung ihrer Cloud-Betriebsmodelle und -prozesse. Er interessiert sich leidenschaftlich für Cloud und maschinelles Lernen. Raj ist auch ein Spezialist für maschinelles Lernen und arbeitet mit AWS-Kunden zusammen, um ihre AWS-Workloads und -Architekturen zu entwerfen, bereitzustellen und zu verwalten.

Rajakumar Sampathkumar ist Principal Technical Account Manager bei AWS, berät Kunden bei der Ausrichtung von Unternehmen und Technologien und unterstützt die Neuerfindung ihrer Cloud-Betriebsmodelle und -prozesse. Er interessiert sich leidenschaftlich für Cloud und maschinelles Lernen. Raj ist auch ein Spezialist für maschinelles Lernen und arbeitet mit AWS-Kunden zusammen, um ihre AWS-Workloads und -Architekturen zu entwerfen, bereitzustellen und zu verwalten.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/churn-prediction-using-multimodality-of-text-and-tabular-features-with-amazon-sagemaker-jumpstart/

- 000

- 1

- 10

- 100

- 28

- 7

- 70

- 9

- a

- Über Uns

- Konto

- Genauigkeit

- genau

- Erreichen

- Erwerb

- aktiv

- Zusatz

- Zusätzliche

- Adressen

- Nach der

- Makler

- Aggregator

- Ziel

- Algorithmus

- Algorithmen

- Alle

- erlaubt

- neben

- Obwohl

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon SageMaker-JumpStart

- Analyse

- analysieren

- und

- angewandt

- Ansatz

- Architektur

- Bereich

- künstlich

- künstliche Intelligenz

- Details

- automatische

- AutoML

- verfügbar

- AWS

- Backbone (Rückgrat)

- Balance

- Bankinggg

- basierend

- weil

- BESTE

- Besser

- zwischen

- Bootstrap

- bauen

- eingebaut

- Geschäft

- Kaufe

- rufen Sie uns an!

- Aufruf

- Aufrufe

- fähig

- Erfassung

- tragen

- Häuser

- Fälle

- Kategorien

- sicher

- Chance

- Übernehmen

- aus der Ferne überprüfen

- Auswählen

- Auswahl

- Umstände

- Einstufung

- näher

- Cloud

- Clustering

- Code

- Kolonne

- Spalten

- kombinieren

- gemeinsam

- Unternehmen

- Unternehmen

- vergleichen

- verglichen

- Konkurrenz

- abschließen

- Komponenten

- Berechnen

- Kongressbegleitung

- Konsul (Console)

- Container

- Vertrag

- Verträge

- Dazugehörigen

- Kosten

- Abdeckung

- erstellen

- erstellt

- Kunde

- Kundenverhalten

- Kundenservice

- Kundensupport

- Kunden

- technische Daten

- Deal

- Behandlung

- entschieden

- tief

- tiefe Lernen

- abhängig

- hängt

- einsetzen

- Einsatz

- Design

- Details

- Bestimmen

- Entwicklung

- DID

- anders

- Direkt

- verteilen

- Verteilung

- Docker

- Dokument

- Tut nicht

- Nicht

- herunterladen

- dynamisch

- jeder

- Bemühungen

- entweder

- End-to-End

- Endpunkt

- Entwicklung

- Bewerten

- Auswertung

- Sogar

- Beispiel

- Beispiele

- vorhandenen

- ERFAHRUNGEN

- erklärt

- Exploration

- ERKUNDEN

- Erkundet

- Möglichkeiten sondieren

- Extrakt

- äußerst

- Gesicht

- konfrontiert

- Faktoren

- Merkmal

- Eigenschaften

- Feld

- Felder

- Abbildung

- Endlich

- Finden Sie

- findet

- Vorname

- passen

- passend zu

- Setzen Sie mit Achtsamkeit

- konzentriert

- folgen

- Folgende

- Wald

- Format

- Gerüste

- für

- Funktion

- weiter

- Verschmelzung

- gewinnen

- erzeugen

- erzeugt

- bekommen

- gegeben

- gibt

- Gluon

- Ziele

- gut

- Wachsen Sie über sich hinaus

- Garantie

- Griff

- Handling

- praktische

- Hilfe

- hilfreich

- Ultraschall

- Hilfe

- HTML

- HTTPS

- Nabe

- Hyperparameteroptimierung

- Hyperparameter-Tuning

- identifizieren

- Image

- importieren

- wichtig

- zu unterstützen,

- in

- inklusive

- Einschließlich

- Erhöhung

- Anzeigen

- Krankengymnastik

- Information

- Infrastruktur

- Varianten des Eingangssignals:

- Einblicke

- installieren

- Instanz

- beantragen müssen

- Anleitung

- Integration

- Intelligenz

- Interesse

- interessiert

- Interessen

- beteiligt

- Probleme

- IT

- Job

- Jobs

- Zeitschrift

- JSON

- Wesentliche

- Art

- bekannt

- Landung

- Sprache

- starten

- Lagen

- lernen

- Verlassen

- Länge

- wahrscheinlich

- LIMIT

- Line

- Lang

- aussehen

- Maschine

- Maschinelles Lernen

- um

- verwalten

- Manager

- manuell

- viele

- Spiel

- Maximieren

- maximal

- Metrisch

- Metrik

- könnte

- Geist / Bewusstsein

- Kommt demnächst...

- ML

- Modell

- für

- Monat

- Monat

- mehr

- vor allem warme

- multidisziplinär

- mehrere

- Name

- Natürliche

- Verarbeitung natürlicher Sprache

- Navigieren

- Menü

- Notwendig

- Need

- Netzwerk

- Netzwerke

- neuronale Netzwerk

- Neu

- weiter

- Nlp

- Notizbuch

- Anzahl

- Objekt

- Ziel

- angeboten

- EINEM

- XNUMXh geöffnet

- Betrieb

- optimal

- Optimierung

- optimiert

- Original

- Andere

- skizzierte

- besitzen

- Pakete

- Brot

- Papiere

- Parallel

- Parameter

- Teil

- besondere

- leidenschaftlich

- Schnittmuster

- Ausführen

- Leistung

- Leistungen

- führt

- Telefon

- wählen

- Ort

- Plan

- Plato

- Datenintelligenz von Plato

- PlatoData

- Post

- BLOG-POSTS

- vorhersagen

- Prognose

- Prognosen

- Predictor

- Danach

- früher

- in erster Linie

- Principal

- Aufgabenstellung:

- Prozessdefinierung

- Verarbeitet

- anpassen

- Verarbeitung

- Resorts

- bietet

- Bereitstellung

- öffentlich

- veröffentlicht

- Zwecke

- Python

- Pytorch

- Direkt

- schnell

- zufällig

- Angebot

- Roh

- RE

- bereit

- Regex

- regulär

- relevant

- ersetzen

- Vertreter

- Anforderung

- falls angefordert

- Forschungsprojekte

- Downloads

- Antwort

- ansprechbar

- Folge

- Die Ergebnisse

- Einnahmen

- robust

- königlich

- Führen Sie

- Laufen

- sagemaker

- Automatisches SageMaker-Modelltuning

- gleich

- skalierbaren

- Wissenschaftler

- scikit-lernen

- Sdk

- Suche

- Suche

- Abschnitt

- Abschnitte

- Segment

- ausgewählt

- Auswahl

- Satz

- Modellreihe

- Serie A

- kompensieren

- Sets

- mehrere

- sollte

- erklären

- gezeigt

- Konzerte

- Signale

- bedeutend

- ähnlich

- Einfacher

- So

- Gesellschaft

- Lösung

- Lösungen

- LÖSEN

- Auflösung

- einige

- Quelle

- Spezialist

- spezifisch

- speziell

- gespalten

- Sprint

- gestapelt

- Stapeln

- Stufe

- Standard

- Anfang

- begonnen

- State-of-the-art

- statistisch

- Statistiken

- Schritt

- Shritte

- Lagerung

- speichern

- strukturierte

- Studio Adressen

- Anschließend

- Erfolgreich

- so

- ausreichend

- ZUSAMMENFASSUNG

- Support

- Unterstützung

- Tabelle

- Nehmen

- Target

- Tech

- Technische

- Telekommunikation

- Vorlage

- Vorlagen

- AGB

- Test

- Das

- Die Gegend

- Die Quelle

- ihr

- deswegen

- nach drei

- zu

- heute

- Zeichen

- Top

- Gesamt

- traditionell

- Training

- trainiert

- Ausbildung

- verwandelt

- was immer dies auch sein sollte.

- Typen

- typisch

- für

- Verständnis

- unbegrenzt

- unerwünscht

- mehr Stunden

- us

- -

- Anwendungsfall

- Mitglied

- gewöhnlich

- Verwendung

- BESTÄTIGEN

- Bestätigung

- wertvoll

- Wert

- Werte

- Vielfalt

- verschiedene

- Ve

- Verizon

- Version

- Was

- ob

- welche

- WHO

- breit

- Große Auswahl

- werden wir

- ohne

- Arbeiten

- Werk

- würde

- Falsch

- X

- Du

- Ihr

- Zephyrnet