Im Jahr 2021 haben wir gestartet Proaktive AWS-Support-Services als Teil der AWS Enterprise-Support Angebot. Seit der Einführung haben wir Hunderten von Kunden dabei geholfen, ihre Arbeitslasten zu optimieren, Leitplanken festzulegen und die Sichtbarkeit der Kosten und Nutzung ihrer Arbeitslasten für maschinelles Lernen (ML) zu verbessern.

In dieser Beitragsreihe teilen wir unsere Erkenntnisse zur Kostenoptimierung Amazon Sage Maker. in Teil 1Wir haben gezeigt, wie Sie mit der Verwendung beginnen können AWS-Kosten-Explorer um Kostenoptimierungsmöglichkeiten in SageMaker zu identifizieren. In diesem Beitrag konzentrieren wir uns auf verschiedene Möglichkeiten, die SageMaker-Nutzung zu analysieren und Möglichkeiten zur Kostenoptimierung für SageMaker-Notebook-Instanzen zu identifizieren Amazon SageMaker-Studio.

SageMaker-Notebook-Instanzen

A SageMaker-Notebook-Instanz ist eine vollständig verwaltete Recheninstanz, auf der die Jupyter Notebook-App ausgeführt wird. SageMaker verwaltet die Erstellung der Instanz und der zugehörigen Ressourcen. Notebooks enthalten alles, was zum Ausführen oder Neuerstellen eines ML-Workflows erforderlich ist. Sie können Jupyter-Notebooks in Ihrer Notebook-Instanz verwenden, um Daten vorzubereiten und zu verarbeiten, Code zum Trainieren von Modellen zu schreiben, Modelle auf SageMaker Hosting bereitzustellen und Ihre Modelle zu testen oder zu validieren. Die Kosten für SageMaker-Notebook-Instanzen basieren auf den Instanzstunden, die während der Ausführung der Notebook-Instanz verbraucht werden, sowie auf den Kosten für den bereitgestellten Speicher in GB pro Monat, wie unter beschrieben Amazon SageMaker Preise.

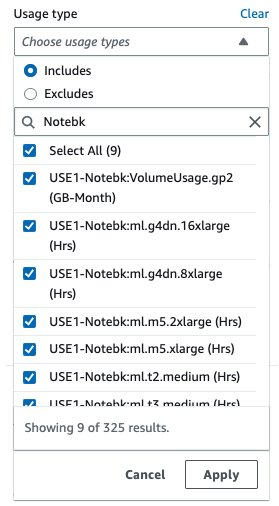

Im Cost Explorer können Sie Notebookkosten filtern, indem Sie einen Filter anwenden Nutzungsart. Die Namen dieser Nutzungsarten sind wie folgt aufgebaut:

REGION-Notebk:instanceType(zum Beispiel,USE1-Notebk:ml.g4dn.8xlarge)REGION-Notebk:VolumeUsage.gp2(zum Beispiel,USE2-Notebk:VolumeUsage.gp2)

Filterung nach Nutzungsart Notebk: zeigt Ihnen eine Liste der Notebook-Nutzungstypen in einem Konto an. Wie im folgenden Screenshot gezeigt, können Sie auswählen Alle auswählen und wählen Sie Bewerben , um die Kostenaufschlüsselung Ihrer Notebook-Nutzung anzuzeigen.

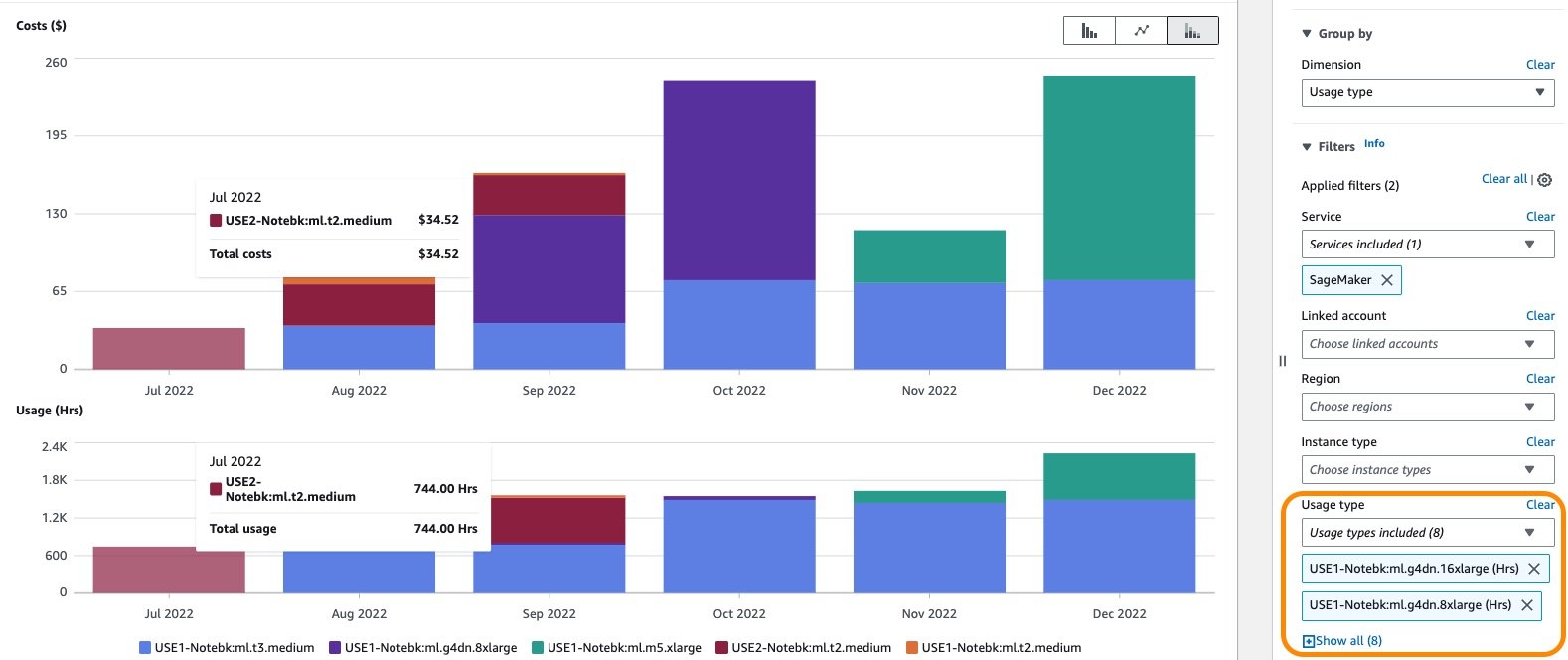

Um die Kostenaufschlüsselung des ausgewählten Notebook-Nutzungstyps nach Anzahl der Nutzungsstunden anzuzeigen, müssen Sie alle abwählen REGION-Notebk:VolumeUsage.gp2 Wählen Sie die Nutzungsarten aus der vorherigen Liste aus und wählen Sie Bewerben um den Filter anzuwenden. Der folgende Screenshot zeigt die Kosten- und Nutzungsdiagramme für die ausgewählten Notebook-Nutzungsarten.

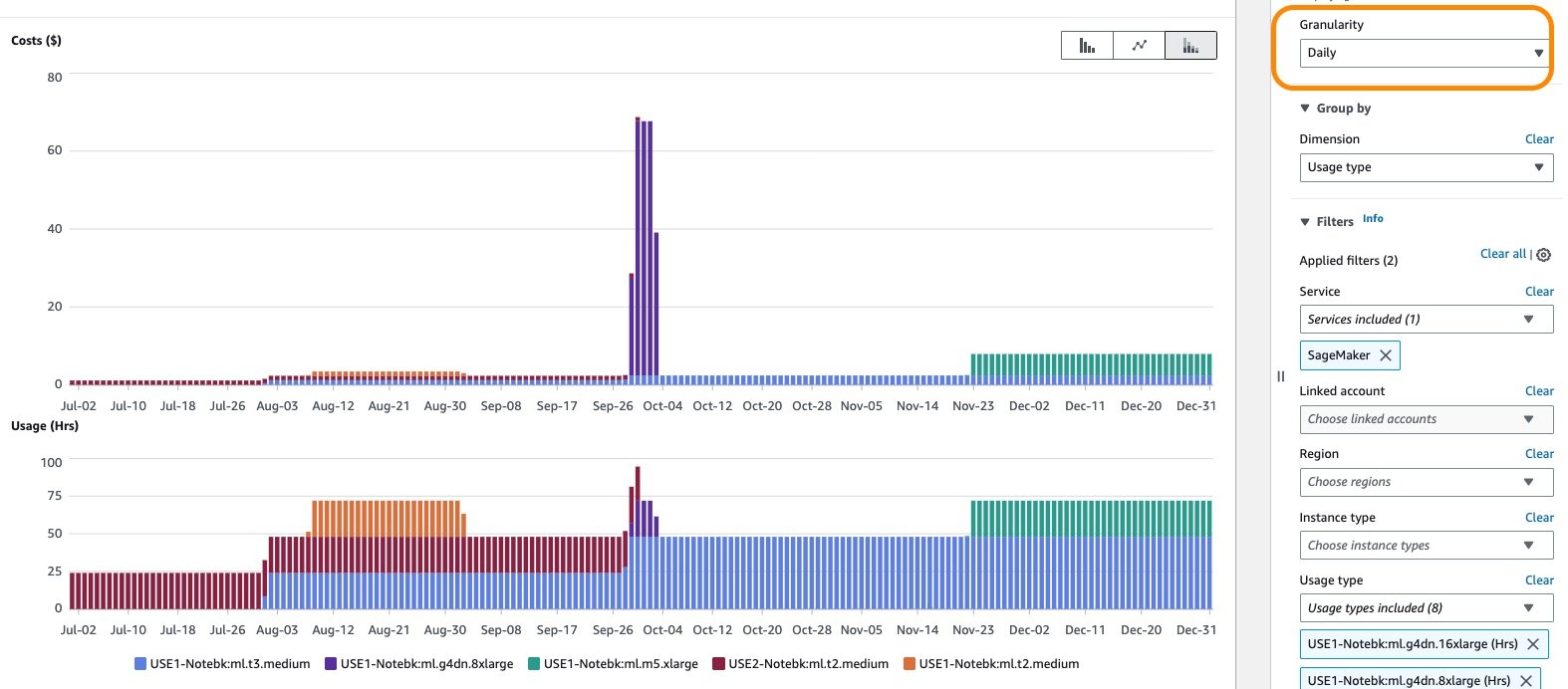

Sie können auch zusätzliche Filter wie Kontonummer, Amazon Elastic Compute-Cloud (Amazon EC2) Instanztyp, Kostenzuordnungs-Tag, Region, und vieles mehr. Ändern der Granularität auf Daily Bietet Ihnen tägliche Kosten- und Nutzungsdiagramme basierend auf den ausgewählten Nutzungsarten und -dimensionen, wie im folgenden Screenshot dargestellt.

Im vorherigen Beispiel meldet die Notebook-Instanz vom Typ ml.t2.medium in der USE2-Region eine tägliche Nutzung von 24 Stunden zwischen dem 2. Juli und dem 26. September. Ebenso die Notebook-Instanz vom Typ ml.t3.medium in Die USE1-Region meldet eine tägliche Nutzung von 24 Stunden zwischen dem 3. August und dem 26. September und eine tägliche Nutzung von 48 Stunden zwischen dem 26. September und dem 31. Dezember. Eine tägliche Nutzung von 24 Stunden oder mehr an mehreren aufeinanderfolgenden Tagen könnte darauf hinweisen, dass eine Notebook-Instanz dies getan hat läuft seit mehreren Tagen, wird aber nicht aktiv genutzt. Diese Art von Muster könnte von der Anwendung von Kostenkontrollrichtlinien wie manuellem oder automatischem Herunterfahren von Notebook-Instanzen profitieren, um Leerlauflaufzeiten zu verhindern.

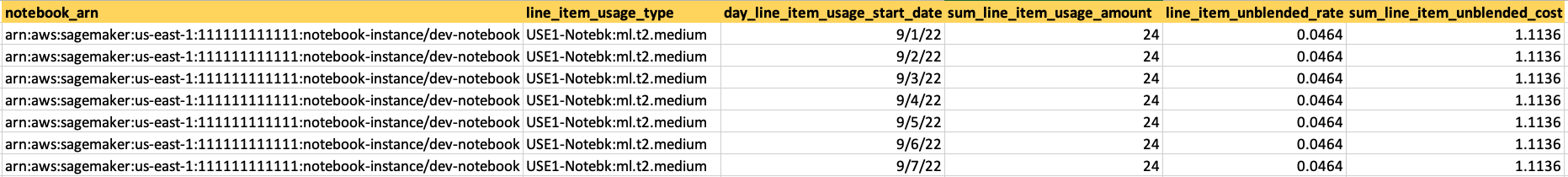

Obwohl Cost Explorer Ihnen hilft, Kosten- und Nutzungsdaten auf der Granularität des Instanztyps zu verstehen, können Sie ihn verwenden AWS-Kosten- und Nutzungsberichte (AWS CUR), um Daten mit der Granularität einer Ressource wie einem Notebook-ARN abzurufen. Sie können benutzerdefinierte Abfragen erstellen, um AWS CUR-Daten mithilfe von Standard-SQL nachzuschlagen. Sie können Ihrer Abfrage auch Kostenzuordnungs-Tags hinzufügen, um eine zusätzliche Granularitätsebene zu erreichen. Die folgende Abfrage gibt die Notebook-Ressourcennutzung für die letzten 3 Monate aus Ihren AWS CUR-Daten zurück:

Der folgende Screenshot zeigt die Ergebnisse der Ausführung der AWS CUR-Abfrage mit Amazonas Athena. Weitere Informationen zur Verwendung von Athena finden Sie unter Abfragen von Kosten- und Nutzungsberichten mit Amazon Athena.

Das Ergebnis der Abfrage zeigt dieses Notizbuch dev-notebook Bei der Ausführung auf einer ml.t2.medium-Instanz wird eine Nutzung von 24 Stunden an mehreren aufeinanderfolgenden Tagen gemeldet. Der Instanzpreis beträgt 0.0464 $/Stunde und die täglichen Kosten für eine 24-stündige Ausführung betragen 1.1136 $.

Die Ergebnisse der AWS CUR-Abfrage können Ihnen dabei helfen, Muster von Notebooks zu erkennen, die an aufeinanderfolgenden Tagen ausgeführt werden, und diese zur Kostenoptimierung analysieren zu können. Weitere Informationen und Beispielabfragen finden Sie im AWS CUR-Abfragebibliothek.

Sie können auch AWS CUR-Daten einspeisen Amazon QuickSight, wo Sie es für Berichts- oder Visualisierungszwecke beliebig in Stücke schneiden können. Anweisungen zum Aufnehmen von AWS CUR-Daten in QuickSight finden Sie unter Wie kann ich den AWS Cost and Usage Report (CUR) in Amazon QuickSight aufnehmen und visualisieren.

Optimieren Sie die Kosten für Notebook-Instanzen

SageMaker-Notebooks eignen sich für die ML-Modellentwicklung, die interaktive Datenexploration, Skripterstellung, Prototyping von Feature-Engineering und Modellierung umfasst. Jede dieser Aufgaben kann unterschiedliche Anforderungen an die Rechenressourcen stellen. Die Einschätzung der richtigen Art von Computerressourcen zur Bewältigung verschiedener Arbeitslasten ist eine Herausforderung und kann zu einer Überbereitstellung von Ressourcen führen, was zu höheren Kosten führt.

Bei der ML-Modellentwicklung hängt die Größe einer SageMaker-Notebook-Instanz von der Datenmenge ab, die Sie für aussagekräftige explorative Datenanalysen (EDA) in den Speicher laden müssen, und vom erforderlichen Rechenaufwand. Wir empfehlen, klein mit Allzweckinstanzen (z. B. T- oder M-Familien) anzufangen und nach Bedarf zu skalieren. Beispielsweise reicht ml.t2.medium für die meisten grundlegenden Datenverarbeitungs-, Feature-Engineering- und EDA-Anwendungen aus, die kleine Datensätze verarbeiten, die in einem Speicher von 4 GB gespeichert werden können. Wenn Ihre Modellentwicklung einen hohen Rechenaufwand erfordert (z. B. Bildverarbeitung), können Sie Ihre kleinere Notebook-Instanz stoppen und den Instanztyp in die gewünschte größere Instanz ändern, z. B. ml.c5.xlarge. Sie können zur kleineren Instanz zurückwechseln, wenn Sie keine größere Instanz mehr benötigen. Dies wird dazu beitragen, die Rechenkosten niedrig zu halten.

Berücksichtigen Sie die folgenden Best Practices, um die Kosten Ihrer Notebook-Instanzen zu senken.

CPU vs. GPU

Die Berücksichtigung von CPU- und GPU-Notebook-Instanzen ist beispielsweise für die richtige Dimensionierung wichtig. CPUs sind am besten in der Lage, einzelne, komplexere Berechnungen nacheinander durchzuführen, während GPUs besser in der Lage sind, mehrere, aber einfache Berechnungen parallel durchzuführen. Für viele Anwendungsfälle bietet ein Standard-Instance-Typ der aktuellen Generation aus einer Instance-Familie wie M genügend Rechenleistung, Speicher und Netzwerkleistung, damit Notebooks eine gute Leistung erbringen.

GPUs bieten ein hervorragendes Preis-Leistungs-Verhältnis, wenn Sie sie effektiv nutzen. Wenn Sie beispielsweise Ihr Deep-Learning-Modell auf einem SageMaker-Notebook trainieren und Ihr neuronales Netzwerk relativ groß ist und eine große Anzahl von Berechnungen mit Hunderttausenden von Parametern durchführt, kann Ihr Modell die Vorteile der beschleunigten Rechen- und Hardwareparallelität nutzen durch GPU-Instanzen wie P-Instanzfamilien. Es wird jedoch empfohlen, GPU-Instanzen nur dann zu verwenden, wenn Sie sie wirklich benötigen, da sie teuer sind und der GPU-Kommunikationsaufwand möglicherweise sogar die Leistung beeinträchtigt, wenn Ihr Notebook sie nicht benötigt. Wir empfehlen, für die interaktive Erstellung Notebooks mit Instanzen zu verwenden, deren Rechenleistung kleiner ist, und die schwere Arbeit kurzlebigen Trainings-, Optimierungs- und Verarbeitungsaufgaben mit größeren Instanzen, einschließlich GPU-fähigen Instanzen, zu überlassen. Auf diese Weise müssen Sie nicht ständig eine große Instanz (oder eine GPU) mit Ihrem Notebook laufen lassen. Wenn Sie eine beschleunigte Datenverarbeitung in Ihrer Notebook-Umgebung benötigen, können Sie Ihre Notebook-Instanz der m*-Familie stoppen, zu einer GPU-fähigen Instanz der P*-Familie wechseln und sie erneut starten. Vergessen Sie nicht, es wieder umzuschalten, wenn Sie diesen zusätzlichen Schub in Ihrer Entwicklungsumgebung nicht mehr benötigen.

Beschränken Sie den Benutzerzugriff auf bestimmte Instanztypen

Administratoren können Benutzer daran hindern, zu große Notizbücher zu erstellen AWS Identity and Access Management and (IAM)-Richtlinien. Mit der folgenden Beispielrichtlinie können Benutzer beispielsweise nur kleinere t3-SageMaker-Notebook-Instanzen erstellen:

Administratoren können ebenfalls verwenden AWS-Servicekatalog um die Selbstbedienung von SageMaker-Notizbüchern zu ermöglichen. Dadurch können Sie die Instanztypen einschränken, die Benutzern beim Erstellen eines Notebooks zur Verfügung stehen. Weitere Informationen finden Sie unter Ermöglichen Sie sichere Self-Service-Datenwissenschaft mit Amazon SageMaker-Notebooks und AWS Service Catalog und Starten Sie Amazon SageMaker Studio mit AWS Service Catalog und AWS SSO in der AWS Control Tower-Umgebung.

Stoppen Sie inaktive Notebook-Instanzen

Um Ihre Kosten niedrig zu halten, empfehlen wir Ihnen, Ihre Notebook-Instanzen zu stoppen, wenn Sie sie nicht benötigen, und sie zu starten, wenn Sie sie benötigen. Erwägen Sie die automatische Erkennung inaktiver Notebook-Instanzen und die Verwaltung ihres Lebenszyklus mithilfe eines Lebenszyklus-Konfigurationsskript. Beispielsweise, Auto-Stopp-Leerlauf ist ein Beispiel-Shell-Skript, das ein SageMaker-Notebook stoppt, wenn es länger als eine Stunde inaktiv ist.

AWS unterhält a öffentliches Repository von Notebook-Lebenszyklus-Konfigurationsskripten Diese behandeln allgemeine Anwendungsfälle zum Anpassen von Notebook-Instanzen, einschließlich eines Beispiel-Bash-Skripts zum Stoppen nicht genutzter Notebooks.

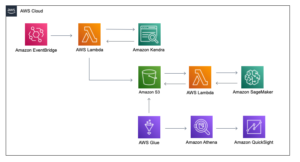

Planen Sie den automatischen Start und Stopp von Notebook-Instanzen

Eine weitere Möglichkeit, Notebookkosten zu sparen, besteht darin, Ihre Notebooks zu bestimmten Zeiten automatisch zu starten und zu stoppen. Sie können dies erreichen, indem Sie verwenden Amazon EventBridge Regeln und AWS Lambda Funktionen. Weitere Informationen zum Konfigurieren Ihrer Lambda-Funktionen finden Sie unter Konfigurieren von Lambda-Funktionsoptionen. Nachdem Sie die Funktionen erstellt haben, können Sie Regeln erstellen, um diese Funktionen nach einem bestimmten Zeitplan auszulösen, z. B. um die Notizbücher jeden Wochentag um 7:00 Uhr zu starten. Sehen Erstellen einer Amazon EventBridge-Regel, die nach einem Zeitplan ausgeführt wird für Anweisungen. Informationen zu den Skripts zum Starten und Stoppen von Notebooks mit einer Lambda-Funktion finden Sie unter Sorgen Sie für effiziente Rechenressourcen auf Amazon SageMaker.

SageMaker-Studio

Studio bietet Datenwissenschaftlern eine vollständig verwaltete Lösung zum interaktiven Erstellen, Trainieren und Bereitstellen von ML-Modellen. Studio-Notebooks sind kollaborative Jupyter-Notebooks mit einem Klick, die schnell gestartet werden können, da Sie zuvor keine Recheninstanzen und keinen Dateispeicher einrichten müssen. Der Compute-Instanztyp, auf dem Sie Ihre Notebooks ausführen, wird Ihnen basierend auf der Nutzungsdauer in Rechnung gestellt. Für die Nutzung von Studio fallen keine zusätzlichen Kosten an. Die für den Betrieb von Studio-Notebooks, interaktiven Shells, Konsolen und Terminals anfallenden Kosten basieren auf der Nutzung der ML-Recheninstanzen.

Beim Start wird die Ressource auf einer ML-Recheninstanz des ausgewählten Instanztyps ausgeführt. Wenn eine Instanz dieses Typs zuvor gestartet wurde und verfügbar ist, wird die Ressource auf dieser Instanz ausgeführt. Für CPU-basierte Images ist der standardmäßig empfohlene Instanztyp ml.t3.medium. Für GPU-basierte Bilder ist der standardmäßig empfohlene Instanztyp ml.g4dn.xlarge. Die Abrechnung erfolgt pro Instanz und beginnt mit dem Start der ersten Instanz eines bestimmten Instanztyps.

Wenn Sie ein Notizbuch erstellen oder öffnen möchten, ohne dass Kosten anfallen, öffnen Sie das Notizbuch über Reichen Sie das Menü und wählen Sie Kein Kernel von dem Wählen Sie Kernel Dialog. Sie können ein Notebook lesen und bearbeiten, ohne dass ein Kernel ausgeführt wird, Sie können jedoch keine Zellen ausführen. Für jede Instanz wird Ihnen eine separate Rechnung gestellt. Die Abrechnung endet, wenn alle KernelGateway-Apps auf der Instanz heruntergefahren werden oder die Instanz heruntergefahren wird. Informationen zur Abrechnung sowie Preisbeispiele finden Sie unter Amazon SageMaker-Preise.

Im Kosten-Explorer können Sie die Kosten für Studio-Notebooks filtern, indem Sie einen Filter anwenden Nutzungsart. Der Name dieser Nutzungsarten ist wie folgt aufgebaut: REGION-studio:KernelGateway-instanceType (zum Beispiel, USE1-Studio:KernelGateway-ml.m5.large)

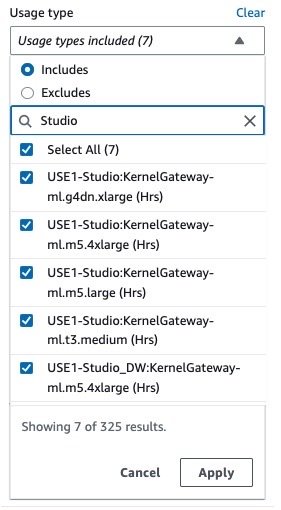

Filterung nach Nutzungsart studio: Im Cost Explorer wird Ihnen die Liste der Studio-Nutzungstypen in einem Konto angezeigt. Sie können die erforderlichen Nutzungsarten auswählen oder auswählen Alle auswählen und wählen Sie Bewerben , um die Kostenaufschlüsselung der Studio-App-Nutzung anzuzeigen. Der folgende Screenshot zeigt die Auswahl aller studio Nutzungsarten zur Kostenanalyse.

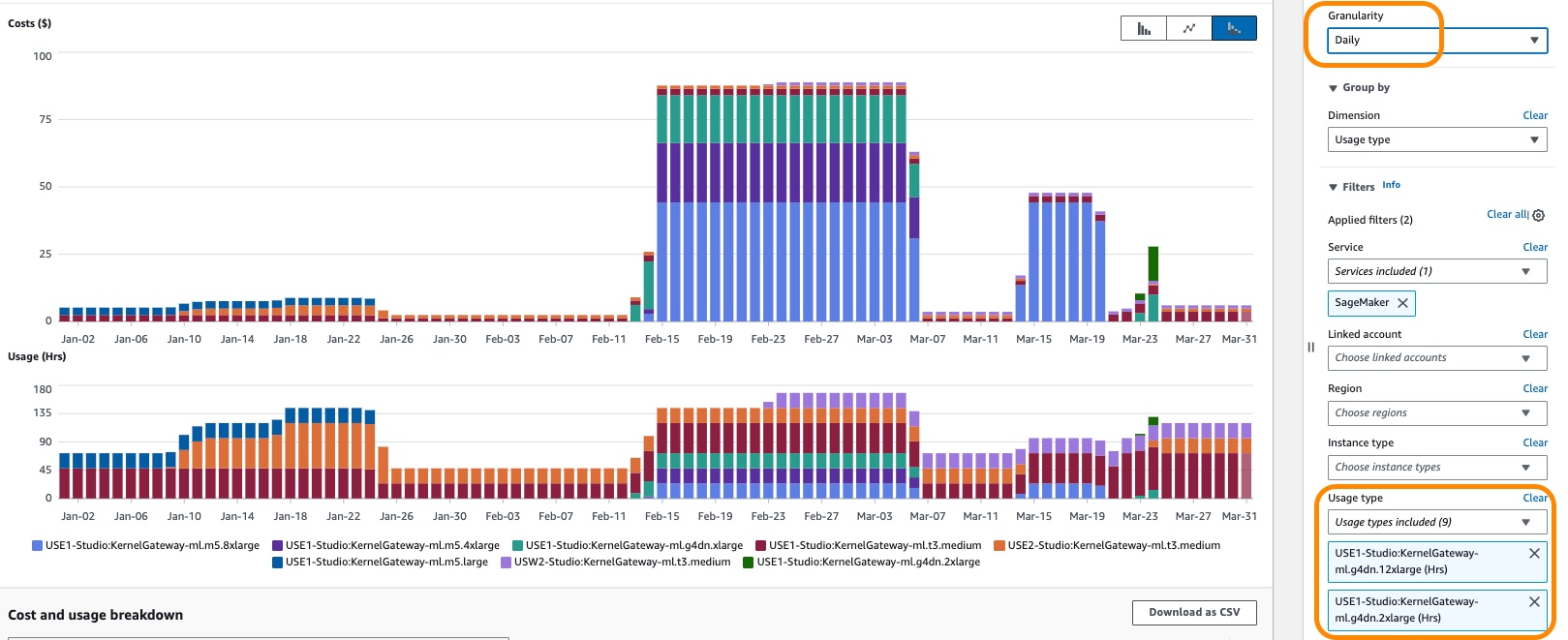

Für eine detailliertere Kostenanalyse können Sie auch zusätzliche Filter wie Region, verknüpftes Konto oder Instanztyp anwenden. Ändern der Granularität auf Daily Bietet Ihnen tägliche Kosten- und Nutzungsdiagramme basierend auf ausgewählten Nutzungsarten und -dimensionen, wie im folgenden Screenshot gezeigt.

Im vorherigen Beispiel meldet die Studio KernelGateway-Instanz vom Typ ml.t3.medium in der USE1-Region eine tägliche Nutzung von 48 Stunden zwischen dem 1. und 24. Januar, gefolgt von einer täglichen Nutzung von 24 Stunden bis zum 11. Februar. Ebenso meldet die Studio KernelGateway-Instanz vom Typ ml.m5.large in der USE1-Region eine tägliche Nutzung von 24 Stunden zwischen dem 1. und 23. Januar. Eine tägliche Nutzung von 24 Stunden oder mehr an mehreren aufeinanderfolgenden Tagen weist darauf hin, dass möglicherweise Studio-Notebook-Instanzen ausgeführt werden kontinuierlich über mehrere Tage. Diese Art von Muster könnte von der Anwendung von Kostenkontrollrichtlinien wie dem manuellen oder automatischen Herunterfahren von Studio-Apps bei Nichtgebrauch profitieren.

Wie bereits erwähnt, können Sie AWS CUR verwenden, um Daten mit der Granularität einer Ressource abzurufen und benutzerdefinierte Abfragen zu erstellen, um AWS CUR-Daten mithilfe von Standard-SQL nachzuschlagen. Sie können Ihrer Abfrage auch Kostenzuordnungs-Tags hinzufügen, um eine zusätzliche Granularitätsebene zu erreichen. Die folgende Abfrage gibt die Ressourcennutzung von Studio KernelGateway für die letzten 3 Monate aus Ihren AWS CUR-Daten zurück:

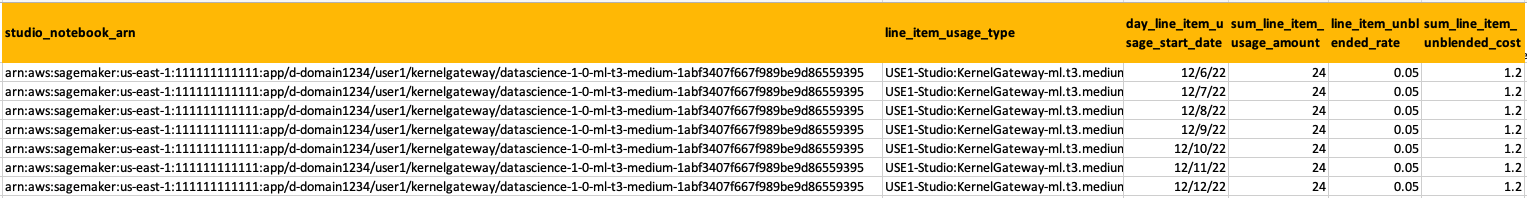

Der folgende Screenshot zeigt die Ergebnisse der Ausführung der AWS CUR-Abfrage mit Athena.

Das Ergebnis der Abfrage zeigt, dass die Studio KernelGateway-App benannt ist datascience-1-0-ml-t3-medium-1abf3407f667f989be9d86559395 läuft im Konto 111111111111, Studio-Domäne d-domain1234und Benutzerprofil user1 Auf einer ml.t3.medium-Instanz wird eine Nutzung von 24 Stunden an mehreren aufeinanderfolgenden Tagen gemeldet. Der Instanzpreis beträgt 0.05 $/Stunde und die täglichen Kosten für eine 24-stündige Ausführung betragen 1.20 $.

Die Ergebnisse der AWS CUR-Abfrage können Ihnen dabei helfen, Muster von Ressourcen zu erkennen, die an aufeinanderfolgenden Tagen auf einer granularen Ebene der stündlichen oder täglichen Nutzung ausgeführt werden, und diese zur Kostenoptimierung analysieren zu können. Wie bei SageMaker-Notebooks können Sie auch AWS CUR-Daten zu Berichts- oder Visualisierungszwecken in QuickSight einspeisen.

SageMaker Data Wrangler

Amazon SageMaker Data Wrangler ist eine Funktion von Studio, die Ihnen hilft, den Prozess der Datenvorbereitung und Feature-Entwicklung über eine visuelle Low-Code-Oberfläche zu vereinfachen. Der Nutzungstypname für eine Studio Data Wrangler-App ist wie folgt strukturiert REGION-Studio_DW:KernelGateway-instanceType (zum Beispiel, USE1-Studio_DW:KernelGateway-ml.m5.4xlarge).

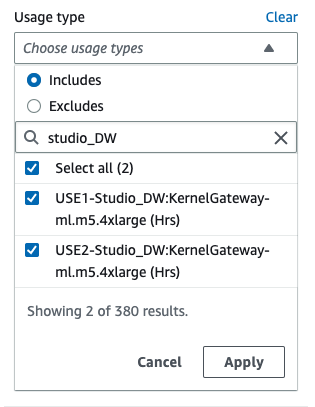

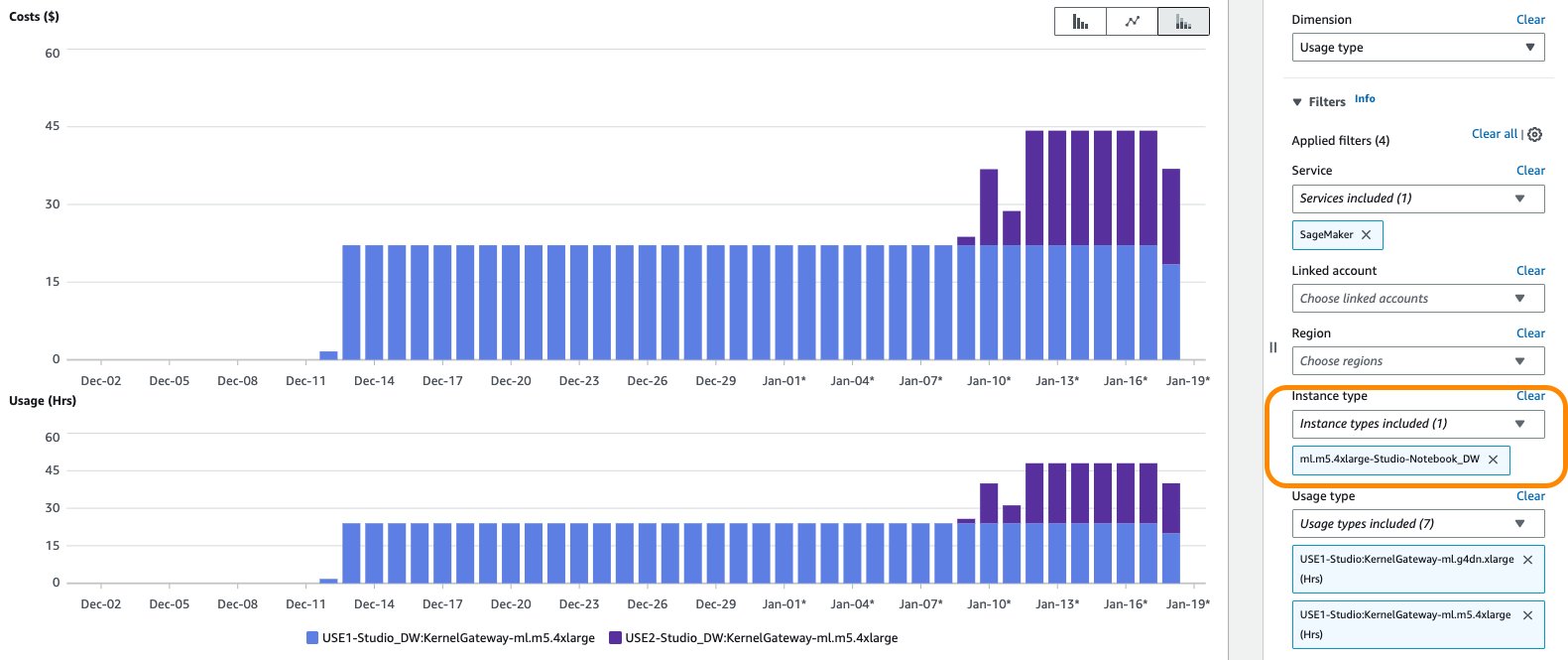

Filterung nach Nutzungsart studio_DW: Im Cost Explorer wird Ihnen die Liste der Studio Data Wrangler-Nutzungstypen in einem Konto angezeigt. Sie können die erforderlichen Nutzungsarten auswählen oder auswählen Alle auswählen und wählen Sie Bewerben um die Kostenaufschlüsselung der Nutzung der Studio Data Wrangler-App anzuzeigen. Der folgende Screenshot zeigt die Auswahl aller studio_DW Nutzungsarten zur Kostenanalyse.

Wie bereits erwähnt, können Sie auch zusätzliche Filter für eine detailliertere Kostenanalyse anwenden. Der folgende Screenshot zeigt beispielsweise 24 Stunden tägliche Nutzung des Studio Data Wrangler-Instanztyps ml.m5.4xlarge in der USE1-Region über mehrere Tage und die damit verbundenen Kosten. Erkenntnisse wie diese können genutzt werden, um Maßnahmen zur Kostenkontrolle anzuwenden, wie z. B. das Herunterfahren von Studio-Apps, wenn sie nicht verwendet werden.

Sie können Informationen auf Ressourcenebene von AWS CUR erhalten und benutzerdefinierte Abfragen erstellen, um AWS CUR-Daten mithilfe von Standard-SQL nachzuschlagen. Die folgende Abfrage gibt die Ressourcennutzung der Studio Data Wrangler-App und die damit verbundenen Kosten für die letzten 3 Monate aus Ihren AWS CUR-Daten zurück:

SELECT bill_payer_account_id, line_item_usage_account_id, line_item_resource_id AS studio_notebook_arn, line_item_usage_type, DATE_FORMAT((line_item_usage_start_date),'%Y-%m-%d') AS day_line_item_usage_start_date, SUM(CAST(line_item_usage_amount AS DOUBLE)) AS sum_line_item_usage_amount, line_item_unblended_rate, SUM(CAST(line_item_unblended_cost AS DECIMAL(16,8))) AS sum_line_item_unblended_cost, line_item_blended_rate, SUM(CAST(line_item_blended_cost AS DECIMAL(16,8))) AS sum_line_item_blended_cost, line_item_line_item_description, line_item_line_item_type FROM {$table_name} WHERE line_item_usage_start_date >= date_trunc('month',current_date - interval '3' month) AND line_item_product_code = 'AmazonSageMaker' AND line_item_line_item_type IN ('DiscountedUsage', 'Usage', 'SavingsPlanCoveredUsage') AND line_item_usage_type like '%Studio_DW:KernelGateway%' AND line_item_operation = 'RunInstance' AND bill_payer_account_id = 'xxxxxxxxxxxx' GROUP BY bill_payer_account_id, line_item_usage_account_id, line_item_resource_id, line_item_usage_type, line_item_unblended_rate, line_item_blended_rate, line_item_line_item_type, DATE_FORMAT((line_item_usage_start_date),'%Y-%m-%d'), line_item_line_item_description ORDER BY line_item_resource_id, day_line_item_usage_start_date

Der folgende Screenshot zeigt die Ergebnisse der Ausführung der AWS CUR-Abfrage mit Athena.

Das Ergebnis der Abfrage zeigt, dass die Studio Data Wrangler-App benannt ist sagemaker-data-wrang-ml-m5-4xlarge-b741c1a025d542c78bb538373f2d läuft im Konto 111111111111, Studio-Domain d-domain1234und Benutzerprofil user1 Auf einer ml.m5.4xlarge-Instanz wird eine Nutzung von 24 Stunden an mehreren aufeinanderfolgenden Tagen gemeldet. Der Instanzpreis beträgt 0.922 $/Stunde und die täglichen Kosten für eine 24-stündige Ausführung betragen 22.128 $.

Optimieren Sie die Studiokosten

Studio-Notebooks werden für den von Ihnen gewählten Instanztyp berechnet, basierend auf der Nutzungsdauer. Sie müssen die Instanz herunterfahren, damit keine Gebühren mehr anfallen. Wenn Sie das auf der Instanz ausgeführte Notebook herunterfahren, die Instanz jedoch nicht herunterfahren, fallen weiterhin Gebühren an. Wenn Sie die Studio-Notebook-Instanzen herunterfahren, werden alle zusätzlichen Ressourcen, wie z. B. SageMaker-Endpunkte, Amazon EMR Cluster und Amazon Simple Storage-Service (Amazon S3) Von Studio erstellte Buckets werden nicht gelöscht. Löschen Sie diese Ressourcen, wenn sie nicht mehr benötigt werden, um die Entstehung von Gebühren zu verhindern. Weitere Informationen zum Herunterfahren von Studio-Ressourcen finden Sie unter Ressourcen herunterfahren. Wenn Sie Data Wrangler verwenden, ist es wichtig, es nach Abschluss Ihrer Arbeit herunterzufahren, um Kosten zu sparen. Einzelheiten finden Sie unter Beenden Sie Data Wrangler.

Berücksichtigen Sie die folgenden Best Practices, um die Kosten Ihrer Studio-Notebooks zu senken.

Stoppen Sie inaktive Studio-Notebook-Instanzen automatisch

Mit können Sie inaktive Studio-Notebook-Ressourcen automatisch stoppen Lebenszykluskonfigurationen im Studio. Sie können auch eine verfügbare JupyterLab-Erweiterung installieren und verwenden GitHub als Studio-Lebenszykluskonfiguration. Ausführliche Anweisungen zur Studio-Architektur und zum Hinzufügen der Erweiterung finden Sie unter Sparen Sie Kosten, indem Sie ungenutzte Ressourcen in Amazon SageMaker Studio automatisch herunterfahren.

Ändern Sie die Größe im Handumdrehen

Der Vorteil von Studio-Notebooks gegenüber Notebook-Instanzen besteht darin, dass Studio die zugrunde liegende Instanz ist Rechenressourcen sind vollständig elastisch und Sie können die Instanz im laufenden Betrieb ändern. Dadurch können Sie die Rechenleistung nach oben und unten skalieren, wenn sich Ihr Rechenbedarf ändert, beispielsweise von ml.t3.medium auf ml.m5.4xlarge, ohne Ihre Arbeit zu unterbrechen oder die Infrastruktur zu verwalten. Der Wechsel von einer Instanz zur anderen erfolgt nahtlos und Sie können weiterarbeiten, während die Instanz gestartet wird. Bei On-Demand-Notebook-Instanzen müssen Sie die Instanz stoppen, die Einstellung aktualisieren und mit dem neuen Instanztyp neu starten. Weitere Informationen finden Sie unter Erfahren Sie, wie Sie ML-Instanzen im laufenden Betrieb in Amazon SageMaker Studio auswählen.

Beschränken Sie den Benutzerzugriff auf bestimmte Instanztypen

Administratoren können IAM verwenden Bedingungsschlüssel als effektive Möglichkeit, bestimmte Instanztypen, wie z. B. GPU-Instanzen, für bestimmte Benutzer einzuschränken und so die Kosten zu kontrollieren. In der folgenden Beispielrichtlinie wird beispielsweise der Zugriff für alle Instanzen außer ml.t3.medium und ml.g4dn.xlarge verweigert. Beachten Sie, dass Sie die Systeminstanz für die Standard-Jupyter-Server-Apps zulassen müssen.

Eine umfassende Anleitung zu Best Practices zur Optimierung der Studio-Kosten finden Sie unter Sorgen Sie für effiziente Rechenressourcen auf Amazon SageMaker.

Verwenden Sie Tags, um die Studio-Kosten im Auge zu behalten

In Studio können Sie Ihrem Studio benutzerdefinierte Tags zuweisen Domain und auch der Nutzer denen Zugriff auf die Domäne gewährt wird. Studio kopiert diese Tags automatisch und weist sie zu Studio-Notebooks von den Benutzern erstellt, sodass Sie die Kosten von Studio-Notebooks einfach verfolgen und kategorisieren und Kostenrückbuchungsmodelle für Ihr Unternehmen erstellen können.

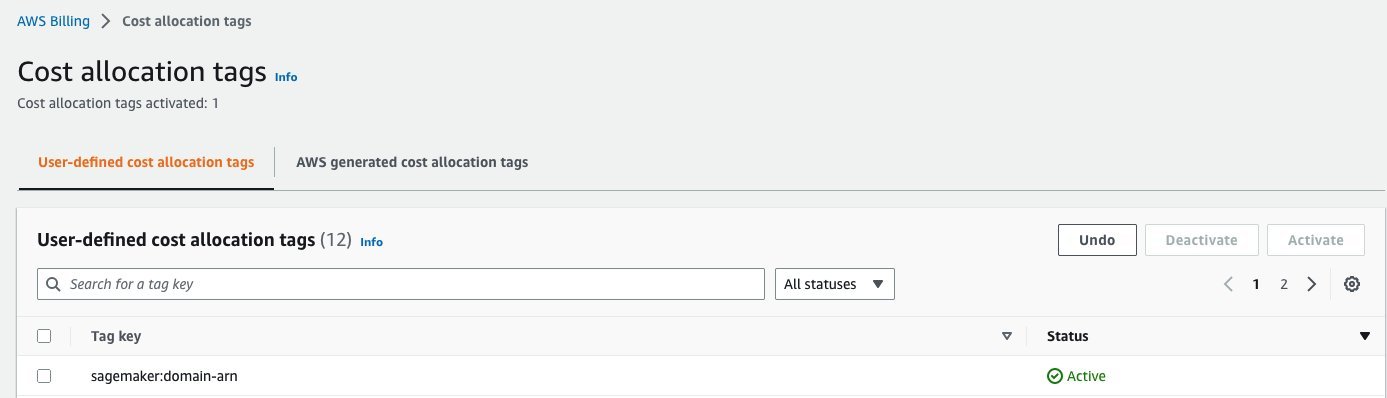

Standardmäßig markiert SageMaker neue SageMaker-Ressourcen wie Trainingsjobs, Verarbeitungsjobs, Experimente, Pipelines und Modellregistrierungseinträge automatisch mit ihren jeweiligen Tags sagemaker:domain-arn. SageMaker kennzeichnet die Ressource auch mit dem sagemaker:user-profile-arn or sagemaker:space-arn um die Ressourcenerstellung auf einer noch granulareren Ebene zu benennen.

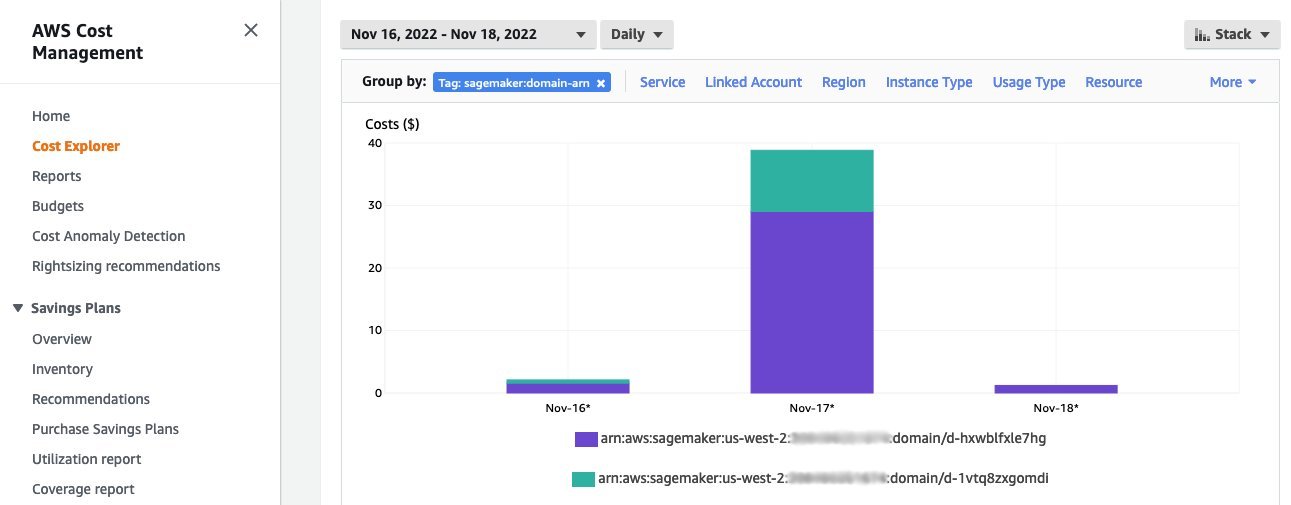

Administratoren können automatisiertes Tagging verwenden, um mit Tools wie AWS-Budgets und Cost Explorer. Sie können beispielsweise eine anhängen Kostenzuordnungskennzeichen für die sagemaker:domain-arn -Tag.

Dadurch können Sie den Cost Explorer verwenden, um die Studio-Notebook-Ausgaben für eine bestimmte Domäne zu visualisieren.

Berücksichtigen Sie die Lagerkosten

Wenn das erste Mitglied Ihres Teams in Studio einsteigt, erstellt SageMaker eine Amazon Elastic File System (Amazon EFS) Volumen für das Team. Wenn dieses Mitglied oder ein Mitglied des Teams Studio öffnet, wird im Volume ein Home-Verzeichnis für das Mitglied erstellt. Für dieses Verzeichnis fällt eine Speichergebühr an. Anschließend fallen zusätzliche Speichergebühren für die im Home-Verzeichnis des Mitglieds gespeicherten Notizbücher und Datendateien an. Weitere Informationen finden Sie unter Amazon EFS-Preise.

Zusammenfassung

In diesem Beitrag haben wir Anleitungen zur Kostenanalyse und Best Practices beim Erstellen von ML-Modellen mithilfe von Notebook-Instanzen und Studio gegeben. Da sich maschinelles Lernen branchenübergreifend als leistungsstarkes Werkzeug etabliert, müssen Schulung und Ausführung von ML-Modellen weiterhin kosteneffektiv bleiben. SageMaker bietet einen breiten und umfassenden Funktionsumfang zur Erleichterung jedes Schritts in der ML-Pipeline und bietet Möglichkeiten zur Kostenoptimierung, ohne die Leistung oder Agilität zu beeinträchtigen.

Über die Autoren

Deepali Rajale ist Senior AI/ML-Spezialist bei AWS. Sie arbeitet mit Unternehmenskunden zusammen und bietet technische Beratung mit Best Practices für die Bereitstellung und Wartung von KI/ML-Lösungen im AWS-Ökosystem. Sie hat mit einer Vielzahl von Organisationen an verschiedenen Deep-Learning-Anwendungsfällen mit NLP und Computer Vision gearbeitet. Ihre Leidenschaft liegt darin, Unternehmen dabei zu unterstützen, generative KI zu nutzen, um ihr Nutzungserlebnis zu verbessern. In ihrer Freizeit genießt sie Filme, Musik und Literatur.

Deepali Rajale ist Senior AI/ML-Spezialist bei AWS. Sie arbeitet mit Unternehmenskunden zusammen und bietet technische Beratung mit Best Practices für die Bereitstellung und Wartung von KI/ML-Lösungen im AWS-Ökosystem. Sie hat mit einer Vielzahl von Organisationen an verschiedenen Deep-Learning-Anwendungsfällen mit NLP und Computer Vision gearbeitet. Ihre Leidenschaft liegt darin, Unternehmen dabei zu unterstützen, generative KI zu nutzen, um ihr Nutzungserlebnis zu verbessern. In ihrer Freizeit genießt sie Filme, Musik und Literatur.

Uri Rosenberg ist der AI & ML Specialist Technical Manager für Europa, den Nahen Osten und Afrika. Uri hat seinen Sitz in Israel und arbeitet daran, Unternehmenskunden in allen ML-Themen dabei zu unterstützen, in großem Maßstab zu entwerfen, zu bauen und zu betreiben. In seiner Freizeit genießt er Radfahren, Wandern, Frühstück, Mittag- und Abendessen.

Uri Rosenberg ist der AI & ML Specialist Technical Manager für Europa, den Nahen Osten und Afrika. Uri hat seinen Sitz in Israel und arbeitet daran, Unternehmenskunden in allen ML-Themen dabei zu unterstützen, in großem Maßstab zu entwerfen, zu bauen und zu betreiben. In seiner Freizeit genießt er Radfahren, Wandern, Frühstück, Mittag- und Abendessen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoAiStream. Web3-Datenintelligenz. Wissen verstärkt. Hier zugreifen.

- Die Zukunft prägen mit Adryenn Ashley. Hier zugreifen.

- Kaufen und verkaufen Sie Anteile an PRE-IPO-Unternehmen mit PREIPO®. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/part-2-analyze-amazon-sagemaker-spend-and-determine-cost-optimization-opportunities-based-on-usage-part-2-sagemaker-notebooks-and-studio/

- :hast

- :Ist

- :nicht

- :Wo

- ][P

- $UP

- 1

- 100

- 11

- 14

- 15%

- 20

- 2021

- 23

- 24

- 26%

- 31

- 7

- 8

- a

- Über Uns

- beschleunigt

- Zugang

- erreichen

- Konto

- über

- Action

- aktiv

- Hinzufügen

- Zusätzliche

- Adresse

- Vorteil

- Afrika

- Nach der

- aufs Neue

- AI

- AI / ML

- Alle

- Zuteilung

- erlauben

- erlaubt

- entlang

- ebenfalls

- am

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon SageMaker-Studio

- Amazon Web Services

- Betrag

- an

- Analysen

- Analyse

- analysieren

- und

- Ein anderer

- jedem

- App

- Bewerben

- Anwendung

- Ansatz

- Apps

- Architektur

- SIND

- AS

- damit verbundenen

- At

- anhängen

- AUGUST

- Automatisiert

- automatische

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- AWS

- Zurück

- basierend

- bash

- basic

- BE

- weil

- war

- Nutzen

- BESTE

- Best Practices

- Besser

- zwischen

- Big

- Rechnungs-

- Auftrieb

- Breakdown

- Frühstück

- bauen

- Building

- Geschäft

- aber

- by

- Berechnungen

- CAN

- Fälle

- Katalog

- Die Zellen

- sicher

- herausfordernd

- Übernehmen

- Änderungen

- Ändern

- berechnen

- berechnet

- Gebühren

- Charts

- Auswählen

- gewählt

- Code

- kollaborative

- gemeinsam

- Kommunikation

- Komplex

- umfassend

- Berechnung

- Berechnen

- Computer

- Computer Vision

- Computing

- Rechenleistung

- Zustand

- Konfiguration

- aufeinanderfolgenden

- Geht davon

- Konsolen

- ständig

- verbraucht

- enthalten

- fortsetzen

- ständig

- Smartgeräte App

- Kontrollturm

- Regelung

- Kosten

- kostengünstiger

- Kosten

- könnte

- erstellen

- erstellt

- schafft

- Erstellen

- Schaffung

- Strom

- Original

- Kunden

- Unterricht

- technische Daten

- Datenaufbereitung

- Datenverarbeitung

- Datenwissenschaft

- Datensätze

- Tage

- Angebote

- Dezember

- tief

- tiefe Lernen

- Standard

- Demand

- hängt

- einsetzen

- Bereitstellen

- Design

- erwünscht

- detailliert

- Details

- Bestimmen

- Entwicklung

- Dialog

- Abmessungen

- Abendessen

- Display

- do

- Tut nicht

- Domain

- erledigt

- Nicht

- doppelt

- nach unten

- Dauer

- jeder

- Früher

- leicht

- Osten

- Ökosystem

- bewirken

- Effektiv

- effektiv

- effizient

- ermächtigen

- Empowerment

- endet

- Entwicklung

- zu steigern,

- genug

- Unternehmen

- Arbeitsumfeld

- etabliert

- Europa

- Sogar

- Jedes

- alles

- Beispiel

- Beispiele

- Außer

- teuer

- ERFAHRUNGEN

- Experimente

- Exploration

- Forscher

- Erweiterung

- extra

- erleichtern

- Familien

- Familie

- Merkmal

- Februar

- Reichen Sie das

- Mappen

- Filter

- Filter

- Vorname

- Setzen Sie mit Achtsamkeit

- gefolgt

- Folgende

- folgt

- Aussichten für

- gefunden

- für

- voll

- Funktion

- Funktionen

- allgemeiner Zweck

- Generation

- generativ

- Generative KI

- bekommen

- gegeben

- gibt

- GPU

- GPUs

- Graphen

- groß

- Gruppe an

- die Vermittlung von Kompetenzen,

- Handling

- Hardware

- Haben

- he

- schwer

- schweres Heben

- Statt

- Hilfe

- dazu beigetragen,

- hilft

- hier (auf dänisch)

- seine

- Startseite

- Hosting

- Stunde

- STUNDEN

- Ultraschall

- Hilfe

- aber

- HTML

- http

- HTTPS

- hunderte

- i

- identifizieren

- Identitätsschutz

- Leerlauf

- if

- Image

- Bilder

- Auswirkungen

- wichtig

- zu unterstützen,

- in

- das

- Dazu gehören

- Einschließlich

- hat

- zeigen

- zeigt

- Krankengymnastik

- Branchen

- Information

- Infrastruktur

- Einblicke

- installieren

- Instanz

- Anleitung

- interaktive

- Schnittstelle

- in

- Einleitung

- Beteiligung

- Israel

- IT

- SEINE

- selbst

- Januar

- Januar 24

- Jobs

- jpg

- Juli

- Behalten

- grosse

- größer

- Nachname

- ins Leben gerufen

- startet

- führen

- gelernt

- lernen

- Verlassen

- links

- Programm

- Lessons Learned

- Niveau

- Hebelwirkung

- Lebenszyklus

- Facelift

- Gefällt mir

- Line

- verknüpft

- Liste

- Kataloge

- Belastung

- länger

- aussehen

- Mittagessen

- Maschine

- Maschinelles Lernen

- Aufrechterhaltung

- unterhält

- verwaltet

- Manager

- Managed

- flächendeckende Gesundheitsprogramme

- manuell

- viele

- Kann..

- sinnvoll

- Maßnahmen

- mittlere

- Mitglied

- Memory

- erwähnt

- MENÜ

- Mitte

- Mittlerer Osten

- könnte

- ML

- Modell

- Modellieren

- für

- Überwachen

- Monat

- Monat

- mehr

- vor allem warme

- Filme

- ziehen um

- mehrere

- Musik

- sollen

- Name

- Namens

- Namen

- notwendig,

- Need

- erforderlich

- Bedürfnisse

- Netzwerk

- neuronale Netzwerk

- Neu

- Nlp

- nicht

- Notizbuch

- bekannt

- Anzahl

- erhalten

- erhalten

- of

- angeboten

- bieten

- Angebote

- on

- On-Demand

- EINEM

- einzige

- XNUMXh geöffnet

- öffnet

- betreiben

- Entwicklungsmöglichkeiten

- Optimierung

- Optimieren

- Optimierung

- or

- Auftrag

- Organisation

- Organisationen

- skizzierte

- übrig

- Parallel

- Parameter

- Teil

- leidenschaftlich

- Schnittmuster

- Muster

- Ausführen

- Leistung

- Durchführung

- Zeit

- Pipeline

- Plato

- Datenintelligenz von Plato

- PlatoData

- Politik durchzulesen

- Datenschutzrichtlinien

- Möglichkeit

- Post

- BLOG-POSTS

- Werkzeuge

- größte treibende

- Praktiken

- Vorbereitung

- Danach

- verhindern

- vorher

- gebühr

- Proaktives Handeln

- Probleme

- Prozessdefinierung

- Verarbeitung

- Profil

- Prototyping

- die

- vorausgesetzt

- bietet

- Bereitstellung

- Zwecke

- Abfragen

- schnell

- Angebot

- Bewerten

- Verhältnis

- Lesen Sie mehr

- wirklich

- empfehlen

- empfohlen

- Veteran

- Region

- Registratur

- bezogene

- verhältnismäßig

- bleiben

- berichten

- Reporting

- Meldungen

- Quelle

- falls angefordert

- Voraussetzungen:

- Ressourcen

- Downloads

- diejenigen

- eine Beschränkung

- Folge

- was zu

- Die Ergebnisse

- Rückgabe

- Recht

- Risiko

- Regel

- Ohne eine erfahrene Medienplanung zur Festlegung von Regeln und Strategien beschleunigt der programmatische Medieneinkauf einfach die Rate der verschwenderischen Ausgaben.

- Führen Sie

- Laufen

- sagemaker

- Speichern

- Skalieren

- Skalierung

- Zeitplan

- Wissenschaft

- Wissenschaftler

- Skripte

- nahtlos

- Gesicherte

- sehen

- ausgewählt

- Auswahl

- Selbstbedienung

- Senior

- September

- Modellreihe

- brauchen

- Lösungen

- kompensieren

- Einstellung

- Teilen

- sie

- Schale

- erklären

- zeigte

- gezeigt

- Konzerte

- schließen

- Schließung

- Herunterfahren

- Ähnlich

- Einfacher

- vereinfachen

- da

- Single

- Größe

- Slice

- klein

- kleinere

- So

- Lösung

- Lösungen

- Spezialist

- spezifisch

- verbringen

- gesponnen

- Standard

- Anfang

- begonnen

- Beginnen Sie

- beginnt

- Schritt

- Immer noch

- Stoppen

- Einstellung

- Stoppt

- Lagerung

- gelagert

- strukturierte

- Studio Adressen

- Anschließend

- so

- ausreichend

- geeignet

- Support

- proaktiv unterstützen

- Schalter

- System

- TAG

- Nehmen

- und Aufgaben

- Team

- Teams

- Technische

- Test

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Dort.

- damit

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- diejenigen

- Tausende

- Durch

- Zeit

- mal

- zu

- auch

- Werkzeug

- Werkzeuge

- Tower

- verfolgen sind

- Training

- Ausbildung

- auslösen

- tippe

- Typen

- zugrunde liegen,

- verstehen

- bis

- Aktualisierung

- Anwendungsbereich

- -

- benutzt

- Mitglied

- Nutzer

- Verwendung von

- Nutzen

- BESTÄTIGEN

- verschiedene

- Sichtbarkeit

- Seh-

- Visualisierung

- Volumen

- vs

- wollen

- wurde

- Weg..

- Wege

- we

- Netz

- Web-Services

- GUT

- wann

- während

- welche

- während

- WHO

- breit

- Große Auswahl

- werden wir

- mit

- .

- ohne

- Arbeiten

- gearbeitet

- Arbeitsablauf.

- arbeiten,

- Werk

- schreiben

- Code schreiben

- Schreiben

- Du

- Ihr

- Zephyrnet