Wir freuen uns, heute die Vorschau von bekannt geben zu können Amazon SageMaker Profiler, eine Fähigkeit von Amazon Sage Maker Dies bietet einen detaillierten Einblick in die AWS-Rechenressourcen, die während des Trainings von Deep-Learning-Modellen auf SageMaker bereitgestellt werden. Mit SageMaker Profiler können Sie alle Aktivitäten auf CPUs und GPUs verfolgen, wie z. B. CPU- und GPU-Auslastung, Kernel-Ausführungen auf GPUs, Kernel-Starts auf CPUs, Synchronisierungsvorgänge, Speichervorgänge zwischen GPUs, Latenzen zwischen Kernel-Starts und entsprechenden Ausführungen sowie Datenübertragung zwischen CPUs und GPUs. In diesem Beitrag führen wir Sie durch die Funktionen von SageMaker Profiler.

SageMaker Profiler bietet Python-Module zum Kommentieren von PyTorch- oder TensorFlow-Trainingsskripten und zum Aktivieren von SageMaker Profiler. Es bietet auch eine Benutzeroberfläche (UI), die das visualisiert profile, eine statistische Zusammenfassung profilierter Ereignisse und die Zeitleiste eines Trainingsjobs zum Verfolgen und Verstehen der zeitlichen Beziehung der Ereignisse zwischen GPUs und CPUs.

Die Notwendigkeit, Ausbildungsberufe zu profilieren

Mit dem Aufkommen von Deep Learning (DL) ist maschinelles Lernen (ML) rechen- und datenintensiv geworden und erfordert typischerweise Cluster mit mehreren Knoten und mehreren GPUs. Da die Größe moderner Modelle in der Größenordnung von Billionen Parametern zunimmt, nehmen auch ihre Rechenkomplexität und -kosten rapide zu. ML-Praktiker müssen sich beim Training solch großer Modelle mit den üblichen Herausforderungen einer effizienten Ressourcennutzung auseinandersetzen. Dies zeigt sich insbesondere bei großen Sprachmodellen (LLMs), die typischerweise über Milliarden von Parametern verfügen und daher große GPU-Cluster mit mehreren Knoten erfordern, um sie effizient zu trainieren.

Wenn wir diese Modelle auf großen Rechenclustern trainieren, können wir auf Herausforderungen bei der Optimierung der Rechenressourcen stoßen, wie z. B. E/A-Engpässe, Latenzen beim Kernel-Start, Speicherbeschränkungen und geringe Ressourcenauslastung. Wenn die Konfiguration des Trainingsjobs nicht optimiert ist, können diese Herausforderungen zu einer ineffizienten Hardwareauslastung und längeren Trainingszeiten oder unvollständigen Trainingsläufen führen, was die Gesamtkosten und Zeitpläne für das Projekt erhöht.

Voraussetzungen:

Für die Verwendung von SageMaker Profiler gelten folgende Voraussetzungen:

- Eine SageMaker-Domäne in Ihrem AWS-Konto – Anweisungen zum Einrichten einer Domäne finden Sie unter Onboarding zur Amazon SageMaker-Domäne mithilfe der Schnelleinrichtung. Sie müssen außerdem Domänenbenutzerprofile für einzelne Benutzer hinzufügen, um auf die SageMaker Profiler-UI-Anwendung zugreifen zu können. Weitere Informationen finden Sie unter Fügen Sie SageMaker-Domänenbenutzerprofile hinzu und entfernen Sie sie.

- Berechtigungen – Die folgende Liste enthält den Mindestsatz an Berechtigungen, die der Ausführungsrolle für die Verwendung der SageMaker Profiler-UI-Anwendung zugewiesen werden sollten:

sagemaker:CreateAppsagemaker:DeleteAppsagemaker:DescribeTrainingJobsagemaker:SearchTrainingJobss3:GetObjects3:ListBucket

Bereiten Sie einen Trainingsjob mit SageMaker Profiler vor und führen Sie ihn aus

Um mit der Erfassung von Kernelläufen auf GPUs zu beginnen, während der Trainingsauftrag ausgeführt wird, ändern Sie Ihr Trainingsskript mithilfe der SageMaker Profiler-Python-Module. Importieren Sie die Bibliothek und fügen Sie sie hinzu start_profiling() und stop_profiling() Methoden zum Definieren des Anfangs und Endes der Profilerstellung. Sie können auch optionale benutzerdefinierte Anmerkungen verwenden, um Markierungen im Trainingsskript hinzuzufügen, um Hardwareaktivitäten während bestimmter Vorgänge in jedem Schritt zu visualisieren.

Es gibt zwei Ansätze, mit denen Sie Ihre Trainingsskripte mit SageMaker Profiler profilieren können. Der erste Ansatz basiert auf der Profilierung aller Funktionen. Der zweite Ansatz basiert auf der Profilierung spezifischer Codezeilen in Funktionen.

Um ein Profil nach Funktionen zu erstellen, verwenden Sie den Kontextmanager smppy.annotate um vollständige Funktionen zu kommentieren. Das folgende Beispielskript zeigt, wie der Kontextmanager implementiert wird, um die Trainingsschleife und die vollständigen Funktionen in jeder Iteration einzuschließen:

Sie können auch smppy.annotation_begin() und smppy.annotation_end() um bestimmte Codezeilen in Funktionen zu kommentieren. Weitere Informationen finden Sie unter Dokumentation.

Konfigurieren Sie den SageMaker-Schulungsjob-Starter

Nachdem Sie mit dem Kommentieren und Einrichten der Profiler-Initiierungsmodule fertig sind, speichern Sie das Trainingsskript und bereiten Sie den SageMaker-Framework-Schätzer für das Training mit dem SageMaker Python SDK vor.

- Richten Sie ein

profiler_configObjekt mit demProfilerConfigundProfilerModule wie folgt: - Erstellen Sie einen SageMaker-Schätzer mit dem

profiler_configObjekt, das im vorherigen Schritt erstellt wurde. Der folgende Code zeigt ein Beispiel für die Erstellung eines PyTorch-Schätzers:

Wenn Sie einen TensorFlow-Schätzer erstellen möchten, importieren Sie ihn sagemaker.tensorflow.TensorFlow Geben Sie stattdessen eine der von SageMaker Profiler unterstützten TensorFlow-Versionen an. Weitere Informationen zu unterstützten Frameworks und Instanztypen finden Sie unter Unterstützte Frameworks.

- Starten Sie den Trainingsjob, indem Sie die Fit-Methode ausführen:

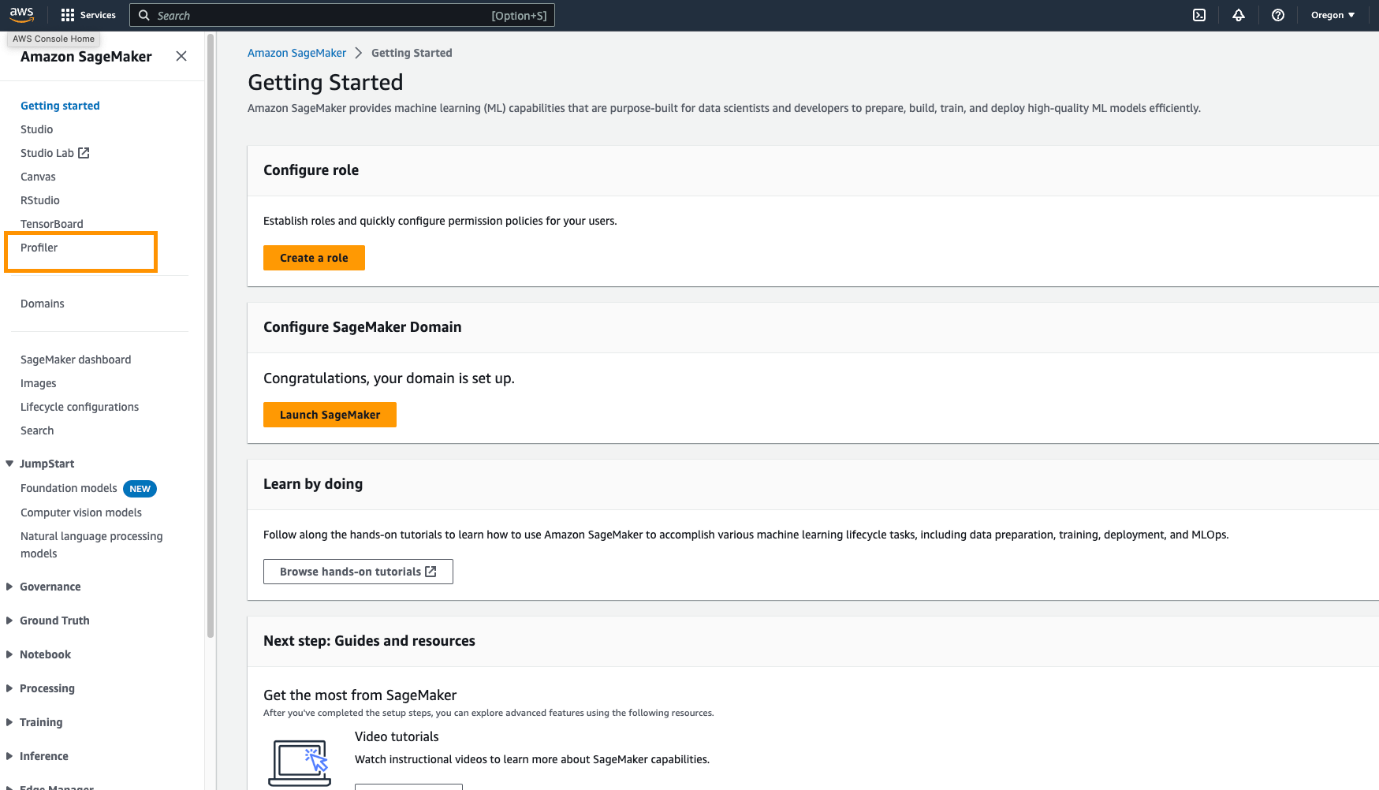

Starten Sie die SageMaker Profiler-Benutzeroberfläche

Wenn der Schulungsauftrag abgeschlossen ist, können Sie die SageMaker Profiler-Benutzeroberfläche starten, um das Profil des Schulungsauftrags anzuzeigen und zu erkunden. Sie können über die SageMaker Profiler-Landingpage auf der SageMaker-Konsole oder über die SageMaker-Domäne auf die SageMaker Profiler-UI-Anwendung zugreifen.

Führen Sie die folgenden Schritte aus, um die SageMaker Profiler-UI-Anwendung auf der SageMaker-Konsole zu starten:

- Wählen Sie in der SageMaker-Konsole Profiler im Navigationsbereich.

- Der Los geht´s, wählen Sie die Domäne aus, in der Sie die SageMaker Profiler UI-Anwendung starten möchten.

Wenn Ihr Benutzerprofil nur zu einer Domain gehört, wird Ihnen die Option zur Auswahl einer Domain nicht angezeigt.

- Wählen Sie das Benutzerprofil aus, für das Sie die SageMaker Profiler UI-Anwendung starten möchten.

Wenn in der Domäne kein Benutzerprofil vorhanden ist, wählen Sie Benutzerprofil erstellen. Weitere Informationen zum Erstellen eines neuen Benutzerprofils finden Sie unter Benutzerprofile hinzufügen und entfernen.

- Auswählen Öffnen Sie den Profiler.

Sie können uns auch Starten Sie die SageMaker Profiler-Benutzeroberfläche über die Seite mit den Domänendetails.

Gewinnen Sie Erkenntnisse mit dem SageMaker Profiler

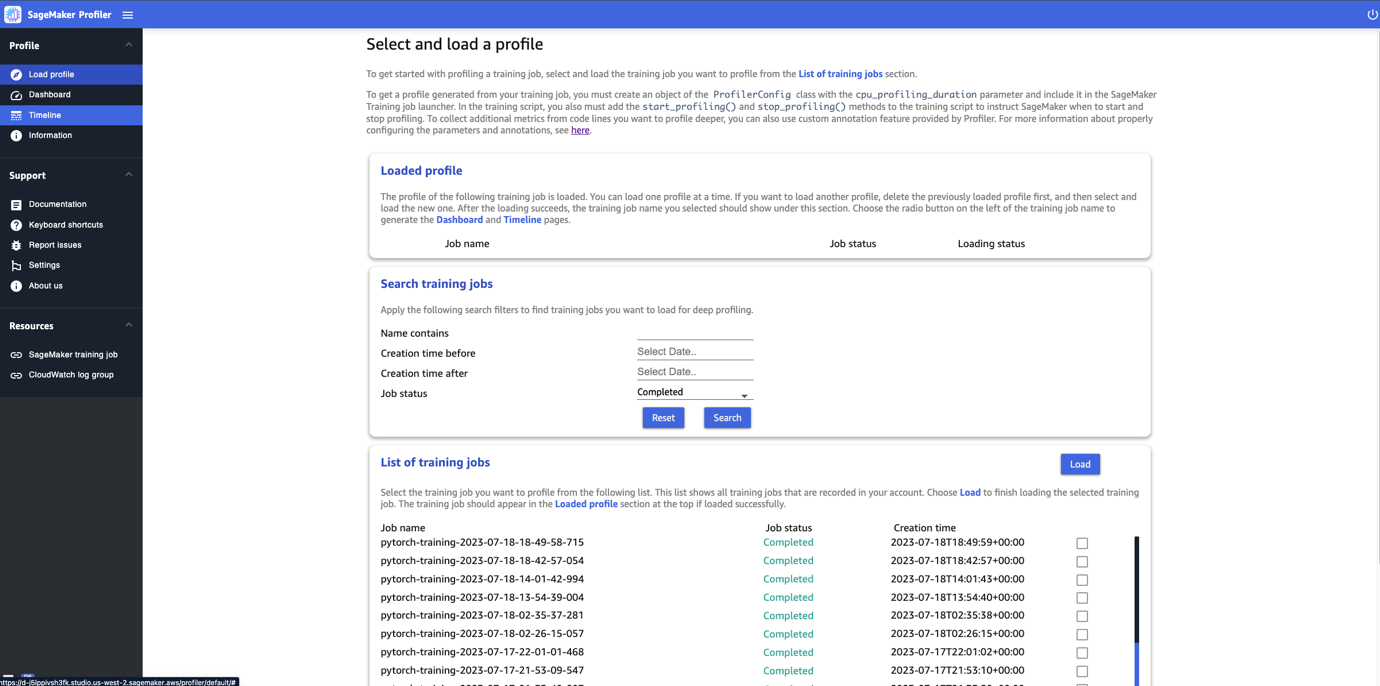

Wenn Sie die SageMaker Profiler-Benutzeroberfläche öffnen, wird die Wählen Sie ein Profil aus und laden Sie es Die Seite wird geöffnet, wie im folgenden Screenshot gezeigt.

Sie können eine Liste aller Trainingsjobs anzeigen, die an SageMaker Profiler übermittelt wurden, und nach einem bestimmten Trainingsjob anhand seines Namens, seiner Erstellungszeit und seines Ausführungsstatus (In Bearbeitung, Abgeschlossen, Fehlgeschlagen, Gestoppt oder Stoppt) suchen. Um ein Profil zu laden, wählen Sie den Schulungsjob aus, den Sie anzeigen möchten, und wählen Sie aus Laden Sie. Der Jobname sollte im erscheinen Geladenes Profil Abschnitt ganz oben.

Wählen Sie den Jobnamen aus, um das Dashboard und die Zeitleiste zu generieren. Beachten Sie, dass die Benutzeroberfläche automatisch das Dashboard öffnet, wenn Sie den Job auswählen. Sie können jeweils ein Profil laden und anzeigen. Um ein anderes Profil zu laden, müssen Sie zunächst das zuvor geladene Profil entladen. Um ein Profil zu entladen, wählen Sie das Papierkorbsymbol im Geladenes Profil .

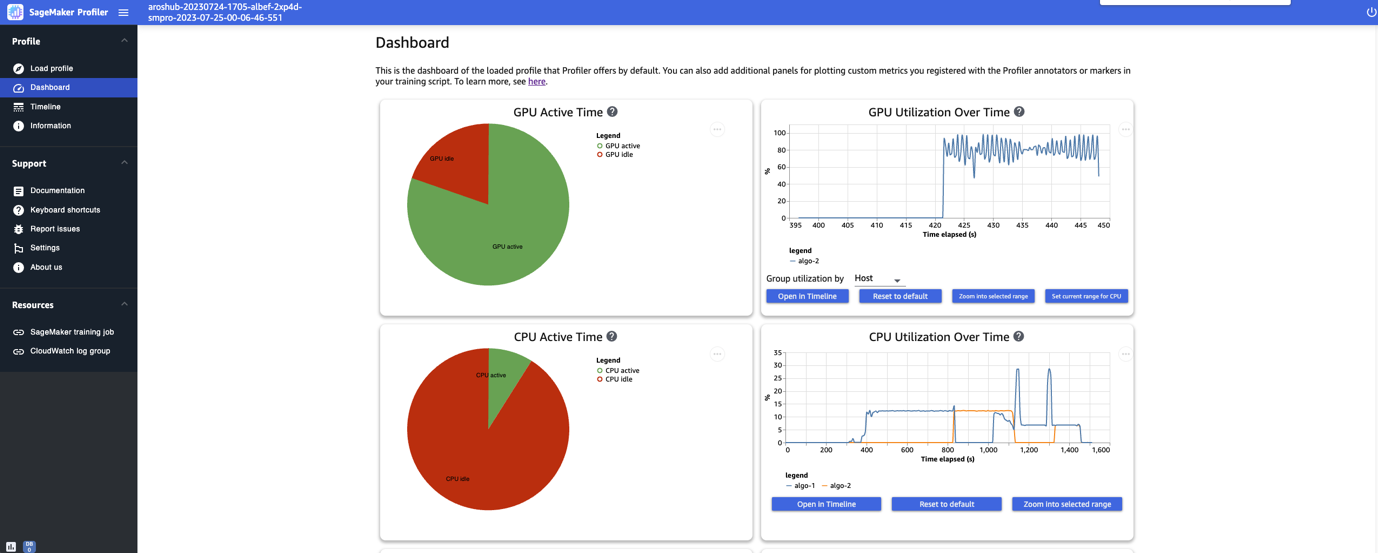

Für diesen Beitrag sehen wir uns das Profil eines an ALBEF Trainingsjob auf zwei ml.p4d.24xlarge-Instanzen.

Nachdem Sie das Laden und Auswählen des Trainingsjobs abgeschlossen haben, öffnet die Benutzeroberfläche die Dashboard Seite, wie im folgenden Screenshot gezeigt.

Sie können die Diagramme für wichtige Kennzahlen sehen, nämlich die GPU-Aktivzeit, die GPU-Auslastung im Zeitverlauf, die CPU-Aktivzeit und die CPU-Auslastung im Zeitverlauf. Das GPU-Aktivzeit-Kreisdiagramm zeigt den Prozentsatz der GPU-Aktivzeit im Vergleich zur GPU-Leerlaufzeit. Dadurch können wir überprüfen, ob die GPUs während des gesamten Trainingsauftrags aktiver als im Leerlauf sind. Das Zeitachsendiagramm der GPU-Auslastung im Zeitverlauf zeigt die durchschnittliche GPU-Nutzungsrate im Zeitverlauf pro Knoten und fasst alle Knoten in einem einzigen Diagramm zusammen. Sie können überprüfen, ob die GPUs in bestimmten Zeitintervallen eine unausgeglichene Arbeitslast, Unterauslastungsprobleme, Engpässe oder Leerlaufprobleme aufweisen. Weitere Einzelheiten zur Interpretation dieser Metriken finden Sie unter Dokumentation.

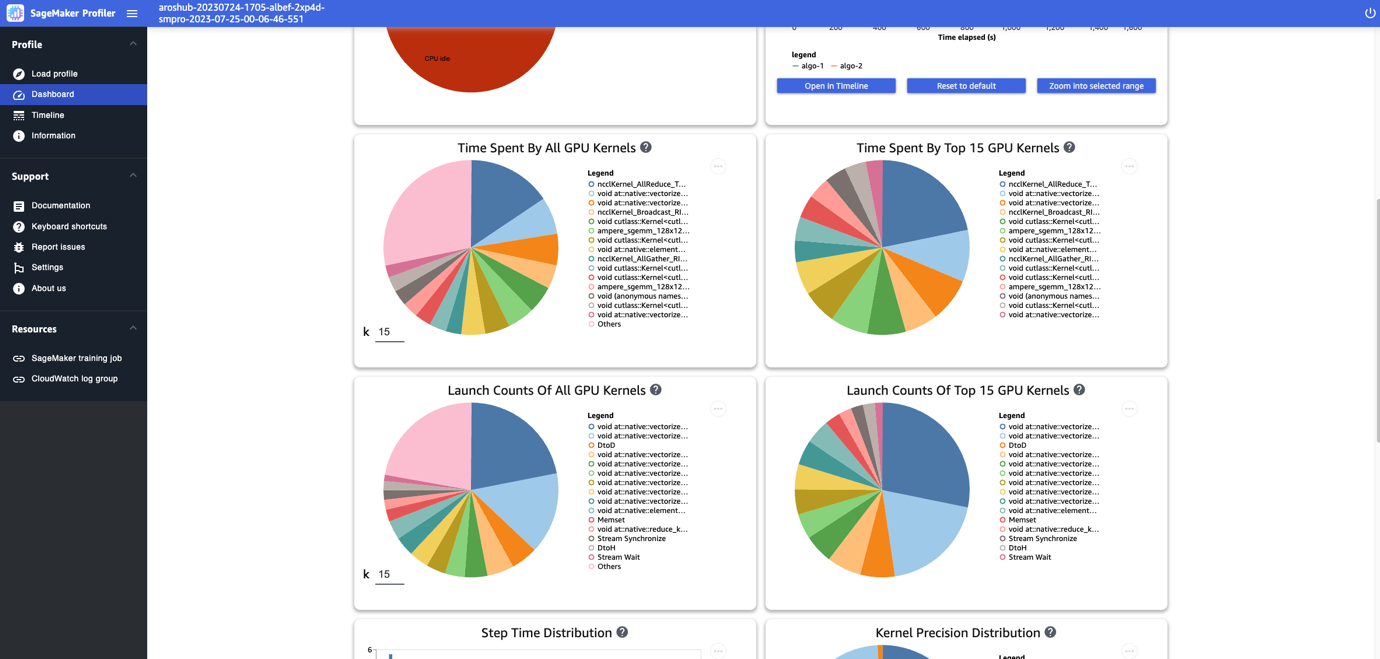

Das Dashboard bietet Ihnen zusätzliche Diagramme, einschließlich der von allen GPU-Kerneln verbrachten Zeit, der von den 15 besten GPU-Kerneln verbrauchten Zeit, der Startanzahl aller GPU-Kernel und der Startanzahl der 15 besten GPU-Kernel, wie im folgenden Screenshot gezeigt.

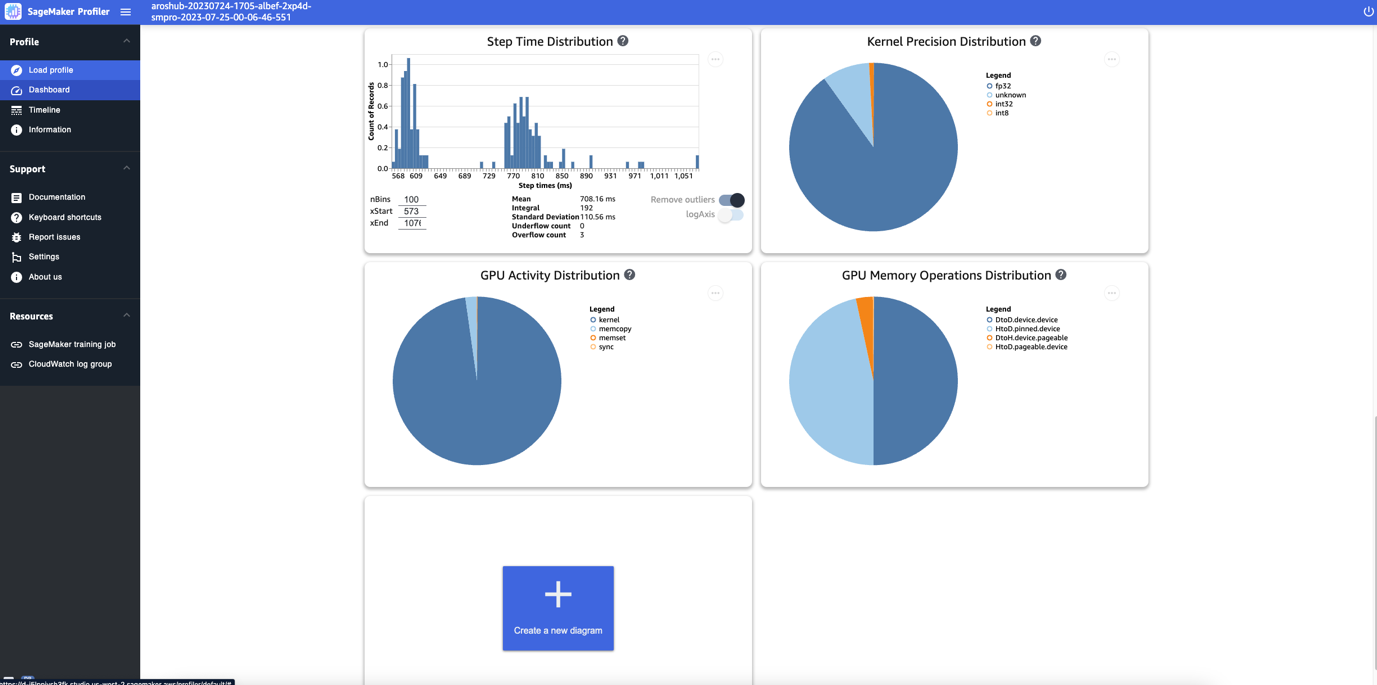

Schließlich ermöglicht Ihnen das Dashboard die Visualisierung zusätzlicher Metriken, wie z. B. die Schrittzeitverteilung, ein Histogramm, das die Verteilung der Schrittdauern auf GPUs anzeigt, und das Kreisdiagramm der Kernel-Präzisionsverteilung, das den Prozentsatz der für die Ausführung von Kerneln aufgewendeten Zeit anzeigt in verschiedenen Datentypen wie FP32, FP16, INT32 und INT8.

Sie können auch ein Kreisdiagramm zur GPU-Aktivitätsverteilung erhalten, das den Prozentsatz der für GPU-Aktivitäten aufgewendeten Zeit anzeigt, z. B. das Ausführen von Kerneln, Speicher (memcpy und memset) und Synchronisation (sync). Sie können den Prozentsatz der für GPU-Speichervorgänge aufgewendeten Zeit anhand des Kreisdiagramms zur Verteilung der GPU-Speichervorgänge visualisieren.

Sie können auch Ihre eigenen Histogramme erstellen, die auf einer benutzerdefinierten Metrik basieren, die Sie manuell mit Anmerkungen versehen haben, wie weiter oben in diesem Beitrag beschrieben. Wenn Sie einem neuen Histogramm eine benutzerdefinierte Anmerkung hinzufügen, wählen Sie den Namen der Anmerkung aus, die Sie im Trainingsskript hinzugefügt haben, oder geben Sie ihn ein.

Timeline-Schnittstelle

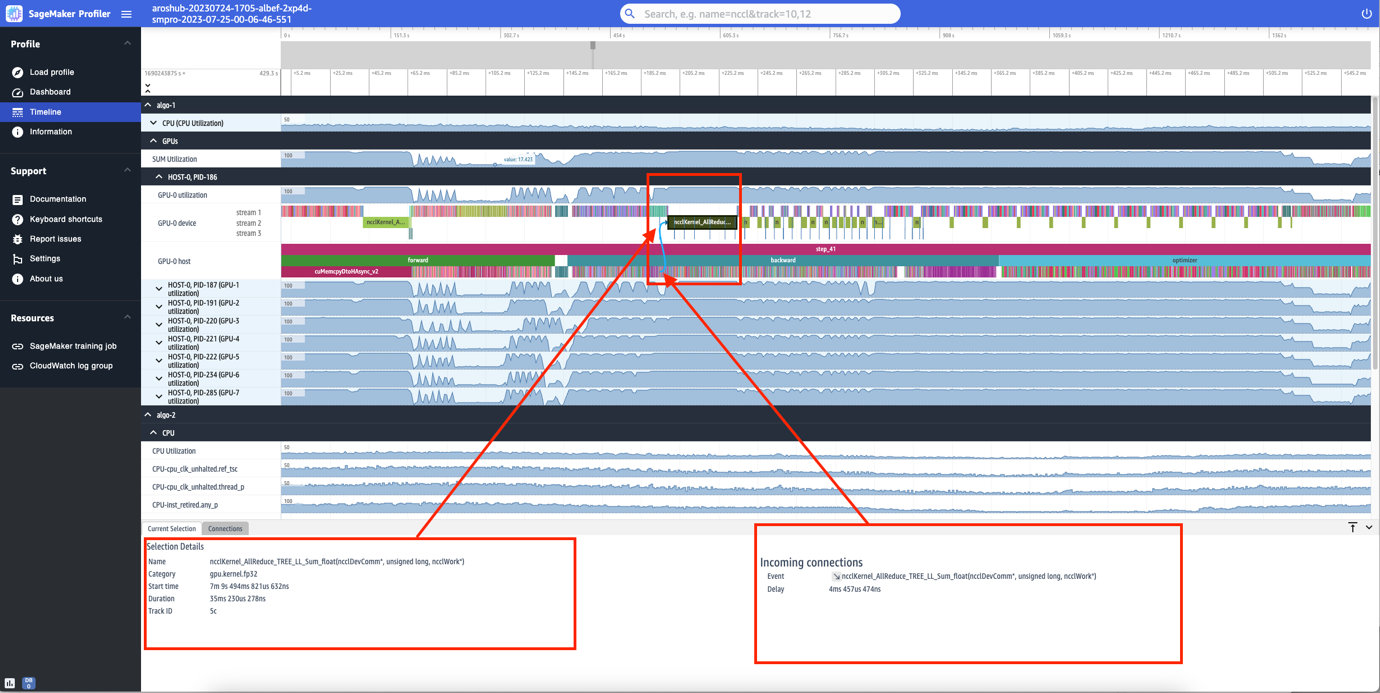

Die SageMaker Profiler-Benutzeroberfläche umfasst außerdem eine Zeitleistenschnittstelle, die Ihnen einen detaillierten Einblick in die Rechenressourcen auf der Ebene der auf den CPUs geplanten und auf den GPUs ausgeführten Vorgänge und Kernel bietet. Die Zeitleiste ist in einer Baumstruktur organisiert und bietet Ihnen Informationen von der Host- bis zur Geräteebene, wie im folgenden Screenshot dargestellt.

Für jede CPU können Sie die CPU-Leistungsindikatoren verfolgen, z clk_unhalted_ref.tsc und itlb_misses.miss_causes_a_walk. Für jede GPU auf der 2x p4d.24xlarge-Instanz können Sie eine Host-Timeline und eine Geräte-Timeline sehen. Kernel-Starts erfolgen auf der Host-Timeline und Kernel-Ausführungen auf der Geräte-Timeline.

Sie können auch in die einzelnen Schritte hineinzoomen. Im folgenden Screenshot haben wir auf Schritt_41 gezoomt. Der im folgenden Screenshot ausgewählte Timeline-Streifen ist der AllReduce Der Betrieb, ein wesentlicher Kommunikations- und Synchronisierungsschritt im verteilten Training, wird auf GPU-0 ausgeführt. Beachten Sie im Screenshot, dass der Kernel-Start im GPU-0-Host eine Verbindung zum Kernel-Start im GPU-0-Gerätestream 1 herstellt, was durch den Pfeil in Cyan angezeigt wird.

Verfügbarkeit und Überlegungen

SageMaker Profiler ist in PyTorch (Version 2.0.0 und 1.13.1) und TensorFlow (Version 2.12.0 und 2.11.1) verfügbar. Die folgende Tabelle enthält die Links zu den unterstützten AWS Deep Learning Container für SageMaker.

| Unser Ansatz | Version | AWS DLC-Bild-URI |

| PyTorch | 2.0.0 | 763104351884.dkr.ecr.<region>.amazonaws.com/pytorch-training:2.0.0-gpu-py310-cu118-ubuntu20.04-sagemaker |

| PyTorch | 1.13.1 | 763104351884.dkr.ecr.<region>.amazonaws.com/pytorch-training:1.13.1-gpu-py39-cu117-ubuntu20.04-sagemaker |

| TensorFlow | 2.12.0 | 763104351884.dkr.ecr.<region>.amazonaws.com/tensorflow-training:2.12.0-gpu-py310-cu118-ubuntu20.04-sagemaker |

| TensorFlow | 2.11.1 | 763104351884.dkr.ecr.<region>.amazonaws.com/tensorflow-training:2.11.1-gpu-py39-cu112-ubuntu20.04-sagemaker |

SageMaker Profiler ist derzeit in den folgenden Regionen verfügbar: USA Ost (Ohio, Nord-Virginia), USA West (Oregon) und Europa (Frankfurt, Irland).

SageMaker Profiler ist in den Trainingsinstanztypen ml.p4d.24xlarge, ml.p3dn.24xlarge und ml.g4dn.12xlarge verfügbar.

Die vollständige Liste der unterstützten Frameworks und Versionen finden Sie unter Dokumentation.

Für SageMaker Profiler fallen Gebühren an, nachdem das kostenlose SageMaker-Kontingent oder der kostenlose Testzeitraum der Funktion abgelaufen ist. Weitere Informationen finden Sie unter Amazon SageMaker Preise.

Leistung von SageMaker Profiler

Wir haben den Overhead von SageMaker Profiler mit verschiedenen Open-Source-Profilern verglichen. Die für den Vergleich verwendete Basislinie wurde durch die Ausführung des Trainingsjobs ohne Profiler ermittelt.

Unsere wichtigste Erkenntnis ergab, dass SageMaker Profiler im Allgemeinen zu einer kürzeren abrechenbaren Schulungsdauer führte, da bei den End-to-End-Trainingsläufen weniger Overhead-Zeit anfiel. Im Vergleich zu Open-Source-Alternativen wurden außerdem weniger Profilierungsdaten generiert (bis zu zehnmal weniger). Die kleineren Profilierungsartefakte, die von SageMaker Profiler generiert werden, benötigen weniger Speicherplatz und sparen dadurch auch Kosten.

Zusammenfassung

Mit SageMaker Profiler erhalten Sie beim Training Ihrer Deep-Learning-Modelle detaillierte Einblicke in die Nutzung von Rechenressourcen. Dadurch können Sie Leistungs-Hotspots und Engpässe beheben, um eine effiziente Ressourcennutzung sicherzustellen, die letztendlich die Schulungskosten senkt und die Gesamtschulungsdauer verkürzt.

Informationen zu den ersten Schritten mit SageMaker Profiler finden Sie unter Dokumentation.

Über die Autoren

Roy Allela ist Senior AI/ML Specialist Solutions Architect bei AWS mit Sitz in München, Deutschland. Roy hilft AWS-Kunden – von kleinen Startups bis hin zu großen Unternehmen –, große Sprachmodelle effizient auf AWS zu trainieren und bereitzustellen. Roy beschäftigt sich leidenschaftlich mit rechnerischen Optimierungsproblemen und der Verbesserung der Leistung von KI-Workloads.

Roy Allela ist Senior AI/ML Specialist Solutions Architect bei AWS mit Sitz in München, Deutschland. Roy hilft AWS-Kunden – von kleinen Startups bis hin zu großen Unternehmen –, große Sprachmodelle effizient auf AWS zu trainieren und bereitzustellen. Roy beschäftigt sich leidenschaftlich mit rechnerischen Optimierungsproblemen und der Verbesserung der Leistung von KI-Workloads.

Sushant Moon ist ein Datenwissenschaftler bei AWS, Indien, der sich darauf spezialisiert hat, Kunden bei ihren KI/ML-Bemühungen zu begleiten. Mit einem vielfältigen Hintergrund in den Bereichen Einzelhandel, Finanzen und Versicherungen liefert er innovative und maßgeschneiderte Lösungen. Über sein Berufsleben hinaus findet Sushant beim Schwimmen neue Kraft und lässt sich von seinen Reisen zu verschiedenen Orten inspirieren.

Sushant Moon ist ein Datenwissenschaftler bei AWS, Indien, der sich darauf spezialisiert hat, Kunden bei ihren KI/ML-Bemühungen zu begleiten. Mit einem vielfältigen Hintergrund in den Bereichen Einzelhandel, Finanzen und Versicherungen liefert er innovative und maßgeschneiderte Lösungen. Über sein Berufsleben hinaus findet Sushant beim Schwimmen neue Kraft und lässt sich von seinen Reisen zu verschiedenen Orten inspirieren.

Diksha Sharma ist ein AI/ML Specialist Solutions Architect in der Worldwide Specialist Organization. Sie arbeitet mit Kunden aus dem öffentlichen Sektor zusammen, um ihnen bei der Entwicklung effizienter, sicherer und skalierbarer Anwendungen für maschinelles Lernen zu helfen, einschließlich generativer KI-Lösungen auf AWS. In ihrer Freizeit liest und malt Diksha gerne und verbringt Zeit mit ihrer Familie.

Diksha Sharma ist ein AI/ML Specialist Solutions Architect in der Worldwide Specialist Organization. Sie arbeitet mit Kunden aus dem öffentlichen Sektor zusammen, um ihnen bei der Entwicklung effizienter, sicherer und skalierbarer Anwendungen für maschinelles Lernen zu helfen, einschließlich generativer KI-Lösungen auf AWS. In ihrer Freizeit liest und malt Diksha gerne und verbringt Zeit mit ihrer Familie.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- ChartPrime. Verbessern Sie Ihr Handelsspiel mit ChartPrime. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/announcing-the-preview-of-amazon-sagemaker-profiler-track-and-visualize-detailed-hardware-performance-data-for-your-model-training-workloads/

- :hast

- :Ist

- :nicht

- $UP

- 1

- 10

- 100

- 11

- 12

- 125

- 13

- 15%

- 17

- 20

- 7

- 9

- a

- Über Uns

- Zugang

- über

- Aktivierungs

- aktiv

- Aktivitäten

- Aktivität

- hinzufügen

- hinzugefügt

- Hinzufügen

- Zusätzliche

- Nach der

- gegen

- aggregierend

- AI

- AI / ML

- Alle

- ebenfalls

- Alternativen

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- und

- Bekannt geben

- Ankündigung

- Ein anderer

- jedem

- erscheinen

- Anwendung

- Anwendungen

- Ansatz

- Ansätze

- SIND

- AS

- zugewiesen

- At

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- durchschnittlich

- AWS

- Hintergrund

- basierend

- Baseline

- BE

- weil

- werden

- war

- Anfang

- gehört

- zwischen

- Beyond

- Milliarden

- BIN

- by

- CAN

- Fähigkeiten

- capability

- Capturing

- sicher

- Herausforderungen

- Gebühren

- Chart

- aus der Ferne überprüfen

- Auswählen

- Code

- gemeinsam

- Kommunikation

- verglichen

- Vergleich

- abschließen

- Abgeschlossene Verkäufe

- Komplexität

- Berechnen

- Konfiguration

- Connects

- Konsul (Console)

- Behälter

- Kontext

- Dazugehörigen

- Kosten

- Kosten

- Zähler

- erstellen

- erstellt

- Erstellen

- Schaffung

- Zur Zeit

- Original

- Kunden

- Cyan

- Armaturenbrett

- technische Daten

- Datenwissenschaftler

- tief

- tiefe Lernen

- definieren

- liefert

- einsetzen

- beschrieben

- detailliert

- Details

- Gerät

- anders

- verteilt

- verteiltes Training

- Verteilung

- verschieden

- Domain

- Domains

- erledigt

- nach unten

- Antrieb

- Dauer

- im

- jeder

- Früher

- Osten

- effizient

- effizient

- ermöglichen

- ermöglicht

- Ende

- End-to-End

- bemüht sich

- endet

- gewährleisten

- Enter

- Ganz

- Eintrag

- Epoche

- Epochen

- essential

- Europa

- Veranstaltungen

- offensichtlich

- Beispiel

- Ausführung

- ERKUNDEN

- Gescheitert

- Familie

- Merkmal

- Finanzen

- Suche nach

- findet

- Fertig

- Vorname

- passen

- Folgende

- folgt

- Aussichten für

- vorwärts

- Unser Ansatz

- Gerüste

- Frei

- die kostenlose Testversion.

- für

- voller

- Funktionen

- allgemein

- erzeugen

- erzeugt

- generativ

- Generative KI

- Deutschland

- bekommen

- Unterstützung

- GPU

- GPUs

- Graph

- Wachsen Sie über sich hinaus

- hätten

- Hardware

- Haben

- he

- Hilfe

- hilft

- hier (auf dänisch)

- seine

- Gastgeber

- Ultraschall

- Hilfe

- HTML

- http

- HTTPS

- i

- ICON

- Leerlauf

- if

- Image

- implementieren

- importieren

- Verbesserung

- in

- Dazu gehören

- Einschließlich

- Erhöhung

- Indien

- angegeben

- Krankengymnastik

- ineffizient

- Information

- innovativ

- Eingänge

- Einblicke

- Inspiration

- Instanz

- beantragen müssen

- Anleitung

- Versicherung

- Schnittstelle

- in

- Irland

- Probleme

- IT

- Iteration

- SEINE

- Job

- Jobs

- jpg

- Wesentliche

- Etiketten

- Landung

- Sprache

- grosse

- starten

- startet

- lernen

- weniger

- Niveau

- Bibliothek

- Lebensdauer

- Grenzen

- Linien

- Links

- Liste

- Belastung

- Laden

- länger

- Verlust

- liebt

- Sneaker

- Maschine

- Maschinelles Lernen

- Manager

- manuell

- Memory

- Methode

- Methoden

- Metrisch

- Metrik

- Minimum

- ML

- Modell

- für

- ändern

- Module

- mehr

- sollen

- Name

- nämlich

- Menü

- Need

- Neu

- nicht

- Knoten

- Fiber Node

- Objekt

- erhalten

- erhalten

- of

- Angebote

- Ohio

- on

- EINEM

- einzige

- XNUMXh geöffnet

- Open-Source-

- öffnet

- Betrieb

- Einkauf & Prozesse

- Optimierung

- optimiert

- Option

- or

- Auftrag

- Oregon

- Organisation

- Organisiert

- übrig

- Gesamt-

- besitzen

- Seite

- Brot

- Parameter

- besondere

- besonders

- leidenschaftlich

- für

- Prozentsatz

- Leistung

- Zeit

- Berechtigungen

- Plato

- Datenintelligenz von Plato

- PlatoData

- zufrieden

- Points

- Post

- Präzision

- Danach

- Voraussetzungen

- Vorspann

- früher

- vorher

- Probleme

- Professionell

- Profil

- Profil

- Profiling

- Fortschritt

- Projekt

- bietet

- Öffentlichkeit

- Python

- Pytorch

- Direkt

- schnell

- Bewerten

- Lesen Sie mehr

- Veteran

- Regionen

- Verjüngung

- Beziehung

- entfernen

- erfordern

- Ressourcen

- Downloads

- Folge

- Einzelhandel

- Revealed

- Rise

- Rollen

- roy

- Führen Sie

- Laufen

- läuft

- sagemaker

- Speichern

- Einsparung

- skalierbaren

- vorgesehen

- Wissenschaftler

- Skripte

- Sdk

- Suche

- Zweite

- Abschnitt

- Bibliotheken

- Verbindung

- sehen

- Sucht

- ausgewählt

- Auswahl

- Senior

- Lösungen

- kompensieren

- Einstellung

- sie

- sollte

- gezeigt

- Konzerte

- Single

- Größe

- klein

- kleinere

- Lösungen

- Quelle

- überspannend

- Spezialist

- spezialisieren

- spezifisch

- verbringen

- verbrachte

- Anfang

- begonnen

- Startups

- State-of-the-art

- statistisch

- Status

- Schritt

- Shritte

- gestoppt

- Einstellung

- Lagerung

- Strom

- Struktur

- eingereicht

- so

- ZUSAMMENFASSUNG

- Unterstützte

- Synchronisation

- Tabelle

- zugeschnitten

- Nehmen

- Tensorfluss

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- Dort.

- damit

- deswegen

- Diese

- fehlen uns die Worte.

- Durch

- während

- Tier

- Zeit

- Timeline

- Zeitleisten

- mal

- zu

- Top

- verfolgen sind

- Tracking

- Training

- Ausbildung

- privaten Transfer

- Reisen

- Baum

- Versuch

- Billionen

- XNUMX

- Typen

- typisch

- ui

- Letztlich

- Verständnis

- us

- -

- benutzt

- Mitglied

- Benutzerschnittstelle

- Nutzer

- Verwendung von

- verschiedene

- Version

- Versionen

- Anzeigen

- Virginia

- vs

- wollen

- wurde

- we

- Netz

- Web-Services

- West

- wann

- welche

- während

- werden wir

- mit

- ohne

- Werk

- Das weltweit

- würde

- wickeln

- Du

- Ihr

- Zephyrnet

- Zoom