Die generative KI befindet sich mitten in einer Phase atemberaubenden Wachstums. Es werden kontinuierlich immer leistungsfähigere Basismodelle veröffentlicht, wobei große Sprachmodelle (LLMs) eine der sichtbarsten Modellklassen sind. LLMs sind Modelle, die aus Milliarden von Parametern bestehen, die auf umfangreichen Textkorpora trainiert werden, bis zu Hunderten von Milliarden oder sogar einer Billion Token. Diese Modelle haben sich für eine Vielzahl textbasierter Aufgaben als äußerst effektiv erwiesen, von der Beantwortung von Fragen bis zur Stimmungsanalyse.

Die Leistungsfähigkeit von LLMs beruht auf ihrer Fähigkeit, aus umfangreichen und vielfältigen Trainingsdaten zu lernen und diese zu verallgemeinern. Das anfängliche Training dieser Modelle erfolgt mit verschiedenen Zielen, überwacht, unbeaufsichtigt oder hybrid. Die Textvervollständigung oder -imputation ist eines der häufigsten unbeaufsichtigten Ziele: Anhand eines Textabschnitts lernt das Modell, genau vorherzusagen, was als nächstes kommt (z. B. den nächsten Satz vorherzusagen). Modelle können auch auf überwachte Weise mithilfe gekennzeichneter Daten trainiert werden, um eine Reihe von Aufgaben zu erfüllen (z. B. ist diese Filmrezension positiv, negativ oder neutral). Unabhängig davon, ob das Modell für die Textvervollständigung oder eine andere Aufgabe trainiert ist, handelt es sich häufig nicht um die Aufgabe, für die Kunden das Modell verwenden möchten.

Um die Leistung eines vorab trainierten LLM für eine bestimmte Aufgabe zu verbessern, können wir das Modell mithilfe von Beispielen der Zielaufgabe in einem Prozess optimieren, der als bekannt ist Feinabstimmung der Anleitung. Bei der Feinabstimmung der Anweisungen wird eine Reihe beschrifteter Beispiele in Form von {Prompt, Response}-Paaren verwendet, um das vorab trainierte Modell weiter zu trainieren, damit es die Antwort auf die Eingabeaufforderung angemessen vorhersagen kann. Durch diesen Prozess werden die Gewichte des Modells geändert.

In diesem Beitrag wird beschrieben, wie Sie die Befehlsfeinabstimmung eines LLM, nämlich FLAN T5 XL, durchführen Amazon SageMaker-Jumpstart. Wir zeigen, wie Sie dies sowohl mit der Jumpstart-Benutzeroberfläche als auch mit einem Notebook erreichen Amazon SageMaker-Studio. Sie finden die Begleitnotizbuch der amazon-sagemaker-beispiele GitHub-Repository.

Lösungsüberblick

Die Zielaufgabe in diesem Beitrag besteht darin, anhand eines Textabschnitts in der Eingabeaufforderung Fragen zurückzugeben, die sich auf den Text beziehen, aber anhand der darin enthaltenen Informationen nicht beantwortet werden können. Dies ist eine nützliche Aufgabe, um fehlende Informationen in einer Beschreibung zu identifizieren oder festzustellen, ob eine Anfrage weitere Informationen zur Beantwortung benötigt.

FLAN T5-Modelle sind auf eine Vielzahl von Aufgaben abgestimmte Anweisungen, um die Nullschussleistung dieser Modelle bei vielen gängigen Aufgaben zu erhöhen[1]. Eine zusätzliche Feinabstimmung der Anweisungen für eine bestimmte Kundenaufgabe kann die Genauigkeit dieser Modelle weiter erhöhen, insbesondere wenn die Zielaufgabe zuvor nicht zum Trainieren eines FLAN T5-Modells verwendet wurde, wie dies bei unserer Aufgabe der Fall ist.

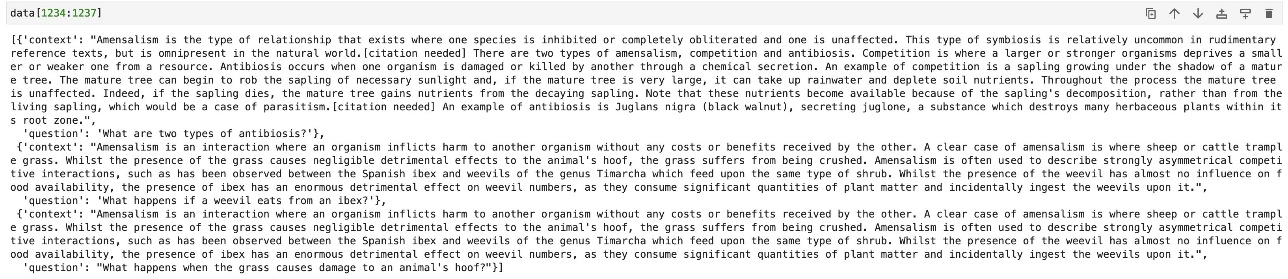

In unserer Beispielaufgabe geht es uns darum, relevante, aber unbeantwortete Fragen zu generieren. Zu diesem Zweck verwenden wir eine Teilmenge der Version 2 des Stanford Question Answering Dataset (SQuAD2.0)[2], um das Modell zu verfeinern. Dieser Datensatz enthält Fragen, die von menschlichen Kommentatoren zu einer Reihe von Wikipedia-Artikeln gestellt wurden. Neben Fragen mit Antworten enthält SQuAD2.0 etwa 50,000 unbeantwortete Fragen. Solche Fragen sind plausibel, können aber nicht direkt aus dem Inhalt der Artikel beantwortet werden. Wir verwenden nur die unbeantwortbaren Fragen. Unsere Daten sind als JSON-Zeilendatei strukturiert, wobei jede Zeile einen Kontext und eine Frage enthält.

Voraussetzungen:

Um loszulegen, benötigen Sie lediglich ein AWS-Konto, in dem Sie Studio nutzen können. Sie müssen ein Benutzerprofil für Studio erstellen, falls Sie noch keines haben.

Optimieren Sie FLAN-T5 mit der Jumpstart-Benutzeroberfläche

Führen Sie die folgenden Schritte aus, um das Modell mit der Jumpstart-Benutzeroberfläche zu optimieren:

- Öffnen Sie Studio auf der SageMaker-Konsole.

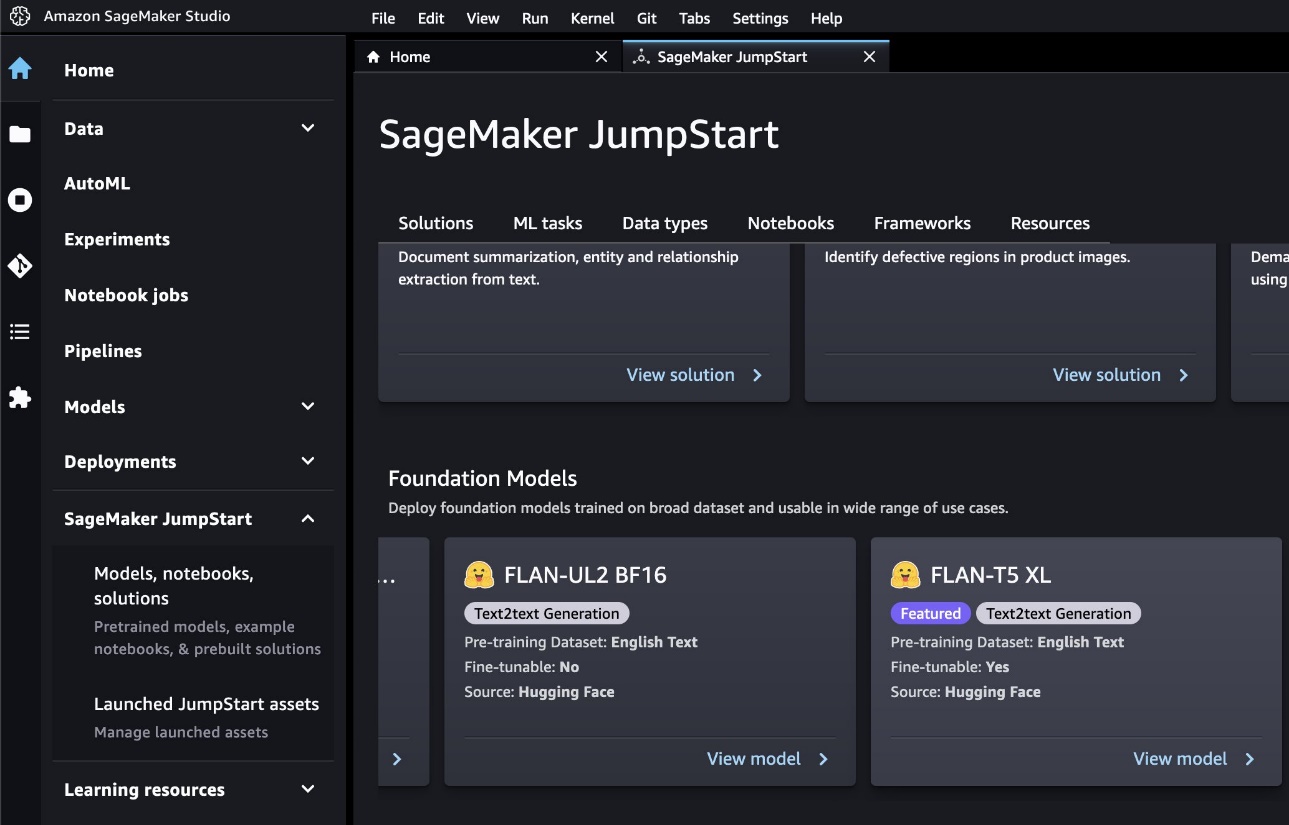

- Der SageMaker-Starthilfe Wählen Sie im Navigationsbereich Modelle, Notizbücher, Lösungen.

Sie sehen eine Liste der Foundation-Modelle, darunter FLAN T5 XL, das als feinabstimmbar gekennzeichnet ist.

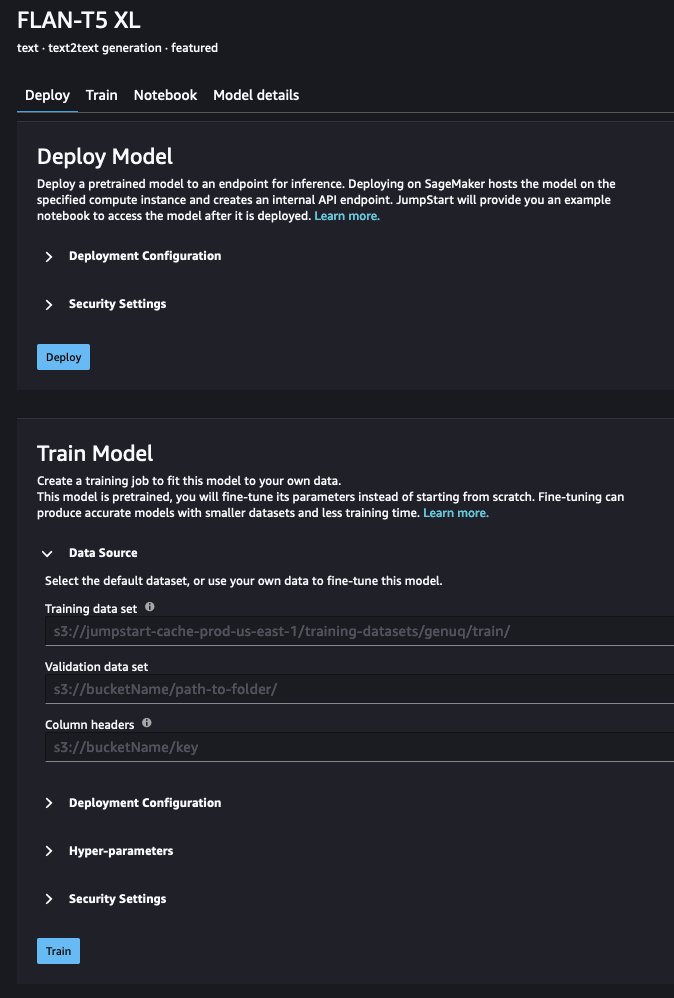

- Auswählen Modell ansehen.

- Der Datenquellekönnen Sie den Pfad zu Ihren Trainingsdaten angeben. Die Quelle für die in diesem Beitrag verwendeten Daten wird standardmäßig angegeben.

- Sie können den Standardwert für die Bereitstellungskonfiguration (einschließlich Instanztyp), die Sicherheit und die Hyperparameter beibehalten, sollten jedoch die Anzahl der Epochen auf mindestens drei erhöhen, um gute Ergebnisse zu erzielen.

- Auswählen Training um das Modell zu trainieren.

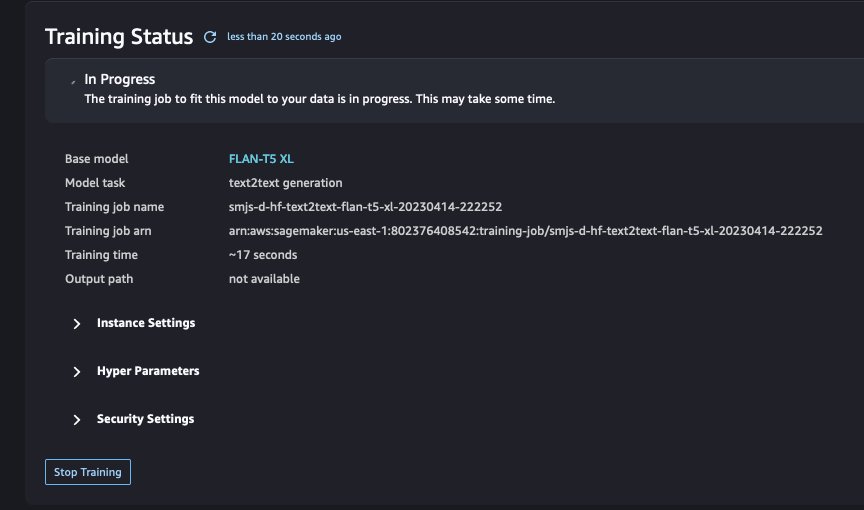

Sie können den Status des Schulungsauftrags in der Benutzeroberfläche verfolgen.

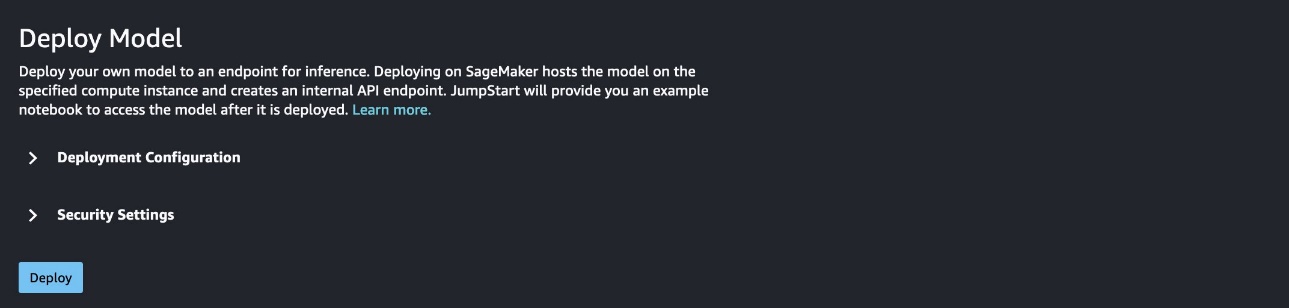

- Wenn das Training abgeschlossen ist (in unserem Fall nach etwa 53 Minuten), wählen Sie Deploy um das fein abgestimmte Modell bereitzustellen.

Nachdem der Endpunkt erstellt wurde (einige Minuten), können Sie ein Notebook öffnen und mit der Verwendung Ihres fein abgestimmten Modells beginnen.

Optimieren Sie FLAN-T5 mithilfe eines Python-Notebooks

Unser Beispielnotizbuch zeigt, wie Sie mit Jumpstart und SageMaker ein FLAN T5 XL-Modell programmgesteuert optimieren und bereitstellen. Es kann in Studio oder lokal ausgeführt werden.

In diesem Abschnitt gehen wir zunächst einige allgemeine Einstellungen durch. Anschließend optimieren Sie das Modell mithilfe der SQuADv2-Datensätze. Als Nächstes stellen Sie die vorab trainierte Version des Modells hinter einem SageMaker-Endpunkt bereit und machen dasselbe mit dem fein abgestimmten Modell. Schließlich können Sie die Endpunkte abfragen und die Qualität der Ausgabe des vorab trainierten und fein abgestimmten Modells vergleichen. Sie werden feststellen, dass die Ausgabe des fein abgestimmten Modells von viel höherer Qualität ist.

Voraussetzungen einrichten

Beginnen Sie mit der Installation und Aktualisierung der erforderlichen Pakete. Starten Sie den Kernel neu, nachdem Sie den folgenden Code ausgeführt haben:

Rufen Sie als Nächstes die Ausführungsrolle ab, die der aktuellen Notebook-Instanz zugeordnet ist:

Sie können ein praktisches Dropdown-Menü definieren, das die zur Feinabstimmung verfügbaren Modellgrößen auflistet:

Jumpstart ruft automatisch geeignete Trainings- und Inferenzinstanztypen für das von Ihnen ausgewählte Modell ab:

Jetzt können Sie mit der Feinabstimmung beginnen.

Trainieren Sie das Modell anhand des Feinabstimmungsdatensatzes neu

Führen Sie nach Abschluss der Einrichtung die folgenden Schritte aus:

Verwenden Sie den folgenden Code, um den URI für die benötigten Artefakte abzurufen:

Die Trainingsdaten liegen in einem öffentlichen Verzeichnis Amazon Simple Storage-Service (Amazon S3) Eimer.

Verwenden Sie den folgenden Code, um auf den Speicherort der Daten zu verweisen und den Ausgabespeicherort in einem Bucket in Ihrem Konto einzurichten:

Die Originaldaten liegen nicht in einem Format vor, das der Aufgabe entspricht, für die Sie das Modell optimieren. Sie können sie also neu formatieren:

Jetzt können Sie einige Hyperparameter für das Training definieren:

Sie können jetzt den Trainingsjob starten:

Abhängig von der Größe der Feinabstimmungsdaten und dem gewählten Modell kann die Feinabstimmung bis zu ein paar Stunden dauern.

Sie können Leistungsmetriken wie Trainings- und Validierungsverluste überwachen Amazon CloudWatch während dem Training. Praktischerweise können Sie auch den aktuellsten Snapshot der Metriken abrufen, indem Sie den folgenden Code ausführen:

Wenn das Training abgeschlossen ist, verfügen Sie über ein fein abgestimmtes Modell model_uri. Nutzen wir es!

Sie können zwei Inferenzendpunkte erstellen: einen für das ursprüngliche vorab trainierte Modell und einen für das fein abgestimmte Modell. Dadurch können Sie die Ausgabe beider Versionen des Modells vergleichen. Im nächsten Schritt stellen Sie einen Inferenzendpunkt für das vorab trainierte Modell bereit. Anschließend stellen Sie einen Endpunkt für Ihr fein abgestimmtes Modell bereit.

Stellen Sie das vorab trainierte Modell bereit

Beginnen wir mit der Bereitstellung des vorab trainierten Modells, um den Inferenz-Docker-Image-URI abzurufen. Dies ist das Basisbild des Hugging Face-Containers. Verwenden Sie den folgenden Code:

Sie können jetzt den Endpunkt erstellen und das vorab trainierte Modell bereitstellen. Beachten Sie, dass Sie die Predictor-Klasse beim Bereitstellen des Modells über die Model-Klasse übergeben müssen, um Rückschlüsse über die SageMaker-API ausführen zu können. Siehe den folgenden Code:

Die Endpunkterstellung und Modellbereitstellung kann einige Minuten dauern, dann ist Ihr Endpunkt bereit, Inferenzaufrufe zu empfangen.

Stellen Sie das optimierte Modell bereit

Lassen Sie uns das fein abgestimmte Modell auf seinem eigenen Endpunkt bereitstellen. Der Prozess ist fast identisch mit dem, den wir zuvor für das vorab trainierte Modell verwendet haben. Der einzige Unterschied besteht darin, dass wir den fein abgestimmten Modellnamen und URI verwenden:

Wenn dieser Prozess abgeschlossen ist, werden sowohl vorab trainierte als auch fein abgestimmte Modelle hinter ihren eigenen Endpunkten bereitgestellt. Vergleichen wir ihre Ergebnisse.

Generieren Sie eine Ausgabe und vergleichen Sie die Ergebnisse

Definieren Sie einige Hilfsfunktionen, um den Endpunkt abzufragen und die Antwort zu analysieren:

Im nächsten Codeausschnitt definieren wir die Eingabeaufforderung und die Testdaten. Das beschreibt unsere Zielaufgabe, nämlich Fragen zu generieren, die sich auf den bereitgestellten Text beziehen, aber nicht darauf basierend beantwortet werden können.

Die Testdaten bestehen aus drei verschiedenen Absätzen, einer über die australische Stadt Adelaide Die ersten beiden Absätze der Wikipedia-Seite, eine bezüglich Amazon Elastic Block-Shop (Amazon EBS) von der Amazon EBS-Dokumentationund einer von Amazon verstehen von dem Amazon Comprehend-Dokumentation. Wir erwarten, dass das Modell Fragen im Zusammenhang mit diesen Absätzen erkennt, die jedoch mit den darin bereitgestellten Informationen nicht beantwortet werden können.

Sie können die Endpunkte nun anhand der Beispielartikel testen

Testdaten: Adelaide

Wir verwenden den folgenden Kontext:

Die vorab trainierte Modellantwort lautet wie folgt:

Die fein abgestimmten Modellantworten lauten wie folgt:

Testdaten: Amazon EBS

Wir verwenden den folgenden Kontext:

Die vorab trainierten Modellantworten lauten wie folgt:

Die fein abgestimmten Modellantworten lauten wie folgt:

Testdaten: Amazon Comprehend

Wir verwenden den folgenden Kontext:

Die vorab trainierten Modellantworten lauten wie folgt:

Die fein abgestimmten Modellantworten lauten wie folgt:

Der Unterschied in der Ausgabequalität zwischen dem vorab trainierten Modell und dem fein abgestimmten Modell ist erheblich. Die Fragen des verfeinerten Modells decken ein breiteres Themenspektrum ab. Es handelt sich um systematisch sinnvolle Fragen, was beim vorab trainierten Modell nicht immer der Fall ist, wie das Amazon EBS-Beispiel zeigt.

Obwohl es sich hierbei nicht um eine formale und systematische Bewertung handelt, ist klar, dass der Feinabstimmungsprozess die Qualität der Antworten des Modells auf diese Aufgabe verbessert hat.

Aufräumen

Denken Sie zum Schluss daran, die Endpunkte zu bereinigen und zu löschen:

Zusammenfassung

In diesem Beitrag haben wir gezeigt, wie Sie die Befehlsfeinabstimmung bei FLAN T5-Modellen mithilfe der Jumpstart-Benutzeroberfläche oder eines in Studio ausgeführten Jupyter-Notebooks durchführen können. Wir haben Code bereitgestellt, der erklärt, wie das Modell mithilfe von Daten für die Zielaufgabe neu trainiert und das fein abgestimmte Modell hinter einem Endpunkt bereitgestellt wird. Die Zielaufgabe in diesem Beitrag bestand darin, Fragen zu identifizieren, die sich auf einen in der Eingabe bereitgestellten Textabschnitt beziehen, aber nicht anhand der in diesem Text bereitgestellten Informationen beantwortet werden können. Wir haben gezeigt, dass ein auf diese spezielle Aufgabe abgestimmtes Modell bessere Ergebnisse liefert als ein vorab trainiertes Modell.

Nachdem Sie nun wissen, wie Sie mit Jumpstart ein Modell verfeinern, können Sie leistungsstarke, auf Ihre Anwendung zugeschnittene Modelle erstellen. Sammeln Sie einige Daten für Ihren Anwendungsfall, laden Sie sie auf Amazon S3 hoch und verwenden Sie entweder die Studio-Benutzeroberfläche oder das Notebook, um ein FLAN T5-Modell zu optimieren!

Bibliographie

[1] Chung, Hyung Won et al. „Skalierung von anweisungsfein abgestimmten Sprachmodellen.“ arXiv-Vorabdruck arXiv:2210.11416 (2022).

[2] Rajpurkar, Pranav, Robin Jia und Percy Liang. „Wissen Sie, was Sie nicht wissen: Unbeantwortbare Fragen für SQuAD.“ Tagungsband der 56. Jahrestagung der Association for Computational Linguistics (Band 2: Kurzbeiträge). 2018.

Über die Autoren

Laurent Callot ist leitender angewandter Wissenschaftler und Manager bei AWS AI Labs und hat an einer Vielzahl von Problemen des maschinellen Lernens gearbeitet, von grundlegenden Modellen und generativer KI bis hin zu Prognosen, Anomalieerkennung, Kausalität und KI-Operationen.

Laurent Callot ist leitender angewandter Wissenschaftler und Manager bei AWS AI Labs und hat an einer Vielzahl von Problemen des maschinellen Lernens gearbeitet, von grundlegenden Modellen und generativer KI bis hin zu Prognosen, Anomalieerkennung, Kausalität und KI-Operationen.

Andrey Kan ist Senior Applied Scientist bei AWS AI Labs mit Interessen und Erfahrung in verschiedenen Bereichen des maschinellen Lernens. Dazu gehören Forschungen zu Grundlagenmodellen sowie ML-Anwendungen für Graphen und Zeitreihen.

Andrey Kan ist Senior Applied Scientist bei AWS AI Labs mit Interessen und Erfahrung in verschiedenen Bereichen des maschinellen Lernens. Dazu gehören Forschungen zu Grundlagenmodellen sowie ML-Anwendungen für Graphen und Zeitreihen.

Dr. Ashish Khetan ist Senior Applied Scientist mit integrierten Amazon SageMaker-Algorithmen und hilft bei der Entwicklung von Algorithmen für maschinelles Lernen. Er promovierte an der University of Illinois Urbana Champaign. Er ist ein aktiver Forscher auf dem Gebiet des maschinellen Lernens und der statistischen Inferenz und hat viele Artikel auf den Konferenzen NeurIPS, ICML, ICLR, JMLR, ACL und EMNLP veröffentlicht.

Dr. Ashish Khetan ist Senior Applied Scientist mit integrierten Amazon SageMaker-Algorithmen und hilft bei der Entwicklung von Algorithmen für maschinelles Lernen. Er promovierte an der University of Illinois Urbana Champaign. Er ist ein aktiver Forscher auf dem Gebiet des maschinellen Lernens und der statistischen Inferenz und hat viele Artikel auf den Konferenzen NeurIPS, ICML, ICLR, JMLR, ACL und EMNLP veröffentlicht.

Baris Kurt ist angewandter Wissenschaftler bei AWS AI Labs. Seine Interessen liegen in der Erkennung von Zeitreihenanomalien und Grundlagenmodellen. Er liebt die Entwicklung benutzerfreundlicher ML-Systeme.

Baris Kurt ist angewandter Wissenschaftler bei AWS AI Labs. Seine Interessen liegen in der Erkennung von Zeitreihenanomalien und Grundlagenmodellen. Er liebt die Entwicklung benutzerfreundlicher ML-Systeme.

Jonas Kübler ist angewandter Wissenschaftler bei AWS AI Labs. Er arbeitet an Grundlagenmodellen mit dem Ziel, anwendungsfallspezifische Anwendungen zu ermöglichen.

Jonas Kübler ist angewandter Wissenschaftler bei AWS AI Labs. Er arbeitet an Grundlagenmodellen mit dem Ziel, anwendungsfallspezifische Anwendungen zu ermöglichen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoAiStream. Web3-Datenintelligenz. Wissen verstärkt. Hier zugreifen.

- Die Zukunft prägen mit Adryenn Ashley. Hier zugreifen.

- Kaufen und verkaufen Sie Anteile an PRE-IPO-Unternehmen mit PREIPO®. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/instruction-fine-tuning-for-flan-t5-xl-with-amazon-sagemaker-jumpstart/

- :hast

- :Ist

- :nicht

- $UP

- 000

- 1

- 10

- 100

- 11

- 12

- 13

- 17

- 1M

- 20

- 2018

- 2022

- 22

- 40

- 50

- 60

- 7

- 8

- 80

- 9

- a

- Fähig

- Über uns

- Akzeptieren

- Zugang

- zugänglich

- erreichen

- Konto

- Genauigkeit

- genau

- aktiv

- Zusatz

- Zusätzliche

- angemessen

- Nach der

- AI

- AL

- Algorithmen

- Alle

- erlaubt

- bereits

- ebenfalls

- immer

- Amazon

- Amazon verstehen

- Amazon Sage Maker

- Amazon SageMaker-JumpStart

- Amazon Web Services

- an

- Analyse

- analysieren

- und

- jährlich

- Anomalieerkennung

- Antworten

- jedem

- Bienen

- APIs

- Anwendung

- Anwendungen

- angewandt

- angemessen

- SIND

- Bereich

- Argument

- Artikel

- Artikel

- AS

- damit verbundenen

- Verein

- At

- Australien

- australisch

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- AWS

- Base

- basierend

- BE

- Beach

- Strahl

- hinter

- Sein

- unten

- Besser

- zwischen

- Milliarden

- Blockieren

- Körper

- fett

- beide

- eingebaut

- aber

- by

- namens

- Aufrufe

- CAN

- kann keine

- Fähigkeiten

- fähig

- Kapazität

- Hauptstadt

- Häuser

- Zentrum

- Übernehmen

- Wahl

- Auswählen

- wählten

- gewählt

- Stadt

- Klasse

- Unterricht

- Einstufung

- klar

- Auftraggeber

- Küstenregion

- Code

- kommt

- gemeinsam

- vergleichen

- abschließen

- Abschluss

- zusammengesetzt

- begreifen

- Kongressbegleitung

- Konfiguration

- Konsul (Console)

- bilden

- Container

- enthält

- Inhalt

- Kontext

- kontinuierlich

- ständig

- Praktische

- entspricht

- könnte

- Paar

- erstellen

- erstellt

- Erstellen

- Schaffung

- Strom

- Original

- Kunde

- Kunden

- maßgeschneiderte

- technische Daten

- Datenbanken

- Datensätze

- Standard

- zeigen

- weisen nach, dass

- Abhängig

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- Beschreibung

- Entdeckung

- Bestimmen

- entwickeln

- Entwicklung

- entwickelt

- Gerät

- Geräte

- Unterschied

- anders

- Direkt

- Display

- verschieden

- do

- Docker

- Dokument

- Unterlagen

- die

- Tut nicht

- dominant

- Nicht

- Antrieb

- im

- dynamisch

- E & T

- jeder

- Früher

- Osten

- Effektiv

- entweder

- Elemente

- sonst

- Ende

- Endpunkt

- Ganz

- Entitäten

- Einheit

- Epoche

- Epochen

- insbesondere

- Auswertung

- Sogar

- untersuchen

- Beispiel

- Beispiele

- ausführen

- Ausführung

- erwarten

- ERFAHRUNGEN

- Erläuterung

- ausgesetzt

- erweitert

- Erweiterung

- umfangreiche

- Extrakt

- äußerst

- Gesicht

- erleichtern

- weit

- Fashion

- Merkmal

- Eigenschaften

- wenige

- Felder

- Reichen Sie das

- Mappen

- Endlich

- Finden Sie

- Ende

- Vorname

- Folgende

- folgt

- Aussichten für

- unten stehende Formular

- formal

- Format

- gefunden

- Foundation

- Vierte

- Unser Ansatz

- häufig

- freundlich

- für

- Funktionen

- weiter

- sammeln

- Allgemeines

- erzeugen

- erzeugt

- Erzeugung

- Generation

- generativ

- Generative KI

- bekommen

- GitHub

- gegeben

- Kundenziele

- gut

- Graphen

- groß

- mehr

- Wachstum

- hart

- Festplatte

- Haben

- he

- hilft

- höher

- Hills

- seine

- STUNDEN

- Ultraschall

- Hilfe

- HTML

- http

- HTTPS

- Umarmendes Gesicht

- human

- hunderte

- Hybrid

- i

- ID

- identisch

- identifizieren

- ids

- if

- Illinois

- Image

- importieren

- zu unterstützen,

- verbessert

- in

- das

- Einschließlich

- Erhöhung

- zunehmend

- unabhängig

- Info

- Information

- informativ

- Anfangs-

- Varianten des Eingangssignals:

- Eingänge

- Einblicke

- installieren

- Installieren

- Instanz

- interessiert

- Interessen

- Einleitung

- IT

- SEINE

- Job

- Jobs

- jpg

- JSON

- Behalten

- Wesentliche

- Wissen

- bekannt

- Labs

- Sprache

- Sprachen

- grosse

- höchste

- starten

- LERNEN

- lernen

- am wenigsten

- Länge

- Niveau

- Lebensdauer

- Gefällt mir

- Line

- Linien

- Liste

- LLM

- örtlich

- located

- Standorte

- hoch

- Lang

- langfristig

- Verlust

- liebt

- Maschine

- Maschinelles Lernen

- Manager

- viele

- markiert

- max

- Kann..

- sinnvoll

- Treffen

- Erwähnungen

- MENÜ

- Metrik

- Minuten

- Kommt demnächst...

- ML

- Modell

- für

- Überwachen

- mehr

- vor allem warme

- MOUNT

- Film

- viel

- sollen

- Name

- nämlich

- Natürliche

- Verarbeitung natürlicher Sprache

- Navigation

- notwendig,

- Need

- erforderlich

- Bedürfnisse

- Negativ

- Vernetzung

- Neutral

- Neu

- neue Produkte

- weiter

- Nlp

- Norden

- Notizbuch

- jetzt an

- Anzahl

- erhalten

- of

- on

- EINEM

- einzige

- XNUMXh geöffnet

- or

- Original

- Andere

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- übrig

- Override

- besitzen

- Besitzer

- Pakete

- Paare

- Brot

- Papiere

- Parameter

- Teil

- besondere

- besonders

- passieren

- Weg

- Personen

- Ausführen

- Leistung

- Zeit

- Beharrlichkeit

- Sätze

- Plato

- Datenintelligenz von Plato

- PlatoData

- plausibel

- Points

- Bevölkerung

- positiv

- Post

- Werkzeuge

- größte treibende

- vorhersagen

- Vorhersage

- Predictor

- vorher

- primär

- Principal

- Probleme

- Prozessdefinierung

- Verarbeitung

- Produkte

- Profil

- Fortschritt

- zuverlässig

- die

- vorausgesetzt

- bietet

- Öffentlichkeit

- veröffentlicht

- Python

- Qualität

- Abfragen

- Frage

- Fragen

- schnell

- zufällig

- Angebot

- Roh

- bereit

- Echtzeit

- erhalten

- kürzlich

- Anerkennung

- erkennen

- erkennen

- empfehlen

- empfohlen

- in Bezug auf

- Regex

- Region

- bezogene

- freigegeben

- relevant

- verlassen

- merken

- Quelle

- erfordern

- falls angefordert

- erfordert

- Forschungsprojekte

- Forscher

- Bewohner

- Downloads

- Antwort

- Antworten

- eine Beschränkung

- Die Ergebnisse

- Rückkehr

- Rückgabe

- Überprüfen

- Rotkehlchen

- Rollen

- Führen Sie

- Laufen

- s

- sagemaker

- gleich

- Scan

- Wissenschaftler

- Suche

- Zweite

- Abschnitt

- Sicherheitdienst

- sehen

- Auswahl

- Senior

- Satz

- Gefühl

- Modellreihe

- Leistungen

- Sitzung

- kompensieren

- Sets

- Setup

- mehrere

- Short

- sollte

- zeigte

- Konzerte

- Einfacher

- Größe

- Größen

- klein

- Schnappschuss

- So

- Social Media

- Soziales Netzwerk

- einige

- Quelle

- Süd

- spezifisch

- gespalten

- Stanford

- stark

- Anfang

- begonnen

- Bundesstaat

- statistisch

- Status

- Schritt

- Shritte

- Immer noch

- Lagerung

- speichern

- Struktur

- strukturierte

- Studio Adressen

- Atemberaubende

- so

- Support

- Unterstützte

- Umgebung

- System

- Systeme und Techniken

- Nehmen

- Target

- Aufgabe

- und Aufgaben

- Vorlage

- Test

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Gegend

- Die Hauptstadt

- die Informationen

- Die Quelle

- Der Staat

- Der Westen

- die Welt

- ihr

- Sie

- dann

- darin

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- diejenigen

- nach drei

- Durch

- Zeit

- Zeitfolgen

- zu

- Tokens

- Top

- Themen

- aufnehmen

- verfolgen sind

- traditionell

- Training

- trainiert

- Ausbildung

- Billion

- was immer dies auch sein sollte.

- XNUMX

- tippe

- Typen

- ui

- Verständnis

- Universität

- Updates

- hochgeladen

- -

- Anwendungsfall

- benutzt

- Mitglied

- Verwendung von

- Nutzen

- Bestätigung

- Wert

- Werte

- Vielfalt

- Version

- vincent

- sichtbar

- Volumen

- Volumen

- W

- wollen

- wurde

- Weg..

- we

- Netz

- Web-Services

- GUT

- West

- Was

- Was ist

- wann

- ob

- welche

- während

- WHO

- breit

- Große Auswahl

- breiter

- Breite

- Wikipedia

- werden wir

- mit

- .

- Gewonnen

- Word

- gearbeitet

- arbeiten,

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- würde

- Du

- Ihr

- Zephyrnet