Dies ist ein Gastbeitrag von Skalierbares Kapital, ein führendes FinTech in Europa, das digitale Vermögensverwaltung und eine Brokerage-Plattform mit Trading-Flatrate anbietet.

Als schnell wachsendes Unternehmen besteht das Ziel von Scalable Capital nicht nur darin, eine innovative, robuste und zuverlässige Infrastruktur aufzubauen, sondern unseren Kunden auch die besten Erfahrungen zu bieten, insbesondere wenn es um den Kundenservice geht.

Scalable erhält täglich Hunderte von E-Mail-Anfragen unserer Kunden. Durch die Implementierung eines modernen NLP-Modells (Natural Language Processing) konnte der Antwortprozess wesentlich effizienter gestaltet und die Wartezeit für Kunden enorm verkürzt werden. Das Modell des maschinellen Lernens (ML) klassifiziert neu eingehende Kundenanfragen, sobald sie eintreffen, und leitet sie an vordefinierte Warteschlangen weiter, sodass sich unsere engagierten Kundenerfolgsagenten entsprechend ihren Fähigkeiten auf den Inhalt der E-Mails konzentrieren und entsprechende Antworten geben können.

In diesem Beitrag demonstrieren wir die technischen Vorteile der Verwendung von Hugging Face-Transformatoren im Einsatz mit Amazon Sage Maker, wie z. B. Schulungen und Experimente in großem Maßstab, und erhöhte Produktivität und Kosteneffizienz.

Problemstellung

Scalable Capital ist eines der am schnellsten wachsenden FinTechs in Europa. Mit dem Ziel, Investitionen zu demokratisieren, bietet das Unternehmen seinen Kunden einen einfachen Zugang zu den Finanzmärkten. Kunden von Scalable können über die Brokerage-Handelsplattform des Unternehmens aktiv am Markt teilnehmen oder Scalable Wealth Management nutzen, um intelligent und automatisiert zu investieren. Im Jahr 2021 verzeichnete Scalable Capital eine Verzehnfachung seines Kundenstamms, von Zehntausenden auf Hunderttausende.

Um unseren Kunden ein erstklassiges (und konsistentes) Benutzererlebnis für alle Produkte und den Kundenservice zu bieten, suchte das Unternehmen nach automatisierten Lösungen, um die Effizienz einer skalierbaren Lösung zu steigern und gleichzeitig die operative Exzellenz aufrechtzuerhalten. Die Datenwissenschafts- und Kundendienstteams von Scalable Capital stellten fest, dass einer der größten Engpässe bei der Betreuung unserer Kunden die Beantwortung von E-Mail-Anfragen war. Der Flaschenhals war insbesondere der Klassifizierungsschritt, bei dem die Mitarbeiter täglich Anforderungstexte lesen und kennzeichnen mussten. Nachdem die E-Mails an die entsprechenden Warteschlangen weitergeleitet wurden, griffen die jeweiligen Spezialisten schnell zu und lösten die Fälle.

Um diesen Klassifizierungsprozess zu rationalisieren, hat das Data-Science-Team von Scalable ein Multitask-NLP-Modell unter Verwendung modernster Transformer-Architektur basierend auf den vorab trainierten Daten erstellt und bereitgestellt Distilbert-Base-Deutsch-Gehäuse Modell veröffentlicht von Hugging Face. Distilbert-Base-Deutsch-Gehäuse verwendet das Wissensdestillation Methode zum Vorabtrainieren eines kleineren Allzweck-Sprachdarstellungsmodells als das ursprüngliche BERT-Basismodell. Die destillierte Version erreicht eine vergleichbare Leistung wie die Originalversion, ist jedoch kleiner und schneller. Um unseren ML-Lebenszyklusprozess zu vereinfachen, haben wir uns entschieden, SageMaker zum Erstellen, Bereitstellen, Bereitstellen und Überwachen unserer Modelle einzusetzen. Im folgenden Abschnitt stellen wir unser Projektarchitekturdesign vor.

Lösungsüberblick

Die ML-Infrastruktur von Scalable Capital besteht aus zwei AWS-Konten: eines als Umgebung für die Entwicklungsphase und das andere für die Produktionsphase.

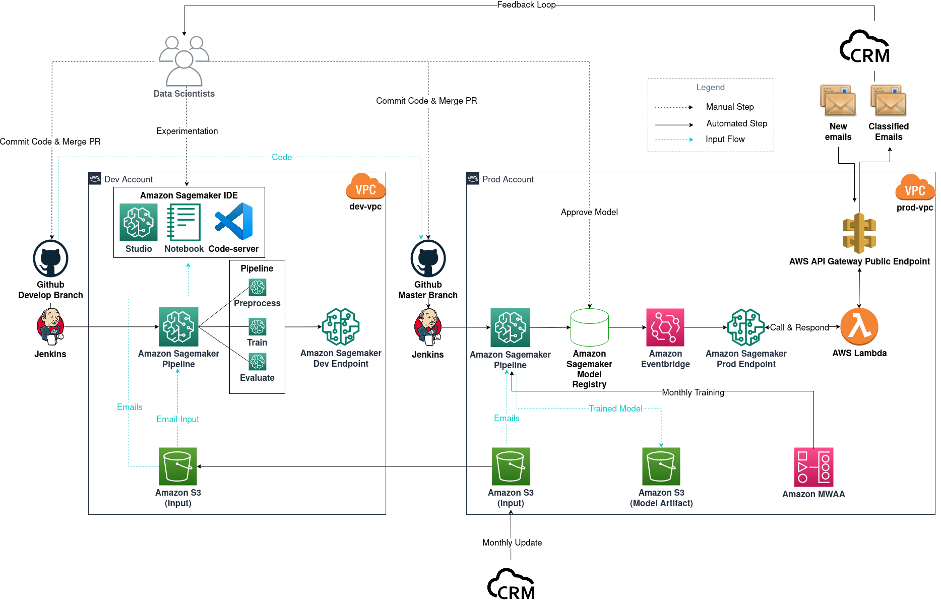

Das folgende Diagramm zeigt den Arbeitsablauf für unser E-Mail-Klassifizierungsprojekt, kann aber auch auf andere Data-Science-Projekte übertragen werden.

Projektdiagramm zur E-Mail-Klassifizierung

Der Workflow besteht aus folgenden Komponenten:

- Modellexperimente – Datenwissenschaftler verwenden Amazon SageMaker-Studio die ersten Schritte im Data-Science-Lebenszyklus durchzuführen: explorative Datenanalyse (EDA), Datenbereinigung und -aufbereitung sowie Erstellung von Prototypmodellen. Wenn die Erkundungsphase abgeschlossen ist, verwenden wir VSCode, der von einem SageMaker-Notebook gehostet wird, als unser Remote-Entwicklungstool, um unsere Codebasis zu modularisieren und zu produzieren. Um verschiedene Modelltypen und Modellkonfigurationen zu erkunden und gleichzeitig den Überblick über unsere Experimente zu behalten, verwenden wir SageMaker Training und SageMaker Experiments.

- Modellbau – Nachdem wir uns für ein Modell für unseren Produktionsanwendungsfall entschieden haben, in diesem Fall ein Multitasking Distilbert-Base-Deutsch-Gehäuse Modell, das anhand des vorab trainierten Modells von Hugging Face verfeinert wurde, übergeben wir unseren Code und übertragen ihn an den Github-Entwicklungszweig. Das Github-Merge-Ereignis löst unsere Jenkins CI-Pipeline aus, die wiederum einen SageMaker Pipelines-Job mit Testdaten startet. Dies dient als Test, um sicherzustellen, dass Codes wie erwartet ausgeführt werden. Zu Testzwecken wird ein Testendpunkt bereitgestellt.

- Modellbereitstellung – Nachdem sichergestellt wurde, dass alles wie erwartet läuft, führen Datenwissenschaftler den Entwicklungszweig mit dem Primärzweig zusammen. Dieses Zusammenführungsereignis löst nun einen SageMaker Pipelines-Job aus, der Produktionsdaten für Schulungszwecke verwendet. Anschließend werden Modellartefakte erzeugt und in einer Ausgabe gespeichert Amazon Simple Storage-Service (Amazon S3)-Bucket und eine neue Modellversion wird in der SageMaker-Modellregistrierung protokolliert. Datenwissenschaftler prüfen die Leistung des neuen Modells und genehmigen es dann, wenn es den Erwartungen entspricht. Das Modellgenehmigungsereignis wird erfasst von Amazon EventBridge, der das Modell dann auf einem SageMaker-Endpunkt in der Produktionsumgebung bereitstellt.

- MLOps – Da der SageMaker-Endpunkt privat ist und nicht von Diensten außerhalb der VPC erreicht werden kann, ist ein AWS Lambda Funktion und Amazon API-Gateway Für die Kommunikation mit CRM sind öffentliche Endpunkte erforderlich. Immer wenn neue E-Mails im CRM-Posteingang eingehen, ruft CRM den öffentlichen API Gateway-Endpunkt auf, der wiederum die Lambda-Funktion auslöst, um den privaten SageMaker-Endpunkt aufzurufen. Die Funktion leitet die Klassifizierung dann über den öffentlichen Endpunkt des API Gateway zurück an CRM weiter. Um die Leistung unseres bereitgestellten Modells zu überwachen, implementieren wir eine Feedbackschleife zwischen CRM und den Datenwissenschaftlern, um die Vorhersagemetriken des Modells zu verfolgen. Monatlich aktualisiert CRM die historischen Daten, die für Experimente und Modellschulungen verwendet werden. Wir gebrauchen Von Amazon verwaltete Workflows für Apache Airflow (Amazon MWAA) als Planer für unsere monatliche Umschulung.

In den folgenden Abschnitten werden die Schritte Datenvorbereitung, Modellexperimente und Modellbereitstellung detaillierter beschrieben.

Datenaufbereitung

Scalable Capital nutzt ein CRM-Tool zur Verwaltung und Speicherung von E-Mail-Daten. Relevante E-Mail-Inhalte bestehen aus Betreff, Text und den Depotbanken. Jeder E-Mail können drei Bezeichnungen zugewiesen werden: aus welchem Geschäftsbereich die E-Mail stammt, welche Warteschlange geeignet ist und das spezifische Thema der E-Mail.

Bevor wir mit dem Training von NLP-Modellen beginnen, stellen wir sicher, dass die Eingabedaten sauber sind und die Bezeichnungen den Erwartungen entsprechend zugewiesen werden.

Um saubere Anfrageinhalte von Scalable-Clients abzurufen, entfernen wir aus den E-Mail-Rohdaten zusätzlichen Text und Symbole wie E-Mail-Signaturen, Impressum, Zitate früherer Nachrichten in E-Mail-Ketten, CSS-Symbole usw. Andernfalls kann es bei unseren künftig trainierten Modellen zu Leistungseinbußen kommen.

Etiketten für E-Mails entwickeln sich im Laufe der Zeit weiter, da die Kundendienstteams von Scalable neue hinzufügen und vorhandene verfeinern oder entfernen, um den Geschäftsanforderungen gerecht zu werden. Um sicherzustellen, dass die Beschriftungen für Trainingsdaten sowie die erwarteten Klassifizierungen für die Vorhersage auf dem neuesten Stand sind, arbeitet das Data-Science-Team eng mit dem Kundenservice-Team zusammen, um die Richtigkeit der Beschriftungen sicherzustellen.

Modellexperimente

Wir beginnen unser Experiment mit den leicht verfügbaren vorab trainierten Elementen Distilbert-Base-Deutsch-Gehäuse Modell veröffentlicht von Hugging Face. Da es sich bei dem vorab trainierten Modell um ein allgemeines Sprachdarstellungsmodell handelt, können wir die Architektur anpassen, um bestimmte nachgelagerte Aufgaben – wie Klassifizierung und Beantwortung von Fragen – auszuführen, indem wir dem neuronalen Netzwerk entsprechende Köpfe hinzufügen. In unserem Anwendungsfall ist die nachgelagerte Aufgabe, an der wir interessiert sind, die Sequenzklassifizierung. Ohne die zu ändern bestehende Architektur, beschließen wir, drei separate vorab trainierte Modelle für jede unserer erforderlichen Kategorien zu optimieren. Mit dem SageMaker Hugging Face Deep Learning Container (DLCs) wird das Starten und Verwalten von NLP-Experimenten mit Hugging Face-Containern und der SageMaker Experiments API vereinfacht.

Das Folgende ist ein Codeausschnitt von train.py:

Der folgende Code ist der Hugging Face-Schätzer:

Zur Validierung der fein abgestimmten Modelle verwenden wir die F1-Punktzahl aufgrund der Unausgewogenheit unseres E-Mail-Datensatzes, aber auch zur Berechnung anderer Metriken wie Genauigkeit, Präzision und Erinnerung. Damit die SageMaker Experiments-API die Metriken des Trainingsjobs registrieren kann, müssen wir die Metriken zunächst in der lokalen Konsole des Trainingsjobs protokollieren, die von dieser erfasst werden Amazon CloudWatch. Anschließend definieren wir das richtige Regex-Format zum Erfassen der CloudWatch-Protokolle. Die Metrikdefinitionen umfassen den Namen der Metriken und die Regex-Validierung zum Extrahieren der Metriken aus dem Trainingsjob:

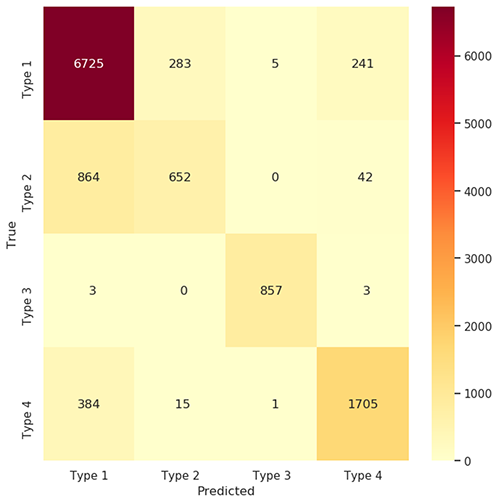

Im Rahmen der Trainingsiteration für das Klassifikatormodell verwenden wir eine Verwirrungsmatrix und einen Klassifizierungsbericht, um das Ergebnis auszuwerten. Die folgende Abbildung zeigt die Verwirrungsmatrix für die Branchenvorhersage.

Verwirrung Matrix

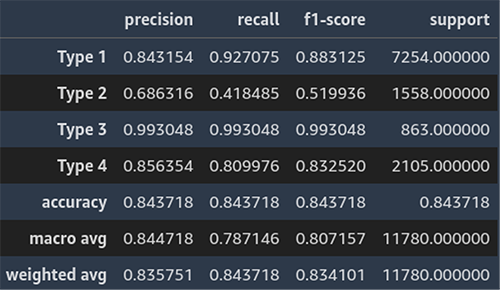

Der folgende Screenshot zeigt ein Beispiel des Klassifizierungsberichts für die Branchenvorhersage.

Klassifizierungsbericht

Als nächste Wiederholung unseres Experiments werden wir davon profitieren Multitasking-Lernen um unser Modell zu verbessern. Multitasking-Lernen ist eine Trainingsform, bei der ein Modell lernt, mehrere Aufgaben gleichzeitig zu lösen, da die zwischen den Aufgaben gemeinsam genutzten Informationen die Lerneffizienz verbessern können. Durch die Anbindung von zwei weiteren Klassifizierungsköpfen an die ursprüngliche Distilbert-Architektur können wir eine Multitasking-Feinabstimmung durchführen, die unserem Kundenservice-Team sinnvolle Kennzahlen liefert.

Modellbereitstellung

In unserem Anwendungsfall soll der E-Mail-Klassifikator an einem Endpunkt bereitgestellt werden, an den unsere CRM-Pipeline einen Stapel nicht klassifizierter E-Mails senden und Vorhersagen zurückerhalten kann. Da wir zusätzlich zur Hugging-Face-Modellinferenz über andere Logiken verfügen, wie z. B. Eingabedatenbereinigung und Multitasking-Vorhersagen, müssen wir ein benutzerdefiniertes Inferenzskript schreiben, das sich daran hält SageMaker-Standard.

Das Folgende ist ein Codeausschnitt von inference.py:

Wenn alles fertig ist, verwenden wir SageMaker Pipelines, um unsere Trainingspipeline zu verwalten und sie an unsere Infrastruktur anzuschließen, um unser MLOps-Setup abzuschließen.

Um die Leistung des bereitgestellten Modells zu überwachen, bauen wir eine Feedbackschleife auf, damit CRM uns den Status klassifizierter E-Mails mitteilen kann, wenn Fälle abgeschlossen werden. Basierend auf diesen Informationen nehmen wir Anpassungen vor, um das bereitgestellte Modell zu verbessern.

Zusammenfassung

In diesem Beitrag haben wir darüber berichtet, wie SageMaker dem Data-Science-Team bei Scalable dabei hilft, den Lebenszyklus eines Data-Science-Projekts, insbesondere des E-Mail-Klassifizierungsprojekts, effizient zu verwalten. Der Lebenszyklus beginnt mit der Anfangsphase der Datenanalyse und -exploration mit SageMaker Studio; geht weiter zum Modellexperiment und zur Bereitstellung mit SageMaker-Training, Inferenz und Hugging Face-DLCs; und endet mit einer Trainingspipeline mit SageMaker Pipelines, die in andere AWS-Dienste integriert ist. Dank dieser Infrastruktur sind wir in der Lage, neue Modelle effizienter zu iterieren und bereitzustellen und so bestehende Prozesse innerhalb von Scalable sowie die Erfahrungen unserer Kunden zu verbessern.

Weitere Informationen zu Hugging Face und SageMaker finden Sie in den folgenden Ressourcen:

Über die Autoren

Dr. Sandra Schmid ist Head of Data Analytics bei der Scalable GmbH. Sie ist gemeinsam mit ihren Teams für datengetriebene Ansätze und Use Cases im Unternehmen verantwortlich. Ihr Hauptaugenmerk liegt darauf, die beste Kombination aus maschinellen Lern- und Data-Science-Modellen und Geschäftszielen zu finden, um den größtmöglichen Geschäftswert und die größtmögliche Effizienz aus Daten zu ziehen.

Dr. Sandra Schmid ist Head of Data Analytics bei der Scalable GmbH. Sie ist gemeinsam mit ihren Teams für datengetriebene Ansätze und Use Cases im Unternehmen verantwortlich. Ihr Hauptaugenmerk liegt darauf, die beste Kombination aus maschinellen Lern- und Data-Science-Modellen und Geschäftszielen zu finden, um den größtmöglichen Geschäftswert und die größtmögliche Effizienz aus Daten zu ziehen.

Huy Dang Data Scientist bei Scalable GmbH. Zu seinen Aufgaben gehören Datenanalysen, die Erstellung und Bereitstellung von Modellen für maschinelles Lernen sowie die Entwicklung und Wartung der Infrastruktur für das Data-Science-Team. In seiner Freizeit liest er gerne, wandert, klettert und hält sich über die neuesten Entwicklungen im Bereich maschinelles Lernen auf dem Laufenden.

Huy Dang Data Scientist bei Scalable GmbH. Zu seinen Aufgaben gehören Datenanalysen, die Erstellung und Bereitstellung von Modellen für maschinelles Lernen sowie die Entwicklung und Wartung der Infrastruktur für das Data-Science-Team. In seiner Freizeit liest er gerne, wandert, klettert und hält sich über die neuesten Entwicklungen im Bereich maschinelles Lernen auf dem Laufenden.

Mia Chang ist ein ML-Spezialist für Lösungsarchitekten für Amazon Web Services. Sie arbeitet mit Kunden in EMEA zusammen und teilt Best Practices für die Ausführung von KI/ML-Workloads in der Cloud mit ihrem Hintergrund in angewandter Mathematik, Informatik und KI/ML. Sie konzentriert sich auf NLP-spezifische Arbeitsbelastungen und teilt ihre Erfahrungen als Konferenzrednerin und Buchautorin. In ihrer Freizeit macht sie gerne Yoga, spielt Brettspiele und kocht gerne Kaffee.

Mia Chang ist ein ML-Spezialist für Lösungsarchitekten für Amazon Web Services. Sie arbeitet mit Kunden in EMEA zusammen und teilt Best Practices für die Ausführung von KI/ML-Workloads in der Cloud mit ihrem Hintergrund in angewandter Mathematik, Informatik und KI/ML. Sie konzentriert sich auf NLP-spezifische Arbeitsbelastungen und teilt ihre Erfahrungen als Konferenzrednerin und Buchautorin. In ihrer Freizeit macht sie gerne Yoga, spielt Brettspiele und kocht gerne Kaffee.

Moritz Gürtler ist Account Executive im Segment Digital Native Businesses bei AWS. Er konzentriert sich auf Kunden im FinTech-Bereich und unterstützt sie dabei, Innovationen durch sichere und skalierbare Cloud-Infrastruktur zu beschleunigen.

Moritz Gürtler ist Account Executive im Segment Digital Native Businesses bei AWS. Er konzentriert sich auf Kunden im FinTech-Bereich und unterstützt sie dabei, Innovationen durch sichere und skalierbare Cloud-Infrastruktur zu beschleunigen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- ChartPrime. Verbessern Sie Ihr Handelsspiel mit ChartPrime. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/accelerate-client-success-management-through-email-classification-with-hugging-face-on-amazon-sagemaker/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 100

- 13

- 15%

- 17

- 2021

- 26%

- 32

- 500

- 7

- a

- Fähig

- Über Uns

- oben

- beschleunigen

- beschleunigend

- Akzeptieren

- Zugang

- unterbringen

- Nach

- Konto

- Trading Konten

- Genauigkeit

- Erreicht

- über

- aktiv

- Handlungen

- automatisch

- hinzufügen

- Zusatz

- Anpassungen

- adoptieren

- Vorteil

- Nach der

- danach

- Agenten

- AI / ML

- Ziel

- erlaubt

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- unter

- an

- Analyse

- Analytik

- und

- jedem

- Apache

- Bienen

- angewandt

- Ansätze

- angemessen

- Genehmigung

- genehmigen

- Architektur

- SIND

- Argumente

- AS

- zugewiesen

- At

- anhängen

- Autor

- Automatisiert

- verfügbar

- AWS

- Zurück

- Hintergrund

- Banken

- Base

- basierend

- Grundlage

- BE

- weil

- war

- Sein

- Vorteile

- BESTE

- Best Practices

- zwischen

- Tafel

- Brettspiele

- Körper

- buchen

- Filiale

- Break

- Brokerage

- bauen

- Building

- erbaut

- Geschäft

- Unternehmen

- aber

- by

- CAN

- Hauptstadt

- Hauptstadt

- Erfassung

- gefangen

- tragen

- Häuser

- Fälle

- Kategorien

- Ketten

- Einstufung

- eingestuft

- Reinigung

- Auftraggeber

- Kunden

- Klettern

- Menu

- geschlossen

- Cloud

- Cloud-Infrastruktur

- Code

- Codebasis

- Codes

- Kaffee

- Zusammenarbeit

- Kombination

- kommt

- verpflichten

- mit uns kommunizieren,

- Unternehmen

- Unternehmen

- vergleichbar

- abschließen

- Wird abgeschlossen

- Komponenten

- Berechnen

- Computer

- Computerwissenschaften

- Konferenz

- Verwirrung

- konsistent

- besteht

- Konsul (Console)

- Behälter

- Inhalt

- Inhalt

- und beseitigen Muskelschwäche

- CRM

- CSS

- verwahrer

- Original

- Kunde

- Kunden

- Unterricht

- technische Daten

- Datenanalyse

- Datenanalyse

- Datenaufbereitung

- Datenwissenschaft

- Datenwissenschaftler

- datengesteuerte

- Datum

- entscheidet

- entschieden

- gewidmet

- tief

- tiefe Lernen

- Standard

- definieren

- definiert

- Definitionen

- demokratisieren

- zeigen

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- setzt ein

- Design

- Detail

- entwickeln

- Entwicklung

- Entwicklung

- Entwicklungen

- anders

- digital

- digitale Vermögensverwaltung

- nach unten

- zwei

- jeder

- Einfache

- Wirkungsgrade

- effizient

- sonst

- E-Mails

- EMEA

- Mitarbeiter

- ermöglichen

- Endpunkt

- beschäftigt

- gewährleisten

- Arbeitsumfeld

- Epoche

- insbesondere

- Europa

- bewerten

- Auswertung

- Event

- alles

- entwickelt sich

- untersuchen

- Beispiel

- Exzellenz

- Exekutive

- vorhandenen

- Erwartung

- Erwartungen

- erwartet

- ERFAHRUNGEN

- erfahrensten

- Erfahrungen

- Experiment

- Experimente

- Exploration

- Explorative Datenanalyse

- ERKUNDEN

- extra

- f1

- Gesicht

- erleichtern

- erleichtert

- Fashion

- beschleunigt

- schnellsten

- am schnellsten wachsenden

- Feedback

- Abbildung

- Revolution

- Suche nach

- FinTech

- FinTechs

- Vorname

- erste Schritte

- Wohnung

- Setzen Sie mit Achtsamkeit

- konzentriert

- Folgende

- Aussichten für

- unten stehende Formular

- Format

- Frei

- für

- Funktion

- Zukunft

- Gewinnen

- Games

- Tor

- allgemeiner Zweck

- erzeugen

- bekommen

- GitHub

- GmbH

- Ziele

- persönlichem Wachstum

- GUEST

- Guest Post

- hätten

- Haben

- he

- ganzer

- Köpfe

- hier (auf dänisch)

- seine

- historisch

- gehostet

- Ultraschall

- HTML

- http

- HTTPS

- hunderte

- identifiziert

- if

- implementieren

- Umsetzung

- zu unterstützen,

- in

- das

- Eingehende

- Erhöhung

- hat

- Information

- Infrastruktur

- Anfangs-

- Innovation

- innovativ

- Varianten des Eingangssignals:

- Anfragen

- Anfrage

- integriert

- Intelligent

- interessiert

- in

- einführen

- Investieren

- Investition

- ruft auf

- IT

- Iteration

- SEINE

- Job

- JSON

- Behalten

- Wesentliche

- Label

- Etiketten

- Sprache

- höchste

- neueste

- führenden

- LERNEN

- lernen

- Lebenszyklus

- Line

- Belastung

- aus einer regionalen

- Log

- protokolliert

- suchen

- Verlust

- Maschine

- Maschinelles Lernen

- gemacht

- Aufrechterhaltung

- um

- Making

- verwalten

- verwaltet

- Management

- flächendeckende Gesundheitsprogramme

- Markt

- Märkte

- Mathematik

- Matrix

- Merge

- Ereignis zusammenführen

- Nachrichten

- Methode

- Metrisch

- Metrik

- könnte

- ML

- MLOps

- Modell

- für

- modern

- Überwachen

- monatlich

- mehr

- bewegt sich

- viel

- mehrere

- Name

- nämlich

- nativen

- Natürliche

- Verarbeitung natürlicher Sprache

- Natur

- Need

- Bedürfnisse

- Netzwerk

- Nerven-

- neuronale Netzwerk

- Neu

- weiter

- Nlp

- Notizbuch

- jetzt an

- Anzahl

- of

- Angebote

- on

- EINEM

- Einsen

- einzige

- Betriebs-

- or

- Auftrag

- Original

- Andere

- Andernfalls

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- aussen

- übrig

- Teil

- teilnehmen

- Ausführen

- Leistung

- Phase

- abgeholt

- Pipeline

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- möglich

- Post

- Praktiken

- Präzision

- Prognose

- Prognosen

- Vorbereitung

- früher

- primär

- privat

- Prozessdefinierung

- anpassen

- Verarbeitung

- Produziert

- Produktion

- PRODUKTIVITÄT

- Produkte

- Projekt

- Projekte

- ordnungsgemäße

- Prototyp

- die

- bietet

- Öffentlichkeit

- veröffentlicht

- Zwecke

- Push

- Frage

- schnell

- Zitate

- erhöhen

- Bewerten

- Roh

- erreicht

- Lesen Sie mehr

- Lesebrillen

- bereit

- vernünftig

- erhält

- Aufzeichnungen

- Reduziert

- siehe

- verfeinern

- Regex

- Registrieren

- Registratur

- relevant

- zuverlässig

- entfernt

- entfernen

- berichten

- Darstellung

- Anforderung

- Zugriffe

- falls angefordert

- entschlossen

- Downloads

- diejenigen

- reagiert

- Antwort

- Antworten

- Verantwortlichkeiten

- für ihren Verlust verantwortlich.

- Folge

- Rückkehr

- robust

- Rock

- Laufen

- sagemaker

- SageMaker-Pipelines

- gleich

- skalierbaren

- Skalieren

- Wissenschaft

- Wissenschaftler

- Wissenschaftler

- Skript

- Abschnitt

- Abschnitte

- Verbindung

- Segment

- senden

- getrennte

- Reihenfolge

- brauchen

- Lösungen

- Setup

- geformt

- von Locals geführtes

- Shares

- sie

- Konzerte

- Unterschriften

- Einfacher

- gleichzeitig

- Fähigkeiten

- kleinere

- Schnipsel

- So

- Lösung

- Lösungen

- LÖSEN

- bald

- Raumfahrt

- Speaker

- Spezialist

- Spezialisten

- spezifisch

- speziell

- Stufe

- Anfang

- Beginnen Sie

- beginnt

- State-of-the-art

- Status

- bleiben

- Schritt

- Shritte

- Lagerung

- gelagert

- Speicherung

- rationalisieren

- Studio Adressen

- Fach

- Erfolg

- so

- Unterstützt

- sicher

- Nehmen

- Aufgabe

- und Aufgaben

- Team

- Teams

- Technische

- Zehn

- Test

- Testen

- Text

- als

- Vielen Dank

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Dort.

- deswegen

- vom Nutzer definierten

- fehlen uns die Worte.

- Tausende

- nach drei

- Durch

- Zeit

- zu

- gemeinsam

- Werkzeug

- Thema

- Fackel

- verfolgen sind

- Trading

- Trading Platform

- Training

- trainiert

- Ausbildung

- Transformator

- Transformer

- riesig

- WENDE

- XNUMX

- tippe

- Typen

- Updates

- us

- -

- Anwendungsfall

- benutzt

- Mitglied

- Benutzererfahrung

- verwendet

- Verwendung von

- BESTÄTIGEN

- Bestätigung

- Wert

- Version

- Warten

- wurde

- we

- Reichtum

- Vermögensverwaltung

- Netz

- Web-Services

- GUT

- waren

- wann

- sobald

- welche

- während

- mit

- .

- ohne

- Arbeitsablauf.

- Workflows

- Werk

- schreiben

- Yoga

- Zephyrnet