Unternehmen haben Zugriff auf riesige Datenmengen, von denen viele schwer zu entdecken sind, da die Daten unstrukturiert sind. Konventionelle Analyseansätze unstrukturierte Daten Verwenden Sie den Schlüsselwort- oder Synonymabgleich. Sie erfassen nicht den gesamten Kontext eines Dokuments und sind daher weniger effektiv im Umgang mit unstrukturierten Daten.

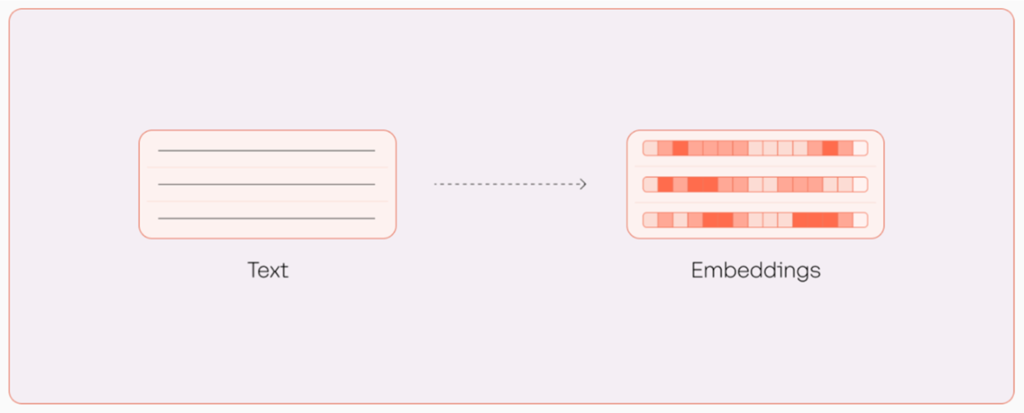

Im Gegensatz dazu werden Texteinbettungen verwendet Maschinelles Lernen (ML)-Funktionen zur Erfassung der Bedeutung unstrukturierter Daten. Einbettungen werden durch repräsentative Sprachmodelle generiert, die Text in numerische Vektoren übersetzen und Kontextinformationen in einem Dokument kodieren. Dies ermöglicht Anwendungen wie semantische Suche, Augmented Generation abrufen (RAG), Themenmodellierung und Textklassifizierung.

In der Finanzdienstleistungsbranche umfassen die Anwendungen beispielsweise das Extrahieren von Erkenntnissen aus Gewinnberichten, die Suche nach Informationen aus Finanzberichten und die Analyse der Stimmung über Aktien und Märkte in Finanznachrichten. Texteinbettungen ermöglichen es Branchenexperten, Erkenntnisse aus Dokumenten zu gewinnen, Fehler zu minimieren und ihre Leistung zu steigern.

In diesem Beitrag stellen wir eine Anwendung vor, die mithilfe von Cohere Finanznachrichten in verschiedenen Sprachen durchsuchen und abfragen kann Einbetten und Neu einordnen Modelle mit Amazonas Grundgestein.

Das mehrsprachige Einbettungsmodell von Cohere

Cohere ist eine führende KI-Plattform für Unternehmen, die erstklassige Large Language Models (LLMs) und LLM-gestützte Lösungen erstellt, die es Computern ermöglichen, in Texten zu suchen, Bedeutungen zu erfassen und sich darin zu unterhalten. Sie bieten Benutzerfreundlichkeit und starke Sicherheits- und Datenschutzkontrollen.

Das mehrsprachige Einbettungsmodell von Cohere generiert Vektordarstellungen von Dokumenten für über 100 Sprachen und ist auf Amazon Bedrock verfügbar. Dadurch können AWS-Kunden als API darauf zugreifen, wodurch die Verwaltung der zugrunde liegenden Infrastruktur entfällt und sichergestellt wird, dass vertrauliche Informationen sicher verwaltet und geschützt bleiben.

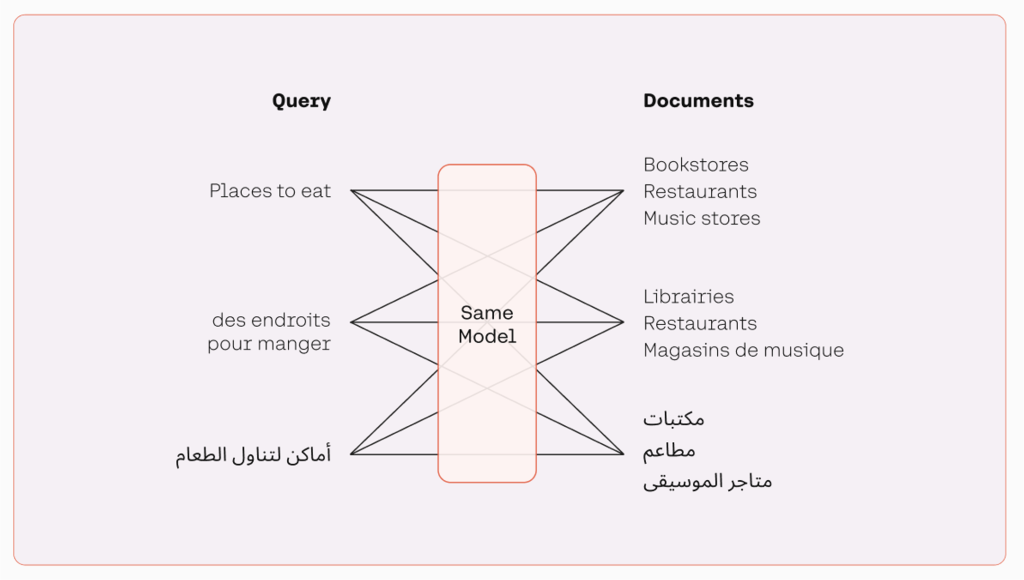

Das mehrsprachige Modell gruppiert Texte mit ähnlicher Bedeutung, indem es ihnen nahe beieinander liegende Positionen in einem semantischen Vektorraum zuordnet. Mit einem mehrsprachigen Einbettungsmodell können Entwickler Texte in mehreren Sprachen verarbeiten, ohne zwischen verschiedenen Modellen wechseln zu müssen, wie in der folgenden Abbildung dargestellt. Dies macht die Verarbeitung effizienter und verbessert die Leistung für mehrsprachige Anwendungen.

Im Folgenden sind einige der Highlights des Einbettungsmodells von Cohere aufgeführt:

- Konzentrieren Sie sich auf die Dokumentenqualität – Typische Einbettungsmodelle werden trainiert, um die Ähnlichkeit zwischen Dokumenten zu messen, aber das Modell von Cohere misst auch die Qualität von Dokumenten

- Besserer Abruf für RAG-Anwendungen – RAG-Anwendungen erfordern ein gutes Retrieval-System, das das Einbettungsmodell von Cohere auszeichnet

- Kosteneffiziente Datenkomprimierung – Cohere verwendet eine spezielle, kompressionsbewusste Trainingsmethode, die zu erheblichen Kosteneinsparungen für Ihre Vektordatenbank führt

Anwendungsfälle für die Texteinbettung

Texteinbettungen verwandeln unstrukturierte Daten in eine strukturierte Form. Dadurch können Sie alle diese Dokumente objektiv vergleichen, analysieren und daraus Erkenntnisse ableiten. Im Folgenden finden Sie Beispielanwendungsfälle, die das Einbettungsmodell von Cohere ermöglicht:

- Semantische Suche – Ermöglicht leistungsstarke Suchanwendungen in Verbindung mit einer Vektordatenbank mit hervorragender Relevanz basierend auf der Bedeutung der Suchbegriffe

- Suchmaschine für ein größeres System – Findet und ruft die relevantesten Informationen aus verbundenen Unternehmensdatenquellen für RAG-Systeme ab

- Textklassifizierung – Unterstützt Absichtserkennung, Stimmungsanalyse und erweiterte Dokumentenanalyse

- Themenmodellierung – Wandelt eine Sammlung von Dokumenten in unterschiedliche Cluster um, um neue Themen und Themen aufzudecken

Verbesserte Suchsysteme mit Rerank

Wie führt man in Unternehmen, in denen herkömmliche Schlüsselwortsuchsysteme bereits vorhanden sind, moderne semantische Suchfunktionen ein? Für solche Systeme, die schon lange Teil der Informationsarchitektur eines Unternehmens sind, ist eine vollständige Migration auf einen einbettungsbasierten Ansatz in vielen Fällen einfach nicht machbar.

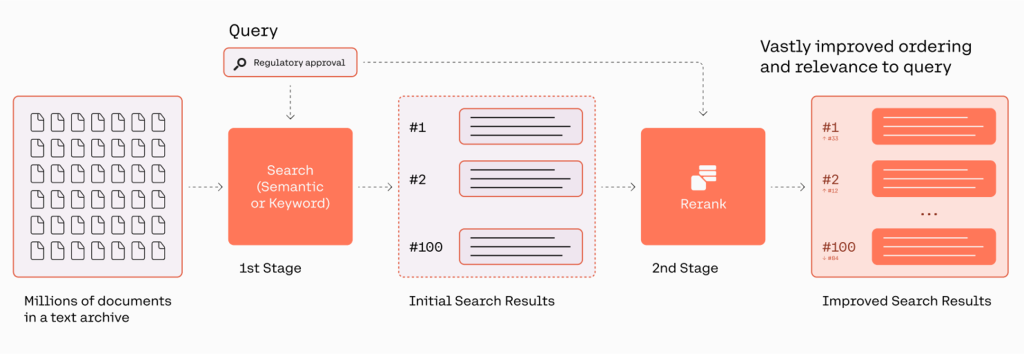

Coheres Rerank-Endpunkt soll diese Lücke schließen. Es fungiert als zweite Stufe eines Suchablaufs, um eine Rangfolge relevanter Dokumente für die Suchanfrage eines Benutzers bereitzustellen. Unternehmen können ein bestehendes Schlüsselwortsystem (oder sogar ein semantisches System) für die erste Retrieval-Stufe beibehalten und die Qualität der Suchergebnisse mit dem Rerank-Endpunkt in der zweiten Reranking-Stufe steigern.

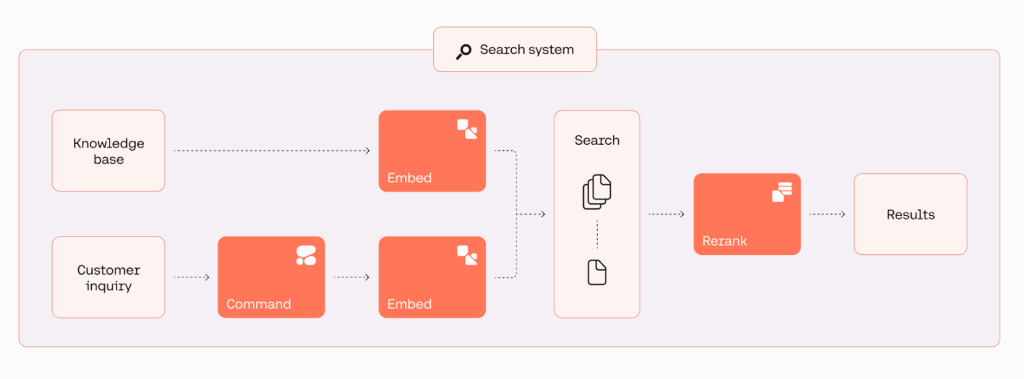

Rerank bietet eine schnelle und unkomplizierte Option zur Verbesserung der Suchergebnisse, indem mit einer einzigen Codezeile semantische Suchtechnologie in den Stack eines Benutzers eingeführt wird. Der Endpunkt verfügt außerdem über mehrsprachige Unterstützung. Die folgende Abbildung veranschaulicht den Abruf- und Neuranking-Workflow.

Lösungsüberblick

Finanzanalysten müssen viele Inhalte verarbeiten, beispielsweise Finanzpublikationen und Nachrichtenmedien, um auf dem Laufenden zu bleiben. Entsprechend der Verband für Finanzfachleute (AFP)Finanzanalysten verbringen 75 % ihrer Zeit damit, Daten zu sammeln oder den Prozess zu verwalten, anstatt Mehrwertanalysen durchzuführen. Die Antwort auf eine Frage in einer Vielzahl von Quellen und Dokumenten zu finden, ist zeitaufwändig und mühsam. Das Cohere-Einbettungsmodell hilft Analysten, schnell zahlreiche Artikeltitel in mehreren Sprachen zu durchsuchen, um die Artikel zu finden und einzustufen, die für eine bestimmte Suchanfrage am relevantesten sind, was enorm viel Zeit und Mühe spart.

Im folgenden Anwendungsbeispiel zeigen wir, wie das Embed-Modell von Cohere Finanznachrichten in verschiedenen Sprachen in einer einzigen Pipeline durchsucht und abfragt. Anschließend zeigen wir, wie das Hinzufügen von Rerank zu Ihrem Einbettungsabruf (oder das Hinzufügen zu einer älteren lexikalischen Suche) die Ergebnisse weiter verbessern kann.

Das unterstützende Notebook ist verfügbar unter GitHub.

Das folgende Diagramm veranschaulicht den Arbeitsablauf der Anwendung.

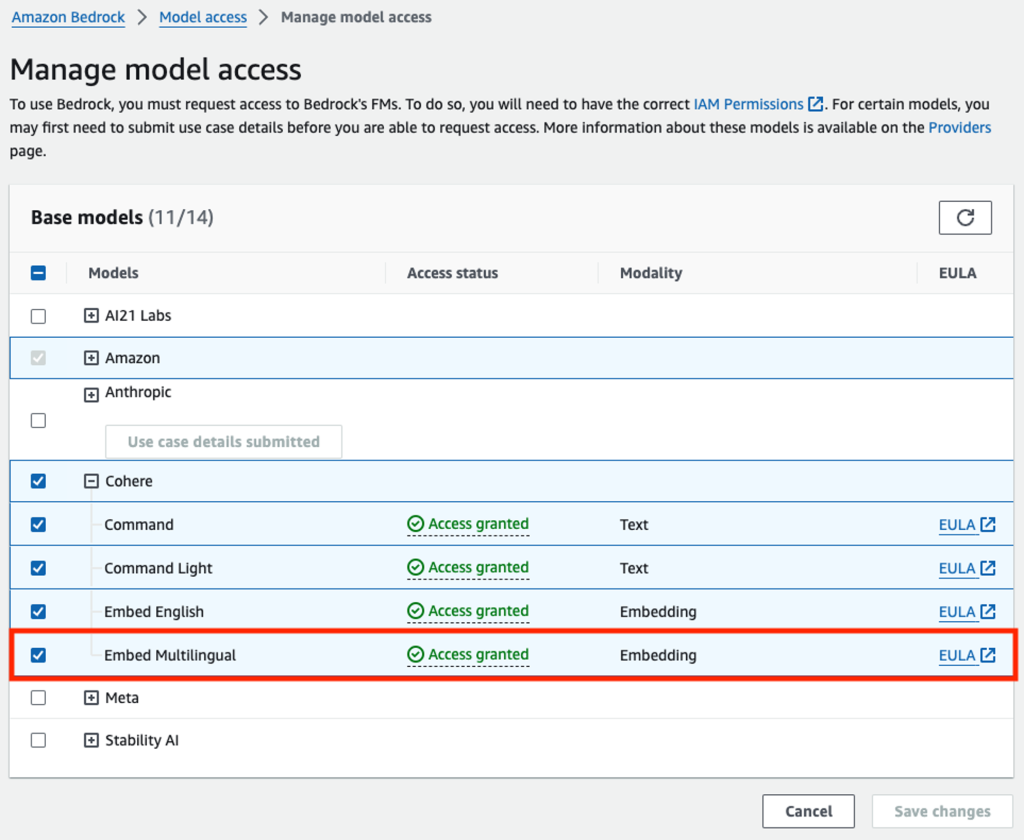

Aktivieren Sie den Modellzugriff über Amazon Bedrock

Benutzer von Amazon Bedrock müssen Zugriff auf Modelle anfordern, um sie zur Nutzung verfügbar zu machen. Um Zugriff auf weitere Modelle anzufordern, wählen Sie Modellzugriff Der Navigationsbereich auf dem Amazon Bedrock trösten. Weitere Informationen finden Sie unter Modellzugriff. Für diese exemplarische Vorgehensweise müssen Sie Zugriff auf das Cohere Embed Multilingual-Modell anfordern.

Installieren Sie Pakete und importieren Sie Module

Zuerst installieren wir die notwendigen Pakete und importieren die Module, die wir in diesem Beispiel verwenden werden:

Einfuhrdokumente

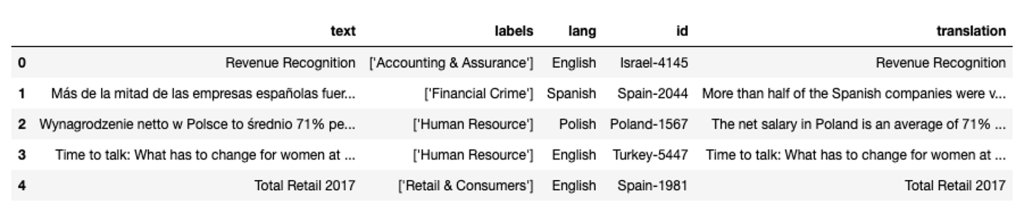

Wir verwenden einen Datensatz (MultiFIN), der eine Liste realer Artikelüberschriften in 15 Sprachen enthält (Englisch, Türkisch, Dänisch, Spanisch, Polnisch, Griechisch, Finnisch, Hebräisch, Japanisch, Ungarisch, Norwegisch, Russisch, Italienisch, Isländisch und Schwedisch). ). Dies ist ein Open-Source-Datensatz, der für die finanzielle Verarbeitung natürlicher Sprache (NLP) kuratiert wurde und auf a verfügbar ist GitHub-Repository.

In unserem Fall haben wir eine CSV-Datei mit den Daten von MultiFIN sowie eine Spalte mit Übersetzungen erstellt. Wir verwenden diese Spalte nicht, um das Modell zu füttern; Wir verwenden es, um beim Drucken der Ergebnisse für diejenigen, die kein Dänisch oder Spanisch sprechen, nachzuverfolgen. Wir verweisen auf diese CSV-Datei, um unseren Datenrahmen zu erstellen:

Wählen Sie eine Liste der abzufragenden Dokumente aus

MultiFIN verfügt über über 6,000 Datensätze in 15 verschiedenen Sprachen. Für unseren Beispielanwendungsfall konzentrieren wir uns auf drei Sprachen: Englisch, Spanisch und Dänisch. Wir sortieren die Header auch nach Länge und wählen die längsten aus.

Da wir die längsten Artikel auswählen, stellen wir sicher, dass die Länge nicht auf wiederholte Sequenzen zurückzuführen ist. Der folgende Code zeigt ein Beispiel, in dem dies der Fall ist. Wir werden das aufräumen.

df['text'].iloc[2215]

Unsere Dokumentenliste ist gut auf die drei Sprachen verteilt:

Das Folgende ist der längste Artikelkopf in unserem Datensatz:

Dokumente einbetten und indizieren

Jetzt wollen wir unsere Dokumente einbetten und die Einbettungen speichern. Bei den Einbettungen handelt es sich um sehr große Vektoren, die die semantische Bedeutung unseres Dokuments zusammenfassen. Insbesondere verwenden wir das Modell „embed-multilingual-v3.0“ von Cohere, das Einbettungen mit 1,024 Dimensionen erstellt.

Wenn eine Abfrage übergeben wird, betten wir die Abfrage auch ein und verwenden die hnswlib-Bibliothek, um die nächsten Nachbarn zu finden.

Es sind nur wenige Codezeilen erforderlich, um einen Cohere-Client einzurichten, die Dokumente einzubetten und den Suchindex zu erstellen. Wir verfolgen auch die Sprache und Übersetzung des Dokuments, um die Anzeige der Ergebnisse zu bereichern.

Bauen Sie ein Abrufsystem auf

Als Nächstes erstellen wir eine Funktion, die eine Abfrage als Eingabe verwendet, sie einbettet und die vier Header findet, die näher damit zusammenhängen:

Fragen Sie das Abrufsystem ab

Lassen Sie uns untersuchen, was unser System mit einigen verschiedenen Abfragen macht. Wir beginnen mit Englisch:

Die Ergebnisse sind wie folgt:

Beachten Sie Folgendes:

- Wir stellen verwandte, aber leicht unterschiedliche Fragen, und das Modell ist nuanciert genug, um die relevantesten Ergebnisse oben anzuzeigen.

- Unser Modell führt keine schlüsselwortbasierte Suche durch, sondern eine semantische Suche. Selbst wenn wir einen Begriff wie „Data Science“ anstelle von „KI“ verwenden, ist unser Modell in der Lage, zu verstehen, was gefragt wird, und ganz oben das relevanteste Ergebnis zurückzugeben.

Wie wäre es mit einer Anfrage auf Dänisch? Schauen wir uns die folgende Abfrage an:

Im vorherigen Beispiel steht das englische Akronym „PP&E“ für „Property, Plant, and Equipment“ und unser Modell konnte es mit unserer Abfrage verbinden.

In diesem Fall sind alle zurückgegebenen Ergebnisse auf Dänisch, aber das Modell kann ein Dokument in einer anderen Sprache als der Abfrage zurückgeben, wenn seine semantische Bedeutung näher ist. Wir sind völlig flexibel und können mit wenigen Codezeilen festlegen, ob das Modell nur Dokumente in der Sprache der Abfrage oder alle Dokumente betrachten soll.

Verbessern Sie die Ergebnisse mit Cohere Rerank

Einbettungen sind sehr mächtig. Jetzt werden wir uns jedoch ansehen, wie wir unsere Ergebnisse mit dem Rerank-Endpunkt von Cohere noch weiter verfeinern können, der darauf trainiert wurde, die Relevanz von Dokumenten anhand einer Abfrage zu bewerten.

Ein weiterer Vorteil von Rerank besteht darin, dass es auf einer älteren Stichwortsuchmaschine aufbauen kann. Sie müssen nicht auf eine Vektordatenbank umsteigen oder drastische Änderungen an Ihrer Infrastruktur vornehmen, und es sind nur wenige Codezeilen erforderlich. Rerank ist verfügbar in Amazon Sage Maker.

Versuchen wir es mit einer neuen Abfrage. Diesmal verwenden wir SageMaker:

In diesem Fall konnte eine semantische Suche unsere Antwort abrufen und in den Ergebnissen anzeigen, sie steht jedoch nicht ganz oben. Wenn wir die Abfrage jedoch mit der Liste der abgerufenen Dokumente erneut an unseren Rerank-Endpunkt übergeben, kann Rerank das relevanteste Dokument ganz oben anzeigen.

Zuerst erstellen wir den Client und den Rerank-Endpunkt:

Wenn wir die Dokumente an Rerank übergeben, kann das Modell genau das relevanteste auswählen:

Zusammenfassung

In diesem Beitrag wurde eine exemplarische Vorgehensweise für die Verwendung des mehrsprachigen Einbettungsmodells von Cohere in Amazon Bedrock im Bereich Finanzdienstleistungen vorgestellt. Insbesondere haben wir ein Beispiel einer mehrsprachigen Suchanwendung für Finanzartikel demonstriert. Wir haben gesehen, wie das Einbettungsmodell eine effiziente und genaue Ermittlung von Informationen ermöglicht und dadurch die Produktivität und Ausgabequalität eines Analysten steigert.

Das mehrsprachige Einbettungsmodell von Cohere unterstützt über 100 Sprachen. Dadurch entfällt die Komplexität beim Erstellen von Anwendungen, die die Arbeit mit einem Korpus von Dokumenten in verschiedenen Sprachen erfordern. Der Cohere Embed-Modell ist darauf geschult, Ergebnisse in realen Anwendungen zu liefern. Es verarbeitet verrauschte Daten als Eingaben, passt sich an komplexe RAG-Systeme an und sorgt durch seine kompressionsbewusste Trainingsmethode für Kosteneffizienz.

Beginnen Sie noch heute mit dem mehrsprachigen Einbettungsmodell von Cohere in Amazon Bedrock.

Über die Autoren

James Yi ist Senior AI/ML Partner Solutions Architect im Technology Partners COE Tech-Team bei Amazon Web Services. Er arbeitet leidenschaftlich gerne mit Unternehmenskunden und Partnern zusammen, um KI/ML-Anwendungen zu entwerfen, bereitzustellen und zu skalieren, um einen Geschäftswert zu erzielen. Außerhalb der Arbeit spielt er gerne Fußball, reist und verbringt Zeit mit seiner Familie.

James Yi ist Senior AI/ML Partner Solutions Architect im Technology Partners COE Tech-Team bei Amazon Web Services. Er arbeitet leidenschaftlich gerne mit Unternehmenskunden und Partnern zusammen, um KI/ML-Anwendungen zu entwerfen, bereitzustellen und zu skalieren, um einen Geschäftswert zu erzielen. Außerhalb der Arbeit spielt er gerne Fußball, reist und verbringt Zeit mit seiner Familie.

Gonzalo Betegon ist Solutions Architect bei Cohere, einem Anbieter modernster Technologie zur Verarbeitung natürlicher Sprache. Er hilft Unternehmen, ihre Geschäftsanforderungen durch den Einsatz großer Sprachmodelle zu erfüllen.

Gonzalo Betegon ist Solutions Architect bei Cohere, einem Anbieter modernster Technologie zur Verarbeitung natürlicher Sprache. Er hilft Unternehmen, ihre Geschäftsanforderungen durch den Einsatz großer Sprachmodelle zu erfüllen.

Meor Amer ist Developer Advocate bei Cohere, einem Anbieter modernster NLP-Technologie (Natural Language Processing). Er hilft Entwicklern beim Aufbau modernster Anwendungen mit den Large Language Models (LLMs) von Cohere.

Meor Amer ist Developer Advocate bei Cohere, einem Anbieter modernster NLP-Technologie (Natural Language Processing). Er hilft Entwicklern beim Aufbau modernster Anwendungen mit den Large Language Models (LLMs) von Cohere.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/build-financial-search-applications-using-the-amazon-bedrock-cohere-multilingual-embedding-model/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 000

- 1

- 10

- 100

- 11

- 13

- 15%

- 16

- 2030

- 22

- 29

- 33

- 7

- 8

- 80

- 9

- a

- Fähig

- Über uns

- Zugang

- Nach

- Konto

- genau

- genau

- Erreichen

- über

- Handlungen

- passt sich an

- Hinzufügen

- Zusätzliche

- Adresse

- advanced

- Vorteil

- Anwalt

- AFP

- aufs Neue

- gegen

- AI

- KI-Plattform

- AI / ML

- Alle

- erlauben

- erlaubt

- entlang

- bereits

- ebenfalls

- Amazon

- Amazon Web Services

- Betrag

- Beträge

- an

- Analyse

- Analytiker

- Business Analysten

- Analyse

- und

- beantworten

- Bienen

- Anwendung

- Anwendungen

- Ansatz

- Ansätze

- Architektur

- SIND

- Artikel

- Artikel

- AS

- fragen

- At

- Augmented

- verfügbar

- AWS

- basierend

- weil

- war

- Sein

- Besser

- zwischen

- Blockiert

- Auftrieb

- Stärkung

- Brexit

- BRIDGE

- bauen

- Building

- baut

- Geschäft

- Geschäftsführer

- Unternehmen

- aber

- by

- CAN

- Fähigkeiten

- Erfassung

- Häuser

- Fälle

- Decke

- CFOs

- challenges

- Herausforderungen

- Übernehmen

- Änderungen

- Auswählen

- Einstufung

- reinigen

- Auftraggeber

- Menu

- eng

- näher

- CO

- Code

- Sammlung

- Kolonne

- kommt

- Unternehmen

- Unternehmen

- vergleichen

- abschließen

- Komplex

- Komplexität

- Computer

- betroffen

- Vernetz Dich

- Sie

- Inhalt

- Kontext

- kontextuelle

- Kontrast

- Steuerung

- konventionellen

- Unternehmen

- Kosten

- Einsparmaßnahmen

- könnte

- Paar

- gekoppelt

- Abdeckung

- COVID-19

- erstellen

- erstellt

- schafft

- Kredit

- Krise

- Kriterien

- kuratiert

- Strom

- Kunden

- innovativ, auf dem neuesten Stand

- Internet-Sicherheit

- dänisch

- Dänisch

- technische Daten

- Datenwissenschaft

- Datenbase

- de

- Frist

- Behandlung

- gewidmet

- des Restaurants

- Übergeben

- Ergebnisse liefern

- liefert

- zeigen

- weisen nach, dass

- einsetzen

- Einsatz

- Ablagerungen

- ableiten

- Design

- entworfen

- Entwickler:in / Unternehmen

- Entwickler

- Entwicklung

- anders

- schwer

- Digest

- Größe

- entdeckt,

- Entdeckung

- Display

- deutlich

- verteilt

- Verteilung

- do

- Dokument

- Unterlagen

- die

- Domain

- Nicht

- nach unten

- Antrieb

- zwei

- e

- jeder

- Früh

- Verdienste

- erleichtern

- Benutzerfreundlichkeit

- Wirtschaft

- Effektiv

- effizient

- Anstrengung

- el

- eliminiert

- sonst

- einbetten

- Einbettung

- aufstrebenden

- Emissionen

- Mitarbeiter

- ermöglichen

- ermöglicht

- Ende

- Endpunkt

- Engagement

- Motor

- Englisch

- enorm

- genug

- bereichern

- gewährleisten

- sorgt

- Unternehmen

- Unternehmen

- Arbeitsumfeld

- Ausrüstung

- Fehler

- Nachhaltigkeit

- etablieren

- Sogar

- Beispiel

- Ausgezeichnet

- vorhandenen

- erfahrensten

- ERKUNDEN

- Extrakt

- Stürze

- Familie

- FAST

- möglich

- wenige

- Abbildung

- Reichen Sie das

- Revolution

- Finanznachrichten

- Finanzdienstleistungen

- Finden Sie

- Suche nach

- findet

- finnisch

- fünf

- Flexibilität

- Fluss

- Setzen Sie mit Achtsamkeit

- folgen

- Folgende

- folgt

- Aussichten für

- unten stehende Formular

- gefunden

- vier

- Frist

- für

- voller

- Funktion

- weiter

- Lücke

- GAS

- Sammlung

- BIP

- erzeugt

- erzeugt

- Global

- Globale Wirtschaft

- Go

- Ziele

- gehen

- gut

- griechisch

- Gruppen

- Guide

- Griffe

- Haben

- he

- Überschriften

- Schlagzeilen

- Hebräisch

- Hilfe

- hilft

- Highlights

- seine

- Hit

- Ultraschall

- Hilfe

- aber

- HTML

- HTTPS

- Ungarisch

- i

- if

- zeigt

- Umsetzung

- importieren

- zu unterstützen,

- verbessert

- Verbesserung

- in

- das

- Erhöhung

- Index

- Energiegewinnung

- Info

- Information

- informiert

- Infrastruktur

- Varianten des Eingangssignals:

- Eingänge

- Einblicke

- installieren

- beantragen müssen

- integrieren

- Integration

- Absicht

- in

- einführen

- Einführung

- IP

- IT

- italienisch

- SEINE

- Januar

- Japanisch

- Jobs

- jpg

- nur

- Behalten

- Landschaft

- SPRACHE

- Sprache

- Sprachen

- grosse

- größer

- höchste

- LAS

- Nachname

- neueste

- Führung

- führenden

- Leasing

- Legacy

- Gesetzgeber

- Legislativvorschlag

- Länge

- weniger

- Bibliothek

- Gefällt mir

- Line

- Linien

- Liste

- Gelistet

- Kredite

- Lang

- lange Zeit

- aussehen

- die

- Los

- Main

- um

- MACHT

- Making

- Mann

- verwalten

- verwaltet

- Management

- viele

- Karte

- März

- Markt

- Marktwert

- Märkte

- massiv

- Abstimmung

- Bedeutung

- Bedeutungen

- messen

- Maßnahmen

- Medien

- Triff

- Treffen

- bloß

- Methode

- Migration

- ML

- Model

- Modell

- Modellieren

- für

- modern

- Module

- mehr

- effizienter

- vor allem warme

- viel

- mehrere

- Name

- Natürliche

- Verarbeitung natürlicher Sprache

- Navigation

- notwendig,

- Need

- Bedürfnisse

- Nachbarschaft

- Neu

- News

- weiter

- Nlp

- nicht

- Norwegisch

- Notizbuch

- jetzt an

- und viele

- NY

- NYE

- NYT

- objektiv

- of

- on

- EINEM

- Einsen

- einzige

- Ansturm

- XNUMXh geöffnet

- Open-Source-

- Option

- or

- Auftrag

- Organisationen

- Original

- OS

- Andere

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- aussen

- übrig

- Paket

- Pakete

- Pandas

- Brot

- Teil

- besondere

- Partner

- passieren

- Bestanden

- leidenschaftlich

- Zahlung

- Payroll

- für

- Ausführen

- Leistung

- wählen

- Kommissionierung

- Pipeline

- Plan

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- spielend

- Podcast

- Points

- Polnisch

- für einige Positionen

- Post

- Potenzial

- größte treibende

- vor

- Gegenwart

- vorgeführt

- Principal

- Datenschutz

- Prozessdefinierung

- Verarbeitung

- PRODUKTIVITÄT

- Profis

- Fortschritt

- Resorts

- Angebot

- geschützt

- die

- Versorger

- bietet

- Publikationen

- Zweck

- PWC

- Qualität

- Abfragen

- Frage

- Fragen

- schnell

- R

- erhöhen

- Rang

- Rangliste

- RE

- bereit

- realen Welt

- Anerkennung

- Aufzeichnungen

- Veteran

- Referenz

- verfeinern

- Reform

- Region

- bezogene

- Relevanz

- relevant

- bleiben

- bleibt bestehen

- entfernt

- wieder öffnen

- wiederholt

- ersetzen

- Reporting

- Meldungen

- Anforderung

- erfordern

- Folge

- was zu

- Die Ergebnisse

- behalten

- Rückkehr

- Rückkehr

- russisch

- s

- sagemaker

- Einsparung

- Ersparnisse

- sah

- Skalieren

- Wissenschaft

- Ergebnis

- Suche

- Suchmaschine

- Suchbegriffe

- Suche

- SEK

- Zweite

- sicher

- Sicherheitdienst

- sehen

- ausgewählt

- Senior

- empfindlich

- Gefühl

- Dienstleistungen

- Sitzung

- Aktionär

- sollte

- Vitrine

- Konzerte

- ähnlich

- Single

- Seiten

- geringfügig

- Langsam

- Fußball

- Lösungen

- einige

- Quelle

- Quellen

- Raumfahrt

- Spanisch

- sprechen

- besondere

- verbringen

- Ausgabe

- Stapel

- Unser Team

- Stufe

- Standard

- steht

- Anfang

- Beginnen Sie

- Aussagen

- bleiben

- -bestands-

- Börse

- Aktien

- speichern

- einfach

- Strategie

- stark

- strukturierte

- wesentlich

- so

- Support

- Unterstützte

- Unterstützung

- Unterstützt

- Oberfläche

- Umfrage

- Nachhaltigkeit

- nachhaltiger

- Nachhaltige Entwicklung

- Schwedisch

- Schalter

- Synonym

- System

- Systeme und Techniken

- nimmt

- Ziele

- Steuer

- Team

- Tech

- Technologie

- Begriff

- Text

- Textklassifizierung

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Dort.

- damit

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- diejenigen

- nach drei

- Durch

- Zeit

- Titel

- zu

- heute

- Top

- Thema

- Themen

- verfolgen sind

- trainiert

- Ausbildung

- Übersetzen

- Übersetzungen

- Reise

- versuchen

- Türkische

- WENDE

- Drehungen

- typisch

- UN

- aufdecken

- zugrunde liegen,

- verstehen

- einzigartiges

- URL

- us

- -

- Anwendungsfall

- Nutzer

- verwendet

- Verwendung von

- Wert

- Vielfalt

- sehr

- Walkthrough

- wollen

- wurde

- Wave

- Weg..

- we

- Netz

- Web-Services

- GUT

- Was

- wann

- ob

- welche

- WHO

- werden wir

- mit

- ohne

- Arbeiten

- Arbeitsablauf.

- arbeiten,

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- Weltklasse

- Jahr

- noch

- Du

- Ihr

- Zephyrnet