Die Moderation von Inhalten spielt eine entscheidende Rolle bei der Aufrechterhaltung der Online-Sicherheit und der Wahrung der Werte und Standards von Websites und Social-Media-Plattformen. Seine Bedeutung wird durch den Schutz unterstrichen, den es den Nutzern vor unangemessenen Inhalten bietet und ihr Wohlbefinden in digitalen Räumen gewährleistet. In der Werbebranche beispielsweise dient die Moderation von Inhalten dazu, Marken vor ungünstigen Assoziationen zu schützen und so zur Markenbekanntheit und zum Umsatzwachstum beizutragen. Werbetreibende legen Wert darauf, ihre Marke mit geeigneten Inhalten auszurichten, um ihren Ruf zu wahren und negative Publicity zu vermeiden. Auch im Finanz- und Gesundheitssektor kommt der Moderation von Inhalten eine entscheidende Bedeutung zu, da sie mehrere Funktionen erfüllt. Es spielt eine wichtige Rolle bei der Identifizierung und dem Schutz sensibler personenbezogener Daten und Gesundheitsinformationen (PII, PHI). Durch die Einhaltung interner Standards und Praktiken sowie die Einhaltung externer Vorschriften erhöht die Inhaltsmoderation die digitale Sicherheit für Benutzer. Auf diese Weise wird die unbeabsichtigte Weitergabe vertraulicher Daten auf öffentlichen Plattformen verhindert und die Wahrung der Privatsphäre und Datensicherheit der Benutzer gewährleistet.

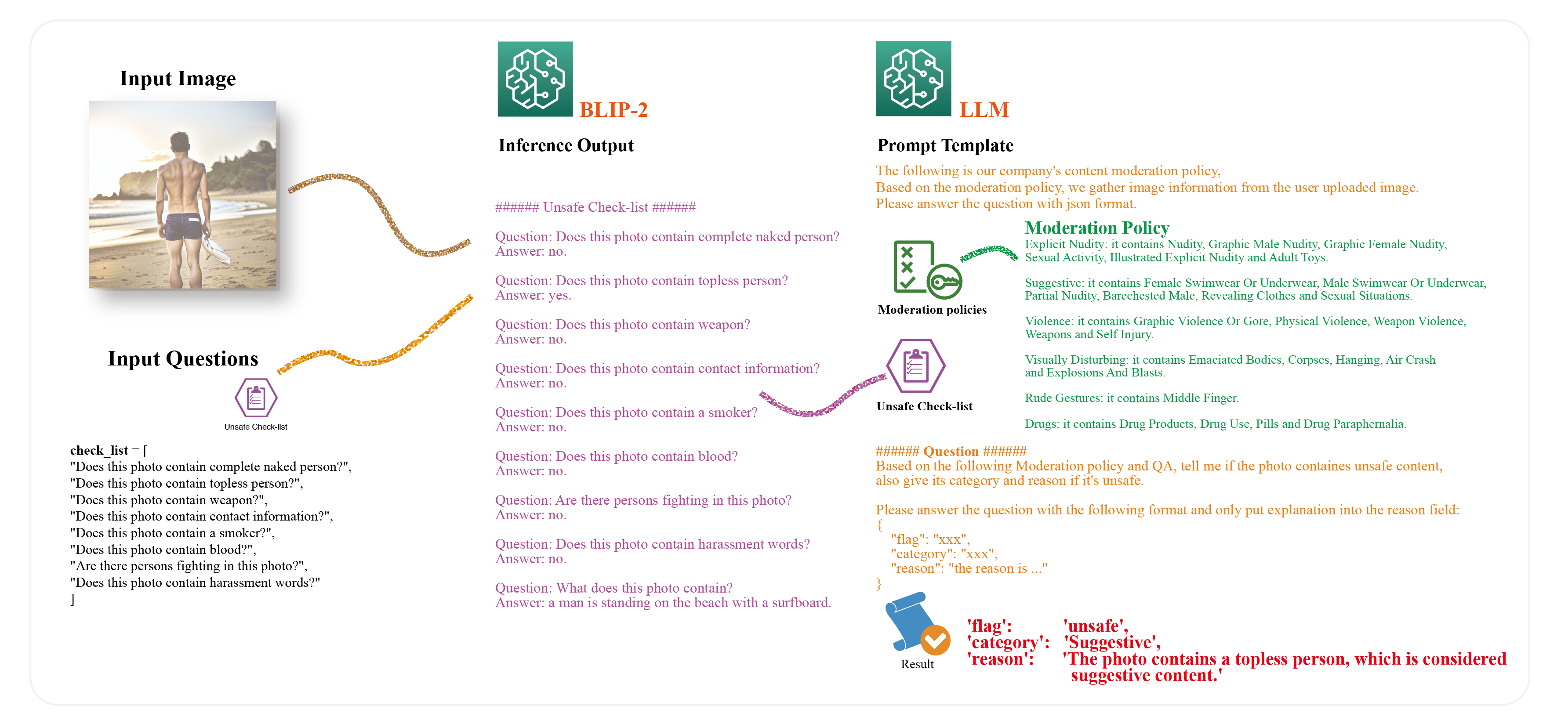

In diesem Beitrag stellen wir eine neuartige Methode zur Inhaltsmoderation von Bilddaten mit multimodalem Vortraining und einem großen Sprachmodell (LLM) vor. Mit dem multimodalen Vortraining können wir den Bildinhalt basierend auf einer Reihe von interessierenden Fragen direkt abfragen und das Modell wird in der Lage sein, diese Fragen zu beantworten. Dadurch können Benutzer mit dem Bild chatten, um zu überprüfen, ob es unangemessene Inhalte enthält, die gegen die Richtlinien der Organisation verstoßen. Wir nutzen die leistungsstarke Generierungsfähigkeit von LLMs, um die endgültige Entscheidung zu treffen, einschließlich sicherer/unsicherer Etiketten und Kategorietyp. Darüber hinaus können wir durch die Gestaltung einer Eingabeaufforderung einen LLM veranlassen, das definierte Ausgabeformat, beispielsweise das JSON-Format, zu generieren. Die entworfene Eingabeaufforderungsvorlage ermöglicht es dem LLM, festzustellen, ob das Bild gegen die Moderationsrichtlinie verstößt, die Kategorie des Verstoßes zu identifizieren, den Grund zu erklären und die Ausgabe in einem strukturierten JSON-Format bereitzustellen.

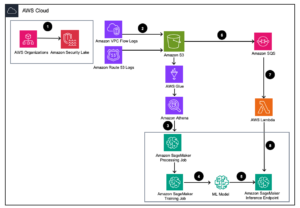

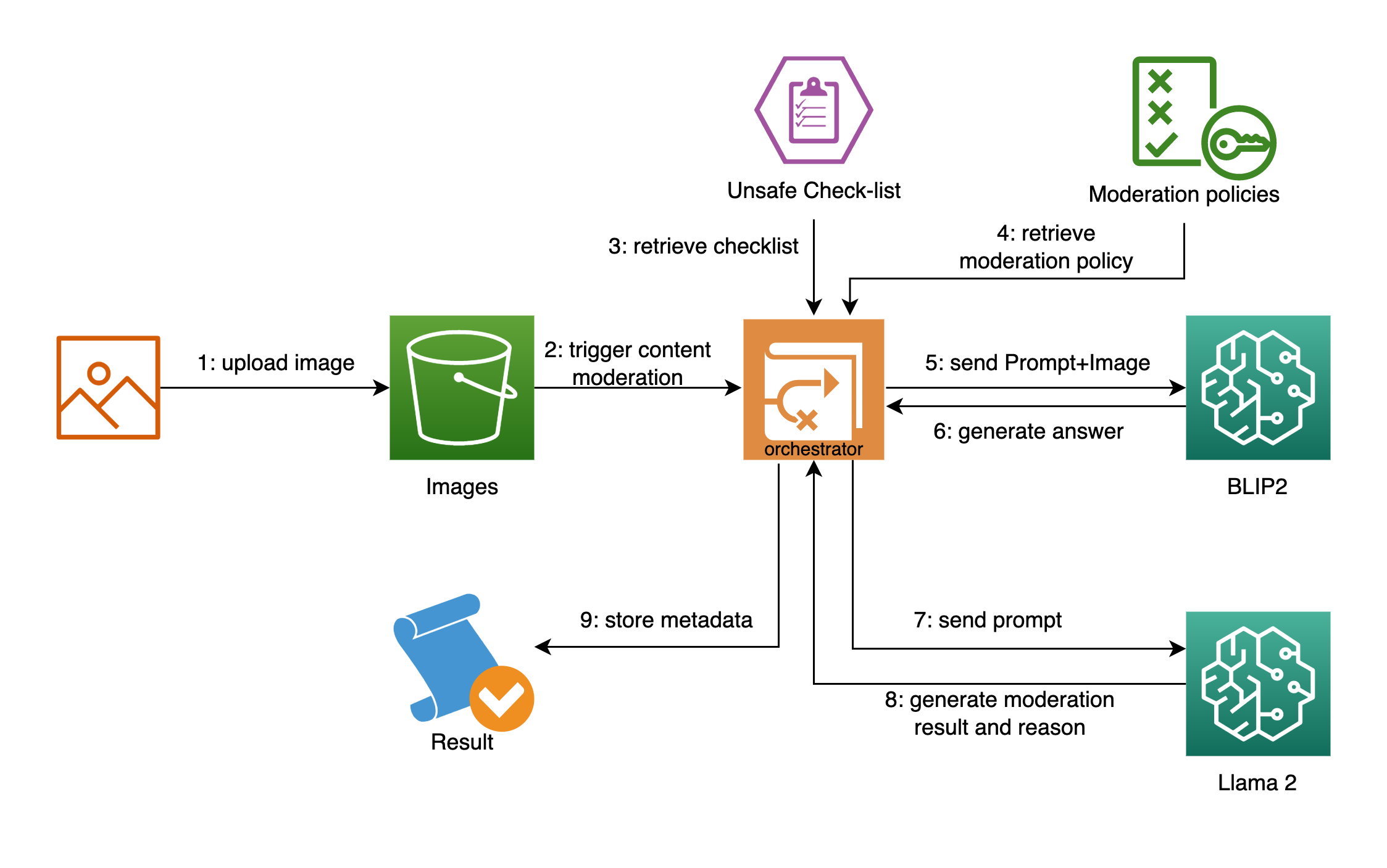

Wir verwenden BLIP-2 als multimodale Pre-Training-Methode. BLIP-2 ist eines der modernsten Modelle im multimodalen Pre-Training und übertrifft die meisten vorhandenen Methoden bei der visuellen Beantwortung von Fragen, der Bildunterschrift und dem Abruf von Bildtext. Für unser LLM verwenden wir Lama 2, das Open-Source-LLM der nächsten Generation, das übertrifft bestehende Open-Source-Sprachmodelle bei vielen Benchmarks, einschließlich Argumentations-, Codierungs-, Kompetenz- und Wissenstests. Das folgende Diagramm veranschaulicht die Lösungskomponenten.

Herausforderungen bei der Inhaltsmoderation

Herkömmliche Methoden zur Inhaltsmoderation, wie z. B. die Moderation durch Menschen, können mit der wachsenden Menge an benutzergenerierten Inhalten (User Generated Content, UGC) nicht mithalten. Wenn das UGC-Volumen zunimmt, können menschliche Moderatoren überfordert sein und Schwierigkeiten haben, Inhalte effektiv zu moderieren. Dies führt zu einer schlechten Benutzererfahrung, hohen Moderationskosten und einem Markenrisiko. Auch menschliche Moderation ist fehleranfällig, was zu inkonsistenter Moderation und voreingenommenen Entscheidungen führen kann. Um diese Herausforderungen anzugehen, hat sich die durch maschinelles Lernen (ML) unterstützte Inhaltsmoderation als Lösung herausgestellt. ML-Algorithmen können große Mengen an UGC analysieren und Inhalte identifizieren, die gegen die Richtlinien der Organisation verstoßen. ML-Modelle können trainiert werden, um Muster zu erkennen und problematische Inhalte wie Hassreden, Spam und unangemessenes Material zu identifizieren. Laut der Studie Schützen Sie Ihre Benutzer, Ihre Marke und Ihr Budget mit KI-gestützter InhaltsmoderationMithilfe der ML-gestützten Inhaltsmoderation können Unternehmen bis zu 95 % der Zeit einsparen, die ihre Teams mit der manuellen Moderation von Inhalten verbringen. Dies ermöglicht es Unternehmen, ihre Ressourcen auf strategischere Aufgaben wie den Aufbau von Communities und die Erstellung von Inhalten zu konzentrieren. Die ML-gestützte Inhaltsmoderation kann auch die Moderationskosten senken, da sie effizienter ist als die Moderation durch Menschen.

Trotz der Vorteile der ML-gestützten Inhaltsmoderation gibt es noch Raum für weitere Verbesserungen. Die Wirksamkeit von ML-Algorithmen hängt stark von der Qualität der Daten ab, auf denen sie trainiert werden. Wenn Modelle anhand verzerrter oder unvollständiger Daten trainiert werden, können sie fehlerhafte Moderationsentscheidungen treffen und Unternehmen damit Markenrisiken und potenziellen rechtlichen Verpflichtungen aussetzen. Die Einführung ML-basierter Ansätze zur Inhaltsmoderation bringt mehrere Herausforderungen mit sich, die sorgfältige Überlegungen erfordern. Zu diesen Herausforderungen gehören:

- Erfassen gekennzeichneter Daten – Dies kann ein kostspieliger Prozess sein, insbesondere bei komplexen Inhaltsmoderationsaufgaben, die eine Schulung von Labelern erfordern. Diese Kosten können es schwierig machen, ausreichend große Datensätze zu sammeln, um problemlos ein überwachtes ML-Modell zu trainieren. Darüber hinaus hängt die Genauigkeit des Modells stark von der Qualität der Trainingsdaten ab, und verzerrte oder unvollständige Daten können zu ungenauen Moderationsentscheidungen führen, was zu Markenrisiken und rechtlichen Haftungen führen kann.

- Modellverallgemeinerung – Dies ist entscheidend für die Einführung ML-basierter Ansätze. Ein auf einem Datensatz trainiertes Modell lässt sich möglicherweise nicht gut auf einen anderen Datensatz verallgemeinern, insbesondere wenn die Datensätze unterschiedliche Verteilungen aufweisen. Daher ist es wichtig sicherzustellen, dass das Modell auf einem vielfältigen und repräsentativen Datensatz trainiert wird, um sicherzustellen, dass es sich gut auf neue Daten übertragen lässt.

- Betriebseffizienz – Dies ist eine weitere Herausforderung bei der Verwendung herkömmlicher ML-basierter Ansätze zur Inhaltsmoderation. Das ständige Hinzufügen neuer Labels und das erneute Trainieren des Modells, wenn neue Klassen hinzugefügt werden, kann zeitaufwändig und kostspielig sein. Darüber hinaus ist es wichtig sicherzustellen, dass das Modell regelmäßig aktualisiert wird, um mit Änderungen in den moderierten Inhalten Schritt zu halten.

- Erklärbarkeit – Endbenutzer könnten die Plattform als voreingenommen oder ungerecht empfinden, wenn Inhalte ohne Begründung markiert oder entfernt werden, was zu einer schlechten Benutzererfahrung führt. Ebenso kann das Fehlen klarer Erklärungen den Prozess der Inhaltsmoderation für Moderatoren ineffizient, zeitaufwändig und kostspielig machen.

- Gegnerischer Charakter – Der kontroverse Charakter der bildbasierten Inhaltsmoderation stellt eine einzigartige Herausforderung für herkömmliche ML-basierte Ansätze dar. Kriminelle können versuchen, den Mechanismen zur Inhaltsmoderation zu entgehen, indem sie den Inhalt auf verschiedene Weise verändern, z. B. durch die Verwendung von Synonymen für Bilder oder durch die Einbettung ihres eigentlichen Inhalts in einen größeren Bestand an nicht anstößigen Inhalten. Dies erfordert eine ständige Überwachung und Aktualisierung des Modells, um solche gegnerischen Taktiken zu erkennen und darauf zu reagieren.

Multimodales Denken mit BLIP-2

Multimodale ML-Modelle beziehen sich auf Modelle, die Daten aus mehreren Quellen oder Modalitäten wie Bildern, Text, Audio, Video und anderen Formen strukturierter oder unstrukturierter Daten verarbeiten und integrieren können. Eines der beliebtesten Multimodalitätsmodelle sind visuelle Sprachmodelle wie BLIP-2, das Computer Vision und natürliche Sprachverarbeitung (NLP) kombiniert, um sowohl visuelle als auch textliche Informationen zu verstehen und zu generieren. Diese Modelle ermöglichen es Computern, die Bedeutung von Bildern und Texten so zu interpretieren, dass sie das menschliche Verständnis nachahmen. Vision-Language-Modelle können eine Vielzahl von Aufgaben bewältigen, darunter Bildunterschriften, Bildtextabruf, visuelle Beantwortung von Fragen und mehr. Beispielsweise kann ein Bildunterschriftenmodell eine Beschreibung eines Bildes in natürlicher Sprache generieren, und ein Bildtext-Retrieval-Modell kann auf der Grundlage einer Textabfrage nach Bildern suchen. Visuelle Frage-Antwort-Modelle können auf Fragen zu Bildern in natürlicher Sprache antworten, und multimodale Chatbots können visuelle und textuelle Eingaben verwenden, um Antworten zu generieren. Im Hinblick auf die Inhaltsmoderation können Sie diese Funktion nutzen, um eine Liste mit Fragen abzufragen.

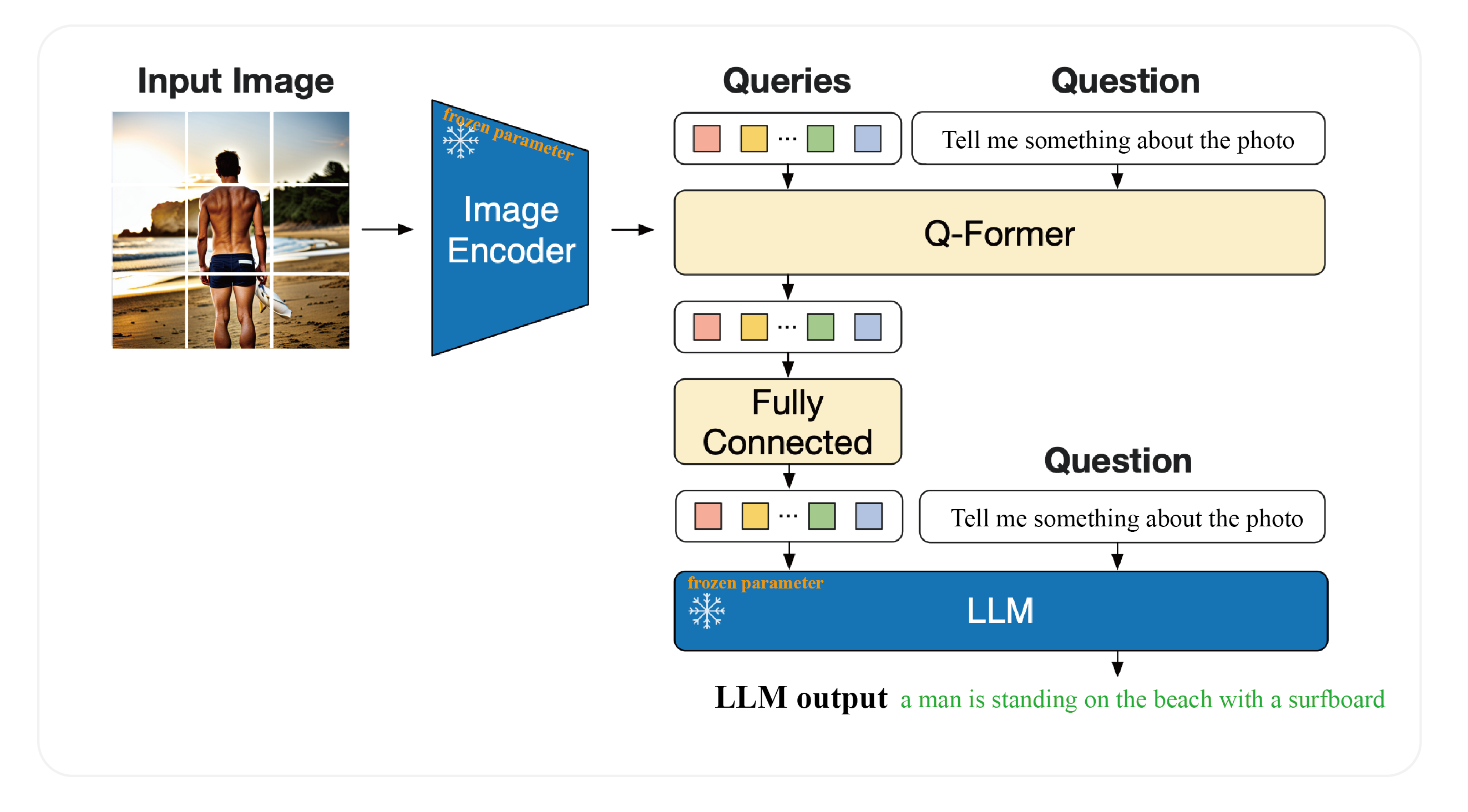

BLIP-2 besteht aus drei Teilen. Die erste Komponente ist ein Encoder für eingefrorene Bilder, ViT-L/14 von CLIP, der Bilddaten als Eingabe verwendet. Die zweite Komponente ist ein eingefrorenes LLM, FlanT5, das Text ausgibt. Die dritte Komponente ist ein trainierbares Modul namens Q-Former, ein leichter Transformator, der den Encoder für eingefrorene Bilder mit dem eingefrorenen LLM verbindet. Q-Former verwendet lernbare Abfragevektoren, um visuelle Merkmale aus dem Encoder für eingefrorene Bilder zu extrahieren und speist das nützlichste visuelle Merkmal in den LLM ein, um den gewünschten Text auszugeben.

Der Vorschulungsprozess umfasst zwei Phasen. In der ersten Phase wird das Erlernen der visuellen Sprachdarstellung durchgeführt, um Q-Former beizubringen, die relevanteste visuelle Darstellung für den Text zu lernen. In der zweiten Phase wird generatives Lernen von Vision zu Sprache durchgeführt, indem die Ausgabe von Q-Former mit einem eingefrorenen LLM verbunden und Q-Former trainiert wird, visuelle Darstellungen auszugeben, die vom LLM interpretiert werden können.

BLIP-2 erreicht bei verschiedenen visuellen Sprachaufgaben eine Leistung auf dem neuesten Stand der Technik, obwohl es deutlich weniger trainierbare Parameter als bestehende Methoden hat. Das Modell demonstriert auch die neuen Fähigkeiten der Zero-Shot-Bild-zu-Text-Generierung, die Anweisungen in natürlicher Sprache befolgen kann. Die folgende Abbildung wurde gegenüber der geändert Original-Forschungsarbeit.

Lösungsüberblick

Das folgende Diagramm zeigt die Lösungsarchitektur.

In den folgenden Abschnitten zeigen wir, wie BLIP-2 auf einem bereitgestellt wird Amazon Sage Maker Endpunkt und verwenden Sie BLIP-2 und ein LLM für die Inhaltsmoderation.

Voraussetzungen:

Sie benötigen ein AWS-Konto mit einem AWS Identity and Access Management and (IAM)-Rolle mit Berechtigungen zum Verwalten von Ressourcen, die als Teil der Lösung erstellt wurden. Einzelheiten finden Sie unter Erstellen Sie ein eigenständiges AWS-Konto.

Wenn Sie zum ersten Mal damit arbeiten Amazon SageMaker-Studio, müssen Sie zunächst eine erstellen SageMaker-Domäne. Darüber hinaus müssen Sie möglicherweise eine Erhöhung des Servicekontingents für die entsprechenden SageMaker-Hosting-Instanzen beantragen. Für das BLIP-2-Modell verwenden wir ein ml.g5.2xlarge SageMaker-Hosting-Instanz. Für das Modell Llama 2 13B verwenden wir ein ml.g5.12xlarge SageMaker-Hosting-Instanz.

Stellen Sie BLIP-2 auf einem SageMaker-Endpunkt bereit

Sie können ein LLM auf SageMaker hosten, indem Sie das verwenden Große Modellinferenz (LMI)-Container, der für das Hosten großer Modelle mit DJLServing optimiert ist. DJLServing ist eine leistungsstarke, universelle Model-Serving-Lösung, die auf der Deep Java Library (DJL) basiert und unabhängig von der Programmiersprache ist. Weitere Informationen zu DJL und DJLServing finden Sie unter Stellen Sie große Modelle auf Amazon SageMaker mit DJLServing und paralleler DeepSpeed-Modellinferenz bereit. Mit Hilfe des SageMaker LMI-Containers kann das BLIP-2-Modell einfach mit der Hugging Face-Bibliothek implementiert und auf SageMaker gehostet werden. Du kannst rennen blip2-sagemaker.ipynb für diesen Schritt.

Um das Docker-Image und die Modelldatei vorzubereiten, müssen Sie das Docker-Image von DJLServing abrufen, das Inferenzskript und die Konfigurationsdateien als packen model.tar.gz Datei und laden Sie sie in eine hoch Amazon Simple Storage-Service (Amazon S3) Eimer. Sie können sich auf die beziehen Inferenzskript und Konfigurationsdatei für weitere Informationen an.

inference_image_uri = image_uris.retrieve( framework="djl-deepspeed", region=sess.boto_session.region_name, version="0.22.1"

)

! tar czvf model.tar.gz blip2/

s3_code_artifact = sess.upload_data("model.tar.gz", bucket, s3_code_prefix)Wenn das Docker-Image und die inferenzbezogenen Dateien bereit sind, erstellen Sie das Modell, die Konfiguration für den Endpunkt und den Endpunkt:

from sagemaker.utils import name_from_base

blip_model_version = "blip2-flan-t5-xl"

model_name = name_from_base(blip_model_version)

model = Model( image_uri=inference_image_uri, model_data=s3_code_artifact, role=role, name=model_name,

)

model.deploy( initial_instance_count=1, instance_type="ml.g5.2xlarge", endpoint_name=model_name

)Wenn der Endpunkt den Status „In Betrieb“ erhält, können Sie den Endpunkt für die Bildbeschriftung und die angewiesene Aufgabe zur Zero-Shot-Vision-to-Language-Generierung aufrufen. Für die Bildbeschriftungsaufgabe müssen Sie lediglich ein Bild an den Endpunkt übergeben:

import base64

import json

from PIL import Image smr_client = boto3.client("sagemaker-runtime") def encode_image(img_file): with open(img_file, "rb") as image_file: img_str = base64.b64encode(image_file.read()) base64_string = img_str.decode("latin1") return base64_string def run_inference(endpoint_name, inputs): response = smr_client.invoke_endpoint( EndpointName=endpoint_name, Body=json.dumps(inputs) ) print(response["Body"].read()) test_image = "carcrash-ai.jpeg"

base64_string = encode_image(test_image)

inputs = {"image": base64_string}

run_inference(endpoint_name, inputs)Für die angewiesene Zero-Shot-Vision-to-Language-Generierungsaufgabe müssen Sie zusätzlich zum Eingabebild die Frage als Eingabeaufforderung definieren:

base64_string = encode_image(test_image)

inputs = {"prompt": "Question: what happened in this photo? Answer:", "image": base64_string}

run_inference(endpoint_name, inputs)Nutzen Sie BLIP-2 und LLM zur Inhaltsmoderation

In dieser Phase können Sie Abfragen zum angegebenen Bild durchführen und verborgene Informationen abrufen. Mit dem LLM organisieren Sie die Abfragen und rufen Informationen ab, um das Ergebnis im JSON-Format zu generieren. Sie können diese Aufgabe grob in die folgenden zwei Unteraufgaben aufteilen:

- Extrahieren Sie Informationen aus dem Bild mit dem BLIP-2-Modell.

- Generieren Sie das Endergebnis und die Erklärung mit dem LLM.

Extrahieren Sie Informationen aus dem Bild mit dem BLIP-2-Modell

Um genügend nützliche versteckte Informationen aus dem gegebenen Bild abzurufen, müssen Sie Abfragen definieren. Da jede Abfrage den Endpunkt einmal aufruft, führen viele Abfragen zu einer längeren Verarbeitungszeit. Daher empfehlen wir, die Abfragen von hoher Qualität zu gestalten und alle Policen abzudecken, aber auch ohne Duplikate. In unserem Beispielcode definieren wir die Abfragen wie folgt:

check_list = [ "Does this photo contain complete naked person?", "Does this photo contain topless person?", "Does this photo contain weapon?", "Does this photo contain contact information?", "Does this photo contain a smoker?", "Does this photo contain blood?", "Are there persons fighting in this photo?", "Does this photo contain harassment words?"

]Rufen Sie mit den vorherigen Abfragen den Endpunkt von BLIP-2 auf, um die Informationen mit dem folgenden Code abzurufen:

test_image = "./surf_swimwear.png"

raw_image = Image.open(test_image).convert('RGB') base64_string = encode_image(test_image)

conversations = """"""

for question in check_list: inputs = {"prompt": f"Question: {question}? Answer:", "image": base64_string} response = run_inference(endpoint_name, inputs) conversations += f"""

Question: {question}

Answer: {response}. """Zusätzlich zu den durch Abfragen abgerufenen Informationen können Sie Informationen mit der Bildbeschriftungsaufgabe abrufen, indem Sie den Endpunkt ohne aufrufen prompt Feld in der Nutzlast:

inputs = {"image": base64_string}

response = smr_client.invoke_endpoint(

EndpointName=endpoint_name, Body=json.dumps(inputs)

)

image_caption = response["Body"].read().decode('utf-8')Sie können den Inhalt von Abfragen und Antworten mit der Bildunterschrift kombinieren und diese abgerufenen Informationen für die nachgelagerte Aufgabe verwenden, die im nächsten Abschnitt unten beschrieben wird.

Generieren Sie das Endergebnis und die Erklärung mit dem LLM

Große Sprachmodelle (LLMs) wie Llama 2 können mit der richtigen Eingabeaufforderungsvorlage qualitativ hochwertige Ergebnisse generieren. Benutzen Amazon SageMaker-JumpStartML-Praktiker können aus einer breiten Auswahl öffentlich verfügbarer Stiftungsmodelle wählen. Mit nur wenigen Klicks in SageMaker Studio ist das jetzt möglich Entdecken und implementieren Sie Llama 2.

Die Endergebnisse basieren auf einem LLM mit einer spezifischen Eingabeaufforderungsvorlage. Eine solche Aufforderung besteht aus: der Moderationsrichtlinie basierend auf den Kategorien „unangemessen“ oder „anstößig“. Moderationskategorien; Bildinformationen aus BLIP-2 extrahiert; die Fragevorlage an das LLM, in der gefragt wird, ob das Foto unsichere Inhalte enthält, und nach der Kategorie und dem Grund gefragt wird, falls es unsicher ist; und Anweisungen zur Ausgabe der Ergebnisse im JSON-Format. Die entworfene Eingabeaufforderungsvorlage ermöglicht es dem LLM, festzustellen, ob das Bild gegen die Moderationsrichtlinie verstößt, die Kategorie des Verstoßes zu identifizieren, den Grund zu erklären und die Ausgabe in einem strukturierten JSON-Format bereitzustellen.

Der Kernquellcode lautet wie folgt:

prompt_template = f"""

The following is our company's content moderation policy, based on the moderation policy, we gather image information from the user uploaded image. Please answer the question with json format. ###### moderation policy ######

{moderation_policy} ###### Image information ######

{conversations} ###### Question ######

Based on the following Moderation policy and QA, tell me if the photo containes unsafe content, also give its category and reason if it's unsafe. Please anwser the question with the following format and only put explanation into the reason field: """ prompt_template += """

{ "flag": "xxx", "category": "xxx", "reason": "the reason is ..."

} """ dialog = [ {"role": "user", "content": prompt_template}

]Sie können die Eingabeaufforderung basierend auf Ihrem eigenen Anwendungsfall anpassen. Siehe die Notizbuch für mehr Details. Wenn die Eingabeaufforderung fertig ist, können Sie den LLM-Endpunkt aufrufen, um Ergebnisse zu generieren:

endpoint_name = "jumpstart-dft-meta-textgeneration-llama-2-70b-f" def query_endpoint(payload): client = boto3.client("sagemaker-runtime") response = client.invoke_endpoint( EndpointName=endpoint_name, ContentType="application/json", Body=json.dumps(payload), CustomAttributes="accept_eula=true", ) response = response["Body"].read().decode("utf8") response = json.loads(response) return response payload = { "inputs": [dialog], "parameters": {"max_new_tokens": 256, "top_p": 0.9, "temperature": 0.5}

}

result = query_endpoint(payload)[0]Ein Teil der generierten Ausgabe sieht wie folgt aus:

Gelegentlich fügt Llama 2 zusätzlich zur Antwort des Assistenten zusätzliche Erklärungen hinzu. Sie können den Parsing-Code verwenden, um JSON-Daten aus den ursprünglich generierten Ergebnissen zu extrahieren:

answer = result['generation']['content'].split('}')[0]+'}'

json.loads(answer)

Vorteile generativer Ansätze

In den vorherigen Abschnitten wurde gezeigt, wie der Kernteil der Modellinferenz implementiert wird. In diesem Abschnitt behandeln wir verschiedene Aspekte generativer Ansätze, einschließlich Vergleiche mit konventionellen Ansätzen und Perspektiven.

In der folgenden Tabelle werden die einzelnen Ansätze verglichen.

| . | Generativer Ansatz | Klassifizierungsansatz |

| Erfassen gekennzeichneter Daten | Vorab trainiertes Modell für eine große Anzahl von Bildern, Zero-Shot-Inferenz | Erfordert Daten aus allen Arten von Kategorien |

| Modellverallgemeinerung | Vorab trainiertes Modell mit verschiedenen Bildtypen | Erfordert eine große Menge an Daten zur Inhaltsmoderation, um die Modellverallgemeinerung zu verbessern |

| Betriebseffizienz | Zero-Shot-Fähigkeiten | Erfordert ein Training des Modells für die Erkennung verschiedener Muster und ein erneutes Training, wenn Beschriftungen hinzugefügt werden |

| Erklärbarkeit | Argumentation wie die Textausgabe, tolle Benutzererfahrung | Schwer zu begründen, schwer zu erklären und zu interpretieren |

| Gegnerischer Charakter | Robust | Hochfrequenz-Umschulung |

Mögliche Anwendungsfälle multimodalen Denkens über die Inhaltsmoderation hinaus

Die BLIP-2-Modelle können mit oder ohne Feinabstimmung für verschiedene Zwecke eingesetzt werden, darunter Folgendes:

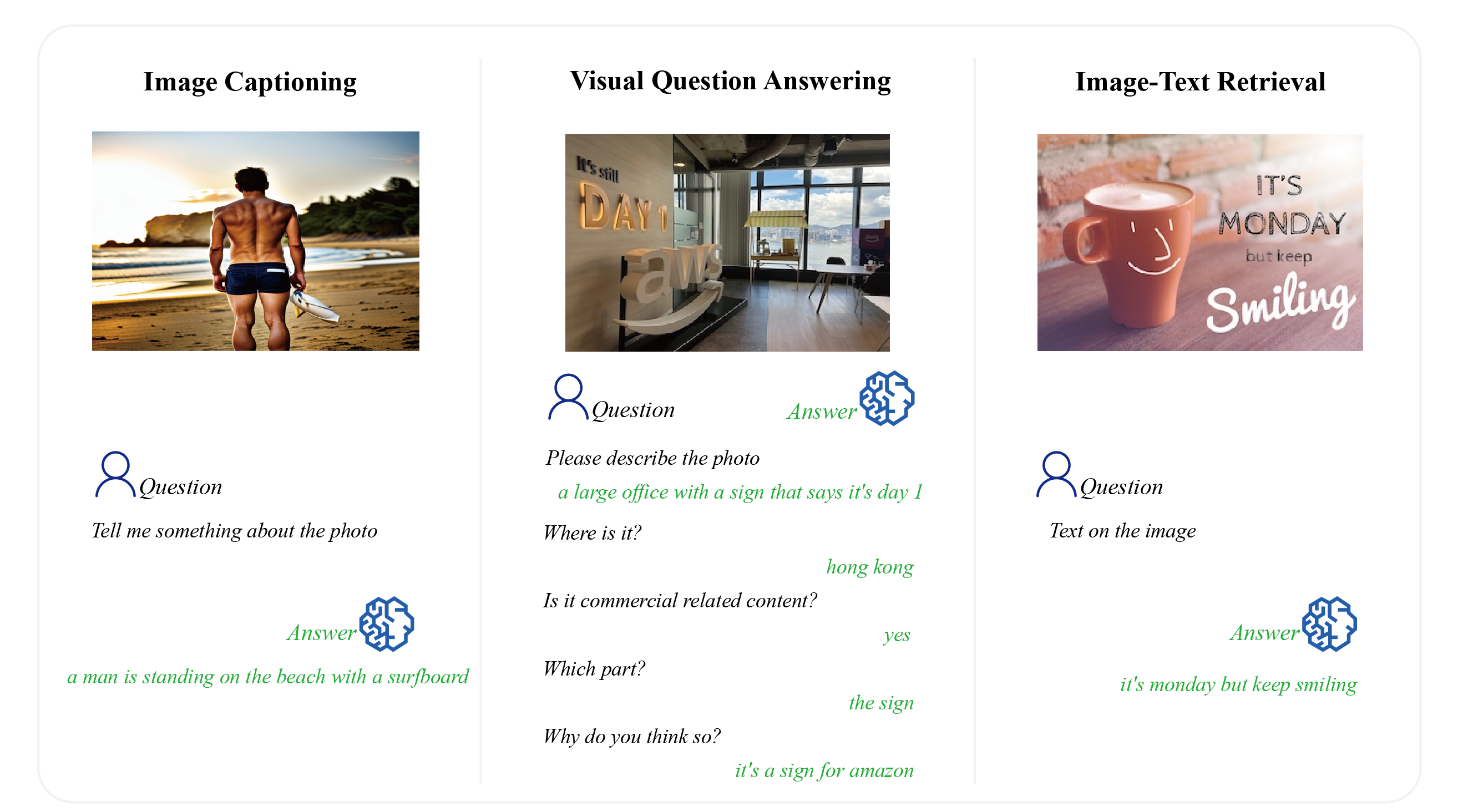

- Bildunterschrift – Dadurch wird das Modell aufgefordert, eine Textbeschreibung für den visuellen Inhalt des Bildes zu generieren. Wie im folgenden Beispielbild (links) dargestellt, können wir haben „Ein Mann steht mit einem Surfbrett am Strand“ als Bildbeschreibung.

- Visuelle Beantwortung von Fragen – Wie das Beispielbild in der Mitte zeigt, können wir fragen „Handelt es sich um kommerzielle Inhalte?“ und wir haben "Ja" als Antwort. Darüber hinaus unterstützt BLIP-2 die Multi-Runden-Konversation und gibt die folgende Frage aus: "Warum denkst du das?" Basierend auf dem visuellen Hinweis und den LLM-Funktionen gibt BLIP-2 aus „Es ist ein Zeichen für Amazon.“

- Abrufen von Bildtexten – Angesichts der Frage als „Text auf dem Bild“, können wir den Bildtext extrahieren „Es ist Montag, aber lächle weiter“ wie im Bild rechts gezeigt.

Die folgenden Bilder zeigen Beispiele, um die Zero-Shot-Bild-zu-Text-Fähigkeit des visuellen Wissensschlusses zu demonstrieren.

Wie wir anhand verschiedener Beispiele oben sehen können, eröffnen Multimodalitätsmodelle neue Möglichkeiten zur Lösung komplexer Probleme, die mit herkömmlichen Einzelmodalitätsmodellen nur schwer zu bewältigen wären.

Aufräumen

Um künftige Gebühren zu vermeiden, löschen Sie die im Rahmen dieses Beitrags erstellten Ressourcen. Sie können dies tun, indem Sie den Anweisungen im Abschnitt „Notebook-Bereinigung“ folgen oder die erstellten Endpunkte über die SageMaker-Konsole und die im S3-Bucket gespeicherten Ressourcen löschen.

Zusammenfassung

In diesem Beitrag haben wir die Bedeutung der Inhaltsmoderation in der digitalen Welt diskutiert und ihre Herausforderungen hervorgehoben. Wir haben eine neue Methode vorgeschlagen, um die Inhaltsmoderation mit Bilddaten zu verbessern und Fragen zu den Bildern zu beantworten, um automatisch nützliche Informationen zu extrahieren. Wir diskutierten außerdem weiter über die Vorteile der Verwendung eines generativen KI-basierten Ansatzes im Vergleich zum traditionellen klassifizierungsbasierten Ansatz. Abschließend haben wir die möglichen Anwendungsfälle visuell-sprachlicher Modelle über die Inhaltsmoderation hinaus veranschaulicht.

Wir ermutigen Sie, mehr zu erfahren, indem Sie SageMaker erkunden und eine Lösung mithilfe der in diesem Beitrag bereitgestellten Multimodalitätslösung und eines für Ihr Unternehmen relevanten Datensatzes erstellen.

Über die Autoren

Gordon Wang ist Senior AI/ML Specialist TAM bei AWS. Er unterstützt strategische Kunden mit KI/ML-Best Practices in vielen Branchen. Seine Leidenschaft gilt Computer Vision, NLP, generativer KI und MLOps. In seiner Freizeit liebt er Laufen und Wandern.

Gordon Wang ist Senior AI/ML Specialist TAM bei AWS. Er unterstützt strategische Kunden mit KI/ML-Best Practices in vielen Branchen. Seine Leidenschaft gilt Computer Vision, NLP, generativer KI und MLOps. In seiner Freizeit liebt er Laufen und Wandern.

Yanwei Cui, PhD, ist leitender Lösungsarchitekt für maschinelles Lernen bei AWS. Er begann mit der Forschung zum maschinellen Lernen am IRISA (Research Institute of Computer Science and Random Systems) und verfügt über mehrere Jahre Erfahrung in der Entwicklung KI-gestützter Industrieanwendungen in den Bereichen Computer Vision, Verarbeitung natürlicher Sprache und Vorhersage des Online-Benutzerverhaltens. Bei AWS teilt er sein Fachwissen und hilft Kunden dabei, Geschäftspotenziale zu erschließen und mit maschinellem Lernen in großem Maßstab umsetzbare Ergebnisse zu erzielen. Außerhalb der Arbeit liest und reist er gerne.

Yanwei Cui, PhD, ist leitender Lösungsarchitekt für maschinelles Lernen bei AWS. Er begann mit der Forschung zum maschinellen Lernen am IRISA (Research Institute of Computer Science and Random Systems) und verfügt über mehrere Jahre Erfahrung in der Entwicklung KI-gestützter Industrieanwendungen in den Bereichen Computer Vision, Verarbeitung natürlicher Sprache und Vorhersage des Online-Benutzerverhaltens. Bei AWS teilt er sein Fachwissen und hilft Kunden dabei, Geschäftspotenziale zu erschließen und mit maschinellem Lernen in großem Maßstab umsetzbare Ergebnisse zu erzielen. Außerhalb der Arbeit liest und reist er gerne.

Melanie Li, PhD, ist Senior AI/ML Specialist TAM bei AWS mit Sitz in Sydney, Australien. Sie unterstützt Unternehmenskunden beim Aufbau von Lösungen mit modernsten KI/ML-Tools auf AWS und bietet Anleitungen zur Architektur und Implementierung von ML-Lösungen mit Best Practices. In ihrer Freizeit erkundet sie gerne die Natur und verbringt Zeit mit Familie und Freunden.

Melanie Li, PhD, ist Senior AI/ML Specialist TAM bei AWS mit Sitz in Sydney, Australien. Sie unterstützt Unternehmenskunden beim Aufbau von Lösungen mit modernsten KI/ML-Tools auf AWS und bietet Anleitungen zur Architektur und Implementierung von ML-Lösungen mit Best Practices. In ihrer Freizeit erkundet sie gerne die Natur und verbringt Zeit mit Familie und Freunden.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- ChartPrime. Verbessern Sie Ihr Handelsspiel mit ChartPrime. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/build-a-generative-ai-based-content-moderation-solution-on-amazon-sagemaker-jumpstart/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 10

- 100

- 20

- 22

- 7

- 9

- 95%

- a

- Fähig

- Über Uns

- oben

- Zugang

- Nach

- Konto

- Genauigkeit

- Erreichen

- Erreicht

- Akteure

- präsentieren

- hinzugefügt

- Hinzufügen

- Zusatz

- Zusätzliche

- zusätzlich

- Adresse

- haften

- Die Annahme

- Adoption

- Vorteilen

- widersprüchlich

- Werbekunden

- Marketings

- gegen

- AI

- AI-powered

- AI / ML

- Algorithmen

- Ausrichtung

- Alle

- erlaubt

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon SageMaker-JumpStart

- Amazon Web Services

- an

- analysieren

- und

- Ein anderer

- beantworten

- Antworten

- jedem

- Anwendungen

- angewandt

- Ansatz

- Ansätze

- angemessen

- Architektur

- SIND

- AS

- fragen

- Aspekte

- Assistentin

- Verbände

- übernimmt

- At

- Audio-

- Australien

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- vermeiden

- AWS

- Badewanne

- basierend

- BE

- Beach

- weil

- werden

- wird

- Verhalten

- Sein

- unten

- Benchmarks

- neben

- BESTE

- Best Practices

- Beyond

- voreingenommen

- Blut

- Körper

- beide

- Marke

- Marken

- Brings

- breit

- Haushalt

- bauen

- Building

- Geschäft

- aber

- by

- namens

- CAN

- Kann bekommen

- Fähigkeiten

- capability

- vorsichtig

- Häuser

- Fälle

- Kategorien

- Kategorie

- challenges

- Herausforderungen

- herausfordernd

- Änderungen

- Gebühren

- Chatbots

- Auswählen

- Unterricht

- klar

- Auftraggeber

- Kleider

- Code

- Programmierung

- kombinieren

- vereint

- kommerziell

- community

- Gemeinschaftshaus

- Unternehmen

- verglichen

- abschließen

- Komplex

- Komponente

- Komponenten

- Computer

- Computerwissenschaften

- Computer Vision

- Computer

- Konfiguration

- Schichtannahme

- Sich zusammenschliessen

- Connects

- Berücksichtigung

- betrachtet

- besteht

- Konsul (Console)

- konstante

- ständig

- Kontakt

- enthalten

- Container

- enthält

- Inhalt

- Inhaltserstellung

- Inhalt

- Beitrag

- konventionellen

- Gespräch

- Gespräche

- Kernbereich

- Dazugehörigen

- Kosten

- teuer werden

- Kosten

- könnte

- Abdeckung

- erstellen

- erstellt

- Schaffung

- kritischem

- Cross

- Kunden

- anpassen

- technische Daten

- Datensicherheit

- Datensätze

- Entscheidung

- Entscheidungen

- tief

- definieren

- definiert

- zeigen

- Synergie

- zeigt

- einsetzen

- beschrieben

- Beschreibung

- entworfen

- Entwerfen

- erwünscht

- Trotz

- Details

- entdecken

- Bestimmen

- Dialog

- anders

- digital

- Digitale Welt

- Direkt

- diskutiert

- Diskussion

- Ausschüttungen

- verschieden

- do

- Docker

- die

- Domain

- Antrieb

- jeder

- erleichtern

- leicht

- effektiv

- Wirksamkeit

- effizient

- Einbettung

- entstanden

- aufstrebenden

- beschäftigt

- ermöglichen

- ermöglicht

- ermutigen

- Ende

- Endpunkt

- Verbessert

- genug

- gewährleisten

- Gewährleistung

- Unternehmen

- Fehler

- insbesondere

- essential

- Beispiel

- Beispiele

- vorhandenen

- ERFAHRUNGEN

- Expertise

- Erklären

- Erklärung

- ERKUNDEN

- Möglichkeiten sondieren

- Belichtung

- extern

- Extrakt

- Gesicht

- Stürze

- Familie

- Merkmal

- Eigenschaften

- weiblich

- wenige

- Weniger

- Feld

- Kampf

- Reichen Sie das

- Mappen

- Finale

- Finanzen

- Vorname

- erstes Mal

- passen

- markiert

- Setzen Sie mit Achtsamkeit

- folgen

- Folgende

- folgt

- Aussichten für

- Format

- Formen

- Foundation

- Frequenz

- Freunde

- für

- eingefroren

- Funktionen

- weiter

- Zukunft

- sammeln

- erzeugen

- erzeugt

- Erzeugung

- Generation

- generativ

- Generative KI

- bekommen

- ABSICHT

- gegeben

- groß

- persönlichem Wachstum

- Wachstum

- die Vermittlung von Kompetenzen,

- Griff

- passiert

- hart

- Haben

- mit

- he

- Gesundheit

- Gesundheitsinformationen

- Gesundheitswesen

- schwer

- Hilfe

- hilft

- hier (auf dänisch)

- versteckt

- GUTE

- Hohe Leistungsfähigkeit

- hochwertige

- Besondere

- seine

- Gastgeber

- gehostet

- Hosting

- Ultraschall

- Hilfe

- HTML

- http

- HTTPS

- human

- identifizieren

- Identifizierung

- Identitätsschutz

- if

- zeigt

- Image

- Bilder

- implementieren

- umgesetzt

- Umsetzung

- importieren

- Bedeutung

- wichtig

- zu unterstützen,

- Verbesserung

- in

- ungenau

- das

- Dazu gehören

- Einschließlich

- Erhöhung

- Steigert

- industriell

- Branchen

- Energiegewinnung

- ineffizient

- Information

- Varianten des Eingangssignals:

- Eingänge

- Instanz

- Institut

- Anleitung

- integrieren

- Interesse

- intern

- in

- einführen

- IT

- SEINE

- Javac

- jpg

- JSON

- nur

- Behalten

- Wissen

- Etiketten

- Sprache

- grosse

- größer

- führen

- führenden

- LERNEN

- lernen

- links

- Rechtlich

- Verbindlichkeiten

- Bibliothek

- leicht

- Liste

- Lama

- LLM

- länger

- liebt

- Maschine

- Maschinelles Lernen

- Aufrechterhaltung

- um

- Making

- Mann

- verwalten

- manuell

- viele

- Ihres Materials

- Kann..

- me

- Bedeutung

- Mechanismen

- Medien

- Meta

- Methode

- Methoden

- Mitte

- ML

- MLOps

- Modell

- für

- Mäßigung

- geändert

- Modul

- Montag

- Überwachung

- mehr

- effizienter

- vor allem warme

- mehrere

- Natürliche

- Verarbeitung natürlicher Sprache

- Natur

- Need

- Negativ

- Neu

- weiter

- Nlp

- Notizbuch

- Roman

- jetzt an

- Anzahl

- of

- Offensive

- on

- einmal

- EINEM

- Online

- einzige

- XNUMXh geöffnet

- Open-Source-

- Entwicklungsmöglichkeiten

- optimiert

- or

- Organisationen

- Original

- Andere

- UNSERE

- Unser Unternehmen

- Ergebnisse

- Übertrifft

- Möglichkeiten für das Ausgangssignal:

- aussen

- überwältigt

- besitzen

- Paket

- Parallel

- Parameter

- Teil

- besonders

- Teile

- passieren

- leidenschaftlich

- Muster

- Ausführen

- Leistung

- durchgeführt

- Berechtigungen

- person

- persönliche

- Personen

- Perspektiven

- phd

- für Ihre privaten Foto

- zentrale

- Plattform

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- spielt

- Bitte

- Politik durchzulesen

- Datenschutzrichtlinien

- Arm

- Beliebt

- Post

- Potenzial

- Potenziale

- angetriebene

- größte treibende

- Praktiken

- Prognose

- Danach

- Geschenke

- Erhaltung

- verhindert

- Priorität einräumen

- Datenschutz

- Probleme

- Prozessdefinierung

- Verarbeitung

- Programmierung

- vorgeschlage

- Sicherheit

- die

- vorausgesetzt

- bietet

- Öffentlichkeit

- Werbung

- öffentlich

- Zwecke

- setzen

- F&A

- Qualität

- Abfragen

- Frage

- Fragen

- zufällig

- Lesebrillen

- bereit

- Grund

- erkennen

- erkennen

- Veteran

- regelmäßig

- Vorschriften

- bezogene

- relevant

- verlassen

- Entfernt

- Darstellung

- Vertreter

- Ruf

- Anforderung

- erfordern

- erfordert

- Forschungsprojekte

- Downloads

- Reagieren

- Antwort

- Antworten

- Folge

- was zu

- Die Ergebnisse

- Rückkehr

- aufschlussreich

- Einnahmen

- Umsatzwachstum

- RGB

- Recht

- Risiko

- Risiken

- Rollen

- rund

- Regel

- Führen Sie

- Laufen

- s

- Sicherung

- Sicherheit

- sagemaker

- Skalieren

- Wissenschaft

- Suche

- Zweite

- Abschnitt

- Abschnitte

- Sektoren

- Sicherheitdienst

- sehen

- Auswahl

- Senior

- empfindlich

- dient

- Lösungen

- Dienst

- kompensieren

- mehrere

- Sexuell

- Shares

- ,,teilen"

- sie

- Schild

- erklären

- zeigte

- Konzerte

- Schild

- Bedeutung

- bedeutend

- Ähnlich

- Einfacher

- Umstände

- So

- Social Media

- Social Media

- Social-Media-Plattformen

- Lösung

- Lösungen

- Auflösung

- Quelle

- Quellcode

- Quellen

- Raumfahrt

- Räume

- Spam

- Spezialist

- spezifisch

- Rede

- verbringen

- gespalten

- Stufe

- Stufen

- standalone

- Normen

- begonnen

- State-of-the-art

- Staaten

- Status

- Schritt

- Immer noch

- Lagerung

- gelagert

- Strategisch

- strukturierte

- Kämpfen

- Studio Adressen

- Studie

- so

- vorschlagen

- Unterstützt

- Sydney

- Systeme und Techniken

- Tabelle

- angehen

- Taktik

- nimmt

- Aufgabe

- und Aufgaben

- Teams

- erzählen

- Vorlage

- AGB

- Text

- textuell

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- die Informationen

- ihr

- Dort.

- damit

- deswegen

- Diese

- vom Nutzer definierten

- think

- Dritte

- fehlen uns die Worte.

- nach drei

- Zeit

- Zeitaufwendig

- zu

- Werkzeuge

- traditionell

- Training

- trainiert

- Ausbildung

- Transformator

- Reise

- XNUMX

- tippe

- Typen

- für

- verstehen

- Verständnis

- einzigartiges

- Universal-

- öffnen

- aktualisiert

- Aktualisierung

- Aufrechterhalten

- hochgeladen

- -

- Anwendungsfall

- Mitglied

- Benutzererfahrung

- Benutzer Privatsphäre

- Nutzer

- Verwendung von

- Werte

- Vielfalt

- verschiedene

- Video

- VERSTOSS

- Seh-

- Volumen

- Volumen

- Weg..

- Wege

- we

- Netz

- Web-Services

- Webseiten

- GUT

- Was

- wann

- welche

- warum

- werden wir

- mit

- .

- ohne

- Worte

- Arbeiten

- arbeiten,

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- würde

- Jahr

- Du

- Ihr

- Zephyrnet