Amazon SageMaker Feature Store ist ein speziell entwickelter Dienst zum Speichern und Abrufen von Feature-Daten zur Verwendung durch Modelle für maschinelles Lernen (ML). Feature Store bietet einen Online-Shop, der Lese- und Schreibvorgänge mit geringer Latenz und hohem Durchsatz ermöglicht, sowie einen Offline-Shop, der Massenzugriff auf alle historischen Datensatzdaten ermöglicht. Feature Store übernimmt die Synchronisierung der Daten zwischen den Online- und Offline-Stores.

Da es sich bei der Modellentwicklung um einen iterativen Prozess handelt, fragen Kunden häufig den Offline-Shop ab und erstellen verschiedene Datensätze für das Modelltraining. Derzeit gibt es mehrere Möglichkeiten, auf Funktionen im Offline-Store zuzugreifen, einschließlich der Ausführung von SQL-Abfragen mit Amazonas Athena oder Spark SQL in Apache Spark verwenden. Diese Muster erfordern jedoch das Schreiben von Ad-hoc-SQL-Anweisungen (und manchmal komplexen), was nicht immer für die Rolle eines Datenwissenschaftlers geeignet ist.

Feature-Store vor kurzem erweitert das SageMaker Python SDK, um die Erstellung von Datensätzen aus dem Offline-Store zu erleichtern. Mit dieser Version können Sie einen neuen Satz von Methoden im SDK verwenden, um Datensätze zu erstellen, ohne SQL-Abfragen schreiben zu müssen. Diese neuen Methoden unterstützen gängige Vorgänge wie Zeitreisen, das Filtern doppelter Datensätze und das Zusammenführen mehrerer Feature-Gruppen und gewährleisten gleichzeitig die Genauigkeit des Zeitpunkts.

In diesem Beitrag zeigen wir, wie Sie mit dem SageMaker Python SDK ML-fähige Datensätze erstellen, ohne SQL-Anweisungen schreiben zu müssen.

Lösungsüberblick

Um die neue Funktionalität zu demonstrieren, arbeiten wir mit zwei Datensätzen: Leads und Web-Marketing-Kennzahlen. Diese Datensätze können verwendet werden, um ein Modell zu erstellen, das anhand der für diesen Lead erfassten Marketingaktivitäten und Kennzahlen vorhersagt, ob ein Lead in einen Verkauf umgewandelt wird.

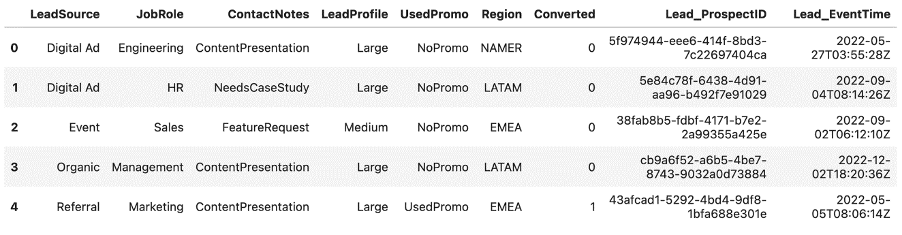

Die Lead-Daten enthalten Informationen zu potenziellen Kunden, die über identifiziert wurden Lead_ProspectID. Die Funktionen für einen Lead (z. B. LeadSource) kann im Laufe der Zeit aktualisiert werden, was zu einem neuen Datensatz für diesen Lead führt. Der Lead_EventTime stellt die Zeit dar, in der jeder Datensatz erstellt wird. Der folgende Screenshot zeigt ein Beispiel dieser Daten.

Die Web-Marketing-Metrikdaten verfolgen die Engagement-Metriken für einen Lead, wobei jeder Lead anhand des identifiziert wird Web_ProspectIDdem „Vermischten Geschmack“. Seine Web_EventTime stellt die Zeit dar, in der der Datensatz erstellt wurde. Im Gegensatz zur Lead-Feature-Gruppe gibt es in dieser Feature-Gruppe nur einen Datensatz pro Lead. Der folgende Screenshot zeigt ein Beispiel dieser Daten.

Wir gehen durch die wichtigsten Teile des sagemaker-feature-store-offline-sdk.ipynb Notebook, das die folgenden Schritte demonstriert:

- Erstellen Sie einen Datensatz aus einer Feature-Gruppe.

- Treten Sie mehreren Funktionsgruppen bei.

- Erstellen Sie eine Point-in-Time-Verbindung zwischen einer Feature-Gruppe und einem Datensatz basierend auf einer Reihe von Ereignissen zu bestimmten Zeitstempeln.

- Rufen Sie den Funktionsverlauf innerhalb eines bestimmten Zeitraums ab.

- Rufen Sie Features ab einem bestimmten Zeitstempel ab.

Voraussetzungen:

Sie benötigen folgende Voraussetzungen:

Wir gehen davon aus, dass eine Funktionsgruppe für die Lead-Daten unter Verwendung der vorhandenen erstellt wurde FeatureGroup.create Methode und kann über die Variable referenziert werden base_fg. Weitere Informationen zu Funktionsgruppen finden Sie unter Erstellen Sie Funktionsgruppen.

Erstellen Sie einen Datensatz aus einer Feature-Gruppe

Um einen Datensatz mit dem SageMaker SDK zu erstellen, verwenden wir das neue FeatureStore Klasse, die die enthält create_dataset Methode. Diese Methode akzeptiert eine Basis-Feature-Gruppe, die mit anderen Feature-Gruppen oder DataFrames verbunden werden kann. Wir beginnen mit der Bereitstellung der Leads-Feature-Gruppe als Basis und einer Amazon Simple Storage-Service (Amazon S3) Pfad zum Speichern des Datensatzes:

Das create_dataset Methode gibt a zurück DatasetBuilder Objekt, das zum Generieren eines Datensatzes aus einer oder mehreren Merkmalsgruppen verwendet werden kann (was wir im nächsten Abschnitt demonstrieren). Um einen einfachen Datensatz zu erstellen, der nur aus den Lead-Features besteht, rufen wir auf to_csv_file Methode. Dadurch wird in Athena eine Abfrage ausgeführt, um die Funktionen aus dem Offline-Speicher abzurufen, und die Ergebnisse werden im angegebenen S3-Pfad gespeichert.

Treten Sie mehreren Funktionsgruppen bei

Mit dem SageMaker SDK können Sie ganz einfach mehrere Funktionsgruppen zusammenführen, um einen Datensatz zu erstellen. Sie können auch Verknüpfungsvorgänge zwischen einem vorhandenen Pandas DataFrame und einer einzelnen oder mehreren Funktionsgruppen durchführen. Der Basis-Feature-Gruppe ist ein wichtiges Konzept für Joins. Die Basis-Feature-Gruppe ist die Feature-Gruppe, mit der andere Feature-Gruppen oder der Pandas DataFrame verbunden sind.

Beim Erstellen des Datensatzes mit create_dataset Funktion verwenden wir die with_feature_group Methode, die eine innere Verknüpfung zwischen der Basis-Feature-Gruppe und einer anderen Feature-Gruppe unter Verwendung der Datensatz-ID und des Ziel-Feature-Namens in der Basis-Feature-Gruppe durchführt. In unserem Beispiel ist die Basis-Feature-Gruppe die Leads-Feature-Gruppe und die Ziel-Feature-Gruppe die Web-Marketing-Feature-Gruppe. Der with_feature_group Die Methode akzeptiert die folgenden Argumente:

- feature_group – Dies ist die Funktionsgruppe, der wir beitreten. In unserem Codebeispiel wird die Zielfunktionsgruppe mithilfe des Webmarketing-Datensatzes erstellt.

- target_feature_name_in_base – Der Name des Features in der Basis-Feature-Gruppe, das wir als Schlüssel im Join verwenden. Wir gebrauchen

Lead_ProspectIDals Datensatz-ID für die Basis-Feature-Gruppe. - include_feature_names – Dies ist die Liste der Feature-Namen der Basis-Feature-Gruppe. Wir verwenden dieses Feld, um die Features anzugeben, die wir in den Datensatz aufnehmen möchten.

Der folgende Code zeigt ein Beispiel für die Erstellung eines Datensatzes durch Verbinden der Basis-Feature-Gruppe mit der Ziel-Feature-Gruppe:

Sie können die Verknüpfungsvorgänge erweitern, um mehrere Funktionsgruppen einzubeziehen, indem Sie Folgendes hinzufügen with_feature_group -Methode am Ende des vorherigen Codebeispiels und Definieren der erforderlichen Argumente für die neue Funktionsgruppe. Sie können auch Verknüpfungsvorgänge mit einem vorhandenen DataFrame durchführen, indem Sie die Basis als Ihren vorhandenen Pandas DataFrame definieren und mit den interessierten Funktionsgruppen verbinden. Das folgende Codebeispiel zeigt, wie ein Datensatz mit einem vorhandenen Pandas DataFrame und einer vorhandenen Funktionsgruppe erstellt wird:

Weitere Beispiele zu diesen verschiedenen Konfigurationen finden Sie unter Erstellen Sie einen Datensatz aus Ihren Funktionsgruppen.

Erstellen Sie einen Point-in-Time-Join

Eine der leistungsstärksten Funktionen dieser Erweiterung ist die einfache Durchführung von Point-in-Time-Joins, ohne dass komplexer SQL-Code geschrieben werden muss. Beim Erstellen von ML-Modellen müssen Datenwissenschaftler dies vermeiden Datenlecks oder Zielleckage, bei der während des Modelltrainings versehentlich Daten verwendet werden, die zum Zeitpunkt der Vorhersage nicht verfügbar wären. Wenn wir beispielsweise versuchen, Kreditkartenbetrug vorherzusagen, sollten wir Transaktionen ausschließen, die nach der betrügerischen Belastung eingehen, die wir vorhersagen möchten. Andernfalls könnte das trainierte Modell diese Post-Betrugsinformationen verwenden, um das Modell zu ändern und es zu verallgemeinern weniger gut.

Zum Abrufen punktgenauer Feature-Daten müssen Sie einen Entitäts-DataFrame bereitstellen, der eine Reihe von Datensatz-IDs (oder Primärschlüssel) und entsprechende Ereigniszeiten bereitstellt, die als Cutoff-Zeit für das Ereignis dienen. Dieser Abrufmechanismus wird manchmal als bezeichnet Zeitreise auf Zeilenebene, da dadurch für jeden Zeilenschlüssel eine andere Zeitbeschränkung angewendet werden kann. Um Point-in-Time-Joins mit dem SageMaker SDK durchzuführen, verwenden wir die Datensatz-Builder Klasse und stellen Sie die Entität DataFrame als Basisargument für den Konstruktor bereit.

Im folgenden Code erstellen wir einen einfachen Entitäts-DataFrame mit zwei Datensätzen. Wir haben die Ereigniszeiten, die zur Angabe der Cutoff-Zeit verwendet werden, etwa in der Mitte der Zeitreihendaten (Mitte Januar 2023) festgelegt:

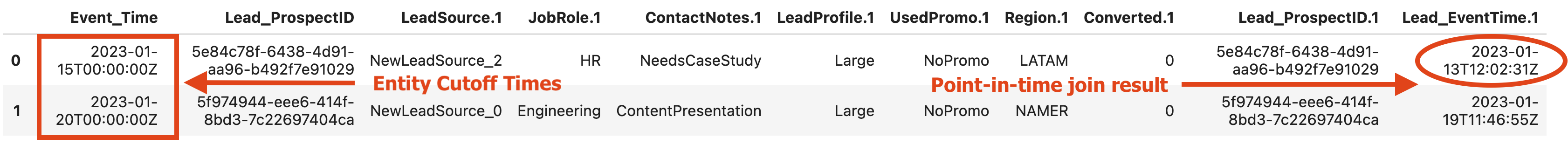

Wenn wir die verwenden point_in_time_accurate_join Funktionalität mit der create_dataset Aufruf schließt die interne Abfrage alle Datensätze mit Zeitstempeln aus, die nach den angegebenen Cutoff-Zeiten liegen, und gibt die neuesten Feature-Werte zurück, die zum Zeitpunkt des Ereignisses verfügbar gewesen wären:

Beachten Sie, dass der vom Point-in-Time-Join zurückgegebene DataFrame nur zwei Datensätze enthält. Dies liegt daran, dass wir im Entitäts-DataFrame nur zwei Datensatz-IDs übermittelt haben, eine für jede Lead_ProspectID wir wollen zurückholen. Das Zeitpunktkriterium gibt an, dass die Ereigniszeit eines Datensatzes (gespeichert im Lead_Eventtime Feld) muss einen Wert enthalten, der kleiner als die Cutoff-Zeit ist.

Darüber hinaus weisen wir die Abfrage an, nur den neuesten Datensatz abzurufen, der dieses Kriterium erfüllt, da wir das angewendet haben with_number_of_recent_records_by_record_identifier Methode. Bei Verwendung in Verbindung mit dem point_in_time_accurate_join Mit dieser Methode kann der Aufrufer angeben, wie viele Datensätze von denen zurückgegeben werden sollen, die die Point-in-Time-Join-Kriterien erfüllen.

Vergleichen Sie Zeitpunkt-Join-Ergebnisse mit Athena-Abfrageergebnissen

Um die vom SageMaker SDK zurückgegebene Ausgabe zu überprüfen point_in_time_accurate_join Funktion vergleichen wir sie mit dem Ergebnis einer Athena-Abfrage. Zuerst erstellen wir eine Standard-Athena-Abfrage mithilfe einer SELECT-Anweisung, die an die spezifische Tabelle gebunden ist, die von der Feature Store-Laufzeit erstellt wurde. Dieser Tabellenname kann durch Verweis auf gefunden werden table_name Feld nach der Instanziierung des athena_query von dem FeatureGroup API:

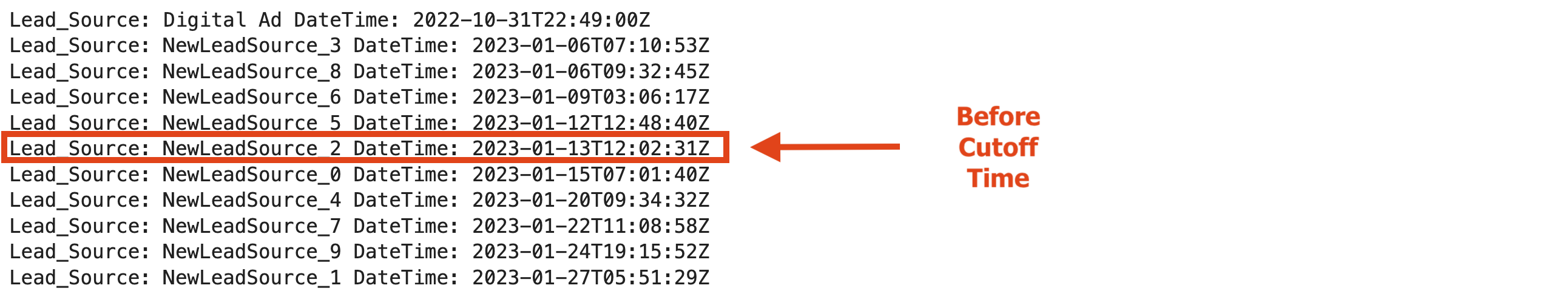

Die Athena-Abfrage enthält keine Point-in-Time-Join-Semantik und gibt daher alle Datensätze zurück, die mit dem angegebenen übereinstimmen record_id (Lead_ProspectID).

Als Nächstes verwenden wir die Pandas-Bibliothek, um die Athena-Ergebnisse zum einfacheren Vergleich nach Ereigniszeiten zu sortieren. Die Datensätze mit Zeitstempeln, die nach den im Entitäts-DataFrame angegebenen Ereigniszeiten liegen (z. B. 2023-01-15T00:00:00Z) eingereicht an die point_in_time_accurate_join erscheinen nicht in den Point-in-Time-Ergebnissen. Weil wir zusätzlich angegeben haben, dass wir nur einen einzigen Datensatz vom Vorhergehenden wollen create_dataset Code erhalten wir nur den neuesten Datensatz vor der Cutoff-Zeit. Durch den Vergleich der SageMaker SDK-Ergebnisse mit den Athena-Abfrageergebnissen sehen wir, dass die Point-in-Time-Join-Funktion die richtigen Datensätze zurückgegeben hat.

Daher sind wir zuversichtlich, dass wir das SageMaker SDK verwenden können, um Zeitreisen auf Zeilenebene durchzuführen und Zielverluste zu vermeiden. Darüber hinaus funktioniert diese Funktion über mehrere Funktionsgruppen hinweg, die auf völlig unterschiedlichen Zeitachsen aktualisiert werden können.

Rufen Sie den Funktionsverlauf innerhalb eines bestimmten Zeitraums ab

Wir möchten auch die Verwendung der Angabe eines Zeitbereichsfensters beim Zusammenfügen der Feature-Gruppen zu einem Datensatz demonstrieren. Das Zeitfenster wird mit definiert with_event_time_range, das zwei Eingaben akzeptiert, starting_timestamp und ending_timestampund gibt ein Dataset-Builder-Objekt zurück. In unserem Codebeispiel legen wir das Abrufzeitfenster auf einen ganzen Tag ab fest 2022-07-01 00:00:00 bis 2022-07-02 00:00:00.

Der folgende Code zeigt, wie ein Datensatz mit dem angegebenen Ereigniszeitfenster erstellt wird, während die Basis-Feature-Gruppe mit der Ziel-Feature-Gruppe verbunden wird:

Wir bestätigen auch den Unterschied zwischen den Größen des mit erstellten Datensatzes with_event_time_range durch Exportieren in einen Pandas DataFrame mit to_dataframe() Methode und Anzeige der Daten. Beachten Sie, dass die Ergebnismenge nur einen Bruchteil der ursprünglichen 10,020 Datensätze enthält, da nur Datensätze abgerufen werden, deren event_time innerhalb des 1-Tages-Zeitraums liegt.

Rufen Sie Features ab einem bestimmten Zeitstempel ab

Das DatasetBuilder as_of Die Methode ruft Features aus einem Datensatz ab, die eine zeitstempelbasierte Einschränkung erfüllen, die der Aufrufer der Funktion als Argument bereitstellt. Dieser Mechanismus ist nützlich für Szenarien wie das erneute Ausführen von Experimenten mit zuvor erfassten Daten, das Backtesting von Zeitreihenmodellen oder das Erstellen eines Datensatzes aus einem früheren Zustand des Offline-Speichers für Datenprüfungszwecke. Diese Funktionalität wird manchmal als Zeitreise bezeichnet, da sie den Datenspeicher im Wesentlichen auf ein früheres Datum und eine frühere Uhrzeit zurücksetzt. Diese Zeitbeschränkung wird auch als bezeichnet Cutoff-Zeitstempel.

In unserem Beispielcode erstellen wir zunächst den Cutoff-Zeitstempel, indem wir die lesen write_time Wert für den letzten in den Feature Store geschriebenen Datensatz, der mit geschrieben wurde put_record. Dann stellen wir diesen Cutoff-Zeitstempel zur Verfügung DatasetBuilder als Argument für die as_of Verfahren:

Es ist wichtig zu beachten, dass die as_of Die Methode wendet die Zeitbeschränkung auf das Interne an write_time Feld, das automatisch vom Feature Store generiert wird. Der write_time Das Feld stellt den tatsächlichen Zeitstempel dar, zu dem der Datensatz in den Datenspeicher geschrieben wird. Dies unterscheidet sich von anderen Methoden wie z point-in-time-accurate-join und with_event_time_range die das vom Client bereitgestellte verwenden event_time Feld als Komparator.

Aufräumen

Löschen Sie unbedingt alle im Rahmen dieses Beispiels erstellten Ressourcen, um laufende Kosten zu vermeiden. Dazu gehören die Funktionsgruppen und der S3-Bucket, der die Offline-Store-Daten enthält.

SageMaker Python SDK-Erfahrung im Vergleich zum Schreiben von SQL

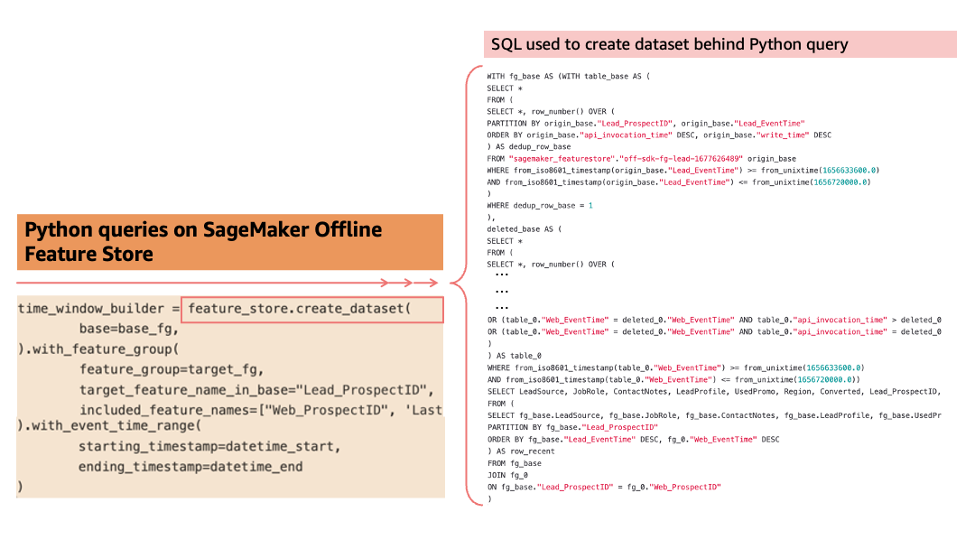

Mit den neuen Methoden im SageMaker Python SDK können Sie schnell Datensätze erstellen und während des ML-Lebenszyklus schnell zum Trainingsschritt übergehen. Um zu zeigen, wie viel Zeit und Aufwand eingespart werden können, untersuchen wir einen Anwendungsfall, bei dem wir zwei Funktionsgruppen zusammenführen und gleichzeitig die Funktionen innerhalb eines bestimmten Zeitrahmens abrufen müssen. Die folgende Abbildung vergleicht die Python-Abfragen im Offline-Feature-Store mit SQL, das zum Erstellen des Datensatzes hinter einer Python-Abfrage verwendet wurde.

Wie Sie sehen, erfordert derselbe Vorgang des Zusammenführens zweier Funktionsgruppen die Erstellung einer langen, komplexen SQL-Abfrage, wohingegen dies allein mit der erfolgen kann with_feature_group und with_event_time_range Methoden im SageMaker Python SDK.

Zusammenfassung

Mit den neuen Offline-Speichermethoden im Python SageMaker SDK können Sie Ihre Offline-Funktionen abfragen, ohne komplexe SQL-Anweisungen schreiben zu müssen. Dies bietet Kunden, die es gewohnt sind, während der Modellentwicklung Python-Code zu schreiben, ein nahtloses Erlebnis. Weitere Informationen zu Funktionsgruppen finden Sie unter Erstellen Sie einen Datensatz aus Ihren Funktionsgruppen und Feature Store-APIs: Feature-Gruppe.

Das vollständige Beispiel in diesem Beitrag finden Sie im GitHub-Repository. Probieren Sie es aus und teilen Sie uns Ihr Feedback in den Kommentaren mit.

Über die Autoren

Paul Hargis hat seine Bemühungen auf maschinelles Lernen bei mehreren Unternehmen konzentriert, darunter AWS, Amazon und Hortonworks. Es macht ihm Spaß, Technologielösungen zu entwickeln und Menschen beizubringen, wie sie diese nutzen können. Paul hilft Kunden gerne dabei, ihre Initiativen zum maschinellen Lernen zu erweitern, um reale Probleme zu lösen. Vor seiner Tätigkeit bei AWS war er als leitender Architekt für Amazon Exports and Expansions tätig und half dabei amazon.com das Erlebnis für internationale Käufer verbessern.

Paul Hargis hat seine Bemühungen auf maschinelles Lernen bei mehreren Unternehmen konzentriert, darunter AWS, Amazon und Hortonworks. Es macht ihm Spaß, Technologielösungen zu entwickeln und Menschen beizubringen, wie sie diese nutzen können. Paul hilft Kunden gerne dabei, ihre Initiativen zum maschinellen Lernen zu erweitern, um reale Probleme zu lösen. Vor seiner Tätigkeit bei AWS war er als leitender Architekt für Amazon Exports and Expansions tätig und half dabei amazon.com das Erlebnis für internationale Käufer verbessern.

Mecit Gungor ist ein AI/ML-Spezialist für Lösungsarchitekten bei AWS, der Kunden beim Entwerfen und Erstellen von KI/ML-Lösungen im großen Maßstab unterstützt. Er deckt ein breites Spektrum an KI/ML-Anwendungsfällen für Telekommunikationskunden ab und konzentriert sich derzeit auf generative KI, LLMs sowie Schulungs- und Inferenzoptimierung. In seiner Freizeit trifft man ihn oft beim Wandern in der Wildnis oder beim Brettspielen mit seinen Freunden an.

Mecit Gungor ist ein AI/ML-Spezialist für Lösungsarchitekten bei AWS, der Kunden beim Entwerfen und Erstellen von KI/ML-Lösungen im großen Maßstab unterstützt. Er deckt ein breites Spektrum an KI/ML-Anwendungsfällen für Telekommunikationskunden ab und konzentriert sich derzeit auf generative KI, LLMs sowie Schulungs- und Inferenzoptimierung. In seiner Freizeit trifft man ihn oft beim Wandern in der Wildnis oder beim Brettspielen mit seinen Freunden an.

Tony Chen ist Machine Learning Solutions Architect bei AWS und unterstützt Kunden bei der Entwicklung skalierbarer und robuster Machine Learning-Funktionen in der Cloud. Als ehemaliger Datenwissenschaftler und Dateningenieur nutzt er seine Erfahrung, um einige der schwierigsten Probleme zu bewältigen, mit denen Unternehmen bei der Operationalisierung von maschinellem Lernen konfrontiert sind.

Tony Chen ist Machine Learning Solutions Architect bei AWS und unterstützt Kunden bei der Entwicklung skalierbarer und robuster Machine Learning-Funktionen in der Cloud. Als ehemaliger Datenwissenschaftler und Dateningenieur nutzt er seine Erfahrung, um einige der schwierigsten Probleme zu bewältigen, mit denen Unternehmen bei der Operationalisierung von maschinellem Lernen konfrontiert sind.

Sovik Kumar Nath ist AI/ML-Lösungsarchitekt bei AWS. Er verfügt über umfangreiche Erfahrung in End-to-End-Designs und Lösungen für maschinelles Lernen; Geschäftsanalysen im Rahmen von Finanz-, Betriebs- und Marketinganalysen; Gesundheitspflege; Lieferkette; und IoT. Außerhalb der Arbeit reist Sovik gerne und schaut sich Filme an.

Sovik Kumar Nath ist AI/ML-Lösungsarchitekt bei AWS. Er verfügt über umfangreiche Erfahrung in End-to-End-Designs und Lösungen für maschinelles Lernen; Geschäftsanalysen im Rahmen von Finanz-, Betriebs- und Marketinganalysen; Gesundheitspflege; Lieferkette; und IoT. Außerhalb der Arbeit reist Sovik gerne und schaut sich Filme an.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- EVM-Finanzen. Einheitliche Schnittstelle für dezentrale Finanzen. Hier zugreifen.

- Quantum Media Group. IR/PR verstärkt. Hier zugreifen.

- PlatoAiStream. Web3-Datenintelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/build-machine-learning-ready-datasets-from-the-amazon-sagemaker-offline-feature-store-using-the-amazon-sagemaker-python-sdk/

- :hast

- :Ist

- :Wo

- $UP

- 1

- 10

- 100

- 11

- 14

- 15%

- 16

- 2023

- 22

- 24

- 7

- 8

- a

- Über Uns

- Akzeptiert

- Zugang

- erreicht

- Genauigkeit

- genau

- über

- Aktivitäten

- präsentieren

- Ad

- Hinzufügen

- zusätzlich

- Nach der

- AI

- AI / ML

- Alle

- erlauben

- erlaubt

- ebenfalls

- immer

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- Analytik

- und

- Ein anderer

- jedem

- Apache

- Bienen

- APIs

- angewandt

- SIND

- Argument

- Argumente

- AS

- At

- Wirtschaftsprüfung

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- vermeiden

- AWS

- Zurück

- Rückvergleich

- Base

- basierend

- BE

- weil

- war

- hinter

- zwischen

- Tafel

- Brettspiele

- bauen

- Baumeister

- Building

- Geschäft

- by

- rufen Sie uns an!

- Anrufer

- CAN

- Fähigkeiten

- fähig

- gefangen

- Karte

- Häuser

- Fälle

- Kette

- herausfordernd

- berechnen

- Gebühren

- Klasse

- Cloud

- Code

- Bemerkungen

- gemeinsam

- Unternehmen

- vergleichen

- Vergleich

- Vergleich

- uneingeschränkt

- Komplex

- konzept

- Vertrauen

- Schichtannahme

- Verbindung

- Bestehend

- enthalten

- enthält

- verkaufen

- Dazugehörigen

- könnte

- Covers

- erstellen

- erstellt

- Erstellen

- Kredit

- Kreditkarte

- Kriterien

- Zur Zeit

- Kunden

- technische Daten

- Datenwissenschaftler

- Datensätze

- Datum

- datetime

- Tag

- definiert

- Definition

- zeigen

- zeigt

- Design

- Designs

- Entwicklung

- Unterschied

- anders

- Anzeige

- Tut nicht

- Nicht

- im

- jeder

- Früher

- einfacher

- leicht

- Einfache

- Anstrengung

- Bemühungen

- Ende

- End-to-End

- Engagement

- Ingenieur

- Gewährleistung

- Einheit

- Epoche

- im Wesentlichen

- Event

- Veranstaltungen

- untersuchen

- Beispiel

- Beispiele

- vorhandenen

- Erweitern Sie die Funktionalität der

- ERFAHRUNGEN

- Experimente

- Ausfuhr

- erweitern

- umfangreiche

- Langjährige Erfahrung

- Gesicht

- Merkmal

- Eigenschaften

- FeatureStore

- Feedback

- Feld

- Abbildung

- Reichen Sie das

- Filterung

- Revolution

- Vorname

- konzentriert

- konzentriert

- Folgende

- Aussichten für

- unten stehende Formular

- Früher

- gefunden

- Fraktion

- FRAME

- Betrug

- betrügerisch

- Frei

- häufig

- Freunde

- für

- voller

- Funktion

- Funktionalität

- Außerdem

- Games

- erzeugen

- erzeugt

- generativ

- Generative KI

- bekommen

- ABSICHT

- gegeben

- Gruppe an

- Gruppen

- Griffe

- Haben

- mit

- he

- Gesundheitswesen

- Hilfe

- Unternehmen

- seine

- historisch

- Geschichte

- Ultraschall

- Hilfe

- aber

- HTML

- http

- HTTPS

- identifiziert

- Kennzeichnung

- ids

- if

- importieren

- wichtig

- zu unterstützen,

- in

- das

- Dazu gehören

- Einschließlich

- zeigen

- Information

- Initiativen

- Eingänge

- Instanz

- interessiert

- intern

- International

- in

- iot

- IT

- join

- beigetreten

- Beitritt

- Joins

- jpg

- nur

- Wesentliche

- Wissen

- Nachname

- später

- neueste

- führen

- umwandeln

- lernen

- weniger

- lassen

- Hebelwirkung

- Hebelwirkungen

- Bibliothek

- Lebenszyklus

- Gefällt mir

- Gleichen

- Liste

- Standorte

- Lang

- Maschine

- Maschinelles Lernen

- um

- Making

- viele

- Marketing

- Spiel

- Kann..

- Mechanismus

- Triff

- Trifft

- Methode

- Methoden

- Metrik

- Mitte

- ML

- Modell

- für

- mehr

- vor allem warme

- schlauer bewegen

- Filme

- mehrere

- sollen

- Name

- Namen

- In der Nähe von

- Need

- Neu

- weiter

- Notizbuch

- Notiz..

- Objekt

- of

- Offline-Bereich.

- vorgenommen,

- on

- EINEM

- laufend

- Online

- einzige

- Betrieb

- Betriebs-

- Einkauf & Prozesse

- Optimierung

- or

- Organisationen

- Original

- Andere

- Andernfalls

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- aussen

- übrig

- Pandas

- Teil

- Teile

- passieren

- Weg

- Muster

- Alexander

- Personen

- Ausführen

- führt

- Zeit

- Plato

- Datenintelligenz von Plato

- PlatoData

- spielend

- Post

- größte treibende

- vorhersagen

- Prognose

- sagt voraus,

- Voraussetzungen

- früher

- vorher

- primär

- Vor

- Probleme

- Prozessdefinierung

- ordnungsgemäße

- prospektiv

- die

- bietet

- Bereitstellung

- Zwecke

- Python

- Abfragen

- schnell

- Angebot

- Lesebrillen

- realen Welt

- Rekord

- Aufzeichnungen

- Referenzierung

- bezeichnet

- Release

- representiert

- erfordern

- falls angefordert

- erfordert

- Downloads

- Folge

- Die Ergebnisse

- Rückkehr

- Rückkehr

- Rückgabe

- robust

- Rollen

- Rollen

- REIHE

- Laufen

- sagemaker

- Salz

- gleich

- skalierbaren

- Skalieren

- Szenarien

- Wissenschaftler

- Wissenschaftler

- Sdk

- nahtlos

- Sekunden

- Abschnitt

- sehen

- Semantik

- Modellreihe

- brauchen

- Lösungen

- kompensieren

- Einstellung

- Setup

- mehrere

- sollte

- erklären

- Konzerte

- Einfacher

- einfach

- Single

- Größen

- So

- Lösung

- Lösungen

- LÖSEN

- einige

- Spark

- Spezialist

- spezifisch

- angegeben

- Standard

- Anfang

- Bundesstaat

- Erklärung

- Aussagen

- Schritt

- Shritte

- Lagerung

- speichern

- gelagert

- Läden

- eingereicht

- so

- geeignet

- geliefert

- liefern

- Supply Chain

- Support

- Synchronisation

- Tabelle

- angehen

- Target

- Einführungen

- Technologie

- Telekommunikations

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Dort.

- Diese

- fehlen uns die Worte.

- diejenigen

- Durch

- Gebunden

- Zeit

- Zeitfolgen

- Zeitreise

- Zeitleisten

- mal

- Zeitstempel

- zu

- Tony

- trainiert

- Ausbildung

- Transaktionen

- reisen

- Reise

- versuchen

- XNUMX

- Unix

- nicht wie

- bis

- aktualisiert

- us

- -

- Anwendungsfall

- benutzt

- Verwendung von

- Wert

- Werte

- verschiedene

- überprüfen

- vs

- wollen

- wurde

- beobachten

- Wege

- we

- Netz

- Web-Services

- GUT

- wann

- während

- welche

- während

- WHO

- deren

- breit

- Große Auswahl

- Wikipedia

- werden wir

- mit

- .

- ohne

- Arbeiten

- Werk

- würde

- schreiben

- Schreiben

- geschrieben

- Du

- Ihr

- Zephyrnet