Dieser Blogbeitrag wurde gemeinsam mit Tuana Çelik von deepset verfasst.

Die Unternehmenssuche ist eine entscheidende Komponente der organisatorischen Effizienz durch Dokumentendigitalisierung und Wissensmanagement. Die Unternehmenssuche umfasst das Speichern von Dokumenten wie digitalen Dateien, die Indizierung der Dokumente für die Suche und die Bereitstellung relevanter Ergebnisse auf der Grundlage von Benutzeranfragen. Mit dem Aufkommen großer Sprachmodelle (LLMs) können wir Konversationserfahrungen implementieren, um den Benutzern die Ergebnisse bereitzustellen. Wir müssen jedoch sicherstellen, dass die LLMs die Reaktionen auf Unternehmensdaten begrenzen und so Modellhalluzinationen abmildern.

In diesem Beitrag zeigen wir, wie man mithilfe von Haystack-Pipelines und dem Falcon-40b-Instruct-Modell eine durchgängige generative KI-Anwendung für die Unternehmenssuche mit Retrieval Augmented Generation (RAG) erstellt Amazon SageMaker-JumpStart und Amazon OpenSearch-Dienst. Der Quellcode für das in diesem Beitrag vorgestellte Beispiel ist im verfügbar GitHub-Repository

Lösungsüberblick

Um die generativen KI-Anwendungsantworten nur auf Unternehmensdaten zu beschränken, müssen wir eine Technik namens Retrieval Augmented Generation (RAG) verwenden. Eine Anwendung, die den RAG-Ansatz verwendet, ruft die für die Benutzeranfrage am relevantesten Informationen aus der Wissensdatenbank oder dem Inhalt des Unternehmens ab, bündelt sie als Kontext zusammen mit der Benutzeranfrage als Eingabeaufforderung und sendet sie dann an das LLM, um eine Antwort zu erhalten. Bei LLMs gibt es Einschränkungen hinsichtlich der maximalen Wortanzahl für die Eingabeaufforderungen. Daher hat die Auswahl der richtigen Passagen aus Tausenden oder Millionen von Dokumenten im Unternehmen einen direkten Einfluss auf die Genauigkeit des LLM.

Die RAG-Technik hat in der Unternehmenssuche zunehmend an Bedeutung gewonnen. In diesem Beitrag zeigen wir einen Workflow, der SageMaker JumpStart nutzt, um ein Falcon-40b-Instruct-Modell bereitzustellen, und HayStack verwendet, um eine abruferweiterte Frage-Antwort-Pipeline zu entwerfen und auszuführen. Der endgültige Workflow zur Abruferweiterung umfasst die folgenden allgemeinen Schritte:

- Die Benutzerabfrage wird für eine Retriever-Komponente verwendet, die eine Vektorsuche durchführt, um den relevantesten Kontext aus unserer Datenbank abzurufen.

- Dieser Kontext ist in eine Eingabeaufforderung eingebettet, die einen LLM anweisen soll, nur aus dem bereitgestellten Kontext eine Antwort zu generieren.

- Das LLM generiert eine Antwort auf die ursprüngliche Anfrage, indem es nur den Kontext berücksichtigt, der in die empfangene Eingabeaufforderung eingebettet ist.

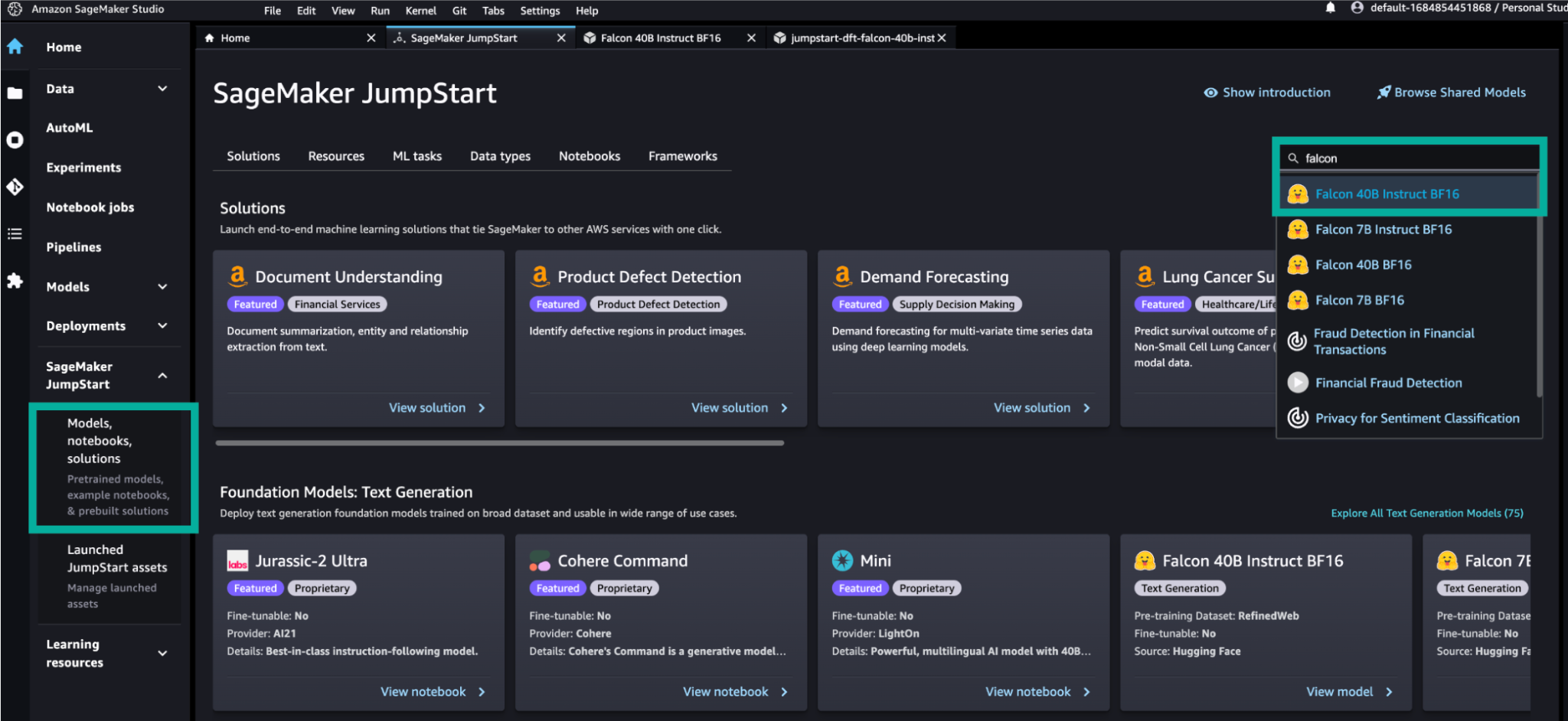

SageMaker-JumpStart

SageMaker JumpStart dient als Modell-Hub, der eine breite Palette von Deep-Learning-Modellen für Text-, Vision-, Audio- und Einbettungsanwendungsfälle bündelt. Mit über 500 Modellen umfasst sein Modell-Hub sowohl öffentliche als auch proprietäre Modelle von AWS-Partnern wie AI21, Stability AI, Cohere und LightOn. Es beherbergt auch ausschließlich von Amazon entwickelte Basismodelle wie AlexaTM. Einige der Modelle bieten die Möglichkeit, sie mit Ihren eigenen Daten zu verfeinern. SageMaker JumpStart bietet außerdem Lösungsvorlagen, die eine Infrastruktur für häufige Anwendungsfälle einrichten, sowie ausführbare Beispiel-Notebooks für maschinelles Lernen (ML) mit SageMaker.

Heuhaufen

Heuhaufen ist ein Open-Source-Framework von Deepset, das es Entwicklern ermöglicht, LLM-Anwendungen zu orchestrieren, die aus verschiedenen Komponenten wie Modellen, Vektor-DBs, Dateikonvertern und unzähligen anderen Modulen bestehen. Haystack bietet Pipelines und Mitarbeiter, zwei leistungsstarke Strukturen zum Entwerfen von LLM-Anwendungen für verschiedene Anwendungsfälle, einschließlich Suche, Fragebeantwortung und Konversations-KI. Mit einem großen Fokus auf modernste Abrufmethoden und solide Bewertungsmetriken bietet es Ihnen alles, was Sie für die Bereitstellung einer zuverlässigen, vertrauenswürdigen Anwendung benötigen. Sie können Pipelines serialisieren YAML-Dateien, legen Sie sie über a frei REST APIund skalieren Sie sie flexibel mit Ihren Arbeitslasten, sodass Sie Ihre Anwendung problemlos von der Prototypenphase in die Produktion überführen können.

Amazon OpenSearch

OpenSearch Service ist ein vollständig verwalteter Service, der die Bereitstellung, Skalierung und den Betrieb von OpenSearch in der AWS Cloud vereinfacht. OpenSearch ist eine skalierbare, flexible und erweiterbare Open-Source-Software-Suite für Such-, Analyse-, Sicherheitsüberwachungs- und Observability-Anwendungen, lizenziert unter der Apache 2.0-Lizenz.

In den letzten Jahren sind ML-Techniken zur Verbesserung der Suche immer beliebter geworden. Dazu gehört die Verwendung von Einbetten von Modellen, ein Modelltyp, der einen großen Datenbestand in einen n-dimensionalen Raum kodieren kann, in dem jede Entität in a kodiert wird Vektor, ein Datenpunkt in diesem Raum, und so organisiert, dass ähnliche Entitäten näher beieinander liegen. Eine Vektordatenbank ermöglicht eine effiziente Suche nach Vektorähnlichkeiten, indem sie spezielle Indizes wie k-NN-Indizes bereitstellt.

Mit den Vektordatenbankfunktionen von OpenSearch Service können Sie semantische Suche, RAG mit LLMs, Empfehlungsmaschinen und die Suche nach Rich Media implementieren. In diesem Beitrag verwenden wir RAG, um generative LLMs mit einer externen Wissensdatenbank zu ergänzen, die typischerweise mithilfe einer Vektordatenbank aufgebaut wird, die mit vektorcodierten Wissensartikeln hydratisiert ist.

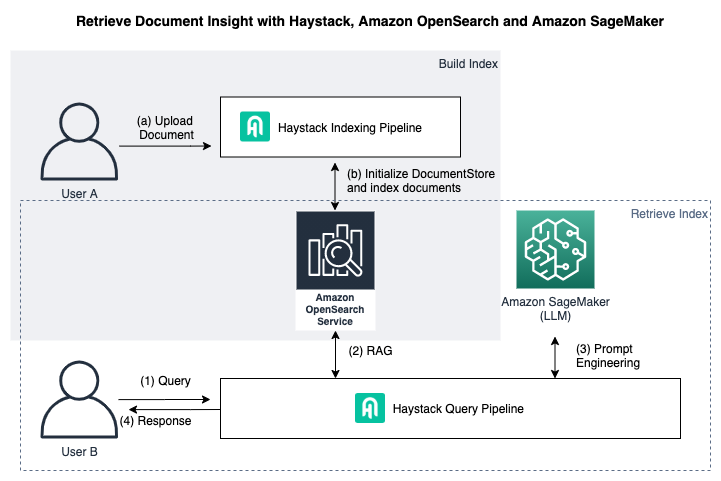

Anwendungsübersicht

Das folgende Diagramm zeigt den Aufbau der endgültigen Bewerbung.

In dieser Anwendung verwenden wir die Haystack Indexing Pipeline, um hochgeladene Dokumente zu verwalten und Dokumente zu indizieren, und die Haystack Query Pipeline, um den Wissensabruf aus indizierten Dokumenten durchzuführen.

Die Haystack Indexing Pipeline umfasst die folgenden allgemeinen Schritte:

- Laden Sie ein Dokument hoch.

- Initialisieren

DocumentStoreund Indexdokumente.

Wir verwenden OpenSearch als unsere DocumentStore und ein Heuhaufen Indizierungspipeline um unsere Dateien vorzuverarbeiten und für OpenSearch zu indizieren. Heuhaufen Dateikonverter und Präprozessor ermöglichen es Ihnen, Ihre Rohdateien zu bereinigen und so vorzubereiten, dass sie in einer Form und einem Format vorliegen, mit denen Ihre NLP-Pipeline (Natural Language Processing) und das Sprachmodell Ihrer Wahl umgehen können. Die hier verwendete Indizierungspipeline verwendet auch sentence-transformers/all-MiniLM-L12-v2 um für jedes Dokument Einbettungen zu erstellen, die wir für eine effiziente Recherche nutzen.

Die Haystack-Abfragepipeline umfasst die folgenden allgemeinen Schritte:

- Wir senden eine Anfrage an die RAG-Pipeline.

- An EmbeddingRetriever Die Komponente fungiert als Filter, der die relevantesten Informationen abruft

top_kDokumente aus unseren indizierten Dokumenten in OpenSearch. Um dies zu erreichen, verwenden wir das von uns gewählte Einbettungsmodell, um sowohl die Abfrage als auch die Dokumente (bei der Indizierung) einzubetten. - Die abgerufenen Dokumente werden in unsere Eingabeaufforderung zum Falcon-40b-Instruct-Modell eingebettet.

- Der LLM kehrt mit einer Antwort zurück, die auf den abgerufenen Dokumenten basiert.

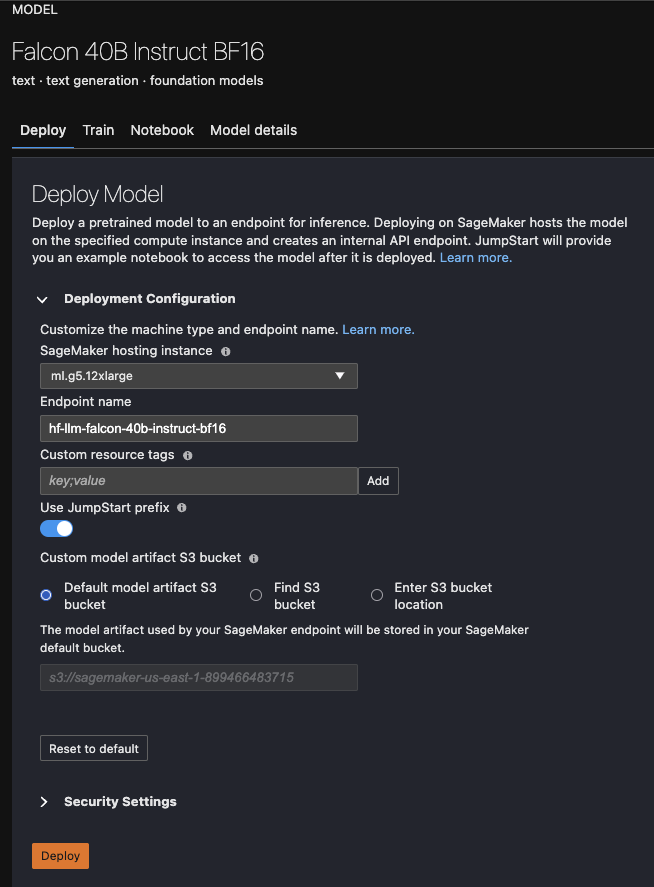

Für die Modellbereitstellung verwenden wir SageMaker JumpStart, das die Bereitstellung von Modellen durch einen einfachen Knopfdruck vereinfacht. Obwohl wir für dieses Beispiel Falcon-40b-instruct verwendet und getestet haben, können Sie jedes auf SageMaker verfügbare Hugging Face-Modell verwenden.

Die endgültige Lösung finden Sie auf der Heuhaufen-Salbeimacher Repository und verwendet die OpenSearch-Website und -Dokumentation (für OpenSearch 2.7) als Beispieldaten für die Durchführung einer erweiterten Abfragebeantwortung.

Voraussetzungen:

Bevor wir AWS-Dienste nutzen können, müssen wir zunächst sicherstellen, dass wir uns angemeldet und ein AWS-Konto erstellt haben. Anschließend sollten Sie einen Administratorbenutzer und eine Administratorgruppe erstellen. Anweisungen zu beiden Schritten finden Sie unter Einrichten von Amazon SageMaker-Voraussetzungen.

Um den Haystack nutzen zu können, müssen Sie den installieren farm-haystack Paket mit den erforderlichen Abhängigkeiten. Um dies zu erreichen, verwenden Sie die requirements.txt Datei in das GitHub-Repository durch Laufen pip install requirements.txt.

Indizieren Sie Dokumente für OpenSearch

Haystack bietet eine Reihe von Konnektoren zu Datenbanken an, die sogenannte DocumentStores. Für diesen RAG-Workflow verwenden wir die OpenSearchDocumentStore. Das Beispiel Quelle enthält eine Indizierungspipeline und AWS CloudFormation Vorlage ein OpenSearchDocumentStore mit Dokumenten, die von der OpenSearch-Website und den Dokumentationsseiten gecrawlt wurden.

Um eine NLP-Anwendung für Produktionsanwendungsfälle zum Laufen zu bringen, müssen wir uns oft Gedanken über die Datenaufbereitung und -bereinigung machen. Dies ist mit abgedeckt Haystack-Indizierungspipelines, mit dem Sie Ihre eigenen Datenvorbereitungsschritte entwerfen können, die Ihre Dokumente letztendlich in die Datenbank Ihrer Wahl schreiben.

Eine Indizierungspipeline kann auch einen Schritt zum Erstellen von Einbettungen für Ihre Dokumente umfassen. Dies ist für den Abrufschritt von großer Bedeutung. In unserem Beispiel verwenden wir Satztransformatoren/all-MiniLM-L12-v2 als unser Einbettungsmodell. Dieses Modell wird verwendet, um Einbettungen für alle unsere indizierten Dokumente, aber auch die Abfrage des Benutzers zum Zeitpunkt der Abfrage zu erstellen.

Um Dokumente in die zu indizieren OpenSearchDocumentStore, wir bieten zwei Optionen mit detaillierten Anweisungen in der README des Beispielrepositorys. Hier führen wir die Schritte zur Indizierung für einen auf AWS bereitgestellten OpenSearch-Dienst durch.

Starten Sie einen OpenSearch-Dienst

Verwenden Sie die bereitgestellten CloudFormation-Vorlage um einen OpenSearch-Dienst auf AWS einzurichten. Wenn Sie den folgenden Befehl ausführen, erhalten Sie einen leeren OpenSearch-Dienst. Anschließend können Sie entweder die von uns bereitgestellten Beispieldaten indizieren oder Ihre eigenen Daten verwenden, die Sie mithilfe von bereinigen und vorverarbeiten können Haystack-Indexierungspipeline. Beachten Sie, dass dadurch eine Instanz erstellt wird, die für das Internet geöffnet ist, was für den Produktionseinsatz nicht empfohlen wird.

Warten Sie etwa 30 Minuten, bis der Stack-Start abgeschlossen ist. Sie können den Fortschritt in der AWS CloudFormation-Konsole überprüfen, indem Sie zu navigieren Stacks Seite und suchen nach dem Stapel mit dem Namen HaystackOpensearch.

Indizieren Sie Dokumente in OpenSearch

Da wir nun über einen laufenden OpenSearch-Dienst verfügen, können wir die OpenSearchDocumentStore-Klasse verwenden, um eine Verbindung zu ihm herzustellen und unsere Dokumente darauf zu schreiben.

Um den Hostnamen für OpenSearch zu erhalten, führen Sie den folgenden Befehl aus:

Exportieren Sie zunächst Folgendes:

Dann können Sie die opensearch_indexing_pipeline.py Skript zur Vorverarbeitung und Indizierung der bereitgestellten Demodaten.

Wenn Sie Ihre eigenen Daten verwenden möchten, ändern Sie die Indizierungspipeline in opensearch_indexing_pipeline.py die einbeziehen FileConverter und Präprozessor Einrichtungsschritte, die Sie benötigen.

Implementieren Sie die erweiterte Frage-Antwort-Pipeline für den Abruf

Nachdem wir die Daten nun in OpenSearch indiziert haben, können wir Fragen zu diesen Dokumenten beantworten. Für diese RAG-Pipeline verwenden wir das Falcon-40b-instruct-Modell, das wir auf SageMaker JumpStart bereitgestellt haben.

Sie haben auch die Möglichkeit, das Modell programmgesteuert über ein Jupyter-Notebook bereitzustellen. Anweisungen finden Sie im GitHub Repo.

- Suchen Sie auf SageMaker JumpStart nach dem Falcon-40b-instruct-Modell.

- Stellen Sie Ihr Modell auf SageMaker JumpStart bereit und notieren Sie sich den Endpunktnamen.

- Exportieren Sie die folgenden Werte:

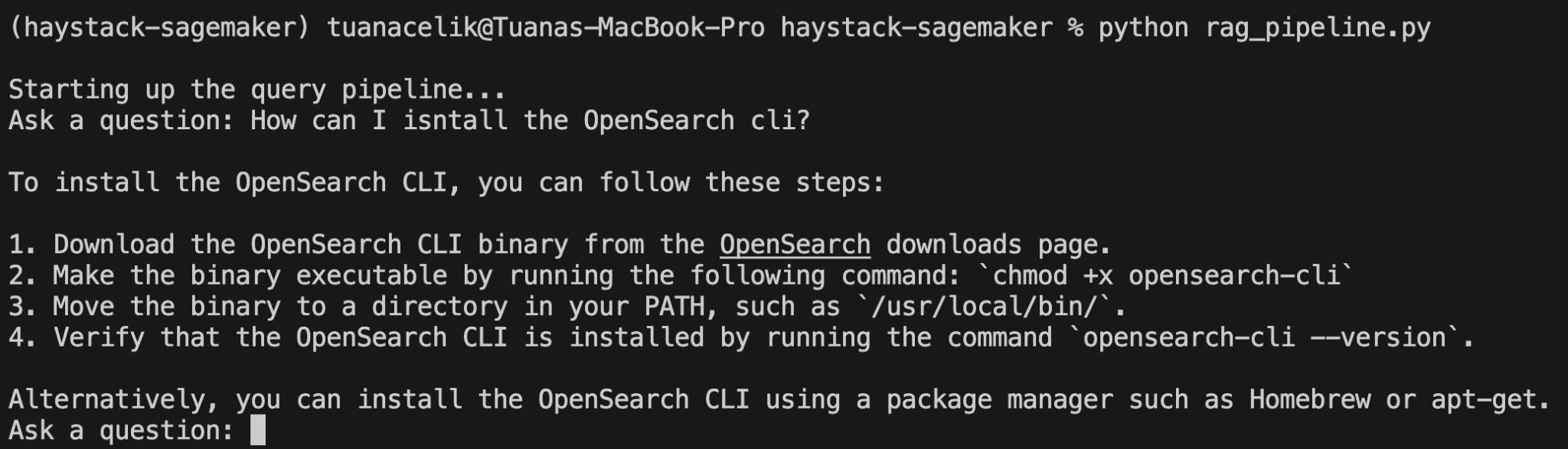

- Führen Sie

python rag_pipeline.py.

Dadurch wird ein Befehlszeilenprogramm gestartet, das auf die Frage eines Benutzers wartet. Stellen wir uns zum Beispiel die Frage: „Wie kann ich die OpenSearch-CLI installieren?“

Dieses Ergebnis wird erreicht, weil wir unsere Eingabeaufforderung im definiert haben Haystack PromptTemplate folgendes sein:

Weitere Anpassungen

Sie können zusätzliche Anpassungen an verschiedenen Elementen in der Lösung vornehmen, wie zum Beispiel die folgenden:

- Die Daten – Wir haben die OpenSearch bereitgestellt Dokumentation und Website Daten als Beispieldaten. Denken Sie daran, die zu ändern

opensearch_indexing_pipeline.pyWenn Sie Ihre eigenen Daten verwenden möchten, können Sie das Skript entsprechend Ihren Anforderungen anpassen. - Das Modell – In diesem Beispiel haben wir das Falcon-40b-instruct-Modell verwendet. Es steht Ihnen frei, jedes andere Hugging Face-Modell auf SageMaker bereitzustellen und zu verwenden. Beachten Sie, dass das Ändern eines Modells wahrscheinlich bedeutet, dass Sie Ihre Eingabeaufforderung an etwas anpassen müssen, für das sie entwickelt wurde.

- die Aufforderung – Für diesen Beitrag haben wir unseren eigenen erstellt

PromptTemplateDadurch wird das Modell angewiesen, Fragen basierend auf dem bereitgestellten Kontext zu beantworten und mit „Ich weiß nicht“ zu antworten, wenn der Kontext keine relevanten Informationen enthält. Sie können diese Eingabeaufforderung ändern, um mit Falcon-40b-instruct mit verschiedenen Eingabeaufforderungen zu experimentieren. Sie können einige unserer Eingabeaufforderungen auch einfach aus dem abrufen PromptHub. - Das Einbettungsmodell – Für den Abrufschritt verwenden wir ein leichtes Einbettungsmodell: Satztransformatoren/all-MiniLM-L12-v2. Sie können dies jedoch auch an Ihre Bedürfnisse anpassen. Denken Sie daran, die erwarteten Einbettungsmaße in Ihrem zu ändern

DocumentStoreentsprechend. - Die Anzahl der abgerufenen Dokumente – Sie können auch mit der Anzahl der angeforderten Dokumente herumspielen

EmbeddingRetrieverfür jede Abfrage abzurufen. In unserem Setup ist dies auf eingestellt top_k=5. Sie können mit der Änderung dieser Zahl experimentieren, um zu sehen, ob die Bereitstellung von mehr Kontext die Genauigkeit Ihrer Ergebnisse verbessert.

Produktionsbereitschaft

Die in diesem Beitrag vorgeschlagene Lösung kann die Wertschöpfungszeit des Projektentwicklungsprozesses beschleunigen. Sie können ein Projekt erstellen, das sich leicht mit der Sicherheits- und Datenschutzumgebung in der AWS Cloud skalieren lässt.

Aus Sicherheits- und Datenschutzgründen bietet OpenSearch Service Datenschutz Identitäts- und Zugriffsverwaltung und Dienstübergreifende Verhinderung verwirrter Proxys. Sie können eine differenzierte Benutzerzugriffskontrolle einsetzen, sodass der Benutzer nur auf die Daten zugreifen kann, zu deren Zugriff er berechtigt ist. Darüber hinaus bietet SageMaker konfigurierbare Sicherheitseinstellungen für Zutrittskontrolle, Datenschutz und Protokollierung und Überwachung. Mit können Sie Ihre Daten im Ruhezustand und während der Übertragung schützen AWS-Schlüsselverwaltungsservice (AWS KMS) Schlüssel. Sie können auch das Protokoll der SageMaker-Modellbereitstellung oder des Endpunktzugriffs verfolgen Amazon CloudWatch. Weitere Informationen finden Sie unter Überwachen Sie Amazon SageMaker mit Amazon CloudWatch.

Für die hohe Skalierbarkeit des OpenSearch-Dienstes können Sie ihn anpassen Dimensionierung Ihrer OpenSearch Service-Domänen und beschäftigen betriebliche Best Practices. Sie können auch die automatische Skalierung Ihres SageMaker-Endpunkts nutzen – das ist möglich SageMaker-Modelle automatisch skalieren um den Endpunkt anzupassen, wenn der Datenverkehr zunimmt oder die Ressourcen nicht genutzt werden.

Aufräumen

Um Kosten zu sparen, löschen Sie alle Ressourcen, die Sie im Rahmen dieses Beitrags bereitgestellt haben. Wenn Sie den CloudFormation-Stack gestartet haben, können Sie ihn über die AWS CloudFormation-Konsole löschen. Ebenso können Sie alle SageMaker-Endpunkte löschen, die Sie möglicherweise über die SageMaker-Konsole erstellt haben.

Zusammenfassung

In diesem Beitrag haben wir gezeigt, wie man mit RAG eine durchgängige generative KI-Anwendung für die Unternehmenssuche erstellt, indem man Haystack-Pipelines und das Falcon-40b-Instruct-Modell von SageMaker JumpStart und OpenSearch Service verwendet. Der RAG-Ansatz ist bei der Unternehmenssuche von entscheidender Bedeutung, da er sicherstellt, dass die generierten Antworten innerhalb der Domäne liegen und somit Halluzinationen mildern. Durch den Einsatz von Haystack-Pipelines sind wir in der Lage, LLM-Anwendungen zu orchestrieren, die aus verschiedenen Komponenten wie Modellen und Vektordatenbanken bestehen. SageMaker JumpStart bietet uns eine Ein-Klick-Lösung für die Bereitstellung von LLMs, und wir haben OpenSearch Service als Vektordatenbank für unsere indizierten Daten verwendet. Sie können mit dem Experimentieren und dem Erstellen von RAG-Proofs of Concept für Ihre generativen KI-Anwendungen in Ihrem Unternehmen beginnen, indem Sie die in diesem Beitrag beschriebenen Schritte und den im verfügbaren Quellcode verwenden GitHub-Repository.

Über die Autoren

Tuana Celik ist Lead Developer Advocate bei deepset, wo sie sich auf die Open-Source-Community für HayStack konzentriert. Sie leitet die Developer Relations-Funktion, spricht regelmäßig auf Veranstaltungen über NLP und erstellt Lernmaterialien für die Community.

Tuana Celik ist Lead Developer Advocate bei deepset, wo sie sich auf die Open-Source-Community für HayStack konzentriert. Sie leitet die Developer Relations-Funktion, spricht regelmäßig auf Veranstaltungen über NLP und erstellt Lernmaterialien für die Community.

Roy Allela ist Senior AI/ML Specialist Solutions Architect bei AWS mit Sitz in München, Deutschland. Roy hilft AWS-Kunden – von kleinen Startups bis hin zu großen Unternehmen –, große Sprachmodelle effizient auf AWS zu trainieren und bereitzustellen. Roy beschäftigt sich leidenschaftlich mit rechnerischen Optimierungsproblemen und der Verbesserung der Leistung von KI-Workloads.

Roy Allela ist Senior AI/ML Specialist Solutions Architect bei AWS mit Sitz in München, Deutschland. Roy hilft AWS-Kunden – von kleinen Startups bis hin zu großen Unternehmen –, große Sprachmodelle effizient auf AWS zu trainieren und bereitzustellen. Roy beschäftigt sich leidenschaftlich mit rechnerischen Optimierungsproblemen und der Verbesserung der Leistung von KI-Workloads.

Mia Chang ist ein ML-Spezialist für Lösungsarchitekten für Amazon Web Services. Sie arbeitet mit Kunden in EMEA zusammen und teilt Best Practices für die Ausführung von KI/ML-Workloads in der Cloud mit ihrem Hintergrund in angewandter Mathematik, Informatik und KI/ML. Sie konzentriert sich auf NLP-spezifische Arbeitsbelastungen und teilt ihre Erfahrungen als Konferenzrednerin und Buchautorin. In ihrer Freizeit geht sie gerne wandern, spielt Gesellschaftsspiele und kocht Kaffee.

Mia Chang ist ein ML-Spezialist für Lösungsarchitekten für Amazon Web Services. Sie arbeitet mit Kunden in EMEA zusammen und teilt Best Practices für die Ausführung von KI/ML-Workloads in der Cloud mit ihrem Hintergrund in angewandter Mathematik, Informatik und KI/ML. Sie konzentriert sich auf NLP-spezifische Arbeitsbelastungen und teilt ihre Erfahrungen als Konferenzrednerin und Buchautorin. In ihrer Freizeit geht sie gerne wandern, spielt Gesellschaftsspiele und kocht Kaffee.

Inaam Syed ist Startup Solutions Architect bei AWS und konzentriert sich stark darauf, B2B- und SaaS-Startups bei der Skalierung und Erzielung von Wachstum zu unterstützen. Er besitzt eine tiefe Leidenschaft für serverlose Architekturen und KI/ML. In seiner Freizeit genießt Inaam schöne Momente mit seiner Familie und geht seiner Liebe zum Radfahren und Badminton nach.

Inaam Syed ist Startup Solutions Architect bei AWS und konzentriert sich stark darauf, B2B- und SaaS-Startups bei der Skalierung und Erzielung von Wachstum zu unterstützen. Er besitzt eine tiefe Leidenschaft für serverlose Architekturen und KI/ML. In seiner Freizeit genießt Inaam schöne Momente mit seiner Familie und geht seiner Liebe zum Radfahren und Badminton nach.

David Tippett ist Senior Developer Advocate und arbeitet an Open-Source-OpenSearch bei AWS. Seine Arbeit umfasst alle Bereiche von OpenSearch von Suche und Relevanz bis hin zu Observability und Security Analytics.

David Tippett ist Senior Developer Advocate und arbeitet an Open-Source-OpenSearch bei AWS. Seine Arbeit umfasst alle Bereiche von OpenSearch von Suche und Relevanz bis hin zu Observability und Security Analytics.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- ChartPrime. Verbessern Sie Ihr Handelsspiel mit ChartPrime. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/build-production-ready-generative-ai-applications-for-enterprise-search-using-haystack-pipelines-and-amazon-sagemaker-jumpstart-with-llms/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 100

- 12

- 13

- 30

- 500

- 7

- 8

- a

- Fähig

- Über Uns

- beschleunigen

- Zugang

- erreichen

- entsprechend

- Konto

- Genauigkeit

- Erreichen

- erreicht

- Erreichen

- Handlungen

- automatisch

- Zusätzliche

- zusätzlich

- administrativ

- Vorteil

- Advent

- Anwalt

- AI

- AI / ML

- Alle

- erlauben

- erlaubt

- entlang

- ebenfalls

- Obwohl

- Amazon

- Amazon Sage Maker

- Amazon SageMaker-JumpStart

- Amazon Web Services

- unter

- an

- Analytik

- und

- beantworten

- jedem

- Apache

- Anwendung

- Anwendungen

- angewandt

- Ansatz

- ca.

- SIND

- Bereiche

- um

- Feld

- Kunst

- Artikel

- AS

- Unterstützung

- At

- Audio-

- Augmented

- Autor

- zugelassen

- Auto

- verfügbar

- AWS

- AWS CloudFormation

- B2B

- Hintergrund

- Base

- basierend

- BE

- weil

- werden

- Bevor

- Sein

- unten

- BESTE

- Best Practices

- Big

- Blog

- Tafel

- Brettspiele

- Körper

- buchen

- beide

- breit

- bauen

- Building

- erbaut

- Bündel

- aber

- Taste im nun erscheinenden Bestätigungsfenster nun wieder los.

- by

- namens

- CAN

- Fähigkeiten

- Fälle

- Übernehmen

- Ändern

- aus der Ferne überprüfen

- Wahl

- Auswählen

- Auswahl

- wählten

- Klasse

- Reinigung

- näher

- Cloud

- Code

- Kaffee

- gemeinsam

- community

- Unternehmen

- Ergänzung

- abschließen

- Komponente

- Komponenten

- inbegriffen

- Computer

- Computerwissenschaften

- konzept

- Konferenz

- verwirrt

- Vernetz Dich

- Berücksichtigung

- Konsul (Console)

- enthalten

- Inhalt

- Kontext

- Smartgeräte App

- Konversations

- Konversations-KI

- Kosten

- bedeckt

- Covers

- erstellen

- erstellt

- schafft

- kritischem

- Kunden

- technische Daten

- Datenaufbereitung

- Datenschutz

- Datenbase

- Datenbanken

- DBS

- Deal

- tief

- tiefe Lernen

- definiert

- Demo

- Abhängigkeiten

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- Design

- entworfen

- Entwerfen

- detailliert

- entwickelt

- Entwickler:in / Unternehmen

- Entwickler

- Entwicklung

- anders

- digital

- Digitalisierung

- Größe

- Direkt

- do

- Dokument

- Dokumentation

- Unterlagen

- die

- Tut nicht

- Don

- Nicht

- jeder

- Einfache

- Effizienz

- effizient

- effizient

- entweder

- Elemente

- einbetten

- eingebettet

- Einbettung

- EMEA

- ermöglichen

- Ende

- End-to-End

- Endpunkt

- Motor (en)

- zu steigern,

- gewährleisten

- sorgt

- Unternehmen

- Entitäten

- Einheit

- Arbeitsumfeld

- Auswertung

- Veranstaltungen

- alles

- Beispiel

- erwartet

- ERFAHRUNGEN

- Erfahrungen

- Experiment

- exportieren

- extern

- Gesicht

- Familie

- Abbildung

- Reichen Sie das

- Mappen

- Filter

- Finale

- Vorname

- passen

- flexibel

- flexibel

- Setzen Sie mit Achtsamkeit

- konzentriert

- Folgende

- Aussichten für

- Format

- Foundation

- Unser Ansatz

- Frei

- für

- voll

- Funktion

- Games

- erzeugen

- erzeugt

- erzeugt

- Generation

- generativ

- Generative KI

- Deutschland

- bekommen

- gegeben

- Gruppe an

- Wachstum

- Griff

- Haben

- mit

- he

- hilft

- hier (auf dänisch)

- hier

- GUTE

- High-Level

- hoch

- seine

- Gastgeber

- Ultraschall

- Hilfe

- aber

- HTML

- http

- HTTPS

- Nabe

- i

- Identitätsschutz

- if

- Impact der HXNUMXO Observatorien

- implementieren

- wichtig

- Verbesserung

- in

- das

- Dazu gehören

- Einschließlich

- hat

- zunehmend

- Index

- indiziert

- Indizes

- Information

- Infrastruktur

- Varianten des Eingangssignals:

- installieren

- Instanz

- Anleitung

- Internet

- in

- IT

- SEINE

- jpg

- Wesentliche

- Tasten

- Wissen

- Wissen

- Knowledge Management

- Sprache

- grosse

- starten

- ins Leben gerufen

- führen

- umwandeln

- lernen

- Lizenz

- Zugelassen

- leicht

- Gefällt mir

- wahrscheinlich

- LIMIT

- Einschränkungen

- Line

- LLM

- Log

- Protokollierung

- suchen

- ich liebe

- Maschine

- Maschinelles Lernen

- gemacht

- um

- MACHT

- Making

- verwalten

- verwaltet

- Management

- Materialien

- Mathematik

- maximal

- Kann..

- bedeuten

- Medien

- Methoden

- Metrik

- Millionen

- Minuten

- mildernd

- ML

- Modell

- für

- ändern

- Module

- Moments

- Überwachung

- mehr

- vor allem warme

- schlauer bewegen

- Name

- Namens

- Natürliche

- Verarbeitung natürlicher Sprache

- navigieren

- Need

- Bedürfnisse

- Nlp

- Notizbuch

- Anzahl

- of

- bieten

- Angebote

- on

- einzige

- XNUMXh geöffnet

- Open-Source-

- Quelloffene Software

- betreiben

- Optimierung

- Option

- Optionen

- or

- organisatorisch

- Organisiert

- Original

- Andere

- UNSERE

- skizzierte

- übrig

- besitzen

- Paket

- Seite

- Seiten

- Teil

- Leidenschaft & KREATIVITÄT

- leidenschaftlich

- Ausführen

- Leistung

- Pipeline

- Plato

- Datenintelligenz von Plato

- PlatoData

- Play

- Bitte

- Points

- Beliebt

- Post

- größte treibende

- Praktiken

- Vorbereitung

- Danach

- Datenschutz

- Probleme

- Prozessdefinierung

- Verarbeitung

- Produktion

- Fortschritt

- Projekt

- Beweise

- vorgeschlage

- Eigentums-

- Risiken zu minimieren

- Sicherheit

- Prototyp

- die

- vorausgesetzt

- bietet

- Bereitstellung

- Stellvertreter

- Öffentlichkeit

- Push

- Qualität

- Abfragen

- Frage

- Fragen

- Roh

- Received

- kürzlich

- Software Empfehlungen

- empfohlen

- regelmäßig

- Verhältnis

- Relevanz

- relevant

- zuverlässig

- merken

- Quelle

- Anforderung

- erfordern

- falls angefordert

- Voraussetzungen:

- Downloads

- Antwort

- Antworten

- REST

- eine Beschränkung

- Folge

- Die Ergebnisse

- Rückgabe

- Reiches

- Recht

- roy

- Führen Sie

- Laufen

- SaaS

- sagemaker

- Speichern

- Skalierbarkeit

- skalierbaren

- Skalieren

- Skalierung

- Wissenschaft

- Suche

- Sicherheitdienst

- sehen

- senden

- sendet

- Senior

- Serverlos

- dient

- Lösungen

- kompensieren

- Einstellungen

- Setup

- Form

- Shares

- sie

- SCHIFF

- sollte

- erklären

- Vitrine

- präsentiert

- unterzeichnet

- ähnlich

- Ähnlich

- Einfacher

- einfach

- klein

- So

- Software

- allein

- solide

- Lösung

- Lösungen

- einige

- etwas

- Quelle

- Quellcode

- Raumfahrt

- Speaker

- spricht

- Spezialist

- spezialisiert

- Stabilität

- Stapel

- Stufe

- Anfang

- Anfang

- Startups

- Schritt

- Shritte

- Speicherung

- stark

- Struktur

- so

- Suite

- sicher

- Nehmen

- nimmt

- Techniken

- Vorlagen

- getestet

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Quelle

- Sie

- dann

- damit

- deswegen

- Diese

- vom Nutzer definierten

- Ding

- think

- fehlen uns die Worte.

- Tausende

- Durch

- Zeit

- zu

- gemeinsam

- verfolgen sind

- der Verkehr

- Transit

- vertrauenswürdig

- XNUMX

- tippe

- typisch

- Letztlich

- für

- hochgeladen

- us

- -

- benutzt

- Mitglied

- Nutzer

- verwendet

- Verwendung von

- Nutzen

- Wert

- Werte

- verschiedene

- Seh-

- wartet

- we

- Netz

- Web-Services

- Webseite

- wann

- welche

- werden wir

- mit

- .

- Word

- Arbeiten

- Arbeitsablauf.

- arbeiten,

- Werk

- würde

- schreiben

- YAML

- Jahr

- Du

- Ihr

- Zephyrnet