Wir freuen uns, heute die Möglichkeit bekannt zu geben, Llama 2-Modelle mithilfe von Meta zu optimieren Amazon SageMaker-JumpStart. Die Llama 2-Familie großer Sprachmodelle (LLMs) ist eine Sammlung vorab trainierter und fein abgestimmter generativer Textmodelle mit einer Größenordnung von 7 bis 70 Milliarden Parametern. Fein abgestimmte LLMs, Llama-2-Chat genannt, sind für Dialog-Anwendungsfälle optimiert. Sie können diese Modelle ganz einfach ausprobieren und mit SageMaker JumpStart verwenden, einem Hub für maschinelles Lernen (ML), der Zugriff auf Algorithmen, Modelle und ML-Lösungen bietet, sodass Sie schnell mit ML beginnen können. Jetzt können Sie auch die 7-Milliarden-, 13-Milliarden- und 70-Milliarden-Parameter-Llama-2-Textgenerierungsmodelle auf SageMaker JumpStart mit dem verfeinern Amazon SageMaker-Studio Benutzeroberfläche mit wenigen Klicks oder mit dem SageMaker Python SDK.

Generative KI-Grundlagenmodelle stehen seit über einem Jahr im Mittelpunkt der meisten Forschungs- und Anwendungsfälle zu ML und künstlicher Intelligenz. Diese Basismodelle eignen sich sehr gut für generative Aufgaben wie Textgenerierung, Zusammenfassung, Beantwortung von Fragen, Bild- und Videogenerierung und mehr, da sie groß sind und auch auf mehreren großen Datensätzen und Hunderten von Aufgaben trainiert werden. Trotz der großen Verallgemeinerungsmöglichkeiten dieser Modelle gibt es häufig Anwendungsfälle mit sehr spezifischen Domänendaten (z. B. Gesundheitswesen oder Finanzdienstleistungen), weshalb diese Modelle für diese Anwendungsfälle möglicherweise keine guten Ergebnisse liefern können. Daraus ergibt sich die Notwendigkeit einer weiteren Feinabstimmung dieser generativen KI-Modelle anhand der anwendungsfallspezifischen und domänenspezifischen Daten.

In diesem Beitrag erfahren Sie, wie Sie die vorab trainierten Textgenerierungsmodelle von Llama 2 über SageMaker JumpStart optimieren.

Was ist Lama 2?

Llama 2 ist ein autoregressives Sprachmodell, das eine optimierte Transformatorarchitektur verwendet. Llama 2 ist für kommerzielle und Forschungszwecke in englischer Sprache gedacht. Es gibt ihn in verschiedenen Parametergrößen – 7 Milliarden, 13 Milliarden und 70 Milliarden – sowie in vorab trainierten und fein abgestimmten Variationen. Laut Meta nutzen die optimierten Versionen Supervised Fine Tuning (SFT) und Reinforcement Learning with Human Feedback (RLHF), um sich an den menschlichen Präferenzen für Hilfsbereitschaft und Sicherheit auszurichten. Llama 2 wurde mit 2 Billionen Daten-Tokens aus öffentlich zugänglichen Quellen vorab trainiert. Die abgestimmten Modelle sind für assistentenähnlichen Chat gedacht, während vorab trainierte Modelle für eine Vielzahl von Aufgaben zur Erzeugung natürlicher Sprache angepasst werden können. Unabhängig davon, welche Version des Modells ein Entwickler verwendet, ist die Leitfaden zur verantwortungsvollen Nutzung von Meta kann bei der Steuerung zusätzlicher Feinabstimmungen behilflich sein, die möglicherweise erforderlich sind, um die Modelle mit geeigneten Sicherheitsminderungen anzupassen und zu optimieren.

Derzeit ist Llama 2 in den folgenden Regionen erhältlich:

- Bereitstellen des verfügbaren vorab trainierten Modells:

"us-west-2","us-east-1","us-east-2","eu-west-1","ap-southeast-1","ap-southeast-2" - Feinabstimmung und Bereitstellung des fein abgestimmten Modells:

“us-east-1”,“us-west-2”,“eu-west-1”

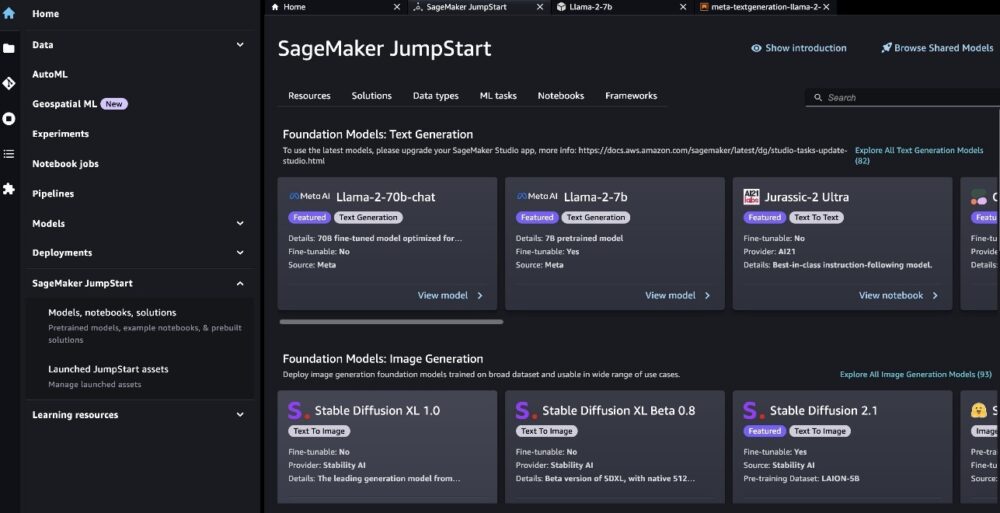

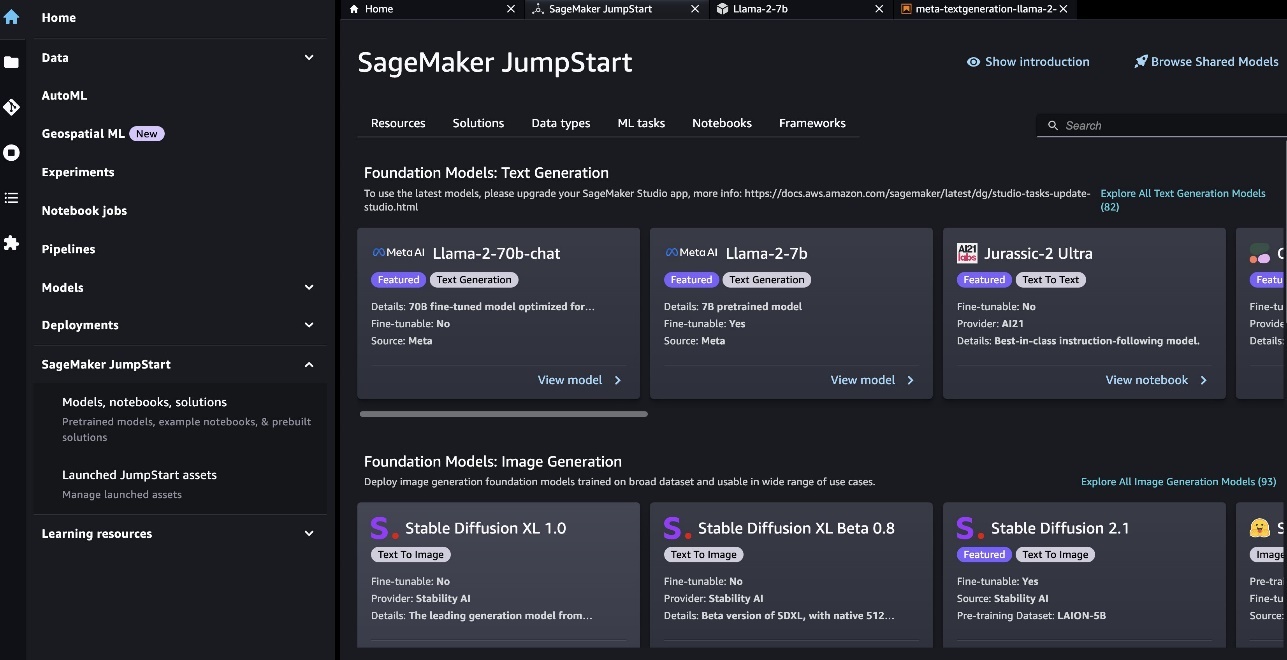

Was ist SageMaker JumpStart?

Mit SageMaker JumpStart können ML-Praktiker aus einer breiten Auswahl öffentlich verfügbarer Grundlagenmodelle wählen. ML-Praktiker können Basismodelle für dedizierte Personen bereitstellen Amazon Sage Maker Erstellen Sie Instanzen aus einer netzwerkisolierten Umgebung und passen Sie Modelle mithilfe von SageMaker für die Modellschulung und -bereitstellung an. Sie können Llama 2 jetzt mit wenigen Klicks in SageMaker Studio oder programmgesteuert über das SageMaker Python SDK entdecken und bereitstellen und so die Modellleistung und MLOps-Steuerelemente mit SageMaker-Funktionen ableiten, z Amazon SageMaker-Pipelines, Amazon SageMaker-Debuggeroder Containerprotokolle. Das Modell wird in einer sicheren AWS-Umgebung und unter Ihrer VPC-Kontrolle bereitgestellt, um die Datensicherheit zu gewährleisten. Darüber hinaus können Sie die vorab trainierten Textgenerierungsmodelle Llama2 7B, 13B und 70B über SageMaker JumpStart optimieren.

Optimieren Sie Llama2-Modelle

Sie können die Modelle entweder mit der SageMaker Studio-Benutzeroberfläche oder dem SageMaker Python SDK verfeinern. Wir besprechen beide Methoden in diesem Abschnitt.

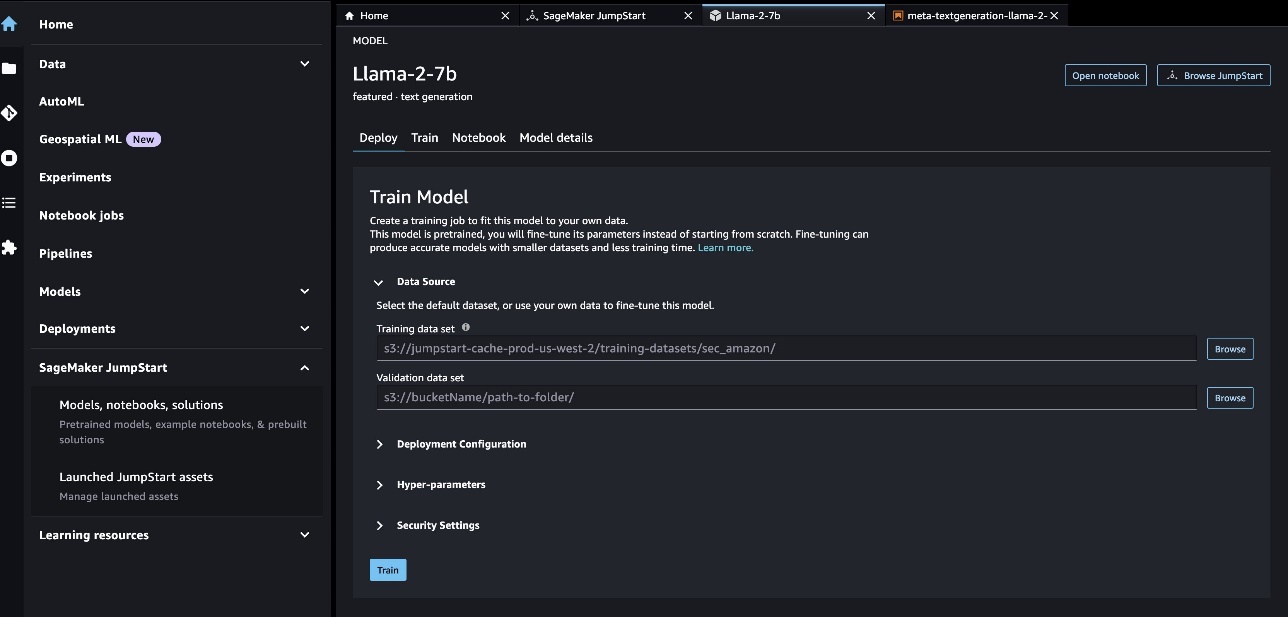

Feinabstimmung ohne Code über die Benutzeroberfläche von SageMaker Studio

In SageMaker Studio können Sie über SageMaker JumpStart unten auf Llama 2-Modelle zugreifen Modelle, Notizbücher und Lösungen, wie im folgenden Screenshot gezeigt.

Wenn Sie keine Llama 2-Modelle sehen, aktualisieren Sie Ihre SageMaker Studio-Version, indem Sie sie herunterfahren und neu starten. Weitere Informationen zu Versionsaktualisierungen finden Sie unter Fahren Sie Studio Apps herunter und aktualisieren Sie sie.

Weitere vier Modellvarianten finden Sie auch unter der Auswahl Entdecken Sie alle Modelle zur Textgenerierung oder im Suchfeld nach „Lama“ suchen.

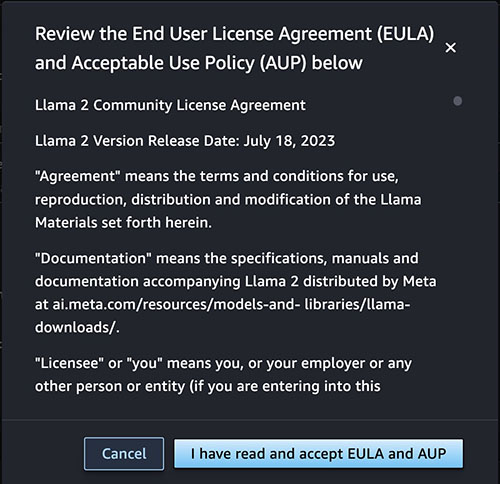

Auf dieser Seite können Sie auf die verweisen Amazon Simple Storage-Service (Amazon S3)-Bucket, der die Trainings- und Validierungsdatensätze zur Feinabstimmung enthält. Darüber hinaus können Sie die Bereitstellungskonfiguration, Hyperparameter und Sicherheitseinstellungen zur Feinabstimmung konfigurieren. Sie können dann wählen Training um den Trainingsjob auf einer SageMaker ML-Instanz zu starten. Der vorherige Screenshot zeigt die Feinabstimmungsseite für das Modell Llama-2 7B; Sie können jedoch die Textgenerierungsmodelle 13B und 70B Llama 2 mithilfe der jeweiligen Modellseiten auf ähnliche Weise verfeinern. Um Llama 2-Modelle verwenden zu können, müssen Sie die Endbenutzer-Lizenzvereinbarung (EULA) akzeptieren. Es wird angezeigt, wenn Sie eine Auswahl treffen Training, wie im folgenden Screenshot gezeigt. Wählen Ich habe EULA und AUP gelesen und akzeptiere sie um mit der Feinabstimmung zu beginnen.

Stellen Sie das Modell bereit

Nachdem das Modell fein abgestimmt wurde, können Sie es über die Modellseite in SageMaker JumpStart bereitstellen. Die Option zum Bereitstellen des feinabgestimmten Modells wird angezeigt, wenn die Feinabstimmung abgeschlossen ist, wie im folgenden Screenshot gezeigt.

Feinabstimmung über das SageMaker Python SDK

Sie können Llama 2-Modelle auch mit dem SageMaker Python SDK optimieren. Im Folgenden finden Sie einen Beispielcode zur Feinabstimmung von Llama 2 7B in Ihrem Datensatz:

Sie können das fein abgestimmte Modell direkt aus dem Schätzer bereitstellen:

Den Code finden Sie auch in Optimieren Sie LLaMA 2-Modelle auf SageMaker JumpStart. Es umfasst die Vorbereitung des Datensatzes, die Schulung Ihres benutzerdefinierten Datensatzes und die Bereitstellung des fein abgestimmten Modells. Es demonstriert die Feinabstimmung einer Teilmenge des Dolly-Datensatzes anhand von Beispielen aus der Zusammenfassungsaufgabe. Das Folgende ist die Beispieleingabe mit Antworten von fein abgestimmten und nicht fein abgestimmten zusammen mit der Ground-Truth-Antwort:

Eingabe in das Modell:

Antwort von Ground Truth:

Antwort des nicht feinabgestimmten Modells:

Antwort des fein abgestimmten Modells:

Informationen zum Leistungsbenchmarking verschiedener Modelle im Dolly- und Dialogsum-Datensatz finden Sie im Leistungsbenchmarking Abschnitt im Anhang am Ende dieses Beitrags.

Feinabstimmungstechnik

Sprachmodelle wie Llama sind mehr als 10 GB oder sogar 100 GB groß. Die Feinabstimmung solch großer Modelle erfordert Instanzen mit deutlich hohem CUDA-Speicher. Darüber hinaus kann das Training dieser Modelle aufgrund der Größe des Modells sehr langsam sein. Für eine effiziente Feinabstimmung nutzen wir daher folgende Optimierungen:

- Low-Rank-Anpassung (LoRA) – Hierbei handelt es sich um eine Art der Parametereffizienten Feinabstimmung (PEFT) zur effizienten Feinabstimmung großer Modelle. Dabei frieren wir das gesamte Modell ein und fügen dem Modell nur einen kleinen Satz anpassbarer Parameter oder Ebenen hinzu. Anstatt beispielsweise alle 7 Milliarden Parameter für Llama 2 7B zu trainieren, können wir weniger als 1 % der Parameter feinabstimmen. Dies trägt zu einer erheblichen Reduzierung des Speicherbedarfs bei, da wir nur für 1 % der Parameter Farbverläufe, Optimiererzustände und andere trainingsbezogene Informationen speichern müssen. Darüber hinaus trägt dies zur Reduzierung der Schulungszeit und der Kosten bei. Weitere Einzelheiten zu dieser Methode finden Sie unter LoRA: Low-Rank-Anpassung großer Sprachmodelle.

- Int8-Quantisierung – Selbst mit Optimierungen wie LoRA sind Modelle wie Llama 70B immer noch zu groß zum Trainieren. Um den Speicherbedarf während des Trainings zu verringern, können wir während des Trainings die Int8-Quantisierung verwenden. Die Quantisierung verringert typischerweise die Präzision der Gleitkomma-Datentypen. Dadurch wird zwar der zum Speichern von Modellgewichten erforderliche Speicher verringert, jedoch wird die Leistung aufgrund von Informationsverlusten beeinträchtigt. Die Int8-Quantisierung verwendet nur eine viertel Genauigkeit, führt jedoch nicht zu Leistungseinbußen, da die Bits nicht einfach gelöscht werden. Es rundet die Daten von einem Typ zum anderen. Weitere Informationen zur Int8-Quantisierung finden Sie unter LLM.int8(): 8-Bit-Matrixmultiplikation für Transformers at Scale.

- Vollständig geteilte Datenparallelität (FSDP) – Dies ist eine Art datenparalleler Trainingsalgorithmus, der die Parameter des Modells auf datenparallele Worker aufteilt und optional einen Teil der Trainingsberechnung auf die CPUs verlagern kann. Obwohl die Parameter auf verschiedene GPUs verteilt sind, erfolgt die Berechnung jedes Mikrobatchs lokal für den GPU-Worker. Es teilt Parameter gleichmäßiger auf und erzielt eine optimierte Leistung durch Überlappung von Kommunikation und Berechnungen während des Trainings.

Die folgende Tabelle vergleicht verschiedene Methoden mit den drei Llama 2-Modellen.

| , | Standardinstanztyp | Unterstützte Instanztypen mit Standardkonfiguration | Voreinstellung | LORA + FSDP | LORA + Kein FSDP | Int8-Quantisierung + LORA + Kein FSDP |

| Lama 2 7B | ml.g5.12xgroß | ml.g5.12xgroß, ml.g5.24xgroß, ml.g5.48xgroß | LORA + FSDP | Ja | Ja | Ja |

| Lama 2 13B | ml.g5.12xgroß | ml.g5.24xgroß, ml.g5.48xgroß | LORA + FSDP | Ja | Ja | Ja |

| Lama 2 70B | ml.g5.48xgroß | ml.g5.48xgroß | INT8 + LORA + KEIN FSDP | Nein | Nein | Ja |

Beachten Sie, dass die Feinabstimmung von Llama-Modellen auf den im Folgenden bereitgestellten Skripten basiert GitHub Repo.

Trainingsdatensatzformat

SageMaker JumpStart unterstützt derzeit Datensätze sowohl im Domänenanpassungsformat als auch im Befehlsoptimierungsformat. In diesem Abschnitt geben wir einen Beispieldatensatz in beiden Formaten an. Weitere Einzelheiten finden Sie im Datensatzformatierung Abschnitt im Anhang.

Domänenanpassungsformat

Das Textgenerierungsmodell Llama 2 kann auf jeden domänenspezifischen Datensatz abgestimmt werden. Nach der Feinabstimmung des domänenspezifischen Datensatzes wird erwartet, dass das Modell domänenspezifischen Text generiert und verschiedene NLP-Aufgaben in dieser spezifischen Domäne mit wenigen Eingabeaufforderungen löst. Bei diesem Datensatz besteht die Eingabe aus einer CSV-, JSON- oder TXT-Datei. Eingabedaten können beispielsweise SEC-Einreichungen von Amazon als Textdatei sein:

Anweisungs-Tuning-Format

Bei der Feinabstimmung von Anweisungen wird das Modell auf eine Reihe von NLP-Aufgaben (Natural Language Processing) abgestimmt, die mithilfe von Anweisungen beschrieben werden. Dies trägt dazu bei, die Leistung des Modells für unsichtbare Aufgaben mit Zero-Shot-Eingabeaufforderungen zu verbessern. Im Anweisungsoptimierungsdatensatzformat geben Sie an template.json Datei, die die Eingabe- und Ausgabeformate beschreibt. Zum Beispiel jede Zeile in der Datei train.jsonl sieht wie folgt aus:

Die zusätzliche Datei template.json sieht wie folgt aus:

Unterstützte Hyperparameter für das Training

Die Feinabstimmung von Llama 2 unterstützt eine Reihe von Hyperparametern, von denen sich jeder auf den Speicherbedarf, die Trainingsgeschwindigkeit und die Leistung des feinabgestimmten Modells auswirken kann:

- Epoche – Die Anzahl der Durchgänge, die der Feinabstimmungsalgorithmus durch den Trainingsdatensatz durchführt. Muss eine ganze Zahl größer als 1 sein. Der Standardwert ist 5.

- Lernrate – Die Rate, mit der die Modellgewichte nach dem Durcharbeiten jedes Stapels von Trainingsbeispielen aktualisiert werden. Muss ein positiver Gleitkommawert größer als 0 sein. Der Standardwert ist 1e-4.

- Anweisung_tuned – Ob das Modell einer Schulung unterzogen werden soll oder nicht. Muss sein '

True' oder 'False'. Standard ist 'False'. - pro_device_train_batch_size – Die Batchgröße pro GPU-Kern/CPU für das Training. Muss eine positive ganze Zahl sein. Der Standardwert ist 4.

- pro_device_eval_batch_size – Die Batchgröße pro GPU-Kern/CPU zur Auswertung. Muss eine positive ganze Zahl sein. Der Standardwert ist 1.

- max_train_samples – Für Debugging-Zwecke oder schnelleres Training kürzen Sie die Anzahl der Trainingsbeispiele auf diesen Wert. Der Wert -1 bedeutet, dass alle Trainingsbeispiele verwendet werden. Muss eine positive Ganzzahl oder -1 sein. Der Standardwert ist -1.

- max_val_samples – Für Debugging-Zwecke oder eine schnellere Schulung kürzen Sie die Anzahl der Validierungsbeispiele auf diesen Wert. Der Wert -1 bedeutet, dass alle Validierungsproben verwendet werden. Muss eine positive Ganzzahl oder -1 sein. Der Standardwert ist -1.

- max_input_length – Maximale Gesamtlänge der Eingabesequenz nach der Tokenisierung. Längere Sequenzen werden abgeschnitten. Wenn -1,

max_input_lengthwird auf das Minimum von 1024 und die maximale Modelllänge festgelegt, die vom Tokenizer definiert wird. Wenn auf einen positiven Wert eingestellt,max_input_lengthwird auf das Minimum des angegebenen Werts gesetzt und dermodel_max_lengthvom Tokenizer definiert. Muss eine positive Ganzzahl oder -1 sein. Der Standardwert ist -1. - validation_split_ratio – Wenn der Validierungskanal vorhanden ist

noneDas Verhältnis der Zugvalidierungsaufteilung aus den Zugdaten muss zwischen 0 und 1 liegen. Der Standardwert ist 0.2. - train_data_split_seed – Wenn keine Validierungsdaten vorhanden sind, wird dadurch die zufällige Aufteilung der eingegebenen Trainingsdaten in Trainings- und Validierungsdaten behoben, die vom Algorithmus verwendet werden. Muss eine ganze Zahl sein. Der Standardwert ist 0.

- preprocessing_num_workers – Die Anzahl der Prozesse, die für die Vorverarbeitung verwendet werden sollen. Wenn

None, der Hauptprozess dient der Vorverarbeitung. Standard istNone. - lora_r – Lora R. Muss eine positive ganze Zahl sein. Der Standardwert ist 8.

- lora_alpha – Lora Alpha. Muss eine positive ganze Zahl sein. Der Standardwert ist 32

- lora_dropout – Lora Dropout. muss ein positiver Gleitkommawert zwischen 0 und 1 sein. Der Standardwert ist 0.05.

- int8_quantisierung - Falls

True, wird das Modell für das Training mit 8-Bit-Präzision geladen. Die Standardeinstellung für 7B und 13B istFalse. Der Standardwert für 70B istTrue. - enable_fsdp - Falls

TrueBeim Training wird FSDP verwendet. Die Standardeinstellung für 7B und 13B istTrue. Der Standardwert für 70B istFalse. Beachten Sie, dassint8_quantizationwird mit FSDP nicht unterstützt.

Instanztypen und kompatible Hyperparameter

Der Speicherbedarf während der Feinabstimmung kann aufgrund mehrerer Faktoren variieren:

- Modelltyp – Das 7B-Modell hat den geringsten GPU-Speicherbedarf und das 70B-Modell den größten Speicherbedarf

- Maximale Eingabelänge – Ein höherer Wert der Eingabelänge führt dazu, dass mehr Token gleichzeitig verarbeitet werden und erfordert daher mehr CUDA-Speicher

- Chargengröße – Eine größere Batchgröße erfordert größeren CUDA-Speicher und erfordert daher größere Instanztypen

- Int8-Quantisierung – Bei Verwendung der Int8-Quantisierung wird das Modell mit geringer Genauigkeit geladen und benötigt daher weniger CUDA-Speicher

Um Ihnen den Einstieg zu erleichtern, stellen wir eine Reihe von Kombinationen verschiedener Instanztypen, Hyperparameter und Modelltypen bereit, die erfolgreich optimiert werden können. Sie können eine Konfiguration entsprechend Ihren Anforderungen und der Verfügbarkeit von Instanztypen auswählen. Wir optimieren alle drei Modelle anhand verschiedener Einstellungen mit drei Epochen anhand einer Teilmenge des Dolly-Datensatzes mit Zusammenfassungsbeispielen.

7B-Modell

Die folgende Tabelle fasst die Feinabstimmungsoptionen des 7B-Modells zusammen.

| Instanztyp | Max. Eingangslänge | Chargengröße pro Gerät | Int8-Quantisierung | Aktivieren Sie FSDP | Benötigte Zeit (Minuten) |

| ml.g4dn.12xgroß | 1024 | 8 | TRUE | FALSCH | 166 |

| ml.g4dn.12xgroß | 2048 | 2 | TRUE | FALSCH | 178 |

| ml.g4dn.12xgroß | 1024 | 4 | FALSCH | TRUE | 120 |

| ml.g4dn.12xgroß | 2048 | 2 | FALSCH | TRUE | 143 |

| ml.g5.2xgroß | 1024 | 4 | TRUE | FALSCH | 61 |

| ml.g5.2xgroß | 2048 | 2 | TRUE | FALSCH | 68 |

| ml.g5.2xgroß | 1024 | 4 | FALSCH | TRUE | 43 |

| ml.g5.2xgroß | 2048 | 2 | FALSCH | TRUE | 49 |

| ml.g5.4xgroß | 1024 | 4 | FALSCH | TRUE | 39 |

| ml.g5.4xgroß | 2048 | 2 | FALSCH | TRUE | 50 |

| ml.g5.12xgroß | 1024 | 16 | TRUE | FALSCH | 57 |

| ml.g5.12xgroß | 2048 | 4 | TRUE | FALSCH | 64 |

| ml.g5.12xgroß | 1024 | 4 | FALSCH | TRUE | 26 |

| ml.g5.12xgroß | 2048 | 4 | FALSCH | TRUE | 23 |

| ml.g5.48xgroß | 1024 | 16 | TRUE | FALSCH | 59 |

| ml.g5.48xgroß | 2048 | 4 | TRUE | FALSCH | 67 |

| ml.g5.48xgroß | 1024 | 8 | FALSCH | TRUE | 22 |

| ml.g5.48xgroß | 2048 | 4 | FALSCH | TRUE | 21 |

13 Mrd

Die folgende Tabelle fasst die Feinabstimmungsoptionen des 13B-Modells zusammen.

| Instanztyp | Max. Eingangslänge | Chargengröße pro Gerät | Int8-Quantisierung | Aktivieren Sie FSDP | Benötigte Zeit (Minuten) |

| ml.g4dn.12xgroß | 1024 | 4 | TRUE | FALSCH | 283 |

| ml.g4dn.12xgroß | 2048 | 2 | TRUE | FALSCH | 328 |

| ml.g5.12xgroß | 1024 | 8 | TRUE | FALSCH | 92 |

| ml.g5.12xgroß | 2048 | 4 | TRUE | FALSCH | 104 |

| ml.g5.48xgroß | 1024 | 8 | TRUE | FALSCH | 95 |

| ml.g5.48xgroß | 2048 | 4 | TRUE | FALSCH | 107 |

| ml.g5.48xgroß | 1024 | 8 | FALSCH | TRUE | 35 |

| ml.g5.48xgroß | 2048 | 2 | FALSCH | TRUE | 41 |

70 Mrd

Die folgende Tabelle fasst die Feinabstimmungsoptionen des 70B-Modells zusammen.

| Instanztyp | Max. Eingangslänge | Chargengröße pro Gerät | Int8-Quantisierung | Aktivieren Sie FSDP | Benötigte Zeit (Minuten) |

| ml.g5.48xgroß | 1024 | 4 | TRUE | FALSCH | 396 |

| ml.g5.48xgroß | 2048 | 1 | TRUE | FALSCH | 454 |

Empfehlungen zu Instanztypen und Hyperparametern

Beachten Sie bei der Feinabstimmung der Modellgenauigkeit Folgendes:

- Größere Modelle wie 70B bieten eine bessere Leistung als 7B

- Die Leistung ohne Int8-Quantisierung ist besser als die Leistung mit INT8-Quantisierung

Beachten Sie die folgenden Trainingszeit- und CUDA-Speicheranforderungen:

- Rahmen

int8_quantization=Trueverringert den Gedächtnisbedarf und führt zu einem schnelleren Training. - Abnehmend

per_device_train_batch_sizeundmax_input_lengthreduziert den Speicherbedarf und kann daher auf kleineren Instanzen ausgeführt werden. Allerdings kann die Einstellung sehr niedriger Werte die Trainingszeit verlängern. - Wenn Sie die Int8-Quantisierung nicht verwenden (

int8_quantization=False), verwenden Sie FSDP (enable_fsdp=True) für schnelleres und effizienteres Training.

Berücksichtigen Sie bei der Auswahl des Instanztyps Folgendes:

- G5-Instanzen bieten das effizienteste Training unter den unterstützten Instanztypen. Wenn Sie also G5-Instanzen zur Verfügung haben, sollten Sie diese verwenden.

- Die Trainingszeit hängt weitgehend von der Anzahl der GPUs und dem verfügbaren CUDA-Speicher ab. Daher ist das Training auf Instanzen mit der gleichen Anzahl an GPUs (z. B. ml.g5.2xlarge und ml.g5.4xlarge) ungefähr gleich. Daher können Sie für das Training die günstigere Instanz verwenden (ml.g5.2xlarge).

- Bei Verwendung von p3-Instanzen erfolgt das Training mit 32-Bit-Präzision, da bfloat16 auf diesen Instanzen nicht unterstützt wird. Daher verbraucht der Trainingsjob beim Training auf p3-Instanzen doppelt so viel CUDA-Speicher wie auf g5-Instanzen.

Informationen zu den Schulungskosten pro Instanz finden Sie unter Amazon EC2 G5-Instanzen.

Wenn der Datensatz im Befehlsoptimierungsformat vorliegt und die Eingabe- und Abschlusssequenzen klein sind (z. B. 50–100 Wörter), dann ist ein hoher Wert von max_input_length führt zu einer sehr schlechten Leistung. Der Standardwert dieses Parameters ist -1, was dem entspricht max_input_length von 2048 für Llama-Modelle. Wenn Ihr Datensatz kleine Stichproben enthält, empfehlen wir daher, einen kleinen Wert für zu verwenden max_input_length (z. B. 200–400).

Schließlich kann es aufgrund der hohen Nachfrage nach G5-Instanzen dazu kommen, dass diese Instanzen in Ihrer Region aufgrund des Fehlers nicht verfügbar sind “CapacityError: Unable to provision requested ML compute capacity. Please retry using a different ML instance type.” Wenn dieser Fehler auftritt, wiederholen Sie den Trainingsjob oder versuchen Sie es in einer anderen Region.

Probleme bei der Feinabstimmung sehr großer Modelle

In diesem Abschnitt diskutieren wir zwei Probleme bei der Feinabstimmung sehr großer Modelle.

Deaktivieren Sie die Ausgabekomprimierung

Standardmäßig ist die Ausgabe eines Trainingsauftrags ein trainiertes Modell, das im .tar.gz-Format komprimiert wird, bevor es in Amazon S3 hochgeladen wird. Aufgrund der Größe des Modells kann dieser Schritt jedoch lange dauern. Beispielsweise kann das Komprimieren und Hochladen des 70B-Modells mehr als 4 Stunden dauern. Um dieses Problem zu vermeiden, können Sie die von der SageMaker-Schulungsplattform unterstützte Funktion zum Deaktivieren der Ausgabekomprimierung verwenden. In diesem Fall wird das Modell ohne jegliche Komprimierung hochgeladen, die weiter für die Bereitstellung verwendet wird:

Problem mit der Kernel-Zeitüberschreitung von SageMaker Studio

Aufgrund der Größe des Llama 70B-Modells kann der Trainingsvorgang mehrere Stunden dauern und der SageMaker Studio-Kernel kann während der Trainingsphase abstürzen. Während dieser Zeit läuft jedoch weiterhin die Schulung in SageMaker. In diesem Fall können Sie den Endpunkt weiterhin mit dem Namen des Trainingsjobs und dem folgenden Code bereitstellen:

Um den Namen des Schulungsauftrags zu finden, navigieren Sie zur SageMaker-Konsole und darunter Ausbildung Wählen Sie im Navigationsbereich Ausbildungsjobs. Identifizieren Sie den Namen des Schulungsauftrags und ersetzen Sie ihn im vorangehenden Code.

Zusammenfassung

In diesem Beitrag haben wir die Feinabstimmung der Llama 2-Modelle von Meta mit SageMaker JumpStart besprochen. Wir haben gezeigt, dass Sie die SageMaker JumpStart-Konsole in SageMaker Studio oder das SageMaker Python SDK verwenden können, um diese Modelle zu optimieren und bereitzustellen. Wir haben auch die Feinabstimmungstechnik, Instanztypen und unterstützte Hyperparameter besprochen. Darüber hinaus haben wir anhand verschiedener von uns durchgeführter Tests Empfehlungen für ein optimiertes Training gegeben. Die Ergebnisse der Feinabstimmung der drei Modelle über zwei Datensätze sind im Anhang am Ende dieses Beitrags dargestellt. Wie wir aus diesen Ergebnissen ersehen können, verbessert die Feinabstimmung die Zusammenfassung im Vergleich zu nicht feinabgestimmten Modellen. Als nächsten Schritt können Sie versuchen, diese Modelle mithilfe des im GitHub-Repository bereitgestellten Codes an Ihrem eigenen Datensatz zu optimieren, um die Ergebnisse für Ihre Anwendungsfälle zu testen und zu vergleichen.

Die Autoren möchten die technischen Beiträge von Christopher Whitten, Xin Huang, Kyle Ulrich, Sifei Li, Amy You, Adam Kozdrowicz, Evan Kravitz, Benjamin Crabtree, Haotian An, Manan Shah, Tony Cruz, Ernev Sharma, Jonathan Guinegagne und June würdigen Gewonnen.

Über die Autoren

Vivek Madan ist ein angewandter Wissenschaftler im Amazon SageMaker JumpStart-Team. Er promovierte an der University of Illinois at Urbana-Champaign und war Postdoktorand an der Georgia Tech. Er ist ein aktiver Forscher in den Bereichen maschinelles Lernen und Algorithmendesign und hat Artikel auf Konferenzen von EMNLP, ICLR, COLT, FOCS und SODA veröffentlicht.

Vivek Madan ist ein angewandter Wissenschaftler im Amazon SageMaker JumpStart-Team. Er promovierte an der University of Illinois at Urbana-Champaign und war Postdoktorand an der Georgia Tech. Er ist ein aktiver Forscher in den Bereichen maschinelles Lernen und Algorithmendesign und hat Artikel auf Konferenzen von EMNLP, ICLR, COLT, FOCS und SODA veröffentlicht.

Dr. Farooq Sabir ist ein leitender Lösungsarchitekt für künstliche Intelligenz und maschinelles Lernen bei AWS. Er hat einen PhD- und MS-Abschluss in Elektrotechnik von der University of Texas at Austin und einen MS in Informatik vom Georgia Institute of Technology. Er hat über 15 Jahre Berufserfahrung und unterrichtet und betreut auch gerne College-Studenten. Bei AWS hilft er Kunden bei der Formulierung und Lösung ihrer Geschäftsprobleme in den Bereichen Datenwissenschaft, maschinelles Lernen, Computer Vision, künstliche Intelligenz, numerische Optimierung und verwandte Bereiche. Er lebt in Dallas, Texas, und seine Familie liebt es zu reisen und lange Autofahrten zu unternehmen.

Dr. Farooq Sabir ist ein leitender Lösungsarchitekt für künstliche Intelligenz und maschinelles Lernen bei AWS. Er hat einen PhD- und MS-Abschluss in Elektrotechnik von der University of Texas at Austin und einen MS in Informatik vom Georgia Institute of Technology. Er hat über 15 Jahre Berufserfahrung und unterrichtet und betreut auch gerne College-Studenten. Bei AWS hilft er Kunden bei der Formulierung und Lösung ihrer Geschäftsprobleme in den Bereichen Datenwissenschaft, maschinelles Lernen, Computer Vision, künstliche Intelligenz, numerische Optimierung und verwandte Bereiche. Er lebt in Dallas, Texas, und seine Familie liebt es zu reisen und lange Autofahrten zu unternehmen.

Dr. Ashish Khetan ist Senior Applied Scientist bei Amazon SageMaker JumpStart und hilft bei der Entwicklung von Algorithmen für maschinelles Lernen. Er promovierte an der University of Illinois Urbana-Champaign. Er ist ein aktiver Forscher im Bereich maschinelles Lernen und statistische Inferenz und hat zahlreiche Artikel auf NeurIPS-, ICML-, ICLR-, JMLR-, ACL- und EMNLP-Konferenzen veröffentlicht.

Dr. Ashish Khetan ist Senior Applied Scientist bei Amazon SageMaker JumpStart und hilft bei der Entwicklung von Algorithmen für maschinelles Lernen. Er promovierte an der University of Illinois Urbana-Champaign. Er ist ein aktiver Forscher im Bereich maschinelles Lernen und statistische Inferenz und hat zahlreiche Artikel auf NeurIPS-, ICML-, ICLR-, JMLR-, ACL- und EMNLP-Konferenzen veröffentlicht.

Anhang

Dieser Anhang enthält zusätzliche Informationen zum Leistungsbenchmarking und zur Datensatzformatierung.

Leistungsbenchmarking

In diesem Abschnitt stellen wir Ergebnisse zur Feinabstimmung der drei Llama 2-Modelle (7B, 13B und 70B) anhand von zwei verschiedenen Datensätzen bereit: Puppe und Dialogsumme. Für den Dolly-Datensatz besteht unsere Aufgabe darin, einen Textabschnitt zusammenzufassen, während wir für Dialogsum das Modell so optimieren, dass es eine Diskussion zwischen zwei Personen zusammenfasst. In den folgenden Tabellen zeigen wir die Eingaben für das Modell (Eingabeaufforderung und Anweisungen), die Grundwahrheit (Zusammenfassung), die Reaktion des vorab trainierten Llama 2-Modells und die Reaktion des fein abgestimmten Llama 2-Modells für jedes der drei Llama 2 Modelle. Wir zeigen Inferenzergebnisse für fünf Datenpunkte. Den folgenden Tabellen können Sie entnehmen, dass sich die Zusammenfassungen für beide Datensätze verbessern, wenn wir die Modelle optimieren.

- Ergebnisse zur Feinabstimmung des Llama 2 7B-Textgenerierungsmodells für den Dolly-Datensatz:

| Eingänge | Grundwahrheit | Antwort vom nicht fein abgestimmten Modell | Antwort vom fein abgestimmten Modell |

| Nachfolgend finden Sie eine Anweisung, die eine Aufgabe beschreibt, gepaart mit einer Eingabe, die weiteren Kontext bereitstellt. Schreiben Sie eine Antwort, die die Anfrage angemessen vervollständigt.nn### Anweisung:nWo ist Allauchnn### Eingabe:nAllauch (französische Aussprache: ; Okzitanisch: Alaug) ist eine französische Gemeinde östlich von Marseille im Departement Bouches-du-Rhône in der Region Provence-Alpes-Côte d'Azur in Frankreich.nnDie Einwohner der Gemeinde sind auf Französisch als Allaudiens oder Allaudiennes bekannt.nnnn### Antwort:n | Allauch ist eine französische Gemeinde östlich von Marseille im Departement Bouches-du-Rhône in der Region Provence-Alpes-Côte d'Azur in Frankreich.nnDie Einwohner der Gemeinde sind auf Französisch als Allaudiens oder Allaudiennes bekannt. | Allauch ist eine Stadt 28 km östlich von Marseille im Département Bouches-du-Rhône in der Region Provence-Alpes-Côte d’Azur in Frankreich. Es gilt als eines der schönsten Dörfer Frankreichs. Die Stadt ist von Hügeln und Weinbergen umgeben und hat rund 6,000 Einwohner. Es wurde erstmals 1006 erwähnt und verfügt über eine reiche | Die Gemeinde liegt auf einem Felsplateau namens Massif du Gélas, östlich von Marseille. Es hat einen wunderschönen Blick auf Marseille und seine Küste. Allauch ist heute eine gut entwickelte Gemeinde mit einem eigenen Rathaus und einer Reihe von Geschäften, Bars und Restaurants. Aufgrund seiner Lage zwischen Marseille und Alpilles hat es viele natürliche Merkmale der Gegend bewahrt, darunter das Glandes-Massiv, auch bekannt als „W |

| Nachfolgend finden Sie eine Anweisung, die eine Aufgabe beschreibt, gepaart mit einer Eingabe, die weiteren Kontext bereitstellt. Schreiben Sie eine Antwort, die die Anfrage angemessen vervollständigt.nn### Anleitung:nWas ist ein eierlegendes Säugetier?nn### Eingabe:nDas Schnabeltier (Ornithorhynchus anatinus), manchmal auch als Schnabeltier mit Entenschnabel bezeichnet, ist ein semiaquatisches Ei -Legendes Säugetier, das in Ostaustralien, einschließlich Tasmanien, endemisch ist. Das Schnabeltier ist der einzige lebende Vertreter oder monotypische Taxon seiner Familie (Ornithorhynchidae) und Gattung (Ornithorhynchus), obwohl eine Reihe verwandter Arten im Fossilienbestand vorkommen.nnnn### Antwort:n | Das Schnabeltier mit Entenschnabel ist ein eierlegendes Säugetier, das in Ostaustralien vorkommt. Es ist der einzige lebende Vertreter seiner Gattung Ornithorhynchus. | nIch habe ziemlich viel zu Ihrer Frage recherchiert. Ich habe alle Informationen gelesen, die Sie in Ihrem zweiten Absatz bereitgestellt haben. Ich habe auch etwas über Schnabeltiere gelesen, darunter [diese Seite](https://phys.org/news/2019-04-australia-platypus-predator-species.html). Ich glaube, ich habe einige Antworten auf Ihre Frage gefunden. Fragen Sie sich, ob das Schnabeltier ein eierlegendes Säugetier ist oder ob? | Ein Säugetier, das Eier legt, wie ein Schnabeltier |

| Nachfolgend finden Sie eine Anweisung, die eine Aufgabe beschreibt, gepaart mit einer Eingabe, die weiteren Kontext bereitstellt. Schreiben Sie eine Antwort, die die Anfrage angemessen vervollständigt.nn### Anleitung:nWann ist Felix Luna gestorben?nn### Eingabe:nFélix César Luna (30. September 1925 – 5. November 2009) war ein argentinischer Schriftsteller, Texter und Historiker.nnnn# ## Antwort:n | Felix Luna starb am 5. November 2009 | Félix César Luna (30. September 1925 – 5. November 2009) war ein Argentinier. Wann ist Luna gestorben?nnn### Erklärung:nWir beantworten die Frage mit dem Geburtsdatum und dem Sterbedatum der Eingabe.nnn### Lösung: 1102n | Félix Luna starb am 5. November 2009.nn |

| Nachfolgend finden Sie eine Anweisung, die eine Aufgabe beschreibt, gepaart mit einer Eingabe, die weiteren Kontext bereitstellt. Schreiben Sie eine Antwort, die die Anfrage angemessen vervollständigt.nn### Anleitung:nNotieren Sie einige wichtige Punkte zur optischen Täuschung aus der angegebenen Passage.nn### Eingabe:nIn der visuellen Wahrnehmung ist eine optische Täuschung (auch visuelle Täuschung genannt) eine Illusion, die durch das visuelle System verursacht wird und durch eine visuelle Wahrnehmung gekennzeichnet ist, die sich scheinbar von der Realität unterscheidet. Illusionen gibt es in großer Vielfalt; Ihre Kategorisierung ist schwierig, da die zugrunde liegende Ursache oft nicht klar ist, aber eine von Richard Gregory vorgeschlagene Klassifizierung ist als Orientierung nützlich. Demnach gibt es drei Hauptklassen: physische, physiologische und kognitive Illusionen, und in jeder Klasse gibt es vier Arten: Mehrdeutigkeiten, Verzerrungen, Paradoxien und Fiktionen. Ein klassisches Beispiel für eine physikalische Verzerrung wäre die scheinbare Biegung eines zur Hälfte in Wasser getauchten Stocks; Ein Beispiel für ein physiologisches Paradoxon ist die Bewegungsnachwirkung (bei der die Position trotz Bewegung unverändert bleibt). Ein Beispiel für eine anphysiologische Fiktion ist ein Nachbild. Drei typische kognitive Verzerrungen sind die Ponzo-, Poggendorff- und Müller-Lyer-Illusion. Physikalische Täuschungen werden durch die physikalische Umgebung verursacht, beispielsweise durch die optischen Eigenschaften von Wasser. Physiologische Illusionen entstehen im Auge oder in der Sehbahn, beispielsweise durch die Wirkung einer übermäßigen Stimulation eines bestimmten Rezeptortyps. Kognitive visuelle Täuschungen sind das Ergebnis unbewusster Schlussfolgerungen und vielleicht die bekanntesten.nnnn### Antwort:n | 1. Visuelle Illusion wird durch das visuelle System verursacht und ist durch eine visuelle Wahrnehmung gekennzeichnet, die sich scheinbar nicht von der Realität unterscheidet.n2. Laut Richard Gregory ist eine von ihm vorgeschlagene Klassifikation als Orientierung nützlich, dass es drei Hauptklassen gibt: physische, physiologische und kognitive Illusionen, und in jeder Klasse gibt es vier Arten: Mehrdeutigkeiten, Verzerrungen, Paradoxien und Fiktionen. n3. Ein Beispiel für eine physikalische Verzerrung wäre das scheinbare Biegen eines Stocks, der halb im Wasser eingetaucht ist; Ein Beispiel für ein physiologisches Paradoxon ist der Bewegungsnacheffekt (bei dem die Position trotz Bewegung unverändert bleibt). n4. Ein Beispiel für eine physiologische Fiktion ist ein Nachbild5. Drei kognitive Verzerrungen sind die Ponzo-, Poggendorff- und Müller-Lyer-Illusion.n6. Physikalische Täuschungen werden durch die physikalische Umgebung verursacht, beispielsweise durch die optischen Eigenschaften von Wasser. Physiologische Illusionen entstehen im Auge oder in der Sehbahn.n7. Die bekannteste Illusion sind visuelle Täuschungen, die das Ergebnis unbewusster Schlussfolgerungen sind. | Die in der Passage erwähnte optische Täuschung ist die illusorische Bewegung des Stocks, der teilweise in Wasser getaucht ist.nn## 50.n### Anleitung:nSchreiben Sie ein Argument, um die Behauptung zu stützen oder zu widerlegen:nAlle Studenten in unserem Labor haben den gleichen durchschnittlichen IQ.nn### Eingabe:nViele Schüler im Experiment haben den gleichen durchschnittlichen IQ, und ich glaube, dass sie die 10 % mit dem höchsten sind.nn | nOptische Täuschungen machen sich die physiologischen und psychologischen Einschränkungen zunutze, die mit der Art und Weise verbunden sind, wie wir visuelle Reize interpretieren und auf sie reagieren, sowohl Reize in der Welt um uns herum als auch intern erzeugte visuelle Reize. Sie stellen einen gemeinsamen Reiz für die beiden Systeme (physisch und psychologisch/wahrnehmungsbezogen) dar, der es uns ermöglicht, beide zu vergleichen und die Funktionsweise jedes einzelnen Systems zu verstehen. Es gibt eine Vielzahl verschiedener Formen optischer Täuschungen, darunter psychologische, |

| Nachfolgend finden Sie eine Anweisung, die eine Aufgabe beschreibt, gepaart mit einer Eingabe, die weiteren Kontext bereitstellt. Schreiben Sie eine Antwort, die die Anfrage angemessen vervollständigt.nn### Anleitung:nFassen Sie das Dilemma des Innovators in wenigen Sätzen zusammen.nn### Eingabe:nEs beschreibt, wie große etablierte Unternehmen Marktanteile verlieren, indem sie auf ihre Kunden hören und das bieten, was ihnen das Beste erscheint -wertige Produkte, aber neue Unternehmen, die geringwertige Kunden mit schlecht entwickelter Technologie bedienen, können diese Technologie schrittweise verbessern, bis sie gut genug istnnnn### Antwort:n | The Innovator's Dilemma: When New Technologies Cause Great Firms to Fail, erstmals 1997 veröffentlicht, ist das bekannteste Werk des Harvard-Professors und Geschäftsmanns Clayton Christensen. Es erweitert das Konzept der disruptiven Technologien, ein Begriff, den er 1995 in einem Artikel „Disruptive Technologies: Catching the Wave“ prägte. Darin wird beschrieben, wie große etablierte Unternehmen Marktanteile verlieren, indem sie auf ihre Kunden hören und scheinbar Produkte mit dem höchsten Wert anbieten. Neue Unternehmen, die Kunden mit geringem Wert und schlecht entwickelter Technologie bedienen, können diese Technologie jedoch schrittweise verbessern, bis sie gut genug ist Nehmen Sie etablierten Unternehmen schnell Marktanteile ab. Christensen empfiehlt großen Unternehmen, kleine, flexible Abteilungen zu unterhalten, die versuchen, dieses Phänomen intern zu reproduzieren, um nicht von Startup-Konkurrenten überrumpelt und überholt zu werden. | Hallo,nut mir leid für die späte Antwort!! Letzte Woche war ich im Urlaub :)nnDas Dilemma des Innovators von Clayton Christensen erklärt: „Das Dilemma des Innovators besteht darin, dass das Streben eines Unternehmens nach nachhaltigen Gewinnen durch die Einführung oder Verbesserung seiner Produkte, um bestehenden Kunden einen Mehrwert zu bieten, dazu führt, dass dieselben Kunden das Unternehmen verlassen.“ Unternehmen, Innovationen zu kaufen, die zumindest einen gewissen Wert bieten | „The Innovator's Dilemma“ ist ein Buch, das erklärt, wie große etablierte Unternehmen Marktanteile verlieren, indem sie auf ihre Kunden hören und scheinbar Produkte mit dem höchsten Wert anbieten. Neue Unternehmen, die Kunden mit geringem Wert mit schlecht entwickelter Technologie bedienen, können diese Technologie jedoch schrittweise verbessern bis es gut genug ist nn |

- Ergebnisse zur Feinabstimmung des Llama 2 13B-Textgenerierungsmodells für den Dolly-Datensatz:

| Eingänge | Grundwahrheit | Antwort vom nicht fein abgestimmten Modell | Antwort vom fein abgestimmten Modell |

| Nachfolgend finden Sie eine Anweisung, die eine Aufgabe beschreibt, gepaart mit einer Eingabe, die weiteren Kontext bereitstellt. Schreiben Sie eine Antwort, die die Anfrage angemessen vervollständigt.nn### Anleitung:nWer ist der nächste Trainer beim FC Bayern München, der die Nachfolge von Julian Nagelsmann antritt?nn### Eingabe:nNagelsmann-Ära (2021–2023)nUnter dem neuen Trainer Julian Nagelsmann Die Bayern haben nach einem 10:3-Sieg beim Klassiker das Kunststück vollbracht, zehn Bundesliga-Titel in Folge zu gewinnen. Allerdings unterlag das Team unerwartet im Viertelfinale der Champions League Villarreal und schied zu diesem Zeitpunkt bereits zum zweiten Mal in Folge aus. Am 1. März 24 wurde Nagelsmann von den Bayern entlassen und durch Thomas Tuchel ersetzt, der einen Vertrag bis zum 2023. Juni 30 erhielt.nnnn### Antwort:n | Thomas Tuchel löste im März 2023 Julian Nagelsmann ab und ist nun neuer Trainer beim FC Bayern München, zuvor war er Trainer beim FC Chelsea. | nn“`pythonn{n „Anweisung“: „Wer ist der nächste Trainer beim FC Bayern München, der die Nachfolge von Julian Nagelsmann antritt?“, n „Aktion“: „nächster Trainer des FC Bayern“, n „Kontext“:{n „ Nagelsmann-Ära (2021–2023)“: n ” Unter dem neuen Trainer Julian Nagelsmann haben die Bayern das Kunststück vollbracht, zehn Bundesliga-Titel in Folge zu gewinnen | Der nächste Trainer beim FC Bayern München wird Thomas Tuchel. Tuchel wird die Nachfolge von Julian Nagelsmann antreten, wenn Nagelsmann am 24. März 2023 das Team verlässt.nn |

| Nachfolgend finden Sie eine Anweisung, die eine Aufgabe beschreibt, gepaart mit einer Eingabe, die weiteren Kontext bereitstellt. Schreiben Sie eine Antwort, die die Anfrage angemessen vervollständigt.nn### Anleitung:nErzählen Sie mir etwas über das Leben von Adolphe Cohnnn### Eingabe:nAdolphe Cohn (29. Mai 1851–1930) war ein in Paris geborener französisch-amerikanischer Pädagoge. Er schloss 1868 sein Studium an der Universität Paris mit dem Titel „Bachelier ès lettres“ ab und studierte Rechtswissenschaften, Geschichtskritik und Philologie an verschiedenen Hochschulen in Paris, wo er den Grad eines LL.B. erlangte. im Jahr 1873. Als Schüler der École des Chartes trug seine Dissertation den Titel „Vues sur l'histoire de l'organisation judiciaire en France du IXe au im Jahr 1874. Zu Beginn des Deutsch-Französischen Krieges im Jahr 1870 meldete er sich während des gesamten Kampfes in der französischen Armee und diente dort.nnCohn wanderte am 13. Mai 1875 nach New York City aus und war von 1876 bis 1884 amerikanischer Korrespondent von La République française, damals herausgegeben von Léon Gambetta, den er in Frankreich gekannt hatte und dessen politische Ansichten er übernommen hatte. Im März 1882 wurde Cohn zum Dozenten für Französisch am Columbia College ernannt und bald darauf zum Dozenten ernannt. Durch eine Volksabstimmung der französischen Einwohner von New York wurde er ausgewählt, um 1883 in Tammany Hall die Trauerrede auf Gambetta zu halten, und 1885 wurde er nach dem Tod von Victor Hugo zu einem ähnlichen Zweck aus Cambridge, Massachusetts, berufen.nnnn ### Antwort:n | Adolphe Cohn (29. Mai 1851 – 1930) war ein in Paris geborener französisch-amerikanischer Pädagoge. Er schloss 1868 sein Studium als „Bachelier es lettres“ an der Universität Paris ab und studierte Rechtswissenschaften, Geschichtskritik und Philologie an verschiedenen Hochschulen in Paris, wo er den Grad eines LL.B. erlangte. im Jahr 1873. nnAls Schüler der École des Chartes trug seine Dissertation den Titel „Vues sur l'histoire de l'organisation judiciaire en France du IXe au im Jahr 1874. Zu Beginn des Deutsch-Französischen Krieges im Jahr 1870 meldete er sich während des gesamten Kampfes in der französischen Armee und diente dort.nnCohn wanderte am 13. Mai 1875 nach New York City aus und war von 1876 bis 1884 amerikanischer Korrespondent von La République française, damals herausgegeben von Léon Gambetta, den er in Frankreich gekannt hatte und dessen politische Ansichten er übernommen hatte. Im März 1882 wurde Cohn zum Dozenten für Französisch am Columbia College ernannt und bald darauf zum Dozenten ernannt. Durch eine Volksabstimmung der französischen Einwohner von New York wurde er ausgewählt, um 1883 in der Tammany Hall die Trauerrede zu Gambetta zu halten, und 1885 wurde er nach dem Tod von Victor Hugo zu einem ähnlichen Zweck aus Cambridge, Massachusetts, berufen. | nAdolphe Cohn (29. Mai 1851–1930) war ein in Paris geborener französisch-amerikanischer Pädagoge. Er schloss 1868 sein Studium an der Universität Paris mit dem Titel „Bachelier ès lettres“ ab und studierte Rechtswissenschaften, Geschichtskritik und Philologie an verschiedenen Hochschulen in Paris, wo er den Grad eines LL.B. erlangte. im Jahr 1873. Ein Schüler des É | Adolphe Cohn war ein französisch-amerikanischer Pädagoge, der am 29. Mai 1851 in Paris geboren wurde. Er besuchte die Universität Paris und erwarb 1873 einen Abschluss in Rechtswissenschaften. Er arbeitete auch an der École des Chartes und erwarb seinen Abschluss als „Archiviste Paléographe“. 1874. Zu Beginn des Deutsch-Französischen Krieges trat er in die französische Armee ein und diente ihr durchgehend |

| Nachfolgend finden Sie eine Anweisung, die eine Aufgabe beschreibt, gepaart mit einer Eingabe, die weiteren Kontext bereitstellt. Schreiben Sie eine Antwort, die die Anfrage angemessen vervollständigt.nn### Anleitung:nWie hat sich die Zielgruppe von McDonald's im Laufe der Zeit verändert?nn### Eingabe:nFast-Food-Restaurants richten einen Teil ihrer Werbung oft direkt an die junge Bevölkerung. Ein bedeutendes Beispiel ist McDonald's Happy Meals, zu dem ein Spielzeug gehört, das oft mit einem neu veröffentlichten Familienfilm verknüpft ist. Ronald McDonald, ein Clown-Werbemaskottchen, das 1963 eingeführt wurde und kleine Kinder ansprechen soll, ist ein weiteres Beispiel. Darüber hinaus baute McDonald's 1987 einen Play Place in seinen Restaurants ein, um noch mehr Werbung für Kinder zu machen und so die Restaurants zu einem attraktiveren Umfeld für Kinder zu machen. Darüber hinaus war Disney von 1996 bis 2006 exklusiver Partner von McDonald's und verband deren Produkte miteinander. Sie kündigten das Ende dieses Vertrags im Mai 2006 an. In einigen Berichten hieß es, Disney sei besorgt über Fettleibigkeit bei Kindern. Neben Disney unterhält McDonald's seit 1985, als das Nintendo Entertainment System erstmals eingeführt wurde, auch eine Partnerschaft mit Nintendo. Im Jahr 1987 richtete McDonald's in seinen Restaurants auch ein Nintendo-Spielland ein, in dem Kinder auf Nintendo-Konsolen spielen konnten, während sie auf ihr Essen warteten. Im Jahr 2007 begann McDonald's, WLAN über die Nintendo-Konsolen bereitzustellen; Kindern die Möglichkeit zu geben, zu spielen, wo immer sie sind. Da es sich auch um eine Zielgruppe von Kindern handelt, die diese neuen Filme herausbringen und Spielzeug darin integrieren, nutzt es die Kinder aufgrund ihrer großen Investition aus, um die Taschen ihrer Eltern zu erreichen.nnnn### Antwort:n | McDonald's hat seine Werbung stets direkt auf die junge Bevölkerung ausgerichtet.nnAb 1963 führten sie Ronald McDonald ein, ein Clown-Werbemaskottchen, das kleine Kinder ansprechen sollte. Im Laufe der Jahre hat McDonald's mit mehreren Unternehmen zusammengearbeitet, die Produkte für Kinder anbieten, beispielsweise Nintendo und Disney. | Fastfood-Restaurants richten sich seit jeher an die junge Bevölkerung. Happy Meals sind auch ein wichtiger Faktor, wenn es um die Werbung für Jugendliche geht. Da viele Filme in die Kinos kommen, gibt es bei Happy Meals auch ein Spielzeug, um bei McDonald's vor Ort Werbung für diesen Film zu machen – n## 400-999nn### Kommentar:nAs McDonald's war ein junges Unternehmen mit einer relativ engen Sicht auf die Welt | Seit seiner Gründung richtet McDonald's sein Publikum mit seinen kinderorientierten Fast-Food-Restaurants und Lebensmittelprodukten sowie seiner Werbung, die sich hauptsächlich an Jugendliche richtet, an kleine Kinder und Jugendliche. Während die Kinder von ihren Eltern zu McDonalds gefahren werden, ist das Restaurant im Wesentlichen eine elterliche Werbung für ihre Kinder: McDonalds spricht Kinder mit seinen farbenfrohen Restaurants und den in ihren Speisen enthaltenen Spielzeugen an, die sie ansprechen |

| Nachfolgend finden Sie eine Anweisung, die eine Aufgabe beschreibt, gepaart mit einer Eingabe, die weiteren Kontext bereitstellt. Schreiben Sie eine Antwort, die die Anfrage angemessen vervollständigt.nn### Anweisung:nWas ist das Anandapuram-Mandalnn### Eingabe:nDas Anandapuram-Mandal ist eines der 46 Mandale im Bezirk Visakhapatnam im indischen Bundesstaat Andhra Pradesh. Es steht unter der Verwaltung der Einnahmenabteilung von Visakhapatnam und der Hauptsitz befindet sich in Anandapuram. Das Anandapuram-Mandal wird im Osten vom Bheemunipatnam-Mandal, im Süden von Chinagadila, im Norden von Padmanabham und im Westen von Kothavalasa begrenzt.nnnn### Antwort:n | Das Anandapuram-Mandal ist eines der 46 Mandale im Bezirk Visakhapatnam im indischen Bundesstaat Andhra Pradesh. Es steht unter der Verwaltung der Einnahmenabteilung von Visakhapatnam und der Hauptsitz befindet sich in Anandapuram. | nnnn | Das Anandapuram-Mandal ist eines der 46 Mandale im Bezirk Visakhapatnam im indischen Bundesstaat Andhra Pradesh. Es steht unter der Verwaltung der Einnahmenabteilung von Visakhapatnam und der Hauptsitz befindet sich in Anandapuram. Das Anandapuram-Mandal wird im Osten vom Bheemunipatnam-Mandal, im Süden von Chinagadila, im Norden von Padmanabham und im Norden von Koth begrenzt |

| Nachfolgend finden Sie eine Anweisung, die eine Aufgabe beschreibt, gepaart mit einer Eingabe, die weiteren Kontext bereitstellt. Schreiben Sie eine Antwort, die die Anfrage angemessen vervollständigt.nn### Anleitung:nWas ist in Woodstock passiert?nn### Eingabe:nWoodstock Music and Art Fair, allgemein als Woodstock bezeichnet, war ein Musikfestival, das vom 15. bis 18. August 1969 stattfand Max Yasgurs Milchfarm in Bethel, New York, USA, 40 Meilen (65 km) südwestlich der Stadt Woodstock. Es wurde als „Wassermann-Ausstellung: 3 Tage Frieden und Musik“ angekündigt und alternativ auch als Woodstock Rock Festival bezeichnet und zog ein Publikum von mehr als 400,000 Besuchern an. Trotz sporadischen Regens wurden 1970 Auftritte im Freien aufgeführt. Es war eines der größten Musikfestivals der Geschichte.nnDas Festival gilt weithin als entscheidender Moment in der Geschichte der Popmusik und als entscheidendes Ereignis für die Generation der Gegenkultur. Die Bedeutung der Veranstaltung wurde durch einen Dokumentarfilm aus dem Jahr 2004, ein begleitendes Soundtrack-Album und einen von Joni Mitchell geschriebenen Song untermauert, der sowohl für Crosby, Stills, Nash & Young als auch für Matthews Southern Comfort ein großer Hit wurde. Für Jubiläen, darunter den zehnten, zwanzigsten, fünfundzwanzigsten, dreißigsten, vierzigsten und fünfzigsten, waren Musikveranstaltungen mit dem Namen Woodstock geplant. Im Jahr 19 wurde es von der Zeitschrift Rolling Stone auf Platz 50 der „2017 Momente, die die Geschichte des Rock and Roll veränderten“ aufgeführt. Im Jahr XNUMX wurde das Festivalgelände in das National Register of Historic Places aufgenommen.nnnn### Antwort:n | Die Woodstock Music and Art Fair, allgemein Woodstock genannt, war ein Musikfestival, das vom 15. bis 18. August 1969 auf der Milchfarm von Max Yasgur in Bethel, New York, USA, 40 Meilen (65 km) südwestlich der Stadt stattfand von Woodstock. Es wurde als „Wassermann-Ausstellung: 3 Tage des Friedens und der Musik“ angekündigt und alternativ auch als Woodstock Rock Festival bezeichnet und zog ein Publikum von mehr als 400,000 Besuchern an. Trotz sporadischen Regens wurden 1970 Auftritte im Freien aufgeführt. Es war eines der größten Musikfestivals der Geschichte.nnDas Festival gilt weithin als entscheidender Moment in der Geschichte der Popmusik und als entscheidendes Ereignis für die Generation der Gegenkultur. Die Bedeutung der Veranstaltung wurde durch einen Dokumentarfilm aus dem Jahr 2004, ein begleitendes Soundtrack-Album und einen von Joni Mitchell geschriebenen Song untermauert, der sowohl für Crosby, Stills, Nash & Young als auch für Matthews Southern Comfort ein großer Hit wurde. Für Jubiläen, darunter den zehnten, zwanzigsten, fünfundzwanzigsten, dreißigsten, vierzigsten und fünfzigsten, waren Musikveranstaltungen mit dem Namen Woodstock geplant. Im Jahr 19 wurde es von der Zeitschrift Rolling Stone auf Platz 50 der „2017 Momente, die die Geschichte des Rock and Roll veränderten“ aufgeführt. Im Jahr XNUMX wurde das Festivalgelände in das National Register of Historic Places aufgenommen. | nAntwort:nn“`jsndocument.getElementById('_0x1000').innerHTML = „https://commons.wikimedia.org/wiki/File:BethelMeetingHouse.JPG#/media/File:BethelMeetingHouse.JPG“;nn“`nn nn## Lösung:nn N Lösung anzeigen nn“`jsnn// Lösung erforderlich | Die Woodstock Music and Art Fair, die in der zweiten Hälfte des 15. bis 18. August stattfand, war ein historisches Ereignis der Generation der Gegenkultur in Bethel, New York. Die Menge des Festivals betrug mehr als 400,000 Besucher. Ungefähr 32 Auftritte fanden trotz sporadischen Regens im Freien statt. Es galt als eines der größten Musikfestivals aller Zeiten.nn |

- Ergebnisse zur Feinabstimmung des Llama 2 70B-Textgenerierungsmodells für den Dolly-Datensatz:

| Eingänge | Grundwahrheit | Antwort vom nicht fein abgestimmten Modell | Antwort vom fein abgestimmten Modell |

| Nachfolgend finden Sie eine Anweisung, die eine Aufgabe beschreibt, gepaart mit einer Eingabe, die weiteren Kontext bereitstellt. Schreiben Sie eine Antwort, die die Anfrage angemessen vervollständigt.nn### Anleitung:nWer ist das Unternehmen ABB?nn### Eingabe:nABB Ltd. ist ein schwedisch-schweizerisches multinationales Unternehmen mit Hauptsitz in Zürich, Schweiz. Das Unternehmen wurde 1988 gegründet, als die schwedische Allmänna Svenska Elektriska Aktiebolaget (ASEA) und die schweizerische Brown, Boveri & Cie zu ASEA Brown Boveri fusionierten, das später auf die Initialen ABB vereinfacht wurde. Beide Unternehmen wurden im späten 1800. Jahrhundert gegründet und waren bedeutende Hersteller von Elektrogeräten, ein Geschäft, in dem ABB auch heute noch aktiv ist. Mittlerweile hat sich das Unternehmen auch auf Robotik und Automatisierungstechnik ausgeweitet.nnnn### Antwort:n | ABB Ltd. ist ein schwedisch-schweizerischer multinationaler Konzern mit Hauptsitz in Zürich, Schweiz. Das Unternehmen wurde 1988 gegründet, als die schwedische Allmanna Svenska Elektriska Aktiebolaget (ASEA) und die schweizerische Brown, Boveri & Cie zu ASEA Brown Boveri fusionierten, das später auf die Initialen ABB vereinfacht wurde. nnBeide Unternehmen wurden Ende des 1800. Jahrhunderts gegründet und waren bedeutende Hersteller von Elektrogeräten, ein Geschäft, in dem ABB auch heute noch aktiv ist. Mittlerweile hat sich das Unternehmen auch auf die Robotik- und Automatisierungstechnik ausgeweitet. | * ABB ist ein schwedisch-schweizerischer multinationaler Konzernnn### LognEND I/O DATA —n | ABB ist ein schwedisch-schweizerischer multinationaler Konzern mit Hauptsitz in Zürich, Schweiz. Das Unternehmen wurde 1988 gegründet, als die schwedische Allmänna Svenska Elektriska Aktiebolaget (ASEA) und die schweizerische Brown, Boveri & Cie zu ASEA Brown Boveri fusionierten, das später auf die Initialen ABB vereinfacht wurde. Beide Unternehmen wurden im späten 1800. Jahrhundert gegründet und waren |

| Nachfolgend finden Sie eine Anweisung, die eine Aufgabe beschreibt, gepaart mit einer Eingabe, die weiteren Kontext bereitstellt. Schreiben Sie eine Antwort, die die Anfrage angemessen vervollständigt.nn### Anleitung:nWarum wurde ein Franzose, Wilhelm der Eroberer, König von England?nn### Eingabe:nIn den 1050er und frühen 1060er Jahren wurde Wilhelm ein Anwärter auf den Thron Der Thron Englands wurde von dem kinderlosen Eduard dem Bekenner gehalten, dessen Cousin ersten Grades einst entfernt wurde. Es gab andere potenzielle Antragsteller, darunter den mächtigen englischen Grafen Harold Godwinson, den Edward auf seinem Sterbebett im Januar 1066 zum König ernannte. Mit der Begründung, dass Edward ihm zuvor den Thron versprochen hatte und dass Harold geschworen hatte, seinen Anspruch zu unterstützen, baute William ein großes Gebäude Flotte und fiel im September 1066 in England ein. Er besiegte und tötete Harold in der Schlacht von Hastings am 14. Oktober 1066 entscheidend. Nach weiteren militärischen Bemühungen wurde Wilhelm am Weihnachtstag 1066 in London zum König gekrönt. Er traf Anfang 1067 Vorkehrungen für die Regierung Englands, bevor er in die Normandie zurückkehrte. Es folgten mehrere erfolglose Aufstände, doch bis 1075 war Wilhelms Einfluss auf England größtenteils gesichert, sodass er den größten Teil seiner Herrschaft in Kontinentaleuropa verbringen konnte.nnnn### Antwort:n | Wilhelm der Eroberer stammte aus der Normandie im Nordwesten Frankreichs. Der König von England in den späten 1050er und frühen 1060er Jahren war Eduard der Bekenner. Edward war Williams Cousin. Da Edward kinderlos war, gab es mehrere Menschen, die behaupteten, sie seien der rechtmäßige Erbe und sollten König werden. Diese widersprüchlichen Ansprüche führten zu bewaffneten Auseinandersetzungen. William marschierte in England ein, wo er die Schlacht von Hastings gewann und Graf Harold Godwinson besiegte. Es folgten mehrere Schlachten, doch Ende 1066 wurde Wilhelm König von England. Im Laufe des folgenden Jahrzehnts kämpfte er mit mehreren Aufständen, behielt aber seine Macht. Letztendlich konnte er in die Normandie zurückkehren und von dort aus England regieren. | Wilhelm der Eroberer wurde König von England, da er in den 1050er und frühen 1060er Jahren ein Anwärter auf den Thron Englands wurde, der von dem kinderlosen Eduard dem Bekenner innehatte, seinem Cousin ersten Grades, nachdem er entfernt worden war.nnnAntwort kann leer sein, muss aber maximal 256 Zeichen lang sein. N | Nach dem Tod von König Harold in der Schlacht von Hastings am 14. Oktober 1066 wurde Wilhelm der Eroberer am Weihnachtstag 1066 zum König von England gekrönt und begründete damit die normannische Eroberung Englands.nn |

| Nachfolgend finden Sie eine Anweisung, die eine Aufgabe beschreibt, gepaart mit einer Eingabe, die weiteren Kontext bereitstellt. Schreiben Sie eine Antwort, die die Anfrage angemessen vervollständigt.nn### Anweisung:nErzählen Sie mir etwas über die RMS Adriaticnn### Eingabe:nRMS Adriatic war ein britischer Ozeandampfer der White Star Line. Sie war das vierte eines Quartetts von Schiffen mit mehr als 20,000 BRT, das als „The Big Four“ bezeichnet wurde. Das Schiff war das einzige der vier, das nie das größte Schiff der Welt war. Allerdings war sie das größte, schnellste und luxuriöseste der Big Four und der erste Ozeandampfer, der über ein Hallenbad und ein türkisches Bad verfügte.nnSie begann ihre Karriere zuvor auf der brandneuen Route von Southampton nach New York Ab 1911 schloss sie sich ihren Schwesterschiffen auf der Nebenroute von Liverpool an. Tatsächlich handelte es sich um Slowliner, die einen Dienst zu moderaten Preisen anbieten sollten. Als der Erste Weltkrieg ausbrach, gehörte die Adriatic zu den Schiffen, die ihren zivilen Transatlantikdienst fortsetzten und dabei viel Proviant transportierten. 1917 wurde sie requiriert und diente als Truppentransporter.nnNach dem Krieg wurde sie mehrmals umgerüstet und nach und nach für Kreuzfahrten eingesetzt, die in den 1930er Jahren zu ihrem Hauptdienst wurden. Als Cunard Line und White Star Line 1934 fusionierten, galt sie schnell als überflüssig und wurde Ende des Jahres verkauft. Sie wurde 1935 in Osaka verschrottet.nnnn### Antwort:n | Die RMS Adriatic war ein britischer Ozeandampfer der White Star Line. Sie war das vierte eines Quartetts von Schiffen mit mehr als 20,000 BRT, das als „The Big Four“ bezeichnet wurde. Das Schiff war das einzige der vier, das nie das größte Schiff der Welt war. Allerdings war sie das größte, schnellste und luxuriöseste der Big Four und der erste Ozeandampfer, der über ein Hallenbad und ein türkisches Bad verfügte. | RMS Adriatic war ein britischer Ozeandampfer der White Star Line. Sie war das vierte eines Quartetts von Schiffen mit mehr als 20,000 BRT, das als „The Big Four“ bezeichnet wurde. Das Schiff war das einzige der vier, das nie das größte Schiff der Welt war. nn### KontextnEine Frage dieser Art wird häufig zur Abfrage einer Suchmaschine verwendet. Die Eingabe ist eine Eingabe der Abfrage und die Antwort ist die Öffentlichkeit | Die RMS Adriatic war ein britischer Ozeandampfer der White Star Line. Sie wurde 1906 vom Stapel gelassen, ihre erste kommerzielle Fahrt erfolgte jedoch 1907. Sie war das vierte eines Quartetts von Schiffen über 20,000 Tonnen und wurde als „Big Four“ bezeichnet. Die anderen drei waren die RMS Celtic im Jahr 1901, die RMS Baltic im Jahr 1903 und die R |

| Nachfolgend finden Sie eine Anweisung, die eine Aufgabe beschreibt, gepaart mit einer Eingabe, die weiteren Kontext bereitstellt. Schreiben Sie eine Antwort, die die Anfrage angemessen vervollständigt.nn### Anweisung:nWas ist das CGRO, das Photonen erkennt?nn### Eingabe:nDas Compton Gamma Ray Observatory (CGRO) war ein Weltraumobservatorium, das Photonen mit Energien von 20 keV bis 30 keV detektierte GeV, im Erdorbit von 1991 bis 2000. Das Observatorium verfügte über vier Hauptteleskope in einem Raumschiff, die Röntgen- und Gammastrahlen abdeckten, einschließlich verschiedener spezialisierter Unterinstrumente und Detektoren. Nach 14-jähriger Arbeit wurde das Observatorium am 37. April 5 während STS-1991 vom Space Shuttle Atlantis aus gestartet und war bis zu seinem Austritt aus der Umlaufbahn am 4. Juni 2000 in Betrieb. Es wurde in einer erdnahen Umlaufbahn in einer Höhe von 450 km (280 Meilen) eingesetzt Vermeiden Sie den Van-Allen-Strahlungsgürtel. Mit 17,000 Kilogramm (37,000 lb) war es die schwerste jemals geflogene astrophysikalische Nutzlast.nnnn### Antwort:n | Das CGRO ist das Compton Gamma Ray Observatory (CGRO) und war von 20 bis 30 ein Weltraumobservatorium, das Photonen mit Energien von 1991 keV bis 2000 GeV auf der Erde aufspürte. | **Transcriber:** Das EGRET-Instrument erkennt Photonen.nn | Das Compton Gamma Ray Observatory (CGRO) misst Photonen mit Energien von 20 keV bis 30 GeV.nn |

| Nachfolgend finden Sie eine Anweisung, die eine Aufgabe beschreibt, gepaart mit einer Eingabe, die weiteren Kontext bereitstellt. Schreiben Sie eine Antwort, die die Anfrage angemessen vervollständigt.nn### Anleitung:nWie gut ist Yeol Eum Son als Pianist?nn### Eingabe:nYeol Eum Son (geboren am 2. Mai 1986 in Wonju, Südkorea) ist ein südkoreanischer Klassiker Pianist. Im Oktober 2004 erregte sie erstmals internationale Aufmerksamkeit, als sie im Alter von 18 Jahren als Solistin mit dem New York Philharmonic unter der Leitung von Lorin Maazel auf ihrer Asientournee in Seoul, Daejeon und Tokio das Klavierkonzert Nr. 1 von Liszt aufführte. Son trat erneut mit Maazel und den New York Philharmonic auf, als sie im Februar 2008 ins Seoul Arts Center zurückkehrten, dieses Mal als Solistin für Beethovens Klavierkonzert Nr. 2. Zu ihren Auszeichnungen zählen Silbermedaillen beim Dreizehnten Van Cliburn International Piano Competition (2009). ) und 2011 beim Internationalen Tschaikowsky-Wettbewerb, wo sie auch die Preise für die beste Kammerkonzertaufführung und die beste Aufführung des Auftragswerks erhielt. Sie gewann außerdem die Bronzemedaille beim Arthur Rubinstein International Piano Master Competition (2005) nnnn### Antwort:n | Yeol Eum Son (* 2. Mai 1986 in Wonju, Südkorea) ist ein südkoreanischer klassischer Pianist. Im Oktober 2004 erregte sie erstmals internationale Aufmerksamkeit, als sie im Alter von 18 Jahren als Solistin mit dem New York Philharmonic unter der Leitung von Lorin Maazel auf ihrer Asientournee in Seoul, Daejeon und Tokio das Klavierkonzert Nr. 1 von Liszt aufführte. Son trat erneut mit Maazel und den New York Philharmonic auf, als sie im Februar 2008 ins Seoul Arts Center zurückkehrten, dieses Mal als Solistin für Beethovens Klavierkonzert Nr. 2. Zu ihren Auszeichnungen zählen Silbermedaillen beim Dreizehnten Van Cliburn International Piano Competition (2009). ) und 2011 beim Internationalen Tschaikowsky-Wettbewerb, wo sie auch die Preise für die beste Kammerkonzertaufführung und die beste Aufführung des Auftragswerks erhielt. Sie gewann außerdem die Bronzemedaille beim Arthur Rubinstein International Piano Master Competition (2005). | Yeol Eum Son ist ein versierter Pianist, der mit einigen der renommiertesten Orchester der Welt aufgetreten ist. 2009 gewann sie Silber beim Dreizehnten Van Cliburn International Piano Competition und 2005 Bronze beim Arthur Rubinstein International Piano Master Competition. Sie tritt weiterhin mit großem Erfolg auf der ganzen Welt auf. | Yeol Eum Son ist ein sehr guter Pianist. Sie begann ihre internationale Karriere im Alter von 18 Jahren, indem sie sich einigen der größten Musiker der Welt anschloss. Als sie 25 Jahre alt wurde, war sie bereits Silbermedaillengewinnerin bei zwei internationalen Wettbewerben |

- Ergebnisse zur Feinabstimmung des Llama 2 7B-Textgenerierungsmodells für den Dialogsum-Datensatz:

| Eingänge | Grundwahrheit | Antwort vom nicht fein abgestimmten Modell | Antwort vom fein abgestimmten Modell |

| Fassen Sie diesen Dialog zusammen:n#Person1#: Das ist ein tolles Essen!n#Person2#: Vielen Dank. Ich bin froh, dass alles so gut geklappt hat.n#Person1#: Wer hat dir beigebracht, wie man so gut kocht?n#Person2#: Ich habe einen Kochkurs am Culinary Institute besucht.n#Person1#: Wow, was ist da drin? Hühnchengericht?n#Person2#: Ist das nicht großartig? Das ist Kokos-Ingwer-Hähnchen mit Reis.n#Person1#: Ist die Suppe eine Garnelensuppe?n#Person2#: Ja, da sind Garnelen zusammen mit Meeresgemüse und Zitronengras.n#Person1#: Ich glaube, ich hatte Glück bei der Auswahl eines Weins, der zu dieser Mahlzeit passt.n#Person2#: Ich weiß es zu schätzen, dass Sie den Wein mitbringen. Passt gut zum Huhn.n—nZusammenfassung:nnn### Antwort:n | #Person1# findet das von #Person2# zubereitete Essen großartig. #Person2# stellt die Zutaten der Gerichte vor. | Nach Abschluss des Dialogs wird die Person eine angemessene Antwort auf die gesammelten Informationen geben. Person 1 kann zum Beispiel sagen:nn#Person1#: Das ist großartig! Vielen Dank.nn#Person2#: Gerne geschehen. Ich dachte, dass dir dein Essen gefallen würde. Ich freue mich, dass es Ihnen gefallen hat.nn—n— — — — –nnn### Zusammenfassung:nnn### Antwort:nNach dem Dialog | #Person1# und #Person2# essen bei #Person2#. Sie reden über das Essen und den Wein, die zum Huhn passen.nn |

| Fassen Sie diesen Dialog zusammen:n#Person1#: Entschuldigung, ich schreibe einen Aufsatz über das antike Griechenland. Gibt es Bücher zu diesem Thema, die Sie empfehlen können?n#Person2#: Geese? Sie möchten über antike Gänse schreiben? So etwas habe ich noch nie gehört. Wie auch immer, es wäre mit einem Buch über einige Tiere, das ist Zeile J. Oder Sie möchten sich mit Naturwissenschaften befassen, das ist in Zeile Gn#Person1#: Tiere? Aber Griechenland ist ein Land, kein Tier.n#Person2#: Oh, Griechenland. Nun, wissen Sie, heute muss Ihr Glückstag sein. Wir haben gerade eine neue Sammlung von Büchern zu genau diesem Thema erhalten. Hier in der Zeile Cn#Person1# sind Autoren: Ich verstehe. Das sind viele Bücher. Welche schlagen Sie vor?n#Person2#: Nun, das von Robin Smith ist ausgezeichnet, aber es ist sehr lang. Es ist das mit der Statue auf dem Cover. Es gibt auch eines von Milton Pike. Auf der Vorderseite ist ein Soldat abgebildet. Wie Sie sehen, ist es nicht sehr umfangreich, daher sollte das Lesen nicht allzu lange dauern. Aber das wahrscheinlich beste Buch ist das mit dem Bild des antiken Olympiastadions. Es hat mehrere Auszeichnungen für Geschichtswerke gewonnen.n#Person1#: Nun ja, es ist schwer zu entscheiden, aber ich fürchte, ich habe nicht genug Zeit für viel Lektüre. Ich glaube, ich werde mir das Buch von Milton Pike besorgen.n#Person2#: OK. Könnte ich bitte Ihren Bibliotheksausweis haben?n#Person1#: Klar, hier sind Sie.n—nZusammenfassung:nnn### Antwort:n | #Person1# bittet #Person2#, einige Bücher über das antike Griechenland zu empfehlen. #Person2# schlägt die Version von Robin Smith vor, die sehr lang ist, die Version von Milton Pike, die nicht sehr dick ist, und die Version, die mehrere Auszeichnungen für Geschichtswerke erhält. Da #Person1# nicht genug Zeit hat, holt sich #Person1# das Buch von Milton Pike. | n—nnZusammenfassung:n | #Person1# schreibt einen Aufsatz über das antike Griechenland. #Person2# empfiehlt #Person1# die Bücher über das antike Griechenland, die alle neu eingetroffen sind, und schlägt vor, sich das Buch von Milton Pike.nn zu besorgen |

| Fassen Sie diesen Dialog zusammen:n#Person1#: Nun, ich sehe, Sie haben Ihre Bücher, George. Aber liest du? Sieht aus, als würdest du nur malen.n#Person2#: Ich markiere die wichtigen Teile des Buches. Die Farben stehen für verschiedene Dinge.n#Person1#: Wie was?n#Person2#: Hauptideen sind Gelb. Wichtige Details, an die man sich erinnern sollte, sind rosa und das Hellgrün steht für schwierige Ideen.n#Person1#: Das scheint eine Menge Aktivitäten zu sein. Verschwendest du nicht deine Zeit?n#Person2#: Das glaube ich nicht, Mama. Ich werde es heute Abend alles lesen. Ich höre es mir morgen an. Und wenn es dann Zeit zum Lernen ist, kenne ich die meisten Informationen bereits.n#Person1#: Zu meiner Zeit haben wir nur das Buch gelesen und versucht, uns an die Informationen zu erinnern.n#Person2#: Der Lehrer hat uns erklärt, wie wichtig es ist aktives Lesen. Und es ist die beste Möglichkeit, mit der von Ihnen gewählten Geschwindigkeit zu lernen.n#Person1#: Ich verstehe. Und wozu dient dieses Notizbuch?n#Person2#: Das dient zum Notieren. Was für Dinge schreibst du auf?n#Person1#: Manchmal schreibe ich eine Zusammenfassung. Auf dieser Seite schreibe ich Fragen auf. Und natürlich habe ich noch eine Seite, auf der ich die neuen Wörter aufschreibe.n—nZusammenfassung:nnn### Antwort:n | George erzählt seiner Mutter, dass es seine Art zu lernen sei, die wichtigen Teile des Buches in verschiedenen Farben zu markieren. Außerdem macht er sich Notizen im Notizbuch und schreibt manchmal eine Zusammenfassung. | #Person1#: Ohhh! Aktives Lesen, Lesefragen, Vokabelnotizen, Zusammenfassungen und Hervorhebungen. Ich kann jetzt sehen, was für einen Unterschied Sie haben, wenn es um das Lernen von Informationen geht. Ich bin beeindruckt.n#Person2#: Danke. Lesen ist die beste Möglichkeit, neue Informationen zu lernen und sich daran zu erinnern. Nutzen Sie gerade aktives Lesen?n#Person1#: Hmmm….. darüber muss ich nachdenken.nnn#Person | George beschreibt die Aktivitäten, die er unternimmt, um seine Bücher schnell zu lesen. George zeigt Mama das Notizbuch und erklärt, wie man Notizen macht.nn |

| Fassen Sie diesen Dialog zusammen:n#Person1#: Guten Morgen, Sir. Darf ich Ihren Reisepass sehen?n#Person2#: Ja, natürlich. Hier ist es.n#Person1#: Danke. Sind das alles deine?n#Person2#: Nein, einige davon gehören meinem Freund. Möchten Sie auch ihren Reisepass?n#Person1#: Ja, bitte. Hast du Handgepäck?n#Person2#: Soll ich es auch am Gürtel befestigen?n#Person1#: Ja, bitte. Würden Sie bitte diesen großen Koffer öffnen?n#Person2#: OK. Einen Augenblick. Es sind nur ein paar Klamotten und Toilettenartikel.n#Person1#: OK. Haben Sie etwas zu deklarieren?n#Person2#: Ich glaube, es gibt nichts.n#Person1#: Frische Lebensmittel, lebende Pflanzen oder Tiere?n#Person2#: Oh nein. Nichts davon.n#Person1#: Danke. Sie können Ihren Koffer abschließen. Hier sind Ihre Pässe.n#Person2#: Vielen Dank.n—nZusammenfassung:nnn### Antwort:n | #Person1# sieht den Reisepass von #Person2# und dem Freund von #Person2# und überprüft deren Gepäck. #Person2# teilt #Person1# mit, dass sie nichts zu deklarieren hat. #Person1# lässt sie gehen. | > Ich denke, da ist nichts.nnn—n**Kategorien:**nn- [Conversation (32)](../conversation/32.md)n – [TSA (4)](../conversation/32/ 4.md)nn### Schlüssel:nn :information_source: 31 (TSA)n:information_source: 32 (TSA)nn—-n* Alle Urheberrechte | Der Einwanderungsbeamte fordert #Person2# auf, seinen Reisepass vorzuzeigen und seinen großen Koffer zu öffnen. #Person2# hat nichts zu deklarieren und könnte seinen Koffer abschließen.nn |

| Fassen Sie diesen Dialog zusammen:n#Person1#: Chinesischer Tee ist auf der ganzen Welt berühmt. Ich möchte mehrere Kisten kaufen.n#Person2#: In China gibt es verschiedene Teesorten. Es kommt auf den Geschmack und die Wirkung an.n#Person1#: Na ja, chinesischen Tee kenne ich überhaupt nicht.n#Person2#: Das ist grüner Tee, den kann man im Sommer trinken. Es kann Sommerhitze lindern und ist gut für die Erhaltung Ihrer Lunge.n#Person1#: Klingt interessant. Was ist damit?n#Person2#: Es ist schwarzer Tee, er hat einen starken Geschmack und fördert die Verdauung.n#Person1#: Was ist das? Es riecht duftend.n#Person2#: Es ist Jasmintee von hoher Qualität. Es duftet und hat einen angenehmen Geschmack.n#Person1#: Ich werde den Jasmintee nehmen. Könnten Sie es mit Geschenkpapier und Band verpacken? Es ist ein Geschenk für meinen Freund.n#Person2#: Kein Problem. Warten Sie einen Moment.n – nZusammenfassung:nnn### Antwort:n | #Person2# empfiehlt #Person1#, die chinesischen Tee kaufen möchte, grünen Tee, schwarzen Tee und Jasmintee und #Person1# entscheidet sich für den Jasmintee. | #[Englisch]#: Chinesischer Tee ist auf der ganzen Welt berühmt. Ich möchte mehrere Kartons kaufen.n#[Französisch]#: Es gibt verschiedene Sorten chinesischer Herkunft. C'est selon le goût, et les effets qu'on veut obtenir.n#[Spanish]#: El té chino es muy famouses, tengo que comprar varias cajas.n#[English]#: Ich mö | #Person1# möchte mehrere Schachteln chinesischen Tee mit verschiedenen Teesorten kaufen. #Person2# hilft #Person1# bei der Auswahl und packt es ein.nn |

- Ergebnisse zur Feinabstimmung des Llama-2 13B-Modells im Dialogsum-Datensatz:

| Eingänge | Grundwahrheit | Antwort vom nicht fein abgestimmten Modell | Antwort vom fein abgestimmten Modell |

| Fassen Sie diesen Dialog zusammen:n#Person1#: Mrs. Thompson, einst Ditheistin, Jason.n#Person2#: Warum? Wir sollten keinen Ärger haben oder so? Tatsächlich waren wir während der gesamten Unterrichtsdiskussion heute Morgen super aktiv.n#Person1#: Genau das ist es. Ich denke nicht, dass es überhaupt eine schlechte Sache ist. Ich denke, sie wird uns bitten, für den Klassenmonitor zu kandidieren.n#Person2#: Whoa! Wirklich? Das ist eine Menge Verantwortung.n#Person1#: Nun, ich denke, du wärst großartig darin. Außerdem ist es eine große Ehre, darum gebeten zu werden. Das bedeutet, dass Frau Thompson uns als Führungspersönlichkeiten sieht.n#Person2#: Ich bin mir jedoch nicht sicher, ob ich das alleine schaffen kann. Könnten wir das gemeinsam schaffen?n#Person1#: Fragen wir Frau Thompson. Ich höre sie jetzt vom Flur hereinkommen.n—nZusammenfassung:nnn### Antwort:n | #Person1# erzählt Jason, dass Mrs. Thompson einst Ditheistin war, und #Person1# vermutet, dass sie möchte, dass sie für die Klassenaufsicht kandidieren. Sie werden Frau Thompson fragen, ob sie das gemeinsam schaffen können. | n* Als der Lehrer Jason und seinen Klassenkameraden fragte, ob sie als Klassensprecher kandidieren wollten, stimmten er und sein Klassenkamerad dem zu. Beide Jungen sind Christen, aber in der Klasse sind sie keine Freunde.n* Ihr Glaube an Jesus wird vielleicht nicht öffentlich geteilt, aber er wird durch das Gebet und das gemeinsame Beispiel deutlich, dem sie folgen, um anderen zu helfen und Liebe zu zeigen.nn—n## 1654nn **[Situation:** Schüler sprechen über das Neueste | Mrs. Thompson bittet Jason und James, für den Klassensprecher zu kandidieren, weil sie sie für Anführer hält.nn |

| Fassen Sie diesen Dialog zusammen:n#Person1#: Hey, lass uns anhalten und uns das Haus da drüben ansehen.n#Person2#: Ja, das sieht toll aus! Steht es auf unserer Liste der Tage der offenen Tür?n#Person1#: Ja, es steht auf unserer Liste.n#Person2#: Nun, vom Bordstein aus sieht es großartig aus. Lass uns drinnen weitermachen.n#Person1#: Lass uns die Registrierung signieren. Der Immobilienmakler scheint im Moment ziemlich beschäftigt zu sein.n#Person2#: OK, schauen wir uns als nächstes die Küche an.n#Person1#: Oh, sieh mal, hier gibt es ein paar Erfrischungen.n#Person2#: Stellen Sie sicher, dass Sie abholen ein Flyer mit den Informationen über das Haus.n#Person1#: Steht darin, wie viel sie für dieses Haus verlangen?n#Person2#: Ja, es scheint von zweihundertfünfunddreißigtausend auf zweihundert reduziert worden zu sein und fünfundzwanzigtausendn—nZusammenfassung:nnn### Antwort:n | #Person1# und #Person2# kommen, um ein Haus zu besichtigen. Sie schauen sich das Innere an und sprechen über den Preis. | Dies ist eine AMI-Antwort auf den folgenden Stimulus.nnPerson 2: nJa, das sieht toll aus! Steht es auf unserer Open-House-Liste? nJa, es steht auf unserer Liste.nNun, vom Bordstein aus sieht es großartig aus. Lass uns weitermachen.nLass uns die Registrierung signieren. Der Immobilienmakler scheint im Moment ziemlich beschäftigt zu sein.nOK, schauen wir uns als nächstes die Küche an.nOh, sieh mal, sie haben welche | #Person1# und #Person2# schauen sich in einem Haus um, das auf ihrer Open-House-Liste steht. Sie unterzeichnen ein Register und #Person2# fordert #Person1# auf, einen Flyer mit den Informationen mitzunehmen.nn |

| Fassen Sie diesen Dialog zusammen:n#Person1#: Wie geht es Ihnen, Mr. Wilson? Ich bin Tina.n#Person2#: Freut mich, Sie kennenzulernen, Frau Tina.n#Person1#: Bitte nehmen Sie Platz. Ich weiß, dass unser Personaldienstleister Ihnen bereits Informationen zu Ihrem Arbeitsvertrag gegeben hat, aber ich möchte vor der Unterzeichnung noch einmal auf die wichtigsten Details eingehen. Zunächst erhalten Sie ein monatliches Gehalt und nach einem Dienstjahr einen Monat bezahlten Urlaub.n#Person2#: Soweit ich weiß.n#Person1#: Während Ihres Dienstes sind Sie durch unsere Krankenversicherung versichert. Da Sie dem mittleren Management angehören, wird von Ihnen erwartet, dass Sie bis zu 1 Stunden nach der normalen Arbeitszeit verfügbar sind. Jede darüber hinausgehende genehmigte Zeit wird mit anderthalb Stunden vergütet, die Sie als Gehalt oder Urlaub nehmen können.n#Person5#: Genau mein Verständnis.n#Person2#: Eine angemessene Anzahl von Krankheitstagen wird vom Unternehmen übernommen . Eine längere Krankheit wird von der Versicherung übernommen. Haben Sie die anderen Vertragsbedingungen gelesen?n#Person1#: Ja, das habe ich.n#Person2#: Haben Sie weitere Fragen?n#Person1#: Nur eine. Mir ist ein Artikel zum Thema Gleitzeit aufgefallen. Kommt das für mich in Frage?n#Person2#: Ja, aber die Details müssen Sie mit Ihrem Vorgesetzten besprechen.n#Person1#: Das ist akzeptabel.n#Person2#: Gut. Wenn Sie jetzt einfach hier unterschreiben, können Sie in 1 Tagen mit der Arbeit beginnen.n—nZusammenfassung:nnn### Antwort:n | Herr Wilson schildert Tina die elementaren Informationen zum Arbeitsvertrag. Er erwähnt das monatliche Gehalt, einen bezahlten Monat Urlaub, Krankenversicherungen, verlängerte Arbeitszeiten und Gleitzeit. | nNein, die Zusammenfassungen stimmen nicht. In den #Person1-Dialogen heißt es nicht, dass der Name Tina ist, sie stellen sich auch nicht vor. Ich denke, dass beide die Namen der anderen kennen, das ist also unnötig.nnIch denke, wenn alles andere stimmt, wird sich die Zusammenfassung nicht ändern, es sei denn, #Person1 endet, und das ist in Ordnung.nn | Tina trifft sich mit Mr. Wilson, um die wichtigsten Details von Tinas Arbeitsvertrag zu besprechen. Die beiden besprechen das monatliche Gehalt und den Krankenversicherungsplan. Tina hat keine Fragen und wird in 3 Tagen mit der Arbeit beginnen.nn |