Amazon Sage Maker bietet eine breite Auswahl an Infrastruktur- und Modellbereitstellungsoptionen für maschinelles Lernen (ML), um Ihre ML-Inferenzanforderungen zu erfüllen. Es handelt sich um einen vollständig verwalteten Dienst, der sich in MLOps-Tools integrieren lässt, sodass Sie daran arbeiten können, Ihre Modellbereitstellung zu skalieren, Inferenzkosten zu senken, Modelle effektiver in der Produktion zu verwalten und den Betriebsaufwand zu reduzieren. SageMaker bietet mehrere Rückschlussmöglichkeiten So können Sie die Option auswählen, die am besten zu Ihrer Arbeitsbelastung passt.

Neue Generationen von CPUs bieten aufgrund spezialisierter integrierter Anweisungen eine erhebliche Leistungsverbesserung bei der ML-Inferenz. In diesem Beitrag konzentrieren wir uns darauf, wie Sie die Vorteile nutzen können AWS Graviton3-basierte Amazon Elastic Compute Cloud (EC2) C7g-Instanzen um die Inferenzkosten im Vergleich zu vergleichbaren EC50-Instances um bis zu 2 % zu reduzieren Echtzeit-Inferenz auf Amazon SageMaker. Wir zeigen, wie Sie die Inferenzleistung auswerten und Ihre ML-Workloads in wenigen Schritten auf AWS Graviton-Instanzen umstellen können.

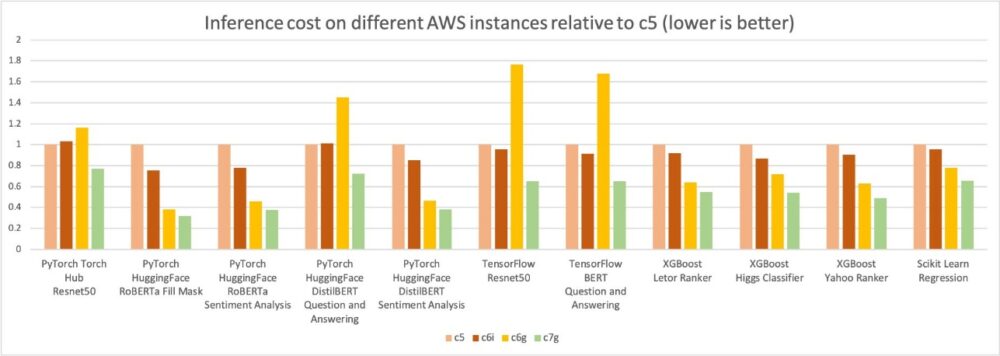

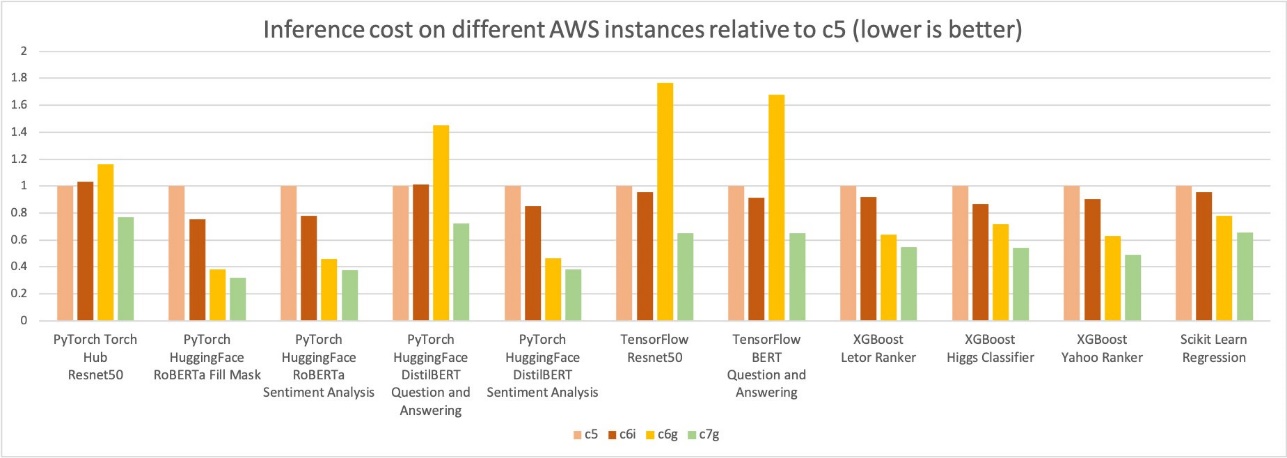

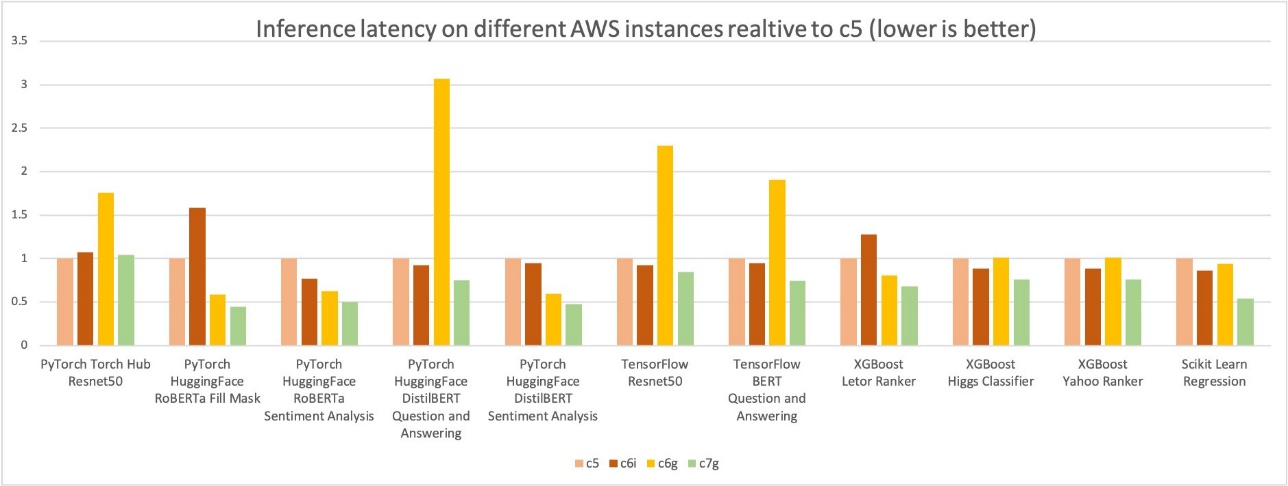

Um die beliebte und breite Palette von Kundenanwendungen abzudecken, diskutieren wir in diesem Beitrag die Inferenzleistung von PyTorch-, TensorFlow-, XGBoost- und scikit-learn-Frameworks. Wir decken Computer Vision (CV), Verarbeitung natürlicher Sprache (NLP), Klassifizierung und Ranking-Szenarien für Modelle und ml.c6g-, ml.c7g-, ml.c5- und ml.c6i-SageMaker-Instanzen für Benchmarking ab.

Benchmarking-Ergebnisse

AWS hat bis zu 50 % Kosteneinsparungen für PyTorch-, TensorFlow-, XGBoost- und scikit-learn-Modellinferenz mit AWS Graviton3-basierten EC2 C7g-Instances im Vergleich zu vergleichbaren EC2-Instances auf Amazon SageMaker gemessen. Gleichzeitig wird auch die Latenz der Inferenz reduziert.

Zum Vergleich haben wir vier verschiedene Instanztypen verwendet:

Alle vier Instanzen haben 16 vCPUs und 32 GiB Arbeitsspeicher.

In der folgenden Grafik haben wir die Kosten-pro-Million-Inferenz für die vier Instance-Typen gemessen. Wir haben die Inferenzergebnisse für Kosten pro Million weiter auf eine c5.4xlarge-Instanz normalisiert, die auf der Y-Achse des Diagramms als 1 gemessen wird. Sie können sehen, dass für die XGBoost-Modelle die Cost-per-Million-Inferenz für c7g.4xlarge (AWS Graviton3) etwa 50 % von c5.4xlarge und 40 % von c6i.4xlarge beträgt; Bei den PyTorch-NLP-Modellen betragen die Kosteneinsparungen etwa 30–50 % im Vergleich zu c5- und c6i.4xlarge-Instances. Bei anderen Modellen und Frameworks haben wir mindestens 30 % Kosteneinsparungen im Vergleich zu c5- und c6i.4xlarge-Instances gemessen.

Ähnlich wie im vorherigen Diagramm zum Vergleich der Inferenzkosten zeigt das folgende Diagramm die Modell-p90-Latenz für dieselben vier Instanztypen. Wir haben die Latenzergebnisse weiter auf die c5.4xlarge-Instanz normalisiert, die auf der Y-Achse des Diagramms als 1 gemessen wird. Die Inferenzlatenz des Modells c7g.4xlarge (AWS Graviton3) ist bis zu 50 % besser als die auf c5.4xlarge und c6i.4xlarge gemessenen Latenzen.

Migrieren Sie zu AWS Graviton-Instances

Um Ihre Modelle auf AWS Graviton-Instances bereitzustellen, können Sie entweder AWS Deep Learning Container (DLCs) bzw Bringen Sie Ihre eigenen Behälter mit die mit der ARMv8.2-Architektur kompatibel sind.

Die Migration (oder Neubereitstellung) Ihrer Modelle zu AWS Graviton-Instances ist unkompliziert, da AWS nicht nur Container zum Hosten von Modellen mit PyTorch, TensorFlow, scikit-learn und XGBoost bereitstellt, sondern die Modelle auch architektonisch unabhängig sind. Sie können auch Ihre eigenen Bibliotheken mitbringen, aber stellen Sie sicher, dass Ihr Container mit einer Umgebung erstellt wurde, die die ARMv8.2-Architektur unterstützt. Weitere Informationen finden Sie unter Erstellen Sie Ihren eigenen Algorithmus-Container.

Sie müssen drei Schritte ausführen, um Ihr Modell bereitzustellen:

- Erstellen Sie ein SageMaker-Modell. Diese enthält neben anderen Parametern die Informationen über den Speicherort der Modelldatei, den Container, der für die Bereitstellung verwendet wird, und den Speicherort des Inferenzskripts. (Wenn Sie bereits ein vorhandenes Modell in einer rechenoptimierten Inferenzinstanz bereitgestellt haben, können Sie diesen Schritt überspringen.)

- Erstellen Sie eine Endpunktkonfiguration. Diese enthält Informationen über den Instanztyp, den Sie für den Endpunkt wünschen (z. B. ml.c7g.xlarge für AWS Graviton3), den Namen des Modells, das Sie im vorherigen Schritt erstellt haben, und die Anzahl der Instanzen pro Endpunkt.

- Starten Sie den Endpunkt mit der im vorherigen Schritt erstellten Endpunktkonfiguration.

Detaillierte Anweisungen finden Sie unter Führen Sie Inferenz-Workloads für maschinelles Lernen auf AWS Graviton-basierten Instances mit Amazon SageMaker aus

Benchmarking-Methodik

Wir verwendeten Amazon SageMaker Inference Recommender Leistungsbenchmarking über verschiedene Instanzen hinweg zu automatisieren. Dieser Service vergleicht die Leistung Ihres ML-Modells in Bezug auf Latenz und Kosten auf verschiedenen Instanzen und empfiehlt die Instanz und Konfiguration, die die beste Leistung zu den niedrigsten Kosten bietet. Wir haben die oben genannten Leistungsdaten mit Inference Recommender gesammelt. Weitere Einzelheiten finden Sie unter GitHub Repo.

Sie können die Verwendung Beispiel Notizbuch um die Benchmarks auszuführen und die Ergebnisse zu reproduzieren. Wir haben die folgenden Modelle für das Benchmarking verwendet:

Zusammenfassung

AWS hat bis zu 50 % Kosteneinsparungen für PyTorch-, TensorFlow-, XGBoost- und scikit-learn-Modellinferenz mit AWS Graviton3-basierten EC2 C7g-Instances im Vergleich zu vergleichbaren EC2-Instances auf Amazon SageMaker gemessen. Sie können Ihre bestehenden Inferenz-Anwendungsfälle migrieren oder neue ML-Modelle auf AWS Graviton bereitstellen, indem Sie die Schritte in diesem Beitrag befolgen. Sie können sich auch auf die beziehen Technischer Leitfaden zu AWS Graviton, die eine Liste mit optimierten Bibliotheken und Best Practices enthält, die Ihnen dabei helfen, Kostenvorteile mit AWS Graviton-Instances über verschiedene Workloads hinweg zu erzielen.

Wenn Sie Anwendungsfälle finden, in denen ähnliche Leistungssteigerungen bei AWS Graviton nicht beobachtet werden, wenden Sie sich bitte an uns. Wir werden weitere Leistungsverbesserungen hinzufügen, um AWS Graviton zum kostengünstigsten und effizientesten Universalprozessor für ML-Inferenz zu machen.

Über die Autoren

Sunita Nadampalli ist Software Development Manager bei AWS. Sie leitet Graviton-Softwareleistungsoptimierungen für maschinelles Lernen, HPC und Multimedia-Workloads. Ihre Leidenschaft gilt der Open-Source-Entwicklung und der Bereitstellung kostengünstiger Softwarelösungen mit Arm-SoCs.

Sunita Nadampalli ist Software Development Manager bei AWS. Sie leitet Graviton-Softwareleistungsoptimierungen für maschinelles Lernen, HPC und Multimedia-Workloads. Ihre Leidenschaft gilt der Open-Source-Entwicklung und der Bereitstellung kostengünstiger Softwarelösungen mit Arm-SoCs.

Jaymin Desai ist Softwareentwicklungsingenieur im Amazon SageMaker Inference-Team. Er ist leidenschaftlich daran interessiert, KI in die Massen zu bringen und die Benutzerfreundlichkeit modernster KI-Assets zu verbessern, indem er sie in Funktionen und Dienste umwandelt. In seiner Freizeit erforscht er gerne Musik und reist.

Jaymin Desai ist Softwareentwicklungsingenieur im Amazon SageMaker Inference-Team. Er ist leidenschaftlich daran interessiert, KI in die Massen zu bringen und die Benutzerfreundlichkeit modernster KI-Assets zu verbessern, indem er sie in Funktionen und Dienste umwandelt. In seiner Freizeit erforscht er gerne Musik und reist.

Mike Schneider ist ein Systementwickler mit Sitz in Phoenix AZ. Er ist Mitglied von Deep-Learning-Containern und unterstützt verschiedene Framework-Container-Images, einschließlich Graviton Inference. Er widmet sich der Effizienz und Stabilität der Infrastruktur.

Mike Schneider ist ein Systementwickler mit Sitz in Phoenix AZ. Er ist Mitglied von Deep-Learning-Containern und unterstützt verschiedene Framework-Container-Images, einschließlich Graviton Inference. Er widmet sich der Effizienz und Stabilität der Infrastruktur.

Mohan Gandhi ist Senior Software Engineer bei AWS. Er ist seit 10 Jahren bei AWS und hat an verschiedenen AWS-Services wie EMR, EFA und RDS gearbeitet. Derzeit konzentriert er sich auf die Verbesserung der SageMaker Inference Experience. In seiner Freizeit geht er gerne wandern und Marathons.

Mohan Gandhi ist Senior Software Engineer bei AWS. Er ist seit 10 Jahren bei AWS und hat an verschiedenen AWS-Services wie EMR, EFA und RDS gearbeitet. Derzeit konzentriert er sich auf die Verbesserung der SageMaker Inference Experience. In seiner Freizeit geht er gerne wandern und Marathons.

Qingwei Li ist Spezialist für maschinelles Lernen bei Amazon Web Services. Er erhielt seinen Ph.D. in Operations Research, nachdem er das Konto seines Beraters für Forschungsstipendien aufgelöst und den versprochenen Nobelpreis nicht geliefert hatte. Derzeit hilft er Kunden in der Finanzdienstleistungs- und Versicherungsbranche beim Aufbau von Lösungen für maschinelles Lernen auf AWS. In seiner Freizeit liest und unterrichtet er gerne.

Qingwei Li ist Spezialist für maschinelles Lernen bei Amazon Web Services. Er erhielt seinen Ph.D. in Operations Research, nachdem er das Konto seines Beraters für Forschungsstipendien aufgelöst und den versprochenen Nobelpreis nicht geliefert hatte. Derzeit hilft er Kunden in der Finanzdienstleistungs- und Versicherungsbranche beim Aufbau von Lösungen für maschinelles Lernen auf AWS. In seiner Freizeit liest und unterrichtet er gerne.

Wayne Toh ist Specialist Solutions Architect für Graviton bei AWS. Er konzentriert sich darauf, Kunden bei der Einführung der ARM-Architektur für große Container-Workloads zu unterstützen. Bevor er zu AWS kam, arbeitete Wayne für mehrere große Softwareanbieter, darunter IBM und Red Hat.

Wayne Toh ist Specialist Solutions Architect für Graviton bei AWS. Er konzentriert sich darauf, Kunden bei der Einführung der ARM-Architektur für große Container-Workloads zu unterstützen. Bevor er zu AWS kam, arbeitete Wayne für mehrere große Softwareanbieter, darunter IBM und Red Hat.

Lauren Mullennex ist Lösungsarchitektin mit Sitz in Denver, CO. Sie arbeitet mit Kunden zusammen, um ihnen bei der Entwicklung von Lösungen auf AWS zu helfen. In ihrer Freizeit wandert sie gerne und kocht hawaiianische Küche.

Lauren Mullennex ist Lösungsarchitektin mit Sitz in Denver, CO. Sie arbeitet mit Kunden zusammen, um ihnen bei der Entwicklung von Lösungen auf AWS zu helfen. In ihrer Freizeit wandert sie gerne und kocht hawaiianische Küche.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoAiStream. Web3-Datenintelligenz. Wissen verstärkt. Hier zugreifen.

- Die Zukunft prägen mit Adryenn Ashley. Hier zugreifen.

- Kaufen und verkaufen Sie Anteile an PRE-IPO-Unternehmen mit PREIPO®. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/reduce-amazon-sagemaker-inference-cost-with-aws-graviton/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 10

- 100

- 7

- 98

- a

- LiveBuzz

- Konto

- Erreichen

- über

- hinzufügen

- adoptieren

- Vorteil

- Nach der

- AI

- Algorithmus

- bereits

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- unter

- an

- und

- Anwendungen

- Architektur

- SIND

- ARM

- AS

- Details

- At

- automatisieren

- AWS

- basierend

- BE

- weil

- war

- Benchmarking

- Benchmarks

- Vorteile

- BESTE

- Best Practices

- Besser

- bringen

- breit

- Pleite

- bauen

- erbaut

- eingebaut

- Last

- aber

- by

- CAN

- Fälle

- Chart

- Einstufung

- Cloud

- CO

- vergleichbar

- verglichen

- Vergleich

- kompatibel

- abschließen

- Berechnen

- Computer

- Computer Vision

- Konfiguration

- enthalten

- Container

- Behälter

- fortsetzen

- Kosten

- Einsparmaßnahmen

- kostengünstiger

- Kosten

- Abdeckung

- erstellt

- Zur Zeit

- Kunde

- Kunden

- technische Daten

- gewidmet

- tief

- tiefe Lernen

- Übergeben

- liefern

- Denver

- einsetzen

- Einsatz

- Einsatz

- detailliert

- Details

- Entwickler:in / Unternehmen

- Entwicklung

- anders

- diskutieren

- die

- zwei

- effektiv

- Effizienz

- effizient

- entweder

- Endpunkt

- Ingenieur

- Arbeitsumfeld

- bewerten

- Beispiel

- vorhandenen

- ERFAHRUNGEN

- Möglichkeiten sondieren

- Gescheitert

- Eigenschaften

- wenige

- Reichen Sie das

- Revolution

- Finanzdienstleistung

- Finden Sie

- Setzen Sie mit Achtsamkeit

- konzentriert

- konzentriert

- Folgende

- Aussichten für

- vier

- Unser Ansatz

- Gerüste

- Frei

- weiter

- Gewinne

- allgemeiner Zweck

- Generationen

- gibt

- gewähren

- Graph

- Hut

- Haben

- he

- Hilfe

- Unternehmen

- hilft

- hier (auf dänisch)

- seine

- Gastgeber

- Ultraschall

- hpc

- HTML

- HTTPS

- IBM

- if

- Bilder

- Verbesserung

- Verbesserungen

- Verbesserung

- in

- das

- Einschließlich

- Energiegewinnung

- Information

- Infrastruktur

- Instanz

- Anleitung

- Versicherung

- Integriert

- in

- Beitritt

- jpg

- nur

- Sprache

- grosse

- Nachname

- Latency

- umwandeln

- lernen

- am wenigsten

- Bibliotheken

- Gefällt mir

- Gleichen

- Liste

- Standorte

- niedrigste

- Maschine

- Maschinelles Lernen

- um

- verwalten

- Manager

- Massen

- Triff

- Mitglied

- Memory

- migriert

- Migration

- Million

- ML

- MLOps

- Modell

- für

- mehr

- vor allem warme

- Multimedia

- mehrere

- Musik

- Name

- Natürliche

- Verarbeitung natürlicher Sprache

- Need

- Bedürfnisse

- Neu

- Nlp

- nobel outlet

- Anzahl

- of

- bieten

- on

- einzige

- Open-Source-

- Betriebs-

- Einkauf & Prozesse

- optimiert

- Option

- Optionen

- or

- Auftrag

- Andere

- besitzen

- Parameter

- leidenschaftlich

- Leistung

- Phönix

- wählen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Bitte

- Beliebt

- Post

- Praktiken

- früher

- Vor

- Preis

- Verarbeitung

- Prozessor

- Produktion

- versprochen

- die

- vorausgesetzt

- bietet

- Pytorch

- Angebot

- Rangliste

- erreichen

- Lesebrillen

- Received

- empfiehlt

- Rot

- Red Hat

- Veteran

- Reduziert

- Forschungsprojekte

- Die Ergebnisse

- Führen Sie

- sagemaker

- SageMaker-Inferenz

- gleich

- Ersparnisse

- Skalieren

- Szenarien

- scikit-lernen

- sehen

- Auswahl

- Senior

- Lösungen

- mehrere

- sie

- erklären

- Konzerte

- signifikant

- ähnlich

- So

- Software

- Software-Entwicklung

- Software IngenieurIn

- Lösungen

- Spezialist

- spezialisiert

- Stabilität

- State-of-the-art

- Schritt

- Shritte

- einfach

- Unterstützung

- Unterstützt

- Schalter

- Systeme und Techniken

- Nehmen

- Einnahme

- Einführungen

- Team

- Technische

- Tensorfluss

- AGB

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- die Informationen

- Sie

- fehlen uns die Worte.

- nach drei

- Zeit

- zu

- Werkzeuge

- Reise

- tippe

- Typen

- us

- Nutzbarkeit

- -

- benutzt

- Verwendung von

- verschiedene

- Anbieter

- Seh-

- wollen

- we

- Netz

- Web-Services

- GUT

- welche

- werden wir

- mit

- Arbeiten

- gearbeitet

- Werk

- XGBoost

- Jahr

- Du

- Ihr

- Zephyrnet