Amazon SageMaker Feature Store bietet eine End-to-End-Lösung zur Automatisierung des Feature-Engineerings für maschinelles Lernen (ML). Für viele ML-Anwendungsfälle müssen Rohdaten wie Protokolldateien, Sensormesswerte oder Transaktionsaufzeichnungen in aussagekräftige Funktionen umgewandelt werden, die für das Modelltraining optimiert sind.

Die Merkmalsqualität ist entscheidend, um ein hochpräzises ML-Modell sicherzustellen. Die Umwandlung von Rohdaten in Features mithilfe von Aggregation, Codierung, Normalisierung und anderen Vorgängen ist häufig erforderlich und kann einen erheblichen Aufwand erfordern. Ingenieure müssen für jeden Anwendungsfall manuell eine benutzerdefinierte Datenvorverarbeitungs- und Aggregationslogik in Python oder Spark schreiben.

Dieses undifferenzierte schwere Heben ist umständlich, eintönig und fehleranfällig. Der SageMaker Feature Store Feature-Prozessor reduziert diese Belastung, indem Rohdaten automatisch in aggregierte Funktionen umgewandelt werden, die für das Batch-Training von ML-Modellen geeignet sind. Ingenieure können damit einfache Datentransformationsfunktionen bereitstellen, diese dann in großem Maßstab auf Spark ausführen und die zugrunde liegende Infrastruktur verwalten. Dies ermöglicht es Datenwissenschaftlern und Dateningenieuren, sich auf die Feature-Engineering-Logik statt auf Implementierungsdetails zu konzentrieren.

In diesem Beitrag zeigen wir, wie ein Autoverkaufsunternehmen den Feature Processor nutzen kann, um rohe Verkaufstransaktionsdaten in drei Schritten in Features umzuwandeln:

- Lokale Ausführungen von Datentransformationen.

- Remote-Ausführung im großen Maßstab mit Spark.

- Operationalisierung über Pipelines.

Wir zeigen, wie SageMaker Feature Store die Rohdaten aufnimmt, Feature-Transformationen remote mit Spark ausführt und die resultierenden aggregierten Features in einen lädt Feature-Gruppe. Diese entwickelten Funktionen können dann zum Trainieren von ML-Modellen verwendet werden.

In diesem Anwendungsfall sehen wir, wie SageMaker Feature Store dabei hilft, die rohen Autoverkaufsdaten in strukturierte Features umzuwandeln. Diese Funktionen werden anschließend verwendet, um Erkenntnisse zu gewinnen wie:

- Durchschnitts- und Höchstpreis roter Cabrios aus dem Jahr 2010

- Modelle mit der besten Laufleistung im Vergleich zum Preis

- Verkaufstrends von Neu- und Gebrauchtwagen im Laufe der Jahre

- Unterschiede im durchschnittlichen UVP zwischen den Standorten

Wir sehen auch, wie die SageMaker Feature Store-Pipelines die Funktionen auf dem neuesten Stand halten, wenn neue Daten eingehen, sodass das Unternehmen im Laufe der Zeit kontinuierlich Erkenntnisse gewinnen kann.

Lösungsüberblick

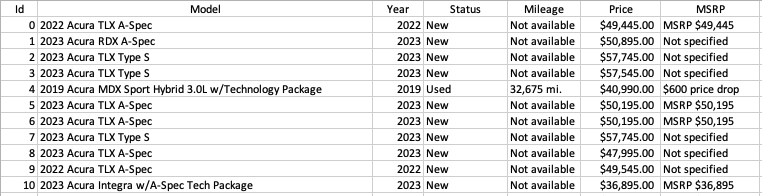

Wir arbeiten mit dem Datensatz car_data.csv, das Spezifikationen wie Modell, Jahr, Status, Kilometerstand, Preis und UVP für vom Unternehmen verkaufte Gebraucht- und Neuwagen enthält. Der folgende Screenshot zeigt ein Beispiel des Datensatzes.

Das Lösungsnotizbuch feature_processor.ipynb enthält die folgenden Hauptschritte, die wir in diesem Beitrag erklären:

- Erstellen Sie zwei Funktionsgruppen: eine namens

car-datafür rohe Autoverkaufsaufzeichnungen und ein anderer rief ancar-data-aggregatedfür aggregierte Autoverkaufsaufzeichnungen. - Verwenden Sie das

@feature_processorDecorator zum Laden von Daten in die Car-Data-Feature-Gruppe Amazon Simple Storage-Service (Amazon S3). - Führen Sie die

@feature_processor coderemote als Spark-Anwendung zur Aggregation der Daten. - Operationalisieren Sie den Feature-Prozessor über SageMaker-Pipelines und Planläufe.

- Entdecken Sie die Feature-Verarbeitungspipelines und Abstammung in Amazon SageMaker-Studio.

- Verwenden Sie aggregierte Funktionen, um ein ML-Modell zu trainieren.

Voraussetzungen:

Um diesem Tutorial folgen zu können, benötigen Sie Folgendes:

Für diesen Beitrag verweisen wir auf Folgendes Notizbuch, das zeigt, wie Sie mit dem SageMaker Python SDK mit Feature Processor beginnen.

Erstellen Sie Funktionsgruppen

Führen Sie die folgenden Schritte aus, um die Funktionsgruppen zu erstellen:

- Erstellen Sie eine Featuregruppendefinition für

car-datawie folgt:

Die Merkmale entsprechen jeder Spalte in der car_data.csv Datensatz (Model, Year, Status, Mileage, Price und MSRP).

- Fügen Sie die Datensatzkennung hinzu

idund Veranstaltungszeitingest_timezur Funktionsgruppe:

- Erstellen Sie eine Featuregruppendefinition für

car-data-aggregatedwie folgt:

Für die aggregierte Funktionsgruppe sind die Funktionen Modelljahresstatus, durchschnittlicher Kilometerstand, maximaler Kilometerstand, Durchschnittspreis, Höchstpreis, durchschnittlicher UVP, maximaler UVP und Aufnahmezeit. Wir fügen die Datensatzkennung hinzu model_year_status und Veranstaltungszeit ingest_time zu dieser Funktionsgruppe.

- Erstellen Sie nun die

car-dataMerkmalsgruppe:

- erstellen Sie

car-data-aggregatedMerkmalsgruppe:

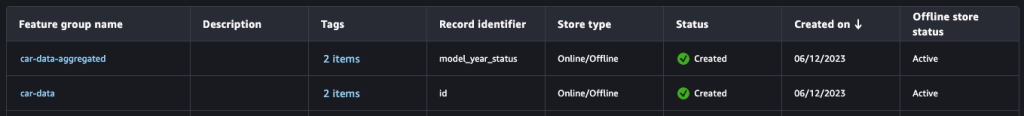

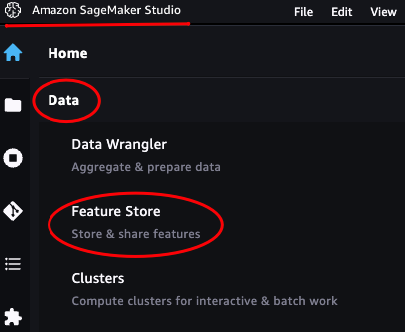

Sie können unten zur Option „SageMaker Feature Store“ navigieren Daten-Management auf dem SageMaker Studio Startseite Menü, um die Funktionsgruppen anzuzeigen.

Verwenden Sie den @feature_processor-Dekorator, um Daten zu laden

In diesem Abschnitt transformieren wir die rohen Eingabedaten lokal (car_data.csv) von Amazon S3 in die car-data Feature-Gruppe mit dem Feature Store Feature Processor. Dieser erste lokale Lauf ermöglicht uns die Entwicklung und Iteration vor der Remote-Ausführung und kann bei Bedarf anhand einer Stichprobe der Daten durchgeführt werden, um eine schnellere Iteration zu ermöglichen.

Mit der @feature_processor decorator ausgeführt wird, wird Ihre Transformationsfunktion in einer Spark-Laufzeitumgebung ausgeführt, in der die für Ihre Funktion bereitgestellten Eingabeargumente und ihr Rückgabewert Spark-DataFrames sind.

- Installieren Sie das Feature-Prozessor-SDK von dem SageMaker Python-SDK und seine Extras mit dem folgenden Befehl:

Die Anzahl der Eingabeparameter in Ihrer Transformationsfunktion muss mit der Anzahl der in der konfigurierten Eingaben übereinstimmen @feature_processor Dekorateur. In diesem Fall ist die @feature_processor Dekorateur hat car-data.csv als Eingabe und die car-data Feature-Gruppe als Ausgabe, was darauf hinweist, dass es sich um einen Batch-Vorgang mit dem handelt target_store as OfflineStore:

- Definiere das

transform()Funktion zur Transformation der Daten. Diese Funktion führt die folgenden Aktionen aus:- Spaltennamen in Kleinbuchstaben umwandeln.

- Fügen Sie die Ereigniszeit hinzu

ingest_timeSpalte. - Entfernen Sie Satzzeichen und ersetzen Sie fehlende Werte durch NA.

- Ruf den

transform()Funktion zum Speichern der Daten imcar-dataMerkmalsgruppe:

Die Ausgabe zeigt, dass die Daten erfolgreich in die Funktionsgruppe „car-data“ aufgenommen wurden.

Die Ausgabe der transform_df.show() Funktion ist wie folgt:

Wir haben die Eingabedaten erfolgreich transformiert und in die aufgenommen car-data Feature-Gruppe.

Führen Sie den @feature_processor-Code remote aus

In diesem Abschnitt demonstrieren wir die Remoteausführung des Feature-Verarbeitungscodes als Spark-Anwendung mithilfe von @remote zuvor beschriebener Dekorateur. Wir führen die Feature-Verarbeitung remote mit Spark aus, um sie auf große Datensätze zu skalieren. Spark bietet verteilte Verarbeitung auf Clustern, um Daten zu verarbeiten, die für einen einzelnen Computer zu groß sind. Der @remote decorator führt den lokalen Python-Code als SageMaker-Trainingsjob mit einem oder mehreren Knoten aus.

- Verwenden Sie das

@remoteDekorateur zusammen mit dem@feature_processorDekorateur wie folgt:

Das spark_config Der Parameter gibt an, dass dies als ausgeführt wird Spark application. Die SparkConfig-Instanz konfiguriert die Spark-Konfiguration und -Abhängigkeiten.

- Definiere das

aggregate()Funktion zum Aggregieren der Daten mithilfe von PySpark SQL und benutzerdefinierten Funktionen (UDFs). Diese Funktion führt die folgenden Aktionen aus:- Verketten

model,yearundstatuserschaffenmodel_year_status. - Nehmen Sie den Durchschnitt von

priceerschaffenavg_price. - Nehmen Sie den Maximalwert von

priceerschaffenmax_price. - Nehmen Sie den Durchschnitt von

mileageerschaffenavg_mileage. - Nehmen Sie den Maximalwert von

mileageerschaffenmax_mileage. - Nehmen Sie den Durchschnitt von

msrperschaffenavg_msrp. - Nehmen Sie den Maximalwert von

msrperschaffenmax_msrp. - Gruppiere nach

model_year_status.

- Verketten

- Führen Sie die

aggregate()Funktion, die einen SageMaker-Trainingsjob zum Ausführen der Spark-Anwendung erstellt:

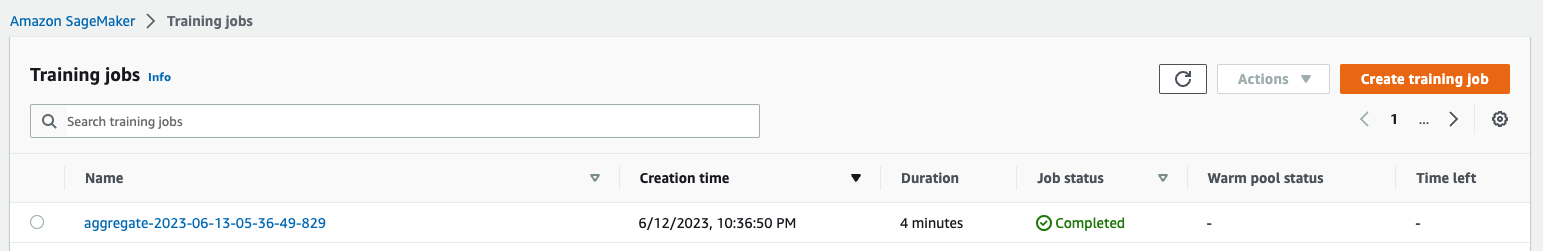

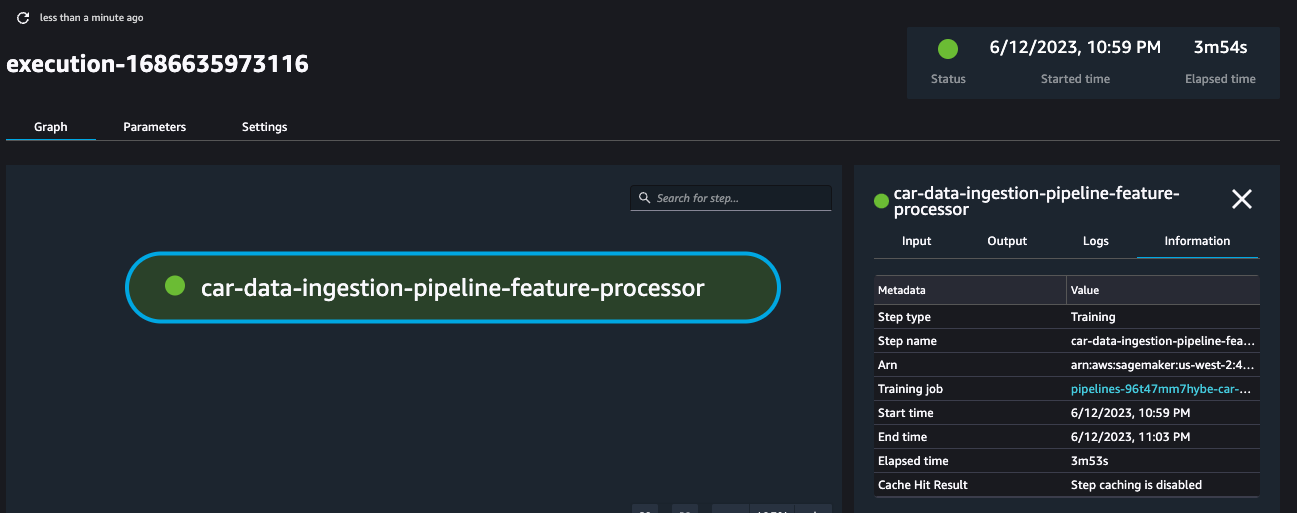

Als Ergebnis erstellt SageMaker einen Trainingsjob für die zuvor definierte Spark-Anwendung. Es wird eine Spark-Laufzeitumgebung mit erstellt sagemaker-spark-processing image.

Wir verwenden hier SageMaker Training-Jobs, um unsere Spark-Funktionsverarbeitungsanwendung auszuführen. Mit SageMaker Training können Sie die Startzeiten auf 1 Minute oder weniger reduzieren, indem Sie Warmpooling verwenden, das in SageMaker Processing nicht verfügbar ist. Dadurch ist SageMaker Training besser für kurze Batch-Jobs wie die Funktionsverarbeitung optimiert, bei denen die Startzeit wichtig ist.

- Um die Details anzuzeigen, wählen Sie in der SageMaker-Konsole Ausbildungsjobs für Ausbildung Wählen Sie im Navigationsbereich den Job mit dem Namen aus

aggregate-<timestamp>.

Die Ausgabe der Aggregat() Funktion generiert Telemetriecode. In der Ausgabe sehen Sie die aggregierten Daten wie folgt:

Wenn der Trainingsauftrag abgeschlossen ist, sollten Sie die folgende Ausgabe sehen:

Operationalisieren Sie den Feature-Prozessor über SageMaker-Pipelines

In diesem Abschnitt zeigen wir, wie Sie den Feature-Prozessor operationell machen, indem Sie ihn in eine SageMaker-Pipeline hochstufen und Ausführungen planen.

- Laden Sie zunächst die Datei hoch transformation_code.py Datei mit der Funktionsverarbeitungslogik für Amazon S3:

- Erstellen Sie als Nächstes eine Feature-Prozessor-Pipeline car_data_pipeline Verwendung der .to_pipeline() Funktion:

- Verwenden Sie zum Ausführen der Pipeline den folgenden Code:

- Auf ähnliche Weise können Sie eine Pipeline für aggregierte Features mit dem Namen erstellen

car_data_aggregated_pipelineund einen Lauf starten. - Planen Sie die

car_data_aggregated_pipelinealle 24 Stunden ausführen:

Im Ausgabeabschnitt sehen Sie den ARN der Pipeline und die Pipeline-Ausführungsrolle sowie die Zeitplandetails:

- Um alle Feature-Prozessor-Pipelines in diesem Konto abzurufen, verwenden Sie die

list_pipelines()Funktion auf dem Feature-Prozessor:

Die Ausgabe wird wie folgt sein:

Wir haben erfolgreich SageMaker Feature Processor-Pipelines erstellt.

Entdecken Sie Feature-Processing-Pipelines und ML-Herkunft

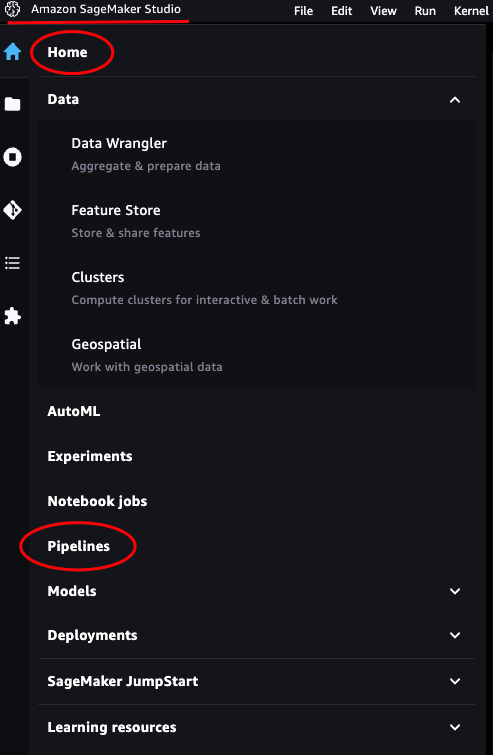

Führen Sie in SageMaker Studio die folgenden Schritte aus:

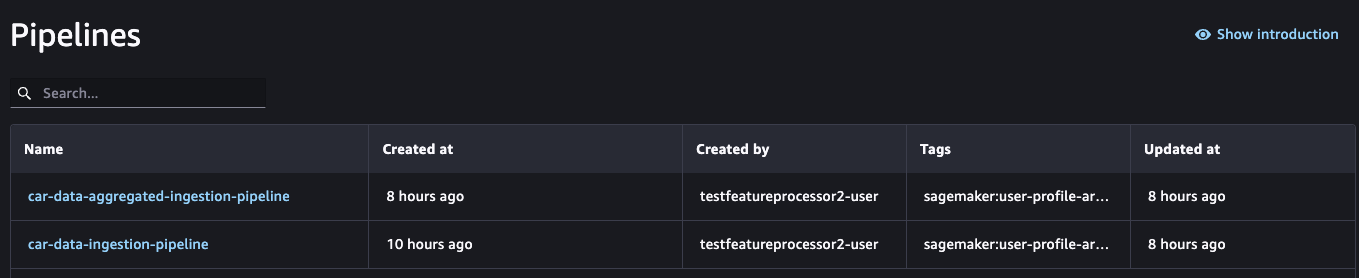

- Auf der SageMaker Studio-Konsole auf der Startseite Menü, wählen Sie Pipelines.

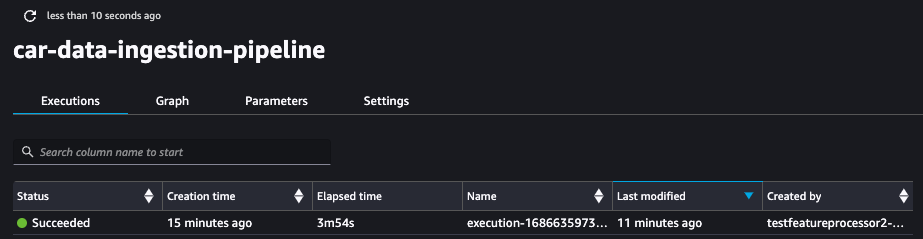

Es sollten zwei erstellte Pipelines angezeigt werden: car-data-ingestion-pipeline und car-data-aggregated-ingestion-pipeline.

- Wähle die

car-data-ingestion-pipeline.

Es zeigt die Laufdetails auf dem Hinrichtungen Tab.

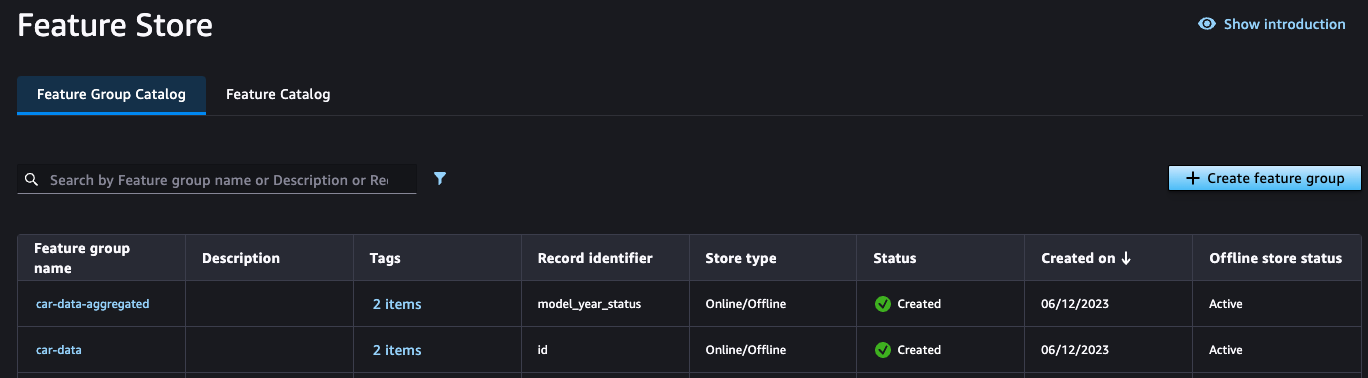

- Um die von der Pipeline gefüllte Funktionsgruppe anzuzeigen, wählen Sie Feature-Store für Daten-Management und wählen Sie

car-data.

Sie sehen die beiden Funktionsgruppen, die wir in den vorherigen Schritten erstellt haben.

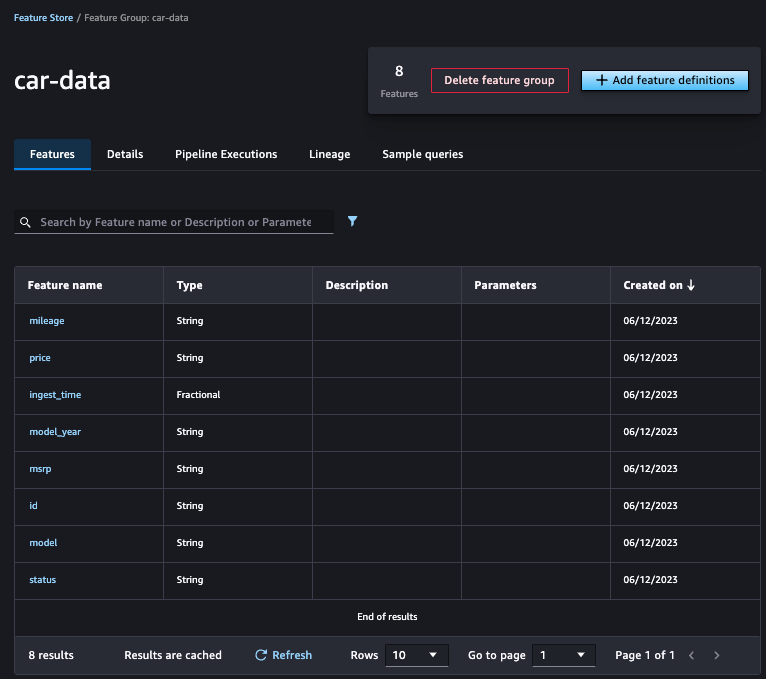

- Wähle die

car-dataFeature-Gruppe.

Die Funktionsdetails finden Sie auf der Eigenschaften Tab.

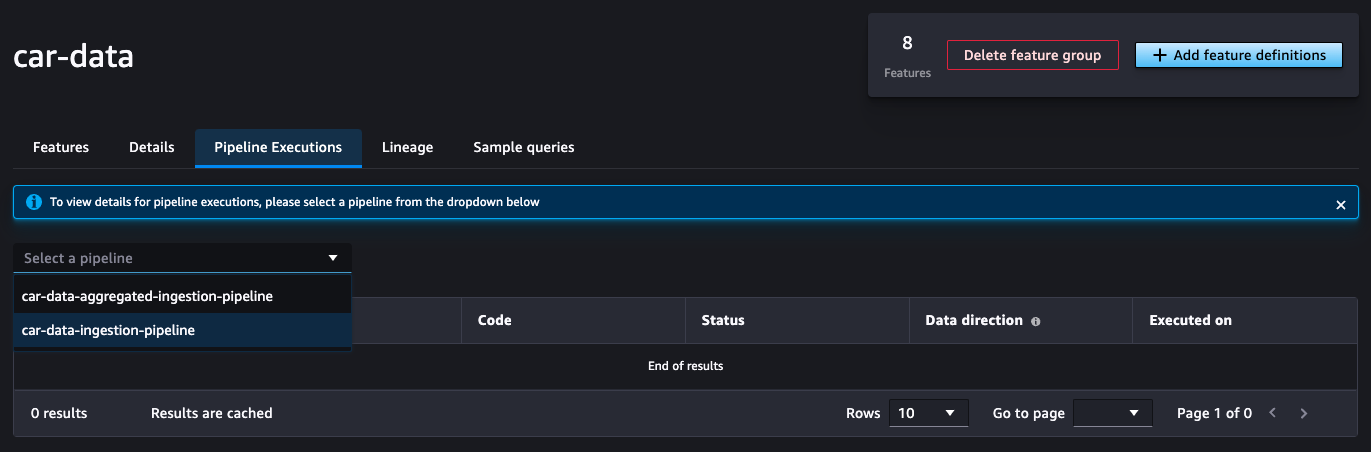

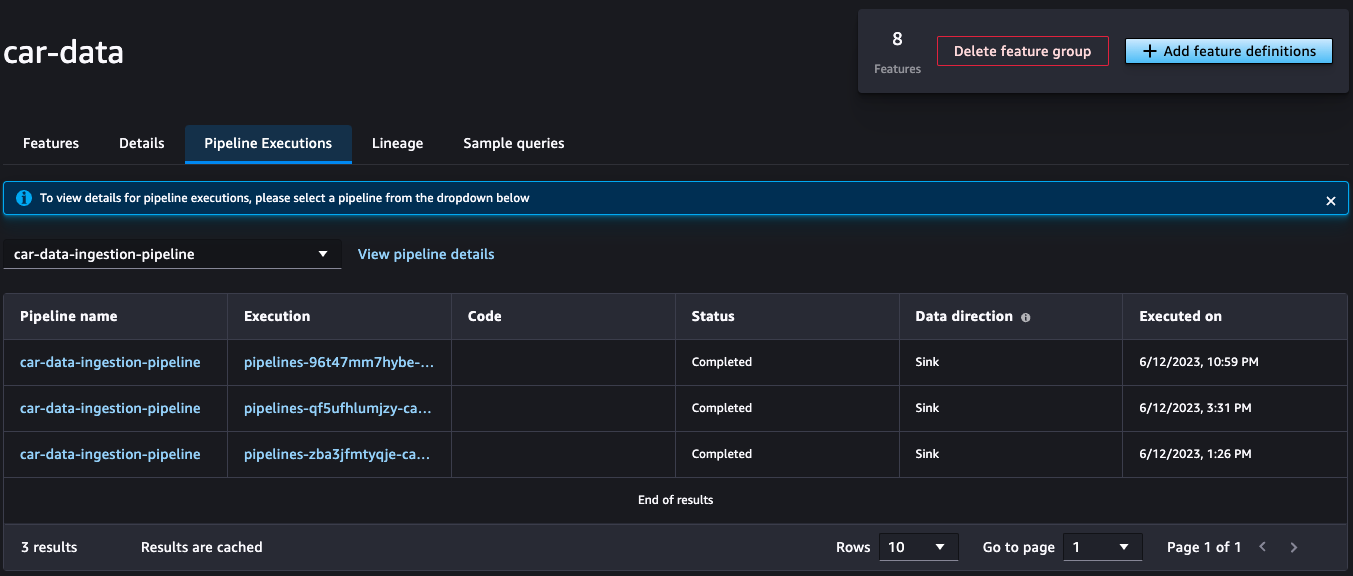

Pipeline-Ausführungen anzeigen

Führen Sie die folgenden Schritte aus, um die Pipeline-Ausführungen anzuzeigen:

- Auf dem Pipeline-Ausführungs-Registerkarte, wählen Sie

car-data-ingestion-pipeline.

Dadurch werden alle Läufe angezeigt.

- Wählen Sie einen der Links, um die Details des Laufs anzuzeigen.

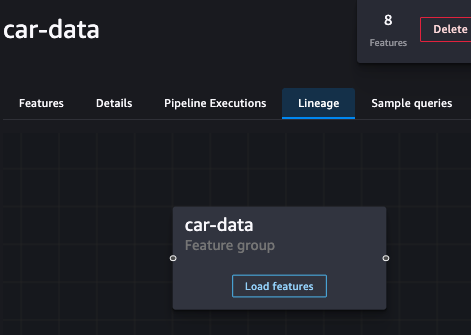

- Um die Herkunft anzuzeigen, wählen Sie „Herkunft“.

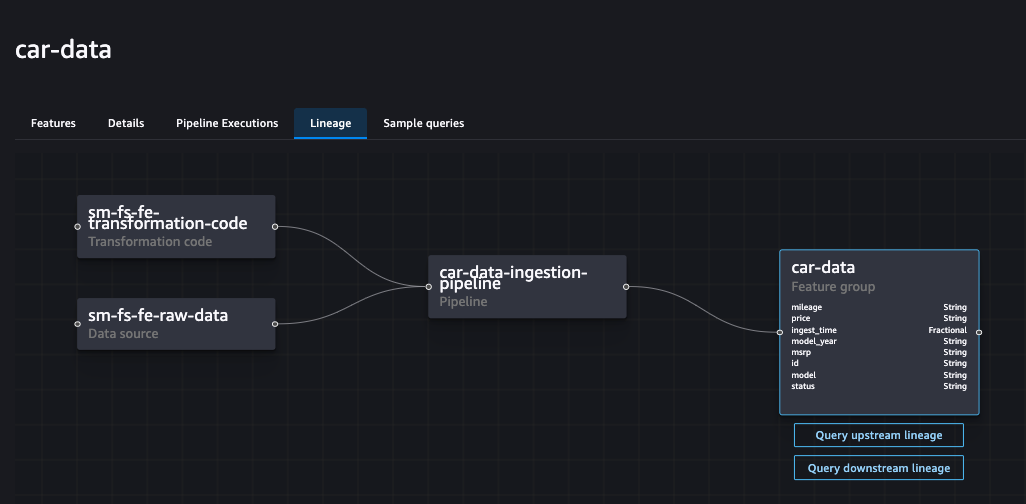

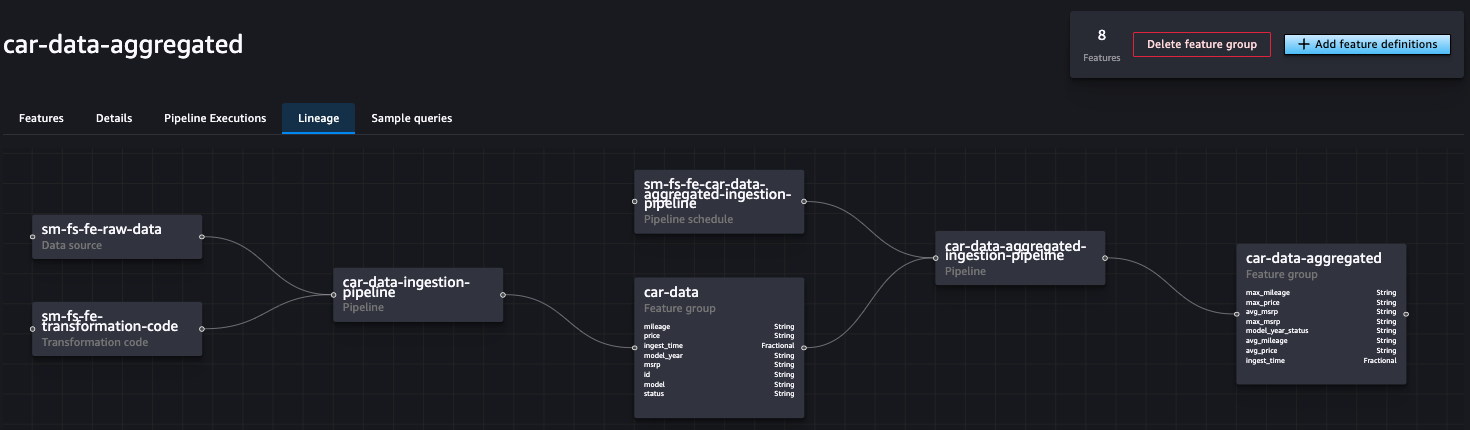

Die vollständige Abstammungslinie für car-data zeigt die Eingabedatenquelle an car_data.csv und vorgelagerte Einheiten. Die Abstammung für car-data-aggregated zeigt die Eingabe car-data Feature-Gruppe.

- Auswählen

Funktionen laden und dann wählen Fragen Sie die Upstream-Abstammung ab on

car-dataundcar-data-ingestion-pipelineum alle Upstream-Entitäten anzuzeigen.

Die vollständige Abstammungslinie für car-data Die Funktionsgruppe sollte wie im folgenden Screenshot aussehen.

Ebenso die Abstammungslinie für die car-aggregated-data Die Funktionsgruppe sollte wie im folgenden Screenshot aussehen.

SageMaker Studio bietet eine einzige Umgebung zum Verfolgen geplanter Pipelines, zum Anzeigen von Ausführungen, zum Erkunden der Herkunft und zum Anzeigen des Feature-Verarbeitungscodes.

Die aggregierten Merkmale wie Durchschnittspreis, Höchstpreis, durchschnittliche Kilometerleistung und mehr im car-data-aggregated Die Funktionsgruppe bietet Einblick in die Art der Daten. Sie können diese Funktionen auch als Datensatz verwenden, um ein Modell zur Vorhersage von Autopreisen oder für andere Vorgänge zu trainieren. Das Trainieren des Modells ist jedoch nicht Gegenstand dieses Beitrags, der sich auf die Demonstration der SageMaker Feature Store-Funktionen für die Feature-Entwicklung konzentriert.

Aufräumen

Vergessen Sie nicht, die im Rahmen dieses Beitrags erstellten Ressourcen zu bereinigen, um laufende Kosten zu vermeiden.

- Deaktivieren Sie die geplante Pipeline über

fp.schedule()Methode mit dem Statusparameter asDisabled:

- Beide Funktionsgruppen löschen:

Für die Daten im S3-Bucket und im Offline-Feature-Store können Kosten anfallen. Sie sollten sie daher löschen, um Gebühren zu vermeiden.

- Löschen Sie die S3-Objekte.

- Löschen Sie die Aufzeichnungen aus dem Feature Store.

Zusammenfassung

In diesem Beitrag haben wir gezeigt, wie ein Autoverkäufer den SageMaker Feature Store Feature Processor nutzte, um wertvolle Erkenntnisse aus seinen Rohverkaufsdaten zu gewinnen, indem er:

- Batch-Daten im großen Maßstab mit Spark aufnehmen und umwandeln

- Operationalisierung von Feature-Engineering-Workflows über SageMaker-Pipelines

- Bereitstellung der Herkunftsverfolgung und einer einzigen Umgebung zur Überwachung von Pipelines und zur Erkundung von Funktionen

- Vorbereiten aggregierter Funktionen, die für das Training von ML-Modellen optimiert sind

Durch die Befolgung dieser Schritte war das Unternehmen in der Lage, zuvor unbrauchbare Daten in strukturierte Funktionen umzuwandeln, die dann zum Trainieren eines Modells zur Vorhersage von Autopreisen verwendet werden konnten. Mit dem SageMaker Feature Store konnten sie sich auf das Feature-Engineering statt auf die zugrunde liegende Infrastruktur konzentrieren.

Wir hoffen, dass dieser Beitrag Ihnen dabei hilft, mit dem SageMaker Feature Store Feature Processor wertvolle ML-Erkenntnisse aus Ihren eigenen Daten zu gewinnen!

Weitere Informationen hierzu finden Sie unter Feature-Verarbeitung und das SageMaker-Beispiel weiter Amazon SageMaker Feature Store: Einführung in den Feature-Prozessor.

Über die Autoren

Dhaval Shah ist Senior Solutions Architect bei AWS und auf maschinelles Lernen spezialisiert. Mit einem starken Fokus auf Digital-Native-Unternehmen ermöglicht er Kunden, AWS zu nutzen und ihr Geschäftswachstum voranzutreiben. Als ML-Enthusiast wird Dhaval von seiner Leidenschaft angetrieben, wirkungsvolle Lösungen zu schaffen, die positive Veränderungen bewirken. In seiner Freizeit geht er seiner Liebe zum Reisen nach und genießt schöne Momente mit seiner Familie.

Dhaval Shah ist Senior Solutions Architect bei AWS und auf maschinelles Lernen spezialisiert. Mit einem starken Fokus auf Digital-Native-Unternehmen ermöglicht er Kunden, AWS zu nutzen und ihr Geschäftswachstum voranzutreiben. Als ML-Enthusiast wird Dhaval von seiner Leidenschaft angetrieben, wirkungsvolle Lösungen zu schaffen, die positive Veränderungen bewirken. In seiner Freizeit geht er seiner Liebe zum Reisen nach und genießt schöne Momente mit seiner Familie.

Ninad Joshi ist Senior Solutions Architect bei AWS und unterstützt globale AWS-Kunden bei der Entwicklung sicherer, skalierbarer und kostengünstiger Lösungen in der Cloud, um ihre komplexen realen Geschäftsherausforderungen zu lösen. Seine Arbeit im Bereich maschinelles Lernen (ML) deckt ein breites Spektrum von KI/ML-Anwendungsfällen ab, wobei der Schwerpunkt auf End-to-End-ML, Verarbeitung natürlicher Sprache und Computer Vision liegt. Bevor sie zu AWS kam, arbeitete Ninad mehr als 12 Jahre als Softwareentwicklerin. Außerhalb seiner beruflichen Aktivitäten spielt Ninad gerne Schach und erkundet verschiedene Schachzüge.

Ninad Joshi ist Senior Solutions Architect bei AWS und unterstützt globale AWS-Kunden bei der Entwicklung sicherer, skalierbarer und kostengünstiger Lösungen in der Cloud, um ihre komplexen realen Geschäftsherausforderungen zu lösen. Seine Arbeit im Bereich maschinelles Lernen (ML) deckt ein breites Spektrum von KI/ML-Anwendungsfällen ab, wobei der Schwerpunkt auf End-to-End-ML, Verarbeitung natürlicher Sprache und Computer Vision liegt. Bevor sie zu AWS kam, arbeitete Ninad mehr als 12 Jahre als Softwareentwicklerin. Außerhalb seiner beruflichen Aktivitäten spielt Ninad gerne Schach und erkundet verschiedene Schachzüge.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/unlock-ml-insights-using-the-amazon-sagemaker-feature-store-feature-processor/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 10

- 100

- 11

- 116

- 12

- 13

- 14

- 15%

- 16

- 20

- 24

- 26%

- 40

- 7

- 8

- 9

- a

- Fähig

- Konto

- genau

- über

- Aktionen

- hinzufügen

- Aggregat

- Anhäufung

- AI / ML

- Alle

- erlaubt

- entlang

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- und

- Ein anderer

- jedem

- Anwendung

- SIND

- Argumente

- AS

- At

- automatisieren

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- durchschnittlich

- vermeiden

- AWS

- basic

- BE

- Bevor

- BESTE

- Besser

- Big

- beide

- bringen

- Last

- Geschäft

- Unternehmen

- by

- namens

- CAN

- Fähigkeiten

- Auto

- Autos

- Häuser

- Fälle

- Herausforderungen

- Übernehmen

- Gebühren

- Schach

- Auswählen

- Cloud

- Code

- Kolonne

- Spalten

- kommt

- Unternehmen

- abschließen

- Komplex

- Computer

- Computer Vision

- Konfiguration

- konfiguriert

- Konsul (Console)

- enthält

- ständig

- verkaufen

- Kosten

- Kosten

- könnte

- Covers

- erstellen

- erstellt

- schafft

- Erstellen

- kritischem

- schwerfällig

- Original

- Kunden

- technische Daten

- Datensätze

- definiert

- Definition

- zeigen

- Synergie

- zeigt

- demonstrieren

- Abhängigkeiten

- beschrieben

- Beschreibung

- Design

- erwünscht

- Details

- entwickeln

- Entwickler:in / Unternehmen

- anders

- digital

- behindert

- Anzeige

- verteilt

- erledigt

- Antrieb

- angetrieben

- jeder

- Früher

- Effektiv

- Anstrengung

- befähigt

- freigegeben

- ermöglicht

- ermöglichen

- End-to-End

- bemüht sich

- Entwicklung

- Ingenieure

- gewährleisten

- Enthusiast

- Entitäten

- Arbeitsumfeld

- Event

- Jedes

- Beispiel

- ausführen

- Ausführung

- Faszinierende

- Erklären

- ERKUNDEN

- Möglichkeiten sondieren

- Familie

- beschleunigt

- Merkmal

- Eigenschaften

- Reichen Sie das

- Mappen

- Setzen Sie mit Achtsamkeit

- konzentriert

- folgen

- Folgende

- folgt

- Aussichten für

- fraktioniert

- für

- voller

- Funktion

- Funktionen

- Gewinnen

- erzeugt

- bekommen

- Global

- Gruppe an

- Gruppen

- Wachstum

- Griff

- Griffe

- Haben

- he

- Überschriften

- schwer

- schweres Heben

- Unternehmen

- hilft

- hier

- Hervorheben

- hoch

- seine

- Startseite

- ein Geschenk

- STUNDEN

- Ultraschall

- Hilfe

- aber

- HTML

- HTTPS

- ID

- Kennzeichnung

- if

- Image

- schlagkräftig

- Implementierung

- importieren

- wichtig

- in

- Einschließlich

- zeigt

- Info

- Information

- Infrastruktur

- Anfangs-

- Varianten des Eingangssignals:

- Eingänge

- innerhalb

- Einblick

- Einblicke

- installieren

- Instanz

- in

- IT

- Iteration

- SEINE

- Job

- Jobs

- Beitritt

- jpg

- Behalten

- Sprache

- grosse

- lernen

- weniger

- Lasst uns

- Hebelwirkung

- Facelift

- Gefällt mir

- Abstammung

- Links

- Liste

- Belastung

- Belastungen

- aus einer regionalen

- örtlich

- Log

- Logik

- aussehen

- aussehen wie

- ich liebe

- Maschine

- Maschinelles Lernen

- Main

- MACHT

- flächendeckende Gesundheitsprogramme

- manuell

- viele

- Spiel

- max

- maximal

- mdx

- sinnvoll

- MENÜ

- Methode

- Minute

- Kommt demnächst...

- ML

- Modell

- für

- Moments

- Überwachen

- mehr

- sollen

- Name

- Namen

- nativen

- Natürliche

- Verarbeitung natürlicher Sprache

- Natur

- Navigieren

- Menü

- Need

- erforderlich

- Neu

- Knoten

- Notizbuch

- Anzahl

- of

- Offline-Bereich.

- vorgenommen,

- on

- EINEM

- laufend

- einzige

- Betrieb

- Einkauf & Prozesse

- optimiert

- Option

- or

- Andere

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- aussen

- übrig

- besitzen

- Brot

- Parameter

- Parameter

- Teil

- Leidenschaft & KREATIVITÄT

- Ausführen

- führt

- Pipeline

- Plato

- Datenintelligenz von Plato

- PlatoData

- spielend

- besiedelt

- positiv

- Post

- pr

- vorhersagen

- früher

- vorher

- Preis

- Preise

- primär

- Vor

- Verarbeitung

- Prozessor

- Professionell

- Die Förderung der

- die

- vorausgesetzt

- bietet

- Python

- Qualität

- Angebot

- lieber

- Roh

- realen Welt

- Rekord

- Aufzeichnungen

- Rot

- Veteran

- reduziert

- siehe

- entfernen

- repetitiv

- ersetzen

- erfordern

- Downloads

- Folge

- was zu

- Rückkehr

- Rollen

- Führen Sie

- Laufen

- läuft

- s

- sagemaker

- Salz

- Vertrieb

- skalierbaren

- Skalieren

- Zeitplan

- vorgesehen

- Planung

- Wissenschaftler

- Umfang

- Sdk

- Sdn

- Sekunden

- Abschnitt

- Verbindung

- sehen

- Senior

- Lösungen

- Short

- sollte

- erklären

- Konzerte

- signifikant

- Einfacher

- Single

- einzelne Umgebung

- So

- Software

- verkauft

- Lösung

- Lösungen

- LÖSEN

- Quelle

- Spark

- spezialisieren

- Spezifikationen

- angegeben

- Sport

- Anfang

- begonnen

- Anfang

- Bundesstaat

- Status

- Shritte

- Lagerung

- speichern

- Speichern Sie die Daten

- Schnur

- stark

- strukturierte

- Studio Adressen

- abschicken

- Anschließend

- erfolgreich

- Erfolgreich

- so

- geeignet

- Tabelle

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Der Staat

- ihr

- Sie

- dann

- Diese

- fehlen uns die Worte.

- nach drei

- Zeit

- mal

- zu

- auch

- Top

- verfolgen sind

- Tracking

- Training

- Ausbildung

- Transaktion

- Transformieren

- Transformation

- Transformationen

- verwandelt

- Transformieren

- reisen

- Trends

- Lernprogramm

- XNUMX

- tippe

- Typen

- ui

- für

- zugrunde liegen,

- öffnen

- aktualisiert

- us

- -

- Anwendungsfall

- benutzt

- Verwendung von

- wertvoll

- Wert

- Werte

- verschiedene

- Fahrzeuge

- Anzeigen

- Seh-

- vs

- warm

- wurde

- we

- Netz

- Web-Services

- welche

- breit

- Große Auswahl

- werden wir

- mit

- Arbeiten

- gearbeitet

- Workflows

- schreiben

- Jahr

- Jahr

- Du

- Ihr

- Zephyrnet