Die generative KI-Technologie entwickelt sich rasant weiter und es ist jetzt möglich, Texte und Bilder basierend auf Texteingaben zu generieren. Stable Diffusion ist ein Text-zu-Bild-Modell, mit dem Sie fotorealistische Anwendungen erstellen können. Mithilfe von Stable Diffusion-Modellen können Sie ganz einfach Bilder aus Text generieren Amazon SageMaker JumpStart.

Im Folgenden finden Sie Beispiele für Eingabetexte und die entsprechenden Ausgabebilder, die von Stable Diffusion generiert werden. Die Eingaben sind „Ein Boxer tanzt auf einem Tisch“, „Eine Dame am Strand in Badekleidung im Aquarellstil“ und „Ein Hund im Anzug“.

Obwohl generative KI-Lösungen leistungsstark und nützlich sind, können sie auch anfällig für Manipulation und Missbrauch sein. Kunden, die sie zur Bilderzeugung nutzen, müssen der Inhaltsmoderation Vorrang einräumen, um ihre Benutzer, ihre Plattform und ihre Marke zu schützen, indem sie strenge Moderationspraktiken implementieren, um ein sicheres und positives Benutzererlebnis zu schaffen und gleichzeitig den Ruf ihrer Plattform und ihrer Marke zu schützen.

In diesem Beitrag untersuchen wir die Verwendung von AWS AI-Diensten Amazon-Anerkennung und Amazon verstehen, zusammen mit anderen Techniken, um vom Stable Diffusion-Modell generierte Inhalte nahezu in Echtzeit effektiv zu moderieren. Informationen zum Starten und Generieren von Bildern aus Text mithilfe eines Stable Diffusion-Modells in AWS finden Sie unter Generieren Sie Bilder aus Text mit dem stabilen Diffusionsmodell auf Amazon SageMaker JumpStart.

Lösungsüberblick

Amazon Rekognition und Amazon Comprehend sind verwaltete KI-Dienste, die vorab trainierte und anpassbare ML-Modelle über eine API-Schnittstelle bereitstellen, sodass keine Fachkenntnisse im Bereich maschinelles Lernen (ML) erforderlich sind. Amazon Rekognition Content Moderation automatisiert und optimiert die Bild- und Videomoderation. Amazon Comprehend nutzt ML, um Text zu analysieren und wertvolle Erkenntnisse und Zusammenhänge aufzudecken.

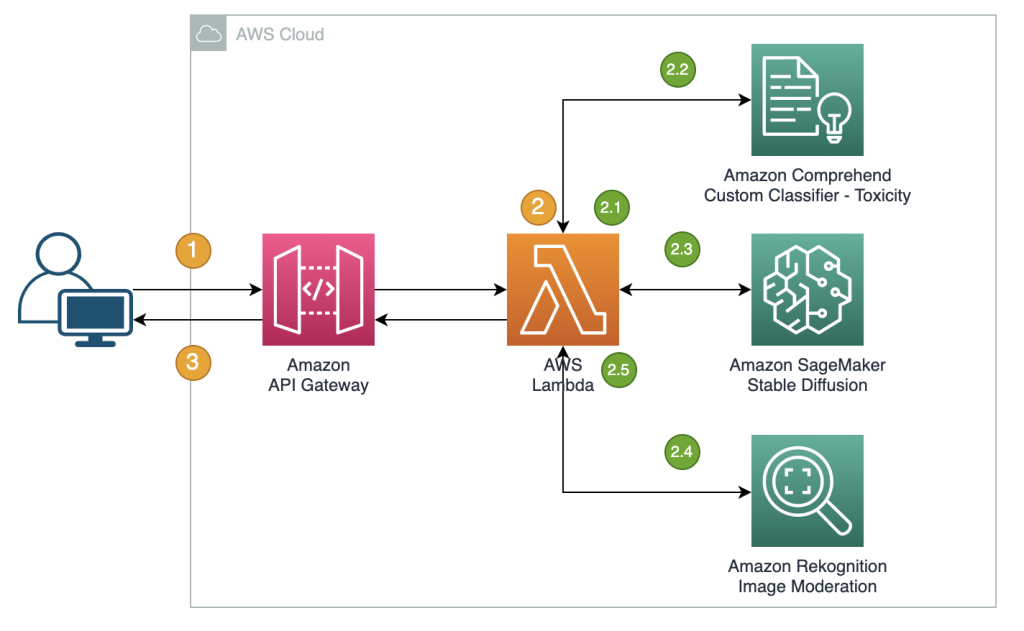

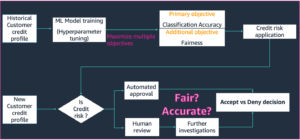

Die folgende Referenz veranschaulicht die Erstellung einer RESTful-Proxy-API zur Moderation von durch Stable Diffusion vom Text-zu-Bild-Modell generierten Bildern nahezu in Echtzeit. In dieser Lösung haben wir mit JumpStart ein Stable Diffusion-Modell (v2-1-Basis) gestartet und bereitgestellt. Die Lösung nutzt negative Eingabeaufforderungen und Textmoderationslösungen wie Amazon Comprehend sowie einen regelbasierten Filter zur Moderation von Eingabeaufforderungen. Es nutzt außerdem Amazon Rekognition, um die generierten Bilder zu moderieren. Die RESTful-API gibt das generierte Bild und die Moderationswarnungen an den Client zurück, wenn unsichere Informationen erkannt werden.

Die Schritte im Workflow sind wie folgt:

- Der Benutzer sendet eine Aufforderung zum Generieren eines Bildes.

- An AWS Lambda Die Funktion koordiniert die Bildgenerierung und -moderation mithilfe von Amazon Comprehend, JumpStart und Amazon Rekognition:

- Wenden Sie eine regelbasierte Bedingung auf Eingabeaufforderungen in Lambda-Funktionen an und erzwingen Sie die Inhaltsmoderation mit der Erkennung verbotener Wörter.

- Verwenden Sie den benutzerdefinierten Klassifikator von Amazon Comprehend, um den Eingabeaufforderungstext für die Toxizitätsklassifizierung zu analysieren.

- Senden Sie die Eingabeaufforderung über den SageMaker-Endpunkt an das Stable Diffusion-Modell und übergeben Sie dabei sowohl die Eingabeaufforderungen als Benutzereingabe als auch negative Eingabeaufforderungen aus einer vordefinierten Liste.

- Senden Sie die vom SageMaker-Endpunkt zurückgegebenen Bildbytes an Amazon Rekognition

DetectModerationLabelAPI zur Bildmoderation. - Erstellen Sie eine Antwortnachricht, die Bildbytes und Warnungen enthält, wenn in den vorherigen Schritten unangemessene Informationen in der Eingabeaufforderung oder im generierten Bild erkannt wurden.

- Senden Sie die Antwort an den Kunden zurück.

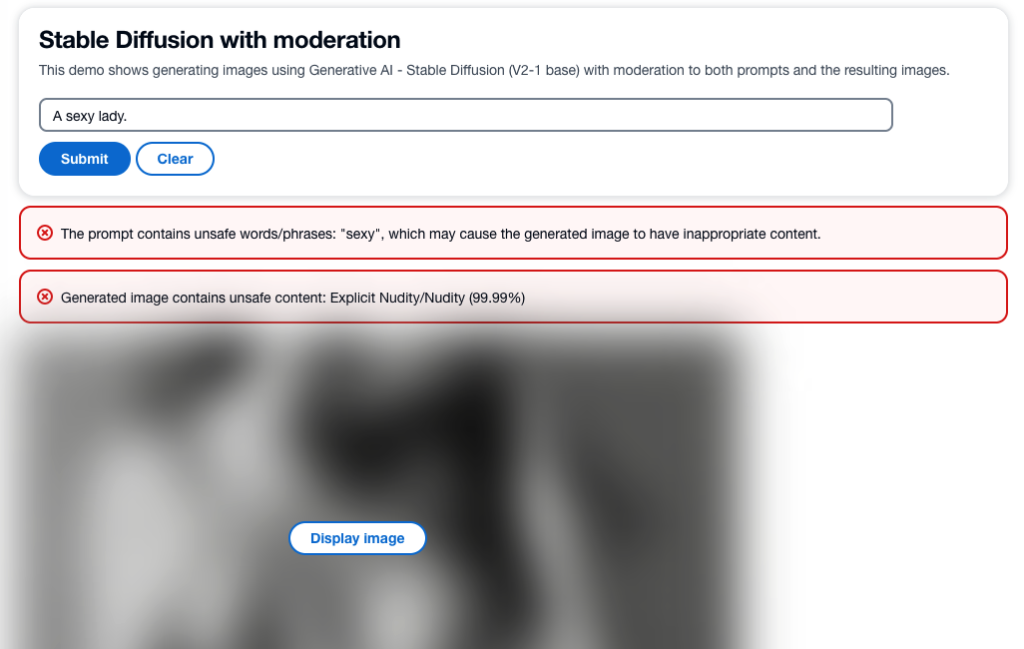

Der folgende Screenshot zeigt eine Beispiel-App, die mit der beschriebenen Architektur erstellt wurde. Die Web-Benutzeroberfläche sendet Benutzereingabeaufforderungen an die RESTful-Proxy-API und zeigt das Bild und alle in der Antwort empfangenen Moderationswarnungen an. Die Demo-App verwischt das tatsächlich generierte Bild, wenn es unsichere Inhalte enthält. Wir haben die App mit der Beispielaufforderung „Eine sexy Dame“ getestet.

Für ein besseres Benutzererlebnis können Sie eine ausgefeiltere Logik implementieren, z. B. das Ablehnen der Anfrage, wenn die Eingabeaufforderungen unsichere Informationen enthalten. Darüber hinaus könnten Sie über eine Wiederholungsrichtlinie verfügen, um das Bild neu zu generieren, wenn die Eingabeaufforderung sicher, die Ausgabe jedoch unsicher ist.

Definieren Sie eine Liste negativer Eingabeaufforderungen

Stable Diffusion unterstützt negative Eingabeaufforderungen, sodass Sie Eingabeaufforderungen angeben können, die während der Bildgenerierung vermieden werden sollen. Das Erstellen einer vordefinierten Liste negativer Eingabeaufforderungen ist ein praktischer und proaktiver Ansatz, um zu verhindern, dass das Modell unsichere Bilder erzeugt. Durch die Einbeziehung von Aufforderungen wie „nackt“, „sexy“ und „Nacktheit“, die bekanntermaßen zu unangemessenen oder anstößigen Bildern führen, kann das Model diese erkennen und vermeiden und so das Risiko der Generierung unsicherer Inhalte verringern.

Die Implementierung kann in der Lambda-Funktion verwaltet werden, wenn der SageMaker-Endpunkt aufgerufen wird, um die Inferenz des Stable Diffusion-Modells auszuführen, wobei sowohl die Eingabeaufforderungen aus Benutzereingaben als auch die negativen Eingabeaufforderungen aus einer vordefinierten Liste übergeben werden.

Obwohl dieser Ansatz effektiv ist, könnte er die vom Stable Diffusion-Modell generierten Ergebnisse beeinträchtigen und dessen Funktionalität einschränken. Es ist wichtig, es als eine der Moderationstechniken zu betrachten, kombiniert mit anderen Ansätzen wie der Text- und Bildmoderation mit Amazon Comprehend und Amazon Rekognition.

Mäßige Eingabeaufforderungen

Ein gängiger Ansatz zur Textmoderation besteht darin, mithilfe einer regelbasierten Schlüsselwortsuche zu ermitteln, ob der Eingabetext verbotene Wörter oder Phrasen aus einer vordefinierten Liste enthält. Diese Methode ist relativ einfach zu implementieren, mit minimalen Auswirkungen auf die Leistung und geringeren Kosten. Der größte Nachteil dieses Ansatzes besteht jedoch darin, dass er nur die in der vordefinierten Liste enthaltenen Wörter erkennen kann und keine neuen oder geänderten Variationen verbotener Wörter erkennen kann, die nicht in der Liste enthalten sind. Benutzer können auch versuchen, die Regeln zu umgehen, indem sie anstelle von Buchstaben alternative Schreibweisen oder Sonderzeichen verwenden.

Um die Einschränkungen einer regelbasierten Textmoderation zu überwinden, haben viele Lösungen einen Hybridansatz gewählt, der regelbasierte Schlüsselwortsuche mit ML-basierter Toxizitätserkennung kombiniert. Die Kombination beider Ansätze ermöglicht eine umfassendere und effektivere Textmoderationslösung, die in der Lage ist, ein breiteres Spektrum an unangemessenen Inhalten zu erkennen und die Genauigkeit der Moderationsergebnisse zu verbessern.

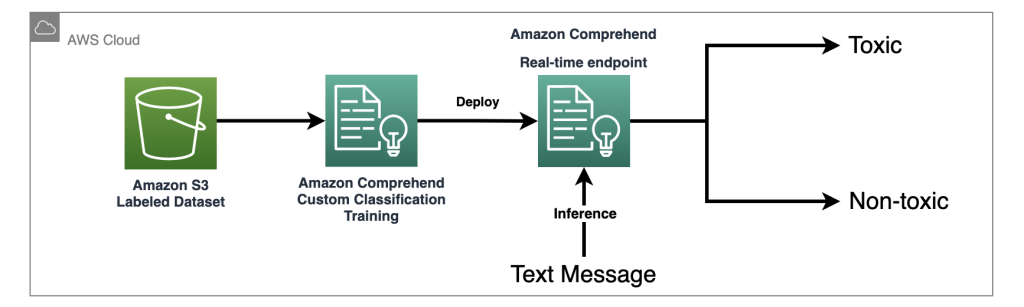

In dieser Lösung verwenden wir eine Benutzerdefinierter Amazon Comprehend-Klassifikator um ein Toxizitätserkennungsmodell zu trainieren, mit dem wir potenziell schädliche Inhalte in Eingabeaufforderungen erkennen, wenn keine explizit verbotenen Wörter erkannt werden. Mit der Kraft des maschinellen Lernens können wir dem Modell beibringen, Muster im Text zu erkennen, die auf Toxizität hinweisen könnten, selbst wenn solche Muster mit einem regelbasierten Ansatz nicht leicht erkennbar sind.

Mit Amazon Comprehend als verwaltetem KI-Dienst werden Training und Inferenz vereinfacht. Sie können die benutzerdefinierte Amazon Comprehend-Klassifizierung ganz einfach in nur zwei Schritten trainieren und bereitstellen. Schauen Sie sich unsere an Werkstattlabor Weitere Informationen zum Toxizitätserkennungsmodell mit einem benutzerdefinierten Amazon Comprehend-Klassifikator finden Sie hier. Das Labor bietet eine Schritt-für-Schritt-Anleitung zum Erstellen und Integrieren eines benutzerdefinierten Toxizitätsklassifikators in Ihre Anwendung. Das folgende Diagramm veranschaulicht diese Lösungsarchitektur.

Dieser Beispielklassifikator verwendet einen Social-Media-Trainingsdatensatz und führt eine binäre Klassifizierung durch. Wenn Sie jedoch spezifischere Anforderungen an die Textmoderation haben, sollten Sie die Verwendung eines maßgeschneiderten Datensatzes zum Trainieren Ihres benutzerdefinierten Amazon Comprehend-Klassifikators in Betracht ziehen.

Mäßige Ausgabebilder

Obwohl die Moderation von Texteingabeaufforderungen wichtig ist, garantiert sie nicht, dass alle vom Stable Diffusion-Modell generierten Bilder für die beabsichtigte Zielgruppe sicher sind, da die Ausgaben des Modells ein gewisses Maß an Zufälligkeit enthalten können. Daher ist es ebenso wichtig, die vom Stable Diffusion-Modell erzeugten Bilder zu moderieren.

In dieser Lösung verwenden wir Moderation von Amazon Rekognition-Inhalten, das vorab trainierte ML-Modelle verwendet, um unangemessene Inhalte in Bildern und Videos zu erkennen. In dieser Lösung verwenden wir die Amazon Rekognition DetectModerationLabel-API um vom Stable Diffusion-Modell erzeugte Bilder nahezu in Echtzeit zu moderieren. Amazon Rekognition Content Moderation bietet vorab trainierte APIs zur Analyse einer Vielzahl unangemessener oder anstößiger Inhalte wie Gewalt, Nacktheit, Hasssymbole und mehr. Eine umfassende Liste der Amazon Rekognition Content Moderation-Taxonomien finden Sie unter Inhalte moderieren.

Der folgende Code zeigt, wie Amazon Rekognition aufgerufen wird DetectModerationLabel API zum Moderieren von Bildern innerhalb einer Lambda-Funktion mithilfe der Python-Boto3-Bibliothek. Diese Funktion nimmt die von SageMaker zurückgegebenen Bildbytes und sendet sie zur Moderation an die Bildmoderations-API.

Weitere Beispiele der Amazon Rekognition Image Moderation API finden Sie in unserem Bildlabor für Inhaltsmoderation.

Effektive Bildmoderationstechniken zur Feinabstimmung von Modellen

Feinabstimmung ist eine gängige Technik, mit der vorab trainierte Modelle an bestimmte Aufgaben angepasst werden. Im Fall der stabilen Diffusion kann eine Feinabstimmung verwendet werden, um Bilder zu erzeugen, die bestimmte Objekte, Stile und Charaktere enthalten. Die Moderation von Inhalten ist beim Training eines Stable Diffusion-Modells von entscheidender Bedeutung, um die Erstellung unangemessener oder anstößiger Bilder zu verhindern. Dabei werden alle Daten, die zur Entstehung solcher Bilder führen könnten, sorgfältig geprüft und herausgefiltert. Auf diese Weise lernt das Modell aus einem vielfältigeren und repräsentativeren Bereich von Datenpunkten, verbessert seine Genauigkeit und verhindert die Verbreitung schädlicher Inhalte.

JumpStart erleichtert die Feinabstimmung des Stable Diffusion Model, indem es die Transfer-Lernskripte mithilfe von bereitstellt Traumkabine Methode. Sie müssen lediglich Ihre Trainingsdaten vorbereiten, die Hyperparameter definieren und den Trainingsjob starten. Weitere Einzelheiten finden Sie unter Feinabstimmung von Text-to-Image Stable Diffusion-Modellen mit Amazon SageMaker JumpStart.

Der Datensatz für die Feinabstimmung muss ein einzelner sein Amazon Simple Storage-Service (Amazon S3)-Verzeichnis einschließlich Ihrer Bilder und Instanzkonfigurationsdatei dataset_info.json, wie im folgenden Code gezeigt. Die JSON-Datei ordnet die Bilder wie folgt der Instanz-Eingabeaufforderung zu: {'instance_prompt':<<instance_prompt>>}.

Natürlich können Sie die Bilder manuell überprüfen und filtern, aber das kann zeitaufwändig und sogar unpraktisch sein, wenn Sie dies in großem Umfang über viele Projekte und Teams hinweg tun. In solchen Fällen können Sie einen Batch-Prozess automatisieren, um alle Bilder zentral mit Amazon Rekognition zu vergleichen DetectModerationLabel API und markieren oder entfernen Sie Bilder automatisch, damit sie Ihr Training nicht verunreinigen.

Moderationslatenz und Kosten

Bei dieser Lösung wird ein sequentielles Muster verwendet, um Text und Bilder zu moderieren. Für die Textmoderation werden eine regelbasierte Funktion und Amazon Comprehend aufgerufen, und Amazon Rekognition wird für die Bildmoderation verwendet, sowohl vor als auch nach dem Aufruf von Stable Diffusion. Obwohl dieser Ansatz Eingabeaufforderungen und Ausgabebilder effektiv moderiert, kann er die Gesamtkosten und die Latenz der Lösung erhöhen, was zu berücksichtigen ist.

Latency

Sowohl Amazon Rekognition als auch Amazon Comprehend bieten verwaltete APIs, die hochverfügbar sind und über integrierte Skalierbarkeit verfügen. Trotz möglicher Latenzschwankungen aufgrund der Eingabegröße und Netzwerkgeschwindigkeit bieten die in dieser Lösung verwendeten APIs beider Dienste eine Inferenz nahezu in Echtzeit. Die benutzerdefinierten Klassifikator-Endpunkte von Amazon Comprehend können eine Geschwindigkeit von weniger als 200 Millisekunden für Eingabetextgrößen von weniger als 100 Zeichen bieten, während die Amazon Rekognition Image Moderation API etwa 500 Millisekunden für durchschnittliche Dateigrößen von weniger als 1 MB bereitstellt. (Die Ergebnisse basieren auf dem Test, der mit der Beispielanwendung durchgeführt wurde, was als nahezu Echtzeit-Anforderung gilt.)

Insgesamt verlängern die Moderations-API-Aufrufe an Amazon Rekognition und Amazon Comprehend den API-Aufruf um bis zu 700 Millisekunden. Es ist wichtig zu beachten, dass die Stable Diffusion-Anfrage je nach Komplexität der Eingabeaufforderungen und der zugrunde liegenden Infrastrukturkapazität normalerweise länger dauert. Im Testkonto mit dem Instanztyp ml.p3.2xlarge betrug die durchschnittliche Antwortzeit für das Stable Diffusion-Modell über einen SageMaker-Endpunkt etwa 15 Sekunden. Daher beträgt die durch die Moderation verursachte Latenz etwa 5 % der Gesamtantwortzeit, sodass sie nur minimale Auswirkungen auf die Gesamtleistung des Systems hat.

Kosten

Die Amazon Rekognition Image Moderation API verwendet ein Pay-as-you-go-Modell basierend auf der Anzahl der Anfragen. Die Kosten variieren je nach verwendeter AWS-Region und folgen einer gestaffelten Preisstruktur. Mit steigendem Anfragevolumen sinken die Kosten pro Anfrage. Weitere Informationen finden Sie unter Amazon Rekognition-Preise.

In dieser Lösung haben wir einen benutzerdefinierten Amazon Comprehend-Klassifikator verwendet und ihn als Amazon Comprehend-Endpunkt bereitgestellt, um Echtzeit-Inferenzen zu ermöglichen. Diese Implementierung verursacht sowohl einmalige Schulungskosten als auch laufende Inferenzkosten. Ausführliche Informationen finden Sie unter Amazon Comprehend-Preise.

Mit Jumpstart können Sie das Stable Diffusion-Modell schnell als einzelnes Paket starten und bereitstellen. Für die Ausführung einer Schlussfolgerung auf dem Stable-Diffusion-Modell fallen Kosten für den Basiswert an Amazon Elastic Compute-Cloud (Amazon EC2) Instanz sowie ein- und ausgehender Datentransfer. Ausführliche Informationen finden Sie unter Amazon SageMaker Preise.

Zusammenfassung

In diesem Beitrag haben wir einen Überblick über eine Beispiellösung gegeben, die zeigt, wie man Stable Diffusion-Eingabeaufforderungen moderiert und Bilder mit Amazon Comprehend und Amazon Rekognition ausgibt. Darüber hinaus können Sie in Stable Diffusion negative Aufforderungen definieren, um die Generierung unsicherer Inhalte zu verhindern. Durch die Implementierung mehrerer Moderationsebenen kann das Risiko der Erstellung unsicherer Inhalte erheblich reduziert werden, wodurch ein sichereres und zuverlässigeres Benutzererlebnis gewährleistet wird.

Erfahren Sie mehr darüber Inhaltsmoderation auf AWS und unseren ML-Anwendungsfälle für die Inhaltsmoderation, und machen Sie den ersten Schritt zur Optimierung Ihrer Content-Moderationsvorgänge mit AWS.

Über die Autoren

Lana Zhang ist Senior Solutions Architect beim AWS WWSO AI Services-Team, spezialisiert auf KI und ML für Inhaltsmoderation, Computer Vision und Verarbeitung natürlicher Sprache. Mit ihrem Fachwissen widmet sie sich der Förderung von AWS AI/ML-Lösungen und unterstützt Kunden bei der Transformation ihrer Geschäftslösungen in verschiedenen Branchen, darunter soziale Medien, Spiele, E-Commerce sowie Werbung und Marketing.

Lana Zhang ist Senior Solutions Architect beim AWS WWSO AI Services-Team, spezialisiert auf KI und ML für Inhaltsmoderation, Computer Vision und Verarbeitung natürlicher Sprache. Mit ihrem Fachwissen widmet sie sich der Förderung von AWS AI/ML-Lösungen und unterstützt Kunden bei der Transformation ihrer Geschäftslösungen in verschiedenen Branchen, darunter soziale Medien, Spiele, E-Commerce sowie Werbung und Marketing.

James Wu ist Senior AI/ML Specialist Solution Architect bei AWS. Wir unterstützen Kunden beim Entwerfen und Erstellen von KI/ML-Lösungen. James‘ Arbeit deckt ein breites Spektrum von ML-Anwendungsfällen ab, wobei sein Hauptinteresse an Computer Vision, Deep Learning und der Skalierung von ML im gesamten Unternehmen liegt. Bevor er zu AWS kam, war James über 10 Jahre lang als Architekt, Entwickler und Technologieführer tätig, davon 6 Jahre im Ingenieurwesen und 4 Jahre in der Marketing- und Werbebranche.

James Wu ist Senior AI/ML Specialist Solution Architect bei AWS. Wir unterstützen Kunden beim Entwerfen und Erstellen von KI/ML-Lösungen. James‘ Arbeit deckt ein breites Spektrum von ML-Anwendungsfällen ab, wobei sein Hauptinteresse an Computer Vision, Deep Learning und der Skalierung von ML im gesamten Unternehmen liegt. Bevor er zu AWS kam, war James über 10 Jahre lang als Architekt, Entwickler und Technologieführer tätig, davon 6 Jahre im Ingenieurwesen und 4 Jahre in der Marketing- und Werbebranche.

Kevin Karlson ist Principal AI/ML-Spezialist mit Schwerpunkt auf Computer Vision bei AWS, wo er die Geschäftsentwicklung und GTM für Amazon Rekognition leitet. Bevor er zu AWS kam, leitete er die digitale Transformation weltweit beim Fortune-500-Engineering-Unternehmen AECOM, mit Schwerpunkt auf künstlicher Intelligenz und maschinellem Lernen für generatives Design und Infrastrukturbewertung. Er lebt in Chicago, wo er außerhalb der Arbeit gerne Zeit mit seiner Familie verbringt und sich leidenschaftlich für das Fliegen von Flugzeugen und das Trainieren von Jugend-Baseball interessiert.

Kevin Karlson ist Principal AI/ML-Spezialist mit Schwerpunkt auf Computer Vision bei AWS, wo er die Geschäftsentwicklung und GTM für Amazon Rekognition leitet. Bevor er zu AWS kam, leitete er die digitale Transformation weltweit beim Fortune-500-Engineering-Unternehmen AECOM, mit Schwerpunkt auf künstlicher Intelligenz und maschinellem Lernen für generatives Design und Infrastrukturbewertung. Er lebt in Chicago, wo er außerhalb der Arbeit gerne Zeit mit seiner Familie verbringt und sich leidenschaftlich für das Fliegen von Flugzeugen und das Trainieren von Jugend-Baseball interessiert.

John Rous ist Senior AI/ML-Spezialist bei AWS, wo er die globale Geschäftsentwicklung für KI-Dienste mit Schwerpunkt auf Anwendungsfällen für Inhaltsmoderation und Compliance leitet. Bevor er zu AWS kam, hatte er leitende Positionen in der Geschäftsentwicklung und Führung bei führenden Technologieunternehmen inne. John arbeitet daran, maschinelles Lernen mit dem AWS AI/ML-Stack jedem Entwickler in die Hand zu geben. Kleine Ideen haben kleine Auswirkungen. Johns Ziel für seine Kunden ist es, sie mit großen Ideen und Möglichkeiten zu unterstützen, die ihnen Türen öffnen, damit sie bei ihren Kunden eine große Wirkung erzielen können.

John Rous ist Senior AI/ML-Spezialist bei AWS, wo er die globale Geschäftsentwicklung für KI-Dienste mit Schwerpunkt auf Anwendungsfällen für Inhaltsmoderation und Compliance leitet. Bevor er zu AWS kam, hatte er leitende Positionen in der Geschäftsentwicklung und Führung bei führenden Technologieunternehmen inne. John arbeitet daran, maschinelles Lernen mit dem AWS AI/ML-Stack jedem Entwickler in die Hand zu geben. Kleine Ideen haben kleine Auswirkungen. Johns Ziel für seine Kunden ist es, sie mit großen Ideen und Möglichkeiten zu unterstützen, die ihnen Türen öffnen, damit sie bei ihren Kunden eine große Wirkung erzielen können.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/safe-image-generation-and-diffusion-models-with-amazon-ai-content-moderation-services/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 10

- 100

- 15%

- 200

- 49

- 500

- 7

- 8

- a

- Über Uns

- Missbrauch

- Konto

- Genauigkeit

- über

- präsentieren

- automatisch

- hinzufügen

- Zusätzliche

- zusätzlich

- Adresse

- angenommen

- Marketings

- Nach der

- gegen

- AI

- KI-Dienste

- AI / ML

- Flugzeuge

- Alle

- erlaubt

- entlang

- ebenfalls

- Alternative

- Obwohl

- Amazon

- Amazon verstehen

- Amazon EC2

- Amazon-Anerkennung

- Amazon Sage Maker

- Amazon Web Services

- an

- analysieren

- und

- und Infrastruktur

- jedem

- Bienen

- APIs

- App

- Anwendung

- Anwendungen

- Ansatz

- Ansätze

- ca.

- Architektur

- SIND

- um

- künstlich

- künstliche Intelligenz

- Künstliche Intelligenz und maschinelles Lernen

- AS

- Bewertung

- Unterstützung

- Partnerschaftsräte

- At

- Publikum

- automatisieren

- Automatisches Erfassen:

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- durchschnittlich

- vermeiden

- AWS

- Zurück

- Base

- Baseball

- basierend

- BE

- Beach

- weil

- Bevor

- Besser

- Big

- große Ideen

- Unschärfen

- beide

- Marke

- bringen

- bauen

- erbaut

- eingebaut

- Geschäft

- Geschäftsentwicklung

- aber

- by

- rufen Sie uns an!

- namens

- Aufruf

- Aufrufe

- CAN

- capability

- fähig

- vorsichtig

- Carlson

- Häuser

- Fälle

- sicher

- Zeichen

- aus der Ferne überprüfen

- Chicago

- Einstufung

- Auftraggeber

- test name

- Code

- Farbe

- Kombination

- kombiniert

- vereint

- gemeinsam

- Unternehmen

- Unternehmen

- Komplexität

- Compliance

- begreifen

- umfassend

- Berechnen

- Computer

- Computer Vision

- Zustand

- durchgeführt

- Konfiguration

- Geht davon

- enthalten

- enthält

- Inhalt

- Dazugehörigen

- Kosten

- Kosten

- könnte

- Covers

- erstellen

- Erstellen

- Schaffung

- kritischem

- Original

- Kunde

- Kunden

- anpassbare

- Schneiden

- Tanzen

- technische Daten

- Datenpunkte

- sinkt

- gewidmet

- tief

- tiefe Lernen

- Demo

- zeigt

- zuverlässig

- Abhängig

- einsetzen

- Einsatz

- beschrieben

- Design

- Trotz

- detailliert

- Details

- erkannt

- Entdeckung

- Entwickler:in / Unternehmen

- Entwicklung

- Rundfunk

- digital

- Digitale Transformation

- Displays

- verschieden

- do

- Tut nicht

- Hund

- Dabei

- Nicht

- Türen

- zwei

- im

- e-commerce

- leicht

- Einfache

- Edge

- Effektiv

- effektiv

- eliminieren

- beschäftigt

- ermächtigen

- befähigt

- ermöglicht

- Endpunkt

- Durchsetzung

- Entwicklung

- Gewährleistung

- Unternehmen

- gleichermaßen

- Sogar

- Jedes

- Beispiele

- ERFAHRUNGEN

- Expertise

- ERKUNDEN

- erleichtern

- Familie

- Reichen Sie das

- Filter

- Filterung

- Vorname

- Fliegen

- Setzen Sie mit Achtsamkeit

- konzentriert

- Folgende

- folgt

- Aussichten für

- Vermögen

- für

- Funktion

- Funktionalität

- Funktionen

- Gaming

- erzeugen

- erzeugt

- Erzeugung

- Generation

- generativ

- Generative KI

- GitHub

- Global

- globales Geschäft

- Global

- Kundenziele

- sehr

- Garantie

- Guide

- Hände

- schädlich

- Haben

- he

- Statt

- Unternehmen

- hier (auf dänisch)

- hoch

- seine

- Ultraschall

- Hilfe

- aber

- HTML

- http

- HTTPS

- Hybrid

- Ideen

- identifizieren

- if

- zeigt

- Image

- Bilder

- Impact der HXNUMXO Observatorien

- implementieren

- Implementierung

- Umsetzung

- wichtig

- Verbesserung

- in

- inklusive

- Dazu gehören

- Einschließlich

- integrieren

- Erhöhung

- Steigert

- zeigen

- Branchen

- Information

- Infrastruktur

- Varianten des Eingangssignals:

- Eingänge

- Einblicke

- Instanz

- Integration

- Intelligenz

- beabsichtigt

- Interesse

- Schnittstelle

- in

- eingeführt

- IT

- SEINE

- Jakob

- Job

- Peter

- Beitritt

- JSON

- nur

- bekannt

- Labor

- Dame

- Sprache

- Latency

- starten

- ins Leben gerufen

- Lagen

- führen

- Führer

- Leadership

- umwandeln

- LERNEN

- lernen

- geführt

- weniger

- Lasst uns

- Niveau

- Bibliothek

- Gefällt mir

- LIMIT

- Einschränkungen

- Limitiert

- Liste

- Logik

- länger

- Nachschlagen

- senken

- Maschine

- Maschinelles Lernen

- Dur

- um

- MACHT

- Making

- verwaltet

- Manipulation

- manuell

- viele

- Marketing

- Kann..

- Medien

- Nachricht

- Methode

- minimal

- ML

- Modell

- für

- Mäßigung

- geändert

- mehr

- mehrere

- sollen

- Natürliche

- Verarbeitung natürlicher Sprache

- Need

- Bedürfnisse

- Negativ

- Netzwerk

- Neu

- nicht

- jetzt an

- Anzahl

- Objekt

- Objekte

- of

- Offensive

- bieten

- on

- EINEM

- laufend

- einzige

- XNUMXh geöffnet

- Einkauf & Prozesse

- Entwicklungsmöglichkeiten

- or

- Andere

- UNSERE

- Ergebnisse

- Möglichkeiten für das Ausgangssignal:

- aussen

- übrig

- Gesamt-

- Überblick

- Paket

- Bestehen

- leidenschaftlich

- Schnittmuster

- Muster

- Leistung

- führt

- Fotorealistisch

- Sätze

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- Punkte

- Datenschutzrichtlinien

- positiv

- möglich

- Post

- Potenzial

- möglicherweise

- Werkzeuge

- größte treibende

- Praktisch

- Praktiken

- Danach

- verhindern

- Verhütung

- früher

- gebühr

- primär

- Principal

- Vor

- Priorität einräumen

- Proaktives Handeln

- Prozessdefinierung

- Verarbeitung

- Herstellung

- Projekte

- Die Förderung der

- Risiken zu minimieren

- die

- vorausgesetzt

- bietet

- Bereitstellung

- Stellvertreter

- setzen

- Python

- schnell

- Zufälligkeit

- Angebot

- schnell

- Echtzeit

- Received

- erkennen

- Reduziert

- Reduzierung

- Region

- Beziehungen

- verhältnismäßig

- entfernen

- ersetzen

- Vertreter

- Ruf

- Anforderung

- Zugriffe

- Anforderung

- Voraussetzungen:

- Antwort

- Die Ergebnisse

- Rückkehr

- Überprüfen

- Überprüfung

- Risiko

- Rollen

- Ohne eine erfahrene Medienplanung zur Festlegung von Regeln und Strategien beschleunigt der programmatische Medieneinkauf einfach die Rate der verschwenderischen Ausgaben.

- Führen Sie

- Laufen

- Safe

- Sicherung

- Sicherheit

- sagemaker

- Skalierbarkeit

- Skalieren

- Skalierung

- Skripte

- Sekunden

- senden

- sendet

- Senior

- dient

- Lösungen

- sie

- gezeigt

- Konzerte

- Einfacher

- vereinfachte

- Single

- Größe

- Größen

- klein

- So

- Social Media

- Social Media

- Lösung

- Lösungen

- etwas

- anspruchsvoll

- besondere

- Spezialist

- spezialisieren

- spezifisch

- Geschwindigkeit

- stabil

- Stapel

- Anfang

- Schritt

- Shritte

- Lagerung

- speichern

- Rationalisierung

- stark

- Struktur

- Stil

- so

- Anzug

- Unterstützt

- System

- Tabelle

- zugeschnitten

- Nehmen

- nimmt

- und Aufgaben

- Team

- Teams

- Techniken

- Technologie

- Technologieunternehmen

- Test

- getestet

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- deswegen

- vom Nutzer definierten

- fehlen uns die Worte.

- Durch

- Zeit

- Zeitaufwendig

- zu

- Gesamt

- gegenüber

- Training

- Ausbildung

- privaten Transfer

- Transformation

- Transformieren

- XNUMX

- tippe

- ui

- aufdecken

- zugrunde liegen,

- -

- benutzt

- Mitglied

- Benutzererfahrung

- Nutzer

- verwendet

- Verwendung von

- gewöhnlich

- Nutzen

- seit

- die

- wertvoll

- Video

- Videos

- Gewalt

- Seh-

- Volumen

- Verwundbar

- wurde

- Wasser

- we

- Netz

- Web-Services

- GUT

- wann

- ob

- welche

- während

- breit

- Große Auswahl

- breiter

- werden wir

- mit

- .

- Word

- Worte

- Arbeiten

- Arbeitsablauf.

- arbeiten,

- wu

- Jahr

- Du

- Ihr

- Jugend

- Zephyrnet