Dies ist ein Gastbeitrag, der gemeinsam mit dem Führungsteam von Iambic Therapeutics verfasst wurde.

Iambische Therapeutik ist ein Startup für die Arzneimittelforschung mit der Mission, innovative KI-gesteuerte Technologien zu entwickeln, um Krebspatienten schneller bessere Medikamente zur Verfügung zu stellen.

Unsere fortschrittlichen generativen und prädiktiven Werkzeuge der künstlichen Intelligenz (KI) ermöglichen es uns, den riesigen Raum möglicher Arzneimittelmoleküle schneller und effektiver zu durchsuchen. Unsere Technologien sind vielseitig und über alle Therapiebereiche, Proteinklassen und Wirkmechanismen hinweg anwendbar. Über die Entwicklung differenzierter KI-Tools hinaus haben wir eine integrierte Plattform etabliert, die KI-Software, cloudbasierte Daten, skalierbare Recheninfrastruktur und Hochdurchsatz-Funktionen in den Bereichen Chemie und Biologie vereint. Die Plattform ermöglicht sowohl unsere KI – indem sie Daten zur Verfeinerung unserer Modelle liefert – als auch wird sie von ihr ermöglicht, indem sie Möglichkeiten zur automatisierten Entscheidungsfindung und Datenverarbeitung nutzt.

Wir messen den Erfolg an unserer Fähigkeit, in beispielloser Geschwindigkeit überlegene klinische Kandidaten hervorzubringen, die auf dringende Patientenbedürfnisse reagieren: Wir sind in nur 24 Monaten vom Programmstart zu klinischen Kandidaten gelangt, deutlich schneller als unsere Konkurrenten.

In diesem Beitrag konzentrieren wir uns darauf, wie wir es verwendet haben Karpenter on Amazon Elastic Kubernetes-Service (Amazon EKS) zur Skalierung von KI-Training und Inferenz, die Kernelemente der Iambic Discovery-Plattform sind.

Der Bedarf an skalierbarem KI-Training und Inferenz

Jede Woche führt Iambic KI-Inferenzen über Dutzende Modelle und Millionen Moleküle durch und bedient dabei zwei Hauptanwendungsfälle:

- Medizinische Chemiker und andere Wissenschaftler nutzen unsere Webanwendung Insight, um den chemischen Raum zu erkunden, auf experimentelle Daten zuzugreifen und diese zu interpretieren und Eigenschaften neu entwickelter Moleküle vorherzusagen. All diese Arbeiten werden interaktiv in Echtzeit durchgeführt, sodass eine Inferenz mit geringer Latenz und mittlerem Durchsatz erforderlich ist.

- Gleichzeitig entwerfen unsere generativen KI-Modelle automatisch Moleküle, die auf eine Verbesserung zahlreicher Eigenschaften abzielen, Millionen von Kandidaten durchsuchen und einen enormen Durchsatz und mittlere Latenz erfordern.

Unter der Leitung von KI-Technologien und erfahrenen Drogenjägern generiert unsere experimentelle Plattform jede Woche Tausende einzigartiger Moleküle, und jedes wird mehreren biologischen Tests unterzogen. Die generierten Datenpunkte werden automatisch verarbeitet und jede Woche zur Feinabstimmung unserer KI-Modelle verwendet. Anfangs nahm die Feinabstimmung unseres Modells Stunden an CPU-Zeit in Anspruch, daher war ein Framework zur Skalierung der Modell-Feinabstimmung auf GPUs unerlässlich.

Unsere Deep-Learning-Modelle haben nicht triviale Anforderungen: Sie sind Gigabyte groß, zahlreich und heterogen und erfordern GPUs für schnelle Inferenz und Feinabstimmung. Im Hinblick auf die Cloud-Infrastruktur benötigten wir ein System, das uns den Zugriff auf GPUs ermöglicht, schnell hoch- und herunterskaliert, um Spitzenlasten, heterogene Arbeitslasten zu bewältigen und große Docker-Images auszuführen.

Wir wollten ein skalierbares System zur Unterstützung von KI-Training und -Inferenz aufbauen. Wir nutzen Amazon EKS und waren auf der Suche nach der besten Lösung zur automatischen Skalierung unserer Worker-Knoten. Wir haben uns aus mehreren Gründen für Karpenter für die automatische Skalierung von Kubernetes-Knoten entschieden:

- Einfache Integration mit Kubernetes durch Verwendung der Kubernetes-Semantik zur Definition von Knotenanforderungen und Pod-Spezifikationen für die Skalierung

- Scale-out von Knoten mit geringer Latenz

- Einfache Integration mit unserer Infrastruktur als Code-Tool (Terraform)

Die Knotenbereitsteller unterstützen die mühelose Integration mit Amazon EKS und anderen AWS-Ressourcen wie z Amazon Elastic Compute-Cloud (Amazon EC2) Instanzen und Amazon Elastic Block-Shop Bände. Die von den Bereitstellern verwendete Kubernetes-Semantik unterstützt die gezielte Planung mithilfe von Kubernetes-Konstrukten wie Taints oder Toleranzen und Affinitäts- oder Anti-Affinitätsspezifikationen. Sie erleichtern auch die Kontrolle über die Anzahl und Art der GPU-Instanzen, die von Karpenter geplant werden können.

Lösungsüberblick

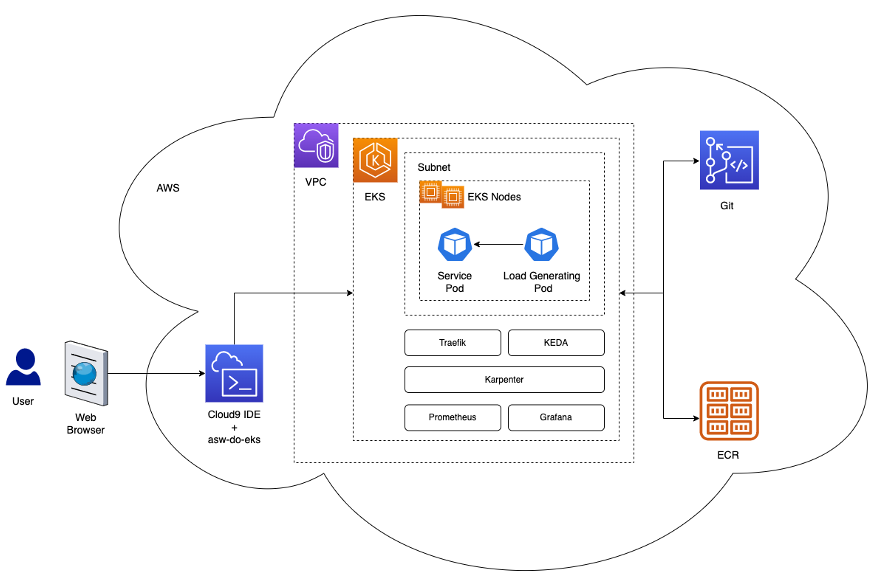

In diesem Abschnitt stellen wir eine generische Architektur vor, die derjenigen ähnelt, die wir für unsere eigenen Workloads verwenden, und die eine elastische Bereitstellung von Modellen mithilfe einer effizienten automatischen Skalierung auf der Grundlage benutzerdefinierter Metriken ermöglicht.

Das folgende Diagramm zeigt die Lösungsarchitektur.

Die Architektur stellt a bereit einfacher Service in einem Kubernetes-Pod innerhalb eines EKS-Cluster. Dies kann eine Modellinferenz, eine Datensimulation oder ein anderer Containerdienst sein, auf den über eine HTTP-Anfrage zugegriffen werden kann. Der Dienst wird hinter einem Reverse-Proxy bereitgestellt Traefik. Der Reverse-Proxy sammelt Metriken zu Aufrufen des Dienstes und stellt sie über eine Standard-Metrik-API bereit Prometheus. Der ereignisgesteuerte Kubernetes-Autoscaler (KEDA) ist so konfiguriert, dass die Anzahl der Service-Pods automatisch skaliert wird, basierend auf den benutzerdefinierten Metriken, die in Prometheus verfügbar sind. Hier verwenden wir die Anzahl der Anfragen pro Sekunde als benutzerdefinierte Metrik. Der gleiche Architekturansatz gilt, wenn Sie eine andere Metrik für Ihre Arbeitslast wählen.

Karpenter überwacht alle ausstehenden Pods, die aufgrund nicht ausreichender Ressourcen im Cluster nicht ausgeführt werden können. Wenn solche Pods erkannt werden, fügt Karpenter dem Cluster weitere Knoten hinzu, um die erforderlichen Ressourcen bereitzustellen. Wenn es umgekehrt mehr Knoten im Cluster gibt, als von den geplanten Pods benötigt werden, entfernt Karpenter einige der Worker-Knoten und die Pods werden neu geplant, wodurch sie auf weniger Instanzen konsolidiert werden. Die Anzahl der HTTP-Anfragen pro Sekunde und die Anzahl der Knoten können mithilfe von a visualisiert werden Grafana Armaturenbrett. Um die automatische Skalierung zu demonstrieren, führen wir einen oder mehrere aus einfache Last erzeugende Pods, die HTTP-Anfragen an den Dienst senden curl.

Lösungsbereitstellung

Im Schritt-für-Schritt-Anleitung, wir gebrauchen AWS Cloud9 als Umgebung zur Bereitstellung der Architektur. Dadurch können alle Schritte über einen Webbrowser ausgeführt werden. Sie können die Lösung auch von einem lokalen Computer oder einer EC2-Instanz aus bereitstellen.

Um den Einsatz zu vereinfachen und die Reproduzierbarkeit zu verbessern, folgen wir den Grundsätzen der Do-Framework und die Struktur der Depend-on-Docker-Vorlage. Wir klonen das aws-do-eks Projekt und, Verwendung Dockererstellen wir ein Container-Image, das mit den notwendigen Tools und Skripten ausgestattet ist. Innerhalb des Containers durchlaufen wir alle Schritte der End-to-End-Komplettlösung, von der Erstellung eines EKS-Clusters mit Karpenter bis zur Skalierung EC2-Instanzen.

Für das Beispiel in diesem Beitrag verwenden wir Folgendes EKS-Cluster-Manifest:

apiVersion: eksctl.io/v1alpha5

kind: ClusterConfig

metadata:

name: do-eks-yaml-karpenter

version: '1.28'

region: us-west-2

tags:

karpenter.sh/discovery: do-eks-yaml-karpenter

iam:

withOIDC: true

addons:

- name: aws-ebs-csi-driver

version: v1.26.0-eksbuild.1

wellKnownPolicies:

ebsCSIController: true

managedNodeGroups:

- name: c5-xl-do-eks-karpenter-ng

instanceType: c5.xlarge

instancePrefix: c5-xl

privateNetworking: true

minSize: 0

desiredCapacity: 2

maxSize: 10

volumeSize: 300

iam:

withAddonPolicies:

cloudWatch: true

ebs: trueDieses Manifest definiert einen Cluster mit dem Namen do-eks-yaml-karpenter mit dem als Add-on installierten EBS CSI-Treiber. Eine verwaltete Knotengruppe mit zwei c5.xlarge Knoten sind enthalten, um System-Pods auszuführen, die vom Cluster benötigt werden. Die Worker-Knoten werden in privaten Subnetzen gehostet und der Cluster-API-Endpunkt ist standardmäßig öffentlich.

Sie können auch einen vorhandenen EKS-Cluster verwenden, anstatt einen zu erstellen. Wir setzen Karpenter ein, indem wir dem folgen Anleitung in der Karpenter-Dokumentation oder indem Sie Folgendes ausführen Skript, wodurch die Bereitstellungsanweisungen automatisiert werden.

Der folgende Code zeigt die Karpenter-Konfiguration, die wir in diesem Beispiel verwenden:

apiVersion: karpenter.sh/v1beta1

kind: NodePool

metadata:

name: default

spec:

template:

metadata: null

labels:

cluster-name: do-eks-yaml-karpenter

annotations:

purpose: karpenter-example

spec:

nodeClassRef:

apiVersion: karpenter.k8s.aws/v1beta1

kind: EC2NodeClass

name: default

requirements:

- key: karpenter.sh/capacity-type

operator: In

values:

- spot

- on-demand

- key: karpenter.k8s.aws/instance-category

operator: In

values:

- c

- m

- r

- g

- p

- key: karpenter.k8s.aws/instance-generation

operator: Gt

values:

- '2'

disruption:

consolidationPolicy: WhenUnderutilized

#consolidationPolicy: WhenEmpty

#consolidateAfter: 30s

expireAfter: 720h

---

apiVersion: karpenter.k8s.aws/v1beta1

kind: EC2NodeClass

metadata:

name: default

spec:

amiFamily: AL2

subnetSelectorTerms:

- tags:

karpenter.sh/discovery: "do-eks-yaml-karpenter"

securityGroupSelectorTerms:

- tags:

karpenter.sh/discovery: "do-eks-yaml-karpenter"

role: "KarpenterNodeRole-do-eks-yaml-karpenter"

tags:

app: autoscaling-test

blockDeviceMappings:

- deviceName: /dev/xvda

ebs:

volumeSize: 80Gi

volumeType: gp3

iops: 10000

deleteOnTermination: true

throughput: 125

detailedMonitoring: trueWir definieren einen Standard-Karpenter-NodePool mit den folgenden Anforderungen:

- Karpenter kann Instanzen von beiden starten

spotmachenon-demandKapazitätspools - Instanzen müssen aus der Kategorie „

c” (rechneroptimiert), „m" (allgemeiner Zweck), "r” (speicheroptimiert) oder „g" und "p” (GPU-beschleunigte) Computerfamilien - Die Instanzgenerierung muss größer als 2 sein; Zum Beispiel,

g3ist akzeptabel, aberg2ist nicht

Der Standard-NodePool definiert auch Störungsrichtlinien. Nicht ausgelastete Knoten werden entfernt, sodass Pods konsolidiert werden können, um auf weniger oder kleineren Knoten ausgeführt zu werden. Alternativ können wir leere Knoten so konfigurieren, dass sie nach dem angegebenen Zeitraum entfernt werden. Der expireAfter Die Einstellung gibt die maximale Lebensdauer eines Knotens an, bevor er gestoppt und bei Bedarf ersetzt wird. Dies trägt dazu bei, Sicherheitslücken zu reduzieren und Probleme zu vermeiden, die für Knoten mit langen Betriebszeiten typisch sind, wie etwa Dateifragmentierung oder Speicherlecks.

Standardmäßig stellt Karpenter Knoten mit einem kleinen Root-Volume bereit, das für die Ausführung von KI- oder Machine-Learning-Workloads (ML) möglicherweise nicht ausreicht. Einige der Deep-Learning-Container-Images können mehrere zehn GB groß sein, und wir müssen sicherstellen, dass auf den Knoten genügend Speicherplatz vorhanden ist, um Pods mit diesen Images auszuführen. Dazu definieren wir EC2NodeClass mit blockDeviceMappings, wie im vorherigen Code gezeigt.

Karpenter ist für die automatische Skalierung auf Clusterebene verantwortlich. Um die automatische Skalierung auf Pod-Ebene zu konfigurieren, verwenden wir KEDA, um eine benutzerdefinierte Ressource namens „ ScaledObject, wie im folgenden Code gezeigt:

apiVersion: keda.sh/v1alpha1

kind: ScaledObject

metadata:

name: keda-prometheus-hpa

namespace: hpa-example

spec:

scaleTargetRef:

name: php-apache

minReplicaCount: 1

cooldownPeriod: 30

triggers:

- type: prometheus

metadata:

serverAddress: http://prometheus- server.prometheus.svc.cluster.local:80

metricName: http_requests_total

threshold: '1'

query: rate(traefik_service_requests_total{service="hpa-example-php-apache-80@kubernetes",code="200"}[2m])Das vorangehende Manifest definiert a ScaledObject namens keda-prometheus-hpa, das für die Skalierung der PHP-Apache-Bereitstellung verantwortlich ist und immer mindestens ein Replikat am Laufen hält. Es skaliert die Pods dieser Bereitstellung basierend auf der Metrik http_requests_total Verfügbar in Prometheus, abgerufen durch die angegebene Abfrage, und zielt darauf ab, die Pods so zu skalieren, dass jeder Pod nicht mehr als eine Anfrage pro Sekunde bedient. Die Replikate werden herunterskaliert, wenn die Anforderungslast länger als 30 Sekunden unter dem Schwellenwert liegt.

Das Bereitstellungsspezifikation Für unseren Beispieldienst ist Folgendes enthalten Ressourcenanforderungen und -grenzen:

resources:

limits:

cpu: 500m

nvidia.com/gpu: 1

requests:

cpu: 200m

nvidia.com/gpu: 1Bei dieser Konfiguration verwendet jeder Service-Pod genau eine NVIDIA-GPU. Wenn neue Pods erstellt werden, befinden sie sich im Status „Ausstehend“, bis eine GPU verfügbar ist. Karpenter fügt dem Cluster nach Bedarf GPU-Knoten hinzu, um die ausstehenden Pods aufzunehmen.

A lasterzeugender Pod sendet HTTP-Anfragen mit einer voreingestellten Häufigkeit an den Dienst. Wir erhöhen die Anzahl der Anfragen, indem wir die Anzahl der Replikate im erhöhen Lastgenerator-Bereitstellung.

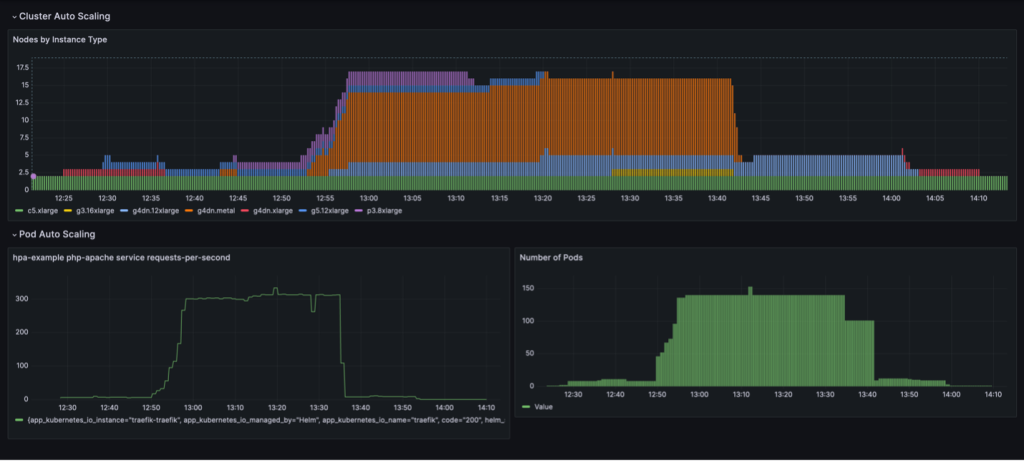

Ein vollständiger Skalierungszyklus mit nutzungsbasierter Knotenkonsolidierung wird in einem Grafana-Dashboard visualisiert. Das folgende Dashboard zeigt die Anzahl der Knoten im Cluster nach Instanztyp (oben), die Anzahl der Anfragen pro Sekunde (unten links) und die Anzahl der Pods (unten rechts).

Wir beginnen nur mit den beiden c5.xlarge-CPU-Instanzen, mit denen der Cluster erstellt wurde. Dann stellen wir eine Dienstinstanz bereit, die eine einzelne GPU erfordert. Karpenter fügt eine g4dn.xlarge-Instanz hinzu, um diesem Bedarf gerecht zu werden. Anschließend stellen wir den Lastgenerator bereit, was dazu führt, dass KEDA weitere Service-Pods hinzufügt und Karpenter weitere GPU-Instanzen hinzufügt. Nach der Optimierung liegt der Status bei einer p3.8xlarge-Instanz mit 8 GPUs und einer g5.12xlarge-Instanz mit 4 GPUs.

Wenn wir die lastgenerierende Bereitstellung auf 40 Replikate skalieren, erstellt KEDA zusätzliche Service-Pods, um die erforderliche Anforderungslast pro Pod aufrechtzuerhalten. Karpenter fügt dem Cluster die Knoten g4dn.metal und g4dn.12xlarge hinzu, um die benötigten GPUs für die zusätzlichen Pods bereitzustellen. Im skalierten Zustand enthält der Cluster 16 GPU-Knoten und bedient etwa 300 Anfragen pro Sekunde. Wenn wir den Lastgenerator auf 1 Replikat verkleinern, findet der umgekehrte Vorgang statt. Nach der Abklingzeit reduziert KEDA die Anzahl der Service-Pods. Wenn dann weniger Pods ausgeführt werden, entfernt Karpenter die nicht ausgelasteten Knoten aus dem Cluster und die Service-Pods werden konsolidiert, um auf weniger Knoten ausgeführt zu werden. Wenn der Lastgenerator-Pod entfernt wird, bleibt ein einzelner Dienst-Pod auf einer einzelnen g4dn.xlarge-Instanz mit 1 GPU aktiv. Wenn wir auch den Service-Pod entfernen, verbleibt der Cluster im Ausgangszustand mit nur zwei CPU-Knoten.

Wir können dieses Verhalten beobachten, wenn die NodePool hat die Einstellung consolidationPolicy: WhenUnderutilized.

Mit dieser Einstellung konfiguriert Karpenter den Cluster dynamisch mit so wenigen Knoten wie möglich und stellt gleichzeitig ausreichend Ressourcen für die Ausführung aller Pods bereit und minimiert gleichzeitig die Kosten.

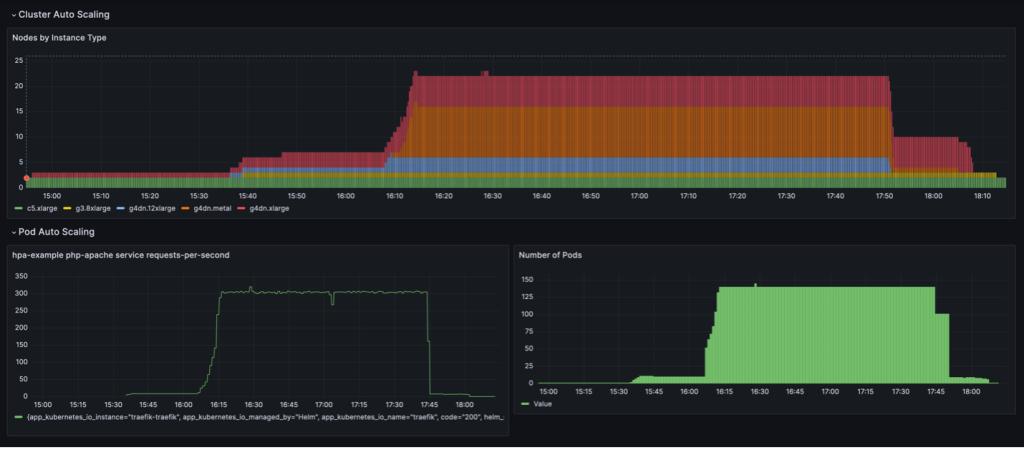

Das im folgenden Dashboard gezeigte Skalierungsverhalten wird beobachtet, wenn die NodePool Die Konsolidierungsrichtlinie ist festgelegt WhenEmpty, zusammen mit consolidateAfter: 30s.

In diesem Szenario werden Knoten nur dann gestoppt, wenn nach der Abkühlphase keine Pods auf ihnen ausgeführt werden. Die Skalierungskurve erscheint im Vergleich zur auslastungsbasierten Konsolidierungspolitik glatt; Es ist jedoch zu erkennen, dass im skalierten Zustand mehr Knoten verwendet werden (22 vs. 16).

Insgesamt stellt die Kombination der automatischen Pod- und Cluster-Skalierung sicher, dass der Cluster dynamisch mit der Arbeitslast skaliert, Ressourcen bei Bedarf zuweist und bei Nichtgebrauch entfernt, wodurch die Auslastung maximiert und die Kosten minimiert werden.

Outcomes

Iambic nutzte diese Architektur, um die effiziente Nutzung von GPUs auf AWS zu ermöglichen und Arbeitslasten von der CPU auf die GPU zu migrieren. Durch die Verwendung von EC2-GPU-basierten Instanzen, Amazon EKS und Karpenter konnten wir eine schnellere Inferenz für unsere physikbasierten Modelle und schnelle Experimentiterationszeiten für angewandte Wissenschaftler ermöglichen, die auf Training als Service angewiesen sind.

Die folgende Tabelle fasst einige der Zeitmetriken dieser Migration zusammen.

| Aufgabe | CPUs | GPUs |

| Inferenz mithilfe von Diffusionsmodellen für physikbasierte ML-Modelle | 3,600 Sekunden |

100 Sekunden (aufgrund der inhärenten Stapelverarbeitung von GPUs) |

| ML-Modellschulung als Dienstleistung | 180 Мinuten | 4 Мinuten |

Die folgende Tabelle fasst einige unserer Zeit- und Kostenkennzahlen zusammen.

| Aufgabe | Leistung/Kosten | |

| CPUs | GPUs | |

| ML-Modelltraining |

240 Мinuten durchschnittlich 0.70 $ pro Trainingsaufgabe |

20 Мinuten durchschnittlich 0.38 $ pro Trainingsaufgabe |

Zusammenfassung

In diesem Beitrag haben wir gezeigt, wie Iambic Karpenter und KEDA verwendet hat, um unsere Amazon EKS-Infrastruktur zu skalieren, um die Latenzanforderungen unserer KI-Inferenz- und Trainings-Workloads zu erfüllen. Karpenter und KEDA sind leistungsstarke Open-Source-Tools, die bei der automatischen Skalierung von EKS-Clustern und darauf ausgeführten Workloads helfen. Dies trägt dazu bei, die Rechenkosten zu optimieren und gleichzeitig die Leistungsanforderungen zu erfüllen. Sie können den Code ausprobieren und dieselbe Architektur in Ihrer eigenen Umgebung bereitstellen, indem Sie der vollständigen Anleitung hier folgen GitHub Repo.

Über die Autoren

Matthew Welborn ist Direktor für maschinelles Lernen bei Iambic Therapeutics. Er und sein Team nutzen KI, um die Identifizierung und Entwicklung neuartiger Therapeutika zu beschleunigen und lebensrettende Medikamente schneller zu den Patienten zu bringen.

Matthew Welborn ist Direktor für maschinelles Lernen bei Iambic Therapeutics. Er und sein Team nutzen KI, um die Identifizierung und Entwicklung neuartiger Therapeutika zu beschleunigen und lebensrettende Medikamente schneller zu den Patienten zu bringen.

Paul Whittemore ist leitender Ingenieur bei Iambic Therapeutics. Er unterstützt die Bereitstellung der Infrastruktur für die KI-gesteuerte Arzneimittelforschungsplattform Iambic.

Paul Whittemore ist leitender Ingenieur bei Iambic Therapeutics. Er unterstützt die Bereitstellung der Infrastruktur für die KI-gesteuerte Arzneimittelforschungsplattform Iambic.

Alex Iankoulski ist Principal Solutions Architect, ML/AI Frameworks, der sich darauf konzentriert, Kunden bei der Orchestrierung ihrer KI-Workloads mithilfe von Containern und beschleunigter Recheninfrastruktur auf AWS zu unterstützen.

Alex Iankoulski ist Principal Solutions Architect, ML/AI Frameworks, der sich darauf konzentriert, Kunden bei der Orchestrierung ihrer KI-Workloads mithilfe von Containern und beschleunigter Recheninfrastruktur auf AWS zu unterstützen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/scale-ai-training-and-inference-for-drug-discovery-through-amazon-eks-and-karpenter/

- :hast

- :Ist

- :nicht

- ][P

- $UP

- 1

- 10

- 100

- 125

- 16

- 200

- 200m

- 22

- 24

- 26%

- 28

- 30

- 300

- 40

- 600

- 7

- 70

- 8

- 80

- a

- Fähigkeit

- Fähig

- Über uns

- beschleunigen

- beschleunigt

- akzeptabel

- Zugang

- zugänglich

- unterbringen

- über

- Action

- hinzufügen

- Erweiterung

- Zusätzliche

- Adresse

- Fügt

- advanced

- Affinität

- Nach der

- AI

- KI-Modelle

- KI-Training

- Alle

- erlaubt

- entlang

- ebenfalls

- immer

- Amazon

- Amazon EC2

- Amazon Web Services

- an

- machen

- jedem

- Bienen

- App

- erscheint

- anwendbar

- Anwendung

- angewandt

- gilt

- Ansatz

- architektonisch

- Architektur

- SIND

- Bereiche

- künstlich

- künstliche Intelligenz

- Künstliche Intelligenz (AI)

- AS

- At

- Auto

- Automatisiert

- Automatisches Erfassen:

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- vermeiden

- AWS

- basierend

- Dosierung

- BE

- war

- Bevor

- Verhalten

- hinter

- unten

- BESTE

- Besser

- Beyond

- Biologie

- Blockieren

- beide

- Boden

- bringen

- Bringing

- Browser

- bauen

- aber

- by

- namens

- Aufrufe

- CAN

- Krebs

- Kandidaten

- Fähigkeiten

- Kapazität

- Aktivierung

- Fälle

- Ursachen

- aus der Ferne überprüfen

- chemisch

- Chemie

- Auswählen

- wählten

- Unterricht

- Klinische

- Cloud

- Cloud-Infrastruktur

- Cluster

- Code

- sammelt

- Vereinigung

- verglichen

- Konkurrenz

- abschließen

- Abgeschlossene Verkäufe

- Berechnung

- Berechnen

- Computer

- Computing

- Konfiguration

- konfiguriert

- konsolidieren

- Festigung

- Konstrukte

- Container

- Behälter

- enthält

- Smartgeräte App

- umgekehrt

- Abklingzeit

- Kernbereich

- Kosten

- Kosten

- könnte

- erstellen

- erstellt

- schafft

- Erstellen

- CSI

- Kurve

- Original

- Kunden

- Zyklus

- Armaturenbrett

- technische Daten

- Datenpunkte

- Datenverarbeitung

- Decision Making

- tief

- tiefe Lernen

- Standard

- definieren

- Definiert

- Lieferanten

- zeigen

- einsetzen

- Einsatz

- setzt ein

- Design

- entworfen

- erkannt

- Entwicklung

- Diagramm

- anders

- differenziert

- Rundfunk

- gerichtet

- Direktor

- Entdeckung

- Störung

- do

- Docker

- Dokumentation

- erledigt

- nach unten

- Dutzende

- angetrieben

- Fahrer

- Medikament

- zwei

- dynamisch

- jeder

- effektiv

- effizient

- mühelos

- Elemente

- ermöglichen

- freigegeben

- ermöglicht

- End-to-End

- Endpunkt

- Ingenieur

- enorm

- genug

- Arbeitsumfeld

- ausgestattet

- etablierten

- Event

- Jedes

- genau

- Beispiel

- vorhandenen

- Experiment

- experimentell

- Experte

- ERKUNDEN

- ausgesetzt

- erleichtern

- FAST

- beschleunigt

- wenige

- Weniger

- Reichen Sie das

- Setzen Sie mit Achtsamkeit

- konzentriert

- folgen

- Folgende

- Aussichten für

- Zersplitterung

- Unser Ansatz

- Gerüste

- Frequenz

- für

- voller

- Allgemeines

- erzeugt

- erzeugt

- Generation

- generativ

- Generative KI

- Generator

- bekommen

- GPU

- GPUs

- mehr

- Gruppe an

- GUEST

- Guest Post

- Griff

- Haben

- he

- Hilfe

- Unternehmen

- hilft

- hier

- seine

- gehostet

- STUNDEN

- Ultraschall

- aber

- http

- HTTPS

- Login

- if

- zeigt

- Image

- Bilder

- Imperativ

- zu unterstützen,

- Verbesserung

- in

- inklusive

- Erhöhung

- zunehmend

- Infrastruktur

- inhärent

- Anfangs-

- anfänglich

- innovativ

- Einblick

- installiert

- Instanz

- beantragen müssen

- Anleitung

- integriert

- Integration

- Intelligenz

- interpretieren

- Probleme

- IT

- Iteration

- jpg

- nur

- hält

- Wesentliche

- Art

- Etiketten

- Mangel

- grosse

- Latency

- starten

- Leadership

- Undichtigkeiten

- lernen

- am wenigsten

- links

- Niveau

- Hebelwirkung

- Lebensdauer

- Grenzen

- Belastung

- aus einer regionalen

- Lang

- länger

- suchen

- Sneaker

- Maschine

- Maschinelles Lernen

- halten

- um

- MACHT

- verwaltet

- Maximierung

- maximal

- Kann..

- messen

- Mechanismen

- mittlere

- Triff

- Treffen

- Memory

- verschmilzt

- Metadaten

- Metall

- Metrisch

- Metrik

- migriert

- Migration

- Millionen

- minimieren

- Ziel

- ML

- Modell

- für

- Monitore

- Monat

- mehr

- mehrere

- sollen

- Name

- Namens

- notwendig,

- Need

- erforderlich

- Neu

- neu

- nicht

- Knoten

- Fiber Node

- Roman

- Anzahl

- und viele

- Nvidia

- beobachten

- erhalten

- of

- on

- On-Demand

- EINEM

- einzige

- XNUMXh geöffnet

- Open-Source-

- Operator

- Entwicklungsmöglichkeiten

- Optimierung

- Optimieren

- optimiert

- or

- Andere

- UNSERE

- übrig

- besitzen

- Vertrauen bei Patienten

- Patienten

- schwebend

- für

- Leistung

- führt

- Zeit

- Ort

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- Punkte

- Politik durchzulesen

- Datenschutzrichtlinien

- möglich

- Post

- angetriebene

- größte treibende

- vor

- vorhersagen

- Gegenwart

- primär

- Principal

- Grundsätze

- privat

- Prozessdefinierung

- Verarbeitet

- Verarbeitung

- produziert

- Programm

- Projekt

- immobilien

- Proteine

- die

- Bereitstellung

- Stellvertreter

- Öffentlichkeit

- Zweck

- query

- schnell

- R

- echt

- Echtzeit

- Gründe

- Veteran

- reduziert

- verfeinern

- Region

- verlassen

- bleibt bestehen

- entfernen

- Entfernt

- entfernt

- Entfernen

- ersetzt

- antworten

- Anforderung

- Zugriffe

- erfordern

- falls angefordert

- Voraussetzungen:

- erfordert

- Ressourcen

- Downloads

- für ihren Verlust verantwortlich.

- rückgängig machen

- Recht

- Rollen

- Wurzel

- Führen Sie

- Laufen

- gleich

- skalierbaren

- Skalieren

- Skala ai

- skaliert

- Waage

- Skalierung

- Szenario

- vorgesehen

- Planung

- Wissenschaftler

- Skripte

- Suche

- Suche

- Zweite

- Sekunden

- Abschnitt

- Sicherheitdienst

- gesehen

- Semantik

- senden

- sendet

- Server

- dient

- Dienstleistungen

- Dienst

- kompensieren

- Einstellung

- siedelt sich an

- präsentiert

- gezeigt

- Konzerte

- bedeutend

- ähnlich

- vereinfachen

- Simulation

- Single

- Größe

- klein

- kleinere

- glätten

- So

- Software

- Lösung

- Lösungen

- einige

- Quelle

- Raumfahrt

- Spezifikationen

- angegeben

- Spezifikation

- Geschwindigkeit

- Spot

- Standard

- Anfang

- Anfang

- Bundesstaat

- Shritte

- gestoppt

- Lagerung

- Struktur

- Subnetze

- Erfolg

- so

- ausreichend

- Oberteil

- Zuführung

- Support

- Unterstützt

- sicher

- SVC

- System

- Tabelle

- nimmt

- Targeting

- Ziele

- Team

- Technologies

- Vorlage

- Zehn

- Terraform

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Der Staat

- ihr

- Sie

- dann

- Therapeutika

- Dort.

- damit

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- Tausende

- Schwelle

- Durch

- Durchsatz

- Zeit

- mal

- zu

- nahm

- Werkzeuge

- Top

- Ausbildung

- was immer dies auch sein sollte.

- XNUMX

- tippe

- Typen

- typisch

- einzigartiges

- beispiellos

- bis

- Betriebszeiten

- dringend

- us

- -

- benutzt

- Verwendung von

- v1

- Werte

- riesig

- vielseitig

- Version

- Volumen

- Volumen

- vs

- Sicherheitslücken

- Walkthrough

- wollte

- wurde

- we

- Netz

- Internetanwendung

- Web-Browser

- Web-Services

- Woche

- GUT

- waren

- Was

- Was ist

- wann

- welche

- während

- WHO

- werden wir

- mit

- .

- Arbeiten

- Arbeiter

- YAML

- Du

- Ihr

- Zephyrnet