In Teil 1 In dieser Serie stellten wir eine Lösung vor, die das nutzte Multimodale Einbettungen von Amazon Titan Modell zum Konvertieren einzelner Folien aus einem Folienstapel in Einbettungen. Wir haben die Einbettungen in einer Vektordatenbank gespeichert und dann verwendet Großer Sprach- und Sehassistent (LLaVA 1.5-7b) Modell zum Generieren von Textantworten auf Benutzerfragen basierend auf der ähnlichsten Folie, die aus der Vektordatenbank abgerufen wurde. Wir haben AWS-Dienste genutzt, darunter Amazonas Grundgestein, Amazon Sage Maker und Amazon OpenSearch ohne Server in dieser Lösung.

In diesem Beitrag zeigen wir einen anderen Ansatz. Wir benutzen das Anthropisches Claude 3 Sonett Modell zum Generieren von Textbeschreibungen für jede Folie im Foliendeck. Diese Beschreibungen werden dann mithilfe von in Texteinbettungen umgewandelt Amazon Titan-Texteinbettungen modelliert und in einer Vektordatenbank gespeichert. Anschließend verwenden wir das Claude-3-Sonett-Modell, um Antworten auf Benutzerfragen basierend auf der relevantesten Textbeschreibung aus der Vektordatenbank zu generieren.

Sie können beide Ansätze für Ihren Datensatz testen und die Ergebnisse auswerten, um zu sehen, welcher Ansatz die besten Ergebnisse liefert. In Teil 3 dieser Serie werten wir die Ergebnisse beider Methoden aus.

Lösungsüberblick

Die Lösung bietet eine Implementierung zur Beantwortung von Fragen mithilfe von Informationen, die in Text- und visuellen Elementen eines Foliendecks enthalten sind. Das Design basiert auf dem Konzept der Retrieval Augmented Generation (RAG). Traditionell wird RAG mit Textdaten in Verbindung gebracht, die von großen Sprachmodellen (LLMs) verarbeitet werden können. In dieser Serie erweitern wir RAG auch um Bilder. Dies bietet eine leistungsstarke Suchfunktion, um kontextrelevante Inhalte aus visuellen Elementen wie Tabellen und Grafiken zusammen mit Text zu extrahieren.

Diese Lösung umfasst die folgenden Komponenten:

- Amazon Titan Text Embeddings ist ein Texteinbettungsmodell, das Text in natürlicher Sprache, einschließlich einzelner Wörter, Phrasen oder sogar großer Dokumente, in numerische Darstellungen umwandelt, die für Anwendungsfälle wie Suche, Personalisierung und Clustering basierend auf semantischer Ähnlichkeit verwendet werden können.

- Claude 3 Sonnet ist die nächste Generation hochmoderner Modelle von Anthropic. Sonnet ist ein vielseitiges Tool, das ein breites Spektrum an Aufgaben bewältigen kann, von komplexen Überlegungen und Analysen bis hin zu schnellen Ausgaben sowie der effizienten Suche und dem Abruf großer Informationsmengen.

- OpenSearch Serverless ist eine serverlose On-Demand-Konfiguration für Amazon OpenSearch Service. Wir verwenden OpenSearch Serverless als Vektordatenbank zum Speichern von Einbettungen, die vom Amazon Titan Text Embeddings-Modell generiert wurden. Ein in der OpenSearch Serverless-Sammlung erstellter Index dient als Vektorspeicher für unsere RAG-Lösung.

- Amazon OpenSearch-Aufnahme (OSI) ist ein vollständig verwalteter, serverloser Datensammler, der Daten an OpenSearch Service-Domänen und serverlose OpenSearch-Sammlungen liefert. In diesem Beitrag verwenden wir eine OSI-Pipeline-API, um Daten an den OpenSearch Serverless-Vektorspeicher zu liefern.

Das Lösungsdesign besteht aus zwei Teilen: Aufnahme und Benutzerinteraktion. Während der Aufnahme verarbeiten wir den Eingabe-Foliensatz, indem wir jede Folie in ein Bild umwandeln und Beschreibungen und Texteinbettungen für jedes Bild generieren. Anschließend füllen wir den Vektordatenspeicher mit den Einbettungen und der Textbeschreibung für jede Folie. Diese Schritte werden vor den Schritten zur Benutzerinteraktion abgeschlossen.

In der Benutzerinteraktionsphase wird eine Frage des Benutzers in Texteinbettungen umgewandelt. In der Vektordatenbank wird eine Ähnlichkeitssuche durchgeführt, um eine Textbeschreibung zu finden, die einer Folie entspricht und möglicherweise Antworten auf die Benutzerfrage enthalten könnte. Anschließend stellen wir die Folienbeschreibung und die Benutzerfrage dem Claude 3 Sonnet-Modell zur Verfügung, um eine Antwort auf die Anfrage zu generieren. Der gesamte Code für diesen Beitrag ist im verfügbar GitHub Repo.

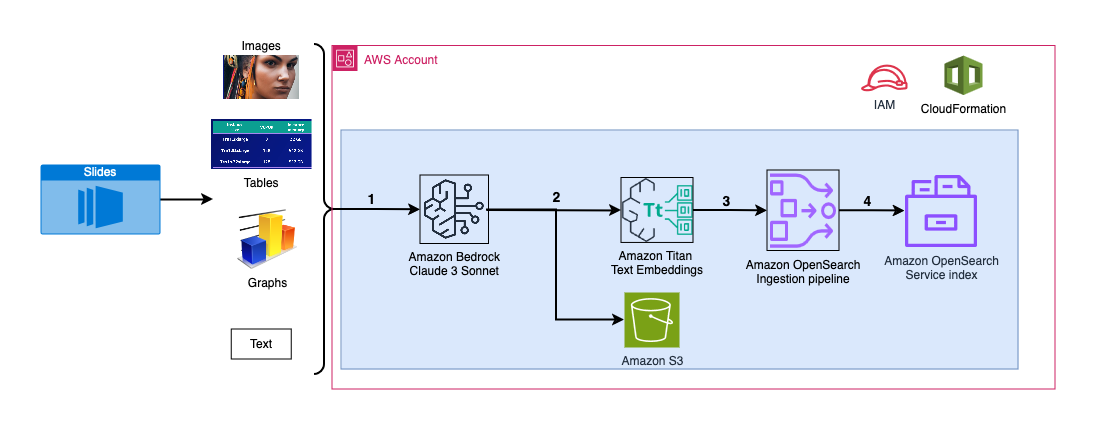

Das folgende Diagramm veranschaulicht die Aufnahmearchitektur.

Der Arbeitsablauf besteht aus den folgenden Schritten:

- Folien werden in Bilddateien (eine pro Folie) im JPG-Format konvertiert und an das Claude 3 Sonnet-Modell übergeben, um eine Textbeschreibung zu generieren.

- Die Daten werden an das Amazon Titan Text Embeddings-Modell gesendet, um Einbettungen zu generieren. In dieser Serie verwenden wir das Slide-Deck Trainieren und implementieren Sie Stable Diffusion mit AWS Trainium und AWS Inferentia vom AWS Summit in Toronto, Juni 2023, um die Lösung zu demonstrieren. Das Beispieldeck verfügt über 31 Folien, daher generieren wir 31 Sätze Vektoreinbettungen mit jeweils 1536 Dimensionen. Wir fügen zusätzliche Metadatenfelder hinzu, um umfangreiche Suchabfragen mithilfe der leistungsstarken Suchfunktionen von OpenSearch durchzuführen.

- Die Einbettungen werden über einen API-Aufruf in eine OSI-Pipeline aufgenommen.

- Die OSI-Pipeline nimmt die Daten als Dokumente in einen OpenSearch Serverless-Index auf. Der Index ist als Senke für diese Pipeline konfiguriert und wird als Teil der OpenSearch Serverless-Sammlung erstellt.

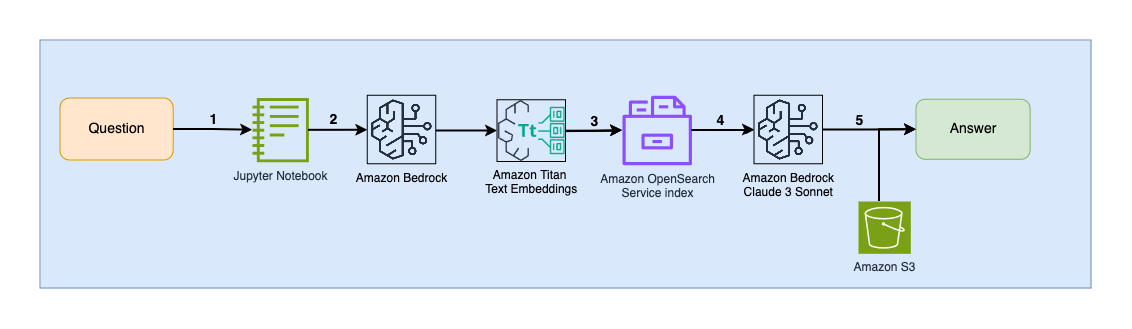

Das folgende Diagramm veranschaulicht die Benutzerinteraktionsarchitektur.

Der Arbeitsablauf besteht aus den folgenden Schritten:

- Ein Benutzer sendet eine Frage im Zusammenhang mit dem aufgenommenen Foliensatz.

- Die Benutzereingaben werden mithilfe des Amazon Titan Text Embeddings-Modells, auf das über Amazon Bedrock zugegriffen wird, in Einbettungen umgewandelt. Mithilfe dieser Einbettungen wird eine OpenSearch Service-Vektorsuche durchgeführt. Wir führen eine k-NN-Suche (k-Nearest Neighbor) durch, um die relevantesten Einbettungen abzurufen, die der Benutzeranfrage entsprechen.

- Die Metadaten der Antwort von OpenSearch Serverless enthalten einen Pfad zum Bild und eine Beschreibung, die der relevantesten Folie entsprechen.

- Durch die Kombination der Benutzerfrage und der Bildbeschreibung wird eine Eingabeaufforderung erstellt. Die Eingabeaufforderung wird an Claude 3 Sonnet gesendet, das auf Amazon Bedrock gehostet wird.

- Das Ergebnis dieser Schlussfolgerung wird an den Benutzer zurückgegeben.

Wir besprechen die Schritte für beide Phasen in den folgenden Abschnitten und geben Details zur Ausgabe an.

Voraussetzungen:

Um die in diesem Beitrag bereitgestellte Lösung zu implementieren, sollten Sie über eine AWS-Konto und Vertrautheit mit FMs, Amazon Bedrock, SageMaker und OpenSearch Service.

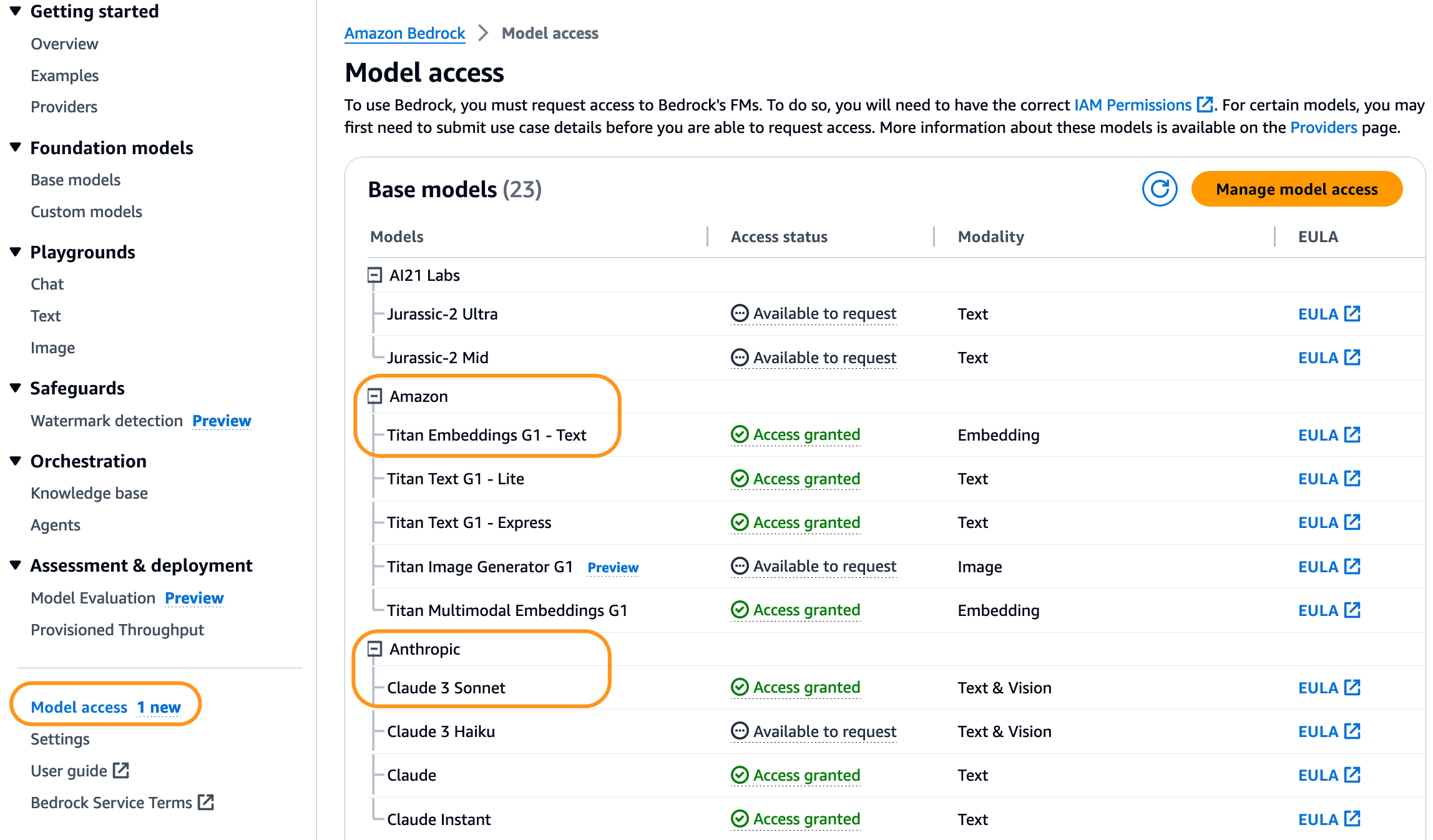

Diese Lösung nutzt die auf Amazon Bedrock gehosteten Modelle Claude 3 Sonnet und Amazon Titan Text Embeddings. Stellen Sie sicher, dass diese Modelle für die Verwendung aktiviert sind, indem Sie zu navigieren Modellzugriff Seite auf der Amazon Bedrock-Konsole.

Wenn Modelle aktiviert sind, wird die Zugriffsstatus wird sagen Zugang gewährt.

Wenn die Modelle nicht verfügbar sind, aktivieren Sie den Zugriff, indem Sie wählen Modellzugriff verwalten, Auswahl der Modelle und Auswahl Modellzugang anfordern. Die Modelle sind sofort einsatzbereit.

Verwenden Sie AWS CloudFormation, um den Lösungsstapel zu erstellen

Sie können AWS CloudFormation verwenden, um den Lösungsstapel zu erstellen. Wenn Sie die Lösung für Teil 1 im selben AWS-Konto erstellt haben, löschen Sie dieses unbedingt, bevor Sie diesen Stack erstellen.

| AWS-Region | Link |

|---|---|

us-east-1 |

|

us-west-2 |

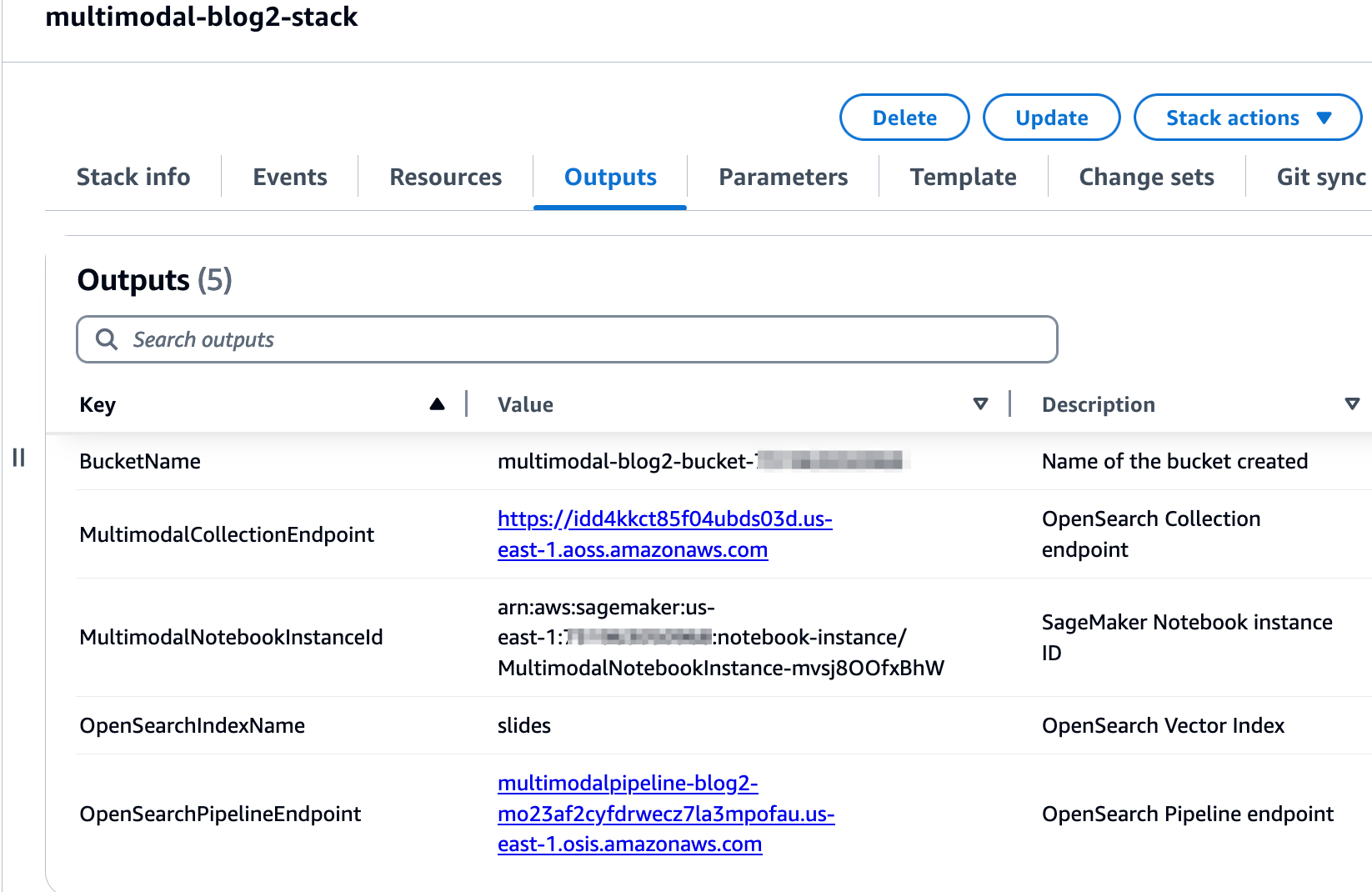

Nachdem der Stack erfolgreich erstellt wurde, navigieren Sie zur Registerkarte „Ausgaben“ des Stacks in der AWS CloudFormation-Konsole und notieren Sie sich die Werte für MultimodalCollectionEndpoint machen OpenSearchPipelineEndpoint. Diese verwenden Sie in den folgenden Schritten.

Die CloudFormation-Vorlage erstellt die folgenden Ressourcen:

- IAM-Rollen - Die folgende AWS Identity and Access Management and (IAM-)Rollen werden erstellt. Aktualisieren Sie diese Rollen, um Berechtigungen mit den geringsten Rechten anzuwenden, wie in beschrieben Bewährte Sicherheitsmethoden.

SMExecutionRolemit Amazon Simple Storage-Service (Amazon S3), SageMaker, OpenSearch Service und Amazon Bedrock voller Zugriff.OSPipelineExecutionRolemit Zugriff auf den S3-Bucket und OSI-Aktionen.

- SageMaker-Notizbuch – Der gesamte Code für diesen Beitrag wird mit diesem Notebook ausgeführt.

- Serverlose OpenSearch-Sammlung – Dies ist die Vektordatenbank zum Speichern und Abrufen von Einbettungen.

- OSI-Pipeline – Dies ist die Pipeline für die Datenaufnahme in OpenSearch Serverless.

- S3-Eimer – Alle Daten für diesen Beitrag werden in diesem Bucket gespeichert.

Die CloudFormation-Vorlage richtet die Pipeline-Konfiguration ein, die zum Konfigurieren der OSI-Pipeline mit HTTP als Quelle und dem OpenSearch Serverless-Index als Senke erforderlich ist. Das SageMaker-Notizbuch 2_data_ingestion.ipynb Zeigt an, wie Daten mithilfe von in die Pipeline aufgenommen werden Anfragen HTTP-Bibliothek.

Die CloudFormation-Vorlage erstellt auch Netzwerk, Verschlüsselung machen Datenzugriff Richtlinien, die für Ihre OpenSearch Serverless-Sammlung erforderlich sind. Aktualisieren Sie diese Richtlinien, um Berechtigungen mit den geringsten Rechten anzuwenden.

Auf den Namen der CloudFormation-Vorlage und den Indexnamen des OpenSearch-Service wird im SageMaker-Notizbuch verwiesen 3_rag_inference.ipynb. Wenn Sie die Standardnamen ändern, stellen Sie sicher, dass Sie diese im Notizbuch aktualisieren.

Testen Sie die Lösung

Nachdem Sie den CloudFormation-Stack erstellt haben, können Sie die Lösung testen. Führen Sie die folgenden Schritte aus:

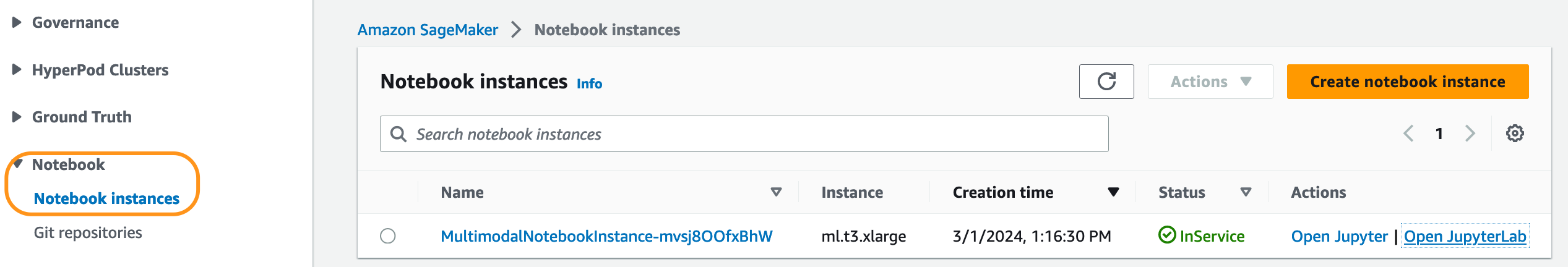

- Wählen Sie in der SageMaker-Konsole Notizbücher im Navigationsbereich.

- Auswählen

MultimodalNotebookInstanceund wählen Sie Öffnen Sie JupyterLab.

- In Datei-Browser, wechseln Sie zum Ordner „Notebooks“, um Notizbücher und unterstützende Dateien anzuzeigen.

Die Notebooks werden in der Reihenfolge nummeriert, in der sie ausgeführt werden. Anweisungen und Kommentare in jedem Notizbuch beschreiben die von diesem Notizbuch ausgeführten Aktionen. Wir führen diese Notebooks einzeln aus.

- Auswählen

1_data_prep.ipynbum es in JupyterLab zu öffnen. - Auf dem Führen Sie Menü, wählen Sie Führen Sie alle Zellen aus um den Code in diesem Notebook auszuführen.

Dieses Notizbuch wird öffentlich verfügbar heruntergeladen Rutsche Deck, konvertieren Sie jede Folie in das JPG-Dateiformat und laden Sie diese in den S3-Bucket hoch.

- Auswählen

2_data_ingestion.ipynbum es in JupyterLab zu öffnen. - Auf dem Führen Sie Menü, wählen Sie Führen Sie alle Zellen aus um den Code in diesem Notebook auszuführen.

In diesem Notizbuch erstellen Sie einen Index in der OpenSearch Serverless-Sammlung. In diesem Index werden die Einbettungsdaten für das Foliendeck gespeichert. Siehe den folgenden Code:

Sie verwenden die Modelle Claude 3 Sonnet und Amazon Titan Text Embeddings, um die im vorherigen Notizbuch erstellten JPG-Bilder in Vektoreinbettungen zu konvertieren. Diese Einbettungen und zusätzliche Metadaten (wie der S3-Pfad und die Beschreibung der Bilddatei) werden zusammen mit den Einbettungen im Index gespeichert. Der folgende Codeausschnitt zeigt, wie Claude 3 Sonnet Bildbeschreibungen generiert:

Die Bildbeschreibungen werden an das Amazon Titan Text Embeddings-Modell übergeben, um Vektoreinbettungen zu generieren. Diese Einbettungen und zusätzliche Metadaten (wie der S3-Pfad und die Beschreibung der Bilddatei) werden zusammen mit den Einbettungen im Index gespeichert. Der folgende Codeausschnitt zeigt den Aufruf des Amazon Titan Text Embeddings-Modells:

Die Daten werden durch einen API-Aufruf an die OSI-Pipeline in den OpenSearch Serverless-Index aufgenommen. Der folgende Codeausschnitt zeigt den Aufruf, der mithilfe der Requests-HTTP-Bibliothek durchgeführt wurde:

- Auswählen

3_rag_inference.ipynbum es in JupyterLab zu öffnen. - Auf dem Führen Sie Menü, wählen Sie Führen Sie alle Zellen aus um den Code in diesem Notebook auszuführen.

Dieses Notizbuch implementiert die RAG-Lösung: Sie wandeln die Benutzerfrage in Einbettungen um, suchen eine ähnliche Bildbeschreibung aus der Vektordatenbank und geben die abgerufene Beschreibung an Claude 3 Sonnet weiter, um eine Antwort auf die Benutzerfrage zu generieren. Sie verwenden die folgende Eingabeaufforderungsvorlage:

Der folgende Codeausschnitt stellt den RAG-Workflow bereit:

Die Ergebnisse

Die folgende Tabelle enthält einige Benutzerfragen und -antworten, die durch unsere Implementierung generiert wurden. Der Fragen (FAQ) Die Spalte erfasst die Benutzerfrage und die Antworten Spalte ist die von Claude 3 Sonnet generierte Textantwort. Der Bild Die Spalte zeigt die k-NN-Folienübereinstimmung, die von der OpenSearch Serverless-Vektorsuche zurückgegeben wird.

Multimodale RAG-Ergebnisse

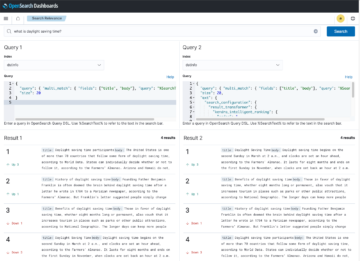

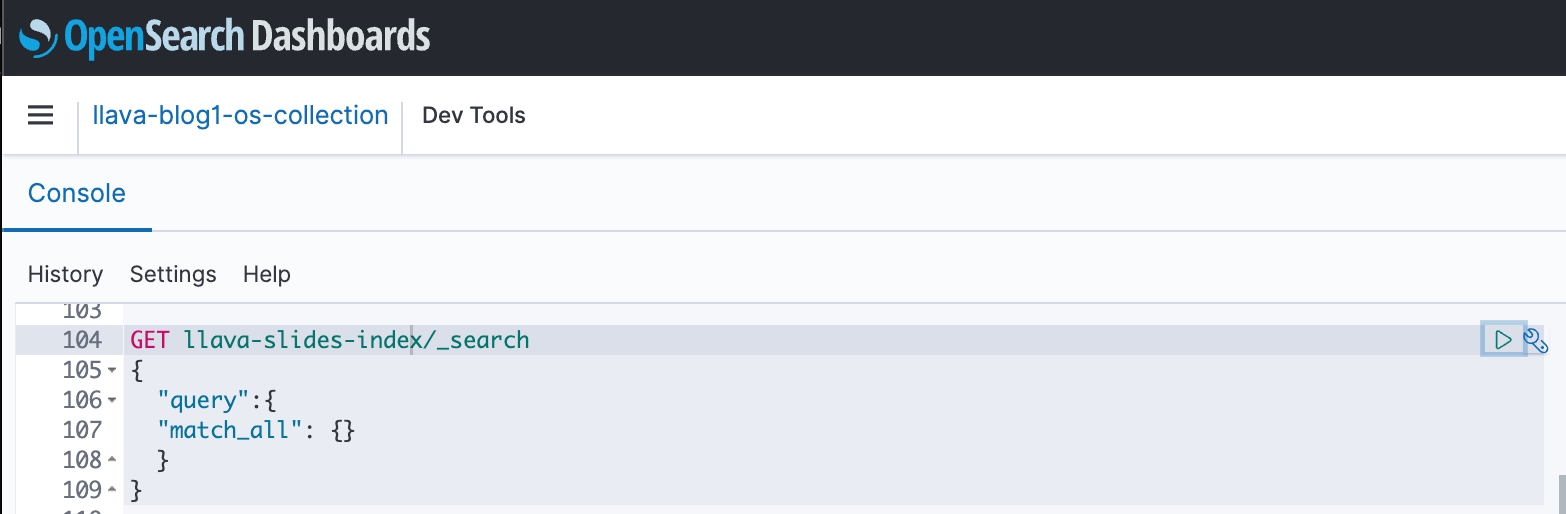

Fragen Sie Ihren Index ab

Sie können OpenSearch-Dashboards verwenden, um mit der OpenSearch-API zu interagieren und schnelle Tests für Ihren Index und die aufgenommenen Daten durchzuführen.

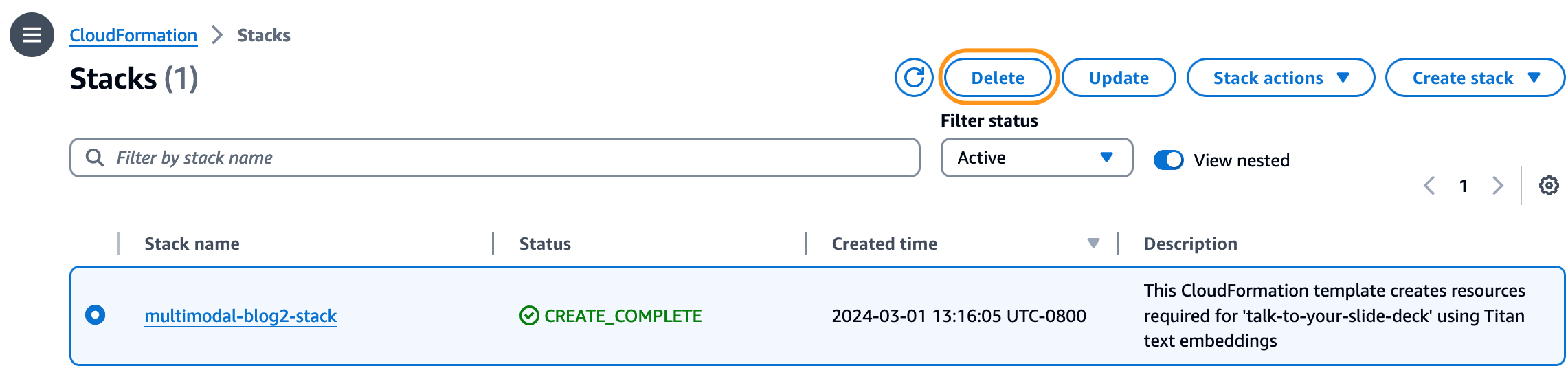

Aufräumen

Um künftige Gebühren zu vermeiden, löschen Sie die Ressourcen. Sie können dies tun, indem Sie den Stack über die AWS CloudFormation-Konsole löschen.

Zusammenfassung

Unternehmen generieren ständig neue Inhalte, und Foliendecks sind eine gängige Möglichkeit, Informationen intern innerhalb des Unternehmens und extern mit Kunden oder auf Konferenzen auszutauschen und zu verbreiten. Im Laufe der Zeit können umfangreiche Informationen in Nicht-Text-Modalitäten wie Grafiken und Tabellen in diesen Foliensätzen vergraben und verborgen bleiben.

Sie können diese Lösung und die Leistungsfähigkeit multimodaler FMs wie Amazon Titan Text Embeddings und Claude 3 Sonnet nutzen, um neue Informationen zu entdecken oder neue Perspektiven auf Inhalte in Foliendecks zu entdecken. Sie können verschiedene auf Amazon Bedrock verfügbare Claude-Modelle ausprobieren, indem Sie die aktualisieren CLAUDE_MODEL_ID der globals.py Datei.

Dies ist Teil 2 einer dreiteiligen Serie. In Teil 1 haben wir die Amazon Titan Multimodal Embeddings und das LLaVA-Modell verwendet. In Teil 3 werden wir die Ansätze aus Teil 1 und Teil 2 vergleichen.

Teile dieses Codes werden unter der veröffentlicht Apache 2.0-Lizenz.

Über die Autoren

Amit Arora ist ein KI- und ML-Spezialistenarchitekt bei Amazon Web Services und unterstützt Unternehmenskunden bei der Nutzung cloudbasierter maschineller Lerndienste, um ihre Innovationen schnell zu skalieren. Er ist außerdem außerordentlicher Dozent im MS Data Science and Analytics-Programm an der Georgetown University in Washington DC

Amit Arora ist ein KI- und ML-Spezialistenarchitekt bei Amazon Web Services und unterstützt Unternehmenskunden bei der Nutzung cloudbasierter maschineller Lerndienste, um ihre Innovationen schnell zu skalieren. Er ist außerdem außerordentlicher Dozent im MS Data Science and Analytics-Programm an der Georgetown University in Washington DC

Manju Prasad ist Senior Solutions Architect bei Amazon Web Services. Ihr Schwerpunkt liegt auf der Bereitstellung technischer Beratung in verschiedenen technischen Bereichen, einschließlich KI/ML. Bevor sie zu AWS kam, entwarf und baute sie Lösungen für Unternehmen im Finanzdienstleistungssektor und auch für ein Startup. Es liegt ihr am Herzen, Wissen zu teilen und das Interesse an aufstrebenden Talenten zu wecken.

Manju Prasad ist Senior Solutions Architect bei Amazon Web Services. Ihr Schwerpunkt liegt auf der Bereitstellung technischer Beratung in verschiedenen technischen Bereichen, einschließlich KI/ML. Bevor sie zu AWS kam, entwarf und baute sie Lösungen für Unternehmen im Finanzdienstleistungssektor und auch für ein Startup. Es liegt ihr am Herzen, Wissen zu teilen und das Interesse an aufstrebenden Talenten zu wecken.

Archana Inapudi ist Senior Solutions Architect bei AWS und unterstützt einen strategischen Kunden. Sie verfügt über mehr als ein Jahrzehnt branchenübergreifendes Fachwissen in der Leitung strategischer technischer Initiativen. Archana ist ein aufstrebendes Mitglied der KI/ML-Technik-Community bei AWS. Bevor Archana zu AWS kam, leitete sie bei einem Gesundheitsunternehmen die Migration von traditionellen isolierten Datenquellen zu Hadoop. Sie setzt sich leidenschaftlich dafür ein, Technologie zu nutzen, um das Wachstum zu beschleunigen, Kunden einen Mehrwert zu bieten und Geschäftsergebnisse zu erzielen.

Archana Inapudi ist Senior Solutions Architect bei AWS und unterstützt einen strategischen Kunden. Sie verfügt über mehr als ein Jahrzehnt branchenübergreifendes Fachwissen in der Leitung strategischer technischer Initiativen. Archana ist ein aufstrebendes Mitglied der KI/ML-Technik-Community bei AWS. Bevor Archana zu AWS kam, leitete sie bei einem Gesundheitsunternehmen die Migration von traditionellen isolierten Datenquellen zu Hadoop. Sie setzt sich leidenschaftlich dafür ein, Technologie zu nutzen, um das Wachstum zu beschleunigen, Kunden einen Mehrwert zu bieten und Geschäftsergebnisse zu erzielen.

Antara Raisa ist KI- und ML-Lösungsarchitekt bei Amazon Web Services und unterstützt strategische Kunden mit Sitz in Dallas, Texas. Sie verfügt außerdem über Erfahrung in der Zusammenarbeit mit großen Unternehmenspartnern bei AWS, wo sie als Partner Success Solutions Architect für digitalorientierte Kunden tätig war.

Antara Raisa ist KI- und ML-Lösungsarchitekt bei Amazon Web Services und unterstützt strategische Kunden mit Sitz in Dallas, Texas. Sie verfügt außerdem über Erfahrung in der Zusammenarbeit mit großen Unternehmenspartnern bei AWS, wo sie als Partner Success Solutions Architect für digitalorientierte Kunden tätig war.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/talk-to-your-slide-deck-using-multimodal-foundation-models-hosted-on-amazon-bedrock-and-amazon-sagemaker-part-2/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 10

- 100

- 12

- 15%

- 17

- 173

- 175

- 20

- 2019

- 2020

- 2023

- 23

- 24

- 27

- 30

- 31

- 7

- 8

- 9

- a

- Fähigkeiten

- Über uns

- beschleunigen

- Zugang

- Zugriff

- Konto

- Erreichen

- über

- Aktionen

- hinzufügen

- Zusätzliche

- Zusatz

- Adoption

- Vorteilen

- AI

- KI-Modelle

- AI / ML

- Algorithmen

- Alle

- entlang

- ebenfalls

- Amazon

- Amazon EC2

- Amazon OpenSearch-Dienst

- Amazon Web Services

- Beträge

- an

- Analyse

- Analytik

- machen

- und Infrastruktur

- beantworten

- Beantwortung

- Antworten

- Anthropisch

- jedem

- etwas

- Bienen

- Anwendung

- Anwendungsentwicklung

- Anwendungen

- Jetzt bewerben

- Ansatz

- Ansätze

- ca.

- Architektur

- SIND

- künstlich

- künstliche Intelligenz

- Künstliche Intelligenz und maschinelles Lernen

- AS

- fragen

- strebend

- Assistentin

- damit verbundenen

- At

- Augmented

- Auth

- verfügbar

- vermeiden

- AWS

- AWS CloudFormation

- basierend

- BE

- war

- Bevor

- BESTE

- Besser

- zwischen

- Milliarde

- Körper

- beide

- erbaut

- Geschäft

- aber

- by

- rufen Sie uns an!

- CAN

- kann keine

- Fähigkeiten

- capability

- Captures

- Fälle

- Übernehmen

- Gebühren

- Auswählen

- Auswahl

- Auftraggeber

- Clustering

- Code

- Sammlung

- Produktauswahl

- Sammler

- Kolonne

- Vereinigung

- Bemerkungen

- gemeinsam

- community

- Unternehmen

- Unternehmen

- vergleichbar

- vergleichen

- verglichen

- Vergleich

- Vergleich

- abschließen

- Abgeschlossene Verkäufe

- Komplex

- Komponenten

- konzept

- prägnant

- Kongressbegleitung

- Konfiguration

- konfiguriert

- besteht

- Konsul (Console)

- enthalten

- enthalten

- enthält

- Inhalt

- Kontext

- kontinuierlich

- verkaufen

- umgewandelt

- Umwandlung

- Dazugehörigen

- könnte

- erstellen

- erstellt

- schafft

- Erstellen

- Referenzen

- Kunde

- Kunden

- Zyklus

- Dallas

- Dashboards

- technische Daten

- Datenwissenschaft

- Datenbase

- Jahrzehnte

- Deck

- Standard

- Übergeben

- liefert

- Demand

- zeigen

- einsetzen

- beschreiben

- beschreibt

- Beschreibung

- Design

- entworfen

- Details

- Entwicklung

- Entwicklung

- Diagramm

- DICT

- Unterschied

- anders

- Rundfunk

- Abmessungen

- Größe

- entdeckt,

- diskutieren

- diskutiert

- Display

- Displays

- do

- Unterlagen

- die

- Domains

- herunterladen

- Antrieb

- Fahren

- im

- e

- jeder

- effizient

- Elemente

- Einbettung

- aufstrebenden

- ermöglichen

- freigegeben

- ermöglichen

- Motor

- Unternehmen

- Fehler

- bewerten

- Sogar

- Außer

- Ausnahme

- ERFAHRUNGEN

- Expertise

- erweitern

- äußerlich

- Extrakt

- Vertrautheit

- Feld

- Felder

- Reichen Sie das

- Mappen

- Revolution

- Finanzdienstleistungen

- Finden Sie

- konzentriert

- Folgende

- Aussichten für

- Format

- Förderung

- Foundation

- für

- Treibstoff

- voller

- voll

- weiter

- Zukunft

- erzeugen

- erzeugt

- erzeugt

- Erzeugung

- Generation

- generativ

- Generative KI

- georgetown

- GitHub

- gegeben

- gibt

- gehen

- Graphen

- Wachstum

- die Vermittlung von Kompetenzen,

- hätten

- Griff

- Haben

- he

- Gesundheitswesen

- Unternehmen

- versteckt

- höher

- Highlights

- Treffer

- Gastgeber

- gehostet

- Gastgeber

- Ultraschall

- Hilfe

- aber

- HTML

- http

- HTTPS

- human

- i

- Identitätsschutz

- if

- zeigt

- Image

- Bilder

- sofort

- implementieren

- Implementierung

- implementiert

- Verbesserungen

- in

- das

- Dazu gehören

- Einschließlich

- Index

- Indizes

- Krankengymnastik

- Information

- Infrastruktur

- Initiativen

- Innovation

- Innovationen

- Varianten des Eingangssignals:

- Instanz

- Anleitung

- Intelligenz

- interagieren

- Interaktion

- Interesse

- innen

- in

- Investition

- IT

- Beitritt

- jpg

- JSON

- Juni

- Wesentliche

- Wissen

- Wissen

- Sprache

- grosse

- Latency

- führenden

- umwandeln

- lernen

- geführt

- Bibliothek

- Lizenz

- Gefällt mir

- aus einer regionalen

- senken

- Maschine

- Maschinelles Lernen

- gemacht

- Main

- um

- Making

- verwaltet

- viele

- Spiel

- Abstimmung

- max

- Mitglied

- erwähnen

- MENÜ

- Nachrichten

- Metadaten

- Methode

- Methoden

- Migration

- ML

- Modell

- für

- mehr

- vor allem warme

- MS

- Name

- Namen

- Natürliche

- Verarbeitung natürlicher Sprache

- Navigieren

- navigieren

- Navigation

- Need

- Neu

- weiter

- Andere

- beachten

- Notizbuch

- nummerierte

- Zahlen

- of

- bieten

- on

- On-Demand

- EINEM

- XNUMXh geöffnet

- Optimierung

- or

- Organisation

- OS

- Andere

- UNSERE

- Ergebnisse

- Möglichkeiten für das Ausgangssignal:

- Ausgänge

- übrig

- Seite

- Brot

- Parameter

- Parameter

- Teil

- Partner

- Teile

- Bestanden

- leidenschaftlich

- Weg

- für

- Ausführen

- Leistung

- durchgeführt

- Berechtigungen

- Personalisierung

- Perspektiven

- Phase

- Sätze

- Physik

- Pipeline

- Plato

- Datenintelligenz von Plato

- PlatoData

- Politik durchzulesen

- Post

- möglicherweise

- Werkzeuge

- größte treibende

- vorgeführt

- früher

- Vor

- Prozessdefinierung

- Verarbeitet

- Verarbeitung

- Programm

- Progression

- immobilien

- die

- vorausgesetzt

- bietet

- Bereitstellung

- öffentlich

- Quarks

- Abfragen

- query

- Frage

- Fragen

- Direkt

- R

- Lappen

- Angebot

- schnell

- schnell

- Lesen Sie mehr

- Received

- referenziert

- bezogene

- freigegeben

- relevant

- verlässt sich

- bleiben

- Zugriffe

- falls angefordert

- Forschungsprojekte

- Downloads

- Antwort

- Antworten

- Folge

- Die Ergebnisse

- Abruf

- Rückkehr

- Reiches

- Rollen

- Rollen

- Führen Sie

- Laufen

- sagemaker

- gleich

- Sample

- Skalieren

- Wissenschaft

- Suche

- Abschnitte

- Bibliotheken

- sehen

- scheinen

- Auswahl

- semantisch

- Senior

- geschickt

- Reihenfolge

- Modellreihe

- Serverlos

- dient

- Dienstleistungen

- Sitzung

- Sets

- Einstellungen

- Teilen

- ,,teilen"

- sie

- sollte

- Konzerte

- Isoliert

- ähnlich

- Einfacher

- Single

- Größe

- Schlitten

- Slides

- Schnipsel

- Lösung

- Lösungen

- einige

- Quelle

- Quellen

- Spezialist

- spezifisch

- stabil

- Stapel

- Stufen

- Anfang

- Bundesstaat

- State-of-the-art

- Shritte

- Lagerung

- speichern

- gelagert

- Läden

- Speicherung

- Strategisch

- Folge

- Erfolg

- Erfolgreich

- so

- ZUSAMMENFASSUNG

- Gipfel

- Support

- Unterstützte

- Unterstützung

- sicher

- Tabelle

- Athleten

- Reden

- und Aufgaben

- Technische

- Technologies

- Technologie

- Vorlage

- Test

- Tests

- Texas

- Text

- textuell

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- die Informationen

- ihr

- Sie

- dann

- deswegen

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- Durchsatz

- Zeit

- mal

- Titan

- zu

- Werkzeug

- Werkzeuge

- toronto

- traditionell

- traditionell

- Traverse

- was immer dies auch sein sollte.

- versuchen

- WENDE

- XNUMX

- tippe

- Typen

- aufdecken

- für

- Universität

- Aktualisierung

- Aktualisierung

- -

- Anwendungsfälle

- benutzt

- Mitglied

- verwendet

- Verwendung von

- Wert

- Werte

- Vielfalt

- riesig

- vielseitig

- visuell

- Washington

- Weg..

- we

- Netz

- Web-Services

- GUT

- Was

- Was ist

- welche

- während

- breit

- Große Auswahl

- breiter

- werden wir

- mit

- .

- Worte

- gearbeitet

- Arbeitsablauf.

- arbeiten,

- Du

- Ihr

- Zephyrnet