Bei der Sprecherdiagnostik, einem wesentlichen Prozess in der Audioanalyse, wird eine Audiodatei anhand der Sprecheridentität segmentiert. Dieser Beitrag befasst sich mit der Integration von PyAnnote von Hugging Face für die Tagebuchaufzeichnung von Sprechern Amazon Sage Maker asynchrone Endpunkte.

Wir bieten eine umfassende Anleitung zur Bereitstellung von Sprechersegmentierungs- und Clustering-Lösungen mit SageMaker in der AWS Cloud. Sie können diese Lösung für Anwendungen verwenden, die sich mit Audioaufnahmen mit mehreren Lautsprechern (über 100) befassen.

Lösungsüberblick

Amazon Transcribe ist der Service der Wahl für die Aufzeichnung von Sprechertagebüchern in AWS. Für nicht unterstützte Sprachen können Sie jedoch andere Modelle (in unserem Fall PyAnnote) verwenden, die in SageMaker zur Inferenz bereitgestellt werden. Für kurze Audiodateien, bei denen die Inferenz bis zu 60 Sekunden dauert, können Sie verwenden Echtzeit-Inferenz. Länger als 60 Sekunden asynchron Inferenz sollte verwendet werden. Der zusätzliche Vorteil der asynchronen Inferenz besteht in den Kosteneinsparungen durch die automatische Skalierung der Instanzanzahl auf Null, wenn keine Anforderungen zu verarbeiten sind.

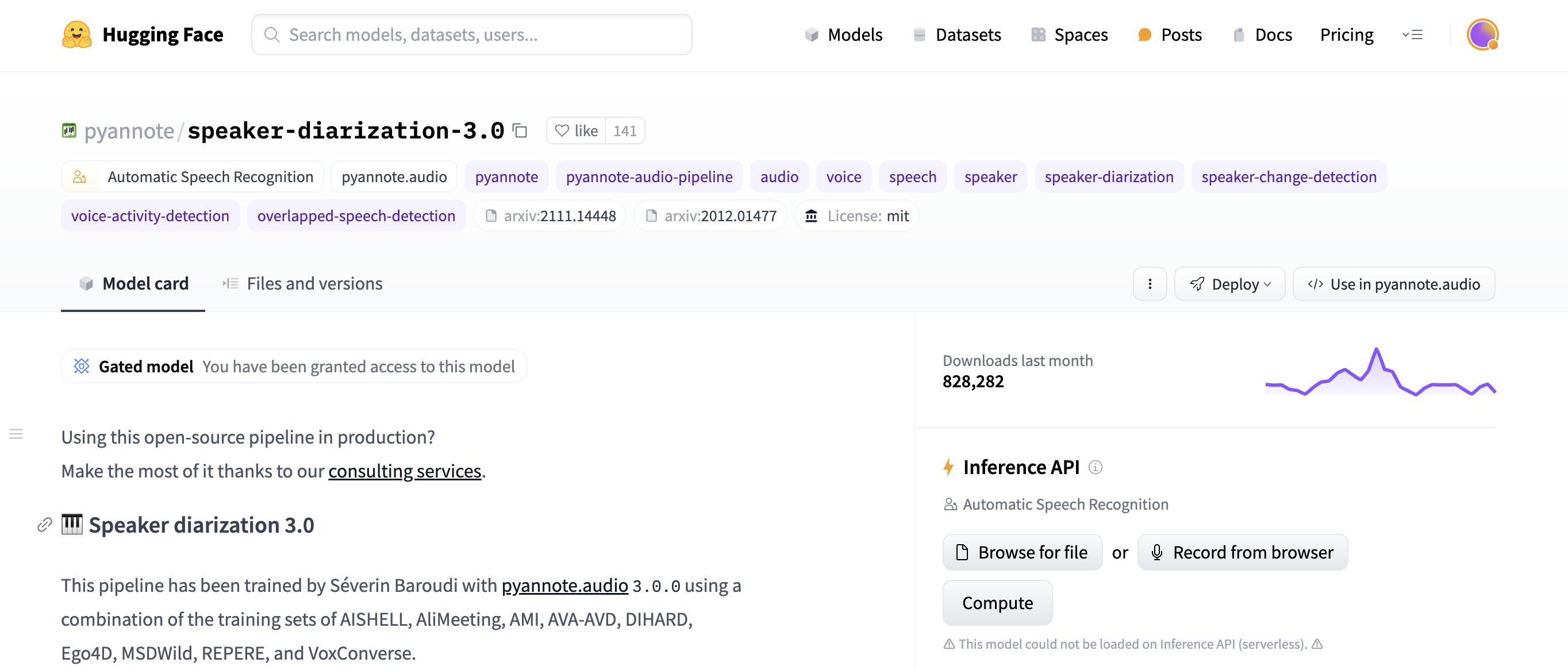

Gesicht umarmen ist ein beliebter Open-Source-Hub für Modelle des maschinellen Lernens (ML). AWS und Hugging Face haben eine Partnerschaft Dies ermöglicht eine nahtlose Integration durch SageMaker mit einer Reihe von AWS Deep Learning Containern (DLCs) für Training und Inferenz in PyTorch oder TensorFlow sowie Hugging Face-Schätzern und -Prädiktoren für das SageMaker Python SDK. Die Funktionen und Fähigkeiten von SageMaker erleichtern Entwicklern und Datenwissenschaftlern den einfachen Einstieg in die Verarbeitung natürlicher Sprache (NLP) auf AWS.

Die Integration für diese Lösung umfasst die Verwendung des vorab trainierten Sprecher-Tagebuchmodells von Hugging Face unter Verwendung von PyAnnote-Bibliothek. PyAnnote ist ein in Python geschriebenes Open-Source-Toolkit zur Tagebuchaufzeichnung von Sprechern. Dieses anhand des Beispiel-Audiodatensatzes trainierte Modell ermöglicht eine effektive Sprecherpartitionierung in Audiodateien. Das Modell wird auf SageMaker als asynchrones Endpunkt-Setup bereitgestellt und ermöglicht eine effiziente und skalierbare Verarbeitung von Diarisierungsaufgaben.

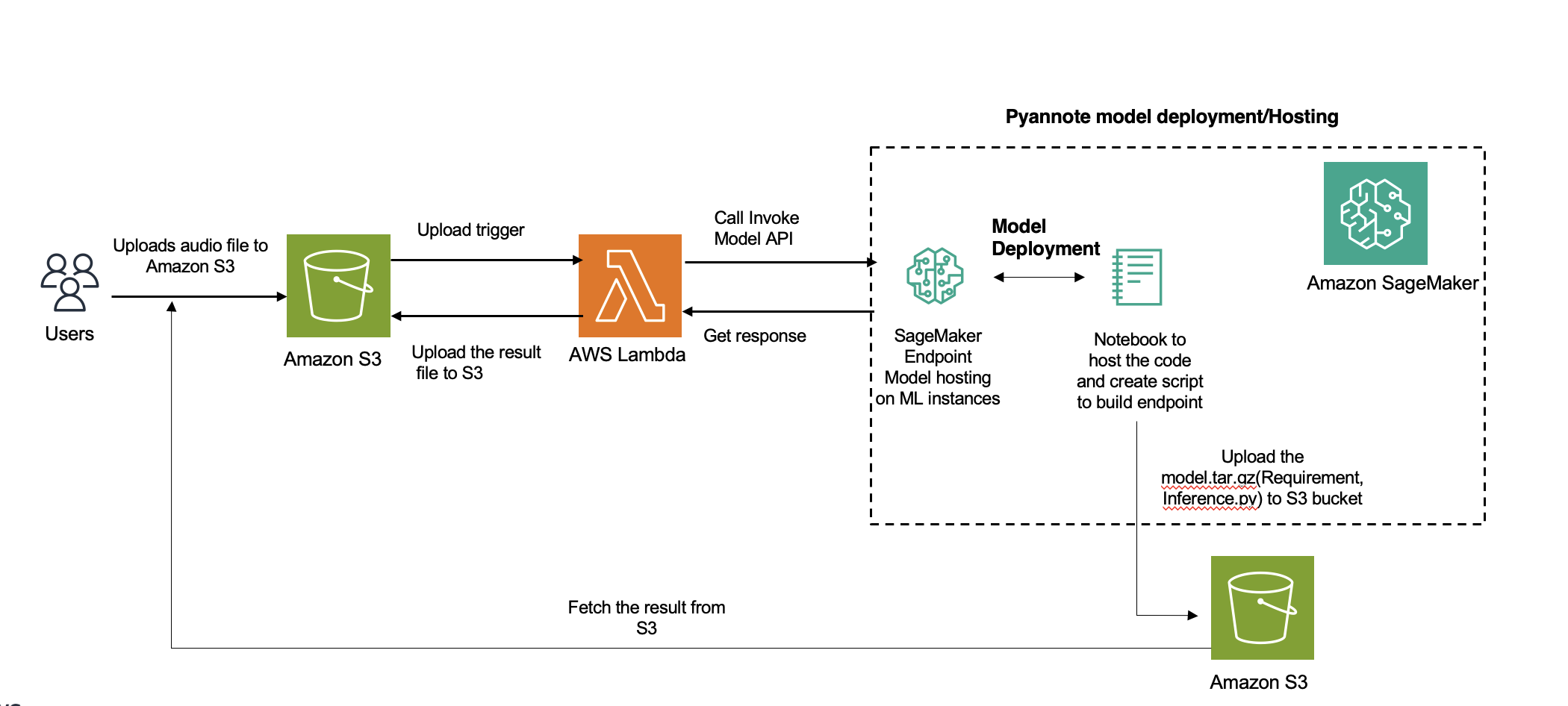

Das folgende Diagramm zeigt die Lösungsarchitektur.

Für diesen Beitrag verwenden wir die folgende Audiodatei.

Stereo- oder Mehrkanal-Audiodateien werden durch Mittelung der Kanäle automatisch auf Mono heruntergemischt. Audiodateien, die mit einer anderen Rate abgetastet wurden, werden beim Laden automatisch auf 16 kHz neu abgetastet.

Voraussetzungen:

Erfüllen Sie die folgenden Voraussetzungen:

- Erstellen Sie eine SageMaker-Domäne.

- Stellen Sie sicher, AWS Identity and Access Management and (IAM)-Benutzer verfügt über die erforderlichen Zugriffsberechtigungen zum Erstellen eines SageMaker-Rolle.

- Stellen Sie sicher, dass das AWS-Konto über ein Servicekontingent zum Hosten eines SageMaker-Endpunkts für eine ml.g5.2xlarge-Instanz verfügt.

Erstellen Sie eine Modellfunktion für den Zugriff auf die PyAnnote-Sprechertagebücher von Hugging Face

Über den Hugging Face Hub können Sie auf die gewünschten vorab trainierten Inhalte zugreifen PyAnnote-Sprechertagebuchmodell. Sie verwenden dasselbe Skript zum Herunterladen der Modelldatei, wenn Sie den SageMaker-Endpunkt erstellen.

Siehe folgenden Code:

Verpacken Sie den Modellcode

Bereiten Sie wichtige Dateien wie inference.py vor, die den Inferenzcode enthalten:

Bereite ein ..... vor requirements.txt Datei, die die erforderlichen Python-Bibliotheken enthält, die zum Ausführen der Inferenz erforderlich sind:

Zum Schluss komprimieren Sie die inference.py und „requirements.txt“-Dateien und speichern Sie sie unter model.tar.gz:

Konfigurieren Sie ein SageMaker-Modell

Definieren Sie eine SageMaker-Modellressource, indem Sie den Bild-URI und den Speicherort der Modelldaten angeben Amazon Simple Storage-Service (S3) und SageMaker-Rolle:

Laden Sie das Modell auf Amazon S3 hoch

Laden Sie die gezippte PyAnnote Hugging Face-Modelldatei in einen S3-Bucket hoch:

Erstellen Sie einen asynchronen SageMaker-Endpunkt

Konfigurieren Sie einen asynchronen Endpunkt für die Bereitstellung des Modells auf SageMaker mithilfe der bereitgestellten asynchronen Inferenzkonfiguration:

Testen Sie den Endpunkt

Bewerten Sie die Endpunktfunktionalität, indem Sie eine Audiodatei zur Diarisierung senden und die JSON-Ausgabe abrufen, die im angegebenen S3-Ausgabepfad gespeichert ist:

Um diese Lösung im großen Maßstab bereitzustellen, empfehlen wir die Verwendung AWS Lambda, Amazon Simple Notification Service (Amazon SNS), oder Amazon Simple Queue-Dienst (Amazon SQS). Diese Dienste sind auf Skalierbarkeit, ereignisgesteuerte Architekturen und effiziente Ressourcennutzung ausgelegt. Sie können dazu beitragen, den asynchronen Inferenzprozess von der Ergebnisverarbeitung zu entkoppeln, sodass Sie jede Komponente unabhängig skalieren und eine Reihe von Inferenzanforderungen effektiver verarbeiten können.

Die Ergebnisse

Die Modellausgabe wird unter gespeichert s3://sagemaker-xxxx /async_inference/output/. Die Ausgabe zeigt, dass die Audioaufnahme in drei Spalten segmentiert wurde:

- Start (Startzeit in Sekunden)

- Ende (Endzeit in Sekunden)

- Sprecher (Sprecherbezeichnung)

Der folgende Code zeigt ein Beispiel unserer Ergebnisse:

Aufräumen

Sie können eine Skalierungsrichtlinie auf Null setzen, indem Sie MinCapacity auf 0 setzen; asynchrone Inferenz ermöglicht die automatische Skalierung auf Null, ohne dass Anfragen erforderlich sind. Sie müssen den Endpunkt nicht löschen, sondern ihn Waage bei Bedarf wieder von Null, wodurch die Kosten bei Nichtgebrauch gesenkt werden. Siehe den folgenden Code:

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/deploy-a-hugging-face-pyannote-speaker-diarization-model-on-amazon-sagemaker-as-an-asynchronous-endpoint/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 10

- 100

- 11

- 118

- 12

- 13

- 14

- 16

- 17

- 23

- 25

- 26%

- 27

- 28

- 31

- 60

- 7

- 8

- 9

- a

- Über uns

- Zugang

- Zugriff

- zuvorkommend

- Konto

- über

- hinzufügen

- hinzugefügt

- passt

- advanced

- aufs Neue

- AI

- KI-Dienste

- AI / ML

- Zulassen

- erlaubt

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- Analyse

- Analytik

- und

- jedem

- Anwendung

- Anwendungen

- Ansatz

- Architektur

- Architekturen

- SIND

- um

- AS

- At

- Versuche

- Audio-

- Auto

- Im Prinzip so, wie Sie es von Google Maps kennen.

- Mittelung

- AWS

- basierend

- BE

- war

- Nutzen

- Vorteile

- zwischen

- Geschäft

- Unternehmen

- by

- CAN

- Fähigkeiten

- Häuser

- Fälle

- Änderungen

- Kanäle

- Klasse

- Auftraggeber

- Cloud

- Clustering

- Code

- Spalten

- Bemerkungen

- gemeinsam

- Komponente

- umfassend

- konzept

- Wettbewerber

- Konfiguration

- Behälter

- enthält

- Steuerung

- Kosten

- Einsparmaßnahmen

- Kosten

- zählen

- erstellen

- Erstellen

- Kunden

- technische Daten

- Behandlung

- tief

- tiefe Lernen

- definieren

- Übergeben

- Delves

- Demonstration

- einsetzen

- Einsatz

- Bereitstellen

- Design

- entworfen

- erwünscht

- entwickelt

- Entwickler:in / Unternehmen

- Entwickler

- Entwicklung

- Diagramm

- anders

- digital

- Digitale Transformation

- Verzeichnis

- Unterlagen

- Nicht

- Herunterladen

- dynamisch

- jeder

- erleichtern

- Effektiv

- effektiv

- effizient

- effizient

- ermöglicht

- Ende

- Endpunkt

- Fehler

- essential

- Beispiel

- Außer

- ERFAHRUNGEN

- ERKUNDEN

- Gesicht

- Eigenschaften

- Reichen Sie das

- Mappen

- Folgende

- Aussichten für

- Format

- für

- Funktion

- Funktionalität

- generativ

- bekommen

- bekommen

- GitHub

- Guide

- Griff

- Haben

- he

- Hilfe

- dazu beigetragen,

- hilft

- seine

- Hosting

- Ultraschall

- Hilfe

- aber

- HTML

- http

- HTTPS

- Nabe

- Umarmendes Gesicht

- hunderte

- Identitätsschutz

- if

- zeigt

- Image

- umgesetzt

- importieren

- in

- unabhängig

- Indien

- Instanz

- Integration

- Integration

- in

- beinhaltet

- IT

- Reise

- jpg

- JSON

- Wesentliche

- Label

- Sprache

- Sprachen

- grosse

- starten

- lernen

- Lasst uns

- Bibliotheken

- Gefällt mir

- Belastung

- Laden

- Standorte

- länger

- Maschine

- Maschinelles Lernen

- Mittel

- ML

- Modell

- für

- mehr

- mehrere

- Natürliche

- Verarbeitung natürlicher Sprache

- notwendig,

- Need

- erforderlich

- Nlp

- nicht

- Andere

- Benachrichtigung

- Anzahl

- Objekt

- of

- Angebote

- on

- XNUMXh geöffnet

- Open-Source-

- Verbessert

- or

- OS

- Andere

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- übrig

- Gesamt-

- besitzen

- Pandas

- Teil

- Weg

- Berechtigungen

- Pipeline

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- Datenschutzrichtlinien

- Beliebt

- Post

- angetriebene

- Prognosen

- Voraussetzungen

- Prozessdefinierung

- Verarbeitung

- Projekte

- Beweise

- die

- vorausgesetzt

- bietet

- Bereitstellung

- Öffentlichkeit

- setzen

- Python

- Pytorch

- Fragen

- Bewerten

- erreichen

- Echtzeit

- Einspielung vor

- reduziert

- Reduzierung

- Referenzen

- Region

- Registrieren

- zuverlässig

- ersetzen

- Darstellen

- Zugriffe

- falls angefordert

- Voraussetzungen:

- Ressourcen

- Downloads

- Antwort

- Folge

- Die Ergebnisse

- Rückkehr

- Rollen

- Führen Sie

- Laufen

- sagemaker

- Vertrieb

- gleich

- Sample

- Speichern

- Ersparnisse

- Skalierbarkeit

- skalierbaren

- Skalieren

- Skalierung

- Wissenschaftler

- Skript

- Skripte

- Sdk

- nahtlos

- nahtlos

- Sekunden

- Bibliotheken

- sehen

- Segmentierung

- Segmente

- Sendung

- Trennung

- Dienstleistungen

- Sitzung

- Sessions

- kompensieren

- Einstellung

- Setup

- mehrere

- Form

- Short

- sollte

- Konzerte

- Einfacher

- Single

- Software

- Software-Entwicklung

- Lösung

- Lösungen

- Quelle

- Speaker

- Spezialist

- spezifisch

- angegeben

- spezifizieren

- verbringt

- gespalten

- Anfang

- begonnen

- Lagerung

- gelagert

- einfach

- Strategisch

- Erfolg

- vorschlagen

- sicher

- System

- nimmt

- und Aufgaben

- Tech

- Tensorfluss

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Dort.

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- Tausende

- nach drei

- Durch

- Zeit

- zu

- heute

- Toolkit

- Thema

- Fackel

- trainiert

- Ausbildung

- Transformation

- Transformer

- versuchen

- WENDE

- auf

- -

- benutzt

- Mitglied

- verwendet

- Verwendung von

- Variante

- Version

- Videos

- W

- warten

- wollen

- we

- Netz

- Web-Services

- wann

- welche

- WHO

- werden wir

- mit

- arbeiten,

- geschrieben

- Jahr

- Du

- Ihr

- Zephyrnet

- Null

Sanjay Tiwary ist ein spezialisierter Lösungsarchitekt für KI/ML, der seine Zeit damit verbringt, mit strategischen Kunden zusammenzuarbeiten, um Geschäftsanforderungen zu definieren, L300-Sitzungen zu bestimmten Anwendungsfällen bereitzustellen und KI/ML-Anwendungen und -Dienste zu entwerfen, die skalierbar, zuverlässig und leistungsfähig sind. Er hat bei der Einführung und Skalierung des KI/ML-gestützten Amazon SageMaker-Dienstes mitgeholfen und mehrere Proofs of Concept mithilfe von Amazon AI-Diensten implementiert. Im Rahmen der digitalen Transformation hat er außerdem die Advanced-Analytics-Plattform entwickelt.

Sanjay Tiwary ist ein spezialisierter Lösungsarchitekt für KI/ML, der seine Zeit damit verbringt, mit strategischen Kunden zusammenzuarbeiten, um Geschäftsanforderungen zu definieren, L300-Sitzungen zu bestimmten Anwendungsfällen bereitzustellen und KI/ML-Anwendungen und -Dienste zu entwerfen, die skalierbar, zuverlässig und leistungsfähig sind. Er hat bei der Einführung und Skalierung des KI/ML-gestützten Amazon SageMaker-Dienstes mitgeholfen und mehrere Proofs of Concept mithilfe von Amazon AI-Diensten implementiert. Im Rahmen der digitalen Transformation hat er außerdem die Advanced-Analytics-Plattform entwickelt. Kiran Challapalli ist ein Deep-Tech-Geschäftsentwickler im öffentlichen AWS-Sektor. Er verfügt über mehr als 8 Jahre Erfahrung im Bereich KI/ML und insgesamt 23 Jahre Erfahrung in der Softwareentwicklung und im Vertrieb. Kiran unterstützt Unternehmen des öffentlichen Sektors in ganz Indien bei der Erforschung und Mitentwicklung cloudbasierter Lösungen, die KI-, ML- und generative KI-Technologien – einschließlich großer Sprachmodelle – nutzen.

Kiran Challapalli ist ein Deep-Tech-Geschäftsentwickler im öffentlichen AWS-Sektor. Er verfügt über mehr als 8 Jahre Erfahrung im Bereich KI/ML und insgesamt 23 Jahre Erfahrung in der Softwareentwicklung und im Vertrieb. Kiran unterstützt Unternehmen des öffentlichen Sektors in ganz Indien bei der Erforschung und Mitentwicklung cloudbasierter Lösungen, die KI-, ML- und generative KI-Technologien – einschließlich großer Sprachmodelle – nutzen.