Da Technologien der künstlichen Intelligenz (KI) und des maschinellen Lernens (ML) zum Mainstream geworden sind, ist es vielen Unternehmen gelungen, wichtige Geschäftsanwendungen, die auf ML-Modellen basieren, im großen Maßstab in der Produktion zu entwickeln. Da diese ML-Modelle jedoch wichtige Geschäftsentscheidungen für das Unternehmen treffen, ist es für Unternehmen wichtig, während ihres ML-Lebenszyklus geeignete Leitplanken hinzuzufügen. Leitplanken stellen sicher, dass Sicherheit, Datenschutz und Qualität des Codes, der Konfiguration sowie der Daten und Modellkonfiguration, die im Modelllebenszyklus verwendet werden, versioniert und erhalten bleiben.

Die Umsetzung dieser Leitplanken wird für Unternehmen immer schwieriger, da die ML-Prozesse und -Aktivitäten innerhalb von Unternehmen aufgrund der Einbeziehung tiefgreifender Prozesse, die Beiträge mehrerer Interessengruppen und Personen erfordern, immer komplexer werden. Zusätzlich zu Dateningenieuren und Datenwissenschaftlern wurden betriebliche Prozesse einbezogen, um den ML-Lebenszyklus zu automatisieren und zu optimieren. Darüber hinaus erfordern die zunehmende Zahl von Geschäftsinteressenten und in einigen Fällen Rechts- und Compliance-Prüfungen Funktionen, um Transparenz für die Verwaltung der Zugriffskontrolle, Aktivitätsverfolgung und Berichterstattung über den gesamten ML-Lebenszyklus hinweg zu schaffen.

Das Framework, das einen systematischen Einblick in die Entwicklung, Validierung und Verwendung von ML-Modellen bietet, wird als ML-Governance bezeichnet. Während AWS re:Invent 2022 AWS hat neue ML-Governance-Tools eingeführt für Amazon Sage Maker Dies vereinfacht die Zugriffskontrolle und erhöht die Transparenz Ihrer ML-Projekte. Eines der im Rahmen der ML-Governance verfügbaren Tools ist Amazon SageMaker-Modellkarten, das die Möglichkeit bietet, durch Zentralisierung und Standardisierung der Dokumentation während des gesamten Modelllebenszyklus eine einzige Quelle der Wahrheit für Modellinformationen zu schaffen.

Mit SageMaker-Modellkarten können Sie die Dokumentation von Modellen standardisieren und so einen Einblick in den Lebenszyklus eines Modells erhalten, vom Entwurf über den Bau bis hin zur Schulung und Bewertung. Modellkarten sollen eine zentrale Informationsquelle für geschäftliche und technische Metadaten zum Modell sein, die zuverlässig für Prüf- und Dokumentationszwecke verwendet werden können. Sie stellen ein Faktenblatt zum Modell bereit, das für die Modellgovernance wichtig ist.

Wenn Sie Ihre Modelle, Projekte und Teams skalieren, empfehlen wir Ihnen als Best Practice, eine Strategie mit mehreren Konten zu übernehmen, die Projekt- und Teamisolation für die Entwicklung und Bereitstellung von ML-Modellen bietet. Weitere Informationen zur Verbesserung der Governance Ihrer ML-Modelle finden Sie unter Verbessern Sie die Governance Ihrer Machine-Learning-Modelle mit Amazon SageMaker.

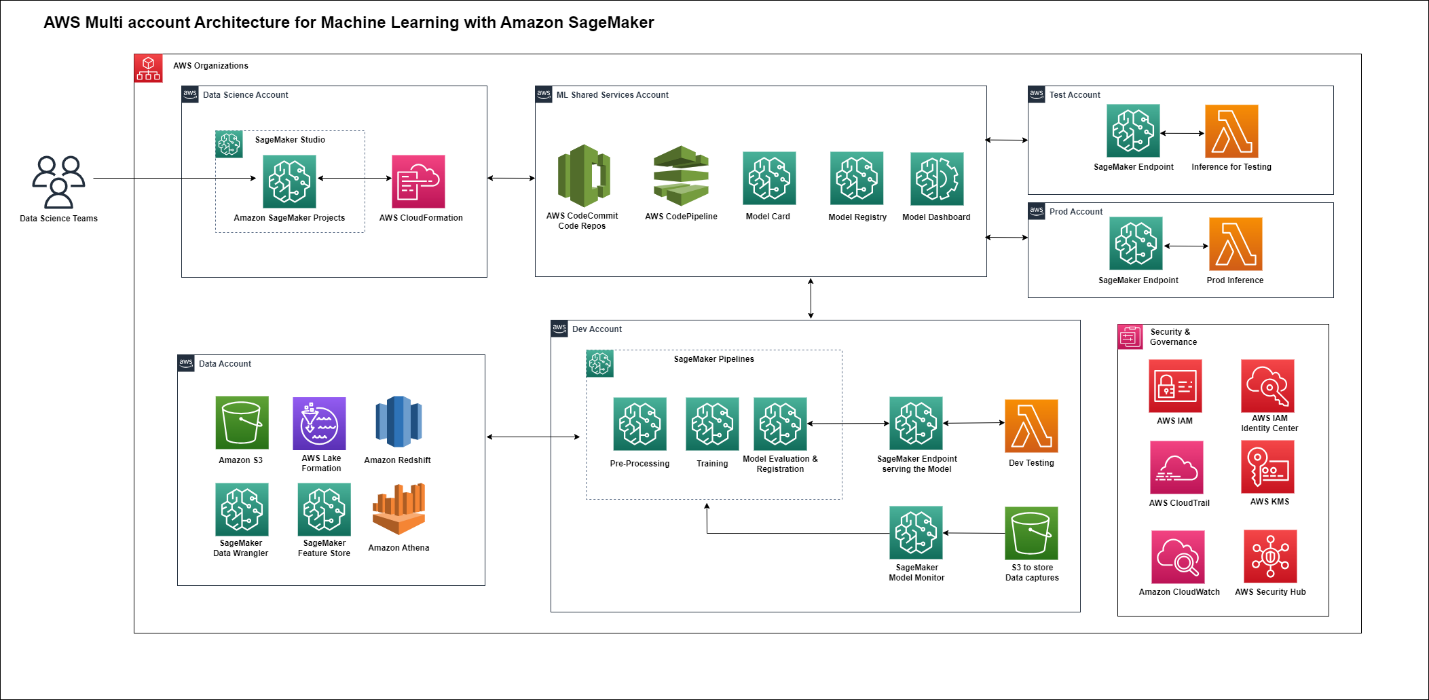

Architektur Überblick

Die Architektur ist wie folgt implementiert:

- Data Science Account – Datenwissenschaftler führen ihre Experimente durch SageMaker-Studio und erstellen Sie ein MLOps-Setup, um Modelle mithilfe von Staging-/Produktionsumgebungen bereitzustellen SageMaker-Projekte.

- ML Shared Services-Konto – Die über das Data Science-Konto eingerichteten MLOps lösen Continuous Integration- und Continuous Delivery-Pipelines (CI/CD) aus AWS-CodeCommit und AWS CodePipeline.

- Dev-Konto – Die CI/CD-Pipelines werden in diesem Konto außerdem ML-Pipelines auslösen, die die Datenvorverarbeitung, das Modelltraining und die Nachbearbeitung wie Modellbewertung und -registrierung abdecken. Durch die Ausgabe dieser Pipelines wird das Modell bereitgestellt SageMaker-Endpunkte zu Inferenzzwecken verwendet werden. Abhängig von Ihren Governance-Anforderungen können Data Science- und Dev-Konten in einem einzigen AWS-Konto zusammengeführt werden.

- Datenkonto – Die im Dev-Konto ausgeführten ML-Pipelines rufen die Daten von diesem Konto ab.

- Test- und Produktkonten – Die CI/CD-Pipelines setzen die Bereitstellung nach dem Dev-Konto fort, um die SageMaker-Endpunktkonfiguration in diesen Konten einzurichten.

- Sicherheit und Governance – Dienste wie AWS Identity and Access Management (IAM), AWS IAM Identity Center, AWS CloudTrail, AWS Key Management Service (AWS KMS), Amazon CloudWatch und AWS Security Hub werden für diese Konten als Teil der Sicherheit und Verwaltung verwendet Führung.

Das folgende Diagramm veranschaulicht diese Architektur.

Weitere Informationen zum Einrichten einer skalierbaren Multi-Account-ML-Architektur finden Sie unter MLOps-Grundlage für Unternehmen mit Amazon SageMaker.

Unsere Kunden benötigen die Möglichkeit, Modellkarten kontenübergreifend zu teilen, um die Sichtbarkeit und Steuerung ihrer Modelle durch die auf der Modellkarte geteilten Informationen zu verbessern. Durch die kontoübergreifende gemeinsame Nutzung von Modellkarten können Kunden nun die Vorteile einer Multi-Account-Strategie nutzen und gleichzeitig Zugriff auf die verfügbaren Modellkarten in ihrem Unternehmen haben, sodass sie die Zusammenarbeit beschleunigen und die Governance sicherstellen können.

In diesem Beitrag zeigen wir, wie Sie mithilfe der neuen kontoübergreifenden Freigabefunktion der Modellkarte Modellkarten über Model Development Lifecycle (MDLC)-Konten hinweg einrichten und darauf zugreifen. Zuerst beschreiben wir ein Szenario und eine Architektur zum Einrichten der kontoübergreifenden Freigabefunktion der Modellkarte und gehen dann eingehend auf die einzelnen Komponenten ein, wie man gemeinsame Modellkarten für mehrere Konten einrichtet und darauf zugreift, um die Sichtbarkeit und Modellverwaltung zu verbessern.

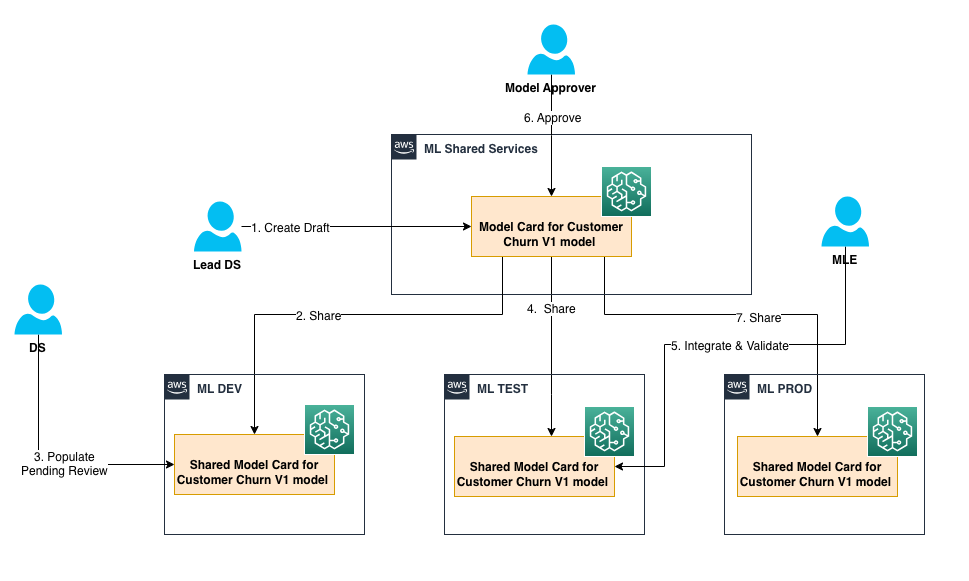

Lösungsüberblick

Beim Erstellen von ML-Modellen empfehlen wir die Einrichtung einer Architektur mit mehreren Konten, um eine Workload-Isolierung zu gewährleisten und so die Sicherheit, Zuverlässigkeit und Skalierbarkeit zu verbessern. In diesem Beitrag gehen wir davon aus, dass wir ein Modell für den Anwendungsfall „Kundenabwanderung“ erstellen und bereitstellen. Das folgende Architekturdiagramm zeigt einen der empfohlenen Ansätze – eine zentralisierte Modellkarte – für die Verwaltung einer Modellkarte in einer MDLC-Architektur (Machine Learning Model-Development Lifecycle) mit mehreren Konten. Sie können jedoch auch einen anderen Ansatz verfolgen, nämlich eine Hub-and-Spoke-Modellkarte. In diesem Beitrag konzentrieren wir uns nur auf einen zentralisierten Modellkartenansatz, aber die gleichen Prinzipien können auf einen Hub-and-Spoke-Ansatz ausgeweitet werden. Der Hauptunterschied besteht darin, dass jedes Spoke-Konto seine eigene Version der Modellkarte verwaltet und über Prozesse zum Zusammenfassen und Kopieren in ein zentrales Konto verfügt.

Das folgende Diagramm veranschaulicht diese Architektur.

Die Architektur ist wie folgt implementiert:

- Der leitende Datenwissenschaftler wird benachrichtigt, um den Anwendungsfall „Kundenabwanderung“ mithilfe von ML zu lösen, und er startet das ML-Projekt durch die Erstellung einer Modellkarte für das Modell „Kundenabwanderung V1“ im Entwurfsstatus im ML Shared Services-Konto

- Durch Automatisierung wird diese Modellkarte mit dem ML-Entwicklerkonto geteilt

- Data Scientist erstellt das Modell und beginnt, basierend auf seinen Experimentierergebnissen Informationen über APIs in die Modellkarte einzutragen. Der Status der Modellkarte wird auf „Überprüfung ausstehend“ gesetzt

- Durch Automatisierung wird diese Modellkarte mit dem ML-Testkonto geteilt

- ML Engineer (MLE) führt Integrations- und Validierungstests im ML-Testkonto durch und das Modell in der zentralen Registrierung ist als „Ausstehende Genehmigung“ gekennzeichnet

- Der Modellgenehmiger überprüft die Modellergebnisse anhand der unterstützenden Dokumentation auf der zentralen Modellkarte und genehmigt die Modellkarte für den Produktionseinsatz.

- Durch die Automatisierung wird diese Modellkarte im schreibgeschützten Modus mit dem ML Prod-Konto geteilt.

Voraussetzungen:

Bevor Sie beginnen, stellen Sie sicher, dass die folgenden Voraussetzungen erfüllt sind:

- Zwei AWS-Konten.

- In beiden AWS-Konten eine IAM-Verbundrolle mit Administratorzugriff, um Folgendes zu tun:

- Erstellen, bearbeiten, anzeigen und löschen Sie Modellkarten in Amazon SageMaker.

- Erstellen, Bearbeiten, Anzeigen und Löschen von Ressourcenfreigaben im AWS RAM.

Weitere Informationen finden Sie unter Beispiel-IAM-Richtlinien für AWS RAM.

Modellkartenfreigabe einrichten

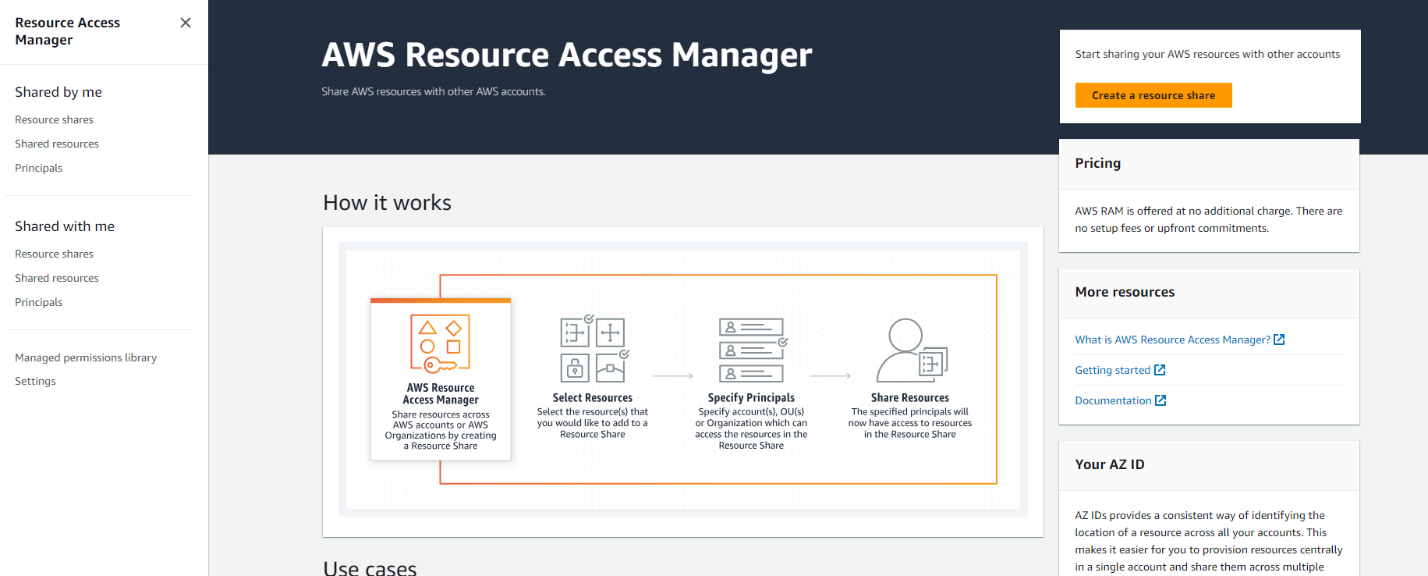

Das Konto, auf dem die Modellkarten erstellt werden, ist das Modellkartenkonto. Benutzer im Modellkartenkonto teilen sie mit den freigegebenen Konten, wo sie aktualisiert werden können. Benutzer im Modellkartenkonto können ihre Modellkarten über teilen AWS Resource Access Manager (AWS-RAM). AWS RAM hilft Ihnen, Ressourcen über AWS-Konten hinweg zu teilen.

Im folgenden Abschnitt zeigen wir, wie Sie Modellkarten teilen.

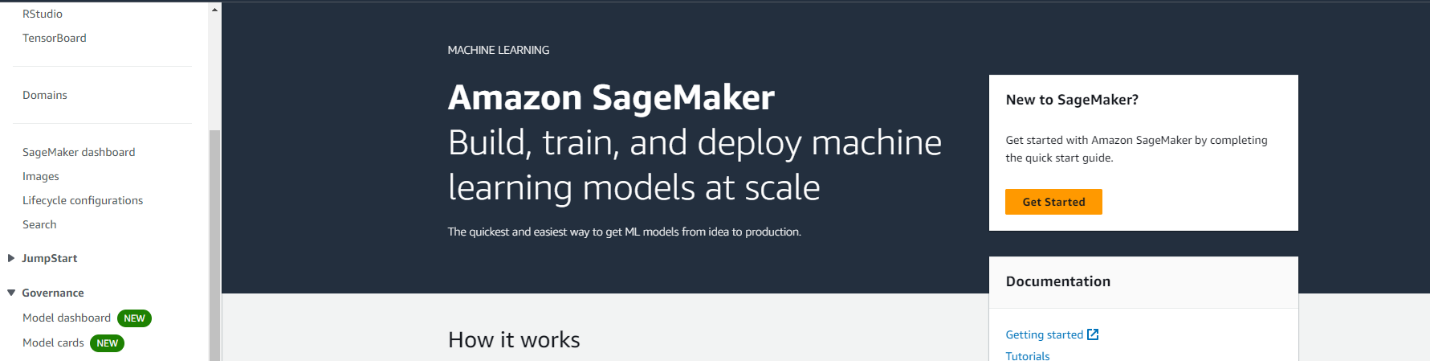

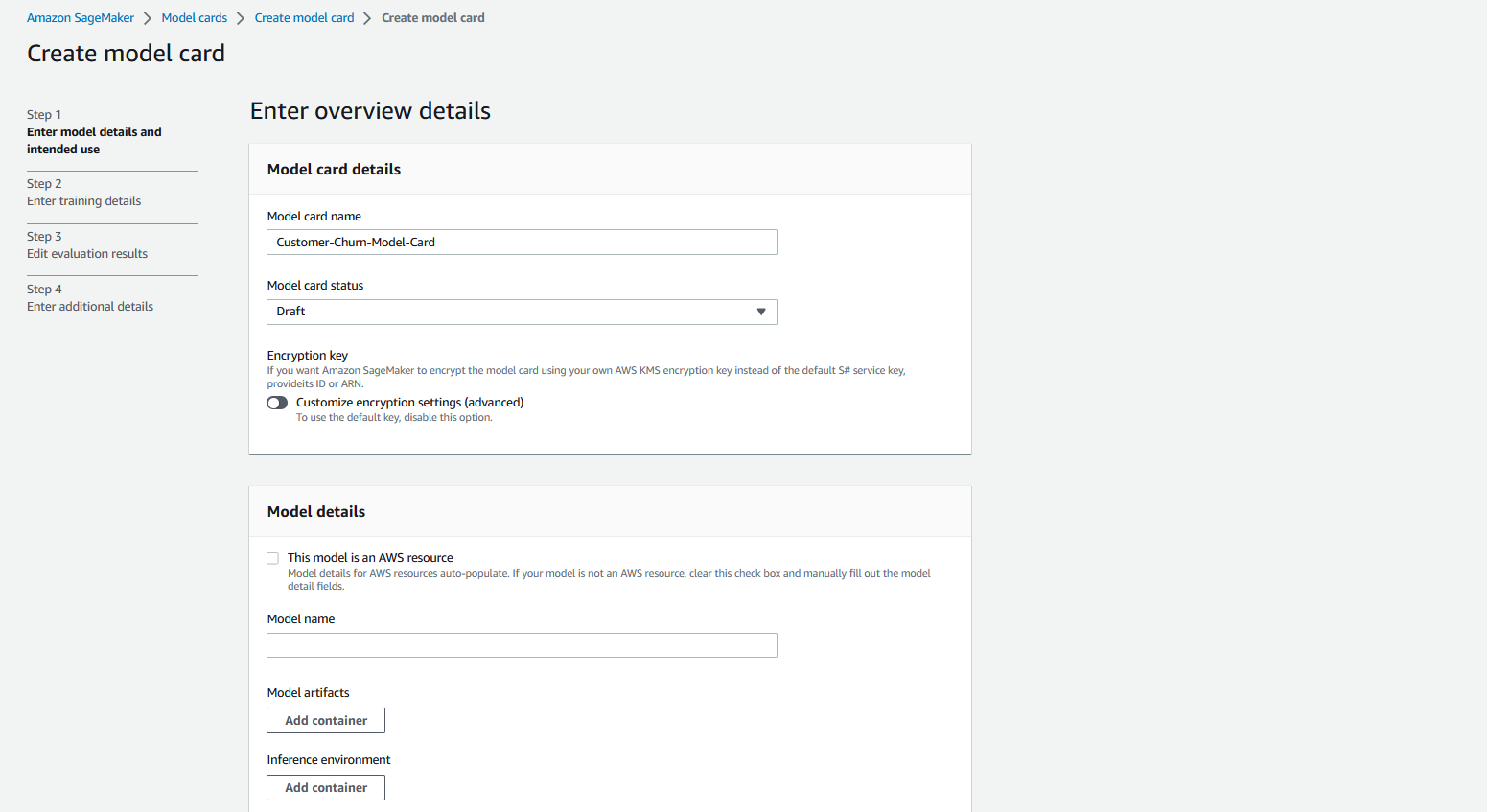

Erstellen Sie zunächst wie zuvor beschrieben eine Modellkarte für einen Anwendungsfall zur Kundenabwanderung. Erweitern Sie in der Amazon SageMaker-Konsole den Abschnitt „Governance“ und wählen Sie „ Modellkarten.

Wir erstellen die Modellkarte in Entwurf Status mit dem Namen Kundenabwanderungsmodell-Karte. Weitere Informationen finden Sie unter Erstellen Sie eine Modellkarte. In dieser Demonstration können Sie die restlichen Felder leer lassen und die Modellkarte erstellen.

Alternativ können Sie den folgenden AWS CLI-Befehl verwenden, um die Modellkarte zu erstellen:

Erstellen Sie nun die kontoübergreifende Freigabe mit AWS RAM. Wählen Sie in der AWS RAM-Konsole aus Erstellen Sie eine Ressourcenfreigabe.

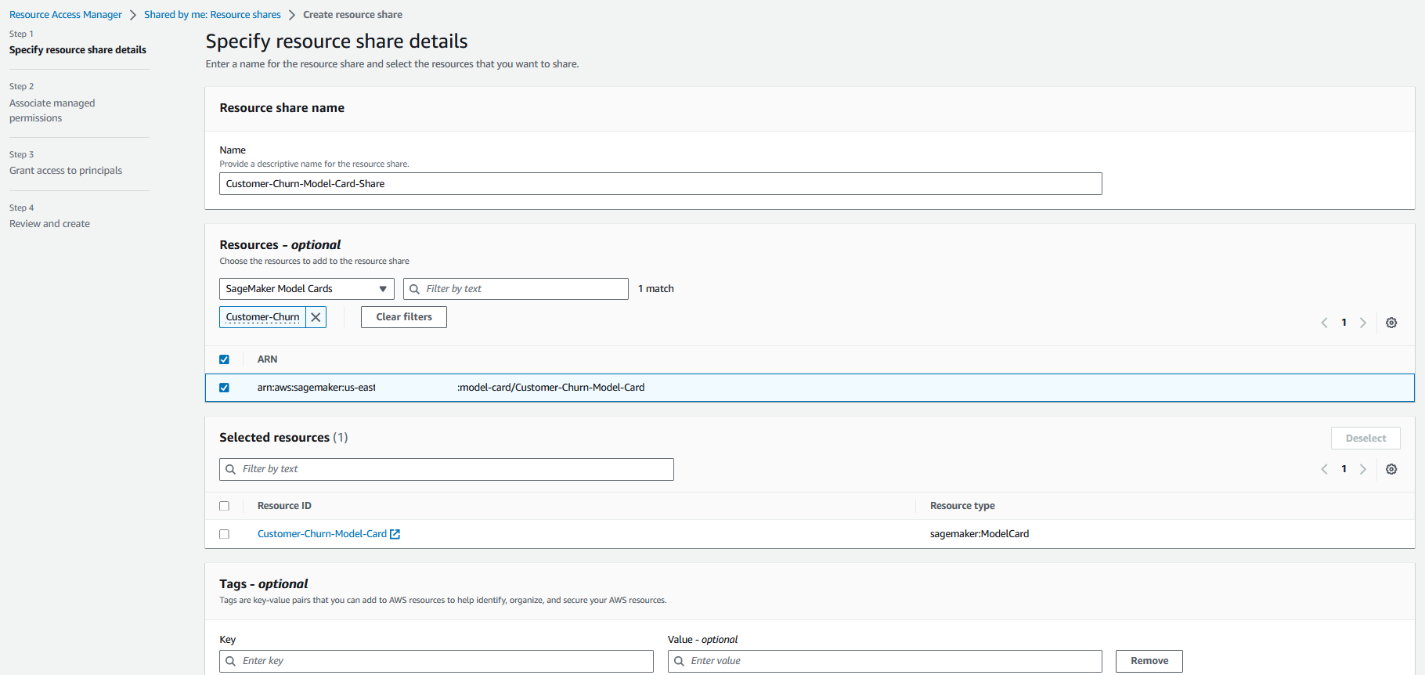

Geben Sie einen Namen für die Ressourcenfreigabe ein, zum Beispiel „Customer-Churn-Model-Card-Share“. In den Ressourcen – optional Wählen Sie im Abschnitt den Ressourcentyp als aus SageMaker-Modellkarten. Die Modellkarte, die wir im vorherigen Schritt erstellt haben, wird in der Liste angezeigt.

Wählen Sie dieses Modell aus und es wird im Abschnitt „Ausgewählte Ressourcen“ angezeigt. Wählen Sie diese Ressource erneut aus, wie in den folgenden Schritten gezeigt, und wählen Sie Weiter.

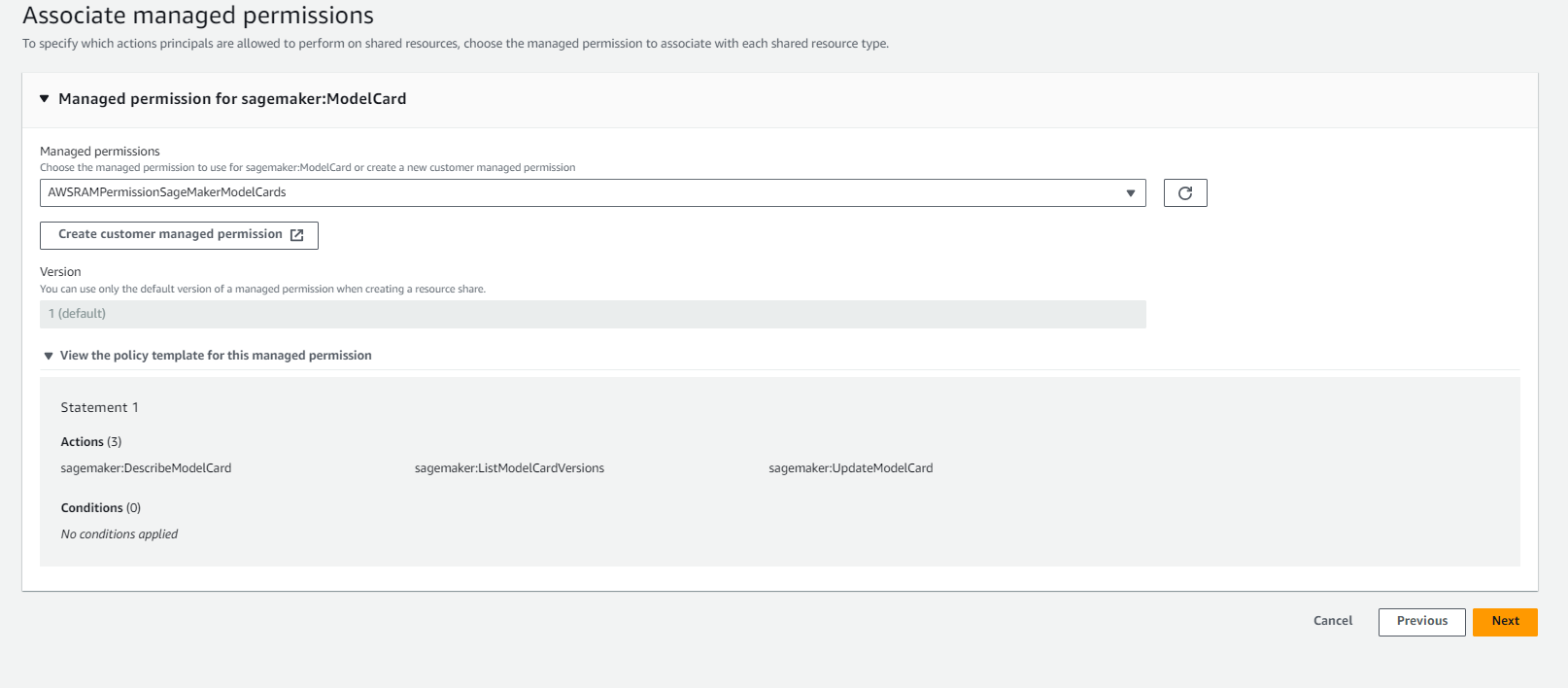

Auf der nächsten Seite können Sie die verwalteten Berechtigungen auswählen. Sie können benutzerdefinierte Berechtigungen erstellen oder die Standardoption „AWSRAMPermissionSageMakerModelCards”Und wählen Sie Weiter. Weitere Informationen finden Sie unter Verwalten von Berechtigungen im AWS RAM.

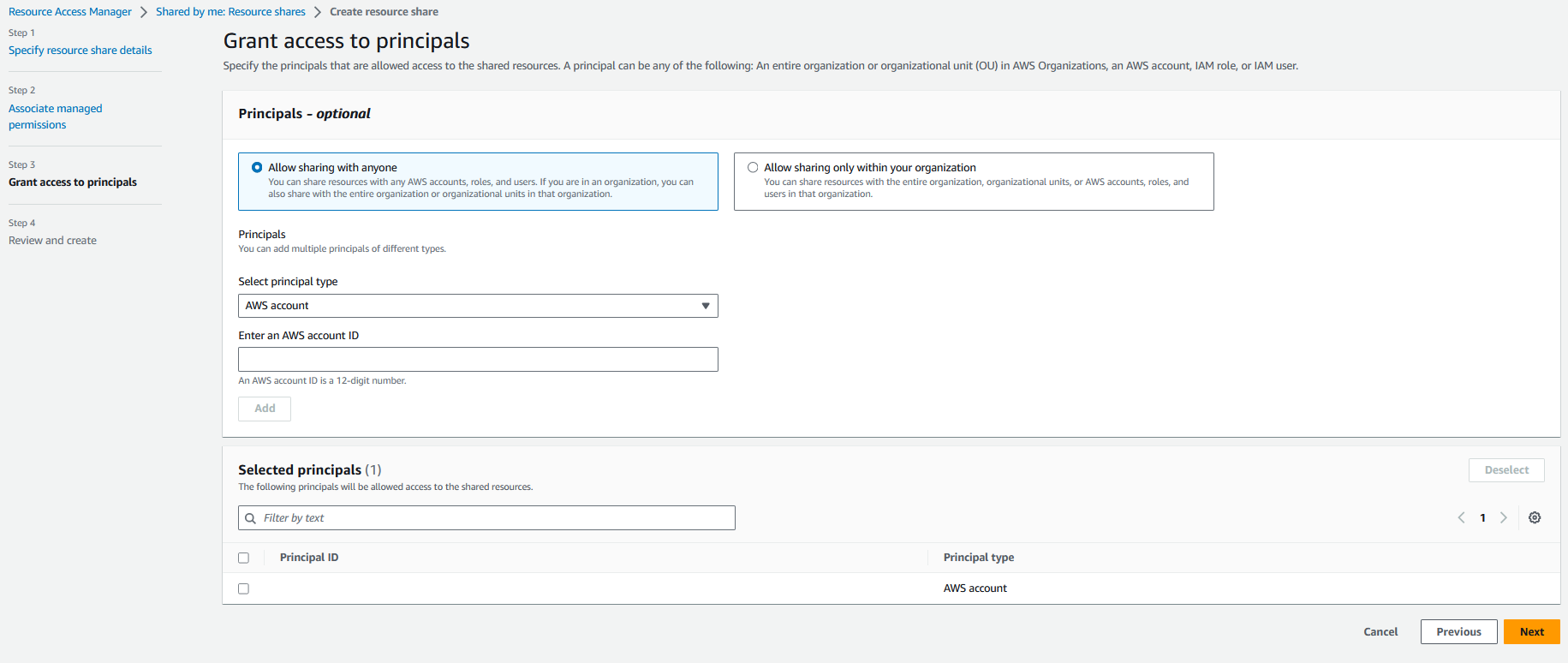

Auf der nächsten Seite können Sie Auftraggeber auswählen. Wählen Sie unter „Prinzipaltyp auswählen“ die Option aus AWS-Konto und geben Sie die ID des Kontos der Modellkarte ein. Wählen Speichern und fahren Sie mit der nächsten Seite fort.

Überprüfen Sie auf der letzten Seite die Informationen und wählen Sie „Ressourcenfreigabe erstellen“. Alternativ können Sie Folgendes verwenden AWS-CLI Befehl zum Erstellen einer Ressourcenfreigabe:

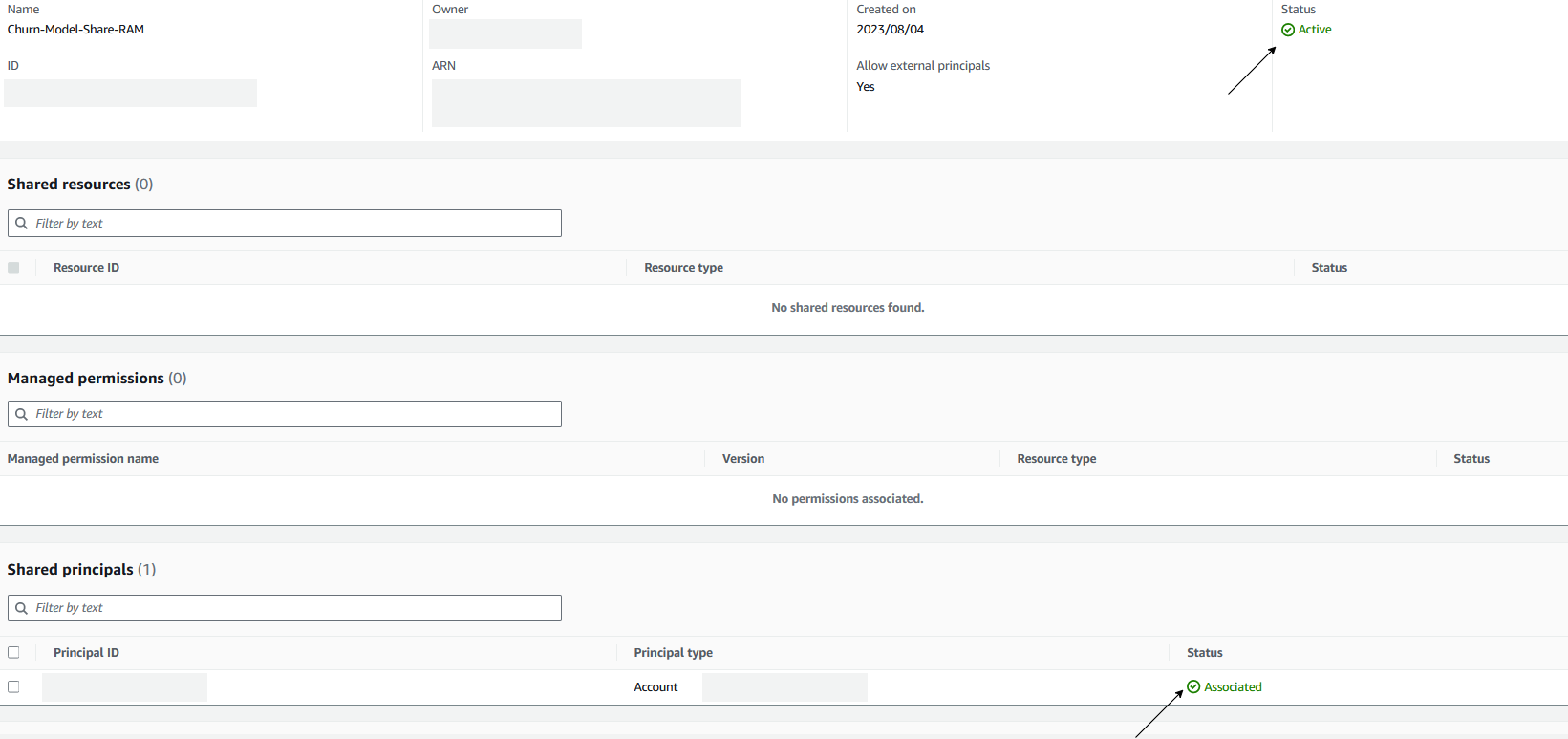

Auf der AWS RAM-Konsole sehen Sie die Attribute der Ressourcenfreigabe. Stellen Sie sicher, dass sich „Freigegebene Ressourcen“, „Verwaltete Berechtigungen“ und „Freigegebene Prinzipale“ im Verzeichnis „Associated”Status.

Nachdem Sie AWS RAM zum Erstellen einer Ressourcenfreigabe verwendet haben, kann den in der Ressourcenfreigabe angegebenen Prinzipalen Zugriff auf die Ressourcen der Freigabe gewährt werden.

- Wenn Sie die AWS-RAM-Freigabe mit AWS Organizations aktivieren und Ihre Prinzipale, mit denen Sie teilen, in derselben Organisation wie das Freigabekonto sind, können diese Prinzipale Zugriff erhalten, sobald ihr Kontoadministrator ihnen Berechtigungen erteilt.

- Wenn Sie die AWS-RAM-Freigabe mit Organisationen nicht aktivieren, können Sie dennoch Ressourcen mit einzelnen AWS-Konten in Ihrer Organisation teilen. Der Administrator im verbrauchenden Konto erhält eine Einladung, der Ressourcenfreigabe beizutreten, und er muss die Einladung annehmen, bevor die in der Ressourcenfreigabe angegebenen Prinzipale auf die freigegebenen Ressourcen zugreifen können.

- Sie können Inhalte auch mit Konten außerhalb Ihrer Organisation teilen, wenn der Ressourcentyp dies unterstützt. Der Administrator im verbrauchenden Konto erhält eine Einladung, der Ressourcenfreigabe beizutreten, und er muss die Einladung annehmen, bevor die in der Ressourcenfreigabe angegebenen Prinzipale auf die freigegebenen Ressourcen zugreifen können.

Weitere Informationen zu AWS RAM finden Sie unter Begriffe und Konzepte für AWS RAM.

Zugriff auf freigegebene Modellkarten

Jetzt können wir uns beim gemeinsamen AWS-Konto anmelden, um auf die Modellkarte zuzugreifen. Stellen Sie sicher, dass Sie mit IAM-Berechtigungen (IAM-Rolle) auf die AWS-Konsole zugreifen, die den Zugriff auf AWS RAM ermöglichen.

Mit AWS RAM können Sie die Ressourcenfreigaben anzeigen, zu denen Sie hinzugefügt wurden, die freigegebenen Ressourcen, auf die Sie zugreifen können, und die AWS-Konten, die über mit Ihnen gemeinsam genutzte Ressourcen verfügen. Sie können eine Ressourcenfreigabe auch verlassen, wenn Sie keinen Zugriff mehr auf die freigegebenen Ressourcen benötigen.

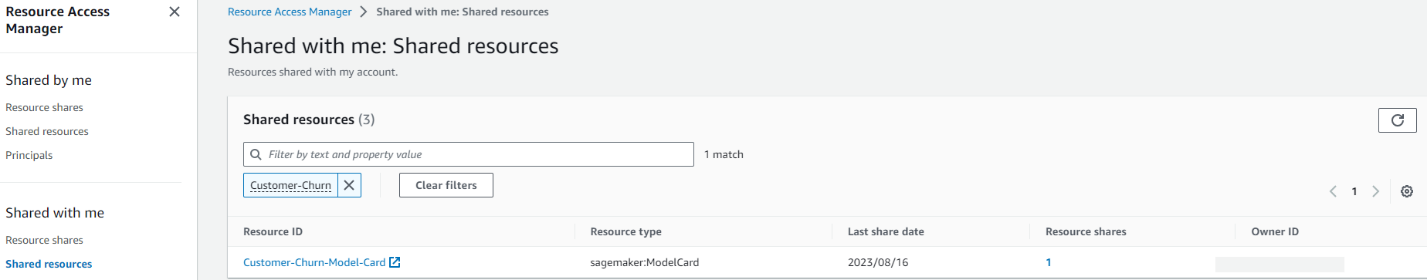

So zeigen Sie die Modellkarte im freigegebenen AWS-Konto an:

- Navigieren Sie zu der Mit mir geteilt: Geteilte Ressourcen Seite in der AWS RAM-Konsole.

- Stellen Sie sicher, dass Sie in derselben AWS-Region arbeiten, in der die Freigabe erstellt wurde.

- Das über das Modellkonto freigegebene Modell ist im Eintrag verfügbar. Wenn eine lange Ressourcenliste vorhanden ist, können Sie einen Filter anwenden, um bestimmte freigegebene Ressourcen zu finden. Sie können mehrere Filter anwenden, um Ihre Suche einzugrenzen.

- Folgende Informationen stehen zur Verfügung:

- Ressourcen-ID – Die ID der Ressource. Dies ist der Name der Modellkarte, die wir zuvor im Modellkartenkonto erstellt haben.

- Ressourcentyp – Die Art der Ressource.

- Datum der letzten Freigabe – Das Datum, an dem die Ressource für Sie freigegeben wurde.

- Ressourcenfreigaben – Die Anzahl der Ressourcenanteile, in denen die Ressource enthalten ist. Wählen Sie den Wert aus, um die Ressourcenanteile anzuzeigen.

- Besitzer-ID – Die ID des Prinzipals, dem die Ressource gehört.

Sie können auch über die AWS CLI-Option auf die Modellkarte zugreifen. Stellen Sie für die mit den richtigen Anmeldeinformationen konfigurierte AWS IAM-Richtlinie sicher, dass Sie über Berechtigungen zum Erstellen, Bearbeiten und Löschen von Modellkarten in Amazon SageMaker verfügen. Weitere Informationen finden Sie unter Konfigurieren Sie die AWS CLI.

Sie können die folgende AWS IAM-Berechtigungsrichtlinie als Vorlage verwenden:

Sie können den folgenden AWS CLI-Befehl ausführen, um auf die Details der freigegebenen Modellkarte zuzugreifen.

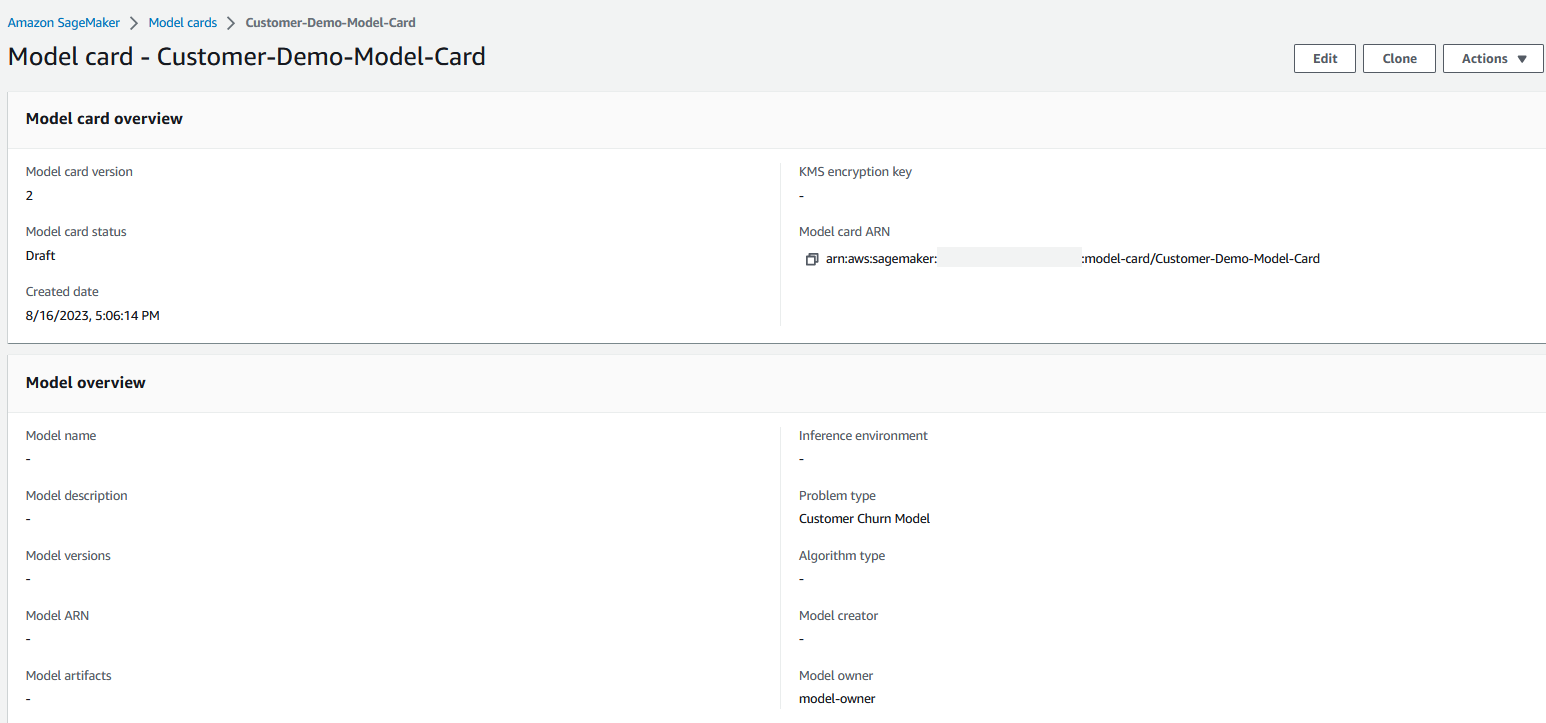

Jetzt können Sie von diesem Konto aus Änderungen an dieser Modellkarte vornehmen.

Nachdem Sie Änderungen vorgenommen haben, kehren Sie zum Modellkartenkonto zurück, um die Änderungen anzuzeigen, die wir in diesem gemeinsamen Konto vorgenommen haben.

Der Problemtyp wurde auf „Customer Churn Model“, den wir als Teil der AWS CLI-Befehlseingabe bereitgestellt hatten.

Aufräumen

Sie können nun die von Ihnen erstellte Modellkarte löschen. Stellen Sie sicher, dass Sie die AWS-RAM-Ressourcenfreigabe löschen, die Sie zur Freigabe der Modellkarte erstellt haben.

Zusammenfassung

In diesem Beitrag haben wir einen Überblick über die Multi-Account-Architektur zur sicheren und zuverlässigen Skalierung und Steuerung Ihrer ML-Workloads gegeben. Wir haben die Architekturmuster zum Einrichten der Modellkartenfreigabe besprochen und gezeigt, wie zentralisierte Modellkartenfreigabemuster funktionieren. Schließlich richten wir die gemeinsame Nutzung von Modellkarten über mehrere Konten ein, um die Sichtbarkeit und Governance in Ihrem Modellentwicklungslebenszyklus zu verbessern. Wir empfehlen Ihnen, die neue Funktion zum Teilen von Modellkarten auszuprobieren und uns Ihr Feedback mitzuteilen.

Über die Autoren

Vishal Naik ist Sr. Solutions Architect bei Amazon Web Services (AWS). Er ist ein Entwickler, dem es Spaß macht, Kunden dabei zu helfen, ihre Geschäftsanforderungen zu erfüllen und komplexe Herausforderungen mit AWS-Lösungen und Best Practices zu lösen. Zu seinen Schwerpunkten zählen maschinelles Lernen, DevOps und Container. In seiner Freizeit dreht Vishal gerne Kurzfilme über Zeitreisen und alternative Universen.

Vishal Naik ist Sr. Solutions Architect bei Amazon Web Services (AWS). Er ist ein Entwickler, dem es Spaß macht, Kunden dabei zu helfen, ihre Geschäftsanforderungen zu erfüllen und komplexe Herausforderungen mit AWS-Lösungen und Best Practices zu lösen. Zu seinen Schwerpunkten zählen maschinelles Lernen, DevOps und Container. In seiner Freizeit dreht Vishal gerne Kurzfilme über Zeitreisen und alternative Universen.

Widder Vittal ist Principal ML Solutions Architect bei AWS. Er verfügt über mehr als 20 Jahre Erfahrung in der Architektur und Entwicklung verteilter, Hybrid- und Cloud-Anwendungen. Seine Leidenschaft gilt der Entwicklung sicherer und skalierbarer KI/ML- und Big-Data-Lösungen, um Unternehmenskunden bei der Einführung und Optimierung der Cloud zu unterstützen und so ihre Geschäftsergebnisse zu verbessern. In seiner Freizeit fährt er Motorrad und geht mit seinem zweijährigen Schäfchen spazieren!

Widder Vittal ist Principal ML Solutions Architect bei AWS. Er verfügt über mehr als 20 Jahre Erfahrung in der Architektur und Entwicklung verteilter, Hybrid- und Cloud-Anwendungen. Seine Leidenschaft gilt der Entwicklung sicherer und skalierbarer KI/ML- und Big-Data-Lösungen, um Unternehmenskunden bei der Einführung und Optimierung der Cloud zu unterstützen und so ihre Geschäftsergebnisse zu verbessern. In seiner Freizeit fährt er Motorrad und geht mit seinem zweijährigen Schäfchen spazieren!

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- ChartPrime. Verbessern Sie Ihr Handelsspiel mit ChartPrime. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/use-amazon-sagemaker-model-card-sharing-to-improve-model-governance/

- :hast

- :Ist

- :Wo

- $UP

- 10

- 100

- 20

- 20 Jahre

- 2022

- 361

- 7

- 700

- 9

- a

- Über Uns

- beschleunigen

- Akzeptieren

- Zugang

- Zugänglichkeit

- Zugriff

- erreichen

- Konto

- Trading Konten

- Erreichen

- über

- Action

- Aktivitäten

- Aktivität

- hinzufügen

- hinzugefügt

- Zusatz

- zusätzlich

- adoptieren

- Adoption

- Nach der

- aufs Neue

- Aggregat

- AI

- AI / ML

- erlauben

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- und

- Ein anderer

- APIs

- erscheinen

- Anwendungen

- Bewerben

- Ansatz

- Ansätze

- Architektur

- SIND

- Bereich

- künstlich

- künstliche Intelligenz

- Künstliche Intelligenz (AI)

- AS

- annehmen

- At

- Attribute

- Wirtschaftsprüfung

- automatisieren

- Automation

- verfügbar

- AWS

- AWS Identitäts- und Zugriffsverwaltung (IAM)

- AWS re: Invent

- Zurück

- basierend

- BE

- weil

- werden

- Werden

- war

- Bevor

- Vorteile

- BESTE

- Best Practices

- Big

- Big Data

- beide

- bauen

- Baumeister

- Building

- baut

- Geschäft

- Geschäftsanwendungen

- aber

- by

- namens

- CAN

- Fähigkeiten

- capability

- Karte

- Karten

- Häuser

- Fälle

- Center

- Hauptgeschäftsstelle

- zentralisierte

- Herausforderungen

- Änderungen

- Auswählen

- Cloud

- Cloud-Einführung

- Code

- Zusammenarbeit

- Komplex

- Compliance

- Komponente

- Konzepte

- Leiten

- Konfiguration

- konfiguriert

- Konsul (Console)

- verbraucht

- Behälter

- fortsetzen

- kontinuierlich

- Beiträge

- Smartgeräte App

- Kernbereich

- und beseitigen Muskelschwäche

- Abdeckung

- erstellen

- erstellt

- Schaffung

- Referenzen

- kritischem

- Original

- Kunde

- Kunden

- technische Daten

- Datenwissenschaft

- Datenwissenschaftler

- Datum

- Entscheidungen

- tief

- Standard

- Lieferanten

- Abhängig

- einsetzen

- Bereitstellen

- Einsatz

- beschreiben

- beschrieben

- Entwerfen

- Details

- Entwickler

- Entwicklung

- Unterschied

- diskutiert

- verteilt

- tauchen

- do

- Dokumentation

- Nicht

- Lüftung

- zwei

- im

- jeder

- Früher

- bewirken

- ermöglichen

- ermutigen

- Endpunkt

- Ingenieur

- Ingenieure

- Verbessert

- genießen

- gewährleisten

- Enter

- Unternehmen

- Unternehmen

- Umgebungen

- Auswertung

- Beispiel

- Erweitern Sie die Funktionalität der

- ERFAHRUNGEN

- Experimente

- Tatsache

- Merkmal

- Föderation

- Feedback

- Felder

- Filme

- Filter

- Filter

- Endlich

- Finden Sie

- Vorname

- Setzen Sie mit Achtsamkeit

- Folgende

- folgt

- Aussichten für

- Foundation

- Unser Ansatz

- für

- weiter

- bekommen

- bekommen

- gibt

- Go

- Governance

- regieren

- erteilt

- für Balkonkraftwerke Reduzierung

- hätten

- Schwerer

- Haben

- mit

- he

- Hilfe

- Unternehmen

- hilft

- seine

- Ultraschall

- Hilfe

- aber

- HTML

- HTTPS

- Nabe

- Hybrid

- ID

- Identitätsschutz

- if

- zeigt

- umgesetzt

- wichtig

- zu unterstützen,

- Verbesserung

- in

- inklusive

- Dazu gehören

- Aufnahme

- Krankengymnastik

- Information

- Varianten des Eingangssignals:

- Integration

- Intelligenz

- beabsichtigt

- in

- eingeführt

- Einladung

- beteiligt

- Isolierung

- IT

- SEINE

- join

- Reise

- jpg

- Wesentliche

- Wissen

- Nachname

- lernen

- Verlassen

- Rechtlich

- lassen

- Lebenszyklus

- Gefällt mir

- Liste

- listing

- Log

- Lang

- länger

- liebt

- Maschine

- Maschinelles Lernen

- gemacht

- Main

- Mainstream

- halten

- um

- Making

- verwaltet

- Management

- Manager

- flächendeckende Gesundheitsprogramme

- viele

- markiert

- me

- Metadaten

- ML

- MLOps

- Model

- Modell

- für

- mehr

- Motorrad

- Multi

- mehrere

- sollen

- Name

- schmal

- Need

- Bedürfnisse

- Neu

- weiter

- nicht

- jetzt an

- Anzahl

- of

- on

- EINEM

- einzige

- die

- Betriebs-

- Optimierung

- Option

- or

- Organisation

- Organisationen

- Ergebnisse

- Möglichkeiten für das Ausgangssignal:

- aussen

- übrig

- Überblick

- besitzen

- Besitzt

- Seite

- Teil

- leidenschaftlich

- Muster

- schwebend

- Berechtigungen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Politik durchzulesen

- Datenschutzrichtlinien

- Post

- angetriebene

- Praxis

- Praktiken

- Voraussetzungen

- früher

- vorher

- Principal

- Auftraggeber

- Grundsätze

- Datenschutz

- Aufgabenstellung:

- anpassen

- Verarbeitung

- Produktion

- Projekt

- Projekte

- ordnungsgemäße

- die

- vorausgesetzt

- bietet

- Zwecke

- Qualität

- RAM

- RE

- Schreibgeschützter Modus

- erhalten

- erhält

- empfehlen

- empfohlen

- Region

- Registrierung:

- Registratur

- Zuverlässigkeit

- Rest

- Reporting

- erfordern

- Voraussetzungen:

- Ressourcen

- Downloads

- Die Ergebnisse

- Überprüfen

- Bewertungen

- Rollen

- Führen Sie

- Laufen

- läuft

- sagemaker

- gleich

- Skalierbarkeit

- skalierbaren

- Skalieren

- Skalierung

- Szenario

- Wissenschaft

- Wissenschaftler

- Wissenschaftler

- Suche

- Abschnitt

- Verbindung

- sicher

- Sicherheitdienst

- sehen

- ausgewählt

- Lösungen

- kompensieren

- Einstellung

- Setup

- Teilen

- von Locals geführtes

- Shares

- ,,teilen"

- Blatt

- Short

- erklären

- gezeigt

- Konzerte

- da

- Single

- So

- Lösungen

- LÖSEN

- einige

- bald

- Quelle

- spezifisch

- angegeben

- Stakeholder

- Standardisierung

- Anfang

- begonnen

- beginnt

- Erklärung

- Status

- Schritt

- Shritte

- Immer noch

- Strategie

- rationalisieren

- erfolgreich

- Unterstützung

- Unterstützt

- sicher

- Schwall

- Team

- Teams

- Technische

- Technologies

- Vorlage

- Test

- Tests

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- die Informationen

- ihr

- Sie

- Themen

- dann

- Dort.

- damit

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- diejenigen

- Durch

- während

- Zeit

- Zeitreise

- zu

- Werkzeuge

- Tracking

- Ausbildung

- Transparenz

- reisen

- auslösen

- Wahrheit

- versuchen

- WENDE

- tippe

- für

- Universum

- aktualisiert

- us

- Anwendungsbereich

- -

- Anwendungsfall

- benutzt

- Nutzer

- Verwendung von

- v1

- Bestätigung

- Wert

- Version

- Anzeigen

- vishal

- Sichtbarkeit

- wurde

- we

- Netz

- Web-Services

- wann

- welche

- während

- WHO

- werden wir

- mit

- .

- Arbeiten

- Jahr

- Du

- Ihr

- Zephyrnet