Dieser Beitrag wurde gemeinsam von Shirsha Ray Chaudhuri, Harpreet Singh Baath, Rashmi B Pawar und Palvika Bansal von Thomson Reuters verfasst.

Thomson Reuters (TR), ein globales, inhalts- und technologieorientiertes Unternehmen, nutzt seit Jahrzehnten künstliche Intelligenz (KI) und maschinelles Lernen (ML) in seinen professionellen Informationsprodukten. Thomson Reuters Labs, das engagierte Innovationsteam des Unternehmens, war maßgeblich an seiner Pionierarbeit in den Bereichen KI und Verarbeitung natürlicher Sprache (NLP) beteiligt. Ein wichtiger Meilenstein war die Einführung von Westlaw Is Natural (WIN) im Jahr 1992. Diese Technologie war eine der ersten ihrer Art und nutzte NLP für eine effizientere und natürlichere Rechtsrecherche. Schneller Vorlauf bis 2023 und Thomson Reuters definiert weiterhin die Zukunft der Fachkräfte durch schnelle Innovation, kreative Lösungen und leistungsstarke Technologie.

Die Einführung generativer KI bietet Thomson Reuters eine weitere Möglichkeit, mit Kunden zusammenzuarbeiten und ihre Arbeitsweise noch einmal zu verbessern, indem sie Fachleuten dabei hilft, Erkenntnisse zu gewinnen und Arbeitsabläufe zu automatisieren, damit sie ihre Zeit auf das Wesentliche konzentrieren können. Während Thomson Reuters die Grenzen dessen verschiebt, was generative KI und andere Technologien für den modernen Profi leisten können, stellt sich die Frage, wie das Unternehmen die Leistungsfähigkeit dieser Technologie für seine eigenen Teams nutzt?

Thomson Reuters legt großen Wert darauf, das Bewusstsein und Verständnis für KI bei Kollegen in jedem Team und jedem Geschäftsbereich zu steigern. Ausgehend von den Grundprinzipien dessen, was KI ist und wie ML funktioniert, bietet es ein fortlaufendes Programm unternehmensweiter KI-Sensibilisierungssitzungen an, darunter Webinare, Schulungsmaterialien und Podiumsdiskussionen. Während dieser Sitzungen tauchten Ideen auf, wie KI eingesetzt werden könnte, während die Kollegen über den Einsatz von Tools nachdachten, die ihnen dabei helfen, KI sowohl für ihre täglichen Aufgaben als auch für die Betreuung ihrer Kunden einzusetzen.

In diesem Beitrag diskutieren wir, wie Thomson Reuters Labs Open Arena geschaffen hat, den unternehmensweiten LLM-Spielplatz (Large Language Model) von Thomson Reuters, der in Zusammenarbeit mit AWS entwickelt wurde. Das ursprüngliche Konzept entstand aus einem AI/ML-Hackathon, der von Simone Zucchet (AWS Solutions Architect) und Tim Precious (AWS Account Manager) unterstützt wurde, und wurde mithilfe von AWS-Services in weniger als 6 Wochen mit Unterstützung von AWS zur Produktion entwickelt. Von AWS verwaltete Dienste wie AWS Lambda, Amazon DynamoDB und Amazon Sage Makersowie die vorgefertigten Hugging Face Deep Learning Containers (DLCs) trugen zum Innovationstempo bei. Open Arena hat dazu beigetragen, unternehmensweite Experimente mit generativer KI in einer sicheren und kontrollierten Umgebung zu ermöglichen.

Open Arena geht tiefer und ist ein webbasierter Spielplatz, der es Benutzern ermöglicht, mit einer wachsenden Anzahl von Tools zu experimentieren, die mit LLMs aktiviert sind. Dies bietet Mitarbeitern von Thomson Reuters, die keine Erfahrung im Programmieren haben, aber die Kunst des Möglichen mit generativer KI bei TR erkunden möchten, einen nicht-programmatischen Zugang. Open Arena wurde entwickelt, um schnelle Antworten aus verschiedenen Korporasätzen zu erhalten, z. B. für Kundendienstmitarbeiter, Lösungen zum Erhalten schneller Antworten von Websites, Lösungen zum Zusammenfassen und Überprüfen von Punkten in einem Dokument und vieles mehr. Die Fähigkeiten von Open Arena wachsen weiter, da die Erfahrungen der Mitarbeiter von Thomson Reuters neue Ideen anregen und neue Trends im Bereich der generativen KI entstehen. Dies alles wird durch die modulare serverlose AWS-Architektur ermöglicht, die der Lösung zugrunde liegt.

Vorstellung der offenen Arena

Das Ziel von Thomson Reuters war klar: eine sichere, benutzerfreundliche Plattform – eine „offene Arena“ – als unternehmensweiten Spielplatz aufzubauen. Hier konnten interne Teams nicht nur die verschiedenen intern entwickelten LLMs und solche aus der Open-Source-Community erkunden und testen, beispielsweise mit der Partnerschaft zwischen AWS und Hugging Face, sondern auch einzigartige Anwendungsfälle entdecken, indem sie die Fähigkeiten von LLMs mit denen von Thomson Reuters zusammenführten umfangreiche Unternehmensdaten. Eine solche Plattform würde die Fähigkeit von Teams verbessern, innovative Lösungen zu entwickeln und die Produkte und Dienstleistungen zu verbessern, die Thomson Reuters seinen Kunden anbieten könnte.

Die geplante Open-Arena-Plattform würde den vielfältigen Teams von Thomson Reuters weltweit dienen und ihnen einen Spielplatz für die freie Interaktion mit LLMs bieten. Die Möglichkeit, diese Interaktion in einer kontrollierten Umgebung durchzuführen, würde es den Teams ermöglichen, neue Anwendungen und Methoden zu entdecken, die bei einer weniger direkten Auseinandersetzung mit diesen komplexen Modellen möglicherweise nicht erkennbar gewesen wären.

Bau der offenen Arena

Der Bau der Open Arena war ein vielschichtiger Prozess. Unser Ziel war es, die Fähigkeiten der serverlosen und ML-Dienste von AWS zu nutzen, um eine Lösung zu entwickeln, die es den Mitarbeitern von Thomson Reuters nahtlos ermöglicht, mit den neuesten LLMs zu experimentieren. Wir erkannten das Potenzial dieser Dienste, nicht nur Skalierbarkeit und Verwaltbarkeit zu bieten, sondern auch Kosteneffizienz sicherzustellen.

Lösungsüberblick

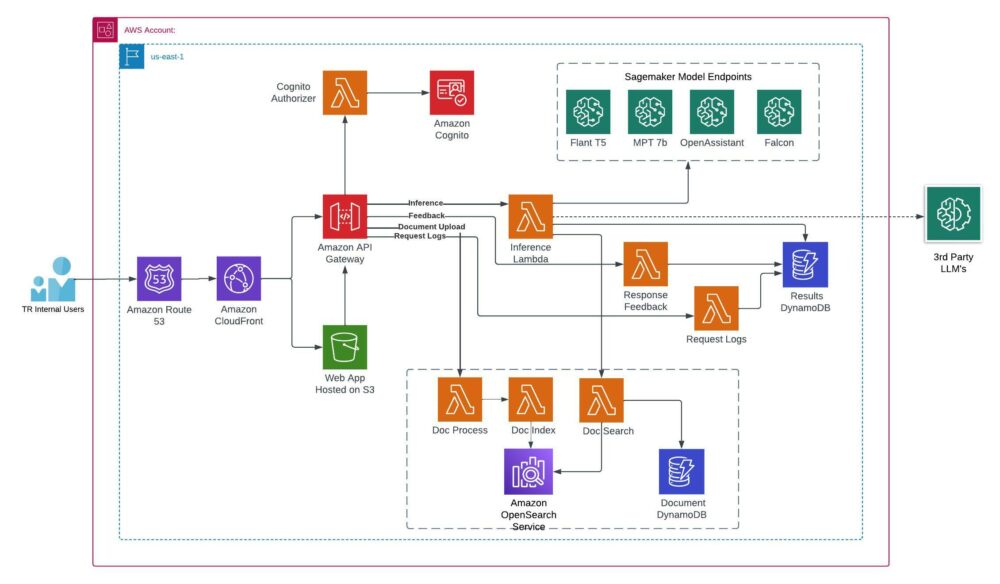

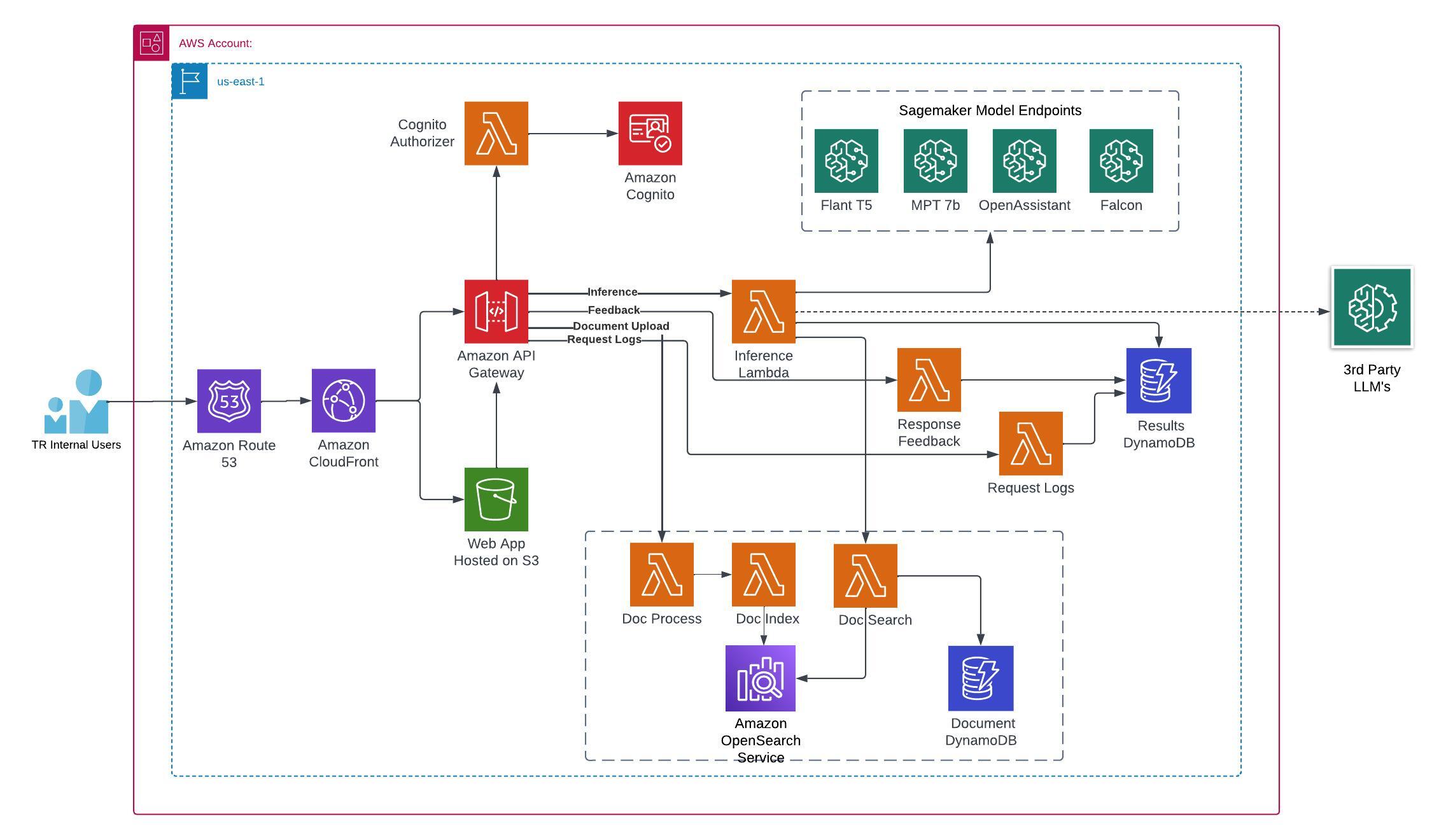

Von der Schaffung einer robusten Umgebung für die Modellbereitstellung und Feinabstimmung bis hin zur Gewährleistung einer sorgfältigen Datenverwaltung und der Bereitstellung eines nahtlosen Benutzererlebnisses musste TR jeden Aspekt in mehrere AWS-Dienste integrieren. Die Architektur von Open Arena wurde so konzipiert, dass sie umfassend und dennoch intuitiv ist und Komplexität mit Benutzerfreundlichkeit in Einklang bringt. Das folgende Diagramm veranschaulicht diese Architektur.

SageMaker diente als Rückgrat, erleichterte die Modellbereitstellung als SageMaker-Endpunkte und stellte eine robuste Umgebung für die Feinabstimmung der Modelle bereit. Wir haben den von AWS angebotenen Hugging Face on SageMaker DLC genutzt, um unseren Bereitstellungsprozess zu verbessern. Darüber hinaus haben wir das SageMaker Hugging Face Inference Toolkit und die Accelerate-Bibliothek verwendet, um den Inferenzprozess zu beschleunigen und die Anforderungen beim Ausführen komplexer und ressourcenintensiver Modelle effektiv zu bewältigen. Diese umfassenden Tools trugen wesentlich dazu bei, die schnelle und nahtlose Bereitstellung unserer LLMs sicherzustellen. Lambda-Funktionen, ausgelöst durch Amazon API-Gateway, verwaltete die APIs und sorgte für eine sorgfältige Vor- und Nachbearbeitung der Daten.

In unserem Bestreben, ein nahtloses Benutzererlebnis zu bieten, haben wir ein sicheres API-Gateway eingeführt, um das in gehostete Frontend zu verbinden Amazon Simple Storage-Service (Amazon S3) zum Lambda-Backend. Wir haben das Frontend als statische Site auf einem S3-Bucket bereitgestellt und die Benutzerauthentifizierung mithilfe von sichergestellt Amazon CloudFront und der Single-Sign-On-Mechanismus unseres Unternehmens.

Open Arena wurde so konzipiert, dass es sich über REST-APIs nahtlos in mehrere LLMs integrieren lässt. Dadurch wurde sichergestellt, dass die Plattform flexibel genug war, um schnell zu reagieren und sich zu integrieren, wenn neue hochmoderne Modelle entwickelt und im schnelllebigen Bereich der generativen KI veröffentlicht wurden. Open Arena wurde von Anfang an so konzipiert, dass es einen sicheren KI/ML-Spielplatz für Unternehmen bietet, sodass Mitarbeiter von Thomson Reuters sofort nach der Veröffentlichung mit jedem hochmodernen LLM experimentieren können. Durch die Verwendung von Hugging Face-Modellen auf SageMaker konnte das Team die Modelle in einer sicheren Umgebung optimieren, da alle Daten verschlüsselt sind und die Virtual Private Cloud (VPC) nicht verlassen, wodurch sichergestellt wird, dass die Daten privat und vertraulich bleiben.

DynamoDB, unser ausgewählter NoSQL-Datenbankdienst, speichert und verwaltet effizient eine Vielzahl von Daten, einschließlich Benutzeranfragen, Antworten, Antwortzeiten und Benutzerdaten. Um den Entwicklungs- und Bereitstellungsprozess zu optimieren, haben wir Folgendes eingesetzt: AWS CodeBuild und AWS CodePipeline für Continuous Integration und Continuous Delivery (CI/CD). Die Überwachung der Infrastruktur und die Sicherstellung ihres optimalen Funktionierens wurden ermöglicht Amazon CloudWatch, das benutzerdefinierte Dashboards und umfassende Protokollierungsfunktionen bereitstellte.

Modellentwicklung und -integration

Das Herzstück von Open Arena ist das vielfältige LLM-Sortiment, das sowohl Open-Source-Modelle als auch selbst entwickelte Modelle umfasst. Diese Modelle wurden so optimiert, dass sie auf spezifische Benutzeraufforderungen reagieren.

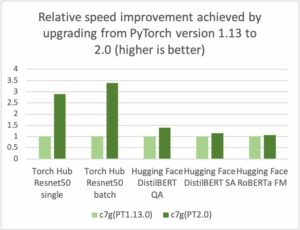

Wir haben mit verschiedenen LLMs für verschiedene Anwendungsfälle in Open Arena experimentiert, darunter Flan-T5-XL, Open Assistant, MPT, Falcon, und Flan-T5-XL anhand verfügbarer Open-Source-Datensätze mithilfe des Parameters „Effiziente Feinabstimmung“ verfeinert Technik. Wir haben die Bitsandbytes-Integration von Hugging Face verwendet, um mit verschiedenen Quantisierungstechniken zu experimentieren. Dadurch konnten wir unsere LLMs für mehr Leistung und Effizienz optimieren und so den Weg für noch größere Innovationen ebnen. Bei der Auswahl eines Modells als Backend hinter diesen Anwendungsfällen haben wir verschiedene Aspekte berücksichtigt, beispielsweise wie die Leistung dieser Modelle bei NLP-Aufgaben aussieht, die für Thomson Reuters relevant sind. Darüber hinaus mussten wir technische Aspekte berücksichtigen, wie zum Beispiel die folgenden:

- Erhöhte Effizienz beim Erstellen von Anwendungen mit LLMs – Schnelle Integration und Bereitstellung hochmoderner LLMs in unsere Anwendungen und Workloads, die auf AWS laufen, unter Verwendung vertrauter Kontrollen und Integrationen mit der Tiefe und Breite von AWS

- Sichere Anpassung – Sicherstellen, dass alle zur Feinabstimmung von LLMs verwendeten Daten verschlüsselt bleiben und die VPC nicht verlassen

- Flexibilität – Die Möglichkeit, aus einer großen Auswahl an nativen und Open-Source-LLMs von AWS auszuwählen, um das richtige Modell für unsere vielfältigen Anwendungsfälle zu finden

Wir haben Fragen gestellt: Sind die höheren Kosten größerer Modelle durch erhebliche Leistungssteigerungen gerechtfertigt? Können diese Modelle lange Dokumente verarbeiten?

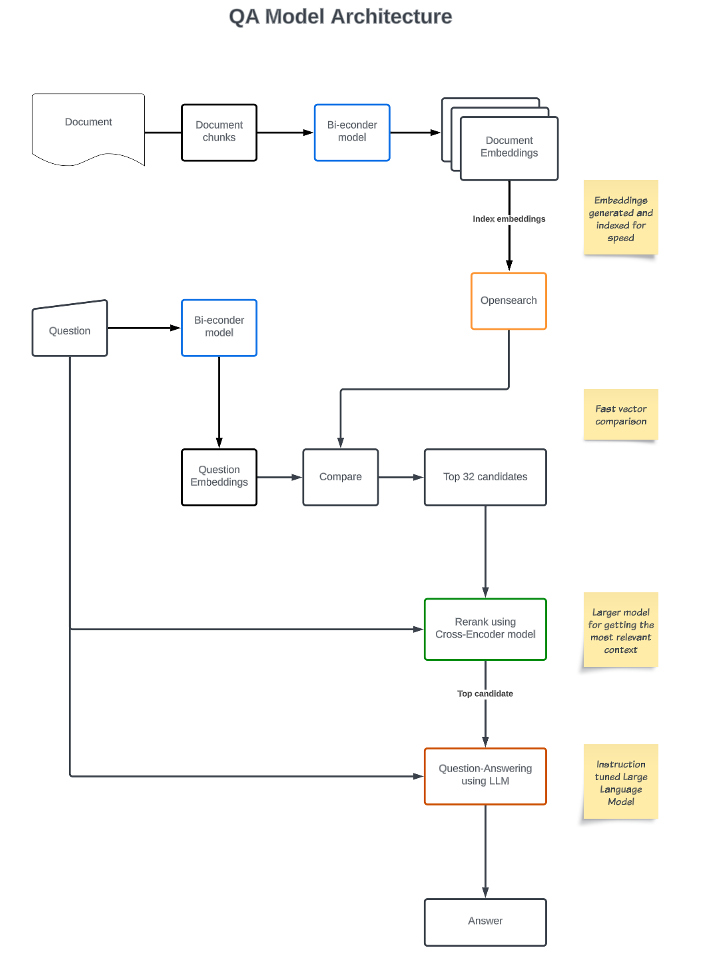

Das folgende Diagramm veranschaulicht unsere Modellarchitektur.

Wir haben diese Modelle anhand der oben genannten Aspekte anhand von Open-Source-Rechtsdatensätzen und internen Datensätzen von Thomson Reuters bewertet, um sie für bestimmte Anwendungsfälle zu bewerten.

Für inhaltsbasierte Anwendungsfälle (Erfahrungen, die Antworten aus einem bestimmten Korpus erfordern) haben wir eine Abruf erweiterte Generation (RAG)-Pipeline vorhanden, die den relevantesten Inhalt für die Abfrage abruft. In solchen Pipelines werden Dokumente in Blöcke aufgeteilt und anschließend Einbettungen erstellt und in OpenSearch gespeichert. Um die am besten passenden Dokumente oder Blöcke zu erhalten, verwenden wir den Retrieval/Re-Ranker-Ansatz basierend auf Bi-Encoder- und Cross-Encoder-Modellen. Die abgerufene beste Übereinstimmung wird dann zusammen mit der Abfrage als Eingabe an das LLM übergeben, um die beste Antwort zu generieren.

Die Integration der internen Inhalte von Thomson Reuters mit der LLM-Erfahrung hat maßgeblich dazu beigetragen, dass Benutzer relevantere und aufschlussreichere Ergebnisse aus diesen Modellen ziehen können. Noch wichtiger ist, dass dadurch in jedem Team Ideen für Möglichkeiten zur Einführung KI-gestützter Lösungen in ihren Geschäftsabläufen entstanden sind.

Offene Arena-Kacheln: Erleichtert die Benutzerinteraktion

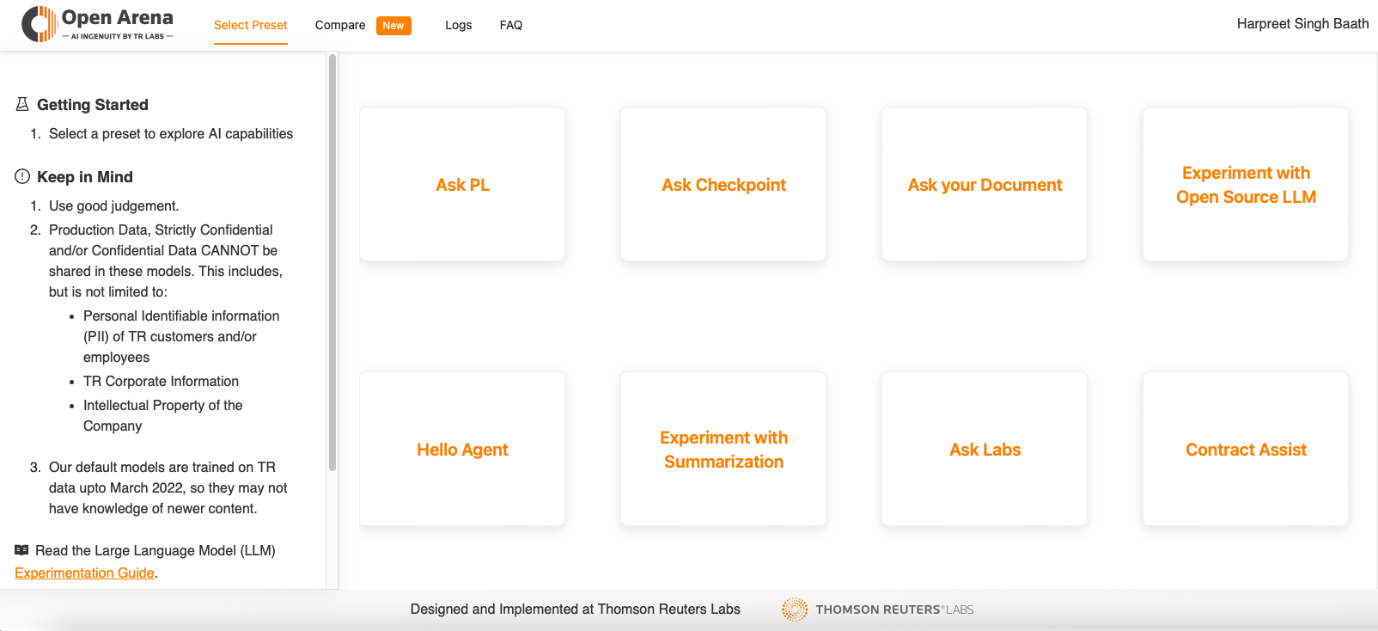

Open Arena verfügt über eine benutzerfreundliche Oberfläche, die mit voreingestellten Aktivierungskacheln für jedes Erlebnis ausgestattet ist, wie im folgenden Screenshot gezeigt. Diese Kacheln dienen als voreingestellte Interaktionen, die auf die spezifischen Anforderungen der Benutzer zugeschnitten sind.

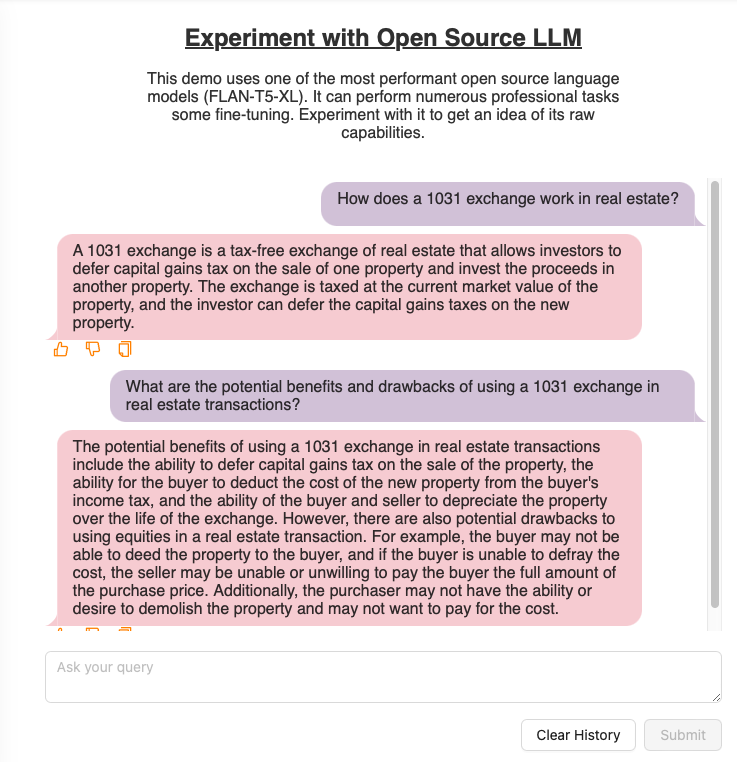

Beispielsweise öffnet die Kachel „Experimentieren mit Open-Source-LLM“ einen chatähnlichen Interaktionskanal mit Open-Source-LLMs.

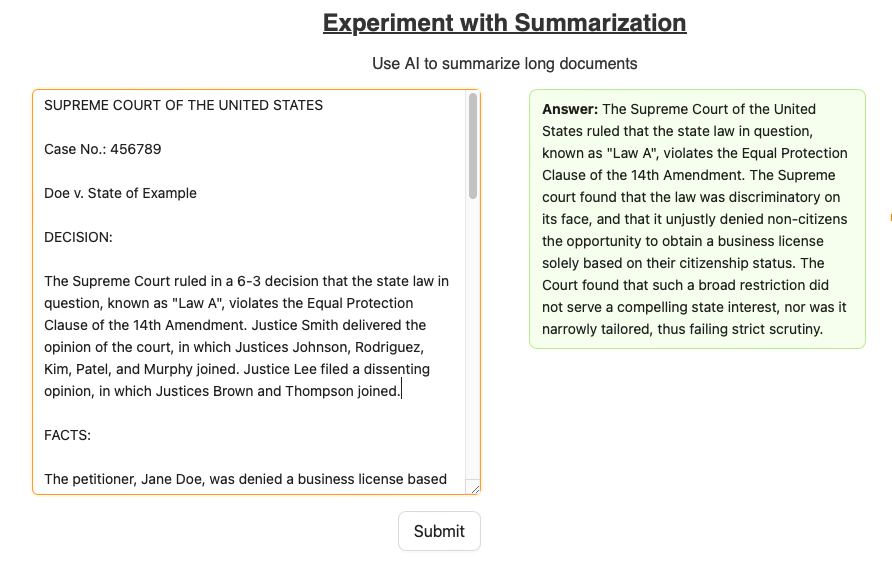

Über die Kachel „Fragen Sie Ihr Dokument“ können Benutzer Dokumente hochladen und spezifische Fragen zum Inhalt der LLMs stellen. Mit der Kachel „Experimentieren mit Zusammenfassung“ können Benutzer große Textmengen in prägnante Zusammenfassungen zusammenfassen, wie im folgenden Screenshot dargestellt.

Diese Kacheln vereinfachen die Benutzernutzung von KI-gestützten Arbeitslösungen und den Navigationsprozess innerhalb der Plattform, regen die Kreativität an und fördern die Entdeckung innovativer Anwendungsfälle.

Die Wirkung der Open Arena

Der Start der Open Arena markierte einen bedeutenden Meilenstein auf dem Weg von Thomson Reuters zur Förderung einer Kultur der Innovation und Zusammenarbeit. Der Erfolg der Plattform war unbestreitbar und ihre Vorteile machten sich im gesamten Unternehmen schnell bemerkbar.

Das intuitive, chatbasierte Design der Open Arena erforderte keine nennenswerten technischen Kenntnisse und machte sie für verschiedene Teams und unterschiedliche Jobrollen auf der ganzen Welt zugänglich. Diese Benutzerfreundlichkeit steigerte das Engagement, regte mehr Benutzer dazu an, die Plattform zu erkunden und innovative Anwendungsfälle vorzustellen.

In weniger als einem Monat bediente die Open Arena monatlich über 1,000 interne Benutzer aus der globalen Präsenz von TR, was einer durchschnittlichen Interaktionszeit von 5 Minuten pro Benutzer entspricht. Mit dem Ziel, interne TR-LLM-Experimente und die Crowdsourcing-Erstellung von LLM-Anwendungsfällen zu fördern, führte die Einführung von Open Arena zu einem Zustrom neuer Anwendungsfälle, wodurch die Leistungsfähigkeit von LLMs in Kombination mit den umfangreichen Datenressourcen von Thomson Reuters effektiv genutzt wurde.

Hier ist, was einige unserer Benutzer über die Open Arena zu sagen hatten:

„Open Arena bietet Mitarbeitern aus allen Bereichen des Unternehmens die Möglichkeit, praxisorientiert und praxisnah mit LLMs zu experimentieren. Es ist eine Sache, über KI-Tools zu lesen, und eine andere, sie selbst zu nutzen. Diese Plattform beschleunigt unsere KI-Lernbemühungen bei Thomson Reuters.“

– Abby Pinto, Leiterin für Talententwicklungslösungen, Personalfunktion

„OA (Open Arena) hat es mir ermöglicht, mit kniffligen Nachrichtenübersetzungsproblemen für den deutschen Sprachdienst von Reuters zu experimentieren, die herkömmliche Übersetzungssoftware nicht bewältigen kann, und das in einer sicheren Umgebung, in der ich unsere tatsächlichen Geschichten ohne Angst verwenden kann Datenlecks. Das Team hinter OA hat unglaublich schnell auf Vorschläge für neue Funktionen reagiert, was die Art von Service ist, von der man bei anderer Software nur träumen kann.“

– Scot W. Stevenson, leitender Korrespondent für aktuelle Nachrichten beim Deutschen Sprachdienst, Berlin, Deutschland

„Als ich Open Arena nutzte, kam mir die Idee, eine ähnliche Schnittstelle für unsere Teams aus Kundenbetreuern zu entwickeln. Dieser Spielplatz hat uns geholfen, die Möglichkeiten mit GenAI neu zu erfinden.“

– Marcel Batista, Gerente de Servicos, Operations Customer Service & Support

„Open Arena, unterstützt durch serverlose AWS-Dienste, Amazon SageMaker und Hugging Face, hat uns geholfen, unseren Kollegen schnell modernste LLMs und generative KI-Tools vorzustellen, was dazu beigetragen hat, unternehmensweite Innovationen voranzutreiben.“

– Shirsha Ray Chaudhuri, Direktorin, Forschungstechnik, Thomson Reuters Labs

Auf breiterer Ebene hatte die Einführung der Open Arena tiefgreifende Auswirkungen auf das Unternehmen. Dies steigerte nicht nur das KI-Bewusstsein der Mitarbeiter, sondern regte auch den Geist der Innovation und Zusammenarbeit an. Die Plattform brachte Teams zum Erkunden, Experimentieren und Generieren von Ideen zusammen und schuf so ein Umfeld, in dem bahnbrechende Konzepte in die Realität umgesetzt werden konnten.

Darüber hinaus hatte die Open Arena einen positiven Einfluss auf die KI-Dienste und -Produkte von Thomson Reuters. Die Plattform diente als Sandbox für KI und ermöglichte es Teams, KI-Anwendungen zu identifizieren und zu verfeinern, bevor sie sie in unsere Angebote integrieren. Dies hat die Entwicklung und Verbesserung der KI-Dienste von Thomson Reuters beschleunigt und bietet Kunden Lösungen, die sich ständig weiterentwickeln und an der Spitze des technologischen Fortschritts stehen.

Zusammenfassung

In der schnelllebigen Welt der KI ist es von entscheidender Bedeutung, weiter voranzukommen, und Thomson Reuters ist bestrebt, genau das zu tun. Das Team hinter der Open Arena arbeitet ständig daran, weitere Funktionen hinzuzufügen und die Fähigkeiten der Plattform zu verbessern, indem es AWS-Dienste wie z Amazonas Grundgestein und Amazon SageMaker-Jumpstart, um sicherzustellen, dass es eine wertvolle Ressource für unsere Teams bleibt. Unser Ziel ist es, mit der sich schnell entwickelnden Landschaft generativer KI und LLMs Schritt zu halten. AWS stellt die Dienste bereit, die TR benötigt, um mit dem sich ständig weiterentwickelnden Bereich der generativen KI Schritt zu halten.

Neben der Weiterentwicklung der Open Arena-Plattform arbeiten wir aktiv an der Produktion der Vielzahl an Anwendungsfällen, die die Plattform generiert. Dadurch können wir unseren Kunden noch fortschrittlichere und effizientere KI-Lösungen anbieten, die auf ihre spezifischen Bedürfnisse zugeschnitten sind. Darüber hinaus werden wir weiterhin eine Kultur der Innovation und Zusammenarbeit fördern, damit unsere Teams neue Ideen und Anwendungen für die KI-Technologie erkunden können.

Während wir uns auf diese spannende Reise begeben, sind wir zuversichtlich, dass die Open Arena eine entscheidende Rolle bei der Förderung von Innovation und Zusammenarbeit bei Thomson Reuters spielen wird. Indem wir an der Spitze der KI-Fortschritte bleiben, stellen wir sicher, dass sich unsere Produkte und Dienstleistungen ständig weiterentwickeln und den sich ständig ändernden Anforderungen unserer Kunden gerecht werden.

Über die Autoren

Shirsha Ray Chaudhuri (Direktorin, Research Engineering) leitet das ML-Engineering-Team in Bangalore für Thomson Reuters Labs, wo sie die Entwicklung und Bereitstellung gut strukturierter Lösungen in AWS und anderen Cloud-Plattformen für ML-Projekte leitet, die die Effizienz und den Wert für KI-gesteuerte Funktionen steigern in Produkten, Plattformen und Geschäftssystemen von Thomson Reuters. Sie arbeitet mit Communities an KI für gute Projekte mit gesellschaftlicher Wirkung und im Technologiebereich für D&I. Sie liebt es, sich mit Menschen zu vernetzen, die KI und moderne Technologie nutzen, um eine bessere Welt aufzubauen, die integrativer und digitaler ist und gemeinsam eine bessere Zukunft schafft.

Shirsha Ray Chaudhuri (Direktorin, Research Engineering) leitet das ML-Engineering-Team in Bangalore für Thomson Reuters Labs, wo sie die Entwicklung und Bereitstellung gut strukturierter Lösungen in AWS und anderen Cloud-Plattformen für ML-Projekte leitet, die die Effizienz und den Wert für KI-gesteuerte Funktionen steigern in Produkten, Plattformen und Geschäftssystemen von Thomson Reuters. Sie arbeitet mit Communities an KI für gute Projekte mit gesellschaftlicher Wirkung und im Technologiebereich für D&I. Sie liebt es, sich mit Menschen zu vernetzen, die KI und moderne Technologie nutzen, um eine bessere Welt aufzubauen, die integrativer und digitaler ist und gemeinsam eine bessere Zukunft schafft.

Harpreet Singh Baath ist Senior Cloud and DevOps Engineer bei Thomson Reuters Labs, wo er Forschungsingenieure und Wissenschaftler bei der Entwicklung von Lösungen für maschinelles Lernen auf Cloud-Plattformen unterstützt. Mit über 6 Jahren Erfahrung erstreckt sich Harpreets Fachwissen über Cloud-Architekturen, Automatisierung, Containerisierung, die Aktivierung von DevOps-Praktiken und Kostenoptimierung. Ihm liegen Effizienz und Kosteneffizienz am Herzen und er sorgt dafür, dass Cloud-Ressourcen optimal genutzt werden.

Harpreet Singh Baath ist Senior Cloud and DevOps Engineer bei Thomson Reuters Labs, wo er Forschungsingenieure und Wissenschaftler bei der Entwicklung von Lösungen für maschinelles Lernen auf Cloud-Plattformen unterstützt. Mit über 6 Jahren Erfahrung erstreckt sich Harpreets Fachwissen über Cloud-Architekturen, Automatisierung, Containerisierung, die Aktivierung von DevOps-Praktiken und Kostenoptimierung. Ihm liegen Effizienz und Kosteneffizienz am Herzen und er sorgt dafür, dass Cloud-Ressourcen optimal genutzt werden.

Rashmi B. Pawar ist Ingenieur für maschinelles Lernen bei Thomson Reuters. Sie verfügt über beträchtliche Erfahrung in der Erstellung von Modellen, der Erstellung von Schlussfolgerungen und der Erstellung von Trainingspipelines, die auf verschiedene Anwendungen des maschinellen Lernens zugeschnitten sind. Darüber hinaus verfügt sie über umfangreiche Expertise in der Integration von Machine-Learning-Workflows in bestehende Systeme und Produkte.

Rashmi B. Pawar ist Ingenieur für maschinelles Lernen bei Thomson Reuters. Sie verfügt über beträchtliche Erfahrung in der Erstellung von Modellen, der Erstellung von Schlussfolgerungen und der Erstellung von Trainingspipelines, die auf verschiedene Anwendungen des maschinellen Lernens zugeschnitten sind. Darüber hinaus verfügt sie über umfangreiche Expertise in der Integration von Machine-Learning-Workflows in bestehende Systeme und Produkte.

Palvika Bansal ist Associate Applied Research Scientist bei Thomson Reuters. Sie hat an Projekten in verschiedenen Branchen gearbeitet, um Geschäftsprobleme für Kunden mithilfe von KI/ML zu lösen. Sie ist sehr leidenschaftlich bei ihrer Arbeit und nimmt gerne neue Herausforderungen an. Außerhalb der Arbeit reist, kocht und liest sie gerne.

Palvika Bansal ist Associate Applied Research Scientist bei Thomson Reuters. Sie hat an Projekten in verschiedenen Branchen gearbeitet, um Geschäftsprobleme für Kunden mithilfe von KI/ML zu lösen. Sie ist sehr leidenschaftlich bei ihrer Arbeit und nimmt gerne neue Herausforderungen an. Außerhalb der Arbeit reist, kocht und liest sie gerne.

Simone Zuchet ist Senior Solutions Architect bei AWS. Mit fast einem Jahrzehnt Erfahrung als Cloud-Architektin arbeitet Simone gerne an innovativen Projekten, die dazu beitragen, die Art und Weise, wie Unternehmen geschäftliche Probleme angehen, zu verändern. Er unterstützt große Unternehmenskunden bei AWS und ist Teil des Machine Learning TFC. Außerhalb seines Berufslebens beschäftigt er sich gerne mit Autos und der Fotografie.

Simone Zuchet ist Senior Solutions Architect bei AWS. Mit fast einem Jahrzehnt Erfahrung als Cloud-Architektin arbeitet Simone gerne an innovativen Projekten, die dazu beitragen, die Art und Weise, wie Unternehmen geschäftliche Probleme angehen, zu verändern. Er unterstützt große Unternehmenskunden bei AWS und ist Teil des Machine Learning TFC. Außerhalb seines Berufslebens beschäftigt er sich gerne mit Autos und der Fotografie.

Heiko Hotz ist Senior Solutions Architect für KI und maschinelles Lernen mit besonderem Fokus auf die Verarbeitung natürlicher Sprache, große Sprachmodelle und generative KI. Vor dieser Position war er Head of Data Science für den EU-Kundenservice von Amazon. Heiko unterstützt unsere Kunden dabei, auf ihrer KI/ML-Reise auf AWS erfolgreich zu sein, und hat mit Organisationen in vielen Branchen zusammengearbeitet, darunter Versicherungen, Finanzdienstleistungen, Medien und Unterhaltung, Gesundheitswesen, Versorgungsunternehmen und Fertigung. In seiner Freizeit reist Heiko so viel wie möglich.

Heiko Hotz ist Senior Solutions Architect für KI und maschinelles Lernen mit besonderem Fokus auf die Verarbeitung natürlicher Sprache, große Sprachmodelle und generative KI. Vor dieser Position war er Head of Data Science für den EU-Kundenservice von Amazon. Heiko unterstützt unsere Kunden dabei, auf ihrer KI/ML-Reise auf AWS erfolgreich zu sein, und hat mit Organisationen in vielen Branchen zusammengearbeitet, darunter Versicherungen, Finanzdienstleistungen, Medien und Unterhaltung, Gesundheitswesen, Versorgungsunternehmen und Fertigung. In seiner Freizeit reist Heiko so viel wie möglich.

Joao Moura ist AI/ML Specialist Solutions Architect bei AWS mit Sitz in Spanien. Er hilft Kunden beim Deep-Learning-Modelltraining und der Inferenzoptimierung und im weiteren Sinne beim Aufbau groß angelegter ML-Plattformen auf AWS. Er ist auch ein aktiver Befürworter von auf ML spezialisierter Hardware und Low-Code-ML-Lösungen.

Joao Moura ist AI/ML Specialist Solutions Architect bei AWS mit Sitz in Spanien. Er hilft Kunden beim Deep-Learning-Modelltraining und der Inferenzoptimierung und im weiteren Sinne beim Aufbau groß angelegter ML-Plattformen auf AWS. Er ist auch ein aktiver Befürworter von auf ML spezialisierter Hardware und Low-Code-ML-Lösungen.

Georgios Schinas ist ein spezialisierter Lösungsarchitekt für KI/ML in der EMEA-Region. Er hat seinen Sitz in London und arbeitet eng mit Kunden in Großbritannien und Irland zusammen. Georgios unterstützt Kunden beim Entwerfen und Bereitstellen von Machine-Learning-Anwendungen in der Produktion auf AWS, mit besonderem Interesse an MLOps-Praktiken und der Möglichkeit für Kunden, maschinelles Lernen in großem Maßstab durchzuführen. In seiner Freizeit reist er gerne, kocht und verbringt Zeit mit Freunden und Familie.

Georgios Schinas ist ein spezialisierter Lösungsarchitekt für KI/ML in der EMEA-Region. Er hat seinen Sitz in London und arbeitet eng mit Kunden in Großbritannien und Irland zusammen. Georgios unterstützt Kunden beim Entwerfen und Bereitstellen von Machine-Learning-Anwendungen in der Produktion auf AWS, mit besonderem Interesse an MLOps-Praktiken und der Möglichkeit für Kunden, maschinelles Lernen in großem Maßstab durchzuführen. In seiner Freizeit reist er gerne, kocht und verbringt Zeit mit Freunden und Familie.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- ChartPrime. Verbessern Sie Ihr Handelsspiel mit ChartPrime. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/how-thomson-reuters-developed-open-arena-an-enterprise-grade-large-language-model-playground-in-under-6-weeks/

- :hast

- :Ist

- :nicht

- :Wo

- 000

- 1

- 100

- 2023

- 7

- a

- Fähigkeit

- Über uns

- beschleunigen

- beschleunigt

- Zugang

- zugänglich

- Konto

- über

- aktiv

- aktiv

- präsentieren

- hinzufügen

- Zusatz

- angenommen

- Die Annahme

- vorantreiben

- advanced

- Förderung

- Fortschritte

- Vorrückend

- aufs Neue

- gegen

- Agenten

- AI

- KI & Maschinelles Lernen

- KI-Dienste

- AI / ML

- Ziel

- gezielt

- Alle

- erlauben

- erlaubt

- Zulassen

- erlaubt

- entlang

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- unter

- unter

- an

- und

- Ein anderer

- Antworten

- jedem

- Bienen

- APIs

- ersichtlich

- Anwendungen

- angewandt

- Ansatz

- Architektur

- SIND

- Bereich

- Arena

- Kunst

- künstlich

- künstliche Intelligenz

- Künstliche Intelligenz (AI)

- AS

- Aussehen

- Aspekte

- beurteilen

- Assistentin

- Partnerschaftsräte

- Sortiment

- At

- Augmented

- Authentifizierung

- automatisieren

- Automation

- verfügbar

- Mittelung

- Bewusstsein

- AWS

- Backbone (Rückgrat)

- Backend

- Hintergrund

- Balancing

- basierend

- BE

- weil

- Werden

- war

- Bevor

- hinter

- Vorteile

- Berlin

- BESTE

- Besser

- Boosted

- beide

- Grenzen

- Breite

- Bruch

- Breaking News

- breiteres

- allgemein

- gebracht

- bauen

- Building

- Geschäft

- aber

- by

- rufen Sie uns an!

- kam

- CAN

- Fähigkeiten

- kapitalisiert

- Autos

- Fälle

- sorgen

- Herausforderungen

- Chance

- Kanal

- Auswählen

- gewählt

- klar

- Kunden

- Menu

- eng

- Cloud

- Programmierung

- Zusammenarbeit

- Kopien

- kombiniert

- begangen

- Communities

- community

- Unternehmen

- Unternehmen

- Komplex

- Komplexität

- umfassend

- konzept

- Konzepte

- prägnant

- zuversichtlich

- Vernetz Dich

- Folglich

- Geht davon

- erheblich

- betrachtet

- ständig

- Verbrauch

- Behälter

- Inhalt

- fortsetzen

- weiter

- kontinuierlich

- beigetragen

- gesteuert

- Steuerung

- konventionellen

- Kosten

- könnte

- Handwerk

- erstellt

- Erstellen

- Schaffung

- Kreativ (Creative)

- Kreativität

- wichtig

- KULTUR

- Original

- Kunde

- Kundenservice

- Kundensupport

- Kunden

- Anpassung

- innovativ, auf dem neuesten Stand

- Dashboards

- technische Daten

- Datenmanagement

- Datenwissenschaft

- Datenbase

- Datensätze

- Täglich, von Tag zu Tag

- Jahrzehnte

- gewidmet

- tief

- tiefe Lernen

- tiefer

- definieren

- Übergeben

- liefern

- Lieferanten

- Anforderungen

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- Tiefe

- Design

- entworfen

- entwickeln

- entwickelt

- Entwicklung

- anders

- digital

- Direkt

- Direktor

- entdeckt,

- Entdeckung

- diskutieren

- Diskussionen

- verschieden

- do

- Dokument

- Unterlagen

- die

- Tut nicht

- Dabei

- Nicht

- zeichnen

- Traum

- Antrieb

- Fahren

- im

- jeder

- erleichtern

- Benutzerfreundlichkeit

- effektiv

- Effizienz

- effizient

- effizient

- Bemühungen

- einsteigen

- EMEA

- entstehen

- beschäftigt

- Mitarbeiter

- ermöglichen

- freigegeben

- ermöglicht

- ermöglichen

- ermutigend

- verschlüsselt

- Ende

- Engagement

- Ingenieur

- Entwicklung

- Ingenieure

- zu steigern,

- verbesserte

- genug

- gewährleisten

- Gewährleistung

- Unternehmen

- Unternehmensqualität

- Unterhaltung

- begeistert

- Arbeitsumfeld

- Festlegung

- EU

- Auswerten

- Sogar

- ÜBERHAUPT

- ständig wechselnd

- Jedes

- offensichtlich

- entwickelt sich

- sich entwickelnden

- unterhaltsame Programmpunkte

- vorhandenen

- ERFAHRUNGEN

- Erfahrungen

- Experiment

- Expertise

- ERKUNDEN

- umfangreiche

- Extrakt

- Gesicht

- erleichtert

- erleichtern

- vertraut

- Familie

- FAST

- schnelllebig

- Angst

- Eigenschaften

- Feld

- Revolution

- Finanzdienstleistungen

- Finden Sie

- Vorname

- flexibel

- Setzen Sie mit Achtsamkeit

- konzentriert

- Folgende

- Fußabdruck

- Aussichten für

- Vordergrund

- vorwärts

- Fördern

- Förderung

- Freunde

- für

- Materials des

- Vorderes Ende

- funktioniert

- Funktionen

- Außerdem

- Zukunft

- Gewinne

- Tor

- erzeugen

- erzeugt

- generativ

- Generative KI

- Deutsch

- bekommen

- gibt

- Global

- Global

- Globus

- Kundenziele

- gut

- mehr

- bahnbrechend

- Wachsen Sie über sich hinaus

- persönlichem Wachstum

- hackathon

- hätten

- Griff

- praktische

- Hardware

- Geschirr

- Nutzen

- Haben

- he

- ganzer

- Köpfe

- Gesundheitswesen

- Herz

- Hilfe

- dazu beigetragen,

- Unternehmen

- hilft

- hier (auf dänisch)

- hier

- höher

- hoch

- seine

- gehostet

- Ultraschall

- Hilfe

- HTML

- http

- HTTPS

- i

- Idee

- Ideen

- identifizieren

- Zünden

- zeigt

- Impact der HXNUMXO Observatorien

- Verbesserung

- in

- Anfang

- Einschließlich

- Inklusive

- einarbeiten

- hat

- unglaublich

- Branchen

- beeinflussen

- Zustrom

- Information

- Infrastruktur

- Innovation

- Innovationsteam

- innovativ

- Varianten des Eingangssignals:

- aufschlussreiche

- Einblicke

- Instanz

- instrumental

- Versicherung

- Integral

- integrieren

- Integration

- Integration

- Integrationen

- Intelligenz

- interagieren

- Interaktion

- Interaktionen

- Interesse

- Schnittstelle

- intern

- in

- Einleitung

- intuitiv

- Irland

- IT

- SEINE

- Job

- Reise

- jpg

- nur

- Behalten

- Wesentliche

- wichtiger Meilenstein

- Art

- Wissen

- Labs

- Landschaft

- Sprache

- grosse

- großflächig

- größer

- neueste

- starten

- führen

- führenden

- Undichtigkeiten

- lernen

- Verlassen

- geführt

- Rechtlich

- weniger

- Cholesterinspiegel

- Bibliothek

- Lebensdauer

- Gefällt mir

- LLM

- Protokollierung

- London

- Lang

- aussehen

- aussehen wie

- liebt

- Maschine

- Maschinelles Lernen

- gemacht

- Making

- verwaltet

- Management

- Manager

- Herstellung

- viele

- markiert

- Spiel

- Materialien

- Angelegenheiten

- me

- Mechanismus

- Medien

- Triff

- Verschmelzung

- Methodologien

- sorgfältig

- könnte

- Meilenstein

- Minuten

- ML

- MLOps

- Modell

- für

- modern

- modulare

- Überwachung

- Monat

- monatlich

- mehr

- effizienter

- vor allem warme

- schlauer bewegen

- vorwärts gehen

- viel

- mehrere

- Vielzahl

- nativen

- Natürliche

- Verarbeitung natürlicher Sprache

- Navigation

- erforderlich

- Bedürfnisse

- Netzwerk

- Neu

- Neue Funktionen

- News

- Nlp

- nicht

- Ziel

- of

- bieten

- angeboten

- Angebote

- on

- einmal

- EINEM

- laufend

- einzige

- XNUMXh geöffnet

- Open-Source-

- öffnet

- Einkauf & Prozesse

- Gelegenheit

- optimal

- Optimierung

- Optimieren

- or

- Organisationen

- Original

- Andere

- UNSERE

- aussen

- übrig

- besitzen

- Frieden

- Tafel

- Podiumsdiskussionen

- Parameter

- Teil

- besondere

- Partnerschaft

- Teile

- Bestanden

- leidenschaftlich

- Pflasterung

- Personen

- für

- Ausführen

- Leistung

- Fotografie

- Pionierarbeit

- Pipeline

- zentrale

- Ort

- Plattform

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Play

- Punkte

- positiv

- Möglichkeiten

- möglich

- Post

- Potenzial

- Werkzeuge

- angetriebene

- größte treibende

- Praktisch

- Praktiken

- Kostbar

- Grundsätze

- Vor

- privat

- Probleme

- Prozessdefinierung

- Verarbeitung

- Produktion

- Produkte

- Professionell

- Profis

- tiefgreifende

- Programm

- Projekte

- Befürworter

- die

- vorausgesetzt

- bietet

- Bereitstellung

- schiebt

- Abfragen

- Suche

- Fragen

- Direkt

- schnell

- schnell

- schnell

- RAY

- Reagieren

- Lesen Sie mehr

- Lesebrillen

- Realität

- verfeinern

- Region

- bezogene

- freigegeben

- Relevanz

- relevant

- bleibt bestehen

- falls angefordert

- Voraussetzungen:

- Forschungsprojekte

- Ressourcen

- ressourcenintensiv

- Downloads

- Antwort

- Antworten

- ansprechbar

- REST

- Die Ergebnisse

- Reuters

- Recht

- robust

- Rollen

- Rollen

- Wenden

- Führen Sie

- Laufen

- Safe

- sagemaker

- Sandkasten

- sah

- Skalierbarkeit

- Skalieren

- Wissenschaft

- Wissenschaftler

- Wissenschaftler

- nahtlos

- nahtlos

- Sektoren

- Verbindung

- Auswahl

- Auswahl

- Senior

- brauchen

- Serverlos

- Dienstleistungen

- Sessions

- kompensieren

- Sets

- mehrere

- sie

- gezeigt

- signifikant

- ähnlich

- Einfacher

- vereinfachen

- Single

- am Standort

- So

- gesellschaftlich

- Software

- Lösung

- Lösungen

- LÖSEN

- einige

- Quelle

- Raumfahrt

- Spanien

- überspannt

- besondere

- Spezialist

- spezifisch

- Ausgabe

- Geist

- gespalten

- begonnen

- Beginnen Sie

- State-of-the-art

- Lagerung

- gelagert

- Geschichten

- rationalisieren

- Erfolg

- erfolgreich

- so

- zusammenfassen

- Support

- Unterstützte

- Oberfläche

- Systeme und Techniken

- zugeschnitten

- Einnahme

- Athleten

- und Aufgaben

- Team

- Teams

- Tech

- Technische

- Techniken

- technologische

- Technologies

- Technologie

- Test

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Zukunft

- Großbritannien

- ihr

- Sie

- dann

- Diese

- vom Nutzer definierten

- Ding

- fehlen uns die Worte.

- Thomson Reuters

- diejenigen

- Durch

- Tim

- Zeit

- mal

- zu

- gemeinsam

- morgen

- Toolkit

- Werkzeuge

- gegenüber

- Ausbildung

- Transformieren

- Übersetzungen

- Reise

- Reisen

- Trends

- ausgelöst

- Turned

- Uk

- aufdecken

- für

- Verständnis

- einzigartiges

- öffnen

- Enthüllung

- us

- -

- benutzt

- Mitglied

- Benutzererfahrung

- benutzerfreundlich

- Nutzer

- Verwendung von

- Dienstprogramme

- seit

- wertvoll

- Wert

- Vielfalt

- verschiedene

- riesig

- überprüfen

- Assistent

- Volumen

- W

- wollen

- wurde

- Weg..

- we

- Netz

- Web-Services

- Webbasiert

- Webinare

- Webseiten

- Wochen

- GUT

- waren

- Was

- Was ist

- wann

- welche

- während

- WHO

- breit

- werden wir

- gewinnen

- mit

- .

- ohne

- Arbeiten

- gearbeitet

- Workflows

- arbeiten,

- Werk

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- würde

- Jahr

- noch

- Du

- Ihr

- sich selbst

- Zephyrnet