Amazon SageMaker Data Wrangler ist eine einzige visuelle Schnittstelle, die den Zeitaufwand für die Vorbereitung von Daten und die Durchführung des Feature-Engineerings von Wochen auf Minuten reduziert und die Möglichkeit bietet, Daten auszuwählen und zu bereinigen, Features zu erstellen und die Datenvorbereitung in Arbeitsabläufen für maschinelles Lernen (ML) zu automatisieren, ohne Code schreiben zu müssen.

SageMaker Data Wrangler unterstützt Schneeflocke, eine beliebte Datenquelle für Benutzer, die ML durchführen möchten. Wir starten die Snowflake-Direktverbindung vom SageMaker Data Wrangler aus, um das Kundenerlebnis zu verbessern. Vor der Einführung dieser Funktion mussten Administratoren die anfängliche Speicherintegration einrichten, um eine Verbindung mit Snowflake herzustellen und Funktionen für ML in Data Wrangler zu erstellen. Dazu gehört auch die Bereitstellung Amazon Simple Storage-Service (Amazon S3) Eimer, AWS Identity and Access Management and (IAM)-Zugriffsberechtigungen, Snowflake-Speicherintegration für einzelne Benutzer und ein fortlaufender Mechanismus zum Verwalten oder Bereinigen von Datenkopien in Amazon S3. Für Kunden mit strenger Datenzugriffskontrolle und einer großen Anzahl von Benutzern ist dieser Prozess nicht skalierbar.

In diesem Beitrag zeigen wir, wie die direkte Verbindung von Snowflake in SageMaker Data Wrangler die Erfahrung des Administrators und den ML-Weg des Datenwissenschaftlers von Daten zu Geschäftserkenntnissen vereinfacht.

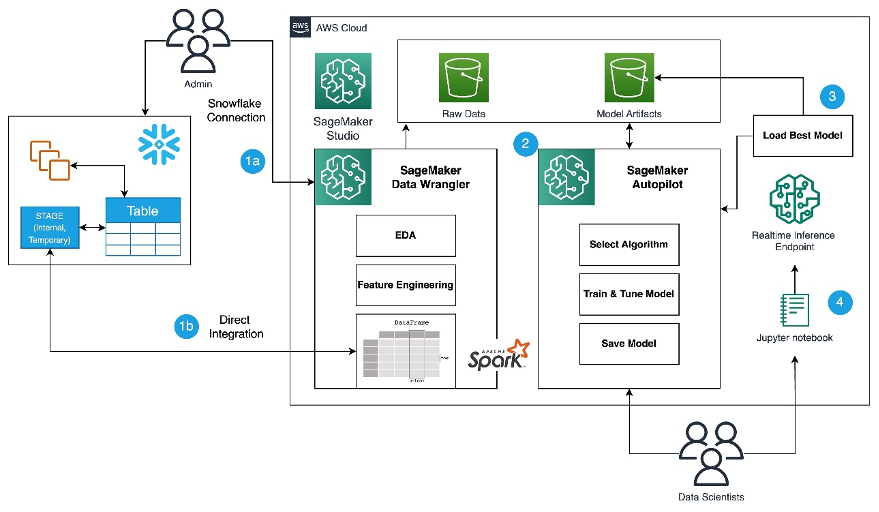

Lösungsüberblick

In dieser Lösung verwenden wir SageMaker Data Wrangler, um die Datenvorbereitung für ML und zu beschleunigen Amazon SageMaker-Autopilot um die ML-Modelle basierend auf Ihren Daten automatisch zu erstellen, zu trainieren und zu optimieren. Beide Dienste sind speziell darauf ausgelegt, die Produktivität zu steigern und die Zeit bis zur Wertschöpfung für ML-Anwender zu verkürzen. Wir demonstrieren auch den vereinfachten Datenzugriff von SageMaker Data Wrangler auf Snowflake mit direkter Verbindung zum Abfragen und Erstellen von Funktionen für ML.

Im folgenden Diagramm finden Sie einen Überblick über den Low-Code-ML-Prozess mit Snowflake, SageMaker Data Wrangler und SageMaker Autopilot.

Der Workflow umfasst die folgenden Schritte:

- Navigieren Sie zu SageMaker Data Wrangler für Ihre Datenvorbereitungs- und Feature-Engineering-Aufgaben.

- Richten Sie die Snowflake-Verbindung mit SageMaker Data Wrangler ein.

- Erkunden Sie Ihre Snowflake-Tabellen in SageMaker Data Wrangler, erstellen Sie einen ML-Datensatz und führen Sie Feature Engineering durch.

- Trainieren und testen Sie die Modelle mit SageMaker Data Wrangler und SageMaker Autopilot.

- Laden Sie das beste Modell für Vorhersagen auf einen Echtzeit-Inferenzendpunkt.

- Verwenden Sie ein Python-Notebook, um den gestarteten Echtzeit-Inferenzendpunkt aufzurufen.

Voraussetzungen:

Für diesen Beitrag benötigt der Administrator folgende Voraussetzungen:

Datenwissenschaftler sollten die folgenden Voraussetzungen mitbringen

Zuletzt sollten Sie Ihre Daten für Snowflake vorbereiten

- Wir verwenden Kreditkartentransaktionsdaten von Kaggle um ML-Modelle zur Erkennung betrügerischer Kreditkartentransaktionen zu erstellen, damit Kunden keine Gebühren für Artikel berechnet werden, die sie nicht gekauft haben. Der Datensatz umfasst Kreditkartentransaktionen europäischer Karteninhaber im September 2013.

- Sie sollten die verwenden SnowSQL-Client und installieren Sie es auf Ihrem lokalen Computer, damit Sie es zum Hochladen des Datensatzes in eine Snowflake-Tabelle verwenden können.

Die folgenden Schritte zeigen, wie Sie den Datensatz vorbereiten und in die Snowflake-Datenbank laden. Dies ist eine einmalige Einrichtung.

Schneeflockentabelle und Datenvorbereitung

Führen Sie für diese einmalige Einrichtung die folgenden Schritte aus:

- Erstellen Sie als Administrator zunächst ein virtuelles Snowflake-Warehouse, einen Benutzer und eine Rolle und gewähren Sie anderen Benutzern wie Datenwissenschaftlern Zugriff, um eine Datenbank zu erstellen und Daten für ihre ML-Anwendungsfälle bereitzustellen:

- Als Datenwissenschaftler erstellen wir nun eine Datenbank und importieren die Kreditkartentransaktionen in die Snowflake-Datenbank, um auf die Daten von SageMaker Data Wrangler zuzugreifen. Zur Veranschaulichung erstellen wir eine Snowflake-Datenbank mit dem Namen

SF_FIN_TRANSACTION: - Laden Sie die CSV-Datei des Datensatzes auf Ihren lokalen Computer herunter und erstellen Sie eine Stufe, um die Daten in die Datenbanktabelle zu laden. Aktualisieren Sie den Dateipfad so, dass er auf den Speicherort des heruntergeladenen Datensatzes verweist, bevor Sie den PUT-Befehl zum Importieren der Daten in die erstellte Phase ausführen:

- Erstellen Sie eine Tabelle mit dem Namen

credit_card_transactions: - Importieren Sie die Daten aus der Bühne in die erstellte Tabelle:

Richten Sie die SageMaker Data Wrangler- und Snowflake-Verbindung ein

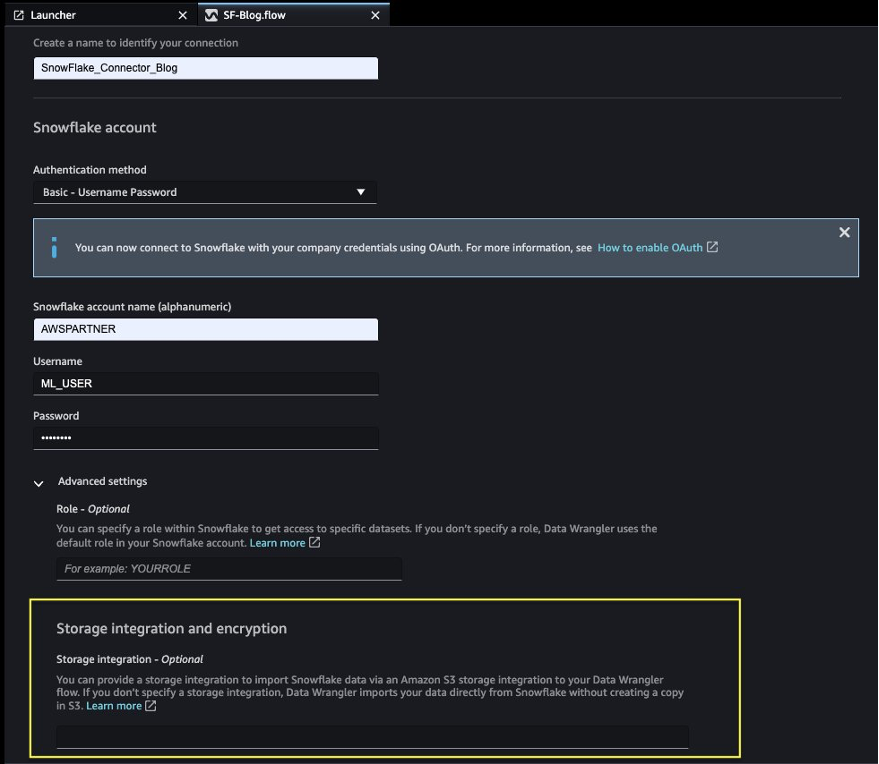

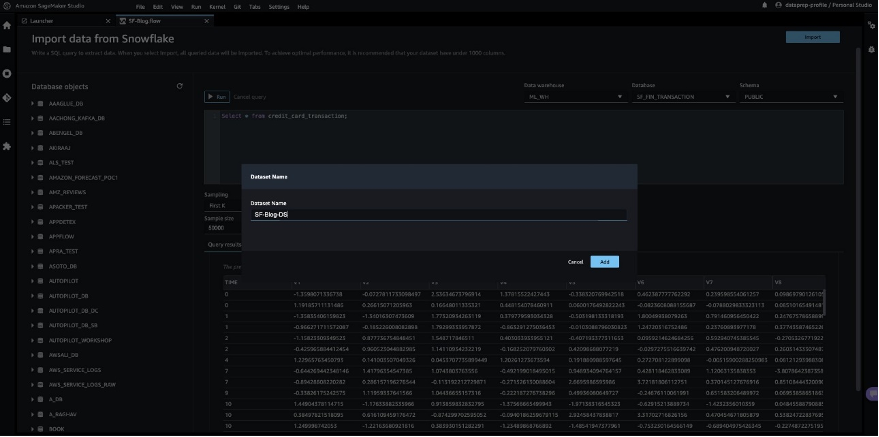

Nachdem wir den Datensatz für die Verwendung mit SageMaker Data Wrangler vorbereitet haben, erstellen wir eine neue Snowflake-Verbindung in SageMaker Data Wrangler, um eine Verbindung herzustellen sf_fin_transaction Datenbank in Snowflake und fragen Sie die ab credit_card_transaction Tabelle:

- Auswählen Schneeflocke auf dem SageMaker Data Wrangler Sichere

- Geben Sie einen Namen ein, um Ihre Verbindung zu identifizieren.

- Wählen Sie Ihre Authentifizierungsmethode aus, um eine Verbindung mit der Snowflake-Datenbank herzustellen:

- Wenn Sie die Basisauthentifizierung verwenden, geben Sie den Benutzernamen und das Passwort an, die Sie von Ihrem Snowflake-Administrator erhalten haben. Für diesen Beitrag verwenden wir die Basisauthentifizierung, um mithilfe der Benutzeranmeldeinformationen, die wir im vorherigen Schritt erstellt haben, eine Verbindung zu Snowflake herzustellen.

- Wenn Sie OAuth verwenden, geben Sie die Anmeldeinformationen Ihres Identitätsanbieters an.

SageMaker Data Wrangler fragt Ihre Daten standardmäßig direkt von Snowflake ab, ohne Datenkopien in S3-Buckets zu erstellen. Die neue Benutzerfreundlichkeitsverbesserung von SageMaker Data Wrangler nutzt Apache Spark zur Integration in Snowflake, um einen Datensatz für Ihre ML-Reise vorzubereiten und nahtlos zu erstellen.

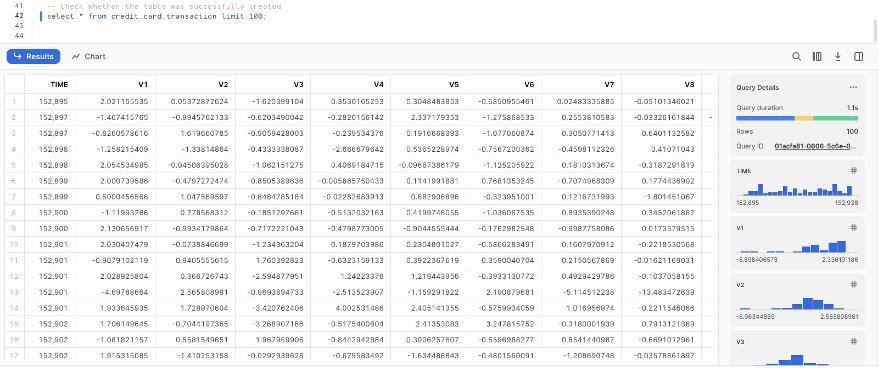

Bisher haben wir die Datenbank auf Snowflake erstellt, die CSV-Datei in die Snowflake-Tabelle importiert, Snowflake-Anmeldeinformationen erstellt und einen Connector auf SageMaker Data Wrangler erstellt, um eine Verbindung zu Snowflake herzustellen. Um die konfigurierte Snowflake-Verbindung zu validieren, führen Sie die folgende Abfrage für die erstellte Snowflake-Tabelle aus:

Beachten Sie, dass die zuvor erforderliche Speicherintegrationsoption in den erweiterten Einstellungen jetzt optional ist.

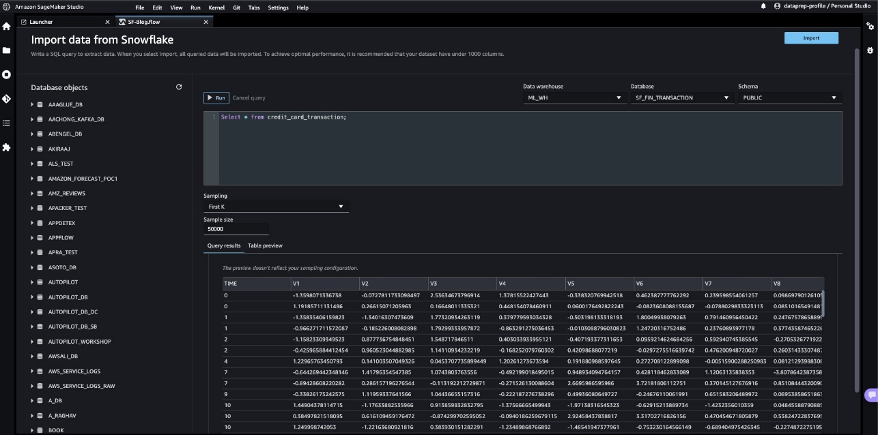

Entdecken Sie Snowflake-Daten

Nachdem Sie die Abfrageergebnisse validiert haben, wählen Sie Import um die Abfrageergebnisse als Datensatz zu speichern. Wir verwenden diesen extrahierten Datensatz für explorative Datenanalyse und Feature-Engineering.

Sie können die Daten von Snowflake in der SageMaker Data Wrangler-Benutzeroberfläche abtasten. Eine weitere Möglichkeit besteht darin, mithilfe von SageMaker Data Wrangler-Verarbeitungsaufträgen vollständige Daten für Ihre Anwendungsfälle für das ML-Modelltraining herunterzuladen.

Führen Sie explorative Datenanalysen in SageMaker Data Wrangler durch

Die Daten in Data Wrangler müssen bearbeitet werden, bevor sie trainiert werden können. In diesem Abschnitt zeigen wir, wie Sie mithilfe der integrierten Funktionen von SageMaker Data Wrangler ein Feature-Engineering für die Daten von Snowflake durchführen.

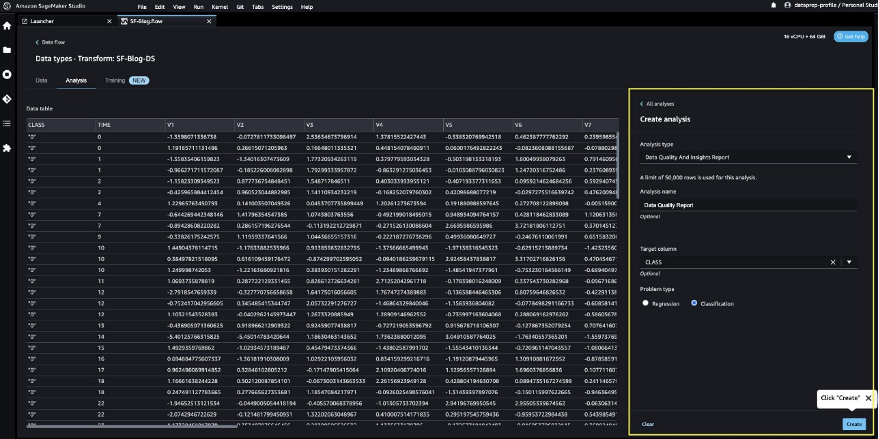

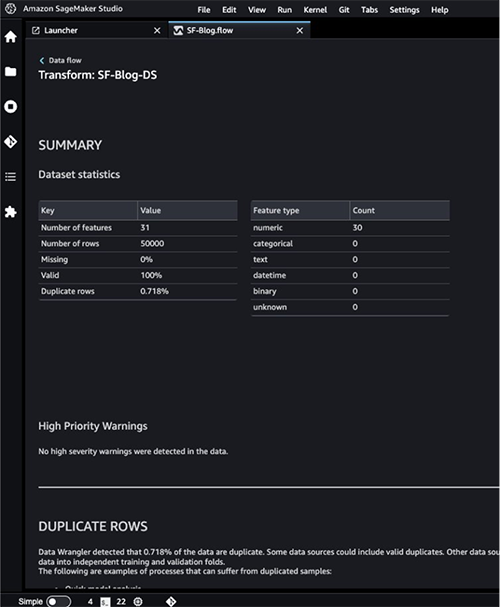

Zuerst verwenden wir die Data Quality and Insights Report Funktion in SageMaker Data Wrangler zum Generieren von Berichten, um die Datenqualität automatisch zu überprüfen und Anomalien in den Daten von Snowflake zu erkennen.

Mithilfe des Berichts können Sie Ihre Daten bereinigen und verarbeiten. Sie erhalten Informationen wie die Anzahl der fehlenden Werte und die Anzahl der Ausreißer. Wenn Sie Probleme mit Ihren Daten haben, wie z. B. Zielverluste oder Ungleichgewichte, kann der Insights-Bericht Sie auf diese Probleme aufmerksam machen. Informationen zu den Berichtsdetails finden Sie unter Beschleunigen Sie die Datenvorbereitung mit Datenqualität und Erkenntnissen in Amazon SageMaker Data Wrangler.

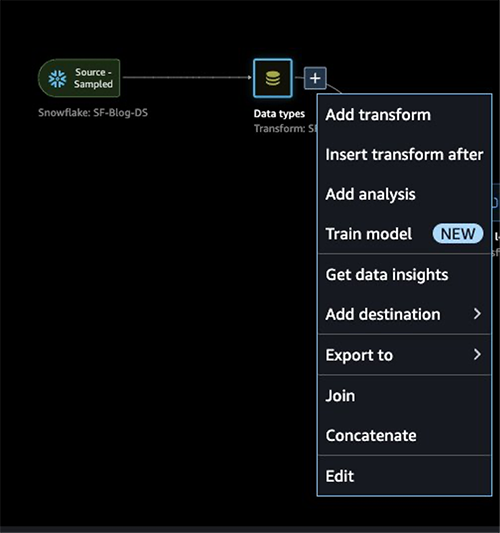

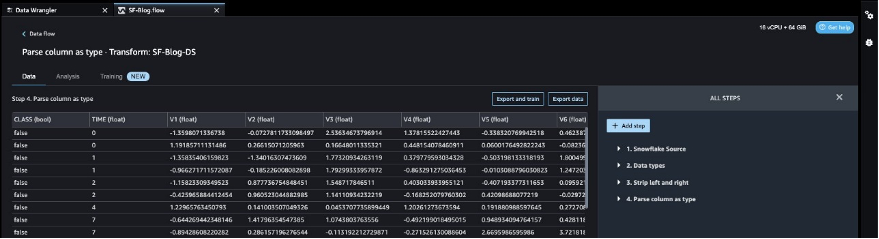

Nachdem Sie den von SageMaker Data Wrangler angewendeten Datentypabgleich überprüft haben, führen Sie die folgenden Schritte aus:

- Wählen Sie das Pluszeichen neben Datentypen und wählen Sie Analyse hinzufügen.

- Aussichten für Analysetyp, wählen Datenqualitäts- und Insights-Bericht.

- Auswählen

Erstellen.

- Informationen zu Warnungen mit hoher Priorität finden Sie in den Details zum Datenqualitäts- und Einblicksbericht.

Sie können die gemeldeten Warnungen beheben, bevor Sie mit Ihrer ML-Reise fortfahren.

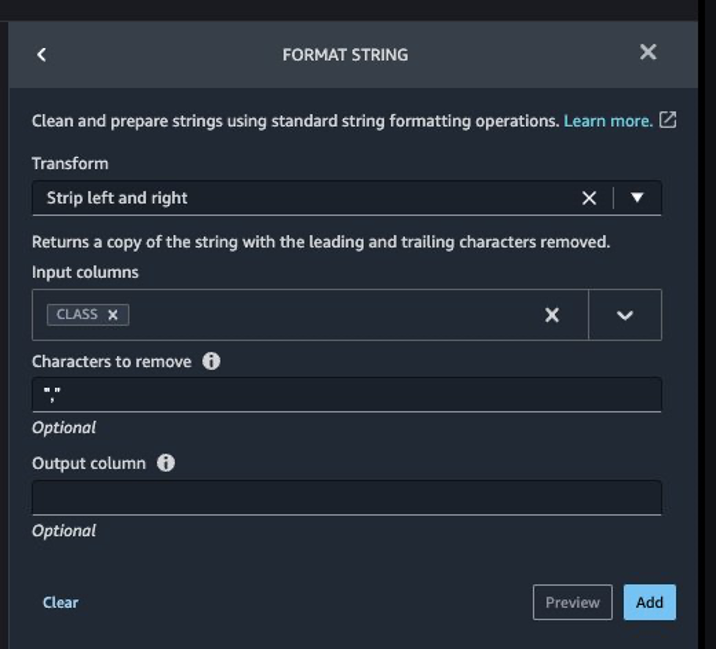

Die Zielspalte Class vorhergesagt werden soll, wird als String klassifiziert. Wenden wir zunächst eine Transformation an, um die veralteten leeren Zeichen zu entfernen.

- Auswählen Schritt hinzufügen und wählen Sie Zeichenfolge formatieren.

- Wählen Sie in der Liste der Transformationen aus Links und rechts abstreifen.

- Geben Sie die zu entfernenden Zeichen ein und wählen Sie aus Speichern.

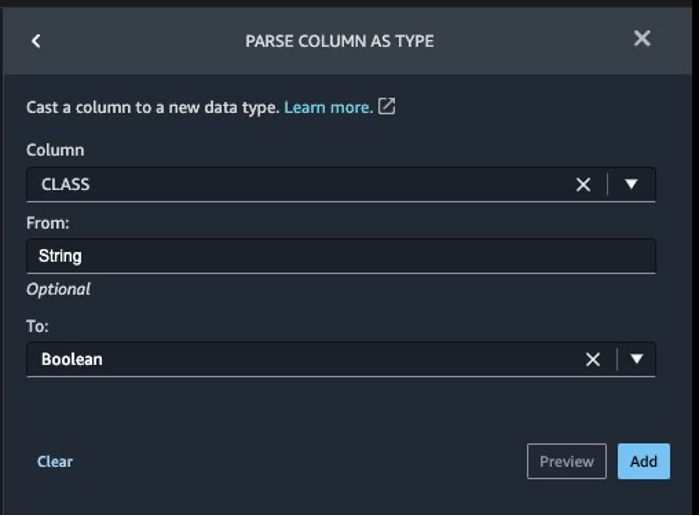

Als nächstes konvertieren wir die Zielspalte Class vom Datentyp „String“ auf „Boolesch“ umstellen, da die Transaktion entweder legitim oder betrügerisch ist.

- Auswählen Schritt hinzufügen.

- Auswählen Spalte als Typ parsen.

- Wählen Sie für „Spalte“ die Option aus

Class. - Aussichten für Aus, wählen Schnur.

- Aussichten für Zu, wählen Boolean.

- Auswählen Speichern.

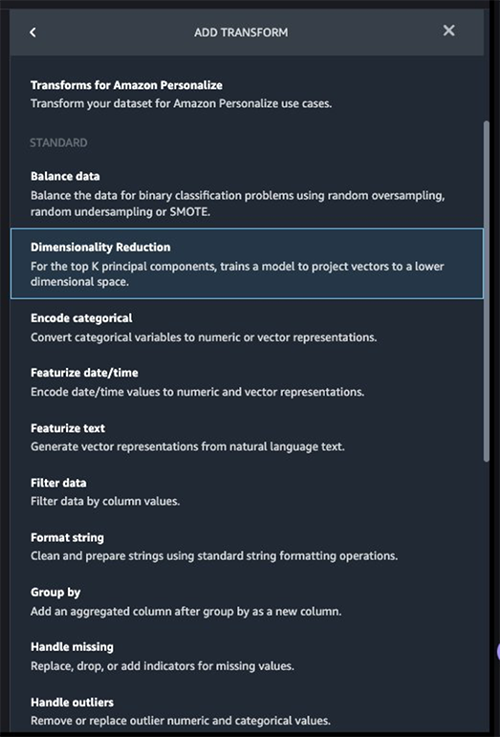

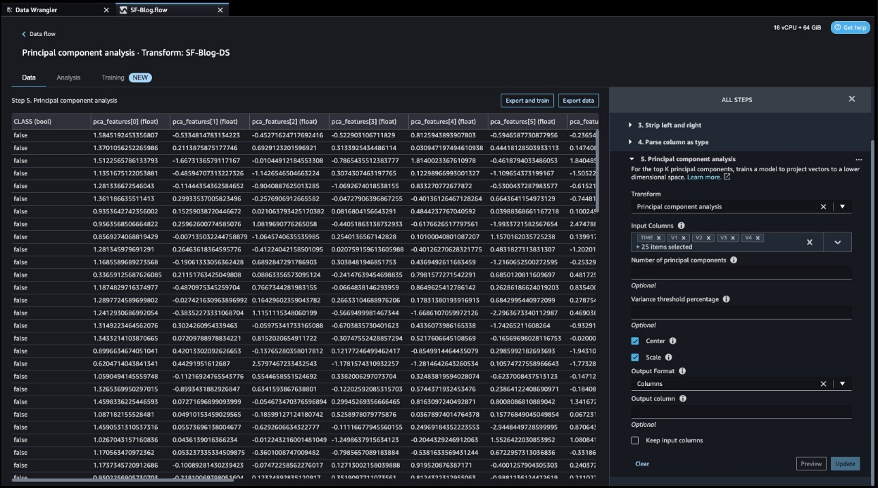

Nach der Zielspaltentransformation reduzieren wir die Anzahl der Feature-Spalten, da der ursprüngliche Datensatz über 30 Features enthält. Wir verwenden die Hauptkomponentenanalyse (PCA), um die Dimensionen basierend auf der Wichtigkeit der Merkmale zu reduzieren. Weitere Informationen zu PCA und Dimensionsreduktion finden Sie unter Algorithmus der Hauptkomponentenanalyse (PCA)..

- Auswählen

Schritt hinzufügen.

- Auswählen

Reduzierung der Dimensionalität.

- Aussichten für Transformieren, wählen Hauptkomponentenanalyse.

- Aussichten für Eingabespalten, wählen Sie alle Spalten außer der Zielspalte aus

Class.

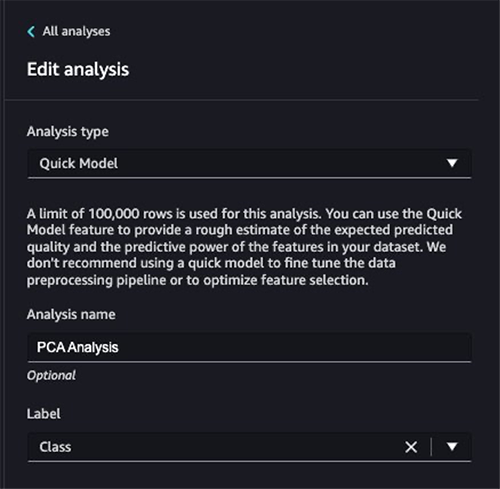

- Wählen Sie das Pluszeichen neben Datenfluss und wählen Sie Analyse hinzufügen.

- Aussichten für Analysetyp, wählen Schnelles Modell.

- Aussichten für Name der Analyse, Geben Sie einen Namen ein.

- Aussichten für Label, wählen

Class.

- Auswählen Führen Sie.

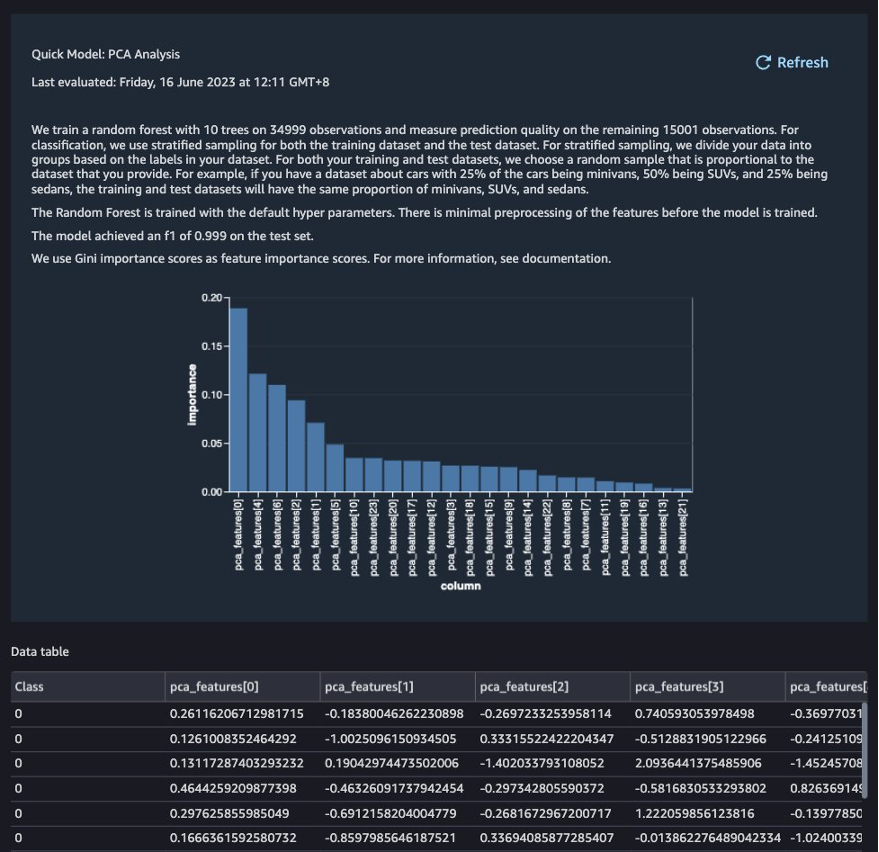

Basierend auf den PCA-Ergebnissen können Sie entscheiden, welche Funktionen zum Aufbau des Modells verwendet werden sollen. Im folgenden Screenshot zeigt das Diagramm die Merkmale (oder Dimensionen) geordnet nach der höchsten bis niedrigsten Wichtigkeit, um die Zielklasse vorherzusagen, die in diesem Datensatz bedeutet, ob die Transaktion betrügerisch oder gültig ist.

Sie können die Anzahl der Funktionen basierend auf dieser Analyse reduzieren. Für diesen Beitrag belassen wir die Standardeinstellungen jedoch unverändert.

Damit ist unser Feature-Engineering-Prozess abgeschlossen. Sie können sich jedoch dafür entscheiden, das Schnellmodell auszuführen und erneut einen Datenqualitäts- und Einblicksbericht zu erstellen, um die Daten zu verstehen, bevor Sie weitere Optimierungen durchführen.

Exportieren Sie Daten und trainieren Sie das Modell

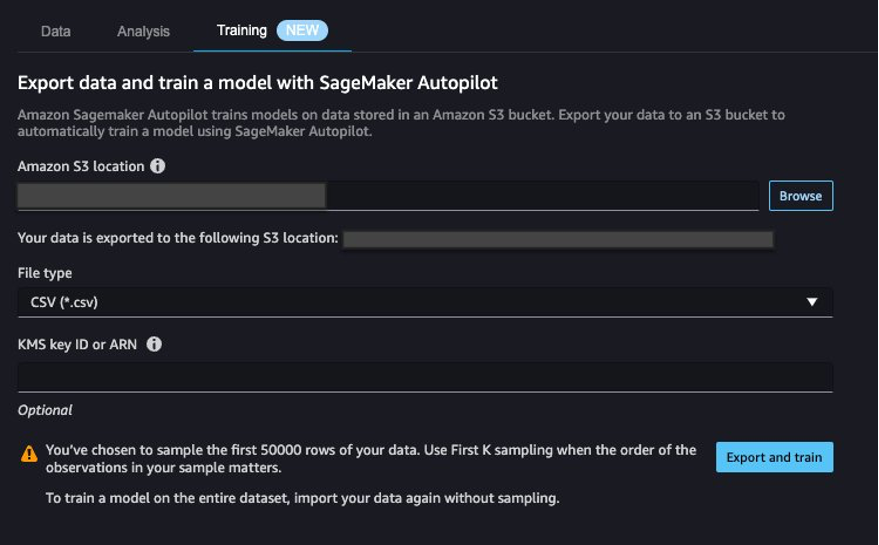

Im nächsten Schritt verwenden wir SageMaker Autopilot, um basierend auf Ihren Daten automatisch die besten ML-Modelle zu erstellen, zu trainieren und zu optimieren. Mit SageMaker Autopilot behalten Sie weiterhin die volle Kontrolle und Sichtbarkeit Ihrer Daten und Ihres Modells.

Nachdem wir nun die Erkundung und das Feature-Engineering abgeschlossen haben, trainieren wir ein Modell anhand des Datensatzes und exportieren die Daten, um das ML-Modell mit SageMaker Autopilot zu trainieren.

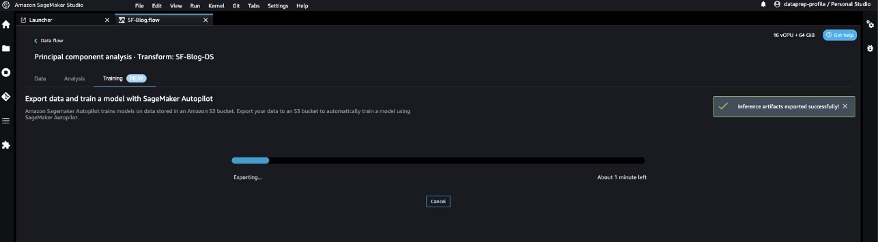

- Auf dem Ausbildung Tab, wählen Sie Exportieren und trainieren.

Wir können den Exportfortschritt überwachen, während wir auf den Abschluss warten.

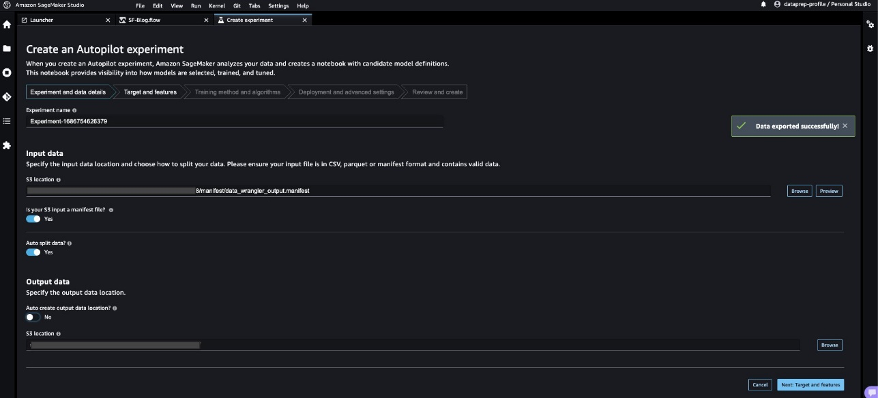

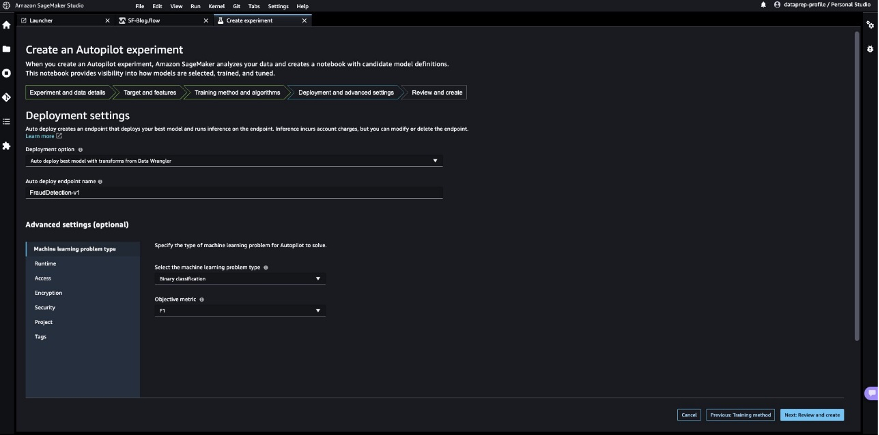

Lassen Sie uns SageMaker Autopilot so konfigurieren, dass ein automatisierter Trainingsjob ausgeführt wird, indem wir das Ziel angeben, das wir vorhersagen möchten, und die Art des Problems. Da wir in diesem Fall den Datensatz trainieren, um vorherzusagen, ob die Transaktion betrügerisch oder gültig ist, verwenden wir die binäre Klassifizierung.

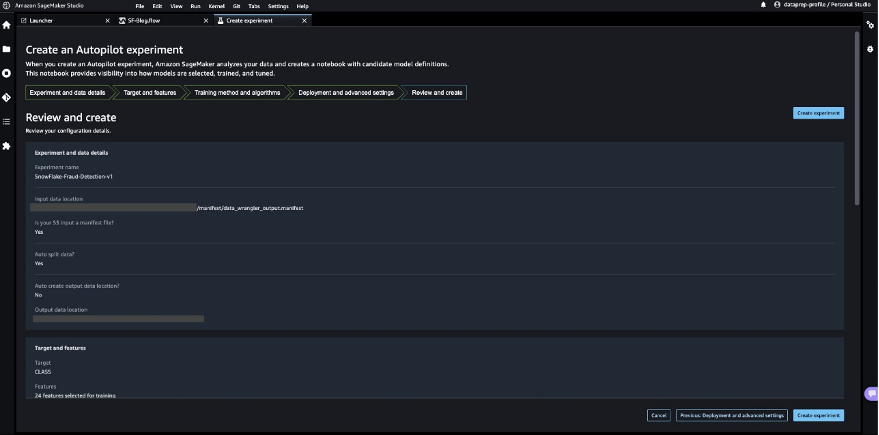

- Geben Sie einen Namen für Ihr Experiment ein, geben Sie die S3-Standortdaten an und wählen Sie Weiter: Ziel und Funktionen.

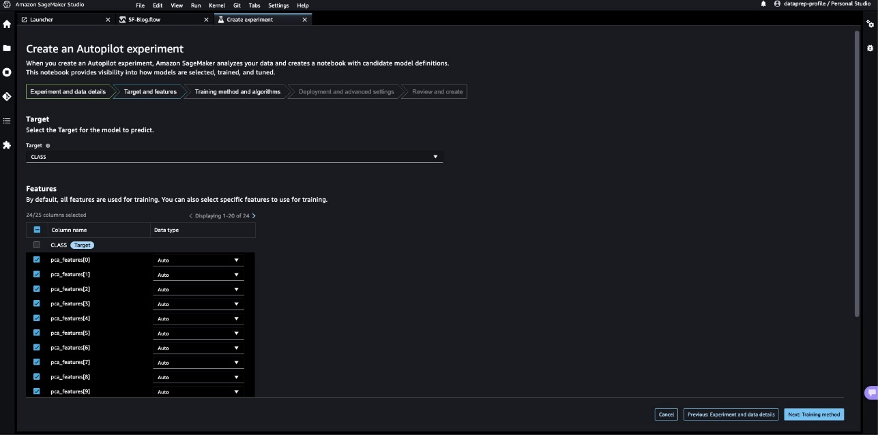

- Aussichten für Target, wählen

Classals die vorherzusagende Spalte. - Auswählen

Weiter: Trainingsmethode.

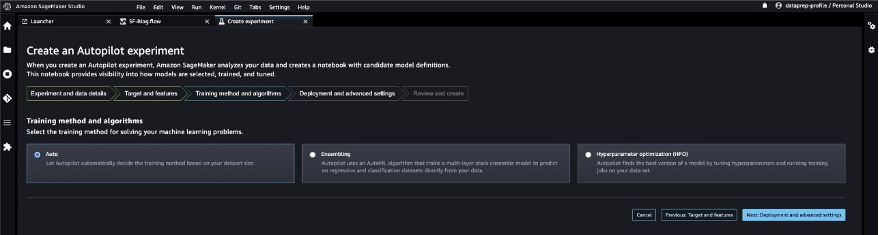

Lassen wir SageMaker Autopilot die Trainingsmethode basierend auf dem Datensatz festlegen.

- Aussichten für Trainingsmethode und AlgorithmenWählen Auto.

Weitere Informationen zu den von SageMaker Autopilot unterstützten Trainingsmodi finden Sie unter Trainingsmodi und Algorithmus unterstützen.

- Auswählen

Weiter: Bereitstellung und erweiterte Einstellungen.

- Aussichten für Bereitstellungsoption, wählen Stellen Sie das beste Modell automatisch mit Transformationen von Data Wrangler bereit, wodurch nach Abschluss des Experiments das beste Modell für die Inferenz geladen wird.

- Geben Sie einen Namen für Ihren Endpunkt ein.

- Aussichten für Wählen Sie den Problemtyp für maschinelles Lernen aus, wählen Binäre Klassifizierung.

- Aussichten für Einspruchsmetrik, wählen F1.

- Auswählen

Weiter: Überprüfen und erstellen.

- Auswählen Versuch erstellen.

Dadurch wird ein SageMaker-Autopilot-Job gestartet, der eine Reihe von Trainingsjobs erstellt, die Kombinationen von Hyperparametern verwenden, um die Zielmetrik zu optimieren.

Warten Sie, bis SageMaker Autopilot die Erstellung der Modelle und die Bewertung des besten ML-Modells abgeschlossen hat.

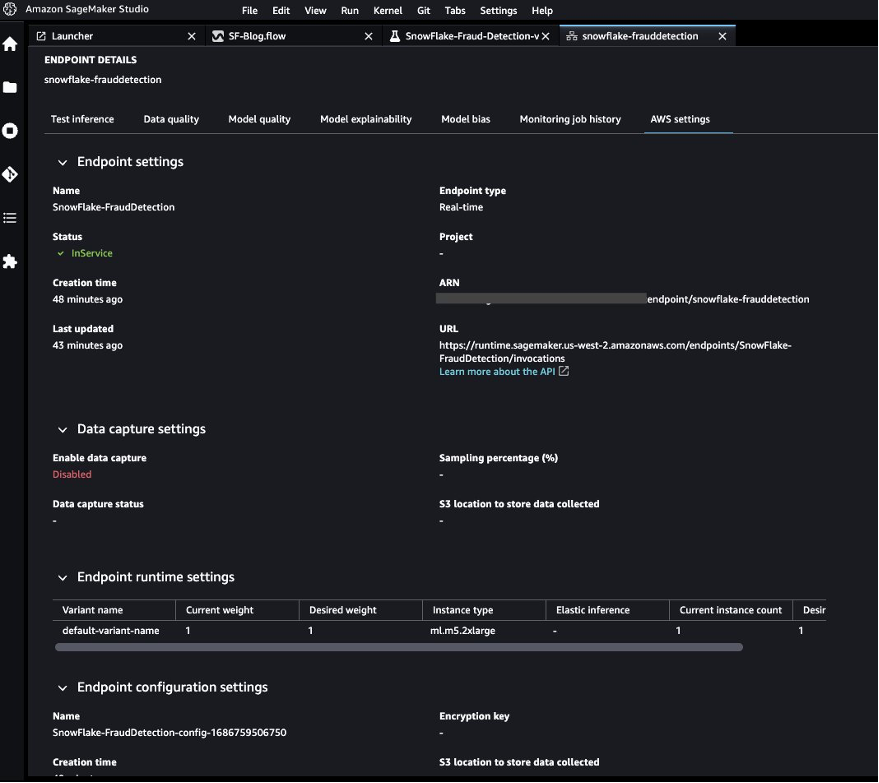

Starten Sie einen Echtzeit-Inferenzendpunkt, um das beste Modell zu testen

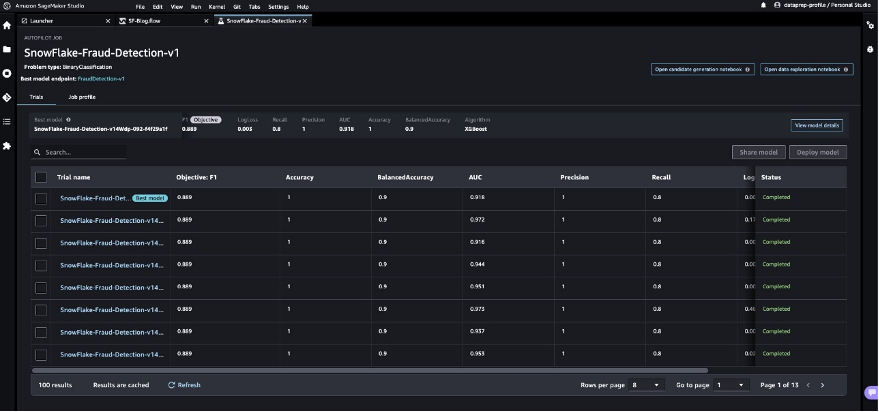

SageMaker Autopilot führt Experimente durch, um das beste Modell zu ermitteln, das Kreditkartentransaktionen als legitim oder betrügerisch klassifizieren kann.

Wenn SageMaker Autopilot das Experiment abschließt, können wir die Trainingsergebnisse mit den Bewertungsmetriken anzeigen und das beste Modell auf der Seite mit der Stellenbeschreibung von SageMaker Autopilot erkunden.

- Wählen Sie das beste Modell aus und wählen Sie Modell bereitstellen.

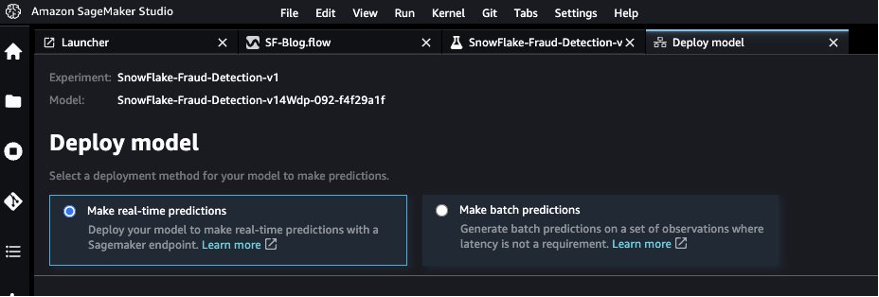

Wir verwenden einen Echtzeit-Inferenzendpunkt, um das beste Modell zu testen, das mit SageMaker Autopilot erstellt wurde.

- Auswählen Machen Sie Vorhersagen in Echtzeit.

Wenn der Endpunkt verfügbar ist, können wir die Nutzlast übergeben und Inferenzergebnisse erhalten.

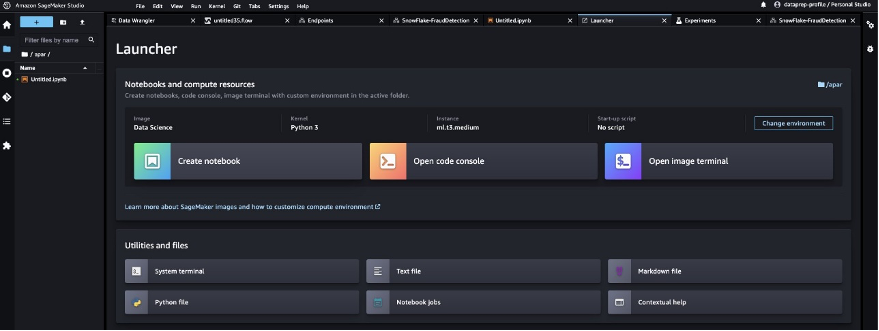

Starten wir ein Python-Notebook, um den Inferenzendpunkt zu verwenden.

- Wählen Sie in der SageMaker Studio-Konsole das Ordnersymbol im Navigationsbereich und wählen Sie Notizbuch erstellen.

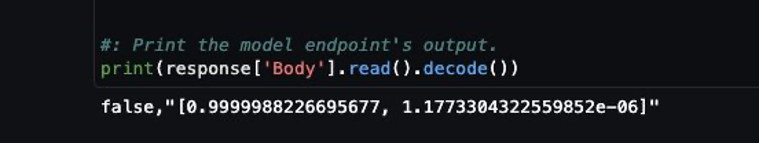

- Verwenden Sie den folgenden Python-Code, um den bereitgestellten Echtzeit-Inferenzendpunkt aufzurufen:

Die Ausgabe zeigt das Ergebnis als false, was bedeutet, dass die Beispiel-Feature-Daten nicht betrügerisch sind.

Aufräumen

Um sicherzustellen, dass Ihnen nach Abschluss dieses Tutorials keine Kosten entstehen, Beenden Sie die SageMaker Data Wrangler-Anwendung und Fahren Sie die Notebook-Instanz herunter Wird verwendet, um Schlussfolgerungen zu ziehen. Du solltest auch Löschen Sie den Inferenzendpunkt Sie haben mit SageMaker Autopilot erstellt, um zusätzliche Kosten zu vermeiden.

Zusammenfassung

In diesem Beitrag haben wir gezeigt, wie Sie Ihre Daten direkt aus Snowflake importieren, ohne dabei Zwischenkopien zu erstellen. Sie können Ihren gesamten Datensatz entweder direkt aus Snowflake abtasten oder in SageMaker Data Wrangler laden. Anschließend können Sie die Daten untersuchen, bereinigen und Feature-Engineering mithilfe der visuellen Benutzeroberfläche von SageMaker Data Wrangler durchführen.

Wir haben außerdem hervorgehoben, wie Sie ein Modell mit SageMaker Autopilot direkt über die Benutzeroberfläche von SageMaker Data Wrangler ganz einfach trainieren und optimieren können. Mit der Integration von SageMaker Data Wrangler und SageMaker Autopilot können wir nach Abschluss des Feature-Engineerings schnell ein Modell erstellen, ohne Code schreiben zu müssen. Dann haben wir auf das beste Modell von SageMaker Autopilot verwiesen, um Inferenzen mithilfe eines Echtzeit-Endpunkts auszuführen.

Probieren Sie noch heute die neue direkte Snowflake-Integration mit SageMaker Data Wrangler aus, um mit SageMaker ganz einfach ML-Modelle mit Ihren Daten zu erstellen.

Über die Autoren

Hariharan Suresh ist Senior Solutions Architect bei AWS. Seine Leidenschaft gilt Datenbanken, maschinellem Lernen und dem Entwerfen innovativer Lösungen. Bevor er zu AWS kam, war Hariharan Produktarchitekt, Core-Banking-Implementierungsspezialist und Entwickler und arbeitete über 11 Jahre lang mit BFSI-Organisationen zusammen. Außerhalb der Technik genießt er Gleitschirmfliegen und Radfahren.

Hariharan Suresh ist Senior Solutions Architect bei AWS. Seine Leidenschaft gilt Datenbanken, maschinellem Lernen und dem Entwerfen innovativer Lösungen. Bevor er zu AWS kam, war Hariharan Produktarchitekt, Core-Banking-Implementierungsspezialist und Entwickler und arbeitete über 11 Jahre lang mit BFSI-Organisationen zusammen. Außerhalb der Technik genießt er Gleitschirmfliegen und Radfahren.

Aparajithan Vaidyanathan ist Principal Enterprise Solutions Architect bei AWS. Er unterstützt Unternehmenskunden bei der Migration und Modernisierung ihrer Workloads in die AWS-Cloud. Er ist ein Cloud-Architekt mit mehr als 23 Jahren Erfahrung in der Gestaltung und Entwicklung von Unternehmens-, Groß- und verteilten Softwaresystemen. Er ist spezialisiert auf maschinelles Lernen und Datenanalyse mit Schwerpunkt auf dem Bereich Daten- und Feature-Engineering. Er ist ein aufstrebender Marathonläufer und zu seinen Hobbys zählen Wandern, Radfahren und Zeit mit seiner Frau und seinen beiden Söhnen verbringen.

Aparajithan Vaidyanathan ist Principal Enterprise Solutions Architect bei AWS. Er unterstützt Unternehmenskunden bei der Migration und Modernisierung ihrer Workloads in die AWS-Cloud. Er ist ein Cloud-Architekt mit mehr als 23 Jahren Erfahrung in der Gestaltung und Entwicklung von Unternehmens-, Groß- und verteilten Softwaresystemen. Er ist spezialisiert auf maschinelles Lernen und Datenanalyse mit Schwerpunkt auf dem Bereich Daten- und Feature-Engineering. Er ist ein aufstrebender Marathonläufer und zu seinen Hobbys zählen Wandern, Radfahren und Zeit mit seiner Frau und seinen beiden Söhnen verbringen.

Tim Lied ist Softwareentwicklungsingenieur bei AWS SageMaker. Mit mehr als 10 Jahren Erfahrung als Softwareentwickler, Berater und Technologieführer hat er seine Fähigkeit bewiesen, skalierbare und zuverlässige Produkte zu liefern und komplexe Probleme zu lösen. In seiner Freizeit genießt er die Natur, läuft im Freien, wandert usw.

Tim Lied ist Softwareentwicklungsingenieur bei AWS SageMaker. Mit mehr als 10 Jahren Erfahrung als Softwareentwickler, Berater und Technologieführer hat er seine Fähigkeit bewiesen, skalierbare und zuverlässige Produkte zu liefern und komplexe Probleme zu lösen. In seiner Freizeit genießt er die Natur, läuft im Freien, wandert usw.

Bosco Albuquerque ist Sr. Partner Solutions Architect bei AWS und verfügt über mehr als 20 Jahre Erfahrung in der Arbeit mit Datenbank- und Analyseprodukten von Anbietern von Unternehmensdatenbanken und Cloud-Anbietern. Er hat große Technologieunternehmen bei der Entwicklung von Datenanalyselösungen unterstützt und Ingenieurteams bei der Entwicklung und Implementierung von Datenanalyseplattformen und Datenprodukten geleitet.

Bosco Albuquerque ist Sr. Partner Solutions Architect bei AWS und verfügt über mehr als 20 Jahre Erfahrung in der Arbeit mit Datenbank- und Analyseprodukten von Anbietern von Unternehmensdatenbanken und Cloud-Anbietern. Er hat große Technologieunternehmen bei der Entwicklung von Datenanalyselösungen unterstützt und Ingenieurteams bei der Entwicklung und Implementierung von Datenanalyseplattformen und Datenprodukten geleitet.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/accelerate-time-to-business-insights-with-the-amazon-sagemaker-data-wrangler-direct-connection-to-snowflake/

- :hast

- :Ist

- :nicht

- $UP

- 1

- 10

- 100

- 11

- 12

- 14

- 15%

- 20

- 20 Jahre

- 2013

- 27

- 30

- 40

- 500

- 7

- 9

- a

- Fähigkeit

- LiveBuzz

- beschleunigen

- Zugang

- Konto

- Zusätzliche

- Administratoren

- advanced

- Nach der

- aufs Neue

- AI / ML

- Alle

- erlauben

- ebenfalls

- Obwohl

- Amazon

- Amazon Sage Maker

- Amazon SageMaker Data Wrangler

- Amazon Web Services

- Betrag

- an

- Analyse

- Analytik

- und

- Ein anderer

- jedem

- Apache

- Bienen

- angewandt

- Bewerben

- SIND

- AS

- strebend

- At

- Aufmerksamkeit

- Authentifizierung

- automatisieren

- Automatisiert

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- AWS

- Bankinggg

- basierend

- basic

- BE

- weil

- Bevor

- unten

- BESTE

- BFSI

- Körper

- beide

- bringen

- bauen

- Building

- eingebaut

- Geschäft

- aber

- by

- CAN

- Fähigkeiten

- Erfassung

- Karte

- Häuser

- Fälle

- Zeichen

- berechnet

- Gebühren

- aus der Ferne überprüfen

- Auswählen

- Klasse

- Einstufung

- eingestuft

- klassifizieren

- Auftraggeber

- Cloud

- Code

- Kolonne

- Spalten

- Kombinationen

- Unternehmen

- abschließen

- Abgeschlossene Verkäufe

- Wird abgeschlossen

- Abschluss

- Komplex

- Komponente

- konfiguriert

- Vernetz Dich

- Verbindung

- Konsul (Console)

- Berater

- fortsetzen

- Smartgeräte App

- verkaufen

- Kernbereich

- Core-Banking

- erstellen

- erstellt

- schafft

- Erstellen

- Referenzen

- Kredit

- Kreditkarte

- Kunde

- Customer Experience

- Kunden

- technische Daten

- Datenzugriff

- Datenanalyse

- Datenanalyse

- Datenaufbereitung

- Datenwissenschaftler

- Datenbase

- Datenbanken

- entscheidet

- Standard

- defaults

- Übergeben

- zeigen

- Synergie

- einsetzen

- Einsatz

- Einsatz

- Beschreibung

- Design

- entworfen

- Entwerfen

- Details

- Bestimmen

- Entwickler:in / Unternehmen

- Entwicklung

- Entwicklung

- Größe

- Direkt

- Direkt

- verteilt

- Domain

- Nicht

- nach unten

- herunterladen

- leicht

- entweder

- Endpunkt

- Ingenieur

- Entwicklung

- Enter

- Unternehmen

- etc

- Europäische

- Auswertung

- Außer

- existiert

- ERFAHRUNGEN

- Experiment

- Experimente

- Exploration

- Explorative Datenanalyse

- ERKUNDEN

- exportieren

- weit

- Merkmal

- Eigenschaften

- Einzigartige

- Reichen Sie das

- Revolution

- Fertig

- Vorname

- Schwimmer

- Setzen Sie mit Achtsamkeit

- Folgende

- Aussichten für

- Format

- betrügerisch

- für

- voller

- weiter

- erzeugen

- bekommen

- gibt

- gewähren

- Graph

- Haben

- he

- Hilfe

- dazu beigetragen,

- höchste

- Besondere

- seine

- Ultraschall

- Hilfe

- HTML

- http

- HTTPS

- ICON

- identifizieren

- Identitätsschutz

- if

- Unausgewogenheit

- Implementierung

- Umsetzung

- importieren

- Bedeutung

- Einfuhr

- Importe

- zu unterstützen,

- in

- das

- Dazu gehören

- Erhöhung

- Krankengymnastik

- Information

- Anfangs-

- innovativ

- Einblicke

- installieren

- integrieren

- Integration

- Schnittstelle

- intern

- in

- Probleme

- IT

- Artikel

- Job

- Jobs

- Beitritt

- Reise

- jpg

- JSON

- grosse

- großflächig

- starten

- ins Leben gerufen

- Führer

- lernen

- Verlassen

- geführt

- links

- legitim

- lassen

- Bibliothek

- LIMIT

- Liste

- Belastung

- Belastungen

- aus einer regionalen

- Standorte

- niedrigste

- Maschine

- Maschinelles Lernen

- gemacht

- halten

- um

- verwalten

- Marathon

- Abstimmung

- Kann..

- Mechanismus

- Methode

- Metrisch

- Metrik

- migriert

- Minuten

- Kommt demnächst...

- ML

- Modell

- für

- modernisieren

- Modi

- Überwachen

- mehr

- Name

- Namens

- Natur

- Menü

- Bedürfnisse

- Neu

- weiter

- Notizbuch

- jetzt an

- Anzahl

- oauth

- Objekt

- Ziel

- of

- on

- laufend

- Optimieren

- Option

- or

- Auftrag

- Organisationen

- Original

- OS

- Andere

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- aussen

- übrig

- Überblick

- Seite

- Brot

- Partner

- passieren

- leidenschaftlich

- Passwort

- Weg

- Ausführen

- Durchführung

- Berechtigungen

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- erfahren

- Points

- Beliebt

- Post

- vorhersagen

- vorhergesagt

- Prognosen

- Vorbereitung

- Danach

- Voraussetzungen

- verhindern

- früher

- Principal

- Vor

- Aufgabenstellung:

- Probleme

- Prozessdefinierung

- Verarbeitung

- Produkt

- PRODUKTIVITÄT

- Produkte

- Fortschritt

- die

- Versorger

- Anbieter

- Öffentlichkeit

- Kauf

- Zwecke

- setzen

- Python

- Qualität

- Abfragen

- Direkt

- schnell

- Echtzeit

- Veteran

- reduziert

- Reduktion

- zuverlässig

- entfernen

- ersetzen

- berichten

- Berichtet

- Meldungen

- Anforderung

- falls angefordert

- Antwort

- Folge

- Die Ergebnisse

- Überprüfen

- Reiten

- Rollen

- Führen Sie

- Läufer

- Laufen

- s

- sagemaker

- Speichern

- skalierbaren

- Wissenschaftler

- Wissenschaftler

- nahtlos

- Abschnitt

- senden

- Senior

- September

- Lösungen

- kompensieren

- Einstellungen

- Setup

- von Locals geführtes

- sollte

- erklären

- Konzerte

- Schild

- Einfacher

- vereinfachte

- Single

- So

- Software

- Software-Entwicklung

- Lösung

- Lösungen

- LÖSEN

- Lied

- Quelle

- Spark

- Spezialist

- spezialisiert

- speziell

- Geschwindigkeit

- Ausgabe

- Stufe

- beginnt

- Schritt

- Shritte

- Immer noch

- Lagerung

- speichern

- Streng

- Schnur

- Studio Adressen

- abschicken

- erfolgreich

- Erfolgreich

- so

- Support

- Unterstützte

- Unterstützt

- Systeme und Techniken

- Tabelle

- Target

- und Aufgaben

- Teams

- Tech

- Technologie

- Technologieunternehmen

- Test

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Der Graph

- ihr

- dann

- Dort.

- vom Nutzer definierten

- fehlen uns die Worte.

- diejenigen

- Durch

- Zeit

- zu

- heute

- Training

- trainiert

- Ausbildung

- Transaktion

- Transaktionen

- Transformation

- Transformationen

- was immer dies auch sein sollte.

- Lernprogramm

- XNUMX

- tippe

- ui

- verstehen

- Aktualisierung

- us

- Nutzbarkeit

- -

- benutzt

- Mitglied

- Benutzerschnittstelle

- Nutzer

- verwendet

- Verwendung von

- v1

- BESTÄTIGEN

- Wert

- Werte

- Anbieter

- überprüfen

- Anzeigen

- Assistent

- Sichtbarkeit

- warten

- wollen

- wurde

- we

- Netz

- Web-Services

- Wochen

- waren

- ob

- welche

- während

- WHO

- Frau

- mit

- .

- ohne

- Arbeiten

- gearbeitet

- Arbeitsablauf.

- Workflows

- arbeiten,

- Schreiben

- Jahr

- Du

- Ihr

- Zephyrnet