Betrugserkennung ist ein wichtiges Problem, das Anwendungen in Finanzdienstleistungen, sozialen Medien, E-Commerce, Spielen und anderen Branchen hat. Dieser Beitrag stellt eine Implementierung einer Betrugserkennungslösung vor, die das Relational Graph Convolutional Network (RGCN)-Modell verwendet, um die Wahrscheinlichkeit vorherzusagen, dass eine Transaktion betrügerisch ist, sowohl durch den transduktiven als auch durch den induktiven Inferenzmodus. Sie können unsere Implementierung für eine bereitstellen Amazon Sage Maker endpoint als Betrugserkennungslösung in Echtzeit, ohne dass externe Diagrammspeicherung oder -orchestrierung erforderlich ist, wodurch die Bereitstellungskosten des Modells erheblich gesenkt werden.

Unternehmen, die nach einem vollständig verwalteten AWS-KI-Service zur Betrugserkennung suchen, können ihn ebenfalls verwenden Amazon Fraud Detector, mit dem Sie verdächtige Online-Zahlungen identifizieren, neuen Kontobetrug erkennen, den Missbrauch von Probe- und Treueprogrammen verhindern oder die Erkennung von Kontoübernahmen verbessern können.

Lösungsüberblick

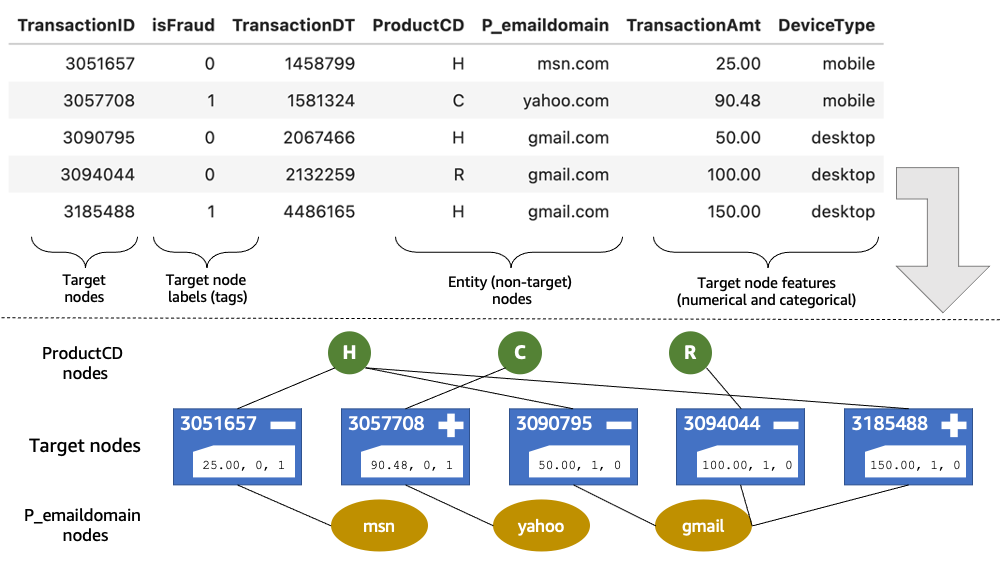

Das folgende Diagramm beschreibt ein beispielhaftes Finanztransaktionsnetzwerk, das verschiedene Arten von Informationen enthält. Jede Transaktion enthält Informationen wie Gerätekennungen, Wi-Fi-IDs, IP-Adressen, physische Standorte, Telefonnummern und mehr. Wir stellen die Transaktionsdatensätze durch einen heterogenen Graphen dar, der verschiedene Arten von Knoten und Kanten enthält. Dann wird das Betrugserkennungsproblem als Knotenklassifizierungsaufgabe auf diesem heterogenen Graphen behandelt.

Graphische neuronale Netze (GNNs) haben sich als vielversprechend bei der Lösung von Betrugserkennungsproblemen erwiesen und beliebte überwachte Lernmethoden wie Gradienten-verstärkte Entscheidungsbäume oder vollständig verbundene Feed-Forward-Netze auf Benchmarking-Datensätzen übertroffen. In einer typischen Einrichtung zur Betrugserkennung wird während der Trainingsphase ein GNN-Modell mit einer Reihe gekennzeichneter Transaktionen trainiert. Jede Trainingstransaktion ist mit einem binären Etikett versehen, das angibt, ob sie betrügerisch ist. Dieses trainierte Modell kann dann verwendet werden, um während der Inferenzphase betrügerische Transaktionen in einer Reihe von nicht gekennzeichneten Transaktionen zu erkennen. Es gibt zwei verschiedene Arten der Inferenz: transduktive Inferenz vs. induktive Inferenz (auf die wir später in diesem Beitrag noch näher eingehen).

GNN-basierte Modelle wie RGCN können topologische Informationen nutzen, indem sie sowohl die Graphstruktur als auch Merkmale von Knoten und Kanten kombinieren, um eine aussagekräftige Darstellung zu lernen, die böswillige Transaktionen von legitimen Transaktionen unterscheidet. RGCN kann effektiv lernen, verschiedene Arten von Knoten und Kanten (Beziehungen) durch heterogene Grapheneinbettung darzustellen. Im vorstehenden Diagramm wird jede Transaktion als Zielknoten modelliert, und mehrere mit jeder Transaktion verknüpfte Entitäten werden als Nicht-Zielknotentypen modelliert, z ProductCD und P_emaildomain. Zielknoten sind numerische und kategoriale Merkmale zugewiesen, während andere Knotentypen merkmalslos sind. Das RGCN-Modell lernt eine Einbettung für jeden Nicht-Zielknotentyp. Für die Einbettung eines Zielknotens wird eine Faltungsoperation verwendet, um seine Einbettung unter Verwendung seiner Merkmale und Nachbarschaftseinbettungen zu berechnen. Im Rest des Beitrags verwenden wir die Begriffe GNN und RGCN synonym.

Es ist erwähnenswert, dass alternative Strategien, wie z. B. das Behandeln der Nicht-Ziel-Entitäten als Merkmale und deren One-Hot-Codierung, aufgrund der großen Kardinalitäten dieser Entitäten oft nicht durchführbar wären. Umgekehrt ermöglicht die Codierung als Diagrammentitäten dem GNN-Modell, die implizite Topologie in den Entitätsbeziehungen zu nutzen. Beispielsweise ist es wahrscheinlicher, dass Transaktionen, die eine Telefonnummer mit bekannten betrügerischen Transaktionen teilen, ebenfalls betrügerisch sind.

Die von GNNs verwendete grafische Darstellung erzeugt eine gewisse Komplexität bei ihrer Implementierung. Dies gilt insbesondere für Anwendungen wie Betrugserkennung, bei denen die Diagrammdarstellung während der Inferenz mit neu hinzugefügten Knoten erweitert werden kann, die Entitäten entsprechen, die während des Modelltrainings nicht bekannt sind. Dieses Inferenzszenario wird üblicherweise als bezeichnet induktiver Modus. Im Gegensatz, transduktiver Modus ist ein Szenario, das davon ausgeht, dass sich die während des Modelltrainings erstellte Diagrammdarstellung während der Inferenz nicht ändert. GNN-Modelle werden häufig im transduktiven Modus ausgewertet, indem Diagrammdarstellungen aus einem kombinierten Satz von Trainings- und Testbeispielen erstellt werden, während Testetiketten während der Rückwärtsausbreitung maskiert werden. Dadurch wird sichergestellt, dass die Diagrammdarstellung statisch ist und das GNN-Modell keine Implementierung von Operationen erfordert, um das Diagramm während der Inferenz um neue Knoten zu erweitern. Leider kann bei der Erkennung betrügerischer Transaktionen in einer realen Umgebung nicht von einer statischen Diagrammdarstellung ausgegangen werden. Daher ist die Unterstützung für induktive Inferenz erforderlich, wenn GNN-Modelle zur Betrugserkennung in Produktionsumgebungen bereitgestellt werden.

Darüber hinaus ist die Erkennung betrügerischer Transaktionen in Echtzeit von entscheidender Bedeutung, insbesondere in Geschäftsfällen, in denen es nur eine Chance gibt, illegale Aktivitäten zu stoppen. Beispielsweise können sich betrügerische Benutzer mit einem Konto nur einmal böswillig verhalten und dasselbe Konto nie wieder verwenden. Echtzeit-Inferenz auf GNN-Modelle bringt zusätzliche Komplexität in die Implementierung ein. Es ist oft notwendig, Subgraph-Extraktionsoperationen zu implementieren, um Echtzeit-Inferenz zu unterstützen. Die Subgraph-Extraktionsoperation wird benötigt, um die Inferenzlatenz zu reduzieren, wenn die Graphdarstellung groß ist und das Durchführen einer Inferenz für den gesamten Graphen unerschwinglich teuer wird. Ein Algorithmus für induktive Inferenz in Echtzeit mit einem RGCN-Modell läuft wie folgt ab:

- Erweitern Sie bei einem Batch von Transaktionen und einem trainierten RGCN-Modell die Diagrammdarstellung mit Entitäten aus dem Batch.

- Weisen Sie Einbettungsvektoren neuer Nicht-Zielknoten dem mittleren Einbettungsvektor ihres jeweiligen Knotentyps zu.

- Extrahieren Sie einen Teilgraphen, der durch induziert wird k-hop out-neighborhood der Zielknoten aus dem Batch.

- Führen Sie eine Inferenz für das Teildiagramm durch und geben Sie Vorhersagewerte für die Zielknoten des Stapels zurück.

- Bereinigen Sie die Diagrammdarstellung, indem Sie neu hinzugefügte Knoten entfernen (dieser Schritt stellt sicher, dass der Speicherbedarf für die Modellinferenz konstant bleibt).

Der Hauptbeitrag dieses Beitrags besteht darin, ein RGCN-Modell vorzustellen, das den induktiven Inferenzalgorithmus in Echtzeit implementiert. Sie können unsere RGCN-Implementierung auf einem SageMaker-Endpunkt als Lösung zur Betrugserkennung in Echtzeit bereitstellen. Unsere Lösung erfordert keine externe Diagrammspeicherung oder Orchestrierung und reduziert die Bereitstellungskosten des RGCN-Modells für Aufgaben zur Betrugserkennung erheblich. Das Modell implementiert auch den transduktiven Inferenzmodus, sodass wir Experimente durchführen können, um die Modellleistung im induktiven und im transduktiven Modus zu vergleichen. Auf den Modellcode und die Notebooks mit Experimenten kann über die zugegriffen werden AWS-Beispiele GitHub-Repository.

Dieser Beitrag baut auf dem Beitrag auf Erstellen Sie mit Amazon SageMaker, Amazon Neptune und der Deep Graph Library eine GNN-basierte Betrugserkennungslösung in Echtzeit. Der vorherige Beitrag erstellte eine RGCN-basierte Echtzeit-Betrugserkennungslösung mit SageMaker, Amazon Neptunund der Deep-Graph-Bibliothek (DGL). Die frühere Lösung verwendete eine Neptune-Datenbank als externen Graphenspeicher, erforderlich AWS Lambda für die Orchestrierung für Echtzeit-Inferenz und enthielt nur Experimente im transduktiven Modus.

Das in diesem Beitrag vorgestellte RGCN-Modell implementiert alle Operationen des induktiven Inferenzalgorithmus in Echtzeit, wobei nur die DGL als Abhängigkeit verwendet wird, und erfordert keine externe Diagrammspeicherung oder Orchestrierung für die Bereitstellung.

Wir bewerten zunächst die Leistung des RGCN-Modells im transduktiven und induktiven Modus anhand eines Benchmark-Datensatzes. Wie erwartet ist die Modellleistung im induktiven Modus etwas geringer als im transduktiven Modus. Wir untersuchen auch die Wirkung von Hyperparametern k auf Modellleistung. Der Hyperparameter k steuert die Anzahl der Sprünge, die durchgeführt werden, um einen Teilgraphen in Schritt 3 des Echtzeit-Inferenzalgorithmus zu extrahieren. Höhere Werte von k erzeugt größere Teilgraphen und kann zu einer besseren Inferenzleistung auf Kosten einer höheren Latenz führen. Daher führen wir auch Timing-Experimente durch, um die Machbarkeit des RGCN-Modells für eine Echtzeitanwendung zu bewerten.

Datensatz

Wir nutzen die IEEE-CIS-Betrugsdatensatz, derselbe Datensatz, der im vorherigen verwendet wurde Post. Der Datensatz enthält über 590,000 Transaktionsdatensätze, die ein binäres Betrugsetikett (das isFraud Spalte). Die Daten sind in zwei Tabellen aufgeteilt: Transaktion und Identität. Jedoch haben nicht alle Transaktionsaufzeichnungen entsprechende Identitätsinformationen. Wir schließen uns den beiden Tischen an TransactionID Spalte, die uns insgesamt 144,233 Transaktionsaufzeichnungen belässt. Wir sortieren die Tabelle nach Transaktionszeitstempel (die TransactionDT Spalte) und erstellen Sie eine 80/20-Prozentaufteilung nach Zeit, was 115,386 bzw. 28,847 Transaktionen für Training und Test ergibt.

Weitere Einzelheiten zum Datensatz und zur Formatierung gemäß den Eingabeanforderungen der DGL finden Sie unter Aufdeckung von Betrug in heterogenen Netzwerken mithilfe von Amazon SageMaker und Deep Graph Library.

Graphkonstruktion

Wir nutzen die TransactionID Spalte zum Generieren von Zielknoten. Wir verwenden die folgenden Spalten, um 11 Arten von Nicht-Zielknoten zu generieren:

card1biscard6ProductCDaddr1undaddr2P_emaildomainundR_emaildomain

Wir verwenden 38 Spalten als kategoriale Merkmale von Zielknoten:

M1bisM9DeviceTypeundDeviceInfoid_12bisid_38

Wir verwenden 382 Spalten als numerische Merkmale von Zielknoten:

TransactionAmtdist1unddist2id_01bisid_11C1bisC14D1bisD15V1bisV339

Unser aus den Trainingstransaktionen konstruierter Graph enthält 217,935 Knoten und 2,653,878 Kanten.

Hyperparameter

Andere Parameter werden so eingestellt, dass sie mit den oben berichteten Parametern übereinstimmen Post. Das folgende Snippet veranschaulicht das Training des RGCN-Modells im transduktiven und induktiven Modus:

Induktiver vs. transduktiver Modus

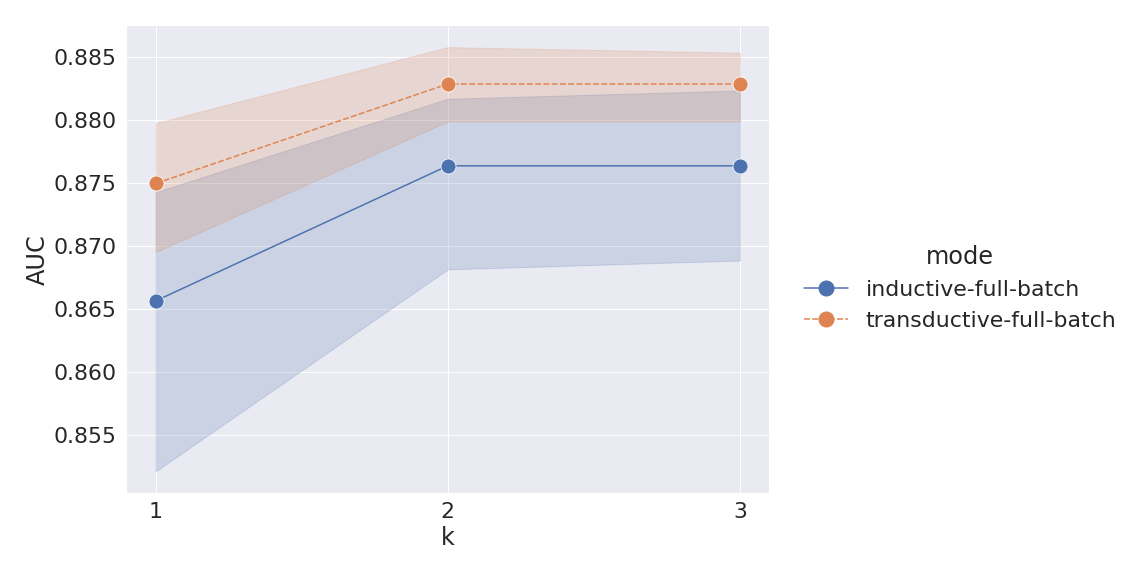

Wir führen fünf Versuche für den induktiven und fünf Versuche für den transduktiven Modus durch. Für jeden Versuch trainieren wir ein RGCN-Modell und speichern es auf der Festplatte, wodurch 10 Modelle erhalten werden. Wir evaluieren jedes Modell anhand von Testbeispielen, während wir die Anzahl der Sprünge erhöhen (Parameter k) verwendet, um einen Teilgraphen für die Inferenz, Einstellung zu extrahieren k auf 1, 2 und 3. Wir sagen für alle Testbeispiele auf einmal voraus und berechnen den ROC-AUC-Score für jeden Versuch. Das folgende Diagramm zeigt den Mittelwert und das 95-%-Konfidenzintervall der AUC-Scores.

Wir können sehen, dass die Leistung im transduktiven Modus etwas höher ist als im induktiven Modus. Für k=2, die mittleren AUC-Scores für den induktiven und den transduktiven Modus betragen 0.876 bzw. 0.883. Dies ist zu erwarten, da das RGCN-Modell in der Lage ist, Einbettungen aller Entitätsknoten im transduktiven Modus zu lernen, einschließlich derjenigen im Testsatz. Im Gegensatz dazu erlaubt der induktive Modus dem Modell nur, Einbettungen von Entitätsknoten zu lernen, die in den Trainingsbeispielen vorhanden sind, und daher müssen einige Knoten während der Inferenz mit Mittelwerten gefüllt werden. Gleichzeitig ist der Leistungsabfall zwischen transduktivem und induktivem Modus nicht signifikant, und selbst im induktiven Modus erreicht das RGCN-Modell mit einer AUC von 0.876 eine gute Leistung. Wir beobachten auch, dass sich die Modellleistung bei Werten von nicht verbessert k>2. Dies impliziert diese Einstellung k=2 würde während der Inferenz einen ausreichend großen Teilgraphen extrahieren, was zu einer optimalen Leistung führt. Diese Beobachtung wird auch durch unser nächstes Experiment bestätigt.

Es ist auch erwähnenswert, dass für den transduktiven Modus die AUC unseres Modells von 0.883 höher ist als die entsprechende AUC von 0.870, die im vorherigen Bericht angegeben wurde Post. Wir verwenden mehr Spalten als numerische und kategoriale Merkmale von Zielknoten, was den höheren AUC-Score erklären kann. Wir stellen auch fest, dass die Experimente im vorherigen Beitrag nur einen einzigen Versuch durchgeführt haben.

Rückschluss auf eine kleine Charge

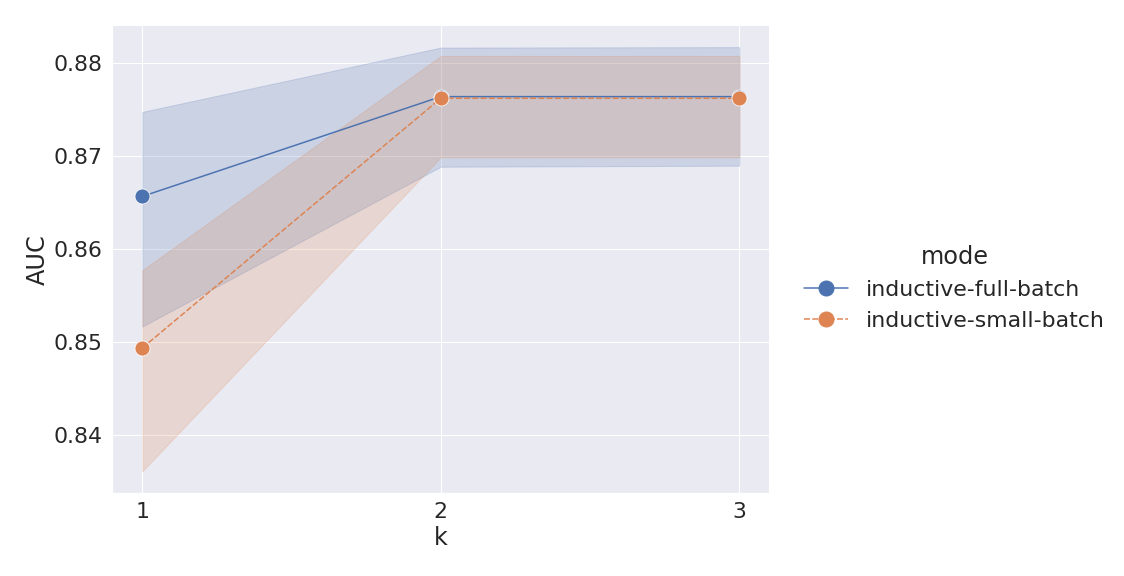

Für dieses Experiment werten wir das RGCN-Modell in einer Kleinserien-Inferenzumgebung aus. Wir verwenden fünf Modelle, die im vorherigen Experiment im induktiven Modus trainiert wurden. Wir vergleichen die Leistung dieser Modelle bei der Vorhersage in zwei Einstellungen: Full- und Small-Batch-Inferenz. Für vollständige Chargeninferenz sagen wir für den gesamten Testsatz voraus, wie dies im vorherigen Experiment geschehen ist. Für Small-Batch-Inferenz sagen wir in kleinen Batches voraus, indem wir den Testsatz in 28 Batches gleicher Größe mit ungefähr 1,000 Transaktionen in jedem Batch partitionieren. Wir berechnen AUC-Scores für beide Einstellungen unter Verwendung unterschiedlicher Werte von k. Das folgende Diagramm zeigt den Mittelwert und die 95 %-Konfidenzintervalle für vollständige und kleine Batch-Inferenzeinstellungen.

Wir beobachten diese Leistung für die Inferenz kleiner Chargen, wenn k=1 ist niedriger als für die vollständige Charge. Die Inferenzleistung für kleine Stapel entspricht jedoch dem vollständigen Stapel, wenn k>1. Dies kann darauf zurückgeführt werden, dass für kleine Chargen viel kleinere Teilgraphen extrahiert werden. Wir bestätigen dies, indem wir die Größen der Teilgraphen mit der Größe des gesamten Graphen vergleichen, der aus den Trainingstransaktionen erstellt wurde. Wir vergleichen Graphgrößen in Bezug auf die Anzahl der Knoten. Für k=1, beträgt die durchschnittliche Unterdiagrammgröße für Small-Batch-Inferenz weniger als 2 % des Trainingsdiagramms. Und für vollständige Batch-Inferenz, wenn k=1, die Teilgraphgröße beträgt 22 %. Wenn k=2, Unterdiagrammgrößen für kleine und vollständige Batch-Inferenz sind 54 % bzw. 64 %. Schließlich erreichen die Unterdiagrammgrößen für beide Inferenzeinstellungen 100 % für k=3. Mit anderen Worten, wann k> 1, wird der Teilgraph für eine kleine Charge ausreichend groß, sodass die Inferenz für kleine Chargen die gleiche Leistung wie die Inferenz für vollständige Chargen erreichen kann.

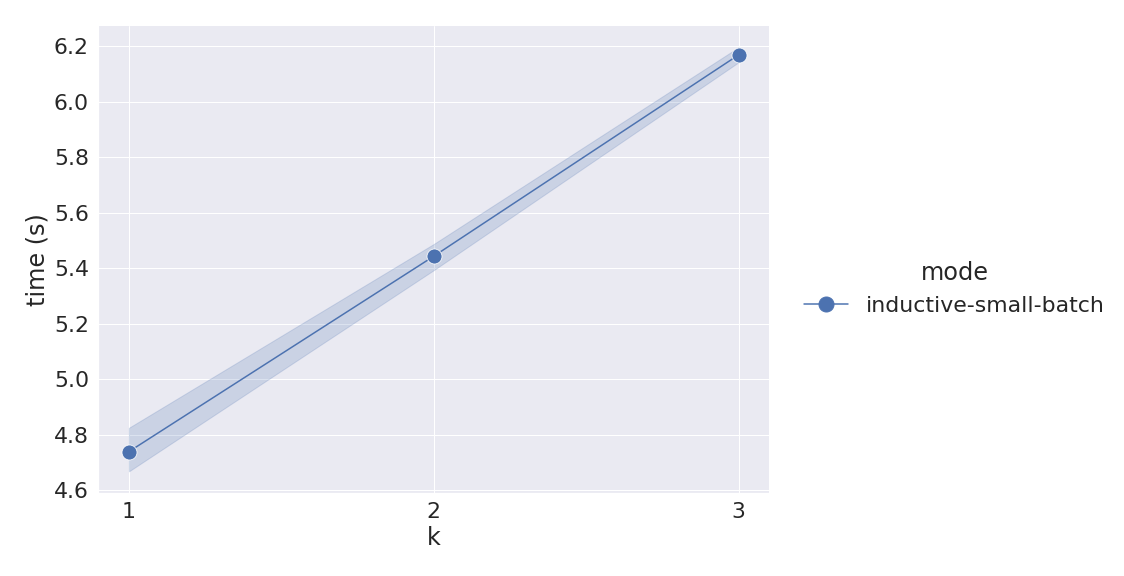

Wir zeichnen auch die Vorhersagelatenz für jeden Stapel auf. Wir führen unsere Experimente auf einer ml.r5.12xlarge-Instance durch, aber Sie können eine kleinere Instance mit 64 G-Speicher verwenden, um dieselben Experimente auszuführen. Das folgende Diagramm zeigt den Mittelwert und die 95 %-Konfidenzintervalle von Vorhersagelatenzen für kleine Batches für verschiedene Werte von k.

Die Latenz umfasst alle fünf Schritte des induktiven Echtzeit-Inferenzalgorithmus. Das sehen wir wann k=2, die Vorhersage von 1,030 Transaktionen dauert durchschnittlich 5.4 Sekunden, was zu einem Durchsatz von 190 Transaktionen pro Sekunde führt. Dies bestätigt, dass die Implementierung des RGCN-Modells für die Echtzeit-Betrugserkennung geeignet ist. Wir stellen auch fest, dass die vorherige Post lieferten keine harten Latenzwerte für ihre Implementierung.

Zusammenfassung

Das mit diesem Beitrag veröffentlichte RGCN-Modell implementiert den Algorithmus für induktive Inferenz in Echtzeit und erfordert keine externe Grafikspeicherung oder Orchestrierung. Der Parameter k in Schritt 3 des Algorithmus gibt die Anzahl der durchgeführten Sprünge an, um den Teilgraphen für die Inferenz zu extrahieren, und führt zu einem Kompromiss zwischen Modellgenauigkeit und Vorhersagelatenz. Wir haben die benutzt IEEE-CIS-Betrugsdatensatz in unseren Experimenten und empirisch validiert, dass der optimale Wert des Parameters k für diesen Datensatz ist 2, wodurch ein AUC-Wert von 0.876 und eine Vorhersagelatenz von weniger als 6 Sekunden pro 1,000 Transaktionen erreicht werden.

Dieser Beitrag stellte einen schrittweisen Prozess zum Trainieren und Evaluieren eines RGCN-Modells für die Echtzeit-Betrugserkennung bereit. Die enthaltene Modellklasse implementiert Methoden für den gesamten Modelllebenszyklus, einschließlich Serialisierungs- und Deserialisierungsmethoden. Dadurch kann das Modell zur Echtzeit-Betrugserkennung verwendet werden. Sie können das Modell wie folgt als PyTorch-SageMaker-Schätzer trainieren und es dann auf einem SageMaker-Endpunkt bereitstellen Notizbuch als Vorlage. Der Endpunkt ist in der Lage, Betrug bei kleinen Mengen von Rohtransaktionen in Echtzeit vorherzusagen. Sie können auch verwenden Amazon SageMaker Inference Recommender um den besten Instance-Typ und die beste Konfiguration für den Inferenzendpunkt basierend auf Ihren Workloads auszuwählen.

Für weitere Informationen zu diesem Thema und der Implementierung empfehlen wir Ihnen, unsere Skripte selbst zu erkunden und zu testen. Sie können auf die Notebooks und den zugehörigen Modellklassencode über zugreifen AWS-Beispiele GitHub-Repository.

Über die Autoren

Dmitrij Bespalow ist Senior Applied Scientist im Amazon Machine Learning Solutions Lab, wo er AWS-Kunden aus verschiedenen Branchen hilft, ihre KI- und Cloud-Einführung zu beschleunigen.

Dmitrij Bespalow ist Senior Applied Scientist im Amazon Machine Learning Solutions Lab, wo er AWS-Kunden aus verschiedenen Branchen hilft, ihre KI- und Cloud-Einführung zu beschleunigen.

Ryan Marke ist Applied Scientist im Amazon Machine Learning Solutions Lab. Er verfügt über besondere Erfahrung in der Anwendung von maschinellem Lernen auf Probleme im Gesundheitswesen und in den Biowissenschaften. In seiner Freizeit liest er gerne Geschichte und Science-Fiction.

Ryan Marke ist Applied Scientist im Amazon Machine Learning Solutions Lab. Er verfügt über besondere Erfahrung in der Anwendung von maschinellem Lernen auf Probleme im Gesundheitswesen und in den Biowissenschaften. In seiner Freizeit liest er gerne Geschichte und Science-Fiction.

Yanjun Qi ist Senior Applied Science Manager im Amazon Machine Learning Solution Lab. Sie ist innovativ und wendet maschinelles Lernen an, um AWS-Kunden dabei zu helfen, ihre KI- und Cloud-Einführung zu beschleunigen.

Yanjun Qi ist Senior Applied Science Manager im Amazon Machine Learning Solution Lab. Sie ist innovativ und wendet maschinelles Lernen an, um AWS-Kunden dabei zu helfen, ihre KI- und Cloud-Einführung zu beschleunigen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/build-a-gnn-based-real-time-fraud-detection-solution-using-the-deep-graph-library-without-using-external-graph-storage/

- 000

- 1

- 10

- 100

- 11

- 2%

- 28

- 7

- 95%

- a

- Fähig

- Über Uns

- Missbrauch

- beschleunigen

- Zugang

- Zugriff

- Konto

- Genauigkeit

- Erreicht

- Erreichen

- über

- Aktivitäten

- hinzugefügt

- Zusatz

- Zusätzliche

- Adressen

- Adoption

- Vorteil

- AI

- Algorithmus

- Alle

- erlaubt

- Alternative

- Amazon

- Amazon Machine Learning

- Amazon Neptun

- Amazon Sage Maker

- unter

- und

- Anwendung

- Anwendungen

- angewandt

- Anwendung

- ca.

- Feld

- zugewiesen

- damit verbundenen

- angenommen

- Augmented

- durchschnittlich

- AWS

- basierend

- weil

- wird

- Sein

- Benchmark

- Benchmarking

- BESTE

- Besser

- zwischen

- Marke

- bauen

- baut

- erbaut

- Geschäft

- tragen

- Fälle

- Chance

- Übernehmen

- Klasse

- Einstufung

- Cloud

- Cloud-Einführung

- Code

- Kolonne

- Spalten

- kombiniert

- Vereinigung

- vergleichen

- Vergleich

- Komplexität

- Berechnen

- Leiten

- Vertrauen

- Konfiguration

- Schichtannahme

- BESTÄTIGT

- Sie

- konstante

- Bau

- Baugewerbe

- enthält

- Kontrast

- Beitrag

- Steuerung

- Dazugehörigen

- Kosten

- erstellen

- schafft

- wichtig

- Kunden

- technische Daten

- Datenbase

- Datensätze

- Entscheidung

- tief

- Standard

- definiert

- Abhängigkeit

- einsetzen

- Bereitstellen

- Einsatz

- Details

- Entdeckung

- Gerät

- DGL

- DID

- anders

- diskutieren

- Tut nicht

- Drop

- im

- jeder

- E-EINKAUF

- bewirken

- effektiv

- ermöglicht

- ermöglichen

- ermutigen

- Endpunkt

- sorgt

- Ganz

- Entitäten

- Einheit

- Umgebungen

- insbesondere

- bewerten

- Bewerten

- Auswerten

- Sogar

- Jedes

- Beispiel

- Beispiele

- erwartet

- teuer

- ERFAHRUNGEN

- Experiment

- Erklären

- ERKUNDEN

- erweitern

- extern

- Extrakt

- Eigenschaften

- Fiktion

- Endlich

- Revolution

- Finanzdienstleistungen

- Vorname

- Folgende

- folgt

- Format

- Betrug

- Betrugserkennung

- betrügerisch

- Frei

- für

- voller

- voll

- Gaming

- erzeugen

- bekommen

- GitHub

- gut

- Graph

- groß

- hart

- Gesundheitswesen

- Hilfe

- hilft

- höher

- Geschichte

- Ultraschall

- Hilfe

- aber

- HTML

- HTTPS

- identifizieren

- Identitätsschutz

- illegal

- implementieren

- Implementierung

- Umsetzung

- implementiert

- importieren

- wichtig

- zu unterstützen,

- in

- In anderen

- inklusive

- Dazu gehören

- Einschließlich

- zunehmend

- Branchen

- Information

- Varianten des Eingangssignals:

- Instanz

- eingeführt

- Stellt vor

- IP

- IP-Adressen

- IT

- join

- Wesentliche

- bekannt

- Labor

- Label

- Etiketten

- grosse

- größer

- Latency

- führen

- LERNEN

- lernen

- Bibliothek

- Lebensdauer

- Biowissenschaften

- Lebenszyklus

- wahrscheinlich

- Belastung

- Standorte

- suchen

- Loyalty

- Treueprogramm

- Maschine

- Maschinelles Lernen

- Manager

- Spiel

- sinnvoll

- Medien

- Memory

- Methoden

- ML

- Model

- Modell

- für

- Modi

- mehr

- notwendig,

- Neptun

- Netzwerk

- Netzwerke

- Neuronale Netze

- Neu

- weiter

- Knoten

- Fiber Node

- Anzahl

- Zahlen

- beobachten

- beschaffen

- EINEM

- Online

- Online-Zahlungen

- Betrieb

- Einkauf & Prozesse

- optimal

- Orchesterbearbeitung

- Andere

- outperforming

- besitzen

- Pandas

- Parameter

- Parameter

- Bestanden

- Zahlungen

- Prozentsatz

- Ausführen

- Leistung

- Durchführung

- Phase

- Telefon

- physikalisch

- Plato

- Datenintelligenz von Plato

- PlatoData

- Beliebt

- Post

- vorhersagen

- Vorhersage

- Prognose

- Gegenwart

- Geschenke

- verhindern

- früher

- Vor

- Aufgabenstellung:

- Probleme

- Prozessdefinierung

- produziert

- Produktion

- Programm

- Versprechen

- die

- vorausgesetzt

- Pytorch

- Qi

- Roh

- erreichen

- Lesebrillen

- echt

- realen Welt

- Echtzeit

- Rekord

- Aufzeichnungen

- Veteran

- reduziert

- Reduzierung

- bezeichnet

- bezogene

- Verhältnis

- Beziehungen

- freigegeben

- Entfernen

- Berichtet

- vertreten

- Darstellung

- erfordern

- falls angefordert

- Anforderung

- diejenigen

- REST

- was zu

- Die Ergebnisse

- Rückkehr

- Führen Sie

- Lutz

- sagemaker

- SageMaker-Inferenz

- gleich

- Speichern

- Szenario

- Wissenschaft

- Science-Fiction

- WISSENSCHAFTEN

- Wissenschaftler

- Skripte

- Zweite

- Sekunden

- Senior

- Lösungen

- kompensieren

- Einstellung

- Einstellungen

- Setup

- mehrere

- Teilen

- gezeigt

- Konzerte

- signifikant

- bedeutend

- Single

- Größe

- Größen

- klein

- kleinere

- So

- Social Media

- Social Media

- Lösung

- Lösungen

- einige

- spezifisch

- Geschwindigkeit

- gespalten

- Spagat

- Schritt

- Shritte

- Einstellung

- Lagerung

- Strategien

- Struktur

- Studie

- Subgraph

- Untergraphen

- so

- Anzug

- geeignet

- Support

- misstrauisch

- Tabelle

- Nehmen

- Übernahme

- nimmt

- Target

- Aufgabe

- und Aufgaben

- Vorlage

- AGB

- Test

- Testen

- Das

- Der Graph

- ihr

- damit

- deswegen

- Durch

- Durchsatz

- Zeit

- Zeitstempel

- zeitliche Koordinierung

- zu

- auch

- Thema

- Gesamt

- Training

- trainiert

- Ausbildung

- Transaktion

- Transaktionen

- Bearbeitung

- Bäume

- Versuch

- Studien

- was immer dies auch sein sollte.

- Typen

- typisch

- us

- -

- Nutzer

- gewöhnlich

- validiert

- Wert

- Werte

- welche

- während

- Wi-fi

- werden wir

- ohne

- Worte

- wert

- würde

- Du

- Ihr

- Zephyrnet