Die Keime eines Paradigmenwechsels beim maschinellen Lernen (ML) bestehen schon seit Jahrzehnten, aber mit der sofortigen Verfügbarkeit praktisch unbegrenzter Rechenkapazität, einer massiven Verbreitung von Daten und der schnellen Weiterentwicklung von ML-Technologien übernehmen und nutzen Kunden aus allen Branchen ML schnell Technologien zur Transformation ihrer Unternehmen.

Gerade erst haben generative KI-Anwendungen die Aufmerksamkeit und Fantasie aller erregt. Wir befinden uns wirklich an einem spannenden Wendepunkt in der weit verbreiteten Einführung von ML und wir glauben, dass jedes Kundenerlebnis und jede Anwendung durch generative KI neu erfunden wird.

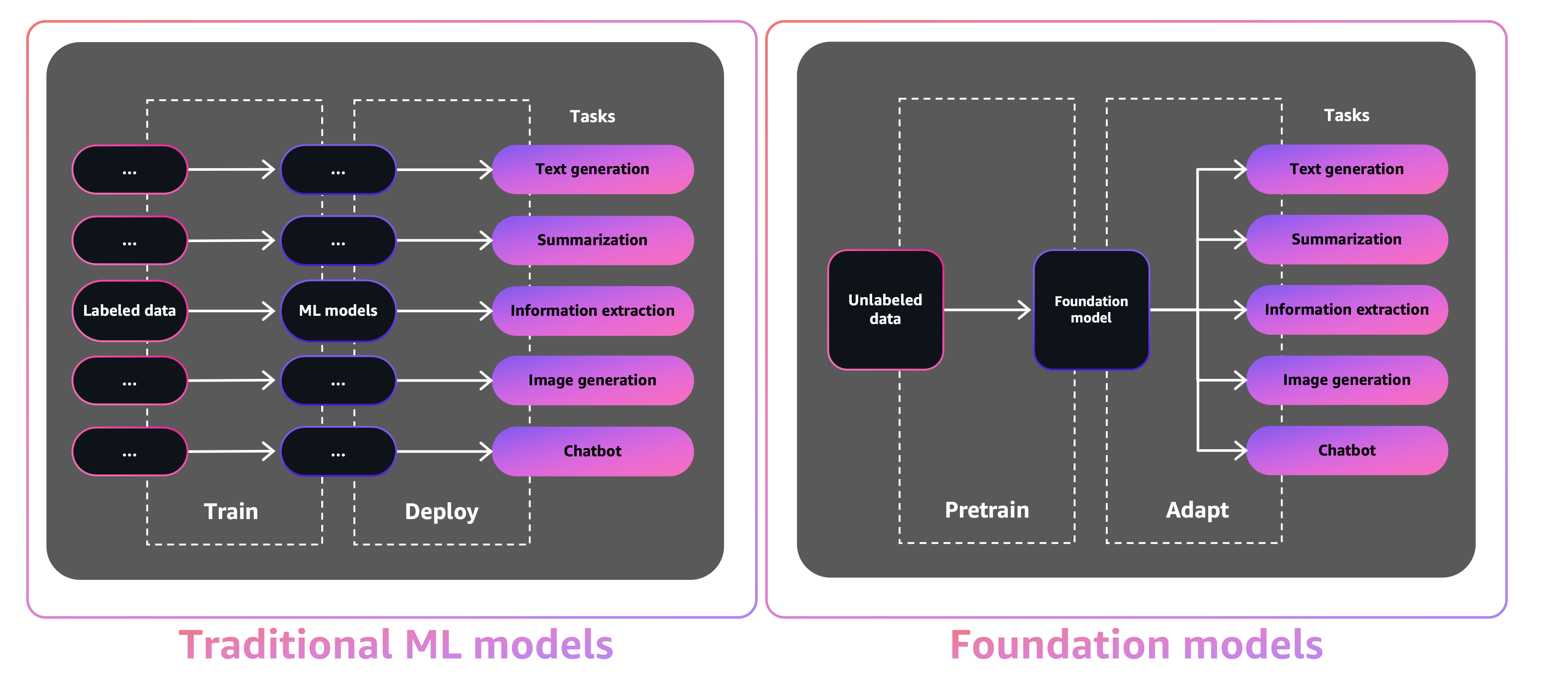

Generative KI ist eine Art von KI, die neue Inhalte und Ideen erstellen kann, darunter Gespräche, Geschichten, Bilder, Videos und Musik. Wie jede KI basiert auch die generative KI auf ML-Modellen – sehr großen Modellen, die auf riesigen Datenkorpora vorab trainiert werden und allgemein als Basismodelle (FMs) bezeichnet werden.

Die Größe und der allgemeine Zweck von FMs unterscheiden sie von herkömmlichen ML-Modellen, die typischerweise bestimmte Aufgaben ausführen, wie z. B. die Analyse von Texten auf Stimmungen, die Klassifizierung von Bildern und die Prognose von Trends.

Bei herkömmlichen ML-Modellen müssen Sie zur Erfüllung jeder spezifischen Aufgabe gekennzeichnete Daten sammeln, ein Modell trainieren und dieses Modell bereitstellen. Anstatt beschriftete Daten für jedes Modell zu sammeln und mehrere Modelle zu trainieren, können Sie mit Basismodellen dasselbe vorab trainierte FM verwenden, um verschiedene Aufgaben anzupassen. Sie können FMs auch so anpassen, dass sie domänenspezifische Funktionen ausführen, die sich von Ihrem Unternehmen unterscheiden, und dabei nur einen kleinen Bruchteil der Daten und Rechenleistung nutzen, die zum Trainieren eines Modells von Grund auf erforderlich sind.

Generative KI hat das Potenzial, viele Branchen zu revolutionieren, indem sie die Art und Weise, wie Inhalte erstellt und konsumiert werden, revolutioniert. Die Produktion von Originalinhalten, die Codegenerierung, die Verbesserung des Kundenservice und die Zusammenfassung von Dokumenten sind typische Anwendungsfälle generativer KI.

Amazon SageMaker-JumpStart bietet vorab trainierte Open-Source-Modelle für eine Vielzahl von Problemtypen, um Ihnen den Einstieg in ML zu erleichtern. Sie können diese Modelle vor der Bereitstellung schrittweise trainieren und optimieren. JumpStart bietet außerdem Lösungsvorlagen, die eine Infrastruktur für gängige Anwendungsfälle einrichten, sowie ausführbare Beispiel-Notebooks für ML mit Amazon Sage Maker.

Mit über 600 verfügbaren und täglich wachsenden vorab trainierten Modellen ermöglicht JumpStart Entwicklern die schnelle und einfache Integration modernster ML-Techniken in ihre Produktionsabläufe. Sie können über die JumpStart-Landingpage in auf die vorab trainierten Modelle, Lösungsvorlagen und Beispiele zugreifen Amazon SageMaker-Studio. Sie können auch mit dem SageMaker Python SDK auf JumpStart-Modelle zugreifen. Informationen zur programmgesteuerten Verwendung von JumpStart-Modellen finden Sie unter Verwenden Sie SageMaker JumpStart-Algorithmen mit vorab trainierten Modellen.

Im April 2023 stellte AWS vor Amazonas Grundgestein, das eine Möglichkeit bietet, generative KI-gestützte Apps über vorab trainierte Modelle von Start-ups zu erstellen, darunter AI21-Labors, Anthropisch und Stabilität KI. Amazon Bedrock bietet auch Zugriff auf Titan-Foundation-Modelle, eine von AWS intern geschulte Modellfamilie. Mit der serverlosen Erfahrung von Amazon Bedrock können Sie ganz einfach das richtige Modell für Ihre Anforderungen finden, schnell loslegen, FMs privat mit Ihren eigenen Daten anpassen und sie mithilfe der Ihnen vertrauten AWS-Tools und -Funktionen einfach in Ihre Anwendungen integrieren und bereitstellen mit (einschließlich Integrationen mit SageMaker ML-Funktionen wie Amazon SageMaker-Experimente um verschiedene Modelle zu testen und Amazon SageMaker-Pipelines um Ihre FMs im großen Maßstab zu verwalten), ohne dass Sie eine Infrastruktur verwalten müssen.

In diesem Beitrag zeigen wir, wie Sie bild- und textgenerative KI-Modelle von JumpStart mithilfe von bereitstellen AWS Cloud-Entwicklungskit (AWS CDK). Das AWS CDK ist ein Open-Source-Softwareentwicklungs-Framework zum Definieren Ihrer Cloud-Anwendungsressourcen mithilfe bekannter Programmiersprachen wie Python.

Wir verwenden das Stable Diffusion-Modell für die Bilderzeugung und das FLAN-T5-XL-Modell für Verstehen natürlicher Sprache (NLU) und Textgenerierung aus Gesicht umarmen in JumpStart.

Lösungsüberblick

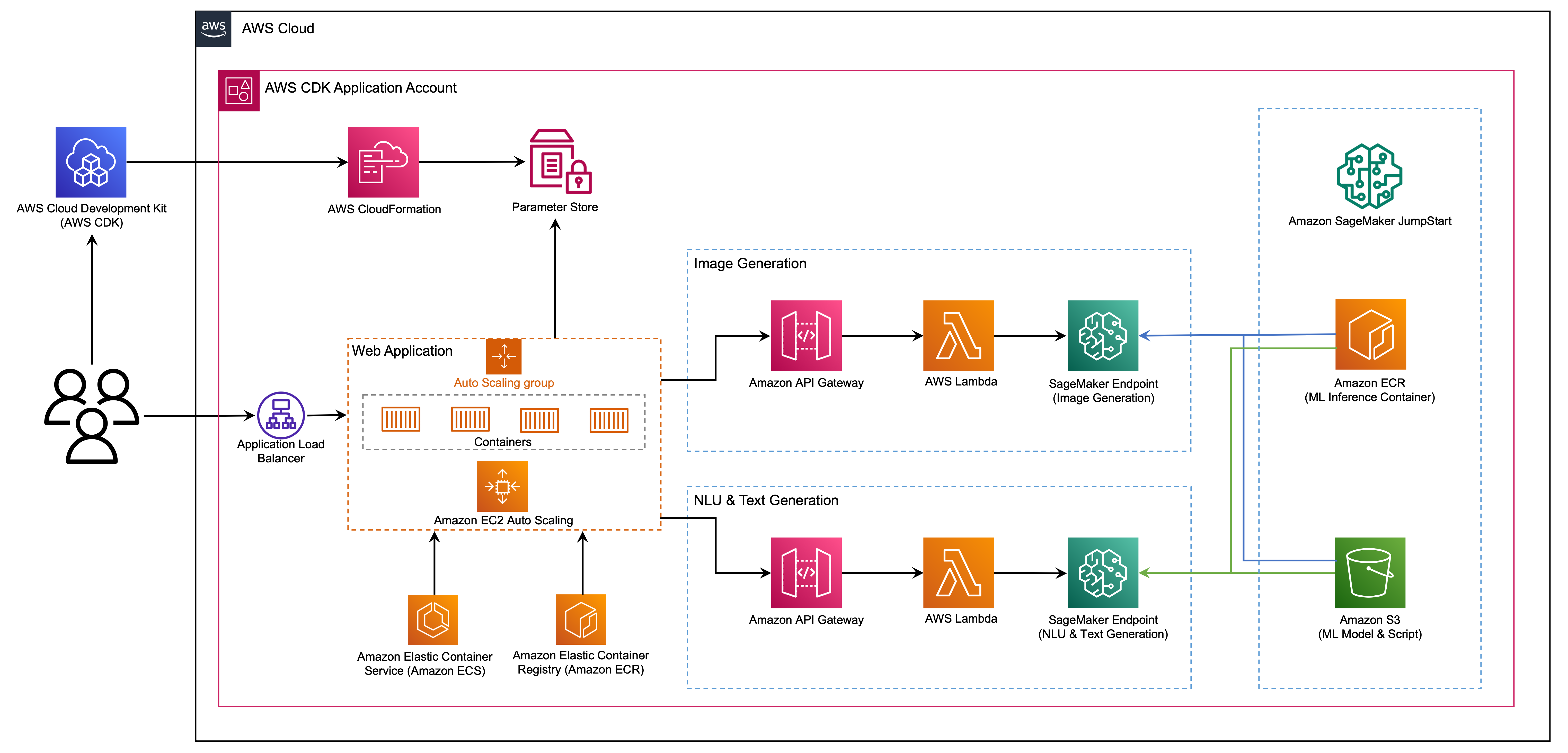

Die Webanwendung ist darauf aufgebaut Stromlit, eine Open-Source-Python-Bibliothek, die es einfach macht, schöne, benutzerdefinierte Web-Apps für ML und Data Science zu erstellen und zu teilen. Wir hosten die Webanwendung mit Amazon Elastic Container-Service (Amazon ECS) mit AWS Fargate Der Zugriff erfolgt über einen Application Load Balancer. Fargate ist eine Technologie, die Sie mit Amazon ECS ausführen können Behälter ohne Server, Cluster oder virtuelle Maschinen verwalten zu müssen. Die generativen KI-Modellendpunkte werden über JumpStart-Bilder in gestartet Amazon Elastic Container-Registrierung (Amazon ECR). Modelldaten werden gespeichert Amazon Simple Storage-Service (Amazon S3) im JumpStart-Konto. Die Webanwendung interagiert mit den Modellen über Amazon API-Gateway und AWS Lambda funktioniert wie im folgenden Diagramm dargestellt.

API Gateway stellt der Webanwendung und anderen Clients eine standardmäßige RESTful-Schnittstelle bereit und schützt gleichzeitig die Lambda-Funktionen, die mit dem Modell kommunizieren. Dies vereinfacht den Clientanwendungscode, der die Modelle nutzt. Die API-Gateway-Endpunkte sind in diesem Beispiel öffentlich zugänglich, was die Möglichkeit bietet, diese Architektur zu erweitern, um andere zu implementieren API-Zugriffskontrollen und mit anderen Anwendungen integrieren.

In diesem Beitrag führen wir Sie durch die folgenden Schritte:

- Installieren Sie das AWS-Befehlszeilenschnittstelle (AWS CLI) und AWS CDK v2 auf Ihrem lokalen Computer.

- Klonen Sie die AWS CDK-Anwendung und richten Sie sie ein.

- Stellen Sie die AWS CDK-Anwendung bereit.

- Verwenden Sie das KI-Modell zur Bildgenerierung.

- Verwenden Sie das KI-Modell zur Textgenerierung.

- Sehen Sie sich die bereitgestellten Ressourcen an AWS-Managementkonsole.

Einen Überblick über den Code in diesem Projekt geben wir im Anhang am Ende dieses Beitrags.

Voraussetzungen:

Folgende Voraussetzungen müssen Sie mitbringen:

Sie können die Infrastruktur in diesem Tutorial von Ihrem lokalen Computer aus bereitstellen oder verwenden AWS Cloud9 als Ihre Bereitstellungsarbeitsstation. AWS Cloud9 ist mit AWS CLI, AWS CDK und Docker vorinstalliert. Wenn Sie sich für AWS Cloud9 entscheiden, die Umgebung schaffen von dem AWS-Konsole.

Die geschätzten Kosten für die Fertigstellung dieses Beitrags betragen 50 US-Dollar, vorausgesetzt, Sie lassen die Ressourcen 8 Stunden lang laufen. Stellen Sie sicher, dass Sie die in diesem Beitrag erstellten Ressourcen löschen, um laufende Kosten zu vermeiden.

Installieren Sie die AWS CLI und das AWS CDK auf Ihrem lokalen Computer

Wenn Sie die AWS CLI noch nicht auf Ihrem lokalen Computer haben, finden Sie weitere Informationen unter Installieren oder Aktualisieren der neuesten Version der AWS CLI und Konfigurieren der AWS CLI.

Installieren Sie das AWS CDK Toolkit global mit dem folgenden Knotenpaket-Manager-Befehl:

Führen Sie den folgenden Befehl aus, um die korrekte Installation zu überprüfen und die Versionsnummer des AWS CDK auszudrucken:

Stellen Sie sicher, dass Docker auf Ihrem lokalen Computer installiert ist. Geben Sie den folgenden Befehl ein, um die Version zu überprüfen:

Klonen Sie die AWS CDK-Anwendung und richten Sie sie ein

Klonen Sie auf Ihrem lokalen Computer die AWS CDK-Anwendung mit dem folgenden Befehl:

Navigieren Sie zum Projektordner:

Bevor wir die Anwendung bereitstellen, überprüfen wir die Verzeichnisstruktur:

Das stack Der Ordner enthält den Code für jeden Stack in der AWS CDK-Anwendung. Der code Der Ordner enthält den Code für die Lambda-Funktionen. Das Repository enthält auch die Webanwendung, die sich im Ordner befindet web-app.

Das cdk.json Die Datei teilt dem AWS CDK Toolkit mit, wie Ihre Anwendung ausgeführt werden soll.

Diese Anwendung wurde im getestet us-east-1 Region, aber es sollte in jeder Region funktionieren, die über die erforderlichen Dienste und Inferenzinstanztypen verfügt ml.g4dn.4xlarge spezifiziert in app.py.

Richten Sie eine virtuelle Umgebung ein

Dieses Projekt ist wie ein Standard-Python-Projekt eingerichtet. Erstellen Sie eine virtuelle Python-Umgebung mit dem folgenden Code:

Verwenden Sie den folgenden Befehl, um die virtuelle Umgebung zu aktivieren:

Wenn Sie eine Windows-Plattform verwenden, aktivieren Sie die virtuelle Umgebung wie folgt:

Nachdem die virtuelle Umgebung aktiviert wurde, aktualisieren Sie pip auf die neueste Version:

Installieren Sie die erforderlichen Abhängigkeiten:

Bevor Sie eine AWS CDK-Anwendung bereitstellen, müssen Sie einen Bereich in Ihrem Konto und der Region, in der Sie die Bereitstellung durchführen, booten. Um in Ihrer Standardregion zu booten, geben Sie den folgenden Befehl ein:

Wenn Sie die Bereitstellung in einem bestimmten Konto und einer bestimmten Region durchführen möchten, geben Sie den folgenden Befehl ein:

Weitere Informationen zu diesem Setup finden Sie unter Erste Schritte mit dem AWS CDK.

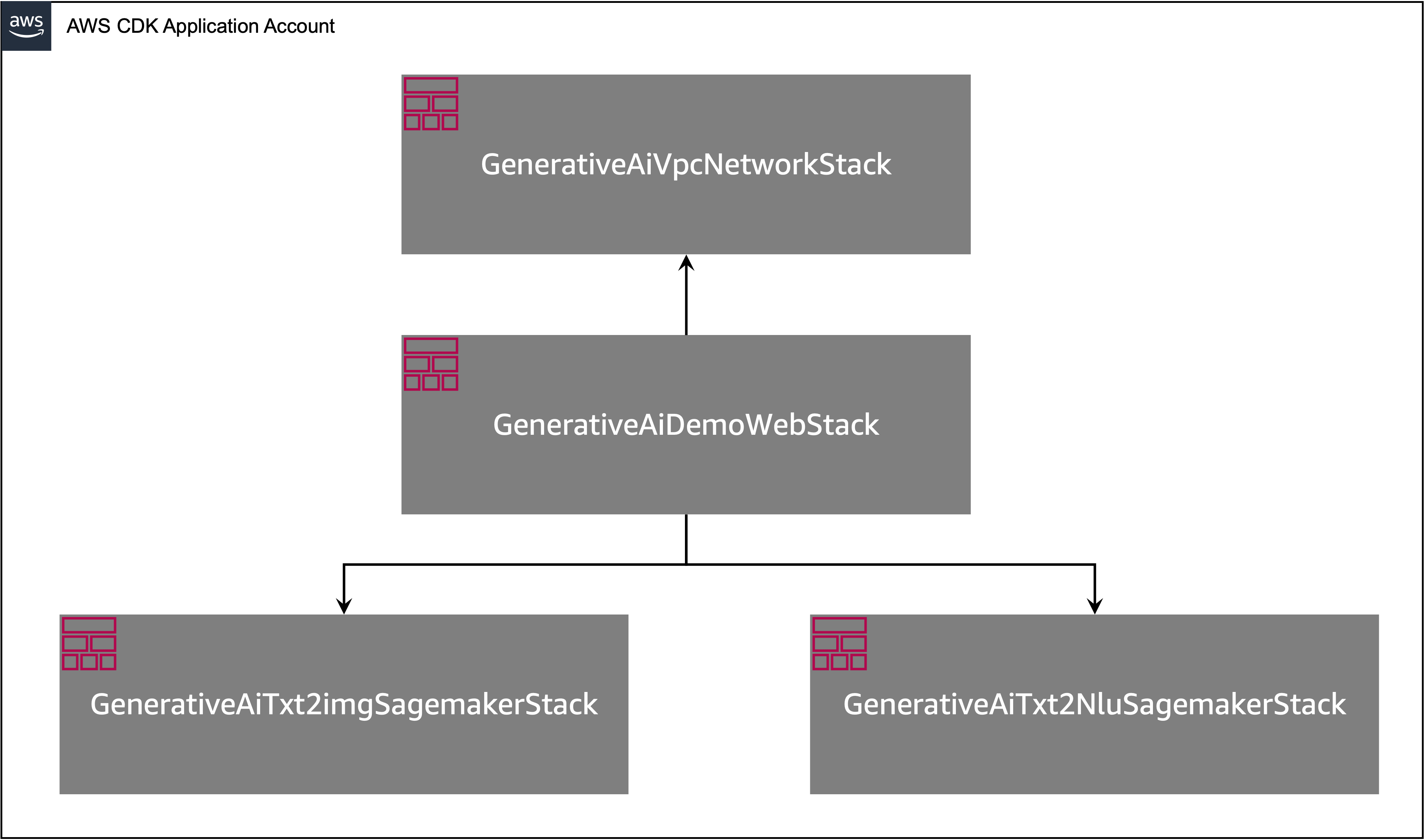

Struktur des AWS CDK-Anwendungsstapels

Die AWS CDK-Anwendung enthält mehrere Stacks, wie im folgenden Diagramm dargestellt.

Sie können die Stacks in Ihrer AWS CDK-Anwendung mit dem folgenden Befehl auflisten:

Im Folgenden finden Sie weitere nützliche AWS CDK-Befehle:

- cdk ls – Listet alle Stapel in der App auf

- CDK-Synth – Gibt das synthetisierte aus AWS CloudFormation Vorlage

- cdk bereitstellen – Stellt diesen Stack für Ihr Standard-AWS-Konto und Ihre Standardregion bereit

- CDK-Diff – Vergleicht den bereitgestellten Stack mit dem aktuellen Status

- CDK-Dokumente – Öffnet die AWS CDK-Dokumentation

Im nächsten Abschnitt erfahren Sie, wie Sie die AWS CDK-Anwendung bereitstellen.

Stellen Sie die AWS CDK-Anwendung bereit

Die AWS CDK-Anwendung wird basierend auf Ihrer Workstation-Konfiguration in der Standardregion bereitgestellt. Wenn Sie die Bereitstellung in einer bestimmten Region erzwingen möchten, legen Sie Ihre fest AWS_DEFAULT_REGION Umgebungsvariable entsprechend anpassen.

An diesem Punkt können Sie die AWS CDK-Anwendung bereitstellen. Zuerst starten Sie den VPC-Netzwerk-Stack:

Wenn Sie dazu aufgefordert werden, geben Sie ein y um mit der Bereitstellung fortzufahren. Sie sollten eine Liste der AWS-Ressourcen sehen, die im Stack bereitgestellt werden. Dieser Schritt dauert etwa 3 Minuten.

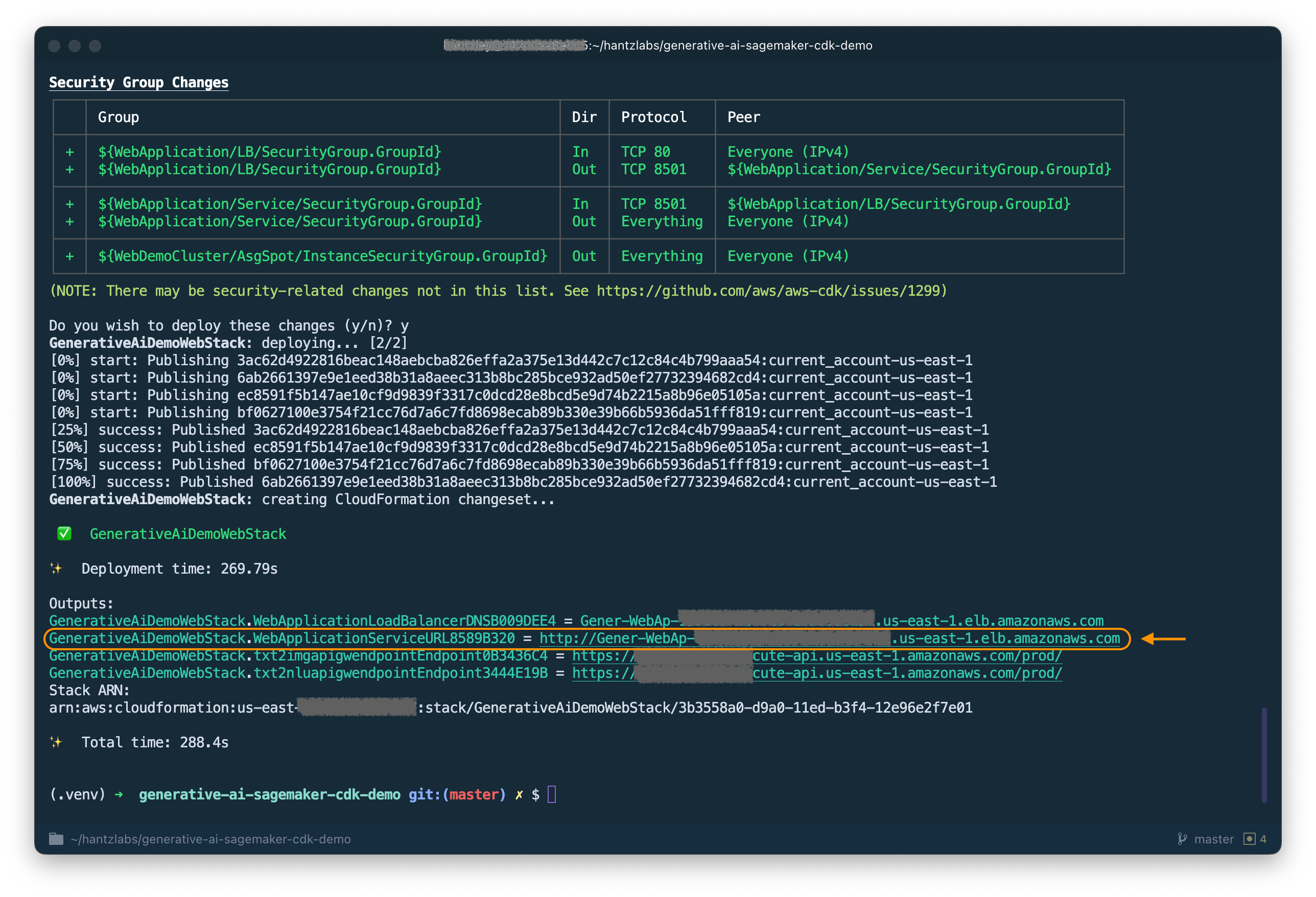

Anschließend starten Sie den Webanwendungsstapel:

Nach der Analyse des Stacks zeigt das AWS CDK die Ressourcenliste im Stack an. Geben Sie y ein, um mit der Bereitstellung fortzufahren. Dieser Schritt dauert etwa 5 Minuten.

Notieren Sie die WebApplicationServiceURL aus der Ausgabe zur späteren Verwendung. Sie können es auch in der AWS CloudFormation-Konsole unter abrufen GenerativeAiDemoWebStack Stack-Ausgänge.

Starten Sie nun den Endpunktstapel für das Bildgenerierungs-KI-Modell:

Dieser Schritt dauert etwa 8 Minuten. Der Endpunkt des Bildgenerierungsmodells ist bereitgestellt, wir können ihn jetzt verwenden.

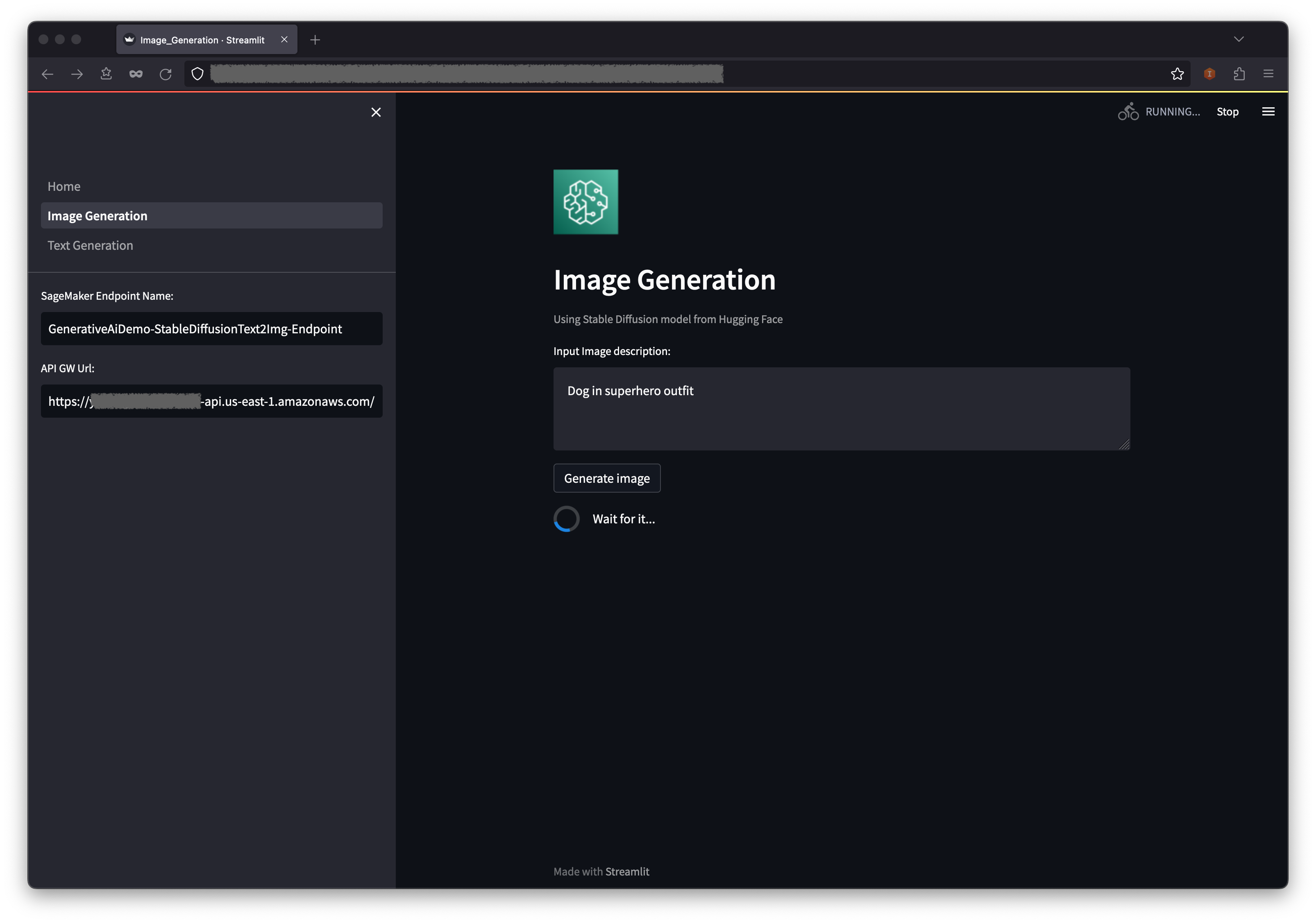

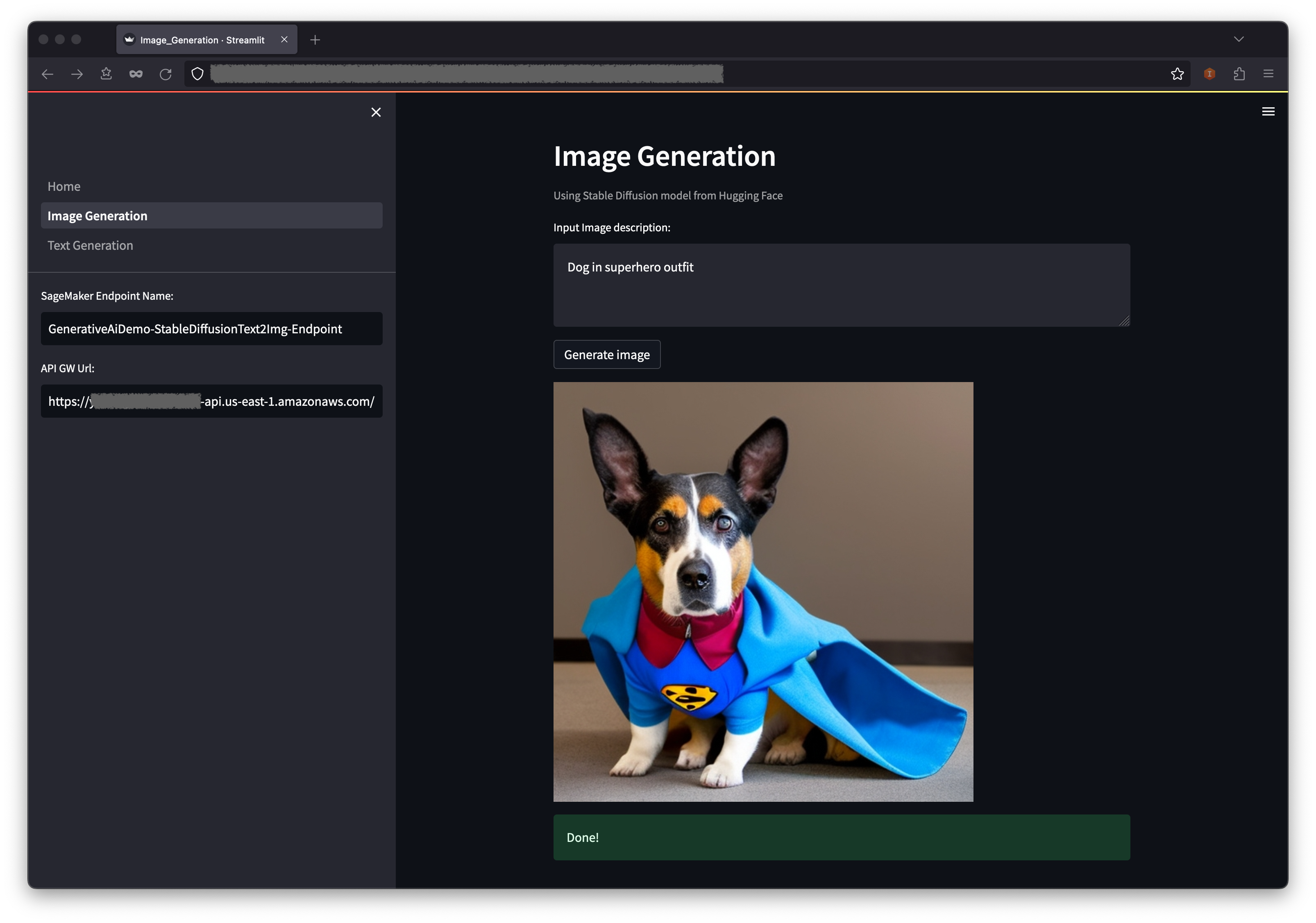

Verwenden Sie das KI-Modell zur Bildgenerierung

Das erste Beispiel zeigt, wie Stable Diffusion verwendet wird, eine leistungsstarke generative Modellierungstechnik, die die Erstellung hochwertiger Bilder aus Textaufforderungen ermöglicht.

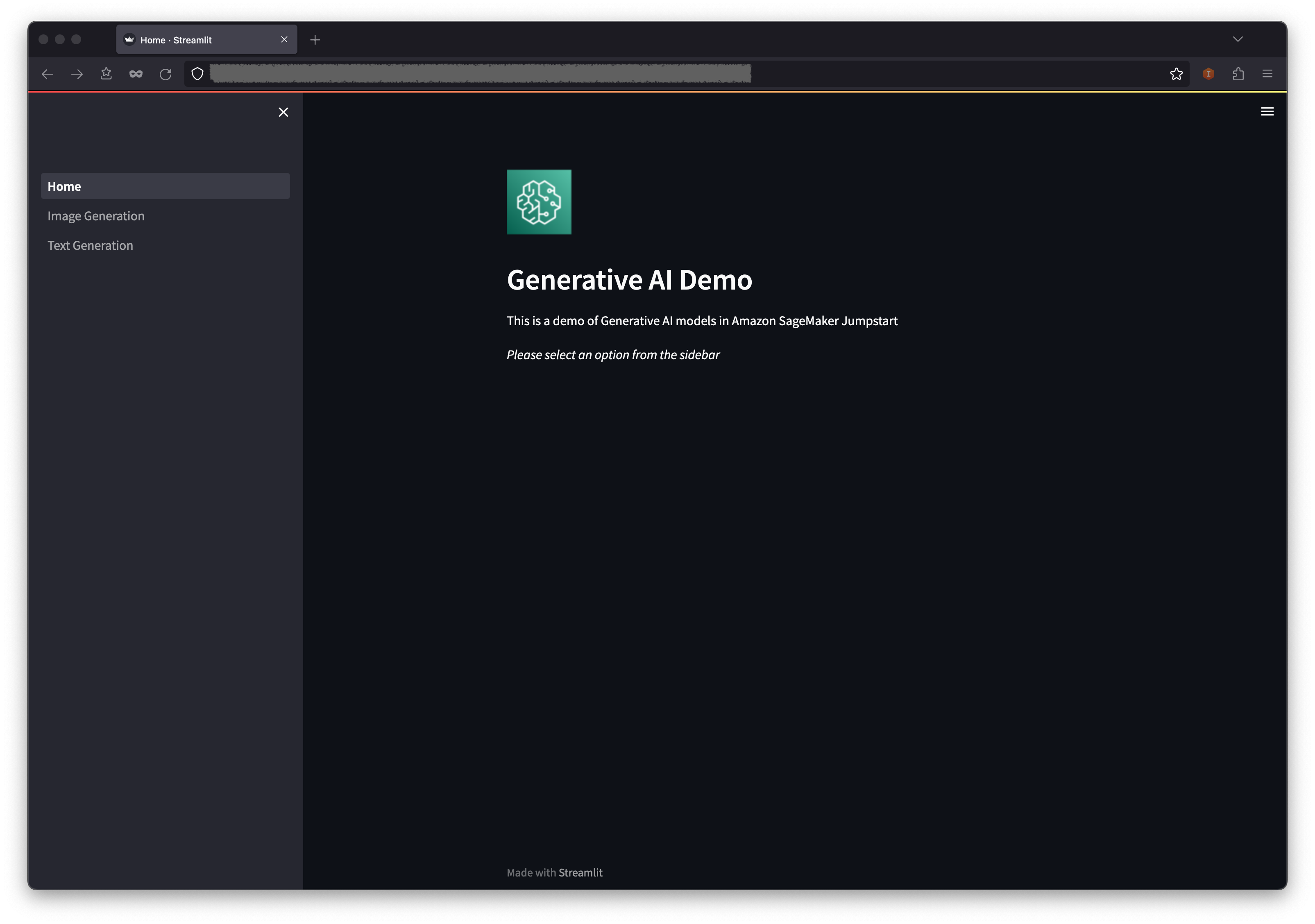

- Greifen Sie über auf die Webanwendung zu

WebApplicationServiceURLaus der Ausgabe vonGenerativeAiDemoWebStackin Ihrem Browser.

- Wählen Sie im Navigationsbereich Bilderzeugung.

- Das SageMaker-Endpunktname und API-GW-URL Die Felder werden vorab ausgefüllt, Sie können die Eingabeaufforderung für die Bildbeschreibung jedoch bei Bedarf ändern.

- Auswählen

Bild generieren.

- Die Anwendung ruft den SageMaker-Endpunkt auf. Es dauert ein paar Sekunden. Es wird ein Bild mit den Merkmalen Ihrer Bildbeschreibung angezeigt.

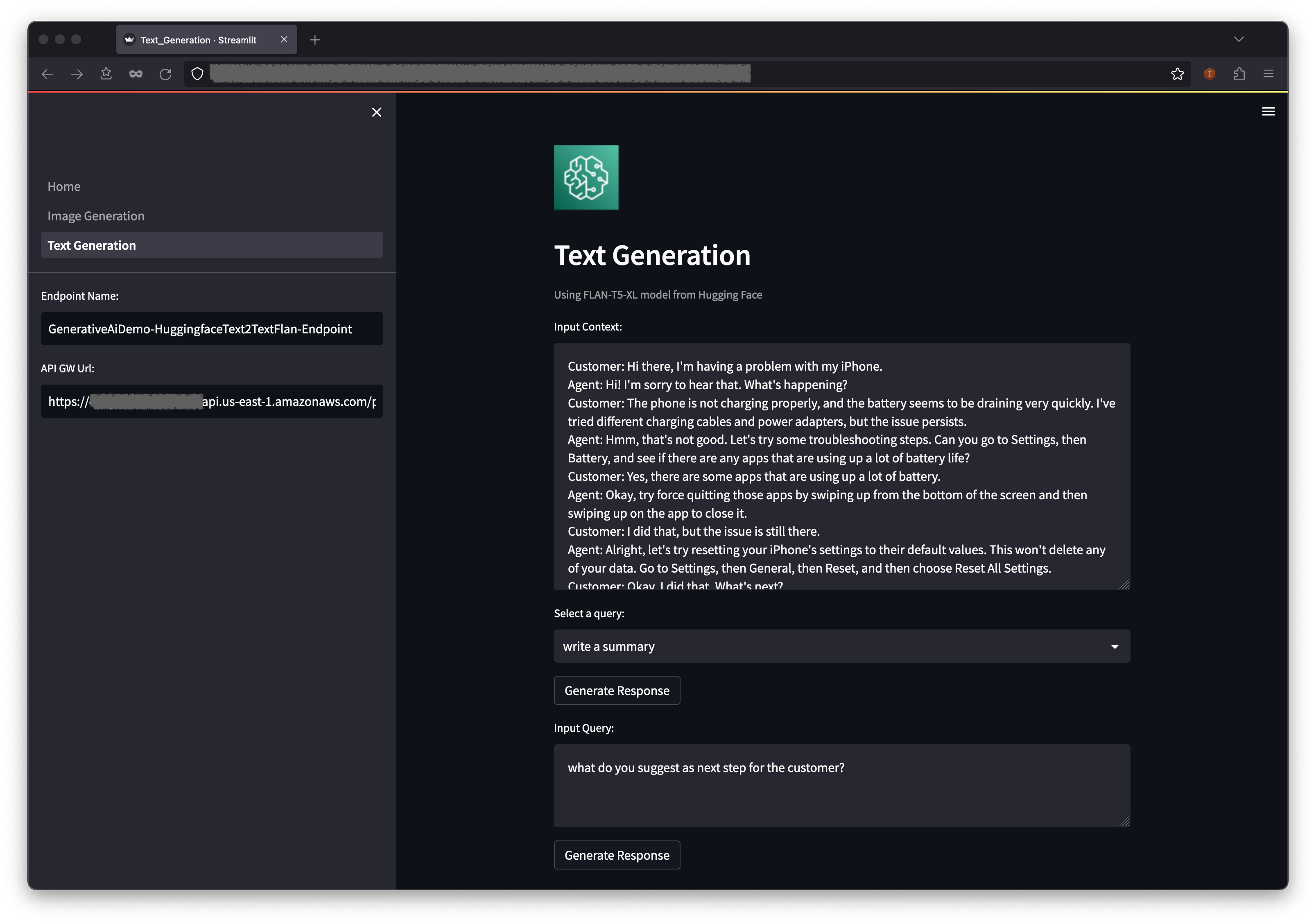

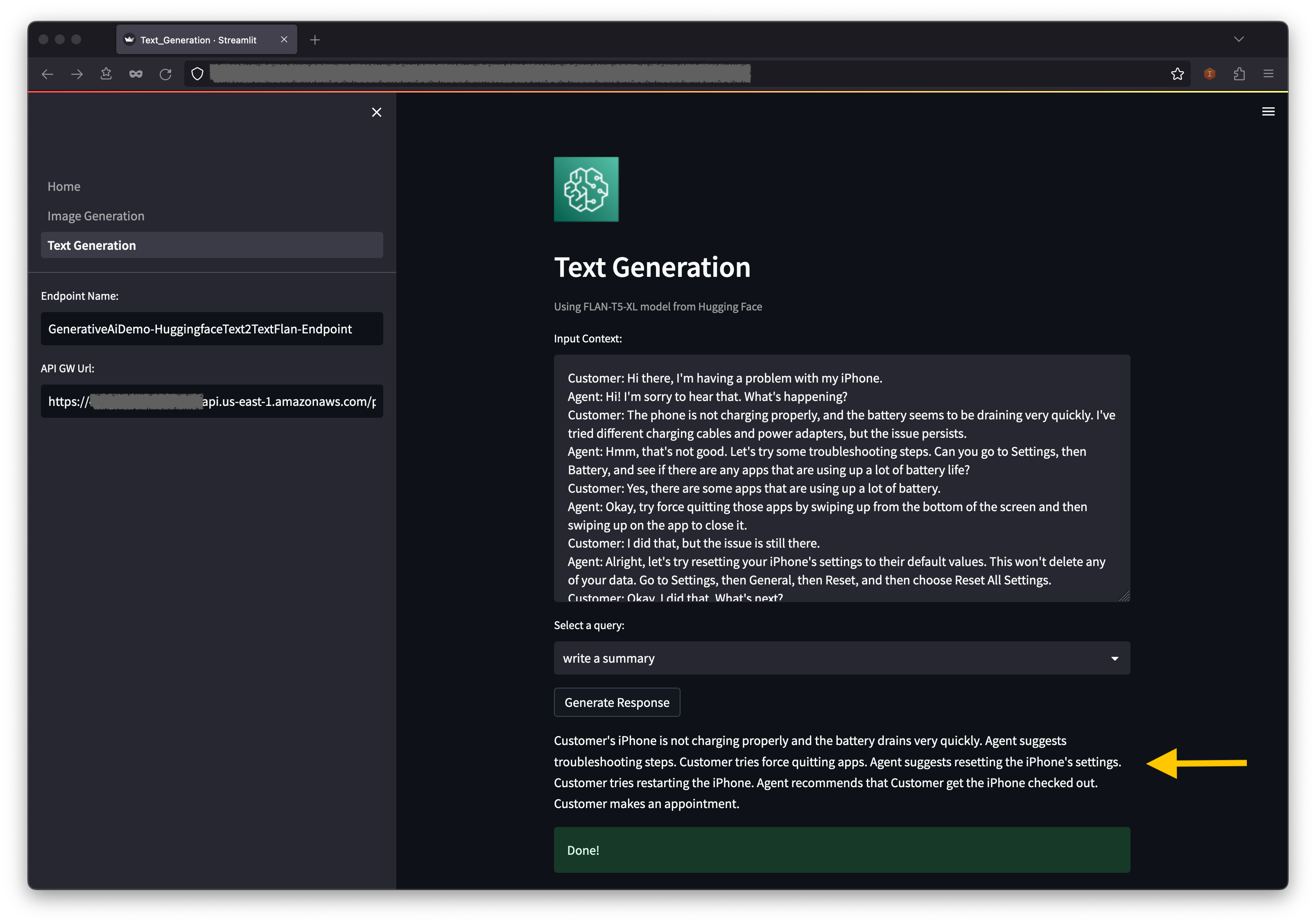

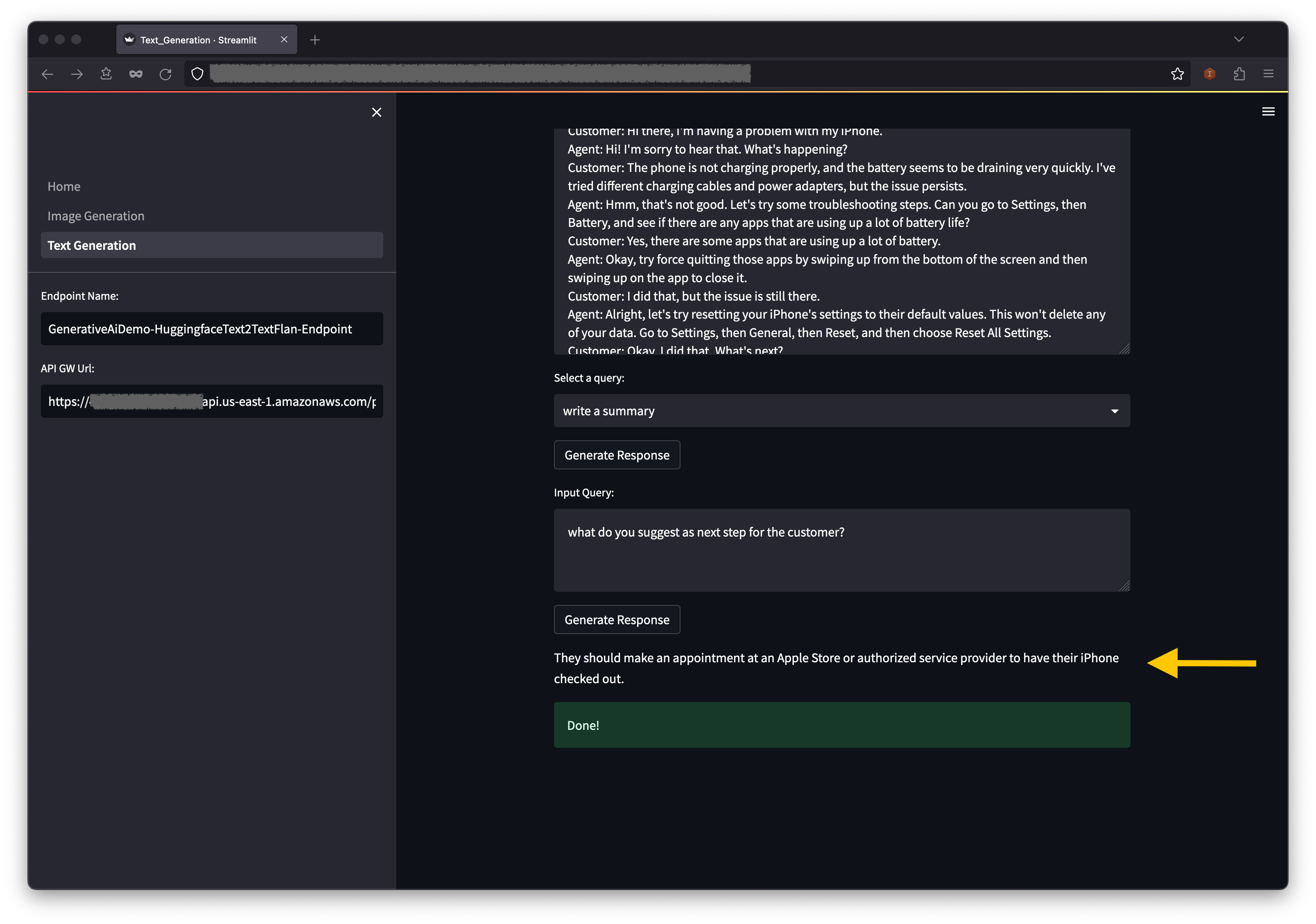

Verwenden Sie das KI-Modell zur Textgenerierung

Im zweiten Beispiel geht es um die Verwendung des FLAN-T5-XL-Modells, bei dem es sich um ein Grundlagen- oder Large-Language-Modell (LLM) handelt, um kontextbezogenes Lernen für die Textgenerierung zu erreichen und gleichzeitig ein breites Spektrum an Natural Language Understanding (NLU) und natürlicher Sprache abzudecken Aufgaben zur Sprachgenerierung (NLG).

In einigen Umgebungen ist möglicherweise die Anzahl der Endpunkte begrenzt, die Sie gleichzeitig starten können. In diesem Fall können Sie jeweils einen SageMaker-Endpunkt starten. Um einen SageMaker-Endpunkt in der AWS CDK-App zu stoppen, müssen Sie den bereitgestellten Endpunkt-Stack zerstören und bevor Sie den anderen Endpunkt-Stack starten. Um den Endpunkt des AI-Modells für die Bildgenerierung zu deaktivieren, geben Sie den folgenden Befehl ein:

Starten Sie dann den Endpunktstapel für das Textgenerierungs-KI-Modell:

Geben Sie bei den Eingabeaufforderungen y ein.

Nachdem der Endpunktstapel des Textgenerierungsmodells gestartet wurde, führen Sie die folgenden Schritte aus:

- Gehen Sie zurück zur Webanwendung und wählen Sie Textgenerierung im Navigationsbereich.

- Das Eingabekontext Das Feld ist vorab mit einem Gespräch zwischen einem Kunden und einem Agenten über ein Problem mit dem Telefon des Kunden ausgefüllt. Sie können jedoch auch einen eigenen Kontext eingeben, wenn Sie möchten.

- Unterhalb des Kontexts finden Sie im Dropdown-Menü einige vorab ausgefüllte Abfragen. Wählen Sie eine Abfrage und wählen Sie Antwort generieren.

- Sie können auch Ihre eigene Abfrage eingeben Eingabeabfrage Feld aus und wählen Sie dann Antwort generieren.

Sehen Sie sich die bereitgestellten Ressourcen auf der Konsole an

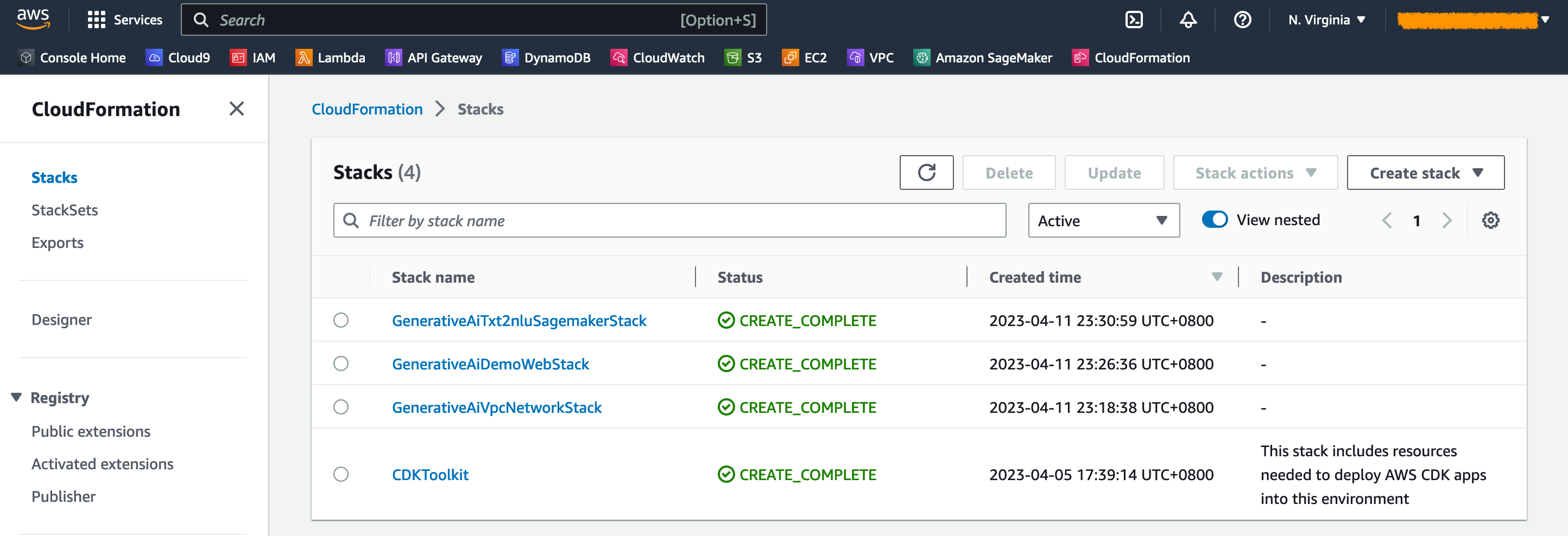

Wählen Sie in der AWS CloudFormation-Konsole aus Stacks im Navigationsbereich, um die bereitgestellten Stacks anzuzeigen.

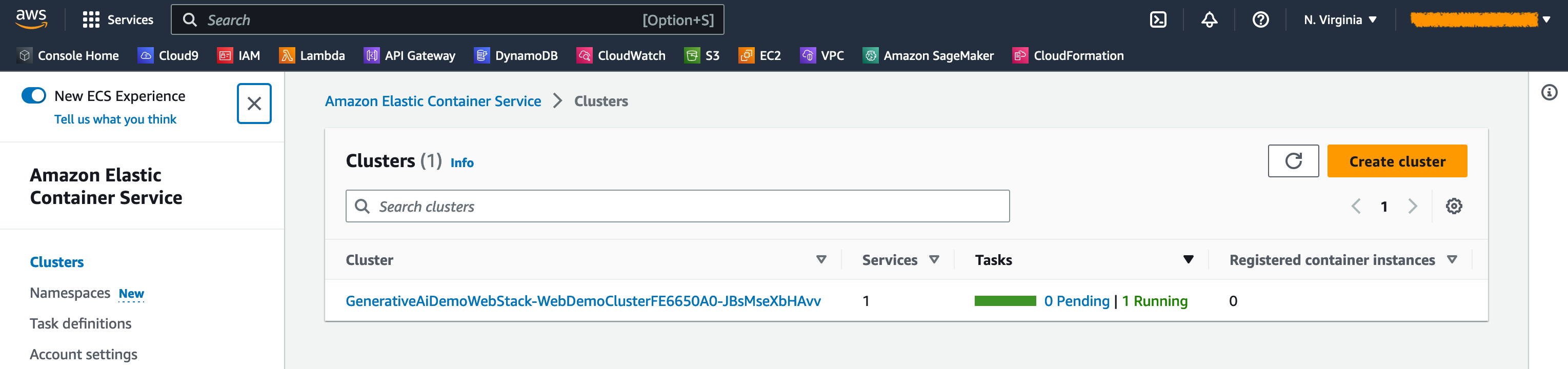

Auf der Amazon ECS-Konsole können Sie die Cluster sehen Cluster

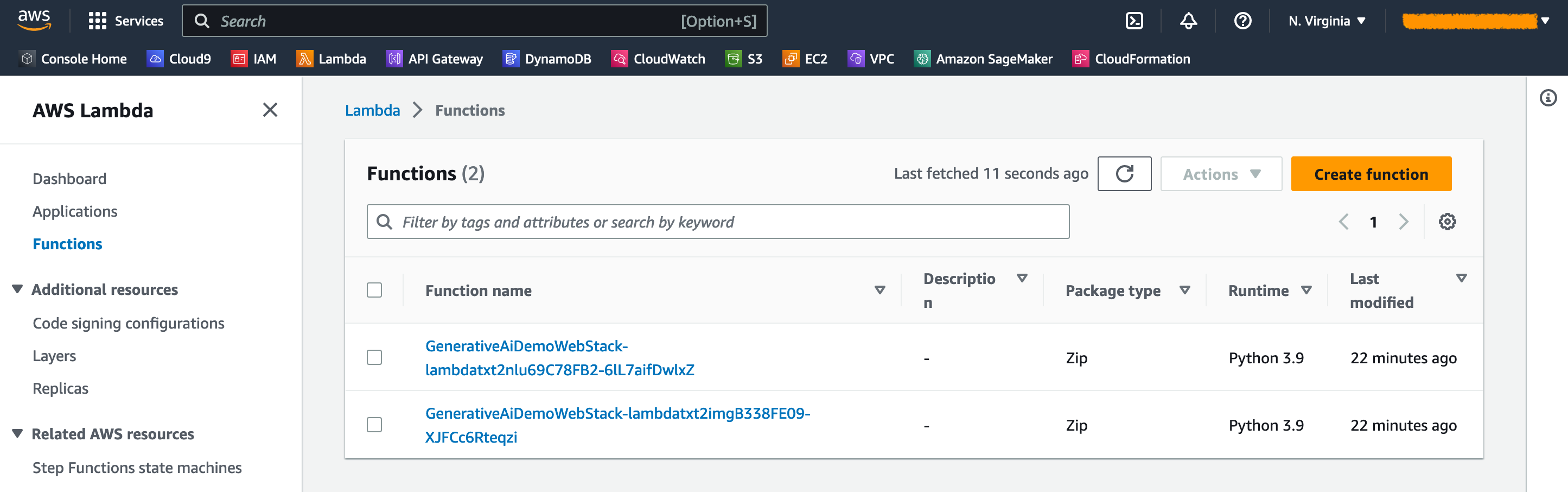

Auf der AWS Lambda-Konsole können Sie die Funktionen auf der sehen Funktionen

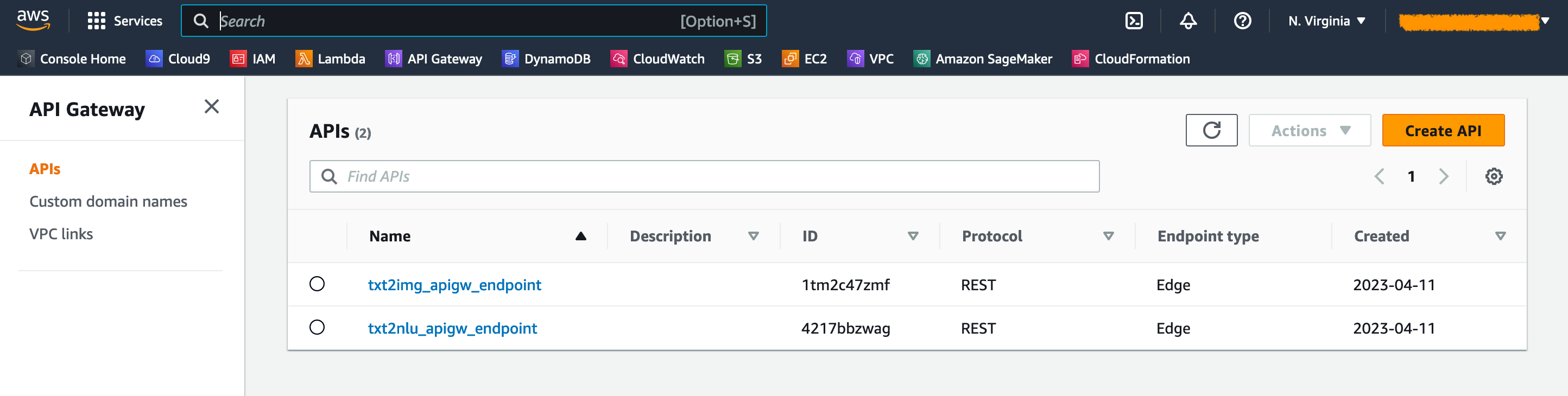

Auf der API Gateway-Konsole können Sie die API Gateway-Endpunkte sehen APIs

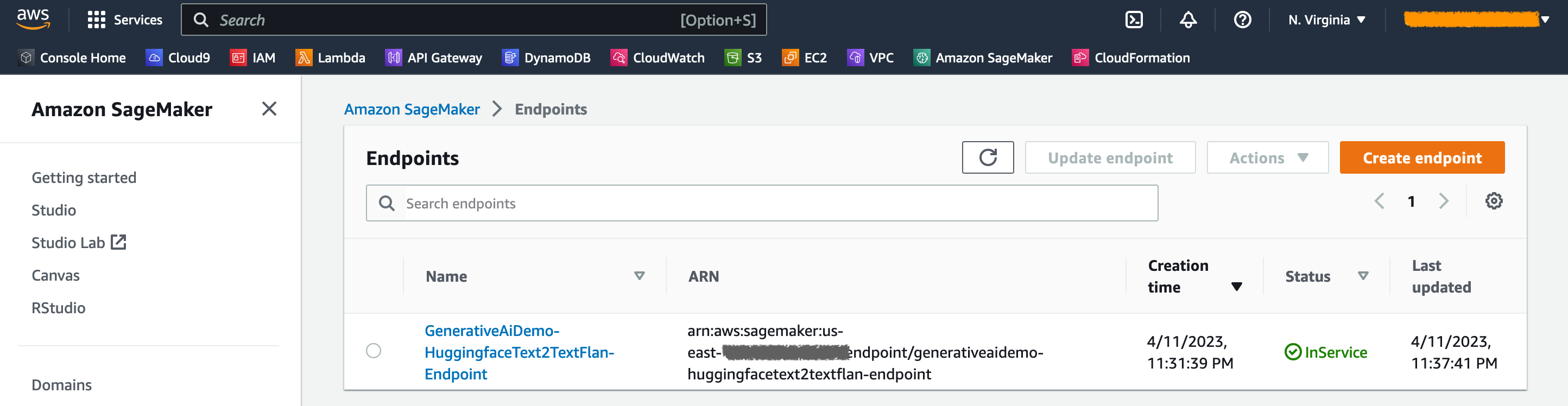

Auf der SageMaker-Konsole können Sie die bereitgestellten Modellendpunkte sehen Endpunkte

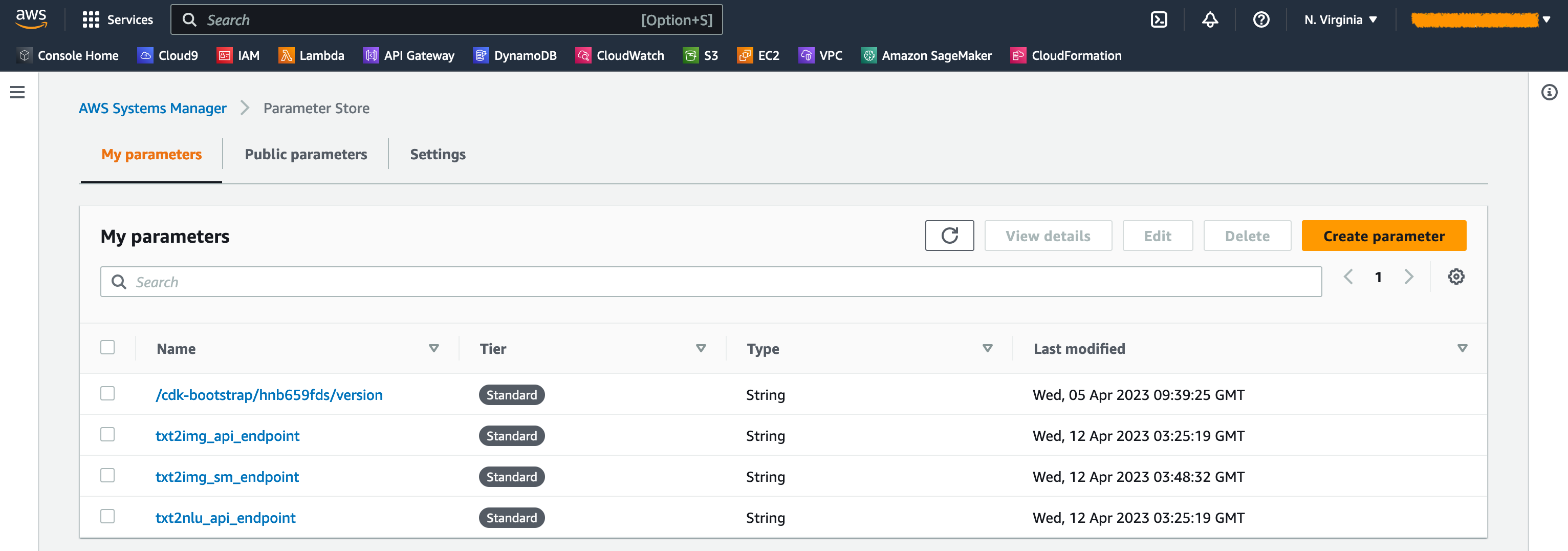

Beim Start der Stacks werden einige Parameter generiert. Diese werden im gespeichert AWS Systems Manager-Parameterspeicher. Um sie anzuzeigen, wählen Sie Parameterspeicher im Navigationsbereich auf der AWS-Systemmanager Konsole.

Aufräumen

Um unnötige Kosten zu vermeiden, bereinigen Sie die gesamte erstellte Infrastruktur mit dem folgenden Befehl auf Ihrer Workstation:

Enter y auf Aufforderung. Dieser Schritt dauert etwa 10 Minuten. Überprüfen Sie, ob alle Ressourcen auf der Konsole gelöscht sind. Löschen Sie außerdem die vom AWS CDK auf der Amazon S3-Konsole erstellten Asset-S3-Buckets sowie die Asset-Repositorys auf Amazon ECR.

Zusammenfassung

Wie in diesem Beitrag gezeigt, können Sie das AWS CDK verwenden, um generative KI-Modelle in JumpStart bereitzustellen. Wir haben ein Beispiel für die Bildgenerierung und ein Beispiel für die Textgenerierung mithilfe einer Benutzeroberfläche gezeigt, die von Streamlit, Lambda und API Gateway unterstützt wird.

Sie können jetzt Ihre generativen KI-Projekte mithilfe vorab trainierter KI-Modelle in JumpStart erstellen. Sie können dieses Projekt auch erweitern, um die Grundmodelle für Ihren Anwendungsfall zu verfeinern und den Zugriff auf API-Gateway-Endpunkte zu steuern.

Wir laden Sie ein, die Lösung zu testen und zum Projekt beizutragen GitHub. Teilen Sie Ihre Meinung zu diesem Tutorial in den Kommentaren!

Lizenzübersicht

Dieser Beispielcode wird unter einer modifizierten MIT-Lizenz zur Verfügung gestellt. Siehe die LIZENZ Weitere Informationen finden Sie in der Datei. Überprüfen Sie auch die entsprechenden Lizenzen für stabile Diffusion und flan-t5-xl Modelle auf Hugging Face.

Über die Autoren

Hantzley Tauckoor ist ein APJ Partner Solutions Architecture Leader mit Sitz in Singapur. Er verfügt über 20 Jahre Erfahrung in der IKT-Branche in verschiedenen Funktionsbereichen, darunter Lösungsarchitektur, Geschäftsentwicklung, Vertriebsstrategie, Beratung und Führung. Er leitet ein Team von Senior Solutions Architects, die es Partnern ermöglichen, gemeinsame Lösungen zu entwickeln, technische Fähigkeiten aufzubauen und sie durch die Implementierungsphase zu steuern, während Kunden ihre Anwendungen zu AWS migrieren und modernisieren.

Hantzley Tauckoor ist ein APJ Partner Solutions Architecture Leader mit Sitz in Singapur. Er verfügt über 20 Jahre Erfahrung in der IKT-Branche in verschiedenen Funktionsbereichen, darunter Lösungsarchitektur, Geschäftsentwicklung, Vertriebsstrategie, Beratung und Führung. Er leitet ein Team von Senior Solutions Architects, die es Partnern ermöglichen, gemeinsame Lösungen zu entwickeln, technische Fähigkeiten aufzubauen und sie durch die Implementierungsphase zu steuern, während Kunden ihre Anwendungen zu AWS migrieren und modernisieren.

Kwonyul Choi ist CTO bei BABITALK, einem koreanischen Beauty-Care-Plattform-Startup mit Sitz in Seoul. Vor dieser Rolle arbeitete Kownyul als Software Development Engineer bei AWS mit Schwerpunkt auf AWS CDK und Amazon SageMaker.

Kwonyul Choi ist CTO bei BABITALK, einem koreanischen Beauty-Care-Plattform-Startup mit Sitz in Seoul. Vor dieser Rolle arbeitete Kownyul als Software Development Engineer bei AWS mit Schwerpunkt auf AWS CDK und Amazon SageMaker.

Arunprasath Shankar ist Senior AI/ML Specialist Solutions Architect bei AWS und unterstützt globale Kunden dabei, ihre KI-Lösungen effektiv und effizient in der Cloud zu skalieren. In seiner Freizeit schaut Arun gerne Science-Fiction-Filme und hört klassische Musik.

Arunprasath Shankar ist Senior AI/ML Specialist Solutions Architect bei AWS und unterstützt globale Kunden dabei, ihre KI-Lösungen effektiv und effizient in der Cloud zu skalieren. In seiner Freizeit schaut Arun gerne Science-Fiction-Filme und hört klassische Musik.

Satish Upreti ist Migration Lead PSA und Security SME in der Partnerorganisation in APJ. Satish verfügt über 20 Jahre Erfahrung mit lokalen Private-Cloud- und Public-Cloud-Technologien. Seit er im August 2020 als Migrationsspezialist zu AWS kam, bietet er AWS-Partnern umfassende technische Beratung und Unterstützung bei der Planung und Umsetzung komplexer Migrationen.

Satish Upreti ist Migration Lead PSA und Security SME in der Partnerorganisation in APJ. Satish verfügt über 20 Jahre Erfahrung mit lokalen Private-Cloud- und Public-Cloud-Technologien. Seit er im August 2020 als Migrationsspezialist zu AWS kam, bietet er AWS-Partnern umfassende technische Beratung und Unterstützung bei der Planung und Umsetzung komplexer Migrationen.

Anhang: Code-Komplettlösung

In diesem Abschnitt geben wir einen Überblick über den Code in diesem Projekt.

AWS CDK-Anwendung

Die Hauptanwendung von AWS CDK ist im enthalten app.py Datei im Stammverzeichnis. Das Projekt besteht aus mehreren Stacks, daher müssen wir die Stacks importieren:

Wir definieren unsere generativen KI-Modelle und erhalten die zugehörigen URIs von SageMaker:

Die Funktion get_sagemaker_uris ruft alle Modellinformationen von JumpStart ab. Sehen script/sagemaker_uri.py.

Dann instanziieren wir die Stapel:

Der erste Stack, der gestartet wird, ist der VPC-Stack GenerativeAiVpcNetworkStack. Der Webanwendungsstapel GenerativeAiDemoWebStack ist vom VPC-Stack abhängig. Die Abhängigkeit erfolgt durch Parameterübergabe vpc=network_stack.vpc.

See app.py für den vollständigen Code.

VPC-Netzwerkstapel

Im GenerativeAiVpcNetworkStack-Stack erstellen wir eine VPC mit einem öffentlichen Subnetz und einem privaten Subnetz, die sich über zwei Availability Zones erstrecken:

See /stack/generative_ai_vpc_network_stack.py für den vollständigen Code.

Demo-Webanwendungs-Stack

Im GenerativeAiDemoWebStack-Stack starten wir Lambda-Funktionen und entsprechende API-Gateway-Endpunkte, über die die Webanwendung mit den SageMaker-Modellendpunkten interagiert. Sehen Sie sich den folgenden Codeausschnitt an:

Die Webanwendung ist containerisiert und wird mit Fargate auf Amazon ECS gehostet. Sehen Sie sich den folgenden Codeausschnitt an:

See /stack/generative_ai_demo_web_stack.py für den vollständigen Code.

Bildgenerierung des SageMaker-Modell-Endpunktstapels

Der GenerativeAiTxt2imgSagemakerStack-Stack erstellt den Bildgenerierungsmodell-Endpunkt von JumpStart und speichert den Endpunktnamen im Systems Manager Parameter Store. Dieser Parameter wird von der Webanwendung verwendet. Siehe den folgenden Code:

See /stack/generative_ai_txt2img_sagemaker_stack.py für den vollständigen Code.

NLU- und Textgenerierungs-SageMaker-Modell-Endpunktstapel

Der GenerativeAiTxt2nluSagemakerStack-Stack erstellt den NLU- und Textgenerierungsmodell-Endpunkt von JumpStart und speichert den Endpunktnamen im Systems Manager Parameter Store. Dieser Parameter wird auch von der Webanwendung verwendet. Siehe den folgenden Code:

See /stack/generative_ai_txt2nlu_sagemaker_stack.py für den vollständigen Code.

Internetanwendung

Die Webanwendung befindet sich im /web-app Verzeichnis. Es handelt sich um eine Streamlit-Anwendung, die gemäß dem Containerisiert ist Dockerfile:

Weitere Informationen zu Streamlit finden Sie unter Streamlit-Dokumentation.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoAiStream. Web3-Datenintelligenz. Wissen verstärkt. Hier zugreifen.

- Die Zukunft prägen mit Adryenn Ashley. Hier zugreifen.

- Kaufen und verkaufen Sie Anteile an PRE-IPO-Unternehmen mit PREIPO®. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/deploy-generative-ai-models-from-amazon-sagemaker-jumpstart-using-the-aws-cdk/

- :hast

- :Ist

- $UP

- 1

- 10

- 100

- 20

- 20 Jahre

- 2020

- 2023

- 7

- 8

- 9

- a

- Über Uns

- Zugang

- Zugriff

- zugänglich

- entsprechend

- Konto

- Erreichen

- über

- automatisch

- Adressierung

- Die Annahme

- Adoption

- Förderung

- Beratung

- Makler

- AI

- AI-powered

- AI / ML

- Algorithmen

- Alle

- Zulassen

- bereits

- ebenfalls

- Amazon

- Amazon API-Gateway

- Amazon Sage Maker

- Amazon SageMaker-JumpStart

- Amazon Web Services

- an

- Analyse

- und

- jedem

- Bienen

- App

- Anwendung

- Anwendungen

- Apps

- April

- Architektur

- SIND

- Bereiche

- um

- AS

- Details

- At

- Aufmerksamkeit

- AUGUST

- Verfügbarkeit

- verfügbar

- vermeiden

- AWS

- AWS Cloud9

- AWS CloudFormation

- AWS Lambda

- Zurück

- Balancer

- basierend

- BAT

- BE

- schön

- Die Schönheit

- Bevor

- Sein

- Glauben

- zwischen

- Bootstrap

- breit

- Browser

- bauen

- erbaut

- Geschäft

- Geschäftsentwicklung

- Unternehmen

- aber

- by

- rufen Sie uns an!

- CAN

- Fähigkeiten

- Kapazität

- gefangen

- österreichische Unternehmen

- Häuser

- Fälle

- CD

- Centers

- Übernehmen

- Charakteristik

- Gebühren

- aus der Ferne überprüfen

- Auswählen

- Auftraggeber

- Kunden

- Cloud

- Cloud9

- Code

- kommt

- gemeinsam

- häufig

- abschließen

- Komplex

- Berechnen

- Computer

- Konfiguration

- Konsul (Console)

- konstruieren

- Consulting

- verbraucht

- enthalten

- Container

- enthält

- Inhalt

- Kontext

- beitragen

- Smartgeräte App

- Gespräch

- Gespräche

- und beseitigen Muskelschwäche

- Kosten

- erstellen

- erstellt

- schafft

- Schaffung

- CTO

- Strom

- Original

- Kunde

- Customer Experience

- Kundenservice

- Kunden

- anpassen

- innovativ, auf dem neuesten Stand

- technische Daten

- Datenwissenschaft

- Tag

- Jahrzehnte

- Standard

- Definiert

- Synergie

- zeigt

- Abhängigkeit

- abhängig

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- setzt ein

- Beschreibung

- zerstören

- entwickeln

- Entwickler

- Entwicklung

- anders

- Rundfunk

- Display

- Störung

- Docker

- Dokument

- erledigt

- Nicht

- nach unten

- jeder

- leicht

- Einfache

- effektiv

- effizient

- ermöglichen

- ermöglicht

- Ende

- Endpunkt

- Ingenieur

- Enter

- Arbeitsumfeld

- Umgebungen

- geschätzt

- Jedes

- jeden Tag

- jeder ist

- Beispiel

- Beispiele

- unterhaltsame Programmpunkte

- ERFAHRUNGEN

- erweitern

- umfangreiche

- Gesicht

- falsch

- vertraut

- Familie

- Eigenschaften

- wenige

- Feld

- Felder

- Reichen Sie das

- Finden Sie

- Vorname

- Setzen Sie mit Achtsamkeit

- Folgende

- folgt

- Aussichten für

- Zwingen

- Foundation

- Fraktion

- Unser Ansatz

- für

- voller

- Funktion

- funktional

- Funktionen

- Tor

- sammeln

- Sammlung

- allgemeiner Zweck

- erzeugt

- Generation

- generativ

- Generative KI

- bekommen

- Git

- Global

- Global

- persönlichem Wachstum

- Haben

- mit

- he

- Hilfe

- Unternehmen

- hochwertige

- seine

- Startseite

- Gastgeber

- gehostet

- STUNDEN

- Ultraschall

- Hilfe

- HTML

- http

- HTTPS

- ICT

- Ideen

- if

- Image

- Bilder

- Phantasie

- implementieren

- Implementierung

- importieren

- in

- Einschließlich

- integrieren

- Branchen

- Energiegewinnung

- Unendlich

- Wendepunkt

- Information

- Infrastruktur

- installieren

- Installation

- installiert

- Instanz

- beantragen müssen

- integrieren

- Integrationen

- interagiert

- Schnittstelle

- in

- einladen

- Problem

- IT

- Beitritt

- dank

- jpg

- JSON

- Koreanisch

- Landung

- Sprache

- Sprachen

- grosse

- später

- neueste

- starten

- ins Leben gerufen

- Start

- führen

- Führer

- Leadership

- umwandeln

- LERNEN

- lernen

- Verlassen

- Bibliothek

- Lizenz

- Lizenzen

- Gefällt mir

- LIMIT

- Line

- Liste

- Hören

- Listen

- LLM

- Belastung

- aus einer regionalen

- located

- Maschine

- Maschinelles Lernen

- Maschinen

- gemacht

- Main

- um

- MACHT

- verwalten

- Management

- Manager

- viele

- massiv

- MENÜ

- könnte

- migriert

- Migration

- Minuten

- MIT

- ML

- Modell

- für

- modernisieren

- geändert

- mehr

- Filme

- mehrere

- Musik

- sollen

- Name

- Natürliche

- Natur

- Menü

- Need

- Bedürfnisse

- Netzwerk

- Neu

- weiter

- Knoten

- jetzt an

- Anzahl

- of

- Angebote

- on

- EINEM

- laufend

- einzige

- Open-Source-

- Quelloffene Software

- öffnet

- or

- Auftrag

- Organisation

- Original

- Andere

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- übrig

- Überblick

- besitzen

- Paket

- Seite

- Brot

- Paradigma

- Parameter

- Parameter

- Partner

- Bestehen

- Ausführen

- Phase

- Telefon

- ein Bild

- Plan

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- Points

- Möglichkeit

- Post

- Potenzial

- angetriebene

- größte treibende

- Voraussetzungen

- Vor

- privat

- Aufgabenstellung:

- Produktion

- Programmierung

- Programmiersprachen

- Projekt

- Projekte

- die

- bietet

- Öffentlichkeit

- Public Cloud

- öffentlich

- Python

- Abfragen

- schnell

- Angebot

- schnell

- schnell

- bereit

- kürzlich

- bezeichnet

- in Bezug auf

- Region

- bezogene

- Quelle

- falls angefordert

- Voraussetzungen:

- Ressourcen

- Downloads

- diejenigen

- Überprüfen

- Revolutionierung

- Recht

- Rollen

- Wurzel

- Führen Sie

- Laufen

- sagemaker

- Vertrieb

- gleich

- Skalieren

- Science-Fiction

- Wissenschaft

- kratzen

- Sdk

- Zweite

- Sekunden

- Abschnitt

- Sicherheitdienst

- sehen

- Saatgut

- SELF

- Senior

- Gefühl

- Seoul

- Serverlos

- Fertige Server

- Lösungen

- kompensieren

- Setup

- Teilen

- verschieben

- sollte

- erklären

- zeigte

- gezeigt

- Konzerte

- Einfacher

- da

- Singapur

- Größe

- klein

- KMU

- So

- Software

- Software-Entwicklung

- Lösung

- Lösungen

- einige

- Quelle

- Raumfahrt

- Spezialist

- spezifisch

- angegeben

- stabil

- Stapel

- Stacks

- Standard

- begonnen

- Anfang

- Startups

- Schritt

- Shritte

- Stoppen

- Lagerung

- speichern

- gelagert

- Läden

- Geschichten

- Strategie

- Struktur

- Subnetz

- Support

- Systeme und Techniken

- nimmt

- Aufgabe

- und Aufgaben

- Team

- Technische

- Techniken

- Technologies

- Technologie

- erzählt

- Vorlagen

- Test

- Tests

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Diese

- fehlen uns die Worte.

- Durch

- Zeit

- Titan

- zu

- Toolkit

- Werkzeuge

- Tradition

- traditionell

- Training

- trainiert

- Ausbildung

- Transformieren

- Trends

- was immer dies auch sein sollte.

- wirklich

- WENDE

- Lernprogramm

- XNUMX

- tippe

- Typen

- typisch

- typisch

- für

- Verständnis

- enthüllt

- Aktualisierung

- mehr Stunden

- -

- Anwendungsfall

- benutzt

- Mitglied

- Benutzerschnittstelle

- Verwendung von

- Nutzen

- verschiedene

- riesig

- überprüfen

- Version

- Videos

- Anzeigen

- Assistent

- praktisch

- Besuchen Sie

- wollen

- wurde

- beobachten

- Weg..

- we

- Netz

- Internetanwendung

- Web-Services

- GUT

- welche

- während

- breit

- Große Auswahl

- weit verbreitet

- Wikipedia

- werden wir

- Fenster

- mit

- ohne

- Arbeiten

- gearbeitet

- Workflows

- Arbeitsplatz

- Jahr

- Du

- Ihr

- Zephyrnet

- Zonen