Moderne Chatbots können als digitale Agenten fungieren und eine neue Möglichkeit für die Bereitstellung von Kundenservice und Support rund um die Uhr in vielen Branchen bieten. Ihre Beliebtheit beruht auf der Möglichkeit, in Echtzeit auf Kundenanfragen zu reagieren und mehrere Anfragen gleichzeitig in verschiedenen Sprachen zu bearbeiten. Chatbots bieten außerdem wertvolle datengesteuerte Einblicke in das Kundenverhalten und lassen sich mühelos skalieren, wenn die Benutzerbasis wächst. Daher stellen sie eine kostengünstige Lösung für die Kundenbindung dar. Chatbots nutzen die erweiterten natürlichen Sprachfunktionen großer Sprachmodelle (LLMs), um auf Kundenfragen zu antworten. Sie können Gesprächssprache verstehen und natürlich reagieren. Allerdings haben Chatbots, die lediglich grundlegende Fragen beantworten, nur einen begrenzten Nutzen. Um vertrauenswürdige Berater zu werden, müssen Chatbots durchdachte, maßgeschneiderte Antworten geben.

Eine Möglichkeit, kontextbezogenere Gespräche zu ermöglichen, besteht darin, den Chatbot mit internen Wissensdatenbanken und Informationssystemen zu verknüpfen. Durch die Integration proprietärer Unternehmensdaten aus internen Wissensdatenbanken können Chatbots ihre Antworten auf die individuellen Bedürfnisse und Interessen jedes Benutzers kontextualisieren. Ein Chatbot könnte beispielsweise Produkte vorschlagen, die den Vorlieben und früheren Einkäufen eines Käufers entsprechen, Details in einer Sprache erklären, die an das Fachwissen des Benutzers angepasst ist, oder Kontounterstützung bieten, indem er auf die spezifischen Datensätze des Kunden zugreift. Die Fähigkeit, Informationen intelligent zu integrieren, natürliche Sprache zu verstehen und individuelle Antworten in einem Gesprächsfluss bereitzustellen, ermöglicht es Chatbots, in verschiedenen Anwendungsfällen einen echten Geschäftswert zu liefern.

Das beliebte Architekturmuster von Augmented Generation abrufen (RAG) wird häufig verwendet, um den Kontext und die Antworten von Benutzeranfragen zu erweitern. RAG kombiniert die Fähigkeiten von LLMs mit der fundierten Fakten- und Praxiskenntnis, die durch das Abrufen relevanter Texte und Passagen aus einem Datenkorpus entsteht. Diese abgerufenen Texte werden dann verwendet, um die Ausgabe zu informieren und zu begründen, wodurch Halluzinationen reduziert und die Relevanz verbessert werden.

In diesem Beitrag veranschaulichen wir die kontextbezogene Verbesserung eines Chatbots mithilfe von Wissensdatenbanken für Amazon Bedrock, ein vollständig verwalteter serverloser Dienst. Durch die Integration von Wissensdatenbanken für Amazon Bedrock kann unser Chatbot relevantere, personalisierte Antworten liefern, indem er Benutzeranfragen mit zugehörigen Informationsdatenpunkten verknüpft. Im Inneren, Amazonas Grundgestein verwendet in einer Vektordatenbank gespeicherte Einbettungen, um den Benutzerabfragekontext zur Laufzeit zu erweitern und eine verwaltete RAG-Architekturlösung zu ermöglichen. Wir benutzen das Amazon-Aktionärsbriefe Datensatz zur Entwicklung dieser Lösung.

Augmented Generation abrufen

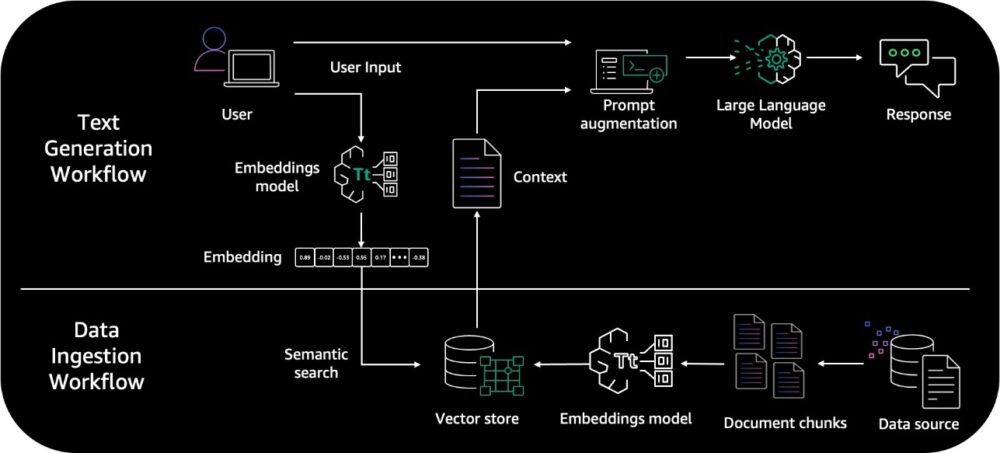

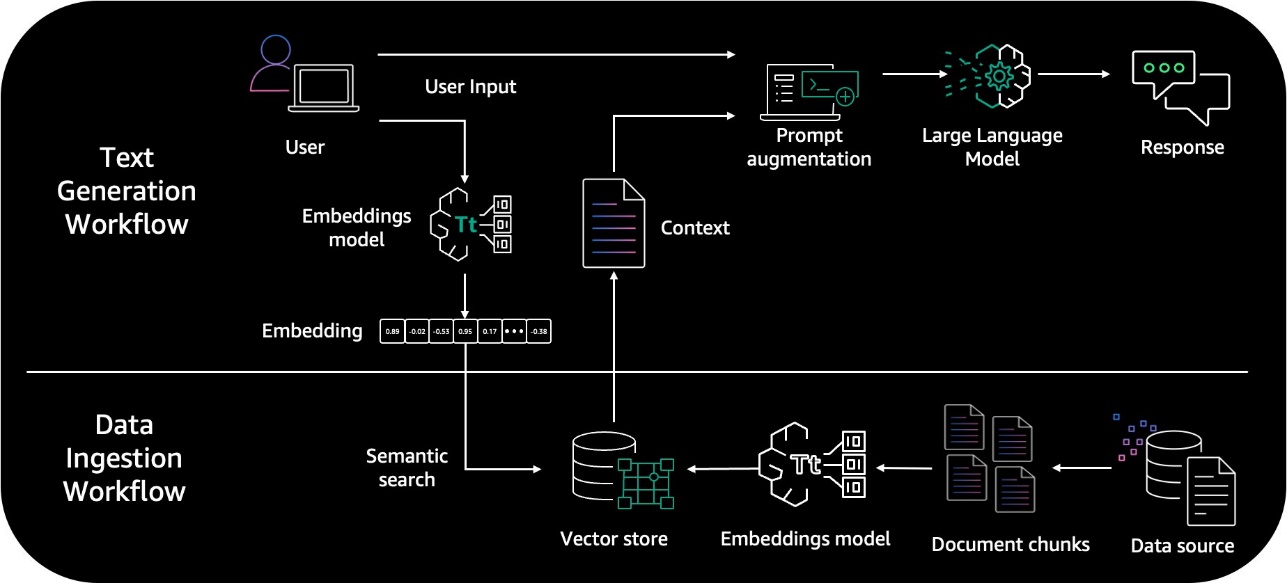

RAG ist ein Ansatz zur Generierung natürlicher Sprache, der den Informationsabruf in den Generierungsprozess einbezieht. Die RAG-Architektur umfasst zwei wichtige Arbeitsabläufe: Datenvorverarbeitung durch Aufnahme und Textgenerierung mithilfe von erweitertem Kontext.

Der Datenaufnahme-Workflow verwendet LLMs, um Einbettungsvektoren zu erstellen, die die semantische Bedeutung von Texten darstellen. Für Dokumente und Benutzerfragen werden Einbettungen erstellt. Die Dokumenteinbettungen werden in Blöcke aufgeteilt und als Indizes in einer Vektordatenbank gespeichert. Der Textgenerierungsworkflow nimmt dann den Einbettungsvektor einer Frage und verwendet ihn, um die ähnlichsten Dokumentabschnitte basierend auf der Vektorähnlichkeit abzurufen. Es erweitert Eingabeaufforderungen um diese relevanten Blöcke, um mithilfe des LLM eine Antwort zu generieren. Weitere Einzelheiten finden Sie im Einführung in Retrieval Augmented Generation, Einbettungen und Vektordatenbanken Abschnitt in Vorschau – Verbinden Sie Foundation-Modelle mit den Datenquellen Ihres Unternehmens mit Agents für Amazon Bedrock.

Das folgende Diagramm veranschaulicht die RAG-Architektur auf hoher Ebene.

Obwohl die RAG-Architektur viele Vorteile bietet, umfasst sie mehrere Komponenten, darunter eine Datenbank, einen Abrufmechanismus, eine Eingabeaufforderung und ein generatives Modell. Die Verwaltung dieser voneinander abhängigen Teile kann zu Komplexitäten bei der Systementwicklung und -bereitstellung führen. Die Integration von Retrieval und Generierung erfordert zudem zusätzlichen Engineering-Aufwand und Rechenressourcen. Einige Open-Source-Bibliotheken stellen Wrapper bereit, um diesen Overhead zu reduzieren. Allerdings können Änderungen an Bibliotheken zu Fehlern führen und zusätzlichen Aufwand für die Versionierung verursachen. Selbst bei Open-Source-Bibliotheken ist ein erheblicher Aufwand erforderlich, um Code zu schreiben, die optimale Blockgröße zu bestimmen, Einbettungen zu generieren und mehr. Allein diese Einrichtungsarbeit kann je nach Datenvolumen Wochen dauern.

Daher könnte eine verwaltete Lösung, die diese undifferenzierten Aufgaben übernimmt, den Prozess der Implementierung und Verwaltung von RAG-Anwendungen rationalisieren und beschleunigen.

Wissensdatenbanken für Amazon Bedrock

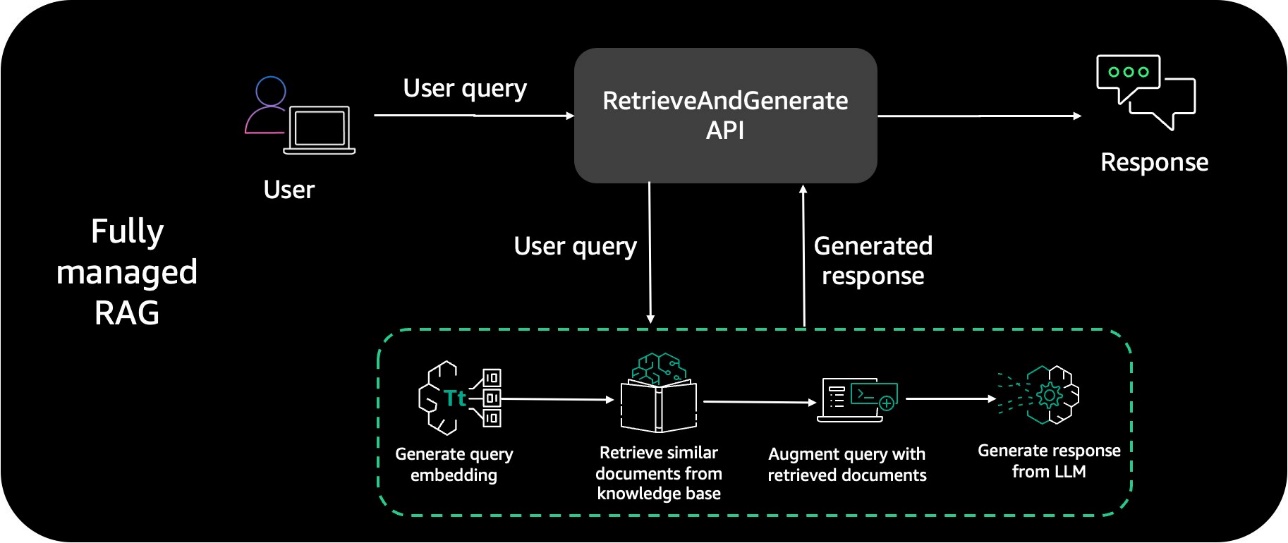

Knowledge Bases für Amazon Bedrock ist eine serverlose Option zum Aufbau leistungsstarker Konversations-KI-Systeme mit RAG. Es bietet vollständig verwaltete Datenerfassungs- und Textgenerierungs-Workflows.

Für die Datenaufnahme übernimmt es automatisch das Erstellen, Speichern, Verwalten und Aktualisieren von Texteinbettungen von Dokumentdaten in der Vektordatenbank. Es teilt die Dokumente in überschaubare Teile auf, um sie effizient abzurufen. Die Blöcke werden dann in Einbettungen umgewandelt und in einen Vektorindex geschrieben, sodass Sie bei der Beantwortung einer Frage die Quelldokumente sehen können.

Für die Textgenerierung stellt Amazon Bedrock die zur Verfügung Abrufen und generieren API zum Erstellen von Einbettungen von Benutzeranfragen und zum Abrufen relevanter Teile aus der Vektordatenbank, um genaue Antworten zu generieren. Es unterstützt auch die Quellenzuordnung und das Kurzzeitgedächtnis, die für RAG-Anwendungen benötigt werden.

Dies ermöglicht es Ihnen, sich auf Ihre Kerngeschäftsanwendungen zu konzentrieren und entfällt die undifferenzierte Schwerstarbeit.

Lösungsüberblick

Die in diesem Beitrag vorgestellte Lösung verwendet einen Chatbot, der mit a erstellt wurde Stromlit Anwendung und umfasst die folgenden AWS-Services:

Das folgende Diagramm ist ein allgemeines Lösungsarchitekturmuster, das Sie verwenden können, um jede Chatbot-Anwendung in Wissensdatenbanken für Amazon Bedrock zu integrieren.

Diese Architektur umfasst die folgenden Schritte:

- Ein Benutzer interagiert mit der Chatbot-Schnittstelle von Streamlit und sendet eine Anfrage in natürlicher Sprache

- Dadurch wird eine Lambda-Funktion ausgelöst, die die Wissensdatenbanken aufruft

RetrieveAndGenerateAPI. Intern verwendet Knowledge Bases eine Amazonas-Titan Einbettungsmodell, wandelt die Benutzerabfrage in einen Vektor um und findet Blöcke, die der Benutzerabfrage semantisch ähnlich sind. Die Benutzeraufforderung wird dann durch die Blöcke erweitert, die aus der Wissensdatenbank abgerufen werden. Die Eingabeaufforderung wird dann zusammen mit dem zusätzlichen Kontext zur Antwortgenerierung an ein LLM gesendet. In dieser Lösung verwenden wir Anthropischer Claude Instant als unser LLM, um Benutzerantworten unter Verwendung zusätzlichen Kontexts zu generieren. Beachten Sie, dass diese Lösung in Regionen unterstützt wird, in denen sich Anthropic Claude auf Amazon Bedrock befindet verfügbar. - Eine kontextrelevante Antwort wird an die Chatbot-Anwendung und den Benutzer zurückgesendet.

Voraussetzungen:

Benutzer von Amazon Bedrock müssen Zugriff auf Fundamentmodelle anfordern, bevor sie zur Verwendung verfügbar sind. Dies ist eine einmalige Aktion und dauert weniger als eine Minute. Für diese Lösung müssen Sie den Zugriff auf die Modelle Titan Embeddings G1 – Text und Claude Instant – v1.2 in Amazon Bedrock aktivieren. Weitere Informationen finden Sie unter Modellzugriff.

Klonen Sie das GitHub-Repo

Die in diesem Beitrag vorgestellte Lösung ist im Folgenden verfügbar GitHub Repo. Sie müssen das GitHub-Repository auf Ihren lokalen Computer klonen. Öffnen Sie ein Terminalfenster und führen Sie den folgenden Befehl aus. Beachten Sie, dass dies ein einzelner Git-Clone-Befehl ist.

Laden Sie Ihren Wissensdatensatz auf Amazon S3 hoch

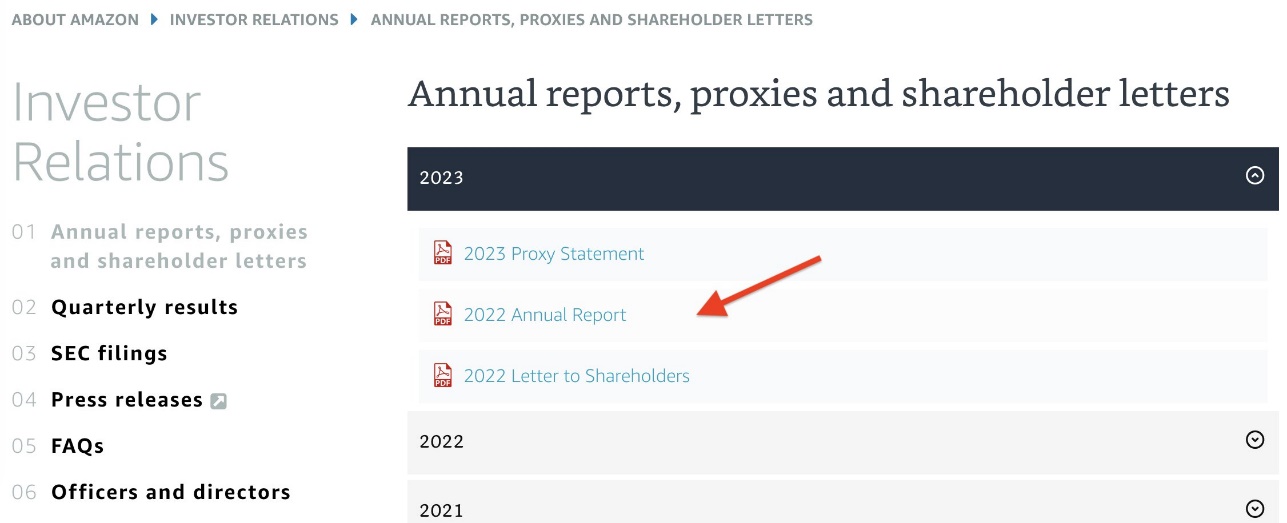

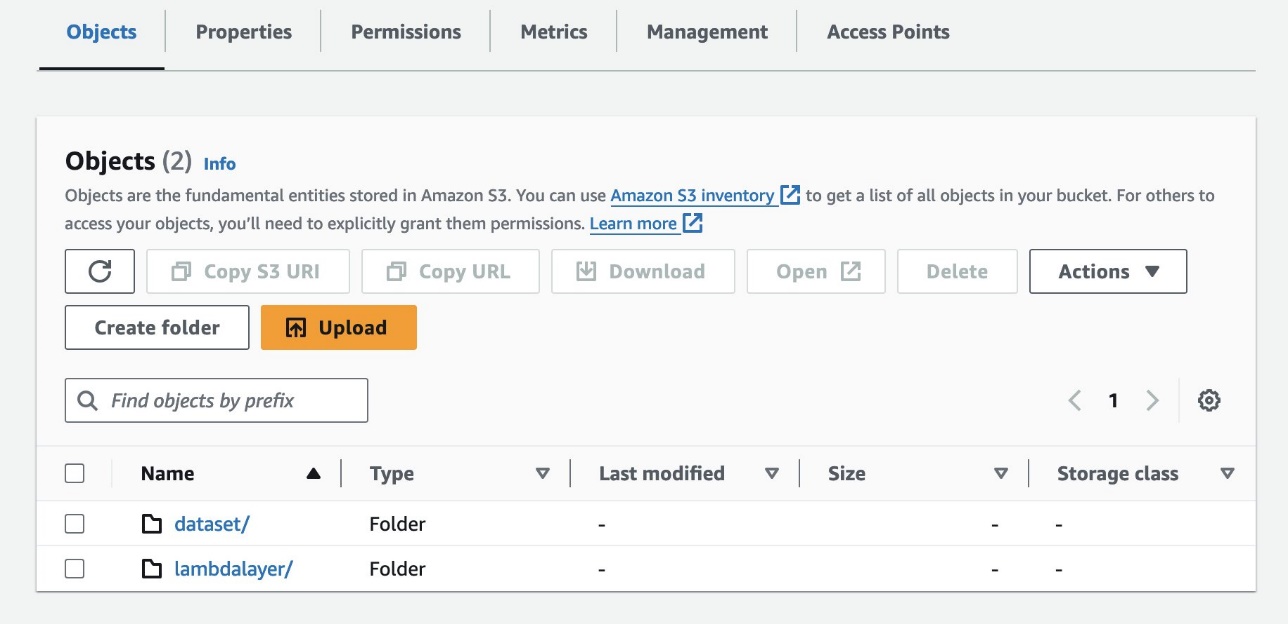

Wir laden den Datensatz für unsere Wissensdatenbank herunter und laden ihn in einen S3-Bucket hoch. Dieser Datensatz wird die Wissensdatenbank speisen und unterstützen. Führen Sie die folgenden Schritte aus:

- Navigieren Sie zu der Jahresberichte, Vollmachten und Aktionärsbriefe Datenspeicher und laden Sie die Amazon-Aktionärsbriefe der letzten Jahre herunter.

- Wählen Sie in der Amazon S3-Konsole aus Eimer im Navigationsbereich.

- Auswählen Eimer erstellen.

- Benennen Sie den Eimer

knowledgebase-<your-awsaccount-number>. - Behalten Sie alle anderen Bucket-Einstellungen als Standard bei und wählen Sie Erstellen.

- Navigieren Sie zu der

knowledgebase-<your-awsaccount-number>Eimer. - Auswählen Ordner erstellen und nennen Sie es Datensatz.

- Belassen Sie alle anderen Ordnereinstellungen als Standard und wählen Sie Erstellen.

- Navigieren Sie zurück zur Bucket-Startseite und wählen Sie Ordner erstellen um einen neuen Ordner zu erstellen und ihm einen Namen zu geben

lambdalayer. - Belassen Sie alle anderen Einstellungen als Standard und wählen Sie Erstellen.

- Navigieren Sie zu der

dataset-Ordner. - Laden Sie die zuvor heruntergeladenen Datensatzdateien für Jahresberichte, Vollmachten und Aktionärsbriefe in diesen Bucket hoch und wählen Sie „ Hochladen.

- Navigieren Sie zu der

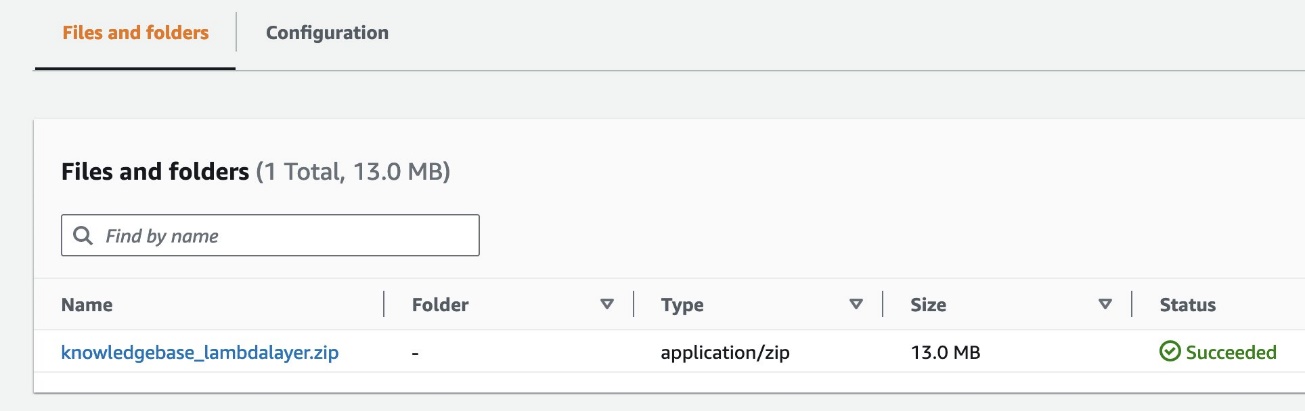

lambdalayer-Ordner. - Laden Sie die

knowledgebase-lambdalayer.zipDatei verfügbar unter der/lambda/layerOrdner im GitHub-Repository, das Sie zuvor geklont haben, und wählen Sie Hochladen. Sie werden diesen Lambda-Ebenencode später verwenden, um die Lambda-Funktion zu erstellen.

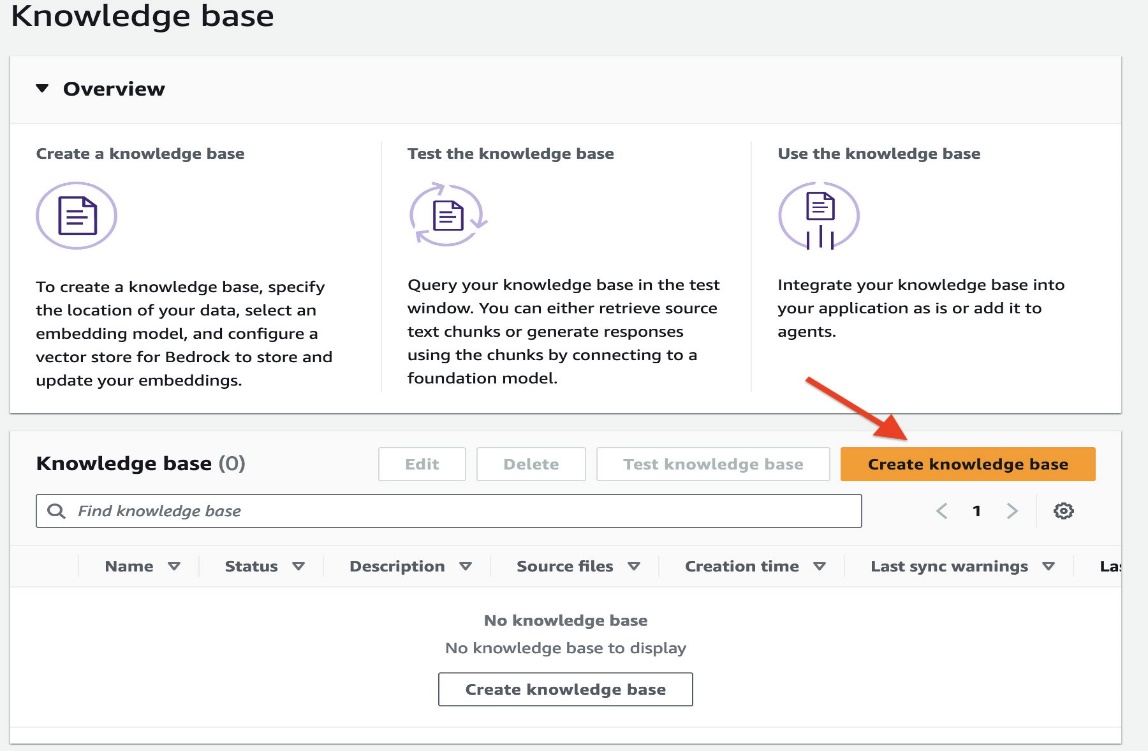

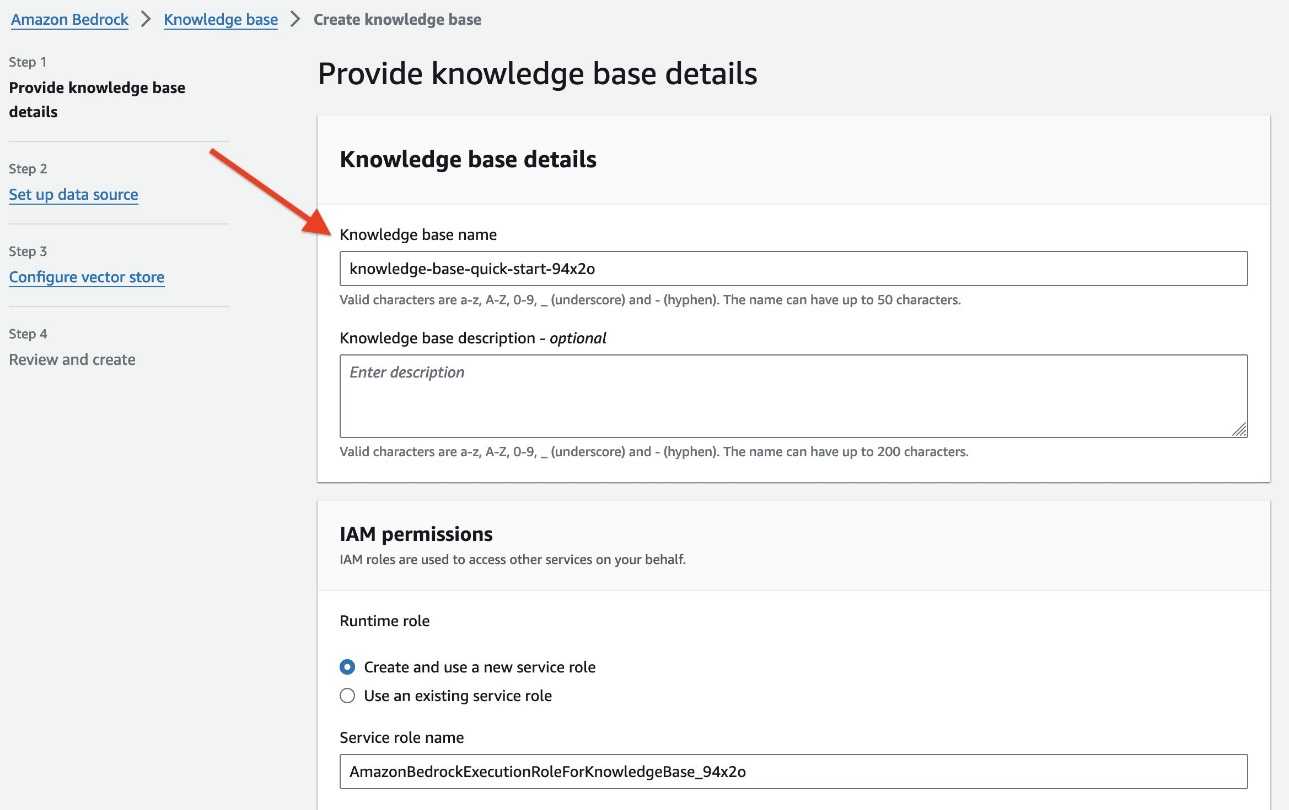

Erstellen Sie eine Wissensbasis

In diesem Schritt erstellen wir eine Wissensdatenbank mithilfe des Amazon-Aktionärsbriefdatensatzes, den wir im vorherigen Schritt in unseren S3-Bucket hochgeladen haben.

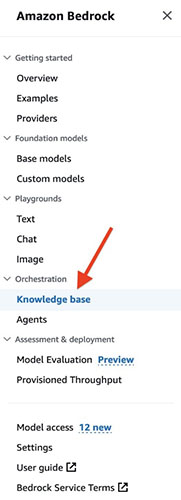

- Auf der Amazon Bedrock-Konsole unter Besetzung Wählen Sie im Navigationsbereich Wissensbasis.

- Auswählen

Wissensbasis schaffen.

- Im Details zur Wissensdatenbank Geben Sie im Abschnitt einen Namen und optional eine Beschreibung ein.

- Im IAM-Berechtigungen Abschnitt auswählen Erstellen und verwenden Sie eine neue Servicerolle und geben Sie einen Namen für die Rolle ein.

- Fügen Sie nach Bedarf Tags hinzu.

- Auswählen

Weiter.

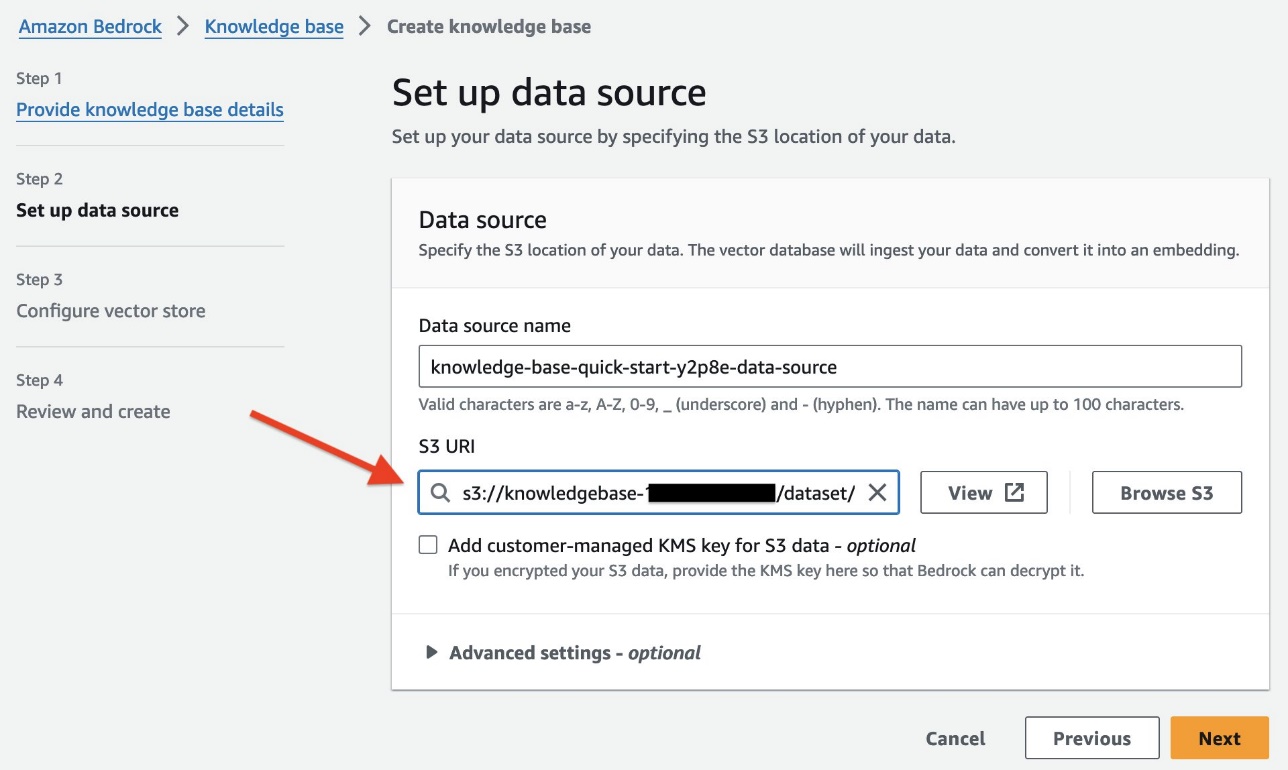

- Verlassen Name der Datenquelle als Standardname.

- Aussichten für S3-URI, wählen Durchsuchen Sie S3 um den S3-Bucket auszuwählen

knowledgebase-<your-account-number>/dataset/.Sie müssen auf den Bucket- und Datensatzordner verweisen, den Sie in den vorherigen Schritten erstellt haben. - Im Erweiterte Einstellungen Belassen Sie im Abschnitt die Standardwerte (wenn Sie möchten, können Sie die Standard-Chunking-Strategie ändern und die Chunk-Größe und die Überlagerung in Prozent angeben).

- Auswählen

Weiter.

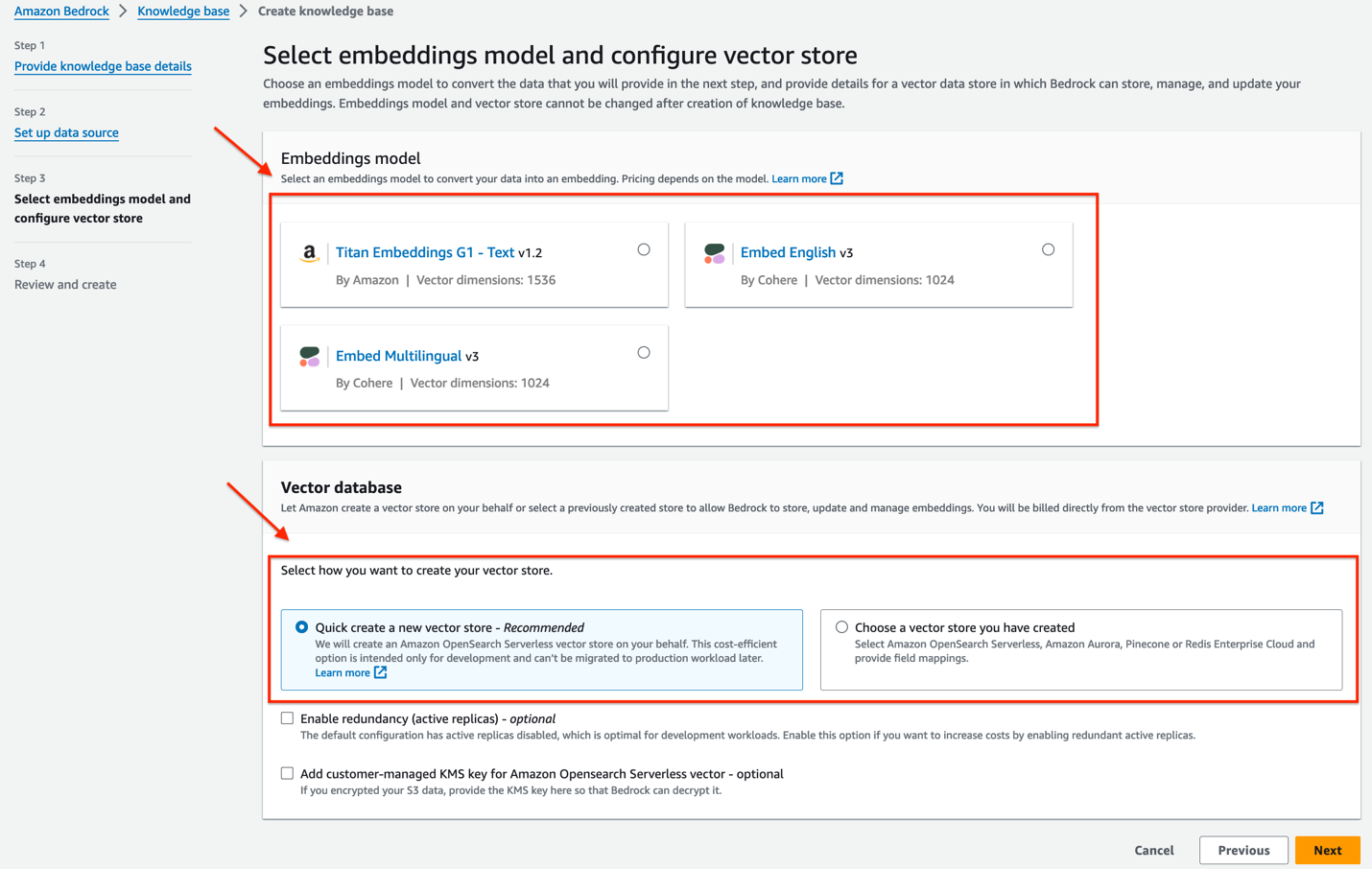

- Aussichten für EinbettungsmodellWählen Titan Embedding G1 – Text.

- Aussichten für Vektordatenbank, Sie können entweder auswählen Erstellen Sie schnell einen neuen Vektorspeicher or Wählen Sie einen von Ihnen erstellten Vektorspeicher aus. Beachten Sie, dass Sie zur Verwendung des Vektorspeichers Ihrer Wahl einen vorkonfigurierten Vektorspeicher benötigen. Wir unterstützen derzeit vier Vektor-Engine-Typen: die Vektor-Engine für Amazon OpenSearch Serverless, Amazon Aurora, Pinecone und Redis Enterprise Cloud. Für diesen Beitrag wählen wir „Schnell einen neuen Vektorspeicher erstellen“, wodurch standardmäßig ein neuer OpenSearch Serverless-Vektorspeicher in Ihrem Konto erstellt wird.

- Auswählen

Weiter.

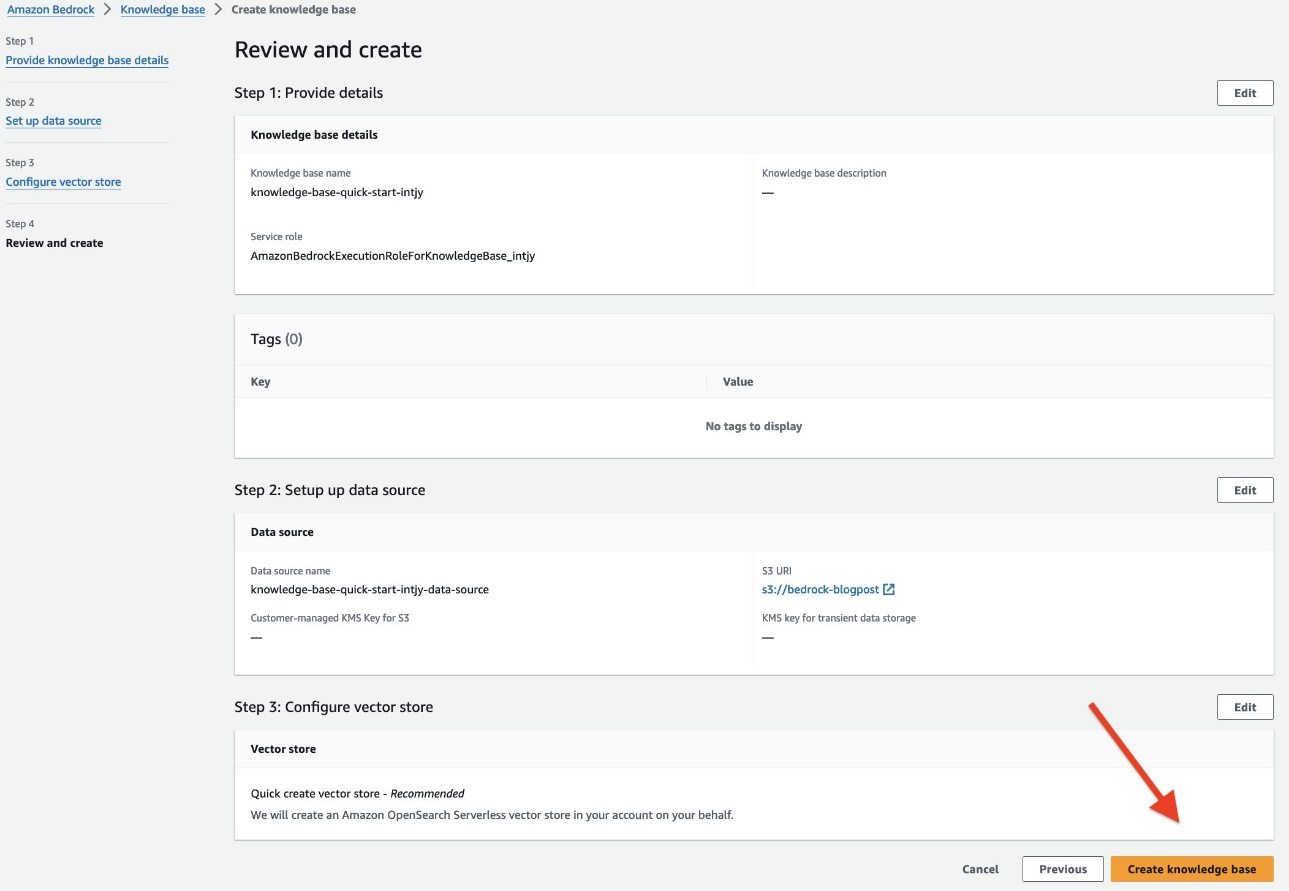

- Auf dem Überprüfen und erstellen Seite, überprüfen Sie alle Informationen oder wählen Sie Vorherige um beliebige Optionen zu ändern.

- Auswählen

Wissensbasis schaffen.

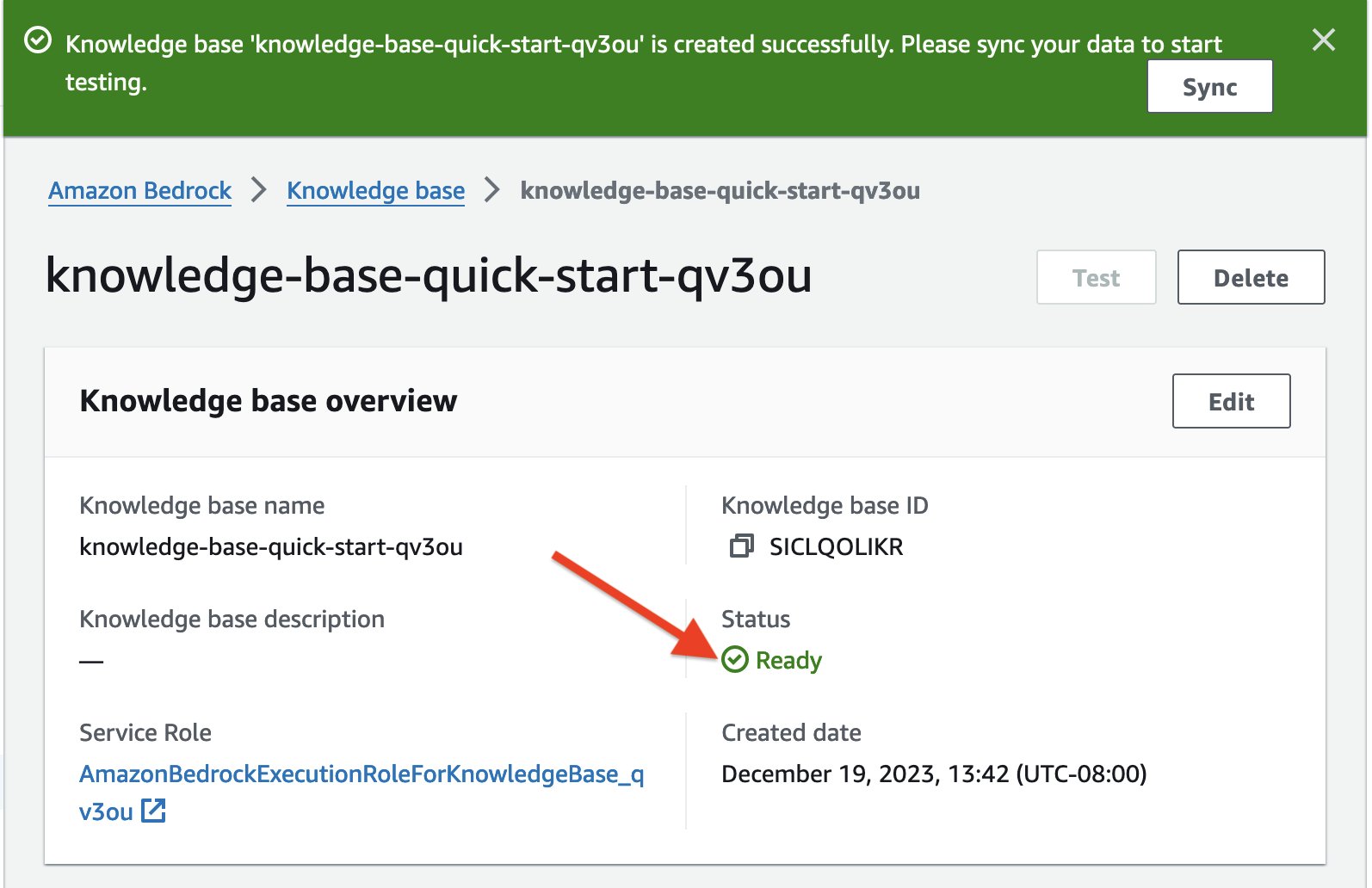

Beachten Sie, dass der Erstellungsprozess der Wissensdatenbank beginnt und der Status „In Bearbeitung“ lautet. Das Erstellen des Vektorspeichers und der Wissensdatenbank dauert einige Minuten. Navigieren Sie nicht von der Seite weg, da sonst die Erstellung fehlschlägt.

Beachten Sie, dass der Erstellungsprozess der Wissensdatenbank beginnt und der Status „In Bearbeitung“ lautet. Das Erstellen des Vektorspeichers und der Wissensdatenbank dauert einige Minuten. Navigieren Sie nicht von der Seite weg, da sonst die Erstellung fehlschlägt. - Wenn der Wissensdatenbankstatus im ist

ReadyZustand, notieren Sie sich die Wissensdatenbank-ID. Sie werden es in den nächsten Schritten verwenden, um die Lambda-Funktion zu konfigurieren.

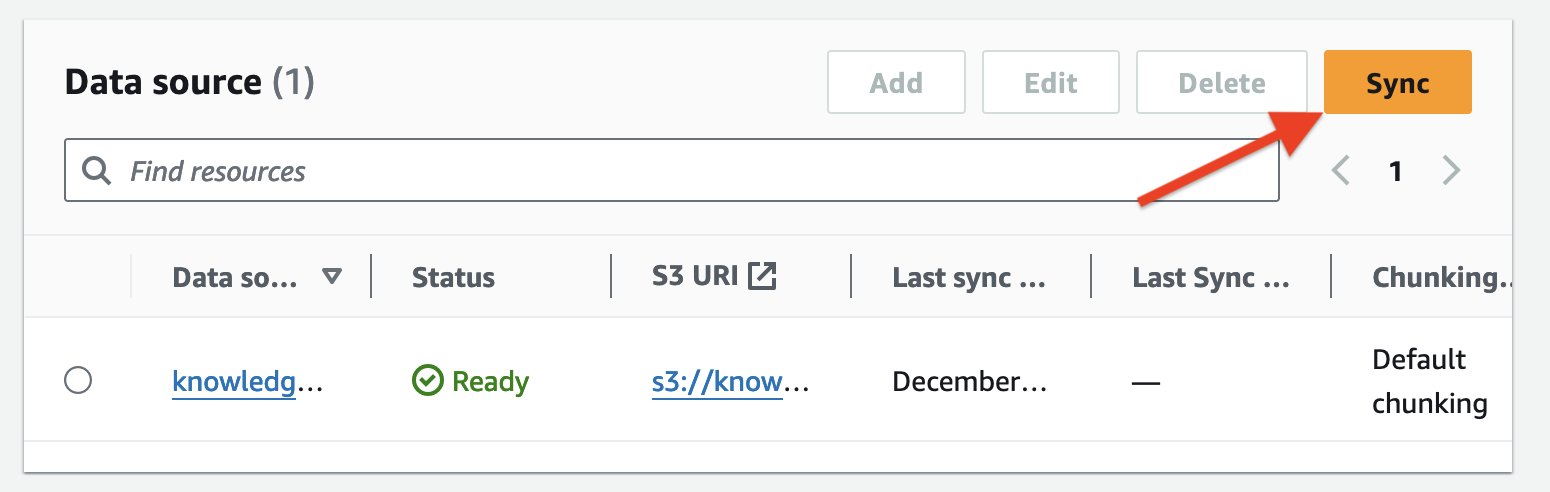

- Da die Wissensdatenbank nun fertig ist, müssen wir die Daten unserer Amazon-Aktionärsbriefe damit synchronisieren. Im Datenquelle Wählen Sie im Abschnitt „Details“ der Wissensdatenbank „ Synchronisierung um den Datenaufnahmeprozess vom S3-Bucket in die Wissensdatenbank auszulösen.

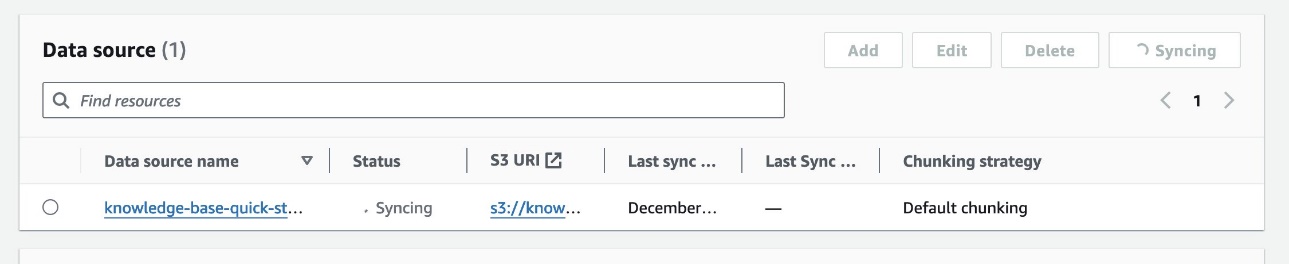

Dieser Synchronisierungsprozess teilt die Dokumentdateien in kleinere Blöcke der zuvor angegebenen Blockgröße auf, generiert Vektoreinbettungen mithilfe des ausgewählten Texteinbettungsmodells und speichert sie im Vektorspeicher, der von Knowledge Bases für Amazon Bedrock verwaltet wird.

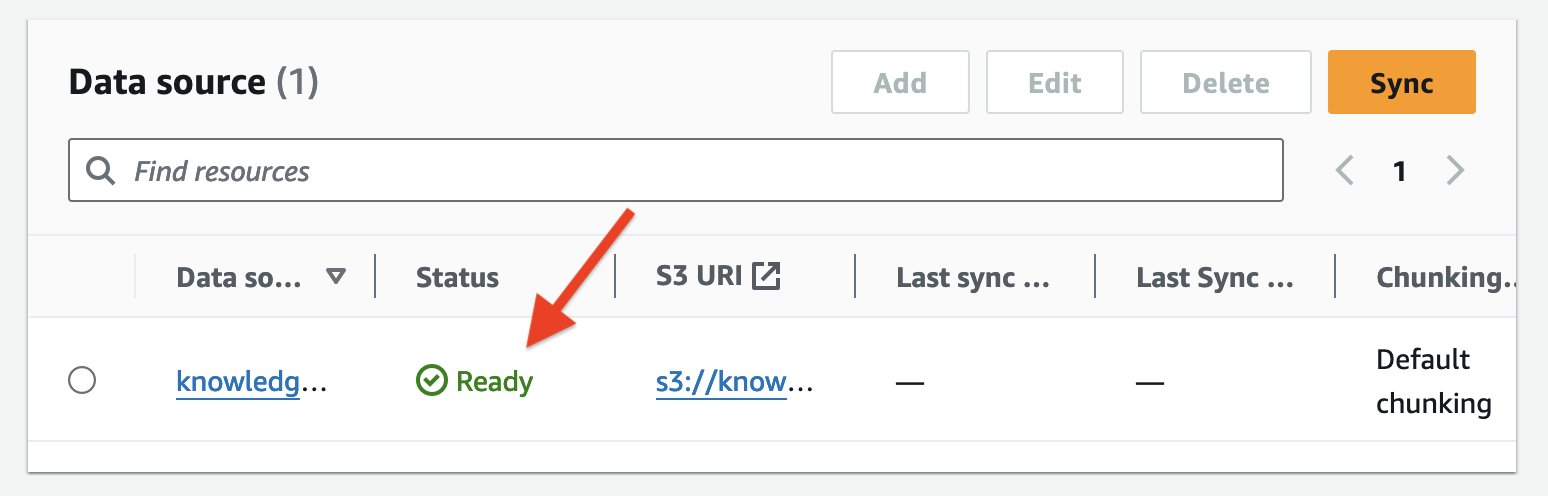

Wenn die Datensatzsynchronisierung abgeschlossen ist, ändert sich der Status der Datenquelle in Ready Zustand. Beachten Sie, dass Sie die Wissensdatenbank erneut synchronisieren müssen, wenn Sie weitere Dokumente zum S3-Datenordner hinzufügen.

Herzlichen Glückwunsch, Ihre Wissensdatenbank ist fertig.

Beachten Sie, dass Sie auch Wissensdatenbanken für Amazon Bedrock-Service-APIs und die verwenden können AWS-Befehlszeilenschnittstelle (AWS CLI) zum programmgesteuerten Erstellen einer Wissensdatenbank. Sie müssen verschiedene Abschnitte des Jupyter-Notebooks ausführen, das unter bereitgestellt wird /notebook Ordner im GitHub-Repo.

Erstellen Sie eine Lambda-Funktion

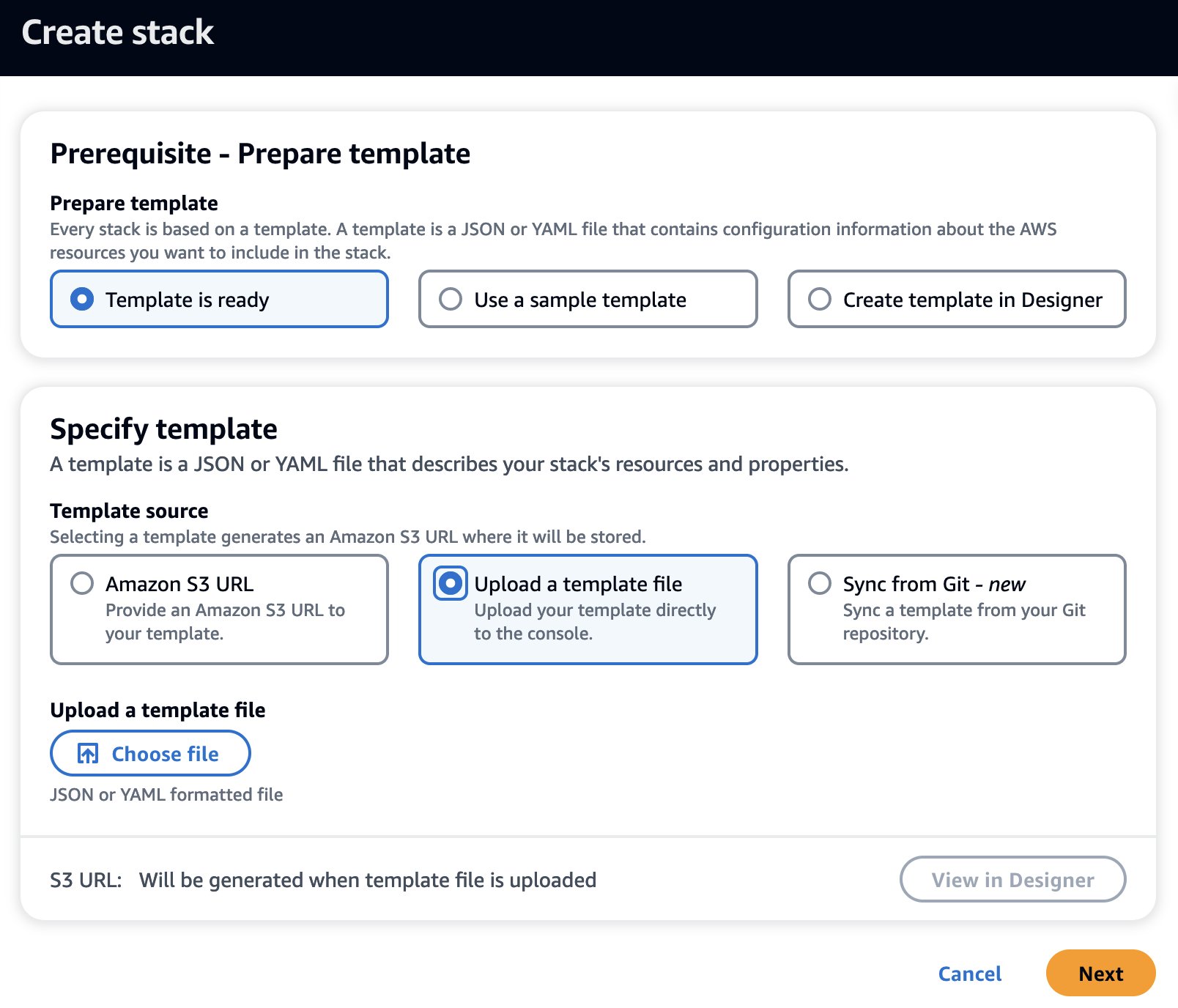

Diese Lambda-Funktion wird mithilfe von bereitgestellt AWS CloudFormation Vorlage verfügbar im GitHub-Repo unter /cfn Ordner. Die Vorlage erfordert zwei Parameter: den S3-Bucket-Namen und die Wissensdatenbank-ID.

- Wählen Sie auf der Startseite des AWS CloudFormation-Service die Option aus Stapel erstellen um einen neuen Stapel zu erstellen.

- Auswählen Vorlage ist fertig für Vorlage vorbereiten.

- Auswählen Laden Sie die Vorlagendatei hoch für Vorlagenquelle.

- Auswählen

Datei auswählen, navigieren Sie zu dem GitHub-Repository, das Sie zuvor geklont haben, und wählen Sie die .yaml-Datei unter aus

/cfn-Ordner. - Auswählen

Weiter.

- Aussichten für Stapelname, Geben Sie einen Namen ein.

- Im Parameter Geben Sie im Abschnitt „Wissensdatenbank-ID“ und „S3-Bucket-Name“ die zuvor notierte Wissensdatenbank-ID ein.

- Auswählen

Weiter.

- Lassen Sie alle Standardoptionen unverändert und wählen Sie Weiter, und wähle Absenden.

- Stellen Sie sicher, dass die CloudFormation-Vorlage erfolgreich ausgeführt wurde und keine Fehler vorliegen.

Herzlichen Glückwunsch, Sie haben erfolgreich eine Lambda-Funktion, zugehörige Rollen und Richtlinien erstellt.

Testen Sie die kontextbezogene Chatbot-Anwendung

Führen Sie die folgenden Schritte aus, um Ihre Chatbot-Anwendung zu testen:

- Öffnen Sie ein neues Terminal oder ein Befehlszeilenfenster auf Ihrem Computer.

- Führen Sie den folgenden Befehl aus, um das zu installieren AWS SDK für Python (Boto3). Boto3 erleichtert die Integration einer Python-Anwendung, einer Python-Bibliothek oder eines Skripts in AWS-Dienste.

- Führen Sie den folgenden Befehl aus, um eine lokale Python-Entwicklungsumgebung zum Ausführen der Streamlit-Anwendung zu installieren und einzurichten:

- Navigieren Sie zu der

/streamlitOrdner im GitHub-Repository-Ordner, den Sie zuvor geklont haben. - Führen Sie den folgenden Befehl aus, um die Chatbot-Anwendung zu instanziieren:

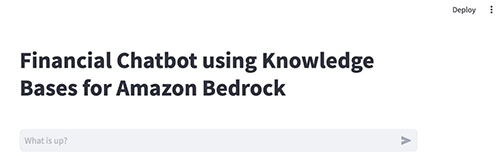

Dadurch sollte eine webbasierte Chat-Anwendung von Streamlit in Ihrem Standard-Webbrowser geöffnet werden.

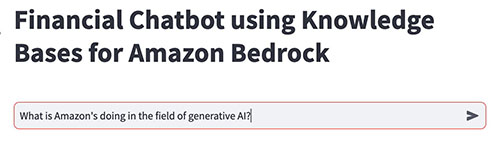

- Verwenden Sie diese Streamlit-Chatbot-Anwendung, um Fragen in natürlicher Sprache zu stellen und die von Knowledge Bases für Amazon Bedrock unterstützten Gespräche zu starten.

Wenn Sie eine Eingabeaufforderung senden, löst die Streamlit-App die Lambda-Funktion aus, die die Wissensdatenbanken aufruft RetrieveAndGenerate API zum Suchen und Generieren von Antworten.

Die folgende Tabelle enthält einige Beispielfragen und zugehörige Antworten aus der Wissensdatenbank. Probieren Sie einige dieser Fragen aus, indem Sie Eingabeaufforderungen verwenden.

| Fragen | Antworten |

| Was macht Amazon im Bereich generative KI? | Amazon hat an eigenen großen Sprachmodellen (LLMs) für generative KI gearbeitet und glaubt, dass diese jedes Kundenerlebnis verändern und verbessern werden. Sie planen, weiterhin erheblich in diese Modelle für alle Kunden-, Verkäufer-, Marken- und Schöpfererlebnisse zu investieren. |

| Wie hoch ist der Jahresumsatz von AWS im Jahr 2022? | Der AWS-Umsatz stieg im Jahr 29 im Jahresvergleich um 2022 % auf einer Umsatzbasis von 62 Milliarden US-Dollar. |

| Wie viele Tage hat Amazon seine Mitarbeiter gebeten, zur Arbeit ins Büro zu kommen? | Amazon hat die Mitarbeiter des Unternehmens gebeten, ab Mai 2022 mindestens drei Tage pro Woche wieder ins Büro zu kommen. |

| Um wie viel Prozent ist der AWS-Umsatz im Jahr 2022 im Vergleich zum Vorjahr gestiegen? | AWS erzielte im Jahr 29 einen Jahresumsatz von 2022 %. |

| Welche Leistungsverbesserung lieferten die Graviton2-Chips im Vergleich zu Graviton3-Prozessoren laut der Passage? | Im Jahr 2022 lieferte AWS seine Graviton3-Chips aus, die eine 25 % bessere Leistung als die Graviton2-Prozessoren bieten. |

| Welcher war laut der Passage der erste von AWS eingeführte Inferenzchip? | AWS brachte 2019 seine ersten Inferenzchips („Inferentia“) auf den Markt und hat Unternehmen wie Amazon über hundert Millionen Dollar an Kapitalkosten erspart. |

| In welchem Jahr ist der Jahresumsatz von Amazon von 245 Milliarden US-Dollar auf 434 Milliarden US-Dollar gestiegen? | Der Jahresumsatz von Amazon stieg von 245 Milliarden US-Dollar im Jahr 2019 auf 434 Milliarden US-Dollar im Jahr 2022. |

| Sagen Sie mir noch einmal, wie hoch waren die Einnahmen im Jahr 2019? | Der Umsatz von Amazon belief sich 2019 auf 245 Milliarden US-Dollar. |

| und 2021? | Der Umsatz von Amazon belief sich im Jahr 2021 auf 469.8 Milliarden US-Dollar, ein Anstieg von 22 % gegenüber 2020. |

| Und erinnern Sie mich noch einmal daran, wann der erste Inferenzchip auf den Markt kam? | Der erste Inferenzchip von Amazon war Inferentia, der 2019 auf den Markt kam. |

Beim ersten Aufruf der Lambda-Funktion wird die RetrieveAndGenerate Die API gibt a zurück sessionId, der dann von der Streamlit-App zusammen mit der nachfolgenden Benutzeraufforderung als Eingabe an die RetrieveAndGenerate-API übergeben wird, um die Konversation in derselben Sitzung fortzusetzen. Der RetrieveAndGenerate Die API verwaltet das Kurzzeitgedächtnis und verwendet den Chatverlauf, solange in den aufeinanderfolgenden Aufrufen dieselbe SessionId als Eingabe übergeben wird.

Herzlichen Glückwunsch, Sie haben mit Knowledge Bases für Amazon Bedrock erfolgreich eine Chatbot-Anwendung erstellt und getestet.

Aufräumen

Wenn Ressourcen wie der S3-Bucket, die OpenSearch Serverless-Sammlung und die Wissensdatenbank nicht gelöscht werden, fallen Gebühren an. Um diese Ressourcen zu bereinigen, löschen Sie den CloudFormation-Stack, löschen Sie den S3-Bucket (einschließlich aller in diesem Bucket gespeicherten Dokumentordner und Dateien), löschen Sie die OpenSearch Serverless-Sammlung, löschen Sie die Wissensdatenbank und löschen Sie alle Rollen, Richtlinien und Berechtigungen, die Sie erhalten früher erstellt.

Zusammenfassung

In diesem Beitrag haben wir einen Überblick über kontextbezogene Chatbots gegeben und erklärt, warum sie wichtig sind. Wir haben die Komplexität beschrieben, die mit den Arbeitsabläufen zur Datenerfassung und Textgenerierung für eine RAG-Architektur verbunden ist. Anschließend stellten wir vor, wie Knowledge Bases für Amazon Bedrock ein vollständig verwaltetes serverloses RAG-System einschließlich eines Vektorspeichers erstellt. Schließlich haben wir eine Lösungsarchitektur und Beispielcode in einem bereitgestellt GitHub Repo um mithilfe einer Wissensdatenbank kontextbezogene Antworten für eine Chatbot-Anwendung abzurufen und zu generieren.

Durch die Erläuterung des Werts kontextbezogener Chatbots, der Herausforderungen von RAG-Systemen und der Art und Weise, wie Knowledge Bases für Amazon Bedrock diese Herausforderungen angeht, wollte dieser Beitrag zeigen, wie Amazon Bedrock es Ihnen ermöglicht, anspruchsvolle Konversations-KI-Anwendungen mit minimalem Aufwand zu erstellen.

Weitere Informationen finden Sie im Amazon Bedrock-Entwicklerhandbuch und Wissensdatenbank-APIs.

Über die Autoren

Manisch Chugh ist Principal Solutions Architect bei AWS mit Sitz in San Francisco, Kalifornien. Er ist spezialisiert auf maschinelles Lernen und generative KI. Er arbeitet mit Organisationen von Großunternehmen bis hin zu Startups in der Frühphase an Problemen im Zusammenhang mit maschinellem Lernen. Zu seinen Aufgaben gehört es, diese Organisationen bei der Entwicklung skalierbarer, sicherer und kosteneffizienter Workloads auf AWS zu unterstützen. Er hält regelmäßig Vorträge auf AWS-Konferenzen und anderen Partnerveranstaltungen. Außerhalb der Arbeit wandert er gerne auf den Wegen von East Bay, fährt Rennrad und schaut (und spielt) Cricket.

Manisch Chugh ist Principal Solutions Architect bei AWS mit Sitz in San Francisco, Kalifornien. Er ist spezialisiert auf maschinelles Lernen und generative KI. Er arbeitet mit Organisationen von Großunternehmen bis hin zu Startups in der Frühphase an Problemen im Zusammenhang mit maschinellem Lernen. Zu seinen Aufgaben gehört es, diese Organisationen bei der Entwicklung skalierbarer, sicherer und kosteneffizienter Workloads auf AWS zu unterstützen. Er hält regelmäßig Vorträge auf AWS-Konferenzen und anderen Partnerveranstaltungen. Außerhalb der Arbeit wandert er gerne auf den Wegen von East Bay, fährt Rennrad und schaut (und spielt) Cricket.

Mani Chanuja ist Tech Lead – Generative AI Specialists, Autorin des Buches Applied Machine Learning and High Performance Computing on AWS und Mitglied des Vorstands der Women in Manufacturing Education Foundation. Sie leitet Projekte zum maschinellen Lernen in verschiedenen Bereichen wie Computer Vision, Verarbeitung natürlicher Sprache und generative KI. Sie spricht auf internen und externen Konferenzen wie AWS re:Invent, Women in Manufacturing West, YouTube-Webinaren und GHC 23. In ihrer Freizeit unternimmt sie gerne lange Läufe am Strand.

Mani Chanuja ist Tech Lead – Generative AI Specialists, Autorin des Buches Applied Machine Learning and High Performance Computing on AWS und Mitglied des Vorstands der Women in Manufacturing Education Foundation. Sie leitet Projekte zum maschinellen Lernen in verschiedenen Bereichen wie Computer Vision, Verarbeitung natürlicher Sprache und generative KI. Sie spricht auf internen und externen Konferenzen wie AWS re:Invent, Women in Manufacturing West, YouTube-Webinaren und GHC 23. In ihrer Freizeit unternimmt sie gerne lange Läufe am Strand.

Pallavi Nargund ist Principal Solutions Architect bei AWS. In ihrer Rolle als Cloud-Technologie-Enabler arbeitet sie mit Kunden zusammen, um deren Ziele und Herausforderungen zu verstehen und präskriptive Anleitungen zu geben, damit sie ihr Ziel mit AWS-Angeboten erreichen. Sie engagiert sich leidenschaftlich für Frauen in der Technologiebranche und ist Kernmitglied von Women in AI/ML bei Amazon. Sie spricht auf internen und externen Konferenzen wie AWS re:Invent, AWS Summits und Webinaren. Außerhalb der Arbeit engagiert sie sich gerne ehrenamtlich, arbeitet im Garten, fährt Fahrrad und wandert.

Pallavi Nargund ist Principal Solutions Architect bei AWS. In ihrer Rolle als Cloud-Technologie-Enabler arbeitet sie mit Kunden zusammen, um deren Ziele und Herausforderungen zu verstehen und präskriptive Anleitungen zu geben, damit sie ihr Ziel mit AWS-Angeboten erreichen. Sie engagiert sich leidenschaftlich für Frauen in der Technologiebranche und ist Kernmitglied von Women in AI/ML bei Amazon. Sie spricht auf internen und externen Konferenzen wie AWS re:Invent, AWS Summits und Webinaren. Außerhalb der Arbeit engagiert sie sich gerne ehrenamtlich, arbeitet im Garten, fährt Fahrrad und wandert.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/build-a-contextual-chatbot-application-using-knowledge-bases-for-amazon-bedrock/

- :hast

- :Ist

- :Wo

- $UP

- 100

- 125

- 2019

- 2020

- 2021

- 2022

- 23

- 27

- 500

- 7

- 8

- 9

- a

- Fähigkeit

- Über Uns

- beschleunigen

- Zugang

- Zugriff

- Nach

- Konto

- genau

- Erreichen

- über

- Action

- hinzufügen

- Zusätzliche

- Adressen

- advanced

- Vorteilen

- Berater

- aufs Neue

- Agenten

- AI

- KI-Systeme

- AI / ML

- gezielt

- Alle

- Zulassen

- erlaubt

- allein

- entlang

- neben

- ebenfalls

- Amazon

- Amazon Web Services

- an

- und

- jährlich

- JAHRESUMSATZ

- beantworten

- Beantwortung

- Anthropisch

- jedem

- Bienen

- APIs

- App

- Anwendung

- Anwendungen

- angewandt

- Ansatz

- Architektur

- SIND

- AS

- At

- vermehren

- Augmented

- Augmentationen

- Aurora

- Autor

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- Avenue

- ein Weg

- AWS

- AWS CloudFormation

- AWS re: Invent

- Zurück

- Base

- basierend

- basic

- Bucht

- Beach

- werden

- war

- Bevor

- Anfang

- beginnt

- Verhalten

- glaubt,

- Besser

- Milliarde

- Tafel

- Vorstand

- buchen

- Marke

- Browser

- bauen

- Geschäft

- Geschäftsanwendungen

- by

- CA

- rufen Sie uns an!

- Aufrufe

- CAN

- Fähigkeiten

- Hauptstadt

- Fälle

- CD

- Herausforderungen

- Übernehmen

- Änderungen

- Gebühren

- Chat

- Chatbot

- Chatbots

- Kasse

- Chip

- Pommes frites

- Wahl

- Auswählen

- reinigen

- cli

- Cloud

- CLOUD-TECHNOLOGIE

- Code

- Sammlung

- vereint

- wie die

- kommt

- gemeinsam

- Unternehmen

- Unternehmen

- abschließen

- Komplexität

- Komponenten

- rechnerisch

- Computer

- Computer Vision

- Computing

- Kongressbegleitung

- Vernetz Dich

- Konsul (Console)

- Verbraucher

- Kontext

- kontextuelle

- kontextualisieren

- fortsetzen

- Gespräch

- Konversations

- Konversations-KI

- Gespräche

- umgewandelt

- Kernbereich

- Unternehmen

- kostengünstiger

- könnte

- erstellen

- erstellt

- schafft

- Erstellen

- Schaffung

- Schöpfer

- Kricket

- Zur Zeit

- Kunde

- Kundenverhalten

- Customer Experience

- Kundenservice

- Kunden

- maßgeschneiderte

- technische Daten

- Datenpunkte

- datengesteuerte

- Datenbase

- Tage

- Standard

- Übergeben

- geliefert

- liefern

- Abhängig

- Einsatz

- Einsatz

- beschrieben

- Beschreibung

- Details

- Bestimmen

- entwickeln

- Entwickler:in / Unternehmen

- Entwicklung

- Diagramm

- DID

- anders

- digital

- Geschäftsführung

- verschieden

- Dokument

- Unterlagen

- Dabei

- Dollar

- Domains

- Nicht

- nach unten

- herunterladen

- jeder

- Früher

- Startup-Gründer

- Osten

- Bildungswesen

- effizient

- Anstrengung

- mühelos

- entweder

- Einbettung

- Mitarbeiter

- ermöglichen

- Ermöglicher

- ermöglicht

- Eingriff

- Motor

- Entwicklung

- verbesserte

- Eine Verbesserung der

- Enter

- Unternehmen

- Unternehmen

- Arbeitsumfeld

- Fehler

- Sogar

- Veranstaltungen

- Jedes

- Beispiel

- ERFAHRUNGEN

- Erfahrungen

- Expertise

- Erklären

- erklärt

- Erläuterung

- extern

- Fakten

- FAIL

- wenige

- Feld

- Reichen Sie das

- Mappen

- Endlich

- findet

- Vorname

- Fluss

- Setzen Sie mit Achtsamkeit

- Folgende

- Aussichten für

- Foundation

- vier

- Francisco cisco~~POS=HEADCOMP

- Frei

- für

- voll

- Funktion

- g1

- erzeugen

- erzeugt

- Generation

- generativ

- Generative KI

- Git

- GitHub

- ABSICHT

- Go

- Ziele

- wuchs

- Boden

- Wachsen Sie über sich hinaus

- Wächst

- die Vermittlung von Kompetenzen,

- hätten

- Griff

- Griffe

- Haben

- he

- schwer

- schweres Heben

- Unternehmen

- hier (auf dänisch)

- GUTE

- High-Level

- seine

- Geschichte

- Startseite

- Ultraschall

- aber

- HTML

- http

- HTTPS

- hundert

- ID

- if

- veranschaulichen

- zeigt

- Umsetzung

- wichtig

- zu unterstützen,

- Verbesserung

- Verbesserung

- in

- Dazu gehören

- Einschließlich

- integrieren

- beinhaltet

- Erhöhung

- hat

- Index

- Indizes

- Krankengymnastik

- Branchen

- informieren

- Information

- Information Systems

- Varianten des Eingangssignals:

- Anfragen

- Einblicke

- installieren

- sofortig

- integrieren

- Integration

- Integration

- interagiert

- Interessen

- Schnittstelle

- intern

- innen

- in

- einführen

- eingeführt

- Investitionen

- ruft auf

- beteiligt

- beinhaltet

- IT

- jpg

- Wesentliche

- Wissen

- Sprache

- Sprachen

- grosse

- Große Unternehmen

- Nachname

- später

- ins Leben gerufen

- Schicht

- führen

- umwandeln

- lernen

- am wenigsten

- Verlassen

- weniger

- Brief

- Niveau

- Bibliotheken

- Bibliothek

- Facelift

- Gefällt mir

- Gleichen

- Limitiert

- Line

- Linking

- LLM

- aus einer regionalen

- Lang

- Maschine

- Maschinelles Lernen

- Main

- MACHT

- handhabbar

- verwaltet

- Managed

- flächendeckende Gesundheitsprogramme

- Herstellung

- viele

- Spiel

- Kann..

- me

- Bedeutung

- Mechanismus

- Mitglied

- Memory

- nur

- Million

- Millionen Dollar

- minimal

- Minute

- Minuten

- Modell

- für

- ändern

- mehr

- vor allem warme

- mehrere

- Name

- Natürliche

- Verarbeitung natürlicher Sprache

- Navigieren

- Menü

- Need

- erforderlich

- Bedürfnisse

- Neu

- weiter

- nicht

- Andere

- beachten

- Notizbuch

- bekannt

- Ziel

- of

- bieten

- Angebote

- Angebote

- Office

- vorgenommen,

- on

- EINEM

- XNUMXh geöffnet

- Open-Source-

- optimal

- Option

- Optionen

- or

- Organisationen

- Andere

- Andernfalls

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- aussen

- übrig

- oben

- Überblick

- besitzen

- Seite

- Brot

- Parameter

- Partner

- Teile

- Durchgang

- Passagen

- Bestanden

- leidenschaftlich

- passt

- Schnittmuster

- Prozentsatz

- Leistung

- Berechtigungen

- Personalisiert

- Plan

- Plato

- Datenintelligenz von Plato

- PlatoData

- spielend

- Points

- Punkte

- Politik durchzulesen

- Beliebt

- Popularität

- Post

- Werkzeuge

- angetriebene

- größte treibende

- Vorlieben

- Gegenwart

- vorgeführt

- Geschenke

- früher

- Principal

- Probleme

- Prozessdefinierung

- Verarbeitung

- Prozessoren

- Produkte

- Fortschritt

- Projekte

- Eingabeaufforderungen

- Eigentums-

- die

- vorausgesetzt

- bietet

- Bereitstellung

- Einkäufe

- Python

- Abfragen

- query

- Frage

- Fragen

- Direkt

- Lappen

- Bereich

- RE

- bereit

- echt

- realen Welt

- Echtzeit

- Aufzeichnungen

- Veteran

- Reduzierung

- siehe

- Regionen

- regelmäßig

- bezogene

- Relevanz

- relevant

- entfernt

- Meldungen

- Quelle

- vertreten

- Anforderung

- falls angefordert

- erfordert

- Downloads

- Reagieren

- Antwort

- Antworten

- Abruf

- Rückgabe

- Einnahmen

- Überprüfen

- Straße

- Rollen

- Rollen

- Führen Sie

- läuft

- Laufzeit

- gleich

- Sample

- San

- San Francisco

- Gerettet

- skalierbaren

- Skalierung

- Skript

- Sdk

- Suche

- Abschnitt

- Abschnitte

- Verbindung

- sehen

- wählen

- ausgewählt

- semantisch

- geschickt

- brauchen

- Serverlos

- Lösungen

- Sitzung

- kompensieren

- Einstellungen

- Setup

- Aktionär

- Aktionäre

- sie

- kurzfristig

- sollte

- Vitrine

- signifikant

- ähnlich

- gleichzeitig

- Single

- Größe

- kleinere

- Lösung

- Lösungen

- einige

- anspruchsvoll

- Quelle

- Quellen

- spricht

- Spezialisten

- spezialisiert

- spezifisch

- angegeben

- gespalten

- Spagat

- Stapel

- Anfang

- Startups

- Bundesstaat

- Status

- stammt

- Schritt

- Shritte

- speichern

- gelagert

- Läden

- Speicherung

- einfach

- Strategie

- rationalisieren

- abschicken

- Folge

- im Wesentlichen

- Erfolgreich

- so

- vorschlagen

- Summits

- Support

- Unterstützte

- Unterstützt

- synchronisieren

- System

- Systeme und Techniken

- Tabelle

- zugeschnitten

- Nehmen

- nimmt

- und Aufgaben

- Tech

- Technologie

- Vorlage

- Terminal

- Test

- getestet

- Text

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- die Informationen

- Die Quelle

- ihr

- Sie

- dann

- Dort.

- deswegen

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- diejenigen

- nach drei

- Durch

- Zeit

- Titan

- zu

- Transformieren

- auslösen

- vertraut

- versuchen

- XNUMX

- Typen

- für

- verstehen

- Aktualisierung

- hochgeladen

- -

- benutzt

- Mitglied

- Nutzer

- verwendet

- Verwendung von

- Nutzen

- v1

- wertvoll

- Wert

- Werte

- verschiedene

- Seh-

- Volumen

- wollen

- wurde

- beobachten

- Weg..

- we

- Netz

- Web-Browser

- Web-Services

- Webbasiert

- Webinare

- Woche

- Wochen

- West

- Was

- wann

- welche

- während

- warum

- werden wir

- Fenster

- mit

- Damen

- Frauen in der Technik

- Arbeiten

- Arbeitsablauf.

- Workflows

- arbeiten,

- Werk

- schreiben

- Code schreiben

- geschrieben

- YAML

- Jahr

- Jahr

- Du

- Ihr

- Youtube

- Zephyrnet