Mit dem Aufkommen von Hochgeschwindigkeits-5G-Mobilfunknetzen sind Unternehmen leichter denn je in der Lage, die Konvergenz von Telekommunikationsnetzen und der Cloud zu nutzen. Als einer der bisher prominentesten Anwendungsfälle hat maschinelles Lernen (ML) am Edge Unternehmen ermöglicht, ML-Modelle näher an ihren Endkunden bereitzustellen, um die Latenz zu reduzieren und die Reaktionsfähigkeit ihrer Anwendungen zu erhöhen. Als Beispiel, intelligente Lösungen für Veranstaltungsorte kann Computer Vision nahezu in Echtzeit für Crowd-Analysen über 5G-Netzwerke verwenden und gleichzeitig die Investitionen in lokale Hardware-Netzwerkausrüstung minimieren. Mit Natural Language Processing (NLP), Echtzeit-Empfehlungssystemen und Betrugserkennung können Einzelhändler unterwegs reibungslosere Erlebnisse bieten. Selbst Boden- und Luftrobotik können ML verwenden, um sicherere, autonomere Operationen zu ermöglichen.

Um die Eintrittsbarriere für ML am Edge zu verringern, wollten wir ein Beispiel für die Bereitstellung eines vorab trainierten Modells demonstrieren Amazon Sage Maker zu AWS Wellenlänge, alles in weniger als 100 Codezeilen. In diesem Beitrag demonstrieren wir, wie ein SageMaker-Modell in AWS Wavelength bereitgestellt wird, um die Modellinferenzlatenz für 5G-Netzwerk-basierte Anwendungen zu reduzieren.

Lösungsüberblick

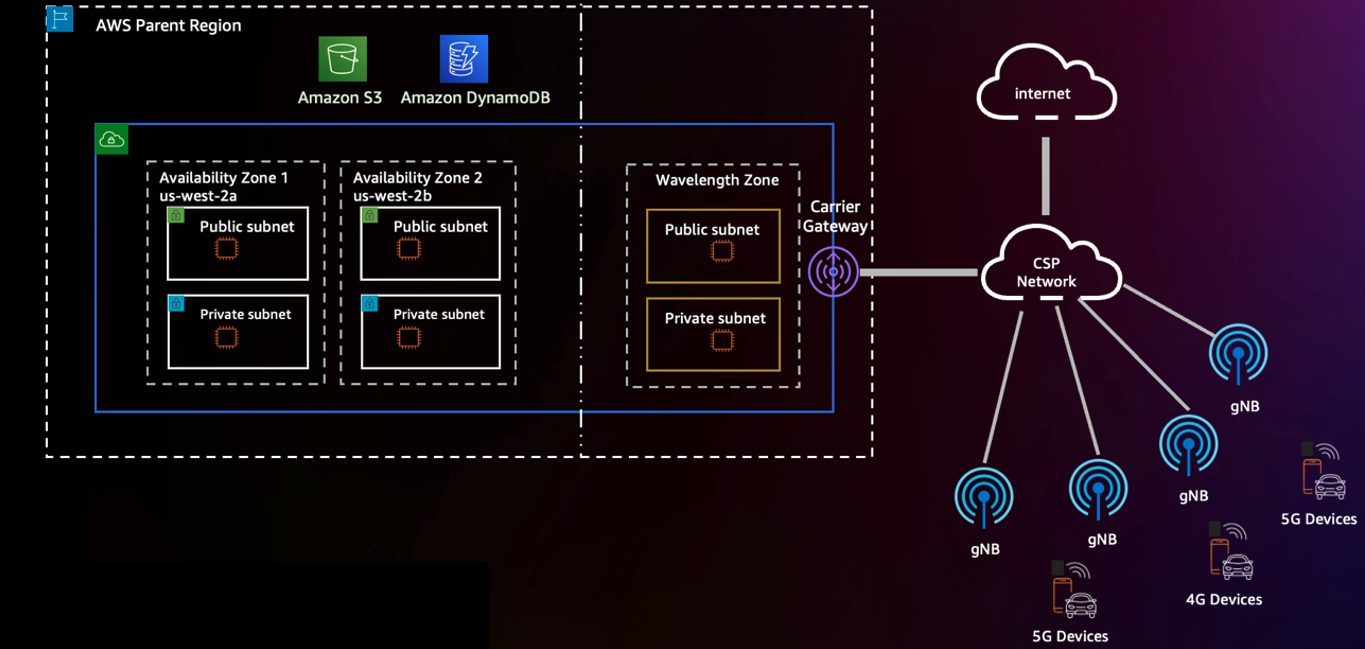

In der schnell wachsenden globalen Infrastruktur von AWS bringt AWS Wavelength die Leistung von Cloud-Computing und -Speicherung an den Rand von 5G-Netzwerken und ermöglicht so leistungsfähigere mobile Erfahrungen. Mit AWS Wavelength können Sie Ihre Virtual Private Cloud (VPC) auf Wavelength Zones erweitern, die dem Netzwerk-Edge des Telekommunikationsanbieters entsprechen 29 Städte über den Globus. Das folgende Diagramm zeigt ein Beispiel für diese Architektur.

Sie können sich über die für die Wavelength Zones innerhalb einer bestimmten Region anmelden AWS-Managementkonsole oder im AWS-Befehlszeilenschnittstelle (AWS-CLI). Weitere Informationen zum Bereitstellen geografisch verteilter Anwendungen auf AWS Wavelength finden Sie unter Stellen Sie geografisch verteilte Amazon EKS-Cluster auf AWS Wavelength bereit.

Aufbauend auf den in diesem Beitrag besprochenen Grundlagen betrachten wir ML am Rand als Beispiel-Workload für die Bereitstellung auf AWS Wavelength. Als Beispiel-Workload stellen wir ein vortrainiertes Modell von bereit Amazon SageMaker-JumpStart.

SageMaker ist ein vollständig verwalteter ML-Service, der es Entwicklern ermöglicht, ML-Modelle einfach in ihren AWS-Umgebungen bereitzustellen. Obwohl AWS eine Reihe von Optionen für das Modelltraining bietet – von AWS-Marktplatz Modelle und in SageMaker integrierte Algorithmen – es gibt eine Reihe von Techniken zum Bereitstellen von Open-Source-ML-Modellen.

JumpStart bietet Zugriff auf Hunderte von integrierten Algorithmen mit vortrainierten Modellen, die nahtlos auf SageMaker-Endpunkten bereitgestellt werden können. Von vorausschauender Wartung und Computer Vision bis hin zu autonomem Fahren und Betrugserkennung unterstützt JumpStart eine Vielzahl beliebter Anwendungsfälle mit Ein-Klick-Bereitstellung auf der Konsole.

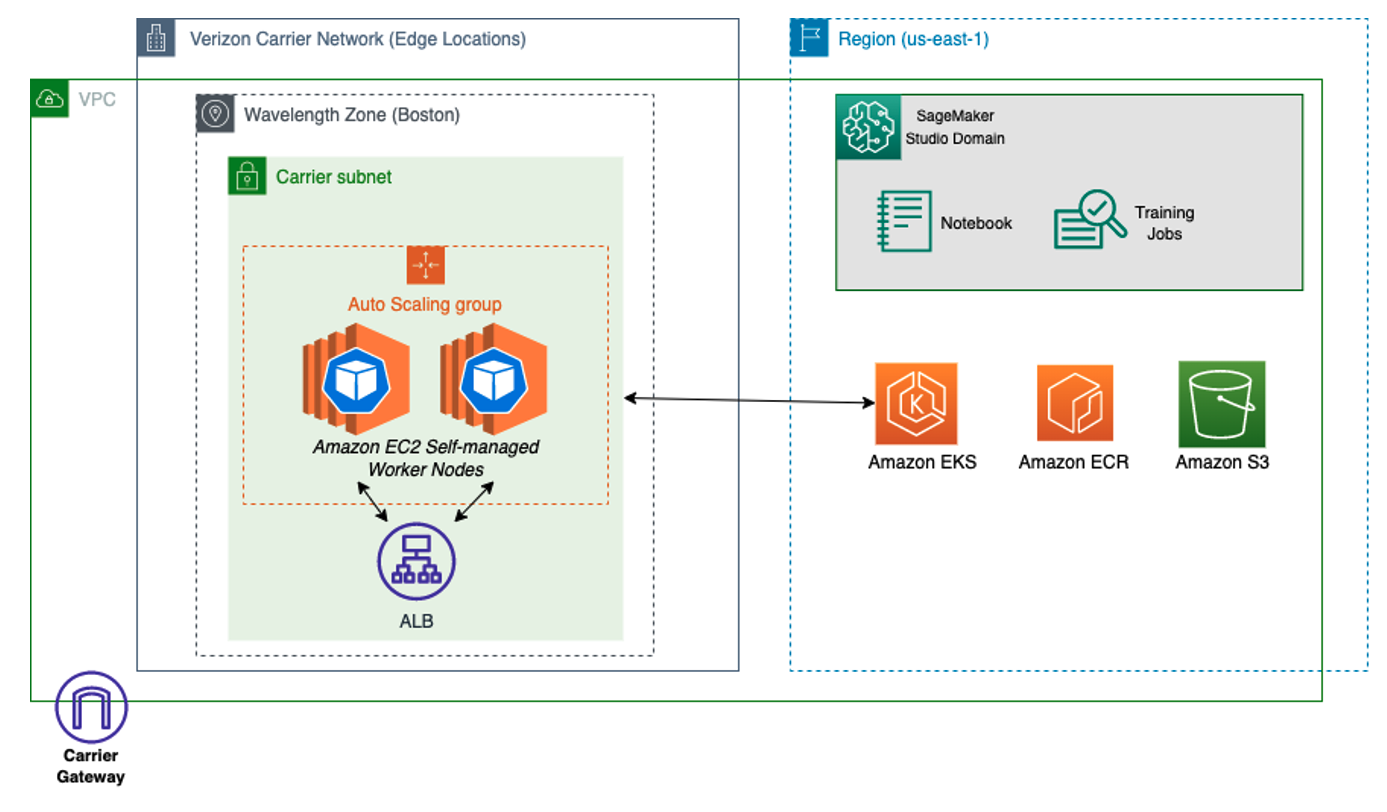

Da SageMaker in Wavelength Zones nicht nativ unterstützt wird, demonstrieren wir, wie die Modellartefakte aus der Region extrahiert und am Edge erneut bereitgestellt werden. Dazu verwenden Sie Amazon Elastic Kubernetes-Service (Amazon EKS)-Cluster und -Knotengruppen in Wavelength Zones, gefolgt von der Erstellung eines Bereitstellungsmanifests mit dem von JumpStart generierten Container-Image. Das folgende Diagramm veranschaulicht diese Architektur.

Voraussetzungen:

Um dies so einfach wie möglich zu gestalten, stellen Sie sicher, dass für Ihr AWS-Konto Wavelength Zones aktiviert sind. Beachten Sie, dass diese Integration nur in verfügbar ist us-east-1 und us-west-2, und Sie werden verwenden us-east-1 für die Dauer der Demo.

Um sich für AWS Wavelength anzumelden, führen Sie die folgenden Schritte aus:

- Wählen Sie in der Amazon VPC-Konsole aus Zonen für Einstellungen und wählen Sie USA Ost (Verizon) / us-east-1-wl1.

- Auswählen Verwalten.

- Auswählen Angemeldet.

- Auswählen Zonen aktualisieren.

Erstellen Sie eine AWS Wavelength-Infrastruktur

Bevor wir den lokalen Inferenzendpunkt des SageMaker-Modells in eine Kubernetes-Bereitstellung konvertieren, können Sie einen EKS-Cluster in einer Wavelength Zone erstellen. Stellen Sie dazu einen Amazon EKS-Cluster mit einer AWS Wavelength-Knotengruppe bereit. Um mehr zu erfahren, können Sie besuchen dieses Handbuch im AWS Containers Blog or Das 5GEdgeTutorials-Repository von Verizon für ein solches Beispiel.

Als nächstes verwenden Sie eine AWS Cloud9 Umgebung oder interaktive Entwicklungsumgebung (IDE) Ihrer Wahl, laden Sie die erforderlichen SageMaker-Pakete herunter und Docker komponieren, eine Schlüsselabhängigkeit von JumpStart.

Erstellen Sie Modellartefakte mit JumpStart

Stellen Sie zunächst sicher, dass Sie eine haben AWS Identity and Access Management and (IAM)-Ausführungsrolle für SageMaker. Um mehr zu erfahren, besuchen Sie SageMaker-Rollen.

- Die richtigen Dieses Beispiel, erstellen Sie eine Datei mit dem Namen train_model.py, die das SageMaker Software Development Kit (SDK) verwendet, um ein vorgefertigtes Modell abzurufen (replace mit dem Amazon-Ressourcennamen (ARN) Ihrer SageMaker-Ausführungsrolle). In dieser Datei stellen Sie ein Modell lokal mithilfe der

instance_typeAttribut in dermodel.deploy()-Funktion, die einen Docker-Container in Ihrer IDE mit allen erforderlichen Modellartefakten startet, die Sie definiert haben:

- Als nächstes einstellen

infer_model_idan die ID des SageMaker-Modells, das Sie verwenden möchten.

Eine vollständige Liste finden Sie unter Eingebaute Algorithmen mit vortrainierter Modelltabelle. In unserem Beispiel verwenden wir das BERT-Modell (Bidirectional Encoder Representations from Transformers), das häufig für die Verarbeitung natürlicher Sprache verwendet wird.

- Führen Sie die

train_model.pySkript zum Abrufen der JumpStart-Modellartefakte und Bereitstellen des vorab trainierten Modells auf Ihrem lokalen Computer:

Sollte dieser Schritt erfolgreich sein, könnte Ihre Ausgabe wie folgt aussehen:

In der Ausgabe sehen Sie der Reihe nach drei Artefakte: das Basisbild für die TensorFlow-Inferenz, das Inferenzskript, das das Modell bedient, und die Artefakte, die das trainierte Modell enthalten. Obwohl Sie mit diesen Artefakten ein benutzerdefiniertes Docker-Image erstellen könnten, besteht ein anderer Ansatz darin, SageMaker im lokalen Modus das Docker-Image für Sie erstellen zu lassen. In den nachfolgenden Schritten extrahieren wir das lokal ausgeführte Container-Image und stellen es bereit Amazon Elastic Container-Registrierung (Amazon ECR) als auch das Modellartefakt separat dazu schieben Amazon Simple Storage-Service (Amazon S3).

Konvertieren Sie Artefakte im lokalen Modus in eine Remote-Kubernetes-Bereitstellung

Nachdem Sie nun bestätigt haben, dass SageMaker lokal funktioniert, extrahieren wir das Bereitstellungsmanifest aus dem ausgeführten Container. Führen Sie die folgenden Schritte aus:

Identifizieren Sie den Speicherort des SageMaker-Bereitstellungsmanifests für den lokalen Modus: Durchsuchen Sie dazu unser Stammverzeichnis nach allen genannten Dateien docker-compose.yaml.

docker_manifest=$( find /tmp/tmp* -name "docker-compose.yaml" -printf '%T+ %pn' | sort | tail -n 1 | cut -d' ' -f2-)

echo $docker_manifestIdentifizieren Sie den Speicherort der SageMaker-Modellartefakte im lokalen Modus: Suchen Sie als Nächstes das zugrunde liegende Volume, das im lokalen SageMaker-Inferenzcontainer gemountet ist, der in jedem EKS-Worker-Knoten verwendet wird, nachdem wir das Artefakt auf Amazon s3 hochgeladen haben.

model_local_volume = $(grep -A1 -w "volumes:" $docker_manifest | tail -n 1 | tr -d ' ' | awk -F: '{print $1}' | cut -c 2-) # Returns something like: /tmp/tmpcr4bu_a7</p>Lokale Kopie des ausgeführten SageMaker-Inferenzcontainers erstellen: Als Nächstes suchen wir das derzeit ausgeführte Container-Image, auf dem unser Machine-Learning-Inferenzmodell ausgeführt wird, und erstellen lokal eine Kopie des Containers. Dadurch wird sichergestellt, dass wir über eine eigene Kopie des Container-Images verfügen, die wir aus Amazon ECR abrufen können.

# Find container ID of running SageMaker Local container

mkdir sagemaker-container

container_id=$(docker ps --format "{{.ID}} {{.Image}}" | grep "tensorflow" | awk '{print $1}')

# Retrieve the files of the container locally

docker cp $my_container_id:/ sagemaker-container/Vor dem Handeln auf der model_local_volume, die wir nach Amazon S3 pushen werden, pushen Sie eine Kopie des laufenden Docker-Images, jetzt in der sagemaker-container Verzeichnis in Amazon Elastic Container Registry. Unbedingt ersetzen region, aws_account_id, docker_image_id und my-repository:tag oder folge dem Amazon ECR-Benutzerhandbuch. Notieren Sie sich außerdem unbedingt die endgültige ECR-Bild-URL (aws_account_id.dkr.ecr.region.amazonaws.com/my-repository:tag), die wir in unserer EKS-Bereitstellung verwenden werden.

Nachdem wir nun ein ECR-Image haben, das dem Inferenzendpunkt entspricht, erstellen Sie einen neuen Amazon S3-Bucket und kopieren Sie die SageMaker Local-Artefakte (model_local_volume) zu diesem Bucket. Erstellen Sie parallel dazu ein Identity Access Management (IAM), das Amazon EC2-Instances Zugriff zum Lesen von Objekten im Bucket gewährt. Unbedingt ersetzen mit einem global eindeutigen Namen für Ihren Amazon S3-Bucket.

Bearbeiten Sie als Nächstes die Benutzerdaten für Ihre EKS-Worker-Knoten, um sicherzustellen, dass jede EC2-Instance beim Start eine Kopie des Modellartefakts abruft. Stellen Sie in Ihrem Benutzerdatenskript sicher, dass jeder Knoten die Modellartefakte beim Start mithilfe der S3-API abruft. Unbedingt ersetzen mit einem global eindeutigen Namen für Ihren Amazon S3-Bucket. Da die Benutzerdaten des Knotens auch das EKS-Bootstrap-Skript enthalten, können die vollständigen Benutzerdaten in etwa so aussehen.

Jetzt können Sie das vorhandene Docker-Manifest überprüfen und es in Kubernetes-freundliche Manifestdateien übersetzen Komponieren, ein bekanntes Konvertierungstool. Hinweis: Wenn Sie einen Versionskompatibilitätsfehler erhalten, ändern Sie die version -Attribut in Zeile 27 von docker-compose.yml an “2”.

Nachdem Sie Kompose ausgeführt haben, sehen Sie vier neue Dateien: a Deployment Objekt, Service Objekt, PersistentVolumeClaim Objekt, und NetworkPolicy Objekt. Sie haben jetzt alles, was Sie brauchen, um Ihren Streifzug durch Kubernetes am Edge zu beginnen!

Stellen Sie SageMaker-Modellartefakte bereit

Stellen Sie sicher, dass Sie kubectl und aws-iam-authenticator auf Ihre AWS Cloud9 IDE heruntergeladen haben. Wenn nicht, befolgen Sie die Installationsanleitungen:

Führen Sie nun die folgenden Schritte aus:

ändern Sie die service/algo-1-ow3nv Objekt, um den Diensttyp umzuschalten ClusterIP zu NodePort. In unserem Beispiel haben wir als unseren Port 30,007 ausgewählt NodePort:

Als Nächstes müssen Sie den NodePort in der Sicherheitsgruppe für Ihren Knoten zulassen. Rufen Sie dazu die Sicherheitsgruppen-ID ab und setzen Sie den NodePort auf die Zulassungsliste:

Als nächstes ändern Sie die algo-1-ow3nv-deployment.yaml Manifest zum Mounten der /tmp/model hostPath Verzeichnis in den Container. Ersetzen mit dem zuvor erstellten ECR-Image:

Verwenden Sie mit den Manifestdateien, die Sie aus Kompose erstellt haben, kubectl, um die Konfigurationen auf Ihren Cluster anzuwenden:

Verbinden Sie sich mit dem 5G-Edge-Modell

Führen Sie die folgenden Schritte aus, um eine Verbindung zu Ihrem Modell herzustellen:

Rufen Sie auf der Amazon EC2-Konsole die Netzbetreiber-IP des EKS-Worker-Knotens ab oder verwenden Sie die AWS CLI, um die Netzbetreiber-IP-Adresse direkt abzufragen:

Nachdem Sie die IP-Adresse des Netzbetreibers extrahiert haben, können Sie sich jetzt über den NodePort direkt mit dem Modell verbinden. Erstellen Sie eine Datei namens invoke.py um das BERT-Modell direkt aufzurufen, indem eine textbasierte Eingabe bereitgestellt wird, die mit einem Stimmungsanalysator verglichen wird, um festzustellen, ob der Ton positiv oder negativ war:

Ihre Ausgabe sollte wie folgt aussehen:

Aufräumen

Um alle erstellten Anwendungsressourcen zu zerstören, löschen Sie die AWS Wavelength-Worker-Knoten, die EKS-Steuerungsebene und alle in der VPC erstellten Ressourcen. Löschen Sie außerdem das ECR-Repository, das zum Hosten des Container-Images verwendet wird, die S3-Buckets, die zum Hosten der SageMaker-Modellartefakte verwendet werden, und die sagemaker-demo-app-s3 IAM Politik.

Zusammenfassung

In diesem Beitrag haben wir einen neuartigen Ansatz zur Bereitstellung von SageMaker-Modellen am Netzwerkrand mit Amazon EKS und AWS Wavelength demonstriert. Informationen zu Best Practices von Amazon EKS auf AWS Wavelength finden Sie unter Stellen Sie geografisch verteilte Amazon EKS-Cluster auf AWS Wavelength bereit. Um mehr über Jumpstart zu erfahren, besuchen Sie außerdem die Amazon SageMaker JumpStart-Entwicklerhandbuch oder im Verfügbare JumpStart-Modelltabelle.

Über die Autoren

Robert Belson ist Developer Advocate in der AWS Worldwide Telecom Business Unit, spezialisiert auf AWS Edge Computing. Er konzentriert sich auf die Zusammenarbeit mit der Entwickler-Community und großen Unternehmenskunden, um ihre geschäftlichen Herausforderungen mithilfe von Automatisierung, Hybridnetzwerken und der Edge-Cloud zu lösen.

Robert Belson ist Developer Advocate in der AWS Worldwide Telecom Business Unit, spezialisiert auf AWS Edge Computing. Er konzentriert sich auf die Zusammenarbeit mit der Entwickler-Community und großen Unternehmenskunden, um ihre geschäftlichen Herausforderungen mithilfe von Automatisierung, Hybridnetzwerken und der Edge-Cloud zu lösen.

Mohammed Al-Mehdar ist Senior Solutions Architect in der Worldwide Telecom Business Unit bei AWS. Sein Hauptaugenmerk liegt darauf, Kunden dabei zu unterstützen, Telco- und Unternehmens-IT-Workloads auf AWS aufzubauen und bereitzustellen. Bevor er zu AWS kam, war Mohammed über 13 Jahre in der Telekommunikationsbranche tätig und bringt einen reichen Erfahrungsschatz in den Bereichen LTE Packet Core, 5G, IMS und WebRTC mit. Mohammed hat einen Bachelor-Abschluss in Telekommunikationstechnik von der Concordia University.

Mohammed Al-Mehdar ist Senior Solutions Architect in der Worldwide Telecom Business Unit bei AWS. Sein Hauptaugenmerk liegt darauf, Kunden dabei zu unterstützen, Telco- und Unternehmens-IT-Workloads auf AWS aufzubauen und bereitzustellen. Bevor er zu AWS kam, war Mohammed über 13 Jahre in der Telekommunikationsbranche tätig und bringt einen reichen Erfahrungsschatz in den Bereichen LTE Packet Core, 5G, IMS und WebRTC mit. Mohammed hat einen Bachelor-Abschluss in Telekommunikationstechnik von der Concordia University.

Evan Kravitz ist Softwareentwickler bei Amazon Web Services und arbeitet an SageMaker JumpStart. Er kocht gerne und geht gerne in New York City laufen.

Evan Kravitz ist Softwareentwickler bei Amazon Web Services und arbeitet an SageMaker JumpStart. Er kocht gerne und geht gerne in New York City laufen.

Justin St. Arnauld ist Associate Director – Solution Architects bei Verizon für den öffentlichen Sektor mit über 15 Jahren Erfahrung in der IT-Branche. Er ist ein leidenschaftlicher Verfechter der Leistungsfähigkeit von Edge-Computing und 5G-Netzwerken und ein Experte für die Entwicklung innovativer Technologielösungen, die diese Technologien nutzen. Justin ist besonders begeistert von den Möglichkeiten, die Amazon Web Services (AWS) bei der Bereitstellung innovativer Lösungen für seine Kunden bietet. In seiner Freizeit hält sich Justin gerne über die neuesten Technologietrends auf dem Laufenden und teilt sein Wissen und seine Erkenntnisse mit anderen in der Branche.

Justin St. Arnauld ist Associate Director – Solution Architects bei Verizon für den öffentlichen Sektor mit über 15 Jahren Erfahrung in der IT-Branche. Er ist ein leidenschaftlicher Verfechter der Leistungsfähigkeit von Edge-Computing und 5G-Netzwerken und ein Experte für die Entwicklung innovativer Technologielösungen, die diese Technologien nutzen. Justin ist besonders begeistert von den Möglichkeiten, die Amazon Web Services (AWS) bei der Bereitstellung innovativer Lösungen für seine Kunden bietet. In seiner Freizeit hält sich Justin gerne über die neuesten Technologietrends auf dem Laufenden und teilt sein Wissen und seine Erkenntnisse mit anderen in der Branche.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/deploy-pre-trained-models-on-aws-wavelength-with-5g-edge-using-amazon-sagemaker-jumpstart/

- :Ist

- 1

- 10

- 100

- 11

- 15 Jahre

- 5G

- 7

- 8

- 9

- a

- Über Uns

- Akzeptieren

- Zugang

- Konto

- über

- Action

- zusätzlich

- Adresse

- Advent

- Anwalt

- Nach der

- gegen

- Algorithmen

- Alle

- erlaubt

- Obwohl

- immer

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon SageMaker-JumpStart

- Amazon Web Services

- Amazon Web Services (AWS)

- Analytik

- und

- Ein anderer

- Bienen

- Anwendung

- Anwendungen

- Bewerben

- Ansatz

- Architektur

- SIND

- Bereiche

- AS

- Partnerschaftsräte

- Verein

- At

- Automation

- Autonom

- verfügbar

- AWS

- AWS Cloud9

- Barriere

- Base

- BE

- beginnen

- BESTE

- Best Practices

- Bootstrap

- Brings

- bauen

- eingebaut

- Geschäft

- by

- namens

- CAN

- Fähigkeiten

- Fälle

- CAT

- CD

- Herausforderungen

- Übernehmen

- Wahl

- Auswählen

- Stadt

- Kunden

- näher

- Cloud

- Cloud9

- Cluster

- Code

- COM

- häufig

- community

- Kompatibilität

- abschließen

- Berechnen

- Computer

- Computer Vision

- Computing

- BESTÄTIGT

- Vernetz Dich

- Konsul (Console)

- Container

- Behälter

- Smartgeräte App

- Konvergenz

- Umwandlung (Conversion)

- verkaufen

- Kernbereich

- Dazugehörigen

- könnte

- erstellen

- erstellt

- Erstellen

- Menschenmenge

- Zur Zeit

- Original

- Kunden

- Schneiden

- innovativ, auf dem neuesten Stand

- technische Daten

- Datum

- definiert

- Grad

- Übergeben

- liefern

- zeigen

- Synergie

- Abhängigkeit

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- zerstören

- Entdeckung

- Bestimmen

- Entwickler:in / Unternehmen

- Entwickler

- Entwicklung

- Entwicklung

- Direkt

- Direktor

- diskutiert

- Docker

- herunterladen

- Fahren

- jeder

- Früher

- leicht

- Osten

- Echo

- Edge

- Edge-Computing

- bewirken

- ermöglichen

- freigegeben

- Endpunkt

- Ingenieur

- Entwicklung

- gewährleisten

- Unternehmen

- Unternehmen

- begeistert

- Eintrag

- Arbeitsumfeld

- Umgebungen

- Ausrüstung

- Fehler

- Sogar

- ÜBERHAUPT

- alles

- Beispiel

- Ausführung

- vorhandenen

- Ausbau

- ERFAHRUNGEN

- Erfahrungen

- Experte

- erweitern

- Extrakt

- Reichen Sie das

- Mappen

- Finale

- Finden Sie

- Setzen Sie mit Achtsamkeit

- konzentriert

- folgen

- gefolgt

- Folgende

- Aussichten für

- Beutezug

- Betrug

- Betrugserkennung

- Frei

- reibungslos

- für

- voll

- Funktion

- Grundlagen

- erzeugt

- bekommen

- gegeben

- Global

- Global

- Globus

- Go

- gehen

- Gruppe an

- Gruppen

- Guide

- Anleitungen

- Hardware

- Geschirr

- Haben

- Hilfe

- hält

- Gastgeber

- Ultraschall

- Hilfe

- HTML

- http

- HTTPS

- hunderte

- Hybrid

- ID

- Identitätsschutz

- Image

- importieren

- in

- das

- Erhöhung

- Energiegewinnung

- Infrastruktur

- innovativ

- innovative Technologie

- Varianten des Eingangssignals:

- Einblicke

- installieren

- Instanz

- Integration

- interaktive

- Investition

- IP

- IP Address

- IT

- IT Industrie

- Beitritt

- jpg

- JSON

- Niklas

- Aufbewahrung

- Wesentliche

- Art

- Bausatz (SDK)

- Wissen

- Etiketten

- Sprache

- grosse

- Latency

- neueste

- starten

- LERNEN

- lernen

- Hebelwirkung

- Gefällt mir

- Line

- Linien

- Liste

- aus einer regionalen

- örtlich

- Standorte

- aussehen

- Maschine

- Maschinelles Lernen

- Main

- Wartung

- um

- verwaltet

- Management

- Metadaten

- minimieren

- ML

- Mobil

- Mobilfunknetze

- Model

- Modell

- für

- ändern

- mehr

- vor allem warme

- MOUNT

- Name

- Namens

- Natürliche

- Verarbeitung natürlicher Sprache

- Need

- Negativ

- Netzwerk

- netzwerkbasiert

- Vernetzung

- Netzwerke

- Neu

- New York

- New York City

- weiter

- Nlp

- Knoten

- Fiber Node

- Roman

- Anzahl

- Objekt

- Objekte

- of

- angeboten

- Angebote

- on

- EINEM

- Open-Source-

- Einkauf & Prozesse

- Gelegenheit

- Optionen

- Auftrag

- Anders

- Möglichkeiten für das Ausgangssignal:

- besitzen

- Pakete

- Parallel

- besonders

- leidenschaftlich

- Weg

- Plato

- Datenintelligenz von Plato

- PlatoData

- Datenschutzrichtlinien

- Beliebt

- positioniert

- positiv

- möglich

- Post

- Werkzeuge

- Praktiken

- Predictor

- Vor

- privat

- Verarbeitung

- prominent

- bietet

- Bereitstellung

- Öffentlichkeit

- Pullover

- Push

- schnell

- Lesen Sie mehr

- Echtzeit

- Software Empfehlungen

- Veteran

- Region

- Registratur

- entfernt

- ersetzen

- Zugriffe

- Requisit

- Ressourcen

- Downloads

- Einzelhändler

- Rückgabe

- Rollen

- Wurzel

- Führen Sie

- Laufen

- Sicherheit

- sagemaker

- SageMaker-Inferenz

- Sdk

- nahtlos

- Suche

- Bibliotheken

- Sicherheitdienst

- ausgewählt

- Senior

- brauchen

- dient

- Lösungen

- kompensieren

- ,,teilen"

- sollte

- Konzerte

- Einfacher

- einfach

- So

- Software

- Software-Entwicklung

- Software IngenieurIn

- Lösung

- Lösungen

- LÖSEN

- etwas

- spezialisieren

- beginnt

- Erklärung

- Status

- Schritt

- Shritte

- Lagerung

- Strategie

- Folge

- Erfolg haben

- so

- Unterstützte

- Unterstützt

- Schalter

- Systeme und Techniken

- TAG

- Nehmen

- Techniken

- Technologies

- Technologie

- Telco

- Telekom

- Telekommunikation

- Telekommunikationstechnik

- Vorlage

- Tensorfluss

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Diese

- nach drei

- Zeit

- zu

- TONE

- Werkzeug

- trainiert

- Transformer

- Übersetzen

- Trends

- was immer dies auch sein sollte.

- für

- zugrunde liegen,

- einzigartiges

- Einheit

- Universität

- öffnen

- Entriegelung

- auf dem neusten Stand

- URL

- -

- Mitglied

- v1

- Wert

- Vielfalt

- Veranstaltungsort

- Verizon

- Version

- Assistent

- Seh-

- Besuchen Sie

- Volumen

- Volumen

- wollte

- Reichtum

- Netz

- Web-Services

- GUT

- bekannt

- ob

- welche

- während

- werden wir

- mit

- .

- Arbeiter

- arbeiten,

- Das weltweit

- würde

- YAML

- Jahr

- Du

- Ihr

- Youtube

- Zephyrnet

- Zonen