Wir freuen uns, die Verfügbarkeit des Antwort-Streamings bekannt geben zu können Amazon Sage Maker Echtzeit-Inferenz. Jetzt können Sie Inferenzantworten kontinuierlich zurück an den Client streamen, wenn Sie die SageMaker-Echtzeitinferenz verwenden, um Sie beim Erstellen interaktiver Erlebnisse für generative KI-Anwendungen wie Chatbots, virtuelle Assistenten und Musikgeneratoren zu unterstützen. Mit dieser neuen Funktion können Sie sofort mit dem Streamen der Antworten beginnen, wenn sie verfügbar sind, anstatt darauf zu warten, dass die gesamte Antwort generiert wird. Dies verkürzt die Zeit bis zum ersten Byte für Ihre generativen KI-Anwendungen.

In diesem Beitrag zeigen wir, wie Sie eine Streaming-Webanwendung mithilfe von SageMaker-Echtzeitendpunkten mit der neuen Antwort-Streaming-Funktion für einen interaktiven Chat-Anwendungsfall erstellen. Wir verwenden Streamlit für die Benutzeroberfläche der Beispiel-Demoanwendung.

Lösungsüberblick

Um Antworten von SageMaker zurückzustreamen, können Sie unser neues verwenden InvokeEndpointWithResponseStream API. Es trägt zur Steigerung der Kundenzufriedenheit bei, indem es die Zeit bis zur ersten Antwort verkürzt. Diese Reduzierung der vom Kunden wahrgenommenen Latenz ist besonders wichtig für Anwendungen, die mit generativen KI-Modellen erstellt wurden, bei denen die sofortige Verarbeitung wichtiger ist als das Warten auf die gesamte Nutzlast. Darüber hinaus wird eine Sticky-Sitzung eingeführt, die Kontinuität bei Interaktionen ermöglicht und Anwendungsfällen wie Chatbots zugute kommt, um natürlichere und effizientere Benutzererlebnisse zu schaffen.

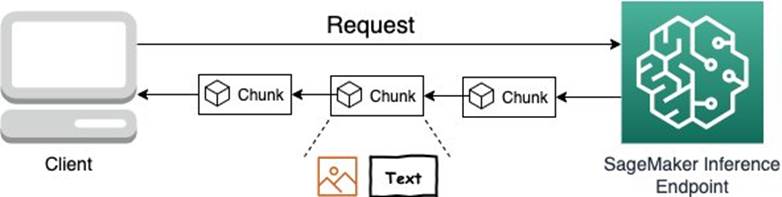

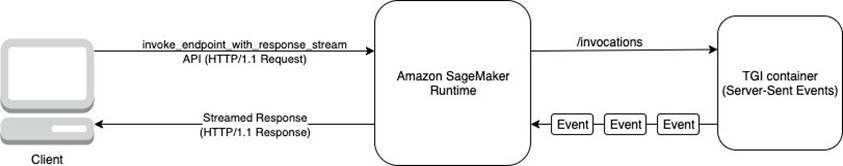

Die Implementierung des Antwort-Streamings in SageMaker-Echtzeitendpunkten wird erreicht durch HTTP 1.1-Chunked-Codierung, ein Mechanismus zum Senden mehrerer Antworten. Dies ist ein HTTP-Standard, der binäre Inhalte unterstützt und von den meisten Client/Server-Frameworks unterstützt wird. HTTP-Chunked-Codierung unterstützt sowohl Text- als auch Bilddaten-Streaming, was bedeutet, dass die auf SageMaker-Endpunkten gehosteten Modelle gestreamte Antworten als Text oder Bild zurücksenden können, z Falke, Lama 2 und Stable Diffusion Modelle. Aus Sicherheitsgründen werden sowohl die Ein- als auch die Ausgabe per TLS gesichert AWS Sigv4-Auth. Andere Streaming-Techniken wie Vom Server gesendete Ereignisse (SSE) werden ebenfalls mit demselben HTTP-Chunked-Codierungsmechanismus implementiert. Um die neue Streaming-API nutzen zu können, müssen Sie sicherstellen, dass der Modellcontainer die gestreamte Antwort als Chunk-codierte Daten zurückgibt.

Das folgende Diagramm veranschaulicht die allgemeine Architektur für das Antwortstreaming mit einem SageMaker-Inferenzendpunkt.

Einer der Anwendungsfälle, die von der Streaming-Antwort profitieren werden, sind generative, auf KI-Modellen basierende Chatbots. Traditionell senden Benutzer eine Anfrage und warten, bis die gesamte Antwort generiert wurde, bevor sie eine Antwort erhalten. Dies kann wertvolle Sekunden oder sogar länger dauern, was möglicherweise die Leistung der Anwendung beeinträchtigen kann. Beim Antwort-Streaming kann der Chatbot damit beginnen, Teilinferenzergebnisse zurückzusenden, sobald diese generiert werden. Dies bedeutet, dass Benutzer die erste Antwort nahezu augenblicklich sehen können, auch wenn die KI ihre Antwort im Hintergrund weiter verfeinert. Dadurch entsteht ein nahtloser und ansprechender Gesprächsfluss, bei dem Benutzer das Gefühl haben, mit einer KI zu chatten, die versteht und in Echtzeit reagiert.

In diesem Beitrag stellen wir zwei Containeroptionen zum Erstellen eines SageMaker-Endpunkts mit Antwort-Streaming vor: mithilfe einer AWS Große Modellinferenz (LMI) und Hugging Face Inferenz zur Textgenerierung (TGI)-Container. In den folgenden Abschnitten führen wir Sie durch die detaillierten Implementierungsschritte zum Bereitstellen und Testen von Falcon-7B-Instruktion Modell unter Verwendung von LMI- und TGI-Containern auf SageMaker. Als Beispiel haben wir Falcon 7B gewählt, aber jedes Modell kann von dieser neuen Streaming-Funktion profitieren.

Voraussetzungen:

Sie benötigen ein AWS-Konto mit einem AWS Identity and Access Management and (IAM)-Rolle mit Berechtigungen zum Verwalten von Ressourcen, die als Teil der Lösung erstellt wurden. Einzelheiten finden Sie unter Erstellen eines AWS-Kontos. Wenn Sie zum ersten Mal damit arbeiten Amazon SageMaker-Studio, müssen Sie zunächst eine erstellen SageMaker-Domäne. Darüber hinaus müssen Sie möglicherweise eine Erhöhung des Servicekontingents für die entsprechenden SageMaker-Hosting-Instanzen beantragen. Für das Falcon-7B-Instruct-Modell verwenden wir eine ml.g5.2xlarge SageMaker-Hosting-Instanz. Zum Hosten eines Falcon-40B-Instruct-Modells verwenden wir eine ml.g5.48xlarge SageMaker-Hosting-Instanz. Eine Quotenerhöhung können Sie bei der beantragen Benutzeroberfläche für Servicekontingente. Weitere Informationen finden Sie unter Beantragung einer Kontingenterhöhung.

Option 1: Stellen Sie einen Echtzeit-Streaming-Endpunkt mithilfe eines LMI-Containers bereit

Der LMI-Container ist einer der Deep-Learning-Container für große Modellinferenzen, die von SageMaker gehostet werden, um das Hosten großer Sprachmodelle (LLMs) auf der AWS-Infrastruktur für Inferenzanwendungsfälle mit geringer Latenz zu erleichtern. Der LMI-Container verwendet Bereitstellung der Deep Java Library (DJL)., ein quelloffenes, Engine-unabhängiges High-Level-Java-Framework für Deep Learning. Mit diesen Containern können Sie entsprechende Open-Source-Bibliotheken nutzen, z Tiefgeschwindigkeit, Accelerate, Transformers-Neuronx und Schneller Transformator Partitionieren Sie Modellparameter mithilfe von Modellparallelitätstechniken, um den Speicher mehrerer GPUs oder Beschleuniger für Inferenzen zu nutzen. Weitere Einzelheiten zu den Vorteilen der Verwendung des LMI-Containers zur Bereitstellung großer Modelle auf SageMaker finden Sie unter Stellen Sie große Modelle mit hoher Leistung mit FasterTransformer auf Amazon SageMaker bereit und Stellen Sie große Modelle auf Amazon SageMaker mit DJLServing und paralleler DeepSpeed-Modellinferenz bereit. Weitere Beispiele für das Hosten von Open-Source-LLMs auf SageMaker mithilfe der LMI-Container finden Sie hier GitHub Repo.

Für den LMI-Container erwarten wir die folgenden Artefakte, die beim Einrichten des Modells für die Inferenz helfen:

- Serving.properties (erforderlich) – Definiert die Modellservereinstellungen

- model.py (optional) – Eine Python-Datei zum Definieren der Kern-Inferenzlogik

- Anforderungen.txt (optional) – Es muss ein zusätzliches Pip-Rad installiert werden

LMI-Container können zum Hosten von Modellen verwendet werden, ohne dass Sie Ihren eigenen Inferenzcode bereitstellen müssen. Dies ist äußerst nützlich, wenn keine benutzerdefinierte Vorverarbeitung der Eingabedaten oder Nachverarbeitung der Modellvorhersagen erfolgt. Wir verwenden die folgende Konfiguration:

- Für dieses Beispiel hosten wir das Falcon-7B-Instruct-Modell. Wir müssen eine erstellen

serving.propertiesKonfigurationsdatei mit unseren gewünschten Hosting-Optionen und packen Sie sie in ein tar.gz-Artefakt. Das Antwort-Streaming kann in DJL Serving durch Festlegen von aktiviert werdenenable_streamingOption in derserving.propertiesDatei. Alle unterstützten Parameter finden Sie unter Streaming-Python-Konfiguration. - In diesem Beispiel verwenden wir die Standardhandler in DJL Serving, um Antworten zu streamen, sodass wir uns nur um das Senden von Anfragen und das Parsen der Ausgabeantwort kümmern. Sie können auch eine angeben

entrypointCode mit einem benutzerdefinierten Handler in amodel.pyDatei zum Anpassen von Eingabe- und Ausgabehandlern. Weitere Einzelheiten zum benutzerdefinierten Handler finden Sie unter Benutzerdefinierter model.py-Handler. - Da wir das Falcon-7B-Instruct-Modell auf einer einzelnen GPU-Instanz (ml.g5.2xlarge) hosten, legen wir fest

option.tensor_parallel_degreeauf 1. Wenn Sie die Ausführung auf mehreren GPUs planen, verwenden Sie diese Option, um die festzulegen Anzahl der GPUs pro Worker. - Wir verwenden

option.output_formatterum den Ausgabeinhaltstyp zu steuern. Der Standardinhaltstyp für die Ausgabe istapplication/jsonWenn Ihre Anwendung also eine andere Ausgabe erfordert, können Sie diesen Wert überschreiben. Weitere Informationen zu den verfügbaren Optionen finden Sie unter Konfigurationen und Einstellungen und Alle DJL-Konfigurationsoptionen.

Um das SageMaker-Modell zu erstellen, rufen Sie den Container-Image-URI ab:

Verwenden Sie das SageMaker Python-SDK um das SageMaker-Modell zu erstellen und es mithilfe von auf einem SageMaker-Echtzeitendpunkt bereitzustellen einsetzen Verfahren:

Wenn der Endpunkt in Betrieb ist, können Sie den verwenden InvokeEndpointWithResponseStream API-Aufruf zum Aufrufen des Modells. Diese API ermöglicht es dem Modell, als Stream von Teilen der gesamten Antwortnutzlast zu antworten. Dies ermöglicht es Modellen, mit größeren Antworten zu antworten, und ermöglicht eine schnellere Zeit bis zum ersten Byte für Modelle, bei denen ein erheblicher Unterschied zwischen der Generierung des ersten und letzten Bytes der Antwort besteht.

Der in angezeigte Antwortinhaltstyp x-amzn-sagemaker-content-type für den LMI-Container ist application/jsonlines wie in der Konfiguration der Modelleigenschaften angegeben. Weil es Teil davon ist gängige Datenformate, die für die Inferenz unterstützt werdenkönnen wir den von bereitgestellten Standard-Deserialisierer verwenden SageMaker Python-SDK um die JSON-Zeilendaten zu deserialisieren. Wir erstellen einen Helfer LineIterator Klasse zum Parsen des von der Inferenzanforderung empfangenen Antwortstroms:

Mit der Klasse im vorherigen Code wird jedes Mal, wenn eine Antwort gestreamt wird, eine binäre Zeichenfolge zurückgegeben (z. B. b'{"outputs": [" a"]}n'), die mithilfe des JSON-Pakets erneut in ein Python-Wörterbuch deserialisiert werden kann. Wir können den folgenden Code verwenden, um jede gestreamte Textzeile zu durchlaufen und eine Textantwort zurückzugeben:

Der folgende Screenshot zeigt, wie es aussehen würde, wenn Sie das Modell über das SageMaker-Notebook mithilfe eines LMI-Containers aufrufen würden.

Option 2: Implementieren Sie einen Chatbot mithilfe eines Hugging Face TGI-Containers

Im vorherigen Abschnitt haben Sie gesehen, wie Sie das Falcon-7B-Instruct-Modell mithilfe eines LMI-Containers bereitstellen. In diesem Abschnitt zeigen wir, wie man dasselbe mit a macht Gesicht umarmen Textgenerierungsinferenz (TGI) Container auf SageMaker. TGI ist eine speziell entwickelte Open-Source-Lösung für die Bereitstellung von LLMs. Es umfasst Optimierungen, darunter Tensorparallelität für schnellere Multi-GPU-Inferenz, dynamisches Batching zur Steigerung des Gesamtdurchsatzes und optimierten Transformer-Code mit Flash-Attention für gängige Modellarchitekturen wie BLOOM, T5, GPT-NeoX, StarCoder und LLaMa.

Unterstützung für TGI-Deep-Learning-Container Token-Streaming Verwendung von Vom Server gesendete Ereignisse (SSE). Beim Token-Streaming kann der Server nach dem ersten mit der Antwort beginnen prefill direkt passieren, ohne darauf warten zu müssen, dass die gesamte Generation abgeschlossen ist. Bei extrem langen Abfragen bedeutet dies, dass Kunden schon Größenordnungen sehen können, was passiert, bevor die Arbeit erledigt ist. Das folgende Diagramm zeigt einen umfassenden End-to-End-Anfrage-/Antwort-Workflow zum Hosten von LLMs auf einem SageMaker-Endpunkt mithilfe des TGI-Containers.

Um das Falcon-7B-Instruct-Modell auf einem SageMaker-Endpunkt bereitzustellen, verwenden wir das HuggingFaceModel Klasse aus dem SageMaker Python SDK. Wir beginnen mit der Einstellung unserer Parameter wie folgt:

Im Vergleich zur Bereitstellung regulärer Hugging Face-Modelle müssen wir zunächst den Container-URI abrufen und ihn unserem bereitstellen HuggingFaceModel Modellklasse mit image_uri zeigt auf das Bild. Um den neuen Hugging Face LLM DLC in SageMaker abzurufen, können wir den verwenden get_huggingface_llm_image_uri Methode, die vom SageMaker SDK bereitgestellt wird. Mit dieser Methode können wir den URI für den gewünschten Hugging Face LLM DLC basierend auf dem angegebenen Backend, der Sitzung, der Region und der Version abrufen. Weitere Einzelheiten zu den verfügbaren Versionen finden Sie unter HuggingFace-Inferenzcontainer für die Textgenerierung.

Wir erstellen dann die HuggingFaceModel und stellen Sie es mithilfe von in SageMaker bereit deploy Verfahren:

Der Hauptunterschied zum LMI-Container besteht darin, dass Sie das Antwortstreaming aktivieren, wenn Sie den Endpunkt durch Bereitstellung aufrufen stream=true als Teil der Aufrufanforderungsnutzlast. Der folgende Code ist ein Beispiel für die Nutzlast, die zum Aufrufen des TGI-Containers mit Streaming verwendet wird:

Anschließend können Sie den Endpunkt aufrufen und mit dem folgenden Befehl eine gestreamte Antwort erhalten:

Der in angezeigte Antwortinhaltstyp x-amzn-sagemaker-content-type für den TGI-Container ist text/event-stream. Wir verwenden StreamDeserializer, um die Antwort in zu deserialisieren EventStream Klasse und analysieren Sie den Antworttext damit LineIterator Klasse wie die im LMI-Containerabschnitt verwendete.

Beachten Sie, dass die gestreamte Antwort von den TGI-Containern eine Binärzeichenfolge zurückgibt (z. B. b`data:{"token": {"text": " sometext"}}`), das mithilfe eines JSON-Pakets erneut in ein Python-Wörterbuch deserialisiert werden kann. Wir können den folgenden Code verwenden, um jede gestreamte Textzeile zu durchlaufen und eine Textantwort zurückzugeben:

Der folgende Screenshot zeigt, wie es aussehen würde, wenn Sie das Modell über das SageMaker-Notebook mithilfe eines TGI-Containers aufrufen würden.

Führen Sie die Chatbot-App auf SageMaker Studio aus

In diesem Anwendungsfall erstellen wir einen dynamischen Chatbot auf SageMaker Studio mit Stromlit, das das Falcon-7B-Instruct-Modell aufruft, das auf einem SageMaker-Echtzeitendpunkt gehostet wird, um Streaming-Antworten bereitzustellen. Zunächst können Sie testen, ob die Streaming-Antworten im Notebook funktionieren, wie im vorherigen Abschnitt gezeigt. Anschließend können Sie die Streamlit-Anwendung im SageMaker Studio JupyterServer-Terminal einrichten und über Ihren Browser auf die Chatbot-Benutzeroberfläche zugreifen, indem Sie die folgenden Schritte ausführen:

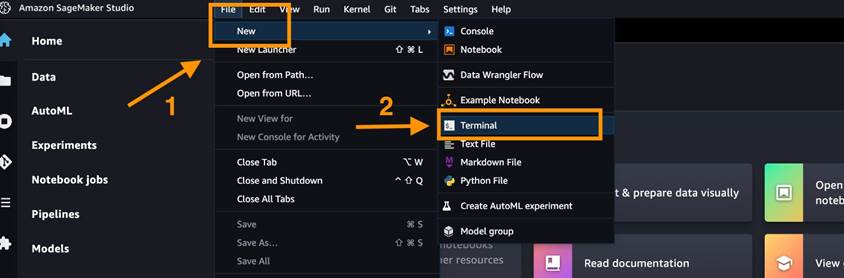

- Öffnen Sie ein Systemterminal in SageMaker Studio.

- Wählen Sie im oberen Menü der SageMaker Studio-Konsole Reichen Sie das und dann Neu und dann Terminal.

- Installieren Sie die erforderlichen Python-Pakete, die in angegeben sind requirements.txt Datei:

- Richten Sie die Umgebungsvariable mit dem in Ihrem Konto bereitgestellten Endpunktnamen ein:

- Starten Sie die Streamlit-App über

streamlit_chatbot_<LMI or TGI>.pyDatei, die die Endpunktnamen im Skript basierend auf der zuvor eingerichteten Umgebungsvariablen automatisch aktualisiert: - Um auf die Streamlit-Benutzeroberfläche zuzugreifen, kopieren Sie Ihre SageMaker Studio-URL in einen anderen Tab in Ihrem Browser und ersetzen Sie sie

lab?mitproxy/[PORT NUMBER]/. Da wir den Server-Port auf 6006 angegeben haben, sollte die URL wie folgt aussehen:

Ersetzen Sie die Domänen-ID und die Region in der vorherigen URL durch Ihr Konto und Ihre Region, um auf die Chatbot-Benutzeroberfläche zuzugreifen. Im linken Bereich finden Sie einige vorgeschlagene Eingabeaufforderungen, um den Einstieg zu erleichtern.

Die folgende Demo zeigt, wie Response-Streaming das Benutzererlebnis revolutioniert. Es kann dafür sorgen, dass sich Interaktionen flüssig und reaktionsschnell anfühlen, was letztendlich die Zufriedenheit und das Engagement der Benutzer steigert. Siehe die GitHub Repo Weitere Informationen zur Chatbot-Implementierung finden Sie hier.

Aufräumen

Wenn Sie mit dem Testen der Modelle fertig sind, löschen Sie als Best Practice den Endpunkt, um Kosten zu sparen, wenn der Endpunkt nicht mehr benötigt wird:

Zusammenfassung

In diesem Beitrag haben wir einen Überblick über das Erstellen von Anwendungen mit generativer KI, die Herausforderungen und wie SageMaker Echtzeit-Antwortstreaming Ihnen bei der Bewältigung dieser Herausforderungen hilft, gegeben. Wir haben gezeigt, wie man eine Chatbot-Anwendung erstellt, um das Falcon-7B-Instruct-Modell bereitzustellen, um Antwort-Streaming mit SageMaker LMI- und HuggingFace TGI-Containern zu verwenden, und zwar anhand eines Beispiels, das auf verfügbar ist GitHub.

Beginnen Sie noch heute mit der Entwicklung Ihrer eigenen hochmodernen Streaming-Anwendungen mit LLMs und SageMaker! Kontaktieren Sie uns für fachkundige Beratung und erschließen Sie das Potenzial des großen Modell-Streamings für Ihre Projekte.

Über die Autoren

Raghu Ramesha ist Senior ML Solutions Architect im Amazon SageMaker Service-Team. Er konzentriert sich darauf, Kunden bei der Erstellung, Bereitstellung und Migration von ML-Produktions-Workloads in großem Maßstab zu SageMaker zu unterstützen. Er ist auf die Bereiche maschinelles Lernen, KI und Computer Vision spezialisiert und verfügt über einen Master-Abschluss in Informatik von der UT Dallas. In seiner Freizeit reist und fotografiert er gerne.

Raghu Ramesha ist Senior ML Solutions Architect im Amazon SageMaker Service-Team. Er konzentriert sich darauf, Kunden bei der Erstellung, Bereitstellung und Migration von ML-Produktions-Workloads in großem Maßstab zu SageMaker zu unterstützen. Er ist auf die Bereiche maschinelles Lernen, KI und Computer Vision spezialisiert und verfügt über einen Master-Abschluss in Informatik von der UT Dallas. In seiner Freizeit reist und fotografiert er gerne.

Abhi Shivaditya ist Senior Solutions Architect bei AWS und arbeitet mit strategischen globalen Unternehmensorganisationen zusammen, um die Einführung von AWS-Services in Bereichen wie künstliche Intelligenz, verteiltes Computing, Netzwerk und Speicher zu erleichtern. Seine Expertise liegt im Deep Learning in den Bereichen Natural Language Processing (NLP) und Computer Vision. Abhi unterstützt Kunden bei der effizienten Bereitstellung leistungsstarker Modelle für maschinelles Lernen innerhalb des AWS-Ökosystems.

Abhi Shivaditya ist Senior Solutions Architect bei AWS und arbeitet mit strategischen globalen Unternehmensorganisationen zusammen, um die Einführung von AWS-Services in Bereichen wie künstliche Intelligenz, verteiltes Computing, Netzwerk und Speicher zu erleichtern. Seine Expertise liegt im Deep Learning in den Bereichen Natural Language Processing (NLP) und Computer Vision. Abhi unterstützt Kunden bei der effizienten Bereitstellung leistungsstarker Modelle für maschinelles Lernen innerhalb des AWS-Ökosystems.

Alan Tan ist Senior Product Manager bei SageMaker und leitet die Bemühungen zur Inferenz großer Modelle. Er setzt sich leidenschaftlich für die Anwendung von maschinellem Lernen im Bereich Analytics ein. Außerhalb der Arbeit genießt er die Natur.

Alan Tan ist Senior Product Manager bei SageMaker und leitet die Bemühungen zur Inferenz großer Modelle. Er setzt sich leidenschaftlich für die Anwendung von maschinellem Lernen im Bereich Analytics ein. Außerhalb der Arbeit genießt er die Natur.

Melaniei, PhD, ist Senior AI/ML Specialist TAM bei AWS mit Sitz in Sydney, Australien. Sie unterstützt Unternehmenskunden beim Aufbau von Lösungen mit modernsten KI/ML-Tools auf AWS und bietet Anleitungen zur Architektur und Implementierung von ML-Lösungen mit Best Practices. In ihrer Freizeit erkundet sie gerne die Natur und verbringt Zeit mit Familie und Freunden.

Melaniei, PhD, ist Senior AI/ML Specialist TAM bei AWS mit Sitz in Sydney, Australien. Sie unterstützt Unternehmenskunden beim Aufbau von Lösungen mit modernsten KI/ML-Tools auf AWS und bietet Anleitungen zur Architektur und Implementierung von ML-Lösungen mit Best Practices. In ihrer Freizeit erkundet sie gerne die Natur und verbringt Zeit mit Familie und Freunden.

Sam Edwards, ist Cloud Engineer (AI/ML) bei AWS Sydney, spezialisiert auf maschinelles Lernen und Amazon SageMaker. Es ist ihm eine Leidenschaft, Kunden bei der Lösung von Problemen im Zusammenhang mit maschinellen Lernabläufen zu unterstützen und neue Lösungen für sie zu entwickeln. Außerhalb der Arbeit treibt er gerne Schlägersport und reist gerne.

Sam Edwards, ist Cloud Engineer (AI/ML) bei AWS Sydney, spezialisiert auf maschinelles Lernen und Amazon SageMaker. Es ist ihm eine Leidenschaft, Kunden bei der Lösung von Problemen im Zusammenhang mit maschinellen Lernabläufen zu unterstützen und neue Lösungen für sie zu entwickeln. Außerhalb der Arbeit treibt er gerne Schlägersport und reist gerne.

James Sanders ist Senior Software Engineer bei Amazon Web Services. Er arbeitet an der Echtzeit-Inferenzplattform für Amazon SageMaker.

James Sanders ist Senior Software Engineer bei Amazon Web Services. Er arbeitet an der Echtzeit-Inferenzplattform für Amazon SageMaker.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- ChartPrime. Verbessern Sie Ihr Handelsspiel mit ChartPrime. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/elevating-the-generative-ai-experience-introducing-streaming-support-in-amazon-sagemaker-hosting/

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 10

- 100

- 11

- 13

- 14

- 16

- 1900

- 23

- 7

- 8

- 9

- a

- Über uns

- Beschleuniger

- Zugang

- Konto

- Trading Konten

- erreicht

- über

- Zusätzliche

- zusätzlich

- Adresse

- Adoption

- Vorteil

- Nach der

- aufs Neue

- AI

- KI-Modelle

- AI / ML

- Alle

- erlaubt

- fast

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- Analytik

- und

- Bekannt geben

- Ein anderer

- beantworten

- jedem

- Bienen

- App

- Anwendung

- Anwendungen

- Anwendung

- Architektur

- SIND

- Bereich

- Bereiche

- Feld

- künstlich

- künstliche Intelligenz

- AS

- Assistenten

- Vorlagen

- At

- Australien

- Im Prinzip so, wie Sie es von Google Maps kennen.

- Verfügbarkeit

- verfügbar

- AWS

- Zurück

- Backend

- Hintergrund

- basierend

- BE

- weil

- Bevor

- beginnen

- Nutzen

- profitieren

- Vorteile

- BESTE

- Best Practices

- zwischen

- Blühen

- Körper

- Auftrieb

- beide

- Browser

- puffern

- bauen

- Building

- erbaut

- aber

- by

- rufen Sie uns an!

- CAN

- österreichische Unternehmen

- Häuser

- Fälle

- Herausforderungen

- herausfordernd

- Charakter

- Chatbot

- Chatbots

- Chat

- aus der Ferne überprüfen

- Auswählen

- wählten

- Klasse

- Auftraggeber

- Kunden

- Cloud

- Code

- Kommentar

- verglichen

- Abschluss

- Computer

- Computerwissenschaften

- Computer Vision

- Computing

- Konfiguration

- Konsul (Console)

- enthalten

- Container

- Behälter

- Inhalt

- fortsetzen

- weiter

- Kontinuität

- ständig

- Smartgeräte App

- Gespräch

- Kernbereich

- Dazugehörigen

- Kosten

- könnte

- erstellen

- erstellt

- schafft

- Erstellen

- wichtig

- Original

- Kunde

- Kundenzufriedenheit

- Kunden

- anpassen

- innovativ, auf dem neuesten Stand

- Dallas

- technische Daten

- tief

- tiefe Lernen

- Standard

- definieren

- Definiert

- Grad

- liefern

- Demo

- einsetzen

- Einsatz

- Bereitstellen

- erwünscht

- detailliert

- Details

- Unterschied

- anders

- Direkt

- verteilt

- Verteiltes rechnen

- do

- Domain

- Domains

- erledigt

- dynamisch

- jeder

- Früher

- Ökosystem

- effizient

- effizient

- Bemühungen

- erhebend

- ermöglichen

- freigegeben

- ermöglicht

- Ende

- End-to-End

- Ende

- Endpunkt

- Engagement

- Eingriff

- Ingenieur

- zu steigern,

- Eine Verbesserung der

- gewährleisten

- Unternehmen

- Ganz

- Arbeitsumfeld

- Sogar

- Event

- Veranstaltungen

- Beispiel

- Beispiele

- Außer

- aufgeregt

- erwarten

- ERFAHRUNGEN

- Erfahrungen

- Experte

- Expertise

- ERKUNDEN

- exportieren

- ausgesetzt

- äußerst

- Gesicht

- erleichtern

- falsch

- Familie

- beschleunigt

- Merkmal

- fühlen

- Reichen Sie das

- Finden Sie

- Vorname

- erstes Mal

- Fluss

- Flüssigkeit

- konzentriert

- Folgende

- folgt

- Aussichten für

- Format

- Unser Ansatz

- Gerüste

- Frei

- Freunde

- für

- voller

- Funktion

- erzeugt

- Generation

- generativ

- Generative KI

- Generatoren

- bekommen

- gif

- Global

- GPU

- GPUs

- garantiert

- die Vermittlung von Kompetenzen,

- Los

- he

- Gesundheit

- Hilfe

- Unternehmen

- hilft

- hier (auf dänisch)

- GUTE

- High-Level

- Hohe Leistungsfähigkeit

- seine

- hält

- Gastgeber

- gehostet

- Hosting

- Ultraschall

- Hilfe

- HTML

- http

- HTTPS

- Umarmendes Gesicht

- ID

- Identitätsschutz

- if

- zeigt

- Image

- unmittelbar

- sofort

- implementieren

- Implementierung

- umgesetzt

- Umsetzung

- importieren

- in

- Einschließlich

- Erhöhung

- Information

- Infrastruktur

- Anfangs-

- Varianten des Eingangssignals:

- Eingänge

- installieren

- Instanz

- sofort

- beantragen müssen

- Intelligenz

- Interaktionen

- interaktive

- in

- Stellt vor

- Einführung

- aufgerufen

- ruft auf

- Probleme

- IT

- SEINE

- Javac

- jpg

- JSON

- Sprache

- grosse

- größer

- Nachname

- Latency

- führenden

- lernen

- links

- Länge

- Bibliotheken

- Bibliothek

- liegt

- Lebensdauer

- Gefällt mir

- Line

- Linien

- Lama

- LLM

- Lang

- länger

- aussehen

- aussehen wie

- liebt

- Maschine

- Maschinelles Lernen

- Main

- unterhält

- um

- verwalten

- Manager

- Meister

- max

- Kann..

- me

- Mittel

- Mechanismus

- Memory

- MENÜ

- Methode

- migriert

- Minuten

- ML

- Modell

- für

- mehr

- Zudem zeigt

- vor allem warme

- mehrere

- Musik

- Name

- Namen

- Natürliche

- Verarbeitung natürlicher Sprache

- Natur

- Need

- Vernetzung

- Neu

- Nlp

- nicht

- Notizbuch

- jetzt an

- Anzahl

- Objekte

- of

- on

- EINEM

- einzige

- XNUMXh geöffnet

- Open-Source-

- optimiert

- Option

- Optionen

- or

- Bestellungen

- Organisationen

- Andere

- UNSERE

- im Freien

- Möglichkeiten für das Ausgangssignal:

- aussen

- übrig

- Gesamt-

- Überblick

- besitzen

- Paket

- Pakete

- Brot

- Parallel

- Parameter

- Teil

- besonders

- Teile

- passieren

- leidenschaftlich

- für

- Leistung

- Berechtigungen

- phd

- Fotografie

- Plan

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- spielend

- Points

- Beliebt

- Position

- Post

- Potenzial

- möglicherweise

- Praxis

- Praktiken

- Kostbar

- Prognosen

- früher

- Aufgabenstellung:

- Verarbeitung

- Produkt

- Produkt-Manager

- Produktion

- Projekte

- immobilien

- die

- vorausgesetzt

- bietet

- Bereitstellung

- Python

- Abfragen

- erhöhen

- erreichen

- Lesen Sie mehr

- echt

- Echtzeit

- erhalten

- Received

- Empfang

- Reduktion

- Verfeinerung

- Region

- regulär

- bezogene

- ersetzen

- Anforderung

- Zugriffe

- falls angefordert

- Voraussetzungen:

- erfordert

- Downloads

- Reagieren

- Antwort

- Antworten

- ansprechbar

- Die Ergebnisse

- Rückkehr

- Rückgabe

- revolutioniert

- Rollen

- Führen Sie

- sagemaker

- SageMaker-Inferenz

- gleich

- Zufriedenheit

- Speichern

- sah

- Skalieren

- Wissenschaft

- Sdk

- nahtlos

- Sekunden

- Abschnitt

- Abschnitte

- Gesicherte

- Sicherheitdienst

- sehen

- SELF

- senden

- Sendung

- Senior

- Satz

- Leistungen

- Dienst

- Sitzung

- kompensieren

- Einstellung

- sie

- sollte

- erklären

- Vitrine

- präsentiert

- gezeigt

- Konzerte

- signifikant

- Single

- Größe

- So

- Software

- Software IngenieurIn

- Lösung

- Lösungen

- LÖSEN

- einige

- etwas

- Quelle

- Spezialist

- spezialisiert

- spezialisiert

- angegeben

- verbringen

- gespalten

- Sports

- Standard

- Anfang

- begonnen

- State-of-the-art

- Shritte

- klebrig

- Lagerung

- Strategisch

- Strom

- gestreamt

- Streaming

- Schnur

- Studio Adressen

- so

- Zuführung

- Support

- Unterstützte

- Unterstützt

- sicher

- Sydney

- System

- Nehmen

- Team

- Techniken

- erzählen

- Terminal

- AGB

- Test

- Testen

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Gegend

- Sie

- dann

- Dort.

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- Durch

- Durchsatz

- Zeit

- zu

- Zeichen

- Werkzeuge

- Top

- traditionell

- Transformer

- Reise

- was immer dies auch sein sollte.

- versuchen

- XNUMX

- tippe

- ui

- Letztlich

- versteht

- unbekannt

- öffnen

- Aktualisierung

- URL

- us

- -

- Anwendungsfall

- benutzt

- Mitglied

- Benutzererfahrung

- Nutzer

- verwendet

- Verwendung von

- gewöhnlich

- Wert

- geschätzt

- Variable

- Version

- Versionen

- Assistent

- Seh-

- warten

- Warten

- wurde

- we

- Netz

- Internetanwendung

- Web-Services

- Was

- Was ist

- Rad

- wann

- welche

- während

- Wikipedia

- werden wir

- mit

- .

- ohne

- Arbeiten

- Arbeitsablauf.

- Workflows

- arbeiten,

- Werk

- würde

- schreiben

- geschrieben

- Du

- Ihr

- Zephyrnet