Große Sprachmodelle (LLMs) können mit ihrem breiten Wissen menschenähnliche Texte zu fast jedem Thema generieren. Allerdings schränkt ihr Training auf riesigen Datensätzen auch ihre Nützlichkeit für spezielle Aufgaben ein. Ohne kontinuierliches Lernen nehmen diese Modelle keine neuen Daten und Trends wahr, die nach ihrem anfänglichen Training auftauchen. Darüber hinaus können sich die Kosten für die Schulung neuer LLMs für viele Unternehmensumgebungen als unerschwinglich erweisen. Es ist jedoch möglich, eine Modellantwort mit dem ursprünglichen Fachinhalt zu vergleichen und dadurch die Notwendigkeit zu vermeiden, ein neues LLM-Modell mithilfe von Retrieval-Augmented Generation (RAG) zu trainieren.

RAG stärkt LLMs, indem es ihnen die Möglichkeit gibt, externes Wissen abzurufen und zu integrieren. Anstatt sich ausschließlich auf ihr vorab trainiertes Wissen zu verlassen, ermöglicht RAG Modellen, Daten aus Dokumenten, Datenbanken und mehr abzurufen. Das Modell integriert diese externen Informationen dann geschickt in seinen generierten Text. Durch die Beschaffung kontextrelevanter Daten kann das Modell fundierte, aktuelle Antworten liefern, die auf Ihren Anwendungsfall zugeschnitten sind. Die Wissenserweiterung verringert auch die Wahrscheinlichkeit von Halluzinationen und ungenauen oder unsinnigen Texten. Mit RAG werden Basismodelle zu anpassungsfähigen Experten, die sich mit der Erweiterung Ihrer Wissensbasis weiterentwickeln.

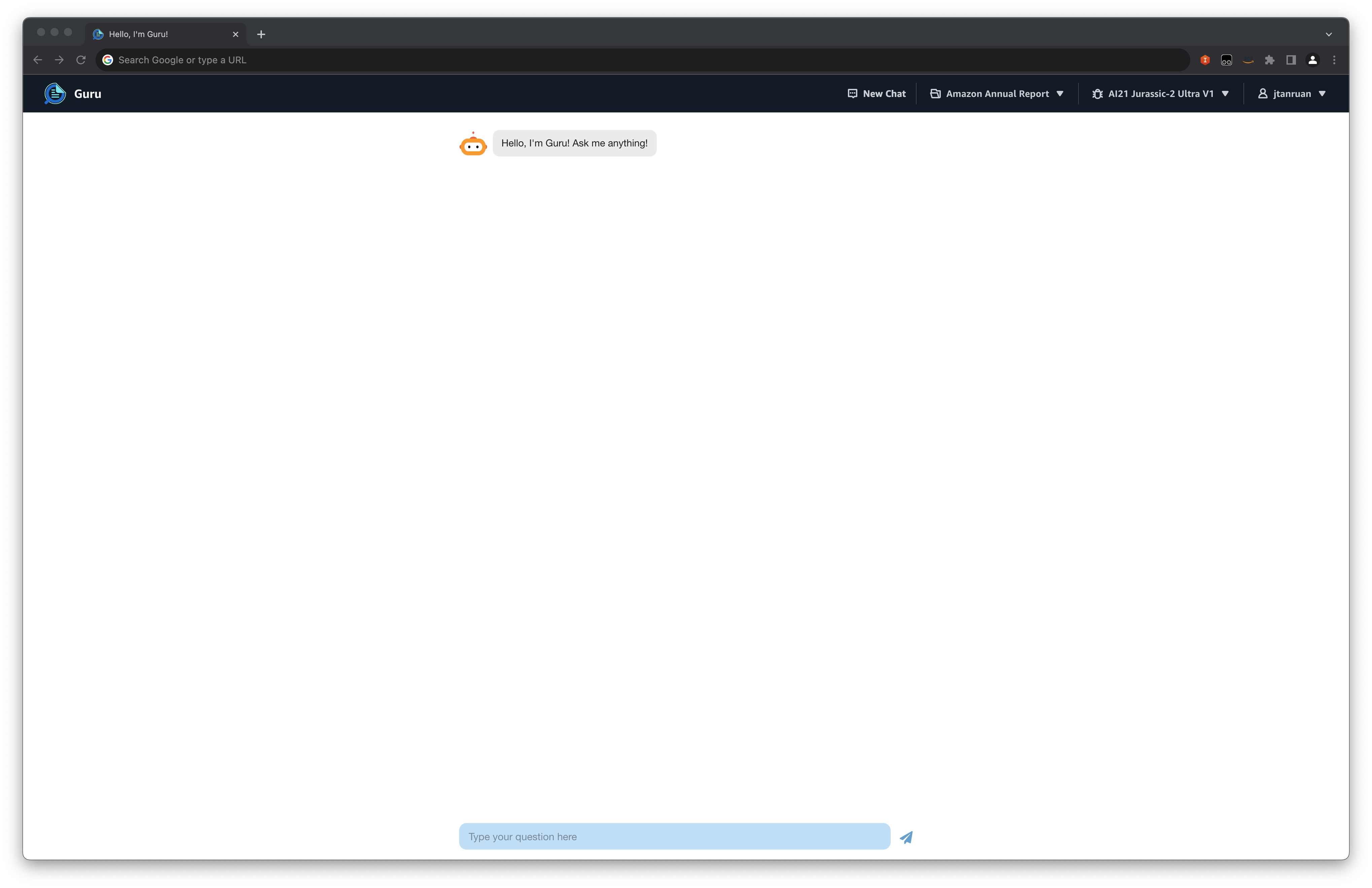

Heute freuen wir uns, drei generative KI-Demos vorstellen zu können, die unter der Lizenz lizenziert sind MIT-0-Lizenz:

- Amazon Kendra mit grundlegendem LLM – Nutzt die Tiefensuchfunktionen von Amazon Kendra kombiniert mit dem umfassenden Wissen von LLMs. Diese Integration liefert präzise und kontextbezogene Antworten auf komplexe Fragen, indem sie auf eine Vielzahl von Quellen zurückgreift.

- Einbettungsmodell mit grundlegendem LLM – Kombiniert die Leistungsfähigkeit von Einbettungen – einer Technik zur Erfassung der semantischen Bedeutung von Wörtern und Phrasen – mit der umfangreichen Wissensbasis von LLMs. Diese Synergie ermöglicht eine genauere Themenmodellierung, Inhaltsempfehlung und semantische Suchfunktionen.

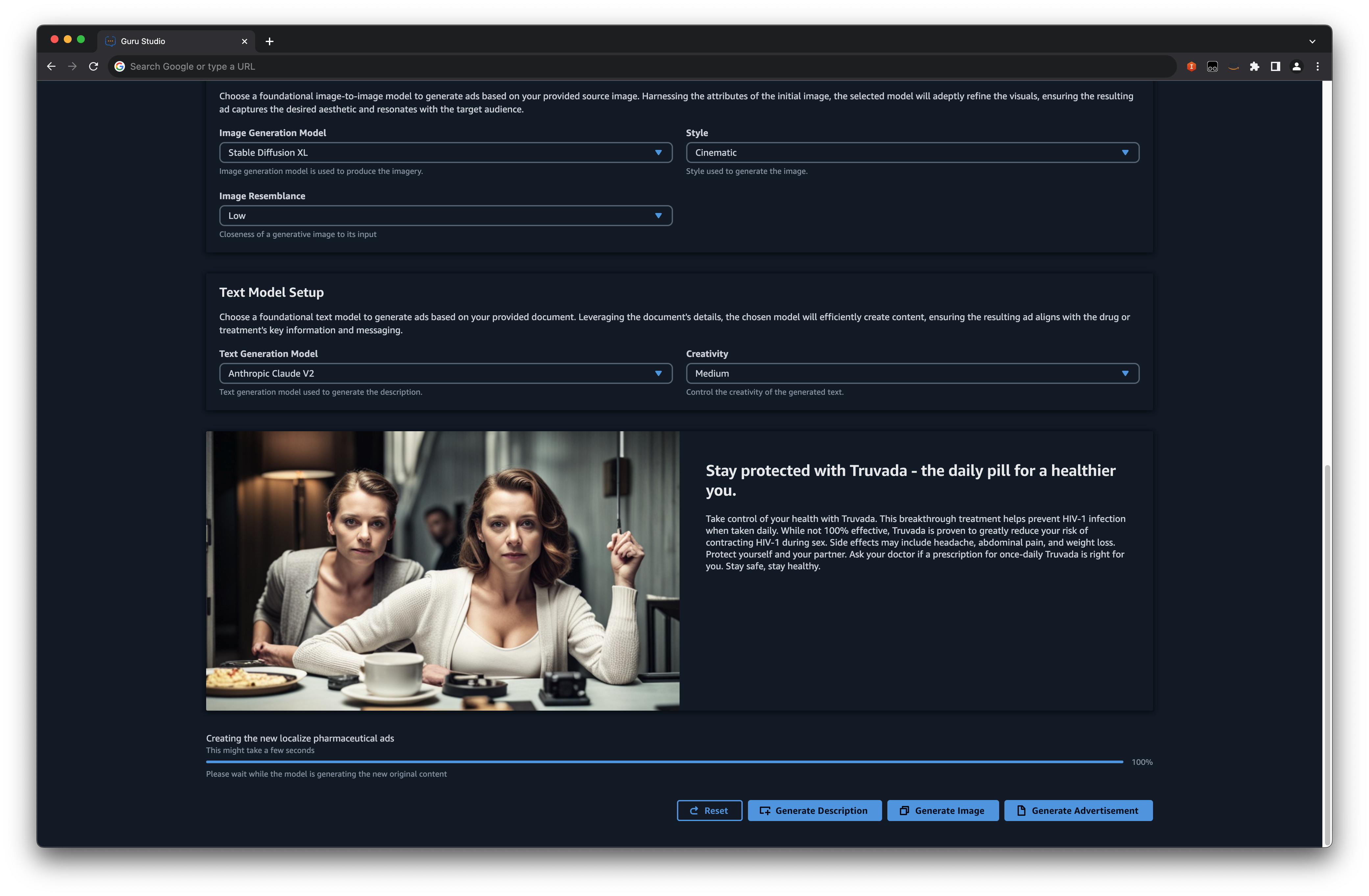

- Foundation Models Pharma-Anzeigengenerator – Eine spezielle Anwendung, maßgeschneidert für die Pharmaindustrie. Dieses Tool nutzt die generativen Fähigkeiten grundlegender Modelle und erstellt überzeugende und konforme Pharmawerbung und stellt sicher, dass der Inhalt den Industriestandards und -vorschriften entspricht.

Diese Demos können nahtlos in Ihrem AWS-Konto bereitgestellt werden und bieten grundlegende Einblicke und Anleitungen zur Nutzung von AWS-Services, um einen hochmodernen LLM-generativen KI-Frage- und Antwort-Bot und die Generierung von Inhalten zu erstellen.

In diesem Beitrag untersuchen wir, wie RAG in Kombination mit Amazon Kendra oder benutzerdefinierten Einbettungen diese Herausforderungen bewältigen und verfeinerte Antworten auf Anfragen in natürlicher Sprache liefern kann.

Lösungsüberblick

Durch die Einführung dieser Lösung können Sie die folgenden Vorteile erzielen:

- Verbesserter Informationszugang – RAG ermöglicht es Modellen, Informationen aus umfangreichen externen Quellen abzurufen, was besonders nützlich sein kann, wenn das Wissen des vorab trainierten Modells veraltet oder unvollständig ist.

- Skalierbarkeit – Anstatt ein Modell anhand aller verfügbaren Daten zu trainieren, ermöglicht RAG den Modellen, relevante Informationen im Handumdrehen abzurufen. Dies bedeutet, dass neue Daten, sobald sie verfügbar sind, zur Abrufdatenbank hinzugefügt werden können, ohne dass das gesamte Modell neu trainiert werden muss.

- Speichereffizienz – LLMs benötigen viel Speicher zum Speichern von Parametern. Mit RAG kann das Modell kleiner sein, da es sich nicht alle Details merken muss; Es kann sie bei Bedarf abrufen.

- Dynamisches Wissensupdate – Im Gegensatz zu herkömmlichen Modellen mit einem festgelegten Wissensendpunkt kann die externe Datenbank von RAG regelmäßig aktualisiert werden, wodurch das Modell Zugriff auf aktuelle Informationen erhält. Die Abruffunktion kann für bestimmte Aufgaben feinabgestimmt werden. Beispielsweise kann eine medizinische Diagnoseaufgabe Daten aus medizinischen Fachzeitschriften beziehen, um sicherzustellen, dass das Modell sachkundige und relevante Erkenntnisse erhält.

- Abschwächung von Verzerrungen – Die Möglichkeit, auf eine gut kuratierte Datenbank zurückzugreifen, bietet das Potenzial, Vorurteile zu minimieren, indem ausgewogene und unparteiische externe Quellen sichergestellt werden.

Bevor Sie sich mit der Integration von Amazon Kendra in grundlegende LLMs befassen, ist es wichtig, sich mit den erforderlichen Tools und Systemanforderungen auszustatten. Das richtige Setup ist der erste Schritt zu einer nahtlosen Bereitstellung der Demos.

Voraussetzungen:

Folgende Voraussetzungen müssen Sie mitbringen:

Obwohl es möglich ist, die in diesem Tutorial beschriebene Infrastruktur von Ihrem lokalen Computer aus einzurichten und bereitzustellen, AWS Cloud9 bietet eine praktische Alternative. AWS Cloud9 ist mit Tools wie AWS CLI, AWS CDK und Docker vorinstalliert und kann als Ihre Bereitstellungs-Workstation fungieren. Um diesen Service zu nutzen, einfach Umgebung einrichten über das AWS Cloud9-Konsole.

Nachdem die Voraussetzungen geklärt sind, tauchen wir mit grundlegenden LLMs in die Funktionen und Fähigkeiten von Amazon Kendra ein.

Amazon Kendra mit grundlegendem LLM

Amazon Kendra ist ein fortschrittlicher Unternehmenssuchdienst, der durch maschinelles Lernen (ML) erweitert wird und sofort einsatzbereite semantische Suchfunktionen bietet. Mithilfe der Verarbeitung natürlicher Sprache (NLP) erfasst Amazon Kendra sowohl den Inhalt von Dokumenten als auch die zugrunde liegende Absicht von Benutzerabfragen und positioniert es als Tool zum Abrufen von Inhalten für RAG-basierte Lösungen. Durch die Verwendung der hochpräzisen Suchinhalte von Kendra als RAG-Nutzlast können Sie bessere LLM-Antworten erhalten. Die Verwendung von Amazon Kendra in dieser Lösung ermöglicht auch eine personalisierte Suche, indem Antworten entsprechend den Zugriffsberechtigungen für Endbenutzerinhalte gefiltert werden.

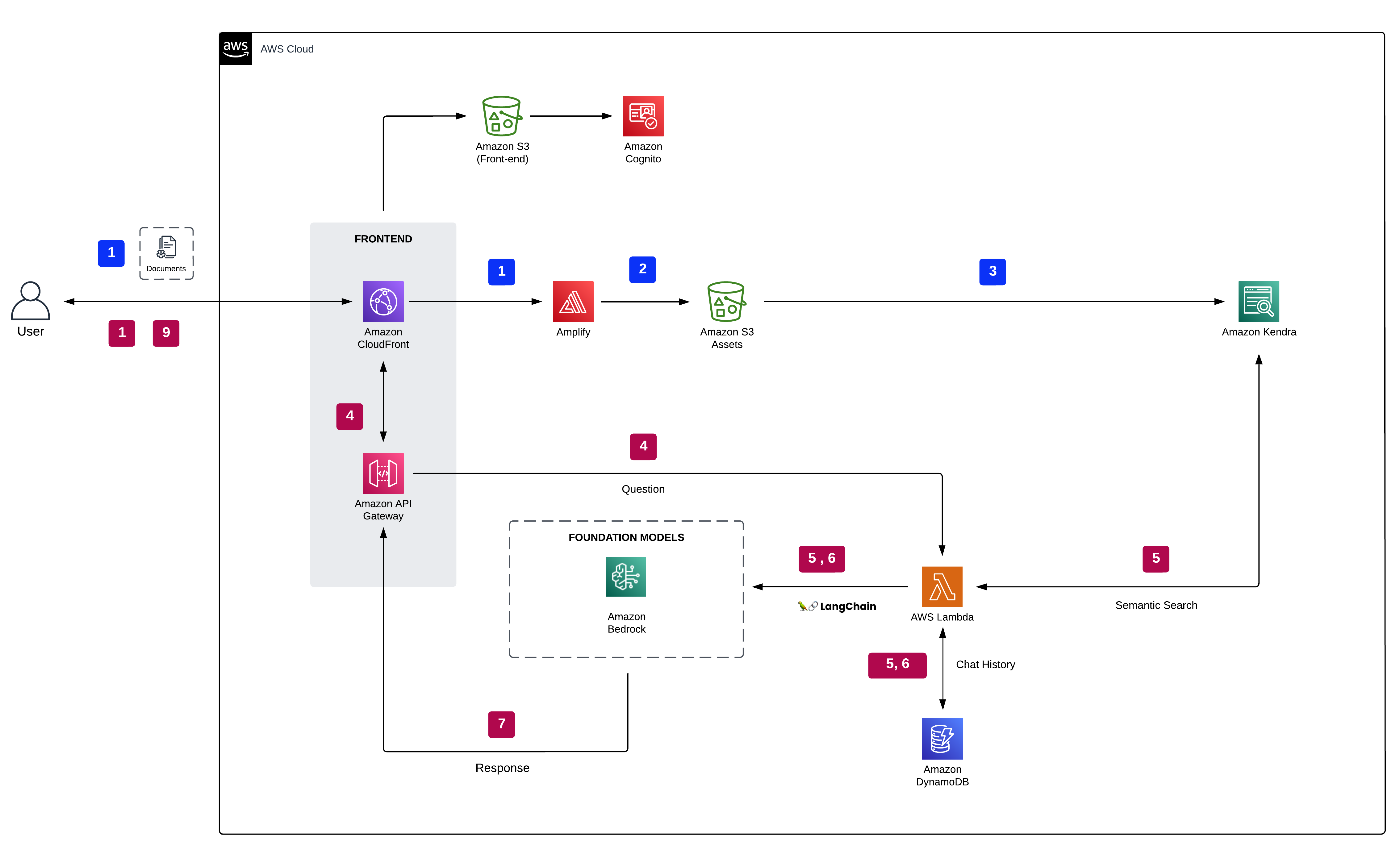

Das folgende Diagramm zeigt die Architektur einer generativen KI-Anwendung unter Verwendung des RAG-Ansatzes.

Dokumente werden von Amazon Kendra über verarbeitet und indiziert Einfacher Amazon-Speicherdienst (Amazon S3) Verbinder. Kundenanfragen und Kontextdaten von Amazon Kendra werden an a weitergeleitet Amazonas Grundgestein Gründungsmodell. In der Demo können Sie zwischen den Modellen Titan von Amazon, Jurassic von AI21 und Claude von Anthropic wählen, die von Amazon Bedrock unterstützt werden. Der Gesprächsverlauf wird in gespeichert Amazon DynamoDBund bietet dem LLM zusätzlichen Kontext zum Generieren von Antworten.

Wir haben diese Demo im bereitgestellt GitHub Repo. Informationen zur Bereitstellung in Ihrem AWS-Konto finden Sie in den Bereitstellungsanweisungen in der Readme-Datei.

Die folgenden Schritte beschreiben den Prozess, wenn ein Benutzer mit der generativen KI-App interagiert:

- Der Benutzer meldet sich authentifiziert bei der Web-App an Amazon Cognito.

- Der Benutzer lädt ein oder mehrere Dokumente in Amazon S3 hoch.

- Der Benutzer führt einen Amazon Kendra-Synchronisierungsauftrag aus, um S3-Dokumente in den Amazon Kendra-Index aufzunehmen.

- Die Frage des Benutzers wird über eine sichere WebSocket-API weitergeleitet, die auf gehostet wird Amazon API-Gateway unterstützt von a AWS Lambda Funktion.

- Die Lambda-Funktion, unterstützt durch die LangChain Framework – ein vielseitiges Tool zum Erstellen von Anwendungen, die auf KI-Sprachmodellen basieren – stellt eine Verbindung zum Amazon Bedrock-Endpunkt her, um die Frage des Benutzers basierend auf dem Chat-Verlauf neu zu formulieren. Nach der Umformulierung wird die Frage mithilfe der Retrieve-API an Amazon Kendra weitergeleitet. Als Reaktion darauf zeigt der Amazon Kendra-Index Suchergebnisse an und stellt Auszüge aus relevanten Dokumenten bereit, die aus den erfassten Daten des Unternehmens stammen.

- Die Frage des Benutzers wird zusammen mit den aus dem Index abgerufenen Daten als Kontext in der LLM-Eingabeaufforderung gesendet. Die Antwort vom LLM wird als Chat-Verlauf in DynamoDB gespeichert.

- Abschließend wird die Antwort vom LLM an den Benutzer zurückgesendet.

Workflow zur Dokumentenindizierung

Das Verfahren zur Bearbeitung und Indizierung von Dokumenten ist wie folgt:

- Benutzer übermitteln Dokumente über die Benutzeroberfläche (UI).

- Dokumente werden mithilfe von in einen S3-Bucket übertragen AWS verstärken API.

- Amazon Kendra indiziert neue Dokumente im S3-Bucket über den Amazon Kendra S3-Connector.

Benefits

Die folgende Liste verdeutlicht die Vorteile dieser Lösung:

- Abruf auf Unternehmensebene – Amazon Kendra ist für die Unternehmenssuche konzipiert und eignet sich daher für Organisationen mit großen Mengen strukturierter und unstrukturierter Daten.

- Semantisches Verständnis – Die ML-Funktionen von Amazon Kendra stellen sicher, dass der Abruf auf einem tiefen semantischen Verständnis und nicht nur auf Schlüsselwortübereinstimmungen basiert.

- Skalierbarkeit – Amazon Kendra kann große Datenquellen verarbeiten und liefert schnelle und relevante Suchergebnisse.

- Flexibilität – Das Basismodell kann Antworten basierend auf einer Vielzahl von Kontexten generieren und stellt so sicher, dass das System vielseitig bleibt.

- Integrationsmöglichkeiten – Amazon Kendra kann in verschiedene AWS-Dienste und Datenquellen integriert werden, wodurch es an unterschiedliche organisatorische Anforderungen angepasst werden kann.

Einbettungsmodell mit grundlegendem LLM

An Einbettung ist ein numerischer Vektor, der den Kern verschiedener Datentypen darstellt, einschließlich Text, Bildern, Audio und Dokumenten. Diese Darstellung erfasst nicht nur die eigentliche Bedeutung der Daten, sondern passt sie auch für eine Vielzahl praktischer Anwendungen an. Einbettungsmodelle, ein Zweig des maschinellen Lernens, transformieren komplexe Daten wie Wörter oder Phrasen in kontinuierliche Vektorräume. Diese Vektoren erfassen von Natur aus die semantischen Zusammenhänge zwischen Daten und ermöglichen tiefere und aufschlussreichere Vergleiche.

RAG kombiniert nahtlos die Stärken grundlegender Modelle wie Transformatoren mit der Präzision von Einbettungen, um riesige Datenbanken nach relevanten Informationen zu durchsuchen. Beim Empfang einer Anfrage verwendet das System Einbettungen, um relevante Abschnitte aus einem umfangreichen Datenbestand zu identifizieren und zu extrahieren. Das Basismodell formuliert dann auf Grundlage dieser extrahierten Informationen eine kontextgenaue Antwort. Diese perfekte Synergie zwischen Datenabruf und Antwortgenerierung ermöglicht es dem System, fundierte Antworten zu liefern und dabei auf das umfangreiche Wissen zurückzugreifen, das in umfangreichen Datenbanken gespeichert ist.

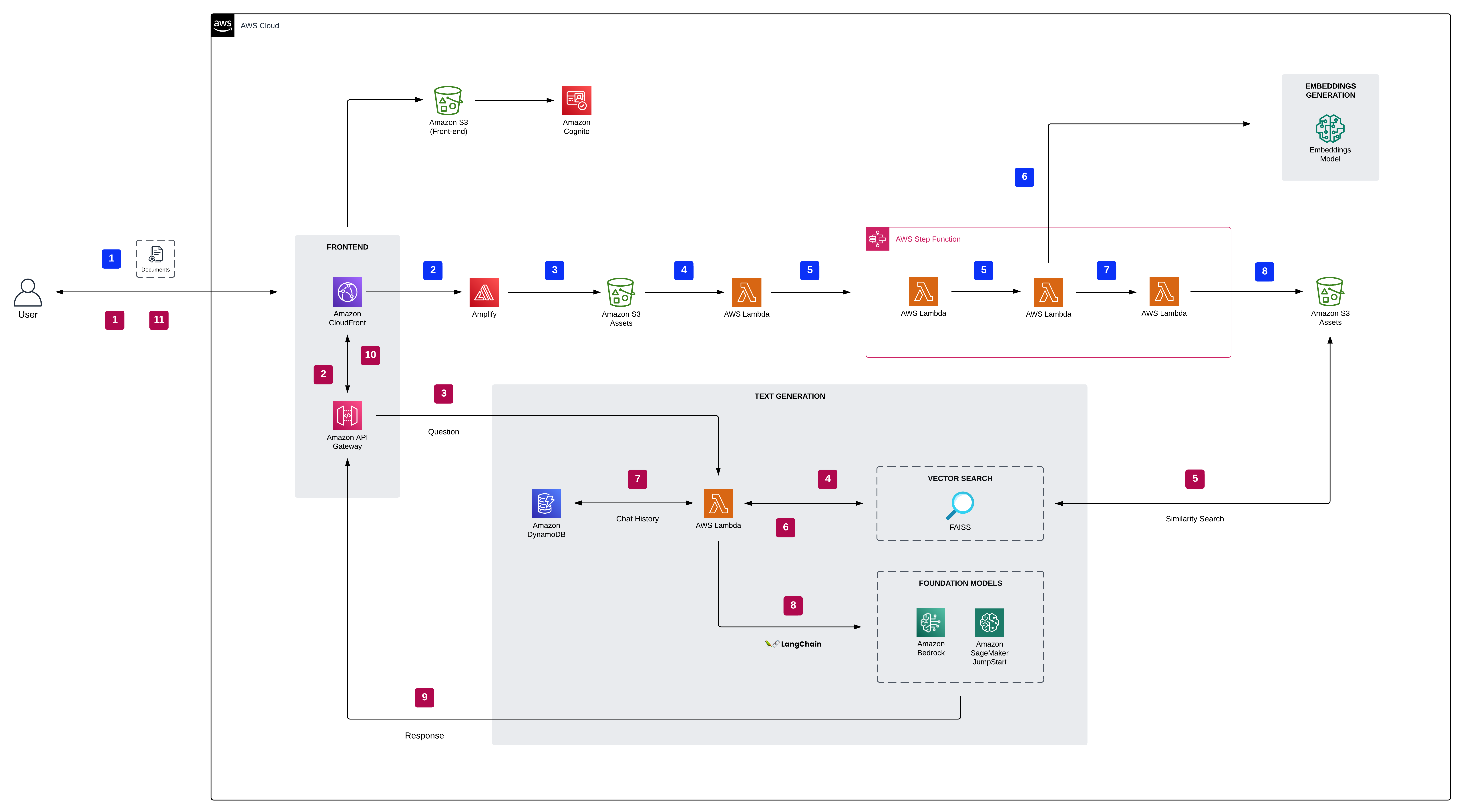

Im architektonischen Layout werden Benutzer basierend auf ihrer UI-Auswahl entweder zum Amazon Bedrock oder geführt Amazon SageMaker-JumpStart Fundamentmodelle. Dokumente werden verarbeitet und Vektoreinbettungen werden vom Einbettungsmodell erstellt. Diese Einbettungen werden dann mit indiziert FAISS um eine effiziente semantische Suche zu ermöglichen. Konversationsverläufe werden in DynamoDB gespeichert und bereichern den Kontext für das LLM, um Antworten zu erstellen.

Das folgende Diagramm veranschaulicht die Lösungsarchitektur und den Workflow.

Wir haben diese Demo im bereitgestellt GitHub Repo. Informationen zur Bereitstellung in Ihrem AWS-Konto finden Sie in den Bereitstellungsanweisungen in der Readme-Datei.

Einbettungsmodell

Die Verantwortlichkeiten des Einbettungsmodells sind wie folgt:

- Dieses Modell ist für die Konvertierung von Text (wie Dokumenten oder Passagen) in dichte Vektordarstellungen verantwortlich, die allgemein als Einbettungen bezeichnet werden.

- Diese Einbettungen erfassen die semantische Bedeutung des Textes und ermöglichen effiziente und semantisch sinnvolle Vergleiche zwischen verschiedenen Textteilen.

- Das Einbettungsmodell kann auf demselben umfangreichen Korpus wie das Basismodell trainiert oder auf bestimmte Domänen spezialisiert werden.

Q&A-Workflow

Die folgenden Schritte beschreiben den Arbeitsablauf der Fragebeantwortung über Dokumente:

- Der Benutzer meldet sich bei der von Amazon Cognito authentifizierten Web-App an.

- Der Benutzer lädt ein oder mehrere Dokumente auf Amazon S3 hoch.

- Bei der Dokumentübertragung löst eine S3-Ereignisbenachrichtigung eine Lambda-Funktion aus, die dann den Endpunkt des SageMaker-Einbettungsmodells aufruft, um Einbettungen für das neue Dokument zu generieren. Das Einbettungsmodell wandelt die Frage in eine dichte Vektordarstellung um (Einbettung). Die resultierende Vektordatei wird sicher im S3-Bucket gespeichert.

- Der FAISS-Retriever vergleicht die Einbettung dieser Frage mit den Einbettungen aller Dokumente oder Passagen in der Datenbank, um die relevantesten Passagen zu finden.

- Die Passagen werden zusammen mit der Frage des Benutzers als Kontext für das grundlegende Modell bereitgestellt. Die Lambda-Funktion verwendet die LangChain-Bibliothek und stellt mit einer kontextgefüllten Abfrage eine Verbindung zum Amazon Bedrock- oder SageMaker JumpStart-Endpunkt her.

- Die Antwort vom LLM wird in DynamoDB zusammen mit der Anfrage des Benutzers, dem Zeitstempel, einer eindeutigen Kennung und anderen willkürlichen Kennungen für das Element, wie z. B. der Fragekategorie, gespeichert. Durch das Speichern von Frage und Antwort als separate Elemente kann die Lambda-Funktion den Gesprächsverlauf eines Benutzers basierend auf dem Zeitpunkt, zu dem Fragen gestellt wurden, einfach neu erstellen.

- Schließlich wird die Antwort über eine HTTPS-Anfrage über die API Gateway WebSocket API-Integrationsantwort an den Benutzer zurückgesendet.

Benefits

Die folgende Liste beschreibt die Vorteile dieser Lösung:

- Semantisches Verständnis – Das Einbettungsmodell stellt sicher, dass der Retriever Passagen auf der Grundlage eines tiefen semantischen Verständnisses und nicht nur auf der Grundlage von Schlüsselwortübereinstimmungen auswählt.

- Skalierbarkeit – Einbettungen ermöglichen effiziente Ähnlichkeitsvergleiche und machen das schnelle Durchsuchen umfangreicher Dokumentendatenbanken möglich.

- Flexibilität – Das Basismodell kann Antworten basierend auf einer Vielzahl von Kontexten generieren und stellt so sicher, dass das System vielseitig bleibt.

- Domänenanpassungsfähigkeit – Das Einbettungsmodell kann für bestimmte Domänen trainiert oder feinabgestimmt werden, sodass das System für verschiedene Anwendungen angepasst werden kann.

Foundation Models Pharma-Anzeigengenerator

In der heutigen schnelllebigen Pharmaindustrie ist effiziente und lokalisierte Werbung wichtiger denn je. Hier kommt eine innovative Lösung ins Spiel, die die Leistungsfähigkeit generativer KI nutzt, um lokalisierte Pharma-Anzeigen aus Quellbildern und PDFs zu erstellen. Dieser Ansatz beschleunigt nicht nur den Anzeigenerstellungsprozess, sondern rationalisiert auch den Medical Legal Review (MLR)-Prozess. MLR ist ein strenger Überprüfungsmechanismus, bei dem medizinische, juristische und behördliche Teams Werbematerialien sorgfältig bewerten, um deren Richtigkeit, wissenschaftliche Unterstützung und Einhaltung gesetzlicher Vorschriften zu gewährleisten. Herkömmliche Methoden zur Inhaltserstellung können umständlich sein und erfordern oft manuelle Anpassungen und umfangreiche Überprüfungen, um die Übereinstimmung mit regionaler Compliance und Relevanz sicherzustellen. Mit dem Aufkommen der generativen KI können wir nun jedoch die Erstellung von Anzeigen automatisieren, die bei den lokalen Zielgruppen wirklich Anklang finden, und das alles unter Einhaltung strenger Standards und Richtlinien.

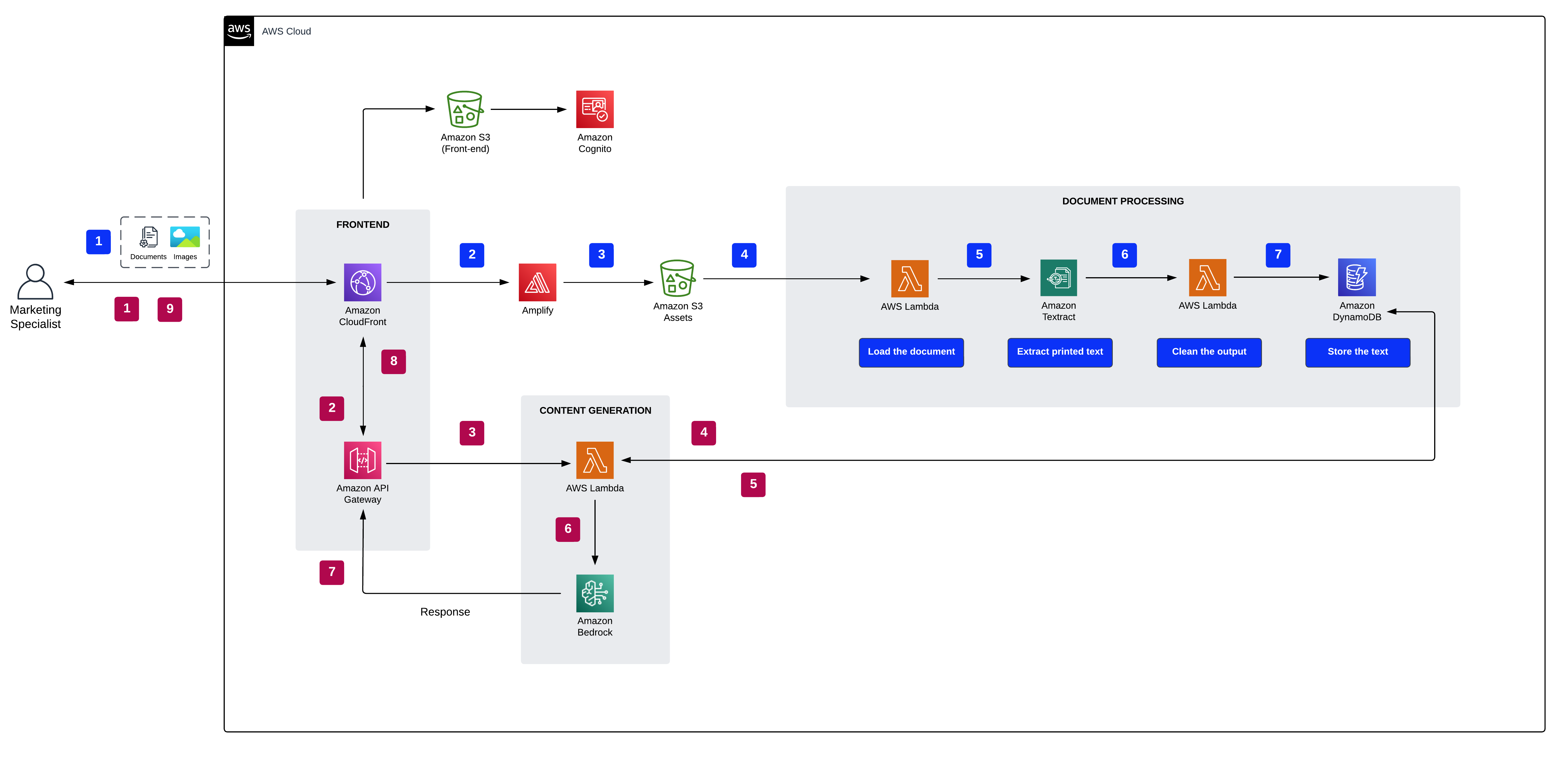

Das folgende Diagramm zeigt die Lösungsarchitektur.

Im Architekturlayout werden Benutzer basierend auf ihren ausgewählten Modell- und Anzeigenpräferenzen nahtlos zu den Fundamentmodellen von Amazon Bedrock geführt. Dieser optimierte Ansatz stellt sicher, dass neue Anzeigen genau gemäß der gewünschten Konfiguration generiert werden. Im Rahmen des Prozesses werden Dokumente effizient bearbeitet Amazontext, wobei der resultierende Text sicher in DynamoDB gespeichert wird. Ein herausragendes Merkmal ist der modulare Aufbau für die Bild- und Textgenerierung, der Ihnen die Flexibilität gibt, jede Komponente nach Bedarf unabhängig neu zu generieren.

Wir haben diese Demo im bereitgestellt GitHub Repo. Informationen zur Bereitstellung in Ihrem AWS-Konto finden Sie in den Bereitstellungsanweisungen in der Readme-Datei.

Workflow zur Inhaltsgenerierung

Die folgenden Schritte beschreiben den Prozess zur Inhaltsgenerierung:

- Der Benutzer wählt sein Dokument, sein Quellbild, seine Anzeigenplatzierung, seine Sprache und seinen Bildstil.

- Der sichere Zugriff auf die Webanwendung wird durch die Amazon Cognito-Authentifizierung gewährleistet.

- Das Frontend der Webanwendung wird über Amplify gehostet.

- Eine von API Gateway verwaltete WebSocket-API erleichtert Benutzeranfragen. Diese Anfragen werden durch authentifiziert AWS Identity and Access Management and (ICH BIN).

- Die Integration mit Amazon Bedrock umfasst die folgenden Schritte:

- Eine Lambda-Funktion nutzt die LangChain-Bibliothek, um mithilfe einer kontextreichen Abfrage eine Verbindung zum Amazon Bedrock-Endpunkt herzustellen.

- Das Text-zu-Text-Grundmodell erstellt eine kontextbezogene Anzeige basierend auf dem gegebenen Kontext und den gegebenen Einstellungen.

- Das Text-zu-Bild-Grundmodell erstellt ein maßgeschneidertes Bild, das vom Quellbild, dem gewählten Stil und dem Standort beeinflusst wird.

- Der Benutzer erhält die Antwort durch eine HTTPS-Anfrage über die integrierte API Gateway WebSocket API.

Workflow für die Dokumenten- und Bildverarbeitung

Für die Bearbeitung von Dokumenten und Bildern gehen Sie wie folgt vor:

- Der Benutzer lädt Assets über die angegebene Benutzeroberfläche hoch.

- Die Amplify API überträgt die Dokumente in einen S3-Bucket.

- Nachdem das Asset an Amazon S3 übertragen wurde, findet eine der folgenden Aktionen statt:

- Wenn es sich um ein Dokument handelt, verwendet eine Lambda-Funktion Amazon Textract, um Text für die Anzeigengenerierung zu verarbeiten und zu extrahieren.

- Wenn es sich um ein Bild handelt, konvertiert die Lambda-Funktion es in das Base64-Format, das für das Stable Diffusion-Modell geeignet ist, um aus der Quelle ein neues Bild zu erstellen.

- Der extrahierte Text oder die Base64-Bildzeichenfolge wird sicher in DynamoDB gespeichert.

Benefits

Die folgende Liste beschreibt die Vorteile dieser Lösung:

- Effizienz – Der Einsatz generativer KI beschleunigt den Anzeigenerstellungsprozess deutlich und macht manuelle Anpassungen überflüssig.

- Compliance-Einhaltung – Die Lösung stellt sicher, dass generierte Anzeigen bestimmten Richtlinien und Vorschriften entsprechen, beispielsweise den Marketingrichtlinien der FDA.

- Kosteneffizient – Durch die Automatisierung der Erstellung maßgeschneiderter Anzeigen können Unternehmen die mit der Anzeigenproduktion und -überarbeitung verbundenen Kosten erheblich senken.

- Optimierter MLR-Prozess – Die Lösung vereinfacht den MLR-Prozess, reduziert Reibungspunkte und sorgt für reibungslosere Überprüfungen.

- Lokalisierte Resonanz – Generative KI produziert Anzeigen, die beim lokalen Publikum ankommen und so für Relevanz und Wirkung in verschiedenen Regionen sorgen.

- Standardisierung – Die Lösung hält die notwendigen Standards und Richtlinien ein und gewährleistet so die Konsistenz aller generierten Anzeigen.

- Skalierbarkeit – Der KI-gesteuerte Ansatz kann große Datenbanken mit Quellbildern und PDFs verarbeiten und ist somit für die Generierung groß angelegter Anzeigen geeignet.

- Reduzierte manuelle Eingriffe – Die Automatisierung reduziert den Bedarf an menschlichem Eingreifen, minimiert Fehler und sorgt für Konsistenz.

Sie können die Infrastruktur in diesem Tutorial von Ihrem lokalen Computer aus bereitstellen oder AWS Cloud9 als Bereitstellungsarbeitsstation verwenden. AWS Cloud9 ist mit AWS CLI, AWS CDK und Docker vorinstalliert. Wenn Sie sich für AWS Cloud9 entscheiden, die Umgebung schaffen von dem AWS Cloud9-Konsole.

Aufräumen

Um unnötige Kosten zu vermeiden, bereinigen Sie die gesamte erstellte Infrastruktur über die AWS CloudFormation-Konsole oder indem Sie den folgenden Befehl auf Ihrer Workstation ausführen:

Denken Sie außerdem daran, alle SageMaker-Endpunkte zu stoppen, die Sie über die SageMaker-Konsole initiiert haben. Denken Sie daran, dass durch das Löschen eines Amazon Kendra-Index nicht die Originaldokumente aus Ihrem Speicher entfernt werden.

Zusammenfassung

Generative KI, verkörpert durch LLMs, kündigt einen Paradigmenwechsel in der Art und Weise an, wie wir auf Informationen zugreifen und diese generieren. Diese Modelle sind zwar leistungsstark, werden jedoch oft durch die Grenzen ihrer Trainingsdaten eingeschränkt. RAG stellt sich dieser Herausforderung und stellt sicher, dass das umfangreiche Wissen in diesen Modellen kontinuierlich mit relevanten, aktuellen Erkenntnissen angereichert wird.

Unsere RAG-basierten Demos sind ein greifbarer Beweis dafür. Sie demonstrieren die nahtlose Synergie zwischen Amazon Kendra, Vektoreinbettungen und LLMs und schaffen ein System, in dem die Informationen nicht nur umfangreich, sondern auch präzise und aktuell sind. Wenn Sie in diese Demos eintauchen, werden Sie aus erster Hand das transformative Potenzial der Zusammenführung von vorab trainiertem Wissen mit den dynamischen Fähigkeiten von RAG erkunden, was zu Ergebnissen führt, die sowohl vertrauenswürdig als auch auf Unternehmensinhalte zugeschnitten sind.

Obwohl die durch LLMs unterstützte generative KI eine neue Möglichkeit zur Gewinnung von Informationserkenntnissen eröffnet, müssen diese Erkenntnisse vertrauenswürdig sein und sich auf Unternehmensinhalte beschränken, die den RAG-Ansatz verwenden. Mit diesen RAG-basierten Demos erhalten Sie genaue und aktuelle Erkenntnisse. Die Qualität dieser Erkenntnisse hängt von der semantischen Relevanz ab, die durch die Verwendung von Amazon Kendra und Vektoreinbettungen ermöglicht wird.

Wenn Sie bereit sind, die Leistungsfähigkeit der generativen KI weiter zu erforschen und zu nutzen, sind hier Ihre nächsten Schritte:

- Nehmen Sie an unseren Demos teil – Die praktische Erfahrung ist von unschätzbarem Wert. Entdecken Sie die Funktionen, verstehen Sie die Integrationen und machen Sie sich mit der Benutzeroberfläche vertraut.

- Vertiefen Sie Ihr Wissen – Nutzen Sie die verfügbaren Ressourcen. AWS bietet ausführliche Dokumentation, Tutorials und Community-Support, um Sie bei Ihrer KI-Reise zu unterstützen.

- Starten Sie ein Pilotprojekt – Erwägen Sie, mit einer kleinen Implementierung generativer KI in Ihrem Unternehmen zu beginnen. Dadurch erhalten Sie Einblicke in die Praktikabilität und Anpassungsfähigkeit des Systems in Ihrem spezifischen Kontext.

Weitere Informationen zu generativen KI-Anwendungen auf AWS finden Sie hier:

Denken Sie daran, dass sich die KI-Landschaft ständig weiterentwickelt. Bleiben Sie auf dem Laufenden, bleiben Sie neugierig und seien Sie stets bereit für Anpassungen und Innovationen.

Über den Autor

Jin Tan Ruan ist ein Prototyping-Entwickler im AWS Industries Prototyping and Customer Engineering (PACE)-Team, spezialisiert auf NLP und generative KI. Mit einem Hintergrund in der Softwareentwicklung und neun AWS-Zertifizierungen bringt Jin einen großen Erfahrungsschatz mit, um AWS-Kunden bei der Verwirklichung ihrer KI/ML- und generativen KI-Visionen mithilfe der AWS-Plattform zu unterstützen. Er hat einen Master-Abschluss in Informatik und Softwaretechnik von der University of Syracuse. Außerhalb der Arbeit spielt Jin gerne Videospiele und taucht in die spannende Welt der Horrorfilme ein.

Jin Tan Ruan ist ein Prototyping-Entwickler im AWS Industries Prototyping and Customer Engineering (PACE)-Team, spezialisiert auf NLP und generative KI. Mit einem Hintergrund in der Softwareentwicklung und neun AWS-Zertifizierungen bringt Jin einen großen Erfahrungsschatz mit, um AWS-Kunden bei der Verwirklichung ihrer KI/ML- und generativen KI-Visionen mithilfe der AWS-Plattform zu unterstützen. Er hat einen Master-Abschluss in Informatik und Softwaretechnik von der University of Syracuse. Außerhalb der Arbeit spielt Jin gerne Videospiele und taucht in die spannende Welt der Horrorfilme ein.

Aravind Kodandaramaiah ist Senior Prototyping Full-Stack-Lösungsentwickler im AWS Industries Prototyping and Customer Engineering (PACE)-Team. Er konzentriert sich darauf, AWS-Kunden dabei zu helfen, innovative Ideen in Lösungen mit messbaren und erfreulichen Ergebnissen umzusetzen. Seine Leidenschaft gilt einer Reihe von Themen, darunter Cloud-Sicherheit, DevOps und KI/ML, und man findet ihn häufig beim Tüfteln an diesen Technologien.

Aravind Kodandaramaiah ist Senior Prototyping Full-Stack-Lösungsentwickler im AWS Industries Prototyping and Customer Engineering (PACE)-Team. Er konzentriert sich darauf, AWS-Kunden dabei zu helfen, innovative Ideen in Lösungen mit messbaren und erfreulichen Ergebnissen umzusetzen. Seine Leidenschaft gilt einer Reihe von Themen, darunter Cloud-Sicherheit, DevOps und KI/ML, und man findet ihn häufig beim Tüfteln an diesen Technologien.

Arjun Shakdher ist ein Entwickler im AWS Industries Prototyping (PACE)-Team, der sich leidenschaftlich dafür einsetzt, Technologie in die Struktur des Lebens zu integrieren. Arjun verfügt über einen Master-Abschluss der Purdue University und seine aktuelle Rolle konzentriert sich auf die Architektur und den Bau hochmoderner Prototypen, die eine Reihe von Bereichen abdecken, wobei derzeit vor allem die Bereiche KI/ML und IoT im Vordergrund stehen. Wenn er nicht gerade in Codes und digitale Landschaften eintaucht, taucht Arjun in die Welt des Kaffees ein, erforscht die komplizierten Mechanismen der Uhrmacherkunst oder schwelgt in der Kunstfertigkeit von Automobilen.

Arjun Shakdher ist ein Entwickler im AWS Industries Prototyping (PACE)-Team, der sich leidenschaftlich dafür einsetzt, Technologie in die Struktur des Lebens zu integrieren. Arjun verfügt über einen Master-Abschluss der Purdue University und seine aktuelle Rolle konzentriert sich auf die Architektur und den Bau hochmoderner Prototypen, die eine Reihe von Bereichen abdecken, wobei derzeit vor allem die Bereiche KI/ML und IoT im Vordergrund stehen. Wenn er nicht gerade in Codes und digitale Landschaften eintaucht, taucht Arjun in die Welt des Kaffees ein, erforscht die komplizierten Mechanismen der Uhrmacherkunst oder schwelgt in der Kunstfertigkeit von Automobilen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/harnessing-the-power-of-enterprise-data-with-generative-ai-insights-from-amazon-kendra-langchain-and-large-language-models/

- :Ist

- :nicht

- :Wo

- $UP

- 100

- 150

- 7

- a

- Fähigkeit

- LiveBuzz

- beschleunigt

- Zugang

- Nach

- Konto

- Genauigkeit

- genau

- über

- Aktionen

- Ad

- automatisch

- passt sich an

- hinzugefügt

- Adressen

- haften

- Anpassungen

- Die Annahme

- Siehe Werbung

- advanced

- Vorteil

- Vorteilen

- Advent

- Marketings

- Nach der

- AI

- AI / ML

- Hilfe

- Ausrichtung

- Alle

- erlauben

- Zulassen

- erlaubt

- fast

- entlang

- ebenfalls

- Alternative

- immer

- Amazon

- Amazon Cognito

- Amazon Kendra

- Amazontext

- Amazon Web Services

- Beträge

- verstärken

- an

- und

- beantworten

- Antworten

- jedem

- Bienen

- App

- Anwendung

- Anwendungen

- Ansatz

- angemessen

- architektonisch

- Architektur

- SIND

- um

- Feld

- Kunst

- AS

- Vermögenswert

- Details

- helfen

- damit verbundenen

- Publikum

- Audio-

- authentifiziert

- Authentifizierung

- automatisieren

- automatisieren

- Automation

- verfügbar

- vermeiden

- Vermeidung von

- AWS

- AWS Cloud9

- AWS CloudFormation

- Zurück

- unterstützt

- Hintergrund

- Unterstützung

- Base

- basierend

- BE

- weil

- werden

- wird

- Vorteile

- Besser

- zwischen

- Beyond

- Vorurteile

- Vermischung

- Körper

- Wander- und Outdoorschuhen

- beide

- Filiale

- Brings

- breit

- Baumeister

- Building

- aber

- by

- Aufrufe

- CAN

- Kann bekommen

- Fähigkeiten

- Erfassung

- Captures

- Häuser

- Kategorie

- Zertifizierungen

- challenges

- Herausforderungen

- Auswählen

- gewählt

- reinigen

- Cloud

- Cloud-Sicherheit

- Cloud9

- Code

- Kaffee

- kombiniert

- vereint

- kommt

- häufig

- community

- Unternehmen

- Vergleiche

- Komplex

- Compliance

- konform

- Komponente

- begreift

- Computer

- Computerwissenschaften

- Konfiguration

- Vernetz Dich

- Verbindungen

- Connects

- Geht davon

- konsequent

- Konsul (Console)

- ständig

- Inhalt

- Generierung von Inhalten

- Inhaltserstellung

- Kontext

- Kontexte

- kontextuelle

- weiter

- kontinuierlich

- Praktische

- konventionellen

- Gespräch

- Umwandlung

- Kernbereich

- Kosten

- Kosten

- Handwerk

- erstellen

- erstellt

- schafft

- Erstellen

- Schaffung

- wichtig

- schwerfällig

- neugierig

- Strom

- Original

- Kunde

- Kunden

- innovativ, auf dem neuesten Stand

- technische Daten

- Datenbase

- Datenbanken

- Datensätze

- Datum

- tief

- tiefer

- Grad

- reizvoll

- Demo

- Demos

- abhängig

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- beschreiben

- Design

- entworfen

- erwünscht

- zerstören

- detailliert

- Details

- Entwickler:in / Unternehmen

- Entwicklung

- Diagnose

- anders

- Rundfunk

- digital

- gerichtet

- Displays

- deutlich

- tauchen

- verschieden

- Tauchen

- Docker

- Dokument

- Dokumentation

- Unterlagen

- Tut nicht

- Domains

- zeichnen

- Zeichnung

- angetrieben

- dynamisch

- leicht

- Effizienz

- effizient

- effizient

- entweder

- eliminieren

- Einbettung

- entstehen

- beschäftigt

- ermächtigt

- befähigt

- ermöglichen

- freigegeben

- ermöglicht

- ermöglichen

- Ende

- Endpunkt

- Entwicklung

- verbesserte

- bereichernd

- gewährleisten

- gesichert

- sorgt

- Gewährleistung

- Unternehmen

- Ganz

- ausgestattet

- Fehler

- insbesondere

- Essenz

- bewerten

- Event

- ÜBERHAUPT

- entwickelt sich

- sich entwickelnden

- Beispiel

- aufgeregt

- expansiv

- ERFAHRUNGEN

- Experte

- Experten

- ERKUNDEN

- Möglichkeiten sondieren

- umfangreiche

- extern

- Extrakt

- Stoff

- erleichtert

- vertraut machen

- schnelllebig

- FB

- möglich

- Merkmal

- Eigenschaften

- Einzigartige

- Reichen Sie das

- Filterung

- Finden Sie

- Vorname

- Flexibilität

- konzentriert

- Folgende

- folgt

- Aussichten für

- Format

- gefunden

- Foundation

- Reibung

- für

- Materials des

- Vorderes Ende

- voller

- Voller Stapel

- Funktion

- Funktionsumfang

- weiter

- Außerdem

- Gewinnen

- gewinnen

- Games

- Tor

- erzeugen

- erzeugt

- Generation

- generativ

- Generative KI

- Generator

- bekommen

- gegeben

- Unterstützung

- Gewährung

- Griff

- Wächst

- Garantie

- die Vermittlung von Kompetenzen,

- geführt

- Richtlinien

- Griff

- praktische

- Geschirr

- Nutzen

- Haben

- mit

- he

- Unternehmen

- Herolde

- hier

- Highlights

- selbst

- Geschichten

- Geschichte

- Halten

- hält

- Horror

- gehostet

- Ultraschall

- aber

- HTML

- http

- HTTPS

- human

- Ideen

- Kennzeichnung

- Identifikatoren

- identifizieren

- Identitätsschutz

- if

- zeigt

- Image

- Bilder

- eingetaucht

- Impact der HXNUMXO Observatorien

- Implementierung

- in

- eingehende

- ungenau

- Dazu gehören

- Einschließlich

- integrieren

- unabhängig

- Index

- indiziert

- Indizes

- Branchen

- Energiegewinnung

- Industrie-Standards

- beeinflusst

- Information

- informiert

- Infrastruktur

- von Natur aus

- Anfangs-

- initiiert

- wir innovieren

- innovativ

- aufschlussreiche

- Einblicke

- beantragen müssen

- Anleitung

- integriert

- Integriert

- Integration

- Integrationen

- Absicht

- interagiert

- Schnittstelle

- Intervention

- in

- innere

- unschätzbar

- iot

- IT

- Artikel

- SEINE

- Job

- Reise

- jpg

- nur

- Wissen

- bekannt

- Landschaft

- Sprache

- grosse

- großflächig

- Layout

- lernen

- Rechtlich

- Lasst uns

- Bibliothek

- Zugelassen

- Lebensdauer

- Gefällt mir

- Wahrscheinlichkeit

- Limitiert

- Grenzen

- Liste

- LLM

- aus einer regionalen

- Standorte

- Maschine

- Maschinelles Lernen

- unterhält

- Making

- verwaltet

- manuell

- viele

- Marketing

- massiv

- Meister

- Streichhölzer

- Materialien

- Bedeutung

- sinnvoll

- Bedeutungen

- Mittel

- Mechanik

- Mechanismus

- sowie medizinische

- Memory

- nur

- verschmilzt

- Verschmelzung

- Methoden

- sorgfältig

- minimieren

- Milderung

- ML

- Modell

- Modellieren

- für

- modulare

- mehr

- vor allem warme

- Filme

- sollen

- Natürliche

- Verarbeitung natürlicher Sprache

- notwendig,

- Need

- erforderlich

- benötigen

- Bedürfnisse

- Neu

- weiter

- neun

- Nlp

- Benachrichtigung

- jetzt an

- of

- bieten

- Angebote

- vorgenommen,

- on

- EINEM

- einzige

- öffnet

- or

- organisatorisch

- Organisationen

- Original

- Andere

- UNSERE

- Ergebnisse

- skizzieren

- Ausgänge

- aussen

- übrig

- Überwinden

- Frieden

- Paradigma

- Parameter

- Teil

- leidenschaftlich

- perfekt

- Berechtigungen

- Personalisiert

- Pharma

- Biowissenschaften

- Sätze

- Stücke

- Pilot

- Pilotprojekt

- Ort

- Platzierung

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- Play

- spielend

- Punkte

- Positionierung

- möglich

- Post

- Potenzial

- Werkzeuge

- angetriebene

- größte treibende

- Praktisch

- präzise

- genau

- Präzision

- Vorlieben

- Voraussetzungen

- gegenwärtig

- Verfahren

- Prozessdefinierung

- Verarbeitet

- Verarbeitung

- Produziert

- produziert

- Produktion

- Projekt

- Werbe-

- Prototypen

- Prototyping

- Belegen

- die

- vorausgesetzt

- bietet

- Bereitstellung

- Qualität

- Abfragen

- Frage

- Fragen

- Direkt

- schnell

- Angebot

- bereit

- Reiche

- erhält

- Empfang

- Software Empfehlungen

- Veteran

- reduziert

- Reduzierung

- siehe

- raffiniert

- regional

- Regionen

- regulär

- Vorschriften

- Regulierungsbehörden

- Erfüllung gesetzlicher Auflagen

- Relevanz

- relevant

- sich auf

- bleiben

- bleibt bestehen

- merken

- entfernen

- umformulieren

- Darstellung

- representiert

- Anforderung

- Zugriffe

- erfordern

- falls angefordert

- Voraussetzungen:

- Resonanz

- Downloads

- Antwort

- Antworten

- Verantwortlichkeiten

- für ihren Verlust verantwortlich.

- resultierende

- was zu

- Die Ergebnisse

- Überprüfen

- Bewertungen

- Revisionen

- dreht sich

- Recht

- rigoros

- Rollen

- Laufen

- läuft

- sagemaker

- gleich

- Gerettet

- Wissenschaft

- wissenschaftlich

- nahtlos

- nahtlos

- Suche

- Abschnitte

- Verbindung

- sicher

- Sicherheitdienst

- ausgewählt

- Auswahl

- Senior

- geschickt

- Lösungen

- kompensieren

- Einstellungen

- Setup

- verschieben

- Vitrine

- Konzerte

- Sieben

- signifikant

- bedeutend

- Einfacher

- einfach

- kleinere

- glatter

- Software

- Software-Entwicklung

- Softwareentwicklung

- allein

- Lösung

- Lösungen

- Quelle

- bezogen

- Quellen

- Sourcing

- Räume

- Spannweite

- spezialisiert

- spezialisieren

- spezifisch

- angegeben

- stabil

- Stapel

- Normen

- Beginnen Sie

- State-of-the-art

- bleiben

- Schritt

- Shritte

- Stoppen

- Lagerung

- speichern

- gelagert

- Speicherung

- gestrafft

- Stärken

- Schnur

- stringent

- strukturierte

- Stil

- abschicken

- so

- geeignet

- Support

- Unterstützte

- Synergie

- System

- zugeschnitten

- Nehmen

- nimmt

- greifbar

- Aufgabe

- und Aufgaben

- Team

- Teams

- Technik

- Technologies

- Technologie

- Testament

- Text

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Landschaft

- Die Quelle

- die Welt

- ihr

- Sie

- dann

- damit

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- nach drei

- spannend

- Durch

- Zeit

- rechtzeitig

- Zeitstempel

- Titan

- zu

- heutigen

- Werkzeug

- Werkzeuge

- Thema

- Themen

- gegenüber

- traditionell

- Training

- trainiert

- Ausbildung

- privaten Transfer

- übertragen

- Transfers

- Transformieren

- transformierend

- Transformer

- Trends

- wirklich

- vertrauenswürdig

- WENDE

- Lernprogramm

- Tutorials

- Typen

- ui

- unterziehen

- zugrunde liegen,

- verstehen

- Verständnis

- einzigartiges

- Universität

- nicht wie

- unnötig

- enthüllen

- auf dem neusten Stand

- Aktualisierung

- aktualisiert

- Updates

- Aufrechterhaltung

- auf

- -

- Anwendungsfall

- Mitglied

- Benutzerschnittstelle

- Nutzer

- verwendet

- Verwendung von

- gewöhnlich

- die

- Verwendung

- verschiedene

- riesig

- vielseitig

- Video

- Videospiele

- Visionen

- Weg..

- we

- Reichtum

- Netz

- Internetanwendung

- Web-Services

- Websocket

- waren

- wann

- welche

- während

- WHO

- breit

- Große Auswahl

- werden wir

- mit

- .

- ohne

- Worte

- Arbeiten

- Arbeitsablauf.

- Arbeitsplatz

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- Du

- Ihr

- sich selbst

- Zephyrnet