Kunden aus den Bereichen Gesundheitswesen und Biowissenschaften (HCLS) nutzen generative KI als Werkzeug, um mehr aus ihren Daten herauszuholen. Zu den Anwendungsfällen gehören die Zusammenfassung von Dokumenten, um den Lesern zu helfen, sich auf die Kernpunkte eines Dokuments zu konzentrieren, und die Umwandlung von unstrukturiertem Text in standardisierte Formate, um wichtige Attribute hervorzuheben. Aufgrund einzigartiger Datenformate und strenger regulatorischer Anforderungen suchen Kunden nach Möglichkeiten, das leistungsstärkste und kostengünstigste Modell auszuwählen und die Möglichkeit zu haben, die erforderliche Anpassung (Feinabstimmung) an ihren Geschäftsanwendungsfall vorzunehmen. In diesem Beitrag führen wir Sie durch die Bereitstellung eines Falcon Large Language Model (LLM) mit Amazon SageMaker-JumpStart und Verwendung des Modells zum Zusammenfassen langer Dokumente mit LangChain und Python.

Lösungsüberblick

Amazon Sage Maker basiert auf Amazons zwei Jahrzehnten Erfahrung in der Entwicklung realer ML-Anwendungen, darunter Produktempfehlungen, Personalisierung, intelligentes Einkaufen, Robotik und sprachgestützte Geräte. SageMaker ist ein HIPAA-fähiger verwalteter Dienst, der Tools bereitstellt, die es Datenwissenschaftlern, ML-Ingenieuren und Geschäftsanalysten ermöglichen, mit ML Innovationen zu entwickeln. Innerhalb von SageMaker ist Amazon SageMaker-Studio, eine integrierte Entwicklungsumgebung (IDE), die speziell für kollaborative ML-Workflows entwickelt wurde und wiederum eine Vielzahl von Schnellstartlösungen und vorab trainierten ML-Modellen in einem integrierten Hub namens SageMaker JumpStart enthält. Mit SageMaker JumpStart können Sie vorab trainierte Modelle wie Falcon LLM mit vorgefertigten Beispiel-Notebooks und SDK-Unterstützung verwenden, um mit diesen leistungsstarken Transformer-Modellen zu experimentieren und sie einzusetzen. Sie können SageMaker Studio und SageMaker JumpStart verwenden, um Ihr eigenes generatives Modell in Ihrem AWS-Konto bereitzustellen und abzufragen.

Sie können auch sicherstellen, dass die Inferenznutzlastdaten Ihre VPC nicht verlassen. Sie können Modelle als Single-Tenant-Endpunkte bereitstellen und sie mit Netzwerkisolation bereitstellen. Darüber hinaus können Sie den ausgewählten Satz von Modellen, die Ihren eigenen Sicherheitsanforderungen entsprechen, kuratieren und verwalten, indem Sie die Funktion „Private Model Hub“ in SageMaker JumpStart nutzen und die genehmigten Modelle dort speichern. SageMaker ist in Planung HIPAA BAA, SOC123 und HITRUST CSF.

Das Falcon LLM ist ein großes Sprachmodell, das von Forschern des Technology Innovation Institute (TII) auf über 1 Billion Token mithilfe von AWS trainiert wurde. Falcon verfügt über viele verschiedene Variationen, wobei die beiden Hauptbestandteile Falcon 40B und Falcon 7B aus 40 Milliarden bzw. 7 Milliarden Parametern bestehen, wobei fein abgestimmte Versionen für bestimmte Aufgaben trainiert werden, beispielsweise das Befolgen von Anweisungen. Falcon eignet sich hervorragend für eine Vielzahl von Aufgaben, darunter Textzusammenfassung, Stimmungsanalyse, Beantwortung von Fragen und Konversation. Dieser Beitrag bietet eine exemplarische Vorgehensweise, die Sie befolgen können, um Falcon LLM in Ihrem AWS-Konto bereitzustellen, indem Sie eine verwaltete Notebook-Instanz über SageMaker JumpStart verwenden, um mit der Textzusammenfassung zu experimentieren.

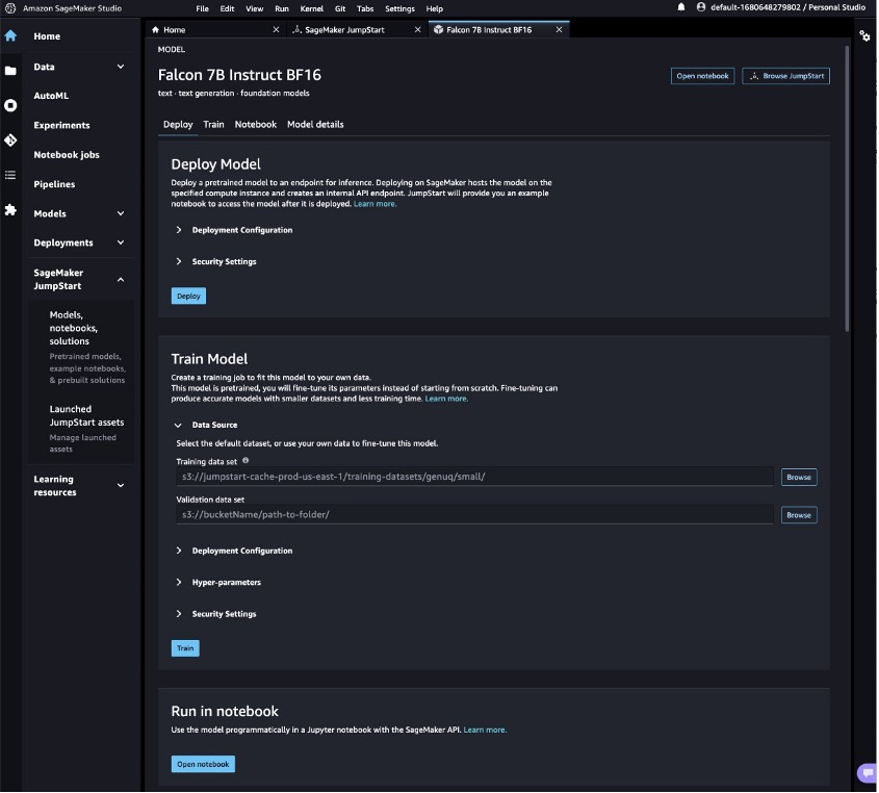

Der SageMaker JumpStart-Modell-Hub enthält vollständige Notebooks zum Bereitstellen und Abfragen jedes Modells. Zum jetzigen Zeitpunkt sind im SageMaker JumpStart-Modellhub sechs Versionen von Falcon verfügbar: Falcon 40B Instruct BF16, Falcon 40B BF16, Falcon 180B BF16, Falcon 180B Chat BF16, Falcon 7B Instruct BF16 und Falcon 7B BF16. In diesem Beitrag wird das Falcon 7B Instruct-Modell verwendet.

In den folgenden Abschnitten zeigen wir, wie Sie mit der Zusammenfassung von Dokumenten beginnen, indem Sie Falcon 7B auf SageMaker Jumpstart bereitstellen.

Voraussetzungen:

Für dieses Tutorial benötigen Sie ein AWS-Konto mit einer SageMaker-Domäne. Wenn Sie noch keine SageMaker-Domäne haben, lesen Sie hier Integrieren in die Amazon SageMaker-Domäne um eins zu erstellen.

Stellen Sie Falcon 7B mit SageMaker JumpStart bereit

Führen Sie die folgenden Schritte aus, um Ihr Modell bereitzustellen:

- Navigieren Sie über die SageMaker-Konsole zu Ihrer SageMaker Studio-Umgebung.

- Innerhalb der IDE, unter SageMaker-JumpStart Wählen Sie im Navigationsbereich Modelle, Notizbücher, Lösungen.

- Stellen Sie das Falcon 7B Instruct-Modell zur Inferenz auf einem Endpunkt bereit.

Dadurch wird die Modellkarte für das Modell Falcon 7B Instruct BF16 geöffnet. Auf dieser Seite finden Sie die Deploy or Training Optionen sowie Links zum Öffnen der Beispielnotizbücher in SageMaker Studio. In diesem Beitrag wird das Beispielnotizbuch von SageMaker JumpStart zum Bereitstellen des Modells verwendet.

- Auswählen Notizbuch öffnen.

- Führen Sie die ersten vier Zellen des Notebooks aus, um den Falcon 7B Instruct-Endpunkt bereitzustellen.

Sie können Ihre bereitgestellten JumpStart-Modelle auf der Seite sehen JumpStart-Assets eingeführt

- Im Navigationsbereich unter SageMaker-Starthilfe, wählen JumpStart-Assets eingeführt.

- Wähle die Modellendpunkte Klicken Sie auf die Registerkarte, um den Status Ihres Endpunkts anzuzeigen.

Sobald der Falcon LLM-Endpunkt bereitgestellt ist, können Sie das Modell abfragen.

Führen Sie Ihre erste Abfrage aus

Führen Sie die folgenden Schritte aus, um eine Abfrage auszuführen:

- Auf dem Reichen Sie das Menü, wählen Sie Neu und Notizbuch um ein neues Notizbuch zu öffnen.

Sie können das fertige Notizbuch auch herunterladen hier.

- Wählen Sie das Image, den Kernel und den Instanztyp aus, wenn Sie dazu aufgefordert werden. Für diesen Beitrag wählen wir das Data Science 3.0-Image, den Python 3-Kernel und die ml.t3.medium-Instanz.

- Importieren Sie die Boto3- und JSON-Module, indem Sie die folgenden zwei Zeilen in die erste Zelle eingeben:

- Öffentlichkeitsarbeit/Presse Umschalt + Eingabetaste um die Zelle zu betreiben.

- Als Nächstes können Sie eine Funktion definieren, die Ihren Endpunkt aufruft. Diese Funktion nimmt eine Wörterbuchnutzlast und verwendet sie, um den SageMaker-Laufzeitclient aufzurufen. Anschließend deserialisiert es die Antwort und gibt die Eingabe und den generierten Text aus.

Die Nutzlast umfasst die Eingabeaufforderung als Eingaben sowie die Inferenzparameter, die an das Modell übergeben werden.

- Sie können diese Parameter mit der Eingabeaufforderung verwenden, um die Ausgabe des Modells für Ihren Anwendungsfall abzustimmen:

Abfrage mit einer Zusammenfassungsaufforderung

In diesem Beitrag wird eine Beispielforschungsarbeit verwendet, um die Zusammenfassung zu demonstrieren. Die Beispieltextdatei befasst sich mit der automatischen Textzusammenfassung in der biomedizinischen Literatur. Führen Sie die folgenden Schritte aus:

- Herunterladen das PDF und kopieren Sie den Text in eine Datei mit dem Namen

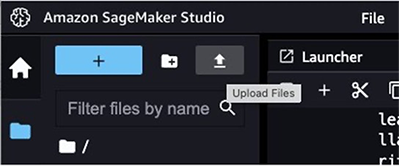

document.txt. - Wählen Sie in SageMaker Studio das Upload-Symbol und laden Sie die Datei auf Ihre SageMaker Studio-Instanz hoch.

Das Falcon LLM bietet standardmäßig Unterstützung für die Textzusammenfassung.

- Lassen Sie uns eine Funktion erstellen, die zur Zusammenfassung schnelle Engineering-Techniken verwendet

document.txt:

Sie werden feststellen, dass bei längeren Dokumenten ein Fehler auftritt: Falcon hat wie alle anderen LLMs eine Begrenzung für die Anzahl der als Eingabe übergebenen Token. Wir können diese Grenze umgehen, indem wir die erweiterten Zusammenfassungsfunktionen von LangChain nutzen, die es ermöglichen, eine viel größere Eingabe an das LLM weiterzuleiten.

Importieren Sie eine Zusammenfassungskette und führen Sie sie aus

LangChain ist eine Open-Source-Softwarebibliothek, die es Entwicklern und Datenwissenschaftlern ermöglicht, schnell benutzerdefinierte generative Anwendungen zu erstellen, abzustimmen und bereitzustellen, ohne komplexe ML-Interaktionen verwalten zu müssen. LangChain wird häufig verwendet, um viele der gängigen Anwendungsfälle für generative KI-Sprachmodelle in nur wenigen zu abstrahieren Zeilen von Code. Die Unterstützung von LangChain für AWS-Dienste umfasst die Unterstützung für SageMaker-Endpunkte.

LangChain bietet eine zugängliche Schnittstelle zu LLMs. Zu seinen Funktionen gehören Tools für die Erstellung von Eingabeaufforderungsvorlagen und die Eingabeaufforderungsverkettung. Diese Ketten können verwendet werden, um Textdokumente, die länger sind als das, was das Sprachmodell unterstützt, in einem einzigen Aufruf zusammenzufassen. Sie können eine Kartenreduzierungsstrategie verwenden, um lange Dokumente zusammenzufassen, indem Sie sie in überschaubare Abschnitte aufteilen, diese zusammenfassen und kombinieren (und bei Bedarf erneut zusammenfassen).

- Beginnen wir mit der Installation von LangChain:

- Importieren Sie die relevanten Module und zerlegen Sie das lange Dokument in Abschnitte:

- Damit LangChain effektiv mit Falcon funktioniert, müssen Sie die Standard-Content-Handler-Klassen für gültige Ein- und Ausgaben definieren:

- Sie können benutzerdefinierte Eingabeaufforderungen definieren als

PromptTemplateObjekte, das Hauptmedium für die Eingabeaufforderung mit LangChain, für den kartenreduzierten Zusammenfassungsansatz. Dies ist ein optionaler Schritt, da Mapping- und Combine-Eingabeaufforderungen standardmäßig bereitgestellt werden, wenn die Parameter innerhalb des Aufrufs zum Laden der Zusammenfassungskette (load_summarize_chain) sind undefiniert.

- LangChain unterstützt LLMs, die auf SageMaker-Inferenzendpunkten gehostet werden. Anstatt das AWS Python SDK zu verwenden, können Sie die Verbindung für eine bessere Zugänglichkeit über LangChain initialisieren:

- Schließlich können Sie mit dem folgenden Code eine Zusammenfassungskette laden und eine Zusammenfassung der Eingabedokumente ausführen:

Da die verbose Parameter ist auf gesetzt True, sehen Sie alle Zwischenergebnisse des Map-Reduce-Ansatzes. Dies ist nützlich, um die Abfolge der Ereignisse zu verfolgen und zu einer endgültigen Zusammenfassung zu gelangen. Mit diesem Map-Reduction-Ansatz können Sie Dokumente effektiv viel länger zusammenfassen, als es normalerweise durch die maximale Eingabe-Token-Grenze des Modells möglich ist.

Aufräumen

Nachdem Sie den Inferenzendpunkt nicht mehr verwendet haben, ist es wichtig, ihn zu löschen, um unnötige Kosten durch die folgenden Codezeilen zu vermeiden:

Verwendung anderer Fundamentmodelle in SageMaker JumpStart

Die Verwendung anderer in SageMaker JumpStart verfügbarer Basismodelle für die Dokumentzusammenfassung erfordert nur minimalen Aufwand für die Einrichtung und Bereitstellung. LLMs variieren gelegentlich je nach Struktur der Eingabe- und Ausgabeformate. Wenn neue Modelle und vorgefertigte Lösungen zu SageMaker JumpStart hinzugefügt werden, müssen Sie je nach Aufgabenimplementierung möglicherweise die folgenden Codeänderungen vornehmen:

- Wenn Sie eine Zusammenfassung über durchführen

summarize()Methode (die Methode ohne Verwendung von LangChain) müssen Sie möglicherweise die JSON-Struktur der ändernpayloadParameter sowie die Behandlung der Antwortvariablen imquery_endpoint()Funktion - Wenn Sie eine Zusammenfassung über LangChain durchführen

load_summarize_chain()Methode müssen Sie möglicherweise die ändernContentHandlerTextSummarizationKlasse, insbesondere dietransform_input()undtransform_output()Funktionen, um die vom LLM erwartete Nutzlast und die vom LLM zurückgegebene Ausgabe korrekt zu verarbeiten

Foundation-Modelle unterscheiden sich nicht nur in Faktoren wie Inferenzgeschwindigkeit und -qualität, sondern auch in den Eingabe- und Ausgabeformaten. Informationen zu den erwarteten Ein- und Ausgaben finden Sie auf der relevanten Informationsseite des LLM.

Zusammenfassung

Das Falcon 7B Instruct-Modell ist im SageMaker JumpStart-Modell-Hub verfügbar und kann in einer Reihe von Anwendungsfällen ausgeführt werden. In diesem Beitrag wurde gezeigt, wie Sie mit SageMaker JumpStart Ihren eigenen Falcon LLM-Endpunkt in Ihrer Umgebung bereitstellen und Ihre ersten Experimente in SageMaker Studio durchführen können, sodass Sie schnell Prototypen Ihrer Modelle erstellen und nahtlos in eine Produktionsumgebung übergehen können. Mit Falcon und LangChain können Sie lange Dokumente aus dem Gesundheitswesen und den Biowissenschaften effektiv und in großem Maßstab zusammenfassen.

Weitere Informationen zum Arbeiten mit generativer KI in AWS finden Sie unter Ankündigung neuer Tools für das Erstellen mit generativer KI auf AWS. Mit der in diesem Beitrag beschriebenen Methode können Sie mit dem Experimentieren beginnen und Konzeptnachweise für die Zusammenfassung von Dokumenten für Ihre GenAI-Anwendungen im Gesundheitswesen und in den Biowissenschaften erstellen. Wann Amazonas Grundgestein allgemein verfügbar ist, werden wir einen Folgebeitrag veröffentlichen, der zeigt, wie Sie die Dokumentenzusammenfassung mit Amazon Bedrock und LangChain implementieren können.

Über die Autoren

John Kitaoka ist Lösungsarchitekt bei Amazon Web Services. John hilft Kunden beim Entwerfen und Optimieren von KI/ML-Workloads auf AWS, um ihnen beim Erreichen ihrer Geschäftsziele zu helfen.

John Kitaoka ist Lösungsarchitekt bei Amazon Web Services. John hilft Kunden beim Entwerfen und Optimieren von KI/ML-Workloads auf AWS, um ihnen beim Erreichen ihrer Geschäftsziele zu helfen.

Josh Famestad ist Lösungsarchitekt bei Amazon Web Services. Josh arbeitet mit Kunden aus dem öffentlichen Sektor zusammen, um cloudbasierte Ansätze zu entwickeln und umzusetzen, um Geschäftsprioritäten zu erfüllen.

Josh Famestad ist Lösungsarchitekt bei Amazon Web Services. Josh arbeitet mit Kunden aus dem öffentlichen Sektor zusammen, um cloudbasierte Ansätze zu entwickeln und umzusetzen, um Geschäftsprioritäten zu erfüllen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/create-an-hcls-document-summarization-application-with-falcon-using-amazon-sagemaker-jumpstart/

- :hast

- :Ist

- :nicht

- $UP

- 1

- 10

- 100

- 11

- 12

- 14

- 150

- 16

- 1M

- 20

- 40

- 400

- 50

- 500

- 7

- a

- Fähigkeit

- ABSTRACT

- Akzeptiert

- Zugänglichkeit

- zugänglich

- Konto

- Erreichen

- hinzugefügt

- Die Annahme

- aufs Neue

- AI

- AI / ML

- Alle

- erlaubt

- Zulassen

- erlaubt

- neben

- bereits

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon SageMaker-JumpStart

- Amazon Web Services

- an

- Analyse

- Business Analysten

- und

- Tier

- Tiere

- Anwendung

- Anwendungen

- Ansatz

- Ansätze

- genehmigt

- SIND

- um

- AS

- At

- Attribute

- automatische

- verfügbar

- vermeiden

- AWS

- basierend

- BE

- weil

- beginnen

- glaubt,

- Milliarde

- biomedizinische

- Körper

- fett

- Box

- Break

- Bruch

- bauen

- Building

- erbaut

- Geschäft

- aber

- by

- rufen Sie uns an!

- namens

- CAN

- Kann bekommen

- Fähigkeiten

- capability

- Karte

- Häuser

- Fälle

- Die Zellen

- Kette

- Ketten

- Übernehmen

- Änderungen

- Entscheidungen

- Auswählen

- Auswahl

- Klasse

- Unterricht

- Auftraggeber

- Cloud

- Code

- kollaborative

- kombinieren

- Vereinigung

- gemeinsam

- häufig

- verglichen

- abschließen

- Abgeschlossene Verkäufe

- Komplex

- Bestehend

- konzept

- prägnant

- Verbindung

- Konsul (Console)

- enthalten

- Inhalt

- kostengünstiger

- Kosten

- erstellen

- Original

- Kunden

- Anpassung

- technische Daten

- Datenwissenschaft

- Jahrzehnte

- Standard

- definieren

- Übergeben

- zeigen

- Synergie

- Abhängig

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- Design

- Entwickler

- Entwicklung

- Entwicklung

- Geräte

- anders

- do

- Dokument

- Unterlagen

- Tut nicht

- Domain

- Nicht

- nach unten

- herunterladen

- jeder

- Erde

- effektiv

- ermöglichen

- Endpunkt

- Entwicklung

- Ingenieure

- verbesserte

- gewährleisten

- Eingabe

- Arbeitsumfeld

- Fehler

- Veranstaltungen

- Beispiel

- ausführen

- erwartet

- erwartet

- ERFAHRUNGEN

- Experiment

- Experimente

- Gesicht

- Faktoren

- falsch

- Eigenschaften

- wenige

- Reichen Sie das

- Finale

- Finden Sie

- Vorname

- passen

- Setzen Sie mit Achtsamkeit

- folgen

- Folgende

- Aussichten für

- Foundation

- vier

- für

- Funktion

- Funktionen

- Außerdem

- allgemein

- erzeugen

- erzeugt

- generativ

- Generative KI

- bekommen

- Ziele

- mehr

- Griff

- Handling

- Haben

- Gesundheitswesen

- Hilfe

- hilft

- Hervorheben

- gehostet

- Ultraschall

- Hilfe

- HTML

- HTTPS

- Nabe

- ICON

- if

- Image

- implementieren

- Implementierung

- importieren

- wichtig

- in

- das

- Dazu gehören

- Einschließlich

- Information

- wir innovieren

- Innovation

- Varianten des Eingangssignals:

- Eingänge

- installieren

- Instanz

- beantragen müssen

- Institut

- Anleitung

- integriert

- Intelligent

- Interaktionen

- Schnittstelle

- in

- Isolierung

- IT

- SEINE

- Peter

- JSON

- nur

- Wesentliche

- Sprache

- grosse

- größer

- ins Leben gerufen

- Verlassen

- Bibliothek

- Lebensdauer

- Biowissenschaften

- LIMIT

- Linien

- Links

- Kataloge

- LLM

- Belastung

- Lang

- länger

- suchen

- Main

- um

- verwalten

- handhabbar

- verwaltet

- flächendeckende Gesundheitsprogramme

- viele

- Mapping

- maximal

- Kann..

- mittlere

- MENÜ

- Methode

- minimal

- ML

- Modell

- für

- ändern

- Module

- mehr

- vor allem warme

- viel

- Menü

- notwendig,

- Need

- erforderlich

- Netzwerk

- Neu

- NIH

- Normalerweise

- Notizbuch

- Notiz..

- Anzahl

- Objekte

- of

- on

- EINEM

- einzige

- XNUMXh geöffnet

- Open-Source-

- Quelloffene Software

- Optimieren

- Optionen

- Andere

- skizzierte

- Möglichkeiten für das Ausgangssignal:

- übrig

- besitzen

- Seite

- Brot

- Papier

- Parameter

- Parameter

- Bestanden

- Ausführen

- Durchführung

- führt

- Personalisierung

- Plato

- Datenintelligenz von Plato

- PlatoData

- Punkte

- Post

- größte treibende

- Drucke

- privat

- Prozessdefinierung

- Produkt

- Produktion

- Beweise

- Prototyp

- die

- vorausgesetzt

- bietet

- Bereitstellung

- Öffentlichkeit

- veröffentlichen

- Python

- Qualität

- Frage

- schnell

- schnell

- Leser

- bereit

- realen Welt

- Empfehlungen

- siehe

- Regulierungsbehörden

- relevant

- Voraussetzungen:

- erfordert

- Forschungsprojekte

- Forscher

- beziehungsweise

- Antwort

- Rückkehr

- Robotik

- Führen Sie

- sagemaker

- SageMaker-Inferenz

- Skalieren

- Wissenschaft

- WISSENSCHAFTEN

- Wissenschaftler

- Umfang

- Sdk

- nahtlos

- Abschnitte

- Bibliotheken

- Sicherheitdienst

- sehen

- ausgewählt

- SELF

- Gefühl

- Reihenfolge

- Lösungen

- kompensieren

- Einstellung

- Shopping

- Short

- erklären

- Single

- SIX

- So

- Software

- Lösungen

- spezifisch

- speziell

- Geschwindigkeit

- Anfang

- begonnen

- Status

- Schritt

- Shritte

- Speicherung

- Strategie

- Streng

- Struktur

- Studio Adressen

- so

- zusammenfassen

- ZUSAMMENFASSUNG

- Support

- Unterstützt

- nimmt

- Aufgabe

- und Aufgaben

- Techniken

- Technologie

- Technologie Innovation

- Text

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Dort.

- Diese

- fehlen uns die Worte.

- Durch

- zu

- gemeinsam

- Zeichen

- Tokens

- Werkzeug

- Werkzeuge

- trainiert

- Transformator

- Transformieren

- Übergang

- Billion

- was immer dies auch sein sollte.

- WENDE

- Lernprogramm

- XNUMX

- tippe

- undefiniert

- einzigartiges

- unnötig

- Uploading

- -

- Anwendungsfall

- benutzt

- verwendet

- Verwendung von

- Variable

- Vielfalt

- Fahrzeug

- Versionen

- Anzeigen

- Spaziergang

- Walkthrough

- we

- Netz

- Web-Services

- GUT

- Was

- wann

- welche

- breit

- werden wir

- mit

- .

- ohne

- Arbeiten

- Workflows

- arbeiten,

- Werk

- schreiben

- Schreiben

- Du

- Ihr

- Zephyrnet