Amazon SageMaker-JumpStart ist ein Hub für maschinelles Lernen (ML), der Ihnen dabei helfen kann, Ihre ML-Reise zu beschleunigen. Mit SageMaker JumpStart können Sie öffentlich verfügbare und proprietäre Basismodelle entdecken und dediziert bereitstellen Amazon Sage Maker Instanzen für Ihre generativen KI-Anwendungen. SageMaker JumpStart ermöglicht Ihnen die Bereitstellung von Basismodellen aus einer netzwerkisolierten Umgebung und gibt keine Kundenschulungs- und Inferenzdaten an Modellanbieter weiter.

In diesem Beitrag erfahren Sie, wie Sie mit proprietären Modellen von Modellanbietern wie AI21, Cohere und LightOn beginnen Amazon SageMaker-Studio. SageMaker Studio ist eine Notebook-Umgebung, in der Kunden von SageMaker Enterprise Data Scientist Modelle für ihre nächsten generativen KI-Anwendungen bewerten und erstellen.

Foundation-Modelle in SageMaker

Foundation-Modelle sind groß angelegte ML-Modelle, die Milliarden von Parametern enthalten und auf Terabytes an Text- und Bilddaten vorab trainiert sind, sodass Sie eine Vielzahl von Aufgaben ausführen können, z. B. Artikelzusammenfassung und Text-, Bild- oder Videogenerierung. Da die Basismodelle vorab trainiert sind, können sie dazu beitragen, die Schulungs- und Infrastrukturkosten zu senken und eine Anpassung an Ihren Anwendungsfall zu ermöglichen.

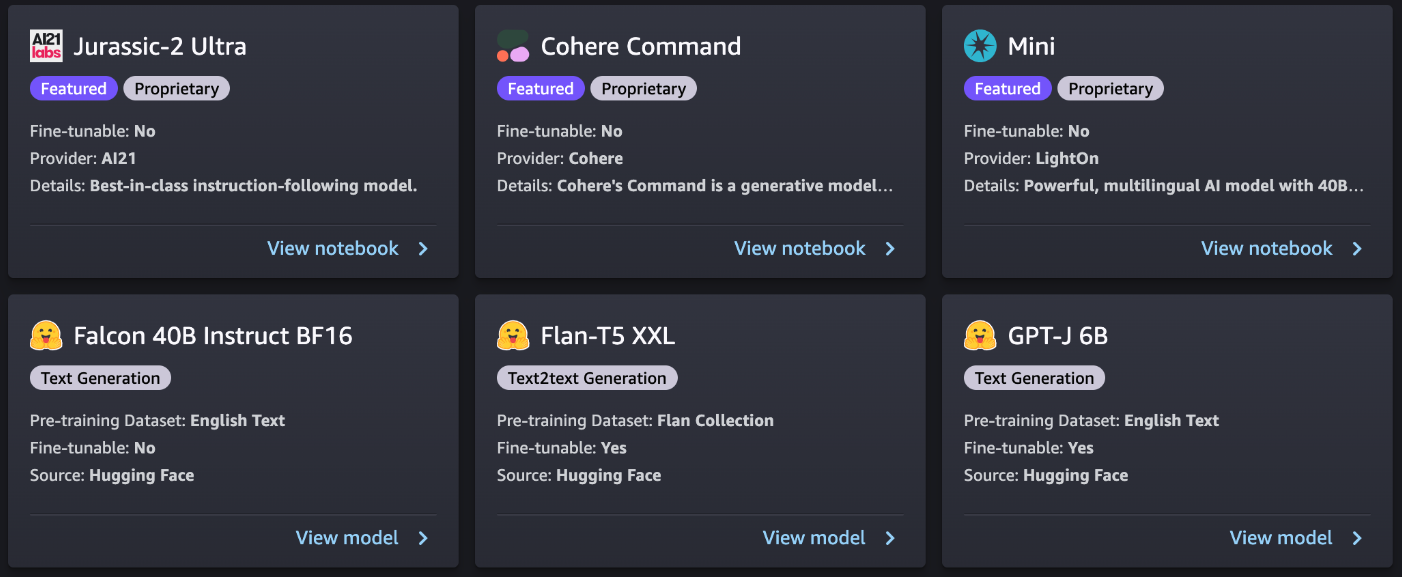

SageMaker JumpStart bietet zwei Arten von Grundmodellen:

- Proprietäre Modelle – Diese Modelle stammen von Anbietern wie AI21 mit Jurassic-2-Modellen, Cohere mit Cohere Command und LightOn mit Mini, die auf proprietären Algorithmen und Daten trainiert wurden. Sie können Modellartefakte wie Gewichtung und Skripte nicht anzeigen, aber Sie können sie dennoch zur Inferenzierung auf SageMaker-Instanzen bereitstellen.

- Öffentlich verfügbare Modelle – Diese stammen von beliebten Modell-Hubs wie Hugging Face with Stable Diffusion, Falcon und FLAN, die auf öffentlich verfügbaren Algorithmen und Daten trainiert wurden. Für diese Modelle haben Benutzer Zugriff auf Modellartefakte und können ihre eigenen Daten vor der Bereitstellung für Inferenzen verfeinern.

Entdecken Sie Modelle

Sie können über SageMaker JumpStart in der SageMaker Studio-Benutzeroberfläche und dem SageMaker Python SDK auf die Grundmodelle zugreifen. In diesem Abschnitt erfahren Sie, wie Sie die Modelle in der SageMaker Studio-Benutzeroberfläche entdecken.

SageMaker Studio ist eine webbasierte integrierte Entwicklungsumgebung (IDE) für ML, mit der Sie Ihre ML-Modelle erstellen, trainieren, debuggen, bereitstellen und überwachen können. Weitere Informationen zu den ersten Schritten und zur Einrichtung von SageMaker Studio finden Sie unter Amazon SageMaker-Studio.

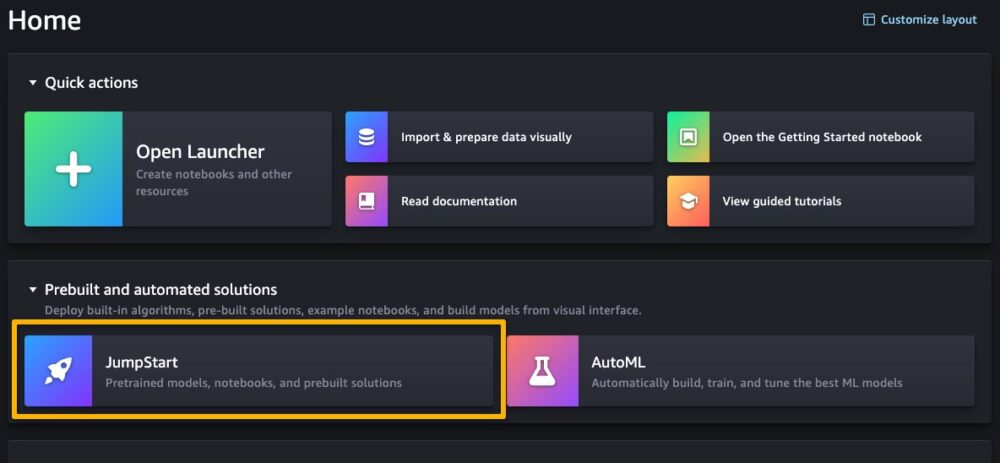

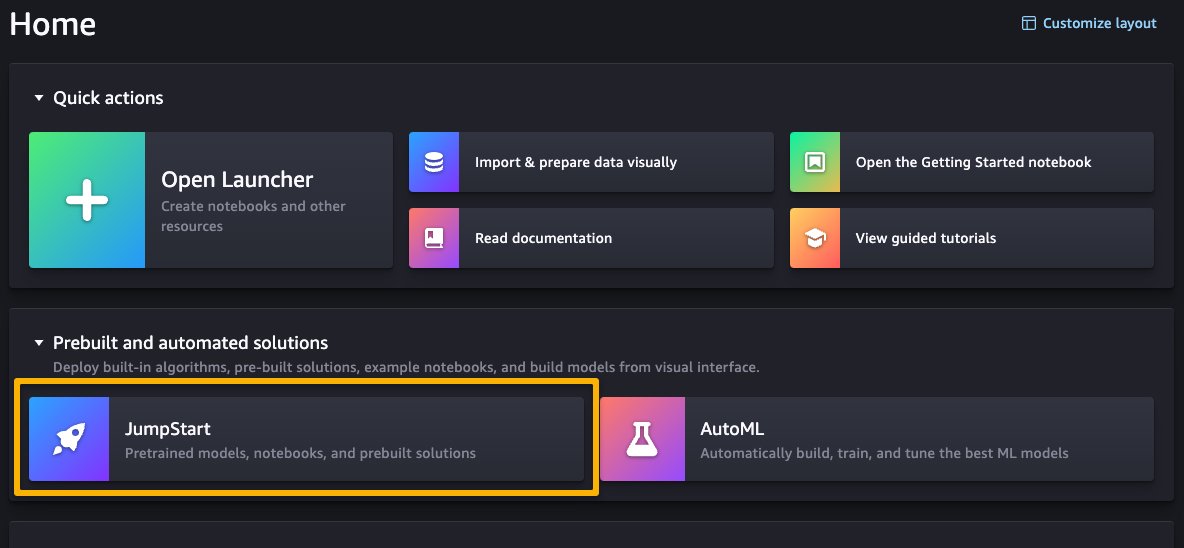

Sobald Sie sich auf der SageMaker Studio-Benutzeroberfläche befinden, können Sie unten auf SageMaker JumpStart zugreifen, das vorab trainierte Modelle, Notebooks und vorgefertigte Lösungen enthält Vorgefertigte und automatisierte Lösungen.

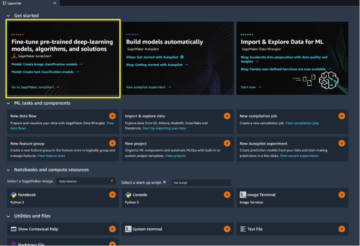

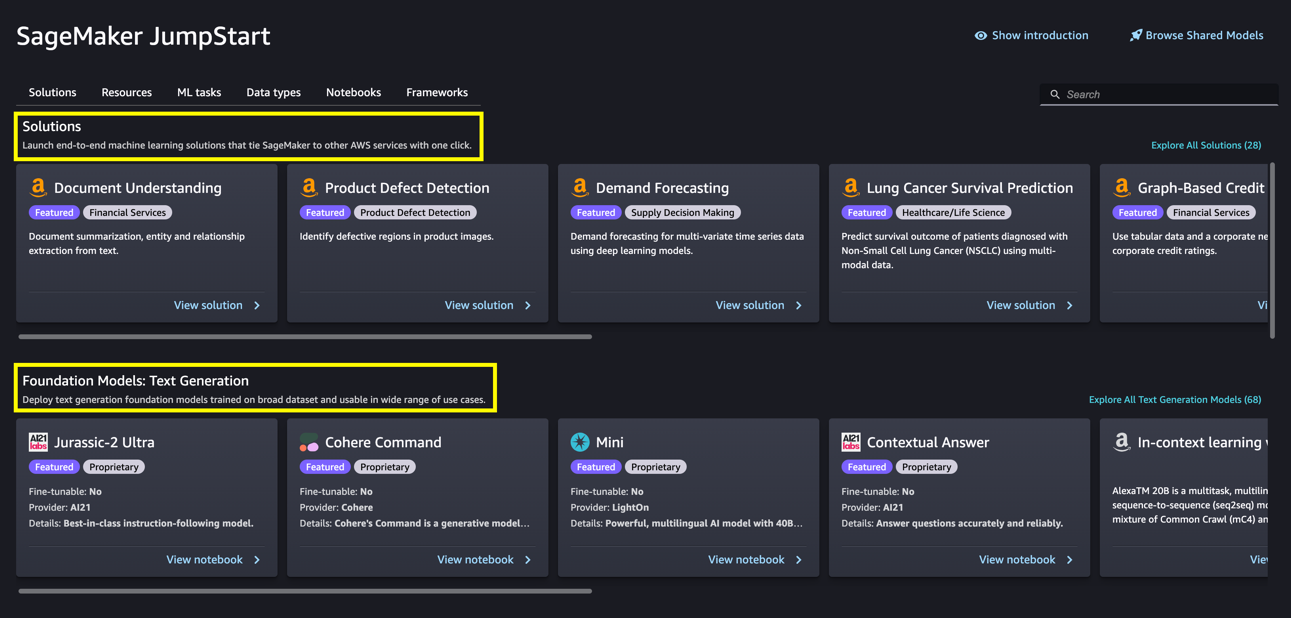

Auf der SageMaker JumpStart-Landingpage können Sie nach Lösungen, Modellen, Notizbüchern und anderen Ressourcen suchen. Der folgende Screenshot zeigt ein Beispiel der Landingpage mit aufgelisteten Lösungen und Fundamentmodellen.

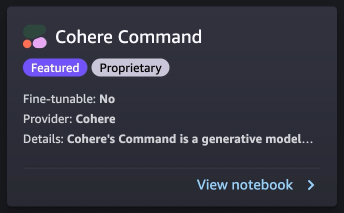

Jedes Modell verfügt über eine Modellkarte, wie im folgenden Screenshot gezeigt, die den Modellnamen (sofern fein einstellbar oder nicht), den Anbieternamen und eine kurze Beschreibung des Modells enthält. Sie können auch die Modellkarte öffnen, um mehr über das Modell zu erfahren und mit dem Training oder der Bereitstellung zu beginnen.

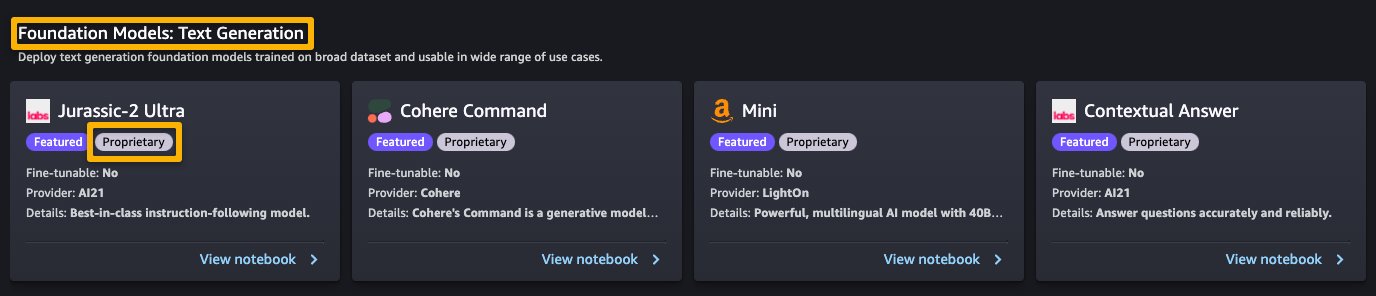

Abonnieren Sie den AWS Marketplace

Proprietäre Modelle in SageMaker JumpStart werden von Modellanbietern wie AI21, Cohere und LightOn veröffentlicht. Sie können proprietäre Modelle anhand des „Proprietary“-Tags auf Modellkarten erkennen, wie im folgenden Screenshot gezeigt.

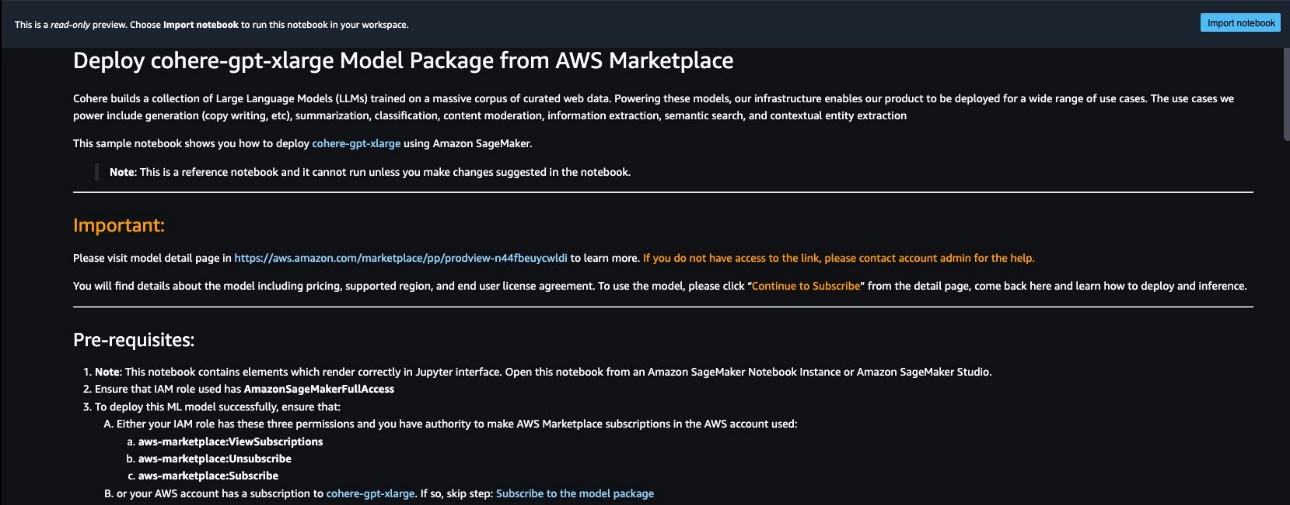

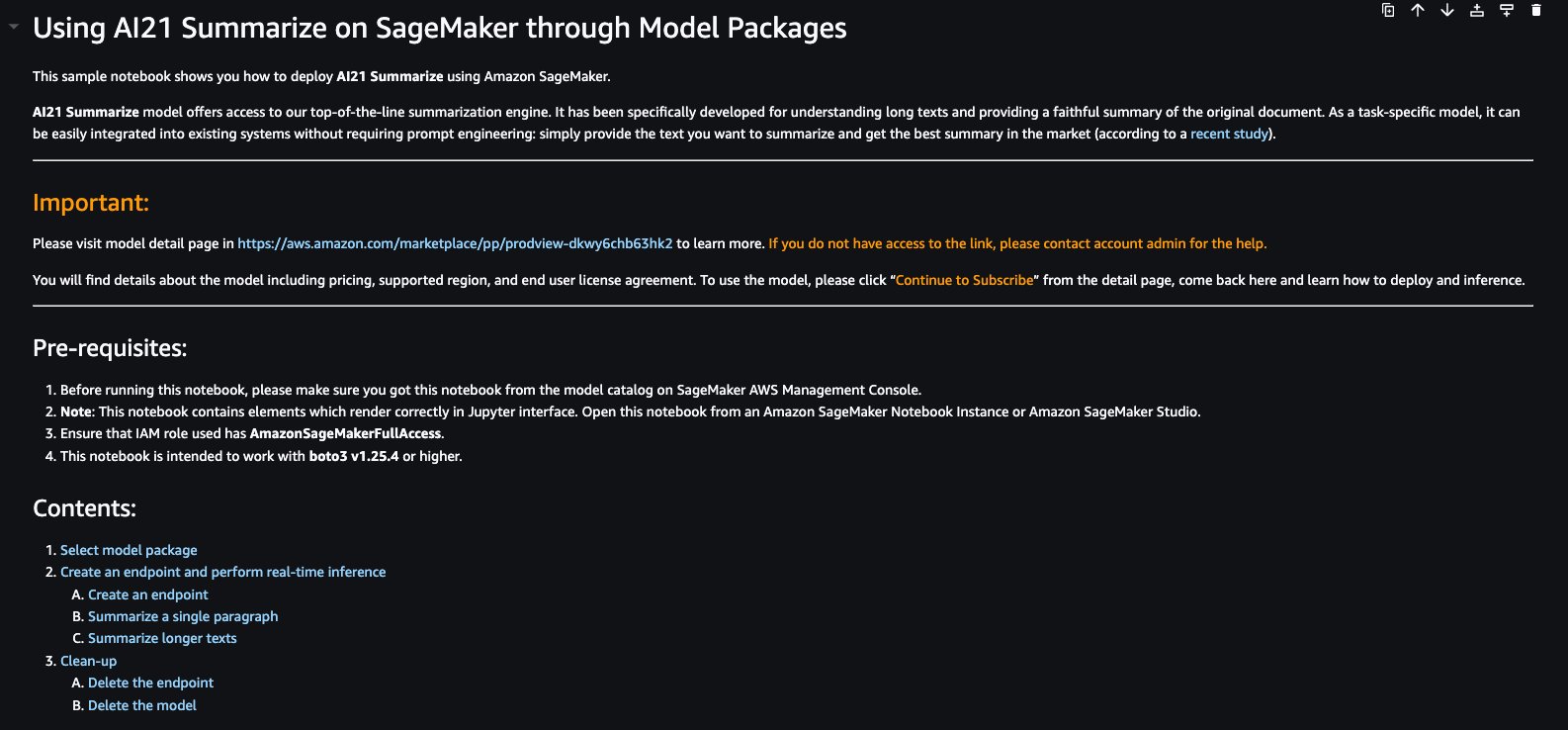

Sie können wählen, Notizbuch ansehen auf der Modellkarte, um das Notebook im schreibgeschützten Modus zu öffnen, wie im folgenden Screenshot gezeigt. Im Notizbuch finden Sie wichtige Informationen zu den Voraussetzungen und andere Nutzungshinweise.

Nach dem Importieren des Notebooks müssen Sie die entsprechende Notebook-Umgebung (Image, Kernel, Instanztyp usw.) auswählen, bevor Sie Codes ausführen. Sie sollten außerdem die Abonnement- und Nutzungsanweisungen für das ausgewählte Notebook befolgen.

Bevor Sie ein proprietäres Modell verwenden können, müssen Sie das Modell zunächst abonnieren AWS-Marktplatz:

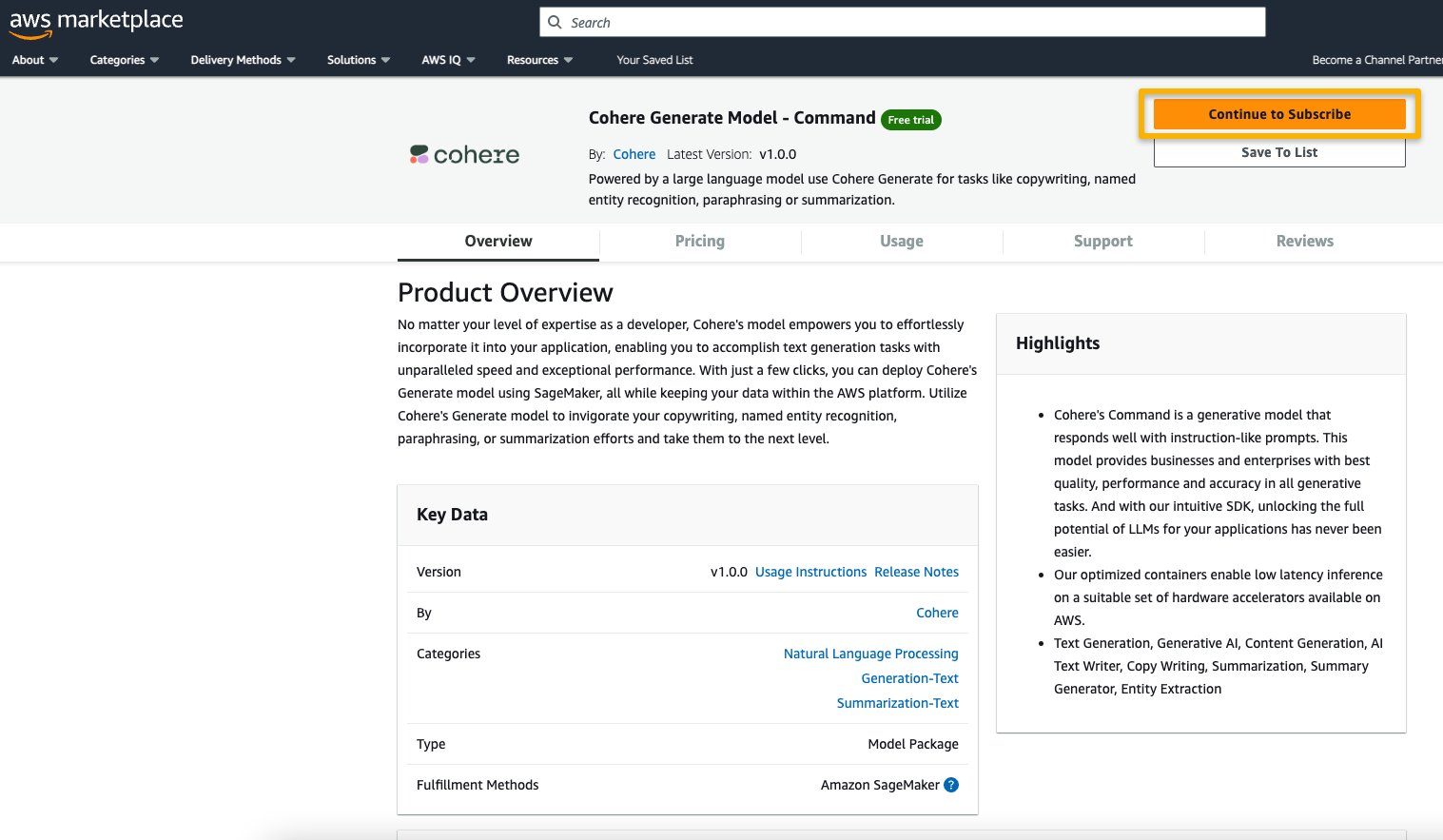

- Öffnen Sie die Modelllistenseite im AWS Marketplace.

Die URL finden Sie im Wichtig Abschnitt des Notizbuchs, oder Sie können über den darauf zugreifen SageMaker JumpStart-Serviceseite. Auf der Auflistungsseite werden die Übersicht, Preise, Nutzung und Supportinformationen zum Modell angezeigt.

- Wählen Sie in der AWS Marketplace-Liste die Option aus Weiter abonnieren.

Wenn Sie nicht über die erforderlichen Berechtigungen verfügen, um das Modell anzuzeigen oder zu abonnieren, wenden Sie sich an Ihren IT-Administrator oder Beschaffungskontakt, um das Modell für Sie zu abonnieren. Viele Unternehmen schränken möglicherweise die AWS Marketplace-Berechtigungen ein, um die Aktionen zu steuern, die jemand mit diesen Berechtigungen im AWS Marketplace Management Portal durchführen kann.

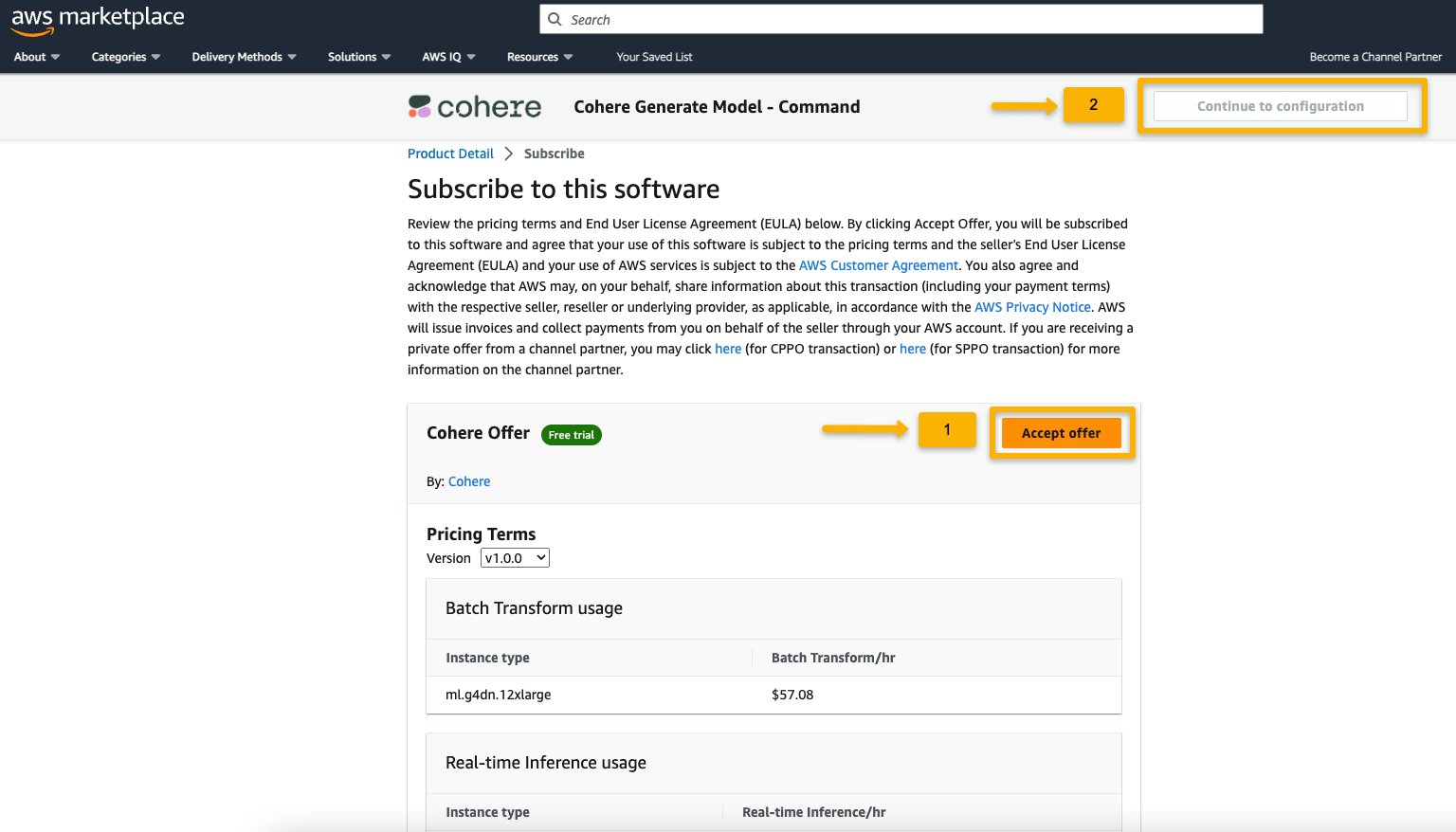

- Auf dem Abonnieren Sie diese Softwareseite, überprüfen Sie die Details und wählen Sie aus Akzeptiere Angebot wenn Sie und Ihre Organisation mit der EULA, den Preisen und den Supportbedingungen einverstanden sind.

Wenn Sie Fragen haben oder einen Mengenrabatt wünschen, wenden Sie sich direkt über die auf der Detailseite angegebene Support-E-Mail an den Modellanbieter oder an Ihr AWS-Kontoteam.

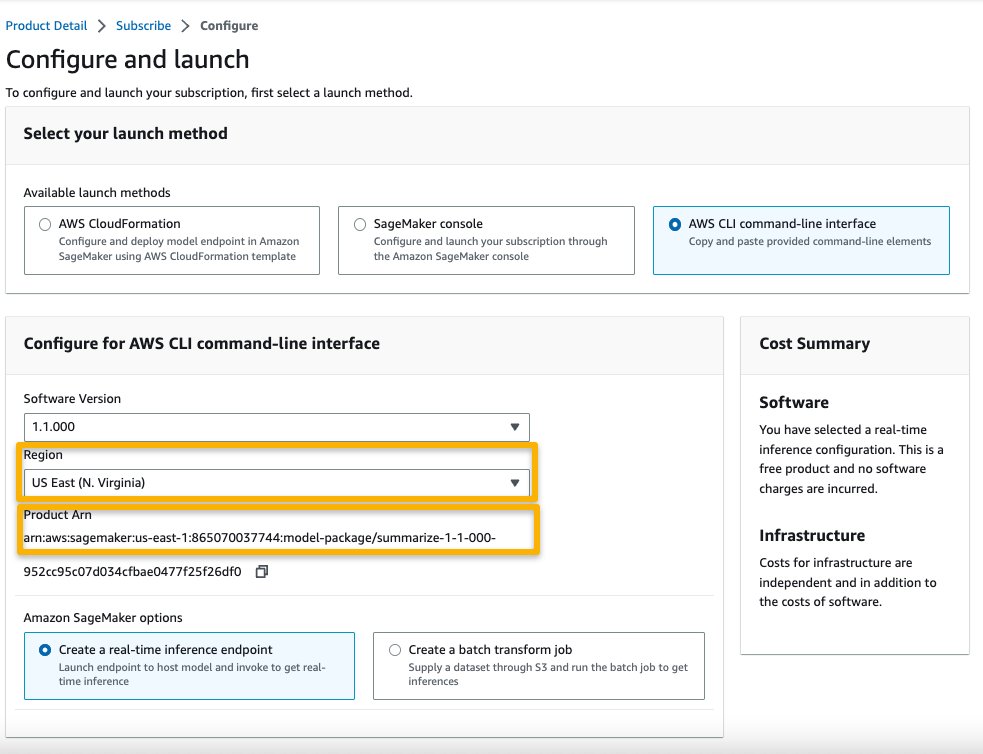

- Auswählen Weiter zur Konfiguration und wählen Sie eine Region.

Es wird ein Produkt-ARN angezeigt. Dies ist der Modellpaket-ARN, den Sie beim Erstellen eines bereitstellbaren Modells mit Boto3 angeben müssen.

- Kopieren Sie den Ihrer Region entsprechenden ARN und geben Sie ihn in der Zellanweisung des Notebooks an.

Beispiel-Inferenzierung mit Beispiel-Eingabeaufforderungen

Schauen wir uns einige der Beispielfundamentmodelle von A21 Labs, Cohere und LightOn an, die über SageMaker JumpStart in SageMaker Studio auffindbar sind. Alle verfügen über die gleichen Anweisungen zum Abonnieren von AWS Marketplace und zum Importieren und Konfigurieren des Notebooks.

AI21 Zusammenfassen

Das Summarize-Modell von A121 Labs verdichtet lange Texte zu kurzen, leicht lesbaren Häppchen, die sachlich mit der Quelle übereinstimmen. Das Modell ist darauf trainiert, Zusammenfassungen zu erstellen, die Schlüsselideen basierend auf einem Textkörper erfassen. Es bedarf keiner Aufforderung. Sie geben einfach den Text ein, der zusammengefasst werden soll. Ihr Ausgangstext kann bis zu 50,000 Zeichen umfassen, was etwa 10,000 Wörtern oder beeindruckenden 40 Seiten entspricht.

Das Beispielnotizbuch für das AI21 Summarize-Modell stellt wichtige Voraussetzungen bereit, die befolgt werden müssen. Das Modell ist beispielsweise über AWS Marketplace abonniert, verfügt über entsprechende IAM-Rollenberechtigungen und die erforderliche boto3-Version usw. Es führt Sie durch die Auswahl des Modellpakets, die Erstellung von Endpunkten für Echtzeit-Inferenz und die anschließende Bereinigung.

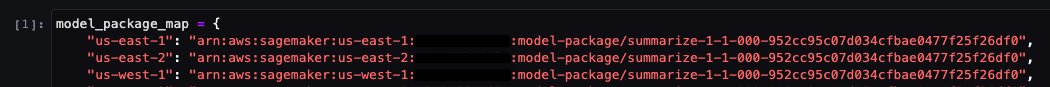

Das ausgewählte Modellpaket enthält die Zuordnung von ARNs zu Regionen. Dies sind die Informationen, die Sie nach der Auswahl erfasst haben Weiter zur Konfiguration auf der AWS Marketplace-Abonnementseite (im Abschnitt Bewerten und abonnieren Sie im Marketplace) und wählen Sie dann eine Region aus, für die Sie den entsprechenden Produkt-ARN sehen.

Auf dem Notebook ist der ARN möglicherweise bereits vorab ausgefüllt.

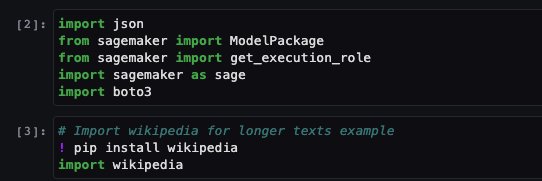

Anschließend importieren Sie einige Bibliotheken, die zum Ausführen dieses Notebooks erforderlich sind, und installieren Wikipedia, eine Python-Bibliothek, die den Zugriff auf und das Parsen von Daten aus Wikipedia erleichtert. Das Notizbuch nutzt dies später, um zu zeigen, wie man einen langen Text aus Wikipedia zusammenfasst.

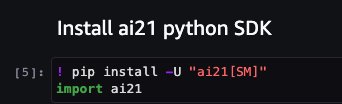

Das Notebook fährt auch mit der Installation fort ai21 Python SDK, ein Wrapper für SageMaker-APIs wie deploy und invoke endpoint.

Die nächsten Zellen des Notizbuchs durchlaufen die folgenden Schritte:

- Wählen Sie die Region aus und rufen Sie den Modellpaket-ARN aus der Modellpaketkarte ab

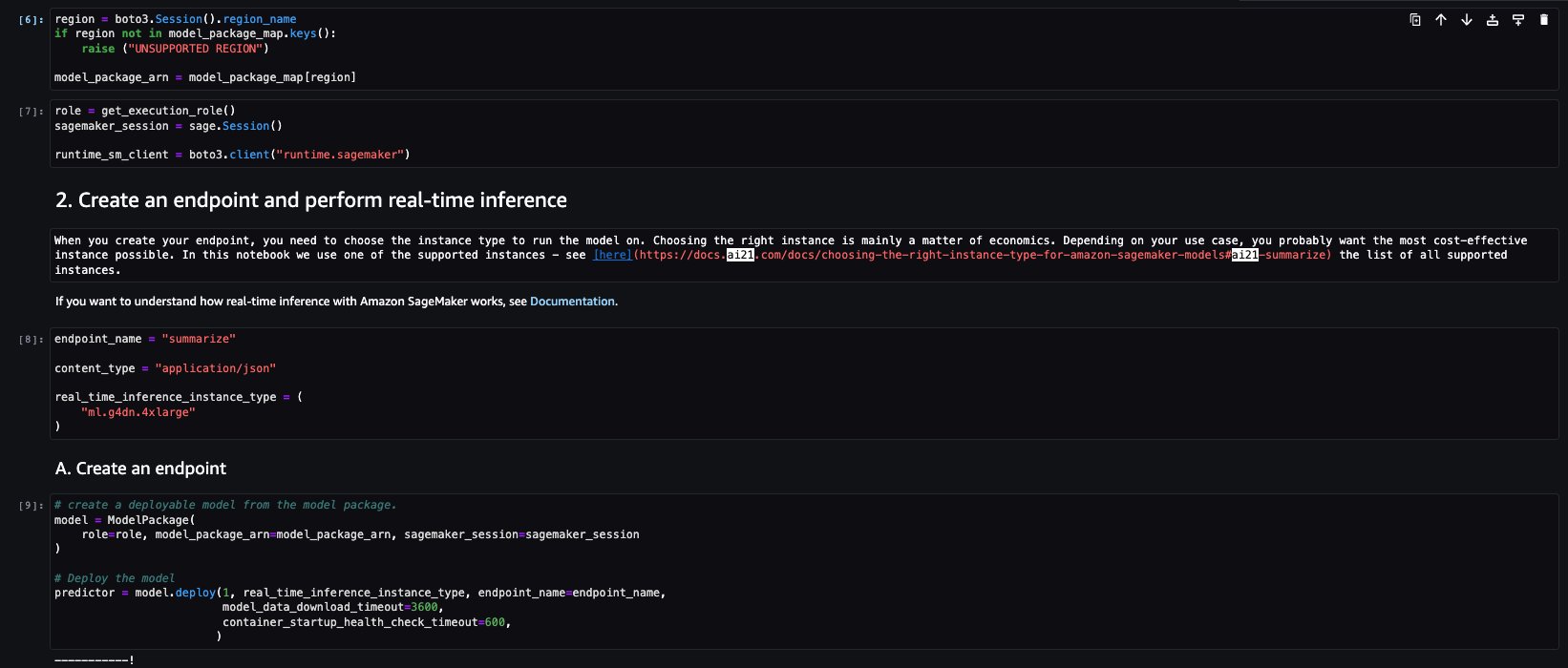

- Erstellen Sie Ihren Inferenzendpunkt, indem Sie einen Instanztyp auswählen (abhängig von Ihrem Anwendungsfall und der unterstützten Instanz für das Modell; siehe Aufgabenspezifische Modelle für weitere Details), um das Modell auszuführen

- Erstellen Sie aus dem Modellpaket ein bereitstellbares Modell

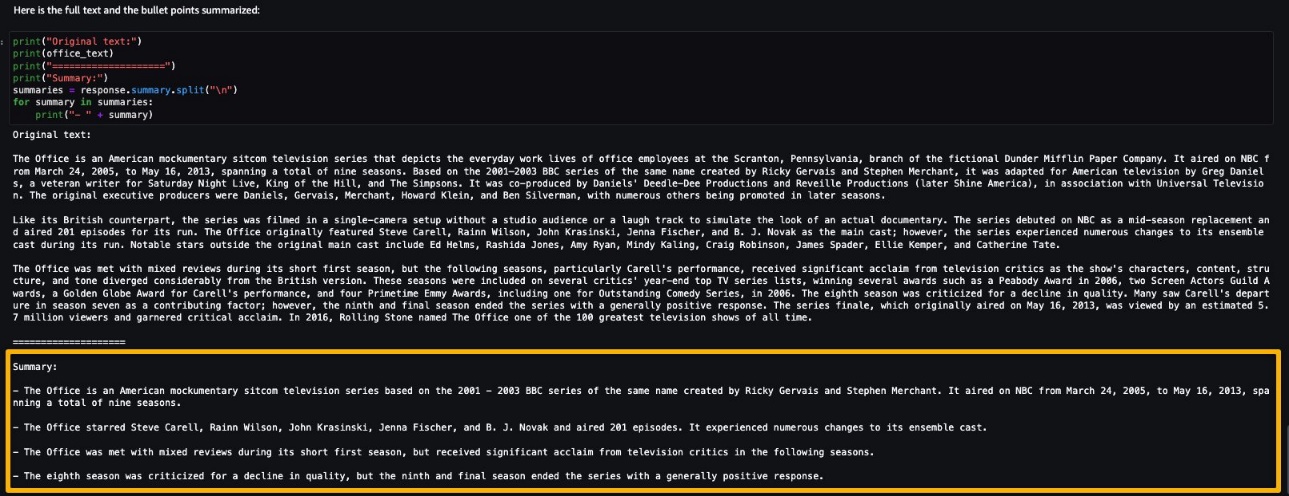

Lassen Sie uns die Inferenz ausführen, um eine Zusammenfassung eines einzelnen Absatzes aus einem Nachrichtenartikel zu erstellen. Wie Sie in der Ausgabe sehen können, wird der zusammengefasste Text vom Modell als Ausgabe dargestellt.

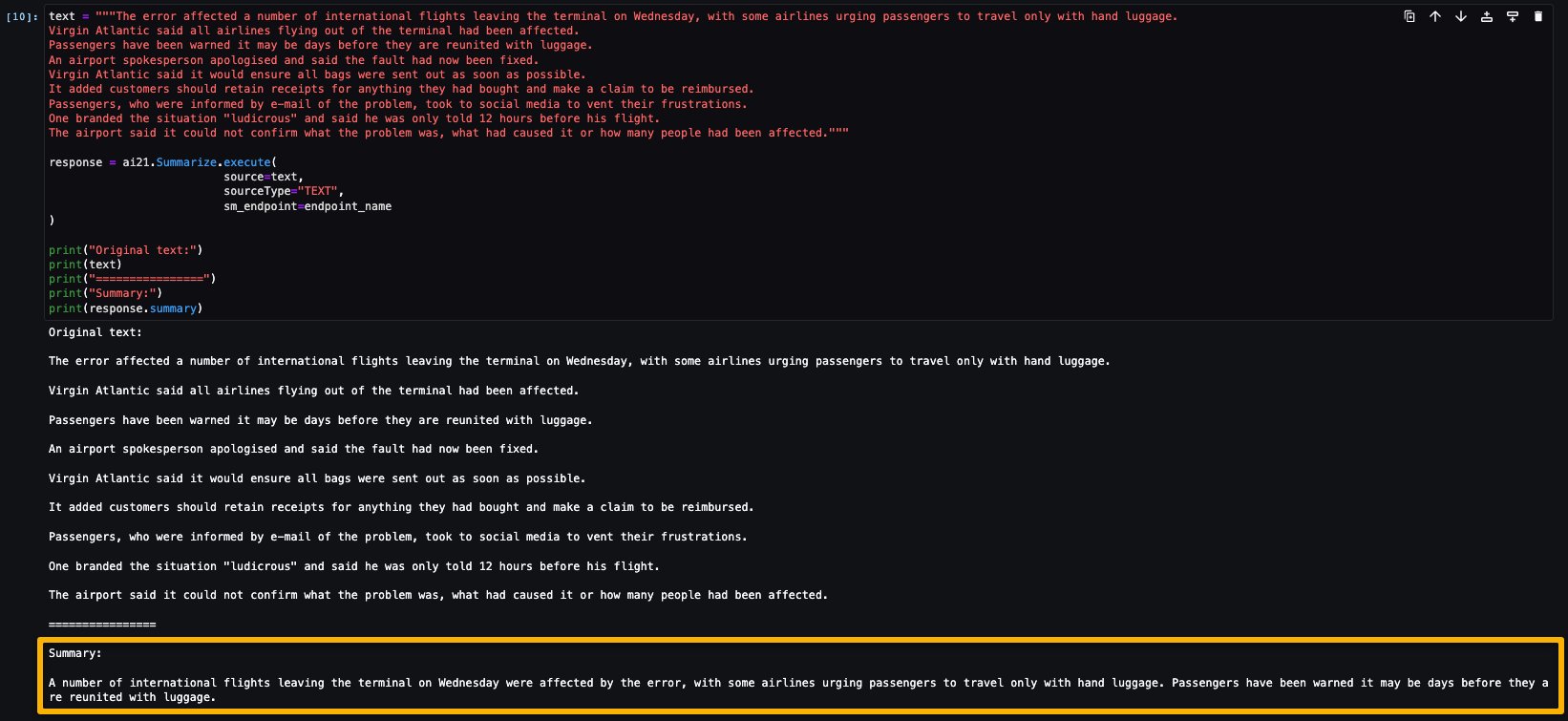

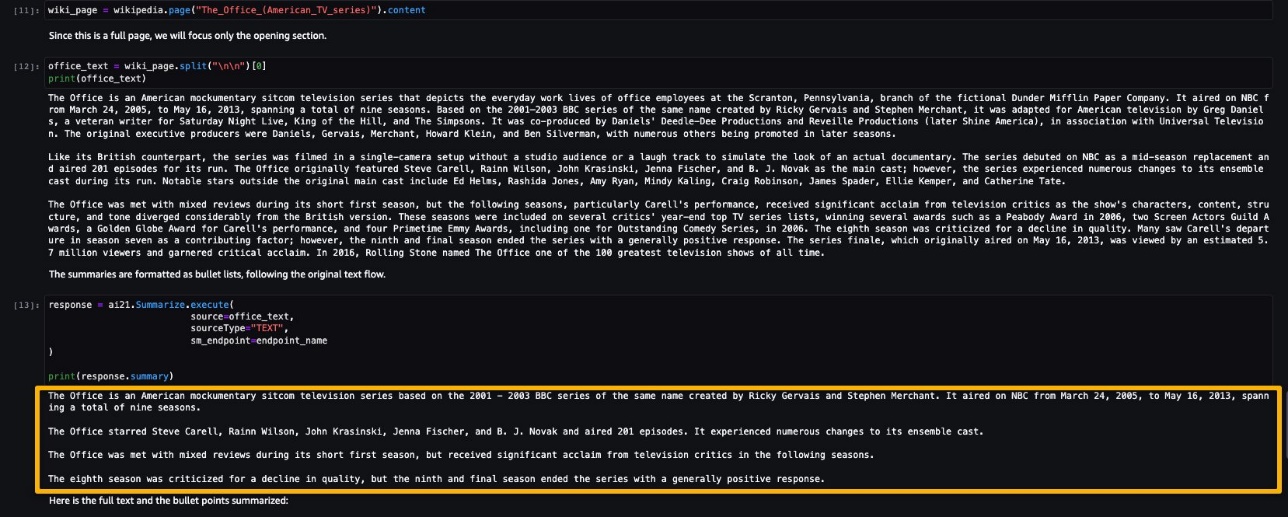

AI21 Summarize kann Eingaben mit bis zu 50,000 Zeichen verarbeiten. Dies entspricht etwa 10,000 Wörtern oder 40 Seiten. Zur Demonstration des Verhaltens des Modells laden wir eine Seite aus Wikipedia.

Nachdem Sie nun zum Testen eine Echtzeitinferenz durchgeführt haben, benötigen Sie den Endpunkt möglicherweise nicht mehr. Sie können den Endpunkt löschen, um Kosten zu vermeiden.

Cohere-Kommando

Cohere Command ist ein generatives Modell, das gut auf anweisungsähnliche Eingabeaufforderungen reagiert. Dieses Modell bietet Unternehmen und Unternehmen beste Qualität, Leistung und Genauigkeit bei allen generativen Aufgaben. Sie können das Command-Modell von Cohere verwenden, um Ihre Texterstellung, Erkennung benannter Entitäten, Paraphrasen oder Zusammenfassungen zu beleben und sie auf die nächste Ebene zu heben.

Das Beispielnotizbuch für das Cohere Command-Modell stellt wichtige Voraussetzungen bereit, die befolgt werden müssen. Das Modell ist beispielsweise über AWS Marketplace abonniert, verfügt über entsprechende IAM-Rollenberechtigungen und die erforderliche boto3-Version usw. Es führt Sie durch die Auswahl des Modellpakets, die Erstellung von Endpunkten für Echtzeit-Inferenz und die anschließende Bereinigung.

Einige der Aufgaben ähneln denen im vorherigen Notebook-Beispiel, z. B. die Installation von Boto3 cohere-sagemaker (Das Paket bietet Funktionen, die entwickelt wurden, um die Schnittstelle zum Cohere-Modell zu vereinfachen) und das Abrufen der Sitzung und Region.

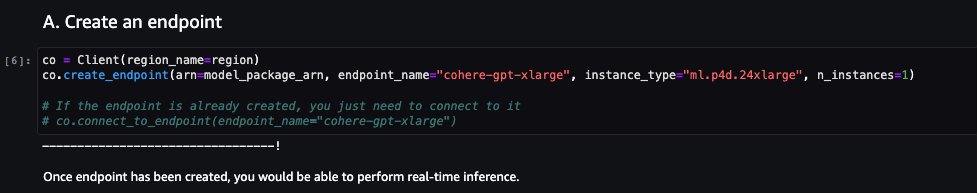

Lassen Sie uns die Erstellung des Endpunkts untersuchen. Sie geben den Modellpaket-ARN, den Endpunktnamen, den zu verwendenden Instanztyp und die Anzahl der Instanzen an. Nach der Erstellung erscheint der Endpunkt in Ihrem Endpunkt Abschnitt von SageMaker.

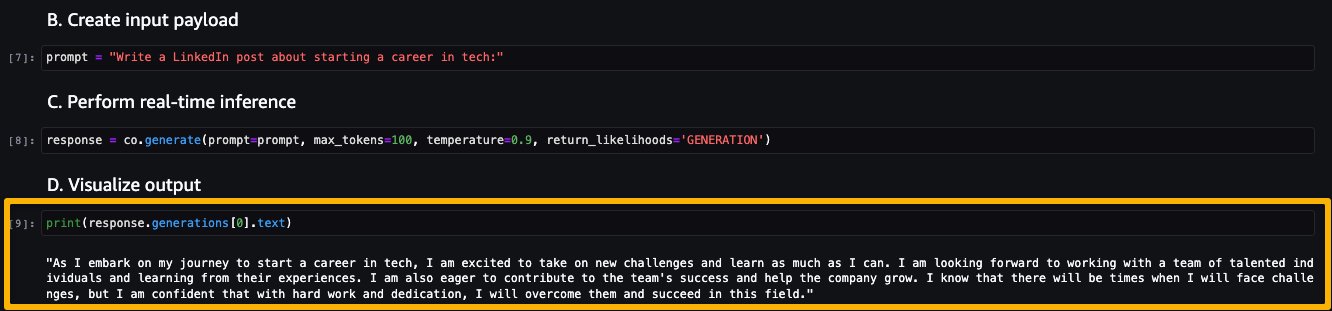

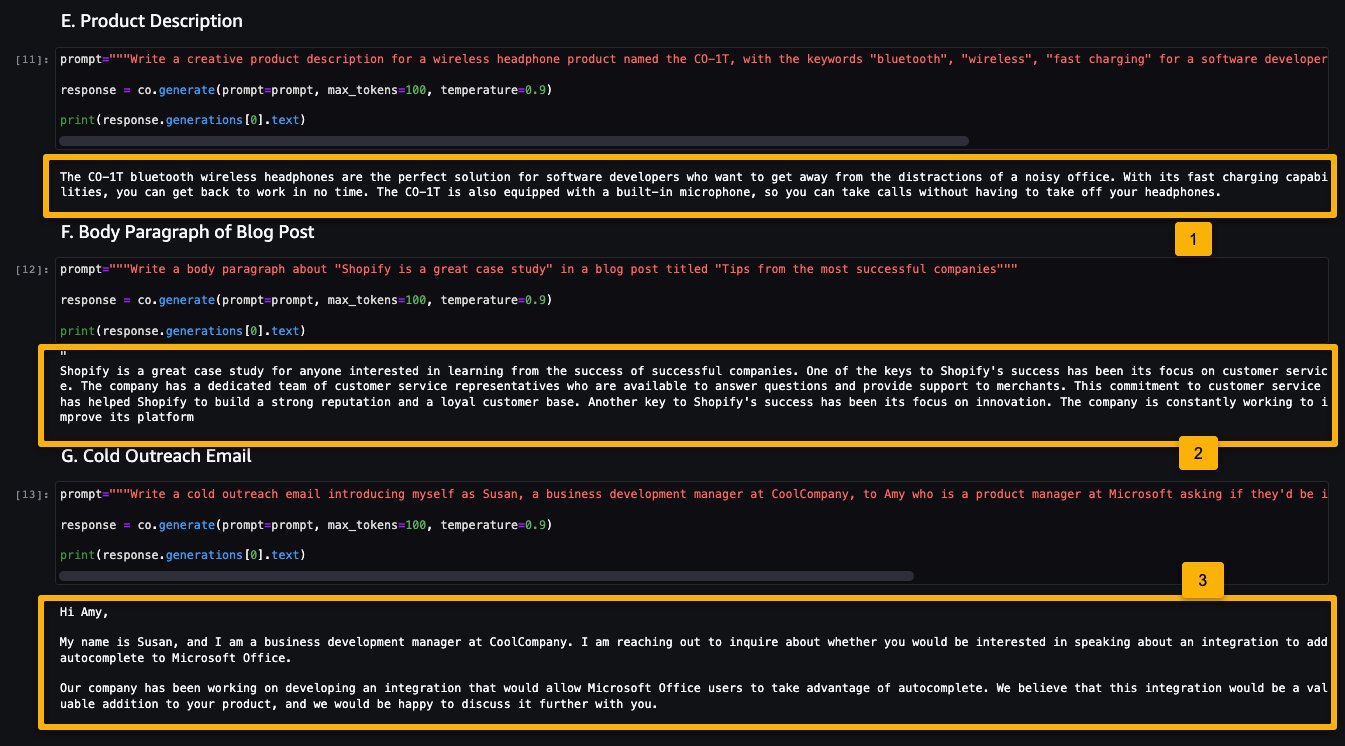

Lassen Sie uns nun die Inferenz ausführen, um einige der Ausgaben des Command-Modells zu sehen.

Der folgende Screenshot zeigt ein Beispielbeispiel für die Erstellung einer Stellenanzeige und deren Ausgabe. Wie Sie sehen können, hat das Modell anhand der angegebenen Eingabeaufforderung einen Beitrag generiert.

Schauen wir uns nun die folgenden Beispiele an:

- Generieren Sie eine Produktbeschreibung

- Generieren Sie einen Hauptabsatz eines Blogbeitrags

- Erstellen Sie eine Outreach-E-Mail

Wie Sie sehen können, generierte das Cohere Command-Modell Text für verschiedene generative Aufgaben.

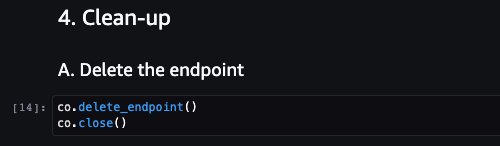

Nachdem Sie nun zum Testen eine Echtzeitinferenz durchgeführt haben, benötigen Sie den Endpunkt möglicherweise nicht mehr. Sie können den Endpunkt löschen, um Kosten zu vermeiden.

LightOn Mini-Anweisung

Mini-instruct, ein von LightOn erstelltes KI-Modell mit 40 Milliarden Parametern, ist ein leistungsstarkes mehrsprachiges KI-System, das anhand hochwertiger Daten aus zahlreichen Quellen trainiert wurde. Es ist darauf ausgelegt, natürliche Sprache zu verstehen und auf Befehle zu reagieren, die speziell auf Ihre Bedürfnisse zugeschnitten sind. Es leistet hervorragende Arbeit in Verbraucherprodukten wie Sprachassistenten, Chatbots und intelligenten Geräten. Es verfügt außerdem über eine breite Palette von Geschäftsanwendungen, einschließlich Agentenunterstützung und Produktion natürlicher Sprache für die automatisierte Kundenbetreuung.

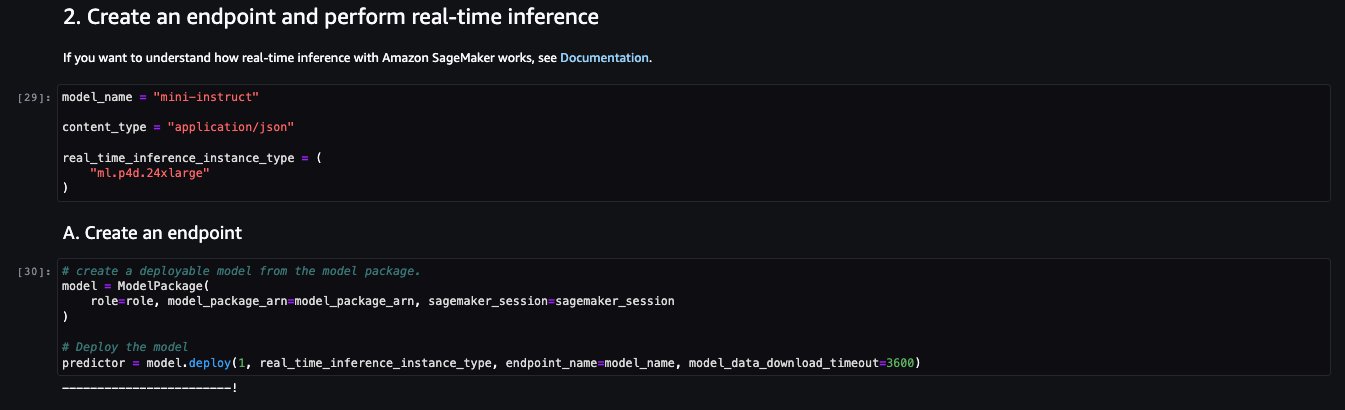

Das Beispielnotizbuch für das LightOn Mini-Instruct-Modell stellt wichtige Voraussetzungen bereit, die befolgt werden müssen. Das Modell ist beispielsweise über AWS Marketplace abonniert, verfügt über entsprechende IAM-Rollenberechtigungen und die erforderliche boto3-Version usw. Es führt Sie durch die Auswahl des Modellpakets, die Erstellung von Endpunkten für Echtzeit-Inferenz und die anschließende Bereinigung.

Einige der Aufgaben ähneln denen im vorherigen Notebook-Beispiel, z. B. die Installation von Boto3 und das Abrufen der Sitzungsregion.

Schauen wir uns die Erstellung des Endpunkts an. Geben Sie zunächst den Modellpaket-ARN, den Endpunktnamen, den zu verwendenden Instanztyp und die Anzahl der Instanzen an. Nach der Erstellung erscheint der Endpunkt in Ihrem Endpunktbereich von SageMaker.

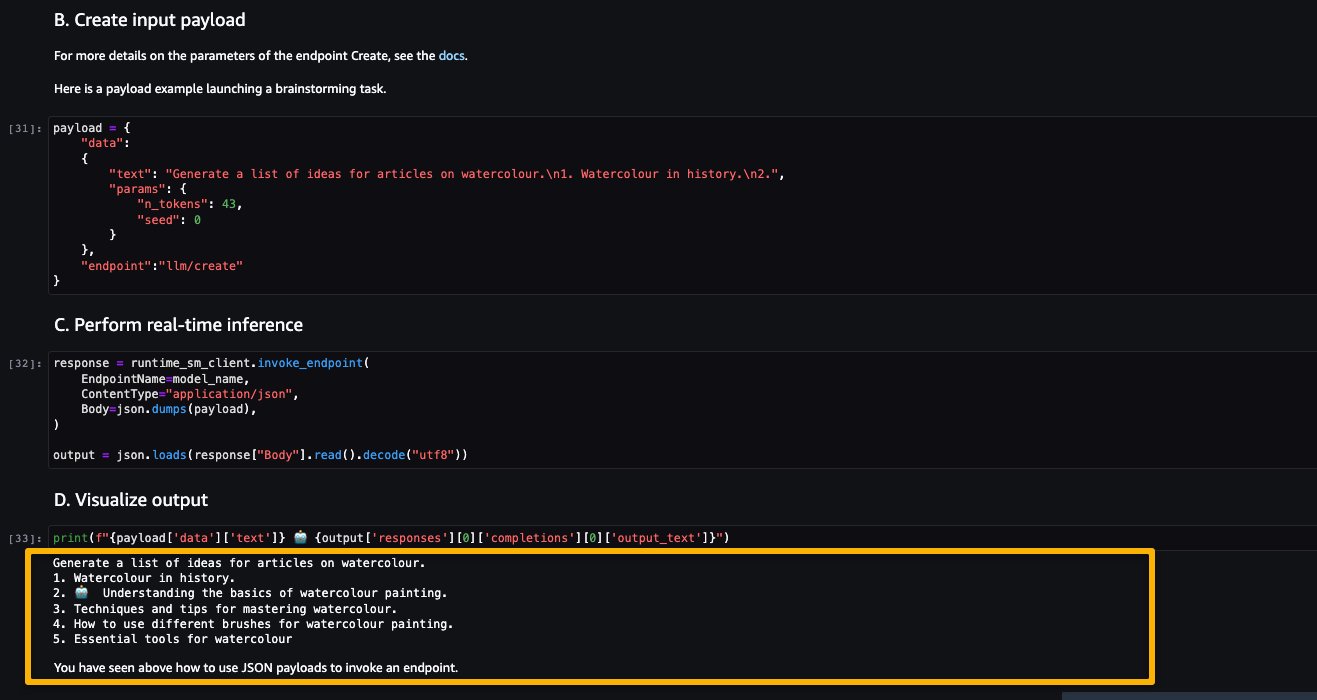

Versuchen wir nun, auf das Modell zu schließen, indem wir es bitten, eine Liste mit Ideen für Artikel zu einem Thema, in diesem Fall Aquarell, zu erstellen.

Wie Sie sehen, konnte das LightOn Mini-Instruct-Modell generierten Text basierend auf der gegebenen Eingabeaufforderung bereitstellen.

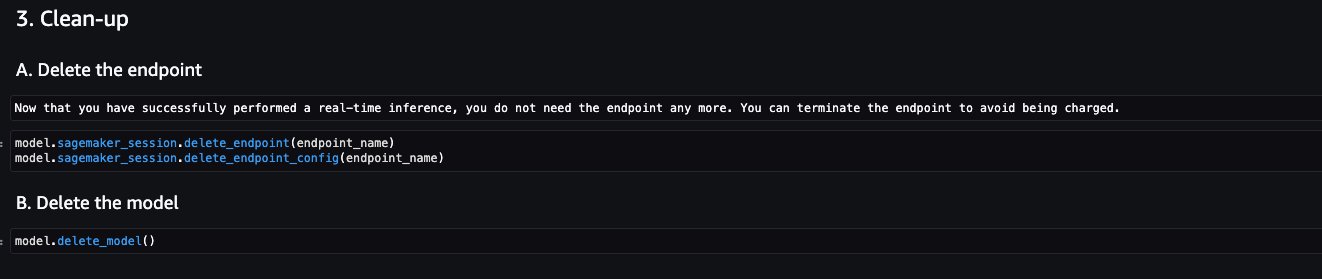

Aufräumen

Nachdem Sie die oben genannten Modelle getestet und Endpunkte für die beispielhaften proprietären Foundation-Modelle erstellt haben, stellen Sie sicher, dass Sie die SageMaker-Inferenzendpunkte löschen und die Modelle löschen, um zu vermeiden, dass Gebühren anfallen.

Zusammenfassung

In diesem Beitrag haben wir Ihnen gezeigt, wie Sie in SageMaker Studio mit proprietären Modellen von Modellanbietern wie AI21, Cohere und LightOn beginnen. Kunden können proprietäre Foundation-Modelle in SageMaker JumpStart von Studio, dem SageMaker SDK und der SageMaker-Konsole entdecken und verwenden. Damit haben sie Zugriff auf groß angelegte ML-Modelle, die Milliarden von Parametern enthalten und auf Terabytes an Text- und Bilddaten vortrainiert sind, sodass Kunden eine breite Palette von Aufgaben wie Artikelzusammenfassung und Text-, Bild- oder Videogenerierung durchführen können. Da die Basismodelle vorab trainiert sind, können sie auch dazu beitragen, die Schulungs- und Infrastrukturkosten zu senken und eine Anpassung an Ihren Anwendungsfall zu ermöglichen.

Downloads

Über die Autoren

Juni gewonnen ist Produktmanager bei SageMaker JumpStart. Sein Schwerpunkt liegt darauf, Basismodelle leicht auffindbar und nutzbar zu machen, um Kunden bei der Entwicklung generativer KI-Anwendungen zu unterstützen.

Juni gewonnen ist Produktmanager bei SageMaker JumpStart. Sein Schwerpunkt liegt darauf, Basismodelle leicht auffindbar und nutzbar zu machen, um Kunden bei der Entwicklung generativer KI-Anwendungen zu unterstützen.

Mani Chanuja ist ein Artificial Intelligence and Machine Learning Specialist SA bei Amazon Web Services (AWS). Sie hilft Kunden, die maschinelles Lernen einsetzen, um ihre geschäftlichen Herausforderungen mit AWS zu lösen. Sie verbringt die meiste Zeit damit, tief einzutauchen und Kunden in KI/ML-Projekten im Zusammenhang mit Computer Vision, Verarbeitung natürlicher Sprache, Prognosen, ML am Rande und mehr zu unterrichten. Sie ist begeistert von ML at Edge, daher hat sie ihr eigenes Labor mit einem selbstfahrenden Kit und einer Produktionslinie für die Herstellung von Prototypen eingerichtet, wo sie viel Freizeit verbringt.

Mani Chanuja ist ein Artificial Intelligence and Machine Learning Specialist SA bei Amazon Web Services (AWS). Sie hilft Kunden, die maschinelles Lernen einsetzen, um ihre geschäftlichen Herausforderungen mit AWS zu lösen. Sie verbringt die meiste Zeit damit, tief einzutauchen und Kunden in KI/ML-Projekten im Zusammenhang mit Computer Vision, Verarbeitung natürlicher Sprache, Prognosen, ML am Rande und mehr zu unterrichten. Sie ist begeistert von ML at Edge, daher hat sie ihr eigenes Labor mit einem selbstfahrenden Kit und einer Produktionslinie für die Herstellung von Prototypen eingerichtet, wo sie viel Freizeit verbringt.

Nitin Eusebius ist Senior Enterprise Solutions Architect bei AWS mit Erfahrung in Software Engineering, Unternehmensarchitektur und AI/ML. Er arbeitet mit Kunden zusammen, um ihnen beim Aufbau gut strukturierter Anwendungen auf der AWS-Plattform zu helfen. Seine Leidenschaft besteht darin, technologische Herausforderungen zu lösen und Kunden bei ihrer Cloud-Reise zu unterstützen.

Nitin Eusebius ist Senior Enterprise Solutions Architect bei AWS mit Erfahrung in Software Engineering, Unternehmensarchitektur und AI/ML. Er arbeitet mit Kunden zusammen, um ihnen beim Aufbau gut strukturierter Anwendungen auf der AWS-Plattform zu helfen. Seine Leidenschaft besteht darin, technologische Herausforderungen zu lösen und Kunden bei ihrer Cloud-Reise zu unterstützen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/use-proprietary-foundation-models-from-amazon-sagemaker-jumpstart-in-amazon-sagemaker-studio/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 000

- 10

- 100

- 40

- 50

- 500

- 7

- 87

- a

- Fähig

- Über Uns

- oben

- beschleunigen

- Zugang

- Konto

- Genauigkeit

- Aktionen

- Administrator

- Nach der

- Makler

- AI

- AI / ML

- Algorithmen

- Alle

- erlaubt

- bereits

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon SageMaker-JumpStart

- Amazon SageMaker-Studio

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- und

- und Infrastruktur

- jedem

- nicht mehr

- APIs

- erscheint

- Geräte

- Anwendungen

- angemessen

- Architektur

- SIND

- um

- Artikel

- Artikel

- künstlich

- künstliche Intelligenz

- Künstliche Intelligenz und maschinelles Lernen

- AS

- Hilfe

- Assistenten

- At

- Automatisiert

- verfügbar

- vermeiden

- AWS

- AWS-Marktplatz

- basierend

- BE

- weil

- war

- Bevor

- Sein

- BESTE

- Milliarde

- Milliarden

- Blog

- Körper

- bauen

- erbaut

- Geschäft

- Geschäftsanwendungen

- Unternehmen

- aber

- by

- CAN

- Erfassung

- gefangen

- Karte

- Karten

- österreichische Unternehmen

- Häuser

- Die Zellen

- Herausforderungen

- Zeichen

- berechnet

- Gebühren

- Chatbots

- Auswählen

- Auswahl

- Cloud

- Codes

- Computer

- Computer Vision

- konsistent

- Konsul (Console)

- Verbraucher

- Verbraucherprodukte

- Kontakt

- enthalten

- enthält

- Smartgeräte App

- Copywriting

- Dazugehörigen

- Kosten

- bedeckt

- erstellen

- erstellt

- Erstellen

- Kunde

- Kunden

- Anpassung

- technische Daten

- Datenwissenschaftler

- gewidmet

- tief

- Abhängig

- einsetzen

- Bereitstellen

- Einsatz

- Beschreibung

- Detail

- Details

- entwickelt

- Entwicklung

- Rundfunk

- Direkt

- Rabatt

- entdeckt,

- angezeigt

- Tut nicht

- Nicht

- leicht

- Einfache

- Edge

- Bemühungen

- ermöglichen

- Endpunkt

- Entwicklung

- Unternehmen

- Unternehmen

- Einheit

- Arbeitsumfeld

- etc

- bewerten

- Beispiel

- Beispiele

- ERFAHRUNGEN

- ERKUNDEN

- Gesicht

- wenige

- Vorname

- konzentriert

- folgen

- gefolgt

- Folgende

- Aussichten für

- Foundation

- Frei

- für

- Funktionalität

- erzeugen

- erzeugt

- Erzeugung

- Generation

- generativ

- Generative KI

- bekommen

- bekommen

- gegeben

- Go

- Griff

- Haben

- he

- Hilfe

- Unternehmen

- hilft

- hier (auf dänisch)

- hochwertige

- Ultraschall

- Hilfe

- HTML

- HTTPS

- Nabe

- Ideen

- identifizieren

- if

- Image

- importieren

- wichtig

- Einfuhr

- beeindruckend

- in

- Einschließlich

- Information

- Infrastruktur

- Varianten des Eingangssignals:

- Eingänge

- installieren

- Installieren

- Instanz

- Anleitung

- integriert

- Intelligenz

- in

- isoliert

- IT

- SEINE

- Job

- Reise

- jpg

- Wesentliche

- Labor

- Labs

- Landung

- Sprache

- großflächig

- später

- LERNEN

- lernen

- Lasst uns

- Niveau

- Bibliotheken

- Bibliothek

- Gefällt mir

- LIMIT

- Line

- Liste

- Gelistet

- listing

- Belastung

- Lang

- aussehen

- Los

- senken

- Maschine

- Maschinelles Lernen

- um

- MACHT

- Making

- Management

- Manager

- Herstellung

- viele

- Mapping

- Marktplatz

- Kann..

- ML

- Model

- Modell

- für

- Überwachen

- mehr

- vor allem warme

- Name

- Namens

- Natürliche

- Verarbeitung natürlicher Sprache

- notwendig,

- Need

- Bedürfnisse

- Netzwerk

- News

- weiter

- Notizbuch

- Anzahl

- und viele

- of

- on

- einmal

- XNUMXh geöffnet

- or

- Organisation

- Andere

- Möglichkeiten für das Ausgangssignal:

- Reichweite

- übrig

- Überblick

- besitzen

- Paket

- Seite

- Parameter

- leidenschaftlich

- Ausführen

- Leistung

- durchgeführt

- führt

- Berechtigungen

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- Points

- Beliebt

- Portal

- Post

- größte treibende

- Voraussetzungen

- vorgeführt

- früher

- gebühr

- Vor

- Erlös

- Verarbeitung

- Beschaffung

- Produkt

- Produkt-Manager

- Produktion

- Produkte

- Projekte

- Eigentums-

- Prototyp

- die

- vorausgesetzt

- Versorger

- Anbieter

- bietet

- öffentlich

- veröffentlicht

- Python

- Qualität

- Fragen

- Angebot

- erreichen

- Reagieren

- Lesen Sie mehr

- Schreibgeschützter Modus

- Echtzeit

- Anerkennung

- in Bezug auf

- Region

- Regionen

- bezogene

- bleiben

- Anforderung

- erfordern

- falls angefordert

- Downloads

- Überprüfen

- Rollen

- rund

- Führen Sie

- Laufen

- SA

- sagemaker

- SageMaker-Inferenz

- gleich

- Wissenschaftler

- Skripte

- Sdk

- Abschnitt

- sehen

- ausgewählt

- Auswahl

- selbstfahrend

- Lösungen

- Sitzung

- kompensieren

- Teilen

- sie

- Short

- sollte

- Vitrine

- zeigte

- gezeigt

- Konzerte

- ähnlich

- vereinfachen

- einfach

- Single

- smart

- So

- Software

- Softwareentwicklung

- Lösungen

- LÖSEN

- Auflösung

- einige

- Jemand,

- Quelle

- Quellen

- Spezialist

- spezifisch

- stabil

- Anfang

- begonnen

- Shritte

- Immer noch

- Studio Adressen

- Abonnieren

- Abonnement

- so

- zusammenfassen

- ZUSAMMENFASSUNG

- Support

- Unterstützte

- System

- TAG

- Nehmen

- gemacht

- und Aufgaben

- Einführungen

- Team

- Technologie

- AGB

- getestet

- Testen

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- die Informationen

- Die Quelle

- ihr

- Sie

- dann

- deswegen

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- diejenigen

- Durch

- Zeit

- zu

- Thema

- Training

- trainiert

- Ausbildung

- versuchen

- XNUMX

- tippe

- Typen

- ui

- für

- verstehen

- URL

- verwendbar

- Anwendungsbereich

- -

- Anwendungsfall

- benutzt

- Nutzer

- verwendet

- Verwendung von

- verschiedene

- Version

- Video

- Anzeigen

- Seh-

- Stimme

- Volumen

- wurde

- we

- Netz

- Web-Services

- Webbasiert

- Gewicht

- GUT

- welche

- während

- breit

- Große Auswahl

- Wikipedia

- werden wir

- mit

- Worte

- Werk

- Du

- Ihr

- Zephyrnet