Nachdem Sie Ihr Modell für maschinelles Lernen (ML) erstellt, trainiert und bewertet haben, um sicherzustellen, dass es das beabsichtigte vorgeschlagene Geschäftsproblem löst, möchten Sie dieses Modell bereitstellen, um die Entscheidungsfindung im Geschäftsbetrieb zu ermöglichen. Modelle, die geschäftskritische Funktionen unterstützen, werden in einer Produktionsumgebung bereitgestellt, in der eine Modellfreigabestrategie eingeführt wird. Angesichts der Natur von ML-Modellen, bei denen sich die Daten ständig ändern, möchten Sie auch sicherstellen, dass ein bereitgestelltes Modell immer noch für neue Daten relevant ist und dass das Modell aktualisiert wird, wenn dies nicht der Fall ist. Dazu gehört die Auswahl einer Bereitstellungsstrategie, die Risiken und Ausfallzeiten minimiert. Diese optimale Bereitstellungsstrategie sollte die hohe Verfügbarkeit des Modells aufrechterhalten, die Geschäftskosten für die Bereitstellung eines minderwertigen Modells gegenüber dem bereits in Produktion befindlichen Modell berücksichtigen und Funktionen enthalten, um ein einfaches Rollback auf eine frühere Modellversion zu ermöglichen. Viele dieser empfohlenen Überlegungen und Bereitstellungsmuster werden auch im behandelt AWS Well Architected Framework – Maschinelles Lernen.

Zusätzlich zur Auswahl der richtigen Bereitstellungsstrategie sollte diese Strategie mithilfe eines zuverlässigen Mechanismus implementiert werden, der MLOps-Praktiken umfasst. MLOps umfasst Praktiken, die ML-Workloads in Release-Management, CI/CD und Betrieb integrieren und dabei die einzigartigen Aspekte von ML-Projekten berücksichtigen, einschließlich Überlegungen zur Bereitstellung und Überwachung von Modellen. Amazon SageMaker für MLOps bietet speziell entwickelte Tools zum Automatisieren und Standardisieren von Schritten im gesamten ML-Lebenszyklus, einschließlich Funktionen zum Bereitstellen und Verwalten neuer Modelle mithilfe fortschrittlicher Bereitstellungsmuster.

In diesem Beitrag erörtern wir, wie ML-Modelle mit bereitgestellt werden Amazon Sage Maker auf wiederholbare und automatisierte Weise, Integration der Produktionsvarianten und Einsatzleitplanken Fähigkeiten von SageMaker mit MLOps-Lösungen. Wir geben Ihnen eine Einführung in die Integration der MLOps-Tools von SageMaker mit SageMaker-Modellbereitstellungsmustern, wobei wir uns auf Einzelmodell-Endpunkte in Echtzeit konzentrieren.

Lösungsüberblick

Wir untersuchen die folgenden Modelltest- und Leitplankenmuster und ihre Integration mit SageMaker MLOps-Tools:

- Modelltest – Wir vergleichen verschiedene Modellversionen in der Produktion, bevor wir die aktuelle Modellversion ersetzen. Dieser Beitrag vergleicht die folgenden Modelltestfunktionen:

- A / B-Tests – Mit A/B-Tests vergleichen Sie verschiedene Versionen Ihres Modells in der Produktion, indem Sie den Endpunktverkehr zwischen Ihren Modellvarianten verteilen. A/B-Tests werden in Szenarios verwendet, in denen Closed-Loop-Feedback Modellausgaben direkt mit nachgelagerten Geschäftsmetriken verknüpfen kann. Dieses Feedback wird dann verwendet, um die statistische Signifikanz des Wechsels von einem Modell zu einem anderen zu bestimmen, was Ihnen hilft, das beste Modell durch Live-Produktionstests auszuwählen.

- Schattentests – Mit Schattentests testen Sie eine neue Version Ihres Modells in der Produktion, indem Sie Anfragen parallel an das Produktionsmodell und das neue Modell senden. Die Vorhersageantwortdaten aus dem Produktionsmodell werden der Anwendung bereitgestellt, während die Vorhersagen der neuen Modellversion zum Testen gespeichert, aber nicht der Produktionsanwendung bereitgestellt werden. Schattentests werden in Situationen verwendet, in denen es kein Closed-Loop-Feedback gibt, das eine Geschäftsmetrik auf die Vorhersagen eines Modells zurückführt. In diesem Szenario verwenden Sie Modellqualität und Betriebsmetriken, um mehrere Modelle zu vergleichen, anstatt sich auf nachgelagerte Geschäftsmetriken auszuwirken.

- Verkehr verlagern – Nachdem Sie die neue Version des Modells getestet haben und mit ihrer Leistung zufrieden sind, besteht der nächste Schritt darin, den Datenverkehr vom aktuellen Modell auf das neue zu verlagern. Der blau/grüne Bereitstellungsleitplanken in SageMaker ermöglichen es Ihnen, einfach und kontrolliert vom aktuellen Modell in der Produktion (blaue Flotte) zu einem neuen (grüne Flotte) zu wechseln. Blau/Grün-Bereitstellungen vermeiden Ausfallzeiten während der Aktualisierungen Ihres Modells, wie Sie es in einem In-Place-Bereitstellungsszenario hätten. Um die Modellverfügbarkeit zu maximieren, sind Blau/Grün-Bereitstellungen zum jetzigen Zeitpunkt die Standardoption für Modellaktualisierungen in SageMaker. Wir diskutieren in diesem Beitrag die folgenden Traffic-Shifting-Methoden:

- Auf einmal Verkehrsverlagerung – 100 % Ihres Endpunktdatenverkehrs werden von Ihrer blauen Flotte auf Ihre grüne Flotte verlagert, sobald die grüne Flotte verfügbar wird. Wir gebrauchen Alarm in Amazon CloudWatch die Ihre grüne Flotte für einen festgelegten Zeitraum überwachen (die Backzeit) und wenn kein Alarm ausgelöst wird, wird die blaue Flotte dann von SageMaker nach der Backzeit gelöscht.

- Kanarischen Verkehrsverlagerung – Ihre grüne Flotte wird zunächst einem kleineren Anteil Ihres Verkehrs ausgesetzt (a Kanarienvogel) und validiert für alle Probleme mit CloudWatch-Alarmen für einen Backzeitraum, während die blaue Flotte weiterhin den größten Teil des Endpunktverkehrs empfängt. Nachdem die grüne Flotte validiert wurde, wird der gesamte Verkehr auf die neue Flotte verlagert und die blaue Flotte wird dann von SageMaker gelöscht.

- Blau/grüne lineare Verkehrsverlagerung Leitplanke – Sie verlagern den Verkehr schrittweise von Ihrer blauen Flotte auf Ihre grüne Flotte. Ihr Modell wird dann in jedem Schritt mit CloudWatch-Alarmen für eine Backzeit überwacht, bevor die Blue-Flotte vollständig ersetzt wird.

Dieser Beitrag konzentriert sich auf die Beschreibung von Architekturen, die SageMaker MLOps-Funktionen verwenden, um kontrollierte Bereitstellungen von Modellen über die von uns aufgelisteten Bereitstellungsleitlinien und Modellierungsteststrategien durchzuführen. Allgemeine Informationen zu diesen Mustern finden Sie unter Profitieren Sie von fortschrittlichen Bereitstellungsstrategien mit Amazon SageMaker-Bereitstellungsleitlinien und Bereitstellungsleitlinien.

Stellen Sie ein Modell mit SageMaker bereit

SageMaker bietet eine breite Palette an Bereitstellungsoptionen die von niedriger Latenz und hohem Durchsatz bis hin zu lang andauernden Inferenzaufträgen reichen. Diese Optionen umfassen Überlegungen für Batch-, Echtzeit- oder Inferenz nahezu in Echtzeit. Jede Option bietet verschiedene erweiterte Funktionen, z. B. die Möglichkeit, mehrere Modelle auf einem einzigen Endpunkt auszuführen. Wie bereits erwähnt, behandeln wir in diesem Beitrag jedoch nur MLOps-Bereitstellungsmuster mit Einzelmodell-Endpunkten. Weitere Informationen zu erweiterten SageMaker-Bereitstellungsfunktionen für Echtzeit-Inferenz finden Sie unter Modellieren von Hosting-Mustern in Amazon SageMaker, Teil 2: Erste Schritte mit der Bereitstellung von Echtzeitmodellen auf SageMaker.

Um die Implementierung erweiterter Bereitstellungsmuster mithilfe von Continuous Delivery (CD)-Pipelines zu verstehen, wollen wir zunächst ein Schlüsselkonzept in SageMaker mit dem Namen „ Modellvarianten.

SageMaker-Modellvarianten

Mit Modellvarianten können Sie mehrere Versionen Ihres Modells auf demselben Endpunkt bereitstellen, um Ihr Modell zu testen. Modellvarianten werden in separaten Instanzen bereitgestellt, sodass es keine Auswirkungen auf andere Varianten gibt, wenn eine aktualisiert wird. In SageMaker werden Modellvarianten als Produktions- und Schattenvarianten implementiert.

Produktionsvarianten ermöglichen es Ihnen, mehrere Versionen Ihres Modells A/B zu testen, um ihre Leistung zu vergleichen. In diesem Szenario geben alle Versionen Ihres Modells Antworten auf die Modellanforderungen zurück. Ihr Endpunkt-Traffic wird entweder nach Traffic-Verteilung, bei der Sie jeder Variante eine Gewichtung zuweisen, oder nach Zielvariante, bei der ein bestimmter Parameter (z. B. Region oder Markt) entscheidet, welches Modell aufgerufen werden soll, zwischen den vorhandenen Varianten verteilt.

Schattenvarianten ermöglichen es Ihnen, eine neue Version Ihres Modells zu testen. In diesem Szenario verfügt Ihr Modell über eine Produktionsvariante und eine Schattenvariante, die parallel auf demselben Endpunkt bereitgestellt werden. Die Schattenvariante empfängt den vollständigen (oder abgetasteten) Datenverkehr von Ihrem Endpunkt. Allerdings werden nur die Vorhersagen der Produktionsvarianten an die Benutzer Ihrer Anwendung zurückgesendet, und die Vorhersagen der Schattenvarianten werden zur Analyse protokolliert. Da Schattenvarianten auf separaten Instanzen von der Produktionsvariante gestartet werden, wirkt sich dieser Test nicht auf die Leistung Ihrer Produktionsvariante aus. Mit dieser Option testen Sie das neue Modell und minimieren die Risiken eines leistungsschwachen Modells, und Sie können die Leistung beider Modelle mit denselben Daten vergleichen.

Leitplanken für die SageMaker-Bereitstellung

Leitplanken sind ein wesentlicher Bestandteil der Softwareentwicklung. Sie schützen Ihre Anwendung und minimieren das Risiko der Bereitstellung einer neuen Version Ihrer Anwendung. In ähnlicher Weise ermöglichen Ihnen die SageMaker-Bereitstellungsleitlinien den kontrollierten Wechsel von einer Modellversion zu einer anderen. Ab Dezember 2022 bieten SageMaker-Leitplanken eine Implementierung für Bereitstellungsoptionen für blaue/grüne, Canary- und lineare Verkehrsverlagerungen. In Kombination mit Modellvarianten können Bereitstellungsleitplanken sowohl auf Produktions- als auch auf Schattenvarianten Ihres Modells angewendet werden, um sicherzustellen, dass während der Aktualisierung einer neuen Variante keine Ausfallzeiten auftreten, wobei die Verkehrsverlagerung entsprechend der ausgewählten Option gesteuert wird.

MLOps-Grundlagen für die Modellbereitstellung

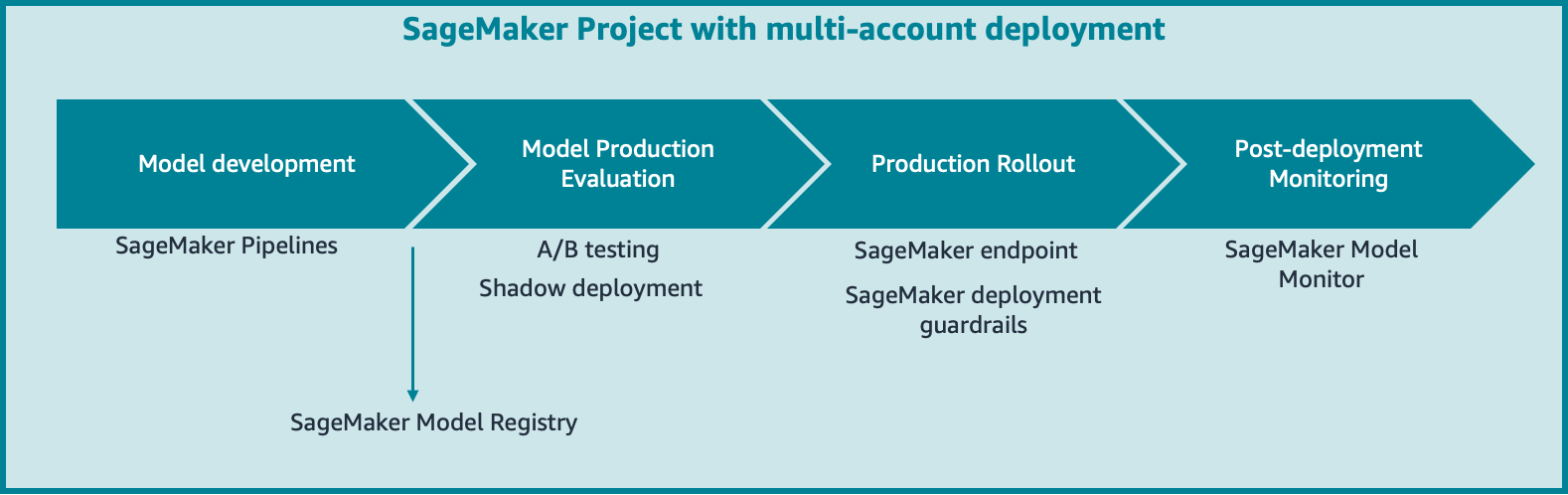

Im breiteren Kontext eines Workflows zum Erstellen und Bereitstellen von ML-Modellen möchten wir CI/CD-Praktiken einsetzen, die speziell für den ML-Workflow entwickelt wurden. Ähnlich wie bei herkömmlichen CI/CD-Systemen möchten wir Softwaretests, Integrationstests und Produktionsbereitstellungen automatisieren. Wir müssen jedoch auch bestimmte Vorgänge rund um den ML-Lebenszyklus einbeziehen, die im traditionellen Softwareentwicklungslebenszyklus nicht vorhanden sind, wie z. B. Modelltraining, Modellversuche, Modelltests und Modellüberwachung.

Um diese ML-spezifischen Funktionen zu erreichen, werden dem Modellbereitstellungsprozess MLOps-Grundlagen wie automatisierte Modelltests, Bereitstellungsleitlinien, Multi-Account-Bereitstellungen und automatisiertes Modell-Rollback hinzugefügt. Dadurch wird sichergestellt, dass die bereits beschriebenen Funktionen Modelltests ermöglichen und Ausfallzeiten während des Prozesses einer Modellaktualisierung vermeiden. Es bietet auch die Zuverlässigkeit und Rückverfolgbarkeit, die für die kontinuierliche Verbesserung eines produktionsreifen Modells erforderlich sind. Darüber hinaus stellen Funktionen wie die Fähigkeit, vorhandene Lösungen in wiederverwendbare Vorlagen zu packen und Modelle in einer Konfiguration mit mehreren Konten bereitzustellen, die Skalierbarkeit der im Beitrag besprochenen Modellbereitstellungsmuster für mehrere Modelle in einer Organisation sicher.

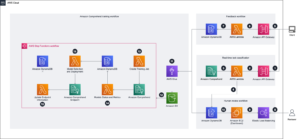

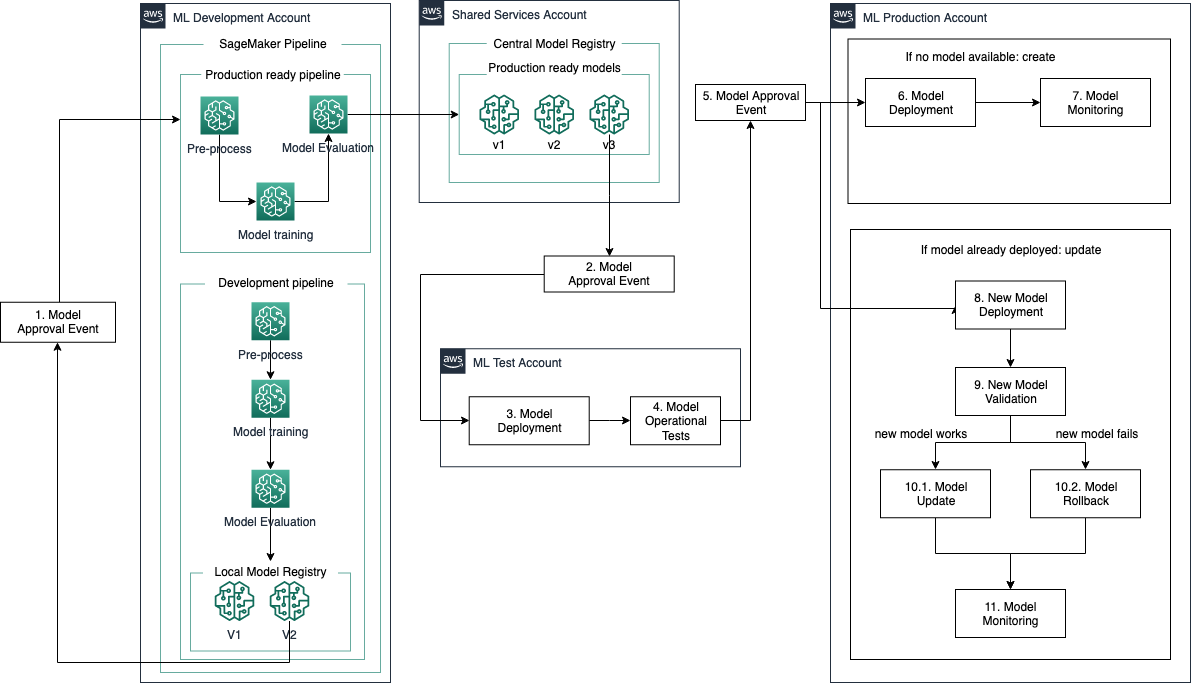

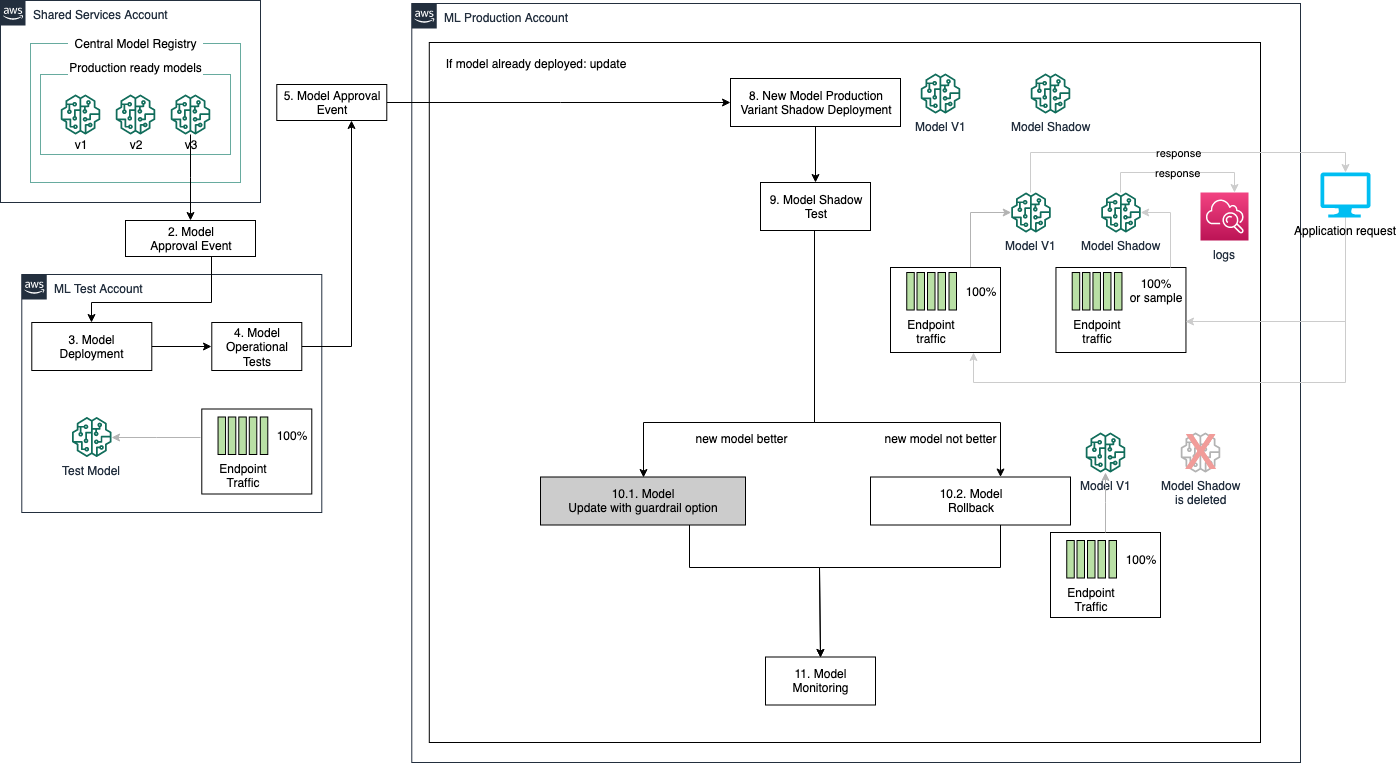

Die folgende Abbildung zeigt ein allgemeines Muster für die Verbindung von SageMaker-Funktionen zum Erstellen einer End-to-End-Modellerstellungs- und Bereitstellungspipeline. In diesem Beispiel wird ein Modell in SageMaker unter Verwendung von entwickelt SageMaker Processing-Jobs um Datenverarbeitungscode auszuführen, der verwendet wird, um Daten für einen ML-Algorithmus vorzubereiten. SageMaker-Schulungsjobs werden dann verwendet, um ein ML-Modell mit den vom Verarbeitungsauftrag erzeugten Daten zu trainieren. Die Modellartefakte und zugehörigen Metadaten werden in der gespeichert SageMaker-Modellregistrierung als letzter Schritt des Ausbildungsprozesses. Dies wird orchestriert von SageMaker-Pipelines, ein speziell entwickelter CI/CD-Dienst für ML, der dabei hilft, ML-Workflows in großem Umfang zu automatisieren und zu verwalten.

Nachdem das Modell genehmigt wurde, wird es in der Produktion entweder mit einem A/B-Test oder einer Schattenbereitstellung getestet. Nachdem das Modell in der Produktion validiert wurde, verwenden wir die Modellregistrierung, um das Modell für die Produktionseinführung auf einem SageMaker-Endpunkt zu genehmigen, indem wir eine der Bereitstellungsleitlinienoptionen verwenden.

Wenn der Modellaktualisierungsprozess abgeschlossen ist, SageMaker Modellmonitor überwacht kontinuierlich die Modellleistung auf Drifts in die Modell- und Datenqualität. Dieser Prozess wird für mehrere Anwendungsfälle automatisiert SageMaker-Projekt Vorlagen, die die Infrastrukturbereitstellung einem Multi-Account-Setup zuordnen, um eine vollständige Ressourcenisolierung und eine einfachere Kostenkontrolle zu gewährleisten.

Bereitstellungsmuster für einzelne Endpunkte

Wenn Sie Modelle zum ersten Mal in einer Produktionsumgebung bereitstellen, haben Sie kein Modell, mit dem Sie vergleichen können, und das bereitgestellte Modell wird von Ihrer Geschäftsanwendung verwendet. Nachdem das Modell in einer Produktionsumgebung bereitgestellt und überwacht wurde, möchten Sie das Modell möglicherweise entweder regelmäßig oder bei Bedarf aktualisieren, wenn neue Daten verfügbar sind oder wenn bei Ihrem Modell eine Leistungslücke erkannt wird. Wenn Sie ein vorhandenes Modell aktualisieren, möchten Sie sicherstellen, dass das neue Modell eine bessere Leistung als das aktuelle Modell erbringt und den Vorhersageanfrageverkehr von Ihren Geschäftsanwendungen verarbeiten kann. Während dieses Validierungszeitraums soll das aktuelle Modell für ein mögliches Rollback weiterhin verfügbar sein, um das Risiko von Ausfallzeiten Ihrer Anwendungen zu minimieren.

In einem breiteren Modellentwicklungsbild werden Modelle typischerweise in einem Data-Science-Entwicklungskonto trainiert. Dazu gehören Experimentier-Workflows, die häufig bei der Entwicklung von Modellen verwendet werden, sowie Umschulungs-Workflows, die in produktionsbereiten Pipelines verwendet werden. Alle Metadaten für diese Experimente können mit verfolgt werden Amazon SageMaker-Experimente während der Entwicklung. Nachdem der Workflow für die Produktionsnutzung in eine Pipeline integriert wurde, werden die Metadaten automatisch über SageMaker-Pipelines nachverfolgt. Um brauchbare Produktionsmodelle an einem Ort zu verfolgen, nachdem Experimente die Leistungsmetriken eines Modells (Präzision, Abruf usw.) auf ein akzeptables Niveau für die Produktion gebracht haben, a Bedingungsschritt in der SageMaker-Pipeline ermöglicht die Registrierung des Modells in der Modellregistrierung.

Die Modellregistrierung ermöglicht es Ihnen, die Bereitstellung dieses Modells mit einem manuellen oder automatisierten Genehmigungsprozess auszulösen. Diese Bereitstellung erfolgt in einem ML-Testkonto, in dem Betriebstests wie Integrationstests, Komponententests, Modelllatenz und alle zusätzlichen Modellvalidierungen für die neue Modellversion durchgeführt werden können. Beachten Sie, dass A/B-Tests und Schattentests nicht im ML-Testkonto durchgeführt werden, sondern im ML-Produktionskonto.

Nachdem das Modell alle Validierungen im Testkonto bestanden hat, kann es in einer Produktionsumgebung bereitgestellt werden. Ein neuer Genehmigungsprozess löst diese Bereitstellung aus, und die SageMaker-Bereitstellungsleitplanken ermöglichen eine kontrollierte Freigabe und einen transparenten Modellaktualisierungsprozess entsprechend dem ausgewählten Modus für die Verkehrsumschaltung.

Das folgende Diagramm veranschaulicht diese Lösungsarchitektur.

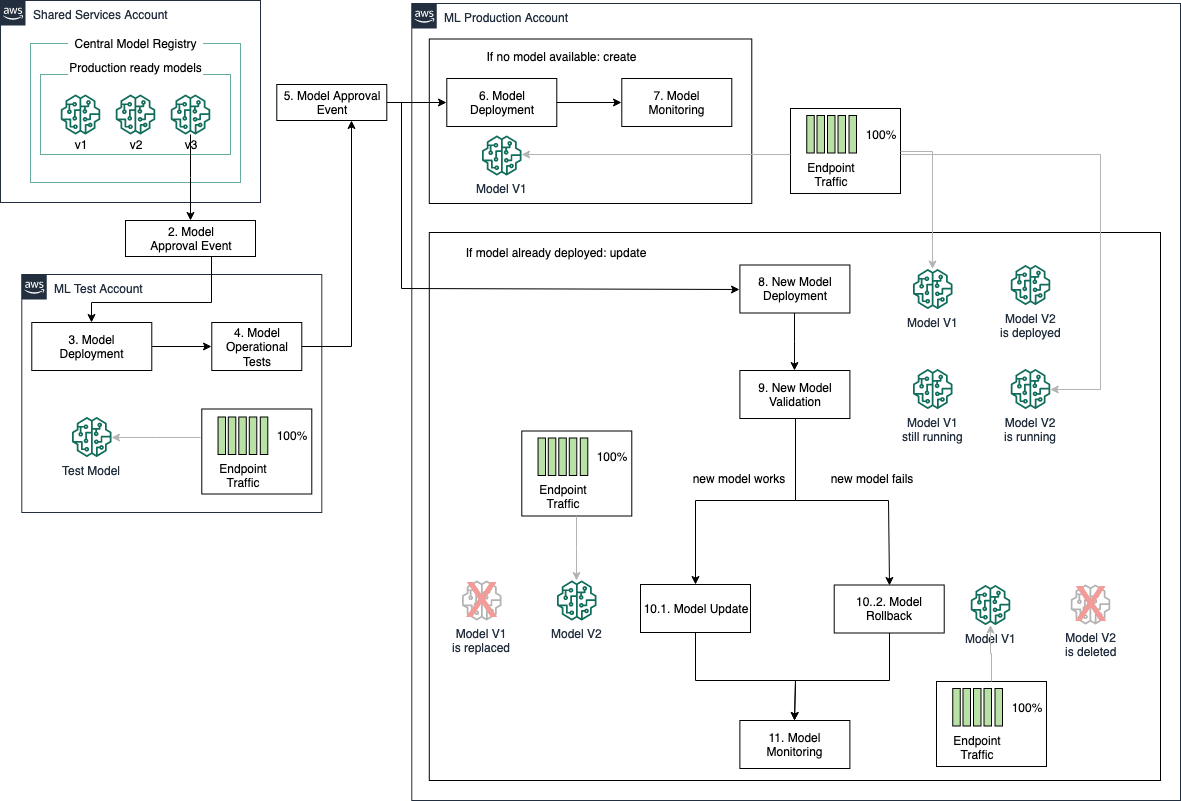

Auf einmal Verkehrsverlagerung

Das auf einmal Verkehrsverlagerungsmodus ermöglicht es Ihnen, eine neue Modellversion (grüne Flotte) zu aktualisieren, indem Sie 100 % des Verkehrs von Ihrem aktuellen Modell (blaue Flotte) auf Ihr neues Modell verlagern. Mit dieser Option können Sie eine Baking-Periode konfigurieren, während der beide Versionen Ihres Modells noch laufen, und Sie können schnell und automatisch auf die aktuelle Version zurücksetzen, wenn Ihr neues Modell nicht wie erwartet funktioniert. Der Nachteil dieser Option ist, dass Ihr gesamter Datenverkehr auf einmal betroffen ist. Wenn also ein Problem mit Ihrer Modellbereitstellung auftritt, sind alle Benutzer betroffen, die die Anwendung während des Bereitstellungsprozesses verwenden. Die folgende Architektur zeigt, wie die All-on-Once-Traffic-Shifting-Option Modellaktualisierungen handhabt.

All-on-on-Traffic-Shifting kann in Ihre MLOps-Tools integriert werden, indem Sie eine Endpoint-Bereitstellungskonfiguration mit definieren BlueGreenUpdatePolicy einstellen ALL_AT_ONCE. In Ihrer MLOps-Pipeline prüft SageMaker, nachdem ein neues Modell für die Bereitstellung im ML-Produktionskonto genehmigt wurde, ob Ihr Modellendpunkt bereits vorhanden ist. Wenn ja, die ALL_AT_ONCE Konfiguration löst eine Endpunktaktualisierung aus, die der Architektur folgt. Ihr Endpunkt-Rollback wird basierend auf gesteuert CloudWatch-Alarme definiert durch Ihren Endpunkt AutoRollbackConfiguration, die bei Auslösung automatisch das Modell-Rollback auf Ihre aktuelle Modellversion startet.

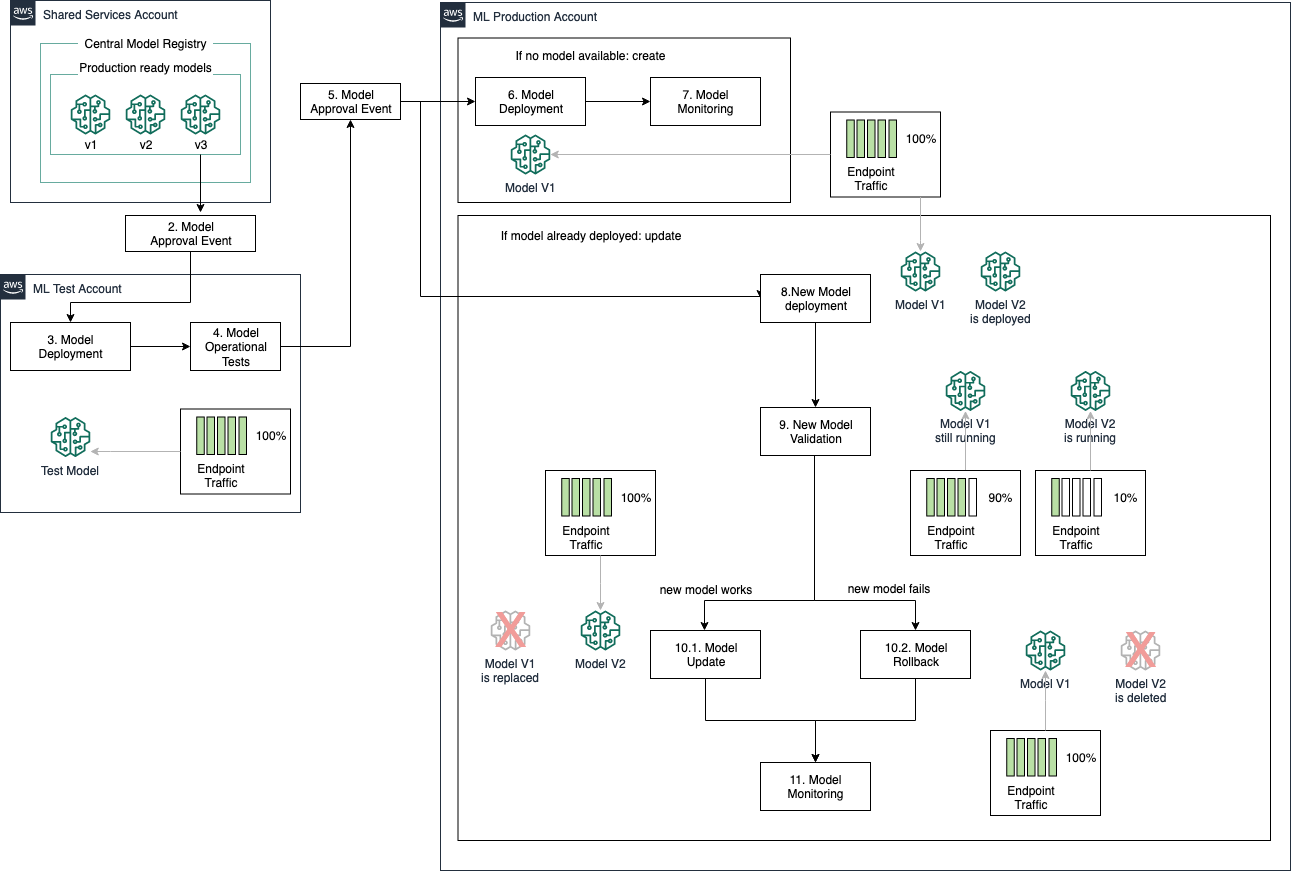

Kanarischen Verkehrsverlagerung

Das kanarische Verkehrsverlagerung -Modus können Sie Ihr neues Modell (grüne Flotte) mit einem kleinen Teil des Datenverkehrs testen, bevor Sie entweder das laufende Modell (blaue Flotte) auf die neue Version aktualisieren oder die neue Version zurücksetzen, je nach Ergebnis des Canary-Tests. Der Teil des Datenverkehrs, der zum Testen des neuen Modells verwendet wird, wird als Canary bezeichnet, und bei dieser Option wird Ihr Risiko eines problematischen neuen Modells auf den Canary-Datenverkehr minimiert, während die Aktualisierungszeit weiterhin minimiert wird.

Mit Canary-Bereitstellungen können Sie das Risiko der Implementierung einer neuen Modellversion minimieren, indem Sie die neue Modellversion einer kleineren Gruppe von Benutzern zur Verfügung stellen, um die Effektivität über einen bestimmten Zeitraum zu überwachen. Der Nachteil ist die Verwaltung mehrerer Versionen über einen Zeitraum, der es ermöglicht, Leistungsmetriken zu sammeln, die aussagekräftig genug sind, um die Auswirkungen auf die Leistung zu bestimmen. Der Vorteil ist die Möglichkeit, das Risiko auf eine kleinere Gruppe von Benutzern zu isolieren.

Canary Traffic Shifting kann in Ihre MLOps-Tools integriert werden, indem Sie eine Endpoint-Bereitstellungskonfiguration mit a definieren BlueGreenUpdatePolicy einstellen CANARY und definieren die CanarySize um zu bestimmen, wie viel Ihres Endpunktdatenverkehrs auf eine neue Modellversion umgeleitet werden soll. Ähnlich wie bei der All-on-Once-Option prüft SageMaker in Ihrer MLOps-Pipeline, nachdem ein neues Modell für die Bereitstellung im ML-Produktionskonto genehmigt wurde, ob Ihr Modellendpunkt bereits vorhanden ist. Wenn ja, die CANARY Konfiguration löst eine Endpunktaktualisierung aus, die der im folgenden Diagramm skizzierten Architektur folgt. Ihr Endpunkt-Rollback wird basierend auf CloudWatch-Alarmen gesteuert, die von Ihrem Endpunkt definiert werden AutoRollbackConfiguration das bei Auslösung automatisch das Modell-Rollback auf Ihre aktuelle Modellversion startet. Nützliche Alarmtypen, die hier eingesetzt werden können, sind 500 Statuscodes und Modelllatenz; Diese Alarmeinstellungen sollten jedoch an Ihren spezifischen Geschäftsanwendungsfall und Ihre ML-Technologie angepasst werden.

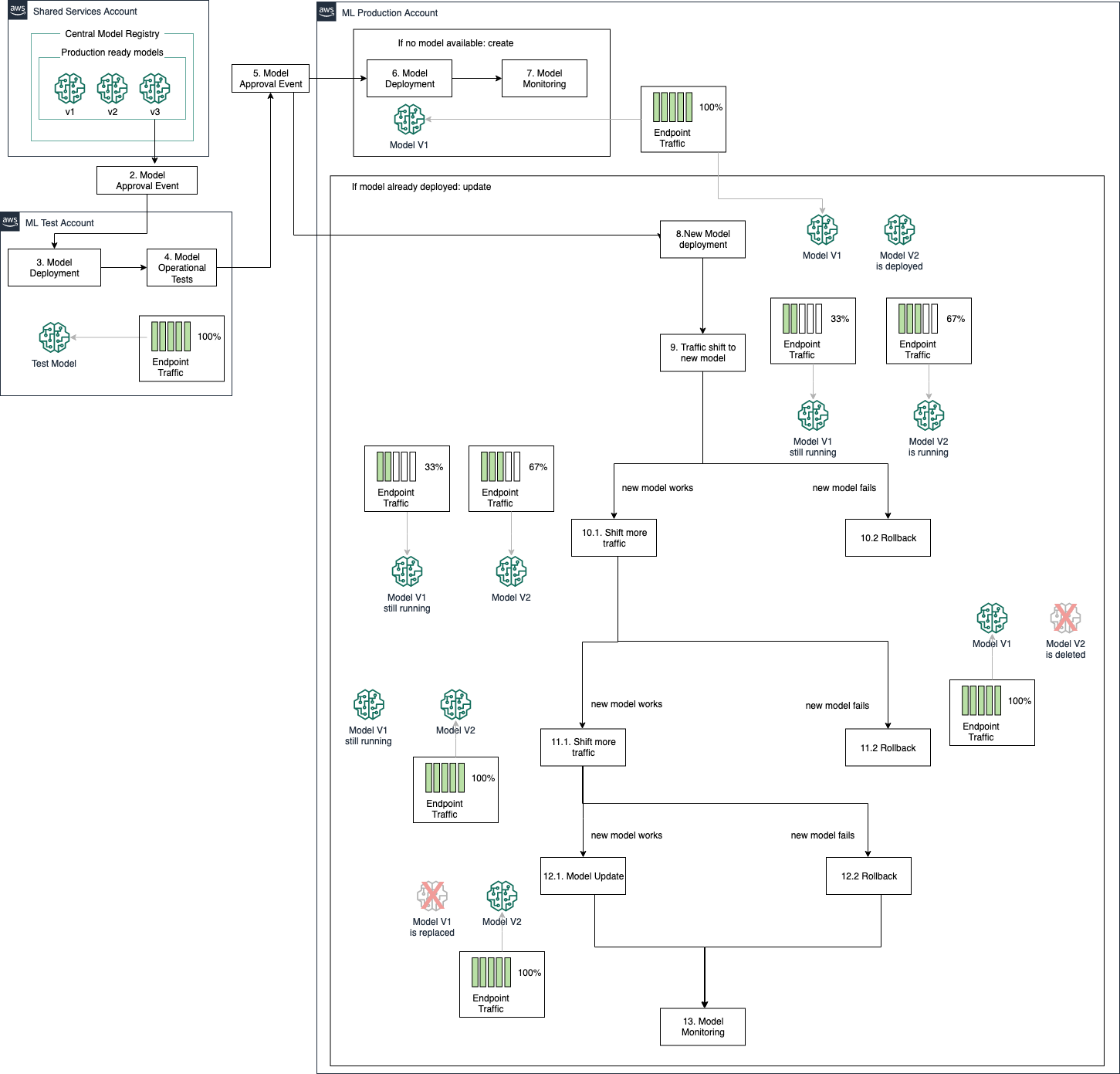

Lineare Verkehrsverlagerung

Im lineare Verkehrsverlagerung Modells stellen Sie den Datenverkehr von Ihrem aktuellen Modell (blaue Flotte) schrittweise auf Ihre neue Modellversion (grüne Flotte) um, indem Sie den an das neue Modell gesendeten Datenverkehr schrittweise erhöhen. Auf diese Weise erhöht sich der Anteil des Verkehrs, der zum Testen Ihrer neuen Modellversion verwendet wird, allmählich mit jedem Schritt, und eine Backzeit für jeden Schritt stellt sicher, dass Ihr Modell mit dem neuen Verkehr weiterhin einsatzbereit ist. Mit dieser Option minimieren Sie das Risiko, ein leistungsschwaches Modell bereitzustellen, und setzen das neue Modell schrittweise mehr Datenverkehr aus. Der Nachteil dieses Ansatzes besteht darin, dass Ihre Aktualisierungszeit länger ist und die Kosten für den parallelen Betrieb beider Modelle steigen.

Die lineare Datenverkehrsverschiebung kann in Ihre MLOps-Tools integriert werden, indem Sie eine Endpunktbereitstellungskonfiguration definieren, bei der BlueGreenUpdatePolicy auf festgelegt ist LINEAR und definieren die LinearStepSize um zu bestimmen, wie viel Ihres Datenverkehrs in jedem Schritt zu einem neuen Modell umgeleitet werden soll. Ähnlich wie bei der All-on-Once-Option prüft SageMaker in Ihrer MLOps-Pipeline, nachdem ein neues Modell für die Bereitstellung im ML-Produktionskonto genehmigt wurde, ob Ihr Modellendpunkt bereits vorhanden ist. Wenn ja, die LINEAR Konfiguration löst eine Endpunktaktualisierung aus, die der im folgenden Diagramm angegebenen Architektur folgt. Ihr Endpunkt-Rollback wird basierend auf CloudWatch-Alarmen gesteuert, die von Ihrem Endpunkt definiert werden AutoRollbackConfiguration das bei Auslösung automatisch das Modell-Rollback auf Ihre aktuelle Modellversion startet.

Bereitstellungsmuster mit Modellproduktionsvarianten

Unabhängig von dem Bereitstellungsmuster, das Sie für Ihre Anwendung ausgewählt haben, können Sie auch Produktionsvarianten verwenden, um die Leistung Ihres Modells zu validieren, bevor Sie Ihren Endpunkt aktualisieren, oder zusätzliche Bereitstellungsmuster wie Schattenbereitstellungen implementieren. In diesem Fall möchten Sie einen manuellen oder automatisierten Prozess hinzufügen, um das beste bereitzustellende Modell auszuwählen, bevor Sie Ihren Endpunkt aktualisieren. Die folgende Architektur zeigt, wie sich Ihr Endpunktverkehr und Ihre Antwort in einem Schattenbereitstellungsszenario verhalten. In diesem Szenario wird jede Vorhersageanforderung sowohl an das neue als auch an das bereitgestellte Modell gesendet; Allerdings liefert nur das aktuell bereitgestellte Modell die Vorhersageantwort an die Geschäftsanwendung, während die vom neuen Modell bereitgestellte Vorhersage nur zur Analyse der Leistung gegenüber dem aktuell bereitgestellten Modell beibehalten wird. Nachdem die Modellleistung bewertet wurde, kann die neue Modellversion bereitgestellt werden, um den Vorhersageantwortverkehr für Geschäftsanwendungen zu bedienen.

Rollback

Unabhängig von der Bereitstellungsstrategie, die Sie für Ihre Modellbereitstellung gewählt haben, möchten Sie in der Lage sein, auf die vorherige Modellversion zurückzusetzen, wenn die Leistung Ihres neuen Modells niedriger ist als die Leistung Ihres aktuellen Modells. Um dies zu tun und gleichzeitig die Ausfallzeit Ihrer Anwendung zu minimieren, müssen Sie Ihr aktuelles Modell parallel zum neuen laufen lassen, bis Sie sicher sind, dass Ihr neues Modell eine bessere Leistung als das aktuelle Modell erbringt.

SageMaker-Bereitstellungsleitlinien ermöglichen es Ihnen, Alarme festzulegen und während der Modellvalidierungsperiode automatisch auf frühere Modellversionen zurückzusetzen. Nach Ablauf des Validierungszeitraums müssen Sie möglicherweise immer noch auf eine frühere Modellversion zurücksetzen, um ein neues Problem zu lösen, das nach Abschluss der Modellaktualisierung entdeckt wird. Dazu können Sie die Modellregistrierung von SageMaker nutzen abgelehnte und genehmigte Modelle und auslösen a Rollback-Prozess.

Zusammenfassung

In diesem Beitrag haben Sie gelernt, wie Sie SageMaker-Endpunktmodellvarianten und Bereitstellungsleitplanken mit MLOps-Funktionen kombinieren, um End-to-End-Muster für die Modellentwicklung zu erstellen. Wir haben eine Beispielimplementierung für Canary- und Linear-Shifting-Bereitstellungsleitplanken bereitgestellt, die mit SageMaker-Pipelines und der Modellregistrierung über ein benutzerdefiniertes SageMaker-Projekt verbunden sind. Versuchen Sie als nächsten Schritt, Folgendes anzupassen Vorlage um die Bereitstellungsstrategie Ihrer Organisation umzusetzen.

Bibliographie

Über die Autoren

Maira Ladeira Tanke ist ML Specialist Solutions Architect bei AWS. Mit einem Hintergrund in Data Science verfügt sie über 9 Jahre Erfahrung in der Architektur und Erstellung von ML-Anwendungen mit Kunden aus allen Branchen. Als technische Leiterin hilft sie Kunden dabei, ihre geschäftliche Wertschöpfung durch neue Technologien und innovative Lösungen zu beschleunigen. In ihrer Freizeit reist Maira gerne und verbringt Zeit mit ihrer Familie an einem warmen Ort.

Maira Ladeira Tanke ist ML Specialist Solutions Architect bei AWS. Mit einem Hintergrund in Data Science verfügt sie über 9 Jahre Erfahrung in der Architektur und Erstellung von ML-Anwendungen mit Kunden aus allen Branchen. Als technische Leiterin hilft sie Kunden dabei, ihre geschäftliche Wertschöpfung durch neue Technologien und innovative Lösungen zu beschleunigen. In ihrer Freizeit reist Maira gerne und verbringt Zeit mit ihrer Familie an einem warmen Ort.

Lehm Elmore ist AI/ML Specialist Solutions Architect bei AWS. Nachdem er viele Stunden in einem Materialforschungslabor verbracht hatte, ließ er seinen Hintergrund in Chemieingenieurwesen schnell hinter sich, um seinem Interesse am maschinellen Lernen nachzugehen. Er hat an ML-Anwendungen in vielen verschiedenen Branchen gearbeitet, vom Energiehandel bis zum Marketing im Gastgewerbe. Clay hat ein besonderes Interesse daran, Softwareentwicklungspraktiken in ML einzubringen und Kunden mithilfe dieser Prinzipien zu wiederholbaren, skalierbaren Lösungen zu führen. In seiner Freizeit fährt Clay gerne Ski, löst Rubiks Würfel, liest und kocht.

Lehm Elmore ist AI/ML Specialist Solutions Architect bei AWS. Nachdem er viele Stunden in einem Materialforschungslabor verbracht hatte, ließ er seinen Hintergrund in Chemieingenieurwesen schnell hinter sich, um seinem Interesse am maschinellen Lernen nachzugehen. Er hat an ML-Anwendungen in vielen verschiedenen Branchen gearbeitet, vom Energiehandel bis zum Marketing im Gastgewerbe. Clay hat ein besonderes Interesse daran, Softwareentwicklungspraktiken in ML einzubringen und Kunden mithilfe dieser Prinzipien zu wiederholbaren, skalierbaren Lösungen zu führen. In seiner Freizeit fährt Clay gerne Ski, löst Rubiks Würfel, liest und kocht.

Shelbee Eigenbrode ist Principal AI and Machine Learning Specialist Solutions Architect bei AWS. Sie ist seit 24 Jahren in der Technologiebranche tätig und hat verschiedene Branchen, Technologien und Rollen abgedeckt. Sie konzentriert sich derzeit darauf, ihren DevOps- und ML-Hintergrund in die Domäne von MLOps zu integrieren, um Kunden bei der Bereitstellung und Verwaltung von ML-Workloads in großem Maßstab zu unterstützen. Mit über 35 erteilten Patenten in verschiedenen Technologiebereichen hat sie eine Leidenschaft für kontinuierliche Innovation und die Nutzung von Daten zur Steigerung der Geschäftsergebnisse. Shelbee ist Mitgestalter und Ausbilder der Spezialisierung „Practical Data Science“ auf Coursera. Sie ist außerdem Co-Direktorin von Women In Big Data (WiBD), Kapitel Denver. In ihrer Freizeit verbringt sie gerne Zeit mit ihrer Familie, Freunden und überaktiven Hunden.

Shelbee Eigenbrode ist Principal AI and Machine Learning Specialist Solutions Architect bei AWS. Sie ist seit 24 Jahren in der Technologiebranche tätig und hat verschiedene Branchen, Technologien und Rollen abgedeckt. Sie konzentriert sich derzeit darauf, ihren DevOps- und ML-Hintergrund in die Domäne von MLOps zu integrieren, um Kunden bei der Bereitstellung und Verwaltung von ML-Workloads in großem Maßstab zu unterstützen. Mit über 35 erteilten Patenten in verschiedenen Technologiebereichen hat sie eine Leidenschaft für kontinuierliche Innovation und die Nutzung von Daten zur Steigerung der Geschäftsergebnisse. Shelbee ist Mitgestalter und Ausbilder der Spezialisierung „Practical Data Science“ auf Coursera. Sie ist außerdem Co-Direktorin von Women In Big Data (WiBD), Kapitel Denver. In ihrer Freizeit verbringt sie gerne Zeit mit ihrer Familie, Freunden und überaktiven Hunden.

Qiyun Zhao ist Senior Software Development Engineer im Team der Amazon SageMaker Inference Platform. Er ist der leitende Entwickler der Bereitstellungsleitlinien und Schattenbereitstellungen und konzentriert sich darauf, Kunden dabei zu helfen, ML-Workloads und -Bereitstellungen in großem Umfang mit hoher Verfügbarkeit zu verwalten. Er arbeitet auch an Plattformarchitekturentwicklungen für die schnelle und sichere Bereitstellung von ML-Jobs und die problemlose Durchführung von ML-Online-Experimenten. In seiner Freizeit liest, spielt und reist er gerne.

Qiyun Zhao ist Senior Software Development Engineer im Team der Amazon SageMaker Inference Platform. Er ist der leitende Entwickler der Bereitstellungsleitlinien und Schattenbereitstellungen und konzentriert sich darauf, Kunden dabei zu helfen, ML-Workloads und -Bereitstellungen in großem Umfang mit hoher Verfügbarkeit zu verwalten. Er arbeitet auch an Plattformarchitekturentwicklungen für die schnelle und sichere Bereitstellung von ML-Jobs und die problemlose Durchführung von ML-Online-Experimenten. In seiner Freizeit liest, spielt und reist er gerne.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/mlops-deployment-best-practices-for-real-time-inference-model-serving-endpoints-with-amazon-sagemaker/

- 100

- 2022

- 7

- 9

- a

- Fähigkeit

- Fähig

- beschleunigen

- akzeptabel

- Nach

- Konto

- Buchhaltung

- Erreichen

- Leistung

- über

- hinzugefügt

- Zusatz

- Zusätzliche

- zusätzlich

- advanced

- Vorteil

- Nach der

- gegen

- AI

- AI / ML

- Alarm

- Algorithmus

- Alle

- erlaubt

- bereits

- Amazon

- Amazon Sage Maker

- Betrag

- Analyse

- und

- Ein anderer

- Anwendung

- Anwendungen

- angewandt

- Ansatz

- Genehmigung

- genehmigen

- genehmigt

- Architektur

- um

- Aspekte

- damit verbundenen

- automatisieren

- Automatisiert

- Im Prinzip so, wie Sie es von Google Maps kennen.

- Verfügbarkeit

- verfügbar

- AWS

- Zurück

- Hintergrund

- basierend

- Grundlage

- weil

- wird

- Bevor

- hinter

- Sein

- Nutzen

- BESTE

- Best Practices

- Besser

- zwischen

- Big

- Big Data

- Blau

- Bringing

- breit

- breiteres

- gebracht

- bauen

- Building

- erbaut

- Geschäft

- Geschäftsanwendungen

- namens

- Fähigkeiten

- Häuser

- Fälle

- CD

- sicher

- Übernehmen

- Ändern

- Kapitel

- Schecks

- chemisch

- Auswahl

- wählten

- geschlossen

- Code

- kombinieren

- kombiniert

- Vereinigung

- gemeinsam

- vergleichen

- abschließen

- uneingeschränkt

- konzept

- zuversichtlich

- Konfiguration

- Sie

- Verbindung

- Geht davon

- Überlegungen

- enthalten

- Kontext

- ständig

- kontinuierlich

- ständig

- Smartgeräte App

- gesteuert

- Kosten

- Kosten

- Abdeckung

- bedeckt

- erstellen

- Strom

- Zur Zeit

- Original

- Kunden

- maßgeschneiderte

- technische Daten

- Datenverarbeitung

- Datenwissenschaft

- Dezember

- Decision Making

- Standard

- definiert

- Definition

- Übergeben

- Lieferanten

- Demand

- zeigt

- Denver

- Abhängig

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- Implementierungen

- beschrieben

- erkannt

- Bestimmen

- entwickelt

- Entwickler:in / Unternehmen

- Entwicklung

- anders

- Direkt

- entdeckt

- diskutieren

- diskutiert

- verteilt

- verteilen

- Verteilung

- Tut nicht

- Domain

- Domains

- Nicht

- Nachteil

- Ausfallzeit

- Antrieb

- im

- jeder

- einfacher

- leicht

- Wirksamkeit

- entweder

- aufstrebenden

- ermöglichen

- End-to-End

- Endpunkt

- Energie

- Ingenieur

- Entwicklung

- genug

- gewährleisten

- sorgt

- Gewährleistung

- Arbeitsumfeld

- essential

- bewerten

- Bewerten

- Evolutionen

- Beispiel

- vorhandenen

- existiert

- erwartet

- ERFAHRUNGEN

- ERKUNDEN

- ausgesetzt

- Familie

- FAST

- Eigenschaften

- Feedback

- Abbildung

- Vorname

- erstes Mal

- FLOTTE

- konzentriert

- Fokussierung

- Folgende

- folgt

- Foundations

- Unser Ansatz

- Frei

- Freunde

- für

- voller

- Funktionalität

- Funktionen

- weiter

- Gaming

- Lücke

- Sammlung

- Allgemeines

- bekommen

- ABSICHT

- gegeben

- allmählich

- erteilt

- Grün

- Gruppe an

- Griff

- Griffe

- Hilfe

- Unternehmen

- hilft

- hier

- GUTE

- Gastgewerbe

- Hosting

- STUNDEN

- Ultraschall

- Hilfe

- aber

- HTML

- HTTPS

- Impact der HXNUMXO Observatorien

- implementieren

- Implementierung

- umgesetzt

- Umsetzung

- Verbesserung

- in

- das

- Dazu gehören

- Einschließlich

- Incorporated

- hat

- Steigert

- zunehmend

- Branchen

- Information

- Infrastruktur

- Innovation

- innovativ

- Instanz

- beantragen müssen

- integrieren

- Integration

- Integration

- Interesse

- Einleitung

- Isolierung

- Problem

- Probleme

- IT

- Job

- Jobs

- Behalten

- Wesentliche

- Labor

- Nachname

- Latency

- ins Leben gerufen

- führen

- gelernt

- lernen

- Niveau

- Lebenszyklus

- Gelistet

- leben

- länger

- Sneaker

- Maschine

- Maschinelles Lernen

- halten

- verwalten

- Management

- flächendeckende Gesundheitsprogramme

- manuell

- viele

- Mapping

- Markt

- Marketing

- Materialien

- Maximieren

- sinnvoll

- Mechanismus

- erwähnt

- Metadaten

- Methoden

- Metrisch

- Metrik

- könnte

- minimieren

- ML

- MLOps

- Model

- Modell

- Modelltests

- für

- Überwachen

- überwacht

- Überwachung

- Monitore

- mehr

- vor allem warme

- mehrere

- Natur

- notwendig,

- Need

- Neu

- weiter

- Angebote

- EINEM

- Online

- Betriebs-

- Einkauf & Prozesse

- optimal

- Option

- Optionen

- Auftrag

- Organisation

- Andere

- Ergebnis

- skizzierte

- Paket

- Parallel

- Parameter

- Teil

- leitet

- Leidenschaft & KREATIVITÄT

- Patente

- Schnittmuster

- Muster

- Ausführen

- Leistung

- führt

- Zeit

- ein Bild

- Pipeline

- Ort

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- möglich

- Post

- Praktisch

- Praktiken

- Präzision

- Prognose

- Prognosen

- Danach

- Gegenwart

- früher

- vorher

- Principal

- Grundsätze

- Aufgabenstellung:

- Prozessdefinierung

- Verarbeitung

- Produziert

- Produktion

- Projekt

- Projekte

- vorgeschlage

- Risiken zu minimieren

- die

- vorausgesetzt

- bietet

- Zweck

- setzen

- Qualität

- schnell

- Angebot

- Bereich

- Lesebrillen

- bereit

- echt

- Echtzeit

- erhält

- Empfang

- empfohlen

- Region

- eingetragen

- Registratur

- regulär

- Release

- relevant

- Zuverlässigkeit

- zuverlässig

- wiederholbar

- ersetzt

- Anforderung

- Zugriffe

- Forschungsprojekte

- Ressourcen

- Antwort

- Rückkehr

- wiederverwendbar

- Risiko

- Risiken

- Rollen

- Rollen

- Wenden

- Führen Sie

- Laufen

- sagemaker

- SageMaker-Inferenz

- SageMaker-Pipelines

- gleich

- zufrieden

- zufrieden

- Skalierbarkeit

- skalierbaren

- Skalieren

- Szenario

- Szenarien

- Wissenschaft

- Verbindung

- ausgewählt

- Sendung

- Senior

- getrennte

- dient

- Dienst

- kompensieren

- Einstellungen

- Setup

- mehrere

- Shadow

- Schattentests

- verschieben

- VERSCHIEBUNG

- sollte

- Konzerte

- Bedeutung

- ähnlich

- Ähnlich

- Single

- Umstände

- klein

- kleinere

- So

- Software

- Software-Entwicklung

- Lösung

- Lösungen

- LÖSEN

- Auflösung

- besondere

- Spezialist

- spezifisch

- verbringen

- Ausgabe

- begonnen

- beginnt

- statistisch

- Status

- Schritt

- Shritte

- Immer noch

- gelagert

- Strategien

- Strategie

- eingereicht

- so

- Support

- Schalter

- Systeme und Techniken

- Nehmen

- nimmt

- Target

- Team

- Technische

- Technologies

- Technologie

- Vorlagen

- Test

- Testen

- Tests

- Das

- ihr

- Durch

- Durchsatz

- KRAWATTE

- Zeit

- zu

- Werkzeuge

- gegenüber

- Rückverfolgbarkeit

- verfolgen sind

- Trading

- traditionell

- der Verkehr

- Training

- trainiert

- Ausbildung

- transparent

- Reise

- auslösen

- ausgelöst

- Typen

- typisch

- verstehen

- einzigartiges

- Einheit

- Aktualisierung

- aktualisiert

- Updates

- Aktualisierung

- -

- Anwendungsfall

- Nutzer

- Nutzen

- BESTÄTIGEN

- validiert

- Bestätigung

- Wert

- Variante

- verschiedene

- Version

- lebensfähig

- warm

- Gewicht

- Was

- Was ist

- welche

- während

- werden wir

- .

- Damen

- gearbeitet

- Workflows

- Werk

- würde

- Schreiben

- Jahr

- Du

- Ihr

- Zephyrnet