ZOO Digital bietet End-to-End-Lokalisierungs- und Mediendienste zur Anpassung von Original-TV- und Filminhalten an verschiedene Sprachen, Regionen und Kulturen. Es erleichtert den weltbesten Content-Erstellern die Globalisierung. ZOO Digital genießt das Vertrauen der größten Namen der Unterhaltungsbranche und bietet hochwertige Lokalisierungs- und Mediendienste in großem Maßstab, einschließlich Synchronisation, Untertitelung, Skripterstellung und Compliance.

Typische Lokalisierungsworkflows erfordern eine manuelle Sprecherdialogisierung, wobei ein Audiostream basierend auf der Identität des Sprechers segmentiert wird. Dieser zeitaufwändige Prozess muss abgeschlossen sein, bevor Inhalte in eine andere Sprache synchronisiert werden können. Bei manuellen Methoden kann die Lokalisierung einer 30-minütigen Episode zwischen 1 und 3 Stunden dauern. Durch Automatisierung strebt ZOO Digital eine Lokalisierung in weniger als 30 Minuten an.

In diesem Beitrag diskutieren wir den Einsatz skalierbarer Modelle für maschinelles Lernen (ML) zur Tagebucherstellung von Medieninhalten Amazon Sage Maker, mit Schwerpunkt auf der WhisperX Modell.

Hintergrund

Die Vision von ZOO Digital besteht darin, eine schnellere Bereitstellung lokalisierter Inhalte zu ermöglichen. Dieses Ziel wird durch den manuell intensiven Charakter der Übung und die geringe Zahl qualifizierter Mitarbeiter, die Inhalte manuell lokalisieren können, erschwert. ZOO Digital arbeitet mit über 11,000 Freelancern zusammen und hat allein im Jahr 600 über 2022 Millionen Wörter lokalisiert. Allerdings wird das Angebot an Fachkräften durch die steigende Nachfrage nach Inhalten übertroffen, was eine Automatisierung zur Unterstützung der Lokalisierungsabläufe erfordert.

Mit dem Ziel, die Lokalisierung von Content-Workflows durch maschinelles Lernen zu beschleunigen, beauftragte ZOO Digital AWS Prototyping, ein Investitionsprogramm von AWS zur gemeinsamen Erstellung von Workloads mit Kunden. Der Schwerpunkt des Engagements lag auf der Bereitstellung einer funktionalen Lösung für den Lokalisierungsprozess und der Bereitstellung praktischer Schulungen für ZOO Digital-Entwickler zu SageMaker. Amazon Transcribe und Amazon Übersetzen.

Kundenherausforderung

Nachdem ein Titel (ein Film oder eine Episode einer Fernsehserie) transkribiert wurde, müssen jedem Sprachsegment Sprecher zugewiesen werden, damit sie korrekt den Sprechern zugeordnet werden können, die für die Wiedergabe der Charaktere besetzt sind. Dieser Vorgang wird als Sprecherdiarisierung bezeichnet. ZOO Digital steht vor der Herausforderung, Inhalte in großem Maßstab zu archivieren und gleichzeitig wirtschaftlich rentabel zu sein.

Lösungsüberblick

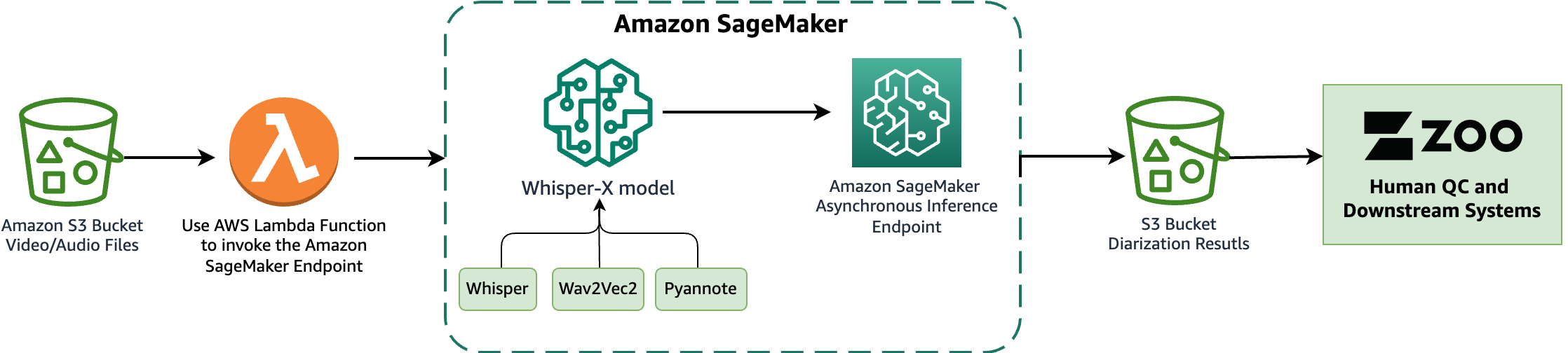

In diesem Prototyp haben wir die Originalmediendateien in einem angegebenen Speicherort gespeichert Amazon Simple Storage-Service (Amazon S3) Eimer. Dieser S3-Bucket wurde so konfiguriert, dass er ein Ereignis ausgibt, wenn darin neue Dateien erkannt werden, was ein Ereignis auslöst AWS Lambda Funktion. Anweisungen zum Konfigurieren dieses Triggers finden Sie im Tutorial Verwenden eines Amazon S3-Triggers zum Aufrufen einer Lambda-Funktion. Anschließend rief die Lambda-Funktion den SageMaker-Endpunkt zur Inferenz mithilfe von auf Boto3 SageMaker Runtime-Client.

Das WhisperX Modell, basierend auf OpenAIs Whisper, führt Transkriptionen und Tagebücher für Medienressourcen durch. Es basiert auf dem Schnelleres Flüstern Neuimplementierung, die im Vergleich zu Whisper eine bis zu viermal schnellere Transkription mit verbesserter Zeitstempelausrichtung auf Wortebene bietet. Darüber hinaus wird eine Lautsprecher-Dialogisierung eingeführt, die im ursprünglichen Whisper-Modell nicht vorhanden war. WhisperX nutzt das Whisper-Modell für Transkriptionen, das Wav2Vec2 Modell zur Verbesserung der Zeitstempelausrichtung (Gewährleistung der Synchronisierung von transkribiertem Text mit Audio-Zeitstempeln) und das Pyannote Modell für die Diarisierung. FFmpeg wird zum Laden von Audio von Quellmedien verwendet und unterstützt verschiedene Medienformate. Die transparente und modulare Modellarchitektur ermöglicht Flexibilität, da jede Komponente des Modells bei Bedarf in der Zukunft ausgetauscht werden kann. Es ist jedoch wichtig zu beachten, dass WhisperX keine vollständigen Verwaltungsfunktionen bietet und kein Produkt für Unternehmen ist. Ohne Wartung und Support ist es möglicherweise nicht für den Produktionseinsatz geeignet.

In dieser Zusammenarbeit haben wir WhisperX auf SageMaker mithilfe eines bereitgestellt und evaluiert asynchroner Inferenzendpunkt um das Modell zu hosten. Die asynchronen Endpunkte von SageMaker unterstützen Upload-Größen von bis zu 1 GB und verfügen über Funktionen zur automatischen Skalierung, die Verkehrsspitzen effizient abmildern und in Zeiten außerhalb der Spitzenzeiten Kosten sparen. Asynchrone Endpunkte eignen sich besonders gut für die Verarbeitung großer Dateien, wie in unserem Anwendungsfall Filme und Fernsehserien.

Das folgende Diagramm veranschaulicht die Kernelemente der Experimente, die wir im Rahmen dieser Zusammenarbeit durchgeführt haben.

In den folgenden Abschnitten gehen wir näher auf die Bereitstellung des WhisperX-Modells auf SageMaker ein und bewerten die Diarisierungsleistung.

Laden Sie das Modell und seine Komponenten herunter

WhisperX ist ein System, das mehrere Modelle für Transkription, erzwungene Ausrichtung und Diarisierung umfasst. Für einen reibungslosen SageMaker-Betrieb, ohne dass Modellartefakte während der Inferenz abgerufen werden müssen, ist es wichtig, alle Modellartefakte vorab herunterzuladen. Diese Artefakte werden dann während der Initiierung in den SageMaker-Bereitstellungscontainer geladen. Da auf diese Modelle nicht direkt zugegriffen werden kann, bieten wir Beschreibungen und Beispielcode aus der WhisperX-Quelle sowie Anweisungen zum Herunterladen des Modells und seiner Komponenten.

WhisperX verwendet sechs Modelle:

Die meisten dieser Modelle sind bei erhältlich Gesicht umarmen unter Verwendung der Bibliothek „huggingface_hub“. Wir verwenden Folgendes download_hf_model() Funktion zum Abrufen dieser Modellartefakte. Es ist ein Zugriffstoken von Hugging Face erforderlich, der nach Annahme der Nutzungsvereinbarungen für die folgenden Pyannote-Modelle generiert wird:

import huggingface_hub

import yaml

import torchaudio

import urllib.request

import os CONTAINER_MODEL_DIR = "/opt/ml/model"

WHISPERX_MODEL = "guillaumekln/faster-whisper-large-v2"

VAD_MODEL_URL = "https://whisperx.s3.eu-west-2.amazonaws.com/model_weights/segmentation/0b5b3216d60a2d32fc086b47ea8c67589aaeb26b7e07fcbe620d6d0b83e209ea/pytorch_model.bin"

WAV2VEC2_MODEL = "WAV2VEC2_ASR_BASE_960H"

DIARIZATION_MODEL = "pyannote/speaker-diarization" def download_hf_model(model_name: str, hf_token: str, local_model_dir: str) -> str: """ Fetches the provided model from HuggingFace and returns the subdirectory it is downloaded to :param model_name: HuggingFace model name (and an optional version, appended with @[version]) :param hf_token: HuggingFace access token authorized to access the requested model :param local_model_dir: The local directory to download the model to :return: The subdirectory within local_modeL_dir that the model is downloaded to """ model_subdir = model_name.split('@')[0] huggingface_hub.snapshot_download(model_subdir, token=hf_token, local_dir=f"{local_model_dir}/{model_subdir}", local_dir_use_symlinks=False) return model_subdir

Das VAD-Modell wird von Amazon S3 abgerufen, und das Wav2Vec2-Modell wird vom Modul Torchaudio.pipelines abgerufen. Basierend auf dem folgenden Code können wir alle Artefakte der Modelle abrufen, einschließlich der Artefakte von Hugging Face, und sie im angegebenen lokalen Modellverzeichnis speichern:

def fetch_models(hf_token: str, local_model_dir="./models"): """ Fetches all required models to run WhisperX locally without downloading models every time :param hf_token: A huggingface access token to download the models :param local_model_dir: The directory to download the models to """ # Fetch Faster Whisper's Large V2 model from HuggingFace download_hf_model(model_name=WHISPERX_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Fetch WhisperX's VAD Segmentation model from S3 vad_model_dir = "whisperx/vad" if not os.path.exists(f"{local_model_dir}/{vad_model_dir}"): os.makedirs(f"{local_model_dir}/{vad_model_dir}") urllib.request.urlretrieve(VAD_MODEL_URL, f"{local_model_dir}/{vad_model_dir}/pytorch_model.bin") # Fetch the Wav2Vec2 alignment model torchaudio.pipelines.__dict__[WAV2VEC2_MODEL].get_model(dl_kwargs={"model_dir": f"{local_model_dir}/wav2vec2/"}) # Fetch pyannote's Speaker Diarization model from HuggingFace download_hf_model(model_name=DIARIZATION_MODEL, hf_token=hf_token, local_model_dir=local_model_dir) # Read in the Speaker Diarization model config to fetch models and update with their local paths with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'r') as file: diarization_config = yaml.safe_load(file) embedding_model = diarization_config['pipeline']['params']['embedding'] embedding_model_dir = download_hf_model(model_name=embedding_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['embedding'] = f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}" segmentation_model = diarization_config['pipeline']['params']['segmentation'] segmentation_model_dir = download_hf_model(model_name=segmentation_model, hf_token=hf_token, local_model_dir=local_model_dir) diarization_config['pipeline']['params']['segmentation'] = f"{CONTAINER_MODEL_DIR}/{segmentation_model_dir}/pytorch_model.bin" with open(f"{local_model_dir}/{DIARIZATION_MODEL}/config.yaml", 'w') as file: yaml.safe_dump(diarization_config, file) # Read in the Speaker Embedding model config to update it with its local path speechbrain_hyperparams_path = f"{local_model_dir}/{embedding_model_dir}/hyperparams.yaml" with open(speechbrain_hyperparams_path, 'r') as file: speechbrain_hyperparams = file.read() speechbrain_hyperparams = speechbrain_hyperparams.replace(embedding_model_dir, f"{CONTAINER_MODEL_DIR}/{embedding_model_dir}") with open(speechbrain_hyperparams_path, 'w') as file: file.write(speechbrain_hyperparams)

Wählen Sie den entsprechenden AWS Deep Learning Container zur Bereitstellung des Modells aus

Nachdem die Modellartefakte mit dem vorherigen Beispielcode gespeichert wurden, können Sie vorgefertigte Artefakte auswählen AWS Deep Learning Container (DLCs) aus dem Folgenden GitHub Repo. Berücksichtigen Sie bei der Auswahl des Docker-Images die folgenden Einstellungen: Framework (Hugging Face), Aufgabe (Inferenz), Python-Version und Hardware (z. B. GPU). Wir empfehlen die Verwendung des folgenden Bildes: 763104351884.dkr.ecr.[REGION].amazonaws.com/huggingface-pytorch-inference:2.0.0-transformers4.28.1-gpu-py310-cu118-ubuntu20.04 Auf diesem Image sind alle notwendigen Systempakete vorinstalliert, z. B. ffmpeg. Denken Sie daran, [REGION] durch die von Ihnen verwendete AWS-Region zu ersetzen.

Erstellen Sie für andere erforderliche Python-Pakete ein requirements.txt Datei mit einer Liste der Pakete und ihrer Versionen. Diese Pakete werden installiert, wenn der AWS DLC erstellt wird. Im Folgenden sind die zusätzlichen Pakete aufgeführt, die zum Hosten des WhisperX-Modells auf SageMaker erforderlich sind:

Erstellen Sie ein Inferenzskript, um die Modelle zu laden und die Inferenz auszuführen

Als nächstes erstellen wir eine benutzerdefinierte inference.py Skript, um zu skizzieren, wie das WhisperX-Modell und seine Komponenten in den Container geladen werden und wie der Inferenzprozess ausgeführt werden soll. Das Skript enthält zwei Funktionen: model_fn und transform_fndem „Vermischten Geschmack“. Seine model_fn Die Funktion wird aufgerufen, um die Modelle von ihren jeweiligen Speicherorten zu laden. Anschließend werden diese Modelle an die übergeben transform_fn Funktion während der Inferenz, bei der Transkriptions-, Alignment- und Diarisierungsprozesse durchgeführt werden. Das Folgende ist ein Codebeispiel für inference.py:

import io

import json

import logging

import tempfile

import time import torch

import whisperx DEVICE = 'cuda' if torch.cuda.is_available() else 'cpu' def model_fn(model_dir: str) -> dict: """ Deserialize and return the models """ logging.info("Loading WhisperX model") model = whisperx.load_model(whisper_arch=f"{model_dir}/guillaumekln/faster-whisper-large-v2", device=DEVICE, language="en", compute_type="float16", vad_options={'model_fp': f"{model_dir}/whisperx/vad/pytorch_model.bin"}) logging.info("Loading alignment model") align_model, metadata = whisperx.load_align_model(language_code="en", device=DEVICE, model_name="WAV2VEC2_ASR_BASE_960H", model_dir=f"{model_dir}/wav2vec2") logging.info("Loading diarization model") diarization_model = whisperx.DiarizationPipeline(model_name=f"{model_dir}/pyannote/speaker-diarization/config.yaml", device=DEVICE) return { 'model': model, 'align_model': align_model, 'metadata': metadata, 'diarization_model': diarization_model } def transform_fn(model: dict, request_body: bytes, request_content_type: str, response_content_type="application/json") -> (str, str): """ Load in audio from the request, transcribe and diarize, and return JSON output """ # Start a timer so that we can log how long inference takes start_time = time.time() # Unpack the models whisperx_model = model['model'] align_model = model['align_model'] metadata = model['metadata'] diarization_model = model['diarization_model'] # Load the media file (the request_body as bytes) into a temporary file, then use WhisperX to load the audio from it logging.info("Loading audio") with io.BytesIO(request_body) as file: tfile = tempfile.NamedTemporaryFile(delete=False) tfile.write(file.read()) audio = whisperx.load_audio(tfile.name) # Run transcription logging.info("Transcribing audio") result = whisperx_model.transcribe(audio, batch_size=16) # Align the outputs for better timings logging.info("Aligning outputs") result = whisperx.align(result["segments"], align_model, metadata, audio, DEVICE, return_char_alignments=False) # Run diarization logging.info("Running diarization") diarize_segments = diarization_model(audio) result = whisperx.assign_word_speakers(diarize_segments, result) # Calculate the time it took to perform the transcription and diarization end_time = time.time() elapsed_time = end_time - start_time logging.info(f"Transcription and Diarization took {int(elapsed_time)} seconds") # Return the results to be stored in S3 return json.dumps(result), response_content_type

Im Verzeichnis des Modells neben dem requirements.txt Datei, stellen Sie sicher, dass vorhanden ist inference.py in einem Code-Unterverzeichnis. Der models Das Verzeichnis sollte wie folgt aussehen:

Erstellen Sie einen Tarball der Modelle

Nachdem Sie die Modelle und Codeverzeichnisse erstellt haben, können Sie die folgenden Befehlszeilen verwenden, um das Modell in einen Tarball (.tar.gz-Datei) zu komprimieren und es auf Amazon S3 hochzuladen. Zum Zeitpunkt des Verfassens dieses Artikels ist der resultierende Tarball, der das SageMaker-Modell darstellt, bei Verwendung des Faster-Whisper-Large-V2-Modells 3 GB groß. Weitere Informationen finden Sie unter Modellieren von Hosting-Mustern in Amazon SageMaker, Teil 2: Erste Schritte mit der Bereitstellung von Echtzeitmodellen auf SageMaker.

Erstellen Sie ein SageMaker-Modell und stellen Sie einen Endpunkt mit einem asynchronen Prädiktor bereit

Jetzt können Sie das SageMaker-Modell, die Endpunktkonfiguration und den asynchronen Endpunkt mit erstellen AsyncPredictor Verwenden des im vorherigen Schritt erstellten Modell-Tarballs. Anweisungen finden Sie unter Erstellen eines asynchronen Inferenzendpunkts.

Bewerten Sie die Diarisierungsleistung

Um die Diarisierungsleistung des WhisperX-Modells in verschiedenen Szenarien zu bewerten, haben wir jeweils drei Episoden aus zwei englischen Titeln ausgewählt: einen Dramatitel, der aus 30-minütigen Episoden besteht, und einen Dokumentarfilmtitel, der aus 45-minütigen Episoden besteht. Wir haben das Metrik-Toolkit von Pyannote verwendet. pyannote.metrics, um die zu berechnen Diarisierungsfehlerrate (DER). Bei der Auswertung dienten von ZOO bereitgestellte manuell transkribierte und tagebuchgeführte Transkripte als Grundwahrheit.

Wir haben den DER wie folgt definiert:

Gesamt ist die Länge des Ground-Truth-Videos. FA (Falscher Alarm) ist die Länge von Segmenten, die in Vorhersagen als Sprache betrachtet werden, in der Grundwahrheit jedoch nicht. Verpassen ist die Länge der Segmente, die in der Grundwahrheit als Sprache betrachtet werden, in der Vorhersage jedoch nicht. Fehler, auch genannt Verwechslungist die Länge von Segmenten, die verschiedenen Sprechern in der Vorhersage und der Grundwahrheit zugewiesen werden. Alle Einheiten werden in Sekunden gemessen. Die typischen Werte für DER können je nach spezifischer Anwendung, Datensatz und Qualität des Diarisierungssystems variieren. Beachten Sie, dass DER größer als 1.0 sein kann. Ein niedrigerer DER ist besser.

Um den DER für ein Medium berechnen zu können, ist eine Ground-Truth-Diarisierung sowie die von WhisperX transkribierten und diarisierten Ausgaben erforderlich. Diese müssen analysiert werden und führen zu Listen von Tupeln, die eine Sprecherbezeichnung, die Startzeit des Sprachsegments und die Endzeit des Sprachsegments für jedes Sprachsegment in den Medien enthalten. Die Sprecherbezeichnungen zwischen den WhisperX- und Ground-Truth-Tagebüchern müssen nicht übereinstimmen. Die Ergebnisse basieren hauptsächlich auf der Zeit der Segmente. pyannote.metrics verwendet diese Tupel von Ground-Truth-Diarisierungen und Ausgabe-Diarisierungen (in der pyannote.metrics-Dokumentation als bezeichnet). Referenz und Hypothese), um den DER zu berechnen. Die folgende Tabelle fasst unsere Ergebnisse zusammen.

| Video Type | DER | In Ordnung | Verpassen | Fehler | Falscher Alarm |

| Drama | 0.738 | 44.80% | 21.80% | 33.30% | 18.70% |

| Dokumentarfilm | 1.29 | 94.50% | 5.30% | 0.20% | 123.40% |

| Durchschnittlich | 0.901 | 71.40% | 13.50% | 15.10% | 61.50% |

Diese Ergebnisse zeigen einen erheblichen Leistungsunterschied zwischen den Drama- und Dokumentarfilmtiteln, wobei das Modell für die Drama-Episoden deutlich bessere Ergebnisse erzielte (unter Verwendung von DER als aggregierter Metrik) als für den Dokumentarfilmtitel. Eine genauere Analyse der Titel liefert Einblicke in mögliche Faktoren, die zu dieser Leistungslücke beitragen. Ein Schlüsselfaktor könnte das häufige Vorhandensein von Hintergrundmusik sein, die sich mit der Sprache im Titel des Dokumentarfilms überschneidet. Obwohl die Vorverarbeitung von Medien zur Verbesserung der Diarisierungsgenauigkeit, wie z. B. das Entfernen von Hintergrundgeräuschen zur Isolierung von Sprache, den Rahmen dieses Prototyps sprengte, eröffnet es Möglichkeiten für zukünftige Arbeiten, die möglicherweise die Leistung von WhisperX verbessern könnten.

Zusammenfassung

In diesem Beitrag haben wir die Kooperationspartnerschaft zwischen AWS und ZOO Digital untersucht und maschinelle Lerntechniken mit SageMaker und dem WhisperX-Modell eingesetzt, um den Diarisierungsworkflow zu verbessern. Das AWS-Team spielte eine entscheidende Rolle bei der Unterstützung von ZOO beim Prototyping, der Bewertung und dem Verständnis der effektiven Bereitstellung benutzerdefinierter ML-Modelle, die speziell für die Diarisierung entwickelt wurden. Dazu gehörte die Integration der automatischen Skalierung zur Skalierbarkeit mithilfe von SageMaker.

Die Nutzung von KI für die Diarisierung wird zu erheblichen Kosten- und Zeiteinsparungen bei der Generierung lokalisierter Inhalte für ZOO führen. Indem diese Technologie Transkriptoren bei der schnellen und präzisen Erstellung und Identifizierung von Sprechern unterstützt, begegnet sie dem traditionell zeitaufwändigen und fehleranfälligen Charakter dieser Aufgabe. Der herkömmliche Prozess umfasst häufig mehrere Durchläufe des Videos und zusätzliche Schritte zur Qualitätskontrolle, um Fehler zu minimieren. Der Einsatz von KI für die Diarisierung ermöglicht einen gezielteren und effizienteren Ansatz und steigert dadurch die Produktivität in kürzerer Zeit.

Wir haben die wichtigsten Schritte zur Bereitstellung des WhisperX-Modells auf dem asynchronen SageMaker-Endpunkt beschrieben und empfehlen Ihnen, es selbst mit dem bereitgestellten Code auszuprobieren. Weitere Einblicke in die Dienste und Technologie von ZOO Digital finden Sie unter Offizielle Website von ZOO Digital. Einzelheiten zur Bereitstellung des OpenAI Whisper-Modells auf SageMaker und zu verschiedenen Inferenzoptionen finden Sie unter Hosten Sie das Whisper-Modell auf Amazon SageMaker: Entdecken Sie Inferenzoptionen. Teilen Sie Ihre Gedanken gerne in den Kommentaren mit.

Über die Autoren

Ying Hou, PhD, ist ein Prototyping-Architekt für maschinelles Lernen bei AWS. Ihre Hauptinteressengebiete umfassen Deep Learning mit einem Schwerpunkt auf GenAI, Computer Vision, NLP und Zeitreihendatenvorhersage. In ihrer Freizeit verbringt sie gerne schöne Momente mit ihrer Familie, vertieft sich in Romane und wandert in den Nationalparks Großbritanniens.

Ying Hou, PhD, ist ein Prototyping-Architekt für maschinelles Lernen bei AWS. Ihre Hauptinteressengebiete umfassen Deep Learning mit einem Schwerpunkt auf GenAI, Computer Vision, NLP und Zeitreihendatenvorhersage. In ihrer Freizeit verbringt sie gerne schöne Momente mit ihrer Familie, vertieft sich in Romane und wandert in den Nationalparks Großbritanniens.

Ethan Cumberland ist KI-Forschungsingenieur bei ZOO Digital, wo er an der Nutzung von KI und maschinellem Lernen als unterstützende Technologien arbeitet, um Arbeitsabläufe in den Bereichen Sprache, Sprache und Lokalisierung zu verbessern. Er verfügt über einen Hintergrund in Softwareentwicklung und Forschung im Sicherheits- und Polizeibereich, wobei sein Schwerpunkt auf der Extraktion strukturierter Informationen aus dem Web und der Nutzung von Open-Source-ML-Modellen zur Analyse und Anreicherung gesammelter Daten liegt.

Ethan Cumberland ist KI-Forschungsingenieur bei ZOO Digital, wo er an der Nutzung von KI und maschinellem Lernen als unterstützende Technologien arbeitet, um Arbeitsabläufe in den Bereichen Sprache, Sprache und Lokalisierung zu verbessern. Er verfügt über einen Hintergrund in Softwareentwicklung und Forschung im Sicherheits- und Polizeibereich, wobei sein Schwerpunkt auf der Extraktion strukturierter Informationen aus dem Web und der Nutzung von Open-Source-ML-Modellen zur Analyse und Anreicherung gesammelter Daten liegt.

Gaurav Kaila leitet das AWS Prototyping-Team für Großbritannien und Irland. Sein Team arbeitet mit Kunden aus verschiedenen Branchen zusammen, um geschäftskritische Workloads zu entwickeln und gemeinsam zu entwickeln, mit dem Auftrag, die Einführung von AWS-Services zu beschleunigen.

Gaurav Kaila leitet das AWS Prototyping-Team für Großbritannien und Irland. Sein Team arbeitet mit Kunden aus verschiedenen Branchen zusammen, um geschäftskritische Workloads zu entwickeln und gemeinsam zu entwickeln, mit dem Auftrag, die Einführung von AWS-Services zu beschleunigen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/streamline-diarization-using-ai-as-an-assistive-technology-zoo-digitals-story/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 000

- 1

- 10

- 100

- 11

- 140

- 2022

- 220

- 28

- 30

- 350

- 600

- 7

- 8

- a

- Fähig

- beschleunigen

- akzeptieren

- Zugang

- zugänglich

- Genauigkeit

- Erreichen

- Erreichen

- über

- automatisch

- Zusätzliche

- zusätzlich

- Adressen

- Adoption

- Nach der

- Aggregat

- Vereinbarungen

- AI

- ai Forschung

- Ziel

- Ziel

- Alarm

- ausrichten

- ausrichten

- Ausrichtung

- Alle

- erlaubt

- allein

- neben

- ebenfalls

- Obwohl

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- Analysieren

- Analyse

- und

- Ein anderer

- Anwendung

- Ansatz

- angemessen

- Architektur

- SIND

- Bereiche

- Künstler

- AS

- beurteilen

- Details

- zugewiesen

- helfen

- Unterstützung

- At

- Audio-

- zugelassen

- Auto

- Automation

- Alleen

- AWS

- Hintergrund

- basierend

- BE

- weil

- war

- Bevor

- Sein

- BESTE

- Besser

- zwischen

- Beyond

- Größte

- BIN

- beide

- erbaut

- Geschäft

- aber

- by

- Berechnen

- namens

- CAN

- Häuser

- challenges

- Zeichen

- Auswählen

- näher

- Code

- Zusammenarbeit

- kollaborative

- Bemerkungen

- verglichen

- Abgeschlossene Verkäufe

- Compliance

- Komponente

- Komponenten

- compoundiert

- Computer

- Computer Vision

- durchgeführt

- konfiguriert

- konfigurieren

- Geht davon

- betrachtet

- Bestehend

- Container

- enthält

- Inhalt

- Inhaltsentwickler

- Beitrag

- Smartgeräte App

- konventionellen

- Kernbereich

- korrekt

- Kosten

- Kosten

- könnte

- erstellen

- erstellt

- Erstellen

- Schöpfer

- kritischem

- Kulturen

- Original

- Kunden

- technische Daten

- tief

- tiefe Lernen

- definiert

- liefern

- liefert

- vertiefen

- Demand

- Abhängig

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- entworfen

- Details

- erkannt

- Entwickler

- Gerät

- Diagramm

- DICT

- Unterschied

- anders

- digital

- Digitals

- Direkt

- Verzeichnisse

- Verzeichnis

- diskutieren

- verschieden

- Docker

- Dokumentarfilm

- Dokumentation

- Domain

- Nicht

- herunterladen

- Herunterladen

- Drama

- synchronisiert

- im

- jeder

- einfacher

- Effektiv

- effizient

- effizient

- Elemente

- sonst

- Einbettung

- anstellen

- ermöglicht

- umfassen

- ermutigen

- Ende

- End-to-End

- Endpunkt

- beschäftigt

- Engagement

- Ingenieur

- Entwicklung

- Englisch

- zu steigern,

- bereichernd

- gewährleisten

- Gewährleistung

- Unternehmensebene

- Unterhaltung

- Folge anschauen

- Fehler

- Fehler

- essential

- bewerten

- Bewerten

- Auswerten

- Auswertung

- Event

- Jedes

- Beispiel

- Training

- Experimente

- Erkundet

- Möglichkeiten sondieren

- Gesicht

- Gesichter

- Faktor

- Faktoren

- falsch

- Familie

- beschleunigt

- Eigenschaften

- fühlen

- Abgerufen

- Reichen Sie das

- Mappen

- Flexibilität

- Setzen Sie mit Achtsamkeit

- konzentriert

- Fokussierung

- Folgende

- folgt

- Aussichten für

- gezwungen

- vier

- Unser Ansatz

- Frei

- häufig

- für

- voller

- Funktion

- funktional

- Funktionen

- weiter

- Zukunft

- Lücke

- Genai

- erzeugt

- Erzeugung

- bekommen

- GitHub

- Globalisierung

- Kundenziele

- GPU

- Boden

- praktische

- Hardware

- he

- hier (auf dänisch)

- hochwertige

- seine

- Gastgeber

- Hosting

- STUNDEN

- Ultraschall

- aber

- HTML

- http

- HTTPS

- Umarmendes Gesicht

- Identifizierung

- Identitätsschutz

- if

- zeigt

- Image

- importieren

- zu unterstützen,

- verbessert

- in

- inklusive

- Dazu gehören

- Einschließlich

- integrieren

- einarbeiten

- zunehmend

- Branchen

- Information

- Einleitung

- Einblicke

- installiert

- Anleitung

- Interesse

- in

- Stellt vor

- Investition

- aufgerufen

- beinhaltet

- Irland

- IT

- SEINE

- jpg

- JSON

- Wesentliche

- Schlüssel Faktor

- Label

- Etiketten

- Sprache

- Sprachen

- grosse

- größer

- führen

- umwandeln

- lernen

- Länge

- Nutzung

- Bibliothek

- Linien

- Liste

- Listen

- Belastung

- Laden

- aus einer regionalen

- Lokalisierung

- örtlich

- Standorte

- Log

- Protokollierung

- Lang

- senken

- Maschine

- Maschinelles Lernen

- Wartung

- MACHT

- Management

- Mandat

- manuell

- manuell

- Spiel

- Kann..

- Medien

- Metadaten

- Methoden

- Metrisch

- Metrik

- Million

- minimieren

- Minuten

- Mildern

- ML

- Modell

- für

- modulare

- Modul

- Moments

- mehr

- meist

- Film

- Filme

- mehrere

- Musik

- sollen

- Name

- Namen

- National

- Natur

- notwendig,

- Need

- erforderlich

- Neu

- Nlp

- Lärm

- vor allem

- beachten

- erhalten

- of

- bieten

- bieten

- offiziell

- vorgenommen,

- on

- EINEM

- Open-Source-

- OpenAI

- öffnet

- Betrieb

- Optionen

- or

- Original

- OS

- Andere

- UNSERE

- skizzieren

- skizzierte

- Möglichkeiten für das Ausgangssignal:

- Ausgänge

- übrig

- Pakete

- Teil

- besonders

- Partnerschaft

- Bestanden

- leitet

- Weg

- Pfade

- Muster

- Personen

- Ausführen

- Leistung

- durchgeführt

- führt

- Stück

- Pipeline

- zentrale

- Plato

- Datenintelligenz von Plato

- PlatoData

- Play

- gespielt

- Polizeiarbeit

- Post

- Potenzial

- möglicherweise

- vor

- genau

- Prognose

- Prognosen

- Präsenz

- Gegenwart

- früher

- primär

- Prozessdefinierung

- anpassen

- Verarbeitung

- Produkt

- Produktion

- PRODUKTIVITÄT

- Programm

- Prototyp

- Prototyping

- die

- vorausgesetzt

- bietet

- Bereitstellung

- Python

- Qualität

- R

- Bewerten

- Lesen Sie mehr

- echt

- Echtzeit

- empfehlen

- siehe

- bezeichnet

- Region

- Regionen

- merken

- Entfernen

- ersetzen

- Darstellen

- Anforderung

- erfordern

- falls angefordert

- Voraussetzungen:

- Forschungsprojekte

- diejenigen

- Folge

- was zu

- Die Ergebnisse

- Rückkehr

- Rückgabe

- zeigen

- Rollen

- Führen Sie

- Laufen

- Laufzeit

- s

- sagemaker

- Sample

- Speichern

- Gerettet

- Ersparnisse

- Skalierbarkeit

- skalierbaren

- Skalieren

- Skalierung

- Szenarien

- Umfang

- Skript

- Sekunden

- Abschnitte

- Sicherheitdienst

- Segment

- Segmentierung

- Segmente

- ausgewählt

- Auswahl

- Modellreihe

- serviert

- Lösungen

- Dienst

- Einstellungen

- Teilen

- sie

- sollte

- signifikant

- Einfacher

- SIX

- Größe

- Größen

- erfahren

- klein

- glätten

- So

- Software

- Softwareentwicklung

- Lösung

- Quelle

- Speaker

- Lautsprecher

- spezifisch

- speziell

- angegeben

- Rede

- Ausgabe

- Spikes

- Anfang

- begonnen

- Schritt

- Shritte

- Lagerung

- gelagert

- Geschichte

- Strom

- rationalisieren

- strukturierte

- Anschließend

- wesentlich

- so

- geeignet

- liefern

- Support

- Unterstützung

- getauscht

- schnell

- Synchronisation

- System

- Tabelle

- Nehmen

- nimmt

- gezielt

- Aufgabe

- Team

- Techniken

- Technologies

- Technologie

- vorübergehend

- Text

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Zukunft

- Großbritannien

- ihr

- Sie

- dann

- damit

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- diejenigen

- nach drei

- Durch

- Zeit

- Zeitfolgen

- Zeitaufwendig

- Zeitplan

- mal

- Zeitstempel

- Timings

- Titel

- Titel

- zu

- Zeichen

- nahm

- Toolkit

- Fackel

- traditionell

- der Verkehr

- Ausbildung

- transparent

- auslösen

- Auslösen

- vertraut

- Wahrheit

- versuchen

- Lernprogramm

- tv

- XNUMX

- typisch

- Uk

- für

- während 30

- Verständnis

- Bereiche

- Aktualisierung

- auf

- -

- Anwendungsfall

- benutzt

- Mitglied

- verwendet

- Verwendung von

- seit

- die

- Werte

- verschiedene

- variieren

- Version

- Versionen

- lebensfähig

- Video

- Seh-

- Besuchen Sie

- Stimme

- W

- wurde

- we

- Netz

- Web-Services

- GUT

- wann

- während

- Flüstern

- werden wir

- mit

- .

- ohne

- Worte

- Arbeiten

- Arbeitsablauf.

- Workflows

- Belegschaft

- Werk

- weltweit

- Schreiben

- YAML

- Du

- Ihr

- sich selbst

- Zephyrnet

- ZOO