Kunden sind mit zunehmenden Sicherheitsbedrohungen und Schwachstellen in allen Infrastruktur- und Anwendungsressourcen konfrontiert, da ihr digitaler Fußabdruck zunimmt und die geschäftlichen Auswirkungen dieser digitalen Assets zugenommen haben. Eine häufige Herausforderung für die Cybersicherheit besteht aus zwei Gründen:

- Nutzung von Protokollen aus digitalen Ressourcen, die in verschiedenen Formaten und Schemata vorliegen, und Automatisierung der Analyse von Bedrohungsergebnissen auf der Grundlage dieser Protokolle.

- Unabhängig davon, ob Protokolle von Amazon Web Services (AWS), anderen Cloud-Anbietern, lokalen oder Edge-Geräten stammen, müssen Kunden Sicherheitsdaten zentralisieren und standardisieren.

Darüber hinaus müssen die Analysen zur Identifizierung von Sicherheitsbedrohungen skalierbar und weiterentwickelt werden können, um einer sich verändernden Landschaft von Bedrohungsakteuren, Sicherheitsvektoren und digitalen Assets gerecht zu werden.

Ein neuartiger Ansatz zur Lösung dieses komplexen Sicherheitsanalyseszenarios kombiniert die Erfassung und Speicherung von Sicherheitsdaten mithilfe von Amazon Security Lake und Analysieren der Sicherheitsdaten mit maschinellem Lernen (ML). Amazon Sage Maker. Amazon Security Lake ist ein speziell entwickelter Dienst, der die Sicherheitsdaten einer Organisation aus Cloud- und lokalen Quellen automatisch in einem speziell entwickelten Data Lake zentralisiert, der in Ihrem AWS-Konto gespeichert ist. Amazon Security Lake automatisiert die zentrale Verwaltung von Sicherheitsdaten, normalisiert Protokolle von integrierten AWS-Diensten und Diensten von Drittanbietern, verwaltet den Lebenszyklus von Daten mit anpassbarer Aufbewahrung und automatisiert auch das Speicher-Tiering. Amazon Security Lake erfasst Protokolldateien im Öffnen Sie das Schema-Framework für Cybersicherheit (OCSF)-Format mit Unterstützung für Partner wie Cisco Security, CrowdStrike, Palo Alto Networks und OCSF-Protokolle von Ressourcen außerhalb Ihrer AWS-Umgebung. Dieses einheitliche Schema optimiert die nachgelagerte Nutzung und Analyse, da die Daten einem standardisierten Schema folgen und neue Quellen mit minimalen Änderungen an der Datenpipeline hinzugefügt werden können. Nachdem die Sicherheitsprotokolldaten in Amazon Security Lake gespeichert wurden, stellt sich die Frage, wie sie analysiert werden sollen. Ein effektiver Ansatz zur Analyse der Sicherheitsprotokolldaten ist die Verwendung von ML; Insbesondere die Anomalieerkennung, bei der Aktivitäts- und Verkehrsdaten untersucht und mit einer Basislinie verglichen werden. Die Basislinie definiert, welche Aktivität für diese Umgebung statistisch normal ist. Die Erkennung von Anomalien geht über eine einzelne Ereignissignatur hinaus und kann durch regelmäßiges Umschulen weiterentwickelt werden. Auf den als anormal oder anomal eingestuften Verkehr kann dann mit priorisierter Konzentration und Dringlichkeit reagiert werden. Amazon SageMaker ist ein vollständig verwalteter Service, der es Kunden ermöglicht, Daten vorzubereiten und ML-Modelle für jeden Anwendungsfall mit vollständig verwalteter Infrastruktur, Tools und Workflows zu erstellen, zu trainieren und bereitzustellen, einschließlich No-Code-Angeboten für Geschäftsanalysten. SageMaker unterstützt zwei integrierte Anomalieerkennungsalgorithmen: IP-Einblicke machen Zufällig geschnittener Wald. Sie können SageMaker auch verwenden, um Ihr eigenes benutzerdefiniertes Modell zur Erkennung von Ausreißern zu erstellen Algorithmen stammen aus mehreren ML-Frameworks.

In diesem Beitrag erfahren Sie, wie Sie Daten aus Amazon Security Lake vorbereiten und anschließend ein ML-Modell mithilfe eines IP Insights-Algorithmus in SageMaker trainieren und bereitstellen. Dieses Modell identifiziert anormalen Netzwerkverkehr oder -verhalten, das dann als Teil einer größeren End-to-End-Sicherheitslösung zusammengestellt werden kann. Eine solche Lösung könnte eine Multi-Faktor-Authentifizierung (MFA)-Prüfung durchführen, wenn sich ein Benutzer von einem ungewöhnlichen Server oder zu einem ungewöhnlichen Zeitpunkt anmeldet, das Personal benachrichtigen, wenn ein verdächtiger Netzwerkscan von neuen IP-Adressen ausgeht, und Administratoren benachrichtigen, wenn das Netzwerk ungewöhnlich ist Protokolle oder Ports verwendet werden oder das IP-Insights-Klassifizierungsergebnis mit anderen Datenquellen anreichern, z Amazon-Wachdienst und IP-Reputationswerte zur Einstufung von Bedrohungsergebnissen.

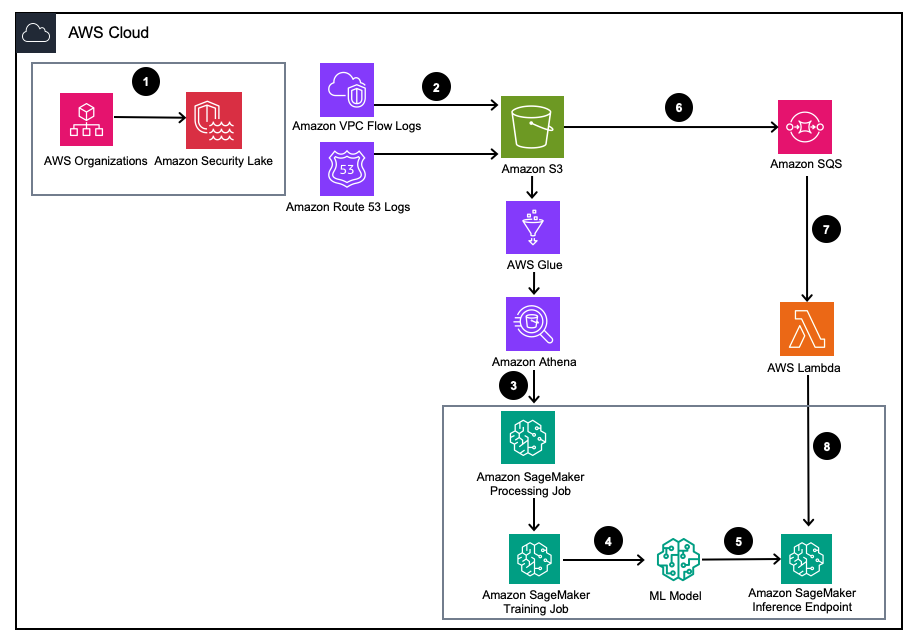

Lösungsüberblick

Abbildung 1 – Lösungsarchitektur

- Aktivieren Sie Amazon Security Lake mit AWS-Organisationen für AWS-Konten, AWS-Regionen und externe IT-Umgebungen.

- Richten Sie Security Lake-Quellen ein von Amazon Virtual Private Cloud (Amazon-VPC) Flussprotokolle und Amazon Route53 DNS-Protokolle im Amazon Security Lake S3-Bucket.

- Verarbeiten Sie Amazon Security Lake-Protokolldaten mithilfe eines SageMaker-Verarbeitungsauftrags, um Funktionen zu entwickeln. Verwenden Amazonas Athena um strukturierte OCSF-Protokolldaten abzufragen Einfacher Amazon-Speicherdienst (Amazon S3) bis AWS-Kleber Von AWS LakeFormation verwaltete Tabellen.

- Trainieren Sie ein SageMaker ML-Modell mithilfe eines SageMaker-Trainingsauftrags, der die verarbeiteten Amazon Security Lake-Protokolle nutzt.

- Stellen Sie das trainierte ML-Modell auf einem SageMaker-Inferenzendpunkt bereit.

- Speichern Sie neue Sicherheitsprotokolle in einem S3-Bucket und stellen Sie Ereignisse in eine Warteschlange Amazon Simple Queue Service (Amazon SQS).

- Abonnieren Sie eine AWS Lambda Funktion in die SQS-Warteschlange einfügen.

- Rufen Sie den SageMaker-Inferenzendpunkt mithilfe einer Lambda-Funktion auf, um Sicherheitsprotokolle in Echtzeit als Anomalien zu klassifizieren.

Voraussetzungen:

Um die Lösung bereitzustellen, müssen Sie zunächst die folgenden Voraussetzungen erfüllen:

- Aktivieren Sie Amazon Security Lake innerhalb Ihrer Organisation oder ein einzelnes Konto mit aktivierten VPC-Flussprotokollen und Route 53-Resolver-Protokollen.

- Stellen Sie sicher, dass die AWS Identitäts- und Zugriffsverwaltung (IAM) Der Rolle, die SageMaker bei der Verarbeitung von Aufträgen und Notizbüchern verwendet, wurde eine IAM-Richtlinie einschließlich der zugewiesen Abfragezugriffsberechtigung für Amazon Security Lake-Abonnenten für die verwaltete Amazon Security Lake-Datenbank und die von AWS Lake Formation verwalteten Tabellen. Dieser Verarbeitungsauftrag sollte aus Gründen der Compliance über ein Analyse- oder Sicherheitstool-Konto ausgeführt werden AWS-Sicherheitsreferenzarchitektur (AWS SRA).

- Stellen Sie sicher, dass der von der Lambda-Funktion verwendeten IAM-Rolle eine IAM-Richtlinie einschließlich gewährt wurde Zugriffsberechtigung für Amazon Security Lake-Abonnentendaten.

Stellen Sie die Lösung bereit

Führen Sie die folgenden Schritte aus, um die Umgebung einzurichten:

- Etwas starten SageMaker-Studio oder SageMaker Jupyter-Notebook mit einem

ml.m5.largeBeispiel. Hinweis: Die Instanzgröße hängt von den von Ihnen verwendeten Datensätzen ab. - Klonen Sie den GitHub Quelle.

- Öffnen Sie das Notizbuch

01_ipinsights/01-01.amazon-securitylake-sagemaker-ipinsights.ipy. - Implementieren Sie die bereitgestellte IAM-Richtlinie machen entsprechende IAM-Vertrauensrichtlinie Damit Ihre SageMaker Studio Notebook-Instanz auf alle erforderlichen Daten in S3, Lake Formation und Athena zugreifen kann.

Dieser Blog geht durch den relevanten Teil des Codes im Notebook, nachdem dieser in Ihrer Umgebung bereitgestellt wurde.

Installieren Sie die Abhängigkeiten und importieren Sie die erforderliche Bibliothek

Verwenden Sie den folgenden Code, um Abhängigkeiten zu installieren, die erforderlichen Bibliotheken zu importieren und den SageMaker S3-Bucket zu erstellen, der für die Datenverarbeitung und das Modelltraining benötigt wird. Eine der erforderlichen Bibliotheken, awswrangler, ist ein AWS SDK für Pandas-Datenrahmen Dies wird verwendet, um die relevanten Tabellen im AWS Glue-Datenkatalog abzufragen und die Ergebnisse lokal in einem Datenrahmen zu speichern.

Fragen Sie die VPC-Flussprotokolltabelle von Amazon Security Lake ab

Dieser Teil des Codes verwendet das AWS SDK für Pandas, um die AWS Glue-Tabelle im Zusammenhang mit VPC-Flussprotokollen abzufragen. Wie in den Voraussetzungen erwähnt, werden Amazon Security Lake-Tabellen verwaltet von AWS Lake-FormationDaher müssen der vom SageMaker-Notizbuch verwendeten Rolle alle erforderlichen Berechtigungen erteilt werden. Diese Abfrage ruft den VPC-Flussprotokollverkehr über mehrere Tage ab. Der bei der Entwicklung dieses Blogs verwendete Datensatz war klein. Abhängig vom Umfang Ihres Anwendungsfalls sollten Sie sich der Grenzen des AWS SDK für Pandas bewusst sein. Wenn Sie eine Terabyte-Skalierung in Betracht ziehen, sollten Sie die Unterstützung von AWS SDK für Pandas in Betracht ziehen Modin.

Wenn Sie den Datenrahmen anzeigen, sehen Sie die Ausgabe einer einzelnen Spalte mit allgemeinen Feldern, die im zu finden sind Netzwerkaktivität (4001) Klasse der OCSF.

Normalisieren Sie die Amazon Security Lake VPC-Flussprotokolldaten in das erforderliche Trainingsformat für IP Insights.

Der IP Insights-Algorithmus erfordert, dass die Trainingsdaten im CSV-Format vorliegen und zwei Spalten enthalten. Die erste Spalte muss eine undurchsichtige Zeichenfolge sein, die der eindeutigen Kennung einer Entität entspricht. Die zweite Spalte muss die IPv4-Adresse des Zugriffsereignisses der Entität in Dezimalpunktschreibweise enthalten. Im Beispieldatensatz für diesen Blog handelt es sich bei der eindeutigen Kennung um die Instanz-IDs der damit verknüpften EC2-Instanzen instance_id Wert innerhalb der dataframe. Die IPv4-Adresse wird daraus abgeleitet src_endpoint. Basierend auf der Art und Weise, wie die Amazon Athena-Abfrage erstellt wurde, haben die importierten Daten bereits das richtige Format für das Training eines IP Insights-Modells, sodass kein zusätzliches Feature-Engineering erforderlich ist. Wenn Sie die Abfrage auf andere Weise ändern, müssen Sie möglicherweise zusätzliches Feature-Engineering integrieren.

Fragen Sie die Amazon Security Lake Route 53-Resolver-Protokolltabelle ab und normalisieren Sie sie

Genau wie Sie es oben getan haben, führt der nächste Schritt des Notebooks eine ähnliche Abfrage für die Amazon Security Lake Route 53-Resolver-Tabelle aus. Da Sie in diesem Notebook alle OCSF-kompatiblen Daten verwenden, bleiben alle Feature-Engineering-Aufgaben für Route 53-Resolver-Protokolle dieselben wie für VPC-Flussprotokolle. Anschließend kombinieren Sie die beiden Datenrahmen zu einem einzigen Datenrahmen, der für das Training verwendet wird. Da die Amazon Athena-Abfrage die Daten lokal im richtigen Format lädt, ist kein weiteres Feature-Engineering erforderlich.

Holen Sie sich das IP Insights-Trainingsbild und trainieren Sie das Modell mit den OCSF-Daten

In diesem nächsten Teil des Notebooks trainieren Sie ein ML-Modell basierend auf dem IP Insights-Algorithmus und verwenden das konsolidierte dataframe von OCSF aus verschiedenen Protokolltypen. Eine Liste der IP Insights-Hyperparameter finden Sie hier hier. Im folgenden Beispiel haben wir Hyperparameter ausgewählt, die das Modell mit der besten Leistung ausgegeben haben, zum Beispiel 5 für Epoche und 128 für vector_dim. Da der Trainingsdatensatz für unsere Stichprobe relativ klein war, verwendeten wir a ml.m5.large Beispiel. Hyperparameter und Ihre Trainingskonfigurationen wie Instanzanzahl und Instanztyp sollten basierend auf Ihren objektiven Metriken und der Größe Ihrer Trainingsdaten ausgewählt werden. Eine Funktion, die Sie in Amazon SageMaker nutzen können, um die beste Version Ihres Modells zu finden, ist Amazon SageMaker automatische Modellabstimmung das nach dem besten Modell für einen Bereich von Hyperparameterwerten sucht.

Stellen Sie das trainierte Modell bereit und testen Sie es mit gültigem und anomalem Datenverkehr

Nachdem das Modell trainiert wurde, stellen Sie das Modell auf einem SageMaker-Endpunkt bereit und senden eine Reihe eindeutiger Kombinationen aus Kennung und IPv4-Adresse, um Ihr Modell zu testen. In diesem Codeteil wird davon ausgegangen, dass Sie Testdaten in Ihrem S3-Bucket gespeichert haben. Die Testdaten sind eine CSV-Datei, wobei die erste Spalte Instanz-IDs und die zweite Spalte IPs enthält. Es wird empfohlen, gültige und ungültige Daten zu testen, um die Ergebnisse des Modells anzuzeigen. Der folgende Code stellt Ihren Endpunkt bereit.

Nachdem Ihr Endpunkt nun bereitgestellt ist, können Sie Inferenzanfragen senden, um festzustellen, ob der Datenverkehr möglicherweise anomal ist. Nachfolgend finden Sie ein Beispiel dafür, wie Ihre formatierten Daten aussehen sollten. In diesem Fall ist die erste Spaltenkennung eine Instanz-ID und die zweite Spalte eine zugehörige IP-Adresse, wie im Folgenden dargestellt:

Nachdem Sie Ihre Daten im CSV-Format haben, können Sie die Daten mithilfe des Codes zur Inferenz übermitteln, indem Sie Ihre CSV-Datei aus einem S3-Bucket lesen:

Die Ausgabe für ein IP Insights-Modell liefert ein Maß dafür, wie statistisch erwartet eine IP-Adresse und eine Online-Ressource sind. Der Bereich für diese Adresse und Ressource ist jedoch unbegrenzt, daher gibt es Überlegungen, wie Sie bestimmen würden, ob eine Kombination aus Instanz-ID und IP-Adresse als anomal betrachtet werden sollte.

Im vorherigen Beispiel wurden vier verschiedene Kombinationen aus Kennung und IP an das Modell übermittelt. Die ersten beiden Kombinationen waren gültige Kombinationen aus Instanz-ID und IP-Adresse, die basierend auf dem Trainingssatz erwartet werden. Die dritte Kombination hat die richtige eindeutige Kennung, aber eine andere IP-Adresse innerhalb desselben Subnetzes. Das Modell sollte feststellen, dass eine geringfügige Anomalie vorliegt, da sich die Einbettung geringfügig von den Trainingsdaten unterscheidet. Die vierte Kombination hat eine gültige eindeutige Kennung, aber eine IP-Adresse eines nicht vorhandenen Subnetzes innerhalb einer VPC in der Umgebung.

Hinweis: Normale und abnormale Verkehrsdaten ändern sich je nach Ihrem spezifischen Anwendungsfall. Beispiel: Wenn Sie externen und internen Datenverkehr überwachen möchten, benötigen Sie eine eindeutige Kennung, die auf jede IP-Adresse abgestimmt ist, und ein Schema zur Generierung der externen Kennungen.

Um zu bestimmen, wie hoch Ihr Schwellenwert sein sollte, um festzustellen, ob der Verkehr anomal ist, können Sie bekannten normalen und abnormalen Verkehr verwenden. Die in aufgeführten Schritte dieses Beispielnotizbuch sind wie folgt:

- Erstellen Sie einen Testsatz, der den normalen Datenverkehr darstellt.

- Fügen Sie dem Datensatz abnormalen Verkehr hinzu.

- Zeichnen Sie die Verteilung von auf

dot_productBewertungen für das Modell bei normalem und abnormalem Verkehr. - Wählen Sie einen Schwellenwert aus, der die normale Teilmenge von der abnormalen Teilmenge unterscheidet. Dieser Wert basiert auf Ihrer Falsch-Positiv-Toleranz

Richten Sie eine kontinuierliche Überwachung des neuen VPC-Flussprotokollverkehrs ein.

Um zu demonstrieren, wie dieses neue ML-Modell proaktiv mit Amazon Security Lake verwendet werden kann, konfigurieren wir eine Lambda-Funktion, die auf jedem aufgerufen wird PutObject Ereignis innerhalb des von Amazon Security Lake verwalteten Buckets, insbesondere die VPC-Flussprotokolldaten. Innerhalb von Amazon Security Lake gibt es das Konzept eines Abonnenten, der Protokolle und Ereignisse von Amazon Security Lake nutzt. Der Lambda-Funktion, die auf neue Ereignisse reagiert, muss ein Datenzugriffsabonnement gewährt werden. Datenzugriffsabonnenten werden über neue Amazon S3-Objekte für eine Quelle benachrichtigt, während die Objekte in den Security Lake-Bucket geschrieben werden. Abonnenten können über einen Abonnementendpunkt oder durch Abfragen einer Amazon SQS-Warteschlange direkt auf die S3-Objekte zugreifen und Benachrichtigungen über neue Objekte erhalten.

- Öffnen Sie den Microsoft Store auf Ihrem Windows-PC. Security Lake-Konsole.

- Wählen Sie im Navigationsbereich aus Abonnenten.

- Wählen Sie auf der Seite „Abonnenten“ die Option aus Abonnenten erstellen.

- Geben Sie für Abonnentendetails Folgendes ein:

inferencelambdafür Name des Abonnenten und eine optionale Beschreibung. - Das Region wird automatisch als Ihre aktuell ausgewählte AWS-Region festgelegt und kann nicht geändert werden.

- Aussichten für Protokoll- und Ereignisquellen, wählen Spezifische Protokoll- und Ereignisquellen und wählen Sie VPC-Flussprotokolle und Route 53-Protokolle

- Aussichten für Datenzugriffsmethode, wählen S3.

- Aussichten für Anmeldedaten des AbonnentenGeben Sie Ihre AWS-Konto-ID des Kontos an, in dem sich die Lambda-Funktion befindet, sowie eine vom Benutzer angegebene externe ID.

Hinweis: Wenn Sie dies lokal innerhalb eines Kontos tun, benötigen Sie keine externe ID. - Auswählen Erstellen.

Erstellen Sie die Lambda-Funktion

Um die Lambda-Funktion zu erstellen und bereitzustellen, können Sie entweder die folgenden Schritte ausführen oder die vorgefertigte SAM-Vorlage bereitstellen 01_ipinsights/01.02-ipcheck.yaml im GitHub-Repo. Für die SAM-Vorlage müssen Sie den SQS-ARN und den SageMaker-Endpunktnamen angeben.

- Wählen Sie auf der Lambda-Konsole Funktion erstellen.

- Auswählen Autor von Grund auf neu.

- Aussichten für Funktionsname, eingeben

ipcheck. - Aussichten für Laufzeit, wählen Python 3.10.

- Aussichten für ArchitekturWählen x86_64.

- Aussichten für AusführungsrolleWählen Erstellen Sie eine neue Rolle mit Lambda-Berechtigungen.

- Nachdem Sie die Funktion erstellt haben, geben Sie den Inhalt ein ipcheck.py Datei aus dem GitHub-Repo.

- Wählen Sie im Navigationsbereich Umgebungsvariablen.

- Auswählen Bearbeiten.

- Auswählen Umgebungsvariable hinzufügen.

- Geben Sie als neue Umgebungsvariable ein

ENDPOINT_NAMEund geben Sie als Wert den Endpunkt-ARN ein, der während der Bereitstellung des SageMaker-Endpunkts ausgegeben wurde. - Auswählen Speichern.

- Auswählen Deploy.

- Wählen Sie im Navigationsbereich Konfiguration.

- Auswählen Auslöser.

- Auswählen Trigger hinzufügen.

- Der Wählen Sie eine Quelle aus, wählen SQS.

- Der SQS-WarteschlangeGeben Sie den ARN der von Security Lake erstellten Haupt-SQS-Warteschlange ein.

- Aktivieren Sie das Kontrollkästchen für Auslöser aktivieren.

- Auswählen Speichern.

Validieren Sie Lambda-Ergebnisse

- Öffnen Sie den Microsoft Store auf Ihrem Windows-PC. Amazon CloudWatch-Konsole.

- Wählen Sie im linken Seitenbereich aus Protokollgruppen.

- Geben Sie in der Suchleiste ipcheck ein und wählen Sie dann die Protokollgruppe mit dem Namen aus

/aws/lambda/ipcheck. - Wählen Sie unten den neuesten Protokollstream aus Streams protokollieren.

- In den Protokollen sollten für jedes neue Amazon Security Lake-Protokoll Ergebnisse angezeigt werden, die etwa wie folgt aussehen:

{'predictions': [{'dot_product': 0.018832731992006302}, {'dot_product': 0.018832731992006302}]}

Diese Lambda-Funktion analysiert kontinuierlich den Netzwerkverkehr, der von Amazon Security Lake aufgenommen wird. Auf diese Weise können Sie Mechanismen erstellen, um Ihre Sicherheitsteams zu benachrichtigen, wenn ein bestimmter Schwellenwert verletzt wird, was auf einen anomalen Datenverkehr in Ihrer Umgebung hinweisen würde.

Aufräumen

Wenn Sie mit dem Experimentieren mit dieser Lösung fertig sind und Gebühren für Ihr Konto vermeiden möchten, bereinigen Sie Ihre Ressourcen, indem Sie den S3-Bucket und den SageMaker-Endpunkt löschen, die mit dem SageMaker-Jupyter-Notebook verbundene Rechenleistung herunterfahren, die Lambda-Funktion löschen und Amazon Security deaktivieren Lake in Ihrem Konto.

Zusammenfassung

In diesem Beitrag haben Sie erfahren, wie Sie Netzwerkverkehrsdaten aus Amazon Security Lake für maschinelles Lernen vorbereiten und anschließend ein ML-Modell mithilfe des IP Insights-Algorithmus in Amazon SageMaker trainieren und bereitstellen. Alle im Jupyter-Notizbuch beschriebenen Schritte können in einer End-to-End-ML-Pipeline repliziert werden. Sie haben außerdem eine AWS Lambda-Funktion implementiert, die neue Amazon Security Lake-Protokolle verarbeitet und Schlussfolgerungen basierend auf dem trainierten Anomalieerkennungsmodell übermittelt. Die von AWS Lambda empfangenen ML-Modellantworten könnten Sicherheitsteams proaktiv über anomalen Datenverkehr benachrichtigen, wenn bestimmte Schwellenwerte erreicht werden. Eine kontinuierliche Verbesserung des Modells kann ermöglicht werden, indem Ihr Sicherheitsteam in die Loop-Reviews einbezogen wird, um zu kennzeichnen, ob der als anomal erkannte Datenverkehr falsch positiv war oder nicht. Dies könnte dann zu Ihrem Trainingssatz hinzugefügt und auch zu Ihrem hinzugefügt werden normal Verkehrsdatensatz bei der Bestimmung eines empirischen Schwellenwerts. Dieses Modell kann potenziell anomalen Netzwerkverkehr oder -verhalten identifizieren und kann als Teil einer größeren Sicherheitslösung eingebunden werden, um eine MFA-Prüfung einzuleiten, wenn sich ein Benutzer von einem ungewöhnlichen Server oder zu einem ungewöhnlichen Zeitpunkt anmeldet, und das Personal zu benachrichtigen, wenn ein verdächtiger Vorfall vorliegt Netzwerk-Scans von neuen IP-Adressen durchführen oder den IP-Insights-Score mit anderen Quellen wie Amazon Guard Duty kombinieren, um Bedrohungsergebnisse zu bewerten. Dieses Modell kann benutzerdefinierte Protokollquellen wie Azure Flow Logs oder lokale Protokolle umfassen, indem Sie benutzerdefinierte Quellen zu Ihrer Amazon Security Lake-Bereitstellung hinzufügen.

In Teil 2 dieser Blogbeitragsreihe erfahren Sie, wie Sie mit dem ein Anomalieerkennungsmodell erstellen Zufällig geschnittener Wald Mit zusätzlichen Amazon Security Lake-Quellen trainierter Algorithmus, der Netzwerk- und Host-Sicherheitsprotokolldaten integriert und die Klassifizierung von Sicherheitsanomalien als Teil einer automatisierten, umfassenden Sicherheitsüberwachungslösung anwendet.

Über die Autoren

Joe Morotti ist Lösungsarchitekt bei Amazon Web Services (AWS) und unterstützt Unternehmenskunden im Mittleren Westen der USA. Er hatte eine Vielzahl von technischen Funktionen inne und zeigt gerne Kunden die Kunst des Möglichen. In seiner Freizeit verbringt er gerne Zeit mit seiner Familie, um neue Orte zu erkunden und die Leistung seines Sportteams zu überschätzen

Joe Morotti ist Lösungsarchitekt bei Amazon Web Services (AWS) und unterstützt Unternehmenskunden im Mittleren Westen der USA. Er hatte eine Vielzahl von technischen Funktionen inne und zeigt gerne Kunden die Kunst des Möglichen. In seiner Freizeit verbringt er gerne Zeit mit seiner Familie, um neue Orte zu erkunden und die Leistung seines Sportteams zu überschätzen

Bishr Tabbaa ist Lösungsarchitekt bei Amazon Web Services. Bishr ist darauf spezialisiert, Kunden mit Anwendungen für maschinelles Lernen, Sicherheit und Beobachtbarkeit zu unterstützen. Außerhalb der Arbeit spielt er gerne Tennis, kocht und verbringt Zeit mit der Familie.

Bishr Tabbaa ist Lösungsarchitekt bei Amazon Web Services. Bishr ist darauf spezialisiert, Kunden mit Anwendungen für maschinelles Lernen, Sicherheit und Beobachtbarkeit zu unterstützen. Außerhalb der Arbeit spielt er gerne Tennis, kocht und verbringt Zeit mit der Familie.

Sriharsh Adari ist Senior Solutions Architect bei Amazon Web Services (AWS), wo er Kunden hilft, ausgehend von Geschäftsergebnissen rückwärts zu arbeiten, um innovative Lösungen auf AWS zu entwickeln. Im Laufe der Jahre hat er mehreren Kunden bei der Transformation von Datenplattformen in allen Branchen geholfen. Zu seinen Kernkompetenzen gehören Technologiestrategie, Datenanalyse und Datenwissenschaft. In seiner Freizeit spielt er gerne Tennis, schaut sich Serien an und spielt Tabla.

Sriharsh Adari ist Senior Solutions Architect bei Amazon Web Services (AWS), wo er Kunden hilft, ausgehend von Geschäftsergebnissen rückwärts zu arbeiten, um innovative Lösungen auf AWS zu entwickeln. Im Laufe der Jahre hat er mehreren Kunden bei der Transformation von Datenplattformen in allen Branchen geholfen. Zu seinen Kernkompetenzen gehören Technologiestrategie, Datenanalyse und Datenwissenschaft. In seiner Freizeit spielt er gerne Tennis, schaut sich Serien an und spielt Tabla.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/identify-cybersecurity-anomalies-in-your-amazon-security-lake-data-using-amazon-sagemaker/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 01

- 1

- 10

- 100

- 12

- 125

- 15%

- 17

- 20000

- 25

- 32

- 7

- 9

- a

- oben

- Zugang

- Konto

- Trading Konten

- über

- Aktivität

- Akteure

- hinzugefügt

- Hinzufügen

- Zusätzliche

- Adresse

- Adressen

- Administratoren

- Nach der

- gegen

- Aufmerksam

- Algorithmus

- Algorithmen

- ausgerichtet

- Alle

- erlaubt

- bereits

- ebenfalls

- Amazon

- Amazonas Athena

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- Analyse

- Business Analysten

- Analytik

- analysieren

- Analysen

- Analyse

- machen

- Anomalien

- Anomalieerkennung

- Ein anderer

- jedem

- Anwendung

- Anwendungen

- Jetzt bewerben

- Ansatz

- Architektur

- SIND

- Bereich

- Kunst

- AS

- Details

- damit verbundenen

- übernimmt

- At

- Authentifizierung

- Automatisiert

- Automatisches Erfassen:

- Im Prinzip so, wie Sie es von Google Maps kennen.

- automatisieren

- vermeiden

- bewusst

- AWS

- AWS-Kleber

- AWS Lake-Formation

- AWS Lambda

- Azure

- Bar

- basierend

- Baseline

- BE

- weil

- wird

- war

- Verhalten

- Sein

- unten

- BESTE

- Beyond

- Blog

- beide

- bauen

- eingebaut

- Geschäft

- aber

- by

- CAN

- capability

- fähig

- Häuser

- Katalog

- Hauptgeschäftsstelle

- zentralisieren

- sicher

- challenges

- Übernehmen

- Änderungen

- Ändern

- Gebühren

- aus der Ferne überprüfen

- Auswählen

- gewählt

- Cisco

- Klasse

- Einstufung

- eingestuft

- klassifizieren

- reinigen

- Cloud

- Code

- Kolonne

- Spalten

- Kombination

- Kombinationen

- kombinieren

- vereint

- wie die

- Kommen

- gemeinsam

- abschließen

- Komplex

- konform

- zusammengesetzt

- umfassend

- Berechnen

- konzept

- Geht davon

- Überlegungen

- betrachtet

- Berücksichtigung

- Konsul (Console)

- verbraucht

- Verbrauch

- enthalten

- Inhalt

- ständig

- kontinuierlich

- Kernbereich

- und beseitigen Muskelschwäche

- entspricht

- könnte

- erstellen

- erstellt

- Zur Zeit

- Original

- Kunden

- anpassbare

- Schneiden

- Internet-Sicherheit

- technische Daten

- Datenzugriff

- Datenanalyse

- Datensee

- Datenplattform

- Datenverarbeitung

- Datenwissenschaft

- Datenbase

- Datensätze

- Tage

- Definiert

- zeigen

- Abhängigkeiten

- abhängig

- Abhängig

- einsetzen

- Einsatz

- Einsatz

- setzt ein

- Abgeleitet

- Details

- Entdeckung

- Bestimmen

- Festlegung

- entwickeln

- Entwicklung

- Geräte

- DID

- anders

- digital

- Digitale Assets

- Direkt

- Verteilung

- dns

- doesn

- Dabei

- Don

- erledigt

- Nicht

- nach unten

- im

- e

- jeder

- Edge

- Effektiv

- entweder

- sonst

- Einbettung

- freigegeben

- ermöglicht

- End-to-End

- Endpunkt

- Ingenieur

- Entwicklung

- genießen

- bereichern

- Enter

- Unternehmen

- Arbeitsumfeld

- Umgebungen

- Epoche

- Fehler

- Event

- Veranstaltungen

- entwickelt sich

- sich entwickelnden

- Überprüft

- Beispiel

- Außer

- existiert

- ergänzt

- erwartet

- Expertise

- Möglichkeiten sondieren

- extern

- konfrontiert

- falsch

- Familie

- Merkmal

- Eigenschaften

- Felder

- Reichen Sie das

- Mappen

- Finden Sie

- Befund

- Vorname

- Fluss

- Setzen Sie mit Achtsamkeit

- Folgende

- folgt

- Fußabdruck

- Aussichten für

- Format

- Ausbildung

- gefunden

- vier

- Vierte

- FRAME

- Gerüste

- Frei

- für

- voll

- Funktion

- weiter

- erzeugen

- GitHub

- erteilt

- Gruppe an

- gewachsen

- Bewachen

- Haben

- he

- Statt

- dazu beigetragen,

- Unternehmen

- hilft

- seine

- Gastgeber

- Ultraschall

- Hilfe

- aber

- HTML

- HTTPS

- ID

- identifiziert

- Kennzeichnung

- Identifikatoren

- identifiziert

- identifizieren

- Identifizierung

- Identitätsschutz

- ids

- if

- Image

- Impact der HXNUMXO Observatorien

- umgesetzt

- importieren

- Verbesserung

- in

- das

- inklusive

- Einschließlich

- integrieren

- zunehmend

- zeigen

- Krankengymnastik

- Energiegewinnung

- Infrastruktur

- initiieren

- innovativ

- Einblicke

- installieren

- Instanz

- integrieren

- integriert

- intern

- in

- aufgerufen

- IP

- IP Address

- IP-Adressen

- IT

- Job

- Jobs

- jpg

- JSON

- bekannt

- Label

- See

- Landschaft

- grosse

- größer

- LERNEN

- gelernt

- lernen

- links

- Bibliotheken

- Lebenszyklus

- Gefällt mir

- Grenzen

- Liste

- Belastungen

- örtlich

- Log

- aussehen

- aussehen wie

- Maschine

- Maschinelles Lernen

- Main

- verwaltet

- Management

- Managed

- Weise

- Kann..

- messen

- Mechanismen

- Triff

- erwähnt

- versiegelte

- Metrik

- MFA

- Midwest

- minimal

- Kommt demnächst...

- ML

- Modell

- für

- bescheiden

- geändert

- ändern

- Überwachen

- Überwachung

- vor allem warme

- mehrere

- sollen

- Name

- Navigation

- notwendig,

- Need

- erforderlich

- Netzwerk

- Netzwerktraffic

- Netzwerke

- Neu

- weiter

- nicht

- nicht existent

- normal

- Notizbuch

- Benachrichtigungen

- Roman

- jetzt an

- Ziel

- Objekte

- of

- Angebote

- on

- EINEM

- Online

- undurchsichtig

- or

- Organisation

- OS

- Andere

- UNSERE

- Ergebnisse

- Ausreißer

- skizzierte

- Möglichkeiten für das Ausgangssignal:

- aussen

- übrig

- besitzen

- Seite

- Palo Alto

- Pandas

- Brot

- Teil

- Durchführung

- periodisch

- Erlaubnis

- Berechtigungen

- Pipeline

- Länder/Regionen

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- spielend

- Datenschutzrichtlinien

- Teil

- Häfen

- positiv

- möglich

- Post

- möglicherweise

- vor

- Prognosen

- Predictor

- Danach

- Voraussetzungen

- priorisiert

- privat

- Proaktives Handeln

- Verarbeitet

- Verarbeitung

- ordnungsgemäße

- Protokolle

- die

- Anbieter

- bietet

- Qualität

- Frage

- erhöhen

- Angebot

- Rang

- Lesebrillen

- echt

- Echtzeit

- erhalten

- Received

- kürzlich

- empfohlen

- Referenz

- Region

- Regionen

- bezogene

- verhältnismäßig

- relevant

- bleiben

- repliziert

- vertreten

- Ruf

- Zugriffe

- falls angefordert

- erfordert

- Ressourcen

- Downloads

- Antwort

- Antworten

- Folge

- Die Ergebnisse

- Beibehaltung

- Bewertungen

- Rollen

- Rollen

- Straße

- Führen Sie

- läuft

- sagemaker

- SageMaker-Inferenz

- Sam

- gleich

- Beispieldatensatz

- Gerettet

- Skalieren

- Waage

- Skalierung

- Scan

- Szenario

- Schema

- Wissenschaft

- Ergebnis

- Sdk

- Suche

- Suchbegriffe

- Zweite

- Sicherheitdienst

- Sicherheitsbedrohungen

- sehen

- wählen

- ausgewählt

- senden

- Senior

- Modellreihe

- Server

- Dienstleistungen

- Sitzung

- kompensieren

- sollte

- gezeigt

- Konzerte

- Herunterfahren

- Seite

- Stempel, Unterschrift

- Unterzeichnung

- ähnlich

- Einfacher

- da

- Single

- Größe

- geringfügig

- klein

- So

- Lösung

- Lösungen

- LÖSEN

- Quelle

- bezogen

- Quellen

- spezialisiert

- spezifisch

- speziell

- angegeben

- Ausgabe

- Sports

- Unser Team

- Schritt

- Shritte

- Lagerung

- speichern

- gelagert

- Strategie

- Strom

- Strafft

- Schnur

- strukturierte

- Studio Adressen

- abschicken

- eingereicht

- Subnetz

- Teilnehmer

- weltweit

- Abonnement

- so

- Support

- Unterstützt

- misstrauisch

- Tabelle

- und Aufgaben

- Team

- Teams

- Technische

- Technologie

- Technologiestrategie

- Vorlage

- Tennis

- Test

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- dann

- Dort.

- vom Nutzer definierten

- Dritte

- basierte Online-to-Offline-Werbezuordnungen von anderen gab.

- fehlen uns die Worte.

- diejenigen

- Bedrohung

- Bedrohungsakteure

- Bedrohungen

- Schwelle

- Durch

- Zeit

- zu

- Werkzeuge

- der Verkehr

- Training

- trainiert

- Ausbildung

- Transformationen

- Vertrauen

- versuchen

- tv

- XNUMX

- zweifach

- tippe

- Typen

- für

- einheitlich

- einzigartiges

- auf

- Dringlichkeit

- us

- -

- Anwendungsfall

- benutzt

- Mitglied

- verwendet

- Verwendung von

- Nutzen

- seit

- gültig

- Wert

- Werte

- Variable

- Version

- Vertikalen

- Anzeigen

- verletzt

- Assistent

- Sicherheitslücken

- geht

- wollen

- wurde

- Weg..

- we

- Netz

- Web-Services

- waren

- Was

- wann

- ob

- welche

- breit

- Große Auswahl

- werden wir

- mit

- .

- Arbeiten

- Workflows

- würde

- geschrieben

- Jahr

- Du

- Ihr

- Zephyrnet