Die Datenvorbereitung ist ein entscheidender Schritt in jedem datengesteuerten Projekt, und die Verwendung der richtigen Tools kann die betriebliche Effizienz erheblich steigern. Amazon SageMaker Data Wrangler reduziert den Zeitaufwand für die Aggregation und Vorbereitung von Tabellen- und Bilddaten für maschinelles Lernen (ML) von Wochen auf Minuten. Mit SageMaker Data Wrangler können Sie den Prozess der Datenvorbereitung und des Feature-Engineerings vereinfachen und jeden Schritt des Datenvorbereitungs-Workflows, einschließlich Datenauswahl, -bereinigung, -exploration und -visualisierung, über eine einzige visuelle Oberfläche abschließen.

In diesem Beitrag erkunden wir die neuesten Funktionen von SageMaker Data Wrangler, die speziell darauf ausgelegt sind, das Betriebserlebnis zu verbessern. Wir beschäftigen uns mit der Unterstützung von Einfacher Speicherservice (Amazon S3) Manifest Dateien, Inferenzartefakte in einem interaktiven Datenfluss und die nahtlose Integration mit JSON (JavaScript-Objektnotation) Format für die Inferenz und hebt hervor, wie diese Verbesserungen die Datenvorbereitung einfacher und effizienter machen.

Einführung neuer Funktionen

In diesem Abschnitt besprechen wir die neuen Funktionen des SageMaker Data Wrangler für eine optimale Datenaufbereitung.

Unterstützung von S3-Manifestdateien mit SageMaker Autopilot für ML-Inferenz

SageMaker Data Wrangler ermöglicht a Einheitliche Datenaufbereitung und Modellschulung Erfahrung mit Amazon SageMaker-Autopilot mit nur wenigen Klicks. Mit SageMaker Autopilot können Sie Modelle automatisch anhand der Daten trainieren, optimieren und bereitstellen, die Sie in Ihrem Datenfluss transformiert haben.

Diese Erfahrung wird jetzt durch die Unterstützung von S3-Manifestdateien noch weiter vereinfacht. Eine S3-Manifestdatei ist eine Textdatei, die die in einem S3-Bucket gespeicherten Objekte (Dateien) auflistet. Wenn Ihr in SageMaker Data Wrangler exportierter Datensatz recht groß und in Amazon S3 in mehrere Datendateien aufgeteilt ist, erstellt SageMaker Data Wrangler jetzt automatisch eine Manifestdatei in S3, die alle diese Datendateien darstellt. Diese generierte Manifestdatei kann jetzt mit der SageMaker Autopilot-Benutzeroberfläche in SageMaker Data Wrangler verwendet werden, um alle partitionierten Daten für das Training abzurufen.

Vor der Einführung dieser Funktion konnten Sie bei der Verwendung von SageMaker Autopilot-Modellen, die auf vorbereiteten Daten von SageMaker Data Wrangler trainiert wurden, nur eine Datendatei auswählen, die möglicherweise nicht den gesamten Datensatz darstellt, insbesondere wenn der Datensatz sehr groß ist. Mit dieser neuen Manifestdatei-Erfahrung sind Sie nicht auf eine Teilmenge Ihres Datensatzes beschränkt. Sie können mit SageMaker Autopilot ein ML-Modell erstellen, das alle Ihre Daten mithilfe der Manifestdatei darstellt, und dieses für Ihre ML-Inferenz und Produktionsbereitstellung verwenden. Diese Funktion steigert die betriebliche Effizienz, indem sie das Training von ML-Modellen mit SageMaker Autopilot vereinfacht und die Arbeitsabläufe bei der Datenverarbeitung rationalisiert.

Unterstützung für den Inferenzfluss in generierten Artefakten hinzugefügt

Kunden möchten die Datentransformationen, die sie auf ihre Modelltrainingsdaten angewendet haben, wie z. B. One-Hot-Codierung, PCA und Imputation fehlender Werte, nutzen und diese Datentransformationen auf Echtzeit-Inferenz oder Batch-Inferenz in der Produktion anwenden. Dazu benötigen Sie ein SageMaker Data Wrangler-Inferenzartefakt, das von einem SageMaker-Modell genutzt wird.

Bisher konnten Inferenzartefakte nur über die Benutzeroberfläche generiert werden, wenn ein Export in die SageMaker Autopilot-Schulung oder ein Inferenz-Pipeline-Notizbuch exportiert wurde. Dies bot keine Flexibilität, wenn Sie Ihre SageMaker Data Wrangler-Flows außerhalb von ausführen wollten Amazon SageMaker-Studio Umfeld. Jetzt können Sie über einen SageMaker Data Wrangler-Verarbeitungsauftrag ein Inferenzartefakt für jede kompatible Flow-Datei generieren. Dies ermöglicht programmatische End-to-End-MLOps mit SageMaker Data Wrangler-Flows für Code-First-MLOps-Personas sowie einen intuitiven Pfad ohne Code, um ein Inferenzartefakt zu erhalten, indem ein Job über die Benutzeroberfläche erstellt wird.

Optimierte Datenvorbereitung

JSON hat sich zu einem weit verbreiteten Format für den Datenaustausch in modernen Datenökosystemen entwickelt. Die Integration von SageMaker Data Wrangler in das JSON-Format ermöglicht Ihnen die nahtlose Verarbeitung von JSON-Daten zur Transformation und Bereinigung. Durch die native Unterstützung von JSON vereinfacht SageMaker Data Wrangler den Prozess der Arbeit mit strukturierten und halbstrukturierten Daten und ermöglicht es Ihnen, wertvolle Erkenntnisse zu gewinnen und Daten effizient aufzubereiten. SageMaker Data Wrangler unterstützt jetzt das JSON-Format sowohl für die Batch- als auch für die Bereitstellung von Inferenzendpunkten in Echtzeit.

Lösungsüberblick

Für unseren Anwendungsfall verwenden wir das Beispiel Datensatz zu Amazon-Kundenrezensionen um zu zeigen, wie SageMaker Data Wrangler den betrieblichen Aufwand zum Erstellen eines neuen ML-Modells mithilfe von SageMaker Autopilot vereinfachen kann. Der Amazon-Kundenrezensionsdatensatz enthält Produktrezensionen und Metadaten von Amazon, darunter 142.8 Millionen Rezensionen für den Zeitraum Mai 1996 bis Juli 2014.

Auf hoher Ebene verwenden wir SageMaker Data Wrangler, um diesen großen Datensatz zu verwalten und die folgenden Aktionen durchzuführen:

- Entwickeln Sie ein ML-Modell in SageMaker Autopilot unter Verwendung des gesamten Datensatzes, nicht nur einer Stichprobe.

- Erstellen Sie eine Echtzeit-Inferenzpipeline mit dem von SageMaker Data Wrangler generierten Inferenzartefakt und verwenden Sie JSON-Formatierung für die Eingabe und Ausgabe.

Unterstützung von S3-Manifestdateien mit SageMaker Autopilot

Beim Erstellen eines SageMaker Autopilot-Experiments mit SageMaker Data Wrangler konnten Sie bisher nur eine einzige CSV- oder Parquet-Datei angeben. Jetzt können Sie auch eine S3-Manifestdatei verwenden und so große Datenmengen für SageMaker Autopilot-Experimente verwenden. SageMaker Data Wrangler partitioniert Eingabedatendateien automatisch in mehrere kleinere Dateien und generiert ein Manifest, das in einem SageMaker Autopilot-Experiment verwendet werden kann, um alle Daten aus der interaktiven Sitzung einzubeziehen, nicht nur eine kleine Stichprobe.

Führen Sie die folgenden Schritte aus:

- Importieren Sie die Amazon-Kundenbewertungsdaten aus einer CSV-Datei in SageMaker Data Wrangler. Stellen Sie sicher, dass die Stichprobenentnahme beim Importieren der Daten deaktiviert ist.

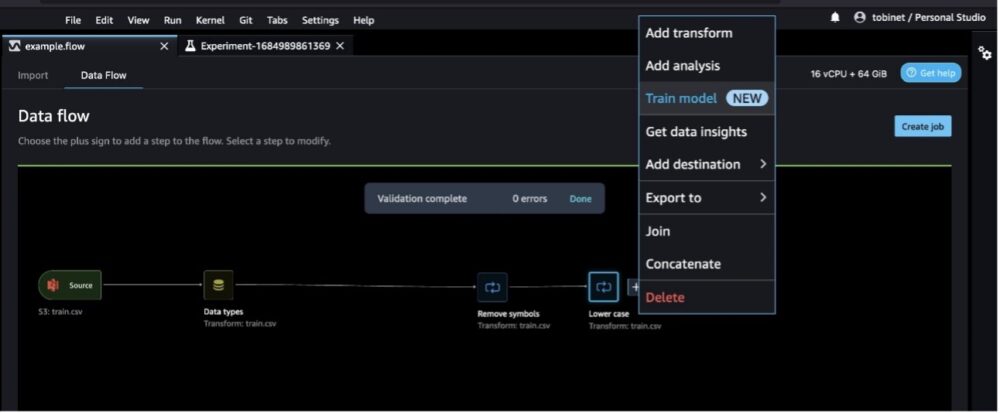

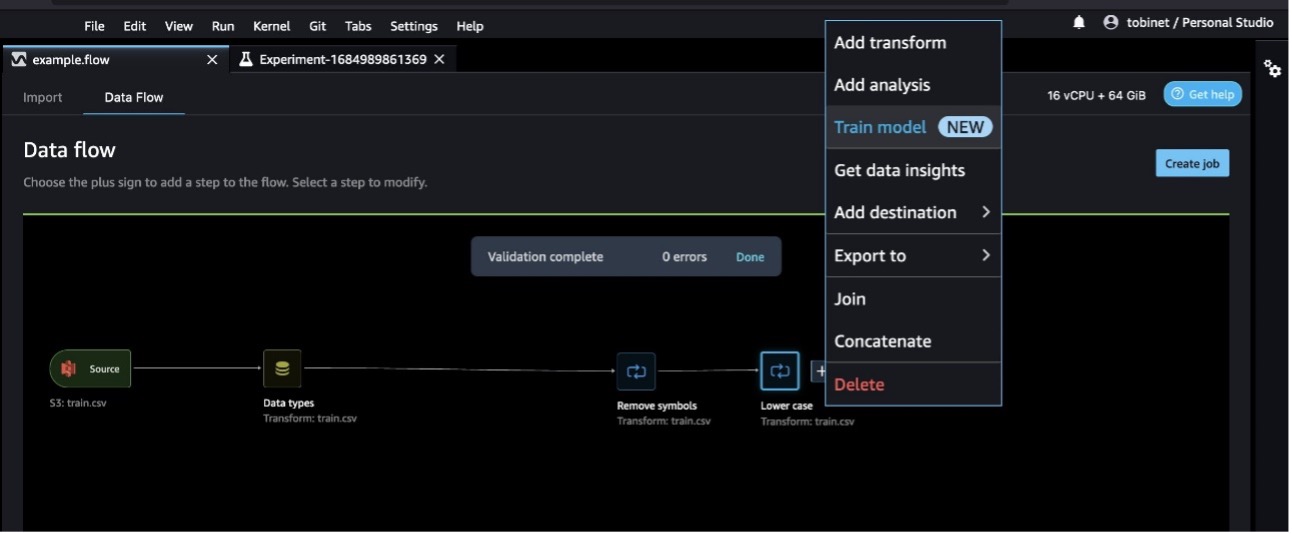

- Geben Sie die Transformationen an, die die Daten normalisieren. Entfernen Sie in diesem Beispiel Symbole und wandeln Sie alles mithilfe der integrierten Transformationen von SageMaker Data Wrangler in Kleinbuchstaben um.

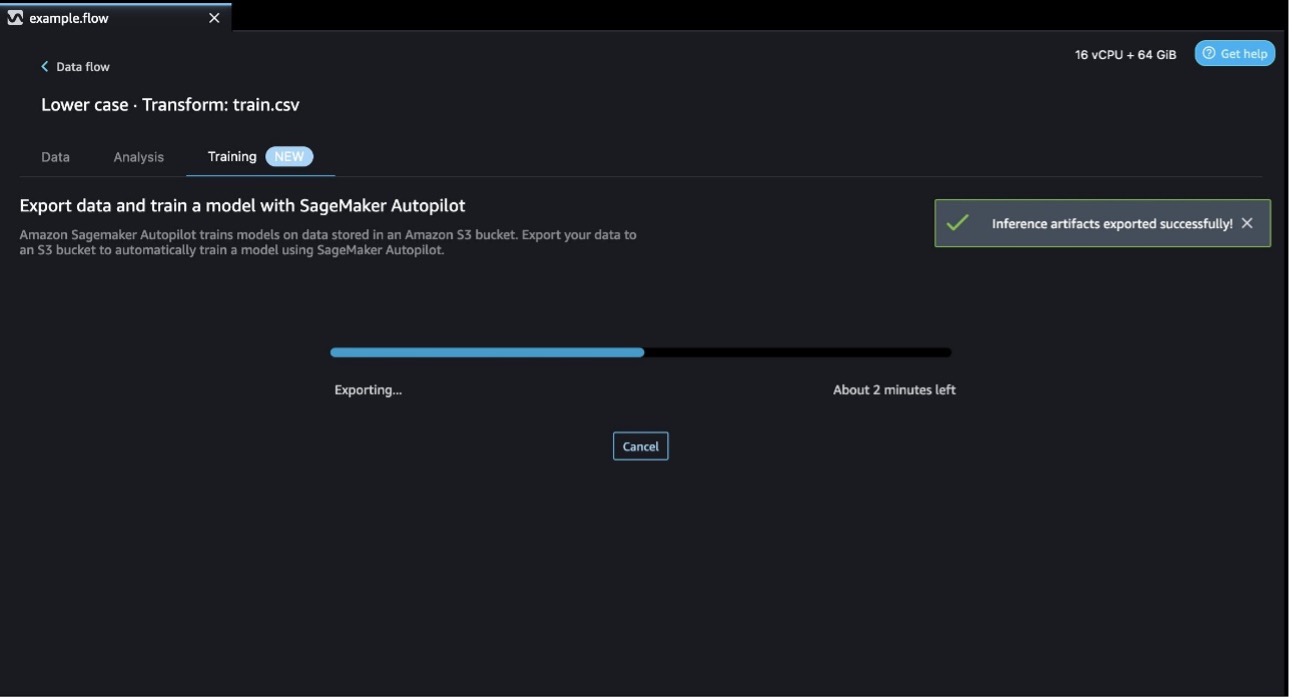

- Auswählen Zugmodell mit dem Training beginnen.

Um ein Modell mit SageMaker Autopilot zu trainieren, exportiert SageMaker automatisch Daten in einen S3-Bucket. Bei großen Datensätzen wie diesem wird die Datei automatisch in kleinere Dateien aufgeteilt und ein Manifest generiert, das den Speicherort der kleineren Dateien enthält.

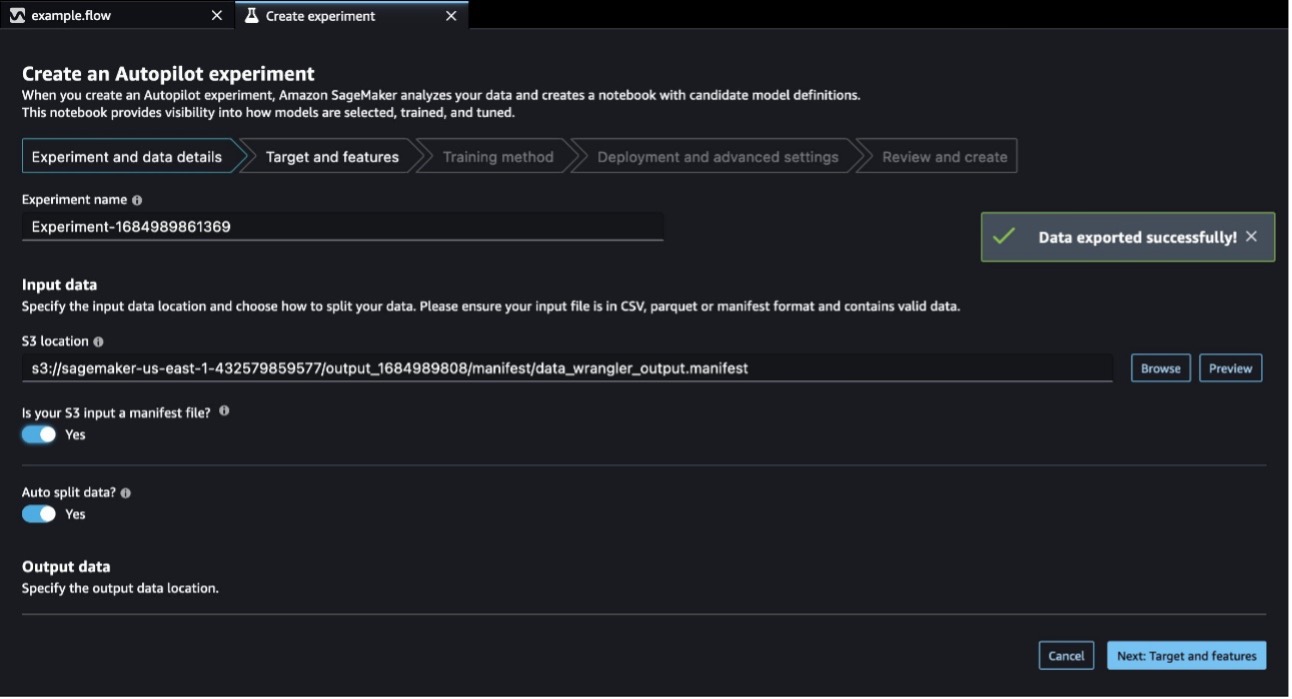

- Wählen Sie zunächst Ihre Eingabedaten aus.

Zuvor hatte SageMaker Data Wrangler keine Option zum Generieren einer Manifestdatei zur Verwendung mit SageMaker Autopilot. Heute, mit der Veröffentlichung der Unterstützung für Manifestdateien, exportiert SageMaker Data Wrangler automatisch eine Manifestdatei nach Amazon S3, füllt den S3-Speicherort des SageMaker Autopilot-Trainings vorab mit dem S3-Speicherort der Manifestdatei aus und schaltet die Manifestdateioption auf um Ja. Zum Generieren oder Verwenden der Manifestdatei sind keine Arbeiten erforderlich.

- Konfigurieren Sie Ihr Experiment, indem Sie das Ziel auswählen, das das Modell vorhersagen soll.

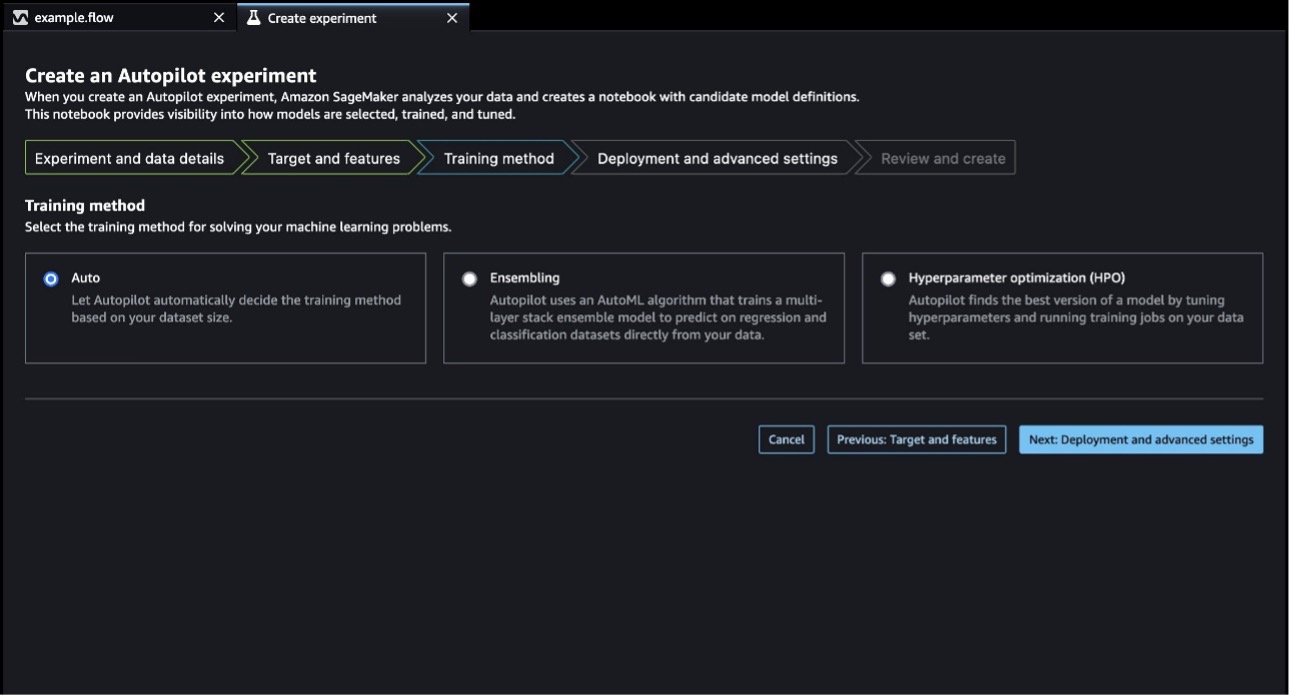

- Wählen Sie als Nächstes eine Trainingsmethode aus. In diesem Fall wählen wir aus Auto und lassen Sie SageMaker Autopilot anhand der Datensatzgröße die beste Trainingsmethode auswählen.

- Geben Sie die Bereitstellungseinstellungen an.

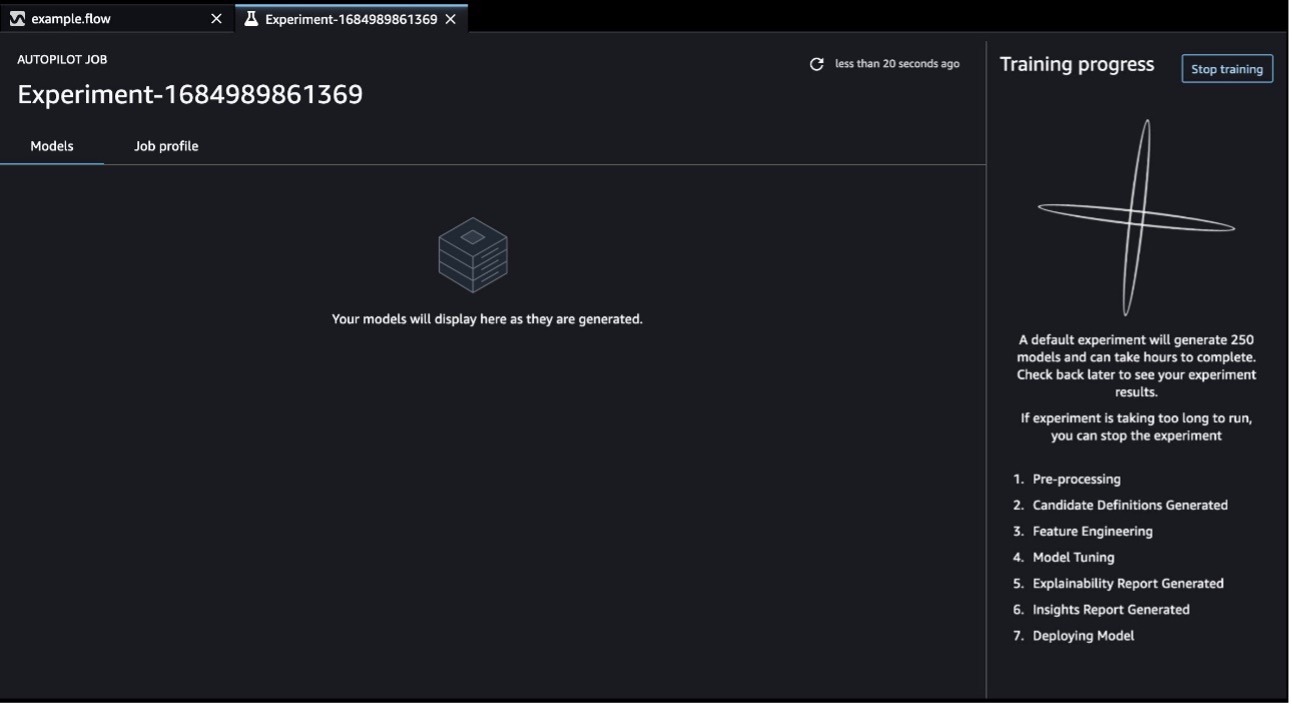

- Überprüfen Sie abschließend die Jobkonfiguration und reichen Sie das SageMaker Autopilot-Experiment zur Schulung ein. Wenn SageMaker Autopilot das Experiment abschließt, können Sie die Trainingsergebnisse anzeigen und das beste Modell erkunden.

Dank der Unterstützung für Manifestdateien können Sie Ihren gesamten Datensatz für das SageMaker Autopilot-Experiment verwenden, nicht nur eine Teilmenge Ihrer Daten.

Weitere Informationen zur Verwendung von SageMaker Autopilot mit SageMaker Data Wrangler finden Sie unter Einheitliche Datenvorbereitung und Modellschulung mit Amazon SageMaker Data Wrangler und Amazon SageMaker Autopilot.

Generieren Sie Inferenzartefakte aus SageMaker-Verarbeitungsaufträgen

Schauen wir uns nun an, wie wir Inferenzartefakte sowohl über die SageMaker Data Wrangler-Benutzeroberfläche als auch über die SageMaker Data Wrangler-Notizbücher generieren können.

SageMaker Data Wrangler-Benutzeroberfläche

Für unseren Anwendungsfall möchten wir unsere Daten über die Benutzeroberfläche verarbeiten und die resultierenden Daten dann verwenden, um ein Modell über die SageMaker-Konsole zu trainieren und bereitzustellen. Führen Sie die folgenden Schritte aus:

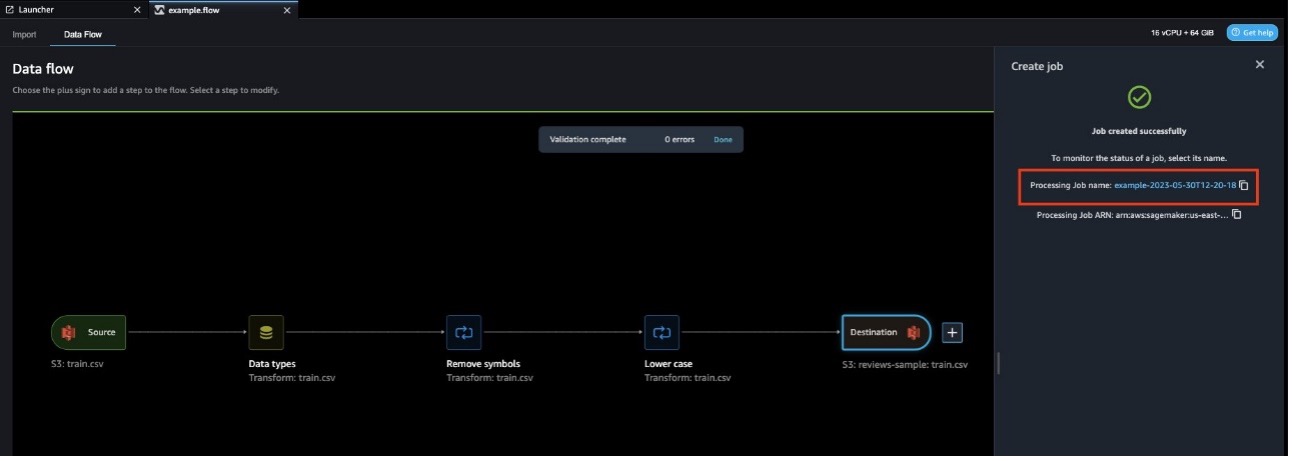

- Öffnen Sie den Datenfluss, den Sie im vorherigen Abschnitt erstellt haben.

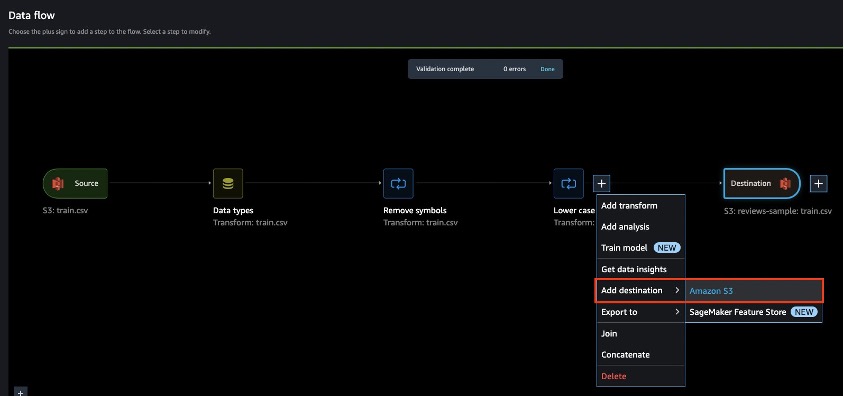

- Wählen Sie das Pluszeichen neben der letzten Transformation und wählen Sie Ziel hinzufügen, und wähle Amazon S3. Dort werden die verarbeiteten Daten gespeichert.

- Auswählen

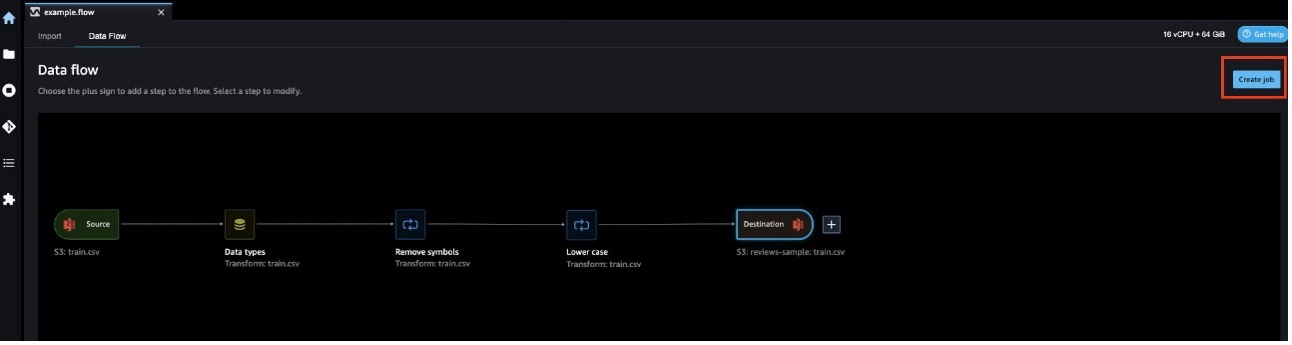

Job erstellen.

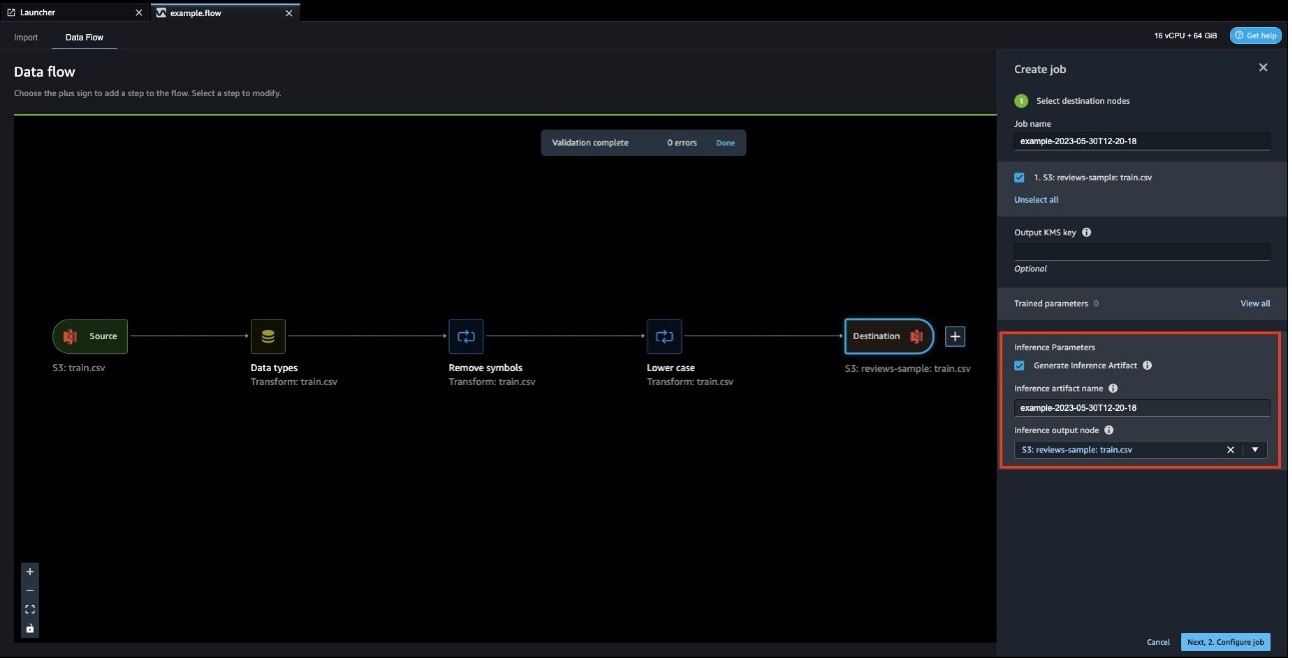

- Auswählen Generieren Sie Inferenzartefakte im Abschnitt „Inferenzparameter“, um ein Inferenzartefakt zu generieren.

- Geben Sie als Name des Inferenzartefakts den Namen Ihres Inferenzartefakts ein (mit .tar.gz als Dateierweiterung).

- Geben Sie als Inferenz-Ausgabeknoten den Zielknoten ein, der den auf Ihre Trainingsdaten angewendeten Transformationen entspricht.

- Auswählen

Job konfigurieren.

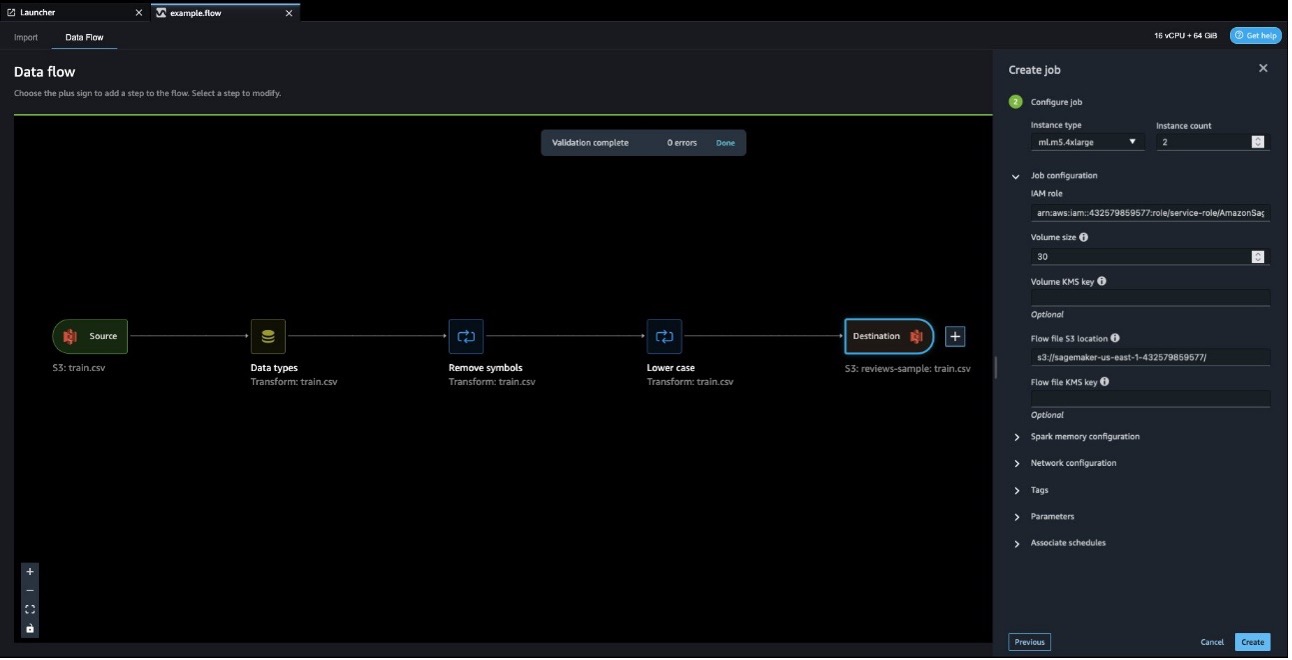

- Der Jobkonfiguration, geben Sie einen Pfad für ein S3-Speicherort der Flow-Datei. Ein Ordner namens

data_wrangler_flowswird unter diesem Speicherort erstellt und das Inferenzartefakt wird in diesen Ordner hochgeladen. Um den Upload-Speicherort zu ändern, legen Sie einen anderen S3-Speicherort fest. - Belassen Sie die Standardeinstellungen für alle anderen Optionen und wählen Sie Erstellen um den Bearbeitungsauftrag anzulegen.

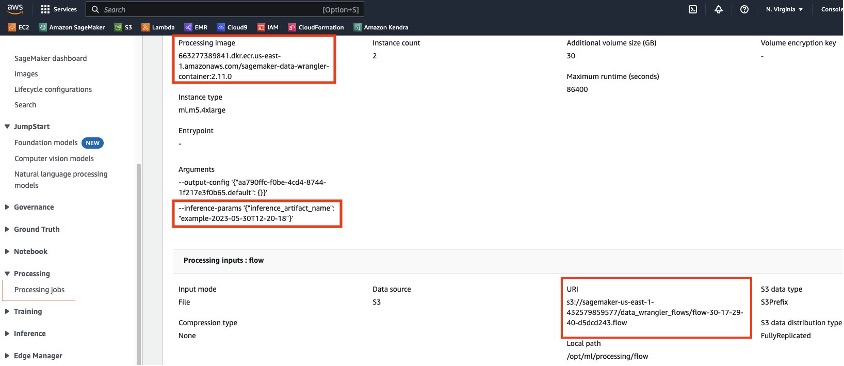

Durch den Verarbeitungsauftrag wird ein erstellttarball (.tar.gz)Enthält eine geänderte Datenflussdatei mit einem neu hinzugefügten Inferenzabschnitt, der es Ihnen ermöglicht, sie für Inferenzen zu verwenden. Sie benötigen den S3 Uniform Resource Identifier (URI) des Inferenzartefakts, um das Artefakt bei der Bereitstellung Ihrer Inferenzlösung einem SageMaker-Modell bereitzustellen. Der URI wird im Formular vorliegen{Flow file S3 location}/data_wrangler_flows/{inference artifact name}.tar.gz. - Wenn Sie diese Werte vorher nicht notiert haben, können Sie über den Link zum Verarbeitungsauftrag die entsprechenden Details finden. In unserem Beispiel lautet der URI

s3://sagemaker-us-east-1-43257985977/data_wrangler_flows/example-2023-05-30T12-20-18.tar.gz.

- Kopieren Sie den Wert von Bild wird verarbeitet; Wir benötigen diesen URI auch beim Erstellen unseres Modells.

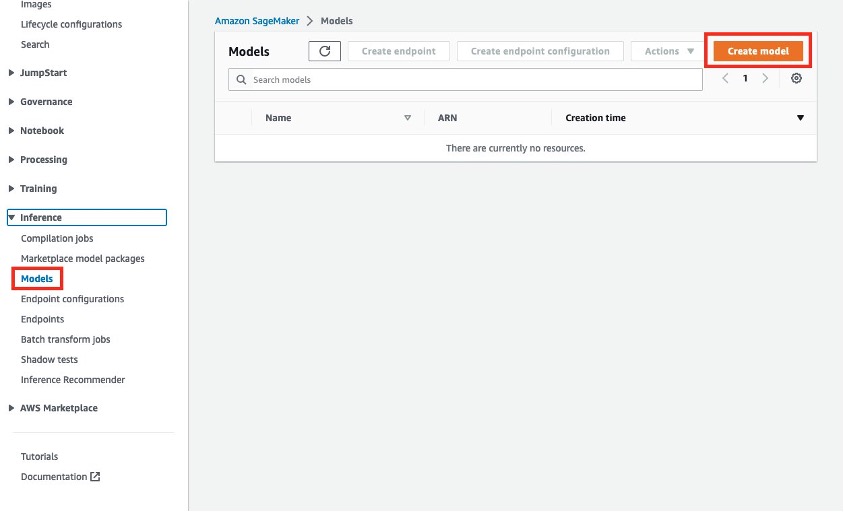

- Mit diesem URI können wir nun ein SageMaker-Modell auf der SageMaker-Konsole erstellen, das wir später auf einem Endpunkt oder einem Batch-Transformationsauftrag bereitstellen können.

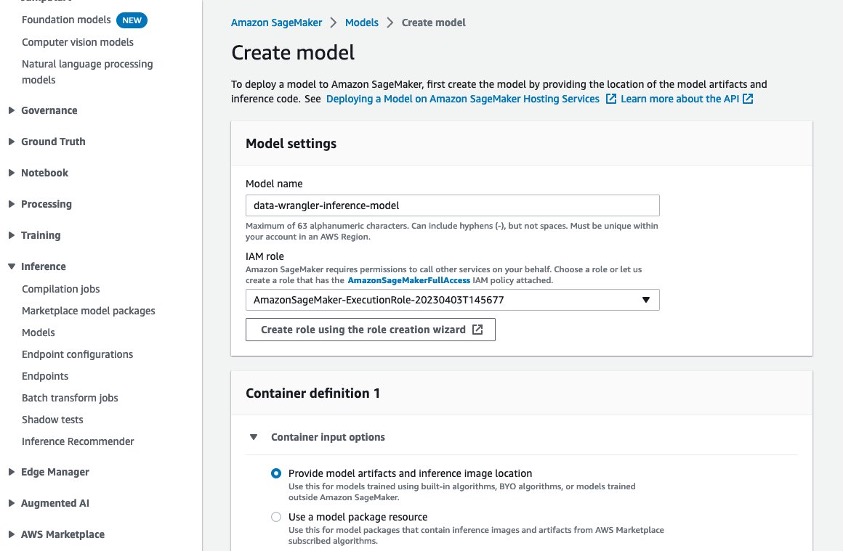

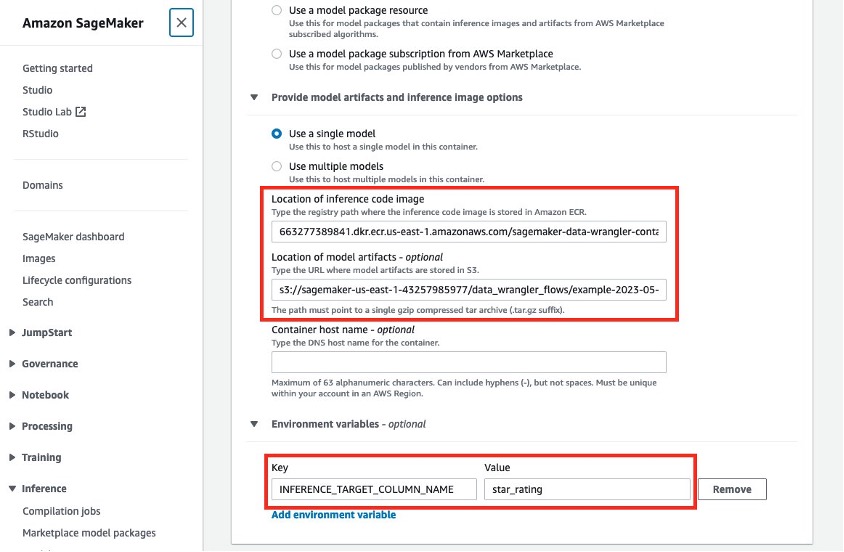

- Der Modelleinstellungen¸ Geben Sie einen Modellnamen ein und geben Sie Ihre IAM-Rolle an.

- Aussichten für Optionen für die ContainereingabeWählen Geben Sie Modellartefakte und die Position des Inferenzbilds an.

- Aussichten für Speicherort des InferenzcodebildsGeben Sie den URI des Verarbeitungsbilds ein.

- Aussichten für Position der ModellartefakteGeben Sie den Inferenzartefakt-URI ein.

- Wenn Ihre Daten außerdem über eine Zielspalte verfügen, die von einem trainierten ML-Modell vorhergesagt wird, geben Sie unten den Namen dieser Spalte an Umgebungsvariablen, mit

INFERENCE_TARGET_COLUMN_NAMEas Wesentliche und der Spaltenname als Wert.

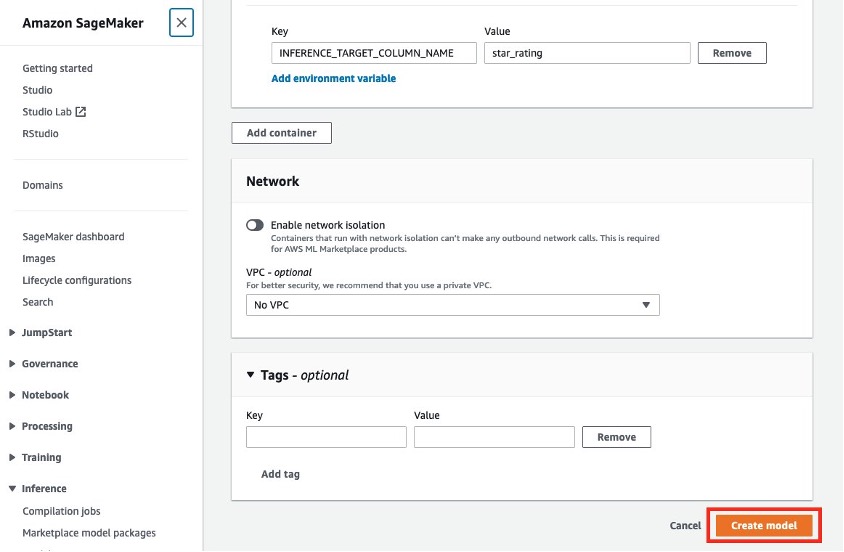

- Beenden Sie die Erstellung Ihres Modells, indem Sie auswählen Modell erstellen.

Wir haben jetzt ein Modell, das wir auf einem Endpunkt oder einem Batch-Transformationsauftrag bereitstellen können.

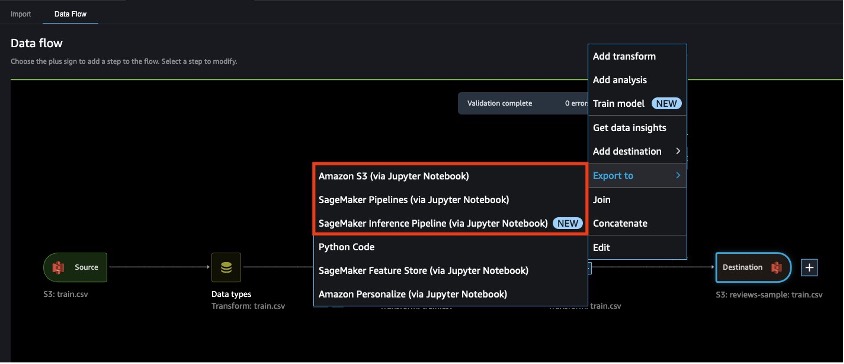

SageMaker Data Wrangler-Notizbücher

Für einen Code-First-Ansatz zum Generieren des Inferenzartefakts aus einem Verarbeitungsauftrag können wir den Beispielcode finden, indem wir auswählen Exportieren nach im Knotenmenü und wählen Sie eines aus Amazon S3, SageMaker-Pipelines, oder SageMaker-Inferenzpipeline. Wir wählen SageMaker-Inferenzpipeline in diesem Beispiel.

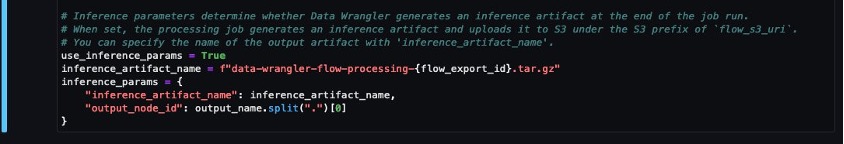

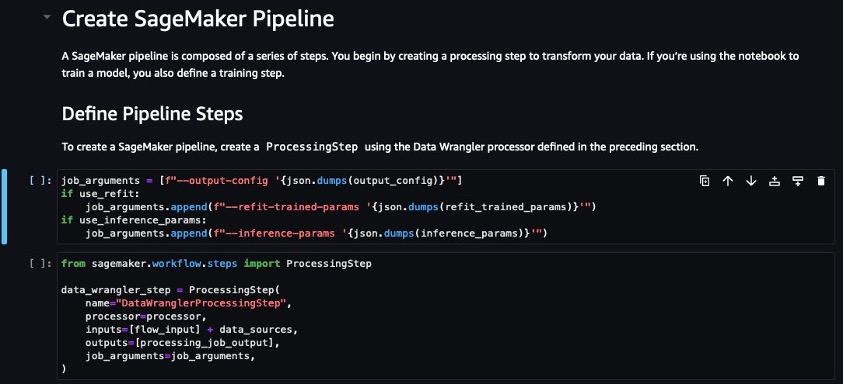

In diesem Notizbuch gibt es einen Abschnitt mit der Überschrift Prozessor erstellen (Dies ist im SageMaker Pipelines-Notizbuch identisch, aber im Amazon S3-Notizbuch befindet sich der entsprechende Code unter Jobkonfigurationen Abschnitt). Am Ende dieses Abschnitts finden Sie eine Konfiguration für unser Inferenzartefakt namens inference_params. Es enthält dieselben Informationen, die wir in der Benutzeroberfläche gesehen haben, nämlich den Namen des Inferenzartefakts und den Inferenzausgabeknoten. Diese Werte werden vorab ausgefüllt, können aber geändert werden. Zusätzlich gibt es einen Parameter namens use_inference_params, was eingestellt werden muss True um diese Konfiguration im Verarbeitungsauftrag zu verwenden.

Weiter unten befindet sich ein Abschnitt mit dem Titel Definieren Sie Pipeline-Schritte, Wobei die inference_params Die Konfiguration wird an eine Liste von Jobargumenten angehängt und an die Definition für einen SageMaker Data Wrangler-Verarbeitungsschritt übergeben. Im Amazon S3-Notebook job_arguments wird unmittelbar nach dem definiert Jobkonfigurationen .

Mit diesen einfachen Konfigurationen generiert der von diesem Notebook erstellte Verarbeitungsauftrag ein Inferenzartefakt am selben S3-Speicherort wie unsere Flow-Datei (zuvor in unserem Notebook definiert). Wir können diesen S3-Speicherort programmgesteuert bestimmen und dieses Artefakt verwenden, um ein SageMaker-Modell mit zu erstellen SageMaker Python-SDK, was im SageMaker Inference Pipeline-Notizbuch demonstriert wird.

Der gleiche Ansatz kann auf jeden Python-Code angewendet werden, der einen SageMaker Data Wrangler-Verarbeitungsauftrag erstellt.

Unterstützung des JSON-Dateiformats für die Eingabe und Ausgabe während der Inferenz

Es ist durchaus üblich, dass Websites und Anwendungen JSON als Anfrage/Antwort für APIs verwenden, damit die Informationen von verschiedenen Programmiersprachen leicht analysiert werden können.

Bisher konnten Sie, nachdem Sie ein trainiertes Modell hatten, nur über CSV als Eingabeformat in einer SageMaker Data Wrangler-Inferenzpipeline damit interagieren. Heutzutage können Sie JSON als Eingabe- und Ausgabeformat verwenden, was mehr Flexibilität bei der Interaktion mit SageMaker Data Wrangler-Inferenzcontainern bietet.

Führen Sie die folgenden Schritte aus, um mit der Verwendung von JSON für die Eingabe und Ausgabe im Inferenzpipeline-Notebook zu beginnen:

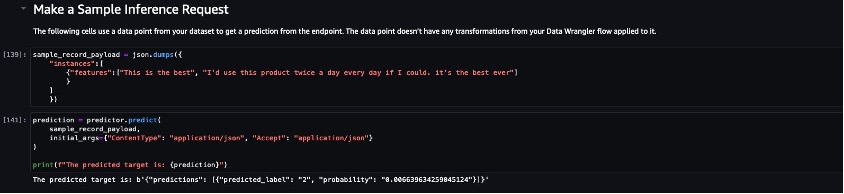

- Definieren Sie eine Nutzlast.

Für jede Nutzlast erwartet das Modell einen Schlüssel mit dem Namen „Instanzen“. Der Wert ist eine Liste von Objekten, von denen jedes ein eigener Datenpunkt ist. Die Objekte erfordern einen Schlüssel namens „Features“, und die Werte sollten die Features eines einzelnen Datenpunkts sein, die an das Modell übermittelt werden sollen. In einer einzigen Anfrage können mehrere Datenpunkte übermittelt werden, bis zu einer Gesamtgröße von 6 MB pro Anfrage.

Siehe folgenden Code:

- Präzisiere das

ContentTypeasapplication/json. - Stellen Sie dem Modell Daten zur Verfügung und erhalten Sie Rückschlüsse im JSON-Format.

See Gängige Datenformate für Inferenz für Beispiel-Eingabe- und Ausgabe-JSON-Beispiele.

Aufräumen

Wenn Sie SageMaker Data Wrangler nicht mehr verwenden, empfehlen wir Ihnen, die Instanz herunterzufahren, auf der es ausgeführt wird, um zusätzliche Kosten zu vermeiden. Anweisungen zum Herunterfahren der SageMaker Data Wrangler-App und der zugehörigen Instanz finden Sie unter Beenden Sie Data Wrangler.

Zusammenfassung

Die neuen Funktionen von SageMaker Data Wrangler, darunter die Unterstützung von S3-Manifestdateien, Inferenzfunktionen und die Integration des JSON-Formats, verändern das Betriebserlebnis der Datenvorbereitung. Diese Verbesserungen optimieren den Datenimport, automatisieren Datentransformationen und vereinfachen die Arbeit mit JSON-Daten. Mit diesen Funktionen können Sie Ihre betriebliche Effizienz steigern, den manuellen Aufwand reduzieren und ganz einfach wertvolle Erkenntnisse aus Ihren Daten gewinnen. Nutzen Sie die Leistungsfähigkeit der neuen Funktionen von SageMaker Data Wrangler und schöpfen Sie das volle Potenzial Ihrer Datenvorbereitungs-Workflows aus.

Um mit SageMaker Data Wrangler zu beginnen, lesen Sie die neuesten Informationen zum SageMaker Data Wrangler-Produktseite.

Über die Autoren

Munisch Dabra ist Principal Solutions Architect bei Amazon Web Services (AWS). Seine aktuellen Schwerpunkte sind KI/ML und Observability. Er verfügt über umfassende Erfahrung im Entwurf und Aufbau skalierbarer verteilter Systeme. Es macht ihm Spaß, Kunden bei der Innovation und Transformation ihres Geschäfts in AWS zu unterstützen. LinkedIn: /mdabra

Munisch Dabra ist Principal Solutions Architect bei Amazon Web Services (AWS). Seine aktuellen Schwerpunkte sind KI/ML und Observability. Er verfügt über umfassende Erfahrung im Entwurf und Aufbau skalierbarer verteilter Systeme. Es macht ihm Spaß, Kunden bei der Innovation und Transformation ihres Geschäfts in AWS zu unterstützen. LinkedIn: /mdabra

Patrick Lin ist Softwareentwicklungsingenieur bei Amazon SageMaker Data Wrangler. Er setzt sich dafür ein, Amazon SageMaker Data Wrangler zum Datenvorbereitungstool Nummer eins für produktive ML-Workflows zu machen. Außerhalb der Arbeit liest er, hört Musik, führt Gespräche mit Freunden und dient in seiner Kirche.

Patrick Lin ist Softwareentwicklungsingenieur bei Amazon SageMaker Data Wrangler. Er setzt sich dafür ein, Amazon SageMaker Data Wrangler zum Datenvorbereitungstool Nummer eins für produktive ML-Workflows zu machen. Außerhalb der Arbeit liest er, hört Musik, führt Gespräche mit Freunden und dient in seiner Kirche.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/optimize-data-preparation-with-new-features-in-aws-sagemaker-data-wrangler/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 100

- 1996

- 2014

- 7

- 8

- 9

- a

- Aktionen

- hinzugefügt

- Zusätzliche

- zusätzlich

- angenommen

- Nach der

- AI / ML

- Alle

- Zulassen

- erlaubt

- ebenfalls

- Amazon

- Amazon Sage Maker

- Amazon SageMaker-Autopilot

- Amazon SageMaker Data Wrangler

- Amazon Web Services

- Amazon Web Services (AWS)

- Beträge

- an

- und

- jedem

- APIs

- App

- Anwendungen

- angewandt

- Bewerbung

- Ansatz

- SIND

- Bereiche

- Argumente

- AS

- damit verbundenen

- At

- automatisieren

- Im Prinzip so, wie Sie es von Google Maps kennen.

- vermeiden

- AWS

- Hintergrund

- basierend

- BE

- werden

- Sein

- BESTE

- Big

- beide

- Boden

- Break

- bauen

- Building

- eingebaut

- Geschäft

- aber

- by

- namens

- CAN

- Fähigkeiten

- Häuser

- Übernehmen

- Gebühren

- aus der Ferne überprüfen

- Auswählen

- Auswahl

- Kirche

- Reinigung

- Code

- Kolonne

- begangen

- gemeinsam

- kompatibel

- abschließen

- Wird abgeschlossen

- Konfiguration

- Konsul (Console)

- verbraucht

- Behälter

- enthält

- Gespräche

- Dazugehörigen

- könnte

- erstellen

- erstellt

- schafft

- Erstellen

- kritischem

- Strom

- Kunde

- Kunden

- technische Daten

- Data Exchange

- Datenpunkte

- Datenaufbereitung

- Datenverarbeitung

- datengesteuerte

- Datensätze

- Tag

- entscheidet

- defaults

- definiert

- Definition

- vertiefen

- Synergie

- einsetzen

- Bereitstellen

- Einsatz

- entworfen

- Entwerfen

- Reiseziel

- Details

- Bestimmen

- Entwicklung

- anders

- diskutieren

- verteilt

- verteilte Systeme

- do

- nach unten

- im

- jeder

- Früher

- erleichtern

- einfacher

- Einfache

- Ecosystems

- Effizienz

- effizient

- effizient

- Anstrengung

- entweder

- umarmen

- ermöglicht

- ermöglichen

- End-to-End

- Endpunkt

- Ingenieur

- Entwicklung

- zu steigern,

- Verbesserungen

- Verbessert

- Enter

- Ganz

- Arbeitsumfeld

- Äquivalent

- insbesondere

- ÜBERHAUPT

- Jedes

- jeden Tag

- alles

- Beispiel

- Beispiele

- Austausch-

- erwartet

- ERFAHRUNGEN

- Experiment

- Experimente

- Exploration

- ERKUNDEN

- exportieren

- Ausfuhr

- Erweiterung

- Extrakt

- Merkmal

- Eigenschaften

- wenige

- Reichen Sie das

- Mappen

- Finden Sie

- Flexibilität

- Fluss

- Fließt

- Setzen Sie mit Achtsamkeit

- folgen

- Folgende

- Aussichten für

- unten stehende Formular

- Format

- Freunde

- für

- voller

- weiter

- erzeugen

- erzeugt

- bekommen

- sehr

- hätten

- Griff

- Haben

- mit

- he

- Unternehmen

- GUTE

- Hervorheben

- ihm

- seine

- Ultraschall

- Hilfe

- HTML

- HTTPS

- i

- identisch

- Kennzeichnung

- if

- Image

- sofort

- importieren

- Einfuhr

- zu unterstützen,

- in

- Dazu gehören

- Einschließlich

- Information

- wir innovieren

- Varianten des Eingangssignals:

- Einblicke

- Instanz

- Anleitung

- Integration

- beabsichtigt

- interagieren

- Interaktion

- interaktive

- Schnittstelle

- in

- intuitiv

- IT

- SEINE

- JavaScript

- Job

- jpg

- JSON

- Juli

- nur

- Wesentliche

- Sprachen

- grosse

- Nachname

- später

- neueste

- starten

- lernen

- lassen

- Niveau

- Gefällt mir

- Limitiert

- LINK

- Liste

- Hören

- Listen

- Standorte

- aussehen

- Maschine

- Maschinelles Lernen

- um

- Making

- verwalten

- manuell

- Kann..

- MENÜ

- Metadaten

- Methode

- könnte

- Million

- Minuten

- Kommt demnächst...

- ML

- MLOps

- Modell

- für

- modern

- geändert

- mehr

- effizienter

- mehrere

- Musik

- sollen

- Name

- Namens

- nämlich

- nativen

- notwendig,

- Need

- Bedürfnisse

- Neu

- Neue Funktionen

- neu

- weiter

- nicht

- Knoten

- Notizbuch

- jetzt an

- Anzahl

- Objekt

- Objekte

- of

- on

- EINEM

- einzige

- Betriebs-

- optimal

- Optimieren

- Option

- Optionen

- or

- Andere

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- aussen

- besitzen

- Parameter

- Parameter

- Bestanden

- Weg

- für

- Ausführen

- wählen

- Pipeline

- Plato

- Datenintelligenz von Plato

- PlatoData

- erfahren

- Points

- Punkte

- Post

- Potenzial

- Werkzeuge

- vorhersagen

- vorhergesagt

- Vorbereitung

- Danach

- bereit

- ziemlich

- vorher

- Principal

- Prozessdefinierung

- Verarbeitet

- Verarbeitung

- Produkt

- Produktrezensionen

- Produktion

- Programmatic

- Programmierung

- Programmiersprachen

- Projekt

- die

- Bereitstellung

- Python

- Lesebrillen

- Echtzeit

- erhalten

- empfehlen

- Veteran

- reduziert

- Release

- relevant

- entfernen

- vertreten

- Darstellen

- Anforderung

- erfordern

- Ressourcen

- was zu

- Die Ergebnisse

- Überprüfen

- Bewertungen

- Recht

- Rollen

- läuft

- s

- sagemaker

- SageMaker-Inferenz

- SageMaker-Pipelines

- gleich

- sah

- skalierbaren

- nahtlos

- nahtlos

- Abschnitt

- sehen

- Auswahl

- Auswahl

- Lösungen

- Dienst

- Sitzung

- kompensieren

- Einstellungen

- mehrere

- sollte

- erklären

- schließen

- Schild

- Einfacher

- vereinfachte

- vereinfachen

- Vereinfachung

- Single

- Größe

- klein

- kleinere

- So

- Software

- Software-Entwicklung

- Lösung

- Lösungen

- speziell

- gespalten

- Anfang

- begonnen

- Schritt

- Shritte

- Lagerung

- gelagert

- rationalisieren

- Rationalisierung

- stark

- strukturierte

- abschicken

- eingereicht

- so

- Support

- Unterstützt

- sicher

- Systeme und Techniken

- Nehmen

- nimmt

- Target

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- die Informationen

- ihr

- dann

- Dort.

- Diese

- fehlen uns die Worte.

- diejenigen

- Durch

- Zeit

- betitelt

- zu

- heute

- auch

- Werkzeug

- Werkzeuge

- Gesamt

- Training

- trainiert

- Ausbildung

- Transformieren

- Transformation

- Transformationen

- verwandelt

- Transformationen

- Twice

- ui

- für

- öffnen

- hochgeladen

- -

- Anwendungsfall

- benutzt

- Verwendung von

- wertvoll

- Wert

- Werte

- sehr

- Anzeigen

- Visualisierung

- wollen

- wollte

- we

- Netz

- Web-Services

- Webseiten

- Wochen

- GUT

- wann

- welche

- weit

- werden wir

- mit

- Arbeiten

- Arbeitsablauf.

- Workflows

- arbeiten,

- Du

- Ihr

- Zephyrnet