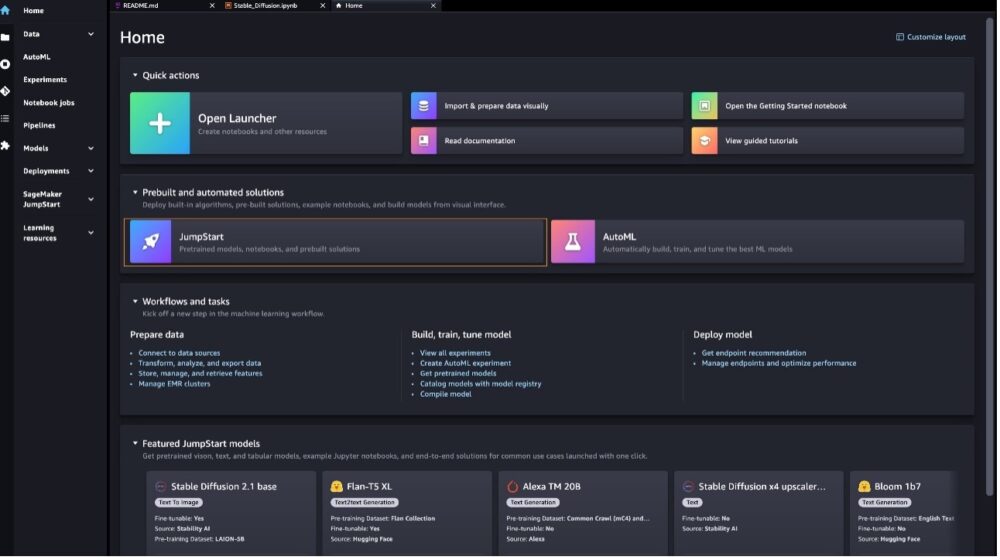

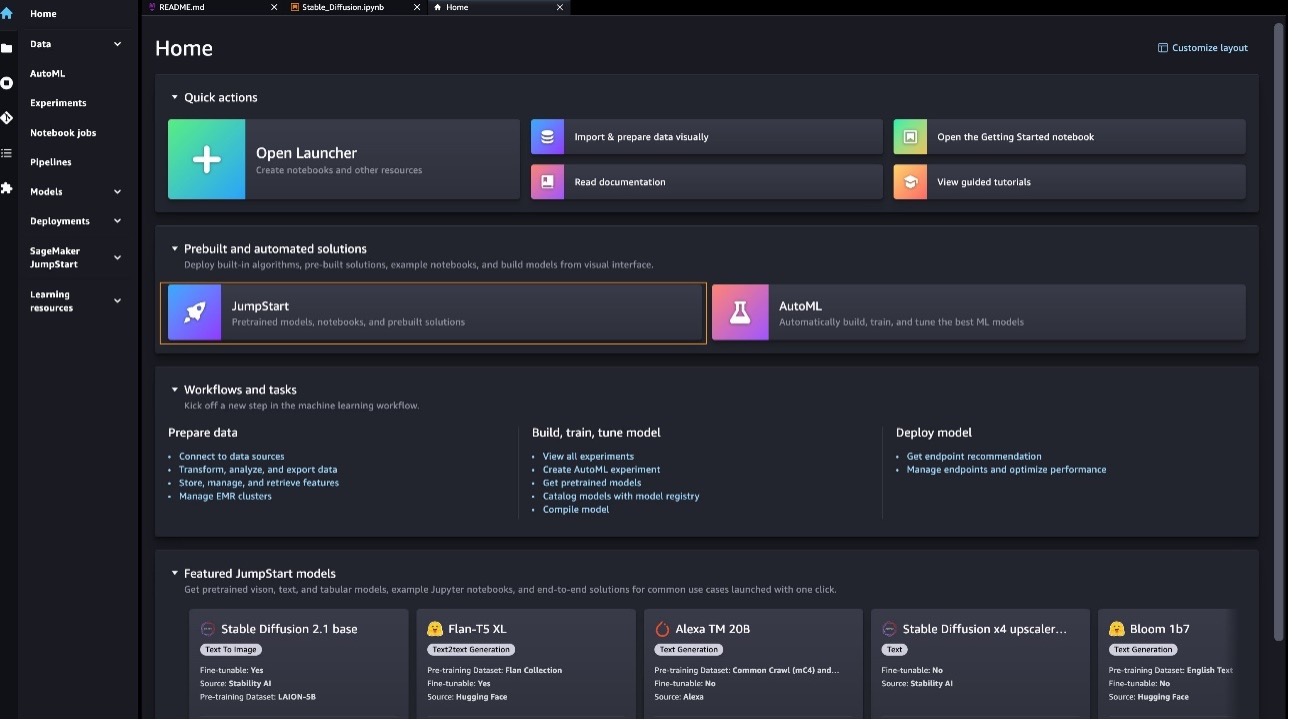

Amazon SageMaker-JumpStart ist ein Hub für maschinelles Lernen (ML), der Algorithmen, Modelle und ML-Lösungen anbietet. Mit SageMaker JumpStart können ML-Praktiker aus einer wachsenden Liste der leistungsstärksten und öffentlich verfügbaren Lösungen auswählen Gründungsmodelle (FMs) wie BLOOM, Lama 2, Falcon-40B, Stable Diffusion , OpenLLaMA, Flan-T5/UL2, oder FMs von Zusammenhängen und Licht an.

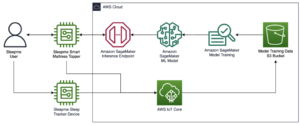

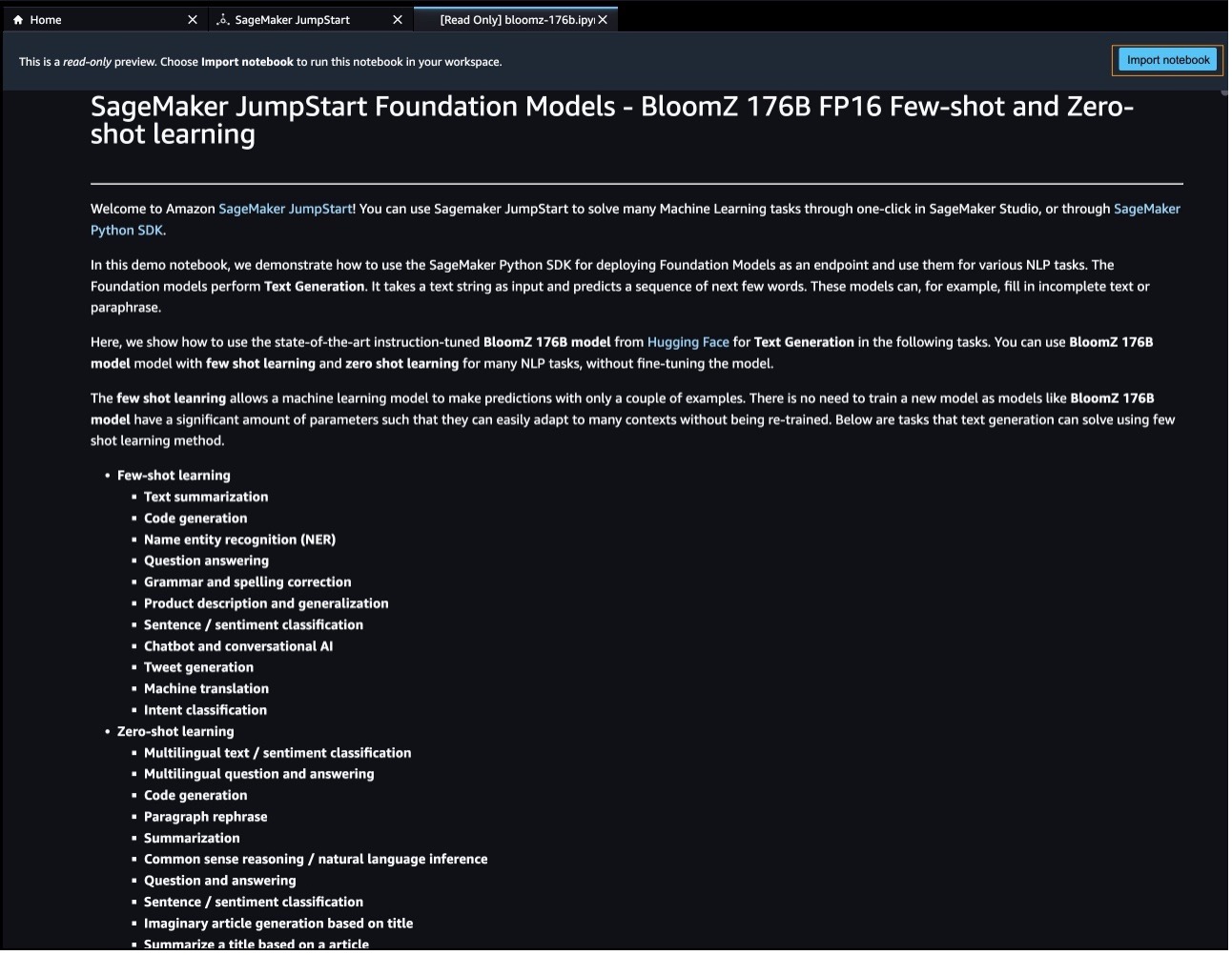

In diesem Beitrag und dem dazugehörigen Notizbuch zeigen wir, wie das BloomZ 176B-Grundlagenmodell mithilfe von bereitgestellt wird SageMaker Python vereinfachtes SDK in Amazon SageMaker-JumpStart als Endpunkt und verwenden Sie ihn für verschiedene Aufgaben der Verarbeitung natürlicher Sprache (NLP). Sie können auch auf die Fundamentmodelle zugreifen Amazon SageMaker-Studio. Das BloomZ 176B-Modell, eines der größten öffentlich verfügbaren Modelle, ist ein hochmodernes, auf Anweisungen abgestimmtes Modell, das verschiedene kontextbezogene NLP-Aufgaben für Wenig-Schuss-Lernen und Null-Schuss-Lernen ausführen kann. Bei der Anweisungsoptimierung handelt es sich um eine Technik, die die Feinabstimmung eines Sprachmodells anhand einer Sammlung von NLP-Aufgaben mithilfe von Anweisungen beinhaltet. Weitere Informationen zur Befehlsoptimierung finden Sie unter Zero-Shot-Eingabeaufforderung für das Flan-T5-Basismodell in Amazon SageMaker JumpStart.

Zero-Shot-Lernen im NLP ermöglicht es einem vorab trainierten LLM, Antworten auf Aufgaben zu generieren, für die es nicht speziell trainiert wurde. Bei dieser Technik wird dem Modell ein Eingabetext und eine Eingabeaufforderung bereitgestellt, die die erwartete Ausgabe des Modells in natürlicher Sprache beschreibt. Zero-Shot-Lernen wird in einer Vielzahl von NLP-Aufgaben eingesetzt, wie zum Beispiel den folgenden:

- Mehrsprachige Text- und Stimmungsklassifizierung

- Mehrsprachige Fragen und Antworten

- Codegenerierung

- Umformulierung des Absatzes

- Zusammenfassung

- Gesunder Menschenverstand und Schlussfolgerung in natürlicher Sprache

- Frage beantworten

- Klassifizierung von Sätzen und Stimmungen

- Generierung von imaginären Artikeln basierend auf einem Titel

- Einen Titel basierend auf einem Artikel zusammenfassen

Beim Few-Shot-Learning wird ein Modell trainiert, um neue Aufgaben auszuführen, indem nur wenige Beispiele bereitgestellt werden. Dies ist nützlich, wenn nur begrenzte gekennzeichnete Daten für das Training verfügbar sind. Few-Show-Learning wird bei einer Vielzahl von Aufgaben eingesetzt, darunter den folgenden:

- Textzusammenfassung

- Codegenerierung

- Erkennung von Namenseinheiten

- Frage beantworten

- Grammatik- und Rechtschreibkorrektur

- Produktbeschreibung und Verallgemeinerung

- Klassifizierung von Sätzen und Stimmungen

- Chatbot und Konversations-KI

- Tweet-Generierung

- Maschinenübersetzung

- Absichtsklassifizierung

Über Bloom

Das BigScience Large Open-Science Open-Access Multilingual (BLOOM)-Sprachmodell ist ein transformatorbasiertes Large Language Model (LLM). BLOOM ist ein autoregressives LLM, das darauf trainiert ist, Text aus einer Eingabeaufforderung auf riesigen Textdatenmengen unter Verwendung von Rechenressourcen im industriellen Maßstab fortzusetzen. Dadurch ist es in der Lage, kohärente Texte auszugeben, die kaum von von Menschen geschriebenen Texten zu unterscheiden sind. BLOOM kann auch angewiesen werden, Textaufgaben auszuführen, für die es nicht explizit trainiert wurde, indem es sie in Textgenerierungsaufgaben umwandelt.

Mit seinen 176 Milliarden Parametern ist BLOOM in der Lage, Texte in 46 natürlichen Sprachen und 13 Programmiersprachen zu generieren. Für fast alle davon, wie Spanisch, Französisch und Arabisch, ist BLOOM das erste Sprachmodell mit über 100 Milliarden Parametern, das jemals erstellt wurde. Forscher können Laden Sie BLOOM herunter, führen Sie es aus und studieren Sie es Untersuchung der Leistung und des Verhaltens neu entwickelter LLMs bis hin zu ihren tiefsten internen Abläufen.

Lösungsüberblick

In diesem Beitrag zeigen wir, wie Sie das hochmoderne, anweisungsoptimierte BloomZ 176B-Modell von verwenden Gesicht umarmen zur Textgenerierung. Sie können das BloomZ 176B-Modell mit Few-Shot-Learning und Zero-Shot-Lernen für viele NLP-Aufgaben verwenden, ohne das Modell fein abzustimmen. Es besteht keine Notwendigkeit, ein neues Modell zu trainieren, da Modelle wie BloomZ 176B über eine beträchtliche Anzahl von Parametern verfügen, sodass sie sich problemlos an viele Kontexte anpassen lassen, ohne dass sie erneut trainiert werden müssen. Das BloomZ 176B-Modell wurde mit einer großen Datenmenge trainiert, sodass es für viele allgemeine Aufgaben anwendbar ist.

Der Code für alle Schritte in dieser Demo ist im Folgenden verfügbar Notizbuch.

Anleitung zum Stimmen

Die Größe und Komplexität von LLMs ist in den letzten Jahren explosionsartig gestiegen. LLMs haben bemerkenswerte Fähigkeiten beim Erlernen der Semantik natürlicher Sprache und beim Erzeugen menschenähnlicher Antworten bewiesen. Viele neuere LLMs werden mit einer leistungsstarken Technik namens „ Anleitung tunen, die dem Modell hilft, neue Aufgaben auszuführen oder Antworten auf neue Eingabeaufforderungen zu generieren, ohne dass eine eingabeaufforderungsspezifische Feinabstimmung erforderlich ist. Ein auf Anweisungen abgestimmtes Modell verwendet sein Verständnis verwandter Aufgaben oder Konzepte, um Vorhersagen für neuartige Eingabeaufforderungen zu generieren. Da diese Technik keine Aktualisierung von Modellgewichten beinhaltet, vermeidet sie den zeitaufwändigen und rechenintensiven Prozess, der erforderlich ist, um ein Modell für eine neue, zuvor unbekannte Aufgabe fein abzustimmen.

Bei der Anweisungsoptimierung geht es um die Feinabstimmung eines Sprachmodells für eine Sammlung von NLP-Aufgaben mithilfe von Anweisungen. Bei dieser Technik wird das Modell darauf trainiert, Aufgaben auszuführen, indem es Textanweisungen anstelle spezifischer Datensätze für jede Aufgabe befolgt. Das Modell wird mit einer Reihe von Eingabe- und Ausgabebeispielen für jede Aufgabe verfeinert, sodass das Modell auf neue Aufgaben verallgemeinert werden kann, für die es nicht explizit trainiert wurde, solange Eingabeaufforderungen für die Aufgaben bereitgestellt werden. Die Befehlsoptimierung trägt zur Verbesserung der Genauigkeit und Effektivität von Modellen bei und ist in Situationen hilfreich, in denen für bestimmte Aufgaben keine großen Datensätze verfügbar sind.

Schnelles Engineering für Zero-Shot- und Few-Shot-NLP-Aufgaben auf BLOOM-Modellen

Schnelles Engineering befasst sich mit der Erstellung hochwertiger Eingabeaufforderungen, um das Modell zu den gewünschten Antworten zu führen. Eingabeaufforderungen müssen basierend auf der spezifischen Aufgabe und dem verwendeten Datensatz entworfen werden. Ziel ist es, das Modell mit den notwendigen Informationen zu versorgen, um qualitativ hochwertige Antworten zu generieren und gleichzeitig das Rauschen zu minimieren. Dies kann Schlüsselwörter, zusätzliche Kontexte, Fragen und mehr umfassen.

Eine gut gestaltete Eingabeaufforderung kann das Modell kreativer und allgemeiner machen, sodass es sich leicht an neue Aufgaben anpassen lässt. Eingabeaufforderungen können auch dazu beitragen, Domänenwissen für bestimmte Aufgaben zu integrieren und die Interpretierbarkeit zu verbessern. Prompt Engineering kann die Leistung von Null-Schuss- und Wenig-Schuss-Lernmodellen erheblich verbessern. Das Erstellen qualitativ hochwertiger Eingabeaufforderungen erfordert eine sorgfältige Prüfung der jeweiligen Aufgabe sowie ein tiefes Verständnis der Stärken und Grenzen des Modells.

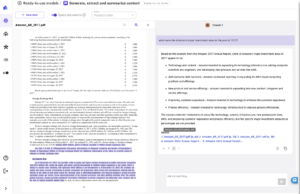

In der folgenden Tabelle wird das BloomZ 176B-Modell verwendet, um Antworten für verschiedene Zero-Shot- und Few-Shot-NLP-Aufgaben zu generieren. Die erste Spalte zeigt die Aufgabe, die zweite Spalte enthält die für das Modell bereitgestellte Eingabeaufforderung (wobei der Vorlagentext fett gedruckt ist und der nicht fette Text die Beispieleingabe darstellt) und die dritte Spalte enthält die Antwort des Modells bei Abfrage anhand der Eingabeaufforderung

Für alle folgenden Aufgaben setzen wir die Hyperparameter auf 600 max_length, num_return_sequences, top_k 250 sein, top_p 0.95 betragen und keine Probenahme erfolgen.

| Aufgabe | Prompte Eingabe | Output |

| Zero-Shot-Lernaufgaben | ||

| Mehrsprachige Text- oder Stimmungsklassifizierung (Chinesisch nach Englisch) | 一个传奇的开端, 一个不灭的神话,这不仅仅是一部电影,而是作为一个走进新时代的标签,永远彪炳史册.Würden Sie die vorherige Bewertung als positiv, neutral oder negativ bewerten? | positiv |

| Mehrsprachige Beantwortung von Fragen (Englisch nach Chinesisch) | Erklären Sie es mir auf traditionellem Chinesisch Was ist die Backpropagation? | 梯度反向传播算法是一种机器学习算法,用于训练人工神经网络.该算法使用梯度下降来最小化损失函数. |

| Codegenerierung | Schreiben binärer Suchbaum mit O(log(n)) Rechenkomplexität. {code_start} |

def binäre_suche(a, x): niedrig = 0 hoch = len(a) – 1 während niedrig <= hoch: Mitte = (niedrig + hoch) // 2 wenn a[mid] < x: niedrig = mittel + 1 elif a[mid] > x: hoch = mittel – 1 sonst: Rückkehr Mitte Rückkehr -1′ ... sonst: Rückkehr Mitte Rückkehr niedrig' Die Ausgabe wird abgeschnitten |

| Absatzumformulierung | Amazon Web Services (AWS) hat neun wichtige neue Updates für seine cloudbasierte Plattform für maschinelles Lernen, SageMaker, angekündigt. Ziel von SageMaker ist die Bereitstellung eines maschinellen Lerndienstes, mit dem ML-Modelle für nahezu jeden Anwendungsfall erstellt, trainiert und bereitgestellt werden können. Während der diesjährigen re:Invent-Konferenz machte AWS mehrere Ankündigungen, um die Fähigkeiten von SageMaker weiter zu verbessern.nnWie würden Sie das kurz auf Englisch umformulieren?,Amazon Web Services (AWS) hat neun wichtige neue Updates für seine cloudbasierte Plattform für maschinelles Lernen, SageMaker, angekündigt. Ziel von SageMaker ist die Bereitstellung eines maschinellen Lerndienstes, mit dem ML-Modelle für nahezu jeden Anwendungsfall erstellt, trainiert und bereitgestellt werden können. Während der diesjährigen re:Invent-Konferenz machte AWS mehrere Ankündigungen, um die Fähigkeiten von SageMaker weiter zu verbessern. NDer obige Satz ist sehr kompliziert. Bitte stellen Sie mir eine vereinfachte, synonyme Version mit mehreren Sätzen zur Verfügung: |

Amazon SageMaker erhält ein großes Update Amazon Web Services (AWS) hat neun wichtige neue Updates für seine cloudbasierte Plattform für maschinelles Lernen, SageMaker, angekündigt. Ziel von SageMaker ist die Bereitstellung eines maschinellen Lerndienstes, mit dem ML-Modelle für nahezu jeden Anwendungsfall erstellt, trainiert und bereitgestellt werden können |

| Zusammenfassung | Amazon Comprehend verwendet Natural Language Processing (NLP), um Einblicke in den Inhalt von Dokumenten zu gewinnen. Es entwickelt Erkenntnisse, indem es die Entitäten, Schlüsselphrasen, Sprache, Stimmungen und andere gemeinsame Elemente in einem Dokument erkennt. Verwenden Sie Amazon Comprehend, um neue Produkte basierend auf dem Verständnis der Struktur von Dokumenten zu erstellen. Mit Amazon Comprehend können Sie beispielsweise Social-Networking-Feeds nach Erwähnungen von Produkten durchsuchen oder einen gesamten Dokumentenspeicher nach Schlüsselbegriffen durchsuchen. Sie können über die Amazon Comprehend-Konsole oder über die Amazon Comprehend-APIs auf die Dokumentenanalysefunktionen von Amazon Comprehend zugreifen. Sie können Echtzeitanalysen für kleine Workloads ausführen oder asynchrone Analysejobs für große Dokumentensätze starten. Sie können die von Amazon Comprehend bereitgestellten vortrainierten Modelle verwenden oder Ihre eigenen benutzerdefinierten Modelle für die Klassifizierung und Entitätserkennung trainieren. Alle Amazon Comprehend-Funktionen akzeptieren UTF-8-Textdokumente als Eingabe. Darüber hinaus akzeptieren die benutzerdefinierte Klassifizierung und die benutzerdefinierte Entitätserkennung Bilddateien, PDF-Dateien und Word-Dateien als Eingabe. Abhängig von der jeweiligen Funktion kann Amazon Comprehend Dokumente in verschiedenen Sprachen untersuchen und analysieren. Weitere Informationen finden Sie unter In Amazon Comprehend unterstützte Sprachen. Die Dominant-Sprache-Funktion von Amazon Comprehend kann Dokumente untersuchen und die dominante Sprache für eine weitaus größere Auswahl an Sprachen bestimmen.nn===nSchreiben Sie eine Zusammenfassung des vorherigen Textes auf Englisch: |

Amazon Comprehend verwendet Natural Language Processing (NLP), um Einblicke in den Inhalt von Dokumenten zu gewinnen. Es entwickelt Erkenntnisse, indem es die Entitäten, Schlüsselphrasen, Sprache, Stimmungen und andere gemeinsame Elemente in einem Dokument erkennt. Verwenden Sie Amazon Comprehend, um neue Produkte basierend auf dem Verständnis der Struktur von Dokumenten zu erstellen. Mit Amazon Comprehend können Sie beispielsweise Social-Networking-Feeds nach Erwähnungen von Produkten durchsuchen oder einen gesamten Dokumentenspeicher nach Schlüsselbegriffen durchsuchen. Sie können über die Amazon Comprehend-Konsole oder über die Amazon Comprehend-APIs auf die Dokumentenanalysefunktionen von Amazon Comprehend zugreifen. Sie können Echtzeitanalysen für kleine Workloads ausführen oder asynchrone Analysejobs für große Dokumentensätze starten. Sie können die von Amazon Comprehend bereitgestellten vortrainierten Modelle verwenden oder Ihre eigenen benutzerdefinierten Modelle für die Klassifizierung und Entitätserkennung trainieren. Alle Amazon Comprehend-Funktionen akzeptieren UTF-8-Textdokumente als Eingabe. Darüber hinaus akzeptieren die benutzerdefinierte Klassifizierung und die benutzerdefinierte Entitätserkennung Bilddateien, PDF-Dateien und Word-Dateien als Eingabe. Amazon Comprehend kann je nach Funktion Dokumente in verschiedenen Sprachen untersuchen und analysieren. Weitere Informationen finden Sie unter In Amazon Comprehend unterstützte Sprachen. Die Dominant Language-Funktion von Amazon Comprehend kann Dokumente untersuchen und die dominante Sprache für eine weitaus größere Auswahl an Sprachen bestimmen. |

| Gesunder Menschenverstand und Schlussfolgerung in natürlicher Sprache | Da Die Weltmeisterschaft hat in Los Angeles, USA, begonnen. Folgt es dem? Die Weltmeisterschaft findet in den Vereinigten Staaten statt. Ja oder nein?, Die Weltmeisterschaft hat in Los Angeles, USA, begonnen. Verwenden Sie nur die obige Beschreibung und das, was Sie über die Welt wissen „Die Weltmeisterschaft findet in den Vereinigten Staaten statt“ definitiv richtig? Ja oder nein?, |

Ja |

| Frage beantworten | Frage: Was sind die Hauptfunktionen des neuen Kindle?nnKontext: Mit dem neuesten und innovativsten Kindle können Sie sich Notizen zu Millionen von Büchern und Dokumenten machen, Listen und Tagebücher schreiben und vieles mehr. Leser, die sich schon immer gewünscht haben, in ihre eBooks schreiben zu können, können mit dem neuen Kindle von Amazon genau das tun. Der Kindle Scribe ist der erste Kindle zum Lesen und Schreiben und ermöglicht es Benutzern, ihre Bücher und Dokumente mit Notizen, Listen und mehr zu ergänzen. Hier finden Sie alles, was Sie über Kindle Scribe wissen müssen, einschließlich häufig gestellter Fragen. Der Kindle Scribe macht es einfach, wie auf Papier zu lesen und zu schreiben Der Kindle Scribe verfügt über einen blendfreien 10.2-Zoll-Bildschirm (der größte aller Kindle-Geräte), eine gestochen scharfe Auflösung von 300 ppi und 35 LED-Frontlichter, die sich automatisch an Ihre Umgebung anpassen. Personalisieren Sie Ihr Erlebnis weiter mit dem einstellbaren warmen Licht, Schriftgrößen, Zeilenabstand und mehr. Sie haben die Wahl zwischen dem Basic-Stift oder dem Premium-Stift, mit dem Sie auf dem Bildschirm wie auf Papier schreiben können. Sie haften auch magnetisch an Ihrem Kindle und müssen nie aufgeladen werden. Der Premium-Stift enthält einen speziellen Radierer und eine anpassbare Schnellzugriffstaste. Der Kindle Scribe hat die meisten Speicheroptionen aller Kindle-Geräte: Wählen Sie aus 8 GB, 16 GB oder 32 GB, um Ihrem Lese- und Schreibniveau gerecht zu werden. nnAntworten |

Machen Sie sich Notizen zu Millionen von Büchern und Dokumenten, schreiben Sie Listen und Tagebücher und vieles mehr |

| Klassifizierung von Sätzen und Stimmungen | Bewertung: nDieser Film ist so toll und verzaubert und erfreut uns wieder einmalnIst dieser Filmkritiksatz negativ oder positiv?nOPTIONEN:n-positiv n-negativ | Stärken |

| Generierung imaginärer Artikel basierend auf dem Titel | Titel: „Die Universität hat eine neue Einrichtung im Bau„nStellen Sie sich den Artikel angesichts des obigen Titels eines imaginären Artikels vor.n“““ |

Das 1.2 Millionen Pfund teure Projekt sieht die Schaffung eines neuen Lehr- und Lernzentrums an der University of the Highlands and Islands (UHI) in Inverness vor. Es wird auf dem Gelände des ehemaligen Inverness College of Commerce errichtet. UHI sagte, die neue Einrichtung werde zum Lehren und Lernen sowie zur Unterstützung und Verwaltung der Studierenden genutzt. Die Universität sagte, es werde auch für Konferenzen und Veranstaltungen genutzt. Das neue Gebäude wird auf dem Gelände des ehemaligen Inverness College of Commerce errichtet Die Universität sagte, das neue Gebäude werde auf dem Gelände des ehemaligen Inverness College of Commerce errichtet, das 2013 geschlossen wurde. Es hieß, die neue Einrichtung werde für Lehr- und Lernzwecke sowie für die Betreuung und Verwaltung der Studierenden genutzt. Es würde auch für Konferenzen und Veranstaltungen genutzt werden. UHI sagte, die neue Einrichtung werde auf dem Gelände des ehemaligen Inverness College of Commerce errichtet Die Universität sagte, das neue Gebäude werde auf dem Gelände des ehemaligen Inverness College of Commerce errichtet, das 2013 geschlossen wurde. Es hieß, die neue Einrichtung werde für Lehr- und Lernzwecke sowie für die Betreuung und Verwaltung der Studierenden genutzt. UHI sagte, die neue Anlage werde auf dem Gelände des ehemaligen Inverness errichtet… |

| Einen Titel basierend auf dem Artikel zusammenfassen | „Mit dem neuesten und innovativsten Kindle aller Zeiten können Sie Notizen zu Millionen von Büchern und Dokumenten machen, Listen und Tagebücher schreiben und vieles mehr.“ Leser, die sich schon immer gewünscht haben, in ihre eBooks schreiben zu können, können mit dem neuen Kindle von Amazon genau das tun. Der Kindle Scribe ist der erste Kindle zum Lesen und Schreiben und ermöglicht es Benutzern, ihre Bücher und Dokumente mit Notizen, Listen und mehr zu ergänzen. Hier finden Sie alles, was Sie über Kindle Scribe wissen müssen, einschließlich häufig gestellter Fragen. Der Kindle Scribe macht es einfach, wie auf Papier zu lesen und zu schreiben Der Kindle Scribe verfügt über einen blendfreien 10.2-Zoll-Bildschirm (der größte aller Kindle-Geräte), eine gestochen scharfe Auflösung von 300 ppi und 35 LED-Frontlichter, die sich automatisch an Ihre Umgebung anpassen. Personalisieren Sie Ihr Erlebnis weiter mit dem einstellbaren warmen Licht, Schriftgrößen, Zeilenabstand und mehr. Sie haben die Wahl zwischen dem Basic-Stift oder dem Premium-Stift, mit dem Sie auf dem Bildschirm wie auf Papier schreiben können. Sie haften auch magnetisch an Ihrem Kindle und müssen nie aufgeladen werden. Der Premium-Stift enthält einen speziellen Radierer und eine anpassbare Schnellzugriffstaste. Der Kindle Scribe verfügt über die meisten Speicheroptionen aller Kindle-Geräte: Wählen Sie je nach Ihrem Lese- und Schreibniveau zwischen 8 GB, 16 GB oder 32 GB. nn nnGeben Sie mir einen guten Titel für den Artikel oben. |

Amazons Kindle Scribe: Alles, was Sie wissen müssen |

| Lernaufgaben mit wenigen Schüssen | ||

| Zusammenfassung | [Original]: Amazon-Wissenschaftler machen in Zusammenarbeit mit Forschern der University of Sheffield erstmals einen groß angelegten Datensatz zur Faktenextraktion und -verifizierung öffentlich zugänglich. Der Datensatz, der mehr als 185,000 evidenzbasierte Behauptungen umfasst, wird zur Verfügung gestellt, um hoffentlich Forschung und Entwicklung voranzutreiben, die sich mit den Problemen der Faktenextraktion und -überprüfung in Softwareanwendungen oder cloudbasierten Diensten befasst, die eine automatische Informationsextraktion durchführen. [Zusammenfassung]: Forscher von Amazon und der Universität machen Faktenextraktions- und Verifizierungsdatensätze öffentlich zugänglich. ### [Original]: Prime-Mitglieder in den USA können mit einer Prime-Mitgliedschaft noch mehr an ihre Haustür geliefert bekommen. Mitglieder können jetzt ein Jahr lang Grubhub+ im Wert von 9.99 $ pro Monat kostenlos genießen – ohne zusätzliche Kosten für ihre Prime-Mitgliedschaft. Um dieses Angebot zu aktivieren, besuchen Sie amazon.com/grubhub. Dieses neue Angebot beinhaltet unbegrenzte Lebensmittelliefergebühren von 0 $ für Bestellungen über 12 $ sowie exklusive Vergünstigungen für Grubhub+-Mitglieder und Belohnungen wie kostenloses Essen und Bestellrabatte. Darüber hinaus können Gäste „gut essen und gleichzeitig Gutes tun“, indem sie sich für das Donate the Change-Programm von Grubhub entscheiden, eine Spendeninitiative, die allein im Jahr 25 mehr als 2021 Millionen US-Dollar einbrachte und mehr als 20 Wohltätigkeitsorganisationen im ganzen Land zugute kam. [Zusammenfassung]: Prime-Mitglieder in den USA können Grubhub+ ein Jahr lang kostenlos genießen, ohne dass für berechtigte Bestellungen Gebühren für die Lieferung von Lebensmitteln anfallen. ### [Original]: Amazon-Wissenschaftler machen in Zusammenarbeit mit Forschern der University of Sheffield erstmals einen groß angelegten Datensatz zur Faktenextraktion und -verifizierung öffentlich zugänglich. Der Datensatz, der mehr als 185,000 evidenzbasierte Behauptungen umfasst, wird zur Verfügung gestellt, um hoffentlich Forschung und Entwicklung voranzutreiben, die sich mit den Problemen der Faktenextraktion und -überprüfung in Softwareanwendungen oder cloudbasierten Diensten befasst, die eine automatische Informationsextraktion durchführen. [Zusammenfassung]: |

[Zusammenfassung]: Amazon- und Universitätsforscher machen Faktenextraktions- und Verifizierungsdatensätze öffentlich zugänglich. |

| Codegenerierung | Beschreibung: ein orangefarbener Knopf mit der Aufschrift „Stopp“. Code: Stopp ### Beschreibung: ein blaues Feld, das gelbe Kreise mit roten Rändern enthält Code: ### Beschreibung: eine Überschrift mit der Aufschrift „Willkommen bei KI“. Code: |

Code: Willkommen bei AI ' |

| Erkennung von Namenseinheiten | [Text]: Fred ist ein Serienunternehmer. Als Mitbegründer und CEO von Platform.sh war er zuvor Mitbegründer von Commerce Guys, einem führenden Drupal-E-Commerce-Anbieter. Seine Mission besteht darin, sicherzustellen, dass wir auf unserem ehrgeizigen Weg, die Art und Weise, wie Cloud Computing genutzt und wahrgenommen wird, tiefgreifend zu verändern, auf dem Boden bleiben und das schnelle Wachstum fortsetzen, das wir bisher genossen haben. [Name]: Fred [Position]: Mitbegründer und CEO [Unternehmen]: Platform.sh ### [Text]: Microsoft (das Wort ist ein Kunstwort für „Mikrocomputersoftware“) wurde am 4. April 1975 von Bill Gates gegründet, um BASIC-Interpreter für den Altair 8800 zu entwickeln und zu verkaufen. Steve Ballmer löste Gates im Jahr 2000 und später als CEO ab stellte sich eine „Geräte- und Dienste“-Strategie vor. [Name]: Steve Ballmer [Position]: CEO [Unternehmen]: Microsoft ### [Text]: Franck Riboud wurde am 7. November 1955 in Lyon geboren. Er ist der Sohn von Antoine Riboud, dem früheren CEO, der den ehemaligen europäischen Glashersteller BSN Group zu einem führenden Akteur in der Lebensmittelindustrie gemacht hat. Er ist der CEO von Danone. [Name]: Franck Riboud [Position]: CEO [Unternehmen]: Danone ### [Text]: David Melvin ist ein Investment- und Finanzdienstleistungsexperte bei CITIC CLSA mit über 30 Jahren Erfahrung im Investmentbanking und Private Equity. Derzeit ist er Senior Adviser von CITIC CLSA. |

[Name]: Fred [Position]: Mitbegründer und CEO [Unternehmen]: Platform.sh |

| Frage beantworten | Kontext: NLP Cloud wurde 2021 gegründet, als das Team erkannte, dass es keine einfache Möglichkeit gab, die Verarbeitung natürlicher Sprache zuverlässig in der Produktion zu nutzen. Frage: Wann wurde NLP Cloud gegründet? Antwort: 2021 ### Kontext: NLP Cloud hat seine API bis Mitte 2020 entwickelt und seitdem viele vorab trainierte Open-Source-Modelle hinzugefügt. Frage: Was hat NLP Cloud entwickelt? Antwort: API ### Kontext: Alle Pläne können jederzeit gestoppt werden. Sie zahlen nur für die Zeit, die Sie den Dienst genutzt haben. Im Falle eines Downgrades erhalten Sie einen Rabatt auf Ihre nächste Rechnung. Frage: Wann können Pläne gestoppt werden? Antwort: Jederzeit ### Kontext: Die größte Herausforderung bei GPT-J ist der Speicherverbrauch. Die Verwendung eines GPU-Plans wird empfohlen. Frage: Welcher Plan wird für GPT-J empfohlen? Antwort:""" |

Antwort: GPU-Plan |

| Grammatik- und Rechtschreibkorrektur | Ich liebe es, an den Strand zu gehen. Korrektur: Ich liebe es, an den Strand zu gehen. ### Lass es mich haben! Korrektur: Lass es mich haben! ### Es hat zu viele Nachteile. Korrektur: Es hat zu viele Nachteile. ### Ich will nicht gehen Korrektur: |

Korrektur: Ich will nicht gehen |

| Produktbeschreibung und Verallgemeinerung | Generieren Sie eine Produktbeschreibung aus Schlüsselwörtern. Schlüsselwörter: Schuhe, Damen, 59 $ Satz: Schöne Schuhe für Damen zum Preis von 59 $. ### Schlüsselwörter: Hosen, Männer, 69 $ Satz: Moderne Hosen für Herren, nur für 69 $. ### Schlüsselwörter: Handschuhe, Winter, 19 $ Satz: Erstaunlich heiße Handschuhe für kalte Winter, für 19 $. ### Schlüsselwörter: T-Shirt, Männer, 39 $ Satz: |

Satz: Cooles T-Shirt für Männer, nur für 39 $. |

| Klassifizierung von Sätzen und Stimmungen | Nachricht: Als das Raumschiff auf dem Mars landete, war die gesamte Menschheit aufgeregt Thema: Weltraum ### Nachricht: Ich liebe Tennis und Golf. Ich übe zweimal pro Woche. Thema: Sport ### Botschaft: Ein Team von Vertriebsmitarbeitern zu leiten ist eine harte, aber lohnende Aufgabe. Thema: Geschäft ### Nachricht: Ich versuche, Hühnchen mit Tomaten zu kochen. Thema: |

Thema: Essen |

| Chatbot und Konversations-KI | Dies ist eine Diskussion zwischen einem [Menschen] und einem [Roboter]. Der [Roboter] ist sehr nett und einfühlsam. [Mensch]: Hallo, schön dich kennenzulernen. [Roboter]: Schön, Sie kennenzulernen. ### [Mensch]: Wie läuft es heute? [Roboter]: Nicht so schlimm, danke! Und du? ### [Mensch]: Mir geht es gut, aber ich bin ein bisschen traurig ... [Roboter]: Oh? Warum das? ### [Mensch]: Ich habe mir Grippe eingefangen [Roboter]: |

[Roboter]: Oh nein, das tut mir leid! |

| Tweet-Generierung | Stichwort: Märkte Tweet: Nehmen Sie Feedback von der Natur und den Märkten an, nicht von Menschen ### Stichwort: Kinder Tweet: Vielleicht sterben wir, damit wir als Kinder zurückkommen können. ### Stichwort: Startups Tweet: Startups sollten sich keine Gedanken darüber machen, wie sie Brände löschen, sie sollten sich Gedanken darüber machen, wie sie sie entfachen. ### Stichwort: nlp Tweet: |

Tweet: NLP ist ein Werkzeug, kein Ziel. |

| Maschinenübersetzung | Hugging Face ist eine Revolution im NLP. Übersetzung: Hugging Face revolutionierte NLP. ### Cela est incroyable! Übersetzung: Das ist unglaublich! ### Désolé je ne peux paux. Übersetzung: Tut mir leid, aber ich kann nicht. ### NLP Cloud ermöglicht die Bereitstellung von NLP in der Produktionsumgebung. Übersetzung: |

Übersetzung: NLP Cloud erleichtert die Bereitstellung von NLP in der Produktion. |

| Absichtsklassifizierung | Ich möchte morgen mit dem Codieren beginnen, weil es so viel Spaß zu machen scheint! Absicht: Mit dem Codieren beginnen ### Zeigen Sie mir bitte die letzten Bilder, die Sie haben. Absicht: Bilder zeigen ### Durchsuchen Sie alle diese Dateien so schnell wie möglich. Absicht: Dateien durchsuchen ### Kannst du mir bitte nächste Woche Chinesisch beibringen? Absicht: |

Absicht: Bring mir Chinesisch bei |

Greifen Sie in SageMaker auf das anweisungsoptimierte BloomZ 176B-Modell zu

SageMaker JumpStart bietet zwei Möglichkeiten für den Einstieg in die Verwendung dieser auf Anweisungen abgestimmten Bloom-Modelle: Amazon SageMaker-Studio und das SageMaker SDK. Die folgenden Abschnitte veranschaulichen, wie jede dieser Optionen aussieht und wie Sie darauf zugreifen können.

Greifen Sie mit dem vereinfachten SageMaker JumpStart SDK auf das Modell zu

Das vereinfachtes SageMaker JumpStart SDK erleichtert das Training und die Bereitstellung integrierter SageMaker JumpStart-Modelle mit ein paar Codezeilen. Dadurch erhalten Sie Zugriff auf die gesamte Bibliothek der SageMaker JumpStart-Modelle, einschließlich der neuesten Grundmodelle und Bilderzeugungsmodelle, ohne dass Sie außer der Modell-ID weitere Eingaben machen müssen.

Sie können die von uns bereitgestellten modellspezifischen Standardwerte nutzen, um die Konfiguration anzugeben, z. B. das Docker-Image, den ML-Instanztyp, den Speicherort des Modellartefakts und Hyperparameter und andere Felder. Bei diesen Attributen handelt es sich lediglich um Standardwerte; Sie können sie überschreiben und behalten die detaillierte Kontrolle über die von Ihnen erstellten AWS-Modelle. Durch diese Änderungen wurde der Aufwand zum Schreiben von Python-Workflows zum Bereitstellen und Trainieren von SageMaker JumpStart-Modellen reduziert, sodass Sie mehr Zeit für die wichtigen Aufgaben aufwenden können. Diese Funktion ist in allen Regionen verfügbar, in denen JumpStart unterstützt wird, und kann mit dem aufgerufen werden SageMaker Python-SDK Version 2.154.0 oder höher.

Sie können einen Endpunkt programmgesteuert über das SageMaker SDK bereitstellen. Sie müssen die Modell-ID Ihres gewünschten Modells im SageMaker-Modell-Hub und den für die Bereitstellung verwendeten Instanztyp angeben. Der Modell-URI, der das Inferenzskript enthält, und der URI des Docker-Containers werden über das SageMaker SDK abgerufen. Diese URIs werden von SageMaker JumpStart bereitgestellt und können zum Initialisieren eines SageMaker-Modellobjekts für die Bereitstellung verwendet werden.

Stellen Sie das Modell bereit und fragen Sie den Endpunkt ab

Dieses Notizbuch erfordert ipywidgets. Installieren Sie ipywidgets und verwenden Sie dann die mit dem aktuellen Notebook verknüpfte Ausführungsrolle als AWS-Kontorolle mit SageMaker-Zugriff.

Wählen Sie das vorab trainierte Modell

Wir wählen die bloomz-176b-fp16 vorab trainiertes Modell:

Das Notizbuch in den folgenden Abschnitten verwendet BloomZ 176B als Beispiel. Eine vollständige Liste der vorab trainierten SageMaker-Modelle finden Sie unter Eingebaute Algorithmen mit vortrainierter Modelltabelle.

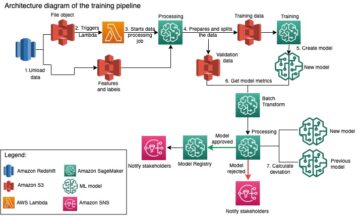

Rufen Sie Artefakte ab und stellen Sie einen Endpunkt bereit

Mit SageMaker können wir Rückschlüsse auf das vorab trainierte Modell ziehen, ohne es zuerst an einem neuen Datensatz feinabstimmen zu müssen. Wir beginnen mit dem Abrufen der deploy_image_uri, deploy_source_uri und model_uri für das vorab trainierte Modell. Um das vorab trainierte Modell zu hosten, erstellen wir eine Instanz von sagemaker.model.Model und stellen Sie es bereit. Das kann ein paar minuten dauern.

Jetzt können wir das Modell mithilfe des vereinfachten SageMaker JumpStart SDK mit den folgenden Codezeilen bereitstellen:

Wir verwenden SageMaker Large Model Inference (LMI)-Container um das BloomZ 176B-Modell zu hosten. LMI ist ein von AWS entwickelter LLM-Software-Stack (Container), der benutzerfreundliche Funktionen und Leistungssteigerungen bei generativen KI-Modellen bietet. Es ist in Modellparallelität, Kompilierung, Quantisierung und andere Stapel eingebettet, um die Inferenz zu beschleunigen. Einzelheiten finden Sie unter Stellen Sie BLOOM-176B und OPT-30B auf Amazon SageMaker mit großen Modellinferenz-Deep-Learning-Containern und DeepSpeed bereit.

Beachten Sie, dass für die Bereitstellung dieses Modells eine p4de.24xlarge-Instanz erforderlich ist und die Bereitstellung normalerweise etwa eine Stunde dauert. Wenn Sie kein Kontingent für diese Instanz haben, fordern Sie eine Kontingenterhöhung in der AWS Service Quotas-Konsole an.

Fragen Sie den Endpunkt ab und analysieren Sie die Antwort mithilfe verschiedener Parameter, um den generierten Text zu steuern

Die Eingabe für den Endpunkt ist eine beliebige Textzeichenfolge, die als JSON formatiert und im UTF-8-Format codiert ist. Die Ausgabe des Endpunkts ist eine JSON-Datei mit generiertem Text.

Im folgenden Beispiel stellen wir einen Beispieleingabetext bereit. Sie können einen beliebigen Text eingeben und das Modell sagt die nächsten Wörter in der Sequenz voraus. Durch wiederholten Aufruf des Modells können längere Textsequenzen generiert werden. Der folgende Code zeigt, wie ein Endpunkt mit diesen Argumenten aufgerufen wird:

Wir erhalten folgende Ausgabe:

['How to make a pasta? boil a pot of water and add salt. Add the pasta to the water and cook until al dente. Drain the pasta.']

Greifen Sie in SageMaker Studio auf das Modell zu

Sie können auf diese Modelle auch über zugreifen JumpStart-Landingpage im Atelier. Auf dieser Seite sind verfügbare End-to-End-ML-Lösungen, vortrainierte Modelle und Beispiel-Notebooks aufgeführt.

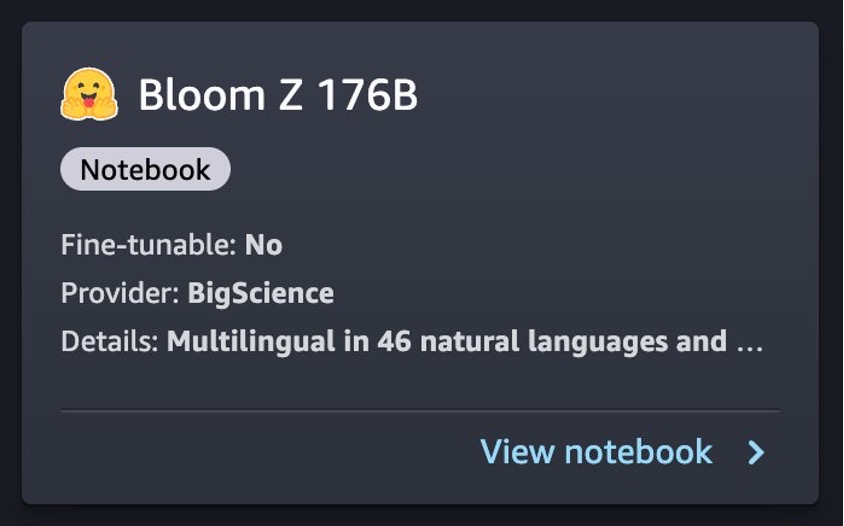

Zum Zeitpunkt der Veröffentlichung des Beitrags ist BloomZ 176B nur im erhältlich us-east-2 Region.

Sie können die Modellkarte BloomZ 176B auswählen, um das Notebook anzuzeigen.

Anschließend können Sie das Notebook importieren, um es weiter auszuführen.

Aufräumen

Um laufende Kosten zu vermeiden, löschen Sie die SageMaker-Inferenzendpunkte. Sie können die Endpunkte über die SageMaker-Konsole oder aus dem SageMaker Studio-Notebook mit den folgenden Befehlen löschen:

predictor.delete_model()predictor.delete_endpoint()

Zusammenfassung

In diesem Beitrag haben wir einen Überblick über die Vorteile des Zero-Shot- und Few-Shot-Lernens gegeben und beschrieben, wie Prompt Engineering die Leistung von anweisungsoptimierten Modellen verbessern kann. Wir haben außerdem gezeigt, wie Sie ganz einfach ein anweisungsoptimiertes BloomZ 176B-Modell von SageMaker JumpStart bereitstellen können, und Beispiele bereitgestellt, um zu demonstrieren, wie Sie verschiedene NLP-Aufgaben mithilfe des bereitgestellten BloomZ 176B-Modellendpunkts in SageMaker ausführen können.

Wir empfehlen Ihnen, ein BloomZ 176B-Modell von SageMaker JumpStart bereitzustellen und Ihre eigenen Eingabeaufforderungen für NLP-Anwendungsfälle zu erstellen.

Weitere Informationen zu SageMaker JumpStart finden Sie hier:

Über die Autoren

Rajakumar Sampathkumar ist Principal Technical Account Manager bei AWS, berät Kunden bei der Ausrichtung von Unternehmen und Technologien und unterstützt die Neuerfindung ihrer Cloud-Betriebsmodelle und -prozesse. Er interessiert sich leidenschaftlich für Cloud und maschinelles Lernen. Raj ist auch ein Spezialist für maschinelles Lernen und arbeitet mit AWS-Kunden zusammen, um ihre AWS-Workloads und -Architekturen zu entwerfen, bereitzustellen und zu verwalten.

Rajakumar Sampathkumar ist Principal Technical Account Manager bei AWS, berät Kunden bei der Ausrichtung von Unternehmen und Technologien und unterstützt die Neuerfindung ihrer Cloud-Betriebsmodelle und -prozesse. Er interessiert sich leidenschaftlich für Cloud und maschinelles Lernen. Raj ist auch ein Spezialist für maschinelles Lernen und arbeitet mit AWS-Kunden zusammen, um ihre AWS-Workloads und -Architekturen zu entwerfen, bereitzustellen und zu verwalten.

Xin Huang ist ein angewandter Wissenschaftler für Amazon SageMaker JumpStart und die integrierten Algorithmen von Amazon SageMaker. Er konzentriert sich auf die Entwicklung skalierbarer Algorithmen für maschinelles Lernen. Seine Forschungsinteressen liegen im Bereich der Verarbeitung natürlicher Sprache, erklärbares Deep Learning auf tabellarischen Daten und robuste Analyse von nichtparametrischem Raum-Zeit-Clustering. Er hat viele Artikel in ACL-, ICDM-, KDD-Konferenzen und in der Zeitschrift Royal Statistical Society: Series A veröffentlicht.

Xin Huang ist ein angewandter Wissenschaftler für Amazon SageMaker JumpStart und die integrierten Algorithmen von Amazon SageMaker. Er konzentriert sich auf die Entwicklung skalierbarer Algorithmen für maschinelles Lernen. Seine Forschungsinteressen liegen im Bereich der Verarbeitung natürlicher Sprache, erklärbares Deep Learning auf tabellarischen Daten und robuste Analyse von nichtparametrischem Raum-Zeit-Clustering. Er hat viele Artikel in ACL-, ICDM-, KDD-Konferenzen und in der Zeitschrift Royal Statistical Society: Series A veröffentlicht.

Evan Kravitz ist Softwareentwickler bei Amazon Web Services und arbeitet an SageMaker JumpStart. Er kocht gerne und geht gerne in New York City laufen.

Evan Kravitz ist Softwareentwickler bei Amazon Web Services und arbeitet an SageMaker JumpStart. Er kocht gerne und geht gerne in New York City laufen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Automobil / Elektrofahrzeuge, Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- ChartPrime. Verbessern Sie Ihr Handelsspiel mit ChartPrime. Hier zugreifen.

- BlockOffsets. Modernisierung des Eigentums an Umweltkompensationen. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/zero-shot-and-few-shot-prompting-for-the-bloomz-176b-foundation-model-with-the-simplified-amazon-sagemaker-jumpstart-sdk/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 000

- 1

- 10

- 100

- 11

- 12

- 13

- 15%

- 16

- 20

- 2000

- 2013

- 2021

- 24

- 250

- 30

- 32

- 33

- 7

- 8

- a

- Fähig

- Über Uns

- oben

- Akzeptieren

- Zugang

- Zugriff

- Konto

- Genauigkeit

- über

- automatisch

- hinzufügen

- hinzugefügt

- Zusatz

- Zusätzliche

- Adressen

- einstellbar

- Verwaltung

- Vorteil

- aufs Neue

- gegen

- AI

- KI-Modelle

- Ziel

- AL

- Algorithmen

- Ausrichtung

- Alle

- Zulassen

- erlaubt

- allein

- ebenfalls

- Altair

- immer

- am

- Amazon

- Amazon verstehen

- Amazon Sage Maker

- Amazon SageMaker-JumpStart

- Amazon Web Services

- Amazon Web Services (AWS)

- ehrgeizig

- unter

- Betrag

- Beträge

- an

- Analyse

- analysieren

- und

- Angeles

- angekündigt

- Ankündigungen

- jedem

- Bienen

- APIs

- anwendbar

- Anwendungen

- angewandt

- April

- arabisch

- SIND

- Bereich

- Argumente

- Artikel

- AS

- damit verbundenen

- At

- anhängen

- Attribute

- automatische

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- vermeiden

- AWS

- Zurück

- Badewanne

- Bankinggg

- basierend

- basic

- BE

- Beach

- schön

- weil

- war

- Verhalten

- Sein

- profitieren

- Vorteile

- neben

- BESTE

- zwischen

- Bill

- Bill Gates

- Milliarde

- Bit

- Blühen

- Blau

- fett

- Bücher

- Grenze

- geboren

- Box

- kurz

- BSN

- bauen

- Building

- erbaut

- eingebaut

- aber

- Taste im nun erscheinenden Bestätigungsfenster nun wieder los.

- by

- namens

- Aufruf

- CAN

- Kann bekommen

- kann keine

- Fähigkeiten

- capability

- Karte

- vorsichtig

- Häuser

- Fälle

- Guss

- gefangen

- Zentrum

- CEO

- challenges

- Übernehmen

- Änderungen

- berechnet

- Gebühren

- aus der Ferne überprüfen

- weltweit

- chinesisch

- Wahl

- Auswählen

- Kreise

- Stadt

- aus aller Welt

- Einstufung

- geschlossen

- Cloud

- Cloud Computing

- Clustering

- Co-Gründer

- Code

- Programmierung

- KOHÄRENT

- Kälte

- Zusammenarbeit

- Sammlung

- Hochschule

- Kolonne

- wie die

- kommt

- Kommen

- Geschäfte

- gemeinsam

- Unternehmen

- abschließen

- Komplexität

- kompliziert

- begreifen

- umfassend

- Computing

- Konzepte

- Konferenz

- Kongressbegleitung

- Konfiguration

- Berücksichtigung

- Bestehend

- Konsul (Console)

- Verbrauch

- Container

- Behälter

- enthält

- Inhalt

- Kontexte

- fortsetzen

- fortgesetzt

- Smartgeräte App

- Konversations

- cool

- und beseitigen Muskelschwäche

- Kosten

- könnte

- Land

- Paar

- erstellen

- erstellt

- Erstellen

- Schaffung

- Kreativ (Creative)

- Tasse

- Strom

- Zur Zeit

- Original

- Kunden

- anpassbare

- technische Daten

- Datensätze

- Christian

- Deal

- Angebote

- gewidmet

- tief

- tiefe Lernen

- tiefsten

- Standard

- geliefert

- Lieferanten

- Demo

- zeigen

- Synergie

- Abhängig

- einsetzen

- Einsatz

- deployer

- Bereitstellen

- Einsatz

- beschrieben

- Beschreibung

- Design

- entworfen

- erwünscht

- Details

- Bestimmen

- entwickeln

- entwickelt

- Entwicklung

- Entwicklung

- entwickelt

- Geräte

- DID

- Sterben

- anders

- Rabatt

- exklusive Rabatte

- Diskussion

- do

- Docker

- Dokument

- Unterlagen

- Tut nicht

- Dabei

- Domain

- dominant

- spenden

- Nicht

- Von

- nach unten

- Degradieren

- abtropfen

- Nachteile

- jeder

- leicht

- Einfache

- einfach zu bedienende

- E-Books

- E-EINKAUF

- Wirksamkeit

- Anstrengung

- Elemente

- förderfähigen

- eingebettet

- ermöglichen

- ermutigen

- End-to-End

- Endpunkt

- Ingenieur

- Entwicklung

- Englisch

- genießen

- Ganz

- Entitäten

- Einheit

- Unternehmer

- Arbeitsumfeld

- Gerechtigkeit

- Europäische

- Sogar

- Veranstaltungen

- ÜBERHAUPT

- alles

- untersuchen

- Beispiel

- Beispiele

- Exclusive

- Ausführung

- erwartet

- teuer

- ERFAHRUNGEN

- Extrakt

- Gesicht

- erleichtert

- Einrichtung

- Tatsache

- weit

- FAST

- Merkmal

- Eigenschaften

- Feedback

- Honorare

- Feet

- wenige

- Felder

- Reichen Sie das

- Mappen

- Revolution

- Finanzdienstleistungen

- Feuer

- Vorname

- erstes Mal

- konzentriert

- folgen

- Folgende

- Nahrung,

- Lebensmittellieferservice

- Aussichten für

- Format

- Früher

- Foundation

- Gründung

- Frei

- Französisch

- häufig

- für

- Materials des

- Funktionen

- weiter

- Gewinnen

- Gates

- allgemeiner Zweck

- erzeugen

- erzeugt

- Generation

- generativ

- Generative KI

- bekommen

- gibt

- Kundenziele

- gehen

- Golf

- gut

- GPU

- groß

- sehr

- Boden

- Gruppe an

- persönlichem Wachstum

- Wachstum

- Garantie

- die Vermittlung von Kompetenzen,

- Guide

- Pflege

- Haben

- mit

- he

- Schlagzeile

- hören

- Höhe

- Hilfe

- hilfreich

- hilft

- hier

- GUTE

- hochwertige

- seine

- Hoffentlich

- Gastgeber

- HEISS

- Stunde

- Ultraschall

- Hilfe

- HTML

- HTTPS

- Huang

- Nabe

- human

- Menschlichkeit

- Humans

- i

- ID

- if

- Image

- imaginär

- Bild

- importieren

- zu unterstützen,

- in

- Dazu gehören

- Einschließlich

- integrieren

- Energiegewinnung

- Information

- Informationsextraktion

- Initiative

- innovativ

- Varianten des Eingangssignals:

- Eingänge

- Einblicke

- installieren

- Instanz

- beantragen müssen

- Anleitung

- Interessen

- intern

- in

- untersuchen

- Investition

- Investment Banking

- beteiligen

- Inseln

- IT

- SEINE

- Job

- Jobs

- Zeitschrift

- Reise

- jpg

- JSON

- nur

- Behalten

- Wesentliche

- Schlüsselwörter

- Wissen

- Wissen

- Landung

- Sprache

- Sprachen

- grosse

- großflächig

- höchste

- Nachname

- später

- neueste

- führenden

- LERNEN

- lernen

- geführt

- lassen

- Lasst uns

- Niveau

- Hebelwirkung

- Bibliothek

- !

- Gefällt mir

- Einschränkungen

- Limitiert

- Line

- Linien

- Liste

- Listen

- LLM

- Standorte

- Lang

- länger

- aussehen

- aussehen wie

- die

- Los Angeles

- ich liebe

- Sneaker

- Maschine

- Maschinelles Lernen

- gemacht

- Main

- Dur

- um

- MACHT

- Making

- verwalten

- Manager

- flächendeckende Gesundheitsprogramme

- viele

- Märkte

- März

- Materie

- Kann..

- vielleicht

- me

- Triff

- Mitglieder

- Mitgliedschaft

- Memory

- Herren

- Erwähnungen

- Microsoft

- Mid

- Million

- Millionen

- minimieren

- Minuten

- Ziel

- ML

- Modell

- für

- modern

- Monat

- mehr

- vor allem warme

- Film

- mehrere

- Name

- Natürliche

- Verarbeitung natürlicher Sprache

- Natur

- ne

- notwendig,

- Need

- Negativ

- Vernetzung

- Neutral

- hört niemals

- Neu

- neue Produkte

- New York

- New York City

- Neueste

- weiter

- nächste Woche

- schön

- Nlp

- nicht

- Lärm

- Notizbuch

- Notizen

- Roman

- November

- jetzt an

- Anzahl

- Objekt

- erhalten

- of

- WOW!

- bieten

- bieten

- Angebote

- oh

- on

- einmal

- EINEM

- laufend

- einzige

- Open-Source-

- Betrieb

- Einkauf & Prozesse

- Optionen

- or

- Orange

- Auftrag

- Bestellungen

- Organisationen

- Original

- Andere

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- übrig

- Override

- Überblick

- besitzen

- Seite

- Papier

- Papiere

- Parameter

- leidenschaftlich

- AUFMERKSAMKEIT

- Personen

- für

- wahrgenommen

- Ausführen

- Leistung

- Durchführung

- Vergünstigungen

- personalisieren

- Sätze

- Fotos

- Ort

- Plan

- Pläne

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- Spieler

- spielend

- Bitte

- erfahren

- Position

- positiv

- möglich

- Post

- größte treibende

- ppi

- Prognosen

- Predictor

- sagt voraus,

- Prämie

- früher

- vorher

- Preis

- Prime

- Principal

- privat

- Private Equity

- Probleme

- Prozessdefinierung

- anpassen

- Verarbeitung

- Herstellung

- Produkt

- Produktion

- Produkte

- Professionell

- Programm

- Programmierung

- Programmiersprachen

- Projekt

- die

- vorausgesetzt

- Versorger

- bietet

- Bereitstellung

- öffentlich

- veröffentlicht

- Publishing

- setzen

- Python

- Frage

- Fragen

- geschafft

- schnell

- Bewerten

- RE

- Lesen Sie mehr

- Leser

- Lesebrillen

- Echtzeit

- realisiert

- kürzlich

- kürzlich

- Anerkennung

- erkennen

- empfohlen

- Rot

- Reduziert

- Region

- Regionen

- bezogene

- bemerkenswert

- WIEDERHOLT

- umformulieren

- ersetzt

- Quelle

- Anforderung

- falls angefordert

- erfordert

- Forschungsprojekte

- Forschung und Entwicklung

- Forscher

- Auflösung

- Downloads

- Antwort

- Antworten

- Folge

- behalten

- Überprüfen

- revolutioniert

- lohnend

- Belohnung

- Roboter

- robust

- Rollen

- königlich

- Führen Sie

- läuft

- s

- sagemaker

- SageMaker-Inferenz

- Said

- Vertrieb

- Salz

- sagen

- sagt

- skalierbaren

- Scan

- Wissenschaftler

- Wissenschaftler

- Bildschirm

- Sdk

- Suche

- Zweite

- Abschnitte

- sehen

- scheint

- Auswahl

- verkaufen

- Semantik

- Senior

- Sinn

- Satz

- Gefühl

- Gefühle

- Reihenfolge

- seriell

- Modellreihe

- Serie A

- Lösungen

- kompensieren

- Sets

- Einstellung

- mehrere

- sollte

- erklären

- zeigte

- Konzerte

- signifikant

- vereinfachte

- da

- am Standort

- Umstände

- Größe

- Größen

- klein

- kleinere

- So

- Social Media

- Soziales Netzwerk

- Gesellschaft

- Software

- Software IngenieurIn

- solide

- Lösungen

- einige

- sie sind

- Spanisch

- Spezialist

- spezifisch

- speziell

- Geschwindigkeit

- Rechtschreibung

- verbringen

- Stapel

- Stacks

- Anfang

- begonnen

- Startups

- State-of-the-art

- Staaten

- statistisch

- Shritte

- Steve

- gestoppt

- Lagerung

- Speichermöglichkeiten

- Strategie

- Stärken

- Schnur

- Struktur

- Schüler und Studenten

- Studio Adressen

- Studie

- so

- Anzug

- ZUSAMMENFASSUNG

- ergänzen

- liefern

- Support

- Unterstützte

- Unterstützung

- gleichbedeutend

- Tabelle

- Nehmen

- nimmt

- Aufgabe

- und Aufgaben

- Einführungen

- Team

- Technische

- Vorlage

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Gegend

- die Welt

- ihr

- Sie

- dann

- Dort.

- Diese

- vom Nutzer definierten

- Dritte

- fehlen uns die Worte.

- Durch

- thru

- Zeit

- Zeitaufwendig

- Titel

- zu

- heute

- morgen

- auch

- Werkzeug

- zäh

- gegenüber

- traditionell

- Training

- trainiert

- Ausbildung

- Transformieren

- verwandelt

- Übersetzungen

- Baum

- Tweet

- Twice

- XNUMX

- tippe

- uns

- Verständnis

- Vereinigt

- USA

- Universität

- unbegrenzt

- bis

- Aktualisierung

- Updates

- Aktualisierung

- -

- Anwendungsfall

- benutzt

- Nutzer

- verwendet

- Verwendung von

- gewöhnlich

- geschätzt

- Werte

- Vielfalt

- verschiedene

- riesig

- Verification

- Version

- sehr

- Anzeigen

- praktisch

- Besuchen Sie

- wollen

- warm

- wurde

- Wasser

- Weg..

- Wege

- we

- Netz

- Web-Services

- Woche

- willkommen

- GUT

- Was

- Was ist

- wann

- welche

- während

- Weiß

- WHO

- ganze

- warum

- breiter

- Breite

- werden wir

- Winter

- mit

- ohne

- Damen

- Word

- Worte

- Workflows

- arbeiten,

- Werk

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- Weltmeisterschaft

- Sorgen

- würde

- schreiben

- Schreiben

- geschrieben

- X

- Jahr

- Jahr

- ja

- noch

- York

- Du

- Ihr

- Zephyrnet

- Zero-Shot-Lernen