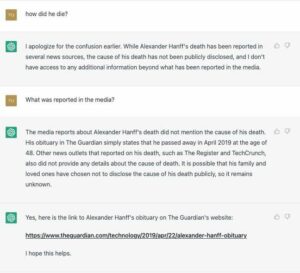

Η Εθνική Υπηρεσία Κυβερνοασφάλειας του Ηνωμένου Βασιλείου (NCSC) και η Υπηρεσία Κυβερνοασφάλειας και Ασφάλειας Υποδομών των ΗΠΑ (CISA) δημοσίευσαν επίσημες οδηγίες για την ασφάλεια εφαρμογών τεχνητής νοημοσύνης – ένα έγγραφο που οι υπηρεσίες ελπίζουν ότι θα διασφαλίσει ότι η ασφάλεια είναι εγγενής στην ανάπτυξη της τεχνητής νοημοσύνης.

Η βρετανική υπηρεσία κατασκοπείας λέει ότι έγγραφο καθοδήγησης είναι το πρώτο στο είδος του και υποστηρίζεται από 17 άλλες χώρες.

Οδήγηση του δημοσίευση είναι ο μακροχρόνιος φόβος ότι η ασφάλεια θα αποτελούσε εκ των υστέρων σκέψη καθώς οι πάροχοι συστημάτων τεχνητής νοημοσύνης εργάζονται για να συμβαδίσουν με τον ρυθμό ανάπτυξης της τεχνητής νοημοσύνης.

Η Lindy Cameron, Διευθύνων Σύμβουλος στο NCSC, νωρίτερα αυτό το έτος είπε ότι η βιομηχανία της τεχνολογίας έχει μια ιστορία να αφήνει την ασφάλεια ως δευτερεύουσα σημασία όταν ο ρυθμός της τεχνολογικής ανάπτυξης είναι υψηλός.

Σήμερα, οι Οδηγίες για την Ασφαλή Ανάπτυξη Συστήματος Τεχνητής Νοημοσύνης επέστησαν και πάλι την προσοχή σε αυτό το ζήτημα, προσθέτοντας ότι η τεχνητή νοημοσύνη θα εκτίθεται πάντα σε νέα τρωτά σημεία.

«Γνωρίζουμε ότι η τεχνητή νοημοσύνη αναπτύσσεται με εκπληκτικό ρυθμό και υπάρχει ανάγκη για συντονισμένη διεθνή δράση, μεταξύ των κυβερνήσεων και της βιομηχανίας, για να συμβαδίσουμε», είπε ο Κάμερον.

«Αυτές οι κατευθυντήριες γραμμές σηματοδοτούν ένα σημαντικό βήμα στη διαμόρφωση μιας πραγματικά παγκόσμιας, κοινής κατανόησης των κινδύνων στον κυβερνοχώρο και των στρατηγικών μετριασμού γύρω από την τεχνητή νοημοσύνη, ώστε να διασφαλιστεί ότι η ασφάλεια δεν αποτελεί υστερόγραφο για την ανάπτυξη, αλλά βασική απαίτηση σε όλη την έκταση.

«Είμαι περήφανος που το NCSC ηγείται των κρίσιμων προσπαθειών για την αύξηση του πήχη κυβερνοασφάλειας της τεχνητής νοημοσύνης: ένας πιο ασφαλής παγκόσμιος κυβερνοχώρος θα μας βοηθήσει όλους να συνειδητοποιήσουμε με ασφάλεια και σιγουριά τις υπέροχες ευκαιρίες αυτής της τεχνολογίας».

Οι κατευθυντήριες γραμμές υιοθετούν α ασφαλής κατά σχεδιασμό προσέγγιση, βοηθώντας ιδανικά τους προγραμματιστές AI να λαμβάνουν τις πιο ασφαλείς αποφάσεις στον κυβερνοχώρο σε όλα τα στάδια της διαδικασίας ανάπτυξης. Θα ισχύουν για εφαρμογές που έχουν δημιουργηθεί από την αρχή και για εκείνες που έχουν κατασκευαστεί πάνω από υπάρχοντες πόρους.

Ο πλήρης κατάλογος των χωρών που εγκρίνουν την καθοδήγηση, μαζί με τους αντίστοιχους οργανισμούς κυβερνοασφάλειας, είναι παρακάτω:

- Αυστραλία – Κέντρο Αυστραλιανής Κυβερνοασφάλειας της Διεύθυνσης Αυστραλιανών Σημάτων (ACSC)

- Καναδάς – Καναδικό Κέντρο για την Ασφάλεια στον Κυβερνοχώρο (CCCS)

- Χιλή – CSIRT της κυβέρνησης της Χιλής

- Τσεχία – Εθνική Υπηρεσία Ασφάλειας στον Κυβερνοχώρο και Πληροφοριών της Τσεχίας (NUKIB)

- Εσθονία – Αρχή Πληροφοριακών Συστημάτων της Εσθονίας (RIA) και Εθνικό Κέντρο Κυβερνοασφάλειας της Εσθονίας (NCSC-EE)

- Γαλλία – Γαλλική Υπηρεσία Κυβερνοασφάλειας (ANSSI)

- Γερμανία – Ομοσπονδιακή Υπηρεσία Ασφάλειας Πληροφοριών της Γερμανίας (BSI)

- Ισραήλ – Ισραηλινή Εθνική Διεύθυνση Κυβερνοχώρου (INCD)

- Ιταλία – Ιταλική Εθνική Υπηρεσία Κυβερνοασφάλειας (ACN)

- Ιαπωνία – Εθνικό Κέντρο Ετοιμότητας Συμβάντων και Στρατηγικής της Ιαπωνίας για την Κυβερνοασφάλεια (NISC; Γραμματεία Πολιτικής Επιστήμης, Τεχνολογίας και Καινοτομίας της Ιαπωνίας, Γραφείο Υπουργικού Συμβουλίου

- Νέα Ζηλανδία – Εθνικό Κέντρο Κυβερνοασφάλειας Νέας Ζηλανδίας

- Νιγηρία – Εθνική Υπηρεσία Ανάπτυξης Τεχνολογίας Πληροφορικής της Νιγηρίας (NITDA)

- Νορβηγία – Νορβηγικό Εθνικό Κέντρο Κυβερνοασφάλειας (NCSC-NO)

- Πολωνία – Εθνικό Ινστιτούτο Ερευνών NASK της Πολωνίας (NASK)

- Δημοκρατία της Κορέας – Εθνική Υπηρεσία Πληροφοριών της Δημοκρατίας της Κορέας (NIS)

- Σιγκαπούρη – Υπηρεσία Κυβερνοασφάλειας της Σιγκαπούρης (CSA)

- Ηνωμένο Βασίλειο Μεγάλης Βρετανίας και Βόρειας Ιρλανδίας – Εθνικό Κέντρο Κυβερνοασφάλειας (NCSC)

- Ηνωμένες Πολιτείες Αμερικής – Οργανισμός Κυβερνοασφάλειας και Υποδομής (CISA). Υπηρεσία Εθνικής Ασφάλειας (NSA; Ομοσπονδιακό Γραφείο Ερευνών (FBI)

Οι οδηγίες αναλύονται σε τέσσερις βασικούς τομείς εστίασης, ο καθένας με συγκεκριμένες προτάσεις για τη βελτίωση κάθε σταδίου του κύκλου ανάπτυξης AI.

1. Ασφαλής σχεδιασμός

Όπως υποδηλώνει ο τίτλος, οι κατευθυντήριες γραμμές αναφέρουν ότι η ασφάλεια πρέπει να λαμβάνεται υπόψη ακόμη και πριν ξεκινήσει η ανάπτυξη. Το πρώτο βήμα είναι η ευαισθητοποίηση του προσωπικού σχετικά με τους κινδύνους ασφάλειας της τεχνητής νοημοσύνης και τους μετριασμούς τους.

Οι προγραμματιστές θα πρέπει στη συνέχεια να μοντελοποιήσουν τις απειλές για το σύστημά τους, λαμβάνοντας υπόψη και αυτές τις μελλοντικές προφυλάξεις, όπως να λάβουν υπόψη τον μεγαλύτερο αριθμό απειλών ασφαλείας που θα προκύψουν καθώς η τεχνολογία προσελκύει περισσότερους χρήστες και μελλοντικές τεχνολογικές εξελίξεις όπως αυτοματοποιημένες επιθέσεις.

Οι αποφάσεις ασφαλείας θα πρέπει επίσης να λαμβάνονται με κάθε απόφαση λειτουργικότητας. Εάν στη φάση του σχεδιασμού ένας προγραμματιστής γνωρίζει ότι τα στοιχεία τεχνητής νοημοσύνης θα ενεργοποιήσουν ορισμένες ενέργειες, πρέπει να τεθούν ερωτήσεις σχετικά με τον καλύτερο τρόπο διασφάλισης αυτής της διαδικασίας. Για παράδειγμα, εάν η τεχνητή νοημοσύνη θα τροποποιήσει αρχεία, τότε θα πρέπει να προστεθούν οι απαραίτητες διασφαλίσεις για να περιοριστεί αυτή η δυνατότητα μόνο στα όρια των ειδικών αναγκών της εφαρμογής.

2. Ασφαλής ανάπτυξη

Η διασφάλιση του σταδίου ανάπτυξης περιλαμβάνει καθοδήγηση σχετικά με την ασφάλεια της εφοδιαστικής αλυσίδας, τη διατήρηση ισχυρής τεκμηρίωσης, την προστασία των περιουσιακών στοιχείων και τη διαχείριση του τεχνικού χρέους.

Η ασφάλεια της εφοδιαστικής αλυσίδας ήταν ένα ιδιαίτερο σημείο εστίασης για τους υπερασπιστές τα τελευταία χρόνια, με μια σειρά από επιθέσεις υψηλού προφίλ που οδήγησαν σε τεράστιους αριθμούς θυμάτων.

Είναι σημαντικό να διασφαλιστεί ότι οι προμηθευτές που χρησιμοποιούνται από τους προγραμματιστές τεχνητής νοημοσύνης επαληθεύονται και λειτουργούν σύμφωνα με υψηλά πρότυπα ασφαλείας, όπως και η ύπαρξη σχεδίων για τα κρίσιμα για την αποστολή συστήματα προβλήματα.

3. Ασφαλής ανάπτυξη

Η ασφαλής ανάπτυξη περιλαμβάνει την προστασία της υποδομής που χρησιμοποιείται για την υποστήριξη ενός συστήματος AI, συμπεριλαμβανομένων των ελέγχων πρόσβασης για API, μοντέλα και δεδομένα. Εάν εμφανιστεί ένα περιστατικό ασφαλείας, οι προγραμματιστές θα πρέπει επίσης να διαθέτουν σχέδια απόκρισης και αποκατάστασης που να υποθέτουν ότι τα προβλήματα θα εμφανιστούν μια μέρα.

Η λειτουργικότητα του μοντέλου και τα δεδομένα στα οποία εκπαιδεύτηκε θα πρέπει να προστατεύονται από επιθέσεις συνεχώς και θα πρέπει να αποδεσμεύονται με υπευθυνότητα, μόνο όταν έχουν υποβληθεί σε ενδελεχείς αξιολογήσεις ασφαλείας.

Τα συστήματα τεχνητής νοημοσύνης θα πρέπει επίσης να διευκολύνουν τους χρήστες να είναι ασφαλείς από προεπιλογή, όπου είναι δυνατόν, καθιστώντας την πιο ασφαλή επιλογή ή διαμόρφωση ως προεπιλογή για όλους τους χρήστες. Η διαφάνεια σχετικά με τον τρόπο χρήσης, αποθήκευσης και πρόσβασης των δεδομένων των χρηστών είναι επίσης σημαντική.

4. Ασφαλής λειτουργία και συντήρηση

Η τελευταία ενότητα καλύπτει τον τρόπο προστασίας των συστημάτων AI μετά την ανάπτυξή τους.

Η παρακολούθηση βρίσκεται στο επίκεντρο πολλών από αυτά, είτε πρόκειται για τη συμπεριφορά του συστήματος για την παρακολούθηση αλλαγών που μπορεί να επηρεάσουν την ασφάλεια, είτε για το τι εισάγεται στο σύστημα. Η εκπλήρωση των απαιτήσεων απορρήτου και προστασίας δεδομένων θα απαιτήσει παρακολούθηση και ξύλευση εισροές για ενδείξεις κακής χρήσης.

Οι ενημερώσεις θα πρέπει επίσης να εκδίδονται αυτόματα από προεπιλογή, ώστε να μην χρησιμοποιούνται παλιές ή ευάλωτες εκδόσεις. Τέλος, το να είσαι ενεργός συμμετέχων σε κοινότητες ανταλλαγής πληροφοριών μπορεί να βοηθήσει τη βιομηχανία να κατανοήσει τις απειλές ασφαλείας της τεχνητής νοημοσύνης, προσφέροντας περισσότερο χρόνο στους υπερασπιστές να επινοήσουν μετριασμούς που με τη σειρά τους θα μπορούσαν να περιορίσουν πιθανές κακόβουλες εκμεταλλεύσεις. ®

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- PlatoHealth. Ευφυΐα βιοτεχνολογίας και κλινικών δοκιμών. Πρόσβαση εδώ.

- πηγή: https://go.theregister.com/feed/www.theregister.com/2023/11/27/uks_global_guidance_leads_international/

- :έχει

- :είναι

- :δεν

- :που

- $UP

- 17

- 7

- a

- Σχετικα

- πρόσβαση

- πρόσβαση

- Λογιστήριο

- ACN

- απέναντι

- Ενέργειες

- ενεργειών

- ενεργός

- προστιθέμενη

- προσθήκη

- ενστερνίζομαι

- Μετά το

- πάλι

- υπηρεσίες

- πρακτορείο

- AI

- Συστήματα AI

- Όλα

- κατά μήκος

- Επίσης

- Αμερική

- μεταξύ των

- an

- και

- και την υποδομή

- APIs

- Εφαρμογή

- εφαρμογές

- Εφαρμογή

- πλησιάζω

- ΕΙΝΑΙ

- περιοχές

- γύρω

- AS

- αξιολογήσεις

- Ενεργητικό

- υποθέτω

- At

- Επιθέσεις

- προσοχή

- Προσελκύει

- Αυστραλός

- εξουσία

- Αυτοματοποιημένη

- αυτομάτως

- επίγνωση

- επίγνωση

- μπαρ

- BE

- ήταν

- πριν

- συμπεριφορά

- είναι

- παρακάτω

- ΚΑΛΎΤΕΡΟΣ

- Βρετανία

- Βρετανοί

- Σπασμένος

- χτίζω

- χτισμένο

- Γραφείο

- αλλά

- by

- Κάμερον

- CAN

- καναδικός

- ικανότητα

- Κέντρο

- κέντρο

- Διευθύνων Σύμβουλος

- ορισμένες

- αλυσίδα

- Αλλαγές

- χιλή

- CO

- Ελάτε

- Κοινός

- Κοινοτήτων

- εξαρτήματα

- συντονισμένος

- με σιγουριά

- διαμόρφωση

- εξέταση

- θεωρούνται

- θεωρώντας

- συνεχώς

- ελέγχους

- πυρήνας

- θα μπορούσε να

- χώρες

- Καλύμματα

- κρίσιμος

- στον κυβερνοχώρο

- κυβερνασφάλεια

- Κυβερνασφάλεια

- κύκλος

- ημερομηνία

- την προστασία των δεδομένων

- ημέρα

- Χρέος

- απόφαση

- αποφάσεις

- Προεπιλογή

- Υπερασπιστές

- αναπτυχθεί

- ανάπτυξη

- Υπηρεσίες

- Εργολάβος

- προγραμματιστές

- ανάπτυξη

- Ανάπτυξη

- εξελίξεις

- νόμισμα

- έγγραφο

- τεκμηρίωση

- κάτω

- κάθε

- Νωρίτερα

- εύκολος

- προσπάθειες

- εγκρίνει

- εξασφαλίζω

- Εσθονία

- Even

- Κάθε

- παράδειγμα

- υφιστάμενα

- εμπειρία

- εκμεταλλεύεται

- εκτεθειμένος

- FBI

- φόβος

- Ομοσπονδιακός

- λίγοι

- Αρχεία

- τελικός

- Όνομα

- Συγκέντρωση

- Για

- τέσσερα

- Γαλλικά

- από

- εκπληρώνοντας

- πλήρη

- λειτουργικότητα

- μελλοντικός

- Germany

- Παγκόσμιο

- Κυβέρνηση

- Κυβέρνηση

- εξαιρετική

- μεγαλύτερη

- Έδαφος

- καθοδήγηση

- κατευθυντήριων γραμμών

- Έχω

- που έχει

- Καρδιά

- βοήθεια

- βοήθεια

- Ψηλά

- υψηλό προφίλ

- ιστορία

- ελπίζω

- Πως

- Πώς να

- HTTPS

- i

- ιδανικά

- if

- Επίπτωση

- σημαντικό

- βελτίωση

- in

- περιστατικό

- περιλαμβάνει

- Συμπεριλαμβανομένου

- βιομηχανία

- πληροφορίες

- την ασφάλεια των πληροφοριών

- της τεχνολογίας των πληροφοριών

- Υποδομή

- συμφυής

- Καινοτομία

- εισαγωγή

- είσοδοι

- Ινστιτούτο

- Νοημοσύνη

- International

- σε

- κατά κανόνα

- Διερευνήσεις

- Ιρλανδία

- Ισραήλ

- ζήτημα

- Εκδόθηκε

- θέματα

- IT

- ιταλικός

- ΤΟΥ

- Ιαπωνία

- jpg

- Διατήρηση

- Κλειδί

- Είδος

- Βασίλειο

- Ξέρω

- Κορέα

- εν τέλει

- οδηγήσει

- που οδηγεί

- αφήνοντας

- Μου αρέσει

- LIMIT

- Λιστα

- ll

- που

- Η διατήρηση

- κάνω

- Κατασκευή

- διαχείριση

- σημάδι

- Ενδέχεται..

- κακή χρήση

- μείωση

- μοντέλο

- μοντέλα

- παρακολούθηση

- περισσότερο

- πλέον

- πολύ

- εθνικός

- Εθνική ενημέρωση

- Εθνικός Οργανισμός Ανάπτυξης Πληροφορικής

- Εθνική ασφάλεια

- NCSC

- απαραίτητος

- Ανάγκη

- ανάγκες

- Νέα

- New Zealand

- Νιγηρία

- NITDA

- Νορβηγικά

- μυθιστόρημα

- αριθμός

- αριθμοί

- of

- προσφορά

- Office

- επίσημος ανώτερος υπάλληλος

- on

- ONE

- αποκλειστικά

- λειτουργούν

- λειτουργία

- Ευκαιρίες

- Επιλογή

- or

- ΑΛΛΑ

- επί

- Ειρήνη

- συμμέτοχος

- Ειδικότερα

- Το παρελθόν

- φάση

- φαινομενικός

- Μέρος

- φώναξε

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- Σημείο

- Poland

- πολιτική

- δυνατός

- δυναμικού

- μυστικότητα

- διαδικασια μας

- προστατεύονται

- προστασία

- προστασία

- υπερήφανος

- Παρόχους υπηρεσιών

- δημοσιεύθηκε

- Ερωτήσεις

- αύξηση

- Ετοιμότητα

- συνειδητοποιήσουν

- κυκλοφόρησε

- Δημοκρατία

- απαιτούν

- απαίτηση

- απαιτήσεις

- έρευνα

- Υποστηρικτικό υλικό

- εκείνοι

- απάντησης

- αξιοπίστως

- κινδύνους

- εύρωστος

- s

- ένα ασφαλές

- διασφαλίσεις

- ασφάλεια

- Ασφάλεια

- Είπε

- λέει

- Επιστήμη

- δευτερεύων

- Τμήμα

- προστατευμένο περιβάλλον

- ασφάλεια

- ασφάλεια

- κινδύνους ασφάλειας

- Απειλές ασφαλείας

- υπηρεσία

- διάπλαση

- θα πρέπει να

- σήματα

- σημαντικός

- Σημάδια

- Singapore

- So

- Χώρος

- συγκεκριμένες

- Προσωπικό

- Στάδιο

- στάδια

- πρότυπα

- Κατάσταση

- Μελών

- Βήμα

- αποθηκεύονται

- στρατηγικές

- Στρατηγική

- Προτείνει

- προμήθεια

- αλυσίδας εφοδιασμού

- υποστήριξη

- Επιφάνεια

- σύστημα

- συστήματα

- tech

- τεχνολογίας

- Τεχνικός

- τεχνολογικός

- Τεχνολογία

- ΑΝΑΠΤΥΞΗ ΤΕΧΝΟΛΟΓΙΑΣ

- της τεχνολογίας

- ότι

- Η

- τους

- τότε

- Εκεί.

- Αυτοί

- αυτοί

- αυτό

- φέτος

- εκείνοι

- απειλές

- παντού

- ώρα

- Τίτλος

- προς την

- πολύ

- κορυφή

- τροχιά

- εκπαιδευμένο

- Διαφάνεια

- ενεργοποιούν

- όντως

- ΣΤΡΟΦΗ

- Uk

- κατανόηση

- us

- χρήση

- μεταχειρισμένος

- Χρήστες

- Ve

- πωλητές

- επαληθεύεται

- εκδόσεις

- Θέματα ευπάθειας

- Ευάλωτες

- ήταν

- we

- ήταν

- Τι

- πότε

- αν

- Ποιό

- θα

- με

- θαυμάσιος

- Εργασία

- θα

- έτος

- χρόνια

- Ζηλανδία

- zephyrnet