Η τεχνητή νοημοσύνη (AI) είναι ένας ταχέως εξελισσόμενος τομέας με τη δυνατότητα να βελτιώσει και να μεταμορφώσει πολλές πτυχές της κοινωνίας. Το 2023, ο ρυθμός υιοθέτησης των τεχνολογιών τεχνητής νοημοσύνης επιταχύνθηκε περαιτέρω με την ανάπτυξη ισχυρών μοντέλων θεμελίωσης (FM) και τη συνακόλουθη πρόοδο στις δυνατότητες παραγωγής τεχνητής νοημοσύνης.

Στην Amazon, έχουμε λανσάρει πολλαπλές παραγωγικές υπηρεσίες τεχνητής νοημοσύνης, όπως π.χ Θεμέλιο του Αμαζονίου και Amazon Code Whisperer, και έχουν διαθέσει μια σειρά μοντέλων παραγωγής υψηλής ικανότητας μέσω Amazon SageMaker JumpStart. Αυτές οι υπηρεσίες έχουν σχεδιαστεί για να υποστηρίζουν τους πελάτες μας στο ξεκλείδωμα των αναδυόμενων δυνατοτήτων της γενετικής τεχνητής νοημοσύνης, συμπεριλαμβανομένης της ενισχυμένης δημιουργικότητας, της εξατομικευμένης και δυναμικής δημιουργίας περιεχομένου και του καινοτόμου σχεδιασμού. Μπορούν επίσης να επιτρέψουν στους επαγγελματίες της τεχνητής νοημοσύνης να κατανοήσουν τον κόσμο όσο ποτέ άλλοτε - αντιμετωπίζοντας τα γλωσσικά εμπόδια, την κλιματική αλλαγή, την επιτάχυνση των επιστημονικών ανακαλύψεων και πολλά άλλα.

Ωστόσο, για να αξιοποιήσετε πλήρως τις δυνατότητες της γενετικής τεχνητής νοημοσύνης, είναι σημαντικό να σκεφτείτε προσεκτικά τυχόν πιθανούς κινδύνους. Πρώτα και κύρια, αυτό ωφελεί τους ενδιαφερόμενους φορείς του συστήματος τεχνητής νοημοσύνης προωθώντας την υπεύθυνη και ασφαλή ανάπτυξη και εγκατάσταση και ενθαρρύνοντας την υιοθέτηση προληπτικών μέτρων για την αντιμετώπιση πιθανών επιπτώσεων. Κατά συνέπεια, η δημιουργία μηχανισμών για την αξιολόγηση και τη διαχείριση του κινδύνου είναι μια σημαντική διαδικασία που πρέπει να λάβουν υπόψη οι επαγγελματίες της τεχνητής νοημοσύνης και έχει γίνει βασικό συστατικό πολλών αναδυόμενων προτύπων της βιομηχανίας τεχνητής νοημοσύνης (για παράδειγμα, ISO 42001, ISO 23894, να NIST RMF) και νομοθεσία (όπως π.χ Νόμος για την τεχνητή νοημοσύνη της ΕΕ).

Σε αυτήν την ανάρτηση, συζητάμε πώς να αξιολογήσετε τον πιθανό κίνδυνο του συστήματος AI σας.

Ποια είναι τα διαφορετικά επίπεδα κινδύνου;

Ενώ μπορεί να είναι ευκολότερο να αρχίσετε να εξετάζετε ένα μεμονωμένο μοντέλο μηχανικής μάθησης (ML) και τους σχετικούς κινδύνους μεμονωμένα, είναι σημαντικό να λάβετε υπόψη τις λεπτομέρειες της συγκεκριμένης εφαρμογής ενός τέτοιου μοντέλου και την αντίστοιχη περίπτωση χρήσης ως μέρος ενός πλήρους συστήματος AI . Στην πραγματικότητα, ένα τυπικό σύστημα τεχνητής νοημοσύνης είναι πιθανό να βασίζεται σε πολλά διαφορετικά μοντέλα ML που συνεργάζονται και ένας οργανισμός μπορεί να επιδιώκει να δημιουργήσει πολλά διαφορετικά συστήματα τεχνητής νοημοσύνης. Κατά συνέπεια, οι κίνδυνοι μπορούν να αξιολογηθούν για κάθε περίπτωση χρήσης και σε διαφορετικά επίπεδα, δηλαδή κίνδυνο μοντέλου, κίνδυνος συστήματος τεχνητής νοημοσύνης και επιχειρηματικός κίνδυνος.

Ο επιχειρηματικός κίνδυνος περιλαμβάνει το ευρύ φάσμα των κινδύνων που μπορεί να αντιμετωπίσει ένας οργανισμός, συμπεριλαμβανομένων των οικονομικών, λειτουργικών και στρατηγικών κινδύνων. Ο κίνδυνος συστήματος τεχνητής νοημοσύνης εστιάζεται στον αντίκτυπο που σχετίζεται με την εφαρμογή και τη λειτουργία συστημάτων τεχνητής νοημοσύνης, ενώ ο κίνδυνος μοντέλων ML αφορά συγκεκριμένα τα τρωτά σημεία και τις αβεβαιότητες που ενυπάρχουν στα μοντέλα ML.

Σε αυτήν την ανάρτηση, εστιάζουμε κυρίως στον κίνδυνο συστήματος AI. Ωστόσο, είναι σημαντικό να σημειωθεί ότι όλα τα διαφορετικά επίπεδα διαχείρισης κινδύνου σε έναν οργανισμό πρέπει να λαμβάνονται υπόψη και να ευθυγραμμίζονται.

Πώς ορίζεται ο κίνδυνος συστήματος AI;

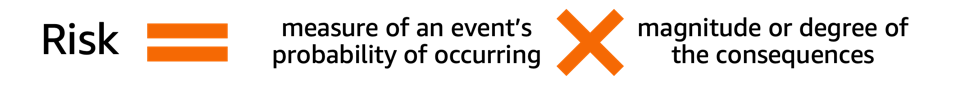

Η διαχείριση κινδύνου στο πλαίσιο ενός συστήματος τεχνητής νοημοσύνης μπορεί να είναι μια οδός για την ελαχιστοποίηση της επίδρασης της αβεβαιότητας ή των πιθανών αρνητικών επιπτώσεων, παρέχοντας παράλληλα ευκαιρίες για τη μεγιστοποίηση των θετικών επιπτώσεων. Ο ίδιος ο κίνδυνος δεν είναι μια πιθανή βλάβη, αλλά η επίδραση της αβεβαιότητας στους στόχους. Σύμφωνα με την Πλαίσιο Διαχείρισης Κινδύνων NIST (NIST RMF), ο κίνδυνος μπορεί να εκτιμηθεί ως πολλαπλασιαστικό μέτρο της πιθανότητας εμφάνισης ενός γεγονότος χρονομετρημένο με βάση τα μεγέθη των συνεπειών του αντίστοιχου γεγονότος.

Υπάρχουν δύο πτυχές του κινδύνου: ο εγγενής κίνδυνος και ο υπολειπόμενος κίνδυνος. Ο εγγενής κίνδυνος αντιπροσωπεύει το μέγεθος του κινδύνου που παρουσιάζει το σύστημα τεχνητής νοημοσύνης ελλείψει μετριασμού ή ελέγχων. Ο υπολειπόμενος κίνδυνος συλλαμβάνει τους υπόλοιπους κινδύνους μετά από συνυπολογισμό των στρατηγικών μετριασμού.

Να έχετε πάντα υπόψη σας ότι η αξιολόγηση κινδύνου είναι μια ανθρωποκεντρική δραστηριότητα που απαιτεί προσπάθειες σε όλο τον οργανισμό. Αυτές οι προσπάθειες κυμαίνονται από τη διασφάλιση της συμμετοχής όλων των σχετικών ενδιαφερομένων στη διαδικασία αξιολόγησης (όπως ομάδες προϊόντων, μηχανικής, επιστήμης, πωλήσεων και ασφάλειας) έως την αξιολόγηση του τρόπου με τον οποίο οι κοινωνικές προοπτικές και κανόνες επηρεάζουν την αντιληπτή πιθανότητα και τις συνέπειες ορισμένων γεγονότων.

Γιατί πρέπει ο οργανισμός σας να ενδιαφέρεται για την αξιολόγηση κινδύνου;

Η δημιουργία πλαισίων διαχείρισης κινδύνου για συστήματα τεχνητής νοημοσύνης μπορεί να ωφελήσει την κοινωνία γενικότερα, προωθώντας τον ασφαλή και υπεύθυνο σχεδιασμό, ανάπτυξη και λειτουργία συστημάτων τεχνητής νοημοσύνης. Τα πλαίσια διαχείρισης κινδύνου μπορούν επίσης να ωφελήσουν τους οργανισμούς μέσω των εξής:

- Βελτιωμένη λήψη αποφάσεων – Κατανοώντας τους κινδύνους που σχετίζονται με τα συστήματα τεχνητής νοημοσύνης, οι οργανισμοί μπορούν να λάβουν καλύτερες αποφάσεις σχετικά με τον μετριασμό αυτών των κινδύνων και να χρησιμοποιήσουν τα συστήματα τεχνητής νοημοσύνης με ασφαλή και υπεύθυνο τρόπο

- Αυξημένος σχεδιασμός συμμόρφωσης – Ένα πλαίσιο αξιολόγησης κινδύνου μπορεί να βοηθήσει τους οργανισμούς να προετοιμαστούν για τις απαιτήσεις εκτίμησης κινδύνου στους σχετικούς νόμους και κανονισμούς

- Οικοδόμηση εμπιστοσύνης – Αποδεικνύοντας ότι λαμβάνουν μέτρα για τον μετριασμό των κινδύνων των συστημάτων τεχνητής νοημοσύνης, οι οργανισμοί μπορούν να δείξουν στους πελάτες και στα ενδιαφερόμενα μέρη τους ότι έχουν δεσμευτεί να χρησιμοποιούν την τεχνητή νοημοσύνη με ασφαλή και υπεύθυνο τρόπο

Πώς να αξιολογήσετε τον κίνδυνο;

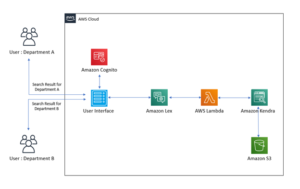

Ως πρώτο βήμα, ένας οργανισμός θα πρέπει να εξετάσει το ενδεχόμενο να περιγράψει την περίπτωση χρήσης τεχνητής νοημοσύνης που πρέπει να αξιολογηθεί και να εντοπίσει όλους τους σχετικούς μετόχους. Μια περίπτωση χρήσης είναι ένα συγκεκριμένο σενάριο ή κατάσταση που περιγράφει τον τρόπο με τον οποίο οι χρήστες αλληλεπιδρούν με ένα σύστημα AI για την επίτευξη ενός συγκεκριμένου στόχου. Κατά τη δημιουργία μιας περιγραφής περίπτωσης χρήσης, μπορεί να είναι χρήσιμο να προσδιορίσετε το επιχειρηματικό πρόβλημα που επιλύεται, να απαριθμήσετε τα ενδιαφερόμενα μέρη, να χαρακτηρίσετε τη ροή εργασίας και να παρέχετε λεπτομέρειες σχετικά με τις βασικές εισροές και εκροές του συστήματος.

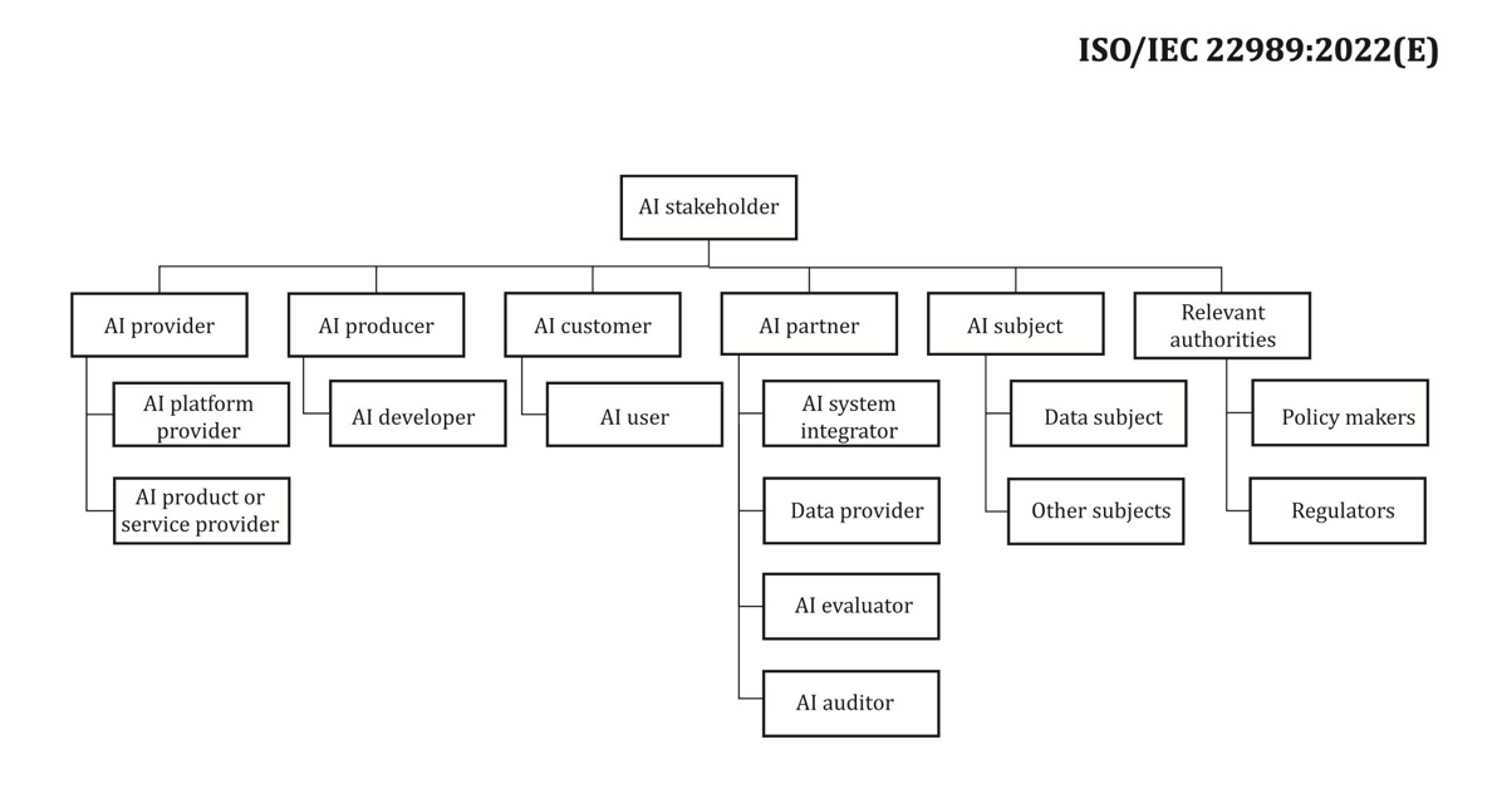

Όσον αφορά τα ενδιαφερόμενα μέρη, είναι εύκολο να παραβλέψουμε κάποιους. Το παρακάτω σχήμα είναι ένα καλό σημείο εκκίνησης για τη χαρτογράφηση των ρόλων των ενδιαφερόμενων μερών AI.

Πηγή: «Τεχνολογία πληροφοριών – Τεχνητή νοημοσύνη – Έννοιες και ορολογία τεχνητής νοημοσύνης».

Ένα σημαντικό επόμενο βήμα της αξιολόγησης κινδύνου συστήματος AI είναι ο εντοπισμός δυνητικά επιβλαβών συμβάντων που σχετίζονται με την περίπτωση χρήσης. Κατά την εξέταση αυτών των γεγονότων, μπορεί να είναι χρήσιμο να αναλογιστούμε διαφορετικές διαστάσεις της υπεύθυνης τεχνητής νοημοσύνης, όπως η δικαιοσύνη και η ευρωστία, για παράδειγμα. Διαφορετικοί ενδιαφερόμενοι μπορεί να επηρεαστούν σε διαφορετικούς βαθμούς σε διαφορετικές διαστάσεις. Για παράδειγμα, ένας κίνδυνος χαμηλής ευρωστίας για έναν τελικό χρήστη θα μπορούσε να είναι το αποτέλεσμα ενός συστήματος τεχνητής νοημοσύνης που παρουσιάζει μικρές διακοπές, ενώ ένας χαμηλός κίνδυνος δικαιοσύνης θα μπορούσε να προκληθεί από ένα σύστημα τεχνητής νοημοσύνης που παράγει αμελητέα διαφορετικά αποτελέσματα για διαφορετικές δημογραφικές ομάδες.

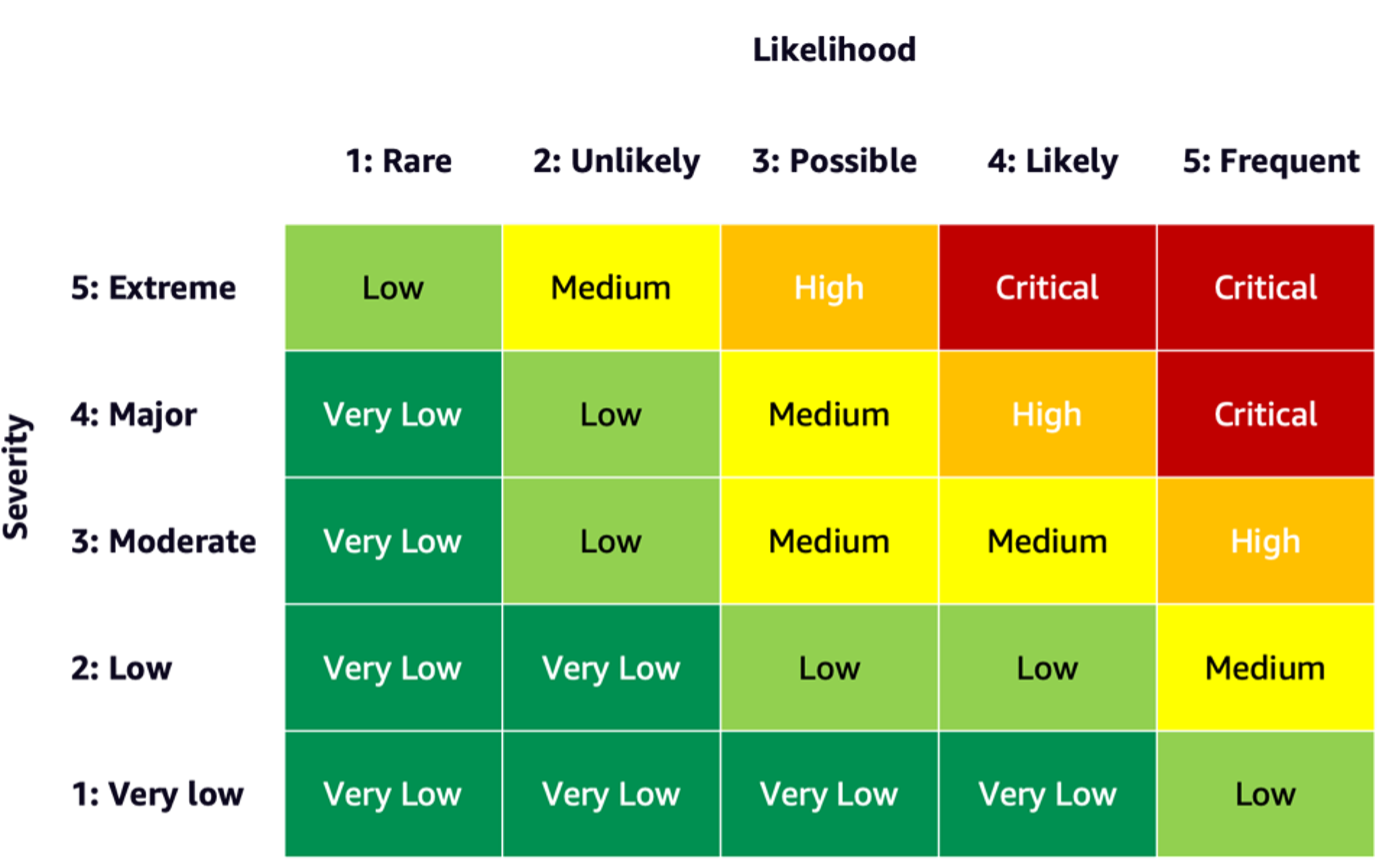

Για να εκτιμήσετε τον κίνδυνο ενός συμβάντος, μπορείτε να χρησιμοποιήσετε μια κλίμακα πιθανότητας σε συνδυασμό με μια κλίμακα σοβαρότητας για να μετρήσετε την πιθανότητα εμφάνισης καθώς και τον βαθμό των συνεπειών. Ένα χρήσιμο σημείο εκκίνησης κατά την ανάπτυξη αυτών των κλιμάκων μπορεί να είναι το NIST RMF, το οποίο προτείνει τη χρήση ποιοτικών μη αριθμητικών κατηγοριών που κυμαίνονται από πολύ χαμηλό έως πολύ υψηλό κίνδυνο ή αρχές ημιποσοτικών αξιολογήσεων, όπως κλίμακες (όπως 1-10), κάδοι ή με άλλο τρόπο αντιπροσωπευτικούς αριθμούς. Αφού ορίσετε τις κλίμακες πιθανότητας και σοβαρότητας για όλες τις σχετικές διαστάσεις, μπορείτε να χρησιμοποιήσετε ένα σχήμα πίνακα κινδύνου για να ποσοτικοποιήσετε τον συνολικό κίνδυνο ανά ενδιαφερόμενο μέρος σε κάθε σχετική διάσταση. Το παρακάτω σχήμα δείχνει ένα παράδειγμα πίνακα κινδύνου.

Χρησιμοποιώντας αυτόν τον πίνακα κινδύνου, μπορούμε να θεωρήσουμε ένα γεγονός με χαμηλή σοβαρότητα και σπάνια πιθανότητα να συμβεί ως πολύ χαμηλό κίνδυνο. Λάβετε υπόψη ότι η αρχική αξιολόγηση θα είναι μια εκτίμηση του εγγενούς κινδύνου και οι στρατηγικές μετριασμού του κινδύνου μπορούν να βοηθήσουν στη μείωση των επιπέδων κινδύνου περαιτέρω. Η διαδικασία μπορεί στη συνέχεια να επαναληφθεί για να δημιουργηθεί μια αξιολόγηση για τυχόν υπολειπόμενο κίνδυνο ανά συμβάν. Εάν υπάρχουν πολλά συμβάντα που προσδιορίζονται κατά μήκος της ίδιας διάστασης, μπορεί να είναι χρήσιμο να επιλέξετε το υψηλότερο επίπεδο κινδύνου μεταξύ όλων για να δημιουργήσετε μια τελική περίληψη αξιολόγησης.

Χρησιμοποιώντας την τελική περίληψη αξιολόγησης, οι οργανισμοί θα πρέπει να καθορίσουν ποια επίπεδα κινδύνου είναι αποδεκτά για τα συστήματα τεχνητής νοημοσύνης τους καθώς και να εξετάσουν τους σχετικούς κανονισμούς και πολιτικές.

δέσμευση AWS

Μέσα από δεσμεύσεις με το Λευκός Οίκος και UN, μεταξύ άλλων, δεσμευόμαστε να μοιραζόμαστε τη γνώση και την τεχνογνωσία μας για να προωθήσουμε την υπεύθυνη και ασφαλή χρήση της τεχνητής νοημοσύνης. Σε αυτές τις γραμμές, ο Adam Selipsky της Amazon εκπροσώπησε πρόσφατα την AWS στο Διάσκεψη κορυφής για την ασφάλεια AI με αρχηγούς κρατών και ηγέτες του κλάδου παρόντες, επιδεικνύοντας περαιτέρω την αφοσίωσή μας στη συνεργασία για την υπεύθυνη πρόοδο της τεχνητής νοημοσύνης.

Συμπέρασμα

Καθώς η τεχνητή νοημοσύνη συνεχίζει να προοδεύει, η αξιολόγηση κινδύνου γίνεται ολοένα και πιο σημαντική και χρήσιμη για οργανισμούς που θέλουν να δημιουργήσουν και να αναπτύξουν την τεχνητή νοημοσύνη υπεύθυνα. Καθιερώνοντας ένα πλαίσιο αξιολόγησης κινδύνου και σχέδιο μετριασμού κινδύνου, οι οργανισμοί μπορούν να μειώσουν τον κίνδυνο πιθανών συμβάντων που σχετίζονται με την τεχνητή νοημοσύνη και να κερδίσουν την εμπιστοσύνη με τους πελάτες τους, καθώς και να αποκομίσουν οφέλη όπως βελτιωμένη αξιοπιστία, βελτιωμένη δικαιοσύνη για διαφορετικά δημογραφικά στοιχεία και πολλά άλλα.

Προχωρήστε και ξεκινήστε το ταξίδι σας για την ανάπτυξη ενός πλαισίου αξιολόγησης κινδύνου στον οργανισμό σας και μοιραστείτε τις σκέψεις σας στα σχόλια.

Δείτε επίσης μια επισκόπηση των γενετικών κινδύνων τεχνητής νοημοσύνης που δημοσιεύτηκε στο Amazon Science: Υπεύθυνη τεχνητή νοημοσύνη στην εποχή της παραγωγήςκαι εξερευνήστε το εύρος των υπηρεσιών AWS που μπορούν να σας υποστηρίξουν στην αξιολόγηση κινδύνου και το ταξίδι μετριασμού: Amazon SageMaker Clerify, Παρακολούθηση μοντέλου Amazon SageMaker, AWS CloudTrail, Καθώς και το πρότυπο πλαίσιο διακυβέρνησης.

Σχετικά με τους Συγγραφείς

Mia C. Mayer είναι Εφαρμοσμένος Επιστήμονας και εκπαιδευτικός ML στο Πανεπιστήμιο Μηχανικής Μάθησης AWS. όπου ερευνά και διδάσκει την ασφάλεια, την επεξήγηση και τη δικαιοσύνη των συστημάτων Machine Learning και AI. Καθ' όλη τη διάρκεια της καριέρας της, η Mia δημιούργησε πολλά πανεπιστημιακά προγράμματα προβολής, ενήργησε ως προσκεκλημένη ομιλήτρια και κεντρική ομιλήτρια και παρουσιάστηκε σε πολλά μεγάλα συνέδρια μάθησης. Βοηθά επίσης τις εσωτερικές ομάδες και τους πελάτες AWS να ξεκινήσουν το υπεύθυνο ταξίδι τους AI.

Mia C. Mayer είναι Εφαρμοσμένος Επιστήμονας και εκπαιδευτικός ML στο Πανεπιστήμιο Μηχανικής Μάθησης AWS. όπου ερευνά και διδάσκει την ασφάλεια, την επεξήγηση και τη δικαιοσύνη των συστημάτων Machine Learning και AI. Καθ' όλη τη διάρκεια της καριέρας της, η Mia δημιούργησε πολλά πανεπιστημιακά προγράμματα προβολής, ενήργησε ως προσκεκλημένη ομιλήτρια και κεντρική ομιλήτρια και παρουσιάστηκε σε πολλά μεγάλα συνέδρια μάθησης. Βοηθά επίσης τις εσωτερικές ομάδες και τους πελάτες AWS να ξεκινήσουν το υπεύθυνο ταξίδι τους AI.

Denis V. Batalov είναι 17χρονος βετεράνος της Amazon και διδάκτωρ στη Μηχανική Μάθηση, ο Ντένις εργάστηκε σε τέτοια συναρπαστικά έργα όπως το Search Inside the Book, οι εφαρμογές Amazon Mobile και το Kindle Direct Publishing. Από το 2013 έχει βοηθήσει τους πελάτες της AWS να υιοθετήσουν την τεχνολογία AI/ML ως Αρχιτέκτονας Λύσεων. Επί του παρόντος, ο Denis είναι παγκόσμιος ηγέτης τεχνολογίας για το AI/ML υπεύθυνος για τη λειτουργία των AWS ML Specialist Solutions Architects παγκοσμίως. Ο Ντένις είναι συχνός δημόσιος ομιλητής, μπορείτε να τον ακολουθήσετε στο Twitter @dbatalov.

Denis V. Batalov είναι 17χρονος βετεράνος της Amazon και διδάκτωρ στη Μηχανική Μάθηση, ο Ντένις εργάστηκε σε τέτοια συναρπαστικά έργα όπως το Search Inside the Book, οι εφαρμογές Amazon Mobile και το Kindle Direct Publishing. Από το 2013 έχει βοηθήσει τους πελάτες της AWS να υιοθετήσουν την τεχνολογία AI/ML ως Αρχιτέκτονας Λύσεων. Επί του παρόντος, ο Denis είναι παγκόσμιος ηγέτης τεχνολογίας για το AI/ML υπεύθυνος για τη λειτουργία των AWS ML Specialist Solutions Architects παγκοσμίως. Ο Ντένις είναι συχνός δημόσιος ομιλητής, μπορείτε να τον ακολουθήσετε στο Twitter @dbatalov.

Δρ Sara Liu είναι Ανώτερος Τεχνικός Διευθυντής Προγράμματος με την ομάδα AWS Responsible AI. Συνεργάζεται με μια ομάδα επιστημόνων, επικεφαλής των συνόλων δεδομένων, μηχανικούς ML, ερευνητές, καθώς και με άλλες διαλειτουργικές ομάδες για να ανεβάσει την υπεύθυνη γραμμή τεχνητής νοημοσύνης στις υπηρεσίες AWS AI. Τα τρέχοντα έργα της περιλαμβάνουν την ανάπτυξη καρτών υπηρεσιών τεχνητής νοημοσύνης, τη διεξαγωγή αξιολογήσεων κινδύνου για υπεύθυνη τεχνητή νοημοσύνη, τη δημιουργία συνόλων δεδομένων αξιολόγησης υψηλής ποιότητας και την εφαρμογή προγραμμάτων ποιότητας. Βοηθά επίσης εσωτερικές ομάδες και πελάτες να πληρούν τα εξελισσόμενα πρότυπα της βιομηχανίας AI.

Δρ Sara Liu είναι Ανώτερος Τεχνικός Διευθυντής Προγράμματος με την ομάδα AWS Responsible AI. Συνεργάζεται με μια ομάδα επιστημόνων, επικεφαλής των συνόλων δεδομένων, μηχανικούς ML, ερευνητές, καθώς και με άλλες διαλειτουργικές ομάδες για να ανεβάσει την υπεύθυνη γραμμή τεχνητής νοημοσύνης στις υπηρεσίες AWS AI. Τα τρέχοντα έργα της περιλαμβάνουν την ανάπτυξη καρτών υπηρεσιών τεχνητής νοημοσύνης, τη διεξαγωγή αξιολογήσεων κινδύνου για υπεύθυνη τεχνητή νοημοσύνη, τη δημιουργία συνόλων δεδομένων αξιολόγησης υψηλής ποιότητας και την εφαρμογή προγραμμάτων ποιότητας. Βοηθά επίσης εσωτερικές ομάδες και πελάτες να πληρούν τα εξελισσόμενα πρότυπα της βιομηχανίας AI.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- PlatoHealth. Ευφυΐα βιοτεχνολογίας και κλινικών δοκιμών. Πρόσβαση εδώ.

- πηγή: https://aws.amazon.com/blogs/machine-learning/learn-how-to-assess-risk-of-ai-systems/

- :έχει

- :είναι

- :δεν

- :που

- 100

- 118

- 150

- 2013

- 2023

- 33

- 7

- a

- Σχετικα

- επιτάχυνση

- επιταχύνοντας

- αποδεκτό

- Σύμφωνα με

- Κατορθώνω

- απέναντι

- δραστηριότητα

- Αδάμ

- διεύθυνση

- ενστερνίζομαι

- Υιοθεσία

- εκ των προτέρων

- προαγωγή

- επηρεαστούν

- Μετά το

- εμπρός

- AI

- Κίνδυνοι AI

- Υπηρεσίες AI

- Συστήματα AI

- AI / ML

- ευθυγραμμισμένος

- Όλα

- κατά μήκος

- Επίσης

- Amazon

- Amazon υπηρεσίες Web

- μεταξύ των

- ποσό

- an

- και

- κάθε

- Εφαρμογή

- εφαρμοσμένος

- εφαρμογές

- αρχιτέκτονες

- ΕΙΝΑΙ

- τεχνητός

- τεχνητή νοημοσύνη

- AS

- πτυχές

- εκτιμώ

- αξιολόγηση

- Αξιολόγηση

- εκτίμηση

- αξιολογήσεις

- συσχετισμένη

- At

- παρουσία

- διαθέσιμος

- AWS

- Μηχανική εκμάθηση AWS

- μπαρ

- εμπόδια

- βασίζονται

- BE

- γίνονται

- να γίνει

- είναι

- όφελος

- οφέλη

- Καλύτερα

- κάδους

- βιβλίο

- ευρύς

- χτίζω

- επιχείρηση

- αλλά

- by

- CAN

- δυνατότητες

- ικανός

- συλλαμβάνει

- Κάρτες

- ο οποίος

- Σταδιοδρομία

- προσεκτικά

- περίπτωση

- κατηγορίες

- προκαλούνται

- ορισμένες

- αλλαγή

- χαρακτηρίζω

- έλεγχος

- Κλίμα

- Κλιματική αλλαγή

- συνεργάζεται

- συνδυασμός

- έρχεται

- σχόλια

- δεσμεύεται

- πλήρης

- Συμμόρφωση

- συστατικό

- έννοιες

- Διεξαγωγή

- συνέδρια

- Συνέπειες

- συνεπώς

- Εξετάστε

- θεωρούνται

- θεωρώντας

- περιεχόμενο

- δημιουργία περιεχομένου

- συμφραζόμενα

- συνεχίζεται

- ελέγχους

- πυρήνας

- Αντίστοιχος

- θα μπορούσε να

- δημιουργία

- δημιουργία

- δημιουργία

- δημιουργικότητα

- διαλειτουργικές ομάδες

- Ρεύμα

- Τη στιγμή

- Πελάτες

- σύνολα δεδομένων

- αποφάσεις

- αφιέρωση

- ορίζεται

- ορίζεται

- Πτυχίο

- δημογραφικός

- Δημογραφικά στοιχεία

- αποδεικνύοντας

- παρατάσσω

- ανάπτυξη

- Περιγράφοντας

- περιγραφή

- Υπηρεσίες

- σχεδιασμένα

- καθέκαστα

- ανάπτυξη

- Ανάπτυξη

- διαφορετικές

- Διάσταση

- Διαστάσεις

- κατευθύνει

- συζητήσουν

- διαταραχές

- δυναμικός

- κάθε

- κερδίζουν

- ευκολότερη

- εύκολος

- αποτέλεσμα

- προσπάθειες

- σμυριδόπετρα

- ενεργοποιήσετε

- περιλαμβάνει

- ενθάρρυνση

- αρραβώνες

- Μηχανική

- Μηχανικοί

- ενισχυμένη

- εξασφαλίζοντας

- Εταιρεία

- εγκατεστημένος

- δημιουργία

- εκτίμηση

- αναμενόμενη

- αξιολόγηση

- εκτίμηση

- Συμβάν

- εκδηλώσεις

- εξελίσσεται

- παράδειγμα

- συναρπαστικός

- Εκθέτοντας

- εκθέματα

- εξειδίκευση

- διερευνήσει

- Πρόσωπο

- γεγονός

- factoring

- δικαιοσύνη

- πεδίο

- Εικόνα

- τελικός

- οικονομικός

- Όνομα

- Συγκέντρωση

- εστιάζει

- ακολουθήστε

- Εξής

- Για

- πρώτιστος

- Θεμέλιο

- Πλαίσιο

- πλαισίων

- συχνάζω

- από

- πλήρη

- λειτουργία

- περαιτέρω

- παράγουν

- γενετική

- Παραγωγική τεχνητή νοημοσύνη

- παίρνω

- Παγκόσμια

- γκολ

- καλός

- διακυβέρνησης

- Ομάδα

- Επισκέπτης

- βλάψει

- επιβλαβής

- Έχω

- he

- κεφαλές

- βοήθεια

- βοήθησε

- χρήσιμο

- βοηθά

- αυτήν

- Ψηλά

- υψηλής ποιότητας

- υψηλότερο

- υψηλά

- αυτόν

- Πως

- Πώς να

- Ωστόσο

- HTML

- HTTPS

- προσδιορίζονται

- προσδιορίσει

- if

- Επίπτωση

- Επιπτώσεις

- εκτέλεση

- εκτελεστικών

- σημαντικό

- βελτίωση

- βελτιωθεί

- in

- περιλαμβάνονται

- Συμπεριλαμβανομένου

- όλο και περισσότερο

- ατομικές

- βιομηχανία

- βιομηχανικά πρότυπα

- επιρροή

- συμφυής

- αρχικός

- καινοτόμες

- είσοδοι

- μέσα

- Νοημοσύνη

- αλληλεπιδρούν

- εσωτερικός

- εμπλέκω

- συμμετέχουν

- ISO

- απομόνωση

- IT

- εαυτό

- ταξίδι

- jpg

- Διατήρηση

- Κλειδί

- Keynote

- Κεντρικός ομιλητής

- γνώση

- Γλώσσα

- large

- ξεκίνησε

- Του νόμου

- ηγέτης

- ηγέτες

- Οδηγεί

- ΜΑΘΑΊΝΩ

- μάθηση

- Νομοθεσία

- Επίπεδο

- επίπεδα

- πιθανότητα

- Πιθανός

- γραμμές

- Λιστα

- κοιτάζοντας

- Χαμηλός

- χαμηλότερα

- μηχανή

- μάθηση μηχανής

- που

- κάνω

- διαχείριση

- διαχείριση

- διευθυντής

- πολοί

- χάρτη

- Μήτρα

- Αυξάνω στον ανώτατο βαθμό

- Ενδέχεται..

- μέτρο

- μέτρα

- μηχανισμούς

- Γνωρίστε

- ενδέχεται να

- νου

- ανήλικος

- Μετριάζω

- μείωση

- ML

- Κινητό

- mobile-εφαρμογές

- μοντέλο

- μοντέλα

- περισσότερο

- πολλαπλούς

- και συγκεκριμένα

- ανάγκες

- αρνητικός

- ποτέ

- επόμενη

- nist

- κανόνες

- σημείωση

- αριθμοί

- πολυάριθμες

- στόχοι

- περιστατικό

- που συμβαίνουν

- of

- on

- λειτουργία

- επιχειρήσεων

- Ευκαιρίες

- or

- επιχειρήσεις

- οργανώσεις

- ΑΛΛΑ

- Άλλα

- αλλιώς

- δικός μας

- έξω

- εξόδους

- προβολής

- φόρμες

- επισκόπηση

- Ειρήνη

- μέρος

- Ειδικότερα

- μονοπάτι

- για

- γινεται αντιληπτο

- Εξατομικευμένη

- προοπτικές

- phd

- επιλέξτε

- σχέδιο

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- Σημείο

- Πολιτικές

- θετικός

- Θέση

- δυναμικού

- ενδεχομένως

- ισχυρός

- Προετοιμάστε

- παρουσιάζονται

- πρωτίστως

- αρχές

- Προληπτική

- Πρόβλημα

- διαδικασια μας

- που παράγουν

- Προϊόν

- Πρόγραμμα

- Προγράμματα

- έργα

- την προώθηση της

- παρέχουν

- χορήγηση

- δημόσιο

- δημοσιεύθηκε

- Δημοσιεύσεις

- ποιοτικός

- ποιότητα

- αύξηση

- σειρά

- κυμαίνεται

- ταχέως

- ΣΠΑΝΙΟΣ

- εκτίμηση

- συνειδητοποιήσουν

- θερίζω

- πρόσφατα

- μείωση

- αντανακλούν

- σχετικά με

- κανονισμοί

- αξιοπιστία

- υπόλοιπα

- επανειλημμένες

- εκπρόσωπος

- εκπροσωπούνται

- αντιπροσωπεύει

- απαιτήσεις

- Απαιτεί

- ερευνητές

- έρευνες

- υπεύθυνος

- αξιοπίστως

- αποτέλεσμα

- με αποτέλεσμα

- Κίνδυνος

- εκτίμηση του κινδύνου

- διαχείριση των κινδύνων

- κινδύνους

- ευρωστία

- ρόλους

- ένα ασφαλές

- Ασφάλεια

- σοφός

- εμπορικός

- ίδιο

- Κλίμακα

- Ζυγός

- σενάριο

- σχέδιο

- Επιστήμη

- επιστημονικός

- Επιστήμονας

- επιστήμονες

- Αναζήτηση

- προστατευμένο περιβάλλον

- ασφάλεια

- αρχαιότερος

- αίσθηση

- υπηρεσία

- Υπηρεσίες

- διάφοροι

- Κοινοποίηση

- μοιράζονται

- αυτή

- θα πρέπει να

- δείχνουν

- Δείχνει

- αφού

- κατάσταση

- Μ.Κ.Δ

- Κοινωνία

- Λύσεις

- μερικοί

- Ομιλητής

- ειδικός

- συγκεκριμένες

- ειδικά

- Φάσμα

- φορέα

- ενδιαφερόμενα μέρη

- πρότυπα

- Εκκίνηση

- ξεκίνησε

- Ξεκινήστε

- Κατάσταση

- Βήμα

- Βήματα

- Στρατηγική

- στρατηγικές

- τέτοιος

- Προτείνει

- ΠΕΡΙΛΗΨΗ

- υποστήριξη

- σύστημα

- συστήματα

- λήψη

- ομάδες

- tech

- Τεχνικός

- Τεχνολογίες

- Τεχνολογία

- ότι

- Η

- ο κόσμος

- τους

- τότε

- Εκεί.

- Αυτοί

- αυτοί

- αυτό

- εκείνοι

- Μέσω

- παντού

- Χρονικά

- προς την

- μαζι

- Μεταμορφώστε

- Εμπιστευθείτε

- Τουίτερ

- δύο

- τυπικός

- αβεβαιότητες

- Αβεβαιότητα

- κατανόηση

- πανεπιστήμιο

- ξεκλειδώματος

- χρήση

- περίπτωση χρήσης

- Χρήστες

- χρησιμοποιώντας

- πολύ

- βετεράνος

- Θέματα ευπάθειας

- we

- ιστός

- διαδικτυακές υπηρεσίες

- ΛΟΙΠΌΝ

- Τι

- πότε

- ενώ

- Ποιό

- ενώ

- θα

- με

- εντός

- εργάστηκαν

- ροής εργασίας

- εργαζόμενος

- λειτουργεί

- κόσμος

- παγκόσμιος

- Εσείς

- Σας

- zephyrnet