Esta publicación de blog está coescrita con Tuana Çelik de deepset.

La búsqueda empresarial es un componente crítico de la eficiencia organizacional a través de la digitalización de documentos y la gestión del conocimiento. La búsqueda empresarial cubre el almacenamiento de documentos como archivos digitales, la indexación de los documentos para la búsqueda y el suministro de resultados relevantes en función de las consultas de los usuarios. Con la llegada de los modelos de lenguaje extenso (LLM), podemos implementar experiencias conversacionales para proporcionar los resultados a los usuarios. Sin embargo, debemos asegurarnos de que los LLM limiten las respuestas a los datos de la empresa, mitigando así las alucinaciones del modelo.

En esta publicación, mostramos cómo crear una aplicación de inteligencia artificial generativa de extremo a extremo para la búsqueda empresarial con generación aumentada de recuperación (RAG) mediante el uso de canalizaciones Haystack y el modelo de instrucción Falcon-40b de JumpStart de Amazon SageMaker y Servicio Amazon OpenSearch. El código fuente de la muestra que se muestra en esta publicación está disponible en el Repositorio GitHub

Resumen de la solución

Para restringir las respuestas de la aplicación de IA generativa solo a los datos de la empresa, necesitamos usar una técnica llamada Generación aumentada de recuperación (RAG). Una aplicación que utiliza el enfoque RAG recupera la información más relevante para la solicitud del usuario de la base de conocimientos o el contenido de la empresa, la agrupa como contexto junto con la solicitud del usuario como un aviso y luego la envía al LLM para obtener una respuesta. Los LLM tienen limitaciones en cuanto al recuento máximo de palabras para las indicaciones de entrada, por lo que elegir los pasajes correctos entre miles o millones de documentos en la empresa tiene un impacto directo en la precisión del LLM.

La técnica RAG se ha vuelto cada vez más importante en la búsqueda empresarial. En esta publicación, mostramos un flujo de trabajo que aprovecha SageMaker JumpStart para implementar un modelo de instrucción Falcon-40b y usa Haystack para diseñar y ejecutar una canalización de respuesta de preguntas aumentada de recuperación. El flujo de trabajo de aumento de recuperación final cubre los siguientes pasos de alto nivel:

- La consulta del usuario se utiliza para un componente de recuperación, que realiza una búsqueda vectorial, para recuperar el contexto más relevante de nuestra base de datos.

- Este contexto está incrustado en un indicador que está diseñado para indicar a un LLM que genere una respuesta solo a partir del contexto proporcionado.

- El LLM genera una respuesta a la consulta original considerando solo el contexto incrustado en el aviso que recibió.

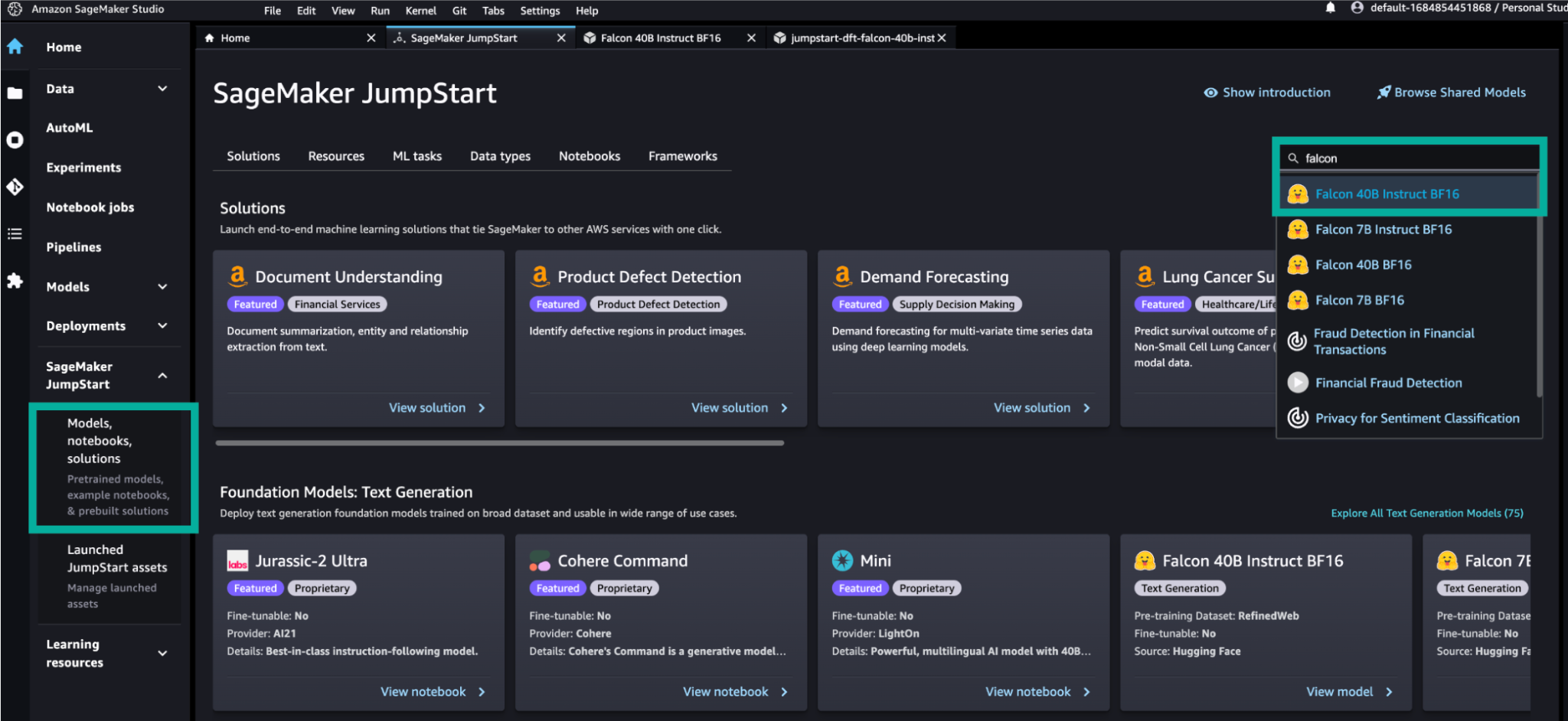

Inicio rápido de SageMaker

SageMaker JumpStart sirve como un centro de modelos que encapsula una amplia gama de modelos de aprendizaje profundo para casos de uso de texto, visión, audio e incrustación. Con más de 500 modelos, su centro de modelos comprende modelos públicos y propietarios de socios de AWS como AI21, Stability AI, Cohere y LightOn. También alberga modelos básicos desarrollados exclusivamente por Amazon, como AlexaTM. Algunos de los modelos ofrecen capacidades para que los ajuste con sus propios datos. SageMaker JumpStart también proporciona plantillas de solución que configuran la infraestructura para casos de uso comunes y cuadernos de ejemplo ejecutables para aprendizaje automático (ML) con SageMaker.

Alpaca

Alpaca es un marco de código abierto de deepset que permite a los desarrolladores orquestar aplicaciones LLM compuestas de diferentes componentes como modelos, bases de datos vectoriales, convertidores de archivos y muchos otros módulos. Haystack proporciona tuberías y Agentes, dos poderosas estructuras para diseñar aplicaciones LLM para varios casos de uso, que incluyen búsqueda, respuesta a preguntas e inteligencia artificial conversacional. Con un gran enfoque en métodos de recuperación de última generación y métricas de evaluación sólidas, le brinda todo lo que necesita para enviar una aplicación confiable. Puede serializar tuberías para Archivos YAML, exponerlos a través de un REST APIy escálelos de manera flexible con sus cargas de trabajo, lo que facilita el paso de su aplicación desde una etapa de prototipo a producción.

Búsqueda abierta de Amazon

OpenSearch Service es un servicio totalmente administrado que simplifica la implementación, el escalado y el funcionamiento de OpenSearch en la nube de AWS. OpenSearch es un paquete de software de código abierto escalable, flexible y extensible para aplicaciones de búsqueda, análisis, monitoreo de seguridad y observabilidad, con licencia Apache 2.0.

En los últimos años, las técnicas de ML se han vuelto cada vez más populares para mejorar la búsqueda. Entre ellos se encuentran el uso de modelos de incrustación, un tipo de modelo que puede codificar una gran cantidad de datos en un espacio n-dimensional donde cada entidad se codifica en un vector, un punto de datos en ese espacio, y organizado de tal manera que las entidades similares estén más juntas. Una base de datos de vectores proporciona una búsqueda eficiente de similitud de vectores al proporcionar índices especializados como los índices k-NN.

Con las capacidades de la base de datos vectorial de OpenSearch Service, puede implementar la búsqueda semántica, RAG con LLM, motores de recomendación y búsqueda de medios enriquecidos. En esta publicación, usamos RAG para permitirnos complementar los LLM generativos con una base de conocimiento externa que generalmente se construye usando una base de datos vectorial hidratada con artículos de conocimiento codificados en vectores.

Descripción general de la aplicación

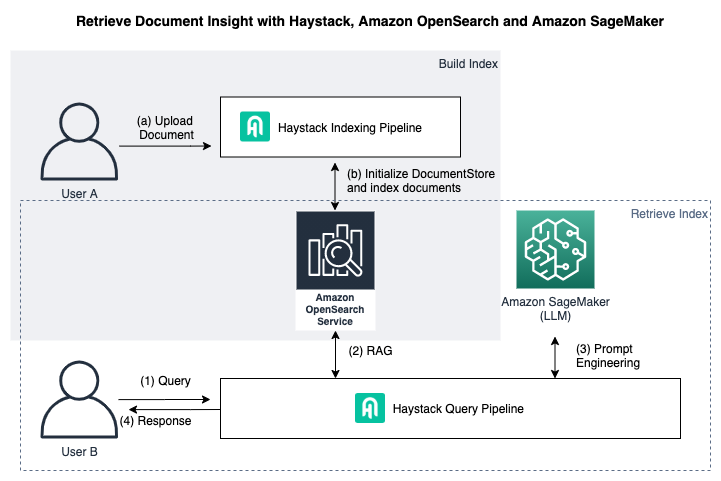

El siguiente diagrama muestra la estructura de la aplicación final.

En esta aplicación, utilizamos Haystack Indexing Pipeline para administrar documentos cargados e indexar documentos y Haystack Query Pipeline para realizar la recuperación de conocimiento de documentos indexados.

Haystack Indexing Pipeline incluye los siguientes pasos de alto nivel:

- Sube un documento.

- Inicializar

DocumentStorey documentos indexados.

Usamos OpenSearch como nuestro Almacén de documentos y un pajar tubería de indexación para preprocesar e indexar nuestros archivos en OpenSearch. Alpaca Conversores de archivos y preprocesador le permite limpiar y preparar sus archivos sin procesar para que tengan una forma y un formato que su canal de procesamiento de lenguaje natural (NLP) y el modelo de lenguaje de su elección puedan manejar. La canalización de indexación que hemos usado aquí también usa sentence-transformers/all-MiniLM-L12-v2 para crear incrustaciones para cada documento, que utilizamos para una recuperación eficiente.

Haystack Query Pipeline incluye los siguientes pasos de alto nivel:

- Enviamos una consulta a la canalización RAG.

- An IncrustaciónRetriever componente actúa como un filtro que recupera los más relevantes

top_kdocumentos de nuestros documentos indexados en OpenSearch. Usamos nuestra elección de modelo de incrustación para incrustar tanto la consulta como los documentos (en la indexación) para lograr esto. - Los documentos recuperados están incrustados en nuestro indicador del modelo de instrucción Falcon-40b.

- El LLM regresa con una respuesta que se basa en los documentos recuperados.

Para la implementación de modelos, usamos SageMaker JumpStart, que simplifica la implementación de modelos con solo presionar un botón. Aunque hemos usado y probado Falcon-40b-instruct para este ejemplo, puede usar cualquier modelo Hugging Face disponible en SageMaker.

La solución final está disponible en el pajar-salvia y utiliza el sitio web y la documentación de OpenSearch (para OpenSearch 2.7) como nuestros datos de ejemplo para realizar la recuperación de respuestas de preguntas aumentadas.

Requisitos previos

Lo primero que debemos hacer antes de que podamos usar cualquier servicio de AWS es asegurarnos de que nos hayamos registrado y creado una cuenta de AWS. Luego debe crear un usuario y grupo administrativo. Para obtener instrucciones sobre ambos pasos, consulte Configurar los requisitos previos de Amazon SageMaker.

Para poder usar el Haystack, tendrás que instalar el farm-haystack paquete con las dependencias requeridas. Para lograr esto, utilice el requirements.txt presentar en el Repositorio GitHub mediante la ejecución pip install requirements.txt.

Indexar documentos a OpenSearch

Haystack ofrece una serie de conectores a bases de datos, que se denominan DocumentStores. Para este flujo de trabajo RAG, usamos el OpenSearchDocumentStore. El ejemplo repositorio incluye una canalización de indexación y Formación en la nube de AWS plantilla para configurar un OpenSearchDocumentStore con documentos rastreados desde el sitio web de OpenSearch y páginas de documentación.

A menudo, para que una aplicación NLP funcione para casos de uso de producción, terminamos teniendo que pensar en la preparación y limpieza de datos. Esto está cubierto con Tuberías de indexación de Haystack, que le permite diseñar sus propios pasos de preparación de datos, que finalmente escriben sus documentos en la base de datos de su elección.

Una canalización de indexación también puede incluir un paso para crear incrustaciones para sus documentos. Esto es muy importante para el paso de recuperación. En nuestro ejemplo, usamos transformadores de oraciones/all-MiniLM-L12-v2 como nuestro modelo de incrustación. Este modelo se utiliza para crear incrustaciones para todos nuestros documentos indexados, pero también para la consulta del usuario en el momento de la consulta.

Para indexar documentos en el OpenSearchDocumentStore, proporcionamos dos opciones con instrucciones detalladas en el README del repositorio de ejemplo. Aquí, recorremos los pasos para la indexación a un servicio OpenSearch implementado en AWS.

Iniciar un servicio OpenSearch

Use el proporcionado Plantilla de CloudFormation para configurar un servicio OpenSearch en AWS. Al ejecutar el siguiente comando, tendrá un servicio OpenSearch vacío. A continuación, puede optar por indexar los datos de ejemplo que proporcionamos o utilizar sus propios datos, que puede limpiar y preprocesar con el Tubería de indexación de Haystack. Tenga en cuenta que esto crea una instancia que está abierta a Internet, lo que no se recomienda para uso en producción.

Espere aproximadamente 30 minutos para que se complete el lanzamiento de la pila. Puede verificar su progreso en la consola de AWS CloudFormation navegando a la Stacks página y buscando la pila nombrada HaystackOpensearch.

Indexar documentos en OpenSearch

Ahora que tenemos un servicio OpenSearch en ejecución, podemos usar la clase OpenSearchDocumentStore para conectarnos y escribir nuestros documentos en él.

Para obtener el nombre de host de OpenSearch, ejecute el siguiente comando:

Primero, exporta lo siguiente:

Entonces, puede usar el opensearch_indexing_pipeline.py script para preprocesar e indexar los datos de demostración proporcionados.

Si desea utilizar sus propios datos, modifique la canalización de indexación en opensearch_indexing_pipeline.py para incluir el Convertidor de archivos y preprocesador pasos de configuración que necesita.

Implementar la canalización de respuesta de preguntas aumentada de recuperación

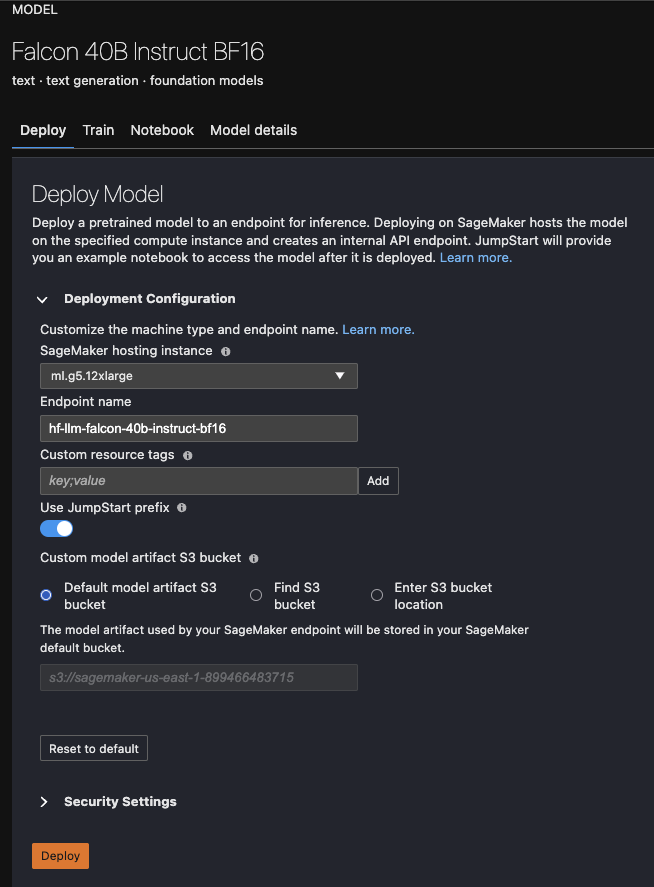

Ahora que hemos indexado los datos en OpenSearch, podemos responder preguntas en estos documentos. Para esta canalización de RAG, usamos el modelo de instrucción Falcon-40b que implementamos en SageMaker JumpStart.

También tiene la opción de implementar el modelo mediante programación desde un cuaderno Jupyter. Para obtener instrucciones, consulte el Repositorio GitHub.

- Busque el modelo de instrucción Falcon-40b en SageMaker JumpStart.

- Implemente su modelo en SageMaker JumpStart y tome nota del nombre del punto final.

- Exporte los siguientes valores:

- Ejecutar

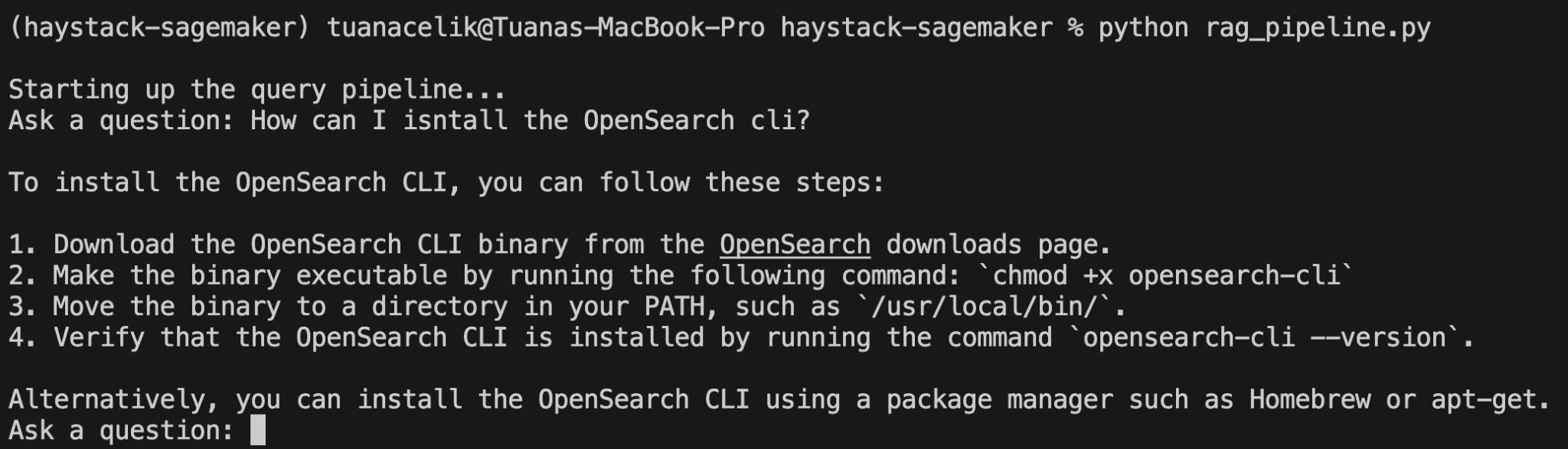

python rag_pipeline.py.

Esto iniciará una utilidad de línea de comandos que espera la pregunta de un usuario. Por ejemplo, preguntemos "¿Cómo puedo instalar la CLI de OpenSearch?"

Este resultado se logra porque hemos definido nuestro aviso en el Plantilla de solicitud de Haystack ser el siguiente:

Otras personalizaciones

Puede realizar personalizaciones adicionales en diferentes elementos de la solución, como las siguientes:

- Los datos – Hemos proporcionado el OpenSearch documentación y página web del NDN Collective datos como datos de ejemplo. Recuerda modificar el

opensearch_indexing_pipeline.pyscript que se adapte a sus necesidades si elige usar sus propios datos. - El modelo – En este ejemplo, hemos utilizado el modelo de instrucción Falcon-40b. Puede implementar y utilizar cualquier otro modelo Hugging Face en SageMaker. Tenga en cuenta que cambiar un modelo probablemente signifique que debe adaptar su indicador a algo para lo que está diseñado.

- el símbolo – Para esta publicación, creamos nuestra propia

PromptTemplateque le indica al modelo que responda preguntas basadas en el contexto provisto y responda "No sé" si el contexto no incluye información relevante. Puede cambiar este mensaje para experimentar con diferentes mensajes con Falcon-40b-instruct. También puede simplemente extraer algunas de nuestras indicaciones de la PromptHub. - El modelo de incrustación – Para el paso de recuperación, utilizamos un modelo de incrustación ligero: transformadores de oraciones/all-MiniLM-L12-v2. Sin embargo, también puede cambiar esto según sus necesidades. Recuerde modificar las dimensiones de incrustación esperadas en su

DocumentStoreen consecuencia. - El número de documentos recuperados. – También puedes optar por jugar con el número de documentos que pides al

EmbeddingRetrievera recuperar para cada consulta. En nuestra configuración, esto está configurado para top_k=5. Puede experimentar cambiando esta cifra para ver si proporcionar más contexto mejora la precisión de sus resultados.

Preparación para la producción

La solución propuesta en esta publicación puede acelerar el tiempo de valorización del proceso de desarrollo del proyecto. Puede crear un proyecto que sea fácil de escalar con el entorno de seguridad y privacidad en la nube de AWS.

Por seguridad y privacidad, OpenSearch Service proporciona protección de datos con Gestión de identidad y acceso. y prevención de proxy confuso entre servicios. Puede emplear un control de acceso de usuario detallado para que el usuario solo pueda acceder a los datos a los que está autorizado a acceder. Además, SageMaker proporciona ajustes de seguridad configurables para control de acceso, protección de datosy registro y monitoreo. Puede proteger sus datos en reposo y en tránsito con Servicio de administración de claves de AWS (AWS KMS) claves. También puede realizar un seguimiento del registro de la implementación del modelo de SageMaker o del acceso al punto final mediante Reloj en la nube de Amazon. Para obtener más información, consulte Monitoree Amazon SageMaker con Amazon CloudWatch.

Para la alta escalabilidad en OpenSearch Service, puede ajustarlo dimensionando sus dominios de OpenSearch Service y empleando mejores prácticas operativas. También puede aprovechar el escalado automático de su terminal de SageMaker: puede escalar automáticamente los modelos de SageMaker para ajustar el punto final tanto cuando aumenta el tráfico como cuando no se utilizan los recursos.

Limpiar

Para ahorrar costos, elimine todos los recursos que implementó como parte de esta publicación. Si lanzó la pila de CloudFormation, puede eliminarla a través de la consola de AWS CloudFormation. Del mismo modo, puede eliminar cualquier extremo de SageMaker que haya creado a través de la consola de SageMaker.

Conclusión

En esta publicación, mostramos cómo crear una aplicación de inteligencia artificial generativa de extremo a extremo para la búsqueda empresarial con RAG mediante el uso de canalizaciones Haystack y el modelo de instrucción Falcon-40b de SageMaker JumpStart y OpenSearch Service. El enfoque RAG es fundamental en la búsqueda empresarial porque garantiza que las respuestas generadas estén en el dominio y, por lo tanto, mitiguen las alucinaciones. Mediante el uso de canalizaciones de Haystack, podemos orquestar aplicaciones LLM compuestas por diferentes componentes, como modelos y bases de datos vectoriales. SageMaker JumpStart nos brinda una solución de un solo clic para implementar LLM, y usamos OpenSearch Service como la base de datos vectorial para nuestros datos indexados. Puede comenzar a experimentar y crear pruebas de concepto de RAG para las aplicaciones de inteligencia artificial generativa de su empresa, siguiendo los pasos descritos en esta publicación y el código fuente disponible en el Repositorio GitHub.

Acerca de los autores

tuana celik es la defensora líder de desarrolladores en deepset, donde se enfoca en la comunidad de código abierto para Haystack. Dirige la función de relaciones con los desarrolladores y habla regularmente en eventos sobre PNL y crea materiales de aprendizaje para la comunidad.

tuana celik es la defensora líder de desarrolladores en deepset, donde se enfoca en la comunidad de código abierto para Haystack. Dirige la función de relaciones con los desarrolladores y habla regularmente en eventos sobre PNL y crea materiales de aprendizaje para la comunidad.

Roy Alela es un arquitecto sénior de soluciones especialista en IA/ML en AWS con sede en Múnich, Alemania. Roy ayuda a los clientes de AWS, desde pequeñas empresas emergentes hasta grandes empresas, a entrenar e implementar modelos de lenguaje grandes de manera eficiente en AWS. A Roy le apasionan los problemas de optimización computacional y la mejora del rendimiento de las cargas de trabajo de IA.

Roy Alela es un arquitecto sénior de soluciones especialista en IA/ML en AWS con sede en Múnich, Alemania. Roy ayuda a los clientes de AWS, desde pequeñas empresas emergentes hasta grandes empresas, a entrenar e implementar modelos de lenguaje grandes de manera eficiente en AWS. A Roy le apasionan los problemas de optimización computacional y la mejora del rendimiento de las cargas de trabajo de IA.

mia chang es un arquitecto de soluciones especializado en ML para Amazon Web Services. Trabaja con clientes en EMEA y comparte las mejores prácticas para ejecutar cargas de trabajo de IA/ML en la nube con su experiencia en matemáticas aplicadas, informática e IA/ML. Se centra en las cargas de trabajo específicas de la PNL y comparte su experiencia como conferencista y autora de libros. En su tiempo libre, disfruta de caminatas, juegos de mesa y preparar café.

mia chang es un arquitecto de soluciones especializado en ML para Amazon Web Services. Trabaja con clientes en EMEA y comparte las mejores prácticas para ejecutar cargas de trabajo de IA/ML en la nube con su experiencia en matemáticas aplicadas, informática e IA/ML. Se centra en las cargas de trabajo específicas de la PNL y comparte su experiencia como conferencista y autora de libros. En su tiempo libre, disfruta de caminatas, juegos de mesa y preparar café.

Inaam Syed es un Arquitecto de Soluciones de Startups en AWS, con un fuerte enfoque en ayudar a las startups B2B y SaaS a escalar y lograr el crecimiento. Posee una profunda pasión por las arquitecturas sin servidor y AI/ML. En su tiempo libre, Inaam disfruta de momentos de calidad con su familia y se entrega a su amor por el ciclismo y el bádminton.

Inaam Syed es un Arquitecto de Soluciones de Startups en AWS, con un fuerte enfoque en ayudar a las startups B2B y SaaS a escalar y lograr el crecimiento. Posee una profunda pasión por las arquitecturas sin servidor y AI/ML. En su tiempo libre, Inaam disfruta de momentos de calidad con su familia y se entrega a su amor por el ciclismo y el bádminton.

david tippet es el Defensor sénior de desarrolladores que trabaja en OpenSearch de código abierto en AWS. Su trabajo involucra todas las áreas de OpenSearch, desde búsqueda y relevancia hasta análisis de seguridad y observabilidad.

david tippet es el Defensor sénior de desarrolladores que trabaja en OpenSearch de código abierto en AWS. Su trabajo involucra todas las áreas de OpenSearch, desde búsqueda y relevancia hasta análisis de seguridad y observabilidad.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Automoción / vehículos eléctricos, Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- ChartPrime. Eleve su juego comercial con ChartPrime. Accede Aquí.

- Desplazamientos de bloque. Modernización de la propiedad de compensaciones ambientales. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/build-production-ready-generative-ai-applications-for-enterprise-search-using-haystack-pipelines-and-amazon-sagemaker-jumpstart-with-llms/

- :posee

- :es

- :no

- :dónde

- $ UP

- 100

- 12

- 13

- 30

- 500

- 7

- 8

- a

- Poder

- Nuestra Empresa

- acelerar

- de la máquina

- lograr

- en consecuencia

- Mi Cuenta

- la exactitud

- Lograr

- alcanzado

- el logro de

- hechos

- adaptar

- Adicionales

- Adicionalmente

- administrativo

- Ventaja

- adviento

- defensor

- AI

- AI / ML

- Todos

- permitir

- permite

- a lo largo de

- también

- Aunque

- Amazon

- Amazon SageMaker

- JumpStart de Amazon SageMaker

- Amazon Web Services

- entre

- an

- Analytics

- y

- https://www.youtube.com/watch?v=xB-eutXNUMXJtA&feature=youtu.be

- cualquier

- APACHE

- Aplicación

- aplicaciones

- aplicada

- enfoque

- aproximadamente

- somos

- áreas

- en torno a

- Formación

- Arte

- AS

- ayudando

- At

- audio

- aumentado

- autor

- autorizado

- auto

- Hoy Disponibles

- AWS

- Formación en la nube de AWS

- B2B

- fondo

- bases

- basado

- BE

- porque

- a las que has recomendado

- antes

- "Ser"

- a continuación

- MEJOR

- y las mejores prácticas

- Big

- Blog

- tablero

- Juegos de Mesa

- cuerpo

- primer libro

- ambas

- general

- build

- Construir la

- construido

- manojos

- pero

- .

- by

- , que son

- PUEDEN

- capacidades

- cases

- el cambio

- cambio

- comprobar

- manera?

- Elige

- la elección de

- eligió

- clase

- Limpieza

- más cerca

- Soluciones

- código

- CAFÉ

- Algunos

- vibrante e inclusiva

- compañía

- Complemento

- completar

- componente

- componentes

- incluido

- computadora

- Ciencias de la Computación

- concepto

- Congreso

- confundido

- Contacto

- en vista de

- Consola

- contenida

- contenido

- contexto

- control

- conversacional

- AI conversacional

- Precio

- cubierto

- Cubiertas

- Para crear

- creado

- crea

- crítico

- Clientes

- datos

- Preparación de datos

- protección de datos

- Base de datos

- bases de datos

- DBS

- acuerdo

- profundo

- deep learning

- se define

- manifestación

- dependencias

- desplegar

- desplegado

- Desplegando

- despliegue

- Diseño

- diseñado

- diseño

- detallado

- desarrollado

- Developer

- desarrolladores

- Desarrollo

- una experiencia diferente

- digital

- digitalización

- dimensiones

- de reservas

- do

- documento

- documentación

- documentos

- sí

- No

- don

- No

- cada una

- de forma sencilla

- eficiencia

- eficiente

- eficiente.

- ya sea

- elementos

- incrustar

- integrado

- incrustación

- EMEA

- habilitar

- final

- de extremo a extremo

- Punto final

- motores

- mejorar

- garantizar

- asegura

- Empresa

- entidades

- entidad

- Entorno

- evaluación

- Eventos

- todo

- ejemplo

- esperado

- experience

- Experiencias

- experimento

- exportar

- externo

- Cara

- familia

- Figura

- Archive

- archivos

- filtrar

- final

- Nombre

- cómodo

- flexible

- flexiblemente

- Focus

- se centra

- siguiendo

- formato

- Fundación

- Marco conceptual

- Gratis

- Desde

- completamente

- función

- Juegos

- generar

- generado

- genera

- generación de AHSS

- generativo

- IA generativa

- Alemania

- obtener

- dado

- Grupo procesos

- Incremento

- encargarse de

- Tienen

- es

- he

- ayuda

- aquí

- esta página

- Alta

- de alto nivel

- altamente

- su

- anfitriones

- Cómo

- Como Hacer

- Sin embargo

- HTML

- http

- HTTPS

- Bujes

- i

- Identidad

- if

- Impacto

- implementar

- importante

- la mejora de

- in

- incluir

- incluye

- Incluye

- aumentado

- cada vez más

- índice

- indexado

- índices

- información

- EN LA MINA

- Las opciones de entrada

- instalar

- ejemplo

- Instrucciones

- Internet

- dentro

- IT

- SUS

- jpg

- Clave

- claves

- Saber

- especialistas

- Gestión del Conocimiento

- idioma

- large

- lanzamiento

- lanzado

- Lead

- Prospectos

- aprendizaje

- Licencia

- Con licencia

- ligero

- como

- que otros

- LIMITE LAS

- limitaciones

- línea

- LLM

- log

- registro

- mirando

- amar

- máquina

- máquina de aprendizaje

- hecho

- para lograr

- HACE

- Realizar

- gestionan

- gestionado

- Management

- materiales

- matemáticas

- máximas

- Puede..

- personalizado

- Medios

- métodos

- Métrica

- millones

- Min

- mitigar

- ML

- modelo

- modelos

- modificar

- Módulos

- Momentos

- monitoreo

- más,

- MEJOR DE TU

- movimiento

- nombre

- Llamado

- Natural

- Procesamiento natural del lenguaje

- navegando

- ¿ Necesita ayuda

- nlp

- cuaderno

- número

- of

- LANZAMIENTO

- Ofertas

- on

- , solamente

- habiertos

- de código abierto

- Software de código abierto

- funcionar

- optimización

- Optión

- Opciones

- or

- organizativo

- Organizado

- reconocida por

- Otro

- "nuestr

- esbozado

- Más de

- EL DESARROLLADOR

- paquete

- página

- paginas

- parte

- socios

- pasión

- apasionado

- Realizar

- actuación

- industrial

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- Jugar

- Por favor

- punto

- Popular

- Publicación

- poderoso

- prácticas

- preparación

- Preparar

- política de privacidad

- problemas

- tratamiento

- Producción

- Progreso

- proyecto

- pruebas

- propuesto

- propietario

- proteger

- Protección

- prototipo

- proporcionar

- previsto

- proporciona un

- proporcionando

- apoderado

- público

- Push

- calidad

- consultas

- pregunta

- Preguntas

- Crudo

- recibido

- reciente

- Recomendación

- recomendado

- regularmente

- relaciones

- la relevancia

- confianza

- recordarlo

- repositorio

- solicita

- exigir

- Requisitos

- Requisitos

- Recursos

- respuesta

- respuestas

- RESTO

- restringir

- resultado

- Resultados

- devoluciones

- Rico

- Derecho

- roy

- Ejecutar

- correr

- SaaS

- sabio

- Guardar

- dices

- Escalabilidad

- escalable

- Escala

- la ampliación

- Ciencia:

- Buscar

- EN LINEA

- ver

- envío

- envía

- mayor

- Sin servidor

- sirve

- de coches

- Servicios

- set

- ajustes

- Configure

- Forma

- Acciones

- ella

- ENVIAR

- tienes

- Mostrar

- mostrar

- exhibido

- firmado

- similares

- Del mismo modo

- sencillos

- simplemente

- chica

- So

- Software

- únicamente

- sólido

- a medida

- Soluciones

- algo

- algo

- Fuente

- código fuente

- Espacio

- Speaker

- Habla

- especialista

- especializado

- Estabilidad

- montón

- Etapa

- comienzo

- inicio

- Startups

- paso

- pasos

- almacenamiento

- fuerte

- estructura

- tal

- suite

- seguro

- ¡Prepárate!

- toma

- técnicas

- plantillas

- probado

- esa

- La

- La Fuente

- Les

- luego

- de este modo

- por lo tanto

- Estas

- ellos

- cosa

- pensar

- así

- miles

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- a

- juntos

- seguir

- tráfico

- tránsito

- digno de confianza

- dos

- tipo

- típicamente

- Finalmente, a veces

- bajo

- subido

- us

- utilizan el

- usado

- Usuario

- usuarios

- usos

- usando

- utilidad

- propuesta de

- Valores

- diversos

- vía

- visión

- murga

- we

- web

- servicios web

- Página web

- cuando

- que

- seguirá

- dentro de

- Palabra

- Actividades:

- flujo de trabajo

- trabajando

- funciona

- se

- escribir

- yaml

- años

- Usted

- tú

- zephyrnet