Desde que ChatGPT explotó en la escena tecnológica en noviembre del año pasado, ha estado ayudando a las personas a escribir todo tipo de material, generar código y encontrar información. Este y otros modelos de lenguaje extenso (LLM, por sus siglas en inglés) han facilitado tareas que van desde atender llamadas de servicio al cliente hasta tomar pedidos de comida rápida. Dado lo útiles que han sido los LLM para los humanos en el poco tiempo que han existido, ¿cómo podría un ChatGPT para robots afectar su capacidad para aprender y hacer cosas nuevas? Los investigadores de Google DeepMind decidieron averiguarlo y publicaron sus hallazgos en un del blog y papel publicado la semana pasada.

Llaman a su sistema RT-2. Es la abreviatura de robotics transformer 2, y es el sucesor de transformador de robótica 1, que la compañía lanzó a fines del año pasado. RT-1 se basó en un pequeño programa de lenguaje y visión y se entrenó específicamente para realizar muchas tareas. El software se usó en Alphabet X's Robots cotidianos, lo que les permite realizar más de 700 tareas diferentes con una tasa de éxito del 97 por ciento. Pero cuando se les pidió que hicieran nuevas tareas para las que no estaban capacitados, los robots que usaban RT-1 solo tuvieron éxito el 32 por ciento de las veces.

RT-2 casi duplica esta tasa, realizando con éxito nuevas tareas el 62 por ciento del tiempo que se le solicita. Los investigadores llaman a RT-2 un modelo de visión-lenguaje-acción (VLA). Utiliza texto e imágenes que ve en línea para aprender nuevas habilidades. Eso no es tan simple como parece; requiere que el software primero "comprenda" un concepto, luego aplique esa comprensión a un comando o conjunto de instrucciones, luego lleve a cabo acciones que satisfagan esas instrucciones.

Un ejemplo que dan los autores del artículo es la eliminación de la basura. En modelos anteriores, el software del robot tendría que ser entrenado primero para identificar la basura. Por ejemplo, si hay un plátano pelado en una mesa con la cáscara al lado, se le mostrará al bot que la cáscara es basura mientras que el plátano no lo es. Luego se le enseñaría cómo recoger la cáscara, moverla a un bote de basura y depositarla allí.

Sin embargo, RT-2 funciona un poco diferente. Dado que el modelo se ha entrenado con una gran cantidad de información y datos de Internet, tiene una comprensión general de lo que es la basura y, aunque no está capacitado para tirar la basura, puede reconstruir los pasos para completar esta tarea.

Los LLM que los investigadores usaron para entrenar RT-2 son PaLI-X (un modelo de visión y lenguaje con 55 mil millones de parámetros), y Palma-E (lo que Google llama un modelo de lenguaje multimodal incorporado, desarrollado específicamente para robots, con 12 mil millones de parámetros). "Parámetro" se refiere a un atributo que define un modelo de aprendizaje automático en función de sus datos de entrenamiento. En el caso de los LLM, modelan las relaciones entre las palabras en una oración y sopesan la probabilidad de que una palabra dada sea precedida o seguida por otra palabra.

Al encontrar las relaciones y los patrones entre las palabras en un conjunto de datos gigante, los modelos aprenden de sus propias inferencias. Eventualmente pueden descubrir cómo los diferentes conceptos se relacionan entre sí y discernir el contexto. En el caso de RT-2, traduce ese conocimiento en instrucciones generalizadas para acciones robóticas.

Esas acciones se representan para el robot como tokens, que generalmente se usan para representar texto en lenguaje natural en forma de fragmentos de palabras. En este caso, los tokens son parte de una acción y el software encadena varios tokens para realizar una acción. Esta estructura también permite que el software realice un razonamiento de cadena de pensamiento, lo que significa que puede responder a preguntas o indicaciones que requieren cierto grado de razonamiento.

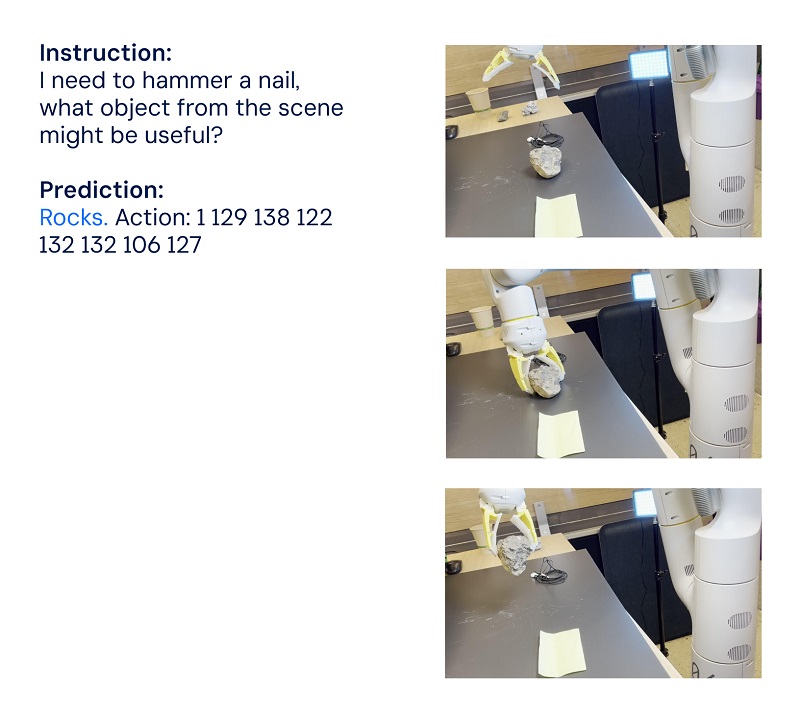

Los ejemplos que da el equipo incluyen elegir un objeto para usar como martillo cuando no hay un martillo disponible (el robot elige una roca) y elegir la mejor bebida para una persona cansada (el robot elige una bebida energética).

"RT-2 muestra capacidades de generalización mejoradas y comprensión semántica y visual más allá de los datos robóticos a los que estuvo expuesto", escribieron los investigadores en Google. del blog. “Esto incluye interpretar nuevos comandos y responder a los comandos del usuario mediante la realización de un razonamiento rudimentario, como el razonamiento sobre categorías de objetos o descripciones de alto nivel”.

El sueño de robots de propósito general que pueda ayudar a los humanos con cualquier cosa que pueda surgir, ya sea en un hogar, un entorno comercial o un entorno industrial, no se podrá lograr hasta que los robots puedan aprender sobre la marcha. Lo que parece ser el instinto más básico para nosotros es, para los robots, una combinación compleja de comprender el contexto, poder razonar a través de él y tomar medidas para resolver problemas que no se esperaba que surgieran. Es imposible programarlos para que reaccionen adecuadamente ante una variedad de escenarios no planificados, por lo que deben poder generalizar y aprender de la experiencia, al igual que los humanos.

RT-2 es un paso en esta dirección. Sin embargo, los investigadores reconocen que, si bien RT-2 puede generalizar conceptos semánticos y visuales, aún no puede aprender nuevas acciones por sí solo. Más bien, aplica las acciones que ya conoce a nuevos escenarios. Quizás RT-3 o 4 podrán llevar estas habilidades al siguiente nivel. Mientras tanto, como concluye el equipo en su del blog, "Si bien todavía queda una gran cantidad de trabajo por hacer para habilitar robots útiles en entornos centrados en el ser humano, RT-2 nos muestra un futuro emocionante para la robótica al alcance de la mano".

Crédito de la imagen: Google DeepMind

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Automoción / vehículos eléctricos, Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- Desplazamientos de bloque. Modernización de la propiedad de compensaciones ambientales. Accede Aquí.

- Fuente: https://singularityhub.com/2023/08/02/deepminds-chatgpt-like-brain-for-robots-lets-them-learn-from-the-internet/

- :posee

- :es

- :no

- $ UP

- 12

- 32

- 700

- a

- capacidad

- Poder

- Nuestra Empresa

- reconocer

- la columna Acción

- acciones

- Todos

- Alphabet

- ya haya utilizado

- también

- cantidad

- an

- y

- Otra

- anticipado

- Aplicá

- adecuadamente

- somos

- en torno a

- AS

- At

- Autorzy

- Hoy Disponibles

- lejos

- Banana

- basado

- básica

- BE

- esto

- "Ser"

- MEJOR

- entre

- Más allá de

- mil millones

- Bot

- Cerebro

- pero

- by

- llamar al

- Calls

- PUEDEN

- capacidades

- llevar

- case

- categoría

- ChatGPT

- la elección de

- código

- combinación

- cómo

- completo

- compañía

- completar

- integraciones

- concepto

- conceptos

- contexto

- crédito

- cliente

- Servicio al Cliente

- datos

- decidido

- Mente profunda

- Define

- Grado

- depositar

- desarrollado

- una experiencia diferente

- dirección

- do

- hecho

- Dobles

- sueño

- Bebidas

- cada una

- habilitar

- permite

- permitiendo

- final

- energía

- ambientes

- finalmente

- ejemplo

- emocionante

- experience

- expuesto

- facilitado

- RÁPIDO

- Figura

- Encuentre

- la búsqueda de

- Los resultados

- Nombre

- seguido

- Comida

- formulario

- Desde

- futuras

- General

- generar

- gigante

- Donar

- dado

- da

- Go

- agarrar

- martillo

- Tienen

- ayuda

- serviciales

- ayudando

- de alto nivel

- Inicio

- Cómo

- Como Hacer

- HTML

- HTTPS

- Humanos

- Identifique

- if

- imágenes

- Impacto

- imposible

- mejorado

- in

- incluir

- incluye

- industrial

- información

- Instrucciones

- Internet

- dentro

- IT

- SUS

- jpg

- solo

- especialistas

- idioma

- large

- Apellidos

- El año pasado

- APRENDE:

- aprendizaje

- Permíteme

- Nivel

- como

- que otros

- pequeño

- cargas

- máquina

- máquina de aprendizaje

- muchos

- materiales

- max-ancho

- Puede..

- sentido

- mientras tanto

- podría

- modelo

- modelos

- MEJOR DE TU

- movimiento

- múltiples

- Natural

- ¿ Necesita ayuda

- Nuevo

- Next

- no

- Noviembre

- objeto

- of

- on

- en línea

- , solamente

- sobre

- or

- en pedidos de venta.

- Otro

- salir

- Más de

- EL DESARROLLADOR

- Papel

- parámetros

- partes

- .

- Personas

- por ciento

- Realizar

- realizar

- quizás

- persona

- recoger

- pieza

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- Deliciosos

- anterior

- problemas

- Programa

- Programación

- publicado

- Preguntas

- Rate

- más bien

- Reaccionar

- razón

- se refiere

- Relaciones

- liberado

- representar

- representado

- exigir

- requiere

- investigadores

- Responder

- responder

- robot

- robótica

- los robots

- Rock

- s

- escenarios

- escena

- parece

- ve

- sentencia

- de coches

- set

- pólipo

- En Corto

- mostrado

- Shows

- sencillos

- desde

- habilidades

- chica

- So

- Software

- RESOLVER

- algo

- específicamente

- paso

- pasos

- Sin embargo

- estructura

- comercial

- exitosos

- Con éxito

- tal

- te

- mesa

- ¡Prepárate!

- toma

- Tarea

- tareas

- enseñó

- equipo

- tecnología

- esa

- La

- su

- Les

- luego

- Ahí.

- Estas

- ellos

- cosas

- así

- aquellos

- ¿aunque?

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- cansado

- a

- juntos

- Tokens

- Entrenar

- entrenado

- Formación

- transformador

- tremendo

- comprensión

- hasta

- us

- utilizan el

- usado

- Usuario

- usos

- usando

- generalmente

- variedad

- visión

- fue

- semana

- pesar

- tuvieron

- ¿

- lo que

- cuando

- que

- mientras

- seguirá

- dentro de

- Palabra

- palabras

- Actividades:

- funciona

- se

- escribir

- escribí

- X's

- año

- aún

- zephyrnet