Tänapäeval ei pea me järgmise läbimurdeni kaua ootama tehisintellekti (AI) avaldab kõigile muljet võimalustega, mis varem kuulusid ainult ulmekirjandusse.

Aastal 2022, AI kunsti loomise tööriistad nagu Open AI DALL-E 2, Google'i Imagen ja Stable Diffusion vallutasid Interneti tormiliselt ning kasutajad genereerisid tekstikirjelduste põhjal kvaliteetseid pilte.

Erinevalt varasematest arendustest leidsid need tekstist pildiks muutmise tööriistad kiiresti tee uurimislaboritest peavoolu kultuur, mis viib viirusnähtusteni, nagu funktsioon „Magic Avatar” Lensa AI rakenduses, mis loob selle kasutajatest stiliseeritud pilte.

Detsembris hämmastas vestlusbot nimega ChatGPT kasutajaid omaga kirjutamisoskused, mis viib ennustusteni, mida tehnoloogia peagi suudab sooritada kutseeksamid. Väidetavalt sai ChatGPT vähem kui nädalaga miljon kasutajat. Mõned kooliametnikud on seda juba teinud keelas selle ära kartusest kasutavad õpilased seda esseede kirjutamiseks. Microsoft on teatatud kavatseb lisada ChatGPT oma Bingi veebiotsingu ja Office'i toodetesse selle aasta lõpus.

Mida tähendab AI järeleandmatu areng lähitulevikus? Ja kas AI võib järgmistel aastatel teatud töökohti ohustada?

Hoolimata nendest muljetavaldavatest hiljutistest tehisintellekti saavutustest, peame tunnistama, et tehisintellektisüsteemidel on endiselt olulisi piiranguid.

AI suurepärased mustrituvastuses

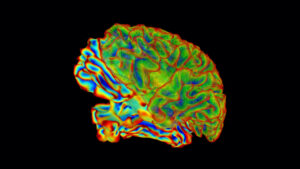

Hiljutised AI edusammud põhinevad peamiselt masinõppe algoritmidel, mis eristavad tohututest andmehulkadest keerulisi mustreid ja seoseid. Seda koolitust kasutatakse seejärel selliste ülesannete jaoks nagu ennustamine ja andmete genereerimine.

Praeguse AI-tehnoloogia arendamine tugineb ennustava võimsuse optimeerimisele, isegi kui eesmärk on luua uus väljund.

Näiteks GPT-3, ChatGPT taga olev keelemudel, õpetati ennustama tekstilõigule järgnevat. Seejärel kasutab GPT-3 seda ennustavat võimet jätkata kasutaja antud sisendteksti.

Generatiivsed AI-d, nagu ChatGPT ja DALL-E 2, on vallandanud palju arutelu selle kohta, kas tehisintellekt võib selles osas olla tõeliselt loov ja isegi inimestega konkureerida. Inimese loovus tugineb aga mitte ainult minevikuandmetele, vaid ka katsetele ja inimkogemuste täielikule valikule.

Põhjus ja tagajärg

Paljud olulised probleemid nõuavad meie tegevuste mõju ennustamist keerulises, ebakindlas ja pidevalt muutuvas keskkonnas. Seda tehes saame valida tegevuste jada, mis kõige tõenäolisemalt meie eesmärke saavutab. Aga algoritmid ei saa õppida põhjuste ja tagajärgede kohta ainult andmete põhjal. Puhtalt andmepõhine masinõpe suudab leida ainult korrelatsioone.

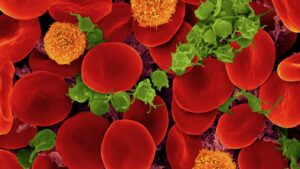

Et mõista, miks see on tehisintellekti jaoks probleem, võime võrrelda haigusseisundi diagnoosimise ja ravi valimise probleeme. Masinõppe mudelid on sageli abiks meditsiiniliste piltide kõrvalekallete leidmisel; see on mustrituvastuse probleem. Me ei pea muretsema põhjusliku seose pärast, sest kõrvalekalded on juba olemas või mitte.

Kuid diagnoosi jaoks parima ravi valimine on põhimõtteliselt erinev probleem. Siin on eesmärk mõjutada tulemust, mitte lihtsalt tuvastada mustrit. Ravi efektiivsuse määramiseks viivad meditsiiniteadlased läbi randomiseeritud kontrollitud uuringuid. Nii saavad nad proovida kontrollida kõiki tegureid, mis võivad ravi mõjutada.

Nende kahte tüüpi probleemide segadus viib mõnikord selleni ebaoptimaalsed rakendused masinõppest organisatsioonides.

Kuigi hiljutise tehisintellekti alase töö edu näitab andmepõhiste mudelite väärtust, nõuavad paljud probleemid, mida arvutid lahendaksid, põhjusliku seose mõistmist.

Praegustel AI-süsteemidel see võimalus puudub, välja arvatud spetsiaalsed rakendused, nagu lauamängud.

Terve mõistuse arutluskäik

Keelemudelid, nagu GPT-3 ja ChatGPT, suudavad edukalt lahendada mõningaid tervet mõistust nõudvaid ülesandeid.

Kuid järgmine suhtlus ChatGPT-ga, mis on kohandatud autori katsest Gary Marcus, viitab sellele, et see pole selles suhtes täiesti usaldusväärne.

Olen kaheksa-aastane. Kui ma sündisin, oli mu bioloogiline ema Barcelonas ja isa Tokyos. Kus ma sündisin? Mõelge see samm-sammult läbi.

Pole mainitud, kus te sündisite. Teame vaid seda, et teie bioloogiline ema oli teie sünni ajal Barcelonas ja isa Tokyos.

Kas tehisintellekti süsteemid, nagu ChatGPT, suudavad saavutada tervet mõistust, on ekspertide seas elava arutelu teema.

Skeptikud, nagu Marcus, juhivad tähelepanu sellele, et me ei saa usaldada keelemudeleid terve mõistuse jõuliseks näitamiseks, kuna neil pole seda sisse ehitatud ega ka otseselt selle jaoks optimeeritud. Optimistid väidavad, et kuigi praegused süsteemid on ebatäiuslikud, võib terve mõistus seda teha tekivad spontaanselt piisavalt arenenud keelemudelites.

Inimlikud väärtused

Kui avaldatakse murrangulised AI-süsteemid, dokumenteerivad uudised ja sotsiaalmeedia postitused rassist, seksistlikja muud tüüpi erapooletu ja kahjulikud käitumised paratamatult järgima.

See viga on omane praegustele AI-süsteemidele, mis peegeldavad kindlasti nende andmeid. Inimlikud väärtused nagu tõde ja õiglus ei ole algoritmidesse põhimõtteliselt sisse ehitatud; see on midagi, mida teadlased veel teha ei tea.

Kuigi teadlased on õppetundide õppimine varasematest episoodidest ja edu erapoolikuse käsitlemisel on AI valdkonnas endiselt a pikk tee minna AI-süsteemide jõuliseks joondamiseks inimeste väärtuste ja eelistustega.![]()

See artikkel avaldatakse uuesti Vestlus Creative Commonsi litsentsi all. Loe algse artikli.

Image Credit: Mahdis Mousavi/Unsplash

- SEO-põhise sisu ja PR-levi. Võimenduge juba täna.

- Platoblockchain. Web3 metaversiooni intelligentsus. Täiustatud teadmised. Juurdepääs siia.

- Allikas: https://singularityhub.com/2023/01/13/ai-might-be-seemingly-everywhere-but-there-are-still-plenty-of-things-it-cant-do-for-now/

- 1

- 10

- 2022

- a

- ABC

- võime

- Võimalik

- MEIST

- üle

- Saavutada

- saavutusi

- meetmete

- adresseerimine

- edasijõudnud

- ettemaksed

- mõjutada

- pärast

- AI

- algoritme

- Materjal: BPA ja flataatide vaba plastik

- üksi

- juba

- vahel

- summad

- ja

- lahus

- app

- rakendused

- vaielda

- Kunst

- artikkel

- kaubad

- kunstlik

- kunstiteoseid

- Barcelona

- sest

- taga

- alla

- BEST

- vahel

- erapoolikus

- Bing

- sündinud

- Seotud

- läbimurre

- ehitatud

- nupp

- kutsutud

- ei saa

- võimeid

- juhul

- põhjuste

- kindel

- muutuv

- chatbot

- ChatGPT

- Vali

- valimine

- kood

- koguma

- COM

- ühine

- Lihtkodanikud

- keeruline

- arvutid

- seisund

- segadus

- pidevalt

- jätkama

- kontrast

- kontrollida

- kontrollitud

- Vestlus

- Võidelda

- loob

- Loominguline

- loovus

- krediit

- Praegune

- dall's

- andmed

- andmepõhistele

- Päeva

- arutelu

- Detsember

- Määrama

- & Tarkvaraarendus

- arenguid

- erinev

- otse

- Ekraan

- teeme

- Ära

- tõhusus

- mõju

- kumbki

- täielikult

- keskkondades

- Isegi

- igaüks

- näide

- kogemus

- eksperiment

- ekspertide

- silmad

- tegurid

- õiglus

- hirm

- tunnusjoon

- Ilukirjandus

- väli

- leidma

- leidmine

- viga

- järgima

- Järel

- järgneb

- avastatud

- Alates

- täis

- põhimõtteliselt

- tulevik

- tekitama

- loodud

- teeniva

- põlvkond

- saama

- gif

- antud

- eesmärk

- Eesmärgid

- murranguline

- kasulik

- siin

- kvaliteetne

- Kuidas

- Kuidas

- aga

- HTML

- HTTPS

- inim-

- Inimkogemus

- Inimestel

- pilt

- pildid

- oluline

- muljetavaldav

- in

- lisada

- paratamatult

- mõju

- info

- omane

- sisend

- suhtlemist

- Internet

- IT

- Tööturg

- Teadma

- Labs

- puudus

- keel

- juhtivate

- Leads

- õppimine

- võimendab

- litsents

- Tõenäoliselt

- piirangud

- piirid

- Pikk

- masin

- masinõpe

- palju

- Marcus

- max laiuse

- Meedia

- meditsiini-

- mainitud

- Microsoft

- võib

- miljon

- mudel

- mudelid

- rohkem

- kõige

- ema

- Lähedal

- Vajadus

- kumbki

- neto

- Uus

- uudised

- järgmine

- Mõiste

- NYU

- Office

- Vana

- ONE

- avatud

- optimeeritud

- optimeerimine

- organisatsioonid

- Muu

- piirjooned

- minevik

- Muster

- mustrid

- täitma

- isiklik

- isiklikud andmed

- tükk

- planeerimine

- Platon

- Platoni andmete intelligentsus

- PlatoData

- palun

- rohke

- Punkt

- hulknurk

- Postitusi

- võim

- ennustada

- prognoosimine

- ennustus

- Ennustused

- valdavalt

- eelistusi

- esitada

- eelmine

- varem

- Probleem

- probleeme

- Toodet

- professionaalne

- Edu

- puhtalt

- kiiresti

- Juhuslikult valitud

- valik

- Lugenud

- hiljuti

- tunnustamine

- tunnistama

- peegeldus

- Suhted

- vabastatud

- usaldusväärne

- kõrvaldama

- esindatud

- nõudma

- teadustöö

- Teadlased

- rivaal

- jooks

- Kool

- teadus

- Ulme

- Otsing

- tunne

- Jada

- mitu

- märkimisväärne

- alates

- olukordades

- sotsiaalmeedia

- Sotsiaalse meedia

- Sotsiaalmeedia postitused

- LAHENDAGE

- mõned

- midagi

- allikas

- spetsialiseeritud

- stabiilne

- Samm

- Veel

- torm

- Õpilased

- teema

- edu

- Edukalt

- selline

- Soovitab

- süsteemid

- TAG

- ülesanded

- Tehnoloogia

- .

- oma

- asjad

- Sel aastal

- ähvardab

- Läbi

- aeg

- et

- Tokyo

- töövahendid

- koolitatud

- koolitus

- ravi

- uuringutes

- Usalda

- liigid

- ebakindel

- mõistma

- mõistmine

- Ootamatu

- kasutama

- Kasutaja

- Kasutajad

- väärtus

- Väärtused

- suur

- Versus

- VOX

- ootama

- web

- nädal

- M

- kas

- mis

- kuigi

- will

- Töö

- oleks

- kirjutama

- aasta

- aastat

- sa

- Sinu

- sephyrnet