Intel väidab, et on välja töötanud tehisintellekti mudeli, mis suudab reaalajas tuvastada, kas video kasutab sügavvõltsitud tehnoloogiat, otsides peeneid värvimuutusi, mis oleksid ilmsed, kui objekt oleks elav inimene.

Kiibivalmistamise hiiglane väidab, et FakeCatcher suudab tulemusi tagastada millisekunditega ja selle täpsus on 96 protsenti.

On olnud mure viimastel aastatel nn sügavvõltsitud videote üle, mis kasutavad AI-algoritme inimestest võltsitud kaadrite loomiseks. Peamine mure on keskendunud sellele, et seda võidakse potentsiaalselt kasutada selleks, et poliitikud või kuulsused näivad olevat avaldanud avaldusi või tegemas asju, mida nad tegelikult ei öelnud ega teinud.

"Deepfake videod on praegu kõikjal. Tõenäoliselt olete neid juba näinud; videod kuulsustest, kes teevad või ütlevad asju, mida nad tegelikult pole teinud,“ ütles Intel Labsi teadur Ilke Demir. Ja see ei puuduta ainult kuulsusi, isegi tavakodanikud on olnud ohvrid.

Kiibitootja sõnul analüüsivad mõned sügaval õppimisel põhinevad detektorid toorvideoandmeid, et püüda leida märguandemärke, mis tuvastaksid selle võltsina. Seevastu FakeCatcher kasutab teistsugust lähenemist, mis hõlmab tõeliste videote analüüsimist visuaalsete vihjete leidmiseks, mis näitavad, et objekt on tõeline.

See hõlmab peeneid värvimuutusi video pikslites, mis on tingitud südame verevoolust, mis pumpab verd ümber keha. Need verevoolu signaalid kogutakse kõikjalt näolt ja algoritmid muudavad need ajaruumilisteks kaartideks, ütles Intel, võimaldades sügaval õppimismudelil tuvastada, kas video on tõeline või mitte. Mõned tuvastamistööriistad nõuavad videosisu analüüsiks üleslaadimist ja seejärel tulemuste ootamist tundide kaupa.

Siiski pole võimalik ette kujutada, et igaüks, kellel on motiivid videovõltsinguid luua, võib piisavalt aega ja ressursse arvestades välja töötada algoritme, mis võivad FakeCatcheri lollitada.

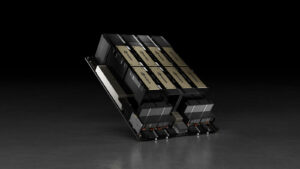

Intel on FakeCatcheri arendamisel loomulikult piisavalt palju kasutanud enda tehnoloogiaid, sealhulgas OpenVINO avatud lähtekoodiga tööriistakomplekti süvaõppe mudelite optimeerimiseks ja OpenCV-d reaalajas piltide ja videote töötlemiseks. Arendajameeskonnad kasutasid ka Open Visual Cloudi platvormi, et pakkuda Inteli Xeon Scalable protsessoritele integreeritud tarkvarapakki. FakeCatcheri tarkvara suudab 72. põlvkonna Xeoni skaleeritavates protsessorites samaaegselt käitada kuni 3 erinevat tuvastusvoogu.

Inteli sõnul on FakeCatcheril mitu potentsiaalset kasutusjuhtumit, sealhulgas kasutajate takistamine kahjulike sügavvõltsitud videote üleslaadimisest sotsiaalmeediasse ja uudisteorganisatsioonide abistamine manipuleeritud sisu levitamise vältimiseks. ®

- AI

- ai kunst

- ai kunsti generaator

- on robot

- tehisintellekti

- tehisintellekti sertifikaat

- tehisintellekt panganduses

- tehisintellekti robot

- tehisintellekti robotid

- tehisintellekti tarkvara

- blockchain

- plokiahela konverents ai

- coingenius

- vestluslik tehisintellekt

- krüptokonverents ai

- dall's

- sügav õpe

- google ai

- masinõpe

- Platon

- plato ai

- Platoni andmete intelligentsus

- Platoni mäng

- PlatoData

- platogaming

- skaala ai

- süntaks

- Register

- sephyrnet