آمازون SageMaker داده رانگلر یک ابزار آماده سازی داده مبتنی بر UI است که به انجام تجزیه و تحلیل داده ها، پیش پردازش و تجسم با ویژگی هایی برای تمیز کردن، تبدیل و آماده سازی سریعتر داده ها کمک می کند. الگوهای جریان از پیش ساخته شده Data Wrangler با کمک به شما در تسریع و درک بهترین الگوهای عملی برای جریان داده ها با استفاده از مجموعه داده های رایج، به آماده سازی داده ها برای دانشمندان داده و متخصصان یادگیری ماشین (ML) سریعتر کمک می کند.

میتوانید از جریانهای Data Wrangler برای انجام وظایف زیر استفاده کنید:

- تجسم داده ها - بررسی ویژگی های آماری برای هر ستون در مجموعه داده، ساخت هیستوگرام، مطالعه نقاط پرت

- تمیز کردن داده ها - حذف موارد تکراری، حذف یا پر کردن ورودی با مقادیر از دست رفته، حذف موارد پرت

- غنی سازی داده ها و مهندسی ویژگی ها – پردازش ستون ها برای ساختن ویژگی های گویاتر، انتخاب زیرمجموعه ای از ویژگی ها برای آموزش

این پست به شما کمک میکند Data Wrangler را با استفاده از نمونه جریانهای از پیش ساخته شده زیر درک کنید GitHub. مخزن تبدیل داده های جدولی، تبدیل داده های سری زمانی و تبدیل داده های پیوست شده را به نمایش می گذارد. هر کدام به دلیل ماهیت اصلی خود به نوع متفاوتی از دگرگونی ها نیاز دارند. داده های استاندارد جدولی یا مقطعی در یک نقطه زمانی خاص جمع آوری می شوند. در مقابل، دادههای سری زمانی به طور مکرر در طول زمان ضبط میشوند و هر نقطه داده متوالی به مقادیر گذشته آن وابسته است.

بیایید به مثالی نگاه کنیم که چگونه می توانیم از جریان داده نمونه برای داده های جدولی استفاده کنیم.

پیش نیازها

Data Wrangler یک آمازون SageMaker ویژگی موجود در داخل Amazon SageMaker Studio، بنابراین باید فرآیند نصب استودیو را دنبال کنیم تا محیط استودیو و نوتبوکها را بچرخانیم. اگرچه میتوانید از میان چند روش احراز هویت انتخاب کنید، سادهترین راه برای ایجاد دامنه استودیو پیروی از آن است شروع سریع دستورالعمل ها. شروع سریع از همان تنظیمات پیش فرض استفاده می کند راه اندازی استاندارد استودیو. شما همچنین می توانید با استفاده از سوار شدن را انتخاب کنید مرکز هویت AWS IAM (جانشین AWS Single Sign-On) برای احراز هویت (نگاه کنید به ورود به دامنه Amazon SageMaker با استفاده از مرکز هویت IAM).

با استفاده از Studio، مجموعه داده و جریان فایل ها را به Data Wrangler وارد کنید

مراحل زیر نحوه وارد کردن داده ها را به SageMaker برای مصرف داده توسط Data Wrangler شرح می دهد:

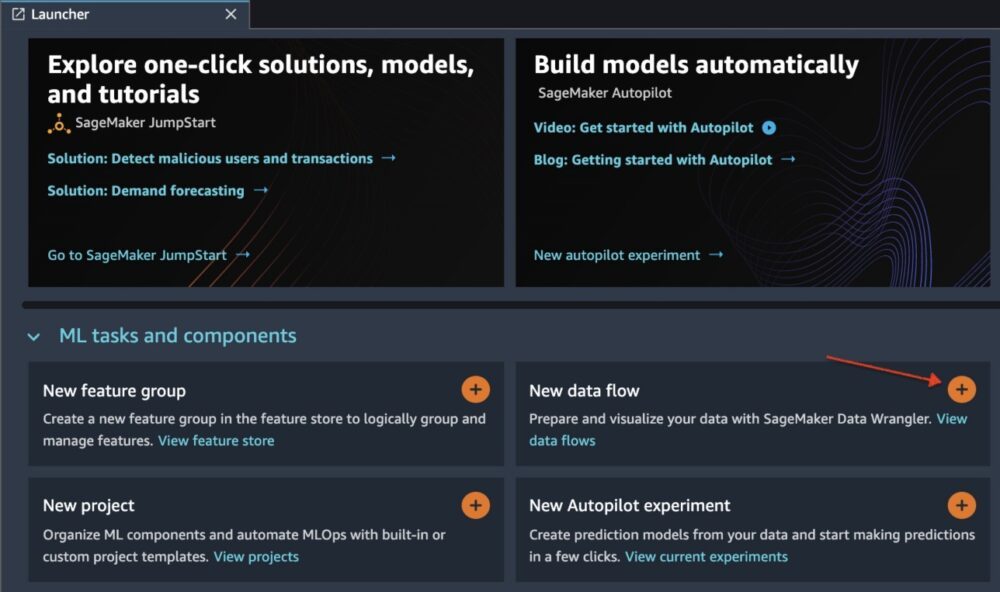

با انتخاب، Data Wrangler را از طریق استودیو UI راه اندازی کنید جریان داده های جدید.

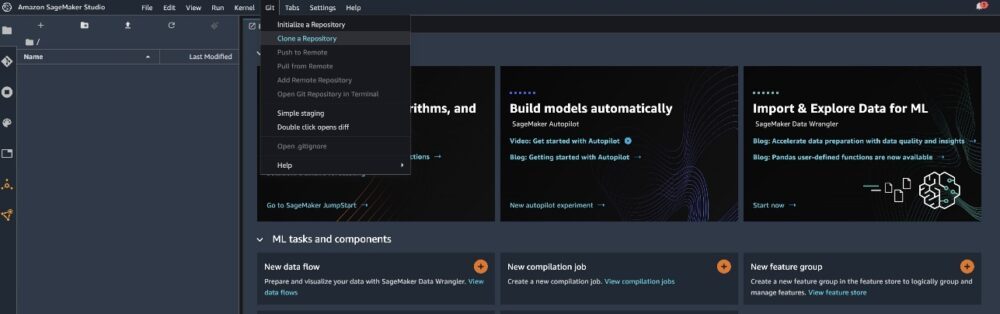

کلون کنید GitHub repo برای دانلود فایل های جریانی در محیط استودیو خود.

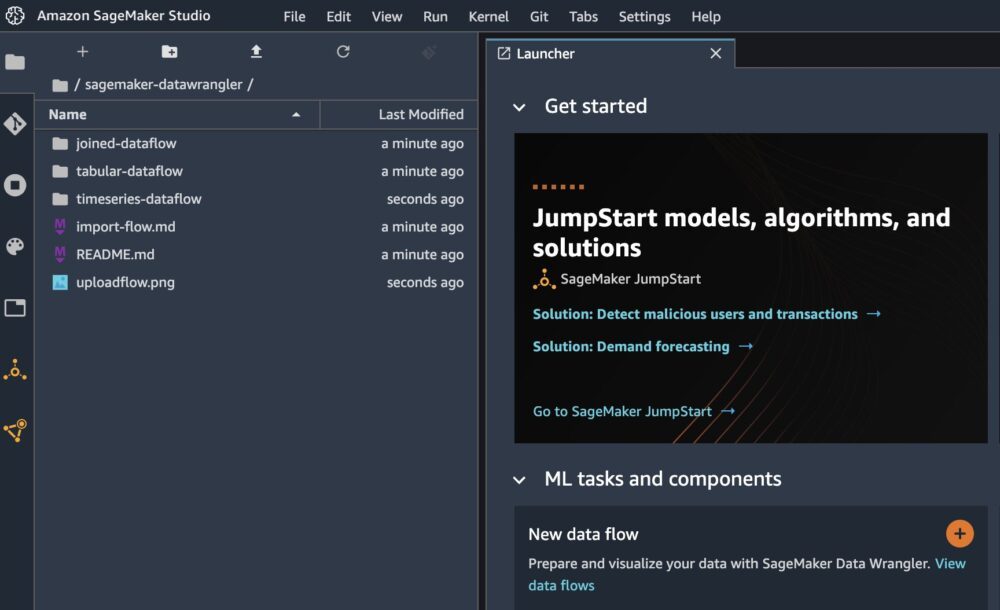

وقتی کلون کامل شد، باید بتوانید محتوای مخزن را در قسمت سمت چپ ببینید.

فایل را انتخاب کنید هتل-رزرو-طبقه بندی.جریان برای وارد کردن فایل جریان به Data Wrangler.

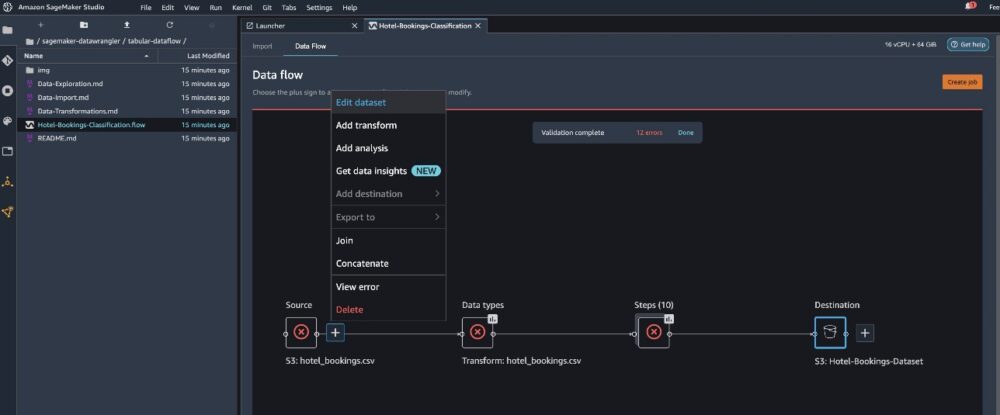

اگر از سری زمانی یا جریان داده متصل استفاده می کنید، جریان با نام دیگری ظاهر می شود. پس از وارد شدن جریان، باید تصویر زیر را مشاهده کنید. این به ما خطاها را نشان می دهد زیرا ما باید مطمئن شویم که فایل جریان به منبع داده صحیح اشاره می کند سرویس ذخیره سازی ساده آمازون (Amazon S3).

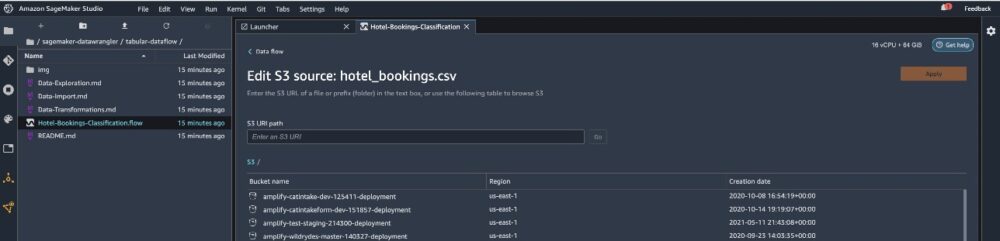

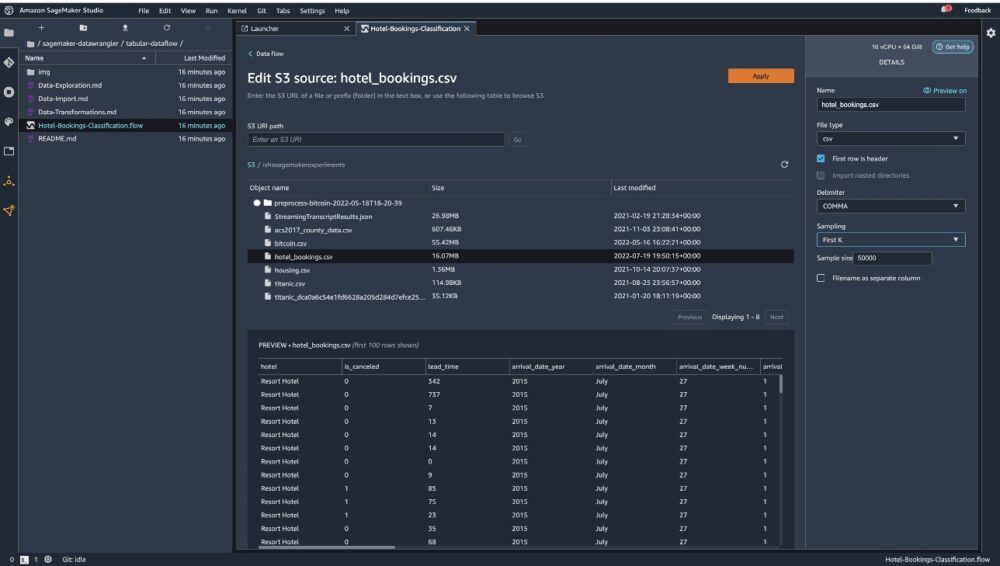

را انتخاب کنید ویرایش مجموعه داده تا تمام سطل های S3 خود را بیاورید. بعد، مجموعه داده را انتخاب کنید hotel_bookings.csv از سطل S3 خود برای اجرا از طریق جریان داده های جدولی.

توجه داشته باشید که اگر از به جریان داده پیوست، ممکن است مجبور شوید چندین مجموعه داده را به Data Wrangler وارد کنید

در قسمت سمت راست، مطمئن شوید پاراگراف به عنوان جداکننده انتخاب می شود و نمونه برداری تنظیم شده است اول ک. مجموعه داده ما به اندازه کافی کوچک است تا تبدیلهای Data Wrangler را روی مجموعه داده کامل اجرا کند، اما میخواهیم نحوه وارد کردن مجموعه داده را برجسته کنیم. اگر مجموعه داده بزرگی دارید، از نمونه برداری استفاده کنید. انتخاب کنید وارد كردن برای وارد کردن این مجموعه داده به Data Wrangler.

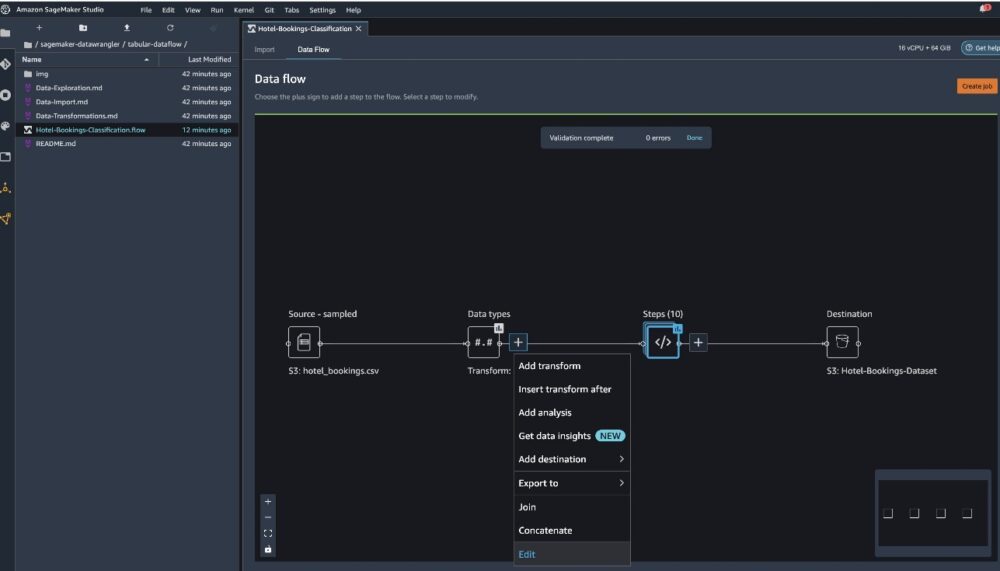

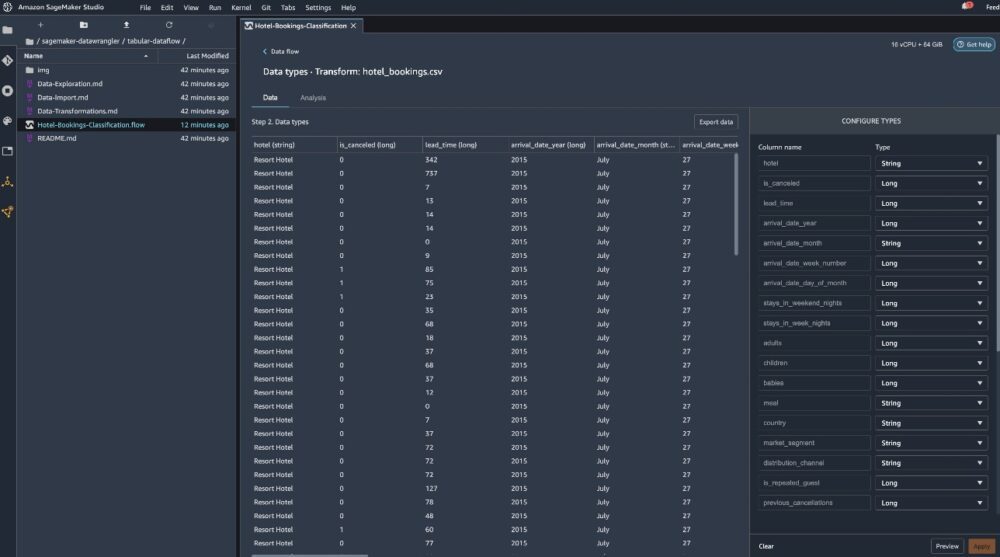

پس از وارد شدن مجموعه داده، Data Wrangler به طور خودکار مجموعه داده را تأیید می کند و انواع داده ها را شناسایی می کند. می بینید که خطاها از بین رفته اند زیرا ما به مجموعه داده صحیح اشاره می کنیم. ویرایشگر جریان اکنون دو بلوک را نشان می دهد که نشان می دهد داده ها از یک منبع وارد شده اند و انواع داده ها شناسایی شده اند. همچنین در صورت نیاز می توانید انواع داده ها را ویرایش کنید.

تصویر زیر انواع داده های ما را نشان می دهد.

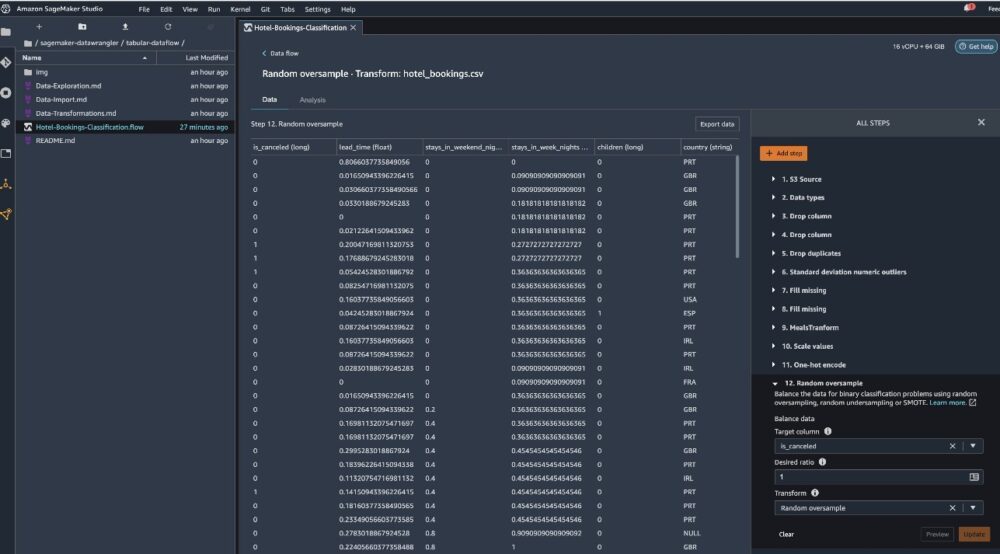

بیایید به برخی از تبدیل های انجام شده به عنوان بخشی از این جریان جدولی نگاه کنیم. اگر از سری زمانی or پیوست جریان داده ها، برخی از تبدیل های رایج را بررسی کنید GitHub repo. ما برخی از تجزیه و تحلیل دادههای اکتشافی اولیه را با استفاده از گزارشهای بینش داده انجام دادیم که نشت هدف و همخطی بودن ویژگیها در مجموعه داده، تجزیه و تحلیل خلاصه جدول و قابلیت مدلسازی سریع را مورد مطالعه قرار داد. مراحل روی را کاوش کنید GitHub repo.

اکنون بر اساس توصیههای ارائه شده توسط دادههای بینش و گزارش کیفیت، ستونها را رها میکنیم.

- برای نشت هدف، رها کنید وضعیت_رزرو.

- برای ستونهای اضافی، رها کنید لیست_انتظار_روزهای_در_انتظار، هتل، نوع_اتاق رزرو شده، تاریخ_ماه_ورود، تاریخ_وضعیت_رزرو، نوزادان، و ورود_تاریخ_روز_ماه.

- بر اساس نتایج همبستگی خطی، ستون ها را رها کنید ورود_تاریخ_هفته_شماره و ورود_تاریخ_سال زیرا مقادیر همبستگی برای این جفتهای ویژگی (ستون) بیشتر از آستانه توصیه شده 0.90 است.

- بر اساس نتایج همبستگی غیر خطی، افت وضعیت_رزرو. این ستون قبلاً بر اساس تجزیه و تحلیل نشت هدف حذف شده بود.

- پردازش مقادیر عددی (حداکثر مقیاس بندی) برای lead_time، اقامت_در_شب_آخر_هفته، اقامت_در_روز_هفته_شب، مهمان_تکرارشده، لغو_قبلی_رزروهای_قبل_لغو_نشده_رزرو_تغییرها، adr، مجموع_درخواست_های_خاص، و مکانهای_پارکینگ_مورد نیاز.

- متغیرهای طبقه بندی شده را رمزگذاری یک داغ مانند وعده غذایی، مهمان_تکرار شده، بخش_بازار، نوع_اتاق_تخصیص، نوع_سپرده، و مشتری_نوع.

- متغییر هدف را متعادل کنید. نمونههای اضافی تصادفی برای عدم تعادل کلاس. از قابلیت مدلسازی سریع برای رسیدگی به مقادیر پرت و از دست رفته استفاده کنید.

صادرات به آمازون S3

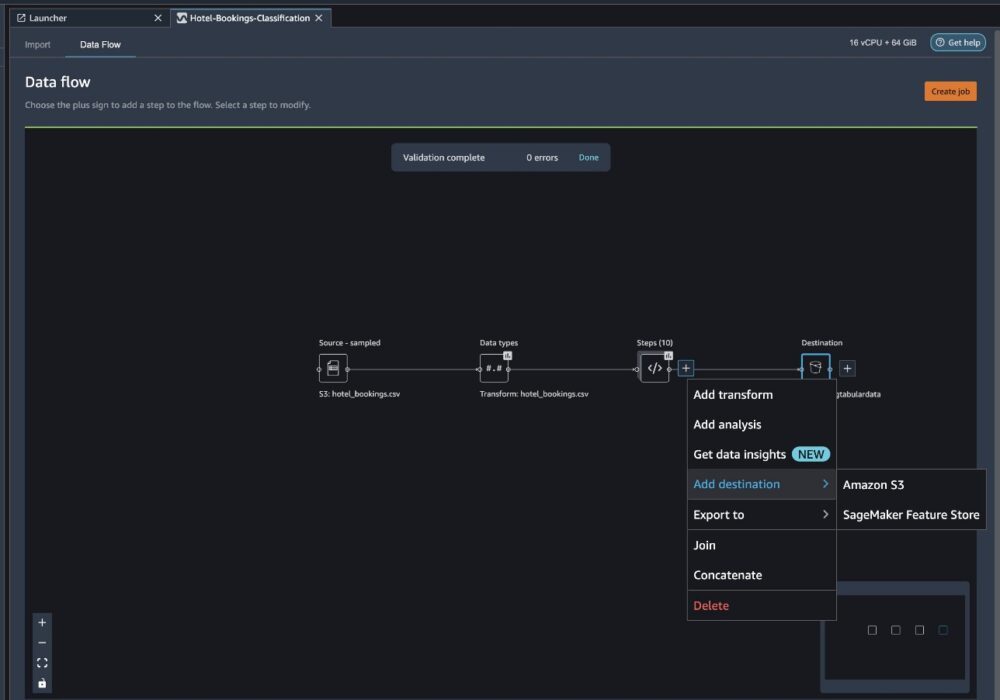

اکنون ما تغییرات مختلف را پشت سر گذاشته ایم و آماده هستیم تا داده ها را به آمازون S3 صادر کنیم. این گزینه یک کار پردازشی SageMaker ایجاد می کند که جریان پردازش Data Wrangler را اجرا می کند و مجموعه داده حاصل را در یک سطل S3 مشخص ذخیره می کند. مراحل بعدی را برای تنظیم صادرات به آمازون S3 دنبال کنید:

علامت مثبت در کنار مجموعه ای از عناصر تبدیل را انتخاب کرده و انتخاب کنید مقصد را اضافه کنید، و سپس آمازون S3.

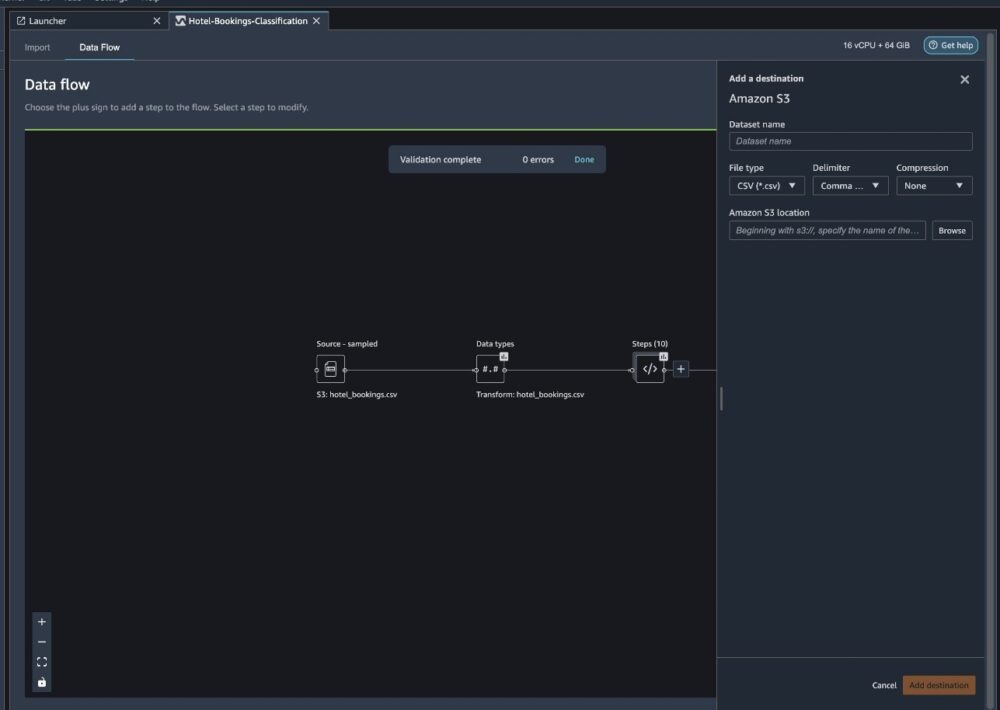

- برای نام مجموعه داده، برای مثال یک نام برای مجموعه داده جدید وارد کنید

NYC_export. - برای نوع فایل، انتخاب کنید CSV.

- برای محدود کننده، انتخاب کنید کاما.

- برای فشرده سازی، انتخاب کنید هیچ.

- برای مکان آمازون S3، از همان نام سطلی استفاده کنید که قبلا ایجاد کردیم.

- را انتخاب کنید مقصد را اضافه کنید.

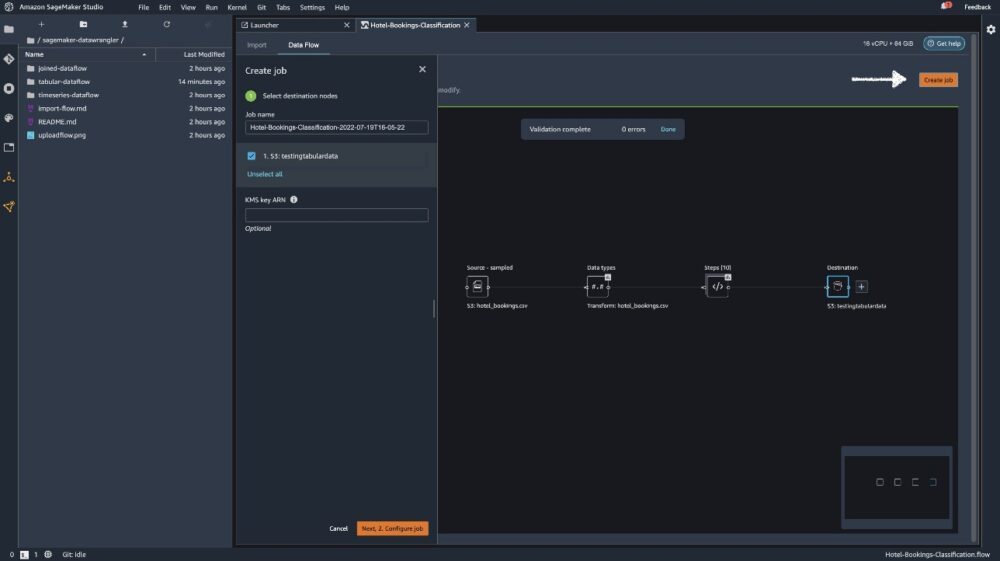

را انتخاب کنید ایجاد شغل.

برای اسم شغل، یک نام وارد کنید یا گزینه autogenerated را نگه دارید و انتخاب کنید مقصد. ما فقط یک مقصد داریم، S3:testingtabulardata، اما ممکن است چندین مقصد از مراحل مختلف در گردش کار خود داشته باشید. ترک کلید KMS ARN فیلد را خالی کرده و انتخاب کنید بعدی.

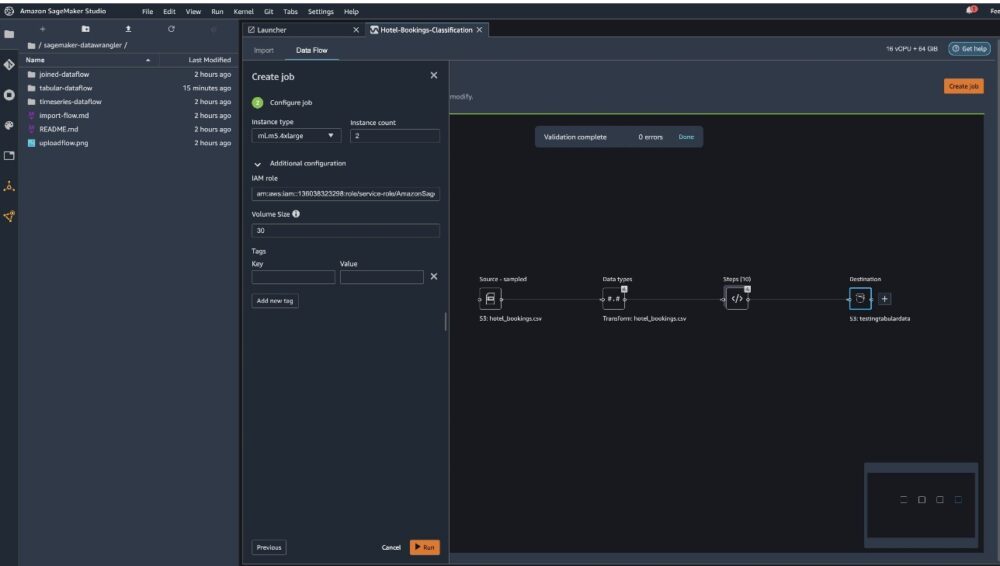

اکنون باید ظرفیت محاسباتی یک کار را پیکربندی کنید. شما می توانید تمام مقادیر پیش فرض را برای این مثال نگه دارید.

- برای نوع نمونه، از ml.m5.4xlarge استفاده کنید.

- برای تعداد نمونه، استفاده از 2.

- می توانید کاوش کنید پیکربندی اضافی، اما تنظیمات پیش فرض را حفظ کنید.

- را انتخاب کنید دویدن.

اکنون کار شما شروع شده است و پردازش 6 گیگابایت داده طبق جریان پردازش Data Wrangler کمی طول می کشد. هزینه این کار حدود 2 دلار آمریکا خواهد بود، زیرا ml.m5.4xlarge 0.922 دلار در ساعت هزینه دارد و ما از دو مورد از آنها استفاده می کنیم.

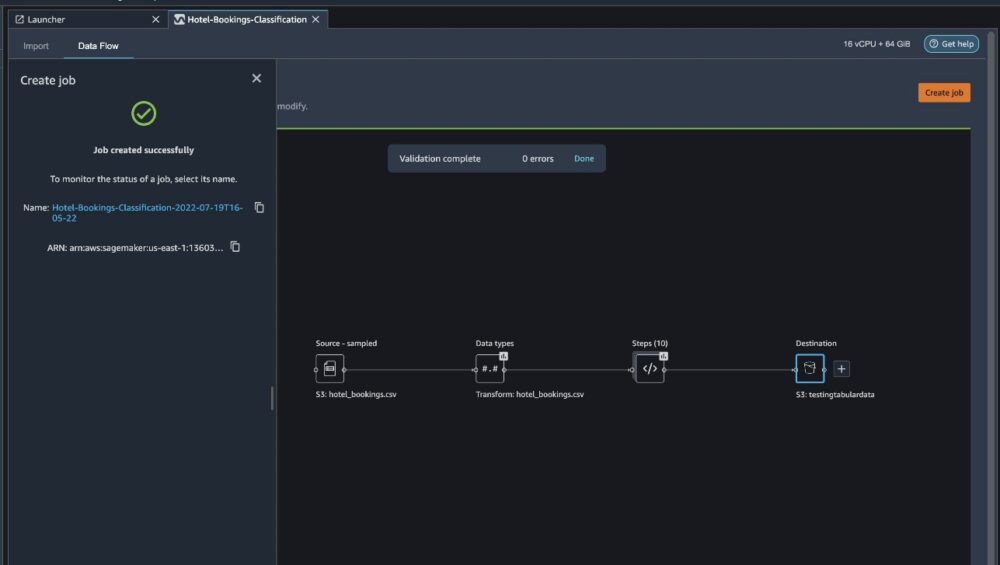

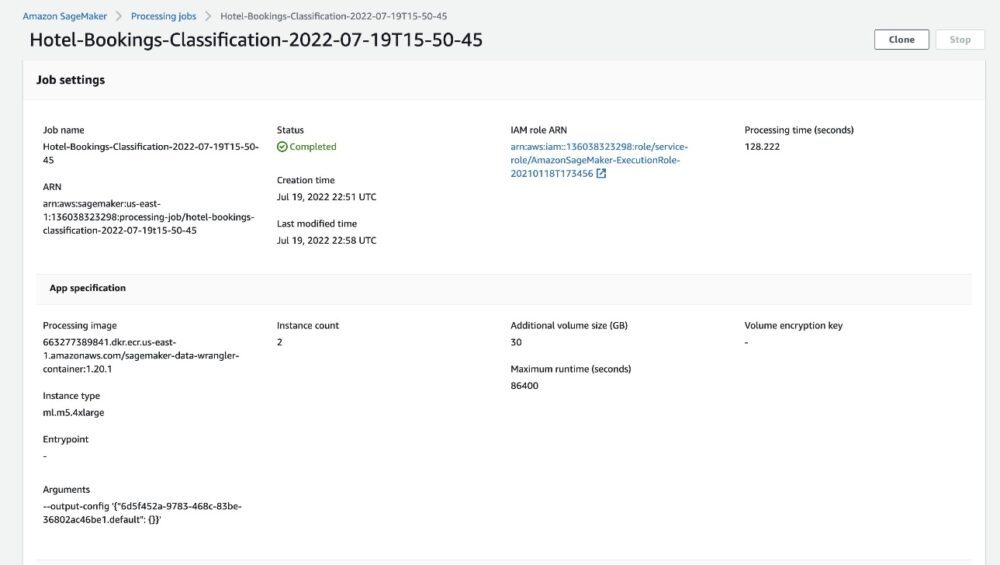

اگر نام شغل را انتخاب کنید، به پنجره جدیدی با جزئیات شغل هدایت می شوید.

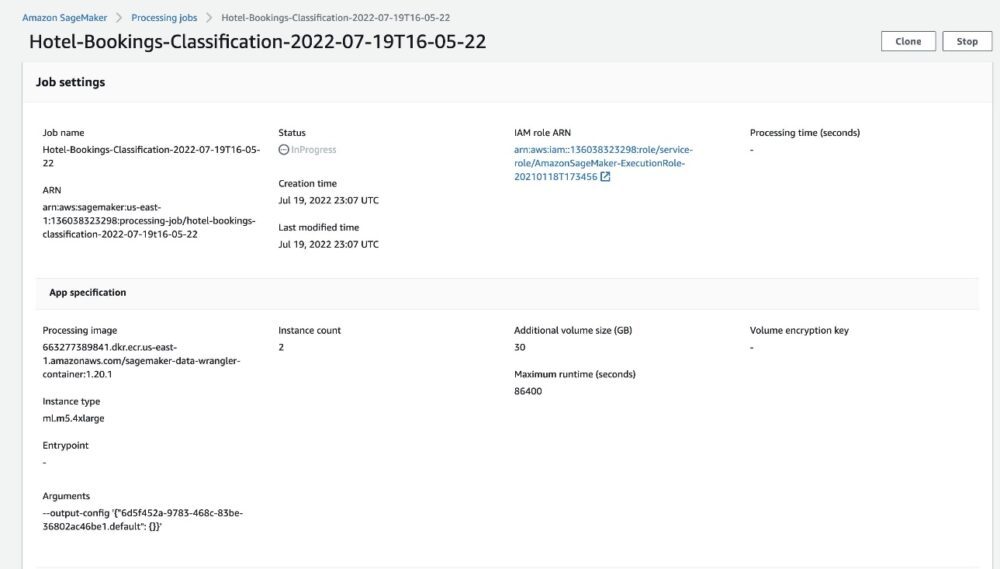

در صفحه جزئیات کار می توانید تمام پارامترهای مراحل قبل را مشاهده کنید.

هنگامی که وضعیت کار به تکمیل شده تغییر می کند، می توانید آن را نیز بررسی کنید زمان پردازش (ثانیه) ارزش. این کار پردازش حدود 5 تا 10 دقیقه طول می کشد تا کامل شود.

وقتی کار کامل شد، فایلهای خروجی قطار و آزمایش در پوشههای خروجی S3 مربوطه در دسترس هستند. می توانید مکان خروجی را از تنظیمات کار پردازش پیدا کنید.

پس از اتمام کار پردازش Data Wrangler، می توانیم نتایج ذخیره شده در سطل S3 خود را بررسی کنیم. فراموش نکنید که به روز رسانی job_name متغیر با نام شغل شما

اکنون می توانید از این داده های صادر شده برای اجرای مدل های ML استفاده کنید.

پاک کردن

سطل های S3 خود را حذف کنید و خود را جریان مخاصمه داده به منظور حذف منابع اساسی و جلوگیری از هزینه های ناخواسته پس از اتمام آزمایش.

نتیجه

در این پست، ما نشان دادیم که چگونه میتوانید جریان دادههای از پیش ساخته شده جدولی را به Data Wrangler وارد کنید، آن را به مجموعه دادههای ما متصل کنید و نتایج را به Amazon S3 صادر کنید. اگر موارد استفاده شما از شما نیاز دارد که دادههای سری زمانی را دستکاری کنید یا به مجموعه دادههای متعدد بپیوندید، میتوانید از طریق سایر جریانهای نمونه از پیش ساخته شده در GitHub repo.

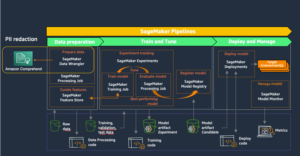

پس از وارد کردن یک گردش کار آماده سازی داده از پیش ساخته شده، می توانید آن را با Amazon SageMaker Processing ادغام کنید. خطوط لوله آمازون SageMakerو فروشگاه ویژگی آمازون SageMaker برای ساده کردن کار پردازش، اشتراک گذاری و ذخیره داده های آموزشی ML. شما همچنین می توانید این نمونه جریان داده را به یک اسکریپت پایتون صادر کنید و یک خط لوله آماده سازی داده ML سفارشی ایجاد کنید، در نتیجه سرعت انتشار خود را تسریع کنید.

ما شما را تشویق می کنیم که ما را بررسی کنید مخزن GitHub برای تمرین عملی و یافتن راه های جدید برای بهبود دقت مدل! برای کسب اطلاعات بیشتر در مورد SageMaker، به سایت مراجعه کنید راهنمای توسعه دهنده Amazon SageMaker.

درباره نویسنده

عشا دعا یک معمار ارشد راه حل مستقر در منطقه خلیج سانفرانسیسکو است. او به مشتریان AWS Enterprise با درک اهداف و چالشهایشان کمک میکند رشد کنند و آنها را راهنمایی میکند که چگونه میتوانند برنامههای خود را به روشی ابری معماری کنند و در عین حال از انعطافپذیری و مقیاسپذیری آنها اطمینان حاصل کنند. او مشتاق فن آوری های یادگیری ماشین و پایداری محیطی است.

عشا دعا یک معمار ارشد راه حل مستقر در منطقه خلیج سانفرانسیسکو است. او به مشتریان AWS Enterprise با درک اهداف و چالشهایشان کمک میکند رشد کنند و آنها را راهنمایی میکند که چگونه میتوانند برنامههای خود را به روشی ابری معماری کنند و در عین حال از انعطافپذیری و مقیاسپذیری آنها اطمینان حاصل کنند. او مشتاق فن آوری های یادگیری ماشین و پایداری محیطی است.

- AI

- آی هنر

- مولد هنر ai

- ربات ai

- آمازون SageMaker

- Amazon SageMaker Data Rangler

- هوش مصنوعی

- گواهی هوش مصنوعی

- هوش مصنوعی در بانکداری

- ربات هوش مصنوعی

- ربات های هوش مصنوعی

- نرم افزار هوش مصنوعی

- آموزش ماشین AWS

- بلاکچین

- کنفرانس بلاک چین ai

- coingenius

- هوش مصنوعی محاوره ای

- کنفرانس کریپتو ai

- دل-ه

- یادگیری عمیق

- گوگل ai

- فراگیری ماشین

- افلاطون

- افلاطون آی

- هوش داده افلاطون

- بازی افلاطون

- PlatoData

- بازی پلاتو

- مقیاس Ai

- نحو

- زفیرنت