ما در یک نقطه عطف هیجان انگیز در پذیرش گسترده یادگیری ماشین (ML) هستیم و معتقدیم که اکثر تجربیات و برنامه های کاربردی مشتری با هوش مصنوعی مولد دوباره اختراع خواهند شد. هوش مصنوعی مولد می تواند محتوا و ایده های جدیدی از جمله مکالمات، داستان ها، تصاویر، ویدیوها و موسیقی ایجاد کند. مانند بیشتر هوش مصنوعی، هوش مصنوعی مولد از مدلهای ML پشتیبانی میکند - مدلهای بسیار بزرگی که بر روی مقادیر زیادی داده آموزش داده میشوند و معمولاً به عنوان مدلهای پایه (FM) شناخته میشوند. FM ها بر اساس ترانسفورماتورها ساخته شده اند. ترانسفورماتورها در تولید توالی متن طولانی به دلیل اندازه بسیار زیاد مدل ها، کند و تشنه حافظه هستند. مدلهای زبان بزرگ (LLM) که برای تولید دنبالههای متنی استفاده میشوند، به قدرت محاسباتی زیادی نیاز دارند و در دسترسی به حافظه پهنای باند بالا (HBM) و ظرفیت محاسباتی مشکل دارند. این به این دلیل است که بخش بزرگی از پهنای باند حافظه موجود با بارگذاری پارامترهای مدل و توسط فرآیند رمزگشایی با رگرسیون خودکاردر نتیجه، حتی با وجود مقادیر انبوه توان محاسباتی، LLMها توسط ورودی/خروجی حافظه و محدودیتهای محاسباتی محدود میشوند و از استفاده کامل از منابع سختافزاری موجود جلوگیری میکنند.

به طور کلی، استنباط مولد LLM ها دارای سه چالش اصلی است (بر اساس پاپ و همکاران 2022):

- ردپای حافظه بزرگ به دلیل پارامترهای مدل عظیم و حالت گذرا در طول رمزگشایی. پارامترها اغلب از حافظه یک تراشه شتاب دهنده فراتر می روند. حافظه پنهان کلید-مقدار توجه نیز به حافظه قابل توجهی نیاز دارد.

- موازی پذیری کم تاخیر را افزایش می دهد، به خصوص با ردپای حافظه بزرگ، که نیاز به انتقال داده های قابل توجهی برای بارگذاری پارامترها و حافظه پنهان در هسته های محاسباتی در هر مرحله دارد. این منجر به نیازهای کل پهنای باند حافظه برای برآوردن اهداف تاخیر می شود.

- مقیاس درجه دوم محاسبه مکانیسم توجه نسبت به طول دنباله، تاخیر و چالش های محاسباتی را ترکیب می کند.

بچینگ یکی از تکنیک های مقابله با این چالش هاست. دسته بندی به فرآیند ارسال چندین توالی ورودی با هم به یک LLM و در نتیجه بهینه سازی عملکرد استنتاج LLM اشاره دارد. این رویکرد به بهبود توان عملیاتی کمک می کند زیرا پارامترهای مدل نیازی به بارگذاری برای هر دنباله ورودی ندارند. پارامترها را می توان یک بار بارگذاری کرد و برای پردازش چندین توالی ورودی استفاده کرد. بچینگ به طور کارآمد از پهنای باند HBM شتاب دهنده استفاده می کند که منجر به استفاده محاسباتی بالاتر، توان عملیاتی بهبود یافته و استنتاج مقرون به صرفه می شود.

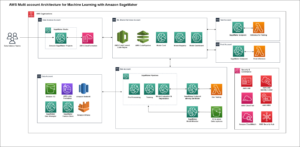

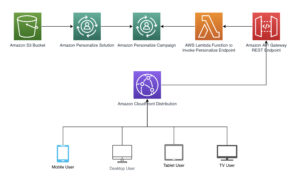

این پست به بررسی تکنیکهایی برای به حداکثر رساندن توان با استفاده از تکنیکهای دستهبندی برای استنتاج مولد موازی در LLM میپردازد. ما در مورد روشهای دستهبندی مختلف برای کاهش ردپای حافظه، افزایش موازیپذیری، و کاهش مقیاس درجه دوم توجه برای افزایش توان عملیاتی بحث میکنیم. هدف استفاده کامل از سخت افزارهایی مانند HBM و شتاب دهنده ها برای غلبه بر تنگناها در حافظه، I/O و محاسبات است. سپس چگونگی را برجسته می کنیم آمازون SageMaker استنتاج مدل بزرگ (LMI) ظروف یادگیری عمیق (DLC) می تواند به این تکنیک ها کمک کند. در نهایت، ما یک تحلیل مقایسه ای از بهبود توان عملیاتی با هر استراتژی دسته بندی در SageMaker را ارائه می کنیم DLC های LMI برای بهبود توان عملیاتی برای مدل هایی مانند لاما نسخه 2. شما می توانید یک دفترچه یادداشت همراه را در قسمت پیدا کنید SageMaker مخزن GitHub را مثال میزند.

استنتاج برای مدل های زبان بزرگ (LLM)

رمزگشایی خود رگرسیون فرآیندی است که در آن مدلهای زبانی مانند GPT خروجی متن را یک توکن تولید میکنند. این شامل تغذیه بازگشتی توکن های تولید شده به مدل به عنوان بخشی از توالی ورودی به منظور پیش بینی توکن های بعدی است. مراحل به شرح زیر است:

- مدل توکن های قبلی را به ترتیب به عنوان ورودی دریافت می کند. برای مرحله اول، این اعلان شروع ارائه شده توسط کاربر است.

- مدل توزیعی را بر روی واژگان برای نشانه بعدی پیش بینی می کند.

- توکن با بالاترین احتمال پیش بینی شده انتخاب شده و به دنباله خروجی الحاق می شود. مراحل 2 و 3 بخشی از رمزگشایی تا زمان نگارش این مقاله، برجستهترین روشهای رمزگشایی عبارتند از جستجوی حریصانه، جستجوی پرتو، جستجوی متضاد و نمونهبرداری.

- این نشانه جدید برای مرحله رمزگشایی بعدی به دنباله ورودی اضافه می شود.

- مدل از طریق این مراحل تکرار میشود و در هر مرحله یک نشانه جدید تولید میکند تا زمانی که نشانگر انتهای دنباله تولید شود یا به طول خروجی مورد نظر برسد.

ارائه مدل برای LLMها

ارائه مدل برای LLMها به فرآیند دریافت درخواستهای ورودی برای تولید متن، استنتاج و برگرداندن نتایج به برنامههای درخواستکننده اشاره دارد. موارد زیر مفاهیم کلیدی درگیر در ارائه مدل هستند:

- کلاینت ها چندین درخواست استنتاج ایجاد می کنند که هر درخواست متشکل از دنباله ای از نشانه ها یا اعلان های ورودی است.

- درخواست ها توسط سرور استنتاج دریافت می شوند (به عنوان مثال، سرویس DJLS, TorchServe, تریتون، یا بغل کردن صورت TGI)

- سرور استنتاج درخواستهای استنتاج را دستهبندی میکند و دسته را به موتور اجرایی که شامل کتابخانههای پارتیشنبندی مدل (مانند Transformers-NeuronX, در اعماق, شتاب دادن، یا سریع ترانسفورماتور) برای اجرای گذر رو به جلو (پیش بینی توالی نشانه خروجی) در مدل زبان مولد

- موتور اجرا توکن های پاسخ را تولید می کند و پاسخ را به سرور استنتاج ارسال می کند

- سرور استنتاج با نتایج تولید شده به مشتریان پاسخ می دهد

زمانی که سرور استنتاج با موتور اجرا در سطح درخواست تعامل دارد، چالشهایی با زمانبندی سطح درخواست وجود دارد، مانند هر درخواست با استفاده از فرآیند پایتون، که نیاز به یک کپی جداگانه از مدل دارد، که حافظه را محدود میکند. به عنوان مثال، همانطور که در شکل زیر نشان داده شده است، فقط می توانید یک نسخه از یک مدل با اندازه 80 گیگابایت را روی یک نمونه یادگیری ماشین (ML) با 96 گیگابایت حافظه کل دستگاه شتاب دهنده بارگذاری کنید. اگر میخواهید درخواستهای اضافی را همزمان ارائه دهید، باید یک نسخه اضافی از کل مدل را بارگیری کنید. این حافظه و مقرون به صرفه نیست.

اکنون که چالشهای ناشی از زمانبندی در سطح درخواست را درک میکنیم، بیایید به تکنیکهای دستهبندی مختلف که میتوانند به بهینهسازی توان عملیاتی کمک کنند نگاهی بیندازیم.

تکنیک های بچینگ

در این بخش، تکنیکهای مختلف بچینگ را توضیح میدهیم و نحوه پیادهسازی آنها را با استفاده از SageMaker نشان میدهیم ظرف LMI.

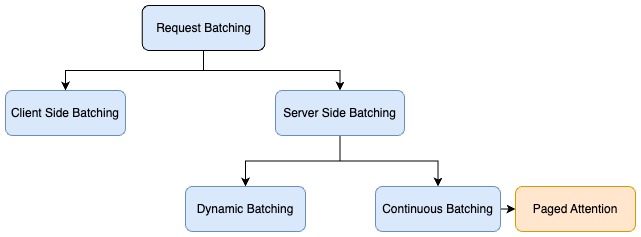

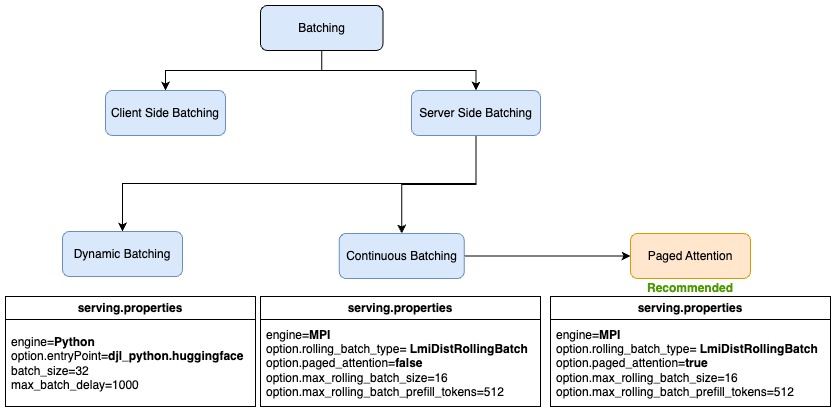

دو نوع اصلی دسته بندی برای درخواست های استنتاج وجود دارد:

- سمت مشتری (استاتیک) – به طور معمول، زمانی که یک کلاینت درخواستی را به یک سرور ارسال می کند، سرور به طور پیش فرض هر درخواست را به صورت متوالی پردازش می کند، که برای توان عملیاتی مطلوب نیست. برای بهینهسازی توان عملیاتی، مشتری درخواستهای استنتاج را در یک بار واحد دستهبندی میکند و سرور منطق پیشپردازش را پیادهسازی میکند تا دسته را به چندین درخواست تقسیم کند و استنتاج را برای هر درخواست جداگانه اجرا کند. در این گزینه، مشتری باید کد بچینگ را تغییر دهد و راه حل به شدت با اندازه دسته ای همراه است.

- سمت سرور (پویا) - یکی دیگر از تکنیک های دسته بندی استفاده از استنتاج برای کمک به دستیابی به دسته بندی در سمت سرور است. همانطور که درخواست های استنتاج مستقل به سرور می رسد، سرور استنتاج می تواند آنها را به صورت پویا در دسته های بزرگتر در سمت سرور گروه بندی کند. سرور استنتاج می تواند دسته بندی را برای رسیدن به یک هدف تأخیر مشخص مدیریت کند، و در عین حال در محدوده تأخیر مورد نظر، توان عملیاتی را به حداکثر برساند. سرور استنتاج به طور خودکار این کار را انجام می دهد، بنابراین نیازی به تغییر کد سمت مشتری نیست. دستهبندی سمت سرور شامل تکنیکهای مختلفی برای بهینهسازی عملکرد بیشتر برای مدلهای زبان مولد مبتنی بر رمزگشایی رگرسیون خودکار است. این تکنیک های دسته بندی شامل دسته بندی پویا، دسته بندی پیوسته و دسته بندی PagedAttention (vLLM) است.

دسته بندی پویا

دسته بندی پویا به ترکیب درخواست های ورودی و ارسال آنها با هم به عنوان یک دسته برای استنتاج اشاره دارد. دسته بندی پویا یک تکنیک دسته بندی سمت سرور عمومی است که برای همه وظایف از جمله بینایی کامپیوتر (CV)، پردازش زبان طبیعی (NLP) و غیره کار می کند.

در یک ظرف LMI، میتوانید دستهبندی درخواستها را بر اساس تنظیمات زیر پیکربندی کنید خدمت.خواص:

- دسته_اندازه - به اندازه دسته اشاره دارد

- حداکثر_تاخیر دسته ای - به حداکثر تاخیر برای تجمع دسته ای اشاره دارد

اگر هر یک از این آستانه ها برآورده شود (برآوردن حداکثر اندازه دسته یا تکمیل دوره انتظار)، سپس یک دسته جدید آماده می شود و برای استنباط به مدل هل داده می شود. نمودار زیر دستهای پویا از درخواستها با طولهای توالی ورودی مختلف را نشان میدهد که با هم توسط مدل پردازش میشوند.

می توانید با پیکربندی کانتینر LMI، دسته بندی پویا را در SageMaker پیاده سازی کنید خدمت.خواص به شرح زیر است:

اگرچه دستهبندی پویا میتواند تا چهار برابر افزایش توان عملیاتی را در مقایسه با عدم دستهبندی فراهم کند، اما مشاهده میکنیم که استفاده از GPU در این مورد بهینه نیست زیرا تا زمانی که تمام درخواستها پردازش کامل نشده باشند، سیستم نمیتواند دسته دیگری را بپذیرد.

بچینگ مداوم

دسته بندی مداوم یک بهینه سازی خاص برای تولید متن است. توان عملیاتی را بهبود می بخشد و زمان را فدای تأخیر اول بایت نمی کند. بچینگ مداوم (همچنین به نام تکراری or بچینگ نورد) به چالش زمان GPU بیکار می پردازد و با فشار دادن مداوم درخواست های جدیدتر در دسته، از رویکرد دسته بندی پویا بیشتر استفاده می کند. نمودار زیر دسته بندی مداوم درخواست ها را نشان می دهد. هنگامی که پردازش درخواست های 2 و 3 به پایان می رسد، مجموعه دیگری از درخواست ها برنامه ریزی می شود.

نمودار تعاملی زیر عمیقتر به نحوه عملکرد دستهبندی پیوسته میپردازد.

(حسن نیت: https://github.com/InternLM/lmdeploy)

میتوانید از یک تکنیک قدرتمند برای کارآمد کردن LLM و تولید متن استفاده کنید: ذخیره برخی از ماتریسهای توجه. این به این معنی است که اولین پاس یک اعلان با پاس های رو به جلو بعدی متفاوت است. برای اولین پاس، شما باید کل ماتریس توجه را محاسبه کنید، در حالی که پیگیری ها فقط نیاز به محاسبه توجه نشانه جدید دارند. اولین پاس نامیده می شود پیش پر کردن در سراسر این پایه کد، در حالی که موارد بعدی فراخوانی می شوند کشف کردن. از آنجایی که prefill بسیار گرانتر از رمزگشایی است، ما نمی خواهیم همیشه آن را انجام دهیم، اما یک پرس و جو در حال اجرا احتمالاً در حال انجام رمزگشایی است. اگر میخواهیم از دستهبندی پیوسته همانطور که قبلا توضیح داده شد استفاده کنیم، باید در نقطهای پیشپر را اجرا کنیم تا ماتریس توجه مورد نیاز برای پیوستن به گروه رمزگشایی ایجاد شود.

این تکنیک ممکن است با استفاده مؤثر از GPUهای بیکار، امکان افزایش 20 برابری توان را در مقایسه با عدم دسته بندی فراهم کند.

شما می توانید پارامترهای زیر را به دقت تنظیم کنید serving.properties ظرف LMI برای استفاده از بچینگ پیوسته:

- موتور – موتور زمان اجرا کد. ارزش ها شامل

Python,DeepSpeed,FasterTransformerوMPI. استفاده ازMPIبرای فعال کردن بچینگ مداوم - رولینگ_بچ - دسته بندی در سطح تکرار را با استفاده از یکی از استراتژی های پشتیبانی شده فعال می کند. ارزش ها شامل

auto,schedulerوlmi-dist. ما استفاده می کنیمlmi-distبرای روشن کردن بچینگ پیوسته برای Llama 2. - max_rolling_batch_size - تعداد درخواست های همزمان را در دسته پیوسته محدود می کند. پیشفرض 32 است.

- max_rolling_batch_prefill_tokens - تعداد نشانهها را برای ذخیرهسازی محدود میکند. این باید بر اساس اندازه دسته و طول توالی ورودی تنظیم شود تا از حافظه GPU جلوگیری شود. فقط برای چه زمانی پشتیبانی می شود

rolling_batch=lmi-dist. توصیه ما این است که مقدار را بر اساس تعداد درخواست های همزمان x حافظه مورد نیاز برای ذخیره نشانه های ورودی و نشانه های خروجی در هر درخواست تنظیم کنید.

کد زیر نمونه ای برای serving.properties برای پیکربندی بچینگ پیوسته:

صفحه دسته بندی توجه

در فرآیند رمزگشایی اتورگرسیو، تمام نشانه های ورودی به LLM تانسورهای کلید توجه و ارزش خود را تولید می کنند و این تانسورها در حافظه GPU نگهداری می شوند تا توکن های بعدی تولید شوند. این تانسورهای کلید و مقدار ذخیره شده در حافظه پنهان اغلب به عنوان تانسور نامیده می شوند حافظه پنهان KV or حافظه پنهان توجه. طبق مقاله vLLM: سرویس دهی آسان، سریع و ارزان LLM با PagedAttention، حافظه نهان KV برای یک دنباله در Llama 1.7B تا 13 گیگابایت طول می کشد. همچنین پویا است. اندازه آن به طول توالی بستگی دارد که بسیار متغیر و غیرقابل پیش بینی است. در نتیجه، مدیریت کارآمد حافظه نهان KV چالش مهمی را به همراه دارد. این مقاله نشان داد که سیستم های موجود 60 تا 80 درصد حافظه را به دلیل تکه تکه شدن و رزرو بیش از حد هدر می دهند.

PagedAttention یک الگوریتم بهینهسازی جدید است که توسط UC Berkeley ایجاد شده است که با تخصیص حافظه در صفحات یا بلوکهای با اندازه ثابت، فرآیند دستهبندی پیوسته را با اجازه دادن به حافظه نهان توجه (کش KV) غیر پیوسته بهبود میبخشد. این الهام گرفته از حافظه مجازی و مفاهیم صفحه بندی مورد استفاده توسط سیستم عامل ها است.

طبق مقاله vLLM، حافظه پنهان توجه هر دنباله توکن ها به بلوک ها تقسیم می شود و از طریق یک جدول بلوک به بلوک های فیزیکی نگاشت می شود. در طول محاسبه توجه، یک هسته PagedAttention می تواند از جدول بلوک ها برای واکشی موثر بلوک ها از حافظه فیزیکی استفاده کند. این منجر به کاهش قابل توجه اتلاف حافظه می شود و به اندازه دسته بزرگتر، افزایش استفاده از GPU و توان عملیاتی بالاتر اجازه می دهد. شکل زیر پارتیشن کش توجه را به صفحات غیر پیوسته نشان می دهد.

نمودار زیر یک مثال استنتاج با PagedAttention را نشان می دهد. مراحل کلیدی عبارتند از:

- درخواست استنتاج با یک اعلان ورودی دریافت می شود.

- در مرحله پیش پر کردن، توجه محاسبه می شود و کلید-مقدارها در حافظه فیزیکی غیر پیوسته ذخیره می شوند و به بلوک های کلید-مقدار منطقی نگاشت می شوند. این نگاشت در یک جدول بلوک ذخیره می شود.

- اعلان ورودی از طریق مدل (یک پاس رو به جلو) اجرا می شود تا اولین نشانه پاسخ تولید شود. در طول تولید نشانه پاسخ، حافظه پنهان توجه از مرحله پیش پر کردن استفاده می شود.

- در طول تولید توکن بعدی، اگر بلوک فیزیکی فعلی پر باشد، حافظه اضافی به صورت غیر پیوسته تخصیص داده می شود که امکان تخصیص به موقع را فراهم می کند.

PagedAttention به استفاده تقریباً بهینه از حافظه و کاهش اتلاف حافظه کمک می کند. این اجازه می دهد تا درخواست های بیشتری با هم جمع شوند و در نتیجه افزایش قابل توجهی در توان استنتاج ایجاد می شود.

کد زیر یک نمونه است serving.properties برای پیکربندی دسته بندی PagedAttention در یک ظرف LMI در SageMaker:

چه زمانی از کدام تکنیک بچینگ استفاده کنیم

شکل زیر تکنیک های دسته بندی سمت سرور را به همراه نمونه خلاصه می کند serving.properties در LMI در SageMaker.

جدول زیر تکنیک های مختلف بچینگ و موارد استفاده از آنها را خلاصه می کند.

| PagedAttention Batching | بچینگ پیوسته | دسته بندی پویا | دسته بندی سمت مشتری | بدون دسته | |

| چگونه کار می کند | همیشه درخواست های جدید را در سطح نشانه به همراه بلوک های صفحه بندی شده ادغام کنید و استنتاج دسته ای انجام دهید. | همیشه درخواست جدید را در سطح نشانه ادغام کنید و استنتاج دسته ای انجام دهید. | ادغام درخواست جدید در سطح درخواست؛ می تواند چند میلی ثانیه به تاخیر بیاندازد تا یک دسته تشکیل شود. | کلاینت مسئول دسته بندی درخواست های استنتاج متعدد در یک محموله قبل از ارسال آن به سرور استنتاج است. | وقتی درخواستی رسید، استنتاج را فورا اجرا کنید. |

| زمانی که بهترین عملکرد را دارد | این رویکرد توصیه شده برای پشتیبانی مدل های فقط رمزگشا این برای بارهای کاری بهینه سازی شده مناسب است. این فقط برای مدل های تولید متن قابل اجرا است. | درخواستهای همزمان در زمانهای مختلف با استراتژی رمزگشایی یکسان ارائه میشوند. این برای بارهای کاری بهینه سازی شده مناسب است. این فقط برای مدل های تولید متن قابل اجرا است. | درخواستهای همزمان در زمانهای مختلف با استراتژی رمزگشایی یکسان ارائه میشوند. این برای بارهای کاری حساس به زمان پاسخگویی که نیاز به توان عملیاتی بالاتری دارند، مناسب است. این برای CV، NLP، و انواع دیگر مدل ها قابل اجرا است. | برای موارد استفاده از استنتاج آفلاین که محدودیت تأخیر برای به حداکثر رساندن توان عملیاتی ندارند، مناسب است. | درخواستهای استنتاج نادر یا درخواستهای استنتاج با استراتژیهای رمزگشایی مختلف. برای بارهای کاری با نیازهای تأخیر زمان پاسخگویی مناسب است. |

مقایسه توان عملیاتی تکنیکهای مختلف بچینگ برای یک مدل بزرگ تولیدی در SageMaker

ما معیار عملکرد را بر روی یک انجام دادیم Llama v2 7B مدل SageMaker با استفاده از یک ظرف LMI و تکنیک های مختلف دسته بندی که در این پست با درخواست های ورودی همزمان 50 و تعداد کل درخواست های 5,000 مورد بحث قرار گرفته است.

ما از سه دستور ورودی مختلف با طول های متغیر برای تست عملکرد استفاده کردیم. در دستهبندی پیوسته و PagedAttention، طول توکنهای خروجی برای سه دستور ورودی به ترتیب 64، 128 و 256 تنظیم شد. برای دسته بندی پویا، از طول توکن خروجی ثابت 128 توکن استفاده کردیم. ما نقاط پایانی SageMaker را برای آزمایش با نوع نمونه ml.g5.24xlarge به کار بردیم. جدول زیر شامل نتایج تست های ارزیابی عملکرد است.

| مدل | استراتژی بچینگ | درخواست در ثانیه در ml.g5.24xlarge |

| LLaMA2-7b | دسته بندی پویا | 3.24 |

| LLaMA2-7b | بچینگ پیوسته | 6.92 |

| LLaMA2-7b | PagedAttention Batching | 7.41 |

با استفاده از دستهبندی PagedAttention در مقایسه با دستهبندی پویا برای مدل Llama2.3-2B در SageMaker با استفاده از یک ظرف LMI، تقریباً 7 برابر افزایش توان عملیاتی را مشاهده میکنیم.

نتیجه

در این پست، تکنیکهای دستهبندی مختلف برای استنتاج LLM و چگونگی کمک به افزایش توان عملیاتی را توضیح دادیم. ما نشان دادیم که چگونه تکنیکهای بهینهسازی حافظه میتوانند کارایی سختافزار را با استفاده از دستهبندی پیوسته و PagedAttention افزایش دهند و مقادیر توان عملیاتی بالاتری نسبت به دستهبندی پویا ارائه دهند. با استفاده از دستهبندی PagedAttention در مقایسه با دستهبندی پویا برای مدل Llama2.3-2B در SageMaker با استفاده از ظرف LMI، تقریباً 7 برابر افزایش توان عملیاتی را شاهد بودیم. می توانید نوت بوک مورد استفاده برای آزمایش تکنیک های مختلف بچینگ را در آن پیدا کنید GitHub.

درباره نویسندگان

گاگان سینگ یک مدیر ارشد حساب فنی در AWS است که در آنجا با استارتاپهای بومی دیجیتالی شریک میشود تا مسیر آنها را به سمت موفقیت بیشتر در کسب و کار هموار کند. او با داشتن جایگاهی در پیشبرد ابتکارات یادگیری ماشینی، از Amazon SageMaker استفاده میکند، بهویژه بر راهحلهای یادگیری عمیق و هوش مصنوعی مولد تأکید میکند. گاگان در اوقات فراغت خود با پیاده روی در مسیرهای هیمالیا و غوطه ور شدن در ژانرهای مختلف موسیقی آرامش می یابد.

گاگان سینگ یک مدیر ارشد حساب فنی در AWS است که در آنجا با استارتاپهای بومی دیجیتالی شریک میشود تا مسیر آنها را به سمت موفقیت بیشتر در کسب و کار هموار کند. او با داشتن جایگاهی در پیشبرد ابتکارات یادگیری ماشینی، از Amazon SageMaker استفاده میکند، بهویژه بر راهحلهای یادگیری عمیق و هوش مصنوعی مولد تأکید میکند. گاگان در اوقات فراغت خود با پیاده روی در مسیرهای هیمالیا و غوطه ور شدن در ژانرهای مختلف موسیقی آرامش می یابد.

داوال پاتل یک معمار اصلی یادگیری ماشین در AWS است. او با سازمانهایی از شرکتهای بزرگ گرفته تا استارتآپهای متوسط در زمینه مشکلات مربوط به محاسبات توزیعشده و هوش مصنوعی کار کرده است. او بر روی یادگیری عمیق از جمله دامنه های NLP و Computer Vision تمرکز دارد. او به مشتریان کمک می کند تا به استنباط مدل با عملکرد بالا در SageMaker دست یابند.

داوال پاتل یک معمار اصلی یادگیری ماشین در AWS است. او با سازمانهایی از شرکتهای بزرگ گرفته تا استارتآپهای متوسط در زمینه مشکلات مربوط به محاسبات توزیعشده و هوش مصنوعی کار کرده است. او بر روی یادگیری عمیق از جمله دامنه های NLP و Computer Vision تمرکز دارد. او به مشتریان کمک می کند تا به استنباط مدل با عملکرد بالا در SageMaker دست یابند.

Venugopal Pai یک معمار راه حل در AWS است. او در بنگالورو، هند زندگی می کند و به مشتریان بومی دیجیتال کمک می کند تا برنامه های خود را در AWS مقیاس و بهینه کنند.

Venugopal Pai یک معمار راه حل در AWS است. او در بنگالورو، هند زندگی می کند و به مشتریان بومی دیجیتال کمک می کند تا برنامه های خود را در AWS مقیاس و بهینه کنند.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://aws.amazon.com/blogs/machine-learning/improve-throughput-performance-of-llama-2-models-using-amazon-sagemaker/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 000

- 1

- 100

- 116

- 118

- 12

- 14

- 150

- 17

- 237

- 32

- 50

- 67

- 7

- 8

- 80

- 9

- 97

- a

- قادر

- شتاب دهنده

- شتاب دهنده ها

- پذیرفتن

- دسترسی

- تطبیق

- مطابق

- حساب

- رسیدن

- اضافه

- اضافی

- نشانی

- آدرس

- اتخاذ

- مزیت - فایده - سود - منفعت

- AI

- AL

- الگوریتم

- معرفی

- اختصاص داده شده است

- تخصیص

- اجازه دادن

- اجازه دادن

- اجازه می دهد تا

- در امتداد

- همچنین

- آمازون

- آمازون SageMaker

- آمازون خدمات وب

- مقدار

- an

- تحلیل

- و

- دیگر

- مربوط

- برنامه های کاربردی

- روش

- تقریبا

- هستند

- وارد می شود

- مصنوعی

- هوش مصنوعی

- AS

- At

- توجه

- بطور خودکار

- در دسترس

- اجتناب از

- AWS

- به عقب

- پهنای باند

- پایه

- مستقر

- BE

- پرتو

- زیرا

- قبل از

- بودن

- باور

- معیار

- برکلی

- مسدود کردن

- بلاک ها

- بالا بردن

- شکستن

- می سازد

- کسب و کار

- اما

- by

- مخزن

- نام

- CAN

- ظرفیت

- مورد

- موارد

- به چالش

- چالش ها

- تغییر دادن

- تبادل

- ارزان

- تراشه

- مشتری

- مشتریان

- رمز

- پایه کد

- ترکیب

- آینده

- عموما

- مقایسه

- مقایسه

- تکمیل شده

- اتمام

- محاسبه

- محاسبه

- کامپیوتر

- چشم انداز کامپیوتر

- محاسبه

- قدرت پردازش

- مفاهیم

- رقیب

- استوار

- شامل

- محدودیت ها

- مصرف

- ظرف

- ظروف

- شامل

- محتوا

- مداوم

- به طور مداوم

- گفتگو

- هزینه

- مقرون به صرفه

- همراه

- ایجاد

- جاری

- در حال حاضر

- مشتری

- مشتریان

- داده ها

- رمز گشایی

- عمیق

- یادگیری عمیق

- عمیق تر

- به طور پیش فرض

- پیش فرض

- تاخیر

- بستگی دارد

- مستقر

- مطلوب

- توسعه

- دستگاه

- مختلف

- مشکل

- دیجیتال

- بحث و تبادل نظر

- بحث کردیم

- توزیع شده

- محاسبات توزیع شده

- توزیع

- مختلف

- do

- نمی کند

- عمل

- حوزه

- آیا

- پایین

- دو

- در طی

- پویا

- بطور پویا

- E&T

- هر

- ساده

- به طور موثر

- بهره وری

- موثر

- موثر

- هر دو

- با تاکید بر

- قادر ساختن

- را قادر می سازد

- موتور

- شرکت

- تمام

- به خصوص

- حتی

- هر

- بررسی می کند

- مثال

- مثال ها

- تجاوز

- مهیج

- اعدام

- موجود

- گران

- تجارب

- توضیح دهید

- توضیح داده شده

- چهره

- روش

- FAST

- تغذیه

- کمی از

- شکل

- سرانجام

- پیدا کردن

- پیدا می کند

- پایان

- نام خانوادگی

- تمرکز

- پیروی

- به دنبال آن است

- رد پا

- برای

- فرم

- به جلو

- یافت

- پایه

- تکه تکه شدن

- رایگان

- از جانب

- کامل

- کاملا

- بیشتر

- تولید می کنند

- تولید

- تولید می کند

- مولد

- نسل

- مولد

- هوش مصنوعی مولد

- GIF

- GitHub

- هدف

- GPU

- GPU ها

- حریص

- گروه

- دستگیره

- سخت افزار

- آیا

- he

- بالا بردن

- کمک

- کمک می کند

- زیاد

- بالاتر

- بالاترین

- نماد

- خیلی

- خود را

- چگونه

- چگونه

- HTML

- HTTPS

- صورت در آغوش گرفته

- ایده ها

- آرام

- if

- نشان می دهد

- تصاویر

- بلافاصله

- عظیم

- انجام

- پیاده سازی می کند

- بهبود

- بهبود یافته

- ارتقاء

- را بهبود می بخشد

- in

- شامل

- شامل

- از جمله

- وارد شونده

- افزایش

- افزایش

- افزایش

- مستقل

- هندوستان

- تورم

- نقطه عطف

- ابتکارات

- ورودی

- الهام بخش

- نمونه

- اطلاعات

- تعاملی

- در ارتباط بودن

- به

- گرفتار

- IT

- ITS

- پیوستن

- JPG

- نگه داشته شد

- کلید

- شناخته شده

- زبان

- بزرگ

- شرکت های بزرگ

- بزرگتر

- تاخیر

- یادگیری

- طول

- سطح

- اهرم ها

- کتابخانه ها

- پسندیدن

- محدود شده

- محدودیت

- زندگی

- پشم لاما

- LLM

- بار

- بارگیری

- منطق

- منطقی

- طولانی

- نگاه کنيد

- دستگاه

- فراگیری ماشین

- اصلی

- ساخت

- ساخت

- مدیریت

- مدیر

- مدیریت

- نقشه برداری

- نشانگر

- عظیم

- ماتریس

- بیشینه ساختن

- به حداکثر رساندن

- بیشترین

- ممکن است..

- به معنی

- مکانیزم

- دیدار

- نشست

- حافظه

- ادغام کردن

- با

- متا

- روش

- میلی ثانیه

- کاهش

- ML

- مدل

- مدل

- بیش

- اکثر

- بسیار

- چندگانه

- موسیقی

- بومی

- طبیعی

- پردازش زبان طبیعی

- نیاز

- ضروری

- نیازمند

- نیازهای

- جدید

- بعد

- تو رفتگی در دیوار

- nlp

- نه

- دفتر یادداشت

- عدد

- کارت گرافیک Nvidia

- مشاهده کردن

- of

- آنلاین نیست.

- غالبا

- on

- ONE

- فقط

- عملیاتی

- سیستم های عامل

- بهینه

- بهینه سازی

- بهینه سازی

- بهینه سازی

- گزینه

- or

- سفارش

- سازمان های

- دیگر

- ما

- خارج

- تولید

- روی

- غلبه بر

- صفحات

- مقاله

- پارامترهای

- بخش

- ویژه

- شرکای

- عبور

- عبور می کند

- مسیر

- سنگفرش

- برای

- کارایی

- انجام

- دوره

- فاز

- فیزیکی

- افلاطون

- هوش داده افلاطون

- PlatoData

- نقطه

- بخشی

- مطرح

- پست

- قدرت

- صفحه اصلی

- قوی

- پیش بینی

- پیش بینی

- پیش بینی

- پیش بینی می کند

- آماده شده

- در حال حاضر

- هدیه

- جلوگیری

- قبلی

- قبلا

- اصلی

- شاید

- مشکلات

- روند

- فرآوری شده

- در حال پردازش

- تولید کردن

- ساخته

- برجسته

- پیشران

- ارائه

- ارائه

- تحت فشار قرار دادند

- هل دادن

- پــایتــون

- درجه دوم

- محدوده

- اعم

- رسیده

- اخذ شده

- دریافت

- دریافت

- توصیه

- توصیه می شود

- كاهش دادن

- کاهش

- اشاره

- اشاره دارد

- مربوط

- نسبی

- درخواست

- درخواست

- نیاز

- ضروری

- نیاز

- منابع

- به ترتیب

- پاسخ

- مسئوليت

- محدود کننده

- نتیجه

- نتیجه

- نتایج

- عودت

- دویدن

- در حال اجرا

- اجرا می شود

- قربانی

- حکیم ساز

- همان

- دید

- مقیاس

- مقیاس گذاری

- برنامه ریزی

- زمان بندی

- جستجو

- دوم

- بخش

- دیدن

- انتخاب شد

- در حال ارسال

- می فرستد

- ارشد

- جداگانه

- دنباله

- خدمت

- سرور

- خدمات

- خدمت

- تنظیم

- تنظیمات

- نشان

- نشان داد

- نشان داده شده

- نشان می دهد

- طرف

- قابل توجه

- تنها

- اندازه

- کند

- So

- راه حل

- مزایا

- برخی از

- خاص

- مشخص شده

- راه افتادن

- نوپا

- دولت

- اقامت

- گام

- مراحل

- opbevare

- ذخیره شده

- داستان

- استراتژی ها

- استراتژی

- سخت

- متعاقب

- قابل توجه

- موفقیت

- چنین

- مناسب

- پشتیبانی

- سیستم

- سیستم های

- جدول

- طول می کشد

- مصرف

- هدف

- اهداف

- وظایف

- فنی

- تکنیک

- آزمون

- تست

- تست

- متن

- نسبت به

- که

- La

- بلوک

- شان

- آنها

- سپس

- در نتیجه

- اینها

- این

- سه

- از طریق

- سراسر

- توان

- محکم

- زمان

- حساس به زمان

- بار

- به

- با هم

- رمز

- نشانه

- بالا

- جمع

- آموزش دیده

- نقل و انتقالات

- ترانسفورماتور

- عطف

- دو

- نوع

- انواع

- به طور معمول

- فهمیدن

- غیرقابل پیش بینی

- تا

- استفاده

- استفاده کنید

- استفاده

- کاربر

- با استفاده از

- استفاده می کند

- با استفاده از

- ارزش

- ارزشها

- متغیر

- وسیع

- فیلم های

- مجازی

- دید

- منتظر

- می خواهم

- ضایعات

- we

- وب

- خدمات وب

- بود

- چه زمانی

- در حالیکه

- که

- در حین

- بطور گسترده

- اراده

- با

- در داخل

- مشغول به کار

- با این نسخهها کار

- نوشته

- X

- شما

- زفیرنت